Щоб поділитися магією DALL E 2 з широкою аудиторією нам потрібно було зменшити ризики, пов’язані з потужними моделями генерації зображень. Для цього ми ставимо різні огорожі на місці, щоб запобігти порушенню створених зображень політика щодо вмісту. Ця публікація присвячена пом'якшення наслідків перед підготовкою, підмножина цих огорож, які безпосередньо змінюють дані, з яких DALL·E 2 навчається. Зокрема, DALL·E 2 навчається на сотнях мільйонів зображень із підписами в Інтернеті, і ми видаляємо та переглядаємо деякі з цих зображень, щоб змінити те, що вивчає модель.

Ця публікація складається з трьох розділів, у кожному з яких описується різне пом’якшення перед тренуванням:

- У першому розділі ми описуємо, як ми відфільтрували насильницькі та сексуальні зображення з навчального набору даних DALL·E 2. Без цього пом’якшення модель навчилася б створювати графічні або відверті зображення, коли їх запитали, і навіть могла б ненавмисно повертати такі зображення у відповідь на, здавалося б, нешкідливі підказки.

- У другому розділі ми знаходимо, що фільтрування навчальних даних може посилити упередження, і описуємо нашу техніку пом’якшення цього ефекту. Наприклад, без цього пом’якшення ми помітили, що моделі, навчені на основі відфільтрованих даних, іноді генерували більше зображень чоловіків і менше зображень жінок порівняно з моделями, навченими на вихідному наборі даних.

- У останньому розділі ми звернемося до питання запам’ятовування, виявивши, що такі моделі, як DALL·E 2, іноді можуть відтворювати зображення, на яких вони навчалися, а не створювати нові зображення. На практиці ми виявили, що це регургітація зображення викликано зображеннями, які багато разів копіюються в наборі даних, і пом’якшіть проблему, видаливши зображення, які візуально схожі на інші зображення в наборі даних.

Зменшення графічних і явних навчальних даних

Оскільки дані навчання формують можливості будь-якої вивченої моделі, фільтрація даних є потужним інструментом для обмеження небажаних можливостей моделі. Ми застосували цей підхід до двох категорій — зображень із зображенням насильства та сексуального вмісту — за допомогою класифікаторів для фільтрації зображень у цих категоріях із набору даних перед навчанням DALL·E 2. Ми навчили ці класифікатори зображень у компанії та продовжуємо вивчати вплив фільтрації набору даних на нашу навчену модель.

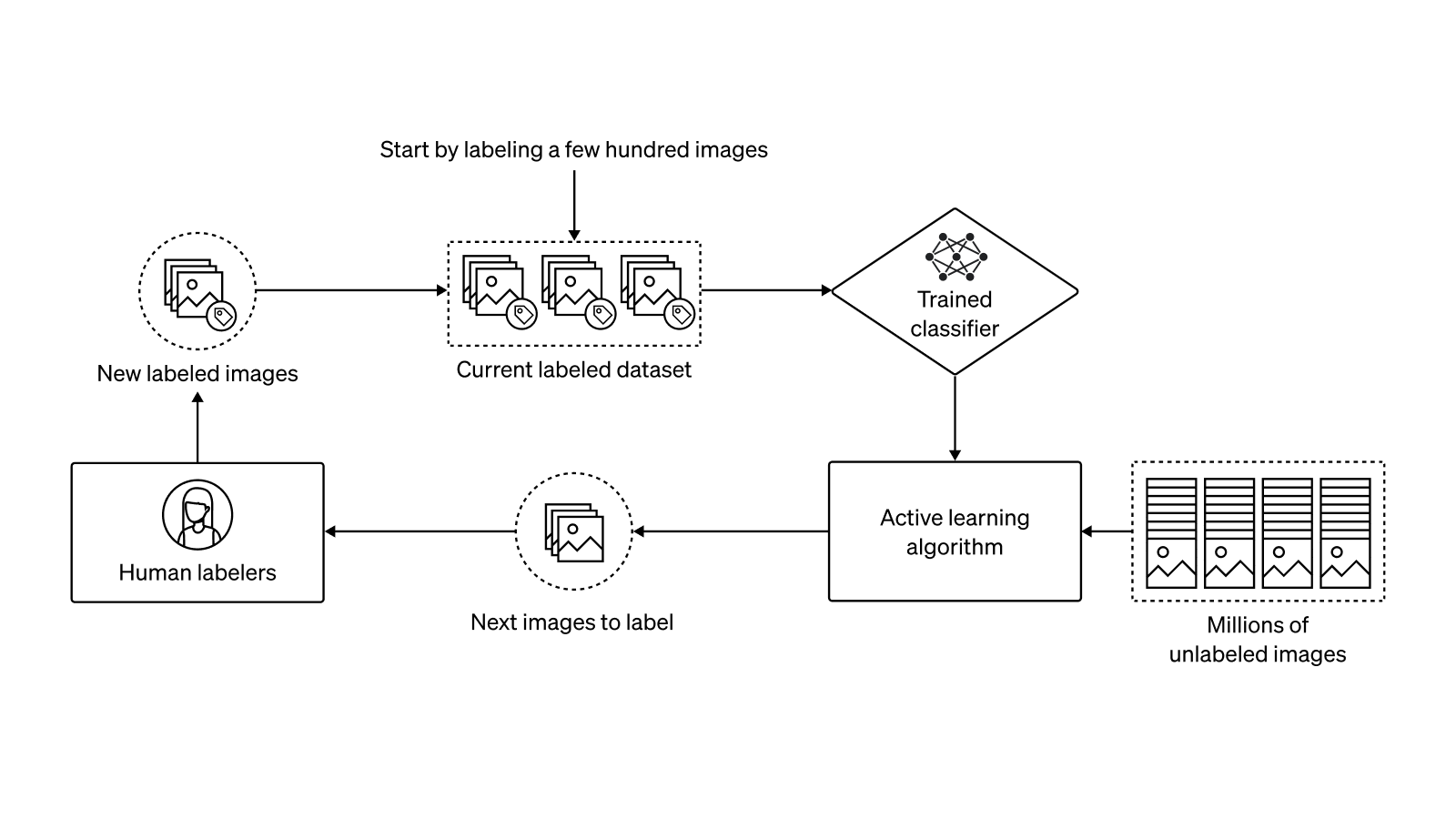

Щоб навчити наші класифікатори зображень, ми повторно використали підхід, який раніше використовували для фільтрації навчальних даних для ГЛИД. Основні кроки цього підходу такі: спочатку ми створюємо специфікацію для категорій зображень, які ми хочемо позначити; по-друге, ми збираємо кілька сотень позитивних і негативних прикладів для кожної категорії; по-третє, ми використовуємо процедуру активного навчання, щоб зібрати більше даних і покращити компроміс між точністю та запам’ятовуванням; і, нарешті, ми запускаємо отриманий класифікатор на всьому наборі даних із консервативним порогом класифікації, щоб віддати перевагу запам’ятовуванню над точністю. Щоб встановити ці пороги, ми визначили пріоритетність фільтрації всіх поганий дані про залишення у всіх добре даних. Це тому, що ми завжди можемо налаштувати нашу модель за допомогою додаткових даних пізніше, щоб навчити її новому, але набагато важче змусити модель забути те, чого вона вже навчилася.

Під час фази активного навчання ми неодноразово вдосконалювали наші класифікатори, збираючи людські мітки для потенційно складних або неправильно класифікованих зображень. Примітно, що ми використовували дві методики активного навчання, щоб вибрати зображення з нашого набору даних (який містить сотні мільйонів немаркованих зображень) для представлення людям для маркування. По-перше, щоб зменшити рівень хибних позитивних результатів нашого класифікатора (тобто частоту, з якою він неправильно класифікує доброякісне зображення як насильницьке чи сексуальне), ми присвоїли людські мітки зображенням, які поточна модель класифікувала як позитивні. Щоб цей крок добре спрацював, ми налаштували наш поріг класифікації на майже 100% запам’ятовування, але високий рівень хибнопозитивних результатів; Таким чином, наші маркувальники в основному позначали справді негативні випадки. Незважаючи на те, що ця техніка допомагає зменшити помилкові спрацьовування та зменшує необхідність переглядати потенційно шкідливі зображення для етикетників, вона не допомагає знайти більше позитивних випадків, які зараз відсутні в моделі.

Щоб зменшити частоту хибно негативних результатів нашого класифікатора, ми застосували другий метод активного навчання: пошук найближчого сусіда. Зокрема, ми провели багаторазову перехресну перевірку, щоб знайти позитивні зразки в нашому поточному позначеному наборі даних, які модель неправильно класифікувала як негативні (щоб зробити це, ми буквально навчили сотні версій класифікатора з різними розподілами перевірки курсу). Потім ми просканували нашу велику колекцію немічених зображень на пошук найближчих сусідів цих зразків у перцептивному просторі ознак і присвоїли людські мітки виявленим зображенням. Завдяки нашій обчислювальній інфраструктурі було нескладно розширити як навчання класифікаторів, так і пошук найближчих сусідів для багатьох графічних процесорів, дозволяючи етапу активного навчання відбуватися протягом кількох хвилин, а не годин чи днів.

Щоб перевірити ефективність наших фільтрів даних, ми навчили дві моделі GLIDE з однаковими гіперпараметрами: одна на невідфільтрованих даних, а друга на наборі даних після фільтрації. Ми називаємо попередню модель як нефільтрована модель, а останнє як фільтрована модель. Як і очікувалося, ми виявили, що нефільтрована модель зазвичай створювала менше відвертого або графічного вмісту у відповідь на запити такого вмісту. Однак ми також виявили несподіваний побічний ефект фільтрації даних: воно створювало або посилювало упередження моделі щодо певних демографічних показників.

Фіксація зміщень, запроваджена фільтрами даних

Генеративні моделі намагаються узгодити розподіл своїх навчальних даних, включаючи будь-які упередження в них. Як наслідок, фільтрація навчальних даних потенційно може створити або посилити зміщення в подальших моделях. Загалом, виправлення помилок у вихідному наборі даних є складним соціотехнічним завданням, яке ми продовжуємо вивчати, і воно виходить за рамки цієї публікації. Проблема, яку ми тут розглядаємо, полягає в посиленні упереджень, спричинених саме фільтрацією даних. Завдяки нашому підходу ми прагнемо запобігти відфільтрованій моделі більше упереджено, ніж нефільтрована модель, істотно зменшуючи зсув розподілу, спричинений фільтрацією даних.

Як конкретний приклад посилення зміщення через фільтрацію, розглянемо підказку «виконавчий директор». Коли наша нефільтрована модель генерувала зображення для цього запиту, вона, як правило, створювала більше зображень чоловіків, ніж жінок, і ми очікуємо, що більша частина цього упередження є відображенням наших поточних даних навчання. Однак, коли ми запустили ту саму підказку через нашу відфільтровану модель, зміщення виявилося посиленим; покоління були майже виключно образами людей.

Ми припускаємо, що цей окремий випадок посилення упередженості походить з двох причин: по-перше, навіть якщо жінки та чоловіки мають приблизно однакове представництво у вихідному наборі даних, набір даних може бути упередженим у бік представлення жінок у більш сексуальному контексті; і по-друге, самі наші класифікатори можуть бути упередженими або через реалізацію, або через визначення класу, незважаючи на наші зусилля переконатися, що цього не було на етапах збору даних і перевірки. Завдяки обом цим ефектам наш фільтр може видалити більше зображень жінок, ніж чоловіків, що змінює гендерне співвідношення, яке модель спостерігає під час навчання.

Щоб більш ретельно дослідити упередженість, спричинену фільтрами, ми хотіли знайти спосіб виміряти, наскільки наші фільтри даних впливають на упередженість щодо різних концепцій. Примітно, що наші фільтри насильства та сексуального вмісту засновані виключно на зображеннях, але мультимодальний характер нашого набору даних дозволяє нам безпосередньо вимірювати вплив цих фільтрів на текст. Оскільки кожне зображення супроводжується текстовим підписом, ми змогли переглянути відносну частоту вибраних вручну ключових слів у відфільтрованих і нефільтрованих наборах даних, щоб оцінити, наскільки фільтри впливають на певну концепцію.

Щоб застосувати це на практиці, ми використали Apache Spark для обчислення частот кількох ключових слів (наприклад, «батько», «жінка», «дитина») для всіх підписів у наших відфільтрованих і невідфільтрованих наборах даних. Незважаючи на те, що наш набір даних містить сотні мільйонів пар текст-зображення, обчислення цих частот ключових слів зайняло лише кілька хвилин за допомогою нашого обчислювального кластера.

Після обчислення частоти ключових слів ми змогли підтвердити, що наші фільтри набору даних справді спотворювали частоти певних ключових слів більше, ніж інших. Наприклад, фільтри знизили частотність слова «жінка» на 14%, а частотність слова «чоловік» – лише на 6%. Це підтвердило, у великому масштабі, те, що ми вже неодноразово спостерігали, беручи вибірку з моделей GLIDE, навчених на обох наборах даних.

Тепер, коли у нас був проксі-сервер для вимірювання зміщення, спричиненого фільтрами, нам потрібен був спосіб пом’якшити його. Щоб вирішити цю проблему, ми мали на меті змінити вагу відфільтрованого набору даних, щоб його розподіл краще відповідав розподілу нефільтрованих зображень. Як іграшковий приклад для ілюстрації цієї ідеї припустімо, що наш набір даних складається з 50% фотографій котів і 50% фотографій собак, але наші фільтри даних видаляють 75% собак, але лише 50% котів. Остаточним набором даних буде ⅔ котів і ⅓ собак, і генеративна модель на основі ймовірності, навчена на цьому наборі даних, швидше за все, створить більше зображень котів, ніж собак. Ми можемо виправити цей дисбаланс, помноживши втрату тренування кожного зображення собаки на 2, імітуючи ефект повторення кожного зображення собаки двічі. Виявляється, ми можемо масштабувати цей підхід до наших реальних наборів даних і моделей значною мірою автоматичним способом, тобто нам не потрібно вручну вибирати функції, які ми хочемо перезважити.

Ми обчислюємо ваги для зображень у відфільтрованому наборі даних, використовуючи ймовірності зі спеціального класифікатора, подібного до підходу, який використовує Choi та ін. (2019). Щоб навчити цей класифікатор, ми рівномірно відбираємо зображення з обох наборів даних і прогнозуємо, з якого набору даних отримано зображення. Зокрема, ця модель прогнозує P(нефільтроване|зображення), враховуючи попередній P (нефільтроване) = 0.5. На практиці ми не хочемо, щоб ця модель була надто потужною, інакше вона може засвоїти точну функцію, реалізовану нашими фільтрами. Натомість ми хочемо, щоб модель була плавнішою, ніж наші оригінальні фільтри даних, охоплюючи широкі категорії, на які впливають фільтри, але все ще не впевнені, чи буде відфільтровано конкретне зображення чи ні. З цією метою ми тренували лінійний зонд поверх невеликого CLIP модель.

Коли у нас є класифікатор, який передбачає ймовірність того, що зображення походить із невідфільтрованого набору даних, нам все одно потрібно перетворити цей прогноз у вагу для зображення. Наприклад, припустимо, що P(нефільтроване|зображення) = 0.8. Це означає, що вибірка в 4 рази більша ймовірність знайти її в невідфільтрованих даних, ніж у відфільтрованих даних, і вага 4 має виправити дисбаланс. Загалом, ми можемо використовувати вагу P(нефільтроване|зображення)/P(відфільтроване|зображення).[1]

Наскільки ця схема перезважування насправді пом’якшує посилене зміщення? Коли ми налаштували нашу попередню відфільтровану модель за новою схемою зважування, поведінка налаштованої моделі набагато більше відповідала невідфільтрованій моделі на прикладах упередженості, які ми знайшли раніше. Хоча це надихало, ми також хотіли більш ретельно оцінити це пом’якшення за допомогою нашої евристики зміщення на основі ключових слів. Щоб виміряти частоту ключових слів, враховуючи нашу нову схему зважування, ми можемо просто зважити кожен екземпляр ключового слова у відфільтрованому наборі даних за вагою вибірки, яка його містить. Роблячи це, ми отримуємо новий набір частот ключових слів, які відображають ваги вибірки у відфільтрованому наборі даних.

У більшості ключових слів, які ми перевірили, схема перезважування зменшила зміну частоти, спричинену фільтрацією. Для наших попередніх прикладів «чоловік» і «жінка» відносне зниження частоти становило 1% і –1%, тоді як їхні попередні значення становили 14% і 6% відповідно. Хоча цей показник є лише проміжним показником фактичного зміщення фільтрації, заспокоює те, що наша схема перезважування на основі зображень фактично значно покращує текстовий показник.

Ми продовжуємо досліджувати залишкові упередження в DALL·E 2, частково шляхом ширших оцінок поведінки моделі та дослідження того, як фільтрація вплинула на упередження та розвиток можливостей.

Запобігання регургітації зображення

Ми помітили, що наші внутрішні попередники DALL·E 2 іноді відтворювали навчальні зображення дослівно. Така поведінка була небажаною, оскільки ми хотіли б, щоб DALL·E 2 за замовчуванням створював оригінальні, унікальні зображення, а не просто «зшивав» фрагменти існуючих зображень. Крім того, дослівне відтворення навчальних зображень може викликати юридичні питання щодо порушення авторських прав, власності та конфіденційності (якщо фотографії людей були присутні в навчальних даних).

Щоб краще зрозуміти проблему регургітації зображень, ми зібрали набір даних підказок, які часто призводили до дублювання зображень. Для цього ми використали навчену модель для вибірки зображень для 50,000 50 підказок із нашого навчального набору даних і відсортували зразки за перцептивною подібністю до відповідного навчального зображення. Нарешті, ми перевірили найпопулярніші збіги вручну, знайшовши лише кілька сотень правдивих дублюючих пар із 1 тисяч запитів. Незважаючи на те, що частота регургітації була меншою за 0%, ми вважали за необхідне знизити частоту до XNUMX з причин, зазначених вище.

Коли ми вивчали наш набір даних вивергнутих зображень, ми помітили дві моделі. По-перше, майже всі зображення являли собою просту векторну графіку, яку, швидше за все, було легко запам’ятати через низький вміст інформації. По-друге, і що важливіше, всі зображення мали багато майже дублікатів у навчальному наборі даних. Наприклад, може бути векторна графіка, яка виглядає як годинник, який показує час 1 годину, але тоді ми виявимо навчальний зразок, який містить той самий годинник, який показує 2 години, а потім 3 години тощо. ми зрозуміли це, ми використали розподілений пошук найближчого сусіда, щоб перевірити, що справді всі вивернуті зображення мали перцепційно схожі дублікати в наборі даних. Інше працює спостерігали подібне явище у великих мовних моделях, виявивши, що дублювання даних тісно пов’язане із запам’ятовуванням.

Наведені вище висновки свідчать про те, що якщо ми дедуплікуємо наш набір даних, ми можемо вирішити проблему регургітації. Щоб досягти цього, ми планували використовувати нейронну мережу для ідентифікації груп зображень, які виглядають схожими, а потім видалити всі зображення, крім одного, з кожної групи.[2] Однак для цього знадобиться перевірити кожне зображення, чи є воно дублікатом будь-якого іншого зображення в наборі даних. Оскільки весь наш набір даних містить сотні мільйонів зображень, нам наївно потрібно буде перевірити сотні квадрильйонів пар зображень, щоб знайти всі дублікати. Хоча це технічно доступно, особливо на великому обчислювальному кластері, ми знайшли набагато ефективнішу альтернативу, яка працює майже так само добре за невелику частину вартості.

Подумайте, що станеться, якщо кластеризувати наш набір даних перед виконанням дедуплікації. Оскільки сусідні зразки часто потрапляють в один кластер, більшість пар-дублікатів не перетинатимуть межі кластерних рішень. Тоді ми могли б дедуплікати зразків у кожному кластері, не перевіряючи наявність дублікатів за межами кластера, пропускаючи лише невелику частину всіх пар дублікатів. Це набагато швидше, ніж наївний підхід, оскільки нам більше не потрібно перевіряти кожну окрему пару зображень.[3] Коли ми емпірично перевірили цей підхід на невеликій підмножині наших даних, було виявлено 85% усіх дублюючих пар при використанні K = 1024 кластери.

Щоб підвищити рівень успіху наведеного вище алгоритму, ми використали одне ключове спостереження: коли ви кластеризуєте різні випадкові підмножини набору даних, кінцеві межі рішень кластера часто сильно відрізняються. Таким чином, якщо повторювана пара перетинає межу кластера для однієї кластеризації даних, та сама пара може потрапити в один кластер в іншій кластеризації. Чим більше кластеризації ви спробуєте, тим більша ймовірність виявити певну пару-дублікат. На практиці ми зупинилися на використанні п’яти кластерів, що означає, що ми шукаємо дублікати кожного зображення в об’єднанні п’яти різних кластерів. На практиці це виявило 97% усіх дублюючих пар у підмножині наших даних.

Дивно, але майже чверть нашого набору даних було видалено за допомогою дедуплікації. Коли ми подивилися на знайдені майже повторювані пари, багато з них містили значні зміни. Згадайте приклад годинника вище: набір даних може включати багато зображень того самого годинника в різний час доби. Хоча ці зображення, швидше за все, змусять модель запам’ятати зовнішній вигляд цього конкретного годинника, вони також можуть допомогти моделі навчитися розрізняти час доби на годиннику. Зважаючи на те, скільки даних було видалено, ми хвилювалися, що видалення таких зображень могло вплинути на продуктивність моделі.

Щоб перевірити вплив дедуплікації на наші моделі, ми навчили дві моделі з ідентичними гіперпараметрами: одну на повному наборі даних, а іншу на дедуплікованій версії набору даних. Щоб порівняти моделі, ми використали ті самі людські оцінки, що й для оцінки нашої оригінальної моделі GLIDE. Дивно, але ми виявили, що люди оцінюють незначно переважним модель тренувалася на дедуплікованих даних, що свідчить про те, що велика кількість зайвих зображень у наборі даних насправді негативно впливає на продуктивність.

Після того, як у нас була модель, навчена на дедуплікованих даних, ми повторно запустили пошук регургітації, який раніше виконали понад 50 тисяч підказок із навчального набору даних. Ми виявили, що нова модель ніколи не повертала навчальне зображення, коли отримувала точну підказку для зображення з навчального набору даних. Щоб зробити цей тест ще одним кроком далі, ми також виконали пошук найближчих сусідів у всьому навчальному наборі даних для кожного з 50 тисяч згенерованих зображень. Таким чином ми думали, що ми можемо вловити модель, яка викидає інше зображення, ніж те, що пов’язане з заданою підказкою. Навіть після цієї більш ретельної перевірки ми жодного разу не виявили випадків регургітації зображення.

Наступні кроки

Хоча всі описані вище засоби пом’якшення є значним прогресом у досягненні нашої мети щодо зменшення ризиків, пов’язаних із DALL·E 2, кожне пом’якшення ще має місце для покращення:

- Кращі фільтри попереднього навчання можуть дозволити нам навчити DALL·E 2 на більшій кількості даних і потенційно ще більше зменшити зміщення в моделі. Наші поточні фільтри налаштовані на низький рівень помилок ціною багатьох помилкових спрацьовувань. У результаті ми відфільтрували приблизно 5% усього нашого набору даних, хоча більшість цих відфільтрованих зображень взагалі не порушують нашу політику щодо вмісту. Удосконалення наших фільтрів може дозволити нам повернути деякі з цих навчальних даних.

- Зміщення вводиться та потенційно посилюється на багатьох етапах розробки та розгортання системи. Оцінка та пом’якшення зміщення в таких системах, як DALL·E 2, і шкоди, спричиненої цим зміщенням, є важливою міждисциплінарною проблемою, яку ми продовжуємо вивчати в OpenAI як частину нашої ширшої місії. Наша робота над цим включає створення оцінок для кращого розуміння проблеми, підбір нових наборів даних і застосування таких методів, як людський відгук і тонке налаштування для створення більш надійних і репрезентативних технологій.

- Також важливо, щоб ми продовжували вивчати запам’ятовування та узагальнення в системах глибокого навчання. Хоча дедуплікація є хорошим першим кроком до запобігання запам’ятовуванню, вона не говорить нам усього, що можна дізнатися про те, чому або як моделі, такі як DALL·E 2, запам’ятовують навчальні дані.

- 000

- 2019

- a

- МЕНЮ

- рахунки

- Achieve

- через

- активний

- адреса

- зачіпає

- алгоритм

- ВСІ

- Дозволити

- дозволяє

- вже

- альтернатива

- завжди

- кількість

- Інший

- з'явився

- прикладної

- Застосування

- підхід

- навколо

- призначений

- асоційований

- аудиторія

- оскільки

- перед тим

- буття

- Краще

- між

- За

- будувати

- Створюємо

- можливості

- Підписи

- випадок

- випадків

- Залучайте

- Категорія

- викликаний

- певний

- зміна

- контроль

- Вибирати

- клас

- класифікація

- класифікований

- годинник

- збір

- порівняний

- обчислення

- обчислення

- концепція

- Вважати

- містить

- зміст

- контексти

- продовжувати

- авторське право

- порушення авторських прав

- Відповідний

- може

- створювати

- створений

- створення

- вирішальне значення

- Поточний

- В даний час

- дані

- день

- Днів

- рішення

- глибокий

- Демографічна

- розгортання

- описувати

- Незважаючи на

- розробка

- різний

- важкий

- безпосередньо

- відкрити

- відкритий

- відстань

- розподілений

- розподіл

- вниз

- дублікати

- під час

- кожен

- ефект

- фактично

- ефективність

- ефекти

- ефективний

- зусилля

- заохочення

- особливо

- по суті

- оцінити

- і т.д.

- оцінювати

- все

- приклад

- Приклади

- виключно

- існуючий

- очікувати

- очікуваний

- швидше

- особливість

- риси

- зворотний зв'язок

- Рисунок

- фільтрація

- Фільтри

- в кінці кінців

- виявлення

- Перший

- виправляти

- фокусується

- слідує

- знайдений

- від

- Повний

- функція

- далі

- збір

- Стать

- Загальне

- в цілому

- породжувати

- генерується

- покоління

- покоління

- генеративний

- мета

- добре

- Графічні процесори

- графіка

- Group

- Групи

- гарантований

- жменя

- допомога

- допомагає

- тут

- Високий

- Як

- Однак

- HTTPS

- людина

- Людей

- Сотні

- ідея

- ідентифікувати

- зображення

- зображень

- реалізація

- реалізовані

- важливо

- удосконалювати

- поліпшений

- поліпшення

- включати

- включені

- includes

- У тому числі

- інформація

- Інфраструктура

- екземпляр

- інтернет

- дослідити

- питання

- IT

- сам

- ключ

- етикетка

- маркування

- етикетки

- мова

- великий

- більше

- УЧИТЬСЯ

- вчений

- вивчення

- легальний

- Ймовірно

- подивитися

- подивився

- зробити

- позначити

- матч

- значущим

- засоби

- вимір

- вимір

- люди

- може бути

- військовий

- мільйони

- Місія

- модель

- Моделі

- більше

- найбільш

- множення

- природа

- необхідно

- негативний

- мережу

- номер

- порядок

- Організований

- оригінал

- Інше

- власність

- частина

- приватність

- продуктивність

- виконанні

- фаза

- частин

- запланований

- політика

- позитивний

- це можливо

- потенціал

- потужний

- практика

- передбачати

- прогноз

- представити

- попередження

- попередній

- недоторканність приватного життя

- зонд

- Проблема

- процес

- виробляти

- Вироблений

- протест

- повноваження

- Квартал

- підвищення

- досягати

- зрозумів,

- Причини

- зменшити

- Знижений

- зниження

- відображати

- відображення

- решті

- видалення

- представляти

- подання

- представник

- запитів

- вимагати

- Вимагається

- відповідь

- в результаті

- повертати

- ризики

- прогін

- то ж

- шкала

- схема

- Пошук

- комплект

- форми

- Поділитись

- зсув

- значний

- аналогічний

- простий

- з

- один

- Розмір

- невеликий

- So

- ВИРІШИТИ

- деякі

- що в сім'ї щось

- Простір

- спеціальний

- конкретно

- специфікація

- Розколи

- етапи

- старт

- заявив,

- Як і раніше

- Вивчення

- успіх

- система

- Systems

- взяття

- методи

- Технології

- тест

- Команда

- отже

- речі

- ретельно

- три

- поріг

- через

- час

- times

- інструмент

- топ

- до

- поїзд

- Навчання

- розуміти

- союз

- створеного

- us

- використання

- перевірка достовірності

- різний

- перевірити

- версія

- хотів

- Що

- Чи

- в той час як

- в

- без

- жінки

- Work

- працює

- хвилювалися

- б

- X