Ми раді повідомити про доступність потокової відповіді Amazon SageMaker висновок у реальному часі. Тепер ви можете безперервно передавати клієнтові відповіді на висновки, використовуючи логічний висновок SageMaker у реальному часі, щоб допомогти вам створити інтерактивний досвід для генеративних програм ШІ, таких як чат-боти, віртуальні помічники та генератори музики. За допомогою цієї нової функції ви можете розпочати потокову передачу відповідей одразу, коли вони стануть доступними, замість того, щоб чекати, доки буде згенерована вся відповідь. Це зменшує час до першого байта для ваших генеративних програм ШІ.

У цій публікації ми покажемо, як створити потокову веб-програму за допомогою кінцевих точок реального часу SageMaker із новою функцією потокової передачі відповідей для інтерактивного чату. Ми використовуємо Streamlit для прикладу інтерфейсу користувача демонстраційної програми.

Огляд рішення

Щоб отримати відповідь від SageMaker, ви можете скористатися нашим новим InvokeEndpointWithResponseStream API. Це допомагає підвищити задоволеність клієнтів, надаючи швидший час до першого байта відповіді. Це зменшення затримки, яку сприймає клієнт, особливо важливо для додатків, створених за допомогою генеративних моделей штучного інтелекту, де негайна обробка цінується над очікуванням усього корисного навантаження. Крім того, він представляє закріплений сеанс, який забезпечить безперервність взаємодії, сприяючи використанню таких випадків, як чат-боти, для створення більш природного та ефективного досвіду користувача.

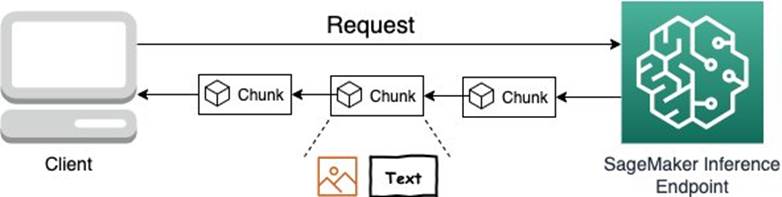

Реалізація потокової передачі відповідей у кінцевих точках реального часу SageMaker досягається за допомогою Часткове кодування HTTP 1.1, який є механізмом надсилання кількох відповідей. Це стандарт HTTP, який підтримує двійковий вміст і підтримується більшістю фреймворків клієнт/сервер. Кодування фрагментів HTTP підтримує потокове передавання даних як тексту, так і зображення, що означає, що моделі, розміщені на кінцевих точках SageMaker, можуть надсилати потокові відповіді як текст або зображення, наприклад Falcon , полум'я 2 та Стабільна дифузія моделі. З точки зору безпеки, як вхід, так і вихід захищені за допомогою TLS Аутентифікація AWS Sigv4. Інші методи потокового передавання, наприклад Події, надіслані сервером (SSE) також реалізовано за допомогою того самого механізму фрагментованого кодування HTTP. Щоб скористатися перевагами нового потокового API, вам потрібно переконатися, що контейнер моделі повертає потокову відповідь у вигляді фрагментованих закодованих даних.

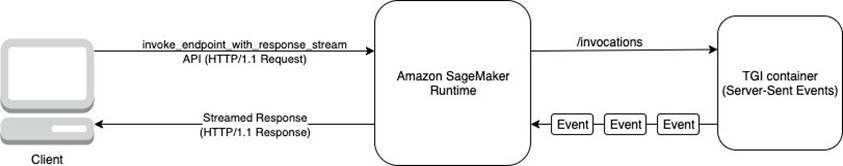

Наступна діаграма ілюструє високорівневу архітектуру для потокової передачі відповіді з кінцевою точкою висновку SageMaker.

Одним із варіантів використання, який виграє від потокової відповіді, є генеративні чат-боти на основі моделі AI. Традиційно користувачі надсилають запит і чекають, поки буде згенерована повна відповідь, перш ніж отримати відповідь. Це може зайняти дорогоцінні секунди або навіть більше, що потенційно може погіршити продуктивність програми. За допомогою потокової передачі відповідей чат-бот може почати надсилати назад часткові результати висновків у міру їх створення. Це означає, що користувачі можуть побачити початкову відповідь майже миттєво, навіть якщо штучний інтелект продовжує вдосконалювати свою відповідь у фоновому режимі. Це створює безперебійний та захоплюючий потік розмови, де користувачі відчувають, ніби вони спілкуються з штучним інтелектом, який розуміє та відповідає в реальному часі.

У цій публікації ми демонструємо два варіанти контейнера для створення кінцевої точки SageMaker із потоковою передачі відповідей: використання AWS Висновок великої моделі (LMI) і Hugging Face Висновок про створення тексту (TGI) контейнер. У наступних розділах ми ознайомимо вас із детальними кроками впровадження для розгортання та тестування Falcon-7B-Instruct модель з використанням контейнерів LMI і TGI на SageMaker. Ми обрали Falcon 7B як приклад, але будь-яка модель може скористатися цією новою функцією потокового передавання.

Передумови

Вам потрібен обліковий запис AWS з Управління ідентифікацією та доступом AWS (IAM) роль із дозволами на керування ресурсами, створеними як частина рішення. Детальніше див Створення облікового запису AWS. Якщо ви вперше працюєте з Студія Amazon SageMaker, спочатку потрібно створити a Домен SageMaker. Крім того, вам може знадобитися подати запит на збільшення квоти послуг для відповідних екземплярів хостингу SageMaker. Для моделі Falcon-7B-Instruct ми використовуємо екземпляр хостингу ml.g5.2xlarge SageMaker. Для розміщення моделі Falcon-40B-Instruct ми використовуємо екземпляр хостингу ml.g5.48xlarge SageMaker. Ви можете подати запит на збільшення квоти в Інтерфейс користувача квот на обслуговування. Для отримання додаткової інформації див Запит на збільшення квоти.

Варіант 1. Розгорніть кінцеву точку потокового передавання в реальному часі за допомогою контейнера LMI

Контейнер LMI є одним із контейнерів глибокого навчання для логічного висновку великої моделі, розміщеного SageMaker для полегшення розміщення великих мовних моделей (LLM) в інфраструктурі AWS для випадків використання висновку з низькою затримкою. Контейнер LMI використовує Сервіс Deep Java Library (DJL)., яка є фреймворком Java високого рівня з відкритим вихідним кодом, незалежно від двигуна для глибокого навчання. За допомогою цих контейнерів ви можете використовувати відповідні бібліотеки з відкритим кодом, такі як DeepSpeed, Прискорювати, Трансформери-нейронкс та FasterTransformer розділити параметри моделі за допомогою методів паралелізму моделей, щоб використовувати пам’ять кількох графічних процесорів або прискорювачів для висновку. Докладніше про переваги використання контейнера LMI для розгортання великих моделей на SageMaker див. Розгортайте великі моделі з високою продуктивністю за допомогою FasterTransformer на Amazon SageMaker та Розгортайте великі моделі на Amazon SageMaker за допомогою паралельного висновку моделі DJLServing і DeepSpeed. Ви також можете знайти більше прикладів розміщення LLM з відкритим кодом на SageMaker за допомогою контейнерів LMI у цьому GitHub репо.

Для контейнера LMI ми очікуємо, що такі артефакти допоможуть налаштувати модель для висновку:

- serving.properties (обов’язково) – Визначає параметри сервера моделі

- model.py (необов'язково) – Файл Python для визначення основної логіки висновку

- requirements.txt (необов'язково) – Буде потрібно встановити будь-яке додаткове колесо

Контейнери LMI можна використовувати для розміщення моделей без надання власного коду висновку. Це надзвичайно корисно, коли немає спеціальної попередньої обробки вхідних даних або постобробки прогнозів моделі. Ми використовуємо таку конфігурацію:

- Для цього прикладу ми розміщуємо модель Falcon-7B-Instruct. Нам потрібно створити a

serving.propertiesфайл конфігурації з нашими бажаними параметрами хостингу та запакуйте його в артефакт tar.gz. Потокове передавання відповідей можна ввімкнути в DJL Serving, налаштувавшиenable_streamingопція вserving.propertiesфайл. Усі підтримувані параметри див Потокова конфігурація Python. - У цьому прикладі ми використовуємо обробники за замовчуванням у DJL Serving для потокової передачі відповідей, тому ми дбаємо лише про надсилання запитів і аналіз вихідної відповіді. Ви також можете надати

entrypointкод із спеціальним обробником у amodel.pyфайл для налаштування обробників введення та виведення. Щоб отримати докладніші відомості про спеціальний обробник, див Спеціальний обробник model.py. - Оскільки ми розміщуємо модель Falcon-7B-Instruct на одному екземплярі GPU (ml.g5.2xlarge), ми встановлюємо

option.tensor_parallel_degreeдо 1. Якщо ви плануєте працювати на кількох графічних процесорах, використовуйте це, щоб установити кількість GPU на одного працівника. - Ми використовуємо

option.output_formatterдля керування типом вихідного вмісту. Тип вихідного вмісту за замовчуванням:application/json, тож якщо ваша програма потребує іншого виводу, ви можете перезаписати це значення. Додаткову інформацію про доступні параметри див Конфігурації та налаштування та Усі параметри конфігурації DJL.

Щоб створити модель SageMaker, отримайте URI зображення контейнера:

Використовувати SageMaker Python SDK щоб створити модель SageMaker і розгорнути її на кінцевій точці реального часу SageMaker за допомогою розгортання метод:

Коли кінцева точка працює, ви можете використовувати InvokeEndpointWithResponseStream Виклик API для виклику моделі. Цей API дозволяє моделі відповідати як потік частин повної відповіді. Це дає змогу моделям відповідати відповідями більшого розміру та забезпечує швидший час до першого байта для моделей, де існує значна різниця між генерацією першого та останнього байтів відповіді.

Тип вмісту відповіді, показаний у x-amzn-sagemaker-content-type для контейнера LMI є application/jsonlines, як зазначено в конфігурації властивостей моделі. Тому що це частина стандартні формати даних, які підтримуються для висновків, ми можемо використовувати десеріалізатор за замовчуванням, наданий у SageMaker Python SDK для десеріалізації даних рядків JSON. Створюємо помічника LineIterator клас для аналізу потоку відповідей, отриманого від запиту висновку:

З класом у попередньому коді щоразу, коли відповідь передається потоком, він повертатиме двійковий рядок (наприклад, b'{"outputs": [" a"]}n'), який можна знову десеріалізувати у словник Python за допомогою пакета JSON. Ми можемо використовувати наступний код для повторення кожного рядка потокового тексту та повернення текстової відповіді:

На наступному знімку екрана показано, як це виглядало б, якби ви викликали модель через блокнот SageMaker за допомогою контейнера LMI.

Варіант 2. Впровадження чат-бота за допомогою контейнера Hugging Face TGI

У попередньому розділі ви бачили, як розгорнути модель Falcon-7B-Instruct за допомогою контейнера LMI. У цьому розділі ми покажемо, як зробити те саме за допомогою a Обіймати обличчя Висновок генерації тексту (TGI) контейнер на SageMaker. TGI — це спеціальне рішення з відкритим кодом для розгортання LLM. Він включає в себе оптимізацію, включаючи тензорний паралелізм для швидшого висновку з кількома графічним процесором, динамічне пакетування для підвищення загальної пропускної здатності та оптимізований код трансформаторів з використанням flash-attention для популярних архітектур моделей, зокрема BLOOM, T5, GPT-NeoX, StarCoder і LLaMa.

Підтримка контейнерів глибокого навчання TGI потоковий токен використання Події, надіслані сервером (SSE). За допомогою потокової передачі маркерів сервер може почати відповідати після першого prefill передати безпосередньо, не чекаючи завершення всього покоління. Для надзвичайно довгих запитів це означає, що клієнти можуть почати бачити, що щось відбувається на порядки величини, перш ніж робота буде виконана. На наступній діаграмі показано високорівневий наскрізний робочий процес запитів/відповідей для розміщення LLM на кінцевій точці SageMaker за допомогою контейнера TGI.

Щоб розгорнути модель Falcon-7B-Instruct на кінцевій точці SageMaker, ми використовуємо HuggingFaceModel із SageMaker Python SDK. Ми починаємо з встановлення наших параметрів наступним чином:

Порівняно з розгортанням звичайних моделей Hugging Face, нам спочатку потрібно отримати URI контейнера та надати його нашому HuggingFaceModel модель класу с image_uri вказуючи на зображення. Щоб отримати новий DLC Hugging Face LLM у SageMaker, ми можемо скористатися get_huggingface_llm_image_uri метод, наданий SageMaker SDK. Цей метод дозволяє нам отримати URI для потрібного DLC Hugging Face LLM на основі вказаного серверного модуля, сеансу, регіону та версії. Додаткову інформацію про доступні версії див HuggingFace Text Generation Inference Containers.

Потім ми створюємо HuggingFaceModel і розгорніть його в SageMaker за допомогою deploy метод:

Основна відмінність у порівнянні з контейнером LMI полягає в тому, що ви вмикаєте потокове передавання відповіді, коли викликаєте кінцеву точку шляхом надання stream=true як частину корисного навантаження запиту на виклик. Наступний код є прикладом корисного навантаження, що використовується для виклику контейнера TGI із потоковою передачі:

Потім ви можете викликати кінцеву точку та отримати потокову відповідь за допомогою такої команди:

Тип вмісту відповіді, показаний у x-amzn-sagemaker-content-type для контейнера TGI є text/event-stream. Ми використовуємо StreamDeserializer, щоб десеріалізувати відповідь у Потік подій клас і проаналізуйте тіло відповіді, використовуючи його LineIterator клас, який використовується в розділі контейнера LMI.

Зауважте, що потокова відповідь із контейнерів TGI поверне двійковий рядок (наприклад, b`data:{"token": {"text": " sometext"}}`), який можна знову десеріалізувати у словник Python за допомогою пакета JSON. Ми можемо використовувати наступний код для повторення кожного рядка потокового тексту та повернення текстової відповіді:

На наступному знімку екрана показано, як це виглядало б, якби ви викликали модель через блокнот SageMaker за допомогою контейнера TGI.

Запустіть програму чат-бота на SageMaker Studio

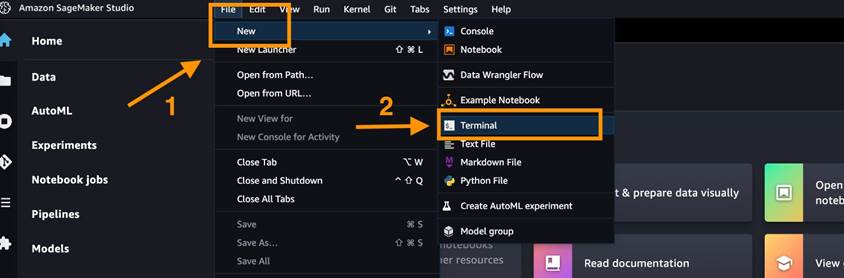

У цьому випадку використання ми створюємо динамічний чат-бот на SageMaker Studio за допомогою Стрітліт, який викликає модель Falcon-7B-Instruct, розміщену на кінцевій точці реального часу SageMaker, щоб надавати потокові відповіді. По-перше, ви можете перевірити, чи потокові відповіді працюють у блокноті, як показано в попередньому розділі. Потім ви можете налаштувати програму Streamlit у терміналі SageMaker Studio JupyterServer і отримати доступ до інтерфейсу користувача чат-бота зі свого браузера, виконавши такі кроки:

- Відкрийте системний термінал у SageMaker Studio.

- У верхньому меню консолі SageMaker Studio виберіть філе, То Нові, То термінал.

- Встановіть необхідні пакети Python, указані в вимоги.txt Файл:

- Налаштуйте змінну середовища з назвою кінцевої точки, розгорнутою у вашому обліковому записі:

- Запустіть програму Streamlit з

streamlit_chatbot_<LMI or TGI>.pyфайл, який автоматично оновить імена кінцевих точок у сценарії на основі змінної середовища, налаштованої раніше: - Щоб отримати доступ до інтерфейсу користувача Streamlit, скопіюйте URL-адресу SageMaker Studio на іншу вкладку браузера та замініть

lab?зproxy/[PORT NUMBER]/. Оскільки ми вказали порт сервера 6006, URL-адреса має виглядати так:

Замініть ідентифікатор домену та регіон у попередній URL-адресі своїм обліковим записом і регіоном, щоб отримати доступ до інтерфейсу користувача чат-бота. Ви можете знайти кілька пропонованих підказок на лівій панелі, щоб почати.

Наступна демонстрація показує, як потокове передавання відповідей революціонізує роботу користувача. Це може зробити взаємодію плавною та чуйною, зрештою підвищуючи задоволеність та залучення користувачів. Зверніться до GitHub репо для більш детальної інформації про впровадження чат-бота.

Прибирати

Коли ви закінчите тестування моделей, радимо видалити кінцеву точку, щоб заощадити кошти, якщо кінцева точка більше не потрібна:

Висновок

У цій публікації ми надали огляд створення програм за допомогою генеративного штучного інтелекту, проблеми та те, як потокове передавання відповідей SageMaker у реальному часі допомагає вам вирішити ці проблеми. Ми продемонстрували, як створити програму чат-бота для розгортання моделі Falcon-7B-Instruct для використання потокової передачі відповідей за допомогою контейнерів SageMaker LMI і HuggingFace TGI, використовуючи приклад, доступний на сайті GitHub.

Почніть створювати власні передові потокові програми за допомогою LLM і SageMaker вже сьогодні! Зверніться до нас за консультаціями експертів і розкрийте потенціал потокової передачі великих моделей для своїх проектів.

Про авторів

Рагу Рамеша є старшим архітектором рішень ML у команді Amazon SageMaker Service. Він зосереджується на допомозі клієнтам створювати, розгортати та переносити робочі навантаження ML на SageMaker у великих масштабах. Він спеціалізується на машинному навчанні, штучному інтелекті та комп’ютерному зорі, а також має ступінь магістра комп’ютерних наук в UT Dallas. У вільний час захоплюється подорожами та фотографією.

Рагу Рамеша є старшим архітектором рішень ML у команді Amazon SageMaker Service. Він зосереджується на допомозі клієнтам створювати, розгортати та переносити робочі навантаження ML на SageMaker у великих масштабах. Він спеціалізується на машинному навчанні, штучному інтелекті та комп’ютерному зорі, а також має ступінь магістра комп’ютерних наук в UT Dallas. У вільний час захоплюється подорожами та фотографією.

Абхі Шивадітья є старшим архітектором рішень в AWS, який працює зі стратегічними глобальними корпоративними організаціями, щоб сприяти впровадженню послуг AWS у таких сферах, як штучний інтелект, розподілені обчислення, мережі та зберігання. Його досвід полягає в глибокому навчанні в областях обробки природної мови (NLP) і комп’ютерного зору. Abhi допомагає клієнтам ефективно розгортати високопродуктивні моделі машинного навчання в екосистемі AWS.

Абхі Шивадітья є старшим архітектором рішень в AWS, який працює зі стратегічними глобальними корпоративними організаціями, щоб сприяти впровадженню послуг AWS у таких сферах, як штучний інтелект, розподілені обчислення, мережі та зберігання. Його досвід полягає в глибокому навчанні в областях обробки природної мови (NLP) і комп’ютерного зору. Abhi допомагає клієнтам ефективно розгортати високопродуктивні моделі машинного навчання в екосистемі AWS.

Алан Тан є старшим менеджером із продуктів у SageMaker, керуючи зусиллями з виведення великих моделей. Він захоплений застосуванням машинного навчання в галузі аналітики. Поза роботою він любить прогулянки на природі.

Алан Тан є старшим менеджером із продуктів у SageMaker, керуючи зусиллями з виведення великих моделей. Він захоплений застосуванням машинного навчання в галузі аналітики. Поза роботою він любить прогулянки на природі.

Мелані Лi, Доктор філософії, є старшим спеціалістом зі штучного інтелекту та ML в AWS у Сіднеї, Австралія. Вона допомагає корпоративним клієнтам створювати рішення за допомогою найсучасніших інструментів AI/ML на AWS і надає вказівки щодо архітектури та впровадження рішень ML із передовими практиками. У вільний час вона любить досліджувати природу та проводити час із родиною та друзями.

Мелані Лi, Доктор філософії, є старшим спеціалістом зі штучного інтелекту та ML в AWS у Сіднеї, Австралія. Вона допомагає корпоративним клієнтам створювати рішення за допомогою найсучасніших інструментів AI/ML на AWS і надає вказівки щодо архітектури та впровадження рішень ML із передовими практиками. У вільний час вона любить досліджувати природу та проводити час із родиною та друзями.

Сем Едвардс, є хмарним інженером (AI/ML) в AWS Sydney, який спеціалізується на машинному навчанні та Amazon SageMaker. Він захоплено допомагає клієнтам вирішувати проблеми, пов’язані з робочими процесами машинного навчання, і створює нові рішення для них. Поза роботою він любить грати в ракетний спорт і подорожувати.

Сем Едвардс, є хмарним інженером (AI/ML) в AWS Sydney, який спеціалізується на машинному навчанні та Amazon SageMaker. Він захоплено допомагає клієнтам вирішувати проблеми, пов’язані з робочими процесами машинного навчання, і створює нові рішення для них. Поза роботою він любить грати в ракетний спорт і подорожувати.

Джеймс Сандерс є старшим інженером-програмістом Amazon Web Services. Він працює над платформою висновків у реальному часі для Amazon SageMaker.

Джеймс Сандерс є старшим інженером-програмістом Amazon Web Services. Він працює над платформою висновків у реальному часі для Amazon SageMaker.

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- PlatoData.Network Vertical Generative Ai. Додайте собі сили. Доступ тут.

- PlatoAiStream. Web3 Intelligence. Розширення знань. Доступ тут.

- ПлатонЕСГ. Автомобільні / електромобілі, вуглець, CleanTech, Енергія, Навколишнє середовище, Сонячна, Поводження з відходами. Доступ тут.

- PlatoHealth. Розвідка про біотехнології та клінічні випробування. Доступ тут.

- ChartPrime. Розвивайте свою торгову гру за допомогою ChartPrime. Доступ тут.

- BlockOffsets. Модернізація екологічної компенсаційної власності. Доступ тут.

- джерело: https://aws.amazon.com/blogs/machine-learning/elevating-the-generative-ai-experience-introducing-streaming-support-in-amazon-sagemaker-hosting/

- :є

- : ні

- :де

- $UP

- 1

- 10

- 100

- 11

- 13

- 14

- 16

- 1900

- 23

- 7

- 8

- 9

- a

- МЕНЮ

- прискорювачі

- доступ

- рахунки

- Рахунки

- досягнутий

- через

- Додатковий

- Додатково

- адреса

- Прийняття

- Перевага

- після

- знову

- AI

- Моделі AI

- AI / ML

- ВСІ

- дозволяє

- майже

- Також

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- аналітика

- та

- Оголосити

- Інший

- відповідь

- будь-який

- API

- додаток

- додаток

- застосування

- Застосування

- архітектура

- ЕСТЬ

- ПЛОЩА

- області

- масив

- штучний

- штучний інтелект

- AS

- помічники

- допомагає

- At

- Австралія

- автоматично

- наявність

- доступний

- AWS

- назад

- Backend

- фон

- заснований

- BE

- оскільки

- перед тим

- починати

- користь

- вигода

- Переваги

- КРАЩЕ

- передового досвіду

- між

- Цвісти

- тіло

- підвищення

- обидва

- браузер

- буфера

- будувати

- Створюємо

- побудований

- але

- by

- call

- CAN

- який

- випадок

- випадків

- проблеми

- складні

- характер

- Chatbot

- chatbots

- в чаті

- перевірка

- Вибирати

- вибрав

- клас

- клієнт

- клієнтів

- хмара

- код

- коментар

- порівняний

- завершення

- комп'ютер

- Інформатика

- Комп'ютерне бачення

- обчислення

- конфігурація

- Консоль

- містити

- Контейнер

- Контейнери

- зміст

- продовжувати

- триває

- безперервність

- постійно

- контроль

- Розмова

- Core

- Відповідний

- витрати

- може

- створювати

- створений

- створює

- створення

- вирішальне значення

- виготовлений на замовлення

- клієнт

- Задоволеність клієнтів

- Клієнти

- налаштувати

- передовий

- Даллас

- дані

- глибокий

- глибоке навчання

- дефолт

- визначати

- Визначає

- Ступінь

- надання

- демонстрація

- розгортання

- розгорнути

- розгортання

- бажаний

- докладно

- деталі

- різниця

- різний

- безпосередньо

- розподілений

- розподілені обчислення

- do

- домен

- домени

- зроблений

- динамічний

- кожен

- Раніше

- екосистема

- ефективний

- продуктивно

- зусилля

- піднесення

- включіть

- включений

- дозволяє

- кінець

- кінець в кінець

- закінчення

- Кінцева точка

- зачеплення

- залучення

- інженер

- підвищувати

- підвищення

- забезпечувати

- підприємство

- Весь

- Навколишнє середовище

- Навіть

- Event

- Події

- приклад

- Приклади

- Крім

- збуджений

- очікувати

- досвід

- Досліди

- експерт

- експертиза

- дослідити

- експорт

- піддаватися

- надзвичайно

- Face

- фасилітувати

- false

- сім'я

- швидше

- особливість

- почувати

- філе

- знайти

- Перший

- перший раз

- потік

- рідина

- фокусується

- після

- слідує

- для

- формат

- Рамки

- каркаси

- Безкоштовна

- друзі

- від

- Повний

- функція

- генерується

- покоління

- генеративний

- Генеративний ШІ

- генератори

- отримати

- GIF

- Глобальний

- GPU

- Графічні процесори

- гарантований

- керівництво

- Відбувається

- he

- здоров'я

- допомога

- допомогу

- допомагає

- її

- Високий

- на вищому рівні

- висока продуктивність

- його

- тримає

- господар

- відбувся

- хостинг

- Як

- How To

- HTML

- HTTP

- HTTPS

- HuggingFace

- ID

- Особистість

- if

- ілюструє

- зображення

- Негайний

- негайно

- здійснювати

- реалізація

- реалізовані

- реалізації

- імпорт

- in

- У тому числі

- Augmenter

- інформація

- Інфраструктура

- початковий

- вхід

- витрати

- встановлювати

- екземпляр

- миттєво

- замість

- Інтелект

- Взаємодії

- інтерактивний

- в

- Вводить

- введення

- викликали

- викликає

- питання

- IT

- ЙОГО

- Java

- JPG

- json

- мова

- великий

- більше

- останній

- Затримка

- провідний

- вивчення

- залишити

- довжина

- libraries

- бібліотека

- лежить

- життя

- як

- Лінія

- ліній

- Лама

- LLM

- Довго

- довше

- подивитися

- виглядає як

- любить

- машина

- навчання за допомогою машини

- головний

- підтримує

- зробити

- управляти

- менеджер

- магістра

- Макс

- Може..

- me

- засоби

- механізм

- пам'ять

- Меню

- метод

- мігрувати

- хвилин

- ML

- модель

- Моделі

- більше

- Більше того

- найбільш

- множинний

- музика

- ім'я

- Імена

- Природний

- Обробка природних мов

- природа

- Необхідність

- мережа

- Нові

- nlp

- немає

- ноутбук

- зараз

- номер

- об'єкти

- of

- on

- ONE

- тільки

- відкрити

- з відкритим вихідним кодом

- оптимізований

- варіант

- Опції

- or

- замовлень

- організації

- Інше

- наші

- з

- на відкритому повітрі

- вихід

- поза

- над

- загальний

- огляд

- власний

- пакет

- пакети

- pane

- Паралельні

- параметри

- частина

- особливо

- частини

- проходити

- пристрасний

- для

- продуктивність

- Дозволи

- Вчений ступінь

- малюнок

- план

- платформа

- plato

- Інформація про дані Платона

- PlatoData

- ігри

- точка

- популярний

- положення

- пошта

- потенціал

- потенційно

- практика

- практики

- дорогоцінний

- Прогнози

- попередній

- Проблема

- обробка

- Product

- менеджер по продукції

- Production

- проектів

- властивості

- забезпечувати

- за умови

- забезпечує

- забезпечення

- Python

- запити

- підвищення

- досягати

- Читати

- реальний

- реального часу

- отримати

- отримано

- отримання

- скорочення

- рафінування

- регіон

- регулярний

- пов'язаний

- замінювати

- запросити

- запитів

- вимагається

- Вимога

- Вимагається

- ресурси

- Реагувати

- відповідь

- відповіді

- реагувати

- результати

- повертати

- Умови повернення

- революціонізує

- Роль

- прогін

- мудрець

- Висновок SageMaker

- то ж

- задоволення

- зберегти

- бачив

- шкала

- наука

- Sdk

- безшовні

- seconds

- розділ

- розділам

- Забезпечений

- безпеку

- побачити

- SELF

- послати

- відправка

- старший

- пропозиція

- обслуговування

- Послуги

- виступаючої

- Сесія

- комплект

- установка

- вона

- Повинен

- Показувати

- демонстрації

- продемонстрований

- показаний

- Шоу

- значний

- один

- Розмір

- So

- Софтвер

- Інженер-програміст

- рішення

- Рішення

- ВИРІШИТИ

- деякі

- що в сім'ї щось

- Source

- спеціаліст

- спеціалізований

- спеціалізується

- зазначений

- витрачати

- розкол

- SPORTS

- standard

- старт

- почалася

- впроваджений

- заходи

- липкий

- зберігання

- Стратегічний

- потік

- потоковий

- потоковий

- рядок

- студія

- такі

- поставки

- підтримка

- Підтриманий

- Опори

- Переконайтеся

- Сідней

- система

- Приймати

- команда

- методи

- сказати

- термінал

- terms

- тест

- Тестування

- Що

- Команда

- Площа

- Їх

- потім

- Там.

- Ці

- вони

- це

- через

- пропускна здатність

- час

- до

- знак

- інструменти

- топ

- традиційно

- Трансформатори

- Подорож

- правда

- намагатися

- два

- тип

- ui

- Зрештою

- розумієш

- невідомий

- відімкнути

- Оновити

- URL

- us

- використання

- використання випадку

- використовуваний

- користувач

- User Experience

- користувачі

- використовує

- використання

- зазвичай

- значення

- цінний

- змінна

- версія

- версії

- через

- Віртуальний

- бачення

- чекати

- Очікування

- було

- we

- Web

- Веб-додаток

- веб-сервіси

- Що

- Що таке

- Колесо

- коли

- який

- в той час як

- Вікіпедія

- волі

- з

- в

- без

- Work

- робочий

- Робочі процеси

- робочий

- працює

- б

- запис

- письмовий

- Ти

- вашу

- зефірнет