У сучасній системі охорони здоров’я, що швидко розвивається, лікарі стикаються з величезною кількістю клінічних даних із різних джерел, таких як нотатки медичного персоналу, електронні медичні записи та звіти про зображення. Ця величезна кількість інформації, яка є важливою для догляду за пацієнтами, також може виявитися надзвичайною та забирати багато часу для медичних працівників, щоб просіяти й проаналізувати її. Ефективне узагальнення та вилучення розуміння з цих даних має вирішальне значення для кращого догляду за пацієнтами та прийняття рішень. Узагальнена інформація про пацієнтів може бути корисною для низки подальших процесів, таких як агрегація даних, ефективне кодування пацієнтів або групування пацієнтів із подібними діагнозами для перегляду.

Моделі штучного інтелекту (AI) і машинного навчання (ML) показали великі перспективи у вирішенні цих проблем. Моделі можна навчити аналізувати та інтерпретувати великі обсяги текстових даних, ефективно зводячи інформацію до стислих підсумків. Завдяки автоматизації процесу узагальнення лікарі можуть швидко отримати доступ до відповідної інформації, що дозволить їм зосередитися на догляді за пацієнтом і приймати більш обґрунтовані рішення. Дивіться наступне тематичне дослідження щоб дізнатися більше про випадки використання в реальному світі.

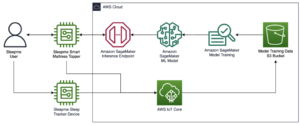

Amazon SageMaker, повністю керований сервіс машинного навчання, забезпечує ідеальну платформу для розміщення та реалізації різних моделей і підходів узагальнення на основі AI/ML. У цій публікації ми досліджуємо різні варіанти впровадження методів підсумовування в SageMaker, зокрема використання Amazon SageMaker JumpStart основні моделі, тонке налаштування попередньо навчених моделей із Hugging Face і створення власних моделей узагальнення. Ми також обговорюємо плюси та мінуси кожного підходу, дозволяючи медичним працівникам вибрати найбільш прийнятне рішення для створення лаконічних і точних підсумків складних клінічних даних.

Два важливі терміни, які слід знати перед початком: попередньо підготовлені та тонка настройка. Попередньо підготовлена або базова модель — це модель, яка була побудована та навчена на основі великого масиву даних, як правило, для загального знання мови. Тонка настройка — це процес, за допомогою якого попередньо навчена модель отримує інший набір даних, більш специфічний для домену, щоб підвищити її продуктивність у виконанні конкретного завдання. У медичному закладі це означало б надати моделі деякі дані, включаючи фрази та термінологію, що стосуються саме догляду за пацієнтами.

Створюйте власні моделі підсумовування на SageMaker

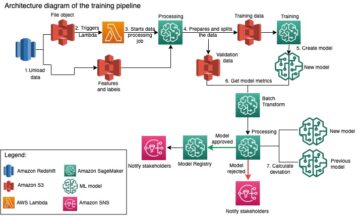

Незважаючи на те, що це найбільш трудомісткий підхід, деякі організації можуть віддати перевагу створенню настроюваних моделей узагальнення на SageMaker з нуля. Цей підхід потребує більш глибоких знань про моделі AI/ML і може включати створення архітектури моделі з нуля або адаптацію існуючих моделей відповідно до конкретних потреб. Створення власних моделей може запропонувати більшу гнучкість і контроль над процесом узагальнення, але також вимагає більше часу та ресурсів порівняно з підходами, які починаються з попередньо навчених моделей. Важливо ретельно зважити переваги та недоліки цього варіанту, перш ніж продовжити, оскільки він може не підходити для всіх випадків використання.

Моделі основи SageMaker JumpStart

Чудовим варіантом реалізації підсумовування на SageMaker є використання базових моделей JumpStart. Ці моделі, розроблені провідними дослідницькими організаціями зі штучного інтелекту, пропонують низку попередньо навчених мовних моделей, оптимізованих для різних завдань, включаючи підсумовування тексту. SageMaker JumpStart пропонує два типи базових моделей: власні моделі та моделі з відкритим кодом. SageMaker JumpStart також відповідає вимогам HIPAA, що робить його корисним для роботи в галузі охорони здоров’я. Зрештою клієнт повинен забезпечити дотримання вимог, тому обов’язково вживайте відповідних заходів. Побачити Розробка архітектури безпеки та відповідності HIPAA на веб-сервісах Amazon для більш докладної інформації.

Власні моделі основи

Запатентовані моделі, як-от моделі Jurassic від AI21 і модель Cohere Generate від Cohere, можна знайти за допомогою SageMaker JumpStart на Консоль управління AWS і зараз знаходяться на стадії попереднього перегляду. Використання власних моделей для підсумовування ідеально підходить, коли вам не потрібно точно налаштовувати свою модель на основі спеціальних даних. Це просте у використанні готове рішення, яке може задовольнити ваші вимоги до узагальнення з мінімальною конфігурацією. Використовуючи можливості цих попередньо навчених моделей, ви можете заощадити час і ресурси, які в іншому випадку були б витрачені на навчання та тонке налаштування спеціальної моделі. Крім того, пропрієтарні моделі зазвичай постачаються зі зручними API та SDK, що спрощує процес інтеграції з вашими існуючими системами та програмами. Якщо ваші потреби в резюмуванні можна задовольнити за допомогою попередньо навчених власних моделей без спеціального налаштування або тонкого налаштування, вони пропонують зручне, економічно вигідне та ефективне рішення для ваших завдань резюмування тексту. Оскільки ці моделі не навчені спеціально для випадків використання в охороні здоров’я, якість не може бути гарантована для медичної мови з коробки без тонкого налаштування.

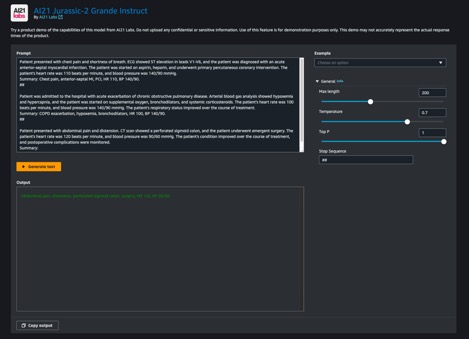

Jurassic-2 Grande Instruct — це велика мовна модель (LLM) від AI21 Labs, оптимізована для інструкцій природною мовою та застосовна до різних мовних завдань. Він пропонує простий у використанні API та Python SDK, балансуючи між якістю та доступністю. Популярні способи використання включають створення маркетингової копії, активацію чат-ботів і підсумовування тексту.

На консолі SageMaker перейдіть до SageMaker JumpStart, знайдіть модель AI21 Jurassic-2 Grande Instruct і виберіть Спробуйте модель.

Якщо ви хочете розгорнути модель на кінцевій точці SageMaker, якою ви керуєте, ви можете виконати кроки в цьому прикладі ноутбук, який показує, як розгорнути Jurassic-2 Large за допомогою SageMaker.

Моделі основи з відкритим кодом

Моделі з відкритим кодом включають моделі FLAN T5, Bloom і GPT-2, які можна знайти за допомогою SageMaker JumpStart у Студія Amazon SageMaker Інтерфейс користувача, SageMaker JumpStart на консолі SageMaker та API SageMaker JumpStart. Ці моделі можна точно налаштувати та розгорнути на кінцевих точках у вашому обліковому записі AWS, надаючи вам повне право власності на ваги моделі та коди сценаріїв.

Flan-T5 XL — потужна та універсальна модель, розроблена для широкого спектру мовних завдань. Тонко налаштувавши модель за допомогою даних, що стосуються предметної області, ви можете оптимізувати її продуктивність для конкретного випадку використання, наприклад підсумовування тексту або будь-якого іншого завдання NLP. Докладніше про те, як точно налаштувати Flan-T5 XL за допомогою інтерфейсу користувача SageMaker Studio, див. Точне налаштування інструкцій для FLAN T5 XL за допомогою Amazon SageMaker Jumpstart.

Точне налаштування попередньо навчених моделей за допомогою Hugging Face на SageMaker

Одним із найпопулярніших варіантів реалізації підсумовування на SageMaker є тонке налаштування попередньо навчених моделей за допомогою Hugging Face трансформери бібліотека. Hugging Face надає широкий спектр попередньо навчених моделей-трансформерів, спеціально розроблених для виконання різноманітних завдань обробки природної мови (NLP), включаючи підсумовування тексту. Завдяки бібліотеці Hugging Face Transformers ви можете легко налаштувати ці попередньо навчені моделі на даних, що стосуються домену, за допомогою SageMaker. Цей підхід має кілька переваг, таких як швидший час навчання, краща продуктивність у конкретних доменах і простіше пакування та розгортання моделі за допомогою вбудованих інструментів і служб SageMaker. Якщо ви не можете знайти відповідну модель у SageMaker JumpStart, ви можете вибрати будь-яку модель, запропоновану Hugging Face, і налаштувати її за допомогою SageMaker.

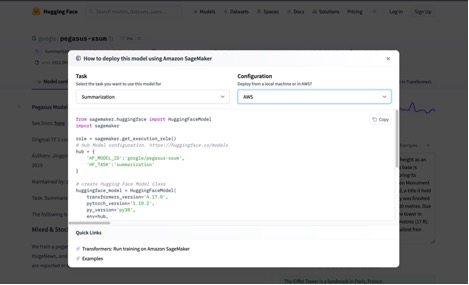

Щоб почати працювати з моделлю та дізнатися про можливості ML, все, що вам потрібно зробити, це відкрити SageMaker Studio, знайти попередньо навчену модель, яку ви хочете використовувати в Hugging Face Model Hubі виберіть SageMaker як спосіб розгортання. Hugging Face надасть вам код, який потрібно скопіювати, вставити та запустити у своєму блокноті. Це так просто! Інженерний досвід ML не потрібен.

Бібліотека Hugging Face Transformers дозволяє розробникам працювати на попередньо навчених моделях і виконувати складні завдання, як-от тонке налаштування, яке ми досліджуємо в наступних розділах.

Ресурси забезпечення

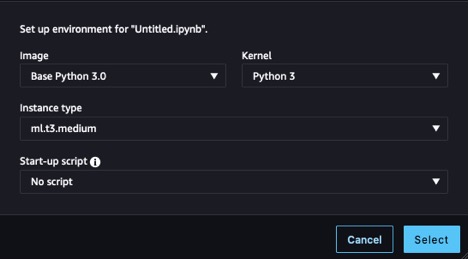

Перш ніж почати, нам потрібно підготувати блокнот. Інструкції наведено в кроках 1 і 2 Створіть і навчіть модель машинного навчання локально. Для цього прикладу ми використали налаштування, показані на наступному знімку екрана.

Нам також потрібно створити Служба простого зберігання Amazon (Amazon S3) для зберігання даних навчання та артефактів навчання. Інструкції див Створення відра.

Підготуйте набір даних

Щоб налаштувати нашу модель для кращого знання домену, нам потрібно отримати дані, придатні для завдання. Під час навчання для корпоративного сценарію використання вам потрібно буде виконати низку завдань з розробки даних, щоб підготувати власні дані до навчання. Ці завдання виходять за рамки цієї публікації. Для цього прикладу ми створили деякі синтетичні дані для імітації нотаток для медсестер і зберегли їх в Amazon S3. Зберігання наших даних в Amazon S3 дозволяє нам проектувати наші робочі навантаження відповідно до HIPAA. Ми починаємо з того, що отримуємо ці нотатки та завантажуємо їх в екземпляр, де працює наш блокнот:

Примітки складаються зі стовпця, що містить повний запис, примітку, і стовпця, що містить скорочену версію, яка ілюструє, яким має бути наш бажаний результат, резюме. Мета використання цього набору даних полягає в тому, щоб покращити біологічний і медичний словниковий запас нашої моделі, щоб він був більш налаштований на підсумовування в контексті охорони здоров’я, який називається точне налаштування доменуі покажіть нашій моделі, як структурувати підсумковий результат. У деяких випадках узагальнення ми можемо захотіти створити анотацію зі статті або однорядковий синопсис огляду, але в цьому випадку ми намагаємося змусити нашу модель виводити скорочену версію симптомів і вжитих дій для пацієнта поки що.

Завантажте модель

Модель, яку ми використовуємо як основу, є версією Pegasus від Google, доступною в Hugging Face Hub під назвою pegasus-xsum. Його вже попередньо навчено для підсумовування, тому наш процес тонкого налаштування може зосередитися на розширенні знань про предметну область. Зміна завдання, яке запускає наша модель, — це інший тип тонкого налаштування, який не розглядається в цій публікації. Бібліотека Transformer надає нам клас для завантаження визначення моделі з нашого model_checkpoint: google/pegasus-xsum. Це завантажить модель із концентратора та створить її екземпляр у нашому блокноті, щоб ми могли використовувати її пізніше. Оскільки pegasus-xsum є моделлю послідовності до послідовності, ми хочемо використовувати тип Seq2Seq Автомодель клас:

Тепер, коли ми маємо нашу модель, настав час звернути увагу на інші компоненти, які дозволять нам запускати наш навчальний цикл.

Створіть токенізатор

Першим із цих компонентів є токенизатор. Токенізація це процес, за допомогою якого слова з вхідних даних перетворюються на числові представлення, зрозумілі нашій моделі. Знову ж таки, бібліотека Transformer надає нам клас для завантаження визначення токенізера з тієї самої контрольної точки, яку ми використовували для створення екземпляра моделі:

За допомогою цього об’єкта токенізера ми можемо створити функцію попередньої обробки та зіставити її з нашим набором даних, щоб отримати токени, готові для введення в модель. Нарешті, ми форматуємо токенізований вихід і видаляємо стовпці, що містять наш оригінальний текст, оскільки модель не зможе їх інтерпретувати. Тепер у нас залишився токенізований вхід, готовий до введення в модель. Перегляньте наступний код:

Завдяки токенізації наших даних і екземпляру нашої моделі ми майже готові до запуску навчального циклу. Наступні компоненти, які ми хочемо створити, це збирач даних і оптимізатор. Колатор даних — це ще один клас, наданий Hugging Face через бібліотеку Transformers, який ми використовуємо для створення пакетів наших токенізованих даних для навчання. Ми можемо легко побудувати це за допомогою об’єктів токенізера та моделі, які у нас уже є, просто знайшовши відповідний тип класу, який ми використовували раніше для нашої моделі (Seq2Seq) для класу сортувальника. Функція оптимізатора полягає в підтримці стану навчання та оновленні параметрів на основі наших втрат навчання під час роботи в циклі. Щоб створити оптимізатор, ми можемо імпортувати оптимальний пакет із модуля torch, де доступна низка алгоритмів оптимізації. Деякі поширені, з якими ви, можливо, стикалися раніше, це стохастичний градієнтний спуск і Адам, останній із яких застосовано в нашому прикладі. Конструктор Адама враховує параметри моделі та параметризовану швидкість навчання для заданого тренувального циклу. Перегляньте наступний код:

Останніми кроками перед тим, як ми зможемо розпочати навчання, є створення прискорювача та планувальника темпів навчання. Прискорювач походить з іншої бібліотеки (ми в основному використовували Transformers), створеної Hugging Face, влучно названої Accelerate, і абстрагує логіку, необхідну для керування пристроями під час навчання (наприклад, за допомогою кількох графічних процесорів). Для останнього компонента ми повертаємося до завжди корисної бібліотеки Transformers, щоб реалізувати наш планувальник швидкості навчання. Вказуючи тип планувальника, загальну кількість кроків навчання в нашому циклі та попередньо створений оптимізатор, get_scheduler функція повертає об’єкт, який дозволяє нам коригувати нашу початкову швидкість навчання протягом усього процесу навчання:

Тепер ми повністю готові до навчання! Давайте налаштуємо навчальну роботу, починаючи зі створення екземпляра training_args використання бібліотеки Transformers і вибір значень параметрів. Ми можемо передати їх разом з іншими підготовленими компонентами та набором даних безпосередньо до тренер і розпочніть навчання, як показано в наступному коді. Залежно від розміру вашого набору даних і вибраних параметрів це може зайняти значну кількість часу.

Запакуйте модель для висновку

Після виконання навчання об’єкт моделі готовий до використання для логічного висновку. Радимо зберегти нашу роботу для майбутнього використання. Нам потрібно створити наші артефакти моделі, скріпити їх разом і завантажити наш архів на Amazon S3 для зберігання. Щоб підготувати нашу модель до архівування, нам потрібно розгорнути налаштовану модель, а потім зберегти двійковий файл моделі та пов’язані файли конфігурації. Нам також потрібно зберегти наш токенізер у тому самому каталозі, де ми зберегли наші артефакти моделі, щоб він був доступним, коли ми використовуємо модель для висновку. наш model_dir тепер папка має виглядати приблизно так:

Все, що залишилося, це запустити команду tar, щоб заархівувати наш каталог і завантажити файл tar.gz в Amazon S3:

Наша нещодавно налаштована модель тепер готова та доступна для використання для висновків.

Виконайте умовивід

Щоб використовувати цей артефакт моделі для висновку, відкрийте новий файл і використовуйте наведений нижче код, змінюючи model_data параметр відповідно до місця збереження артефакту в Amazon S3. The HuggingFaceModel конструктор перебудує нашу модель з контрольної точки, яку ми зберегли model.tar.gz, який ми можемо потім розгорнути для висновку за допомогою методу розгортання. Розгортання кінцевої точки займе кілька хвилин.

Після розгортання кінцевої точки ми можемо використати створений предиктор для її тестування. Передайте predict метод корисного навантаження даних і запустіть клітинку, і ви отримаєте відповідь від вашої точно налаштованої моделі:

Щоб побачити переваги тонкого налаштування моделі, давайте проведемо короткий тест. Наведена нижче таблиця містить підказку та результати передачі цієї підказки моделі до та після тонкого налаштування.

| Підказка | Відповідь без тонкої настройки | Відповідь із тонким налаштуванням |

| Узагальніть симптоми, які відчуває пацієнт. Хворий 45 років, скаржиться на біль за грудиною, що іррадіює в ліву руку. Біль виникає раптово під час роботи у дворі, асоціюється з легкою задишкою та потовиділенням. На момент надходження у хворого ЧСС 120, дихання 24, АТ 170/95. Електрокардіограма в 12 відведеннях зроблена після прибуття до відділення невідкладної допомоги та три рази сублінгвально введені нітрогліцерину без полегшення болю в грудях. Електрокардіограма показує елевацію ST у передніх відведеннях, що свідчить про гострий передній інфаркт міокарда. Ми звернулися до лабораторії катетеризації серця та готуємось до катетеризації серця кардіологом. | Представляємо випадок гострого інфаркту міокарда. | Біль у грудях, передній ІМ, ЧКВ. |

Як бачите, у нашій налаштованій моделі по-іншому використовується термінологія охорони здоров’я, і ми змогли змінити структуру відповіді відповідно до наших цілей. Зауважте, що результати залежать від вашого набору даних і вибору дизайну, зробленого під час навчання. Ваша версія моделі може запропонувати зовсім інші результати.

Прибирати

Коли ви закінчите працювати зі своїм ноутбуком SageMaker, обов’язково вимкніть його, щоб уникнути витрат на довгострокові ресурси. Зауважте, що вимкнення екземпляра призведе до втрати будь-яких даних, що зберігаються в ефемерній пам’яті екземпляра, тому вам слід зберегти всю свою роботу в постійному сховищі перед очищенням. Вам також потрібно буде відвідати Кінцеві точки на консолі SageMaker і видаліть усі кінцеві точки, розгорнуті для висновку. Щоб видалити всі артефакти, вам також потрібно перейти до консолі Amazon S3, щоб видалити файли, завантажені у ваше відро.

Висновок

У цій публікації ми досліджували різні варіанти впровадження методів резюмування тексту в SageMaker, щоб допомогти медичним працівникам ефективно обробляти величезні масиви клінічних даних і отримувати інформацію з них. Ми обговорювали використання базових моделей SageMaker Jumpstart, тонке налаштування попередньо навчених моделей із Hugging Face і створення індивідуальних моделей узагальнення. Кожен підхід має свої переваги та недоліки, задовольняючи різні потреби та вимоги.

Створення настроюваних моделей узагальнення на SageMaker забезпечує велику гнучкість і контроль, але потребує більше часу та ресурсів, ніж використання попередньо навчених моделей. Основні моделі SageMaker Jumpstart забезпечують просте у використанні та економічно ефективне рішення для організацій, які не потребують спеціального налаштування чи тонкого налаштування, а також деякі варіанти для спрощеного тонкого налаштування. Тонке налаштування попередньо навчених моделей від Hugging Face забезпечує швидший час навчання, кращу продуктивність для конкретного домену та повну інтеграцію з інструментами та службами SageMaker у широкому каталозі моделей, але це вимагає певних зусиль із впровадження. На момент написання цієї публікації Amazon оголосив про інший варіант, Amazon Bedrock, який запропонує можливості підсумовування в ще більш керованому середовищі.

Розуміючи плюси та мінуси кожного підходу, медичні працівники та організації можуть приймати обґрунтовані рішення щодо найбільш підходящого рішення для створення лаконічних і точних підсумків складних клінічних даних. Зрештою, використання моделей узагальнення на основі AI/ML у SageMaker може значно покращити догляд за пацієнтами та процес прийняття рішень, дозволяючи медичним працівникам швидко отримувати доступ до відповідної інформації та зосереджуватися на наданні якісної медичної допомоги.

ресурси

Повний сценарій, який обговорюється в цій публікації, і деякі приклади даних див GitHub репо. Щоб отримати додаткові відомості про те, як запускати робочі навантаження ML на AWS, перегляньте такі ресурси:

Про авторів

Коді Коллінз є нью-йоркським архітектором рішень Amazon Web Services. Він працює з клієнтами ISV над створенням провідних у галузі рішень у хмарі. Він успішно реалізовував складні проекти для різних галузей, оптимізуючи ефективність і масштабованість. У вільний час любить читати, подорожувати та тренуватися з джиу-джитсу.

Коді Коллінз є нью-йоркським архітектором рішень Amazon Web Services. Він працює з клієнтами ISV над створенням провідних у галузі рішень у хмарі. Він успішно реалізовував складні проекти для різних галузей, оптимізуючи ефективність і масштабованість. У вільний час любить читати, подорожувати та тренуватися з джиу-джитсу.

Амір Хакме є архітектором рішень AWS, який проживає в Пенсільванії. Його професійна діяльність передбачає співпрацю з незалежними постачальниками програмного забезпечення на північному сході, скеровуючи їх у проектуванні та створенні масштабованих, найсучасніших платформ у хмарі AWS.

Амір Хакме є архітектором рішень AWS, який проживає в Пенсільванії. Його професійна діяльність передбачає співпрацю з незалежними постачальниками програмного забезпечення на північному сході, скеровуючи їх у проектуванні та створенні масштабованих, найсучасніших платформ у хмарі AWS.

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- PlatoData.Network Vertical Generative Ai. Додайте собі сили. Доступ тут.

- PlatoAiStream. Web3 Intelligence. Розширення знань. Доступ тут.

- ПлатонЕСГ. Автомобільні / електромобілі, вуглець, CleanTech, Енергія, Навколишнє середовище, Сонячна, Поводження з відходами. Доступ тут.

- BlockOffsets. Модернізація екологічної компенсаційної власності. Доступ тут.

- джерело: https://aws.amazon.com/blogs/machine-learning/exploring-summarization-options-for-healthcare-with-amazon-sagemaker/

- : має

- :є

- : ні

- :де

- $UP

- 1

- 10

- 100

- 12

- 14

- 15%

- 24

- 33

- 7

- 8

- 9

- a

- Здатний

- МЕНЮ

- РЕЗЮМЕ

- прискорювати

- прискорювач

- доступ

- рахунки

- точний

- через

- дії

- Адам

- адресація

- вводити

- просунутий

- Переваги

- після

- знову

- агрегація

- AI

- ai дослідження

- AI / ML

- алгоритми

- ВСІ

- Дозволити

- дозволяє

- по

- вже

- Також

- Amazon

- Amazon SageMaker

- Amazon Web Services

- кількість

- суми

- an

- аналізувати

- та

- оголошений

- Інший

- будь-який

- API

- Інтерфейси

- застосовно

- застосування

- прикладної

- підхід

- підходи

- відповідний

- архітектура

- ЕСТЬ

- ARM

- прибуття

- стаття

- AS

- асоційований

- At

- увагу

- автоматизація

- доступний

- уникнути

- геть

- AWS

- Балансування

- заснований

- BE

- оскільки

- було

- перед тим

- починати

- користь

- Переваги

- КРАЩЕ

- Краще

- BIN

- кров

- Кров'яний тиск

- Цвісти

- Box

- дихання

- широкий

- будувати

- будівельники

- Створюємо

- побудований

- вбудований

- але

- by

- call

- званий

- CAN

- можливості

- який

- обережно

- випадок

- випадків

- каталог

- Викликати

- проблеми

- зміна

- chatbots

- вибір

- Вибирати

- Вибираючи

- вибраний

- клас

- Клінічний

- хмара

- код

- Коди

- Кодування

- співробітництво

- Колонка

- Колони

- Приходити

- приходить

- загальний

- порівняний

- скарги

- комплекс

- дотримання

- компонент

- Компоненти

- складається

- лаконічний

- конфігурація

- мінуси

- Консоль

- будівництво

- контекст

- контроль

- Зручний

- Відповідний

- рентабельним

- витрати

- може

- покритий

- створювати

- створений

- створення

- вирішальне значення

- В даний час

- виготовлений на замовлення

- клієнт

- Клієнти

- настройка

- дані

- набори даних

- Прийняття рішень

- рішення

- визначення

- поставляється

- демонстрація

- відділ

- залежний

- Залежно

- розгортання

- розгорнути

- розгортання

- розгортання

- дизайн

- призначений

- проектування

- бажаний

- деталі

- розвиненою

- прилади

- різний

- безпосередньо

- відкритий

- обговорювати

- обговорювалися

- Різне

- do

- Лікарі

- справи

- домен

- домени

- зроблений

- Не знаю

- вниз

- недоліки

- під час

- кожен

- легше

- легко

- легко

- легкий у використанні

- фактично

- ефективність

- ефективний

- продуктивно

- зусилля

- Electronic

- Електронні медичні записи

- права

- аварійний

- включіть

- дозволяє

- дозволяє

- Кінцева точка

- Машинобудування

- підвищувати

- забезпечувати

- підприємство

- запис

- Навколишнє середовище

- епоха

- істотний

- Навіть

- еволюціонує

- приклад

- існуючий

- досвід

- зазнають

- дослідити

- Розвіданий

- Дослідження

- розширення

- витяг

- Face

- стикаються

- далеко

- швидше

- Fed

- кілька

- філе

- Файли

- остаточний

- в кінці кінців

- знайти

- виявлення

- Перший

- відповідати

- Гнучкість

- Сфокусувати

- стежити

- після

- для

- формат

- фонд

- від

- Повний

- повністю

- функція

- Крім того

- майбутнє

- Отримувати

- Загальне

- породжувати

- генерується

- породжує

- отримати

- отримання

- Давати

- даний

- дає

- Go

- Google,

- Графічні процесори

- великий

- великий

- гарантований

- Мати

- he

- здоров'я

- охорона здоров'я

- Серце

- допомога

- його

- хостинг

- Як

- How To

- HTML

- HTTP

- HTTPS

- Концентратор

- HuggingFace

- ідеальний

- if

- Зображеннями

- здійснювати

- реалізація

- реалізації

- імпорт

- важливо

- удосконалювати

- in

- поглиблений

- включати

- includes

- У тому числі

- незалежний

- промисловості

- промисловість

- інформація

- повідомив

- початковий

- вхід

- витрати

- розуміння

- екземпляр

- інструкції

- інтеграція

- Інтелект

- в

- залучати

- IT

- ЙОГО

- робота

- json

- просто

- Знати

- знання

- lab

- Labs

- ландшафт

- мова

- великий

- останній

- пізніше

- вести

- провідний

- Веде за собою

- УЧИТЬСЯ

- вивчення

- залишити

- бібліотека

- як

- LLM

- загрузка

- погрузка

- розташування

- логіка

- подивитися

- втрачати

- від

- машина

- навчання за допомогою машини

- made

- підтримувати

- зробити

- Робить

- управляти

- вдалося

- управління

- карта

- Маркетинг

- Може..

- значити

- медичний

- Зустрічатися

- пам'ять

- зустрів

- метод

- може бути

- мінімальний

- хвилин

- ML

- модель

- Моделі

- Модулі

- більше

- найбільш

- Найбільш популярний

- множинний

- Названий

- Природний

- Обробка природних мов

- Переміщення

- Необхідність

- потреби

- Нові

- Нью-Йорк

- нещодавно

- наступний

- nlp

- немає

- ноутбук

- примітки

- зараз

- номер

- об'єкт

- об'єкти

- of

- пропонувати

- запропонований

- Пропозиції

- Старий

- on

- ONE

- ті,

- наступ

- на

- відкрити

- з відкритим вихідним кодом

- працювати

- оптимізація

- Оптимізувати

- оптимізований

- оптимізуючий

- варіант

- Опції

- or

- порядок

- організації

- оригінал

- Інше

- інакше

- наші

- з

- вихід

- поза

- над

- власний

- власність

- пакет

- упаковка

- сторінка

- Біль

- параметр

- параметри

- приватність

- проходити

- Проходження

- пацієнт

- pacientes

- Пегас

- Пенсільванія

- продуктивність

- що стосуються

- фрази

- платформа

- Платформи

- plato

- Інформація про дані Платона

- PlatoData

- точка

- популярний

- пошта

- потужний

- Живлення

- практика

- Прогноз

- надавати перевагу

- Готувати

- підготовлений

- представити

- тиск

- попередній перегляд

- раніше

- в першу чергу

- процес

- процеси

- обробка

- Вироблений

- професійний

- професіонали

- проектів

- обіцянку

- власником

- PROS

- забезпечувати

- за умови

- забезпечує

- забезпечення

- забезпечення

- мета

- цілей

- put

- Python

- якість

- Швидко

- швидко

- діапазон

- швидко

- ставка

- читання

- готовий

- Реальний світ

- облік

- доречний

- допомога

- видаляти

- Звіти

- вимагати

- вимагається

- Вимога

- Вимагається

- дослідження

- ресурси

- відповідь

- результати

- Умови повернення

- огляд

- Роль

- прогін

- біг

- пробіжки

- мудрець

- то ж

- зберегти

- масштабованість

- масштабовані

- сфера

- подряпати

- Sdk

- sdks

- безшовні

- розділам

- безпеку

- побачити

- окремий

- обслуговування

- Послуги

- комплект

- установка

- налаштування

- кілька

- укорочений

- Повинен

- Показувати

- показаний

- Шоу

- закриття

- Просіяти

- значний

- істотно

- аналогічний

- простий

- спрощений

- Розмір

- So

- так далеко

- Софтвер

- рішення

- Рішення

- деякі

- що в сім'ї щось

- Джерела

- конкретний

- конкретно

- відпрацьований

- старт

- Починаючи

- стан

- впроваджений

- заходи

- зберігання

- зберігати

- зберігати

- зберігання

- упорядкування

- структура

- студія

- підязиковий

- Успішно

- такі

- раптовий

- костюм

- підходящий

- РЕЗЮМЕ

- Переконайтеся

- Симптоми

- конспект

- синтетичний

- синтетичні дані

- Systems

- таблиця

- Приймати

- прийняті

- приймає

- Завдання

- завдання

- методи

- термінологія

- terms

- тест

- ніж

- Що

- Команда

- концентратор

- Їх

- потім

- Ці

- вони

- це

- ті

- три

- через

- по всьому

- час

- трудомісткий

- times

- до

- сьогоднішній

- разом

- токенізований

- Жетони

- інструменти

- факел

- Усього:

- поїзд

- навчений

- Навчання

- перетворений

- трансформатор

- Трансформатори

- Подорож

- два

- тип

- Типи

- типово

- ui

- Зрештою

- не в змозі

- при

- розуміти

- розуміння

- Оновити

- завантажено

- us

- використання

- використання випадку

- використовуваний

- зручно

- використовує

- використання

- використовує

- перевірка достовірності

- Цінності

- різний

- величезний

- постачальники

- різнобічний

- версія

- дуже

- Обсяги

- хотіти

- було

- we

- Багатство

- Web

- веб-сервіси

- важать

- ДОБРЕ

- Що

- коли

- який

- в той час як

- широкий

- Широкий діапазон

- волі

- з

- без

- слова

- Work

- робочий

- працює

- б

- лист

- рік

- йорк

- Ти

- вашу

- зефірнет

- Zip