Вступ

Можливо, ваш учитель початкової школи не показував вам, як складати 20-значні числа. Але якщо ви знаєте, як складати менші числа, вам знадобляться лише папір, олівець і трохи терпіння. Почніть з місця одиниць і крок за кроком рухайтеся ліворуч, і незабаром ви з легкістю накопичуватимете квінтильйони.

Такі проблеми легко вирішуються для людей, але тільки якщо ми підходимо до них правильно. «Те, як ми, люди, вирішуємо ці проблеми, — це не «дивитися на це, а потім записувати відповідь», — сказав він Еран Малах, дослідник машинного навчання в Гарвардському університеті. «Ми фактично проходимо по сходах».

Це розуміння надихнуло дослідників, які вивчають великі мовні моделі, на яких працюють такі чат-боти, як ChatGPT. Хоча ці системи можуть справлятися із запитаннями, які включають кілька кроків арифметики, вони часто помиляються проблемами, які включають багато кроків, як-от обчислення суми двох великих чисел. Але в 2022 році команда дослідників Google показав що звернення до мовних моделей для створення покрокових рішень дозволило моделям вирішити проблеми, які раніше здавалися поза їхньою досяжністю. Їхня техніка, яка називається спонуканням за ланцюжком думок, незабаром набула широкого поширення, хоча дослідники намагалися зрозуміти, чому вона працює.

Тепер кілька команд дослідили силу ланцюжка думок, використовуючи прийоми таємничої галузі теоретичної інформатики під назвою теорія обчислювальної складності. Це останній розділ у дослідженні, яке використовує теорію складності для вивчення внутрішніх можливостей і обмежень мовних моделей. Ці зусилля пояснюють, де ми повинні очікувати невдачі моделей, і вони можуть вказувати на нові підходи до їх створення.

"Вони знімають частину магії", - сказав Дімітріс Папайліопулос, дослідник машинного навчання в Університеті Вісконсіна, Медісон. «Це добре».

Тренувальні трансформери

Великі мовні моделі будуються навколо математичних структур, які називаються штучними нейронними мережами. Багато «нейронів» у цих мережах виконують прості математичні операції над довгими рядками чисел, що представляють окремі слова, перетворюючи кожне слово, яке проходить через мережу, в інше. Деталі цієї математичної алхімії залежать від іншого набору чисел, званих параметрами мережі, які кількісно визначають міцність зв’язків між нейронами.

Щоб навчити мовну модель створювати узгоджені результати, дослідники зазвичай починають із нейронної мережі, усі параметри якої мають випадкові значення, а потім передають їй масиви даних з Інтернету. Щоразу, коли модель бачить новий блок тексту, вона намагається передбачити кожне слово по черзі: вона вгадує друге слово на основі першого, третє на основі перших двох і так далі. Він порівнює кожне передбачення з фактичним текстом, а потім налаштовує його параметри, щоб зменшити різницю. Кожне налаштування лише трохи змінює прогнози моделі, але якимось чином їх сукупний ефект дозволяє моделі узгоджено реагувати на вхідні дані, які вона ніколи не бачила.

Дослідники навчали нейронні мережі обробляти мову протягом 20 років. Але робота по-справжньому почалася в 2017 році, коли дослідники з Google представили a новий вид мережі називають трансформатором.

«Це було запропоновано сім років тому, що здається передісторією», — сказав він Пабло Барсело, дослідник машинного навчання в Папському католицькому університеті Чилі.

Що зробило трансформатори настільки трансформаційними, так це те, що їх легко масштабувати — щоб збільшити кількість параметрів і обсяг даних для навчання — без того, щоб навчання було надмірно дорогим. До трансформаторів нейронні мережі мали щонайбільше кілька сотень мільйонів параметрів; сьогодні найбільші моделі на основі трансформаторів нараховують понад трильйон. Значна частина покращення продуктивності мовної моделі за останні п’ять років походить від простого розширення.

Трансформери зробили це можливим завдяки використанню спеціальних математичних структур, які називаються головками уваги, які дають їм щось на зразок висоти пташиного польоту на текст, який вони читають. Коли трансформатор читає новий блок тексту, його концентраційні головки швидко сканують весь текст і визначають відповідні зв’язки між словами — можливо, зауважуючи, що четверте та восьме слова, ймовірно, будуть найбільш корисними для передбачення 10-го. Потім голови уваги передають слова до величезної мережі нейронів, що називається мережею прямого зв’язку, яка виконує інтенсивну обробку чисел, необхідну для створення прогнозів, які допомагають їй навчатися.

Справжні трансформатори мають кілька рівнів головок уваги, розділених мережами прямого зв’язку, і видають прогнози лише після останнього шару. Але на кожному рівні головки уваги вже визначили найбільш релевантний контекст для кожного слова, тому етап, що вимагає інтенсивних обчислень, може відбуватися одночасно для кожного слова в тексті. Це прискорює процес навчання, роблячи можливим навчання трансформаторів на все більших наборах даних. Що ще важливіше, це дозволяє дослідникам розподілити величезне обчислювальне навантаження навчання масивної нейронної мережі між багатьма процесорами, що працюють у тандемі.

Щоб отримати максимальну віддачу від масивних наборів даних, «ви повинні зробити моделі дійсно великими», — сказав він Девід Чіанг, дослідник машинного навчання в Університеті Нотр-Дам. «Просто буде непрактично навчати їх, якщо це не паралельно».

Однак паралельна структура, завдяки якій так легко навчати трансформаторів, не допомагає після навчання — на цьому етапі немає потреби передбачати слова, які вже існують. Під час звичайної роботи трансформатори виводять одне слово за раз, прикріплюючи кожен вихідний сигнал назад до входу перед тим, як генерувати наступне слово, але вони все ще застрягли в архітектурі, оптимізованій для паралельної обробки.

У міру того як моделі на основі трансформаторів зростали, а певні завдання продовжували створювати їм проблеми, деякі дослідники почали замислюватися, чи поштовх до моделей, які можна розпаралелювати, коштував. Чи був спосіб теоретично зрозуміти поведінку трансформаторів?

Складність трансформерів

Теоретичні дослідження нейронних мереж стикаються з багатьма труднощами, особливо коли вони намагаються врахувати навчання. Нейронні мережі використовують добре відому процедуру для налаштування своїх параметрів на кожному кроці процесу навчання. Але може бути важко зрозуміти, чому ця проста процедура збігається на хорошому наборі параметрів.

Замість того, щоб розглядати, що відбувається під час навчання, деякі дослідники вивчають внутрішні можливості трансформаторів, уявляючи, що їх параметри можна налаштувати на будь-які довільні значення. Це означає розглядати трансформатор як особливий тип програмованого комп'ютера.

«У вас є якийсь обчислювальний пристрій, і ви хочете знати: «Ну, що він може?» Які функції він може обчислювати?», — сказав Чіанг.

Це центральні питання формального вивчення обчислень. Поле бере свій початок з 1936 року, коли Алан Тьюринг вперше уявив a химерний пристрій, яку тепер називають машиною Тьюрінга, яка могла виконувати будь-які обчислення, читаючи та записуючи символи на нескінченній стрічці. Теоретики обчислювальної складності пізніше спиралися на роботу Тюрінга, доводячи, що обчислювальні проблеми природно розпадаються на різні класи складності визначається ресурсами, необхідними для їх вирішення.

У 2019 році Барсело та двоє інших дослідників доведений що ідеалізована версія трансформатора з фіксованою кількістю параметрів може бути такою ж потужною, як машина Тьюрінга. Якщо ви налаштуєте трансформатор на повторну подачу вихідного сигналу як вхідного сигналу та встановите параметри на відповідні значення для конкретної проблеми, яку ви хочете вирішити, він зрештою видасть правильну відповідь.

Цей результат був відправною точкою, але він спирався на деякі нереалістичні припущення, які, ймовірно, переоцінюють потужність трансформаторів. З тих пір дослідники працювали над розробкою більш реалістичних теоретичних основ.

Одна з таких спроб розпочалася у 2021 році, коли Вільям Меррілл, тепер аспірант Нью-Йоркського університету, залишав дворічну стипендію в Інституті штучного інтелекту Аллена в Сіетлі. Перебуваючи там, він аналізував інші типи нейронних мереж, використовуючи методи, які, здавалося, погано підходили для паралельної архітектури трансформаторів. Незадовго до від'їзду він зав'язав розмову з дослідником Інституту Аллена для ШІ Ашиш Сабхарвал, який вивчав теорію складності, перш ніж перейти до досліджень ШІ. Вони почали підозрювати, що теорія складності може допомогти їм зрозуміти межі трансформаторів.

«Просто здавалося, що це проста модель; повинні бути деякі обмеження, які можна просто встановити», – сказав Сабхарвал.

Пара проаналізувала трансформатори за допомогою розділу теорії обчислювальної складності, який називається складністю схем, який часто використовується для вивчення паралельних обчислень і мав нещодавно застосовано до спрощених варіантів трансформерів. Протягом наступного року вони уточнили кілька нереалістичних припущень у попередній роботі. Щоб вивчити, як паралельна структура трансформаторів може обмежити їхні можливості, пара розглянула випадок, коли трансформатори не повертають вихідний сигнал назад на вхід — натомість їхній перший вихід має бути остаточною відповіддю. Вони доведений що трансформатори в цій теоретичній структурі не можуть вирішити жодних обчислювальних проблем, які лежать за межами певного класу складності. Вважається, що багато математичних завдань, у тому числі відносно прості, такі як розв’язування лінійних рівнянь, не належать до цього класу.

По суті, вони показали, що паралелізм коштує дорого — принаймні, коли трансформатори повинні були негайно дати відповідь. «Трансформери досить слабкі, якщо ви їх використовуєте, якщо ви надаєте вхід, і ви просто очікуєте негайної відповіді», — сказав Меррілл.

Мистецькі досліди

Результати Меррілла та Сабхарвала викликали природне запитання — наскільки потужнішими стають трансформатори, коли їм дозволяється переробляти свою продукцію? Барсело та його співавтори вивчали цей випадок у своєму аналізі ідеалізованих трансформаторів 2019 року, але з більш реалістичними припущеннями питання залишалося відкритим. А в наступні роки дослідники виявили спонукання до ланцюга думок, надавши питанню нової актуальності.

Меррілл і Сабхарвал знали, що їхній суто математичний підхід не може охопити всі аспекти ланцюжка думок у реальних мовних моделях, де формулювання в підказці може бути дуже важливим. Але незалежно від того, як сформульовано підказку, якщо вона змушує мовну модель виводити покрокові рішення, модель, в принципі, може повторно використовувати результати проміжних кроків під час наступних проходів через трансформатор. Це може забезпечити спосіб уникнути обмежень паралельних обчислень.

Тим часом команда з Пекінського університету думала подібним чином, і їхні попередні результати були позитивними. У документі від травня 2023 року вони визначили деякі математичні проблеми, які повинні бути неможливими для звичайних трансформаторів у системі Меррілла та Сабхарвала, і показав що проміжні кроки дозволили трансформаторам вирішити ці проблеми.

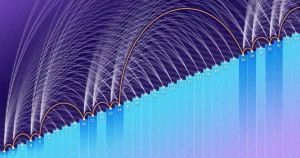

У жовтні Merrill і Sabharwal продовжили свою попередню роботу з a детальне теоретичне дослідження обчислювальної потужності ланцюга думок. Вони кількісно визначили, як ця додаткова обчислювальна потужність залежить від кількості проміжних кроків, які трансформатору дозволено використовувати, перш ніж він повинен буде видати остаточну відповідь. Загалом дослідники очікують, що відповідна кількість проміжних кроків для вирішення будь-якої проблеми залежатиме від розміру вхідних даних для проблеми. Наприклад, найпростіша стратегія додавання двох 20-значних чисел вимагає вдвічі більше проміжних кроків додавання, ніж той самий підхід до додавання двох 10-значних чисел.

Подібні приклади свідчать про те, що трансформатори не виграють від використання лише кількох проміжних кроків. Дійсно, Меррілл і Сабхарвал довели, що ланцюжок думок починає справді допомагати лише тоді, коли кількість проміжних кроків зростає пропорційно розміру вхідних даних, а для багатьох проблем кількість проміжних кроків ще збільшується.

Ретельність результату вразила дослідників. «Вони справді закріпили це», — сказав Даніель Хсу, дослідник машинного навчання в Колумбійському університеті.

Нещодавня робота Меррілла та Сабхарвала показує, що ланцюг думок не є панацеєю — в принципі, він може допомогти трансформаторам вирішити складніші проблеми, але лише ціною великих обчислювальних зусиль.

«Ми зацікавлені в різних способах обійти обмеження трансформаторів одним кроком», — сказав Меррілл. «Ланцюжок думок — це один із способів, але ця стаття показує, що це може бути не найекономічнішим».

Повернутися до реальності

Проте дослідники попереджають, що такий теоретичний аналіз може розкрити лише дуже багато про реальні мовні моделі. Позитивні результати — докази того, що трансформатори в принципі можуть вирішувати певні проблеми — не означають, що мовна модель дійсно вивчатиме ці рішення під час навчання.

І навіть результати, які стосуються обмежень трансформаторів, мають застереження: вони вказують на те, що жоден трансформатор не може ідеально вирішити певні проблеми в усіх випадках. Звичайно, це досить висока планка. «Можуть бути окремі випадки проблеми, з якими він міг би впоратися цілком», — сказав Хсу.

Незважаючи на ці застереження, нова робота пропонує шаблон для аналізу різних типів архітектур нейронних мереж, які з часом можуть замінити трансформатори. Якщо аналіз теорії складності припускає, що певні типи мереж потужніші за інші, це буде доказом того, що ці мережі також можуть працювати краще в реальному світі.

Чіанг також підкреслив, що дослідження обмежень трансформаторів є тим більш цінним, оскільки мовні моделі все частіше використовуються в широкому діапазоні реальних додатків, що дозволяє легко переоцінити їхні можливості.

«Насправді є багато речей, які вони роблять не дуже добре, і ми повинні дуже, дуже усвідомлювати обмеження», — сказав Чіанг. «Ось чому така робота дійсно важлива».

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- PlatoData.Network Vertical Generative Ai. Додайте собі сили. Доступ тут.

- PlatoAiStream. Web3 Intelligence. Розширення знань. Доступ тут.

- ПлатонЕСГ. вуглець, CleanTech, Енергія, Навколишнє середовище, Сонячна, Поводження з відходами. Доступ тут.

- PlatoHealth. Розвідка про біотехнології та клінічні випробування. Доступ тут.

- джерело: https://www.quantamagazine.org/how-chain-of-thought-reasoning-helps-neural-networks-compute-20240321/

- : має

- :є

- : ні

- :де

- ][стор

- $UP

- 10th

- 20

- 20 роки

- 2017

- 2019

- 2021

- 2022

- 2023

- a

- здібності

- МЕНЮ

- рахунки

- через

- фактичний

- насправді

- додавати

- додати

- доповнення

- адреса

- регулювати

- після

- назад

- AI

- ai дослідження

- Алан

- Алан Тьюринг

- Алхімія

- ВСІ

- всі

- дозволено

- дозволяє

- по

- вже

- Також

- кількість

- суми

- an

- аналіз

- проаналізовані

- Аналізуючи

- та

- Інший

- відповідь

- будь-який

- застосування

- підхід

- підходи

- відповідний

- довільний

- Arcane

- архітектура

- архітектури

- ЕСТЬ

- навколо

- штучний

- штучний інтелект

- AS

- запитувач

- аспекти

- припущення

- At

- увагу

- геть

- назад

- бар

- заснований

- BE

- стали

- ставати

- було

- перед тим

- почалася

- починається

- поведінка

- Краще

- між

- За

- Біт

- Блокувати

- Філія

- будувати

- Створюємо

- побудований

- але

- by

- розрахунок

- званий

- CAN

- можливості

- захоплення

- випадок

- випадків

- Причини

- обережність

- центральний

- певний

- ланцюг

- Зміни

- Глава

- chatbots

- ChatGPT

- Чилі

- клас

- КОГЕРЕНТНИЙ

- Collective

- COLUMBIA

- Приходити

- приходить

- складність

- обчислення

- обчислювальна

- обчислювальна потужність

- обчислювально

- обчислення

- комп'ютер

- Інформатика

- обчислення

- Зв'язки

- Вважати

- вважається

- контекст

- триває

- Розмова

- виправити

- Коштувати

- може

- Курс

- дані

- набори даних

- Дати

- певний

- залежати

- залежить

- деталі

- розвивати

- пристрій

- DID

- різниця

- різний

- важкий

- утруднення

- відкритий

- do

- робить

- Ні

- Не знаю

- вниз

- під час

- кожен

- Раніше

- простота

- легко

- ефект

- зусилля

- зусилля

- Восьмий

- включений

- дозволяє

- величезний

- рівняння

- особливо

- Втеча

- Навіть

- врешті-решт

- Кожен

- докази

- приклад

- існувати

- очікувати

- дорогий

- Розвіданий

- додатково

- Face

- FAIL

- Падати

- кілька

- поле

- остаточний

- кінець

- Перший

- відповідати

- п'ять

- фіксованою

- потім

- після

- для

- формальний

- Четвертий

- Рамки

- каркаси

- від

- Функції

- Отримувати

- Загальне

- породжувати

- породжує

- отримати

- отримання

- Давати

- дає

- буде

- добре

- є

- клас

- випускник

- виросла

- Рости

- Зростає

- було

- обробляти

- траплятися

- відбувається

- важче

- Гарвард

- Гарвардський університет

- Мати

- he

- голови

- важкий

- допомога

- допомагає

- Високий

- його

- Як

- How To

- HTTP

- HTTPS

- Людей

- сто

- ідентифікований

- ідентифікувати

- if

- уявляли

- Негайний

- важливо

- неможливе

- вражений

- поліпшення

- in

- У тому числі

- Augmenter

- все більше і більше

- дійсно

- вказувати

- вказує

- індивідуальний

- Нескінченний

- ING

- вхід

- витрати

- всередині

- розуміння

- натхненний

- замість

- Інститут

- Інтелект

- зацікавлений

- інтернет

- втручаючись

- в

- сутнісний

- введені

- за участю

- IT

- ЙОГО

- просто

- Дитина

- види

- Знати

- мова

- великий

- більше

- найбільших

- останній

- пізніше

- останній

- шар

- шарів

- УЧИТЬСЯ

- вивчення

- найменш

- догляд

- брехня

- як

- Ймовірно

- МЕЖА

- недоліки

- рамки

- Лінія

- лінійний

- ліній

- загрузка

- Довго

- серія

- машина

- навчання за допомогою машини

- made

- журнал

- магія

- зробити

- РОБОТИ

- Робить

- багато

- масивний

- математики

- математичний

- Матерія

- Може..

- веселий

- може бути

- мільйона

- модель

- Моделі

- більше

- найбільш

- переміщення

- багато

- множинний

- повинен

- Природний

- Необхідність

- необхідний

- мережу

- мереж

- нервовий

- нейронної мережі

- нейронні мережі

- Нейрони

- ніколи

- Нові

- Нью-Йорк

- наступний

- немає

- відзначивши,

- зараз

- номер

- номера

- жовтень

- of

- від

- Пропозиції

- часто

- on

- ONE

- ті,

- тільки

- на

- відкрити

- операція

- операції

- оптимізований

- звичайний

- Інше

- інші

- з

- вихід

- виходи

- поза

- над

- пара

- панацея

- Папір

- Паралельні

- параметри

- проходити

- проходить

- Минуле

- Терпіння

- Пекін

- відмінно

- Виконувати

- продуктивність

- може бути

- місце

- plato

- Інформація про дані Платона

- PlatoData

- точка

- бідні

- позитивний

- це можливо

- влада

- потужний

- Практичний

- передбачати

- прогнозування

- прогноз

- Прогнози

- попередньо

- досить

- попередній

- раніше

- принцип

- ймовірно

- Проблема

- проблеми

- процедура

- процес

- обробка

- процесори

- виробляти

- програмований

- докази

- частка

- запропонований

- доведений

- забезпечувати

- доведення

- суто

- Штовхати

- Квантамагазин

- кількісно оцінено

- питання

- питань

- швидко

- досить

- піднятий

- випадковий

- діапазон

- досягати

- читання

- реальний

- Реальний світ

- реалістичний

- Реальність

- насправді

- останній

- зменшити

- рафінований

- щодо

- актуальність

- доречний

- залишився

- видаляти

- ПОВТОРНО

- замінювати

- представляє

- вимагати

- вимагається

- Вимагається

- дослідження

- дослідник

- Дослідники

- ресурси

- Реагувати

- результат

- результати

- знову використовувати

- показувати

- право

- Зазначений

- то ж

- шкала

- Масштабування

- сканування

- Школа

- наука

- Сіетл

- другий

- здавалося

- Здається,

- бачив

- бачить

- комплект

- набори

- сім

- кілька

- Незабаром

- Повинен

- Показувати

- показав

- Шоу

- аналогічний

- простий

- спрощений

- просто

- одночасно

- з

- Розмір

- менше

- So

- Рішення

- ВИРІШИТИ

- Розв’язування

- деякі

- якось

- скоро

- спеціальний

- конкретний

- швидкість

- поширення

- укладання

- старт

- Починаючи

- Крок

- заходи

- Як і раніше

- Стратегія

- сила

- структура

- структур

- студент

- навчався

- Дослідження

- Вивчення

- вивчення

- наступні

- такі

- пропонувати

- Запропонує

- Systems

- Тандем

- завдання

- команда

- команди

- техніка

- методи

- шаблон

- текст

- ніж

- Що

- Команда

- їх

- Їх

- потім

- теоретичний

- теорія

- Там.

- Ці

- вони

- річ

- речі

- Мислення

- третій

- це

- ті

- думка

- через

- час

- до

- сьогодні

- прийняли

- до

- поїзд

- Навчання

- перетворювальний

- трансформатор

- Трансформатори

- лікування

- трильйон

- біда

- намагатися

- турінг

- ПЕРЕГЛЯД

- щипати

- Tweaks

- Двічі

- два

- тип

- Типи

- типово

- розуміти

- університет

- якщо не

- використання

- використовуваний

- корисний

- використовує

- використання

- Цінний

- Цінності

- версія

- версії

- дуже

- вид

- ходити

- хотіти

- було

- шлях..

- способи

- we

- слабкий

- Web

- webp

- ДОБРЕ

- добре відомі

- були

- Що

- коли

- Чи

- який

- в той час як

- всі

- чий

- чому

- широкий

- Широкий діапазон

- широко поширений

- волі

- з

- без

- дивуватися

- слово

- формулювання

- слова

- Work

- працював

- робочий

- світ

- б

- запис

- лист

- рік

- років

- йорк

- Ти

- зефірнет