Цей допис написано у співавторстві з Яном Полом Ассендорпом, Томасом Літцовим, Крістофером Машем, Олександром Мейнертом, доктором Ларсом Палцером, Яном Шіллемансом із SIGNAL IDUNA.

У SIGNAL IDUNA, великому німецькому страховику, ми зараз переосмислюємо себе за допомогою нашої програми трансформації VISION2023, щоб стати ще більш орієнтованими на клієнта. Два аспекти є центральними для цієї трансформації: реорганізація великої частини робочої сили в міжфункціональні та гнучкі команди та перетворення компанії, яка справді керується даними. Тут девіз «Ти створюєш, ти запускаєш» є важливою вимогою для міжфункціональної команди, яка створює продукт для даних або машинного навчання (ML). Це накладає жорсткі обмеження на те, скільки робоча група може витратити на виробництво та запуск продукту.

Ця публікація показує, як SIGNAL IDUNA вирішує цю проблему та використовує AWS Cloud щоб дозволити міжфункціональним командам створювати та вводити в дію власні продукти машинного навчання. З цією метою ми спочатку представляємо організаційну структуру гнучких команд, яка встановлює основні вимоги до хмарної інфраструктури, яка використовується для розробки та запуску продукту. Далі ми показуємо, як три центральні команди в SIGNAL IDUNA дозволяють міжфункціональним групам створювати продукти даних у хмарі AWS з мінімальною допомогою, забезпечуючи відповідний робочий процес та інфраструктурні рішення, які можна легко використовувати та адаптувати. Нарешті, ми переглядаємо наш підхід і порівнюємо його з більш класичним підходом, де розробка та експлуатація розділені суворіше.

Agile@SI – основа організаційних змін

З початку 2021 року SIGNAL IDUNA почала впроваджувати свою стратегію Agile@SI і впроваджувати гнучкі методи розробки клієнтоорієнтованих рішень у всій компанії [1]. Попередні завдання та цілі тепер виконують міжфункціональні команди, які називаються загони. Ці загони використовують гнучкі методи (наприклад, фреймворк Scrum), приймають власні рішення та створюють орієнтовані на клієнта продукти. Як правило, загони розташовані в бізнес-підрозділах, таких як маркетинг, і багато з них роблять сильний акцент на створенні продуктів, що керуються даними та працюють на основі машинного навчання. Як приклад, типові випадки використання в страхуванні – це прогнозування відтоку клієнтів і рекомендація продуктів.

Через складність ML створити рішення ML одним загоном складно, і, отже, вимагає співпраці різних загонів.

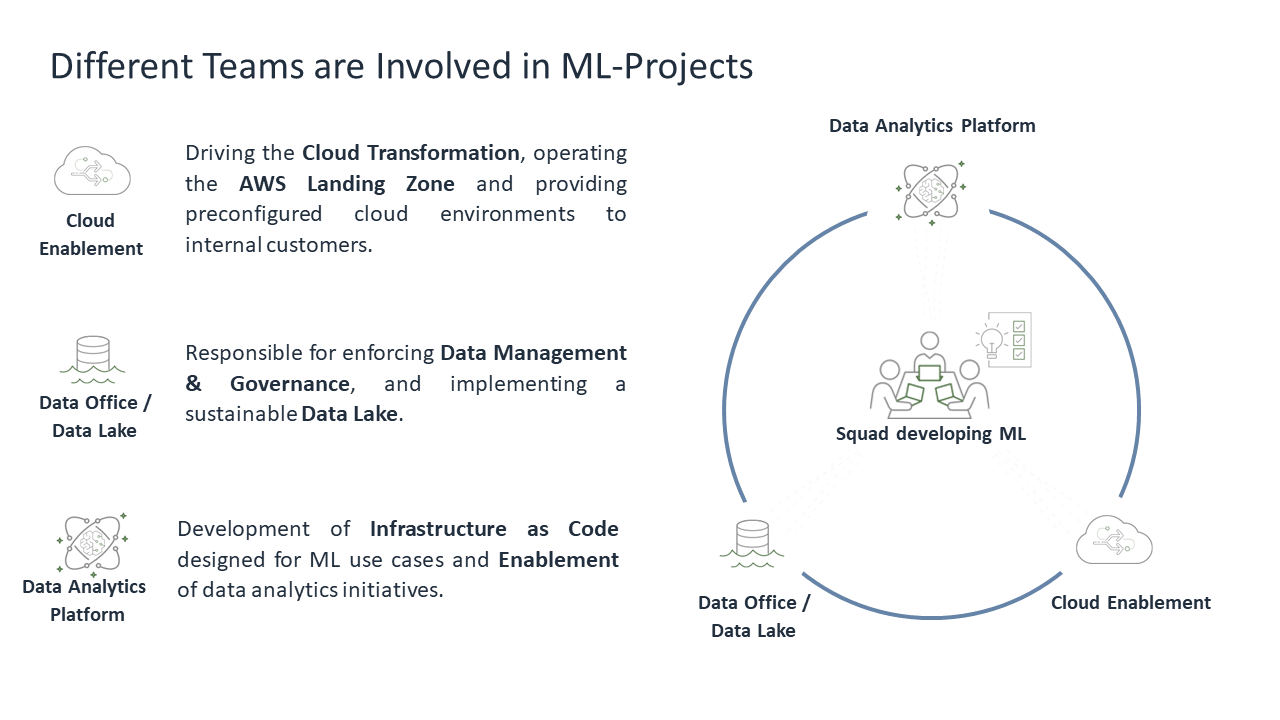

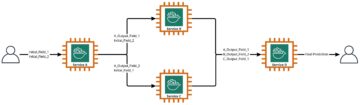

У SIGNAL IDUNA є три важливі команди, які підтримують створення рішень ML. Оточена цими трьома загонами команда, яка відповідає за розробку та довгострокову роботу та рішення ML. Цей підхід відповідає моделі спільної відповідальності AWS [2].

На зображенні вище всі загони представлені в огляді.

Увімкнення хмари

Базову хмарну інфраструктуру для всієї організації забезпечує Squad Cloud Enablement. Їхнє завдання — дати можливість командам самостійно створювати продукти на основі хмарних технологій. Це скорочує час виходу на ринок створення нових продуктів, таких як ML, і дотримується принципу «ви створюєте, ви запускаєте».

Data Office/Data Lake

Переміщення даних у хмару, а також пошук потрібного набору даних підтримується командою Data Office/Data Lake. Вони створили каталог даних, який можна використовувати для пошуку та вибору необхідних наборів даних. Їхня мета – забезпечити прозорість даних і управління. Крім того, вони відповідають за створення та роботу озера даних, яке допомагає командам отримувати доступ до відповідних даних і обробляти їх.

Платформа аналізу даних

Наша група Data Analytics Platform (DAP) — це команда SIGNAL IDUNA, орієнтована на хмару та машинне навчання, яка володіє досконалими знаннями в галузі машинного навчання, розробки даних, а також науки про дані. Ми дозволяємо внутрішнім командам використовувати публічну хмару для машинного навчання, надаючи компоненти інфраструктури та знання. Наші продукти та послуги детально представлені в наступному розділі.

Допомога міжфункціональним командам для створення рішень ML

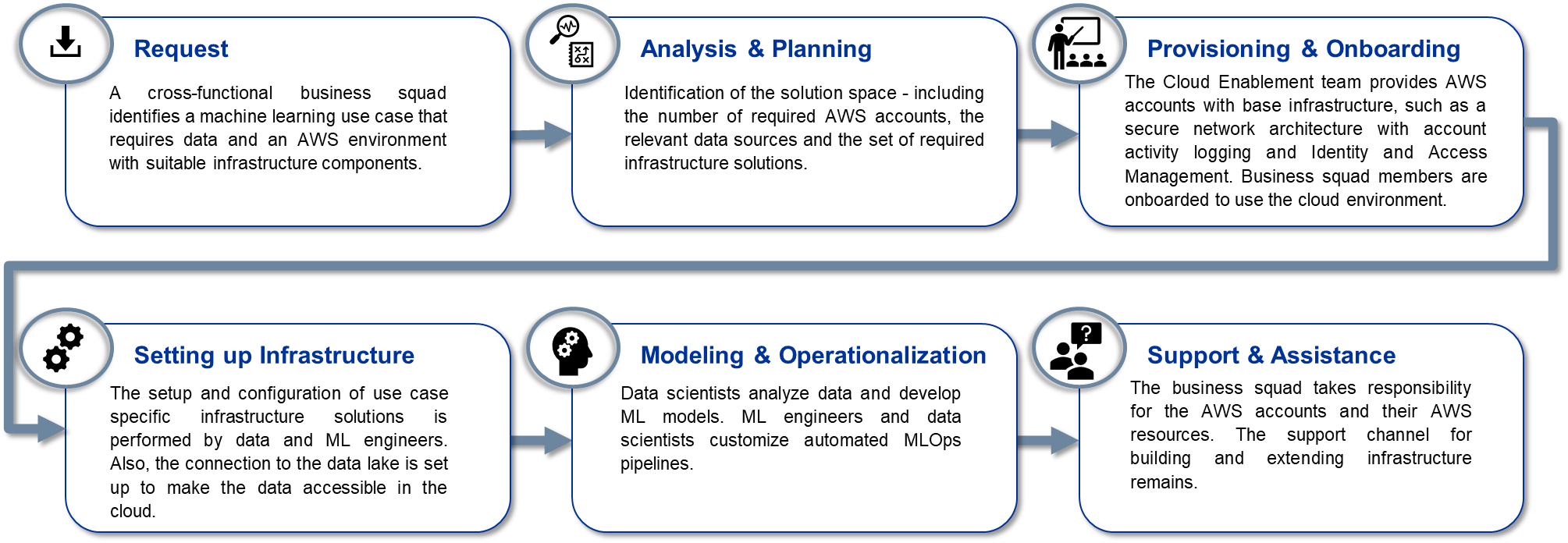

Щоб дозволити багатофункціональним командам у SIGNAL IDUNA створювати рішення для машинного навчання, нам потрібен швидкий і універсальний спосіб надання багаторазової хмарної інфраструктури, а також ефективний робочий процес для команд адаптації для використання можливостей хмари.

З цією метою ми створили стандартизований процес адаптації та підтримки, а також надали шаблони модульної інфраструктури як інфраструктура як код (IaC). Ці шаблони містять компоненти інфраструктури, розроблені для звичайних випадків використання машинного навчання, які можна легко адаптувати до вимог конкретного випадку використання.

Робочий процес створення рішень ML

Є три основні технічні ролі, які беруть участь у розробці та експлуатації рішень ML: науковець з даних, інженер ML та інженер даних. Кожна роль є частиною міжфункціональної команди та має різні обов’язки. Спеціаліст із обробки даних має необхідні знання щодо функціональних і технічних вимог конкретного варіанта використання. Інженер ML спеціалізується на створенні автоматизованих рішень ML і розгортанні моделей. А інженер обробки даних стежить за тим, щоб дані надходили з локальної мережі та в хмару.

Процес надання платформи виглядає наступним чином:

Інфраструктура конкретного сценарію використання визначена в IaC і керується версіями в центральному сховищі проекту. Це також включає конвеєри для навчання та розгортання моделі, а також інші артефакти коду, пов’язані з наукою про дані. Науковці даних, інженери ML та інженери даних мають доступ до сховища проектів і можуть налаштовувати та оновлювати весь код інфраструктури автономно. Це дозволяє команді швидко змінювати інфраструктуру, якщо це необхідно. Однак інженер ML завжди може допомогти в розробці та оновленні інфраструктури або моделей ML.

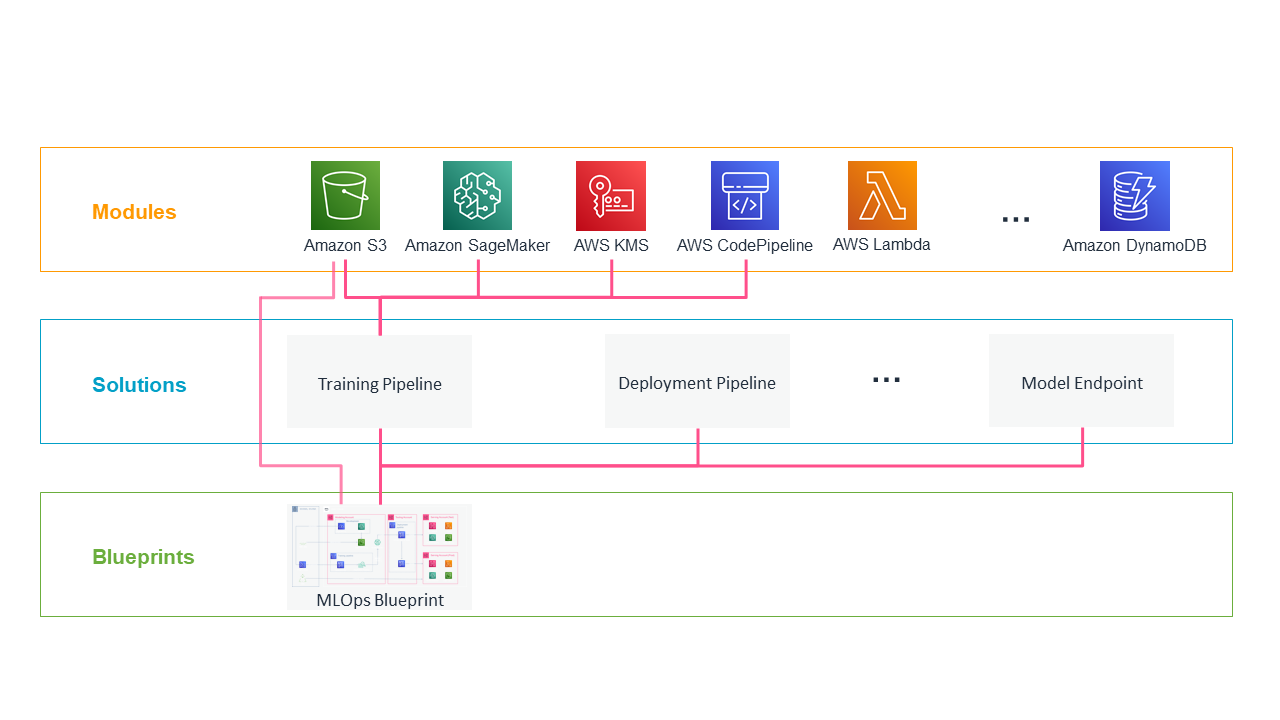

Багаторазові та модульні компоненти інфраструктури

Реалізовані ієрархічні та модульні ресурси IaC Terraform і включають інфраструктуру для загальної науки про дані та випадків використання ETL. Це дає нам змогу повторно використовувати код інфраструктури та застосовувати необхідні політики безпеки та відповідності, наприклад використання Служба керування ключами AWS (KMS) шифрування даних, а також інкапсуляція інфраструктури в Віртуальна приватна хмара Amazon (VPC) середовища без прямого доступу до Інтернету.

Ієрархічна структура IaC така:

- Модулі інкапсулювати основні сервіси AWS з необхідною конфігурацією для безпеки та керування доступом. Це включає конфігурації найкращих практик, такі як запобігання публічного доступу до Amazon Simple Storage Service (S3) відра або застосування шифрування для всіх збережених файлів.

- У деяких випадках вам потрібні різноманітні служби для автоматизації процесів, наприклад для розгортання моделей ML на різних етапах. Тому ми визначили Рішення як набір різних модулів у спільній конфігурації для різних типів завдань.

- Крім того, пропонуємо комплект світлокопій які поєднують рішення в різних середовищах для задоволення багатьох потенційних потреб проекту. У нашому плані MLOps ми визначаємо розгорнуту інфраструктуру для навчання, підготовки та моніторингу моделей ML, які інтегровані та поширені в облікових записах AWS. Ми обговоримо додаткові подробиці в наступному розділі.

Команда DAP підтримує версії цих продуктів у центральному сховищі. Це дозволяє нам постійно вдосконалювати наш IaC і розглядати нові функції від AWS, як-от Amazon SageMaker Реєстр моделей. Кожен загін може посилатися на ці ресурси, параметризувати їх за потреби та, нарешті, розгорнути їх у своїх власних облікових записах AWS.

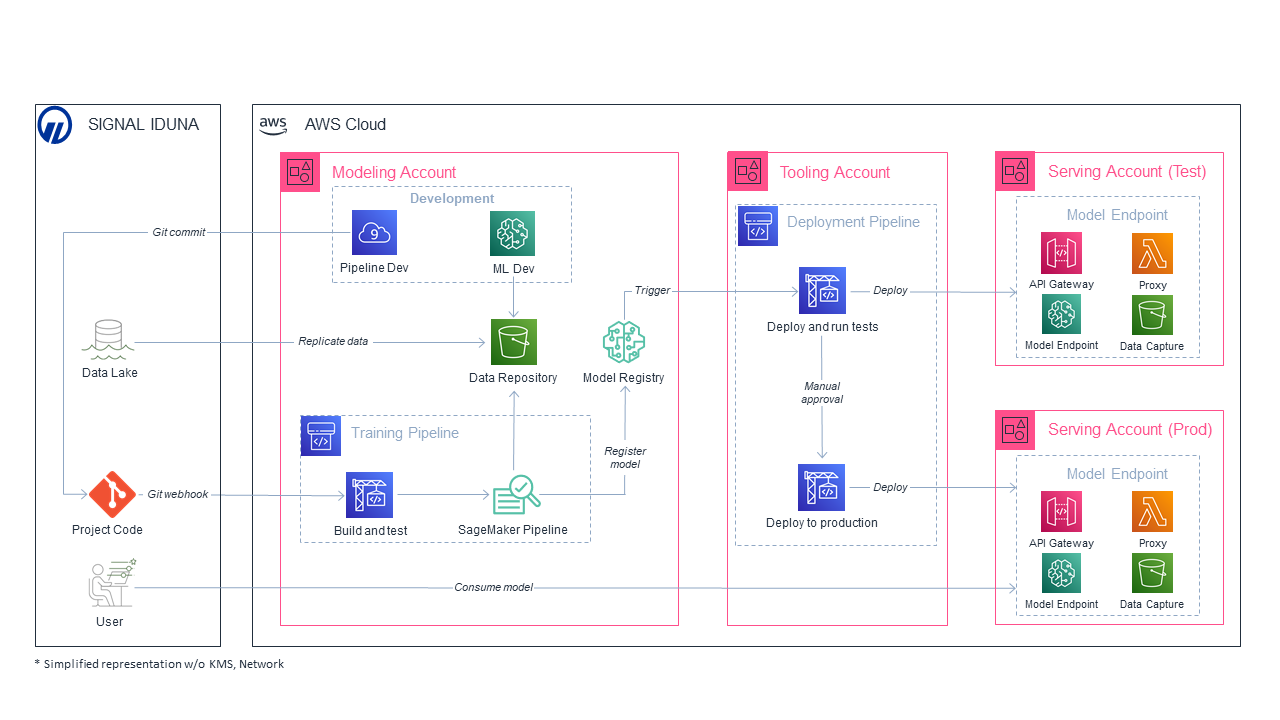

Архітектура MLOps

Ми надаємо готовий до використання план із конкретними рішеннями для охоплення всього процесу MLOps. План містить інфраструктуру, розподілену між чотирма обліковими записами AWS для створення та розгортання моделей машинного навчання. Це дає нам змогу ізолювати ресурси та робочі процеси для різних етапів процесу MLOps. На наступному малюнку показано архітектуру кількох облікових записів, і ми описуємо, як розподіляється відповідальність за конкретні етапи процесу між різними технічними ролями.

Команда моделювання рахунок включає послуги з розробки моделей ML. По-перше, розробник даних використовує процес ETL для надання відповідних даних з озера даних SIGNAL IDUNA, централізованого шлюзу для робочих процесів, керованих даними, у хмарі AWS. Згодом набір даних може бути використаний фахівцем з даних для навчання та оцінки кандидатів на модель. Коли модель-кандидат буде готова до масштабних експериментів, інженер ML інтегрує кандидата в автоматизовану систему навчання. Ми використовуємо Amazon SageMaker Pipelines для автоматизації навчання, налаштування гіперпараметрів і оцінки моделі в масштабі. Це також включає родовід моделей і стандартизований механізм затвердження для моделей, які планується розгортати у виробництві. Автоматизовані модульні тести та аналіз коду забезпечують якість і надійність коду для кожного етапу конвеєра, наприклад попередньої обробки даних, навчання моделі та оцінки. Після оцінки та схвалення моделі ми використовуємо Amazon SageMaker ModelPackages як інтерфейс для навченої моделі та відповідних метаданих.

Команда інструменти обліковий запис містить автоматизовані конвеєри CI/CD з різними етапами для тестування та розгортання навчених моделей. На етапі тестування моделі розгортаються в порційно-непрод рахунок. Незважаючи на те, що якість моделі оцінюється в процесі навчання перед початком її виробництва, тут ми проводимо тести продуктивності та інтеграції в ізольованому середовищі тестування. Після проходження етапу тестування моделі розгортаються в сервірово-прод обліковий запис для інтеграції у робочі процеси виробництва.

Розділення етапів робочого процесу MLOps на різні облікові записи AWS дозволяє нам ізолювати розробку та тестування від виробництва. Таким чином, ми можемо застосувати сувору політику доступу та безпеки. Крім того, індивідуальні ролі IAM гарантують, що певні служби можуть отримувати доступ лише до даних та інших послуг, необхідних для їх сфери дії, відповідно до принцип найменшої привілеї. Сервіси в обслуговуючих середовищах можуть додатково бути доступними для зовнішніх бізнес-процесів. Наприклад, бізнес-процес може запитувати кінцеву точку в середовищі обслуговування продукції для прогнозування моделі.

Переваги нашого підходу

Цей процес має багато переваг порівняно із суворим розділенням розробки та експлуатації для обох моделей ML, а також необхідної інфраструктури:

- Ізоляція: кожна команда отримує власний набір облікових записів AWS, які повністю ізольовані від середовища інших команд. Це полегшує керування правами доступу та збереження конфіденційності даних для тих, хто має право з ними працювати.

- Увімкнення хмари: Члени команди з невеликим попереднім досвідом роботи з хмарними DevOps (наприклад, багато спеціалістів із обробки даних) можуть легко спостерігати за всім процесом проектування та керування інфраструктурою, оскільки (майже) нічого не приховано від них за центральною службою. Це створює краще розуміння інфраструктури, що, у свою чергу, може допомогти їм створювати наукові продукти даних більш ефективно.

- Право власності на продукт: використання попередньо налаштованих інфраструктурних рішень і керованих служб зберігає перешкоди для керування продуктом ML у виробництві на дуже низькому рівні. Таким чином, фахівець із обробки даних може легко взяти у власність модель, яка запущена у виробництво. Це мінімізує добре відомий ризик невдачі у виробництво моделі після розробки.

- інновація: Оскільки інженери ML залучаються задовго до того, як модель буде готова до запуску у виробництво, вони можуть створювати інфраструктурні рішення, придатні для нових випадків використання, поки дослідники даних розробляють модель ML.

- Адаптованість: оскільки рішення IaC, розроблене DAP, є у вільному доступі, будь-яка команда може легко адаптувати їх відповідно до конкретних потреб у своєму випадку використання.

- Відкрите джерело: усі нові інфраструктурні рішення можна легко зробити доступними через центральне сховище коду DAP для використання іншими командами. З часом це створить багату кодову базу з компонентами інфраструктури, адаптованими до різних випадків використання.

Підсумки

У цій публікації ми продемонстрували, як багатофункціональні команди в SIGNAL IDUNA можуть створювати та запускати продукти машинного навчання на AWS. Основним у нашому підході є використання спеціального набору облікових записів AWS для кожної команди в поєднанні зі спеціальними планами та рішеннями IaC. Ці два компоненти дозволяють багатофункціональній команді створювати та керувати інфраструктурою якості виробництва. Своєю чергою, вони можуть отримати повне володіння своїми продуктами ML.

Відноситься до Конвеєри створення моделей Amazon SageMaker – Amazon SageMaker щоб дізнатися більше.

Знайдіть більше інформації ML на AWS на нашій офіційній сторінці.

посилання

[1] https://www.handelsblatt.com/finanzen/versicherungsbranche-vorbild-spotify-signal-iduna-wird-von-einer-handwerker-versicherung-zum-agilen-konzern/27381902.html

[2] https://blog.crisp.se/wp-content/uploads/2012/11/SpotifyScaling.pdf

[3] https://aws.amazon.com/compliance/shared-responsibility-model/

Про авторів

Ян Пауль Ассендорп є інженером ML із сильним фокусом на наукових даних. Він створює моделі ML і автоматизує навчання моделей і розгортання у виробничих середовищах.

Ян Пауль Ассендорп є інженером ML із сильним фокусом на наукових даних. Він створює моделі ML і автоматизує навчання моделей і розгортання у виробничих середовищах.

Томас Літцов є Scrum Master платформи Squad Data Analytics.

Томас Літцов є Scrum Master платформи Squad Data Analytics.

Крістофер Маш є власником продукту Squad Data Analytics Platform, який володіє знаннями в галузі обробки даних, науки про дані та розробки машинного навчання.

Крістофер Маш є власником продукту Squad Data Analytics Platform, який володіє знаннями в галузі обробки даних, науки про дані та розробки машинного навчання.

Олександр Мейнерт є частиною команди Data Analytics Platform і працює інженером ML. Починав зі статистики, виріс на проектах із науки про дані, знайшов пристрасть до методів і архітектури ML.

Олександр Мейнерт є частиною команди Data Analytics Platform і працює інженером ML. Починав зі статистики, виріс на проектах із науки про дані, знайшов пристрасть до методів і архітектури ML.

Доктор Ларс Палцер є спеціалістом із обробки даних і є частиною команди Data Analytics Platform. Після того, як він допоміг створити компоненти архітектури MLOps, тепер він використовує їх для створення продуктів ML.

Доктор Ларс Палцер є спеціалістом із обробки даних і є частиною команди Data Analytics Platform. Після того, як він допоміг створити компоненти архітектури MLOps, тепер він використовує їх для створення продуктів ML.

Ян Шиллеманс є інженером ML із досвідом розробки програмного забезпечення. Він зосереджується на застосуванні найкращих практик програмної інженерії в середовищах ML (MLOps).

Ян Шиллеманс є інженером ML із досвідом розробки програмного забезпечення. Він зосереджується на застосуванні найкращих практик програмної інженерії в середовищах ML (MLOps).

- Coinsmart. Найкраща в Європі біржа біткойн та криптовалют.

- Платоблокчейн. Web3 Metaverse Intelligence. Розширені знання. БЕЗКОШТОВНИЙ ДОСТУП.

- CryptoHawk. Альткойн Радар. Безкоштовне випробування.

- Джерело: https://aws.amazon.com/blogs/machine-learning/how-signal-iduna-operationalizes-machine-learning-projects-on-aws/

- "

- 100

- 2021

- доступ

- рахунки

- через

- дію

- Переваги

- моторний

- ВСІ

- хоча

- Amazon

- аналіз

- аналітика

- Застосування

- підхід

- архітектура

- Автоматизований

- доступний

- AWS

- буття

- КРАЩЕ

- передового досвіду

- будувати

- Створюємо

- Пакет

- бізнес

- можливості

- випадків

- виклик

- хмара

- інфраструктура хмари

- код

- співробітництво

- поєднання

- загальний

- компанія

- порівняний

- дотримання

- конфігурація

- містить

- створення

- дані

- Analytics даних

- наука про дані

- вчений даних

- присвячених

- розгортання

- розгортання

- розгортання

- проектування

- деталь

- розвивати

- розвиненою

- розвивається

- розробка

- різний

- обговорювати

- розподілений

- домен

- легко

- шифрування

- Кінцева точка

- інженер

- Машинобудування

- Інженери

- Навколишнє середовище

- істотний

- встановити

- приклад

- досвід

- ШВИДКО

- риси

- Рисунок

- в кінці кінців

- Перший

- Сфокусувати

- увагу

- після

- знайдений

- фонд

- Рамки

- Повний

- Цілі

- управління

- допомога

- допомагає

- тут

- Як

- HTTPS

- зображення

- реалізовані

- важливо

- удосконалювати

- включати

- інформація

- Інфраструктура

- страхування

- інтегрований

- інтеграція

- інтерфейс

- інтернет

- залучений

- IT

- ключ

- знання

- великий

- УЧИТЬСЯ

- вивчення

- трохи

- Довго

- машина

- навчання за допомогою машини

- управління

- управління

- ринок

- Маркетинг

- матч

- члени

- Meta

- ML

- модель

- Моделі

- модульний

- моніторинг

- Нові можливості

- нові продукти

- пропонувати

- офіційний

- На борту

- операційний

- організація

- Інше

- власник

- продуктивність

- платформа

- Політика

- політика

- прогноз

- Прогнози

- Попередження

- приватний

- процес

- процеси

- Product

- Production

- Продукти

- програма

- проект

- проектів

- забезпечувати

- громадськість

- Публічна хмара

- якість

- Сховище

- вимагається

- Вимога

- ресурси

- відповідальний

- огляд

- Risk

- прогін

- шкала

- наука

- вчений

- Вчені

- Пошук

- безпеку

- обслуговування

- Послуги

- виступаючої

- комплект

- загальні

- простий

- Софтвер

- розробка програмного забезпечення

- Рішення

- спеціалізується

- витрачати

- Стажування

- старт

- почалася

- статистика

- зберігання

- Стратегія

- сильний

- Згодом

- підтримка

- Підтриманий

- оточений

- завдання

- команда

- технічний

- Технології

- тест

- Тестування

- Тести

- час

- Навчання

- Перетворення

- прозорість

- Оновити

- us

- використання

- використовувати

- Віртуальний

- годинник

- ВООЗ

- в

- без

- Work

- Трудові ресурси

- працює