У сучасну інформаційну епоху величезні обсяги даних, що містяться в незліченних документах, є викликом і можливістю для бізнесу. Традиційні методи обробки документів часто не досягають ефективності та точності, залишаючи місце для інновацій, економічності та оптимізації. Обробка документів стала свідком значного прогресу з появою інтелектуальної обробки документів (IDP). За допомогою IDP підприємства можуть перетворювати неструктуровані дані з різних типів документів у структуровані практичні висновки, значно підвищуючи ефективність і зменшуючи ручні зусилля. Однак на цьому потенціал не закінчується. Інтегруючи генеративний штучний інтелект (AI) у процес, ми можемо ще більше розширити можливості IDP. Generative AI не тільки надає розширені можливості в обробці документів, але також забезпечує динамічну адаптацію до мінливих шаблонів даних. У цьому дописі ви ознайомитесь із синергією IDP та генеративного штучного інтелекту, розкривши, як вони являють собою наступний рубіж у обробці документів.

Ми детально обговорюємо IDP у нашій серії Інтелектуальна обробка документів за допомогою служб AWS AI (Частина 1 та Частина 2). У цій публікації ми обговорюємо, як розширити нову або існуючу архітектуру IDP за допомогою великих мовних моделей (LLM). Точніше, ми обговорюємо, як ми можемо інтегруватися Текст Amazon з LangChain як завантажувач документів і Amazon Bedrock витягувати дані з документів і використовувати генеративні можливості ШІ на різних етапах IDP.

Amazon Texttract — це служба машинного навчання (ML), яка автоматично витягує текст, рукописний текст і дані зі сканованих документів. Amazon Bedrock — це повністю керований сервіс, який пропонує вибір високоефективних базових моделей (FM) через прості у використанні API.

На наступній діаграмі показано еталонну архітектуру високого рівня, яка пояснює, як можна додатково покращити робочий процес IDP за допомогою базових моделей. Ви можете використовувати LLM на одній або всіх фазах IDP залежно від варіанту використання та бажаного результату.

У наступних розділах ми детально зануримося в те, як Amazon Texttract інтегрується в генеративні робочі процеси ШІ за допомогою LangChain для обробки документів для кожного з цих конкретних завдань. Надані тут блоки коду скорочені для стислості. Зверніться до нашого GitHub сховище докладні блокноти Python і покрокове керівництво.

Вилучення тексту з документів є вирішальним аспектом, коли йдеться про обробку документів за допомогою LLM. Ви можете використовувати Amazon Texttract для вилучення неструктурованого необробленого тексту з документів і збереження оригінальних напівструктурованих або структурованих об’єктів, як-от пари ключ-значення та таблиці, присутні в документі. Пакети документів, як-от претензії щодо охорони здоров’я та страхування чи іпотеки, складаються зі складних форм, які містять багато інформації у структурованих, напівструктурованих і неструктурованих форматах. Вилучення документів тут є важливим кроком, оскільки LLMs отримує перевагу від багатого вмісту для отримання більш точних і релевантних відповідей, які інакше можуть вплинути на якість результатів LLM.

LangChain — це потужна платформа з відкритим вихідним кодом для інтеграції з LLM. LLM загалом є універсальними, але можуть мати проблеми з предметно-специфічними завданнями, де потрібен глибший контекст і нюансовані відповіді. LangChain дає змогу розробникам у таких сценаріях створювати агенти, які можуть розбивати складні завдання на менші підзадачі. Потім підзавдання можуть вводити контекст і пам’ять у LLM шляхом з’єднання та ланцюжка підказок LLM.

Пропозиції LangChain завантажувачі документів який може завантажувати та перетворювати дані з документів. Ви можете використовувати їх для структурування документів у бажані формати, які можуть оброблятися LLM. The AmazonTextractPFLoader це тип завантажувача документів, який забезпечує швидкий спосіб автоматизації обробки документів за допомогою Amazon Texttract у поєднанні з LangChain. Для більш детальної інформації на AmazonTextractPDFLoader, див LangChain документація. Щоб використовувати завантажувач документів Amazon Texttract, ви починаєте з імпорту його з бібліотеки LangChain:

from langchain.document_loaders import AmazonTextractPDFLoaderhttps_loader = AmazonTextractPDFLoader("https://sample-website.com/sample-doc.pdf")

https_document = https_loader.load() s3_loader = AmazonTextractPDFLoader("s3://sample-bucket/sample-doc.pdf")

s3_document = s3_loader.load()Ви також можете зберігати документи в Amazon S3 і звертатися до них за допомогою шаблону URL-адреси s3://, як пояснюється в Доступ до сегмента за допомогою S3://, і передайте цей шлях S3 до завантажувача PDF-файлів Amazon Texttract:

import boto3

textract_client = boto3.client('textract', region_name='us-east-2') file_path = "s3://amazon-textract-public-content/langchain/layout-parser-paper.pdf"

loader = AmazonTextractPDFLoader(file_path, client=textract_client)

documents = loader.load()Багатосторінковий документ міститиме кілька сторінок тексту, доступ до яких можна отримати за допомогою об’єкта документів, який є списком сторінок. Наступний код перебирає сторінки в об’єкті документів і друкує текст документа, який доступний через page_content атрибут:

print(len(documents)) for document in documents: print(document.page_content)Amazon Comprehend і LLM можна ефективно використовувати для класифікації документів. Amazon Comprehend — це служба обробки природної мови (NLP), яка використовує ML для витягування інформації з тексту. Amazon Comprehend також підтримує навчання моделі спеціальної класифікації з усвідомленням макета таких документів, як PDF, Word і формати зображень. Додаткову інформацію про використання класифікатора документів Amazon Comprehend див Класифікатор документів Amazon Comprehend додає підтримку макета для більшої точності.

У поєднанні з LLM класифікація документів стає потужним підходом для керування великими обсягами документів. LLM є корисними для класифікації документів, оскільки вони можуть аналізувати текст, шаблони та контекстуальні елементи в документі, використовуючи розуміння природної мови. Ви також можете налаштувати їх для певних класів документів. Коли новий тип документа, представлений у конвеєрі IDP, потребує класифікації, LLM може обробити текст і класифікувати документ за набором класів. Нижче наведено зразок коду, який використовує завантажувач документів LangChain на базі Amazon Texttract для вилучення тексту з документа та використання його для класифікації документа. Ми використовуємо Антропний Клод v2 модель через Amazon Bedrock для виконання класифікації.

У наступному прикладі ми спочатку вилучаємо текст зі звіту про виписку пацієнта та використовуємо LLM, щоб класифікувати його за допомогою списку трьох різних типів документів:DISCHARGE_SUMMARY, RECEIPT та PRESCRIPTION. На наступному знімку екрана показано наш звіт.

from langchain.document_loaders import AmazonTextractPDFLoader

from langchain.llms import Bedrock

from langchain.prompts import PromptTemplate

from langchain.chains import LLMChain loader = AmazonTextractPDFLoader("./samples/document.png")

document = loader.load() template = """ Given a list of classes, classify the document into one of these classes. Skip any preamble text and just give the class name. <classes>DISCHARGE_SUMMARY, RECEIPT, PRESCRIPTION</classes>

<document>{doc_text}<document>

<classification>""" prompt = PromptTemplate(template=template, input_variables=["doc_text"])

bedrock_llm = Bedrock(client=bedrock, model_id="anthropic.claude-v2") llm_chain = LLMChain(prompt=prompt, llm=bedrock_llm)

class_name = llm_chain.run(document[0].page_content) print(f"The provided document is = {class_name}")

Резюмування передбачає згортання даного тексту або документа до більш короткої версії, зберігаючи при цьому ключову інформацію. Ця техніка корисна для ефективного пошуку інформації, що дозволяє користувачам швидко зрозуміти ключові моменти документа, не читаючи весь вміст. Хоча Amazon Texttract безпосередньо не виконує резюмування тексту, він надає базові можливості для вилучення всього тексту з документів. Цей витягнутий текст служить вхідними даними для нашої моделі LLM для виконання завдань підсумовування тексту.

Використовуючи той самий зразок звіту про виписку, який ми використовуємо AmazonTextractPDFLoader щоб отримати текст із цього документа. Як і раніше, ми використовуємо модель Claude v2 через Amazon Bedrock та ініціалізуємо її за допомогою підказки, яка містить інструкції щодо того, що робити з текстом (у цьому випадку, підсумовуванням). Нарешті, ми запускаємо ланцюжок LLM, передаючи витягнутий текст із завантажувача документів. Це запускає дію висновку на LLM із підказкою, яка складається з інструкцій для підсумовування та тексту документа, позначеного Document. Дивіться наступний код:

Код генерує підсумок підсумкового звіту про виписку пацієнта:

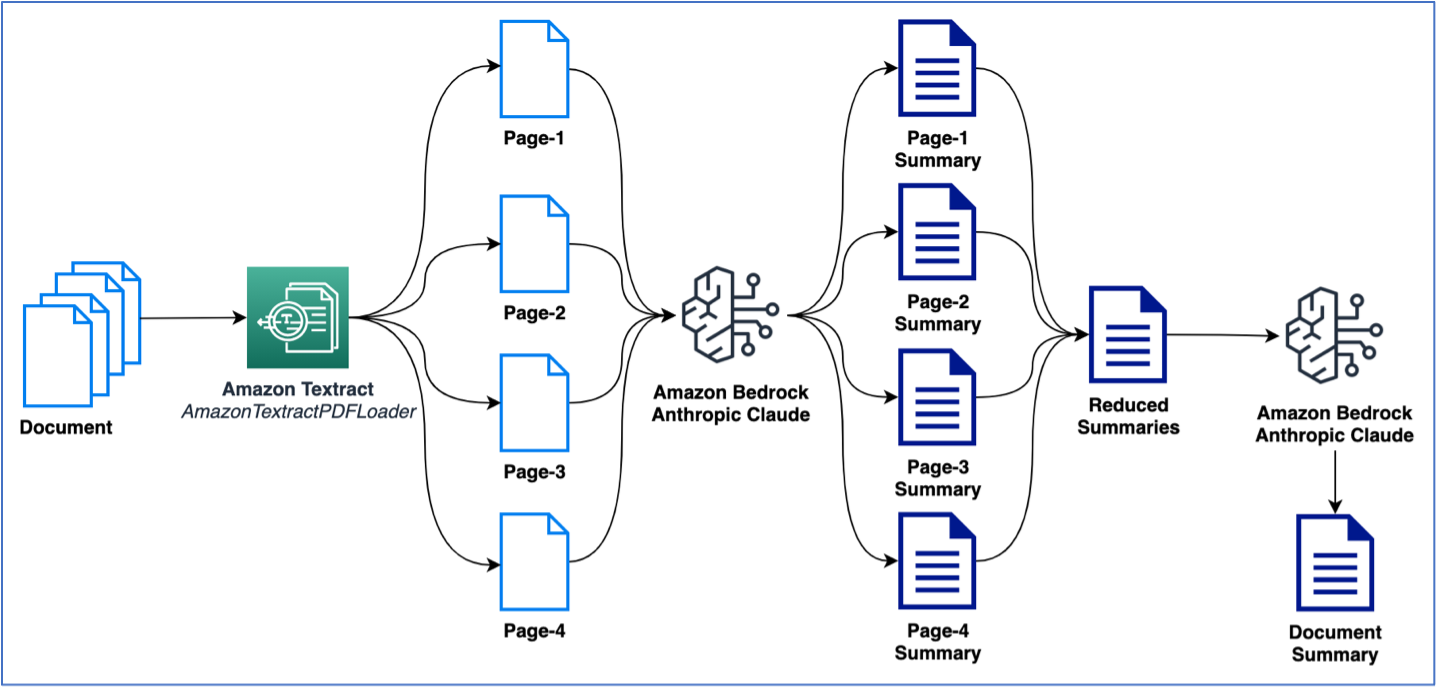

У попередньому прикладі для підсумовування використовувався односторінковий документ. Однак ви, швидше за все, матимете справу з документами, що містять кілька сторінок, які потребують узагальнення. Поширений спосіб виконання резюме на кількох сторінках полягає в тому, щоб спочатку створити підсумки на менших фрагментах тексту, а потім об’єднати менші підсумки, щоб отримати остаточне резюме документа. Зауважте, що цей метод потребує кількох викликів LLM. Логіку для цього можна легко створити; проте LangChain надає вбудований ланцюжок підсумовування, який може підсумовувати великі тексти (з багатосторінкових документів). Узагальнення може відбуватися через map_reduce або stuff параметри, які доступні як параметри для керування кількома викликами LLM. У наступному прикладі ми використовуємо map_reduce щоб підсумувати багатосторінковий документ. Наступний малюнок ілюструє наш робочий процес.

Давайте спочатку витягнемо документ і побачимо загальну кількість токенів на сторінці та загальну кількість сторінок:

Далі ми використовуємо вбудований LangChain load_summarize_chain щоб підсумувати весь документ:

from langchain.chains.summarize import load_summarize_chain summary_chain = load_summarize_chain(llm=bedrock_llm, chain_type='map_reduce')

output = summary_chain.run(document)

print(output.strip())Стандартизація та запитання та відповіді

У цьому розділі ми обговорюємо завдання зі стандартизації та запитань і відповідей.

Стандартизація

Стандартизація виводу — це завдання створення тексту, де LLM використовуються для забезпечення узгодженого форматування виведеного тексту. Це завдання особливо корисне для автоматизації вилучення ключових сутностей, яке вимагає узгодження виводу з бажаними форматами. Наприклад, ми можемо слідувати найкращим інженерним практикам, щоб точно налаштувати LLM для форматування дат у форматі ММ/ДД/РРРР, який може бути сумісним зі стовпцем ДАТА бази даних. У наведеному нижче блоці коду показано приклад того, як це робиться за допомогою LLM і оперативного проектування. Ми не лише стандартизуємо формат виводу для значень дати, ми також спонукаємо модель генерувати кінцевий вивід у форматі JSON, щоб його було легко використати в наших подальших програмах. Ми використовуємо Мова експресії LangChain (LCEL), щоб з’єднати дві дії. Перша дія спонукає LLM створити вихід у форматі JSON лише з датами з документа. Друга дія бере вивід JSON і стандартизує формат дати. Зауважте, що ця двоетапна дія також може бути виконана в один крок за належної швидкої розробки, як ми побачимо в нормалізації та шаблонах.

Результатом попереднього зразка коду є структура JSON із датами 07 та 09 у форматі ДД/ММ/РРРР і є відповідно датою надходження та виписки пацієнта з лікарні. до звіту про виписку.

Питання та відповіді з доповненою генерацією пошуку

Відомо, що магістратури зберігають фактичну інформацію, яку часто називають їхніми знаннями про світ або світоглядом. Після точного налаштування вони можуть дати найсучасніші результати. Однак існують обмеження щодо того, наскільки ефективно LLM може отримати доступ до цих знань і маніпулювати ними. Як наслідок, у завданнях, які значною мірою покладаються на певні знання, їх продуктивність може бути не оптимальною для певних випадків використання. Наприклад, у сценаріях запитань і відповідей важливо, щоб модель суворо дотримувалася контексту, наданого в документі, не покладаючись виключно на знання світу. Відхилення від цього може призвести до спотворення, неточностей або навіть неправильних відповідей. Найбільш часто використовуваний метод вирішення цієї проблеми відомий як Доповнена генерація пошуку (КРАГ). Цей підхід поєднує сильні сторони як пошукових моделей, так і мовних моделей, підвищуючи точність і якість отриманих відповідей.

LLM також можуть накладати обмеження на токени через їх обмеження пам’яті та обмеження апаратного забезпечення, на якому вони працюють. Щоб вирішити цю проблему, використовуються такі методи, як поділ великих документів на менші частини, які вписуються в межі маркерів LLM. З іншого боку, вбудовування використовуються в НЛП головним чином для захоплення семантичного значення слів та їхніх зв’язків з іншими словами у багатовимірному просторі. Ці вбудовування перетворюють слова на вектори, дозволяючи моделям ефективно обробляти та розуміти текстові дані. Розуміючи семантичні нюанси між словами та фразами, вбудовування дозволяє LLM генерувати узгоджені та контекстуально відповідні результати. Зверніть увагу на такі ключові терміни:

- Чунчінг – Цей процес розбиває великі обсяги тексту з документів на менші значущі фрагменти тексту.

- Вкладиші – Це векторні перетворення з фіксованою розмірністю кожного блоку, які зберігають семантичну інформацію з блоків. Ці вбудовування згодом завантажуються у векторну базу даних.

- Векторна база даних – Це база даних вбудованих слів або векторів, які представляють контекст слів. Він діє як джерело знань, яке допомагає виконувати завдання НЛП у конвеєрах обробки документів. Перевага векторної бази даних полягає в тому, що вона дозволяє лише необхідному контексту надаватися LLM під час генерації тексту, як ми пояснюємо в наступному розділі.

RAG використовує можливості вбудовування для розуміння та отримання відповідних сегментів документа на етапі пошуку. Завдяки цьому RAG може працювати в межах обмежень маркерів LLM, гарантуючи, що для генерації вибирається найбільш релевантна інформація, що призводить до більш точних і релевантних контексту результатів.

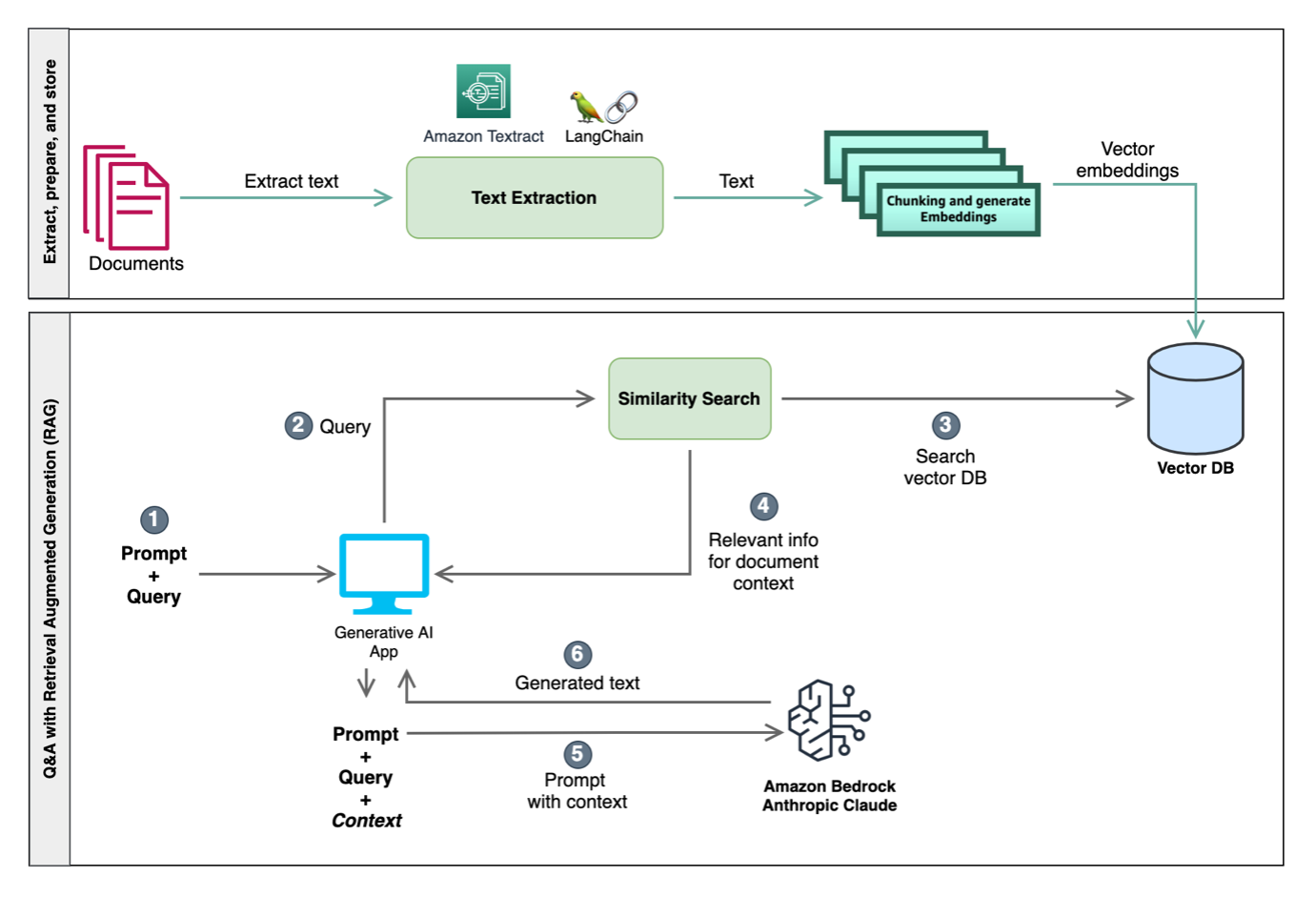

Наступна діаграма ілюструє інтеграцію цих методів для створення вхідних даних для LLM, покращуючи їхнє розуміння контексту та уможливлюючи більш релевантні відповіді в контексті. Один підхід передбачає пошук подібності, використовуючи як векторну базу даних, так і фрагментацію. Векторна база даних зберігає вбудовування, що представляють семантичну інформацію, а фрагментація ділить текст на керовані розділи. Використовуючи цей контекст пошуку подібності, магістри LLM можуть виконувати такі завдання, як відповіді на запитання та специфічні для домену операції, такі як класифікація та збагачення.

У цьому дописі ми використовуємо підхід на основі RAG для виконання запитань і відповідей у контексті документів. У наведеному нижче прикладі коду ми витягуємо текст із документа, а потім розбиваємо документ на менші фрагменти тексту. Розбиття потрібне, оскільки ми можемо мати великі багатосторінкові документи, а наші LLM можуть мати обмеження на маркери. Потім ці фрагменти завантажуються у векторну базу даних для виконання пошуку подібності на наступних кроках. У наступному прикладі ми використовуємо модель Amazon Titan Embed Text v1, яка виконує векторне вбудовування фрагментів документа:

Код створює релевантний контекст для LLM, використовуючи фрагменти тексту, які повертаються дією пошуку схожості з векторної бази даних. Для цього прикладу ми використовуємо відкритий код FAISS векторний магазин як зразок векторної бази даних для зберігання векторних вкладень кожного фрагмента тексту. Потім ми визначаємо векторну базу даних як a Ретрівер ЛангЧейн, який передається в RetrievalQA ланцюг. Це внутрішньо запускає пошуковий запит на схожість у векторній базі даних, який повертає n верхніх (де n=3 у нашому прикладі) фрагментів тексту, які мають відношення до запитання. Нарешті, ланцюжок LLM запускається з релевантним контекстом (групою відповідних фрагментів тексту) і запитанням, на яке повинен відповісти LLM. Щоб отримати покрокову інструкцію щодо коду запитань і відповідей із RAG, зверніться до блокнота Python на GitHub.

Як альтернативу FAISS ви також можете використовувати Можливості векторної бази даних Amazon OpenSearch Service, Служба реляційної бази даних Amazon (Amazon RDS) для PostgreSQL з pgvector розширення у вигляді векторних баз даних або бази даних Chroma з відкритим кодом.

Питання та відповіді з табличними даними

Табличні дані в документах можуть бути складними для обробки LLM через їх структурну складність. Amazon Texttract можна доповнити за допомогою LLM, оскільки він дає змогу видобувати таблиці з документів у вкладеному форматі таких елементів, як сторінка, таблиця та клітинки. Виконання питань і відповідей із табличними даними є багатоетапним процесом, і його можна досягти за допомогою самозапитування. Нижче наведено огляд кроків.

- Витягуйте таблиці з документів за допомогою Amazon Texttract. За допомогою Amazon Texttract табличну структуру (рядки, стовпці, заголовки) можна витягти з документа.

- Зберігайте табличні дані у векторній базі даних разом із інформацією метаданих, такою як імена заголовків і опис кожного заголовка.

- Використовуйте підказку, щоб створити структурований запит, використовуючи LLM, щоб отримати дані з таблиці.

- Використовуйте запит, щоб отримати відповідні табличні дані з векторної бази даних.

Наприклад, у виписці з банку, враховуючи підказку «Які операції з депозитами понад 1000 доларів США», LLM виконав би наступні кроки:

- Створіть запит, наприклад

“Query: transactions” , “filter: greater than (Deposit$)”. - Перетворення запиту на структурований запит.

- Застосуйте структурований запит до векторної бази даних, де зберігаються дані нашої таблиці.

Щоб отримати покроковий приклад коду запитань і відповідей із таблицею, зверніться до блокнота Python у GitHub.

Шаблони та нормалізації

У цьому розділі ми розглянемо, як використовувати методи оперативного проектування та вбудований механізм LangChain для генерації виводу з вилученнями з документа у вказаній схемі. Ми також виконуємо певну стандартизацію витягнутих даних, використовуючи методи, розглянуті раніше. Ми починаємо з визначення шаблону для нашого бажаного результату. Це слугуватиме схемою та інкапсулюватиме деталі про кожну сутність, яку ми хочемо витягти з тексту документа.

Зауважте, що для кожної з сутностей ми використовуємо опис, щоб пояснити, що це за сутність, щоб допомогти LLM отримати значення з тексту документа. У наведеному нижче прикладі коду ми використовуємо цей шаблон, щоб створити наш запит для LLM разом із текстом, витягнутим із документа за допомогою AmazonTextractPDFLoader і згодом виконати висновок з моделлю:

Як ви можете бачити, {keys} частиною підказки є ключі з нашого шаблону та {details} є ключі разом із їхнім описом. У цьому випадку ми не запропонуємо моделі явно вказати формат виводу, окрім вказівки в інструкції для створення виводу у форматі JSON. Це працює здебільшого; однак, оскільки вихідні дані LLM є недетермінованим генеруванням тексту, ми хочемо явно вказати формат як частину інструкції в підказці. Щоб вирішити цю проблему, ми можемо використовувати LangChain аналізатор структурованого виведення модуль, щоб скористатися перевагами автоматизованої розробки підказок, які допомагають перетворити наш шаблон на підказку формату. Ми використовуємо шаблон, визначений раніше, щоб створити підказку щодо форматування таким чином:

Потім ми використовуємо цю змінну в нашому вихідному запиті як інструкцію для LLM, щоб він витягував і форматував вихідні дані в бажаній схемі, вносячи невеликі зміни в наш запит:

Наразі ми лише витягли дані з документа в потрібній схемі. Однак нам все одно потрібно виконати певну стандартизацію. Наприклад, ми хочемо, щоб дата надходження пацієнта та дата виписки були витягнуті у форматі ДД/ММ/РРРР. У цьому випадку ми збільшуємо description ключа з інструкцією форматування:

Зверніться до блокнота Python у GitHub для повної покрокової інструкції та пояснення.

Перевірки орфографії та виправлення

LLM продемонстрували надзвичайні здібності в розумінні та створенні людського тексту. Одним із менш обговорюваних, але надзвичайно корисних застосувань LLM є їхній потенціал у граматичних перевірках і виправленні речень у документах. На відміну від традиційних засобів перевірки граматики, які покладаються на набір попередньо визначених правил, LLM використовують шаблони, які вони визначили з величезної кількості текстових даних, щоб визначити, що вважається правильною або вільною мовою. Це означає, що вони можуть виявляти нюанси, контекст і тонкощі, які системи на основі правил можуть пропустити.

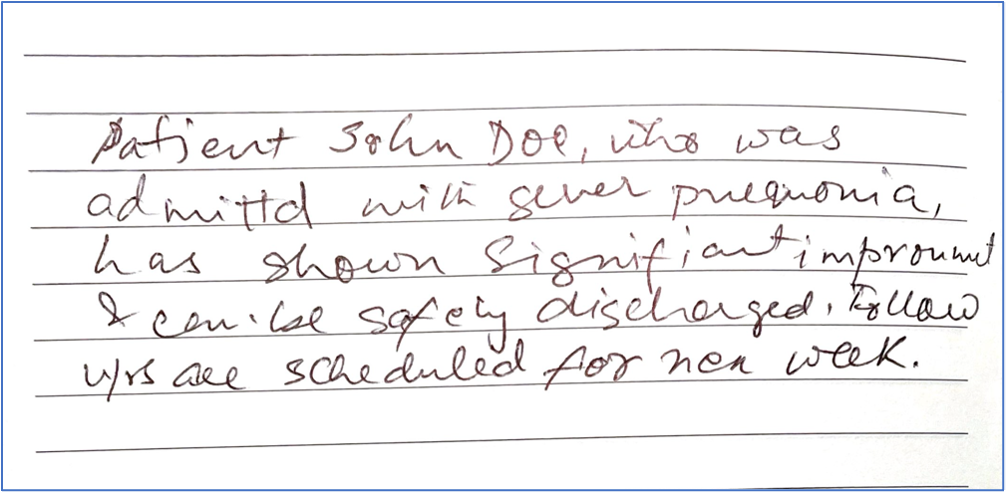

Уявіть собі текст, витягнутий із резюме пацієнта про виписку, який гласить: «Пацієнт Джон Доу, який був госпіталізований із важкою пневмонією, продемонстрував значне покращення, і його можна безпечно виписати. Подальші спостереження заплановано на наступний тиждень». Традиційний засіб перевірки орфографії може розпізнати «admittd», «pneumonia», «improvement» і «nex» як помилки. Однак контекст цих помилок може призвести до подальших помилок або загальних пропозицій. Магістр права, пройшовши всебічну підготовку, може запропонувати: «Пацієнт Джон Доу, якого госпіталізували з важкою пневмонією, продемонстрував значне покращення, і його можна безпечно виписати. Наступний тиждень заплановано на наступний тиждень».

Нижче наведено погано написаний від руки зразок документа з тим самим текстом, що пояснювався раніше.

Ми витягуємо документ за допомогою завантажувача документів Amazon Texttract, а потім інструктуємо LLM за допомогою оперативного проектування виправити витягнутий текст, щоб виправити будь-які орфографічні та/або граматичні помилки:

Вихід попереднього коду показує оригінальний текст, витягнутий завантажувачем документів, а потім виправлений текст, згенерований LLM:

Майте на увазі, що якими б потужними не були магістратури, важливо розглядати їхні пропозиції просто як пропозиції. Хоча вони вражаюче добре вловлюють тонкощі мови, вони не безпомилкові. Деякі пропозиції можуть змінити зміст або тон оригінального тексту. Тому для рецензентів вкрай важливо використовувати виправлення, згенеровані LLM, як орієнтир, а не як абсолют. Співпраця людської інтуїції з можливостями LLM обіцяє майбутнє, де наша письмова комунікація буде не лише безпомилковою, але й багатшою та більш нюансованою.

Висновок

Generative AI змінює спосіб обробки документів за допомогою IDP для отримання розуміння. У пост Покращення інтелектуальної обробки документів AWS за допомогою генеративного штучного інтелекту, ми обговорили різні етапи конвеєра та те, як клієнт AWS Ricoh вдосконалює свій конвеєр IDP за допомогою LLM. У цій публікації ми обговорили різні механізми розширення робочого процесу IDP за допомогою LLM через Amazon Bedrock, Amazon Texttract і популярну структуру LangChain. Ви можете розпочати роботу з новим завантажувачем документів Amazon Texttract із LangChain вже сьогодні, використовуючи зразки блокнотів, доступних у нашому GitHub сховище. Додаткову інформацію про роботу з генеративним ШІ на AWS див Анонс нових інструментів для створення з Generative AI на AWS.

Про авторів

Соналі Саху керує інтелектуальною обробкою документів разом із командою послуг AI/ML в AWS. Вона автор, лідер думок і захоплений технолог. Основною сферою її діяльності є штучний інтелект та машинне навчання, і вона часто виступає на конференціях і зустрічах із штучного інтелекту та машинного навчання по всьому світу. Вона має як широкий, так і глибокий досвід у технологіях і технологічній індустрії, а також у галузі охорони здоров’я, фінансового сектору та страхування.

Соналі Саху керує інтелектуальною обробкою документів разом із командою послуг AI/ML в AWS. Вона автор, лідер думок і захоплений технолог. Основною сферою її діяльності є штучний інтелект та машинне навчання, і вона часто виступає на конференціях і зустрічах із штучного інтелекту та машинного навчання по всьому світу. Вона має як широкий, так і глибокий досвід у технологіях і технологічній індустрії, а також у галузі охорони здоров’я, фінансового сектору та страхування.

Анжан Бісвас є старшим архітектором рішень AI Services, який спеціалізується на AI/ML та аналізі даних. Анджан є частиною всесвітньої команди надання послуг штучного інтелекту та працює з клієнтами, щоб допомогти їм зрозуміти та розробити рішення бізнес-проблем за допомогою штучного інтелекту та машинного навчання. Анджан має понад 14 років досвіду роботи з глобальними ланцюжками постачання, виробництвом і роздрібними організаціями, і активно допомагає клієнтам почати роботу та масштабувати послуги AWS AI.

Анжан Бісвас є старшим архітектором рішень AI Services, який спеціалізується на AI/ML та аналізі даних. Анджан є частиною всесвітньої команди надання послуг штучного інтелекту та працює з клієнтами, щоб допомогти їм зрозуміти та розробити рішення бізнес-проблем за допомогою штучного інтелекту та машинного навчання. Анджан має понад 14 років досвіду роботи з глобальними ланцюжками постачання, виробництвом і роздрібними організаціями, і активно допомагає клієнтам почати роботу та масштабувати послуги AWS AI.

Чінмаї Рейн є архітектором спеціалістів із штучного інтелекту та ML в Amazon Web Services. Вона захоплюється прикладною математикою та машинним навчанням. Вона зосереджується на розробці інтелектуальної обробки документів і генеративних рішень ШІ для клієнтів AWS. Поза роботою вона любить танцювати сальсу та бачату.

Чінмаї Рейн є архітектором спеціалістів із штучного інтелекту та ML в Amazon Web Services. Вона захоплюється прикладною математикою та машинним навчанням. Вона зосереджується на розробці інтелектуальної обробки документів і генеративних рішень ШІ для клієнтів AWS. Поза роботою вона любить танцювати сальсу та бачату.

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- PlatoData.Network Vertical Generative Ai. Додайте собі сили. Доступ тут.

- PlatoAiStream. Web3 Intelligence. Розширення знань. Доступ тут.

- ПлатонЕСГ. вуглець, CleanTech, Енергія, Навколишнє середовище, Сонячна, Поводження з відходами. Доступ тут.

- PlatoHealth. Розвідка про біотехнології та клінічні випробування. Доступ тут.

- джерело: https://aws.amazon.com/blogs/machine-learning/intelligent-document-processing-with-amazon-textract-amazon-bedrock-and-langchain/

- : має

- :є

- : ні

- :де

- .nex

- $1000

- $UP

- 1

- 10

- 100

- 11

- 12

- 13

- 14

- 15%

- 16

- 22

- 23

- 33

- 35%

- 7

- 9

- a

- здібності

- МЕНЮ

- абсолют

- доступ

- доступний

- За

- точність

- точний

- досягнутий

- через

- дію

- дії

- активно

- діяльність

- акти

- Ad

- адреса

- Додає

- дотримуватися

- визнати

- зізнався

- досягнення

- Перевага

- прихід

- вік

- агенти

- AI

- Послуги ШІ

- AI / ML

- вирівняні

- ВСІ

- Дозволити

- дозволяє

- по

- Також

- альтернатива

- хоча

- Amazon

- «Амазонка»

- Amazon RDS

- Текст Amazon

- Amazon Web Services

- суми

- an

- аналітика

- аналізувати

- та

- відповідь

- Антропний

- будь-який

- Інтерфейси

- застосування

- прикладної

- зустрічі

- підхід

- архітектура

- ЕСТЬ

- ПЛОЩА

- навколо

- Art

- штучний

- штучний інтелект

- Штучний інтелект (AI)

- AS

- зовнішній вигляд

- допомогу

- Помічник

- At

- збільшення

- збільшено

- автор

- автоматизувати

- Автоматизований

- автоматично

- Автоматизація

- доступний

- обізнаність

- AWS

- Клієнт AWS

- Банк

- BE

- оскільки

- стає

- було

- перед тим

- корисний

- користь

- КРАЩЕ

- передового досвіду

- між

- Блокувати

- блоки

- обидва

- широта

- Перерва

- ламається

- будувати

- Створюємо

- вбудований

- бізнес

- підприємства

- але

- by

- Виклики

- CAN

- Може отримати

- можливості

- захоплення

- випадок

- випадків

- Клітини

- певний

- ланцюг

- ланцюга

- виклик

- складні

- зміна

- Зміни

- заміна

- Перевірки

- вибір

- претензій

- клас

- класів

- класифікація

- Класифікувати

- код

- КОГЕРЕНТНИЙ

- співробітництво

- Колонка

- Колони

- поєднання

- об'єднувати

- приходить

- загальний

- зазвичай

- Комунікація

- сумісний

- повний

- комплекс

- складність

- осягнути

- лаконічний

- конференції

- З'єднувальний

- послідовний

- складається

- обмеження

- будувати

- містити

- містяться

- містить

- зміст

- контекст

- контекстуальний

- конвертувати

- Core

- виправити

- виправлений

- Виправлення

- може

- виробити

- створений

- створює

- вирішальне значення

- виготовлений на замовлення

- клієнт

- Клієнти

- танці

- дані

- Analytics даних

- Database

- базами даних

- Дата

- Дати

- угода

- глибокий

- глибше

- визначати

- певний

- визначаючи

- продемонстрований

- Залежно

- депозити

- глибина

- описаний

- description

- проектування

- бажаний

- деталь

- докладно

- деталі

- виявляти

- Визначати

- розвивати

- розробників

- дієта

- різний

- безпосередньо

- обговорювати

- обговорювалися

- занурення

- ділити

- розділяє

- do

- Лікар

- документ

- документація

- документація

- лань

- Ні

- справи

- Дон

- зроблений

- Не знаю

- вниз

- різко

- два

- під час

- динамічний

- e

- кожен

- Раніше

- легко

- легкий у використанні

- фактично

- ефективність

- ефективний

- продуктивно

- зусилля

- або

- елементи

- Вставляти

- працевлаштований

- повноваження

- включіть

- дозволяє

- дозволяє

- кінець

- Машинобудування

- підвищувати

- підвищена

- підвищення

- забезпечувати

- забезпечення

- Весь

- юридичні особи

- суб'єкта

- обладнаний

- помилки

- істотний

- Навіть

- приклад

- Крім

- виняток

- існуючий

- досвід

- експертиза

- Пояснювати

- пояснені

- Пояснює

- пояснення

- явно

- вираз

- продовжити

- розширення

- обширний

- витяг

- видобуток

- Виписки

- Падати

- false

- далеко

- втому

- Поля

- Рисунок

- остаточний

- в кінці кінців

- фінансовий

- Фінансовий сектор

- Перший

- відповідати

- Сфокусувати

- фокусується

- стежити

- потім

- після

- слідує

- для

- формат

- форми

- знайдений

- фонд

- Рамки

- Безкоштовна

- часто

- від

- Кордон

- Повний

- повністю

- далі

- майбутнє

- Загальне

- породжувати

- генерується

- генерує

- породжує

- покоління

- генеративний

- Генеративний ШІ

- отримати

- Давати

- даний

- Глобальний

- граматика

- схопити

- великий

- Group

- керівництво

- рука

- обробляти

- траплятися

- Відбувається

- апаратні засоби

- Мати

- Заголовки

- охорона здоров'я

- сильно

- допомога

- корисний

- допомогу

- допомагає

- її

- тут

- на вищому рівні

- високопродуктивний

- вище

- тримає

- лікарня

- Як

- How To

- Однак

- HTML

- HTTPS

- людина

- i

- ID

- ідентифікований

- if

- ілюструє

- зображення

- надзвичайно

- Impact

- імпорт

- важливо

- імпорт

- накладений

- поліпшення

- in

- У тому числі

- індекс

- промисловість

- інформація

- Інформаційний вік

- інновація

- вхід

- розуміння

- екземпляр

- інструкції

- страхування

- інтегрувати

- інтегрований

- Інтеграція

- інтеграція

- Інтелект

- Розумний

- Інтелектуальна обробка документів

- призначених

- внутрішньо

- в

- тонкощі

- вводити

- введені

- Вводить

- IT

- ЙОГО

- Джексон

- Джон

- ДЖОН ДОУ

- джон

- JPG

- json

- просто

- ключ

- ключі

- Знати

- знання

- відомий

- мова

- великий

- макет

- вести

- лідер

- провідний

- вивчення

- догляд

- бібліотека

- як

- Ймовірно

- недоліки

- рамки

- список

- LLM

- загрузка

- завантажувач

- логіка

- подивитися

- серія

- машина

- навчання за допомогою машини

- Робить

- управляти

- керований

- вдалося

- управління

- керівництво

- виробництво

- позначено

- математика

- Може..

- me

- сенс

- значущим

- засоби

- механізм

- механізми

- Зустрічі

- пам'ять

- Meta

- метадані

- метод

- методика

- може бути

- mind

- нудьгувати

- помилки

- ML

- модель

- Моделі

- Модулі

- більше

- іпотечне кредитування

- найбільш

- множинний

- ім'я

- Імена

- Природний

- Обробка природних мов

- необхідно

- Необхідність

- необхідний

- потреби

- Нові

- наступний

- наступного тижня

- nlp

- ноутбук

- зараз

- нюанси

- номер

- об'єкт

- об'єкти

- of

- Пропозиції

- часто

- on

- ONE

- тільки

- з відкритим вихідним кодом

- операції

- Можливість

- оптимальний

- Опції

- or

- організації

- оригінал

- Інше

- інакше

- наші

- з

- Результат

- вихід

- виходи

- поза

- над

- огляд

- пакети

- сторінка

- сторінок

- Біль

- парний

- пар

- частина

- особливо

- проходити

- Пройшов

- Проходження

- пристрасний

- шлях

- пацієнт

- Викрійки

- моделі

- для

- Виконувати

- продуктивність

- виконується

- виконанні

- виступає

- фаза

- Вчений ступінь

- фрази

- трубопровід

- план

- plato

- Інформація про дані Платона

- PlatoData

- будь ласка

- пневмонія

- точок

- популярний

- це можливо

- пошта

- потенціал

- влада

- Харчування

- потужний

- практики

- точно

- Точність

- переважним

- представити

- раніше

- в першу чергу

- друк

- друк

- Проблема

- проблеми

- процес

- Оброблено

- обробка

- виробляти

- обіцяє

- правильний

- забезпечувати

- за умови

- Постачальник

- забезпечує

- Python

- Питання та відповіді

- якість

- питання

- Швидко

- швидко

- Сировина

- читання

- визнавати

- зниження

- послатися

- посилання

- називають

- Відносини

- доречний

- покладатися

- покладаючись

- чудовий

- звітом

- представляти

- представляє

- вимагається

- Вимагається

- відповідно

- відповіді

- Обмеження

- результат

- в результаті

- результати

- роздрібна торгівля

- зберігати

- утримує

- Умови повернення

- Багаті

- Кімната

- Правила

- прогін

- пробіжки

- s

- безпечно

- то ж

- say

- шкала

- сценарії

- плановий

- Пошук

- другий

- розділ

- розділам

- сектор

- побачити

- сегменти

- обраний

- старший

- пропозиція

- Серія

- служити

- служить

- обслуговування

- Послуги

- комплект

- важкий

- вона

- Короткий

- Повинен

- показаний

- Шоу

- значний

- один

- невеликий

- менше

- уривок

- So

- виключно

- Рішення

- ВИРІШИТИ

- деякі

- Source

- Простір

- Говорить

- спеціаліст

- конкретний

- конкретно

- зазначений

- орфографія

- розкол

- етапи

- стандартизація

- старт

- почалася

- впроваджений

- Заява

- Крок

- заходи

- Як і раніше

- зберігати

- зберігати

- магазинів

- сильні сторони

- рядок

- структурний

- структура

- структурований

- боротьба

- наступні

- Згодом

- такі

- пропонувати

- підсумовувати

- РЕЗЮМЕ

- поставка

- ланцюжка поставок

- підтримка

- Опори

- взаємодія

- Systems

- таблиця

- Приймати

- приймає

- Завдання

- завдання

- команда

- техніка

- методи

- технолог

- Технологія

- шаблон

- terms

- текст

- текстуальний

- ніж

- Що

- Команда

- світ

- їх

- Їх

- потім

- Там.

- отже

- Ці

- вони

- це

- думка

- три

- через

- велетень

- до

- сьогодні

- сьогоднішній

- разом

- знак

- Жетони

- TONE

- інструменти

- топ

- Усього:

- традиційний

- Трейлінг

- Навчання

- Transactions

- Перетворення

- перетворень

- правда

- намагатися

- два

- тип

- Типи

- розуміти

- розуміння

- на відміну від

- відкриття

- URL

- використання

- використання випадку

- використовуваний

- користувачі

- використовує

- використання

- використовувати

- використовує

- v1

- значення

- Цінності

- змінна

- різний

- величезний

- різнобічний

- версія

- через

- вид

- Обсяги

- покрокове керівництво

- хотіти

- було

- шлях..

- we

- Web

- веб-сервіси

- week

- ДОБРЕ

- Що

- коли

- який

- в той час як

- ВООЗ

- волі

- з

- в

- без

- свідком

- слово

- слова

- Work

- робочий

- Робочі процеси

- робочий

- працює

- світ

- б

- письмовий

- X

- років

- Ти

- зефірнет