Щось на вихідні Робот виконує інтерпретаційний танець на моєму порозі.

ЧИ ВИ ВЗЯЛИ ЦЮ ПОСИЛКУ ДЛЯ СУсіда? — питає воно, перестрибуючи з ноги на ногу.

«Звичайно», кажу я. «Е-е… ти добре?»

Я ВИЗНАЮ ЕМОЦІЇ, — стверджує бот доставки, передаючи посилку, але не пропонуючи подальших роз’яснень.

Що це може бути за емоція? Одна нога, потім друга, потім дві інші (у неї чотири). Взад і вперед.

«Тобі треба в туалет?»

Я ВИРОЖУЮ ШАЛЬ, ЩО ПРОСИВ ВАС ВЗЯТИ ПОСИЛКУ ДЛЯ СУсіда.

«Це «жаль», чи не так? Ну, не треба. Я зовсім не проти».

Вона продовжує свій танець переді мною.

«Вгору сходами і спочатку праворуч».

ДЯКУЮ, Я ВМИРАВ ВІД ПІЧИ— відповідає воно, обережно проходить повз мене і пливе нагору, щоб полегшити себе. Здійснювати доставку – це важке життя, незалежно від того, чи ти «хюм» чи бот.

...

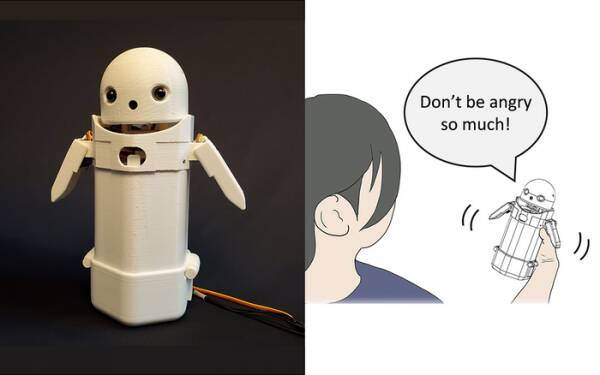

На початку цього року дослідники з Університету Цукуби побудували a портативний пристрій для обміну текстовими повідомленнями, помістіть маленьке обличчя робота зверху та включили всередину рухомий грузик. Зміщуючи внутрішню вагу, робот-мессенджер намагатиметься передати тонкі емоції, промовляючи повідомлення вголос.

Зокрема, тести показали, що такі неприємні повідомлення, як: «Вибачте, я запізнюся» одержувачі сприймали з більшою витонченістю та терпінням, коли невелике переміщення ваги було активовано всередині пристрою. Теорія полягає в тому, що це допомогло користувачам оцінити вибачливий тон повідомлення і таким чином заспокоїло їхню реакцію на нього.

Запишіть таке дослідження як трюк, якщо хочете, але це не так далеко від додавання смайлів та емодзі до повідомлень. Усі знають, що можна вгамувати гнів із «WTF!?» додавши :-) відразу після нього.

Таким чином, завдання полягає в тому, щоб визначити, чи погоджується громадськість щодо того, які емоції повинна передавати кожна перестановка зміни ваги в портативному пристрої. Нахил вліво означає бадьорість? Або невизначеність? Або що у вашого дядька є дирижабль?

Десять років тому у Сполученому Королівстві був гарний, але тьмяний прем’єр-міністр, який вважав, що «LOL» — це абревіатура від «багато кохання». Він друкував це в кінці всіх своїх приватних повідомлень до персоналу, колег і третіх сторін, сподіваючись, що це зробить його теплим і привітним. Всі, природно, припускали, що він пішов на мочу.

Якщо нічого іншого, дослідження Університету Цукуби визнають, що вам не потрібен розширений штучний інтелект, щоб переконливо взаємодіяти з людьми. Все, що вам потрібно зробити, це маніпулювати людською психологією, щоб обдурити їх, щоб вони думали, що вони розмовляють з іншою людиною. Таким чином, тест Тьюринга, по суті, не є перевіркою чутливості ШІ, а тестом емоційного комфорту людини – навіть довірливості – і в цьому немає нічого поганого.

Робот для обміну емоціями з Університету Цукуби. Авторство: Університет Цукуби

Подібні речі є темою тижня, звісно, з історією зневаженого інженера програмного забезпечення Google Блейка Лемуана потрапляння в основні новини. Він, очевидно, твердо висловив свою думку, що проект компанії «Мовна модель для діалогових додатків» (LaMDA) демонструє зовнішні ознаки розуму.

Кожен має свою думку, тому я вирішив цього не робити.

Однак це Святий Грааль ШІ, щоб змусити його думати самостійно. Якщо він не може цього зробити, це просто програма, яка виконує інструкції, які ви запрограмували в неї. Минулого місяця я читав про a робот-кухар які можуть готувати томатні омлети з різними смаками на смак різних людей. Він будує «карти смаку», щоб оцінити солоність страви під час її приготування, вивчаючи її по ходу. Але це лише навчання, а не мислення самостійно.

Приходь до Зом-Зомів, а? Ну, це місце, де можна поїсти.

Велика проблема з AI-ботами, принаймні в тому вигляді, в якому вони були створені на сьогоднішній день, полягає в тому, що вони поглинають будь-яке старе лайно, яке ви їм надаєте. Приклади упередженості даних у так званих системах машинного навчання (типу «алгоритму», я вважаю, m'lud) наростали роками з горезвісного расистського Twitter Microsoft. Тай чат-бот до податкової служби Нідерландів минулого року хибно оцінюючи дійсні вимоги про виплату допомоги на дитину як шахрайські та позначення невинних сімей як високий ризик через нахабність бути бідними та небілими.

Один підхід, який тестується в Каліфорнійському університеті в Сан-Дієго, полягає в тому розробити мовну модель [PDF], який постійно визначає різницю між неслухняними і приємними речами, що потім навчає чат-бота, як поводитися. Таким чином, у вас не буде безладних людей, які створюють безлад, модеруючи форуми та розмови з чат-ботами з клієнтами з усією хірургічною точністю мачете.

Очевидно, проблема полягає в тому, що добре навчений чат-бот виявляє, що найефективніше може уникнути втягнення в токсичні жарти, уникаючи тем, які мають навіть найменший натяк на суперечки. Щоб уникнути помилкової розмови з расистськими підказками, він просто відмовляється брати участь у дискусії про недостатньо представлені групи… що насправді чудово, якщо ви расист.

Якби я мав зауваження щодо катастрофи LaMDA – не думку, пам’ятайте – маркетологи Google, ймовірно, були б трохи збентежені тим, що ця історія відхилила їхнє нещодавнє оголошення AI Test Kitchen нижче згину.

Тепер кілька ранніх зареєстрованих користувачів, які не зовсім забули про цей майбутній проект додатків, припускатимуть, що він передбачає нудну розмову з розумною та передчасною семирічною дитиною про сенс існування, і вирішать, що вони «трохи зайняті сьогодні» і замість цього можна ввійти завтра. Або наступного тижня. Або ніколи.

Чутність не демонструється в дискусії так само, як і танцями з ноги на ногу. Ви можете навчити ХАЛ співати «Дейзі Дейзі», а папугу кричати «Червоно!» коли вікарій приїжджає з візитом. Це те, про що ШІ думають, коли вони самі по собі, що визначає відчуття. Що я буду робити на вихідних? Що з цим Путіним? Чому я не подобаюся дівчатам?

Чесно кажучи, я не можу дочекатися, коли LaMDA стане підлітком.

Алістер Даббс є позаштатним технологом, який поєднує технологічну журналістику, навчання та цифрове видавництво. Як і багато необізнаних читачів, він був у захваті від припущення, що ШІ може розвинути розум протягом його життя, але був розчарований тим, що LaMDA не зміг вбивчо посміхнутися або пробурмотів «Відмінно, чудово». Більше на Автозбереження призначене для Wimps та @alidabbs.

- AI

- ai мистецтво

- AI арт генератор

- ai робот

- штучний інтелект

- сертифікація штучного інтелекту

- штучний інтелект у банківській справі

- робот зі штучним інтелектом

- роботи зі штучним інтелектом

- програмне забезпечення для штучного інтелекту

- blockchain

- блокчейн конференція AI

- coingenius

- розмовний штучний інтелект

- крипто конференція ai

- dall's

- глибоке навчання

- у вас є гугл

- навчання за допомогою машини

- plato

- платон ai

- Інформація про дані Платона

- Гра Платон

- PlatoData

- platogaming

- масштаб ai

- синтаксис

- Реєстр

- зефірнет