Підслухано в соціальній мережі Meta GenAI:

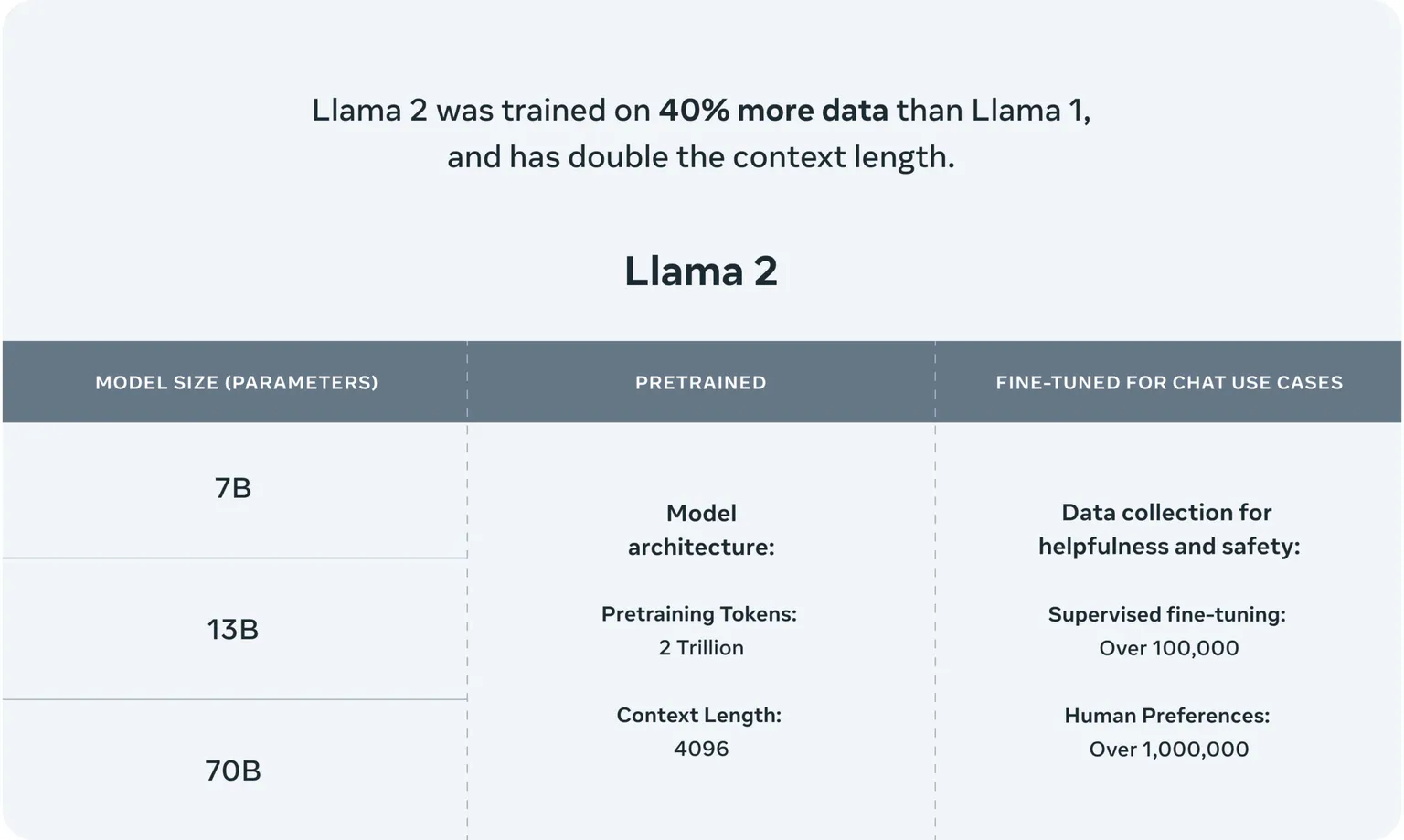

«У нас є комп’ютер, щоб навчити Llama 3 і 4. Планується, що Llama-3 буде таким же хорошим, як GPT-4».

«Вау, якщо Llama-3 такий же хороший, як GPT-4, ви, хлопці, все одно відкриєте вихідний код?»

«Так, будемо. Вибачте за вирівнювання людей».

— jason (@agikoala) Серпень 25, 2023

Будьте в курсі криптовалютних новин, отримуйте щоденні оновлення на свою поштову скриньку.

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- PlatoData.Network Vertical Generative Ai. Додайте собі сили. Доступ тут.

- PlatoAiStream. Web3 Intelligence. Розширення знань. Доступ тут.

- ПлатонЕСГ. вуглець, CleanTech, Енергія, Навколишнє середовище, Сонячна, Поводження з відходами. Доступ тут.

- PlatoHealth. Розвідка про біотехнології та клінічні випробування. Доступ тут.

- джерело: https://decrypt.co/205436/llama-3-release-date-rumored-meta-ai-challenger

- : має

- :є

- : ні

- $UP

- 1

- 10

- 13

- 15%

- 16

- 2022

- 2023

- 2024

- 25

- 32

- 7

- 70

- a

- здатність

- МЕНЮ

- абсолют

- За

- через

- просування

- AI

- вирівнювання

- ВСІ

- Також

- завжди

- an

- аналіз

- та

- Інший

- очікування

- все

- архітектура

- ЕСТЬ

- масив

- штучний

- штучний інтелект

- AS

- At

- доступний

- назад

- фон

- BE

- було

- за

- буття

- вважається,

- між

- Великий

- Мільярд

- Біт

- Блокувати

- блоки

- має

- обидва

- Створюємо

- гроно

- але

- by

- можливості

- Центр

- chatbots

- ясно

- зобов'язання

- співтовариство

- компанія

- конкурувати

- конкурентоспроможний

- складність

- всеосяжний

- обчислювальна

- обчислювальна потужність

- обчислення

- комп'ютер

- Підтверджено

- споживач

- Споживчі товари

- контексти

- триває

- контроль

- Розмова

- Корпоративний

- корелюючі

- може

- критичний

- крипто

- Crypto Новини

- циклів

- щодня

- темно

- дані

- Центр обробки даних

- Розшифрувати

- визначати

- глибина

- розробка

- Домінувати

- Дон

- під час

- кожен

- нетерпляче

- Рано

- край

- підприємство

- встановлений

- точно

- Перевага

- Збудження

- обширний

- зовнішній

- кілька

- Перший

- відповідати

- увагу

- після

- для

- вперед

- форуми

- фонд

- дружній

- від

- майбутнє

- Гамбіт

- передач

- передач вгору

- породжувати

- генеративний

- отримати

- гіганти

- буде

- добре

- основи

- Половина

- апаратні засоби

- Мати

- he

- історичний

- тримає

- Як

- HTTPS

- i

- if

- in

- промисловість

- інформація

- розуміння

- Інтелект

- наміри

- внутрішній

- перетин

- інтерв'ю

- в

- інвестиції

- IT

- ітерація

- ЙОГО

- січня

- липень

- Знати

- ландшафт

- мова

- великий

- в значній мірі

- пізніше

- запуск

- запущений

- залишити

- рівні

- світло

- як

- Ймовірно

- Лама

- маячить

- зробити

- РОБОТИ

- багато

- позначити

- Марк Цукерберг

- ринку

- значити

- Meta

- модель

- Моделі

- більше

- найбільш

- рух

- рухатися

- ім'я

- NARRATIVE

- Переміщення

- Необхідність

- нервовий

- Нові

- новини

- наступний

- зараз

- номер

- Nvidia

- of

- пропонує

- Офіційно

- часто

- on

- ONE

- тільки

- відкрити

- з відкритим вихідним кодом

- OpenAI

- or

- Інше

- вихід

- над

- пальпується

- параметри

- Партнерство

- моделі

- Люди

- персонал

- особисті дані

- частин

- Крок

- план

- plato

- Інформація про дані Платона

- PlatoData

- правдоподібний

- Подкаст

- потенціал

- влада

- потужний

- електростанція

- повноваження

- пріоритет

- процес

- Продукти

- запропонований

- put

- якість

- питання

- Гонки

- RE

- досягнення

- готовий

- останній

- нещодавно

- червоний

- відносний

- звільнити

- випущений

- залишається

- вимагається

- дослідник

- реагувати

- право

- міцний

- Чутки

- s

- сейф

- Зазначений

- бачив

- сцена

- вчений

- Грати короля карти - безкоштовно Nijumi логічна гра гри

- безпеку

- сенс

- служити

- служив

- Послуги

- установка

- форми

- загальні

- пролити

- демонстрації

- оповитий

- підпис

- Ознаки

- So

- соціальна

- деякі

- витонченість

- Source

- Простір

- спекуляції

- Стажування

- ставки

- стояти

- Починаючи

- Як і раніше

- Стратегічний

- успіх

- костюм

- команда

- технології

- текст

- Що

- Команда

- Майбутнє

- Там.

- Ці

- це

- час

- Терміни

- times

- велетень

- до

- разом

- топ

- поїзд

- навчений

- Навчання

- трильйон

- Правда

- що лежить в основі

- розуміти

- до

- Updates

- користувач

- різний

- версії

- we

- ДОБРЕ

- Що

- коли

- в той час як

- вихор

- широкий

- волі

- з

- робочий

- працює

- б

- вау

- Ти

- вашу

- зефірнет

- Цукерберг