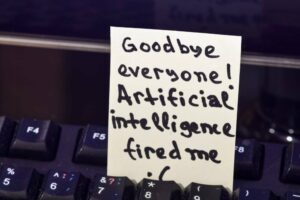

Працівники, найняті за допомогою краудсорсингових служб, таких як Amazon Mechanical Turk, використовують великі мовні моделі для виконання своїх завдань, що може негативно позначитися на моделях ШІ в майбутньому.

Дані мають вирішальне значення для ШІ. Розробникам потрібні чисті високоякісні набори даних для створення точних і надійних систем машинного навчання. Однак збір цінних, першокласних даних може бути виснажливим. Компанії часто звертаються до сторонніх платформ, таких як Amazon Mechanical Turk, щоб доручити групі дешевих працівників виконувати повторювані завдання, такі як маркування об’єктів, опис ситуацій, транскрибування уривків і анотування тексту.

Їхні результати можна очистити та ввести в модель, щоб навчити її відтворювати цю роботу в набагато більшому автоматизованому масштабі.

Таким чином, моделі штучного інтелекту побудовані на основі людської праці: люди, що працюють, надаючи гори навчальних прикладів для систем штучного інтелекту, які корпорації можуть використовувати, щоб заробити мільярди доларів.

Але експеримент, проведений дослідниками Федеральної політехнічної школи Лозанни (EPFL) у Швейцарії, прийшов до висновку, що ці краудсорсингові працівники використовують системи штучного інтелекту, такі як чат-бот OpenAI ChatGPT, щоб виконувати випадкові роботи в Інтернеті.

Не рекомендується навчати модель на її власних результатах. Ми могли бачити, як моделі штучного інтелекту навчаються на даних, створених не людьми, а іншими моделями штучного інтелекту – можливо, навіть тими самими моделями. Це може призвести до катастрофічної якості виходу, більшого упередження та інших небажаних ефектів.

Експеримент

Вчені найняли 44 кріпаків Mechanical Turk для узагальнення рефератів 16 медичних наукових статей і підрахували, що від 33 до 46 відсотків уривків тексту, наданого робітниками, було створено за допомогою великих мовних моделей. Крауд-працівникам часто платять низьку зарплату – використання штучного інтелекту для автоматичної генерації відповідей дозволяє їм працювати швидше та виконувати більше завдань, щоб підвищити зарплату.

Швейцарська команда навчила класифікатор передбачати, чи були подання від Туркерів створені людиною чи штучним інтелектом. Вчені також реєстрували натискання клавіш своїми працівниками, щоб визначити, чи кріпаки копіювали та вставляли текст на платформу, чи вводили свої записи самі. Завжди існує ймовірність, що хтось скористається чат-ботом, а потім вручну введе вихідні дані, але це малоймовірно, ми припускаємо.

«Ми розробили дуже специфічну методологію, яка дуже добре працювала для виявлення синтетичного тексту в нашому сценарії», — Маноель Рібейро, співавтор Дослідження і докторант EPFL, розповів Реєстр на цьому тижні.

«У той час як традиційні методи намагаються виявити синтетичний текст «у будь-якому контексті», наш підхід зосереджений на виявленні синтетичного тексту в нашому конкретному сценарії».

Класифікатор не є досконалим для визначення того, чи хтось використовував систему штучного інтелекту чи створював власну роботу. Вчені об’єднали результати свого класифікатора з даними про натискання клавіш, щоб бути більш впевненими, коли хтось скопіював вставлення з бота або створив власний матеріал.

Людські дані є золотим стандартом, тому що ми дбаємо про людей

«Нам вдалося підтвердити наші результати, використовуючи дані про натискання клавіш, які ми також зібрали з MTurk», — сказав нам Рібейро. «Наприклад, ми виявили, що всі тексти, які не були скопійовані, були класифіковані нами як «справжні», що свідчить про те, що помилкових спрацьовувань мало».

Код і дані, які використовуються для виконання тесту можна знайти тут, на GitHub.

Є ще одна причина, чому експеримент навряд чи буде абсолютно справедливим уявленням про те, скільки працівників насправді використовують ШІ для автоматизації завдань краудсорсингу. Автори відзначають, що завдання підсумовування тексту добре підходить для великих мовних моделей порівняно з іншими типами вакансій, тобто їхні результати можуть бути більш спотвореними в бік більшої кількості працівників, які використовують такі інструменти, як ChatGPT.

Їхній набір даних із 46 відповідей від 44 працівників також невеликий. Працівникам платили 1 долар за кожне текстове резюме, що, знову ж таки, може лише стимулювати використання ШІ.

Дослідники стверджують, що великі мовні моделі погіршаться, якщо їх все більше навчатимуть на фейковому контенті, створеному штучним інтелектом, зібраному з краудсорсингових платформ. Таке обладнання, як OpenAI, тримає в секреті те, як вони тренують своїх останніх моделей, і може не дуже покладатися на такі речі, як Mechanical Turk, якщо взагалі. Тим не менш, багато інших моделей можуть покладатися на людей, які, у свою чергу, можуть використовувати ботів для генерації навчальних даних, що є проблемою.

Mechanical Turk, наприклад, продається як постачальник «рішень для маркування даних для забезпечення моделей машинного навчання».

«Людські дані є золотим стандартом, тому що ми дбаємо про людей, а не про великі мовні моделі», — сказав Ріберіо. «Я б не приймав ліки, які були перевірені лише на біологічній моделі дрозофіли», — сказав він як приклад.

Відповіді, створені сучасними моделями штучного інтелекту, зазвичай досить м’які або тривіальні та не відображають складності та різноманітності людської творчості, стверджують дослідники.

«Іноді те, що ми хочемо вивчити за допомогою краудсорсингових даних, — це саме способи недосконалості людей», — сказав нам Роберт Вест, співавтор статті та доцент школи комп’ютерних і комунікаційних наук EPFL.

Оскільки штучний інтелект продовжує вдосконалюватися, ймовірно, краудсорсингова робота зміниться. Ріберіо припустив, що великі мовні моделі можуть замінити деяких працівників у конкретних завданнях. «Однак, як це не парадоксально, людські дані можуть бути ціннішими, ніж будь-коли, і тому може статися, що ці платформи зможуть реалізувати способи запобігання широкому використанню мовної моделі та гарантувати, що вони залишаться джерелом людських даних».

Хто знає, можливо, люди навіть співпрацюватимуть із великими мовними моделями, щоб генерувати відповіді, додав він. ®

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- EVM Фінанси. Уніфікований інтерфейс для децентралізованих фінансів. Доступ тут.

- Quantum Media Group. ІЧ/ПР посилений. Доступ тут.

- PlatoAiStream. Web3 Data Intelligence. Розширення знань. Доступ тут.

- джерело: https://go.theregister.com/feed/www.theregister.com/2023/06/16/crowd_workers_bots_ai_training/

- : має

- :є

- : ні

- $UP

- 16

- 7

- a

- Здатний

- МЕНЮ

- тези

- вчені

- точний

- доданий

- знову

- AI

- ВСІ

- дозволяє

- Також

- завжди

- Amazon

- an

- та

- Інший

- будь-який

- підхід

- ЕСТЬ

- сперечався

- штучний

- штучний інтелект

- AS

- Помічник

- At

- authors

- автоматизувати

- Автоматизований

- автоматично

- геть

- BE

- оскільки

- буття

- зміщення

- мільярди

- м'який

- Бот

- боти

- будувати

- побудований

- але

- by

- CAN

- захоплення

- який

- певний

- шанс

- зміна

- Chatbot

- ChatGPT

- дешево

- класифікований

- близько

- CO

- Співавтор

- код

- співробітництво

- комбінований

- Комунікація

- Компанії

- порівняний

- повний

- повністю

- складність

- комп'ютер

- уклали

- проводиться

- зміст

- контекст

- триває

- корпорації

- може

- креативність

- критичний

- натовп

- дані

- набори даних

- розвиненою

- розробників

- катастрофічний

- різноманітність

- do

- доларів

- кожен

- ефекти

- заохочувати

- кінець

- забезпечувати

- оцінка

- Навіть

- НІКОЛИ

- точно

- приклад

- Приклади

- експеримент

- ярмарок

- підроблений

- false

- швидше

- Fed

- кілька

- увагу

- для

- знайдений

- від

- майбутнє

- породжувати

- генерується

- отримати

- GitHub

- золото

- Золотий Стандарт

- Мати

- he

- сильно

- високоякісний

- вище

- Як

- Однак

- HTTPS

- людина

- Людей

- i

- ідентифікує

- if

- здійснювати

- удосконалювати

- in

- Augmenter

- все більше і більше

- Інтелект

- в

- isn

- IT

- ЙОГО

- Джобс

- JPG

- тримати

- маркування

- праця

- мова

- великий

- більше

- останній

- вести

- вивчення

- як

- Ймовірно

- увійшли

- низький

- машина

- навчання за допомогою машини

- зробити

- вдалося

- вручну

- багато

- матеріал

- Може..

- сенс

- механічний

- медичний

- медичне дослідження

- медицина

- Методологія

- методика

- може бути

- модель

- Моделі

- більше

- багато

- Необхідність

- негативний

- номер

- об'єкти

- of

- часто

- on

- ONE

- онлайн

- тільки

- OpenAI

- or

- Інше

- наші

- вихід

- власний

- оплачувану

- Папір

- документи

- партія

- Платити

- Люди

- відсотків

- ідеальний

- Виконувати

- може бути

- платформа

- Платформи

- plato

- Інформація про дані Платона

- PlatoData

- Plenty

- Басейни

- влада

- дорогоцінний

- точно

- передбачати

- запобігати

- Проблема

- Вироблений

- Професор

- Постачальник

- забезпечення

- якість

- реальний

- насправді

- причина

- рекомендований

- надійний

- покладатися

- залишається

- повторювані

- замінювати

- подання

- дослідження

- Дослідники

- відповіді

- результати

- РОБЕРТ

- прогін

- s

- Зазначений

- то ж

- шкала

- сценарій

- Школа

- наука

- секрет

- побачити

- Послуги

- ситуацій

- невеликий

- Рішення

- деякі

- Хтось

- Source

- конкретний

- standard

- студент

- Вивчення

- Матеріали

- представлений

- такі

- Запропонує

- підсумовувати

- РЕЗЮМЕ

- Швейцарський

- Швейцарія

- синтетичний

- система

- Systems

- Приймати

- Завдання

- завдання

- команда

- тест

- перевірений

- ніж

- Що

- Команда

- Майбутнє

- їх

- Їх

- самі

- потім

- Там.

- Ці

- вони

- речі

- третій

- це

- На цьому тижні

- до

- сьогодні

- занадто

- інструменти

- до

- традиційний

- поїзд

- навчений

- Навчання

- намагатися

- ПЕРЕГЛЯД

- Типи

- навряд чи

- небажаний

- us

- Використання

- використання

- використовуваний

- використовує

- використання

- зазвичай

- ПЕРЕВІР

- Цінний

- дуже

- через

- заробітна плата

- хотіти

- було

- способи

- we

- week

- ДОБРЕ

- були

- West

- Що

- коли

- Чи

- який

- в той час як

- волі

- з

- Work

- працював

- робочі

- гірше

- зефірнет