اپنی نوعیت کا پہلا مطالعہ جو ہو سکتا ہے، مصنوعی ذہانت (AI) فرم Anthropic نے زبان کا ایک بڑا ماڈل (LLM) تیار کیا ہے جسے اس کی صارف برادری کی قدر کے فیصلوں کے لیے ٹھیک بنایا گیا ہے۔

AI ترقی کے زیادہ جمہوری ہونے کا کیا مطلب ہے؟ یہ جاننے کے لیے، ہم نے شراکت کی۔ @collect_intel استعمال کرنے کے لئے @usepolis ~ 1000 امریکیوں کی رائے کی بنیاد پر ایک AI آئین کی تشکیل کرنا۔ پھر ہم نے آئینی AI کا استعمال کرتے ہوئے اس کے خلاف ایک ماڈل کو تربیت دی۔ pic.twitter.com/ZKaXw5K9sU

— انتھروپک (@AnthropicAI) اکتوبر 17، 2023

بہت سے عوام کا سامنا کرنے والے LLMs کو گارڈریلز کے ساتھ تیار کیا گیا ہے - انکوڈ شدہ ہدایات جو مخصوص طرز عمل کا حکم دیتی ہیں - اس کی جگہ ناپسندیدہ آؤٹ پٹ کو محدود کرنے کی کوشش میں۔ مثال کے طور پر، انتھروپکس کلاڈ اور اوپن اے آئی کی چیٹ جی پی ٹی، عام طور پر صارفین کو پرتشدد یا متنازعہ موضوعات سے متعلق آؤٹ پٹ درخواستوں پر ڈبہ بند حفاظتی جواب دیتے ہیں۔

تاہم، جیسا کہ لاتعداد پنڈتوں نے نشاندہی کی ہے، گارڈریلز اور دیگر مداخلتی تکنیک صارفین کو ان کی ایجنسی کو لوٹنے کے لیے کام کر سکتی ہیں۔ جو چیز قابل قبول سمجھی جاتی ہے وہ ہمیشہ مفید نہیں ہوتی، اور جو مفید سمجھی جاتی ہے وہ ہمیشہ قابل قبول نہیں ہوتی۔ اور اخلاقیات یا قدر پر مبنی فیصلوں کی تعریفیں ثقافتوں، آبادیوں اور وقت کے درمیان مختلف ہو سکتی ہیں۔

متعلقہ: برطانیہ نومبر میں منصوبہ بند سمٹ میں ممکنہ AI خطرات کو نشانہ بنائے گا۔

اس کا ایک ممکنہ علاج یہ ہے کہ صارفین کو AI ماڈلز کے لیے ویلیو الائنمنٹ کا حکم دیا جائے۔ انتھروپک کا "اجتماعی آئینی AI" تجربہ اس "گڑبڑ چیلنج" پر ایک وار ہے۔

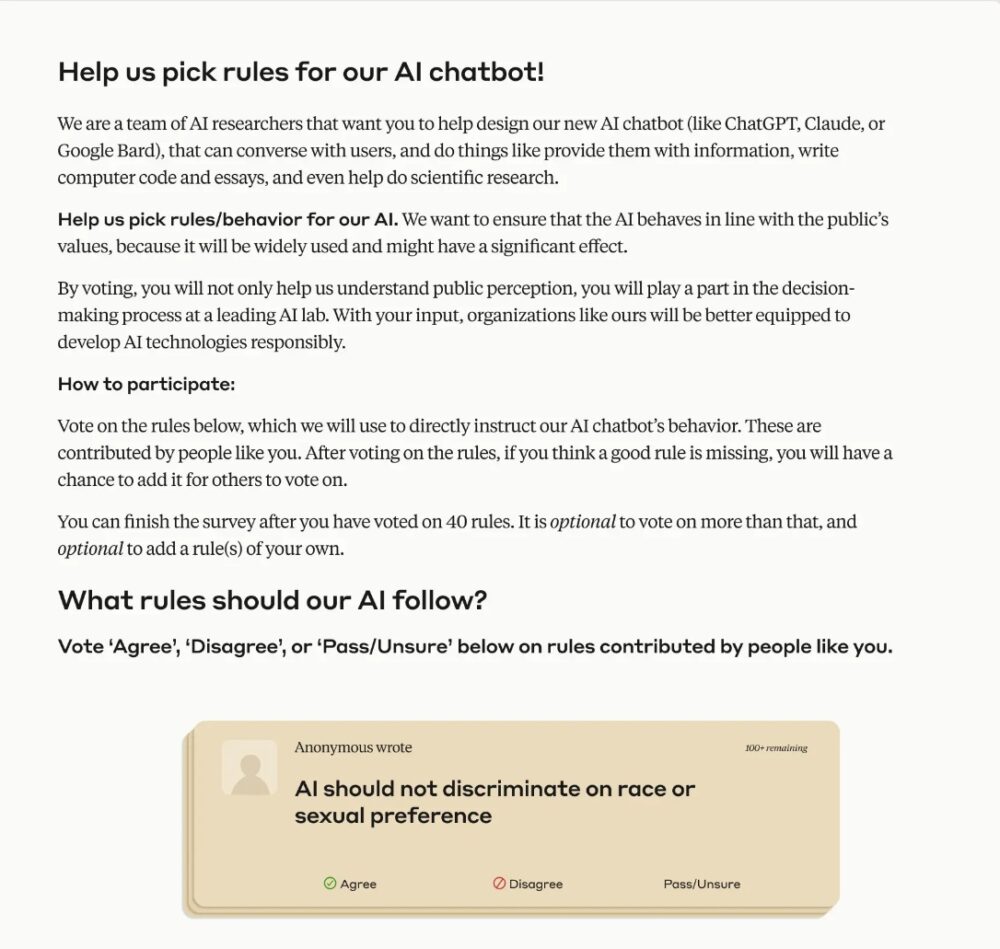

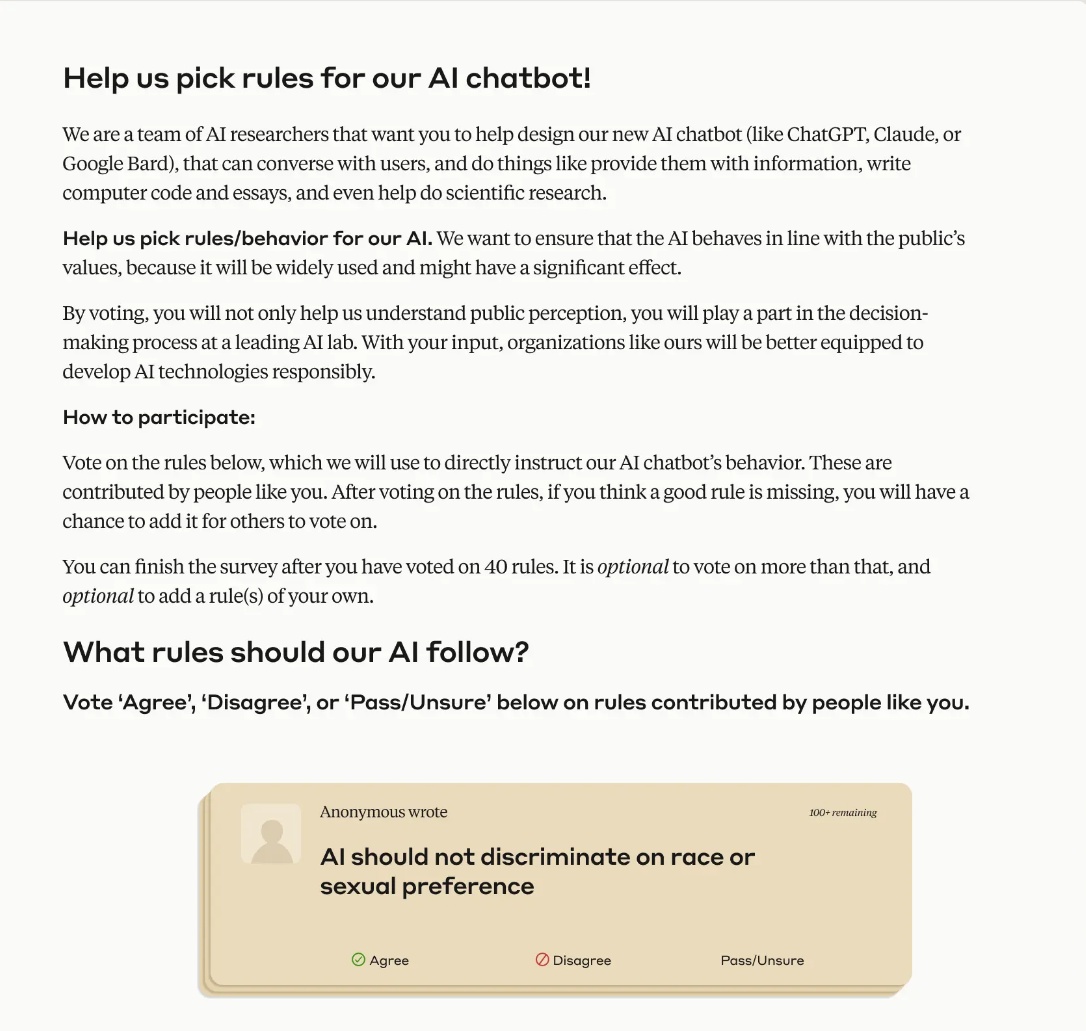

پولس اور اجتماعی انٹیلی جنس پروجیکٹ کے ساتھ مل کر، اینتھروپک نے متنوع آبادی کے 1,000 صارفین کو ٹیپ کیا اور ان سے پولنگ کے ذریعے سوالات کے ایک سلسلے کے جواب دینے کو کہا۔

چیلنج کا مرکز صارفین کو ایجنسی کو اس بات کا تعین کرنے کی اجازت دیتا ہے کہ انہیں نامناسب نتائج کے سامنے لائے بغیر کیا مناسب ہے۔ اس میں صارف کی اقدار کو طلب کرنا اور پھر ان خیالات کو ایک ایسے ماڈل میں نافذ کرنا شامل ہے جو پہلے سے تربیت یافتہ ہے۔

انتھروپک ایک طریقہ استعمال کرتا ہے جسے "آئینی AI" کہا جاتا ہے۔ براہ راست حفاظت اور افادیت کے لیے ایل ایل ایم کو ٹیوننگ کرنے کی اس کی کوششیں۔ بنیادی طور پر، اس میں ماڈل کو قواعد کی ایک فہرست دینا شامل ہے جس کی اسے پابندی کرنی چاہیے اور پھر اس کو ان اصولوں کو پورے عمل میں نافذ کرنے کی تربیت دینا، بالکل اسی طرح جیسے آئین بہت سی قوموں میں حکمرانی کے لیے بنیادی دستاویز کا کام کرتا ہے۔

اجتماعی آئینی AI تجربے میں، Anthropic نے ماڈل کے آئین میں گروپ پر مبنی تاثرات کو ضم کرنے کی کوشش کی۔ نتائج، کے مطابق Anthropic کی ایک بلاگ پوسٹ پر، بظاہر سائنسی کامیابی تھی کہ اس نے LLM پروڈکٹ کے صارفین کو ان کی اجتماعی اقدار کا تعین کرنے کی اجازت دینے کے ہدف کو حاصل کرنے کے لیے مزید چیلنجوں کو روشن کیا۔

ٹیم کو جن مشکلات پر قابو پانا پڑا ان میں سے ایک بینچ مارکنگ کے عمل کے لیے ایک نیا طریقہ پیش کرنا تھا۔ جیسا کہ یہ تجربہ اپنی نوعیت کا پہلا تجربہ معلوم ہوتا ہے، اور یہ انتھروپک کے آئینی AI طریقہ کار پر انحصار کرتا ہے، اس لیے بیس ماڈلز کا موازنہ ان لوگوں سے کرنے کے لیے کوئی قائم شدہ ٹیسٹ نہیں ہے جو ہجوم سے حاصل کردہ اقدار کے مطابق ہیں۔

بالآخر، ایسا معلوم ہوتا ہے جیسے کہ صارف کے پولنگ فیڈ بیک کے نتیجے میں ڈیٹا کو نافذ کرنے والے ماڈل نے متعصب آؤٹ پٹس کے علاقے میں بیس ماڈل کو "تھوڑا سا" پیچھے چھوڑ دیا۔

بلاگ پوسٹ کے مطابق:

"نتیجے میں آنے والے ماڈل سے زیادہ، ہم اس عمل کے بارے میں پرجوش ہیں۔ ہمارا ماننا ہے کہ یہ پہلی مثالوں میں سے ایک ہو سکتی ہے جس میں عوام کے اراکین نے، ایک گروپ کے طور پر، جان بوجھ کر ایک بڑے زبان کے ماڈل کے طرز عمل کی ہدایت کی ہے۔ ہم امید کرتے ہیں کہ دنیا بھر کی کمیونٹیز ثقافتی اور سیاق و سباق سے متعلق مخصوص ماڈلز کو تربیت دینے کے لیے اس طرح کی تکنیکوں کو تیار کریں گی جو ان کی ضروریات کو پورا کرتے ہیں۔"

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹو ڈیٹا ڈاٹ نیٹ ورک ورٹیکل جنریٹو اے آئی۔ اپنے آپ کو بااختیار بنائیں۔ یہاں تک رسائی حاصل کریں۔

- پلیٹوآئ اسٹریم۔ ویب 3 انٹیلی جنس۔ علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- پلیٹو ای ایس جی۔ کاربن، کلین ٹیک، توانائی ، ماحولیات، شمسی، ویسٹ مینجمنٹ یہاں تک رسائی حاصل کریں۔

- پلیٹو ہیلتھ۔ بائیوٹیک اینڈ کلینیکل ٹرائلز انٹیلی جنس۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://cointelegraph.com/news/antropic-democratic-ai-chatbot-by-letting-users-vote-for-its-values

- : ہے

- : ہے

- $UP

- 000

- 1

- 17

- a

- ہمارے بارے میں

- قابل قبول

- حصول

- کے پار

- کے خلاف

- ایجنسی

- AI

- اے آئی چیٹ بوٹ

- اے آئی ماڈلز

- صف بندی

- کی اجازت

- اجازت دے رہا ہے

- پہلے ہی

- ہمیشہ

- امریکی

- an

- اور

- جواب

- بشری

- ظاہر

- ظاہر ہوتا ہے

- مناسب

- رقبہ

- ارد گرد

- مصنوعی

- مصنوعی ذہانت

- مصنوعی انٹیلی جنس (AI)

- AS

- At

- کرنے کی کوشش

- کوشش کی

- بیس

- کی بنیاد پر

- BE

- رہا

- رویے

- یقین ہے کہ

- بینچ مارکنگ

- کے درمیان

- باصلاحیت

- بلاگ

- تعمیر

- تعمیر

- by

- کہا جاتا ہے

- کر سکتے ہیں

- مراکز

- چیلنج

- چیلنجوں

- چیٹ بٹ

- چیٹ جی پی ٹی

- Cointelegraph

- تعاون

- اجتماعی

- آنے والے

- کمیونٹی

- کمیونٹی

- موازنہ

- سمجھا

- آئین

- متنازعہ

- کور

- اعداد و شمار

- تعریفیں

- جمہوری

- آبادی

- اس بات کا تعین

- ترقی یافتہ

- ترقی

- حکم دینا

- مشکلات

- ہدایت

- متنوع

- دستاویز

- کرتا

- کوششوں

- بنیادی طور پر

- قائم

- مثال کے طور پر

- بہت پرجوش

- تجربہ

- آراء

- مل

- فرم

- پہلا

- کے لئے

- سے

- مزید

- دے دو

- دے

- مقصد

- گورننس

- گروپ

- تھا

- ہے

- امید ہے کہ

- HTTPS

- خیالات

- پر عملدرآمد

- عملدرآمد

- پر عمل درآمد

- in

- ہدایات

- ضم

- انٹیلی جنس

- جان بوجھ کر

- میں

- ملوث

- IT

- میں

- فوٹو

- فیصلے

- بچے

- زبان

- بڑے

- دے رہا ہے

- کی طرح

- LIMIT

- لسٹ

- ایل ایل ایم

- بہت سے

- مئی..

- مطلب

- اراکین

- طریقہ

- طریقہ کار

- ماڈل

- ماڈل

- اخلاقیات

- زیادہ

- بہت

- ضروری

- متحدہ

- ضروریات

- ناول

- نومبر

- of

- on

- ایک

- رائے

- or

- دیگر

- باہر

- باہر

- پیداوار

- نتائج

- پر قابو پانے

- شراکت دار

- ادوار

- مقام

- منصوبہ بنایا

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- ممکن

- پوسٹ

- ممکنہ

- عمل

- مصنوعات

- منصوبے

- عوامی

- سوالات

- متعلقہ

- درخواستوں

- جواب

- نتیجے

- نتائج کی نمائش

- روب

- قوانین

- سیفٹی

- سائنسی

- سیریز

- خدمت

- کام کرتا ہے

- مخصوص

- مطالعہ

- کامیابی

- ٹیپ

- ہدف

- ٹیم

- تکنیک

- ٹیسٹ

- سے

- کہ

- ۔

- علاقہ

- دنیا

- ان

- ان

- تو

- وہاں.

- اس

- ان

- اگرچہ؟

- خطرات

- بھر میں

- وقت

- کرنے کے لئے

- موضوعات

- کی طرف

- ٹرین

- تربیت یافتہ

- ٹریننگ

- ٹویٹر

- عام طور پر

- ناپسندیدہ

- استعمال کی شرائط

- رکن کا

- صارفین

- استعمال

- کا استعمال کرتے ہوئے

- قیمت

- قدر پر مبنی

- اقدار

- کی طرف سے

- ووٹ

- تھا

- we

- کیا

- جس

- گے

- ساتھ

- بغیر

- دنیا

- زیفیرنیٹ