آج، ہم Amazon کے جدید ترین کی عوامی دستیابی کا اعلان کرتے ہیں۔ 20 بلین پیرامیٹرز کے ساتھ الیکسا ٹیچر ماڈل (AlexaTM 20B) کے ذریعے ایمیزون سیج میکر جمپ اسٹارٹ، سیج میکر کا مشین لرننگ ہب۔ AlexaTM 20B ایک کثیر لسانی بڑے پیمانے پر ترتیب سے ترتیب (seq2seq) زبان کا ماڈل ہے جسے Amazon نے تیار کیا ہے۔ آپ AlexaTM 20B کو صنعت کے استعمال کے کیسز کی ایک وسیع رینج کے لیے استعمال کر سکتے ہیں، مالیاتی رپورٹوں کا خلاصہ کرنے سے لے کر کسٹمر سروس چیٹ بوٹس کے سوالوں کے جوابات تک۔ اس کا اطلاق اس وقت بھی کیا جا سکتا ہے جب صرف چند دستیاب تربیتی مثالیں ہوں، یا یہاں تک کہ کوئی بھی نہیں۔ AlexaTM 20B outperforms 175 ارب GPT-3 ماڈل زیرو شاٹ لرننگ ٹاسکس جیسے کہ SuperGLUE پر اور XNLI جیسے کثیر لسانی زیرو شاٹ ٹاسک کے لیے جدید ترین کارکردگی دکھاتا ہے۔

اس پوسٹ میں، ہم JumpStart APIs کے ذریعے پروگرام کے مطابق AlexaTM 20B ماڈل کے ساتھ اندازہ لگانے اور چلانے کے طریقہ کا ایک جائزہ فراہم کرتے ہیں، جو SageMaker Python SDK. ہم مثال دیتے ہیں کہ آپ کس طرح اس ماڈل کو متعدد زبانوں کے درمیان ترجمہ کرنے، طویل شکل کے متن کا خلاصہ کرنے، دیئے گئے سیاق و سباق کی بنیاد پر سوالات کے جوابات دینے اور ایسے متن کو تخلیق کرنے کے لیے استعمال کر سکتے ہیں جو انسانی تحریری متن سے الگ نہ ہو۔

AlexaTM 20B اور سیاق و سباق میں سیکھنا

Amazon Alexa AI کی طرف سے Alexa Teacher Model (AlexaTM) پروگرام بڑے پیمانے پر کثیر لسانی گہری سیکھنے کے ماڈلز (بنیادی طور پر ٹرانسفارمر پر مبنی) بنانے کے لیے ڈیزائن کیا گیا ہے، جس کا مقصد بہاوی کاموں کے لیے ڈیٹا کی کمی کو عام کرنا اور ہینڈل کرنا ہے۔ بڑے پیمانے پر پری ٹریننگ کے ساتھ، اساتذہ کے ماڈلز اسپرس ڈیٹا سے نئے کاموں کو سیکھنے کے لیے اچھی طرح عام کر سکتے ہیں اور ڈویلپرز کو بہاو والے کاموں پر کارکردگی کو بہتر بنانے میں مدد کرتے ہیں۔ AlexaTM 20B نے دکھایا ہے۔ مسابقتی کارکردگی کامن نیچرل لینگویج پروسیسنگ (NLP) بینچ مارکس اور کاموں پر، جیسے مشین ترجمہ، ڈیٹا جنریشن اور خلاصہ۔

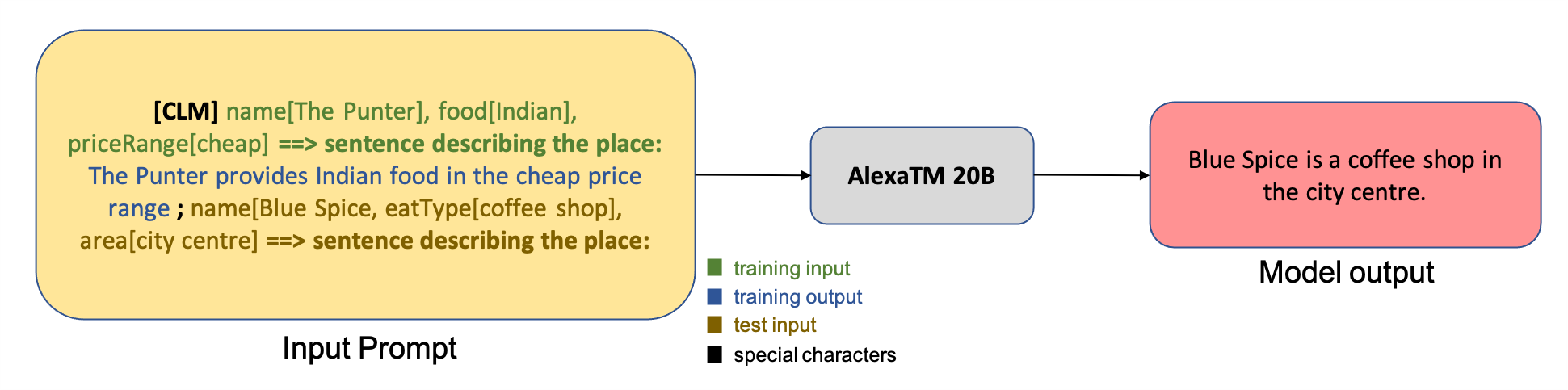

فاؤنڈیشن ماڈلز جیسے کہ AlexaTM 20B کا استعمال مہنگے ماڈل کی پری ٹریننگ کی ضرورت کو کم کرتا ہے اور کم محنت اور کم ٹاسک مخصوص ٹریننگ ڈیٹا کے ساتھ ٹاسک ماڈل تیار کرنے کے لیے ایک جدید ترین نقطہ آغاز فراہم کرتا ہے۔ فاؤنڈیشن ماڈلز کی کلیدی صلاحیتوں میں سے ایک یہ ہے کہ ہم ایک ماڈل کو مختلف زبانوں میں سوال و جواب جیسے نئے کام انجام دینے کے لیے سکھا سکتے ہیں، جس میں ان پٹ مثالوں کی بہت کم مقدار ہوتی ہے اور کسی فائن ٹیوننگ یا گریڈینٹ اپ ڈیٹ کی ضرورت نہیں ہوتی ہے۔ یہ کے طور پر جانا جاتا ہے سیاق و سباق کی تعلیم. ایک نئے کام کی صرف چند مثالوں کے ساتھ جو سیاق و سباق کے حوالے سے فراہم کی گئی ہے، AlexaTM 20B ماڈل بڑے پیمانے پر پری ٹریننگ کے دوران سیکھے گئے علم سے، یہاں تک کہ زبانوں میں بھی منتقل کر سکتا ہے۔ اسے کہتے ہیں۔ چند شاٹ سیکھنے. کچھ معاملات میں، ماڈل بغیر کسی تربیتی ڈیٹا کے بالکل اچھی کارکردگی کا مظاہرہ کر سکتا ہے، صرف اس کی وضاحت کے ساتھ کہ کیا پیشین گوئی کی جانی چاہیے۔ اسے کہتے ہیں۔ صفر شاٹ سیکھنا. مثال کے طور پر، ہم کہتے ہیں کہ ہم ایک شاٹ قدرتی زبان کی تخلیق کے لیے AlexaTM 20B استعمال کر رہے ہیں۔ ماڈل کو دیا گیا ان پٹ اس کے متعلقہ آؤٹ پٹ ٹیکسٹ بیانیہ کے ساتھ، انتساب-قدر کے جوڑوں کی شکل میں تربیتی مثال ہے۔ اس کے بعد ٹیسٹ کی مثال کو مکمل ان پٹ پرامپٹ بنانے کے لیے جوڑا جاتا ہے، جیسا کہ درج ذیل تصویر میں دکھایا گیا ہے۔

ماڈل کے بارے میں مزید جاننے کے لیے، چیک آؤٹ کریں۔ 20B-پیرامیٹر Alexa ماڈل چند شاٹ لرننگ میں نئے نشانات مرتب کرتا ہے۔ یا اصل کاغذ.

AlexaTM 20B کا استعمال غیر تجارتی استعمال کے لیے دستیاب کرایا گیا ہے اور اس کا احاطہ کیا گیا ہے۔ الیکسا ٹیچر ماڈل لائسنس کا معاہدہ.

حل جائزہ

مندرجہ ذیل حصے ایک مرحلہ وار ڈیمو فراہم کرتے ہیں کہ ماڈل کو کیسے تعینات کیا جائے، اندازہ لگایا جائے، اور سیاق و سباق میں سیکھنے کے چند کاموں کو حل کیا جائے۔

نوٹ کریں کہ درج ذیل حصے میں کوڈ کے ٹکڑوں پر مشتمل ہے۔ اس ڈیمو کے تمام مراحل کے ساتھ مکمل کوڈ ساتھ والی نوٹ بک میں دستیاب ہے: سیج میکر جمپ اسٹارٹ میں AlexaTM 20B کے ساتھ سیاق و سباق میں سیکھنا.

ماڈل تعینات کریں۔

SageMaker میں زبان کا ایک بڑا ماڈل استعمال کرنے کے لیے، آپ کو ماڈل کے لیے مخصوص ایک انفرنسنگ اسکرپٹ کی ضرورت ہے، جس میں ماڈل لوڈنگ، متوازی کاری اور بہت کچھ جیسے اقدامات شامل ہیں۔ آپ کو اسکرپٹس، ماڈل اور مطلوبہ مثال کی اقسام کے لیے اینڈ ٹو اینڈ ٹیسٹ بنانے کی بھی ضرورت ہے تاکہ یہ تصدیق ہو سکے کہ تینوں ایک ساتھ کام کر سکتے ہیں۔ جمپ اسٹارٹ استعمال کے لیے تیار اسکرپٹ فراہم کرکے اس کوشش کو ہٹاتا ہے جن کا مضبوطی سے تجربہ کیا گیا ہے۔

سیج میکر آپ کو تربیت اور اندازہ لگانے کے لیے بڑے پیمانے پر ڈوکر کنٹینرز چلانے کی صلاحیت فراہم کرتا ہے۔ جمپ سٹارٹ ان دستیاب فریم ورک کے ساتھ مخصوص استعمال کرتا ہے۔ سیج میکر ڈیپ لرننگ کنٹینرز (DLCs)۔ ہم آپٹمائزڈ DLC (deploy_image_uri) کا استعمال کرتے ہوئے model_id. پھر ہم لاتے ہیں۔ model_uri ماڈل کے پیرامیٹرز پر مشتمل، انفرنس ہینڈلنگ اسکرپٹس اور کسی بھی متعلقہ انحصار کے ساتھ۔ اگلا، ہم ایک بناتے ہیں ماڈل مثال سیج میکر میں اور اسے ریئل ٹائم اینڈ پوائنٹ پر تعینات کریں۔ درج ذیل کوڈ دیکھیں:

AlexaTM 20B کی تعیناتی کے لیے کم از کم 50 GB CPU میموری اور کم از کم 42 GB GPU میموری کے ساتھ GPU کی حمایت یافتہ مثال درکار ہے۔ سیج میکر ایسی بہت سی مثالیں فراہم کرتا ہے جو حقیقی وقت کے تخمینے کی حمایت کرتے ہیں۔ ہم نے اس حل کو تین مثالوں پر آزمایا: ml.g4dn.12xlarge, ml.p3.8xlarge, ml.p3.16xlarge۔ درج ذیل کوڈ دیکھیں:

اگلا، ہم ماڈل کو سیج میکر ریئل ٹائم اینڈ پوائنٹ پر تعینات کرتے ہیں:

AlexaTM 20B کو انفرنس کنٹینر میں 40 GB ڈسک کی جگہ درکار ہے۔ ایک ml.g4dn.12xlarge مثال اس ضرورت کو پورا کرتی ہے۔ مثال کے طور پر ml.p3.8xlarge اور ml.p3.16xlarge کی اقسام، ہم ایک منسلک کرتے ہیں ایمیزون لچکدار بلاک اسٹور (ایمیزون EBS) حجم بڑے ماڈل سائز کو ہینڈل کرنے کے لئے. لہذا، ہم نے مقرر کیا volume_size = None ml.g4dn.12xlarge پر تعینات کرتے وقت اور volume_size=256 ml.p3.8xlarge یا ml.p3.16xlarge پر تعینات کرتے وقت۔

ماڈل کی تعیناتی میں 10 منٹ لگ سکتے ہیں۔ ماڈل کے تعینات ہونے کے بعد، ہم اس سے حقیقی وقت میں پیشین گوئیاں حاصل کر سکتے ہیں!

تخمینہ چلائیں۔

AlexaTM 20B ایک ٹیکسٹ جنریشن ماڈل ہے جو کہ جزوی ترتیب (ایک جملہ یا متن کا ٹکڑا) دیکر الفاظ کا اگلا مجموعہ تیار کرتا ہے۔ درج ذیل کوڈ کا ٹکڑا آپ کو اس بات کی ایک جھلک دیتا ہے کہ ہم نے جو اختتامی نقطہ ہم نے تعینات کیا ہے اس سے کیسے استفسار کیا جائے اور خودکار تکمیل کے کام کے لیے آؤٹ پٹ کو پارس کیا جائے۔ تعینات کردہ ماڈل کو درخواستیں بھیجنے کے لیے، ہم UTF-8 فارمیٹ میں انکوڈ کردہ JSON لغت کا استعمال کرتے ہیں۔ اختتامی جواب ایک JSON آبجیکٹ ہے جس میں تیار کردہ متن کی فہرست ہے۔

اگلا، ہم اختتامی نقطہ سے استفسار کرتے ہیں اور نمونے کے ان پٹ متن پر جواب کو پارس کرتے ہیں:

AlexaTM 20B فی الحال قیاس کے دوران 10 ٹیکسٹ جنریشن پیرامیٹرز کی حمایت کرتا ہے: max_length, num_return_sequences, num_beams, no_repeat_ngram_size, temperature, early_stopping, do_sample, top_k, top_p، اور seed. ہر پیرامیٹر کے لیے درست اقدار اور آؤٹ پٹ پر ان کے اثرات کے بارے میں تفصیلی معلومات کے لیے، ساتھ والی نوٹ بک دیکھیں: سیج میکر جمپ اسٹارٹ میں AlexaTM 20B کے ساتھ سیاق و سباق میں سیکھنا.

سیاق و سباق میں سیکھنا

سیاق و سباق میں سیکھنے سے مراد درج ذیل ہے: ہم زبان کا ماڈل ایک پرامپٹ کے ساتھ فراہم کرتے ہیں، جس میں تربیتی ان پٹ آؤٹ پٹ جوڑے ہوتے ہیں جو کام کو ظاہر کرتے ہیں۔ ہم پرامپٹ میں ایک ٹیسٹ ان پٹ شامل کرتے ہیں اور لینگویج ماڈل کو پرامپٹ پر کنڈیشنگ کرکے اور اگلے ٹوکنز یا الفاظ کی پیشین گوئی کرنے کی اجازت دیتے ہیں۔ یہ شاٹ لرننگ کے چند مسائل کو حل کرنے کے لیے ایک انتہائی موثر تکنیک ہے، جس میں ہم چند تربیتی نمونوں سے ایک کام سیکھتے ہیں۔

اس کے بعد، ہم دکھاتے ہیں کہ آپ سیاق و سباق میں سیکھنے کے ذریعے متعدد 20 شاٹ اور زیرو شاٹ کاموں کے لیے AlexaTM 1B کا استعمال کیسے کر سکتے ہیں۔ پیشگی ترتیب سے ترتیب والے ماڈلز کے برعکس، AlexaTM 20B کو ڈینوائزنگ کے علاوہ کازل لینگویج ماڈلنگ کی تربیت دی گئی تھی، جو اسے سیاق و سباق میں سیکھنے کے لیے ایک اچھا ماڈل بناتی ہے۔

1 شاٹ متن کا خلاصہ

متن کا خلاصہ ڈیٹا کو مختصر کرنے اور ایک خلاصہ تخلیق کرنے کا کام ہے جو اصل متن میں موجود سب سے اہم معلومات کی نمائندگی کرتا ہے۔ 1 شاٹ ٹیکسٹ سمریائزیشن سے مراد وہ ترتیب ہے جہاں ہم ایک تربیتی نمونے کی بنیاد پر متن کا خلاصہ کرنا سیکھتے ہیں۔ درج ذیل کوڈ سے متن کا خلاصہ نمونہ ہے۔ XSUM ڈیٹاسیٹ:

جب صرف ایک تربیتی نمونہ فراہم کیا جاتا ہے تو ہم خلاصہ کے لیے درج ذیل پرامپٹ کا استعمال کرتے ہیں۔ ماڈل سے تیار کردہ متن کو ٹیسٹ مضمون کی پیشین گوئی کے خلاصے کے طور پر سمجھا جاتا ہے۔

آؤٹ پٹ مندرجہ ذیل ہے:

1 شاٹ قدرتی زبان کی نسل

فطری زبان کی نسل ان پٹ ٹیکسٹ کو دیکھتے ہوئے متن کی داستانیں تیار کرنے کا کام ہے۔ مندرجہ ذیل نمونہ سے تربیتی نمونہ دکھاتا ہے۔ E2E ڈیٹاسیٹ:

جب صرف ایک تربیتی نمونہ (1 شاٹ) فراہم کیا جاتا ہے تو ہم فطری زبان کی تخلیق کے لیے درج ذیل پرامپٹ استعمال کرتے ہیں۔ ماڈل سے تیار کردہ متن کو ٹیسٹ ان پٹ (test_inp).

آؤٹ پٹ مندرجہ ذیل ہے:

1 شاٹ مشین کا ترجمہ

مشینی ترجمہ ایک زبان سے دوسری زبان میں متن کا ترجمہ کرنے کا کام ہے۔ مندرجہ ذیل مثال سے تربیتی نمونہ دکھاتا ہے۔ WMT19 ڈیٹاسیٹ جس میں ہمیں جرمن سے انگریزی میں ترجمہ کرنے کی ضرورت ہے:

جب صرف ایک تربیتی نمونہ (1 شاٹ) فراہم کیا جاتا ہے تو ہم مشینی ترجمہ کے لیے درج ذیل پرامپٹ استعمال کرتے ہیں۔ ماڈل سے تیار کردہ متن کو ٹیسٹ ان پٹ کے ترجمہ سے تعبیر کیا جاتا ہے (test_inp).

آؤٹ پٹ مندرجہ ذیل ہے:

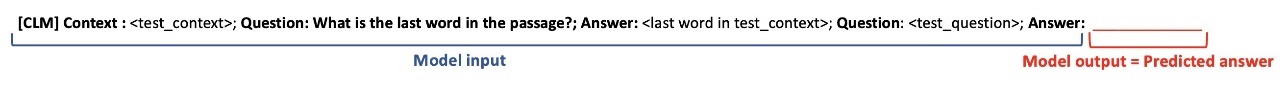

زیرو شاٹ ایکسٹریکٹیو سوال کا جواب دینا

استخراجی سوال کا جواب دینے کا کام سیاق و سباق کے پیراگراف سے کسی سوال کا جواب تلاش کرنا ہے۔ مندرجہ ذیل سیاق و سباق کی ایک مثال اور سے ایک سوال ہے۔ اسکواڈ v2 ڈیٹاسیٹ:

نوٹ کریں کہ ہمارے پاس اپنے کام کے لیے کوئی تربیتی نمونہ نہیں ہے۔ اس کے بجائے، ہم پرامپٹ میں آخری لفظ کے بارے میں ایک ڈمی سوال بناتے ہیں۔ test_context (ڈمی شاٹ) لہذا، ہم اصل میں صفر شاٹ نکالنے والے سوال کا جواب دے رہے ہیں۔

جب کوئی تربیتی نمونہ فراہم نہیں کیا جاتا ہے تو ہم استخراجی سوال کے جوابات کے لیے درج ذیل پرامپٹ استعمال کرتے ہیں۔ ماڈل سے تیار کردہ متن کو ٹیسٹ سوال کے جواب کے طور پر سمجھا جاتا ہے۔

آؤٹ پٹ مندرجہ ذیل ہے:

فوری انجینئرنگ

فوری انجینئرنگ کبھی کبھی ایک فن بن سکتی ہے۔ یہاں تک کہ پرامپٹ ٹیمپلیٹ میں چھوٹی تبدیلیاں بھی کسی مخصوص کام پر ماڈل کی کارکردگی میں نمایاں تبدیلیاں لا سکتی ہیں۔ اچھے پرامپٹ ٹیمپلیٹس لکھنے کے لیے چند مشورے درج ذیل ہیں۔ سب سے پہلے، یہ یاد رکھنا ضروری ہے کہ ماڈل کو حقیقی جملوں کی ساخت (کازل لینگویج ماڈلنگ) سیکھنے کی تربیت دی گئی تھی۔ اس طرح، یہ یقینی بنانا بہتر ہے کہ آپ کا پرامپٹ ٹیمپلیٹ فطری زبان میں گرامر اور ساختی طور پر درست ہے۔ دوسرا، یہ مخصوص ماڈل ڈمی شاٹس سے فائدہ اٹھاتا ہے تاکہ اسے جواب میں متوقع ڈھانچہ سکھانے میں مدد ملے، جیسا کہ اوپر دکھایا گیا ہے۔ تیسرا، یہ ہمیشہ مشورہ دیا جاتا ہے کہ امیدواروں کے پرامپٹ ٹیمپلیٹس کی ایک قسم پر کام کی کارکردگی کا جائزہ لیں۔ پرامپٹ سورس اور قدرتی ہدایات پرامپٹ ٹیمپلیٹس کو معیاری بنانے کے لیے دو اوپن سورس فریم ورک ہیں، اور یہ موجودہ ماڈلنگ کے کاموں کے لیے استعمال کیے جانے والے متعدد مثال کے اشارے فراہم کرتے ہیں۔ مزید برآں، کا ضمیمہ B AlexaTM 20B کاغذ کاغذ میں پیش کردہ نتائج پیدا کرنے کے لیے استعمال کیے جانے والے پرامپٹ ٹیمپلیٹس فراہم کرتا ہے۔ ایک بڑھتا ہوا ذیلی فیلڈ ہے جو کسی کام کے لیے بہترین اشارے کی خودکار تخلیق اور سیکھنے کے لیے وقف ہے، جس میں قدرتی زبان اور مسلسل اشارے دونوں شامل ہیں۔ یہ اس ٹیوٹوریل کے دائرہ کار سے باہر ہے۔

نتیجہ

اس پوسٹ میں، ہم نے دکھایا کہ الیکسا ٹی ایم 20 بی ماڈل کو سیج میکر اینڈ پوائنٹ پر کیسے تعینات کیا جائے اور اندازہ لگایا جائے۔ آپ AlexaTM 20B ماڈل کو سیاق و سباق میں سیکھنے کے لیے استعمال کر سکتے ہیں مختلف شاٹ سیکھنے کے کاموں کے لیے۔ AlexaTM 20B کے بارے میں مزید جاننے کے لیے، رجوع کریں۔ 20B-پیرامیٹر Alexa ماڈل چند شاٹ لرننگ میں نئے نشانات مرتب کرتا ہے۔ یا اصل کاغذ.

مصنفین اس لانچ کو ممکن بنانے میں Maciej Rudnicki، Jakub Debski، Ashish Khetan، Anastasiia Dubinina، Vitaliy Korolev، Karl Albertsen، Saleh Soltan، اور Mariusz Momotko کے تکنیکی تعاون کو تسلیم کرنا چاہیں گے۔

جمپ اسٹارٹ کے بارے میں

JumpStart Amazon SageMaker کا مشین لرننگ (ML) مرکز ہے جو 350 سے زیادہ پہلے سے تربیت یافتہ ماڈلز، بلٹ ان الگورتھم، اور پہلے سے تعمیر شدہ حل ٹیمپلیٹس پیش کرتا ہے تاکہ آپ کو ML کے ساتھ تیزی سے آغاز کرنے میں مدد ملے۔ جمپ سٹارٹ مقبول ماڈل ہب جیسے TensorFlow، PyTorch، Hugging Face، اور MXNet سے جدید ترین ماڈلز کی میزبانی کرتا ہے، جو کہ مقبول ML کاموں جیسے آبجیکٹ کا پتہ لگانے، ٹیکسٹ کی درجہ بندی، اور ٹیکسٹ جنریشن کی حمایت کرتے ہیں۔ ایم ایل ریسرچ کمیونٹی نے حال ہی میں تیار کردہ زیادہ تر ماڈلز کو عوامی طور پر استعمال کے لیے دستیاب کرنے کے لیے بہت زیادہ کوششیں کی ہیں۔ جمپ اسٹارٹ کا مقصد ایم ایل ماڈلز اور الگورتھم کو درست تلاش کرنے میں آپ کی مدد کرنا ہے، اور فوری طور پر ماڈلز بنانا شروع کر دیں۔ خاص طور پر، جمپ اسٹارٹ درج ذیل فوائد فراہم کرتا ہے:

- UI اور SDK کے ساتھ آسان رسائی - آپ SageMaker Python SDK کا استعمال کرتے ہوئے یا Amazon SageMaker Studio میں JumpStart UI کے ذریعے JumpStart میں ماڈلز اور الگورتھم تک رسائی حاصل کر سکتے ہیں۔ فی الحال، AlexaTM 20B صرف SageMaker Python SDK کے ذریعے قابل رسائی ہے۔

- SageMaker بلٹ ان الگورتھم – JumpStart 350 سے زیادہ بلٹ ان الگورتھم اور پہلے سے تربیت یافتہ ماڈلز فراہم کرتا ہے، اس کے ساتھ متعلقہ ٹریننگ اسکرپٹس (اگر تعاون یافتہ ہوں)، انفرنسنگ اسکرپٹس، اور مثال کے طور پر نوٹ بک۔ اسکرپٹس کو ہر فریم ورک اور کام کے لیے بہتر بنایا گیا ہے، اور GPU سپورٹ، آٹومیٹک ماڈل ٹیوننگ اور انکریمنٹل ٹریننگ جیسی خصوصیات فراہم کرتا ہے۔ اسکرپٹس کو SageMaker مثالوں اور خصوصیات کے خلاف بھی آزمایا جاتا ہے تاکہ آپ مطابقت کے مسائل کا شکار نہ ہوں۔

- پہلے سے تیار کردہ حل - جمپ سٹارٹ عام ML استعمال کے معاملات کے لیے 23 حل فراہم کرتا ہے، جیسے کہ ڈیمانڈ کی پیشن گوئی اور صنعتی اور مالیاتی ایپلی کیشنز، جنہیں آپ صرف چند کلکس کے ساتھ تعینات کر سکتے ہیں۔ سولیوشنز اینڈ ٹو اینڈ ایم ایل ایپلی کیشنز ہیں جو مختلف AWS سروسز کو ایک ساتھ جوڑ کر کسی خاص کاروباری استعمال کے معاملے کو حل کرتی ہیں۔ وہ فوری تعیناتی کے لیے AWS CloudFormation ٹیمپلیٹس اور ریفرنس آرکیٹیکچرز کا استعمال کرتے ہیں، جس کا مطلب ہے کہ وہ مکمل طور پر حسب ضرورت ہیں۔

- سپورٹ - سیج میکر کئی طرح کی سپورٹ فراہم کرتا ہے، جیسے سیج میکر کے نئے فیچرز یا ڈیپ لرننگ کنٹینر ورژنز جاری ہونے پر اپ ٹو ڈیٹ ورژنز کو برقرار رکھنا، اور سیج میکر ماحول میں جمپ اسٹارٹ مواد کو استعمال کرنے کے طریقے کے بارے میں دستاویزات بنانا۔

جمپ اسٹارٹ کے بارے میں مزید جاننے کے لیے اور آپ اوپن سورس پری ٹرینڈ ماڈلز کو مختلف قسم کے دیگر ایم ایل کاموں کے لیے کیسے استعمال کر سکتے ہیں، درج ذیل کو دیکھیں AWS re: Invent 2020 ویڈیو.

مصنفین کے بارے میں

ڈاکٹر وویک مدن Amazon SageMaker جمپ سٹارٹ ٹیم کے ساتھ ایک اپلائیڈ سائنٹسٹ ہے۔ انہوں نے Urbana-Champaign میں یونیورسٹی آف الینوائے سے پی ایچ ڈی کی اور جارجیا ٹیک میں پوسٹ ڈاکٹریٹ ریسرچر تھے۔ وہ مشین لرننگ اور الگورتھم ڈیزائن میں ایک فعال محقق ہے اور اس نے EMNLP، ICLR، COLT، FOCS، اور SODA کانفرنسوں میں مقالے شائع کیے ہیں۔

ڈاکٹر وویک مدن Amazon SageMaker جمپ سٹارٹ ٹیم کے ساتھ ایک اپلائیڈ سائنٹسٹ ہے۔ انہوں نے Urbana-Champaign میں یونیورسٹی آف الینوائے سے پی ایچ ڈی کی اور جارجیا ٹیک میں پوسٹ ڈاکٹریٹ ریسرچر تھے۔ وہ مشین لرننگ اور الگورتھم ڈیزائن میں ایک فعال محقق ہے اور اس نے EMNLP، ICLR، COLT، FOCS، اور SODA کانفرنسوں میں مقالے شائع کیے ہیں۔

جیک فٹز جیرالڈ Alexa AI کے ساتھ ایک سینئر اپلائیڈ سائنسدان ہیں، جہاں وہ فی الحال بڑی زبان کی ماڈلنگ، کثیر لسانی ٹیکسٹ ماڈلنگ، اور مشین لرننگ آپریشنز پر توجہ مرکوز کر رہے ہیں۔

جیک فٹز جیرالڈ Alexa AI کے ساتھ ایک سینئر اپلائیڈ سائنسدان ہیں، جہاں وہ فی الحال بڑی زبان کی ماڈلنگ، کثیر لسانی ٹیکسٹ ماڈلنگ، اور مشین لرننگ آپریشنز پر توجہ مرکوز کر رہے ہیں۔

جواؤ مورا ایمیزون ویب سروسز میں ایک AI/ML ماہر حل آرکیٹیکٹ ہے۔ وہ زیادہ تر NLP کے استعمال کے معاملات پر توجہ مرکوز کرتا ہے اور صارفین کو گہری سیکھنے کے ماڈل کی تربیت اور تعیناتی کو بہتر بنانے میں مدد کرتا ہے۔ وہ کم کوڈ ایم ایل سلوشنز اور ایم ایل اسپیشلائزڈ ہارڈ ویئر کا ایک فعال حامی بھی ہے۔

جواؤ مورا ایمیزون ویب سروسز میں ایک AI/ML ماہر حل آرکیٹیکٹ ہے۔ وہ زیادہ تر NLP کے استعمال کے معاملات پر توجہ مرکوز کرتا ہے اور صارفین کو گہری سیکھنے کے ماڈل کی تربیت اور تعیناتی کو بہتر بنانے میں مدد کرتا ہے۔ وہ کم کوڈ ایم ایل سلوشنز اور ایم ایل اسپیشلائزڈ ہارڈ ویئر کا ایک فعال حامی بھی ہے۔

جون جیت گیا۔ سیج میکر جمپ اسٹارٹ اور بلٹ ان الگورتھم کے ساتھ پروڈکٹ مینیجر ہے۔ وہ سیج میکر کے صارفین کے لیے ایم ایل مواد کو آسانی سے قابل دریافت اور قابل استعمال بنانے پر توجہ مرکوز کرتا ہے۔

جون جیت گیا۔ سیج میکر جمپ اسٹارٹ اور بلٹ ان الگورتھم کے ساتھ پروڈکٹ مینیجر ہے۔ وہ سیج میکر کے صارفین کے لیے ایم ایل مواد کو آسانی سے قابل دریافت اور قابل استعمال بنانے پر توجہ مرکوز کرتا ہے۔

پلکت کپور Alexa AI کے ساتھ Alexa Teacher Model پروگرام کے لیے پروڈکٹ لیڈ ہے، جو الیکسا کے ملٹی ٹاسک ملٹی موڈل فاؤنڈیشن ماڈلز کی عمومی ذہانت اور ایپلی کیشنز پر توجہ مرکوز کرتا ہے۔

پلکت کپور Alexa AI کے ساتھ Alexa Teacher Model پروگرام کے لیے پروڈکٹ لیڈ ہے، جو الیکسا کے ملٹی ٹاسک ملٹی موڈل فاؤنڈیشن ماڈلز کی عمومی ذہانت اور ایپلی کیشنز پر توجہ مرکوز کرتا ہے۔

- AI

- ai آرٹ

- AI آرٹ جنریٹر

- عی روبوٹ

- ایمیزون سیج میکر

- ایمیزون سیج میکر جمپ اسٹارٹ

- مصنوعی ذہانت

- مصنوعی ذہانت کا سرٹیفیکیشن

- بینکنگ میں مصنوعی ذہانت

- مصنوعی ذہانت والا روبوٹ

- مصنوعی ذہانت والے روبوٹ

- مصنوعی ذہانت سافٹ ویئر

- AWS مشین لرننگ

- blockchain

- بلاکچین کانفرنس

- coingenius

- بات چیت مصنوعی ذہانت

- crypto کانفرنس ai

- dall-e

- گہری سیکھنے

- بنیادی (100)

- گوگل عی

- مشین لرننگ

- پلاٹا

- افلاطون اے

- افلاطون ڈیٹا انٹیلی جنس

- افلاطون گیم

- پلیٹو ڈیٹا

- پلیٹو گیمنگ

- پیمانہ ai

- نحو

- زیفیرنیٹ