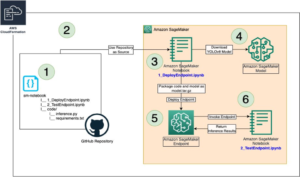

آج ایمیزون سیج میکر SageMaker ٹریننگ مثال کے طور پر فال بیکس کی حمایت کا اعلان کیا۔ ایمیزون سیج میکر آٹومیٹک ماڈل ٹیوننگ (AMT) جو صارفین کو متبادل کمپیوٹ ریسورس کنفیگریشنز کی وضاحت کرنے کی اجازت دیتا ہے۔

سیج میکر آٹومیٹک ماڈل ٹیوننگ آپ کے ڈیٹاسیٹ پر بہت سی ٹریننگ جابز چلا کر ماڈل کا بہترین ورژن تلاش کرتی ہے۔ حدود ہائپرپیرامیٹرس کا جو آپ اپنے الگورتھم کے لیے بیان کرتے ہیں۔ پھر، یہ ہائپر پیرامیٹر اقدار کا انتخاب کرتا ہے جس کے نتیجے میں ایک ایسا ماڈل ہوتا ہے جو بہترین کارکردگی کا مظاہرہ کرتا ہے، جیسا کہ a کے ذریعے ماپا جاتا ہے۔ میٹرک۔ جسے آپ منتخب کرتے ہیں۔

پہلے، صارفین کے پاس صرف ایک مثال کی ترتیب کی وضاحت کرنے کا اختیار تھا۔ یہ مسائل کا باعث بن سکتا ہے جب مخصوص مثال کی قسم زیادہ استعمال کی وجہ سے دستیاب نہیں ہوتی ہے۔ ماضی میں، آپ کی تربیتی ملازمتیں Insufficient CapacityError (ICE) کے ساتھ ناکام ہو جائیں گی۔ AMT نے بہت سے معاملات میں ان ناکامیوں سے بچنے کے لیے ہوشیار کوششوں کا استعمال کیا، لیکن یہ مسلسل کم صلاحیت کی وجہ سے بے اختیار رہا۔

اس نئی خصوصیت کا مطلب ہے کہ آپ ترجیحی ترتیب میں مثال کی ترتیب کی فہرست بتا سکتے ہیں، اس طرح کہ کم گنجائش کی صورت میں آپ کی AMT جاب خود بخود فہرست میں اگلی مثال میں واپس آجائے گی۔

درج ذیل حصوں میں، ہم ICE پر قابو پانے کے لیے ان اعلیٰ سطحی مراحل سے گزرتے ہیں:

- HyperParameter ٹیوننگ جاب کنفیگریشن کی وضاحت کریں۔

- تربیتی ملازمت کے پیرامیٹرز کی وضاحت کریں۔

- ہائپرپیرامیٹر ٹیوننگ جاب بنائیں

- تربیتی کام کی وضاحت کریں۔

HyperParameter ٹیوننگ جاب کنفیگریشن کی وضاحت کریں۔

۔ HyperParameterTuningJobConfig آبجیکٹ ٹیوننگ جاب کی وضاحت کرتا ہے، بشمول تلاش کی حکمت عملی، تربیتی ملازمتوں کا اندازہ کرنے کے لیے استعمال ہونے والا مقصدی میٹرک، تلاش کرنے کے لیے پیرامیٹرز کی حدود، اور ٹیوننگ جاب کے لیے وسائل کی حدود۔ آج کے فیچر ریلیز کے ساتھ اس پہلو کو تبدیل نہیں کیا گیا۔ بہر حال، ہم ایک مکمل مثال دینے کے لیے اس پر جائیں گے۔

۔ ResourceLimits آبجیکٹ اس ٹیوننگ جاب کے لیے زیادہ سے زیادہ ٹریننگ جابز اور متوازی ٹریننگ جابز کی وضاحت کرتا ہے۔ اس مثال میں، ہم کر رہے ہیں a بے ترتیب تلاش حکمت عملی اور زیادہ سے زیادہ 10 ملازمتوں کی وضاحت (MaxNumberOfTrainingJobs) اور 5 ایک ساتھ ملازمتیں (MaxParallelTrainingJobs) ایک وقت میں.

۔ ParameterRanges آبجیکٹ ہائپر پیرامیٹر کی حدود کو بتاتا ہے جو یہ ٹیوننگ جاب تلاش کرتا ہے۔ ہم نام کے ساتھ ساتھ تلاش کرنے کے لیے ہائپر پیرامیٹر کی کم از کم اور زیادہ سے زیادہ قدر بھی بتاتے ہیں۔ اس مثال میں، ہم مسلسل اور انٹیجر پیرامیٹر رینجز کے لیے کم از کم اور زیادہ سے زیادہ اقدار اور ہائپر پیرامیٹر کے نام ("eta"، "max_depth") کی وضاحت کرتے ہیں۔

AmtTuningJobConfig={

"Strategy": "Random",

"ResourceLimits": {

"MaxNumberOfTrainingJobs": 10,

"MaxParallelTrainingJobs": 5

},

"HyperParameterTuningJobObjective": {

"MetricName": "validation:rmse",

"Type": "Minimize"

},

"ParameterRanges": {

"CategoricalParameterRanges": [],

"ContinuousParameterRanges": [

{

"MaxValue": "1",

"MinValue": "0",

"Name": "eta"

}

],

"IntegerParameterRanges": [

{

"MaxValue": "6",

"MinValue": "2",

"Name": "max_depth"

}

]

}

}

تربیتی ملازمت کے پیرامیٹرز کی وضاحت کریں۔

تربیتی ملازمت کی تعریف میں، ہم اس الگورتھم کا استعمال کرتے ہوئے تربیتی جاب کو چلانے کے لیے درکار ان پٹ کی وضاحت کرتے ہیں جسے ہم بیان کرتے ہیں۔ تربیت مکمل ہونے کے بعد، SageMaker نتیجے میں آنے والے ماڈل کے نمونے ایک میں محفوظ کرتا ہے۔ ایمیزون سادہ اسٹوریج سروس (ایمیزون S3) وہ مقام جو آپ بتاتے ہیں۔

پہلے، ہم نے مثال کی قسم، گنتی، اور حجم کا سائز کے تحت بیان کیا تھا۔ ResourceConfig پیرامیٹر جب اس پیرامیٹر کے تحت مثال دستیاب نہیں تھی، ایک ناکافی صلاحیت کی خرابی (ICE) پھینک دی گئی تھی۔

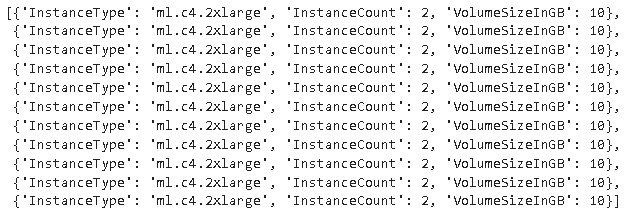

اس سے بچنے کے لیے، اب ہمارے پاس ہے۔ HyperParameterTuningResourceConfig کے تحت پیرامیٹر TrainingJobDefinition، جہاں ہم ان مثالوں کی فہرست بتاتے ہیں جن پر واپس آنا ہے۔ ان مثالوں کی شکل ویسا ہی ہے۔ ResourceConfig. یہ کام دستیاب مثال کی ترتیب کو تلاش کرنے کے لیے فہرست کو اوپر سے نیچے تک لے جائے گا۔ اگر کوئی مثال دستیاب نہیں ہے، تو ناکافی صلاحیت کی خرابی (ICE) کے بجائے، فہرست میں اگلی مثال کا انتخاب کیا جاتا ہے، اس طرح ICE پر قابو پا لیا جاتا ہے۔

TrainingJobDefinition={

"HyperParameterTuningResourceConfig": {

"InstanceConfigs": [

{

"InstanceType": "ml.m4.xlarge",

"InstanceCount": 1,

"VolumeSizeInGB": 5

},

{

"InstanceType": "ml.m5.4xlarge",

"InstanceCount": 1,

"VolumeSizeInGB": 5

}

]

},

"AlgorithmSpecification": {

"TrainingImage": "433757028032.dkr.ecr.us-west-2.amazonaws.com/xgboost:latest",

"TrainingInputMode": "File"

},

"InputDataConfig": [

{

"ChannelName": "train",

"CompressionType": "None",

"ContentType": "json",

"DataSource": {

"S3DataSource": {

"S3DataDistributionType": "FullyReplicated",

"S3DataType": "S3Prefix",

"S3Uri": "s3://<bucket>/test/"

}

},

"RecordWrapperType": "None"

}

],

"OutputDataConfig": {

"S3OutputPath": "s3://<bucket>/output/"

},

"RoleArn": "arn:aws:iam::340308762637:role/service-role/AmazonSageMaker-ExecutionRole-20201117T142856",

"StoppingCondition": {

"MaxRuntimeInSeconds": 259200

},

"StaticHyperParameters": {

"training_script_loc": "q2bn-sagemaker-test_6"

},

}

ہائپر پیرامیٹر ٹیوننگ جاب چلائیں۔

اس مرحلے میں، ہم اوپر بیان کردہ ہائپر پیرامیٹر ٹیوننگ ریسورس کنفیگریشن کے ساتھ ایک ہائپر پیرامیٹر ٹیوننگ جاب بنا اور چلا رہے ہیں۔

ہم سیج میکر کلائنٹ کو شروع کرتے ہیں اور ٹیوننگ کنفیگریشن، ٹریننگ جاب ڈیفینیشن، اور نوکری کا نام بتا کر جاب تخلیق کرتے ہیں۔

import boto3

sm = boto3.client('sagemaker')

sm.create_hyper_parameter_tuning_job(

HyperParameterTuningJobName="my-job-name",

HyperParameterTuningJobConfig=AmtTuningJobConfig,

TrainingJobDefinition=TrainingJobDefinition)

تربیتی ملازمتوں کی وضاحت کریں۔

مندرجہ ذیل فنکشن تجربے کے دوران استعمال ہونے والی تمام مثالوں کی اقسام کی فہرست دیتا ہے اور اس بات کی تصدیق کے لیے استعمال کیا جا سکتا ہے کہ آیا سیج میکر ٹریننگ مثال خود بخود وسائل کی تقسیم کے دوران فہرست میں اگلی مثال پر واپس آ گئی ہے۔

نتیجہ

اس پوسٹ میں، ہم نے دکھایا کہ اب آپ مثالوں کے ایک پول کی وضاحت کیسے کر سکتے ہیں جس پر آپ کا AMT تجربہ واپس آ سکتا ہے۔ InsufficientCapacityError. ہم نے دیکھا کہ ہائپر پیرامیٹر ٹیوننگ جاب کنفیگریشن کی وضاحت کیسے کی جائے، ساتھ ہی تربیتی ملازمتوں کی زیادہ سے زیادہ تعداد اور زیادہ سے زیادہ متوازی ملازمتیں بھی بتائیں۔ آخر میں، ہم نے دیکھا کہ کس طرح پر قابو پانا ہے۔ InsufficientCapacityError استعمال کرتے ہوئے HyperParameterTuningResourceConfig پیرامیٹر، جو تربیتی ملازمت کی تعریف کے تحت بیان کیا جا سکتا ہے۔

AMT کے بارے میں مزید جاننے کے لیے، ملاحظہ کریں۔ ایمیزون سیج میکر آٹومیٹک ماڈل ٹیوننگ.

مصنفین کے بارے میں

ڈوگ Mbaya ڈیٹا اور تجزیات پر توجہ کے ساتھ ایک سینئر پارٹنر سلوشن آرکیٹیکٹ ہے۔ Doug AWS پارٹنرز کے ساتھ مل کر کام کرتا ہے، ان کو کلاؤڈ میں ڈیٹا اور اینالیٹکس سلوشن کو مربوط کرنے میں مدد کرتا ہے۔

ڈوگ Mbaya ڈیٹا اور تجزیات پر توجہ کے ساتھ ایک سینئر پارٹنر سلوشن آرکیٹیکٹ ہے۔ Doug AWS پارٹنرز کے ساتھ مل کر کام کرتا ہے، ان کو کلاؤڈ میں ڈیٹا اور اینالیٹکس سلوشن کو مربوط کرنے میں مدد کرتا ہے۔

کروتھی جیاسمہا۔ راؤ Scale-PSA ٹیم میں ایک پارٹنر سلوشنز آرکیٹیکٹ ہے۔ کروتھی شراکت داروں کے لیے تکنیکی توثیق کرتی ہے تاکہ وہ پارٹنر پاتھ میں ترقی کر سکیں۔

کروتھی جیاسمہا۔ راؤ Scale-PSA ٹیم میں ایک پارٹنر سلوشنز آرکیٹیکٹ ہے۔ کروتھی شراکت داروں کے لیے تکنیکی توثیق کرتی ہے تاکہ وہ پارٹنر پاتھ میں ترقی کر سکیں۔

برنارڈ جولانز ایمیزون سیج میکر آٹومیٹک ماڈل ٹیوننگ کے لیے سافٹ ویئر ڈویلپمنٹ انجینئر ہے۔

برنارڈ جولانز ایمیزون سیج میکر آٹومیٹک ماڈل ٹیوننگ کے لیے سافٹ ویئر ڈویلپمنٹ انجینئر ہے۔

- AI

- ai آرٹ

- AI آرٹ جنریٹر

- عی روبوٹ

- ایمیزون مشین لرننگ

- ایمیزون سیج میکر

- مصنوعی ذہانت

- مصنوعی ذہانت کا سرٹیفیکیشن

- بینکنگ میں مصنوعی ذہانت

- مصنوعی ذہانت والا روبوٹ

- مصنوعی ذہانت والے روبوٹ

- مصنوعی ذہانت سافٹ ویئر

- AWS مشین لرننگ

- blockchain

- بلاکچین کانفرنس

- coingenius

- بات چیت مصنوعی ذہانت

- crypto کانفرنس ai

- dall-e

- گہری سیکھنے

- گوگل عی

- مشین لرننگ

- پلاٹا

- افلاطون اے

- افلاطون ڈیٹا انٹیلی جنس

- افلاطون گیم

- پلیٹو ڈیٹا

- پلیٹو گیمنگ

- پیمانہ ai

- نحو

- زیفیرنیٹ