حالیہ برسوں میں جنریٹو AI میں تیز رفتار پیش رفت کی بدولت بات چیت کے AI نے ایک طویل سفر طے کیا ہے، خاص طور پر تربیتی تکنیکوں کے ذریعے متعارف کرائے گئے بڑے لینگویج ماڈلز (LLMs) کی کارکردگی میں بہتری جیسے کہ انسٹرکشن فائن ٹیوننگ اور انسانی آراء سے کمک سیکھنا۔ جب صحیح طریقے سے اشارہ کیا جائے تو، یہ ماڈل بغیر کسی کام کے مخصوص تربیتی ڈیٹا کے مربوط گفتگو کر سکتے ہیں۔ تاہم، وہ انٹرپرائز سے متعلق مخصوص سوالات کو اچھی طرح سے عام نہیں کر سکتے ہیں کیونکہ، جواب پیدا کرنے کے لیے، وہ اس عوامی ڈیٹا پر انحصار کرتے ہیں جن کا انھیں پری ٹریننگ کے دوران سامنے آیا تھا۔ اس طرح کے اعداد و شمار میں اکثر جدید کاروباروں میں دستیاب اندرونی دستاویزات میں موجود خصوصی علم کی کمی ہوتی ہے، جس کی عام طور پر دواسازی کی تحقیق، مالی تحقیقات، اور کسٹمر سپورٹ جیسے ڈومینز میں درست جوابات حاصل کرنے کے لیے درکار ہوتے ہیں۔

ایسے AI معاونین کو بنانے کے لیے جو خصوصی انٹرپرائز علم پر بحث کرنے کے قابل ہوں، ہمیں ان طاقتور لیکن عام LLMs کو دستاویزات کے اندرونی علمی اڈوں سے جوڑنے کی ضرورت ہے۔ آپ کے داخلی ڈیٹا ذرائع سے حاصل کردہ معلومات کے ساتھ LLM جنریشن کے سیاق و سباق کو افزودہ کرنے کے اس طریقے کو Retrieval Augmented Generation (RAG) کہا جاتا ہے، اور اسسٹنٹ تیار کرتا ہے جو ڈومین کے لیے مخصوص اور زیادہ قابل اعتماد ہوتے ہیں، جیسا کہ دکھایا گیا ہے۔ علم پر مبنی این ایل پی ٹاسکس کے لیے بازیافت سے بڑھا ہوا جنریشن. RAG کی مقبولیت کے پیچھے ایک اور محرک اس کے نفاذ میں آسانی اور بالغ ویکٹر تلاش کے حل کا وجود ہے، جیسے کہ ان کے ذریعہ پیش کردہ ایمیزون کیندر (ملاحظہ کریں Amazon Kendra نے Retrieval API کا آغاز کیا۔) اور ایمیزون اوپن سرچ سروس (ملاحظہ کریں ایمیزون اوپن سرچ سروس میں k-قریب ترین پڑوسی (k-NN) تلاش کریں۔)، دوسروں کے درمیان.

تاہم، سیمنٹک تلاش کے ساتھ مقبول RAG ڈیزائن پیٹرن ہر قسم کے سوالات کا جواب نہیں دے سکتا جو دستاویزات پر ممکن ہیں۔ یہ خاص طور پر ان سوالات کے لیے درست ہے جن کے لیے متعدد دستاویزات میں تجزیاتی استدلال کی ضرورت ہوتی ہے۔ مثال کے طور پر، تصور کریں کہ آپ کسی سرمایہ کاری کمپنی کی اگلے سال کی حکمت عملی کی منصوبہ بندی کر رہے ہیں۔ ایک ضروری قدم امیدوار کمپنیوں کے مالی نتائج اور ممکنہ خطرات کا تجزیہ اور موازنہ کرنا ہوگا۔ اس کام میں تجزیاتی استدلال کے سوالات کا جواب دینا شامل ہے۔ مثال کے طور پر، استفسار "مجھے پچھلے 5 سالوں میں سب سے زیادہ آمدنی والی ٹاپ 2 کمپنیاں دیں اور ان کے اہم خطرات کی نشاندہی کریں" کے لیے استدلال کے متعدد مراحل درکار ہیں، جن میں سے کچھ سیمنٹک تلاش کی بازیافت کا استعمال کر سکتے ہیں، جب کہ دیگر کو تجزیاتی صلاحیتوں کی ضرورت ہوتی ہے۔

اس پوسٹ میں، ہم دکھاتے ہیں کہ تین حصوں میں تجزیاتی اور کثیر الجہتی استدلال کے سوالات کے جواب دینے کے قابل ایک ذہین دستاویز اسسٹنٹ کو کیسے ڈیزائن کیا جائے۔ حصہ 1 میں، ہم تجزیاتی سوالات پر RAG ڈیزائن پیٹرن اور اس کی حدود کا جائزہ لیتے ہیں۔ پھر ہم آپ کو ایک زیادہ ورسٹائل فن تعمیر سے متعارف کراتے ہیں جو ان حدود پر قابو پاتا ہے۔ حصہ 2 آپ کو سٹرکچرڈ ڈیٹا تیار کرنے کے لیے استعمال ہونے والی ہستی نکالنے والی پائپ لائن میں گہرائی میں جانے میں مدد کرتا ہے، جو کہ تجزیاتی سوالوں کے جوابات کے لیے ایک اہم جزو ہے۔ حصہ 3 آپ کو استعمال کرنے کا طریقہ بتاتا ہے۔ ایمیزون بیڈرک LLM اس ڈیٹا سے استفسار کرتے ہیں اور ایک LLM ایجنٹ بناتے ہیں جو RAG کو تجزیاتی صلاحیتوں کے ساتھ بڑھاتا ہے، اس طرح آپ کو ذہین دستاویزی معاون بنانے کے قابل بناتے ہیں جو متعدد دستاویزات میں پیچیدہ ڈومین سے متعلق سوالات کا جواب دے سکتے ہیں۔

حصہ 1: RAG کی حدود اور حل کا جائزہ

اس سیکشن میں، ہم RAG ڈیزائن پیٹرن کا جائزہ لیتے ہیں اور تجزیاتی سوالات پر اس کی حدود پر تبادلہ خیال کرتے ہیں۔ ہم ایک زیادہ ورسٹائل فن تعمیر بھی پیش کرتے ہیں جو ان حدود پر قابو پاتا ہے۔

RAG کا جائزہ

RAG کے حل سے متاثر ہیں۔ نمائندگی کی تعلیم اور اصطلاحی تلاش ایسے خیالات جو 2010 سے درجہ بندی کے مسائل (مثال کے طور پر سفارش اور تلاش) اور نیچرل لینگویج پروسیسنگ (NLP) کے کاموں میں بتدریج اپنائے گئے ہیں۔

آج استعمال ہونے والا مقبول طریقہ تین مراحل پر مشتمل ہے:

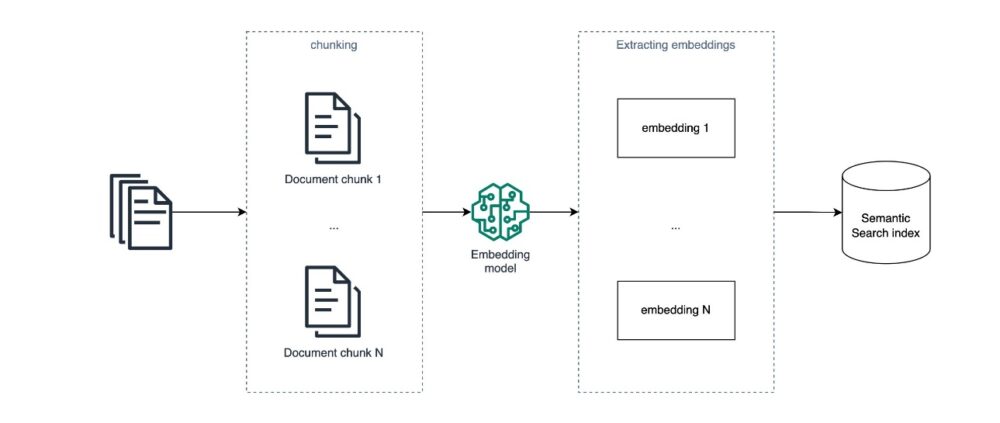

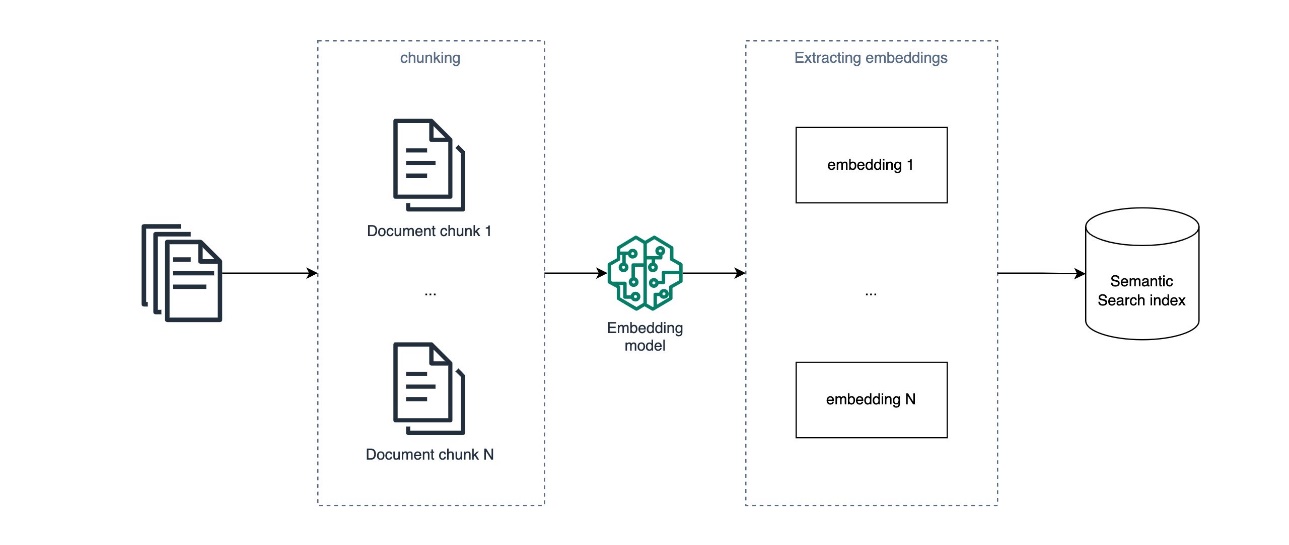

- ایک آف لائن بیچ پروسیسنگ جاب ان پٹ نالج بیس سے دستاویزات کو ہضم کرتی ہے، انہیں ٹکڑوں میں تقسیم کرتی ہے، پہلے سے تربیت یافتہ ایمبیڈنگ ماڈل کا استعمال کرتے ہوئے اس کے سیمنٹکس کی نمائندگی کرنے کے لیے ہر حصے کے لیے ایمبیڈنگ بناتی ہے، جیسے ایمیزون ٹائٹن ایمبیڈنگ ماڈلز، پھر ان ایمبیڈنگز کو ان پٹ کے بطور سیمنٹک سرچ انڈیکس بنانے کے لیے استعمال کرتا ہے۔

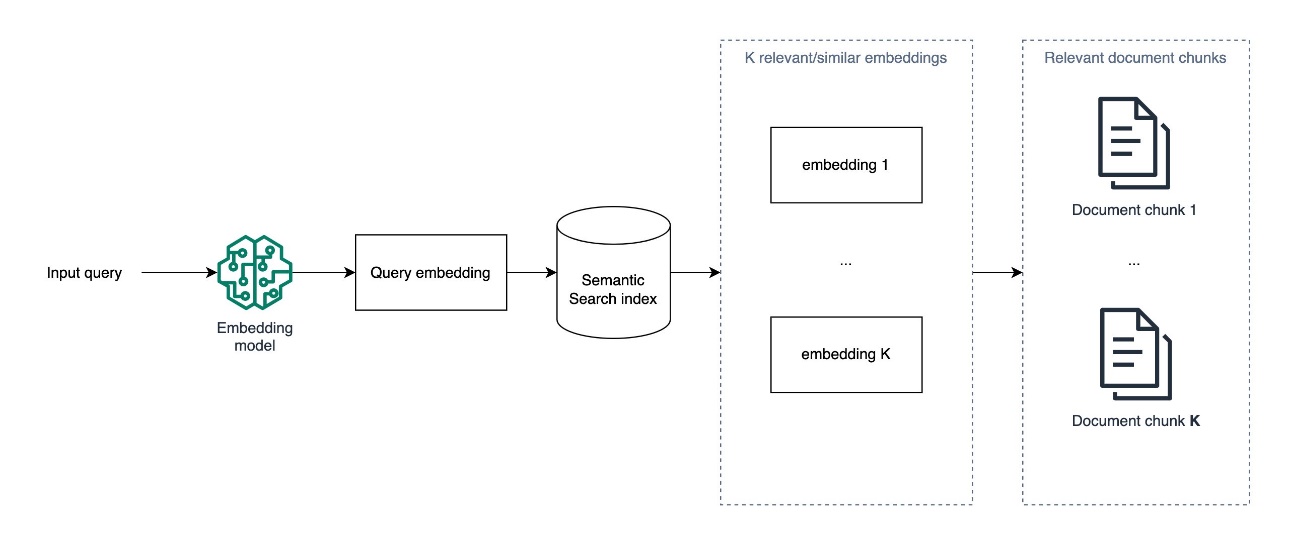

- ریئل ٹائم میں کسی نئے سوال کا جواب دیتے وقت، ان پٹ سوال کو ایمبیڈنگ میں تبدیل کر دیا جاتا ہے، جس کا استعمال مماثلت میٹرک، جیسے کوزائن مماثلت، اور قریب ترین پڑوسی الگورتھم کا استعمال کرتے ہوئے دستاویزات کے سب سے ملتے جلتے حصوں کو تلاش کرنے اور نکالنے کے لیے کیا جاتا ہے۔ میٹا ڈیٹا فلٹرنگ کے ساتھ تلاش کی درستگی کو بھی بہتر بنایا جا سکتا ہے۔

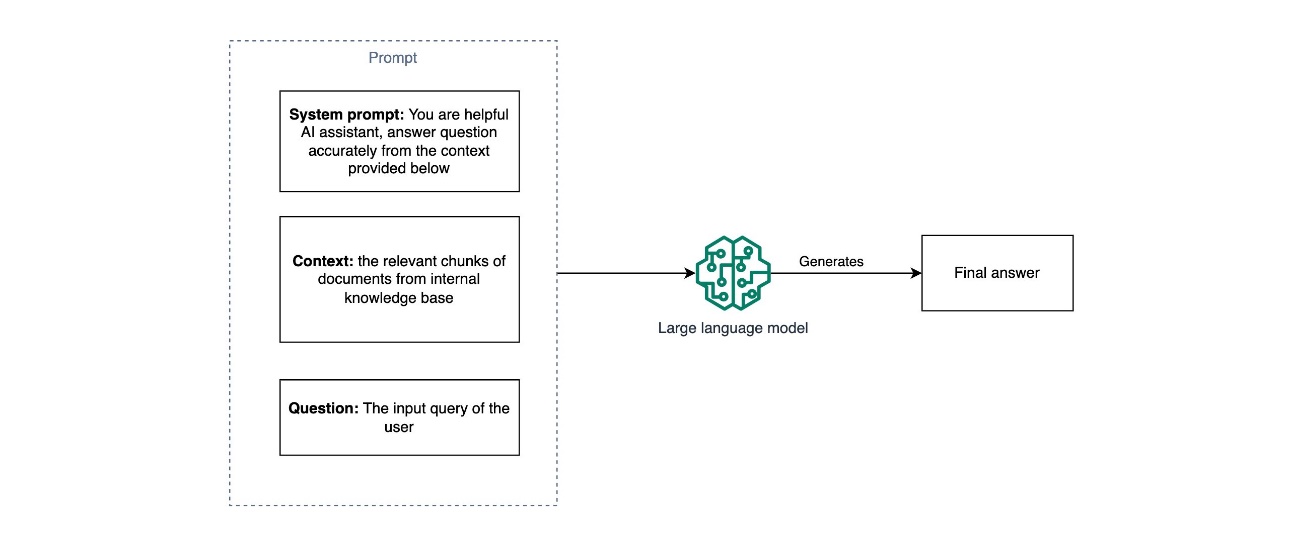

- ایک پرامپٹ ایک سیاق و سباق کے ساتھ سسٹم میسج کے کنکٹنیشن سے بنایا گیا ہے جو مرحلہ 2 میں نکالے گئے دستاویزات کے متعلقہ ٹکڑوں اور خود ان پٹ سوال سے بنتا ہے۔ اس پرامپٹ کو پھر سیاق و سباق سے سوال کا حتمی جواب تیار کرنے کے لیے LLM ماڈل کے سامنے پیش کیا جاتا ہے۔

صحیح بنیادی ایمبیڈنگ ماڈل کے ساتھ، ان پٹ دستاویز کے حصوں اور ان پٹ سوالات کی درست سیمینٹک نمائندگی پیدا کرنے کے قابل، اور ایک موثر سیمنٹک سرچ ماڈیول، یہ حل ایسے سوالات کا جواب دینے کے قابل ہے جن کے لیے دستاویزات کے ڈیٹا بیس میں موجود معلومات کی بازیافت کی ضرورت ہوتی ہے۔ مثال کے طور پر، اگر آپ کے پاس کوئی سروس یا کوئی پروڈکٹ ہے، تو آپ اس کے عمومی سوالنامہ کے سیکشن یا دستاویزات کو ترتیب دے کر شروع کر سکتے ہیں اور آپ کی مخصوص پیشکش کے مطابق ابتدائی بات چیت کا AI حاصل کر سکتے ہیں۔

سیمنٹک تلاش پر مبنی RAG کی حدود

اگرچہ RAG جدید ڈومین کے ساتھ مخصوص AI معاونین میں ایک لازمی جزو ہے اور ایک مخصوص علمی بنیاد کے ارد گرد بات چیت کی AI بنانے کے لیے ایک سمجھدار نقطہ آغاز ہے، لیکن یہ ان سوالوں کا جواب نہیں دے سکتا جن کے لیے آپ کے علم کی بنیاد میں موجود تمام دستاویزات میں اسکیننگ، موازنہ اور استدلال کی ضرورت ہوتی ہے۔ بیک وقت، خاص طور پر جب اضافہ مکمل طور پر معنوی تلاش پر مبنی ہو۔

ان حدود کو سمجھنے کے لیے، آئیے یہ فیصلہ کرنے کی مثال پر دوبارہ غور کریں کہ مالیاتی رپورٹس کی بنیاد پر کہاں سرمایہ کاری کرنی ہے۔ اگر ہم ان رپورٹس کے ساتھ بات چیت کرنے کے لیے RAG کا استعمال کریں، تو ہم سوالات پوچھ سکتے ہیں جیسے کہ "2022 میں کمپنی X کو کون سے خطرات کا سامنا کرنا پڑا،" یا "2022 میں کمپنی Y کی خالص آمدنی کیا ہے؟" ان سوالوں میں سے ہر ایک کے لیے، متعلقہ سرایت کرنے والا ویکٹر، جو سوال کے معنوی مفہوم کو انکوڈ کرتا ہے، سرچ انڈیکس میں دستیاب دستاویزات کے ٹاپ-K سیمینٹک طور پر ملتے جلتے ٹکڑوں کو بازیافت کرنے کے لیے استعمال کیا جاتا ہے۔ یہ عام طور پر قریب ترین پڑوسیوں کے حل جیسے کہ استعمال کرکے پورا کیا جاتا ہے۔ FAISS، NMSLIB، pgvector، یا دیگر، جو تسلی بخش درستگی کو برقرار رکھتے ہوئے حقیقی وقت کی کارکردگی کو حاصل کرنے کے لیے بازیافت کی رفتار اور واپسی کے درمیان توازن قائم کرنے کی کوشش کرتا ہے۔

تاہم، سابقہ نقطہ نظر تمام دستاویزات میں تجزیاتی سوالات کا درست جواب نہیں دے سکتا، جیسے کہ "5 میں سب سے زیادہ خالص آمدنی والی ٹاپ 2022 کمپنیاں کون سی ہیں؟"

اس کی وجہ یہ ہے کہ سیمنٹک تلاش کی بازیافت K کو ان پٹ سوال سے ملتے جلتے دستاویزات کے ٹکڑوں کو تلاش کرنے کی کوشش کرتی ہے۔ لیکن چونکہ کسی بھی دستاویز میں محصولات کے جامع خلاصے شامل نہیں ہیں، اس لیے یہ سب سے زیادہ آمدنی والی کمپنیوں پر توجہ مرکوز کرنے کی لازمی شرط کو پورا کیے بغیر دستاویزات کے ٹکڑوں کو واپس کرے گا جن میں محض "خالص آمدنی" اور ممکنہ طور پر "2022" کا ذکر ہے۔ اگر ہم ان پٹ سوال کا جواب دینے کے لیے سیاق و سباق کے طور پر LLM کے سامنے ان بازیافت کے نتائج پیش کرتے ہیں، تو یہ ایک گمراہ کن جواب تیار کر سکتا ہے یا جواب دینے سے انکار کر سکتا ہے، کیونکہ مطلوبہ درست معلومات غائب ہے۔

یہ حدود ڈیزائن کے لحاظ سے آتی ہیں کیونکہ سیمینٹک تلاش متعلقہ دستاویزات کو تلاش کرنے کے لیے تمام ایمبیڈنگ ویکٹرز کا مکمل اسکین نہیں کرتی ہے۔ اس کے بجائے، یہ مناسب بازیافت کی رفتار کو برقرار رکھنے کے لیے قریب ترین پڑوسی طریقے استعمال کرتا ہے۔ ان طریقوں میں کارکردگی کے لیے ایک اہم حکمت عملی اشاریہ سازی کے دوران سرایت کرنے کی جگہ کو گروہوں میں تقسیم کرنا ہے۔ یہ فوری طور پر شناخت کرنے کی اجازت دیتا ہے کہ کون سے گروپس جوڑے کے لحاظ سے موازنہ کی ضرورت کے بغیر، بازیافت کے دوران متعلقہ سرایت پر مشتمل ہوسکتے ہیں۔ مزید برآں، یہاں تک کہ روایتی قریبی پڑوسیوں کی تکنیک جیسے KNN، جو تمام دستاویزات کو اسکین کرتی ہیں، صرف بنیادی فاصلاتی میٹرکس کی گنتی کرتی ہیں اور تجزیاتی استدلال کے لیے درکار پیچیدہ موازنہ کے لیے موزوں نہیں ہیں۔ لہذا، سیمنٹک تلاش کے ساتھ RAG ان سوالات کے جوابات کے لیے موزوں نہیں ہے جس میں تمام دستاویزات میں تجزیاتی استدلال شامل ہو۔

ان حدود پر قابو پانے کے لیے، ہم ایک ایسا حل تجویز کرتے ہیں جو RAG کو میٹا ڈیٹا اور ہستی نکالنے، SQL استفسار، اور LLM ایجنٹوں کے ساتھ جوڑتا ہے، جیسا کہ درج ذیل حصوں میں بیان کیا گیا ہے۔

میٹا ڈیٹا، SQL، اور LLM ایجنٹوں کے ساتھ RAG کی حدود پر قابو پانا

آئیے ایک سوال کا مزید گہرائی سے جائزہ لیتے ہیں جس پر RAG ناکام ہو جاتا ہے، تاکہ ہم اس کا مؤثر جواب دینے کے لیے درکار استدلال کو تلاش کر سکیں۔ اس تجزیہ سے ہمیں صحیح نقطہ نظر کی طرف اشارہ کرنا چاہئے جو مجموعی حل میں RAG کی تکمیل کر سکتا ہے۔

سوال پر غور کریں: "5 میں سب سے زیادہ آمدنی والی ٹاپ 2022 کمپنیاں کون سی ہیں؟"

اس سوال کا جواب دینے کے لیے، ہمیں یہ کرنے کی ضرورت ہوگی:

- ہر کمپنی کی آمدنی کی شناخت کریں۔

- ان میں سے ہر ایک کے لیے 2022 کی آمدنی رکھنے کے لیے نیچے کو فلٹر کریں۔

- محصولات کو نزولی ترتیب میں ترتیب دیں۔

- کمپنی کے ناموں کے ساتھ سرفہرست 5 محصولات کو سلائس کریں۔

عام طور پر، یہ تجزیاتی کارروائیاں پانڈا یا ایس کیو ایل انجن جیسے ٹولز کا استعمال کرتے ہوئے ساختی ڈیٹا پر کی جاتی ہیں۔ اگر ہمیں کالموں پر مشتمل ایس کیو ایل ٹیبل تک رسائی حاصل ہوتی company, revenue، اور yearہم آسانی سے اپنے سوال کا جواب SQL استفسار چلا کر دے سکتے ہیں، جو درج ذیل مثال کی طرح ہے:

SELECT company, revenue FROM table_name WHERE year = 2022 ORDER BY revenue DESC LIMIT 5;ایس کیو ایل ٹیبل میں سٹرکچرڈ میٹا ڈیٹا کو اسٹور کرنا جس میں متعلقہ اداروں کے بارے میں معلومات ہوتی ہیں آپ کو درست SQL استفسار لکھ کر کئی قسم کے تجزیاتی سوالات کا جواب دینے کے قابل بناتا ہے۔ یہی وجہ ہے کہ ہم اپنے حل میں ایک ایس کیو ایل ٹیبل کے خلاف ریئل ٹائم ایس کیو ایل استفسار کرنے والے ماڈیول کے ساتھ RAG کی تکمیل کرتے ہیں، جو ایک آف لائن عمل میں نکالے گئے میٹا ڈیٹا سے بھرا ہوا ہے۔

لیکن ہم اس نقطہ نظر کو LLM پر مبنی بات چیت کے AI میں کیسے لاگو اور مربوط کر سکتے ہیں؟

ایس کیو ایل تجزیاتی استدلال کو شامل کرنے کے قابل ہونے کے لیے تین مراحل ہیں:

- میٹا ڈیٹا نکالنا - غیر ساختہ دستاویزات سے ایس کیو ایل ٹیبل میں میٹا ڈیٹا نکالیں۔

- ایس کیو ایل کو متن - LLM کا استعمال کرتے ہوئے درست طریقے سے ان پٹ سوالات سے SQL سوالات تیار کریں۔

- آلے کا انتخاب - شناخت کریں کہ آیا کسی سوال کا جواب RAG یا SQL استفسار کے ذریعے دینا ضروری ہے۔

ان اقدامات کو نافذ کرنے کے لیے، پہلے ہم تسلیم کرتے ہیں کہ غیر ساختہ دستاویزات سے معلومات نکالنا ایک روایتی NLP کام ہے جس کے لیے LLMs صفر شاٹ یا چند شاٹ لرننگ کے ذریعے اعلیٰ درستگی حاصل کرنے کا وعدہ ظاہر کرتے ہیں۔ دوسرا، قدرتی زبان سے ایس کیو ایل کے سوالات پیدا کرنے کے لیے ان ماڈلز کی صلاحیت برسوں سے ثابت ہو رہی ہے، جیسا کہ اس میں دیکھا گیا ہے۔ 2020 رہائی of Amazon QuickSight Q. آخر میں، کسی مخصوص سوال کے لیے خود بخود صحیح ٹول کا انتخاب صارف کے تجربے کو بڑھاتا ہے اور کثیر مرحلہ استدلال کے ذریعے پیچیدہ سوالات کے جوابات دینے کے قابل بناتا ہے۔ اس خصوصیت کو لاگو کرنے کے لیے، ہم بعد کے حصے میں LLM ایجنٹس کا جائزہ لیتے ہیں۔

خلاصہ کرنے کے لیے، ہم جو حل تجویز کرتے ہیں وہ درج ذیل بنیادی اجزاء پر مشتمل ہے:

- نسلی سیاق و سباق کو بڑھانے کے لیے معنوی تلاش کی بازیافت

- ایس کیو ایل کے ساتھ سٹرکچرڈ میٹا ڈیٹا نکالنا اور استفسار کرنا

- ایک ایجنٹ جو سوال کا جواب دینے کے لیے صحیح ٹولز استعمال کرنے کے قابل ہو۔

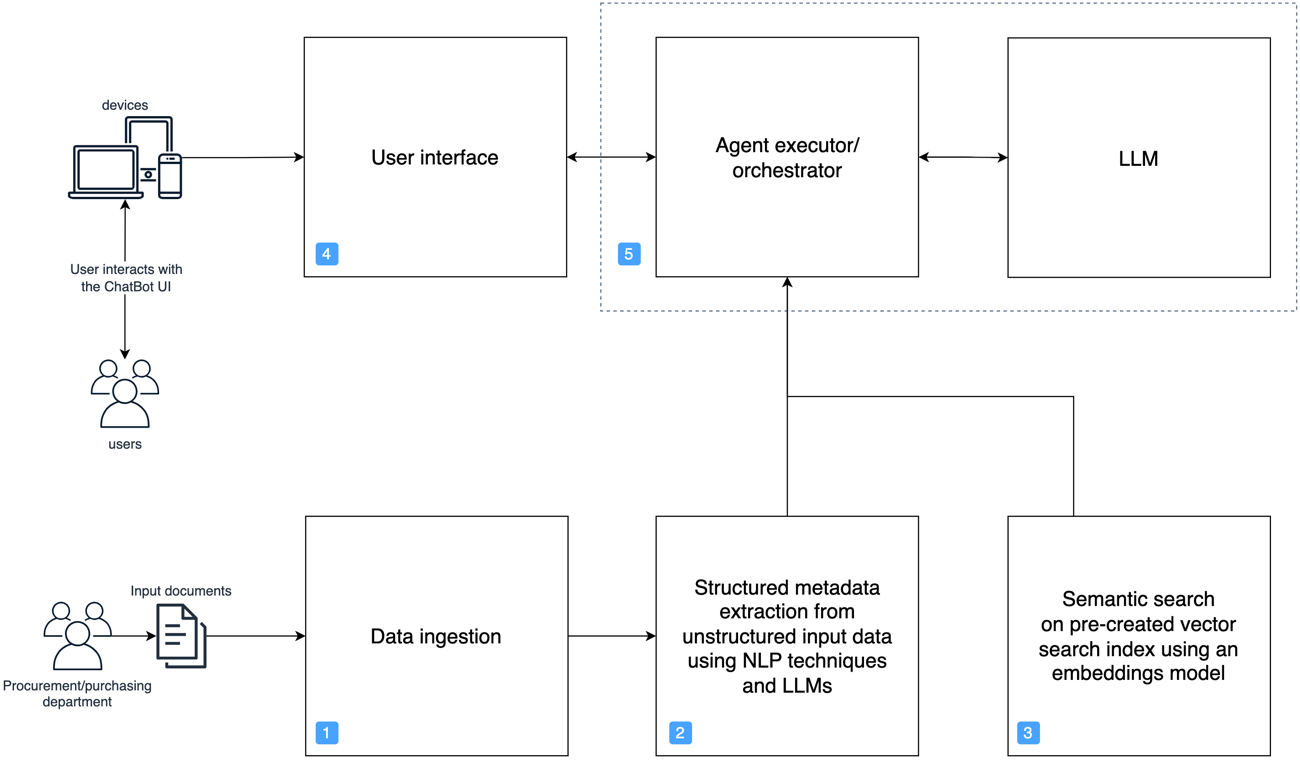

حل جائزہ

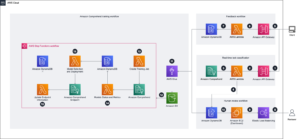

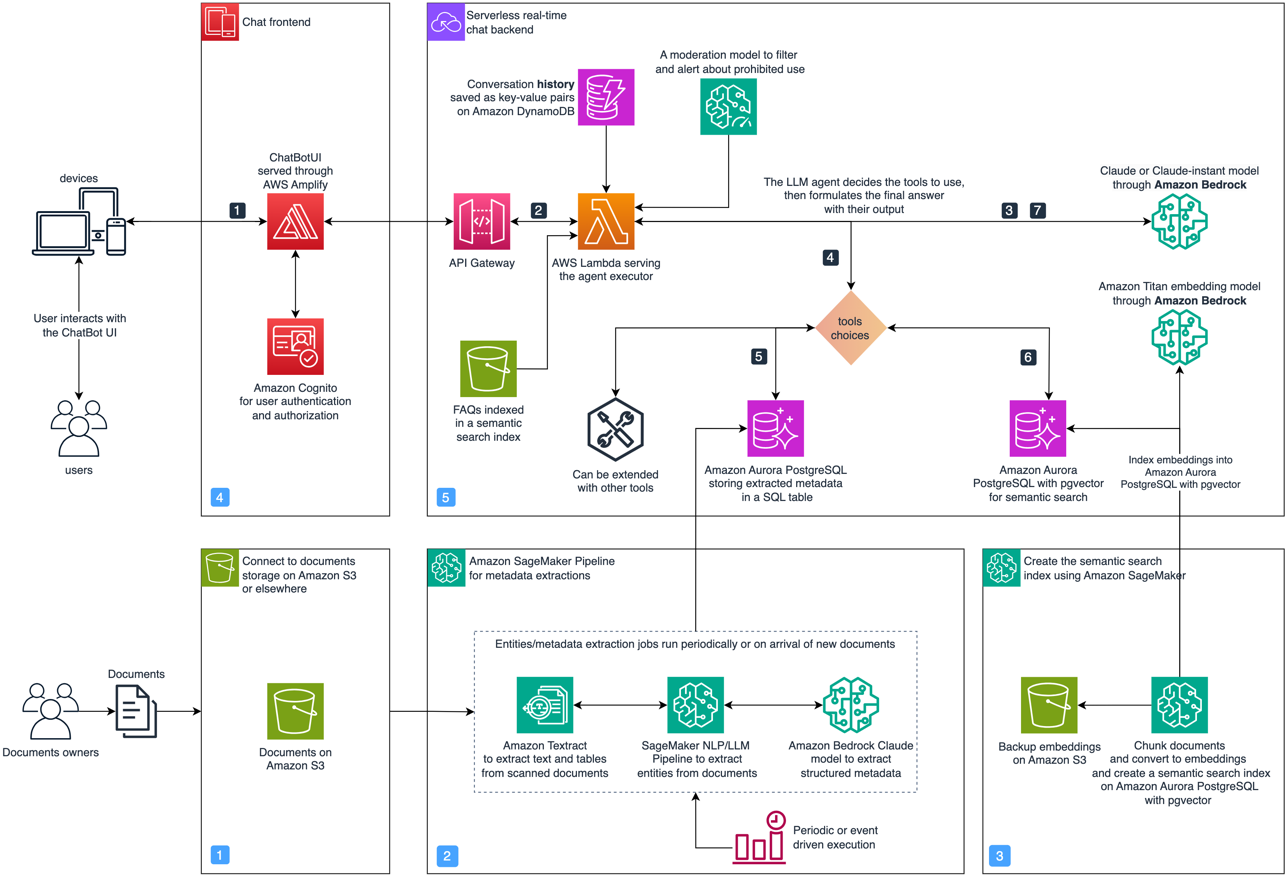

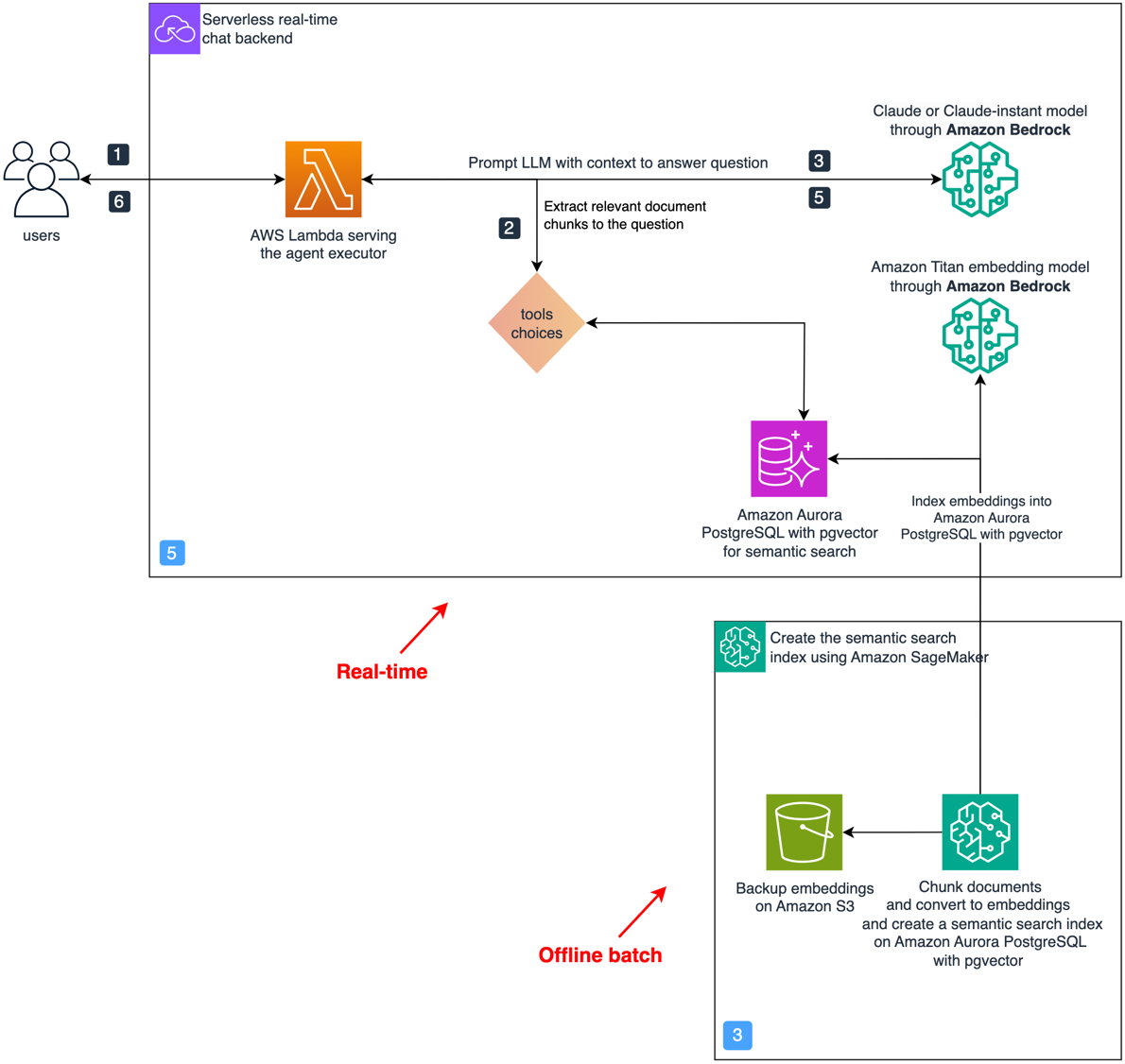

مندرجہ ذیل خاکہ میں حل کے ایک آسان فن تعمیر کو دکھایا گیا ہے۔ یہ آپ کو بنیادی اجزاء کے کردار کی شناخت اور سمجھنے میں مدد کرتا ہے اور یہ کہ وہ مکمل LLM- معاون رویے کو نافذ کرنے کے لیے کس طرح بات چیت کرتے ہیں۔ اس حل کو لاگو کرتے وقت نمبر کاری کی ترتیب کے مطابق ہوتی ہے۔

عملی طور پر، ہم نے اس حل کو لاگو کیا جیسا کہ مندرجہ ذیل تفصیلی فن تعمیر میں بیان کیا گیا ہے۔

اس فن تعمیر کے لیے، ہم پر عمل درآمد کی تجویز پیش کرتے ہیں۔ GitHub کے، ڈھیلے طور پر جوڑے ہوئے اجزاء کے ساتھ جہاں بیک اینڈ (5)، ڈیٹا پائپ لائنز (1، 2، 3) اور فرنٹ اینڈ (4) الگ الگ تیار ہوسکتے ہیں۔ یہ پیداوار کے حل کو اپنی مرضی کے مطابق اور بہتر بناتے وقت اہلیت کے درمیان تعاون کو آسان بنانا ہے۔

حل تعینات کریں۔

اپنے AWS اکاؤنٹ میں اس حل کو انسٹال کرنے کے لیے، درج ذیل مراحل کو مکمل کریں:

- کلون GitHub پر ذخیرہ.

- بیک اینڈ انسٹال کریں۔ AWS کلاؤڈ ڈویلپمنٹ کٹ (AWS CDK) اپلی کیشن:

- کھولو

backendفولڈر. - رن

npm installانحصار کو انسٹال کرنے کے لیے۔ - اگر آپ نے کرنٹ اکاؤنٹ اور ریجن میں AWS CDK کبھی استعمال نہیں کیا ہے تو چلائیں۔ بوٹسٹریپنگ ساتھ

npx cdk bootstrap. - رن

npx cdk deployاسٹیک کو تعینات کرنے کے لئے.

- کھولو

- اختیاری طور پر، چلائیں

streamlit-uiمندرجہ ذیل ہے:- ہم تجویز کرتے ہیں کہ اس ذخیرہ کو ایک میں کلون کریں۔ ایمیزون سیج میکر اسٹوڈیو ماحول مزید معلومات کے لیے رجوع کریں۔ فوری سیٹ اپ کا استعمال کرتے ہوئے ایمیزون سیج میکر ڈومین پر آن بورڈ.

- کے اندر

frontend/streamlit-uiفولڈر، چلائیںbash run-streamlit-ui.sh. - ڈیمو کھولنے کے لیے درج ذیل فارمیٹ کے ساتھ لنک کا انتخاب کریں:

https://{domain_id}.studio.{region}.sagemaker.aws/jupyter/default/proxy/{port_number}/.

- آخر میں، آپ چلا سکتے ہیں ایمیزون سیج میکر پائپ لائن میں وضاحت کی گئی ہے۔

data-pipelines/04-sagemaker-pipeline-for-documents-processing.ipynbان پٹ پی ڈی ایف دستاویزات پر کارروائی کرنے اور ایس کیو ایل ٹیبل اور ایل ایل ایم اسسٹنٹ کے ذریعہ استعمال کردہ سیمنٹک سرچ انڈیکس تیار کرنے کے لیے نوٹ بک۔

اس پوسٹ کے بقیہ حصے میں، ہم سب سے اہم اجزاء اور ڈیزائن کے انتخاب کی وضاحت کرنے پر توجہ مرکوز کرتے ہیں، امید ہے کہ اندرونی علم کی بنیاد پر اپنے AI اسسٹنٹ کو ڈیزائن کرتے وقت آپ کی حوصلہ افزائی ہو گی۔ ہم فرض کرتے ہیں کہ اجزاء 1 اور 4 سمجھنے کے لیے سیدھے ہیں، اور بنیادی اجزاء 2، 3 اور 5 پر توجہ مرکوز کرتے ہیں۔

حصہ 2: ہستی نکالنے کی پائپ لائن

اس سیکشن میں، ہم سٹرکچرڈ ڈیٹا تیار کرنے کے لیے استعمال ہونے والی ہستی نکالنے والی پائپ لائن میں گہرائی میں غوطہ لگاتے ہیں، جو کہ تجزیاتی سوالوں کے جوابات کے لیے ایک اہم جزو ہے۔

متن نکالنا

دستاویزات عام طور پر پی ڈی ایف فارمیٹ میں یا اسکین شدہ تصاویر کے طور پر محفوظ کی جاتی ہیں۔ وہ سادہ پیراگراف لے آؤٹ یا پیچیدہ جدولوں سے بن سکتے ہیں، اور ان میں ڈیجیٹل یا ہاتھ سے لکھا ہوا متن شامل ہے۔ معلومات کو صحیح طریقے سے نکالنے کے لیے، ہمیں ان خام دستاویزات کو ان کی اصل ساخت کو محفوظ رکھتے ہوئے سادہ متن میں تبدیل کرنے کی ضرورت ہے۔ ایسا کرنے کے لیے، آپ استعمال کر سکتے ہیں ایمیزون ٹیکسٹجو کہ ایک مشین لرننگ (ML) سروس ہے جو متن، ٹیبلز، اور ڈیجیٹل اور ہاتھ سے لکھے ہوئے ان پٹس سے فارم نکالنے کے لیے بالغ APIs فراہم کرتی ہے۔

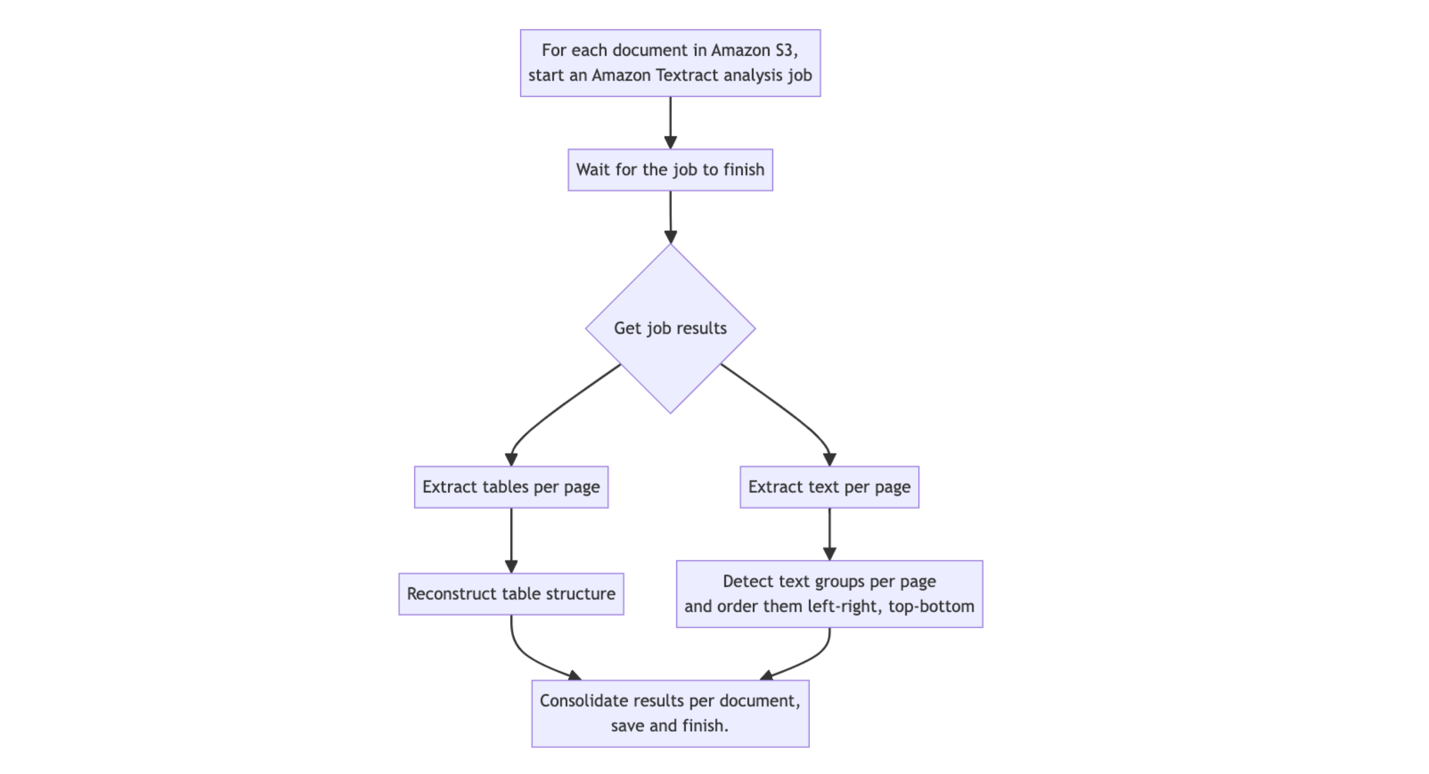

جزو 2 میں، ہم مندرجہ ذیل متن اور میزیں نکالتے ہیں:

- ہر دستاویز کے لیے، ہم متن اور میزیں نکالنے کے لیے Amazon Textract کہتے ہیں۔

- ہم مندرجہ ذیل استعمال کرتے ہیں۔ ازگر اسکرپٹ ٹیبلز کو پانڈا ڈیٹا فریمز کے طور پر دوبارہ بنانے کے لیے۔

- ہم نتائج کو ایک دستاویز میں یکجا کرتے ہیں اور میزیں بطور مارک ڈاؤن داخل کرتے ہیں۔

اس عمل کو مندرجہ ذیل بہاؤ ڈایاگرام کے ذریعے بیان کیا گیا ہے اور اس میں ٹھوس طریقے سے ظاہر کیا گیا ہے۔ notebooks/03-pdf-document-processing.ipynb.

LLMs کا استعمال کرتے ہوئے ہستی نکالنا اور استفسار کرنا

تجزیاتی سوالات کے مؤثر طریقے سے جواب دینے کے لیے، آپ کو متعلقہ میٹا ڈیٹا اور اداروں کو اپنے دستاویز کے علمی مرکز سے ایک قابل رسائی ساختی ڈیٹا فارمیٹ تک نکالنے کی ضرورت ہے۔ ہم تجویز کرتے ہیں کہ اس معلومات کو ذخیرہ کرنے کے لیے SQL کا استعمال کریں اور اس کی مقبولیت، استعمال میں آسانی، اور توسیع پذیری کی وجہ سے جوابات بازیافت کریں۔ یہ انتخاب قدرتی زبان سے SQL سوالات پیدا کرنے کی ثابت شدہ زبان کے ماڈلز کی صلاحیت سے بھی فائدہ اٹھاتا ہے۔

اس سیکشن میں، ہم درج ذیل اجزاء میں گہرائی میں ڈوبتے ہیں جو تجزیاتی سوالات کو قابل بناتے ہیں:

- ایک بیچ کا عمل جو LLMs کا استعمال کرتے ہوئے غیر ساختہ ڈیٹا سے سٹرکچرڈ ڈیٹا نکالتا ہے۔

- ایک حقیقی وقت کا ماڈیول جو قدرتی زبان کے سوالات کو SQL سوالات میں تبدیل کرتا ہے اور SQL ڈیٹا بیس سے نتائج حاصل کرتا ہے۔

آپ مندرجہ ذیل تجزیاتی سوالات کی حمایت کے لیے متعلقہ میٹا ڈیٹا نکال سکتے ہیں:

- آپ کو جو معلومات نکالنے کی ضرورت ہے اس کے لیے ایک JSON اسکیما کی وضاحت کریں، جس میں ہر فیلڈ اور اس کے ڈیٹا کی قسم کی تفصیل شامل ہو، اور متوقع قدروں کی مثالیں شامل ہوں۔

- ہر دستاویز کے لیے، JSON اسکیما کے ساتھ ایک LLM کا اشارہ کریں اور اس سے متعلقہ ڈیٹا کو درست طریقے سے نکالنے کے لیے کہیں۔

- جب دستاویز کی لمبائی سیاق و سباق کی لمبائی سے باہر ہو، اور LLMs کے ساتھ نکالنے کی لاگت کو کم کرنے کے لیے، آپ نکالنے کے دوران LLM کو دستاویزات کے متعلقہ حصوں کو بازیافت کرنے اور پیش کرنے کے لیے سیمنٹک تلاش کا استعمال کر سکتے ہیں۔

- JSON آؤٹ پٹ کو پارس کریں اور LLM نکالنے کی توثیق کریں۔

- اختیاری طور پر، Amazon S3 پر نتائج کو CSV فائلوں کے طور پر بیک اپ کریں۔

- بعد میں استفسار کے لیے SQL ڈیٹا بیس میں لوڈ کریں۔

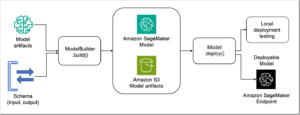

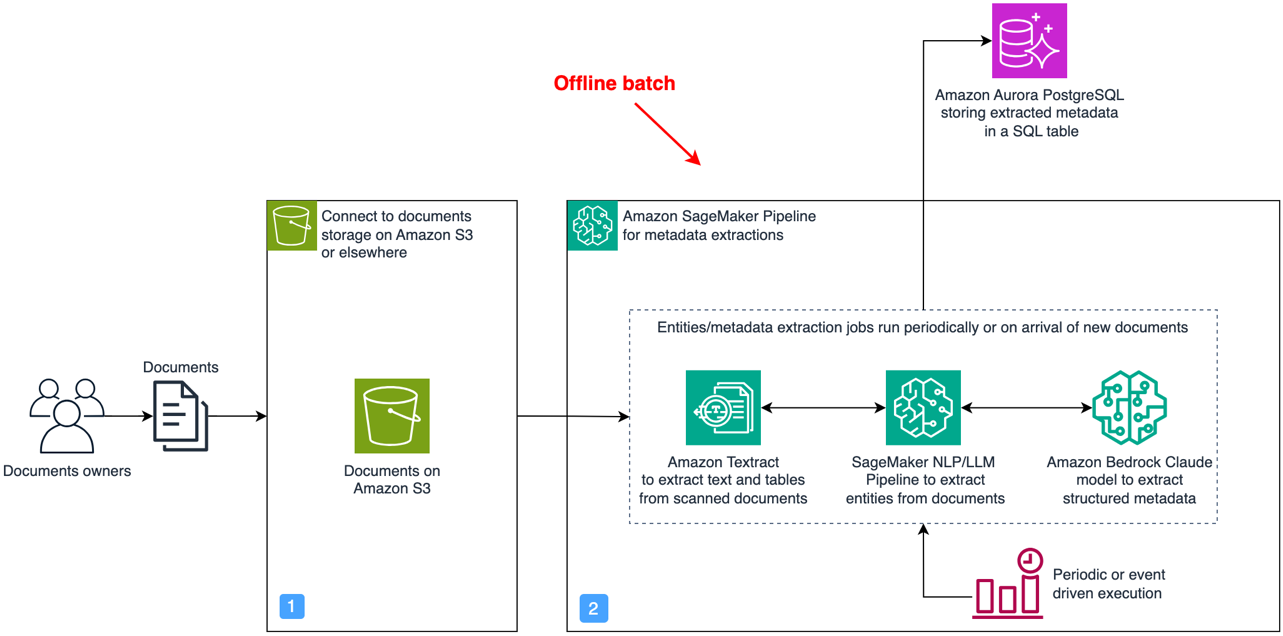

اس عمل کو درج ذیل فن تعمیر کے ذریعے منظم کیا جاتا ہے، جہاں ٹیکسٹ فارمیٹ میں موجود دستاویزات کو Python اسکرپٹ کے ساتھ لوڈ کیا جاتا ہے۔ ایمیزون سیج میکر پروسیسنگ نکالنے کا کام.

اداروں کے ہر گروپ کے لیے، ہم متحرک طور پر ایک پرامپٹ بناتے ہیں جس میں معلومات نکالنے کے کام کی واضح وضاحت شامل ہوتی ہے، اور اس میں ایک JSON اسکیما شامل ہوتا ہے جو متوقع آؤٹ پٹ کی وضاحت کرتا ہے اور متعلقہ دستاویز کے حصوں کو سیاق و سباق کے طور پر شامل کرتا ہے۔ ہم چند شاٹ لرننگ کے ساتھ نکالنے کی کارکردگی کو بہتر بنانے کے لیے ان پٹ اور درست آؤٹ پٹ کی چند مثالیں بھی شامل کرتے ہیں۔ میں اس کا مظاہرہ کیا گیا ہے۔ notebooks/05-entities-extraction-to-structured-metadata.ipynb.

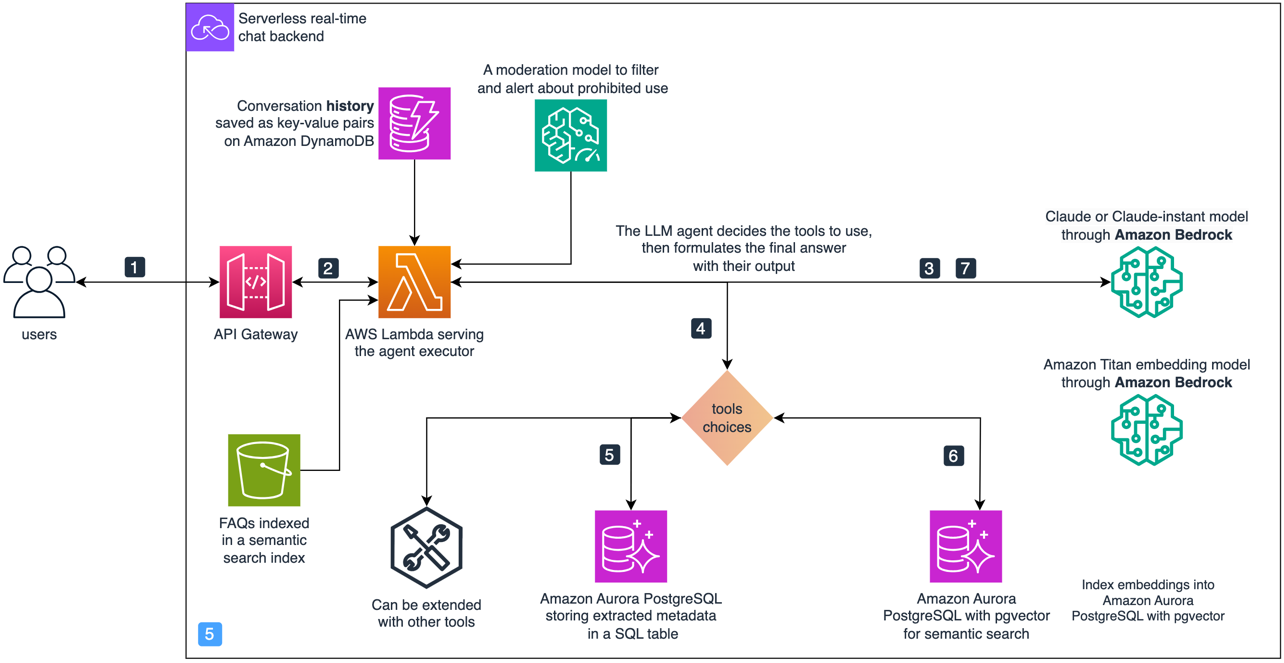

حصہ 3: Amazon Bedrock کے ساتھ ایک ایجنٹ دستاویز اسسٹنٹ بنائیں

اس سیکشن میں، ہم یہ ظاہر کرتے ہیں کہ ڈیٹا سے استفسار کرنے اور ایک LLM ایجنٹ بنانے کے لیے Amazon Bedrock LLMs کا استعمال کیسے کیا جائے جو تجزیاتی صلاحیتوں کے ساتھ RAG کو بہتر بناتا ہے، اس طرح آپ کو ذہین دستاویز معاون بنانے کے قابل بناتا ہے جو متعدد دستاویزات میں پیچیدہ ڈومین سے متعلق سوالات کا جواب دے سکتا ہے۔ آپ کا حوالہ دے سکتے ہیں۔ GitHub پر لیمبڈا فنکشن اس حصے میں بیان کردہ ایجنٹ اور ٹولز کے ٹھوس نفاذ کے لیے۔

ایس کیو ایل کے سوالات تیار کریں اور تجزیاتی سوالات کے جوابات دیں۔

اب جب کہ ہمارے پاس ایک منظم میٹا ڈیٹا اسٹور ہے جس میں متعلقہ اداروں کو نکالا گیا ہے اور ایس کیو ایل ڈیٹا بیس میں لوڈ کیا گیا ہے جس سے ہم استفسار کر سکتے ہیں، سوال جو باقی ہے وہ یہ ہے کہ ان پٹ قدرتی زبان کے سوالات سے صحیح SQL استفسار کیسے تیار کیا جائے؟

جدید ایل ایل ایم ایس کیو ایل بنانے میں اچھے ہیں۔ مثال کے طور پر، اگر آپ Anthropic Claude LLM سے درخواست کرتے ہیں۔ ایمیزون بیڈرک SQL استفسار پیدا کرنے کے لیے، آپ کو قابل فہم جوابات نظر آئیں گے۔ تاہم، زیادہ درست SQL سوالات تک پہنچنے کے لیے ہمیں پرامپٹ لکھتے وقت چند اصولوں کی پابندی کرنے کی ضرورت ہے۔ فریب اور نحو کی غلطیوں کو کم کرنے کے لیے پیچیدہ سوالات کے لیے یہ اصول خاص طور پر اہم ہیں:

- پرامپٹ کے اندر کام کو درست طریقے سے بیان کریں۔

- ٹیبل کے ہر کالم کو بیان کرتے ہوئے اور اس کے ڈیٹا کی قسم کی وضاحت کرتے ہوئے پرامپٹ کے اندر ایس کیو ایل ٹیبلز کا اسکیما شامل کریں۔

- واضح طور پر LLM سے کہو کہ صرف موجودہ کالم کے نام اور ڈیٹا کی قسمیں استعمال کریں۔

- ایس کیو ایل ٹیبلز کی چند قطاریں شامل کریں۔

آپ ایک کا استعمال کرتے ہوئے تیار کردہ ایس کیو ایل استفسار پر پوسٹ پروسیس بھی کرسکتے ہیں۔ linter جیسے sqlfluff فارمیٹنگ کو درست کرنے کے لیے، یا ایک تجزیہ کار جیسے sqlglot نحو کی غلطیوں کا پتہ لگانے اور استفسار کو بہتر بنانے کے لیے۔ مزید برآں، جب کارکردگی ضرورت کو پورا نہیں کرتی ہے، تو آپ زیادہ درست SQL سوالات پیدا کرنے کی طرف چند شاٹ لرننگ کے ساتھ ماڈل کو آگے بڑھانے کے لیے پرامپٹ کے اندر چند مثالیں فراہم کر سکتے ہیں۔

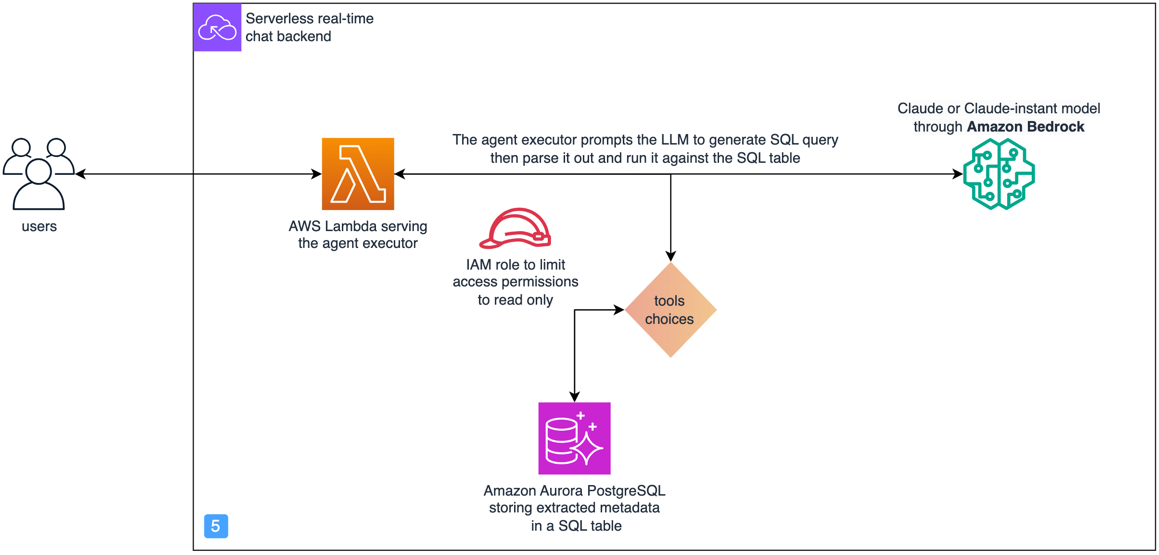

نفاذ کے نقطہ نظر سے، ہم ایک استعمال کرتے ہیں۔ او ڈبلیو ایس لامبڈا۔ مندرجہ ذیل عمل کو آرکیسٹریٹ کرنے کا فنکشن:

- متعلقہ SQL استفسار حاصل کرنے کے لیے ان پٹ سوال کے ساتھ Amazon Bedrock میں Anthropic Claude ماڈل کو کال کریں۔ یہاں، ہم استعمال کرتے ہیں ایس کیو ایل ڈیٹا بیس متعلقہ ایس کیو ایل ٹیبلز کی اسکیما وضاحتیں شامل کرنے اور حسب ضرورت پرامپٹ استعمال کرنے کے لیے LangChain سے کلاس کریں۔

- کے خلاف SQL استفسار کو پارس کریں، توثیق کریں اور چلائیں۔ Amazon Aurora PostgreSQL- ہم آہنگ ایڈیشن ڈیٹا بیس

حل کے اس حصے کے فن تعمیر کو مندرجہ ذیل خاکہ میں نمایاں کیا گیا ہے۔

ایس کیو ایل انجیکشن حملوں کو روکنے کے لیے حفاظتی تحفظات

جیسا کہ ہم AI اسسٹنٹ کو SQL ڈیٹا بیس سے استفسار کرنے کے قابل بناتے ہیں، ہمیں اس بات کو یقینی بنانا ہوگا کہ اس سے سیکیورٹی کی کمزوریاں متعارف نہیں ہوتی ہیں۔ اس کو حاصل کرنے کے لیے، ہم SQL انجیکشن حملوں کو روکنے کے لیے درج ذیل حفاظتی اقدامات تجویز کرتے ہیں:

- کم سے کم استحقاق والی IAM اجازتوں کا اطلاق کریں۔ - لیمبڈا فنکشن کی اجازت کو محدود کریں جو ایس کیو ایل کے سوالات کو استعمال کرتے ہوئے چلاتا ہے۔ AWS شناخت اور رسائی کا انتظام (IAM) کی پالیسی اور کردار جو اس کی پیروی کرتا ہے۔ کم از کم استحقاق کا اصول. اس صورت میں، ہم صرف پڑھنے کے لیے رسائی فراہم کرتے ہیں۔

- ڈیٹا تک رسائی کو محدود کریں۔ - معلومات کے افشاء کے حملوں کو روکنے کے لیے صرف کم از کم میزوں اور کالموں تک رسائی فراہم کریں۔

- ایک اعتدال پسند پرت شامل کریں۔ - ایک اعتدال پسند پرت متعارف کروائیں جو فوری طور پر انجیکشن کی کوششوں کا پتہ لگاتی ہے اور انہیں باقی سسٹم میں پھیلنے سے روکتی ہے۔ یہ اصول پر مبنی فلٹرز کی شکل اختیار کر سکتا ہے، معلوم پرامپٹ انجیکشن مثالوں کے ڈیٹا بیس کے خلاف مماثلت، یا ML درجہ بندی کر سکتا ہے۔

نسلی سیاق و سباق کو بڑھانے کے لیے معنوی تلاش کی بازیافت

ہم جو حل تجویز کرتے ہیں وہ جزو 3 میں سیمنٹک تلاش کے ساتھ RAG کا استعمال کرتا ہے۔ آپ اس ماڈیول کو استعمال کر کے لاگو کر سکتے ہیں۔ ایمیزون بیڈرک کے لیے علم کی بنیاد. مزید برآں، RAG کو لاگو کرنے کے لیے بہت سے دوسرے اختیارات ہیں، جیسے Amazon Kendra Retrieval API, ایمیزون اوپن سرچ ویکٹر ڈیٹا بیس، اور ایمیزون ارورہ پوسٹگری ایس کیو ایل پی جی ویکٹر کے ساتھ، دوسروں کے درمیان. اوپن سورس پیکیج aws-genai-llm-chatbot یہ ظاہر کرتا ہے کہ LLM سے چلنے والے چیٹ بوٹ کو لاگو کرنے کے لیے ان میں سے بہت سے ویکٹر تلاش کے اختیارات کو کیسے استعمال کیا جائے۔

اس حل میں، کیونکہ ہمیں SQL استفسار اور ویکٹر تلاش دونوں کی ضرورت ہے، ہم نے Amazon Aurora PostgreSQL کو اس کے ساتھ استعمال کرنے کا فیصلہ کیا۔ pgvector توسیع، جو دونوں خصوصیات کو سپورٹ کرتی ہے۔ لہذا، ہم مندرجہ ذیل فن تعمیر کے ساتھ سیمنٹک سرچ آر اے جی جزو کو نافذ کرتے ہیں۔

پچھلے فن تعمیر کا استعمال کرتے ہوئے سوالات کے جوابات دینے کا عمل دو اہم مراحل میں کیا جاتا ہے۔

سب سے پہلے، ایک آف لائن بیچ کا عمل، جو سیج میکر پروسیسنگ جاب کے طور پر چلتا ہے، مندرجہ ذیل سیمنٹک سرچ انڈیکس بناتا ہے:

- یا تو وقتاً فوقتاً، یا نئی دستاویزات موصول ہونے پر، سیج میکر جاب چلائی جاتی ہے۔

- یہ ایمیزون S3 سے ٹیکسٹ دستاویزات کو لوڈ کرتا ہے اور انہیں اوورلیپنگ ٹکڑوں میں تقسیم کرتا ہے۔

- ہر ایک حصے کے لیے، یہ ایمبیڈنگ ویکٹر بنانے کے لیے ایمیزون ٹائٹن ایمبیڈنگ ماڈل کا استعمال کرتا ہے۔

- یہ استعمال کرتا ہے۔ پی جی ویکٹر ایمبیڈنگز کو ان کے دستاویز کے ٹکڑوں اور میٹا ڈیٹا کے ساتھ Amazon Aurora PostgreSQL میں داخل کرنے کے لیے LangChain سے کلاس کریں اور تمام ایمبیڈنگ ویکٹرز پر ایک سیمنٹک سرچ انڈیکس بنائیں۔

دوسرا، حقیقی وقت میں اور ہر نئے سوال کے لیے، ہم مندرجہ ذیل جواب بناتے ہیں:

- سوال آرکیسٹریٹر کے ذریعہ موصول ہوا ہے جو لیمبڈا فنکشن پر چلتا ہے۔

- آرکیسٹریٹر اسی ایمبیڈنگ ماڈل کے ساتھ سوال کو سرایت کرتا ہے۔

- یہ PostgreSQL سیمنٹک سرچ انڈیکس سے ٹاپ-K سب سے زیادہ متعلقہ دستاویزات کے ٹکڑوں کو بازیافت کرتا ہے۔ یہ اختیاری طور پر درستگی کو بہتر بنانے کے لیے میٹا ڈیٹا فلٹرنگ کا استعمال کرتا ہے۔

- یہ ٹکڑے ان پٹ سوال کے ساتھ LLM پرامپٹ میں متحرک طور پر داخل کیے جاتے ہیں۔

- یہ اشارہ Amazon Bedrock پر Anthropic Claude کو پیش کیا گیا ہے، تاکہ اسے دستیاب سیاق و سباق کی بنیاد پر ان پٹ سوال کا جواب دینے کی ہدایت کی جائے۔

- آخر میں، تیار کردہ جواب آرکیسٹریٹر کو واپس بھیجا جاتا ہے۔

ایک ایجنٹ جو استدلال اور عمل کے لیے اوزار استعمال کرنے کے قابل ہو۔

اب تک اس پوسٹ میں، ہم نے ان سوالات کے علاج پر تبادلہ خیال کیا ہے جن کے لیے الگ الگ RAG یا تجزیاتی استدلال کی ضرورت ہوتی ہے۔ تاہم، بہت سے حقیقی دنیا کے سوالات حتمی جواب تک پہنچنے کے لیے، بعض اوقات استدلال کے متعدد مراحل پر، دونوں صلاحیتوں کا مطالبہ کرتے ہیں۔ ان پیچیدہ سوالات کی حمایت کرنے کے لیے، ہمیں ایجنٹ کے تصور کو متعارف کرانے کی ضرورت ہے۔

ایل ایل ایم ایجنٹس، جیسے ایمیزون بیڈرک کے ایجنٹ، حال ہی میں ایک امید افزا حل کے طور پر ابھرا ہے جو LLMs کو استدلال کرنے اور موجودہ سیاق و سباق کا استعمال کرتے ہوئے موافقت کرنے اور اختیارات کی فہرست میں سے مناسب اقدامات کا انتخاب کرنے کے قابل ہے، جو ایک عام مسئلہ حل کرنے کا فریم ورک پیش کرتا ہے۔ جیسا کہ میں زیر بحث آیا ایل ایل ایم سے چلنے والے خود مختار ایجنٹسLLM ایجنٹس کے لیے متعدد پرامپٹنگ حکمت عملی اور ڈیزائن پیٹرن ہیں جو پیچیدہ استدلال کی حمایت کرتے ہیں۔

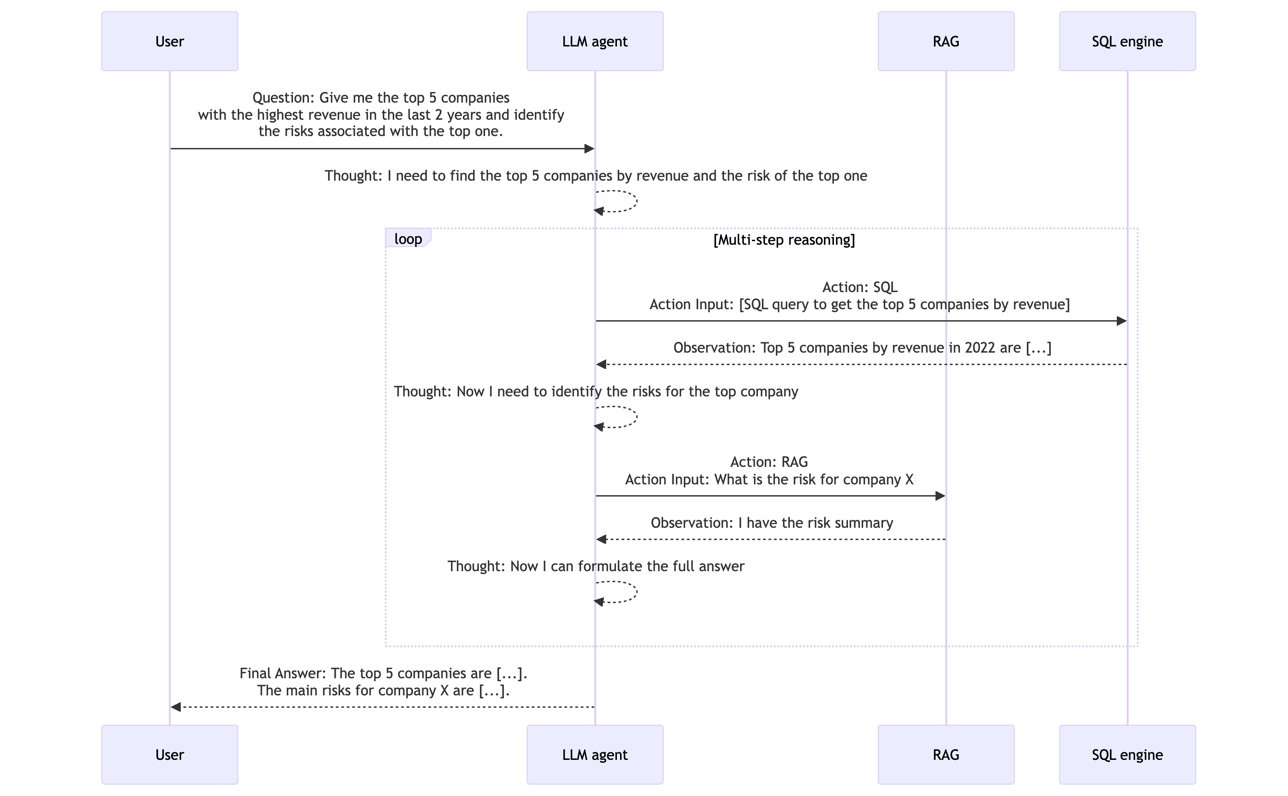

ایسا ہی ایک ڈیزائن پیٹرن Reason and Act (ReAct) ہے، جسے متعارف کرایا گیا ہے۔ رد عمل: زبان کے ماڈلز میں استدلال اور عمل کو ہم آہنگ کرنا. ReAct میں، ایجنٹ ان پٹ کے طور پر ایک مقصد لیتا ہے جو ایک سوال ہو سکتا ہے، اس کا جواب دینے کے لیے گمشدہ معلومات کے ٹکڑوں کی نشاندہی کرتا ہے، اور دستیاب ٹولز کی تفصیل کی بنیاد پر معلومات اکٹھا کرنے کے لیے بار بار صحیح ٹول تجویز کرتا ہے۔ دیئے گئے ٹول سے جواب حاصل کرنے کے بعد، LLM دوبارہ جائزہ لیتا ہے کہ آیا اس کے پاس وہ تمام معلومات موجود ہیں جن کی اسے سوال کا مکمل جواب دینے کی ضرورت ہے۔ اگر نہیں، تو یہ استدلال کا ایک اور مرحلہ کرتا ہے اور اسی یا دوسرے ٹول کو مزید معلومات اکٹھا کرنے کے لیے استعمال کرتا ہے، جب تک کہ کوئی حتمی جواب تیار نہ ہو جائے یا ایک حد تک پہنچ جائے۔

مندرجہ ذیل ترتیب کا خاکہ اس بات کی وضاحت کرتا ہے کہ ایک ReAct ایجنٹ سوال کا جواب دینے کے لیے کس طرح کام کرتا ہے "مجھے پچھلے 5 سالوں میں سب سے زیادہ آمدنی والی ٹاپ 2 کمپنیاں دیں اور ٹاپ کمپنی سے وابستہ خطرات کی نشاندہی کریں۔"

Python میں اس نقطہ نظر کو نافذ کرنے کی تفصیلات میں بیان کی گئی ہیں۔ کسٹم ایل ایل ایم ایجنٹ. ہمارے حل میں، ایجنٹ اور ٹولز کو مندرجہ ذیل نمایاں جزوی فن تعمیر کے ساتھ لاگو کیا جاتا ہے۔

ان پٹ سوال کا جواب دینے کے لیے، ہم AWS سروسز کو مندرجہ ذیل طور پر استعمال کرتے ہیں:

- ایک صارف اپنا سوال UI کے ذریعے داخل کرتا ہے، جو API کو کال کرتا ہے۔ ایمیزون API گیٹ وے.

- API گیٹ وے سوال کو لیمبڈا فنکشن کو بھیجتا ہے جو ایجنٹ ایگزیکیوٹر کو نافذ کرتا ہے۔

- ایجنٹ LLM کو ایک پرامپٹ کے ساتھ کال کرتا ہے جس میں دستیاب ٹولز کی تفصیل، ReAct انسٹرکشن فارمیٹ، اور ان پٹ سوال ہوتا ہے، اور پھر مکمل کرنے کے لیے اگلی کارروائی کو پارس کرتا ہے۔

- ایکشن میں شامل ہوتا ہے کہ کس ٹول کو کال کرنا ہے اور ایکشن ان پٹ کیا ہے۔

- اگر استعمال کرنے والا ٹول ایس کیو ایل ہے، تو ایجنٹ ایگزیکیوٹر سوال کو SQL میں تبدیل کرنے اور اسے چلانے کے لیے SQLQA کو کال کرتا ہے۔ پھر یہ نتیجہ کو پرامپٹ میں شامل کرتا ہے اور LLM کو دوبارہ کال کرتا ہے تاکہ یہ دیکھے کہ آیا یہ اصل سوال کا جواب دے سکتا ہے یا مزید کارروائیوں کی ضرورت ہے۔

- اسی طرح، اگر استعمال کرنے والا ٹول سیمنٹک سرچ ہے، تو ایکشن ان پٹ کو پارس آؤٹ کیا جاتا ہے اور PostgreSQL سیمنٹک سرچ انڈیکس سے بازیافت کرنے کے لیے استعمال کیا جاتا ہے۔ یہ نتائج کو پرامپٹ میں شامل کرتا ہے اور چیک کرتا ہے کہ آیا LLM جواب دینے کے قابل ہے یا اسے کسی اور کارروائی کی ضرورت ہے۔

- سوال کا جواب دینے کے لیے تمام معلومات دستیاب ہونے کے بعد، LLM ایجنٹ ایک حتمی جواب تیار کرتا ہے اور اسے صارف کو واپس بھیج دیتا ہے۔

آپ مزید ٹولز کے ساتھ ایجنٹ کو بڑھا سکتے ہیں۔ پر دستیاب نفاذ میں GitHub کے، ہم یہ ظاہر کرتے ہیں کہ آپ مذکورہ ایس کیو ایل انجن اور سیمنٹک سرچ ٹولز میں اضافی ٹولز کے طور پر سرچ انجن اور کیلکولیٹر کیسے شامل کر سکتے ہیں۔ جاری گفتگو کی سرگزشت کو ذخیرہ کرنے کے لیے، ہم ایک استعمال کرتے ہیں۔ ایمیزون ڈائنومو ڈی بی میز.

ہمارے اب تک کے تجربے سے، ہم نے دیکھا ہے کہ کامیاب ایجنٹ کی کلیدیں درج ذیل ہیں:

- ReAct فارمیٹ کے ساتھ استدلال کرنے کے قابل ایک بنیادی LLM

- دستیاب ٹولز کی واضح وضاحت، انہیں کب استعمال کرنا ہے، اور ممکنہ طور پر، ان پٹ اور متوقع آؤٹ پٹ کی ایک مثال کے ساتھ ان کے ان پٹ دلائل کی تفصیل

- ReAct فارمیٹ کا ایک واضح خاکہ جس کی LLM کو پیروی کرنی چاہیے۔

- کاروباری سوال کو حل کرنے کے لیے صحیح ٹولز LLM ایجنٹ کو استعمال کرنے کے لیے دستیاب ہیں۔

- LLM ایجنٹ کے جوابات سے آؤٹ پٹ کو درست طریقے سے پارس کرنا جیسا کہ اس کی وجہ ہے۔

لاگت کو بہتر بنانے کے لیے، ہم سب سے عام سوالات کو ان کے جوابات کے ساتھ کیش کرنے اور اس کیش کو وقتاً فوقتاً اپ ڈیٹ کرتے رہنے کی تجویز کرتے ہیں تاکہ بنیادی LLM پر کالز کو کم کیا جا سکے۔ مثال کے طور پر، آپ سب سے عام سوالات کے ساتھ ایک سیمینٹک سرچ انڈیکس بنا سکتے ہیں جیسا کہ پہلے بیان کیا گیا ہے، اور LLM کو کال کرنے سے پہلے انڈیکس کے خلاف نئے صارف کے سوال کو ملا سکتے ہیں۔ کیشنگ کے دیگر اختیارات کو دریافت کرنے کے لیے، رجوع کریں۔ ایل ایل ایم کیشنگ انضمام.

دوسرے فارمیٹس جیسے ویڈیو، امیج، آڈیو، اور 3D فائلوں کو سپورٹ کرنا

آپ ایک ہی حل کو مختلف قسم کی معلومات، جیسے کہ تصاویر، ویڈیوز، آڈیو، اور 3D ڈیزائن فائلوں جیسے CAD یا میش فائلوں پر لاگو کر سکتے ہیں۔ اس میں فائل کے مواد کو متن میں بیان کرنے کے لیے قائم کردہ ML تکنیکوں کا استعمال شامل ہے، جسے پھر اس حل میں داخل کیا جا سکتا ہے جسے ہم نے پہلے دریافت کیا تھا۔ یہ نقطہ نظر آپ کو ان متنوع ڈیٹا کی اقسام پر QA گفتگو کرنے کے قابل بناتا ہے۔ مثال کے طور پر، آپ تصاویر، ویڈیوز، یا آڈیو مواد کی متنی وضاحتیں بنا کر اپنے دستاویز کے ڈیٹا بیس کو بڑھا سکتے ہیں۔ آپ ان فارمیٹس کے اندر عناصر پر درجہ بندی یا آبجیکٹ کا پتہ لگانے کے ذریعے خصوصیات کی شناخت کرکے میٹا ڈیٹا ٹیبل کو بھی بڑھا سکتے ہیں۔ اس نکالے گئے ڈیٹا کو یا تو میٹا ڈیٹا اسٹور یا دستاویزات کے لیے سیمنٹک سرچ انڈیکس میں انڈیکس کرنے کے بعد، مجوزہ نظام کا مجموعی فن تعمیر بڑی حد تک مطابقت رکھتا ہے۔

نتیجہ

اس پوسٹ میں، ہم نے دکھایا کہ کس طرح RAG ڈیزائن پیٹرن کے ساتھ LLMs کا استعمال ڈومین کے لیے مخصوص AI اسسٹنٹ بنانے کے لیے ضروری ہے، لیکن کاروباری قدر پیدا کرنے کے لیے قابل اعتماد کی مطلوبہ سطح تک پہنچنے کے لیے ناکافی ہے۔ اس کی وجہ سے، ہم نے ایجنٹوں اور ٹولز کے تصورات کے ساتھ مقبول RAG ڈیزائن پیٹرن کو بڑھانے کی تجویز پیش کی، جہاں ٹولز کی لچک ہمیں روایتی NLP تکنیکوں اور جدید LLM دونوں صلاحیتوں کو استعمال کرنے کی اجازت دیتی ہے تاکہ ایک AI اسسٹنٹ کو مزید اختیارات کے ساتھ معلومات حاصل کرنے اور مدد کرنے کے قابل بنایا جا سکے۔ کاروباری مسائل کو مؤثر طریقے سے حل کرنے میں صارفین۔

حل ایک LLM اسسٹنٹ کی طرف ڈیزائن کے عمل کو ظاہر کرتا ہے جو آپ کے تمام علمی بنیادوں پر مختلف قسم کے بازیافت، تجزیاتی استدلال، اور کثیر مرحلہ استدلال کے سوالات کا جواب دینے کے قابل ہے۔ ہم نے سوالات اور کاموں کی قسموں سے پیچھے ہٹ کر سوچنے کی اہمیت کو بھی اجاگر کیا جن میں آپ کے LLM اسسٹنٹ سے صارفین کی مدد کی توقع کی جاتی ہے۔ اس معاملے میں، ڈیزائن کا سفر ہمیں تین اجزاء کے ساتھ ایک فن تعمیر کی طرف لے گیا: سیمنٹک سرچ، میٹا ڈیٹا نکالنا اور SQL استفسار، اور LLM ایجنٹ اور ٹولز، جو ہمارے خیال میں عام اور متعدد استعمال کے معاملات کے لیے کافی لچکدار ہیں۔ ہمیں یہ بھی یقین ہے کہ اس حل سے متاثر ہو کر اور اپنے صارفین کی ضروریات میں گہرائی میں ڈوب کر، آپ اس حل کو مزید اس طرف بڑھا سکیں گے جو آپ کے لیے بہترین کام کرتا ہے۔

مصنفین کے بارے میں

محمد علی جماوی۔ پروڈکشن مشین لرننگ میں 10 سال کے تجربے کے ساتھ ایک سینئر ایم ایل پروٹو ٹائپنگ آرکیٹیکٹ ہے۔ وہ مشین لرننگ اور سافٹ ویئر انجینئرنگ کے ساتھ کاروباری مسائل کو حل کرنے اور ML کے ساتھ کاروباری قدر نکالنے میں صارفین کی مدد کرنے سے لطف اندوز ہوتا ہے۔ AWS EMEA پروٹو ٹائپنگ اور کلاؤڈ انجینئرنگ کے حصے کے طور پر، وہ صارفین کو ایسے کاروباری حل تیار کرنے میں مدد کرتا ہے جو MLOPs، NLP، CV اور LLMs میں اختراعات کا فائدہ اٹھاتے ہیں۔

محمد علی جماوی۔ پروڈکشن مشین لرننگ میں 10 سال کے تجربے کے ساتھ ایک سینئر ایم ایل پروٹو ٹائپنگ آرکیٹیکٹ ہے۔ وہ مشین لرننگ اور سافٹ ویئر انجینئرنگ کے ساتھ کاروباری مسائل کو حل کرنے اور ML کے ساتھ کاروباری قدر نکالنے میں صارفین کی مدد کرنے سے لطف اندوز ہوتا ہے۔ AWS EMEA پروٹو ٹائپنگ اور کلاؤڈ انجینئرنگ کے حصے کے طور پر، وہ صارفین کو ایسے کاروباری حل تیار کرنے میں مدد کرتا ہے جو MLOPs، NLP، CV اور LLMs میں اختراعات کا فائدہ اٹھاتے ہیں۔

جیوسیپ ہینن ایک ProServe ایسوسی ایٹ کنسلٹنٹ ہے۔ Giuseppe اپنے صارفین کے لیے واضح اور موثر حل تیار کرنے کے لیے AI&ML کے ساتھ مل کر اپنی تجزیاتی مہارتوں کا اطلاق کرتا ہے۔ وہ پیچیدہ مسائل کے آسان حل کے ساتھ آنا پسند کرتا ہے، خاص طور پر وہ جن میں جدید ترین تکنیکی ترقی اور تحقیق شامل ہے۔

جیوسیپ ہینن ایک ProServe ایسوسی ایٹ کنسلٹنٹ ہے۔ Giuseppe اپنے صارفین کے لیے واضح اور موثر حل تیار کرنے کے لیے AI&ML کے ساتھ مل کر اپنی تجزیاتی مہارتوں کا اطلاق کرتا ہے۔ وہ پیچیدہ مسائل کے آسان حل کے ساتھ آنا پسند کرتا ہے، خاص طور پر وہ جن میں جدید ترین تکنیکی ترقی اور تحقیق شامل ہے۔

لارنس ٹین کیٹ ایک سینئر ڈیٹا سائنسدان ہے۔ Laurens EMEA میں انٹرپرائز صارفین کے ساتھ کام کرتا ہے جس سے انہیں AWS AI/ML ٹیکنالوجیز کا استعمال کرتے ہوئے اپنے کاروباری نتائج کو تیز کرنے میں مدد ملتی ہے۔ وہ NLP حل میں مہارت رکھتا ہے اور سپلائی چین اور لاجسٹک انڈسٹری پر توجہ مرکوز کرتا ہے۔ اپنے فارغ وقت میں وہ پڑھنے اور فن سے لطف اندوز ہوتا ہے۔

لارنس ٹین کیٹ ایک سینئر ڈیٹا سائنسدان ہے۔ Laurens EMEA میں انٹرپرائز صارفین کے ساتھ کام کرتا ہے جس سے انہیں AWS AI/ML ٹیکنالوجیز کا استعمال کرتے ہوئے اپنے کاروباری نتائج کو تیز کرنے میں مدد ملتی ہے۔ وہ NLP حل میں مہارت رکھتا ہے اور سپلائی چین اور لاجسٹک انڈسٹری پر توجہ مرکوز کرتا ہے۔ اپنے فارغ وقت میں وہ پڑھنے اور فن سے لطف اندوز ہوتا ہے۔

ارینا راڈو AWS EMEA پروٹو ٹائپنگ اور کلاؤڈ انجینئرنگ کا حصہ، ایک پروٹو ٹائپنگ انگیجمنٹ مینیجر ہے۔ وہ صارفین کو جدید ترین ٹیکنالوجی سے بہترین فائدہ اٹھانے، تیزی سے اختراع کرنے اور بڑا سوچنے میں مدد کر رہی ہے۔

ارینا راڈو AWS EMEA پروٹو ٹائپنگ اور کلاؤڈ انجینئرنگ کا حصہ، ایک پروٹو ٹائپنگ انگیجمنٹ مینیجر ہے۔ وہ صارفین کو جدید ترین ٹیکنالوجی سے بہترین فائدہ اٹھانے، تیزی سے اختراع کرنے اور بڑا سوچنے میں مدد کر رہی ہے۔

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹو ڈیٹا ڈاٹ نیٹ ورک ورٹیکل جنریٹو اے آئی۔ اپنے آپ کو بااختیار بنائیں۔ یہاں تک رسائی حاصل کریں۔

- پلیٹوآئ اسٹریم۔ ویب 3 انٹیلی جنس۔ علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- پلیٹو ای ایس جی۔ کاربن، کلین ٹیک، توانائی ، ماحولیات، شمسی، ویسٹ مینجمنٹ یہاں تک رسائی حاصل کریں۔

- پلیٹو ہیلتھ۔ بائیوٹیک اینڈ کلینیکل ٹرائلز انٹیلی جنس۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://aws.amazon.com/blogs/machine-learning/boosting-rag-based-intelligent-document-assistants-using-entity-extraction-sql-querying-and-agents-with-amazon-bedrock/

- : ہے

- : ہے

- : نہیں

- :کہاں

- $UP

- 1

- 10

- 100

- 2022

- 3d

- 7

- a

- کی صلاحیت

- قابلیت

- ہمارے بارے میں

- رفتار کو تیز تر

- تک رسائی حاصل

- قابل رسائی

- کامیاب

- اکاؤنٹ

- درستگی

- درست

- درست طریقے سے

- حاصل

- حصول

- کے پار

- ایکٹ

- اداکاری

- عمل

- اعمال

- اپنانے

- شامل کریں

- اس کے علاوہ

- جوڑتا ہے

- اپنایا

- کے بعد

- پھر

- کے خلاف

- ایجنٹ

- ایجنٹ

- AI

- اے آئی اسسٹنٹ

- AI / ML

- یلگورتم

- سیدھ میں لائیں

- تمام

- کی اجازت دیتا ہے

- شانہ بشانہ

- بھی

- ایمیزون

- ایمیزون سیج میکر

- ایمیزون ٹیکسٹ

- ایمیزون ویب سروسز

- کے درمیان

- an

- تجزیہ

- تجزیاتی

- تجزیے

- اور

- ایک اور

- جواب

- جواب

- بشری

- کوئی بھی

- اے پی آئی

- APIs

- لاگو ہوتا ہے

- کا اطلاق کریں

- نقطہ نظر

- مناسب

- تخمینہ

- فن تعمیر

- کیا

- دلائل

- ارد گرد

- فن

- AS

- پوچھنا

- مدد

- اسسٹنٹ

- اسسٹنٹ

- ایسوسی ایٹ

- منسلک

- فرض کرو

- At

- حملے

- کوششیں

- آڈیو

- اضافہ

- اضافہ

- ارورہ

- خود کار طریقے سے

- خود مختار

- دستیاب

- AWS

- واپس

- پسدید

- متوازن

- بیس

- کی بنیاد پر

- بنیادی

- BE

- کیونکہ

- رہا

- اس سے پہلے

- رویے

- پیچھے

- یقین ہے کہ

- فوائد

- BEST

- کے درمیان

- سے پرے

- بڑا

- اضافے کا باعث

- دونوں

- تعمیر

- عمارت

- کاروبار

- کاروبار

- لیکن

- by

- کیشے

- CAD

- فون

- کہا جاتا ہے

- بلا

- کالز

- کر سکتے ہیں

- امیدوار

- صلاحیتوں

- صلاحیت رکھتا

- لے جانے کے

- کیس

- مقدمات

- چین

- چیٹ بٹ

- چیک

- انتخاب

- انتخاب

- میں سے انتخاب کریں

- طبقے

- درجہ بندی

- واضح

- بادل

- مربوط

- تعاون

- کالم

- کالم

- مجموعہ

- یکجا

- کس طرح

- کامن

- کمپنیاں

- کمپنی کے

- موازنہ

- موازنہ

- موازنہ

- مکمل

- مکمل

- پیچیدہ

- پیچیدہ

- جزو

- اجزاء

- پر مشتمل

- وسیع

- کمپیوٹنگ

- تصورات

- ٹھوس

- شرط

- سلوک

- رابطہ قائم کریں

- غور کریں

- خیالات

- متواتر

- مضبوط

- تعمیر

- کنسلٹنٹ

- پر مشتمل ہے

- پر مشتمل ہے

- پر مشتمل ہے

- مواد

- سیاق و سباق

- بات چیت

- سنوادی

- بات چیت AI

- مکالمات

- تبدیل

- تبدیل

- کور

- درست

- صحیح طریقے سے

- اسی کے مطابق

- قیمت

- اخراجات

- سکتا ہے

- مل کر

- تخلیق

- پیدا

- تخلیق

- موجودہ

- اپنی مرضی کے

- گاہک

- کسٹمر سپورٹ

- گاہکوں

- اعداد و شمار

- ڈیٹا تک رسائی

- ڈیٹا سائنسدان

- ڈیٹا بیس

- فیصلہ کیا

- فیصلہ کرنا

- گہری

- گہرے

- کی وضاحت

- وضاحت کرتا ہے

- ڈیلے

- ڈیمانڈ

- ڈیمو

- مظاہرہ

- demonstrated,en

- ثبوت

- انحصار

- تعیناتی

- بیان

- بیان کیا

- بیان

- تفصیل

- ڈیزائن

- ڈیزائن پیٹرن

- ڈیزائن کا عمل

- ڈیزائننگ

- تفصیلی

- تفصیلات

- کا پتہ لگانے کے

- کھوج

- ترقی

- ترقی

- رفت

- ڈیجیٹل

- انکشاف

- بات چیت

- بات چیت

- بات چیت

- فاصلے

- ڈوبکی

- متنوع

- ڈائیونگ

- do

- دستاویز

- دستاویزات

- دستاویزات

- کرتا

- نہیں کرتا

- ڈومین

- ڈومینز

- کیا

- نیچے

- ڈرائیور

- دو

- کے دوران

- متحرک طور پر

- ہر ایک

- اس سے قبل

- ابتدائی

- کو کم

- استعمال میں آسانی

- آسانی سے

- موثر

- مؤثر طریقے

- کارکردگی

- ہنر

- مؤثر طریقے سے

- یا تو

- عناصر

- سرایت کرنا

- ای ایم ای اے

- ابھرتی ہوئی

- ملازم

- کو چالو کرنے کے

- کے قابل بناتا ہے

- کو فعال کرنا

- آخر

- مصروفیت

- انجن

- انجنیئرنگ

- انجن

- بڑھانے کے

- بڑھاتا ہے

- کافی

- افزودہ

- انٹرپرائز

- اداروں

- ہستی

- ماحولیات

- نقائص

- خاص طور پر

- ضروری

- قائم

- بھی

- تیار

- جانچ پڑتال

- مثال کے طور پر

- مثال کے طور پر

- وجود

- موجودہ

- توسیع

- توقع

- تجربہ

- وضاحت کی

- کی وضاحت

- بیان کرتا ہے

- تلاش

- وضاحت کی

- ظاہر

- توسیع

- توسیع

- مدت ملازمت میں توسیع

- اضافی

- نکالنے

- نکالنے

- نچوڑ۔

- سامنا

- ناکام رہتا ہے

- اکثر پوچھے جانے والے سوالات

- دور

- تیز تر

- نمایاں کریں

- خصوصیات

- آراء

- چند

- میدان

- فائل

- فائلوں

- فلٹرنگ

- فلٹر

- فائنل

- آخر

- مالی

- مل

- پہلا

- لچک

- لچکدار

- بہاؤ

- توجہ مرکوز

- توجہ مرکوز

- کے بعد

- مندرجہ ذیل ہے

- کے لئے

- فارم

- فارمیٹ

- تشکیل

- فارم

- فریم ورک

- مفت

- سے

- سامنے

- سامنے کے آخر میں

- پورا

- مکمل

- مکمل طور پر

- تقریب

- مزید

- گیٹ وے

- جمع

- جنرل

- پیدا

- پیدا

- پیدا کرنے والے

- نسل

- پیداواری

- پیداواری AI۔

- حاصل

- حاصل کرنے

- GitHub کے

- دی

- مقصد

- اچھا

- آہستہ آہستہ

- عطا

- گروپ

- گروپ کا

- تھا

- ہے

- ہونے

- he

- مدد

- مدد

- مدد کرتا ہے

- یہاں

- ہائی

- سب سے زیادہ

- روشنی ڈالی گئی

- ان

- تاریخ

- امید ہے کہ

- کس طرح

- کیسے

- تاہم

- HTML

- HTTPS

- انسانی

- خیالات

- شناخت

- شناخت

- کی نشاندہی

- شناختی

- if

- تصویر

- تصاویر

- تصور

- پر عملدرآمد

- نفاذ

- عملدرآمد

- پر عمل درآمد

- اہمیت

- اہم

- کو بہتر بنانے کے

- بہتر

- بہتری

- کو بہتر بنانے کے

- in

- شامل ہیں

- انڈکس

- انڈیکس شدہ

- صنعت

- معلومات

- معلومات نکالنا

- ابتدائی

- اختراعات

- بدعت

- ان پٹ

- آدانوں

- پریرتا

- حوصلہ افزائی

- متاثر

- انسٹال

- مثال کے طور پر

- کے بجائے

- ضم

- انٹیلجنٹ

- بات چیت

- اندرونی

- میں

- متعارف کرانے

- متعارف

- سرمایہ کاری

- تحقیقات

- سرمایہ کاری

- شامل

- IT

- میں

- خود

- ایوب

- سفر

- فوٹو

- JSON

- رکھیں

- کلیدی

- چابیاں

- علم

- جانا جاتا ہے

- زبان

- بڑے

- بڑے پیمانے پر

- آخری

- بعد

- تازہ ترین

- آغاز

- پرت

- سیکھنے

- کم سے کم

- قیادت

- لمبائی

- سطح

- لیوریج

- کی طرح

- LIMIT

- حدود

- LINK

- لنکڈ

- لسٹ

- ایل ایل ایم

- بوجھ

- لاجسٹکس

- لاجسٹکس انڈسٹری

- لانگ

- سے محبت کرتا ہے

- مشین

- مشین لرننگ

- بنا

- مین

- برقرار رکھنے کے

- برقرار رکھنے

- بنا

- میں کامیاب

- مینیجر

- بہت سے

- میچ

- کے ملاپ

- عقلمند و سمجھدار ہو

- مئی..

- me

- مطلب

- اقدامات

- سے ملو

- ذکر ہے

- محض

- میش

- پیغام

- میٹا ڈیٹا

- طریقہ

- طریقوں

- میٹرک۔

- پیمائش کا معیار

- کم سے کم

- گمراہ کرنا

- لاپتہ

- ML

- ایم ایل اوپس

- ماڈل

- ماڈل

- اعتدال پسند

- جدید

- ماڈیول

- زیادہ

- اس کے علاوہ

- سب سے زیادہ

- ایک سے زیادہ

- ضروری

- نام

- قدرتی

- قدرتی زبان عملیات

- ضروری

- ضرورت ہے

- ضرورت

- ضروریات

- پڑوسیوں

- خالص

- خالص آمدنی

- کبھی نہیں

- نئی

- اگلے

- ویزا

- کوئی بھی نہیں

- نوٹ بک

- تصور

- اعتراض

- آبجیکٹ کا پتہ لگانا

- of

- کی پیشکش کی

- کی پیشکش

- آف لائن

- اکثر

- on

- ایک

- جاری

- صرف

- کھول

- اوپن سورس

- آپریشنز

- کی اصلاح کریں

- آپشنز کے بھی

- or

- حکم

- اصل

- دیگر

- دیگر

- ہمارے

- باہر

- نتائج

- خاکہ

- بیان کیا

- پیداوار

- نتائج

- پر

- مجموعی طور پر

- پر قابو پانے

- خود

- پیکج

- pandas

- حصہ

- حصے

- پاٹرن

- پیٹرن

- انجام دیں

- کارکردگی

- اجازت

- نقطہ نظر

- دواسازی کی

- ٹکڑے ٹکڑے

- پائپ لائن

- سادہ

- منصوبہ بندی

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- مناسب

- پوائنٹ

- پالیسی

- مقبول

- مقبولیت

- آباد ہے

- ممکن

- ممکنہ طور پر

- پوسٹ

- پوسٹگریسقیل

- ممکنہ

- ممکنہ طور پر

- طاقت

- طاقتور

- پریکٹس

- صحت سے متعلق

- تیار

- حال (-)

- پیش

- تحفہ

- محفوظ کر رہا ہے

- کی روک تھام

- روکتا ہے

- پہلے

- استحقاق

- مسائل کو حل کرنے

- مسائل

- عمل

- پروسیسنگ

- پیدا کرتا ہے

- پیداوار

- مصنوعات

- پیداوار

- وعدہ

- وعدہ

- خصوصیات

- تجویز کریں

- مجوزہ

- تجویز کرتا ہے

- prototyping کے

- ثابت

- فراہم

- فراہم کرتا ہے

- عوامی

- ازگر

- سوال و جواب

- سوالات

- سوال

- سوالات

- فوری

- جلدی سے

- رینکنگ

- تیزی سے

- خام

- تک پہنچنے

- پہنچ گئی

- جواب دیں

- پڑھنا

- تیار

- اصلی

- حقیقی دنیا

- اصل وقت

- وجہ

- مناسب

- موصول

- وصول کرنا

- حال ہی میں

- حال ہی میں

- تسلیم

- سفارش

- سفارش

- کو کم

- کا حوالہ دیتے ہیں

- خطے

- متعلقہ

- وشوسنییتا

- انحصار کرو

- باقی

- رپورٹیں

- ذخیرہ

- کی نمائندگی

- درخواست

- کی ضرورت

- ضرورت

- ضرورت

- کی ضرورت ہے

- تحقیق

- جواب

- جوابات

- باقی

- نتیجہ

- نتائج کی نمائش

- واپسی

- آمدنی

- آمدنی

- کا جائزہ لینے کے

- ٹھیک ہے

- خطرات

- کردار

- قوانین

- رن

- چل رہا ہے

- چلتا ہے

- sagemaker

- اسی

- اسکیل ایبلٹی

- اسکین

- سکیننگ

- سائنسدان

- اسکرپٹ

- تلاش کریں

- تلاش کے انجن

- دوسری

- سیکشن

- سیکشنز

- سیکورٹی

- حفاظتی اقدامات

- دیکھنا

- طلب کرو

- دیکھا

- منتخب

- انتخاب

- سیمنٹ

- بھیجتا ہے

- سینئر

- بھیجا

- تسلسل

- سروس

- سروسز

- وہ

- ہونا چاہئے

- دکھائیں

- سے ظاہر ہوا

- دکھایا گیا

- اسی طرح

- سادہ

- آسان

- آسان بنانے

- بیک وقت

- بعد

- ایک

- مہارت

- So

- اب تک

- سافٹ ویئر کی

- سافٹ ویئر انجینئرنگ

- مکمل طور پر

- حل

- حل

- حل کرنا۔

- کچھ

- کبھی کبھی

- ماخذ

- ذرائع

- خلا

- خصوصی

- مہارت دیتا ہے

- مخصوص

- تیزی

- الگ ہوجاتا ہے

- ڈھیر لگانا

- مراحل

- شروع کریں

- شروع

- راستے پر لانا

- مرحلہ

- مراحل

- ذخیرہ

- ذخیرہ

- براہ راست

- حکمت عملیوں

- حکمت عملی

- ہڑتال

- کوشش کریں

- ساخت

- منظم

- سٹوڈیو

- کامیاب

- اس طرح

- مشورہ

- موزوں

- مختصر

- فراہمی

- فراہمی کا سلسلہ

- حمایت

- کی حمایت کرتا ہے

- اس بات کا یقین

- نحو

- کے نظام

- ٹیبل

- موزوں

- لے لو

- لیتا ہے

- ٹاسک

- کاموں

- ٹیک

- تکنیک

- تکنیکی

- ٹیکنالوجی

- بتا

- دس

- متن

- متنی

- شکریہ

- کہ

- ۔

- کے بارے میں معلومات

- ان

- ان

- تو

- وہاں.

- اس طرح

- لہذا

- یہ

- وہ

- لگتا ہے کہ

- سوچنا

- اس

- ان

- تین

- کے ذریعے

- وقت

- ٹائٹین

- کرنے کے لئے

- آج

- کے آلے

- اوزار

- سب سے اوپر

- اوپر 5

- کی طرف

- کی طرف

- ٹریس

- روایتی

- ٹریننگ

- تبدیل

- علاج

- سچ

- قابل اعتماد

- دو

- قسم

- اقسام

- عام طور پر

- ui

- بنیادی

- سمجھ

- جب تک

- اپ ڈیٹ

- صلی اللہ علیہ وسلم

- us

- استعمال کی شرائط

- استعمال کیا جاتا ہے

- رکن کا

- صارف کا تجربہ

- صارفین

- استعمال

- کا استعمال کرتے ہوئے

- تصدیق کریں۔

- قیمت

- اقدار

- مختلف اقسام کے

- مختلف

- ورسٹائل

- ویڈیو

- ویڈیوز

- نقصان دہ

- چلتا

- راستہ..

- we

- ویب

- ویب خدمات

- اچھا ہے

- تھے

- کیا

- جب

- جبکہ

- چاہے

- جس

- جبکہ

- کیوں

- وکیپیڈیا

- گے

- ساتھ

- کے اندر

- بغیر

- کام کرتا ہے

- گا

- تحریری طور پر

- X

- سال

- سال

- تم

- اور

- زیفیرنیٹ