کا جادو بانٹنے کے لیے ڈیل ای 2 ایک وسیع سامعین کے ساتھ، ہمیں طاقتور امیج جنریشن ماڈلز سے وابستہ خطرات کو کم کرنے کی ضرورت تھی۔ اس مقصد کے لئے، ہم نے مختلف ڈال دیا نگرانی تخلیق شدہ تصاویر کو ہماری خلاف ورزی سے روکنے کے لیے مواد کی پالیسی. اس پوسٹ پر فوکس کیا گیا ہے۔ تربیت سے پہلے کی تخفیف، ان گارڈریلز کا ایک ذیلی سیٹ جو براہ راست ڈیٹا میں ترمیم کرتا ہے جس سے DALL·E 2 سیکھتا ہے۔ خاص طور پر، DALL·E 2 کو انٹرنیٹ سے لاکھوں کیپشن والی تصاویر پر تربیت دی جاتی ہے، اور ہم ان تصاویر میں سے کچھ کو ہٹاتے ہیں اور اس کا وزن کرتے ہیں تاکہ ماڈل جو سیکھتا ہے اسے تبدیل کر سکے۔

اس پوسٹ کو تین حصوں میں ترتیب دیا گیا ہے، ہر ایک مختلف پری ٹریننگ تخفیف کو بیان کرتا ہے:

- پہلے حصے میں، ہم بیان کرتے ہیں کہ ہم نے کیسے DALL·E 2 کے تربیتی ڈیٹاسیٹ سے پرتشدد اور جنسی تصاویر کو فلٹر کیا۔ اس تخفیف کے بغیر، ماڈل گرافک یا واضح تصاویر تیار کرنا سیکھے گا جب ان کے لیے اشارہ کیا جائے گا، اور ہو سکتا ہے کہ بظاہر بے ضرر اشارے کے جواب میں ایسی تصاویر کو غیر ارادی طور پر واپس کر دیں۔

- دوسرے حصے میں، ہمیں معلوم ہوتا ہے کہ فلٹرنگ ٹریننگ ڈیٹا تعصبات کو بڑھا سکتا ہے، اور اس اثر کو کم کرنے کے لیے ہماری تکنیک کی وضاحت کرتا ہے۔ مثال کے طور پر، اس تخفیف کے بغیر، ہم نے دیکھا کہ فلٹر کردہ ڈیٹا پر تربیت یافتہ ماڈلز نے بعض اوقات مردوں کی تصویر کشی کرنے والی زیادہ تصاویر اور اصل ڈیٹاسیٹ پر تربیت یافتہ ماڈلز کے مقابلے خواتین کی کم تصاویر تخلیق کیں۔

- آخری حصے میں، ہم یادداشت کے مسئلے کی طرف رجوع کرتے ہیں، یہ معلوم کرتے ہیں کہ DALL·E 2 جیسے ماڈل بعض اوقات نئی تصاویر بنانے کے بجائے ان تصاویر کو دوبارہ پیش کر سکتے ہیں جن پر انہیں تربیت دی گئی تھی۔ عملی طور پر، ہم نے پایا کہ یہ تصویر کی بحالی ان تصاویر کی وجہ سے ہوتا ہے جو ڈیٹاسیٹ میں کئی بار نقل کی جاتی ہیں، اور ڈیٹاسیٹ میں موجود دیگر تصاویر سے بصری طور پر مشابہہ تصاویر کو ہٹا کر مسئلہ کو کم کریں۔

گرافک اور واضح تربیتی ڈیٹا کو کم کرنا

چونکہ تربیتی ڈیٹا کسی بھی سیکھے ہوئے ماڈل کی صلاحیتوں کو تشکیل دیتا ہے، اس لیے ڈیٹا فلٹرنگ ماڈل کی ناپسندیدہ صلاحیتوں کو محدود کرنے کے لیے ایک طاقتور ٹول ہے۔ ہم نے DALL·E 2 کو تربیت دینے سے پہلے ڈیٹاسیٹ سے باہر ان زمروں میں تصاویر کو فلٹر کرنے کے لیے کلاسیفائر کا استعمال کرتے ہوئے گرافک تشدد اور جنسی مواد کی عکاسی کرنے والی تصاویر کے لیے اس نقطہ نظر کا اطلاق کیا۔ ہمارے تربیت یافتہ ماڈل پر ڈیٹاسیٹ فلٹرنگ کے اثرات۔

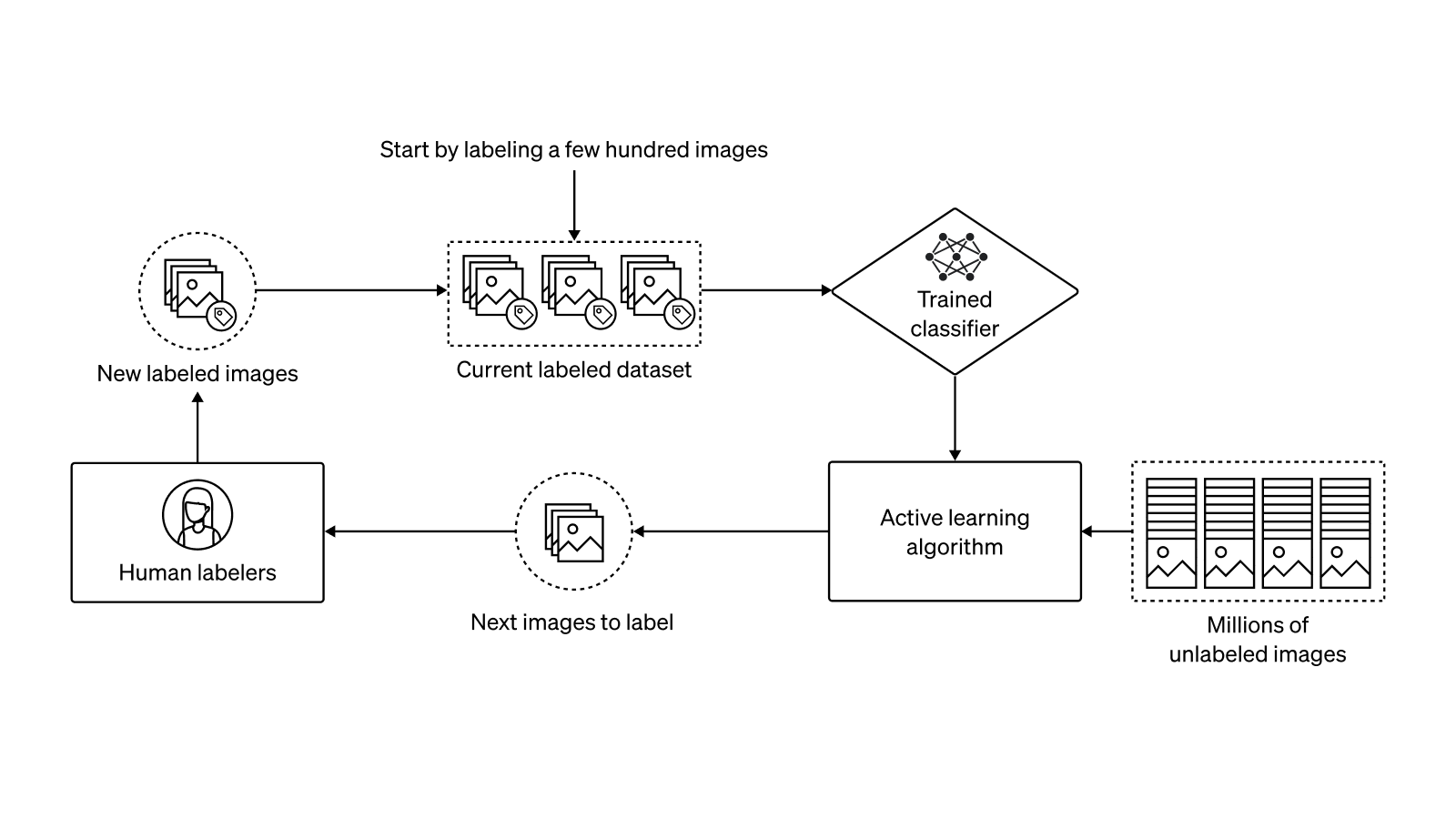

اپنے امیج کی درجہ بندی کرنے والوں کو تربیت دینے کے لیے، ہم نے ایک ایسا طریقہ دوبارہ استعمال کیا جسے ہم نے پہلے تربیتی ڈیٹا کو فلٹر کرنے کے لیے استعمال کیا تھا۔ سرکنا. اس نقطہ نظر کے بنیادی اقدامات درج ذیل ہیں: سب سے پہلے، ہم تصویر کے زمرہ جات کے لیے ایک تصریح بناتے ہیں جن پر ہم لیبل لگانا چاہتے ہیں۔ دوسرا، ہم ہر زمرے کے لیے چند سو مثبت اور منفی مثالیں جمع کرتے ہیں۔ تیسرا، ہم مزید ڈیٹا اکٹھا کرنے اور درستگی/ریکال ٹریڈ آف کو بہتر بنانے کے لیے سیکھنے کا ایک فعال طریقہ کار استعمال کرتے ہیں۔ اور آخر میں، ہم نتیجہ خیز درجہ بندی کو پورے ڈیٹاسیٹ پر ایک قدامت پسند درجہ بندی کی حد کے ساتھ چلاتے ہیں تاکہ درستگی سے زیادہ یاد کرنے کے حق میں ہوں۔ ان حدوں کو متعین کرنے کے لیے، ہم نے سبھی کو فلٹر کرنے کو ترجیح دی۔ بری تمام میں چھوڑنے پر ڈیٹا اچھا ڈیٹا اس کی وجہ یہ ہے کہ ہم اپنے ماڈل کو بعد میں مزید ڈیٹا کے ساتھ نئی چیزیں سکھانے کے لیے اسے ہمیشہ ٹھیک کر سکتے ہیں، لیکن ماڈل کو کسی ایسی چیز کو بھولنا بہت مشکل ہے جو اس نے پہلے ہی سیکھا ہے۔

فعال سیکھنے کے مرحلے کے دوران، ہم نے ممکنہ طور پر مشکل یا غلط درجہ بندی شدہ تصاویر کے لیے انسانی لیبل جمع کرکے اپنے درجہ بندی کو بار بار بہتر کیا۔ خاص طور پر، ہم نے اپنے ڈیٹاسیٹ سے تصاویر منتخب کرنے کے لیے دو فعال سیکھنے کی تکنیکوں کا استعمال کیا (جس میں لاکھوں بغیر لیبل والی تصاویر ہیں) لیبل لگانے کے لیے انسانوں کو پیش کرنے کے لیے۔ سب سے پہلے، اپنے درجہ بندی کرنے والے کی غلط مثبت شرح کو کم کرنے کے لیے (یعنی، وہ فریکوئنسی جس کے ساتھ یہ ایک سومی تصویر کو متشدد یا جنسی کے طور پر غلط درجہ بندی کرتا ہے)، ہم نے ان تصاویر کو انسانی لیبل تفویض کیے جنہیں موجودہ ماڈل نے مثبت کے طور پر درجہ بندی کیا ہے۔ اس قدم کو اچھی طرح سے کام کرنے کے لیے، ہم نے اپنی درجہ بندی کی حد کو تقریباً 100% یاد کرنے کے لیے بنایا لیکن ایک اعلی غلط مثبت شرح؛ اس طرح، ہمارے لیبلرز زیادہ تر واقعی منفی کیسوں پر لیبل لگا رہے تھے۔ اگرچہ یہ تکنیک غلط مثبت کو کم کرنے میں مدد کرتی ہے اور ممکنہ طور پر نقصان دہ تصاویر کو دیکھنے کے لیے لیبلرز کی ضرورت کو کم کرتی ہے، لیکن اس سے زیادہ مثبت کیسز تلاش کرنے میں مدد نہیں ملتی جو ماڈل فی الحال غائب ہے۔

اپنے درجہ بندی کی غلط منفی شرح کو کم کرنے کے لیے، ہم نے سیکھنے کی دوسری فعال تکنیک کا استعمال کیا: قریبی پڑوسی کی تلاش۔ خاص طور پر، ہم نے اپنے موجودہ لیبل والے ڈیٹاسیٹ میں مثبت نمونے تلاش کرنے کے لیے کئی گنا کراس توثیق کی جس کا ماڈل منفی کے طور پر غلط درجہ بندی کرنے کا رجحان رکھتا تھا (ایسا کرنے کے لیے، ہم نے لفظی طور پر درجہ بندی کے سینکڑوں ورژنز کو ٹرین کی توثیق کے مختلف حصوں کے ساتھ تربیت دی)۔ اس کے بعد ہم نے ان نمونوں کے قریب ترین پڑوسیوں کے لیے بغیر لیبل والی تصاویر کے اپنے بڑے ذخیرے کو ایک ادراک کی خصوصیت کی جگہ میں اسکین کیا، اور دریافت شدہ تصاویر پر انسانی لیبل تفویض کیے ہیں۔ ہمارے کمپیوٹ انفراسٹرکچر کی بدولت، درجہ بندی کی تربیت اور قریبی پڑوسی کی تلاش دونوں کو بہت سے GPUs تک بڑھانا معمولی بات تھی، جس سے سیکھنے کا فعال مرحلہ گھنٹوں یا دنوں کے بجائے کئی منٹوں میں ہوتا ہے۔

اپنے ڈیٹا فلٹرز کی تاثیر کی تصدیق کرنے کے لیے، ہم نے دو GLIDE ماڈلز کو ایک ہی ہائپر پیرامیٹر کے ساتھ تربیت دی: ایک غیر فلٹر شدہ ڈیٹا پر، اور دوسرا فلٹر کرنے کے بعد ڈیٹا سیٹ پر۔ ہم سابق ماڈل کے طور پر حوالہ دیتے ہیں غیر فلٹر شدہ ماڈل، اور مؤخر الذکر کے طور پر فلٹر شدہ ماڈل. جیسا کہ توقع کی گئی ہے، ہم نے پایا کہ غیر فلٹر شدہ ماڈل اس قسم کے مواد کی درخواستوں کے جواب میں عام طور پر کم واضح یا گرافک مواد تیار کرتا ہے۔ تاہم، ہمیں ڈیٹا فلٹرنگ کا ایک غیر متوقع ضمنی اثر بھی ملا: اس نے مخصوص آبادیات کی طرف ماڈل کے تعصبات کو تخلیق یا بڑھا دیا۔

ڈیٹا فلٹرز کے ذریعے متعارف کردہ تعصب کو درست کرنا

جنریٹیو ماڈلز ان کے تربیتی ڈیٹا کی تقسیم کو ملانے کی کوشش کرتے ہیں، بشمول اس میں کوئی بھی تعصب۔ نتیجے کے طور پر، تربیتی ڈیٹا کو فلٹر کرنے میں بہاو ماڈلز میں تعصب پیدا کرنے یا بڑھانے کی صلاحیت ہوتی ہے۔ عام طور پر، اصل ڈیٹاسیٹ میں تعصبات کو ٹھیک کرنا ایک مشکل سماجی تکنیکی کام ہے جس کا ہم مطالعہ کرتے رہتے ہیں، اور یہ اس پوسٹ کے دائرہ کار سے باہر ہے۔ ہم یہاں جس مسئلے کو حل کرتے ہیں وہ ہے تعصبات کو بڑھانا جو خاص طور پر ڈیٹا فلٹرنگ کی وجہ سے ہوتا ہے۔ ہمارے نقطہ نظر کے ساتھ، ہمارا مقصد فلٹر شدہ ماڈل کو ہونے سے روکنا ہے۔ زیادہ غیر فلٹر شدہ ماڈل سے متعصب، بنیادی طور پر ڈیٹا فلٹرنگ کی وجہ سے تقسیم کی تبدیلی کو کم کرتا ہے۔

فلٹرنگ کی وجہ سے تعصب کو بڑھاوا دینے کی ٹھوس مثال کے طور پر، پرامپٹ "a CEo" پر غور کریں۔ جب ہمارے غیر فلٹر شدہ ماڈل نے اس پرامپٹ کے لیے تصاویر تیار کیں، تو اس کا رجحان عورتوں کے مقابلے مردوں کی زیادہ تصاویر بنانے کا تھا، اور ہم توقع کرتے ہیں کہ اس تعصب کا زیادہ تر حصہ ہمارے موجودہ تربیتی ڈیٹا کا عکاس ہے۔ تاہم، جب ہم نے اپنے فلٹر شدہ ماڈل کے ذریعے اسی پرامپٹ کو چلایا، تو تعصب بڑھتا ہوا دکھائی دیا۔ نسلیں تقریباً صرف مردوں کی تصویریں تھیں۔

ہم یہ قیاس کرتے ہیں کہ تعصب بڑھانے کا یہ خاص معاملہ دو جگہوں سے آتا ہے: پہلا، یہاں تک کہ اگر اصل ڈیٹاسیٹ میں خواتین اور مردوں کی نمائندگی تقریباً مساوی ہے، ڈیٹا سیٹ خواتین کو زیادہ جنسی سیاق و سباق میں پیش کرنے کی طرف متعصب ہو سکتا ہے۔ اور دوسرا، ہمارے درجہ بندی کرنے والے خود یا تو نفاذ یا طبقاتی تعریف کی وجہ سے متعصب ہوسکتے ہیں، اس بات کو یقینی بنانے کی ہماری کوششوں کے باوجود کہ ڈیٹا اکٹھا کرنے اور تصدیق کے مراحل کے دوران ایسا نہیں تھا۔ ان دونوں اثرات کی وجہ سے، ہمارا فلٹر مردوں کے مقابلے خواتین کی زیادہ تصاویر کو ہٹا سکتا ہے، جس سے صنفی تناسب میں تبدیلی آتی ہے جس کا ماڈل تربیت میں مشاہدہ کرتا ہے۔

فلٹر کی حوصلہ افزائی کے تعصب کی مزید اچھی طرح سے چھان بین کرنے کے لیے، ہم یہ پیمائش کرنے کا ایک طریقہ چاہتے تھے کہ ہمارے ڈیٹا فلٹرز مختلف تصورات کی طرف تعصب کو کتنا متاثر کر رہے ہیں۔ خاص طور پر، ہمارے تشدد اور جنسی مواد کے فلٹرز مکمل طور پر تصویر پر مبنی ہیں، لیکن ہمارے ڈیٹاسیٹ کی ملٹی موڈل نوعیت ہمیں متن پر ان فلٹرز کے اثرات کی براہ راست پیمائش کرنے کی اجازت دیتی ہے۔ چونکہ ہر تصویر کے ساتھ ٹیکسٹ کیپشن ہوتا ہے، اس لیے ہم فلٹر شدہ اور غیر فلٹر شدہ ڈیٹاسیٹ میں ہاتھ سے منتخب کردہ مطلوبہ الفاظ کی نسبتہ تعدد کو دیکھنے کے قابل تھے تاکہ یہ اندازہ لگایا جا سکے کہ فلٹرز کسی بھی تصور کو کتنا متاثر کر رہے ہیں۔

اس کو عملی جامہ پہنانے کے لیے، ہم نے اپنے فلٹر شدہ اور غیر فلٹر شدہ ڈیٹا سیٹس کے تمام کیپشنز پر مٹھی بھر مطلوبہ الفاظ (مثلاً، "والدین"، "عورت"، "بچہ") کی تعدد کا حساب لگانے کے لیے اپاچی اسپارک کا استعمال کیا۔ اگرچہ ہمارے ڈیٹاسیٹ میں لاکھوں ٹیکسٹ امیج کے جوڑے ہیں، ان مطلوبہ الفاظ کی تعدد کو کمپیوٹنگ کرنے میں ہمارے کمپیوٹ کلسٹر کا استعمال کرتے ہوئے صرف چند منٹ لگے۔

مطلوبہ الفاظ کی تعدد کو کمپیوٹنگ کرنے کے بعد، ہم اس بات کی تصدیق کرنے میں کامیاب ہو گئے کہ ہمارے ڈیٹاسیٹ فلٹرز نے واقعی بعض مطلوبہ الفاظ کی تعدد کو دوسروں کے مقابلے میں زیادہ تر کر دیا ہے۔ مثال کے طور پر، فلٹرز نے لفظ "عورت" کی تعدد کو 14 فیصد کم کیا، جب کہ لفظ "مرد" کی تعدد صرف 6 فیصد کم ہوئی۔ اس نے بڑے پیمانے پر اس بات کی تصدیق کی ہے کہ ہم دونوں ڈیٹاسیٹس پر تربیت یافتہ GLIDE ماڈلز سے نمونے لے کر پہلے ہی قصے کا مشاہدہ کر چکے ہیں۔

اب جب کہ ہمارے پاس فلٹر حوصلہ افزائی تعصب کی پیمائش کے لیے ایک پراکسی تھی، ہمیں اسے کم کرنے کے لیے ایک طریقہ کی ضرورت تھی۔ اس مسئلے سے نمٹنے کے لیے، ہم نے فلٹر شدہ ڈیٹاسیٹ کو دوبارہ وزن میں لانے کا مقصد بنایا تاکہ اس کی تقسیم غیر فلٹر شدہ تصاویر کی تقسیم سے بہتر طور پر مماثل ہو۔ اس خیال کو واضح کرنے کے لیے ایک کھلونا مثال کے طور پر، فرض کریں کہ ہمارا ڈیٹاسیٹ 50% بلی کی تصاویر اور 50% کتے کی تصاویر پر مشتمل ہے، لیکن ہمارے ڈیٹا فلٹرز 75% کتوں کو ہٹاتے ہیں لیکن بلیوں کی صرف 50%۔ حتمی ڈیٹاسیٹ ⅔ بلیوں اور ⅓ کتے ہوں گے، اور اس ڈیٹاسیٹ پر تربیت یافتہ امکان پر مبنی تخلیقی ماڈل ممکنہ طور پر کتوں کے مقابلے بلیوں کی زیادہ تصاویر تیار کرے گا۔ ہم کتے کی ہر تصویر کے تربیتی نقصان کو 2 سے ضرب دے کر، کتے کی ہر تصویر کو دو بار دہرانے کے اثر کی تقلید کرکے اس عدم توازن کو ٹھیک کر سکتے ہیں۔ اس سے پتہ چلتا ہے کہ ہم اپنے حقیقی ڈیٹاسیٹس اور ماڈلز کے لیے اس انداز کو اس انداز میں پیمانہ کر سکتے ہیں جو کہ بڑی حد تک خودکار ہے—یعنی ہمیں ان خصوصیات کو ہاتھ سے منتخب کرنے کی ضرورت نہیں ہے جن کا ہم وزن کرنا چاہتے ہیں۔

ہم فلٹر شدہ ڈیٹاسیٹ میں امیجز کے لیے ایک خاص درجہ بندی کے امکانات کا استعمال کرتے ہوئے وزن کا حساب لگاتے ہیں، جیسا کہ استعمال کیا جاتا ہے چوئی ات۔ (2019). اس درجہ بندی کو تربیت دینے کے لیے، ہم دونوں ڈیٹاسیٹس سے یکساں طور پر تصاویر کا نمونہ لیتے ہیں اور اندازہ لگاتے ہیں کہ تصویر کس ڈیٹاسیٹ سے آئی ہے۔ خاص طور پر، یہ ماڈل پیشن گوئی کرتا ہے P(انفلٹرڈ|تصویر)، ایک پیشگی دیا P(غیر فلٹرڈ) = 0.5. عملی طور پر، ہم نہیں چاہتے کہ یہ ماڈل بہت زیادہ طاقتور ہو، ورنہ یہ ہمارے فلٹرز کے ذریعے لاگو کیا گیا عین فنکشن سیکھ سکتا ہے۔ اس کے بجائے، ہم چاہتے ہیں کہ ماڈل ہمارے اصل ڈیٹا فلٹرز سے زیادہ ہموار ہو، وسیع زمروں کو پکڑتا ہو جو فلٹرز سے متاثر ہوتے ہیں جب کہ ابھی تک اس بارے میں یقین نہیں ہے کہ آیا کسی خاص تصویر کو فلٹر کیا جائے گا یا نہیں۔ اس مقصد کے لیے، ہم نے ایک چھوٹے کے اوپر ایک لکیری پروب کو تربیت دی۔ کلپ ماڈل.

ایک بار جب ہمارے پاس ایک درجہ بندی کرنے والا ہے جو اس امکان کی پیش گوئی کرتا ہے کہ کوئی تصویر غیر فلٹر شدہ ڈیٹاسیٹ سے ہے، ہمیں پھر بھی اس پیشین گوئی کو تصویر کے وزن میں تبدیل کرنے کی ضرورت ہے۔ مثال کے طور پر، فرض کریں کہ P(انفلٹرڈ|تصویر) = 0.8۔ اس کا مطلب یہ ہے کہ فلٹر شدہ ڈیٹا کے مقابلے میں نمونہ کے غیر فلٹر شدہ ڈیٹا میں پائے جانے کا امکان 4 گنا زیادہ ہے، اور 4 کا وزن عدم توازن کو درست کرے۔ زیادہ عام طور پر، ہم وزن استعمال کر سکتے ہیں P(انفلٹرڈ|تصویر)/P(فلٹرڈ|تصویر).ہے [1]

یہ ری ویٹنگ اسکیم حقیقت میں ایمپلیفائیڈ تعصب کو کتنی اچھی طرح سے کم کرتی ہے؟ جب ہم نے اپنے سابقہ فلٹر شدہ ماڈل کو نئی وزن کی اسکیم کے ساتھ ٹھیک بنایا، تو ٹھیک ٹیون شدہ ماڈل کا رویہ ان متعصبانہ مثالوں پر جو ہم نے پہلے پایا تھا، غیر فلٹر شدہ ماڈل سے بہت قریب سے میل کھاتا ہے۔ جب کہ یہ حوصلہ افزا تھا، ہم اپنے مطلوبہ الفاظ پر مبنی تعصب کی تحقیق کا استعمال کرتے ہوئے اس تخفیف کا مزید اچھی طرح سے جائزہ لینا چاہتے تھے۔ اپنی نئی وزن کی اسکیم کو مدنظر رکھتے ہوئے مطلوبہ الفاظ کی تعدد کی پیمائش کرنے کے لیے، ہم فلٹر شدہ ڈیٹاسیٹ میں موجود کسی کلیدی لفظ کی ہر مثال کو اس نمونے کے وزن سے آسانی سے وزن کر سکتے ہیں جس میں یہ موجود ہے۔ ایسا کرنے سے، ہمیں مطلوبہ الفاظ کی تعدد کا ایک نیا سیٹ ملتا ہے جو فلٹر کردہ ڈیٹاسیٹ میں نمونے کے وزن کو ظاہر کرتا ہے۔

ہم نے جن کلیدی الفاظ کی جانچ کی ہے ان میں سے زیادہ تر میں، دوبارہ وزن کی اسکیم نے فلٹرنگ کے ذریعے تعدد کی تبدیلی کو کم کیا۔ "مرد" اور "عورت" کی ہماری سابقہ مثالوں کے لیے، نسبتہ تعدد میں کمی 1% اور -1% بن گئی، جب کہ ان کی پچھلی قدریں بالترتیب 14% اور 6% تھیں۔ اگرچہ یہ میٹرک اصل فلٹرنگ تعصب کے لیے صرف ایک پراکسی ہے، لیکن یہ یقین دلاتا ہے کہ ہماری تصویر پر مبنی ری ویٹنگ اسکیم دراصل متن پر مبنی میٹرک کو اس قدر نمایاں طور پر بہتر کرتی ہے۔

ہم DALL·E 2 میں بقیہ تعصبات کی چھان بین جاری رکھے ہوئے ہیں، جزوی طور پر ماڈل کے رویے کے بڑے جائزوں اور اس بات کی تحقیقات کے ذریعے کہ فلٹرنگ نے تعصب اور صلاحیت کی نشوونما کو کیسے متاثر کیا۔

امیج ریگرگیٹیشن کو روکنا

ہم نے مشاہدہ کیا کہ DALL·E 2 کے ہمارے داخلی پیشرو بعض اوقات تربیتی تصاویر کو لفظی طور پر دوبارہ پیش کرتے تھے۔ یہ رویہ ناپسندیدہ تھا، کیونکہ ہم چاہیں گے کہ DALL·E 2 پہلے سے طے شدہ طور پر اصل، منفرد تصاویر بنائے نہ کہ صرف موجودہ تصاویر کے ٹکڑوں کو "ایک ساتھ سلائی"۔ مزید برآں، تربیتی تصاویر کو لفظی طور پر دوبارہ تیار کرنا کاپی رائٹ کی خلاف ورزی، ملکیت، اور رازداری کے بارے میں قانونی سوالات اٹھا سکتا ہے (اگر لوگوں کی تصاویر تربیتی ڈیٹا میں موجود تھیں)۔

امیج ریگرگیٹیشن کے مسئلے کو بہتر طور پر سمجھنے کے لیے، ہم نے پرامپٹس کا ایک ڈیٹاسیٹ اکٹھا کیا جس کے نتیجے میں اکثر تصاویر نقل ہوتی ہیں۔ ایسا کرنے کے لیے، ہم نے اپنے تربیتی ڈیٹاسیٹ سے 50,000 اشارے کے لیے تصاویر کے نمونے کے لیے ایک تربیت یافتہ ماڈل کا استعمال کیا، اور متعلقہ تربیتی تصویر سے ادراک کی مماثلت کے مطابق نمونوں کو ترتیب دیا۔ آخر میں، ہم نے ہاتھ سے سرفہرست میچوں کا معائنہ کیا، 50k کل پرامپٹس میں سے صرف چند سو حقیقی ڈپلیکیٹ جوڑے ملے۔ اگرچہ ریگرگیٹیشن کی شرح 1% سے کم دکھائی دیتی ہے، ہم نے محسوس کیا کہ اوپر بتائی گئی وجوہات کی بنا پر شرح کو 0 تک کم کرنا ضروری ہے۔

جب ہم نے اپنے ریگرگیٹڈ امیجز کے ڈیٹاسیٹ کا مطالعہ کیا تو ہمیں دو پیٹرن نظر آئے۔ سب سے پہلے، تصاویر تقریباً تمام سادہ ویکٹر گرافکس تھیں، جو ان کے کم معلوماتی مواد کی وجہ سے یاد رکھنے میں آسان تھیں۔ دوسرا، اور اس سے بھی اہم بات، تمام تصاویر میں تربیتی ڈیٹاسیٹ میں بہت سے قریب نقلیں تھیں۔ مثال کے طور پر، وہاں ایک ویکٹر گرافک ہو سکتا ہے جو ایک گھڑی کی طرح دکھائی دیتا ہے جو وقت 1 بجے دکھاتا ہے — لیکن پھر ہم ایک تربیتی نمونہ دریافت کریں گے جس میں وہی گھڑی 2 بجے، اور پھر 3 بجے، وغیرہ کو ایک بار دکھاتی ہے۔ ہمیں اس کا احساس ہوا، ہم نے اس بات کی توثیق کرنے کے لیے ایک تقسیم شدہ قریبی پڑوسی تلاش کا استعمال کیا کہ، درحقیقت، تمام ریگرگیٹڈ امیجز ڈیٹاسیٹ میں ادراک سے ملتے جلتے ڈپلیکیٹس تھے۔ دیگر کام کرتا ہے نے بڑے زبان کے ماڈلز میں اسی طرح کے رجحان کا مشاہدہ کیا ہے، یہ معلوم ہوا ہے کہ ڈیٹا کی نقل کا حفظ سے مضبوطی سے تعلق ہے۔

مندرجہ بالا تلاش نے تجویز کیا کہ، اگر ہم اپنے ڈیٹاسیٹ کی نقل تیار کرتے ہیں، تو ہم ریگرگیٹیشن کا مسئلہ حل کر سکتے ہیں۔ اس کو حاصل کرنے کے لیے، ہم نے ایک جیسے نظر آنے والی تصاویر کے گروپوں کی شناخت کے لیے ایک نیورل نیٹ ورک استعمال کرنے کا منصوبہ بنایا، اور پھر ہر گروپ سے ایک تصویر کے علاوہ تمام کو ہٹا دیں۔ہے [2] تاہم، اس کے لیے ہر تصویر کے لیے جانچ پڑتال کی ضرورت ہوگی، آیا یہ ڈیٹاسیٹ میں موجود ہر دوسری تصویر کی ڈپلیکیٹ ہے۔ چونکہ ہمارے پورے ڈیٹاسیٹ میں لاکھوں تصاویر شامل ہیں، اس لیے ہمیں تمام نقلیں تلاش کرنے کے لیے سیکڑوں چوکور تصویروں کے جوڑے چیک کرنے کی ضرورت ہوگی۔ اگرچہ یہ تکنیکی طور پر پہنچ کے اندر ہے، خاص طور پر ایک بڑے کمپیوٹ کلسٹر پر، ہمیں ایک بہت زیادہ موثر متبادل ملا ہے جو لاگت کے ایک چھوٹے سے حصے پر بھی کام کرتا ہے۔

غور کریں کہ کیا ہوتا ہے اگر ہم ڈپلیکیشن کرنے سے پہلے اپنے ڈیٹاسیٹ کو کلسٹر کرتے ہیں۔ چونکہ قریبی نمونے اکثر ایک ہی کلسٹر میں آتے ہیں، اس لیے زیادہ تر ڈپلیکیٹ جوڑے کلسٹر کے فیصلے کی حدود کو عبور نہیں کریں گے۔ اس کے بعد ہم کلسٹر کے باہر ڈپلیکیٹس کی جانچ کیے بغیر ہر کلسٹر کے اندر نمونوں کو ڈپلیکیٹ کر سکتے ہیں، جبکہ تمام ڈپلیکیٹ جوڑوں کا صرف ایک چھوٹا سا حصہ غائب ہے۔ یہ بولی نقطہ نظر سے کہیں زیادہ تیز ہے، کیونکہ اب ہمیں ہر ایک جوڑے کی تصویروں کو چیک کرنے کی ضرورت نہیں ہے۔ہے [3] جب ہم نے اپنے ڈیٹا کے ایک چھوٹے ذیلی سیٹ پر تجرباتی طور پر اس نقطہ نظر کا تجربہ کیا، تو اسے استعمال کرتے وقت تمام ڈپلیکیٹ جوڑوں میں سے 85 فیصد ملے۔ K 1024 = جھرمٹ۔

مندرجہ بالا الگورتھم کی کامیابی کی شرح کو بہتر بنانے کے لیے، ہم نے ایک اہم مشاہدے کا فائدہ اٹھایا: جب آپ ڈیٹاسیٹ کے مختلف بے ترتیب ذیلی سیٹوں کو کلسٹر کرتے ہیں، تو نتیجے میں آنے والے کلسٹر کے فیصلے کی حدود اکثر بالکل مختلف ہوتی ہیں۔ لہذا، اگر ایک ڈپلیکیٹ جوڑا ڈیٹا کے ایک کلسٹرنگ کے لیے کلسٹر کی حد کو عبور کرتا ہے، تو وہی جوڑا ایک مختلف کلسٹرنگ میں ایک کلسٹر کے اندر گر سکتا ہے۔ آپ جتنے زیادہ کلسٹرنگ کی کوشش کریں گے، اتنا ہی زیادہ امکان ہے کہ آپ کو دی گئی ڈپلیکیٹ جوڑی دریافت ہو جائے گی۔ عملی طور پر، ہم نے پانچ کلسٹرنگ استعمال کرنے پر طے کیا، جس کا مطلب ہے کہ ہم پانچ مختلف کلسٹروں کے اتحاد میں ہر تصویر کے ڈپلیکیٹس تلاش کرتے ہیں۔ عملی طور پر، اس نے ہمارے ڈیٹا کے سب سیٹ پر تمام ڈپلیکیٹ جوڑوں کا 97% پایا۔

حیرت انگیز طور پر، ہمارے ڈیٹاسیٹ کا تقریباً ایک چوتھائی حصہ نقل کے ذریعے ہٹا دیا گیا تھا۔ جب ہم نے قریب قریب ڈپلیکیٹ جوڑوں کو دیکھا تو ان میں سے بہت سے معنی خیز تبدیلیاں شامل تھیں۔ اوپر سے گھڑی کی مثال یاد کریں: ڈیٹا سیٹ میں دن کے مختلف اوقات میں ایک ہی گھڑی کی بہت سی تصاویر شامل ہو سکتی ہیں۔ اگرچہ یہ تصاویر ماڈل کو اس مخصوص گھڑی کی ظاہری شکل کو یادگار بنا سکتی ہیں، وہ ماڈل کو گھڑی پر دن کے اوقات کے درمیان فرق کرنا سیکھنے میں بھی مدد کر سکتی ہیں۔ یہ دیکھتے ہوئے کہ کتنا ڈیٹا ہٹا دیا گیا تھا، ہمیں خدشہ تھا کہ اس طرح کی تصاویر ہٹانے سے ماڈل کی کارکردگی کو نقصان پہنچ سکتا ہے۔

اپنے ماڈلز پر ڈپلیکیشن کے اثر کو جانچنے کے لیے، ہم نے ایک جیسے ہائپر پیرامیٹر کے ساتھ دو ماڈلز کو تربیت دی: ایک مکمل ڈیٹاسیٹ پر، اور دوسرا ڈیٹاسیٹ کے نقل شدہ ورژن پر۔ ماڈلز کا موازنہ کرنے کے لیے، ہم نے وہی انسانی تشخیص استعمال کیے جو ہم اپنے اصل GLIDE ماڈل کی جانچ کے لیے استعمال کرتے تھے۔ حیرت انگیز طور پر، ہم نے محسوس کیا کہ انسانی تشخیص کرنے والوں کو تھوڑا سا کو ترجیح دی نقل شدہ ڈیٹا پر تربیت یافتہ ماڈل، تجویز کرتا ہے کہ ڈیٹاسیٹ میں بے کار تصاویر کی بڑی مقدار دراصل کارکردگی کو نقصان پہنچا رہی ہے۔

ایک بار جب ہم نے نقل شدہ ڈیٹا پر ایک ماڈل کی تربیت حاصل کی، تو ہم نے ریگرگیٹیشن کی تلاش کو دوبارہ چلایا جو ہم نے پہلے ٹریننگ ڈیٹاسیٹ سے 50k سے زیادہ پرامپٹ کیے تھے۔ ہم نے پایا کہ جب تربیتی ڈیٹاسیٹ سے امیج کے لیے بالکل درست اشارہ دیا گیا تو نئے ماڈل نے کبھی بھی تربیتی تصویر کو دوبارہ نہیں بنایا۔ اس ٹیسٹ کو ایک اور قدم آگے بڑھانے کے لیے، ہم نے 50k تیار کردہ تصاویر میں سے ہر ایک کے لیے پورے ٹریننگ ڈیٹاسیٹ پر قریبی پڑوسی کی تلاش بھی کی۔ اس طرح، ہم نے سوچا کہ ہم ایک مخصوص تصویر سے مختلف تصویر کو ریگرگیٹ کرنے والے ماڈل کو پکڑ سکتے ہیں۔ یہاں تک کہ اس سے زیادہ مکمل جانچ پڑتال کے باوجود، ہمیں کبھی بھی امیج ریگرگیٹیشن کا کوئی کیس نہیں ملا۔

اگلے مراحل

اگرچہ اوپر زیر بحث تمام تخفیفات DALL·E 2 سے وابستہ خطرات کو کم کرنے کے ہمارے ہدف کی طرف اہم پیشرفت کی نمائندگی کرتی ہیں، لیکن ہر تخفیف میں اب بھی بہتری کی گنجائش ہے:

- بہتر پری ٹریننگ فلٹرز ہمیں مزید ڈیٹا پر DALL·E 2 کو تربیت دینے اور ماڈل میں تعصب کو مزید کم کرنے کی اجازت دے سکتے ہیں۔ ہمارے موجودہ فلٹرز بہت سے غلط مثبتات کی قیمت پر کم مس ریٹ کے لیے بنائے گئے ہیں۔ نتیجے کے طور پر، ہم نے اپنے پورے ڈیٹاسیٹ کا تقریباً 5% فلٹر کر دیا حالانکہ ان میں سے زیادہ تر فلٹر کردہ تصاویر ہماری مواد کی پالیسی کی خلاف ورزی نہیں کرتی ہیں۔ اپنے فلٹرز کو بہتر بنانے سے ہمیں اس تربیتی ڈیٹا میں سے کچھ کا دوبارہ دعوی کرنے کی اجازت مل سکتی ہے۔

- نظام کی ترقی اور تعیناتی کے بہت سے مراحل پر تعصب متعارف کرایا جاتا ہے اور ممکنہ طور پر بڑھایا جاتا ہے۔ DALL·E 2 جیسے سسٹمز میں تعصب کا اندازہ لگانا اور اس کو کم کرنا اور اس تعصب سے ہونے والے نقصان ایک اہم بین الضابطہ مسئلہ ہے جس کا ہم اپنے وسیع تر مشن کے حصے کے طور پر OpenAI میں مطالعہ جاری رکھے ہوئے ہیں۔ اس پر ہمارے کام میں مسئلہ کو بہتر طور پر سمجھنے کے لیے تشخیصات کی تعمیر، نئے ڈیٹاسیٹس کی تشکیل، اور زیادہ مضبوط اور نمائندہ ٹیکنالوجیز بنانے کے لیے انسانی فیڈ بیک اور فائن ٹیوننگ جیسی تکنیکوں کا اطلاق شامل ہے۔

- یہ بھی بہت اہم ہے کہ ہم گہرے سیکھنے کے نظام میں حفظ اور عامی کا مطالعہ جاری رکھیں۔ اگرچہ نقل کرنا حفظ کو روکنے کی طرف ایک اچھا پہلا قدم ہے، لیکن یہ ہمیں وہ سب کچھ نہیں بتاتا جو اس بارے میں جاننے کے لیے موجود ہے کہ DALL·E 2 جیسے ماڈلز تربیتی ڈیٹا کو کیوں یا کیسے حفظ کرتے ہیں۔

- 000

- 2019

- a

- ہمارے بارے میں

- اکاؤنٹ

- حاصل

- کے پار

- فعال

- پتہ

- کو متاثر

- یلگورتم

- تمام

- اجازت دے رہا ہے

- کی اجازت دیتا ہے

- پہلے ہی

- متبادل

- ہمیشہ

- رقم

- ایک اور

- شائع ہوا

- اطلاقی

- درخواست دینا

- نقطہ نظر

- ارد گرد

- تفویض

- منسلک

- سامعین

- کیونکہ

- اس سے پہلے

- کیا جا رہا ہے

- بہتر

- کے درمیان

- سے پرے

- تعمیر

- عمارت

- صلاحیتوں

- کیپشن

- کیس

- مقدمات

- پکڑو

- قسم

- وجہ

- کچھ

- تبدیل

- جانچ پڑتال

- میں سے انتخاب کریں

- طبقے

- درجہ بندی

- درجہ بندی

- گھڑی

- مجموعہ

- مقابلے میں

- کمپیوٹنگ

- کمپیوٹنگ

- تصور

- غور کریں

- پر مشتمل ہے

- مواد

- سیاق و سباق

- جاری

- کاپی رائٹ

- کاپی رائٹ کی خلاف ورزی

- اسی کے مطابق

- سکتا ہے

- تخلیق

- بنائی

- تخلیق

- اہم

- موجودہ

- اس وقت

- اعداد و شمار

- دن

- دن

- فیصلہ

- گہری

- آبادی

- تعیناتی

- بیان

- کے باوجود

- ترقی

- مختلف

- مشکل

- براہ راست

- دریافت

- دریافت

- فاصلے

- تقسیم کئے

- تقسیم

- نیچے

- نقل

- کے دوران

- ہر ایک

- اثر

- مؤثر طریقے

- تاثیر

- اثرات

- ہنر

- کوششوں

- حوصلہ افزا

- خاص طور پر

- بنیادی طور پر

- تخمینہ

- وغیرہ

- اندازہ

- سب کچھ

- مثال کے طور پر

- مثال کے طور پر

- خاص طور سے

- موجودہ

- توقع ہے

- توقع

- تیز تر

- نمایاں کریں

- خصوصیات

- آراء

- اعداد و شمار

- فلٹرنگ

- فلٹر

- آخر

- تلاش

- پہلا

- درست کریں

- توجہ مرکوز

- مندرجہ ذیل ہے

- ملا

- سے

- مکمل

- تقریب

- مزید

- جمع

- جنس

- جنرل

- عام طور پر

- پیدا

- پیدا

- نسل

- نسلیں

- پیداواری

- مقصد

- اچھا

- GPUs

- گرافکس

- گروپ

- گروپ کا

- بات کی ضمانت

- مٹھی بھر

- مدد

- مدد کرتا ہے

- یہاں

- ہائی

- کس طرح

- تاہم

- HTTPS

- انسانی

- انسان

- سینکڑوں

- خیال

- شناخت

- تصویر

- تصاویر

- نفاذ

- عملدرآمد

- اہم

- کو بہتر بنانے کے

- بہتر

- کو بہتر بنانے کے

- شامل

- شامل

- شامل ہیں

- سمیت

- معلومات

- انفراسٹرکچر

- مثال کے طور پر

- انٹرنیٹ

- کی تحقیقات

- مسئلہ

- IT

- خود

- کلیدی

- لیبل

- لیبل

- لیبل

- زبان

- بڑے

- بڑے

- جانیں

- سیکھا ہے

- سیکھنے

- قانونی

- امکان

- دیکھو

- دیکھا

- بنا

- نشان

- میچ

- بامعنی

- کا مطلب ہے کہ

- پیمائش

- پیمائش

- مرد

- شاید

- فوجی

- لاکھوں

- مشن

- ماڈل

- ماڈل

- زیادہ

- سب سے زیادہ

- ضرب لگانا

- فطرت، قدرت

- ضروری

- منفی

- نیٹ ورک

- تعداد

- حکم

- منظم

- اصل

- دیگر

- ملکیت

- حصہ

- خاص طور پر

- کارکردگی

- کارکردگی کا مظاہرہ

- مرحلہ

- ٹکڑے ٹکڑے

- منصوبہ بنایا

- پالیسی

- مثبت

- ممکن

- ممکنہ

- طاقتور

- پریکٹس

- پیشن گوئی

- کی پیشن گوئی

- حال (-)

- کی روک تھام

- پچھلا

- کی رازداری

- تحقیقات

- مسئلہ

- عمل

- پیدا

- تیار

- احتجاج

- پراکسی

- سہ ماہی

- بلند

- تک پہنچنے

- احساس ہوا

- وجوہات

- کو کم

- کم

- کو کم کرنے

- کی عکاسی

- عکاسی

- باقی

- کو ہٹانے کے

- کی نمائندگی

- نمائندگی

- نمائندے

- درخواستوں

- کی ضرورت

- کی ضرورت ہے

- جواب

- نتیجے

- واپسی

- خطرات

- رن

- اسی

- پیمانے

- سکیم

- تلاش کریں

- مقرر

- سائز

- سیکنڈ اور

- منتقل

- اہم

- اسی طرح

- سادہ

- بعد

- ایک

- سائز

- چھوٹے

- So

- حل

- کچھ

- کچھ

- خلا

- خصوصی

- خاص طور پر

- تصریح

- الگ ہوجاتا ہے

- مراحل

- شروع کریں

- نے کہا

- ابھی تک

- مطالعہ

- کامیابی

- کے نظام

- سسٹمز

- لینے

- تکنیک

- ٹیکنالوجی

- ٹیسٹ

- ۔

- لہذا

- چیزیں

- اچھی طرح سے

- تین

- حد

- کے ذریعے

- وقت

- اوقات

- کے آلے

- سب سے اوپر

- کی طرف

- ٹرین

- ٹریننگ

- سمجھ

- یونین

- منفرد

- us

- استعمال کی شرائط

- توثیق

- مختلف

- اس بات کی تصدیق

- ورژن

- چاہتے تھے

- کیا

- چاہے

- جبکہ

- کے اندر

- بغیر

- خواتین

- کام

- کام کرتا ہے

- فکر مند

- گا

- X