جنریٹیو AI ایپلی کیشنز کو تیزی سے اپنانے کے ساتھ، ان ایپلی کیشنز کو وقت پر جواب دینے کی ضرورت ہے تاکہ زیادہ تھرو پٹ کے ساتھ سمجھی جانے والی تاخیر کو کم کیا جا سکے۔ فاؤنڈیشن ماڈلز (FMs) اکثر اعداد و شمار کے وسیع کارپورا پر پہلے سے تربیت یافتہ ہوتے ہیں جن کے پیرامیٹرز لاکھوں سے اربوں اور اس سے زیادہ کے پیمانے پر ہوتے ہیں۔ بڑے لینگویج ماڈلز (LLMs) FM کی ایک قسم ہیں جو صارف کے تاثرات کے جواب کے طور پر متن تیار کرتی ہے۔ انفرنس پیرامیٹرز کی مختلف کنفیگریشنز کے ساتھ ان ماڈلز کا اندازہ لگانا متضاد تاخیر کا باعث بن سکتا ہے۔ عدم مطابقت اس وجہ سے ہو سکتی ہے کہ جوابی ٹوکنز کی مختلف تعداد جس کی آپ ماڈل سے توقع کر رہے ہیں یا جس قسم کے ایکسلریٹر پر ماڈل لگایا گیا ہے۔

دونوں صورتوں میں، مکمل جواب کا انتظار کرنے کے بجائے، آپ اپنے تخمینے کے لیے رسپانس اسٹریمنگ کا طریقہ اپنا سکتے ہیں، جو معلومات کے ٹکڑوں کو تیار ہوتے ہی واپس بھیج دیتا ہے۔ یہ آپ کو تاخیر سے مکمل جواب کے بجائے حقیقی وقت میں جزوی ردعمل دیکھنے کی اجازت دے کر ایک انٹرایکٹو تجربہ تخلیق کرتا ہے۔

سرکاری اعلان کے ساتھ کہ ایمیزون سیج میکر ریئل ٹائم انفرنس اب رسپانس اسٹریمنگ کو سپورٹ کرتا ہے۔، اب آپ استعمال کرتے وقت کلائنٹ کو واپس آنے والے تخمینے کے جوابات کو مسلسل سٹریم کر سکتے ہیں۔ ایمیزون سیج میکر رسپانس اسٹریمنگ کے ساتھ اصل وقت کا اندازہ۔ یہ حل آپ کو مختلف جنریٹیو AI ایپلی کیشنز جیسے چیٹ بوٹس، ورچوئل اسسٹنٹس، اور میوزک جنریٹرز کے لیے انٹرایکٹو تجربات بنانے میں مدد کرے گا۔ یہ پوسٹ آپ کو دکھاتی ہے کہ کس طرح ٹائم ٹو فرسٹ بائٹ (TTFB) کی شکل میں تیزی سے ردعمل کے اوقات کو محسوس کیا جائے اور Llama 2 ماڈلز کا اندازہ لگاتے ہوئے مجموعی طور پر سمجھی جانے والی تاخیر کو کم کیا جائے۔

حل کو لاگو کرنے کے لیے، ہم SageMaker استعمال کرتے ہیں، جو کہ مکمل طور پر منظم انفراسٹرکچر، ٹولز اور ورک فلو کے ساتھ ڈیٹا تیار کرنے اور مشین لرننگ (ML) ماڈلز کو کسی بھی استعمال کے معاملے کے لیے تیار کرنے، تربیت دینے اور ان کی تعیناتی کے لیے مکمل طور پر منظم سروس ہے۔ تعیناتی کے مختلف اختیارات کے بارے میں مزید معلومات کے لیے SageMaker فراہم کرتا ہے، ملاحظہ کریں۔ ایمیزون سیج میکر ماڈل ہوسٹنگ کے عمومی سوالنامہ. آئیے سمجھتے ہیں کہ ہم جوابی سلسلہ بندی کے ساتھ ریئل ٹائم انفرنس کا استعمال کرتے ہوئے تاخیر کے مسائل کو کیسے حل کر سکتے ہیں۔

حل جائزہ

چونکہ ہم LLMs کے ساتھ ریئل ٹائم انفرنس سے منسلک مذکورہ بالا تاخیر کو دور کرنا چاہتے ہیں، آئیے پہلے یہ سمجھیں کہ ہم Llama 2 کے لیے ریئل ٹائم انفرنسنگ کے لیے رسپانس اسٹریمنگ سپورٹ کا استعمال کیسے کر سکتے ہیں۔ تاہم، کوئی بھی LLM ریسپانس اسٹریمنگ سپورٹ کا فائدہ اٹھا سکتا ہے۔ - وقت کا اندازہ لگانا۔

Llama 2 7 بلین سے 70 بلین پیرامیٹرز کے پیمانے پر پہلے سے تربیت یافتہ اور ٹھیک ٹیونڈ جنریٹو ٹیکسٹ ماڈلز کا مجموعہ ہے۔ لاما 2 ماڈل خودکار ماڈلز ہیں جن میں صرف ڈیکوڈر آرکیٹیکچر ہے۔ فوری طور پر اور انفرنس پیرامیٹرز کے ساتھ فراہم کیے جانے پر، Llama 2 ماڈل ٹیکسٹ ردعمل پیدا کرنے کے قابل ہوتے ہیں۔ ان ماڈلز کو ترجمہ، خلاصہ، سوال جواب، اور بات چیت کے لیے استعمال کیا جا سکتا ہے۔

اس پوسٹ کے لیے، ہم Llama 2 Chat ماڈل تعینات کرتے ہیں۔ meta-llama/Llama-2-13b-chat-hf رسپانس اسٹریمنگ کے ساتھ ریئل ٹائم انفرنسنگ کے لیے سیج میکر پر۔

جب سیج میکر اینڈ پوائنٹس پر ماڈلز کی تعیناتی کی بات آتی ہے، تو آپ خصوصی استعمال کرتے ہوئے ماڈلز کو کنٹینرائز کر سکتے ہیں۔ AWS ڈیپ لرننگ کنٹینر (DLC) تصاویر مقبول اوپن سورس لائبریریوں کے لیے دستیاب ہیں۔ لاما 2 ماڈل ٹیکسٹ جنریشن ماڈل ہیں۔ آپ یا تو استعمال کر سکتے ہیں سیج میکر پر LLM انفرنس کنٹینرز کو گلے لگانا Hugging Face کے ذریعے تقویت یافتہ ٹیکسٹ جنریشن انفرنس (TGI) یا AWS DLCs کے لیے بڑے ماڈل کا اندازہ (LMI)۔

اس پوسٹ میں، ہم SageMaker ہوسٹنگ پر DLCs کا استعمال کرتے ہوئے Llama 2 13B چیٹ ماڈل کو G5 مثالوں سے چلنے والے ریئل ٹائم انفرنس کے لیے تعینات کرتے ہیں۔ G5 مثالیں گرافکس-انٹینسیو ایپلی کیشنز اور ML تخمینہ کے لیے اعلی کارکردگی والے GPU پر مبنی مثالیں ہیں۔ آپ مثال کی ترتیب کے مطابق مناسب تبدیلیوں کے ساتھ معاون مثال کی اقسام p4d، p3، g5، اور g4dn بھی استعمال کر سکتے ہیں۔

شرائط

اس حل کو نافذ کرنے کے لیے، آپ کے پاس درج ذیل ہونا چاہیے:

- AWS اکاؤنٹ ایک کے ساتھ AWS شناخت اور رسائی کا انتظام حل کے حصے کے طور پر بنائے گئے وسائل کو منظم کرنے کی اجازت کے ساتھ (IAM) کا کردار۔

- اگر یہ آپ کے ساتھ پہلی بار کام کر رہا ہے۔ ایمیزون سیج میکر اسٹوڈیو، آپ کو پہلے ایک بنانے کی ضرورت ہے۔ سیج میکر ڈومین.

- گلے ملنے والا چہرہ اکاؤنٹ۔ سائن اپ کریں اگر آپ کے پاس پہلے سے اکاؤنٹ نہیں ہے تو اپنے ای میل کے ساتھ۔

- ہگنگ فیس پر دستیاب ماڈلز، خاص طور پر گیٹڈ ماڈلز جیسے لاما، فائن ٹیوننگ اور انفرنسنگ مقاصد کے لیے، آپ کے پاس ہگنگ فیس اکاؤنٹ ہونا چاہیے تاکہ پڑھنے تک رسائی کا ٹوکن حاصل کیا جا سکے۔ اپنے Hugging Face اکاؤنٹ کے لیے سائن اپ کرنے کے بعد، میں لاگ ان کریں دورہ کرنے کی https://huggingface.co/settings/tokens پڑھنے تک رسائی کا ٹوکن بنانے کے لیے۔

- Llama 2 تک رسائی، اسی ای میل ID کا استعمال کرتے ہوئے جسے آپ Hugging Face کے لیے سائن اپ کرتے تھے۔

- ہگنگ فیس کے ذریعے دستیاب لاما 2 ماڈل گیٹڈ ماڈل ہیں۔ لاما ماڈل کا استعمال میٹا لائسنس کے ذریعے کنٹرول کیا جاتا ہے۔ ماڈل وزن اور ٹوکنائزر ڈاؤن لوڈ کرنے کے لیے، لاما تک رسائی کی درخواست کریں۔ اور ان کا لائسنس قبول کریں۔

- آپ کو رسائی دینے کے بعد (عام طور پر چند دنوں میں)، آپ کو ایک ای میل تصدیق موصول ہوگی۔ اس مثال کے لیے ہم ماڈل استعمال کرتے ہیں۔

Llama-2-13b-chat-hf، لیکن آپ کو دیگر مختلف حالتوں تک بھی رسائی حاصل کرنے کے قابل ہونا چاہئے۔

طریقہ 1: TGI کو گلے لگانا

اس سیکشن میں، ہم آپ کو دکھاتے ہیں کہ کس طرح تعینات کیا جائے۔ meta-llama/Llama-2-13b-chat-hf Hugging Face TGI کا استعمال کرتے ہوئے رسپانس اسٹریمنگ کے ساتھ SageMaker ریئل ٹائم اینڈ پوائنٹ کا ماڈل۔ مندرجہ ذیل جدول اس تعیناتی کے لیے وضاحتیں بیان کرتا ہے۔

| تفصیلات | قدر |

| کنٹینر | گلے ملتے ہوئے چہرہ TGI |

| ماڈل کا نام | meta-llama/Llama-2-13b-chat-hf |

| ایم ایل مثال | ml.g5.12xlarge |

| ارادہ | رسپانس اسٹریمنگ کے ساتھ ریئل ٹائم |

ماڈل تعینات کریں۔

سب سے پہلے، آپ ایل ایل ایم کی تعیناتی کے لیے بنیادی تصویر کو بازیافت کرتے ہیں۔ اس کے بعد آپ بیس امیج پر ماڈل بناتے ہیں۔ آخر میں، آپ ریئل ٹائم انفرنس کے لیے SageMaker ہوسٹنگ کے لیے ML مثال کے لیے ماڈل کو تعینات کرتے ہیں۔

آئیے دیکھتے ہیں کہ پروگرامی طور پر تعیناتی کیسے حاصل کی جائے۔ اختصار کے لیے، اس سیکشن میں صرف اس کوڈ پر بات کی گئی ہے جو تعیناتی کے مراحل میں مدد کرتا ہے۔ تعیناتی کے لیے مکمل سورس کوڈ نوٹ بک میں دستیاب ہے۔ llama-2-hf-tgi/llama-2-13b-chat-hf/1-deploy-llama-2-13b-chat-hf-tgi-sagemaker.ipynb.

تازہ ترین Hugging Face LLM DLC کو بازیافت کریں جو TGI کے ذریعے پہلے سے بنایا گیا ہے۔ سیج میکر ڈی ایل سی. آپ اس تصویر کو تعینات کرنے کے لیے استعمال کرتے ہیں۔ meta-llama/Llama-2-13b-chat-hf SageMaker پر ماڈل۔ درج ذیل کوڈ دیکھیں:

ماڈل کے لیے ماحول کی وضاحت کنفیگریشن پیرامیٹرز کے ساتھ کریں جس کی وضاحت درج ذیل ہے:

بدل <YOUR_HUGGING_FACE_READ_ACCESS_TOKEN> تشکیل پیرامیٹر کے لیے HUGGING_FACE_HUB_TOKEN آپ کے گلے لگنے والے چہرے کے پروفائل سے حاصل کردہ ٹوکن کی قیمت کے ساتھ جیسا کہ اس پوسٹ کے ضروری سیکشن میں تفصیل سے بتایا گیا ہے۔ کنفیگریشن میں، آپ ایک ماڈل کی نقل میں استعمال ہونے والے GPUs کی تعداد 4 کے طور پر بیان کرتے ہیں SM_NUM_GPUS. پھر آپ کو تعینات کر سکتے ہیں meta-llama/Llama-2-13b-chat-hf ایک ml.g5.12x بڑی مثال پر ماڈل جو 4 GPUs کے ساتھ آتا ہے۔

اب آپ مثال بنا سکتے ہیں۔ HuggingFaceModel مذکورہ ماحول کی ترتیب کے ساتھ:

آخر میں، مختلف پیرامیٹر اقدار کے ساتھ ماڈل پر دستیاب تعیناتی طریقہ کار کو دلائل فراہم کر کے ماڈل کو تعینات کریں جیسے endpoint_name, initial_instance_count، اور instance_type:

اندازہ لگانا

Hugging Face TGI DLC ماڈل میں کسی تخصیص یا کوڈ میں تبدیلی کے بغیر ردعمل کو سٹریم کرنے کی صلاحیت کے ساتھ آتا ہے۔ آپ استعمال کر سکتے ہیں invoke_endpoint_with_response_stream اگر آپ Boto3 یا استعمال کر رہے ہیں۔ InvokeEndpointWithResponseStream SageMaker Python SDK کے ساتھ پروگرامنگ کرتے وقت۔

۔ InvokeEndpointWithResponseStream SageMaker کا API ڈویلپرز کو SageMaker ماڈلز سے جوابات واپس سٹریم کرنے کی اجازت دیتا ہے، جو سمجھی جانے والی تاخیر کو کم کر کے صارفین کی اطمینان کو بہتر بنانے میں مدد کر سکتا ہے۔ یہ خاص طور پر جنریٹیو AI ماڈلز کے ساتھ بنی ایپلی کیشنز کے لیے اہم ہے، جہاں فوری پروسیسنگ پورے جواب کا انتظار کرنے سے زیادہ اہم ہے۔

اس مثال کے لیے، ہم ماڈل کا اندازہ لگانے کے لیے Boto3 کا استعمال کرتے ہیں اور SageMaker API استعمال کرتے ہیں۔ invoke_endpoint_with_response_stream مندرجہ ذیل ہے:

دلیل CustomAttributes قدر پر سیٹ ہے۔ accept_eula=false. ۔ accept_eula پیرامیٹر پر سیٹ ہونا ضروری ہے۔ true لاما 2 ماڈلز سے کامیابی کے ساتھ جواب حاصل کرنے کے لیے۔ کا استعمال کرتے ہوئے کامیاب درخواست کے بعد invoke_endpoint_with_response_stream، طریقہ بائٹس کا جوابی سلسلہ واپس کرے گا۔

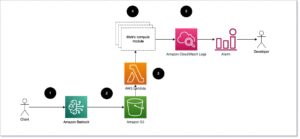

درج ذیل خاکہ اس ورک فلو کو واضح کرتا ہے۔

آپ کو ایک تکرار کرنے والے کی ضرورت ہے جو بائٹس کے سلسلے کو ختم کرے اور انہیں پڑھنے کے قابل متن میں پارس کرے۔ دی LineIterator پر عمل درآمد پایا جا سکتا ہے۔ llama-2-hf-tgi/llama-2-13b-chat-hf/utils/LineIterator.py. اب آپ ماڈل کا اندازہ لگاتے ہوئے انہیں بطور پے لوڈ استعمال کرنے کے لیے پرامپٹ اور ہدایات تیار کرنے کے لیے تیار ہیں۔

ایک اشارہ اور ہدایات تیار کریں۔

اس مرحلے میں، آپ اپنے LLM کے لیے پرامپٹ اور ہدایات تیار کرتے ہیں۔ Llama 2 کو پرامپٹ کرنے کے لیے، آپ کے پاس درج ذیل پرامپٹ ٹیمپلیٹ ہونا چاہیے:

آپ پرامپٹ ٹیمپلیٹ بناتے ہیں جو طریقہ کار میں پروگرام کے مطابق بیان کیا گیا ہے۔ build_llama2_prompt، جو مذکورہ بالا پرامپٹ ٹیمپلیٹ کے ساتھ ہم آہنگ ہے۔ اس کے بعد آپ استعمال کے معاملے کے مطابق ہدایات کی وضاحت کرتے ہیں۔ اس معاملے میں، ہم ماڈل کو ہدایت دے رہے ہیں کہ وہ مارکیٹنگ مہم کے لیے ایک ای میل تیار کرے جیسا کہ get_instructions طریقہ ان طریقوں کا کوڈ میں ہے۔ llama-2-hf-tgi/llama-2-13b-chat-hf/2-sagemaker-realtime-inference-llama-2-13b-chat-hf-tgi-streaming-response.ipynb کاپی. اس کام کے ساتھ مل کر ہدایات بنائیں جیسا کہ تفصیل میں کیا گیا ہے۔ user_ask_1 مندرجہ ذیل ہے:

ہم build_llama2_prompt کے ذریعہ تیار کردہ پرامپٹ ٹیمپلیٹ کے مطابق پرامپٹ بنانے کے لیے ہدایات پاس کرتے ہیں۔

ہم انفرنس پیرامیٹرز کو کلید کے ساتھ پرامپٹ کے ساتھ جمع کرتے ہیں۔ stream قیمت کے ساتھ True حتمی پے لوڈ بنانے کے لیے۔ پے لوڈ کو بھیجیں۔ get_realtime_response_stream، جو رسپانس اسٹریمنگ کے ساتھ ایک اختتامی نقطہ کی درخواست کرنے کے لیے استعمال کیا جائے گا:

LLM سے تیار کردہ متن کو آؤٹ پٹ میں سٹریم کیا جائے گا جیسا کہ درج ذیل اینیمیشن میں دکھایا گیا ہے۔

نقطہ نظر 2: DJL سرونگ کے ساتھ LMI

اس سیکشن میں، ہم یہ ظاہر کرتے ہیں کہ کس طرح تعینات کیا جائے۔ meta-llama/Llama-2-13b-chat-hf DJL سرونگ کے ساتھ LMI کا استعمال کرتے ہوئے رسپانس اسٹریمنگ کے ساتھ SageMaker ریئل ٹائم اینڈ پوائنٹ کا ماڈل۔ مندرجہ ذیل جدول اس تعیناتی کے لیے وضاحتیں بیان کرتا ہے۔

| تفصیلات | قدر |

| کنٹینر | DJL سرونگ کے ساتھ LMI کنٹینر کی تصویر |

| ماڈل کا نام | meta-llama/Llama-2-13b-chat-hf |

| ایم ایل مثال | ml.g5.12xlarge |

| ارادہ | رسپانس اسٹریمنگ کے ساتھ ریئل ٹائم |

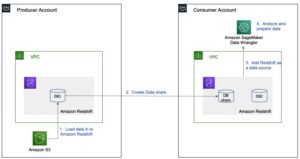

آپ پہلے ماڈل ڈاؤن لوڈ کریں اور اسے اسٹور کریں۔ ایمیزون سادہ اسٹوریج سروس (ایمیزون S3)۔ اس کے بعد آپ S3 URI کی وضاحت کرتے ہیں جس میں ماڈل کے S3 سابقہ کی نشاندہی ہوتی ہے۔ serving.properties فائل اس کے بعد، آپ ایل ایل ایم کی تعیناتی کے لیے بیس امیج کو بازیافت کرتے ہیں۔ اس کے بعد آپ بیس امیج پر ماڈل بناتے ہیں۔ آخر میں، آپ ریئل ٹائم انفرنس کے لیے SageMaker ہوسٹنگ کے لیے ML مثال کے لیے ماڈل کو تعینات کرتے ہیں۔

آئیے دیکھتے ہیں کہ پروگرام کے لحاظ سے مذکورہ بالا تعیناتی کے مراحل کو کیسے حاصل کیا جائے۔ اختصار کے لیے، صرف وہی کوڈ جو تعیناتی کے مراحل میں مدد کرتا ہے اس سیکشن میں تفصیلی ہے۔ اس تعیناتی کا مکمل سورس کوڈ نوٹ بک میں دستیاب ہے۔ llama-2-lmi/llama-2-13b-chat/1-deploy-llama-2-13b-chat-lmi-response-streaming.ipynb.

Hugging Face سے ماڈل کا سنیپ شاٹ ڈاؤن لوڈ کریں اور Amazon S3 پر ماڈل کے نمونے اپ لوڈ کریں۔

مذکورہ بالا شرائط کے ساتھ، SageMaker نوٹ بک مثال پر ماڈل ڈاؤن لوڈ کریں اور پھر مزید تعیناتی کے لیے اسے S3 بالٹی پر اپ لوڈ کریں:

نوٹ کریں کہ اگرچہ آپ ایک درست رسائی ٹوکن فراہم نہیں کرتے ہیں، ماڈل ڈاؤن لوڈ ہو جائے گا۔ لیکن جب آپ ایسا ماڈل لگاتے ہیں، تو پیش کرنے والا ماڈل کامیاب نہیں ہوگا۔ لہذا، اسے تبدیل کرنے کی سفارش کی جاتی ہے <YOUR_HUGGING_FACE_READ_ACCESS_TOKEN> دلیل کے لیے token آپ کے ہگنگ فیس پروفائل سے حاصل کردہ ٹوکن کی قدر کے ساتھ جیسا کہ شرائط میں تفصیل سے بتایا گیا ہے۔ اس پوسٹ کے لیے، ہم Llama 2 کے لیے آفیشل ماڈل کا نام بتاتے ہیں جیسا کہ Hugging Face پر قدر کے ساتھ شناخت کیا گیا ہے۔ meta-llama/Llama-2-13b-chat-hf. غیر کمپریسڈ ماڈل کو ڈاؤن لوڈ کیا جائے گا۔ local_model_path مذکورہ کوڈ کو چلانے کے نتیجے میں۔

فائلوں کو Amazon S3 پر اپ لوڈ کریں اور URI حاصل کریں، جسے بعد میں استعمال کیا جائے گا۔ serving.properties.

آپ پیکنگ کریں گے۔ meta-llama/Llama-2-13b-chat-hf ایل ایم آئی کنٹینر امیج پر ڈی جے ایل سرونگ کے ذریعے مخصوص کنفیگریشن کا استعمال کرتے ہوئے ماڈل serving.properties. اس کے بعد آپ SageMaker ML مثال کے طور پر ml.g5.12xlarge پر کنٹینر امیج پر پیک کیے گئے ماڈل کے نمونے کے ساتھ ماڈل کو تعینات کرتے ہیں۔ اس کے بعد آپ اس ایم ایل مثال کو سیج میکر ہوسٹنگ کے لیے ریئل ٹائم انفرنسنگ کے لیے استعمال کرتے ہیں۔

DJL سرونگ کے لیے ماڈل نمونے تیار کریں۔

ایک بنا کر اپنے ماڈل کے نمونے تیار کریں۔ serving.properties ترتیب فائل:

ہم اس کنفیگریشن فائل میں درج ذیل سیٹنگز استعمال کرتے ہیں۔

- انجن - یہ DJL کے استعمال کے لیے رن ٹائم انجن کی وضاحت کرتا ہے۔ ممکنہ اقدار میں شامل ہیں۔

Python,DeepSpeed,FasterTransformer، اورMPI. اس صورت میں، ہم نے اسے مقرر کیاMPI. ماڈل متوازی اور اندازہ (MPI) تمام دستیاب GPUs میں ماڈل کو تقسیم کرنے میں سہولت فراہم کرتا ہے اور اس وجہ سے اندازہ کو تیز کرتا ہے۔ - option.entryPoint - یہ آپشن بتاتا ہے کہ DJL سرونگ کے ذریعہ پیش کردہ کون سا ہینڈلر آپ استعمال کرنا چاہیں گے۔ ممکنہ قدریں ہیں۔

djl_python.huggingface,djl_python.deepspeed، اورdjl_python.stable-diffusion. ہم استعمال کرتے ہیںdjl_python.huggingfaceگلے لگانے کے لیے چہرے کو تیز کریں۔ - option.tensor_parallel_degree - یہ آپشن ماڈل پر کیے گئے ٹینسر کے متوازی پارٹیشنز کی تعداد بتاتا ہے۔ آپ GPU آلات کی تعداد پر سیٹ کر سکتے ہیں جن پر ایکسلریٹ کو ماڈل کو تقسیم کرنے کی ضرورت ہے۔ یہ پیرامیٹر فی ماڈل کارکنوں کی تعداد کو بھی کنٹرول کرتا ہے جو DJL سرونگ کے چلنے پر شروع کیے جائیں گے۔ مثال کے طور پر، اگر ہمارے پاس 4 GPU مشین ہے اور ہم چار پارٹیشنز بنا رہے ہیں، تو ہمارے پاس درخواستوں کو پورا کرنے کے لیے فی ماڈل ایک کارکن ہوگا۔

- option.low_cpu_mem_usage - یہ ماڈل لوڈ کرتے وقت CPU میموری کے استعمال کو کم کرتا ہے۔ ہم تجویز کرتے ہیں کہ آپ اسے اس پر سیٹ کریں۔

TRUE. - option.rolling_batch - یہ معاون حکمت عملیوں میں سے ایک کا استعمال کرتے ہوئے تکرار کی سطح کی بیچنگ کو قابل بناتا ہے۔ اقدار شامل ہیں۔

auto,scheduler، اورlmi-dist. ہم استعمال کرتے ہیںlmi-distلاما 2 کے لیے مسلسل بیچنگ کو آن کرنے کے لیے۔ - option.max_rolling_batch_size - یہ مسلسل بیچ میں ہم آہنگی کی درخواستوں کی تعداد کو محدود کرتا ہے۔ ویلیو ڈیفالٹ 32 ہے۔

- option.model_id - آپ کو تبدیل کرنا چاہئے۔

{{model_id}}پہلے سے تربیت یافتہ ماڈل کی ماڈل ID کے ساتھ گلے لگانے والے چہرے پر ماڈل ذخیرہ یا ماڈل نمونے کا S3 راستہ۔

مزید ترتیب کے اختیارات میں پایا جا سکتا ہے کنفیگریشنز اور سیٹنگز.

چونکہ DJL Serving توقع کرتا ہے کہ ماڈل کے نمونے پیک کیے جائیں گے اور .tar فائل میں فارمیٹ کیے جائیں گے، اس لیے درج ذیل کوڈ کا ٹکڑا چلائیں تاکہ .tar فائل کو کمپریس کریں اور Amazon S3 پر اپ لوڈ کریں:

DJL سرونگ کے ساتھ تازہ ترین LMI کنٹینر کی تصویر بازیافت کریں۔

اگلا، آپ ماڈل کو تعینات کرنے کے لیے LMI کے لیے SageMaker کے ساتھ دستیاب DLCs کا استعمال کرتے ہیں۔ کے لیے SageMaker امیج URI بازیافت کریں۔ djl-deepspeed کنٹینر پروگرام کے مطابق درج ذیل کوڈ کا استعمال کرتے ہوئے:

آپ مذکورہ بالا تصویر کو تعینات کرنے کے لیے استعمال کر سکتے ہیں۔ meta-llama/Llama-2-13b-chat-hf SageMaker پر ماڈل۔ اب آپ ماڈل بنانے کے لیے آگے بڑھ سکتے ہیں۔

ماڈل بنائیں

آپ وہ ماڈل بنا سکتے ہیں جس کا کنٹینر استعمال کرکے بنایا گیا ہو۔ inference_image_uri اور S3 URI پر واقع ماڈل سرونگ کوڈ جس کی طرف اشارہ کیا گیا ہے۔ s3_code_artifact:

اب آپ اینڈ پوائنٹ کنفیگریشن کے لیے تمام تفصیلات کے ساتھ ماڈل کنفیگریشن بنا سکتے ہیں۔

ماڈل کی تشکیل بنائیں

مندرجہ ذیل کوڈ کا استعمال کرتے ہوئے ماڈل کی تشکیل کے لیے جس کی شناخت کی گئی ہے۔ model_name:

ماڈل کی تشکیل کی وضاحت کی گئی ہے۔ ProductionVariants پیرامیٹر InstanceType ML مثال کے لیے ml.g5.12xlarge۔ آپ بھی فراہم کرتے ہیں۔ ModelName اسی نام کا استعمال کرتے ہوئے جو آپ نے پہلے مرحلے میں ماڈل بنانے کے لیے استعمال کیا تھا، اس طرح ماڈل اور اینڈ پوائنٹ کنفیگریشن کے درمیان تعلق قائم ہوتا ہے۔

اب جب کہ آپ نے ماڈل اور ماڈل کی تشکیل کی وضاحت کر دی ہے، آپ SageMaker اینڈ پوائنٹ بنا سکتے ہیں۔

سیج میکر اینڈ پوائنٹ بنائیں

مندرجہ ذیل کوڈ کا ٹکڑا استعمال کرتے ہوئے ماڈل کو تعینات کرنے کے لیے اینڈ پوائنٹ بنائیں:

آپ درج ذیل کوڈ کا ٹکڑا استعمال کرکے تعیناتی کی پیشرفت دیکھ سکتے ہیں:

تعیناتی کامیاب ہونے کے بعد، اختتامی نقطہ کی حیثیت ہو جائے گی۔ InService. اب جب کہ اختتامی نقطہ تیار ہے، آئیے رسپانس اسٹریمنگ کے ساتھ اندازہ لگائیں۔

رسپانس اسٹریمنگ کے ساتھ اصل وقت کا اندازہ

جیسا کہ ہم نے Huging Face TGI کے لیے پہلے نقطہ نظر کا احاطہ کیا تھا، آپ وہی طریقہ استعمال کر سکتے ہیں۔ get_realtime_response_stream سیج میکر اینڈ پوائنٹ سے رسپانس اسٹریمنگ کو طلب کرنے کے لیے۔ LMI اپروچ کا استعمال کرتے ہوئے اندازہ لگانے کا کوڈ میں ہے۔ llama-2-lmi/llama-2-13b-chat/2-inference-llama-2-13b-chat-lmi-response-streaming.ipynb کاپی. دی LineIterator نفاذ میں واقع ہے llama-2-lmi/utils/LineIterator.py. نوٹ کریں کہ LineIterator LMI کنٹینر پر تعینات Llama 2 Chat ماڈل کے لیے مختلف ہے۔ LineIterator ہگنگ فیس ٹی جی آئی سیکشن میں حوالہ دیا گیا ہے۔ دی LineIterator LMI کنٹینر کے ساتھ لاما 2 چیٹ ماڈلز سے بائٹ سٹریم پر لوپس djl-deepspeed ورژن 0.25.0 مندرجہ ذیل مددگار فنکشن کے ذریعے کی گئی انفرنس کی درخواست سے موصول ہونے والے رسپانس اسٹریم کو پارس کرے گا۔ invoke_endpoint_with_response_stream APIs:

پچھلا طریقہ اس کے ذریعہ پڑھے گئے ڈیٹا کے سلسلے کو پرنٹ کرتا ہے۔ LineIterator انسانی پڑھنے کے قابل فارمیٹ میں۔

آئیے دریافت کرتے ہیں کہ ماڈل کا اندازہ لگاتے ہوئے انہیں پے لوڈ کے طور پر استعمال کرنے کے لیے پرامپٹ اور ہدایات کو کیسے تیار کیا جائے۔

چونکہ آپ Hugging Face TGI اور LMI دونوں میں ایک ہی ماڈل کا اندازہ لگا رہے ہیں، اس لیے پرامپٹ اور ہدایات کی تیاری کا عمل ایک جیسا ہے۔ لہذا، آپ طریقوں کو استعمال کر سکتے ہیں get_instructions اور build_llama2_prompt اندازہ لگانے کے لیے

۔ get_instructions طریقہ ہدایات واپس کرتا ہے۔ جس کام کو انجام دیا جائے اس کے ساتھ مل کر ہدایات بنائیں جیسا کہ تفصیل میں ہے۔ user_ask_2 مندرجہ ذیل ہے:

کے ذریعہ تیار کردہ پرامپٹ ٹیمپلیٹ کے مطابق پرامپٹ بنانے کے لیے ہدایات پاس کریں۔ build_llama2_prompt:

ہم حتمی پے لوڈ بنانے کے پرامپٹ کے ساتھ انفرنس پیرامیٹرز کو جمع کرتے ہیں۔ پھر آپ پے لوڈ بھیجیں۔ get_realtime_response_stream, جس کا استعمال رسپانس اسٹریمنگ کے ساتھ اختتامی نقطہ کی درخواست کرنے کے لیے کیا جاتا ہے:

LLM سے تیار کردہ متن کو آؤٹ پٹ میں سٹریم کیا جائے گا جیسا کہ درج ذیل اینیمیشن میں دکھایا گیا ہے۔

صاف کرو

غیر ضروری چارجز سے بچنے کے لیے، استعمال کریں۔ AWS مینجمنٹ کنسول اختتامی نقطوں اور اس سے وابستہ وسائل کو حذف کرنے کے لیے جو پوسٹ میں مذکور طریقوں کو چلاتے ہوئے بنائے گئے تھے۔ تعیناتی کے دونوں طریقوں کے لیے، درج ذیل کلین اپ روٹین کو انجام دیں:

بدل <SageMaker_Real-time_Endpoint_Name> متغیر کے لیے endpoint_name اصل اختتامی نقطہ کے ساتھ۔

دوسرے نقطہ نظر کے لیے، ہم نے ایمیزون S3 پر ماڈل اور کوڈ کے نمونے محفوظ کیے ہیں۔ آپ درج ذیل کوڈ کا استعمال کرتے ہوئے S3 بالٹی کو صاف کر سکتے ہیں:

نتیجہ

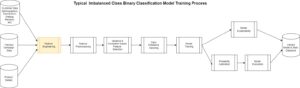

اس پوسٹ میں، ہم نے اس بات پر تبادلہ خیال کیا کہ کس طرح مختلف جوابی ٹوکنز یا انفرنس پیرامیٹرز کا ایک مختلف سیٹ LLMs سے وابستہ تاخیر کو متاثر کر سکتا ہے۔ ہم نے دکھایا کہ رسپانس اسٹریمنگ کی مدد سے مسئلہ کو کیسے حل کیا جائے۔ اس کے بعد ہم نے AWS DLCs—LMI اور Hugging Face TGI کا استعمال کرتے ہوئے Llama 2 Chat ماڈلز کو تعینات کرنے اور ان کا اندازہ لگانے کے لیے دو طریقوں کی نشاندہی کی۔

آپ کو اب اسٹریمنگ رسپانس کی اہمیت کو سمجھنا چاہیے اور یہ سمجھی جانے والی تاخیر کو کیسے کم کر سکتا ہے۔ سٹریمنگ رسپانس صارف کے تجربے کو بہتر بنا سکتا ہے، جو بصورت دیگر آپ کو انتظار کرنے پر مجبور کر دے گا جب تک کہ LLM مکمل جواب نہیں بنا لیتا۔ مزید برآں، لاما 2 چیٹ ماڈلز کو رسپانس اسٹریمنگ کے ساتھ تعینات کرنا صارف کے تجربے کو بہتر بناتا ہے اور آپ کے صارفین کو خوش کرتا ہے۔

آپ سرکاری aws-نمونے کا حوالہ دے سکتے ہیں۔ amazon-sagemaker-llama2-response-streaming-recipes جو دیگر Llama 2 ماڈل کی مختلف حالتوں کے لیے تعیناتی کا احاطہ کرتا ہے۔

حوالہ جات

مصنفین کے بارے میں

پون کمار راؤ نوولے ایمیزون ویب سروسز میں ایک حل آرکیٹیکٹ ہے۔ وہ ہندوستان میں ISVs کے ساتھ کام کرتا ہے تاکہ انہیں AWS پر اختراع کرنے میں مدد ملے۔ وہ کتاب "وی پروگرامنگ کے ساتھ شروعات کرنا" کے شائع شدہ مصنف ہیں۔ انہوں نے انڈین انسٹی ٹیوٹ آف ٹیکنالوجی (IIT)، حیدرآباد سے ڈیٹا سائنس میں ایگزیکٹو M.Tech کی ڈگری حاصل کی۔ انہوں نے انڈین اسکول آف بزنس مینجمنٹ اینڈ ایڈمنسٹریشن سے آئی ٹی اسپیشلائزیشن میں ایگزیکٹو ایم بی اے بھی کیا، اور واگ دیوی انسٹی ٹیوٹ آف ٹیکنالوجی اینڈ سائنس سے الیکٹرانکس اور کمیونیکیشن انجینئرنگ میں بی ٹیک کیا۔ پاون ایک AWS سرٹیفائیڈ سولیوشنز آرکیٹیکٹ پروفیشنل ہے اور اس کے پاس دیگر سرٹیفیکیشنز ہیں جیسے AWS سرٹیفائیڈ مشین لرننگ اسپیشلٹی، مائیکروسافٹ سرٹیفائیڈ پروفیشنل (MCP)، اور Microsoft سرٹیفائیڈ ٹیکنالوجی اسپیشلسٹ (MCTS)۔ وہ اوپن سورس کے شوقین بھی ہیں۔ اپنے فارغ وقت میں، وہ سیا اور ریحانہ کی زبردست جادوئی آوازیں سننا پسند کرتا ہے۔

پون کمار راؤ نوولے ایمیزون ویب سروسز میں ایک حل آرکیٹیکٹ ہے۔ وہ ہندوستان میں ISVs کے ساتھ کام کرتا ہے تاکہ انہیں AWS پر اختراع کرنے میں مدد ملے۔ وہ کتاب "وی پروگرامنگ کے ساتھ شروعات کرنا" کے شائع شدہ مصنف ہیں۔ انہوں نے انڈین انسٹی ٹیوٹ آف ٹیکنالوجی (IIT)، حیدرآباد سے ڈیٹا سائنس میں ایگزیکٹو M.Tech کی ڈگری حاصل کی۔ انہوں نے انڈین اسکول آف بزنس مینجمنٹ اینڈ ایڈمنسٹریشن سے آئی ٹی اسپیشلائزیشن میں ایگزیکٹو ایم بی اے بھی کیا، اور واگ دیوی انسٹی ٹیوٹ آف ٹیکنالوجی اینڈ سائنس سے الیکٹرانکس اور کمیونیکیشن انجینئرنگ میں بی ٹیک کیا۔ پاون ایک AWS سرٹیفائیڈ سولیوشنز آرکیٹیکٹ پروفیشنل ہے اور اس کے پاس دیگر سرٹیفیکیشنز ہیں جیسے AWS سرٹیفائیڈ مشین لرننگ اسپیشلٹی، مائیکروسافٹ سرٹیفائیڈ پروفیشنل (MCP)، اور Microsoft سرٹیفائیڈ ٹیکنالوجی اسپیشلسٹ (MCTS)۔ وہ اوپن سورس کے شوقین بھی ہیں۔ اپنے فارغ وقت میں، وہ سیا اور ریحانہ کی زبردست جادوئی آوازیں سننا پسند کرتا ہے۔

سدھانشو نفرت AWS کے ساتھ پرنسپل AI/ML ماہر ہیں اور کلائنٹس کے ساتھ کام کرتے ہیں تاکہ انہیں ان کے MLOps اور تخلیقی AI سفر پر مشورہ دیں۔ ایمیزون سے پہلے اپنے سابقہ کردار میں، اس نے ٹیموں کو اوپن سورس پر مبنی AI اور گیمیفیکیشن پلیٹ فارم بنانے کے لیے تصور کیا، بنایا اور ان کی قیادت کی، اور اسے 100 سے زیادہ کلائنٹس کے ساتھ کامیابی سے تجارتی بنایا۔ سدھانشو نے اپنے چند پیٹنٹ کے کریڈٹ پر دو کتابیں اور کئی مقالے اور بلاگ لکھے ہیں، اور مختلف تکنیکی فورمز میں اپنا نقطہ نظر پیش کیا ہے۔ وہ ایک سوچنے والے رہنما اور اسپیکر رہے ہیں، اور تقریباً 25 سال سے انڈسٹری میں ہیں۔ اس نے دنیا بھر میں فارچیون 1000 کلائنٹس کے ساتھ اور حال ہی میں ہندوستان میں ڈیجیٹل مقامی کلائنٹس کے ساتھ کام کیا ہے۔

سدھانشو نفرت AWS کے ساتھ پرنسپل AI/ML ماہر ہیں اور کلائنٹس کے ساتھ کام کرتے ہیں تاکہ انہیں ان کے MLOps اور تخلیقی AI سفر پر مشورہ دیں۔ ایمیزون سے پہلے اپنے سابقہ کردار میں، اس نے ٹیموں کو اوپن سورس پر مبنی AI اور گیمیفیکیشن پلیٹ فارم بنانے کے لیے تصور کیا، بنایا اور ان کی قیادت کی، اور اسے 100 سے زیادہ کلائنٹس کے ساتھ کامیابی سے تجارتی بنایا۔ سدھانشو نے اپنے چند پیٹنٹ کے کریڈٹ پر دو کتابیں اور کئی مقالے اور بلاگ لکھے ہیں، اور مختلف تکنیکی فورمز میں اپنا نقطہ نظر پیش کیا ہے۔ وہ ایک سوچنے والے رہنما اور اسپیکر رہے ہیں، اور تقریباً 25 سال سے انڈسٹری میں ہیں۔ اس نے دنیا بھر میں فارچیون 1000 کلائنٹس کے ساتھ اور حال ہی میں ہندوستان میں ڈیجیٹل مقامی کلائنٹس کے ساتھ کام کیا ہے۔

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹو ڈیٹا ڈاٹ نیٹ ورک ورٹیکل جنریٹو اے آئی۔ اپنے آپ کو بااختیار بنائیں۔ یہاں تک رسائی حاصل کریں۔

- پلیٹوآئ اسٹریم۔ ویب 3 انٹیلی جنس۔ علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- پلیٹو ای ایس جی۔ کاربن، کلین ٹیک، توانائی ، ماحولیات، شمسی، ویسٹ مینجمنٹ یہاں تک رسائی حاصل کریں۔

- پلیٹو ہیلتھ۔ بائیوٹیک اینڈ کلینیکل ٹرائلز انٹیلی جنس۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://aws.amazon.com/blogs/machine-learning/inference-llama-2-models-with-real-time-response-streaming-using-amazon-sagemaker/

- : ہے

- : ہے

- :کہاں

- $UP

- 1

- 10

- 100

- 11

- 12

- 14

- 15٪

- 150

- 16

- 19

- 1st

- 25

- 32

- 385

- 50

- 7

- 70

- 8

- 9

- a

- کی صلاحیت

- قابلیت

- ہمارے بارے میں

- رفتار کو تیز تر

- تیز رفتار

- مسرع

- قبول کریں

- تک رسائی حاصل

- اکاؤنٹ

- حاصل

- کے پار

- عمل

- اصل

- اس کے علاوہ

- پتہ

- انتظامیہ

- اپنانے

- منہ بولابیٹا بنانے

- فائدہ

- مشورہ

- پر اثر انداز

- کے بعد

- AI

- اے آئی ماڈلز

- AI / ML

- یلس

- سیدھ میں لائیں

- تمام

- اجازت دے رہا ہے

- کی اجازت دیتا ہے

- ساتھ

- پہلے ہی

- بھی

- ایمیزون

- ایمیزون سیج میکر

- ایمیزون ویب سروسز

- an

- اور

- حرکت پذیری

- کا اعلان کیا ہے

- اعلان

- کوئی بھی

- اے پی آئی

- ایپلی کیشنز

- نقطہ نظر

- نقطہ نظر

- مناسب

- ارکیٹیکچرل

- فن تعمیر

- کیا

- دلیل

- دلائل

- AS

- اسسٹنٹ

- منسلک

- At

- مصنف

- دستیاب

- سے اجتناب

- AWS

- واپس

- بیس

- بیچنے والا

- BE

- کیونکہ

- رہا

- اس سے پہلے

- کے درمیان

- سے پرے

- ارب

- اربوں

- بن

- بلاگز

- جسم

- کتاب

- کتب

- دونوں

- تعمیر

- بناتا ہے

- تعمیر

- کاروبار

- لیکن

- by

- فون

- مہم

- کر سکتے ہیں

- صلاحیت رکھتا

- کیس

- سرٹیفکیٹ

- مصدقہ

- تبدیلیاں

- بوجھ

- چیٹ

- چیٹ بٹس

- صاف

- کلائنٹ

- کلائنٹس

- کلب

- کوڈ

- مجموعہ

- COM

- مل کر

- آتا ہے

- مواصلات

- سمورتی

- ترتیب

- تصدیق کے

- کنٹینر

- کنٹینر

- مسلسل

- مسلسل

- کنٹرول

- سکتا ہے

- جوڑے

- کوپن

- احاطہ کرتا ہے

- کا احاطہ کرتا ہے

- تخلیق

- بنائی

- پیدا

- تخلیق

- کریڈٹ

- گاہک

- گاہکوں کی اطمینان

- گاہکوں

- اعداد و شمار

- ڈیٹا سائنس

- دن

- گہری

- گہری سیکھنے

- غلطی

- وضاحت

- کی وضاحت

- تاخیر

- مظاہرہ

- تعیناتی

- تعینات

- تعینات

- تعیناتی

- تفصیلی

- تفصیلات

- ڈویلپرز

- کے الات

- مختلف

- ڈیجیٹل

- بات چیت

- نہیں

- ڈاؤن لوڈ، اتارنا

- کے دوران

- اس سے قبل

- یا تو

- الیکٹرونکس

- ای میل

- کے قابل بناتا ہے

- اختتام پوائنٹ

- انجن

- انجنیئرنگ

- حوصلہ افزائی

- پوری

- ماحولیات

- خاص طور پر

- قیام

- بھی

- مثال کے طور پر

- ایگزیکٹو

- توقع

- امید ہے

- تجربہ

- تجربات

- تلاش

- چہرہ

- سہولت

- جھوٹی

- تیز تر

- فائل

- فائلوں

- فائنل

- آخر

- پہلا

- پہلی بار

- کے بعد

- مندرجہ ذیل ہے

- کے لئے

- فارم

- فارمیٹ

- فارچیون

- فورمز

- ملا

- فاؤنڈیشن

- چار

- مفت

- سے

- مکمل

- مکمل طور پر

- تقریب

- مزید

- gamification

- متفق

- پیدا

- پیدا

- پیدا کرنے والے

- نسل

- پیداواری

- پیداواری AI۔

- جنریٹر

- حاصل

- GIF

- دنیا

- Go

- حکومت کی

- GPU

- GPUs

- عطا کی

- عظیم

- خوش

- نفرت

- ہے

- he

- مدد

- مدد کرتا ہے

- اعلی کارکردگی

- اعلی

- ان

- کی ڈگری حاصل کی

- میزبانی کی

- ہوسٹنگ

- کس طرح

- کیسے

- تاہم

- HTML

- HTTP

- HTTPS

- گلے لگانے والا چہرہ

- انسانی پڑھنے کے قابل

- ID

- کی نشاندہی

- شناختی

- if

- وضاحت کرتا ہے

- تصویر

- تصاویر

- فوری طور پر

- پر عملدرآمد

- نفاذ

- درآمد

- اہمیت

- اہم

- کو بہتر بنانے کے

- بہتر ہے

- in

- شامل

- سمیت

- بھارت

- بھارتی

- اشارہ کیا

- صنعت

- معلومات

- انفراسٹرکچر

- اختراعات

- ان پٹ

- آدانوں

- کے اندر

- مثال کے طور پر

- کے بجائے

- انسٹی ٹیوٹ

- ہدایات

- انٹرایکٹو

- انٹرنیٹ

- مسائل

- IT

- میں

- سفر

- JSON

- کلیدی

- کمر

- زبان

- بڑے

- تاخیر

- تاخیر کے مسائل

- بعد

- تازہ ترین

- شروع

- قیادت

- رہنما

- سیکھنے

- قیادت

- لمبائی

- لائبریریوں

- لائسنس

- کی طرح

- حدود

- لائن

- سننے

- لاما

- ایل ایل ایم

- لوڈ کر رہا ہے

- واقع ہے

- سے محبت کرتا ہے

- مشین

- مشین لرننگ

- بنا

- بنا

- بناتا ہے

- انتظام

- میں کامیاب

- انتظام

- مارکیٹنگ

- میکس

- مئی..

- ایم سی سی

- یاد داشت

- ذکر کیا

- میٹا

- طریقہ

- طریقوں

- مائیکروسافٹ

- لاکھوں

- ML

- ایم ایل اوپس

- ماڈل

- ماڈل

- ماہ

- زیادہ

- سب سے زیادہ

- موسیقی

- ضروری

- نام

- نامزد

- مقامی

- تقریبا

- ضرورت ہے

- ضروریات

- نئی

- اگلے

- براہ مہربانی نوٹ کریں

- نوٹ بک

- اب

- تعداد

- اشیاء

- مشاہدہ

- حاصل

- حاصل کی

- of

- کی پیشکش کی

- سرکاری

- اکثر

- on

- ایک

- صرف

- کھول

- اوپن سورس

- اختیار

- آپشنز کے بھی

- or

- دیگر

- دوسری صورت میں

- خطوط

- پیداوار

- پر

- مجموعی طور پر

- پیک۔

- پیکیجنگ

- کاغذات

- متوازی

- پیرامیٹر

- پیرامیٹرز

- حصہ

- منظور

- پیٹنٹ

- راستہ

- فی

- سمجھا

- انجام دیں

- کارکردگی

- اجازتیں

- پلیٹ فارم

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- پوائنٹس

- مقبول

- ممکن

- پوسٹ

- طاقت

- پہلے

- تیار

- کی تیاری

- ضروریات

- پیش

- پچھلا

- پرنسپل

- پرنٹس

- مسئلہ

- آگے بڑھو

- عمل

- عملدرآمد

- پروسیسنگ

- مصنوعات

- اغاز مصنوعات

- پیشہ ورانہ

- پروفائل

- پروگرامنگ

- پیش رفت

- خصوصیات

- فراہم

- فراہم

- فراہم کرتا ہے

- فراہم کرنے

- شائع

- مقاصد

- ازگر

- pytorch

- سوال

- لے کر

- تیزی سے

- بلکہ

- پڑھیں

- تیار

- اصلی

- اصل وقت

- احساس

- وصول

- موصول

- حال ہی میں

- سفارش

- سفارش کی

- کو کم

- کم

- کو کم کرنے

- کا حوالہ دیتے ہیں

- سلسلے

- کی جگہ

- جواب

- ذخیرہ

- درخواست

- درخواستوں

- وسائل

- جواب

- جواب

- جوابات

- نتیجہ

- واپسی

- واپسی

- کردار

- روٹین

- رن

- چل رہا ہے

- چلتا ہے

- رن ٹائم

- sagemaker

- اسی

- کی اطمینان

- پیمانے

- سکول

- سائنس

- sdk

- ہموار

- دوسری

- سیکشن

- دیکھنا

- بھیجنے

- بھیجتا ہے

- خدمت

- سروس

- سروسز

- خدمت

- مقرر

- ترتیبات

- کئی

- مختصر

- ہونا چاہئے

- دکھائیں

- سے ظاہر ہوا

- دکھایا گیا

- شوز

- سائن ان کریں

- سادہ

- سنیپشاٹ

- ٹکڑا

- حل

- حل

- جلد ہی

- ماخذ

- ماخذ کوڈ

- اسپیکر

- ماہر

- خصوصی

- خاص

- وضاحتیں

- مخصوص

- شروع

- درجہ

- مرحلہ

- مراحل

- بند کرو

- ذخیرہ

- ذخیرہ

- ذخیرہ

- حکمت عملیوں

- سٹریم

- سلسلہ

- محرومی

- سٹریمنگ سروس

- کامیاب ہوں

- کامیاب

- کامیابی کے ساتھ

- اس طرح

- حمایت

- تائید

- کی حمایت کرتا ہے

- ٹیبل

- لے لو

- ٹاسک

- ٹیموں

- ٹیک

- ٹیکنیکل

- ٹیکنالوجی

- سانچے

- متن

- سے

- کہ

- ۔

- ان

- ان

- تو

- وہاں.

- اس طرح

- لہذا

- یہ

- وہ

- اس

- اگرچہ؟

- سوچا

- تھرو پٹ

- وقت

- اوقات

- کرنے کے لئے

- ٹوکن

- ٹوکن

- اوزار

- ٹرین

- ترجمہ

- سچ

- ٹرننگ

- دو

- قسم

- اقسام

- عام طور پر

- سمجھ

- غیر ضروری

- جب تک

- استعمال

- استعمال کی شرائط

- استعمال کیس

- استعمال کیا جاتا ہے

- رکن کا

- صارف کا تجربہ

- کا استعمال کرتے ہوئے

- درست

- قیمت

- اقدار

- متغیر

- مختلف

- مختلف

- وسیع

- ورژن

- کی طرف سے

- لنک

- مجازی

- دورہ

- آوازیں

- انتظار

- انتظار کر رہا ہے

- چاہتے ہیں

- we

- ویب

- ویب خدمات

- اچھا ہے

- تھے

- جب

- جس

- جبکہ

- پوری

- کس کی

- گے

- ساتھ

- کے اندر

- بغیر

- کام کیا

- کارکن

- کارکنوں

- کام کا بہاؤ

- کام کے بہاؤ

- کام کر

- کام کرتا ہے

- گا

- لکھنا

- لکھا

- سال

- تم

- اور

- زیفیرنیٹ