فیس بک کی جانب سے امریکی صدر جو بائیڈن کو پیڈو فائل کا جھوٹا لیبل لگانے والی جعلی ویڈیو کو ہٹانے کے خلاف فیصلہ کرنے کے بعد میٹا کا اوور سائیٹ بورڈ ڈیپ فیک مواد پر سوشل میڈیا کمپنی کی پالیسیوں کی تحقیقات کر رہا ہے۔

امریکہ کے 2022 کے وسط مدتی انتخابات کے دوران بائیڈن کی پوتی نٹالی بائیڈن کے سینے کے اوپر "میں نے ووٹ دیا" کا اسٹیکر لگاتے ہوئے جعلی ویڈیو کی موافقت کی گئی فوٹیج۔

سات سیکنڈ کی ویڈیو، جو اس سال مئی میں شیئر کی گئی تھی، ڈاکٹریٹ کی گئی تھی اور اسے ایسا ظاہر کرنے کے لیے لوپ کیا گیا تھا جیسے صدر نے اپنی پوتی کو نامناسب طریقے سے چھوا ہے، جس کے پس منظر میں ریپر فروہے مونچ کے گانے "سائمن سیز" کے NSFW بول ہیں۔ ویڈیو میں ایک کیپشن میں غلط طور پر دعوی کیا گیا ہے کہ بائیڈن "ایک بیمار پیڈو فائل" ہے اور دعویٰ کیا ہے کہ جن لوگوں نے انہیں انتخابات میں ووٹ دیا وہ "ذہنی طور پر بیمار" تھے۔

ایک صارف کی شکایت کے باوجود، میٹا کے ماڈریٹرز نے کلپ کو نہیں ہٹایا۔ نگرانی بورڈ کے مطابق، رپورٹ بنانے والے فیس بک صارف نے ویڈیو کو برقرار رکھنے کے فیصلے کے خلاف اپیل کی۔

میٹا نے ایک بار پھر جعلی ویڈیو کو نہ ہٹانے کا فیصلہ کیا، جسے اعتراف کے طور پر پچھلے مہینے تک 30 سے کم مرتبہ دیکھا گیا تھا، کیونکہ یہ AI کا استعمال کرتے ہوئے تیار نہیں کیا گیا تھا اور اسے مستند قرار دیا گیا تھا اور نہ ہی اس میں بائیڈن کی تقریر میں کوئی ہیرا پھیری دکھائی گئی تھی تاکہ وہ ایسا لگ سکے۔ کچھ کہا جو اس نے کبھی نہیں کہا۔

شکایت کنندہ نے بالآخر نگرانی بورڈ کے ساتھ مسئلہ اٹھایا، جو کہ Meta کی طرف سے مواد کی اعتدال کی پالیسیوں کا جائزہ لینے کے لیے بھرتی کیے گئے ماہرین کا ایک آزاد پینل ہے۔

"بورڈ نے اس کیس کو اس بات کا جائزہ لینے کے لیے منتخب کیا کہ آیا میٹا کی پالیسیاں تبدیل شدہ ویڈیوز کا مناسب طور پر احاطہ کرتی ہیں جو لوگوں کو اس بات پر یقین کرنے میں گمراہ کر سکتی ہیں کہ سیاست دانوں نے تقریر سے باہر ایسی کارروائیاں کی ہیں جو انہوں نے نہیں کیں،" گروپ لکھا ہے ایک بیان میں.

"یہ معاملہ بورڈ کے انتخابات اور شہری جگہ اور پالیسیوں کے خودکار نفاذ اور مواد کی ترجیحات کی تشکیل کے اندر آتا ہے۔"

فیس بک کی ہیرا پھیری میڈیا پالیسیاں یہ بتاتی ہیں کہ صارفین کو "مصنوعی ذہانت یا مشین لرننگ، بشمول گہری سیکھنے کی تکنیکوں (مثلاً تکنیکی ڈیپ فیک) کا استعمال کرتے ہوئے تیار کردہ مصنوعی ویڈیوز پوسٹ نہیں کرنی چاہئیں، جو مواد کو ایک ویڈیو پر ضم، یکجا، تبدیل، اور/یا سپرمپوز کرتی ہیں، جس سے ایک ایسی ویڈیو بنتی ہے جو ظاہر ہوتا ہے۔ مستند، اور نہ ہی ایسا مواد جو "ممکنہ طور پر ایک اوسط فرد کو ویڈیو کے کسی موضوع پر یقین کرنے کے لیے گمراہ کرے گا کہ وہ ایسے الفاظ کہے جو اس نے نہیں کہے۔"

زیر غور بائیڈن کی جعلی ویڈیو نے کسی بھی اصول کی خلاف ورزی نہیں کی، اور اس طرح اسے آن لائن رہنے کی اجازت دی گئی۔ یہ مشین سے بنی نہیں تھی اور نہ ہی صدر کے منہ میں الفاظ ڈالے گئے تھے۔

جیسا بھی ہو، سیاسی غلط معلومات سے نمٹنے اور اسے کم کرنے کے لیے میٹا کی بیان کردہ کوششیں کمزور ہو سکتی ہیں اگر ایسے مواد کو پھیلنے کی اجازت دی جائے۔ اگر مندرجہ بالا ویڈیو کو برقرار رہنے دیا جائے تو قواعد میں عدم توازن ہو سکتا ہے، یہ سب اس لیے کہ اسے کسی انسان نے اناڑی طریقے سے ایڈٹ کیا تھا، جبکہ ڈیپ فیکس کے خلاف کریک ڈاؤن ہے۔ اگر AI نے ڈاکٹریٹ والی ویڈیو بنائی تو کیا یہ نیچے آجاتی؟ لیکن اگر انسان کی بنائی ہوئی ہے تو اس کی ضرورت نہیں ہے؟

اس طرح، بورڈ اس معاملے کی روشنی میں درج ذیل شعبوں پر عوام سے تبصرے اور خیالات طلب کر رہا ہے:

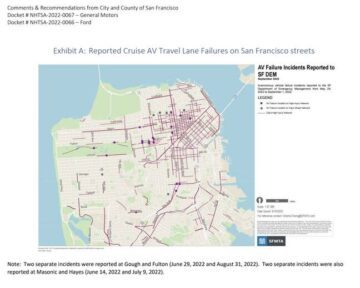

- سیاسی شخصیات کے تاثرات کو متاثر کرنے کے لیے تبدیل شدہ یا ہیرا پھیری والے ویڈیو مواد کے استعمال کے آن لائن رجحانات پر تحقیق کریں، خاص طور پر ریاستہائے متحدہ میں۔

- میٹا کی غلط معلومات کی پالیسیوں کی مناسبیت، بشمول ہیرا پھیری والے میڈیا پر، اس علاقے میں موجودہ اور مستقبل کے چیلنجوں کا جواب دینے کے لیے، خاص طور پر انتخابات کے تناظر میں۔

- میٹا کی انسانی حقوق کی ذمہ داریاں جب ویڈیو مواد کی بات آتی ہے جس میں عوامی شخصیت کا گمراہ کن تاثر پیدا کرنے کے لیے تبدیل کیا گیا ہے، اور تخلیقی مصنوعی ذہانت میں ہونے والی پیش رفت کو ذہن میں رکھتے ہوئے انہیں کیسے سمجھا جانا چاہیے۔

- بڑے پیمانے پر ویڈیو مواد کی توثیق کرنے کے لیے چیلنجز اور بہترین طریقہ کار، بشمول آٹومیشن کا استعمال۔

- مواد کو ہٹانے کے علاوہ سیاسی غلط معلومات یا غلط معلومات کے متبادل ردعمل کی افادیت کے بارے میں تحقیق کریں، جیسے حقائق کی جانچ کے پروگرام یا لیبلنگ (جسے "معلوم علاج" بھی کہا جاتا ہے)۔ مزید برآں، اس طرح کے جوابات میں تعصب سے بچنے پر تحقیق۔

اس ان پٹ سے لیس، پینل سے توقع کی جاتی ہے کہ وہ پالیسیوں کا جائزہ لے گا اور میٹا کو تجاویز پیش کرے گا - حالانکہ اس سے بہت کچھ حاصل نہیں ہو سکتا۔

"اپنے فیصلوں کے حصے کے طور پر، بورڈ میٹا کو پالیسی سفارشات جاری کر سکتا ہے۔ اگرچہ سفارشات پابند نہیں ہیں، میٹا کو 60 دنوں کے اندر ان کا جواب دینا ہوگا،" پینل نے اعتراف کیا۔ "اس طرح، بورڈ عوامی تبصروں کا خیرمقدم کرتا ہے جو اس معاملے سے متعلق سفارشات پیش کرتے ہیں۔"

ماہرین اور قانون ساز اس دوران 2024 کے امریکی صدارتی انتخابات سے قبل سیاسی گفتگو میں ہیرا پھیری کرنے والے گہرے نقالی کے بارے میں فکر مند ہیں۔

پچھلے ہفتے، امریکی سینیٹر ایمی کلبوچر (D-MN) اور ایوان نمائندگان یویٹ کلارک (D-NY) نے Meta CEO Mark Zuckerberg اور X CEO Linda Yaccarino کو خطوط بھیجے جن میں سیاسی ڈیپ فیکس کے حوالے سے اپنی مواد کی پالیسیوں کو واضح کرنے کی کوشش کی گئی۔

"2024 کے انتخابات تیزی سے قریب آنے کے ساتھ، سیاسی اشتہارات میں اس قسم کے مواد کے بارے میں شفافیت کا فقدان آپ کے پلیٹ فارمز پر الیکشن سے متعلق غلط معلومات اور غلط معلومات کے خطرناک سیلاب کا باعث بن سکتا ہے - جہاں ووٹرز اکثر امیدواروں اور مسائل کے بارے میں جاننے کے لیے رجوع کرتے ہیں،" خط میں کہا گیا ہے، اے پی رپورٹ کے مطابق.

رجسٹر تبصرہ کے لئے میٹا سے پوچھا ہے. ®

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹو ڈیٹا ڈاٹ نیٹ ورک ورٹیکل جنریٹو اے آئی۔ اپنے آپ کو بااختیار بنائیں۔ یہاں تک رسائی حاصل کریں۔

- پلیٹوآئ اسٹریم۔ ویب 3 انٹیلی جنس۔ علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- پلیٹو ای ایس جی۔ کاربن، کلین ٹیک، توانائی ، ماحولیات، شمسی، ویسٹ مینجمنٹ یہاں تک رسائی حاصل کریں۔

- پلیٹو ہیلتھ۔ بائیوٹیک اینڈ کلینیکل ٹرائلز انٹیلی جنس۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://go.theregister.com/feed/www.theregister.com/2023/10/11/meta_oversight_board_biden_video/

- : ہے

- : ہے

- : نہیں

- :کہاں

- $UP

- 2022

- 2024

- 30

- 60

- 7

- a

- ہمارے بارے میں

- اوپر

- کے مطابق

- کے پار

- اعمال

- اس کے علاوہ

- مناسب

- اعتراف کیا

- اشتھارات

- کے بعد

- پھر

- کے خلاف

- آگے

- AI

- تمام

- کی اجازت

- بھی

- تبدیل

- متبادل

- امریکہ

- یمی

- an

- اور

- کوئی بھی

- ظاہر

- ظاہر ہوتا ہے

- قریب

- کیا

- رقبہ

- علاقوں

- مصنوعی

- مصنوعی ذہانت

- AS

- تشخیص کریں

- At

- مستند

- آٹومیٹڈ

- میشن

- اوسط

- گریز

- پس منظر

- BE

- کیونکہ

- رہا

- یقین ہے کہ

- مومن

- BEST

- بہترین طریقوں

- سے پرے

- تعصب

- بولنا

- بائنڈنگ

- بورڈ

- لیکن

- by

- کر سکتے ہیں

- امیدواروں

- کیس

- سی ای او

- چیلنجوں

- سوک

- دعوی کیا

- CO

- یکجا

- کس طرح

- آتا ہے

- تبصرہ

- تبصروں

- شکایت

- متعلقہ

- غور

- مواد

- سیاق و سباق

- سکتا ہے

- احاطہ

- کریکشن

- تخلیق

- تخلیق

- کیپشن

- خطرناک

- دن

- فیصلہ کیا

- فیصلہ

- فیصلے

- گہری

- گہری سیکھنے

- deepfakes

- رفت

- DID

- نہیں کیا

- پتلا

- گفتگو

- بے چینی

- نہیں

- نیچے

- کے دوران

- e

- افادیت

- کوششوں

- یا تو

- الیکشن

- انتخابات

- نافذ کرنے والے

- خاص طور پر

- آخر میں

- توقع

- ماہرین

- فیس بک

- جعلی

- آبشار

- FB

- نمایاں کریں

- کم

- اعداد و شمار

- اعداد و شمار

- کے بعد

- کے لئے

- سے

- مستقبل

- پیدا

- پیداواری

- وشال

- گروپ

- ہے

- he

- اسے

- ان

- ہاؤس

- کس طرح

- HTTPS

- انسانی

- انسانی حقوق

- i

- خیالات

- if

- عدم توازن

- in

- سمیت

- دن بدن

- آزاد

- اثر و رسوخ

- ان پٹ

- انٹیلی جنس

- میں

- مدعو کرنا

- مسئلہ

- مسائل

- IT

- میں

- JOE

- جو بائیڈن

- فوٹو

- جانا جاتا ہے

- لیبلنگ

- نہیں

- آخری

- قانون ساز

- قیادت

- جانیں

- سیکھنے

- خط

- روشنی

- کی طرح

- امکان

- لنڈا

- بہت

- مشین

- مشین لرننگ

- بنا

- بنا

- جوڑی

- جوڑ توڑ

- ہیرا پھیری

- نشان

- مارک Zuckerberg

- مئی..

- دریں اثناء

- میڈیا

- انضمام

- میٹا

- درمیانی مدت کے

- وسط مدتی انتخابات

- برا

- غلط معلومات

- گمراہ کرنا

- اعتدال پسند

- مہینہ

- منہ

- ضروری

- کبھی نہیں

- NSFW

- of

- بند

- اکثر

- on

- آن لائن

- پر

- or

- باہر

- نگرانی

- پینل

- حصہ

- خاص طور پر

- منظور

- لوگ

- خیال

- انسان

- رکھ

- پلیٹ فارم

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- کھیل

- پالیسیاں

- پالیسی

- سیاسی

- سیاستدان

- پوسٹ

- طریقوں

- حال (-)

- صدر

- صدر جو بائیڈن

- صدارتی

- صدارتی انتخابات

- پروگرام

- تجویزپیش

- عوامی

- ڈال

- جلدی سے

- اٹھایا

- rapper ہے

- سفارشات

- کو کم

- کے بارے میں

- متعلقہ

- رہے

- ہٹانے

- ہٹا

- رپورٹ

- نمائندے

- تحقیق

- جواب

- جوابات

- ذمہ داریاں

- برقرار رکھنے

- کا جائزہ لینے کے

- جائزہ

- حقوق

- حکمرانی

- قوانین

- s

- کہا

- کا کہنا ہے کہ

- کا کہنا ہے کہ

- پیمانے

- کی تلاش

- لگتا ہے

- منتخب

- سینیٹر

- بھیجا

- مشترکہ

- ہونا چاہئے

- سائمن

- سماجی

- سوشل میڈیا

- کچھ

- نغمہ

- خلا

- تقریر

- حالت

- نے کہا

- بیان

- امریکہ

- رہنا

- موضوع

- اس طرح

- مناسب

- مصنوعی

- ٹیکل

- لیا

- لینے

- ٹیکنیکل

- تکنیک

- سے

- کہ

- ۔

- ان

- ان

- وہاں.

- وہ

- اس

- اس سال

- اگرچہ؟

- اس طرح

- اوقات

- کرنے کے لئے

- چھوڑا

- شفافیت

- رجحانات

- ٹرن

- قسم

- کے تحت

- سمجھا

- متحدہ

- ریاست ہائے متحدہ امریکہ

- آئندہ

- us

- امریکی صدر

- امریکی سینیٹر

- رکن کا

- صارفین

- کا استعمال کرتے ہوئے

- ویڈیو

- ویڈیوز

- ووٹ دیا

- ووٹر

- تھا

- نہیں تھا

- ہفتے

- خیرمقدم ہے۔

- تھے

- جب

- چاہے

- جس

- جبکہ

- ڈبلیو

- ساتھ

- کے اندر

- الفاظ

- گا

- X

- سال

- اور

- زیفیرنیٹ

- Zuckerberg کی