تعارف

مشین لرننگ میں، تعصب-تغیر ٹریڈ آف ایک بنیادی تصور ہے جو کسی بھی پیشین گوئی ماڈل کی کارکردگی کو متاثر کرتا ہے۔ یہ ایک ماڈل کی تعصب کی غلطی اور تغیر کی غلطی کے درمیان نازک توازن کی طرف اشارہ کرتا ہے، کیونکہ دونوں کو بیک وقت کم کرنا ناممکن ہے۔ بہترین ماڈل کی کارکردگی کو حاصل کرنے کے لیے صحیح توازن کو برقرار رکھنا بہت ضروری ہے۔

اس مختصر مضمون میں، ہم تعصب اور تغیر کی وضاحت کریں گے، وضاحت کریں گے کہ وہ کس طرح مشین لرننگ ماڈل کو متاثر کرتے ہیں، اور عملی طور پر ان سے نمٹنے کے بارے میں کچھ عملی مشورہ فراہم کریں گے۔

تعصب اور تغیر کو سمجھنا

تعصب اور تغیر کے درمیان تعلق کو جاننے سے پہلے، آئیے اس بات کی وضاحت کرتے ہیں کہ مشین لرننگ میں یہ اصطلاحات کس چیز کی نمائندگی کرتی ہیں۔

تعصب کی غلطی سے مراد ماڈل کی پیشین گوئی اور درست اقدار کے درمیان فرق ہے جو یہ پیشین گوئی کرنے کی کوشش کرتا ہے (زمینی سچائی)۔ دوسرے لفظوں میں، تعصب وہ غلطی ہے جو ماڈل ڈیٹا کی بنیادی تقسیم کے بارے میں غلط مفروضوں کی وجہ سے کرتا ہے۔ اعلی تعصب کے ماڈل اکثر بہت سادہ ہوتے ہیں، ڈیٹا کی پیچیدگی کو پکڑنے میں ناکام رہتے ہیں، جس کی وجہ سے انڈر فٹنگ ہوتی ہے۔

دوسری طرف، تغیر کی خرابی سے مراد ٹریننگ ڈیٹا میں چھوٹے اتار چڑھاؤ کے لیے ماڈل کی حساسیت ہے۔ ہائی ویرینس ماڈلز حد سے زیادہ پیچیدہ ہوتے ہیں اور بنیادی پیٹرن کے بجائے ڈیٹا میں شور کو فٹ کرتے ہیں، جس کی وجہ سے اوور فٹنگ ہوتی ہے۔ اس کے نتیجے میں نئے، غیر دیکھے ڈیٹا پر خراب کارکردگی ہوتی ہے۔

زیادہ تعصب انڈر فٹنگ کا باعث بن سکتا ہے، جہاں ماڈل ڈیٹا کی پیچیدگی کو پکڑنے کے لیے بہت آسان ہے۔ یہ ڈیٹا کے بارے میں مضبوط مفروضے بناتا ہے اور ان پٹ اور آؤٹ پٹ متغیر کے درمیان حقیقی تعلق کو حاصل کرنے میں ناکام رہتا ہے۔ دوسری طرف، اعلی تغیر اوور فٹنگ کا باعث بن سکتا ہے، جہاں ماڈل بہت پیچیدہ ہے اور ان پٹ اور آؤٹ پٹ متغیر کے درمیان بنیادی تعلق کے بجائے ڈیٹا میں شور سیکھتا ہے۔ اس طرح، اوور فٹنگ ماڈلز ٹریننگ ڈیٹا کو بہت قریب سے فٹ کرتے ہیں اور نئے ڈیٹا کو اچھی طرح سے عام نہیں کریں گے، جبکہ انڈر فٹنگ ماڈلز تربیتی ڈیٹا کو درست طریقے سے فٹ کرنے کے قابل بھی نہیں ہیں۔

جیسا کہ پہلے ذکر کیا گیا ہے، تعصب اور تغیر کا تعلق ہے، اور ایک اچھا ماڈل تعصب کی غلطی اور تغیر کی غلطی کے درمیان توازن رکھتا ہے۔ تعصب-تغیر تجارت کا عمل غلطی کے ان دو ذرائع کے درمیان بہترین توازن تلاش کرنے کا عمل ہے۔ کم تعصب اور کم تغیر کے ساتھ ایک ماڈل ممکنہ طور پر تربیت اور نئے ڈیٹا دونوں پر اچھی کارکردگی کا مظاہرہ کرے گا، کل غلطی کو کم سے کم کرے گا۔

تعصب-تغیر تجارت-آف

ماڈل کی پیچیدگی اور نامعلوم اعداد و شمار کو عام کرنے کی اس کی صلاحیت کے درمیان توازن حاصل کرنا تعصب-متغیر تجارت کا بنیادی حصہ ہے۔ عام طور پر، ایک زیادہ پیچیدہ ماڈل میں کم تعصب لیکن زیادہ تغیر ہوتا ہے، جب کہ ایک سادہ ماڈل میں زیادہ تعصب لیکن کم تغیر ہوتا ہے۔

چونکہ بیک وقت تعصب اور تغیر کو کم کرنا ناممکن ہے، اس لیے ان کے درمیان بہترین توازن تلاش کرنا ایک مضبوط مشین لرننگ ماڈل بنانے میں بہت ضروری ہے۔ مثال کے طور پر، جیسا کہ ہم ایک ماڈل کی پیچیدگی میں اضافہ کرتے ہیں، ہم تغیر کو بھی بڑھاتے ہیں۔ اس کی وجہ یہ ہے کہ زیادہ پیچیدہ ماڈل کے تربیتی اعداد و شمار میں شور کو فٹ کرنے کا زیادہ امکان ہوتا ہے، جس کی وجہ سے اوور فٹنگ ہوتی ہے۔

دوسری طرف، اگر ہم ماڈل کو بہت سادہ رکھیں گے، تو ہم تعصب میں اضافہ کریں گے۔ اس کی وجہ یہ ہے کہ ایک آسان ماڈل ڈیٹا میں بنیادی تعلقات کو حاصل نہیں کر سکے گا، جس کی وجہ سے انڈر فٹنگ ہو گی۔

مقصد ایک ایسے ماڈل کو تربیت دینا ہے جو تربیتی ڈیٹا میں بنیادی تعلقات کو حاصل کرنے کے لیے کافی پیچیدہ ہو، لیکن اتنا پیچیدہ نہیں کہ یہ تربیتی ڈیٹا میں شور کو فٹ کر سکے۔

پریکٹس میں تعصب-تغیر تجارت

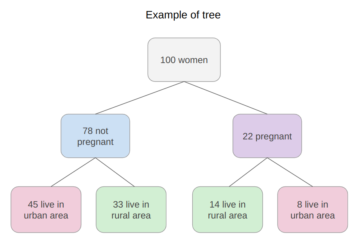

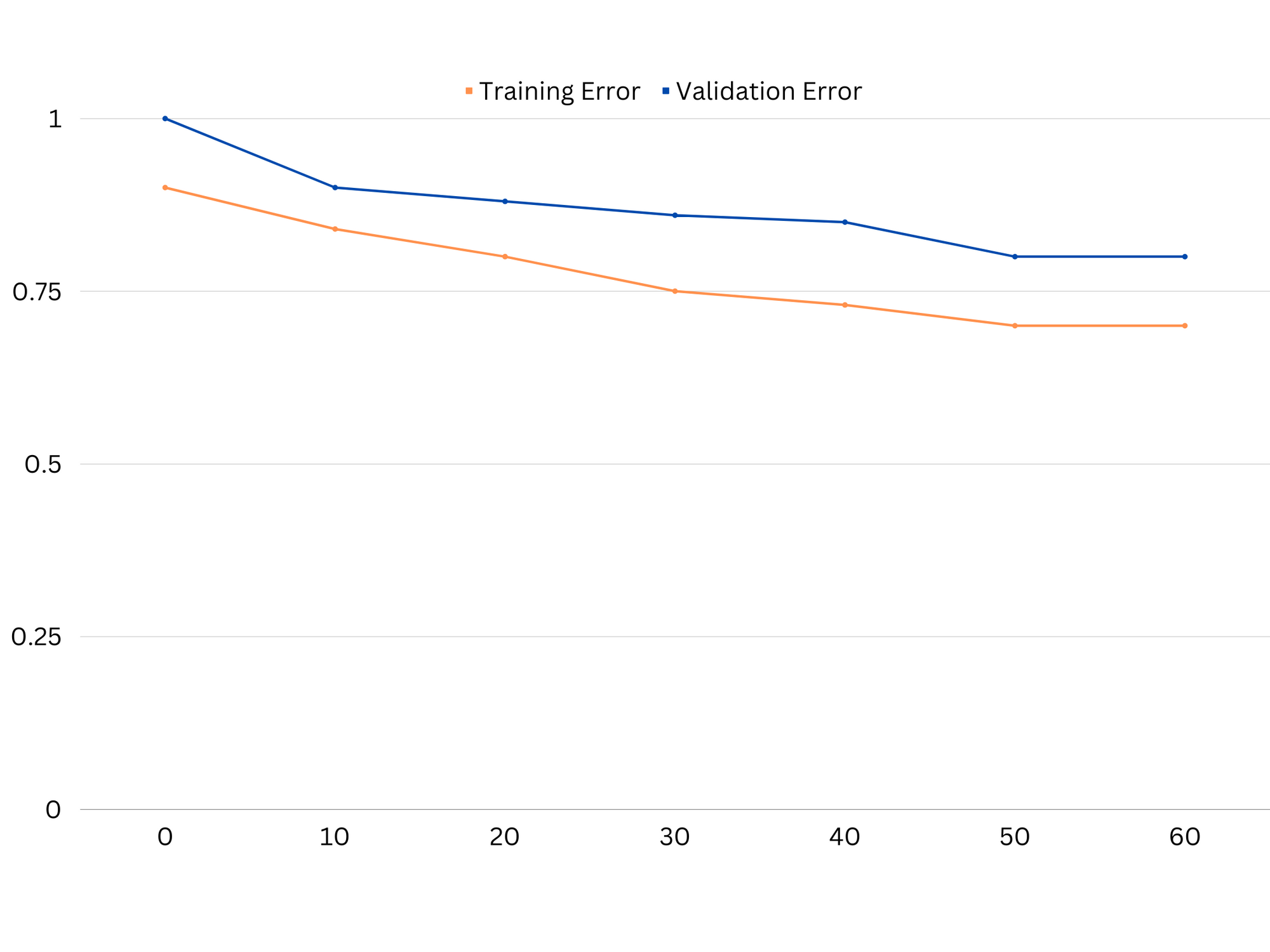

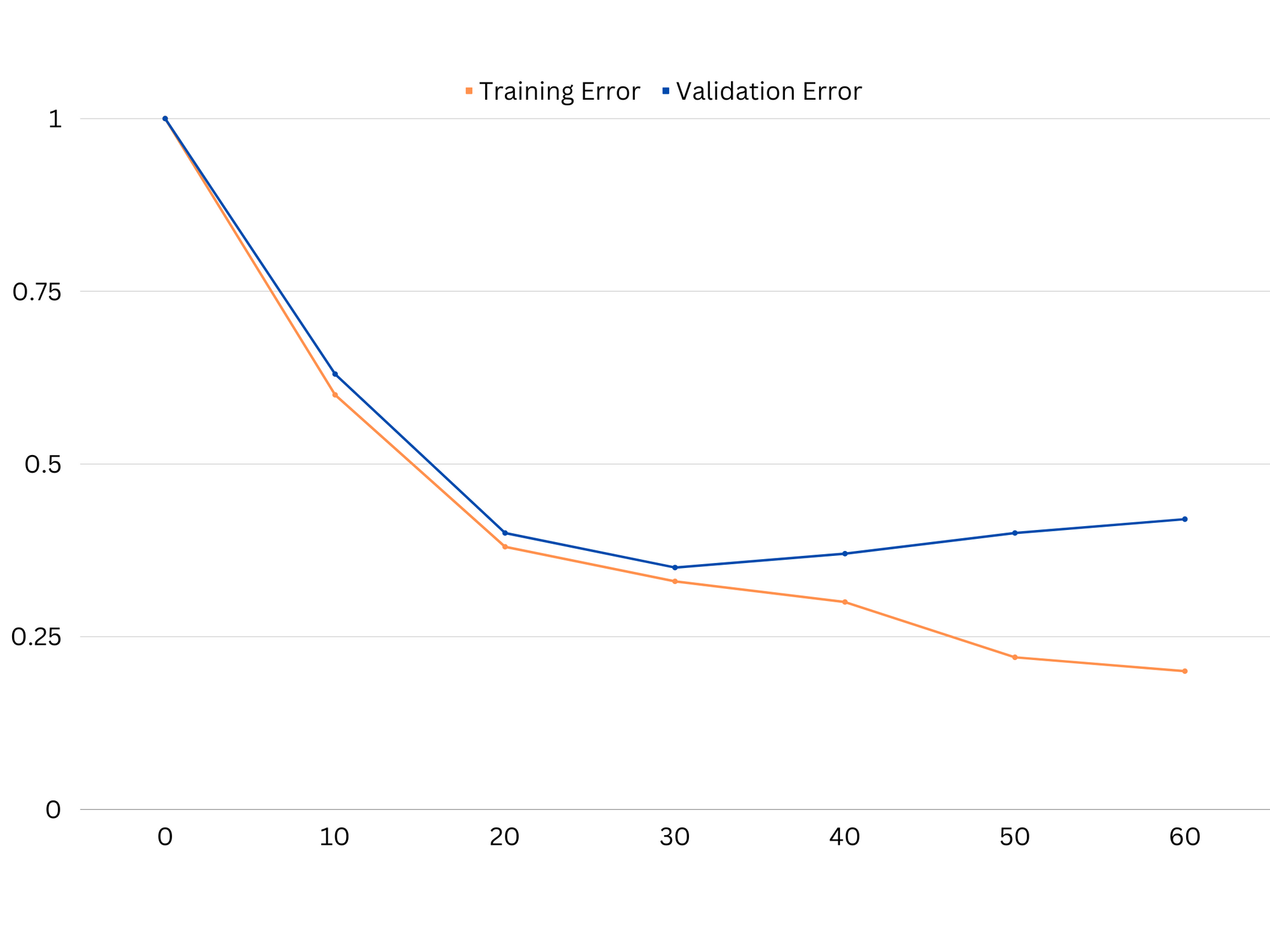

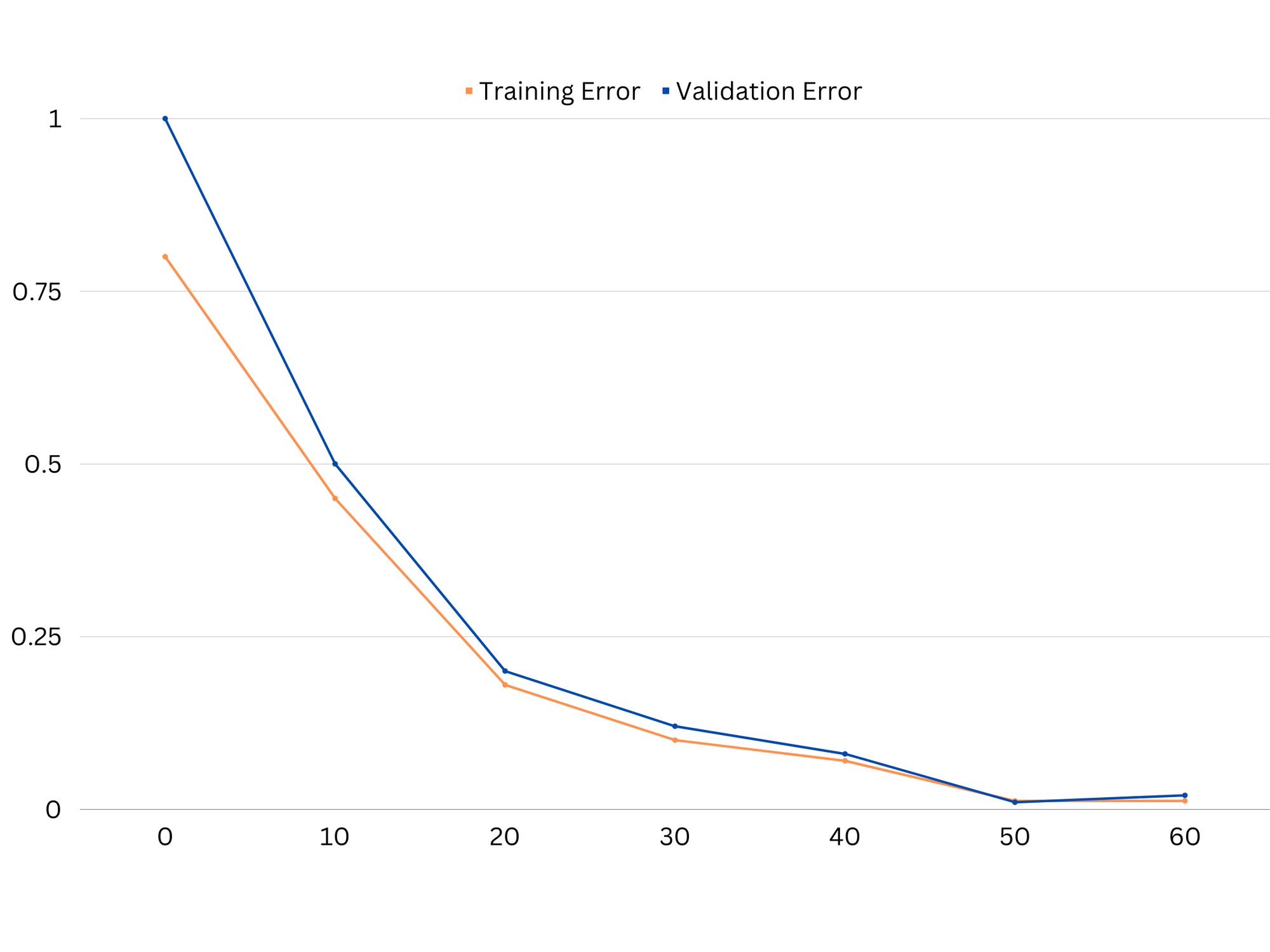

ماڈل کی کارکردگی کی تشخیص کے لیے، ہم عام طور پر ٹرین اور توثیق کی غلطیوں کا حساب لگاتے ہیں اور ان کا موازنہ کرتے ہیں۔ اس کو دیکھنے کے لیے ایک مفید ٹول سیکھنے کے منحنی خطوط کا ایک پلاٹ ہے، جو ٹریننگ اور تصدیقی ڈیٹا دونوں پر ٹریننگ کے پورے عمل میں ماڈل کی کارکردگی کو ظاہر کرتا ہے۔ ان منحنی خطوط کا جائزہ لے کر، ہم اس بات کا تعین کر سکتے ہیں کہ آیا ماڈل اوور فٹنگ (ہائی ویریئنس)، انڈر فٹنگ (اعلی تعصب)، یا اچھی طرح سے فٹنگ (تعصب اور تغیر کے درمیان بہترین توازن) ہے۔

انڈر فٹنگ ماڈل کے سیکھنے کے منحنی خطوط کی مثال۔ ٹرین کی غلطی اور توثیق کی غلطی دونوں زیادہ ہیں۔

عملی طور پر، تربیت اور توثیق کے اعداد و شمار دونوں پر کم کارکردگی بتاتی ہے کہ ماڈل بہت آسان ہے، جس کی وجہ سے انڈر فٹنگ ہوتی ہے۔ دوسری طرف، اگر ماڈل ٹریننگ ڈیٹا پر بہت اچھی کارکردگی کا مظاہرہ کرتا ہے لیکن ٹیسٹ ڈیٹا پر ناقص ہے، تو ماڈل کی پیچیدگی کا امکان بہت زیادہ ہے، جس کے نتیجے میں اوور فٹنگ ہوتی ہے۔ انڈر فٹنگ کو حل کرنے کے لیے، ہم مزید خصوصیات شامل کرکے، سیکھنے کے الگورتھم کو تبدیل کرکے، یا مختلف ہائپرپیرامیٹرس کا انتخاب کرکے ماڈل کی پیچیدگی کو بڑھانے کی کوشش کر سکتے ہیں۔ اوور فٹنگ کی صورت میں، ہمیں ماڈل کو ریگولرائز کرنے یا اس کی عمومی صلاحیتوں کو بہتر بنانے کے لیے کراس-ویلیڈیشن جیسی تکنیکوں کے استعمال پر غور کرنا چاہیے۔

اوور فٹنگ ماڈل کے سیکھنے کے منحنی خطوط کی مثال۔ ٹرین کی خرابی کم ہوتی ہے جب کہ تصدیق کی خرابی بڑھنے لگتی ہے۔ ماڈل عام کرنے سے قاصر ہے۔

ریگولرائزیشن ایک ایسی تکنیک ہے جس کا استعمال مشین لرننگ ماڈلز میں تغیر کی خرابی کو کم کرنے کے لیے کیا جا سکتا ہے، جس سے تعصب کے فرق کو دور کرنے میں مدد ملتی ہے۔ ریگولرائزیشن کی مختلف تکنیکیں ہیں، جن میں سے ہر ایک کے اپنے فوائد اور نقصانات ہیں۔ ریگولرائزیشن کی کچھ مشہور تکنیکوں میں ریج ریگریشن، لاسو ریگریشن، اور لچکدار نیٹ ریگولرائزیشن شامل ہیں۔ یہ تمام تکنیکیں ماڈل کے معروضی فنکشن میں جرمانے کی اصطلاح شامل کر کے اوور فٹنگ کو روکنے میں مدد کرتی ہیں، جو انتہائی پیرامیٹر اقدار کی حوصلہ شکنی کرتی ہے اور آسان ماڈلز کی حوصلہ افزائی کرتی ہے۔

رج رجعتL2 ریگولرائزیشن کے نام سے بھی جانا جاتا ہے، ماڈل پیرامیٹرز کے مربع کے متناسب جرمانے کی اصطلاح کا اضافہ کرتا ہے۔ اس تکنیک کے نتیجے میں چھوٹے پیرامیٹر کی قدروں کے ساتھ ماڈلز نکلتے ہیں، جس کی وجہ سے فرق کم ہو سکتا ہے اور عمومیت کو بہتر بنایا جا سکتا ہے۔ تاہم، یہ فیچر سلیکشن کو انجام نہیں دیتا، اس لیے تمام فیچرز ماڈل میں ہی رہتے ہیں۔

بہترین طرز عمل، صنعت کے لیے منظور شدہ معیارات، اور چیٹ شیٹ کے ساتھ Git سیکھنے کے لیے ہمارے ہینڈ آن، عملی گائیڈ کو دیکھیں۔ گوگلنگ گٹ کمانڈز کو روکیں اور اصل میں سیکھ یہ!

لاسو رجعت، یا L1 ریگولرائزیشن، ماڈل پیرامیٹرز کی مطلق قدر کے متناسب جرمانے کی اصطلاح کا اضافہ کرتی ہے۔ یہ تکنیک کچھ پیرامیٹرز کو صفر پر سیٹ کر کے فیچر سلیکشن کو مؤثر طریقے سے انجام دیتے ہوئے، ویرل پیرامیٹر ویلیوز والے ماڈلز کی طرف لے جا سکتی ہے۔ اس کے نتیجے میں آسان ماڈل بن سکتے ہیں جن کی تشریح کرنا آسان ہے۔

لچکدار نیٹ ریگولرائزیشن L1 اور L2 ریگولرائزیشن دونوں کا ایک مجموعہ ہے، جو رج اور لاسو ریگریشن کے درمیان توازن قائم کرنے کی اجازت دیتا ہے۔ جرمانے کی دو شرائط کے درمیان تناسب کو کنٹرول کرنے سے، لچکدار نیٹ دونوں تکنیکوں کے فوائد حاصل کر سکتا ہے، جیسے بہتر جنرلائزیشن اور فیچر کا انتخاب۔

اچھے فٹنگ ماڈل کے سیکھنے کے منحنی خطوط کی مثال۔

نتیجہ

مشین لرننگ میں تعصب-تغیر تجارت کا ایک اہم تصور ہے جو ماڈل کی تاثیر اور اچھائی کا تعین کرتا ہے۔ جب کہ اعلی تعصب انڈر فٹنگ کا باعث بنتا ہے اور زیادہ تغیرات اوور فٹنگ کا باعث بنتے ہیں، دونوں کے درمیان بہترین توازن تلاش کرنا ایسے مضبوط ماڈلز کی تعمیر کے لیے ضروری ہے جو نئے ڈیٹا کو اچھی طرح سے عام کرتے ہیں۔

سیکھنے کے منحنی خطوط کی مدد سے، اوور فٹنگ یا کم فٹنگ کے مسائل کی نشاندہی کرنا ممکن ہے، اور ماڈل کی پیچیدگی کو ٹیوننگ کرکے یا ریگولرائزیشن تکنیکوں کو لاگو کرکے، تربیت اور توثیق کے ڈیٹا کے ساتھ ساتھ ٹیسٹ ڈیٹا دونوں پر کارکردگی کو بہتر بنانا ممکن ہے۔

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹوآئ اسٹریم۔ ویب 3 ڈیٹا انٹیلی جنس۔ علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- ایڈریین ایشلے کے ساتھ مستقبل کا نقشہ بنانا۔ یہاں تک رسائی حاصل کریں۔

- PREIPO® کے ساتھ PRE-IPO کمپنیوں میں حصص خریدیں اور بیچیں۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://stackabuse.com/the-bias-variance-trade-off-in-machine-learning/

- : ہے

- : نہیں

- :کہاں

- 1

- 12

- 20

- 8

- a

- کی صلاحیت

- قابلیت

- ہمارے بارے میں

- مطلق

- درست طریقے سے

- حاصل

- حصول

- اصل میں

- انہوں نے مزید کہا

- پتہ

- جوڑتا ہے

- فوائد

- مشورہ

- پر اثر انداز

- کو متاثر

- یلگورتم

- تمام

- اجازت دے رہا ہے

- بھی

- an

- اور

- کوئی بھی

- کیا

- مضمون

- AS

- متوازن

- توازن

- BE

- کیونکہ

- فوائد

- کے درمیان

- تعصب

- سرحد

- دونوں

- عمارت

- لیکن

- by

- حساب

- کر سکتے ہیں

- صلاحیتوں

- قبضہ

- کیس

- تبدیل کرنے

- منتخب کریں

- قریب سے

- مجموعہ

- موازنہ

- پیچیدہ

- پیچیدگی

- تصور

- غور کریں

- کنٹرولنگ

- کور

- درست

- اہم

- اعداد و شمار

- نمٹنے کے

- کم ہے

- اس بات کا تعین

- یہ تعین

- فرق

- مختلف

- دکھاتا ہے

- تقسیم

- کرتا

- دو

- ہر ایک

- اس سے قبل

- آسان

- مؤثر طریقے

- تاثیر

- حوصلہ افزائی

- کافی

- خرابی

- نقائص

- بھی

- جانچ کر رہا ہے

- مثال کے طور پر

- وضاحت

- انتہائی

- ناکامی

- ناکام رہتا ہے

- نمایاں کریں

- خصوصیات

- تلاش

- فٹ

- فٹنگ

- اتار چڑھاو

- توجہ مرکوز

- کے لئے

- تقریب

- بنیادی

- جنرل

- جاؤ

- مقصد

- اچھا

- گراؤنڈ

- رہنمائی

- ہاتھ

- ہاتھوں پر

- ہے

- مدد

- مدد

- ہائی

- اعلی

- ہور

- کس طرح

- کیسے

- تاہم

- HTTPS

- شناخت

- if

- پر عمل درآمد

- ناممکن

- کو بہتر بنانے کے

- بہتر

- in

- دیگر میں

- شامل

- شامل

- اضافہ

- اضافہ

- ان پٹ

- میں

- تعارف

- IT

- میں

- رکھیں

- جانا جاتا ہے

- L1

- l2

- قیادت

- معروف

- لیڈز

- سیکھنے

- دو

- LG

- کی طرح

- امکان

- ll

- لو

- کم

- مشین

- مشین لرننگ

- بناتا ہے

- ذکر کیا

- کم سے کم

- ماڈل

- ماڈل

- زیادہ

- ضروری

- خالص

- نئی

- شور

- تعداد

- مقصد

- of

- اکثر

- on

- زیادہ سے زیادہ

- or

- دیگر

- ہمارے

- باہر

- پیداوار

- خود

- پیرامیٹر

- پیرامیٹرز

- پاٹرن

- انجام دیں

- کارکردگی

- کارکردگی کا مظاہرہ

- کارکردگی کا مظاہرہ

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- غریب

- مقبول

- ممکن

- عملی

- پریکٹس

- پیشن گوئی

- کی پیشن گوئی

- کی روک تھام

- مسائل

- عمل

- فراہم

- بلکہ

- تناسب

- کو کم

- کم

- مراد

- متعلقہ

- تعلقات

- تعلقات

- رہے

- کی نمائندگی

- نتیجہ

- نتیجے

- نتائج کی نمائش

- ٹھیک ہے

- رنگ

- مضبوط

- s

- انتخاب

- حساسیت

- قائم کرنے

- شیڈو

- شیٹ

- مختصر

- ہونا چاہئے

- سادہ

- بیک وقت

- چھوٹے

- چھوٹے

- So

- کچھ

- ذرائع

- چوک میں

- Stackabuse

- معیار

- بند کرو

- مضبوط

- اس طرح

- پتہ چلتا ہے

- تکنیک

- اصطلاح

- شرائط

- ٹیسٹ

- سے

- کہ

- ۔

- ان

- ان

- وہاں.

- یہ

- وہ

- اس

- بھر میں

- کرنے کے لئے

- بھی

- کے آلے

- کل

- ٹرین

- ٹریننگ

- منتقلی

- سچ

- حقیقت

- کوشش

- دو

- عام طور پر

- قابل نہیں

- بنیادی

- نامعلوم

- استعمال کیا جاتا ہے

- کا استعمال کرتے ہوئے

- توثیق

- قیمت

- اقدار

- بہت

- we

- اچھا ہے

- کیا

- چاہے

- جس

- جبکہ

- گے

- ساتھ

- الفاظ

- زیفیرنیٹ

- صفر