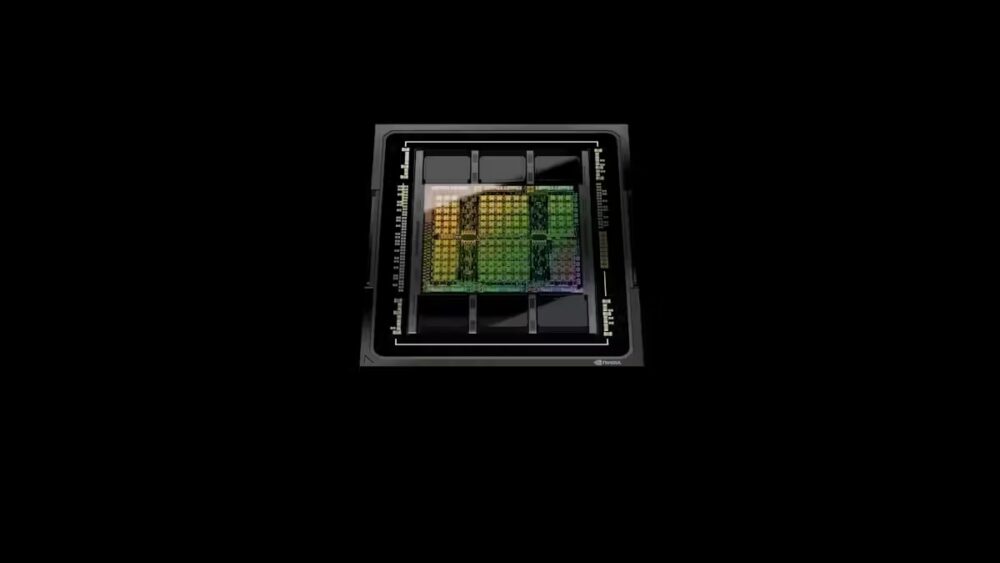

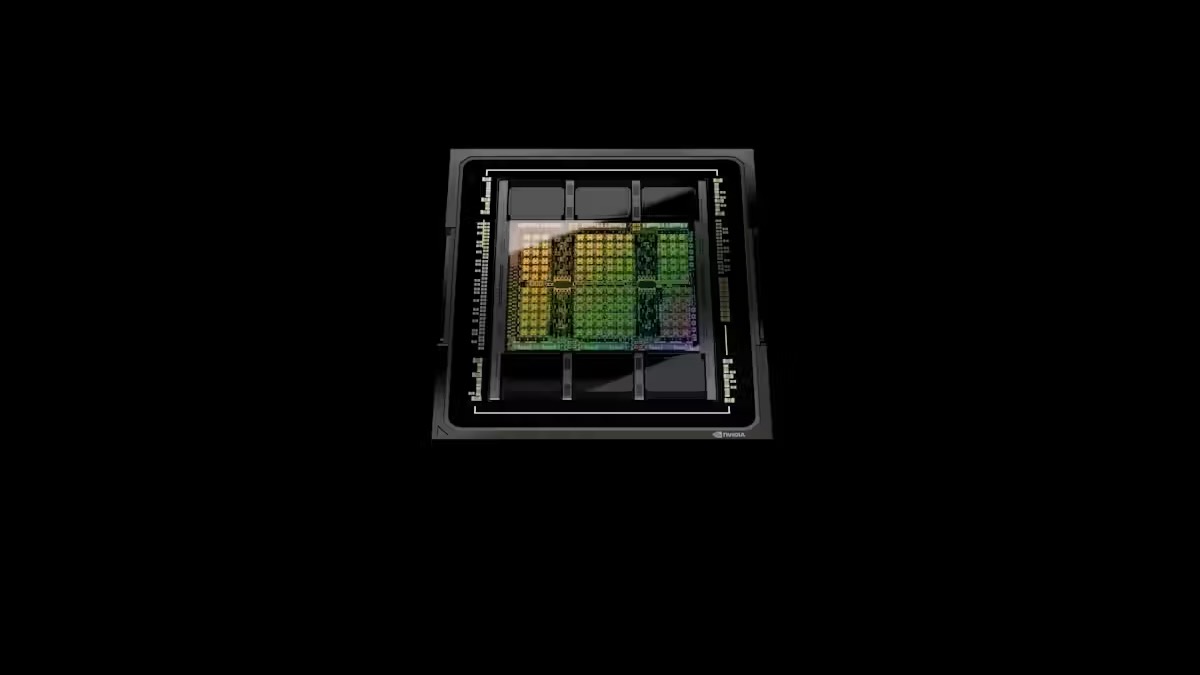

جیسا کہ دنیا AI ٹیکنالوجیز کی تازہ ترین لہر کو استعمال کرنے کے لیے تیزی سے بڑھ رہی ہے، ہائی ٹیک ہارڈویئر کا ایک ٹکڑا حیرت انگیز طور پر گرم چیز بن گیا ہے: گرافکس پروسیسنگ یونٹ، یا GPU۔

ایک ٹاپ آف دی لائن GPU فروخت کر سکتا ہے۔ ہزاروں ڈالر، اور معروف مینوفیکچرر Nvidia نے اپنی مارکیٹ کی قیمت دیکھی ہے۔ 2 ٹریلین ڈالر سے زیادہ ہے۔ جیسا کہ اس کی مصنوعات کی مانگ میں اضافہ ہوتا ہے۔

GPUs صرف اعلی درجے کی AI مصنوعات نہیں ہیں۔ فونز، لیپ ٹاپس اور گیمنگ کنسولز میں بھی کم طاقتور GPUs ہیں۔

اب تک آپ شاید سوچ رہے ہوں گے: واقعی جی پی یو کیا ہے؟ اور کیا انہیں اتنا خاص بناتا ہے؟

GPU کیا ہے؟

GPUs کو بنیادی طور پر پیچیدہ 3D مناظر اور اشیاء کو تیزی سے بنانے اور ڈسپلے کرنے کے لیے ڈیزائن کیا گیا تھا، جیسے کہ ویڈیو گیمز اور کمپیوٹر سے تعاون یافتہ ڈیزائن سافٹ ویئر جدید GPUs جیسے کاموں کو بھی سنبھالتے ہیں۔ ڈیکمپریسنگ ویڈیو اسٹریمز

زیادہ تر کمپیوٹرز کا "دماغ" ایک چپ ہے جسے مرکزی پروسیسنگ یونٹ (CPU) کہا جاتا ہے۔ CPUs کا استعمال گرافیکل سینز بنانے اور ویڈیوز کو ڈیکمپریس کرنے کے لیے کیا جا سکتا ہے، لیکن وہ عام طور پر GPUs کے مقابلے ان کاموں میں بہت سست اور کم موثر ہوتے ہیں۔ CPUs عام کمپیوٹنگ کے کاموں کے لیے بہتر موزوں ہیں، جیسے کہ ورڈ پروسیسنگ اور براؤزنگ ویب صفحات۔

GPUs CPUs سے کیسے مختلف ہیں؟

ایک عام جدید سی پی یو 8 اور 16 کے درمیان ہوتا ہے۔cores"جن میں سے ہر ایک ترتیب وار طریقے سے پیچیدہ کاموں پر کارروائی کر سکتا ہے۔

دوسری طرف، GPUs میں نسبتاً ہزاروں چھوٹے کور ہوتے ہیں، جو ایک ہی وقت میں تمام کام کرنے کے لیے بنائے گئے ہیں ("متوازی") تیزی سے مجموعی پروسیسنگ حاصل کرنے کے لیے۔ یہ انہیں ان کاموں کے لیے موزوں بنا دیتا ہے جن کے لیے ایک کے بعد ایک کے بجائے ایک ہی وقت میں کیے جانے والے سادہ آپریشنز کی ایک بڑی تعداد کی ضرورت ہوتی ہے۔

روایتی GPUs دو اہم ذائقوں میں آتے ہیں۔

سب سے پہلے، اسٹینڈ لون چپس ہیں، جو اکثر بڑے ڈیسک ٹاپ کمپیوٹرز کے لیے ایڈ آن کارڈز میں آتے ہیں۔ دوسرے ایک ہی چپ پیکج میں ایک CPU کے ساتھ مل کر GPUs ہیں، جو اکثر لیپ ٹاپ اور گیم کنسولز جیسے کہ PlayStation 5 میں پائے جاتے ہیں۔ دونوں صورتوں میں، CPU کنٹرول کرتا ہے کہ GPU کیا کرتا ہے۔

GPUs AI کے لیے اتنے کارآمد کیوں ہیں؟

اس سے پتہ چلتا ہے کہ GPUs کو گرافیکل مناظر پیدا کرنے سے زیادہ کرنے کے لئے دوبارہ تیار کیا جاسکتا ہے۔

پیچھے مشین سیکھنے کی تکنیک کے بہت سے مصنوعی ذہانت، جیسے گہرے عصبی نیٹ ورکمیٹرکس ضرب کی مختلف شکلوں پر بہت زیادہ انحصار کریں۔

یہ ایک ریاضیاتی عمل ہے جہاں اعداد کے بہت بڑے سیٹوں کو ایک ساتھ ضرب اور جمع کیا جاتا ہے۔ یہ آپریشنز متوازی پروسیسنگ کے لیے موزوں ہیں اور اس لیے GPUs کے ذریعے بہت تیزی سے انجام دیے جا سکتے ہیں۔

GPUs کے لیے آگے کیا ہے؟

کور کی تعداد اور ان کی آپریٹنگ رفتار میں اضافے کی وجہ سے GPUs کی تعداد کم کرنے کی صلاحیت میں مسلسل اضافہ ہو رہا ہے۔ یہ اصلاحات بنیادی طور پر کمپنیوں کی طرف سے چپ مینوفیکچرنگ میں بہتری کے ذریعے کارفرما ہیں۔ TSMC تائیوان میں

انفرادی ٹرانزسٹرز کا سائز—کسی بھی کمپیوٹر چپ کے بنیادی اجزاء—کم ہو رہا ہے، جس سے زیادہ ٹرانزسٹروں کو جسمانی جگہ کی اتنی ہی مقدار میں رکھا جا سکتا ہے۔

تاہم، یہ پوری کہانی نہیں ہے. اگرچہ روایتی GPUs AI سے متعلقہ کمپیوٹیشن کے کاموں کے لیے کارآمد ہیں، لیکن وہ بہترین نہیں ہیں۔

جس طرح GPUs کو اصل میں گرافکس کے لیے خصوصی پروسیسنگ فراہم کرکے کمپیوٹرز کو تیز کرنے کے لیے ڈیزائن کیا گیا تھا، اسی طرح ایسے ایکسلریٹر بھی ہیں جو مشین لرننگ کے کاموں کو تیز کرنے کے لیے بنائے گئے ہیں۔ ان ایکسلریٹروں کو اکثر ڈیٹا سینٹر GPUs کہا جاتا ہے۔

AMD اور Nvidia جیسی کمپنیوں کے ذریعہ بنائے گئے کچھ سب سے مشہور ایکسلریٹر، روایتی GPUs کے طور پر شروع ہوئے۔ وقت گزرنے کے ساتھ، ان کے ڈیزائن مشین سیکھنے کے مختلف کاموں کو بہتر طریقے سے سنبھالنے کے لیے تیار ہوئے، مثال کے طور پر زیادہ موثر "دماغ فلوٹنمبر کی شکل۔

دوسرے ایکسلریٹر، جیسے کہ گوگل ٹینسر پروسیسنگ یونٹس اور Tenstorrent کی ٹینسکس کورگہرے نیورل نیٹ ورک کو تیز کرنے کے لیے زمین سے ڈیزائن کیا گیا تھا۔

ڈیٹا سینٹر GPUs اور دیگر AI ایکسلریٹر عام طور پر روایتی GPU ایڈ آن کارڈز کے مقابلے میں نمایاں طور پر زیادہ میموری کے ساتھ آتے ہیں، جو کہ بڑے AI ماڈلز کی تربیت کے لیے بہت ضروری ہے۔ AI ماڈل جتنا بڑا ہوگا، اتنا ہی زیادہ قابل اور درست ہوگا۔

تربیت کو مزید تیز کرنے اور اس سے بھی بڑے AI ماڈلز کو ہینڈل کرنے کے لیے، جیسے ChatGPT، بہت سے ڈیٹا سینٹر GPUs کو ایک سپر کمپیوٹر بنانے کے لیے اکٹھا کیا جا سکتا ہے۔ دستیاب نمبر کرنچنگ پاور کو صحیح طریقے سے استعمال کرنے کے لیے اس کے لیے مزید پیچیدہ سافٹ ویئر کی ضرورت ہے۔ ایک اور نقطہ نظر ہے ایک بہت بڑا ایکسلریٹر بنائیںجیسے کہ "ویفر پیمانے پروسیسر" Cerebras کے ذریعہ تیار کردہ۔

کیا خصوصی چپس مستقبل ہیں؟

CPUs بھی ابھی تک نہیں کھڑے ہیں۔ AMD اور Intel کے حالیہ CPUs میں بلٹ ان نچلی سطح کی ہدایات ہیں جو گہرے اعصابی نیٹ ورکس کے لیے مطلوبہ نمبر کرنچنگ کو تیز کرتی ہیں۔ یہ اضافی فعالیت بنیادی طور پر "تخلیق" کے کاموں میں مدد کرتی ہے - یعنی، AI ماڈلز کا استعمال کرتے ہوئے جو پہلے ہی کہیں اور تیار ہو چکے ہیں۔

AI ماڈلز کو پہلے جگہ پر تربیت دینے کے لیے، بڑے GPU جیسے ایکسلریٹر کی اب بھی ضرورت ہے۔

مخصوص مشین لرننگ الگورتھم کے لیے پہلے سے زیادہ خصوصی ایکسلریٹر بنانا ممکن ہے۔ حال ہی میں، مثال کے طور پر، Groq نامی کمپنی نے ایک "زبان پروسیسنگ یونٹ” (LPU) خاص طور پر ChatGPT کی خطوط پر بڑے لینگویج ماڈل چلانے کے لیے ڈیزائن کیا گیا ہے۔

تاہم، ان خصوصی پروسیسرز کو بنانے میں انجینئرنگ کے کافی وسائل درکار ہوتے ہیں۔ تاریخ سے پتہ چلتا ہے کہ کسی بھی مشین لرننگ الگورتھم کا استعمال اور مقبولیت عروج پر ہوتی ہے اور پھر ختم ہوجاتی ہے — اس لیے مہنگا خصوصی ہارڈ ویئر جلد پرانا ہو سکتا ہے۔

اوسط صارفین کے لیے، تاہم، یہ ایک مسئلہ ہونے کا امکان نہیں ہے۔ آپ کے استعمال کردہ پروڈکٹس میں GPUs اور دیگر چپس خاموشی سے تیز تر ہوتے رہنے کا امکان ہے۔

یہ مضمون شائع کی گئی ہے گفتگو تخلیقی العام لائسنس کے تحت. پڑھو اصل مضمون.

تصویری کریڈٹ: NVIDIA

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹو ڈیٹا ڈاٹ نیٹ ورک ورٹیکل جنریٹو اے آئی۔ اپنے آپ کو بااختیار بنائیں۔ یہاں تک رسائی حاصل کریں۔

- پلیٹوآئ اسٹریم۔ ویب 3 انٹیلی جنس۔ علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- پلیٹو ای ایس جی۔ کاربن، کلین ٹیک، توانائی ، ماحولیات، شمسی، ویسٹ مینجمنٹ یہاں تک رسائی حاصل کریں۔

- پلیٹو ہیلتھ۔ بائیوٹیک اینڈ کلینیکل ٹرائلز انٹیلی جنس۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://singularityhub.com/2024/03/13/what-is-a-gpu-the-chips-powering-the-ai-boom-and-why-theyre-worth-trillions/

- : ہے

- : ہے

- : نہیں

- :کہاں

- $UP

- 16

- 3d

- 8

- a

- رفتار کو تیز تر

- ایکسلریٹر

- درست

- حاصل

- اضافت

- ایڈیشنل

- کے بعد

- AI

- اے آئی ماڈلز

- یلگورتم

- یلگوردمز

- تمام

- اجازت دے رہا ہے

- ساتھ

- پہلے ہی

- بھی

- AMD

- رقم

- اور

- ایک اور

- کوئی بھی

- نقطہ نظر

- کیا

- مضمون

- AS

- At

- دستیاب

- اوسط

- بنیادی

- BE

- بن

- رہا

- پیچھے

- بہتر

- کے درمیان

- بوم

- دونوں

- براؤزنگ

- تعمیر میں

- لیکن

- by

- کہا جاتا ہے

- کر سکتے ہیں

- صلاحیت رکھتا

- کارڈ

- مقدمات

- سینٹر

- مرکزی

- چیٹ جی پی ٹی

- چپ

- چپس

- COM

- مل کر

- کس طرح

- شے

- عمومی

- کمپنیاں

- کمپنی کے

- مقابلے میں

- پیچیدہ

- اجزاء

- حساب

- کمپیوٹر

- کمپیوٹر

- کافی

- کنسولز

- صارفین

- کنٹرول

- تخلیق

- تخلیق

- تخلیقی

- کریڈٹ

- اہم

- اعداد و شمار

- ڈیٹا سینٹر

- گہری

- ڈیمانڈ

- ڈیزائن

- ڈیزائن

- ڈیسک ٹاپ

- ترقی یافتہ

- مختلف

- دکھائیں

- do

- کرتا

- کیا

- کارفرما

- دو

- ہر ایک

- ہنر

- یا تو

- دوسری جگہوں پر

- انجنیئرنگ

- پوری

- بھی

- کبھی نہیں

- وضع

- مثال کے طور پر

- مہنگی

- دور

- فاسٹ

- تیز تر

- پہلا

- کے لئے

- فارم

- فارمیٹ

- فارم

- ملا

- سے

- فعالیت

- مزید

- مستقبل

- کھیل ہی کھیل میں

- کھیل

- گیمنگ

- جنرل

- پیدا

- حاصل کرنے

- دی

- گوگل

- GPU

- GPUs

- گرافکس

- گراؤنڈ

- ہاتھ

- ہینڈل

- ہارڈ ویئر

- کنٹرول

- ہے

- بھاری

- مدد کرتا ہے

- لہذا

- ہائی اینڈ

- تاریخ

- HOT

- تاہم

- HTTPS

- بہتری

- in

- اضافہ

- انفرادی

- ہدایات

- انٹیل

- ملوث

- IT

- میں

- JPEG

- صرف

- رکھیں

- زبان

- لیپ ٹاپ

- بڑے

- بڑے

- تازہ ترین

- معروف

- سیکھنے

- کم

- لائسنس

- امکان

- لائنوں

- مشین

- مشین لرننگ

- بنا

- مین

- بنیادی طور پر

- بنا

- بناتا ہے

- انداز

- ڈویلپر

- مینوفیکچرنگ

- بہت سے

- مارکیٹ

- ریاضیاتی

- میٹرکس

- مئی..

- یاد داشت

- ماڈل

- ماڈل

- جدید

- زیادہ

- زیادہ موثر

- سب سے زیادہ

- سب سے زیادہ مقبول

- ضرب

- ضرورت

- نیٹ ورک

- عصبی

- نیند نیٹ ورک

- اگلے

- اب

- تعداد

- تعداد

- NVIDIA

- اشیاء

- of

- اکثر

- on

- ایک

- کام

- آپریشن

- آپریشنز

- زیادہ سے زیادہ

- or

- اصل میں

- دیگر

- باہر

- فرسودہ

- پر

- مجموعی طور پر

- پیکج

- صفحات

- متوازی

- گزشتہ

- چوٹی

- کارکردگی

- فونز

- جسمانی

- ٹکڑا

- مقام

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- پلے اسٹیشن

- پلے اسٹیشن 5

- مقبول

- مقبولیت

- ممکن

- طاقت

- طاقتور

- طاقتور

- بنیادی طور پر

- شاید

- مسئلہ

- عمل

- پروسیسنگ

- پروسیسرز

- تیار

- حاصل

- مناسب طریقے سے

- فراہم کرنے

- صلاحیت

- جلدی سے

- خاموشی سے

- بلکہ

- پڑھیں

- واقعی

- حال ہی میں

- حال ہی میں

- کہا جاتا ہے

- نسبتا

- انحصار کرو

- کی ضرورت

- ضرورت

- کی ضرورت ہے

- وسائل

- رائٹرز

- اضافہ

- چل رہا ہے

- اسی

- مناظر

- دوسری

- دیکھا

- فروخت

- سیٹ

- شوز

- نمایاں طور پر

- سادہ

- ایک

- سائز

- چھوٹے

- So

- سافٹ ویئر کی

- خلا

- خصوصی

- خصوصی

- مخصوص

- خاص طور پر

- تیزی

- رفتار

- اسٹینڈ

- کھڑے

- شروع

- مسلسل

- ابھی تک

- کہانی

- اسٹریمز

- اس طرح

- مناسب

- خلاصہ

- سپر کمپیوٹر

- امدادی

- سورج

- حیرت کی بات ہے

- تائیوان

- لیتا ہے

- کاموں

- تکنیک

- ٹیکنالوجی

- رجحان

- سے

- کہ

- ۔

- مستقبل

- دنیا

- ان

- ان

- تو

- وہاں.

- یہ

- وہ

- اس

- ان

- ہزاروں

- وقت

- کرنے کے لئے

- مل کر

- بھی

- روایتی

- ٹرین

- ٹریننگ

- ٹریلین

- دیتا ہے

- دو

- ٹھیٹھ

- عام طور پر

- کے تحت

- یونٹ

- امکان نہیں

- استعمال

- استعمال کی شرائط

- استعمال کیا جاتا ہے

- مفید

- کا استعمال کرتے ہوئے

- تشخیص

- مختلف

- بہت

- ویڈیو

- ویڈیو گیمز

- ویڈیوز

- لہر

- ویب

- تھے

- کیا

- کیا ہے

- جس

- جبکہ

- کیوں

- وکیپیڈیا

- ساتھ

- سوچ

- لفظ

- کام

- دنیا

- قابل

- تم

- زیفیرنیٹ