Bài đăng này được viết chung với Ming (Melvin) Qin, David Bericat và Brad Genereaux từ NVIDIA.

Các nhà nghiên cứu và phát triển AI về hình ảnh y tế cần một khuôn khổ doanh nghiệp có thể mở rộng để xây dựng, triển khai và tích hợp các ứng dụng AI của họ. AWS và NVIDIA đã cùng nhau biến tầm nhìn này thành hiện thực. AWS, NVIDIA và các đối tác khác xây dựng các ứng dụng và giải pháp để giúp việc chăm sóc sức khỏe trở nên dễ tiếp cận hơn, giá cả phải chăng và hiệu quả hơn bằng cách tăng tốc kết nối đám mây cho hình ảnh doanh nghiệp. Triển khai MONAI là một trong những mô-đun chính trong MONAI (Mạng mở y tế cho trí tuệ nhân tạo) được phát triển bởi một tập đoàn gồm các nhà lãnh đạo học thuật và công nghiệp, bao gồm cả NVIDIA. Hình ảnh sức khỏe AWS (AHI) là cửa hàng hình ảnh y tế đủ điều kiện HIPAA, có khả năng mở rộng cao, hiệu quả và tiết kiệm chi phí. Chúng tôi đã phát triển trình kết nối MONAI Deploy với AHI để tích hợp các ứng dụng AI chụp ảnh y tế với độ trễ truy xuất hình ảnh dưới giây ở quy mô được hỗ trợ bởi API gốc đám mây. Các mô hình và ứng dụng MONAI AI có thể được lưu trữ trên Amazon SageMaker, là một dịch vụ được quản lý hoàn toàn để triển khai các mô hình học máy (ML) trên quy mô lớn. SageMaker đảm nhiệm việc thiết lập và quản lý các phiên bản để suy luận, đồng thời cung cấp số liệu và nhật ký tích hợp cho các điểm cuối mà bạn có thể sử dụng để giám sát và nhận cảnh báo. Nó cũng cung cấp nhiều loại Phiên bản GPU NVIDIA cho suy luận ML, cũng như nhiều tùy chọn triển khai mô hình với khả năng tự động chia tỷ lệ, bao gồm suy luận thời gian thực, suy luận không có máy chủ, suy luận không đồng bộvà biến đổi hàng loạt.

Trong bài đăng này, chúng tôi trình bày cách triển khai Gói ứng dụng MONAI (MAP) với trình kết nối với AWS HealthImaging, sử dụng điểm cuối đa mô hình SageMaker để suy luận thời gian thực và suy luận không đồng bộ. Hai tùy chọn này bao gồm phần lớn các trường hợp sử dụng quy trình suy luận hình ảnh y tế gần như theo thời gian thực.

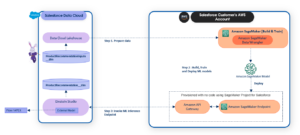

Tổng quan về giải pháp

Sơ đồ sau minh họa kiến trúc giải pháp.

Điều kiện tiên quyết

Hoàn thành các bước điều kiện tiên quyết sau:

- Sử dụng tài khoản AWS với một trong các Khu vực sau, nơi có AWS HealthImaging: Bắc Virginia (

us-east-1), Oregon (us-west-2), Ireland (eu-west-1) và Sydney (ap-southeast-2). - tạo một Xưởng sản xuất Amazon SageMaker tên miền và hồ sơ người dùng với Quản lý truy cập và nhận dạng AWS (IAM) để truy cập AWS HealthImaging.

- Kích hoạt tiện ích mở rộng JupyterLab v3 và cài đặt Imjoy-jupyter-extension nếu bạn muốn trực quan hóa hình ảnh y tế trên sổ ghi chép SageMaker một cách tương tác bằng cách sử dụng itkidgets.

Trình kết nối MAP với AWS HealthImaging

AWS HealthImaging nhập các tệp DICOM P10 và chuyển đổi chúng thành ImageSets, là bản trình bày được tối ưu hóa của chuỗi DICOM. AHI cung cấp quyền truy cập API vào siêu dữ liệu ImageSet và ImageFrames. Siêu dữ liệu chứa tất cả thuộc tính DICOM trong tài liệu JSON. ImageFrames được trả về được mã hóa trong JPEG2000 thông lượng cao (HTJ2K) dạng lossless, có thể giải mã cực nhanh. ImageSets có thể được truy xuất bằng cách sử dụng Giao diện dòng lệnh AWS (AWS CLI) hoặc AWS SDK.

MONAI là một khung AI hình ảnh y tế nhằm đưa những đột phá trong nghiên cứu và ứng dụng AI vào tác động lâm sàng. MONAI Deploy là quy trình xử lý cho phép thực hiện quy trình làm việc từ đầu đến cuối, bao gồm đóng gói, thử nghiệm, triển khai và chạy các ứng dụng AI hình ảnh y tế trong sản xuất lâm sàng. Nó bao gồm MONAI Triển khai SDK ứng dụng, MONAI triển khai nhanh, Trình quản lý luồng công việcvà Cổng tin học. SDK ứng dụng triển khai MONAI cung cấp các thuật toán và khung sẵn sàng sử dụng để tăng tốc xây dựng các ứng dụng AI hình ảnh y tế, cũng như các công cụ tiện ích để đóng gói ứng dụng vào vùng chứa MAP. Các chức năng dựa trên tiêu chuẩn tích hợp trong SDK ứng dụng cho phép MAP tích hợp trơn tru vào mạng CNTT y tế, mạng này yêu cầu sử dụng các tiêu chuẩn như DICOM, HL7 và FHIR cũng như trên các môi trường trung tâm dữ liệu và đám mây. MAP có thể sử dụng cả toán tử được xác định trước và tùy chỉnh để tải hình ảnh DICOM, lựa chọn chuỗi, suy luận mô hình và xử lý hậu kỳ

Chúng tôi đã phát triển một Mô-đun Python bằng cách sử dụng AWS HealthImaging Python SDK Boto3. Bạn có thể cài đặt nó và sử dụng chức năng trợ giúp để truy xuất các phiên bản Cặp đối tượng dịch vụ (SOP) DICOM như sau:

!pip install -q AHItoDICOMInterface

from AHItoDICOMInterface.AHItoDICOM import AHItoDICOM

helper = AHItoDICOM()

instances = helper.DICOMizeImageSet(datastore_id=datastoreId , image_set_id=next(iter(imageSetIds)))Các phiên bản SOP đầu ra có thể được hiển thị bằng cách sử dụng trình xem hình ảnh y tế 3D tương tác itkwidgets sau đây máy tính xách tay. Các AHItoDICOM lớp tận dụng nhiều quy trình để truy xuất song song các khung pixel từ AWS HealthImaging và giải mã các Các đốm màu nhị phân HTJ2K bằng cách sử dụng Thư viện Python OpenJPEG. ImageSetIds đến từ các tệp đầu ra của tác vụ nhập AWS HealthImaging nhất định. Với DatastoreId và nhập JobId, bạn có thể truy xuất ImageSetId, tương đương với UID phiên bản dòng DICOM, như sau:

imageSetIds = {}

try: response = s3.head_object(Bucket=OutputBucketName, Key=f"output/{res_createstore['datastoreId']}-DicomImport-{res_startimportjob['jobId']}/job-output-manifest.json") if response['ResponseMetadata']['HTTPStatusCode'] == 200: data = s3.get_object(Bucket=OutputBucketName, Key=f"output/{res_createstore['datastoreId']}-DicomImport-{res_startimportjob['jobId']}/SUCCESS/success.ndjson") contents = data['Body'].read().decode("utf-8") for l in contents.splitlines(): isid = json.loads(l)['importResponse']['imageSetId'] if isid in imageSetIds: imageSetIds[isid]+=1 else: imageSetIds[isid]=1

except ClientError: passVới ImageSetId, bạn có thể truy xuất riêng biệt siêu dữ liệu tiêu đề DICOM và pixel hình ảnh bằng cách sử dụng các hàm API AWS HealthImaging gốc. Các Tổng hợp nhà xuất khẩu DICOM các tiêu đề DICOM và các pixel hình ảnh vào Pydicom tập dữ liệu có thể được xử lý bởi Toán tử tải dữ liệu MAP DICOM. Bằng cách sử dụng hàm DICOMizeImageSet(), chúng tôi đã tạo một trình kết nối để tải dữ liệu hình ảnh từ AWS HealthImaging, dựa trên MAP Toán tử tải dữ liệu DICOM:

class AHIDataLoaderOperator(Operator): def __init__(self, ahi_client, must_load: bool = True, *args, **kwargs): self.ahi_client = ahi_client … def _load_data(self, input_obj: string): study_dict = {} series_dict = {} sop_instances = self.ahi_client.DICOMizeImageSet(input_obj['datastoreId'], input_obj['imageSetId'])Trong mã trước, ahi_client là một phiên bản của lớp nhà xuất khẩu AHItoDICOM DICOM, với các chức năng truy xuất dữ liệu được minh họa. Chúng tôi đã đưa toán tử tải dữ liệu mới này vào một Ứng dụng AI phân đoạn lá lách 3D được tạo bởi SDK ứng dụng triển khai MONAI. Trước tiên bạn có thể khám phá cách tạo và chạy ứng dụng này trên một phiên bản sổ ghi chép cục bộ, sau đó triển khai ứng dụng MAP này vào các điểm cuối suy luận do SageMaker quản lý.

Suy luận không đồng bộ SageMaker

một nhà hiền triết suy luận không đồng bộ điểm cuối được sử dụng cho các yêu cầu có kích thước tải trọng lớn (tối đa 1 GB), thời gian xử lý dài (tối đa 15 phút) và yêu cầu về độ trễ gần như thời gian thực. Khi không có yêu cầu nào để xử lý, tùy chọn triển khai này có thể giảm số lượng phiên bản xuống XNUMX để tiết kiệm chi phí, lý tưởng cho khối lượng công việc suy luận ML hình ảnh y tế. Thực hiện theo các bước trong mẫu máy tính xách tay để tạo và gọi điểm cuối suy luận không đồng bộ SageMaker. ĐẾN tạo điểm cuối suy luận không đồng bộ, trước tiên bạn sẽ cần tạo mô hình SageMaker và cấu hình điểm cuối. Để tạo mô hình SageMaker, bạn sẽ cần tải gói model.tar.gz có cấu trúc thư mục được xác định vào một thùng chứa Docker. Gói model.tar.gz bao gồm tệp model.ts phân đoạn lách được đào tạo trước và tệp inference.py tùy chỉnh. Chúng tôi đã sử dụng vùng chứa dựng sẵn với các phiên bản khung Python 3.8 và PyTorch 1.12.1 để tải mô hình và chạy dự đoán.

Trong tùy chỉnh suy luận.py tệp, chúng tôi khởi tạo lớp trình trợ giúp AHItoDICOM từ AHItoDICOMInterface và sử dụng nó để tạo một phiên bản MAP trong model_fn() và chúng tôi chạy ứng dụng MAP theo mọi yêu cầu suy luận trong predict_fn() chức năng:

from app import AISpleenSegApp

from AHItoDICOMInterface.AHItoDICOM import AHItoDICOM

helper = AHItoDICOM()

def model_fn(model_dir, context): … monai_app_instance = AISpleenSegApp(helper, do_run=False,path="/home/model-server") def predict_fn(input_data, model): with open('/home/model-server/inputImageSets.json', 'w') as f: f.write(json.dumps(input_data)) output_folder = "/home/model-server/output" if not os.path.exists(output_folder): os.makedirs(output_folder) model.run(input='/home/model-server/inputImageSets.json', output=output_folder, workdir='/home/model-server', model='/opt/ml/model/model.ts')Đến gọi điểm cuối không đồng bộ, bạn sẽ cần tải tải trọng đầu vào của yêu cầu lên Dịch vụ lưu trữ đơn giản của Amazon (Amazon S3), là tệp JSON chỉ định ID kho dữ liệu AWS HealthImaging và ID ImageSet để chạy suy luận trên:

sess = sagemaker.Session()

InputLocation = sess.upload_data('inputImageSets.json', bucket=sess.default_bucket(), key_prefix=prefix, extra_args={"ContentType": "application/json"})

response = runtime_sm_client.invoke_endpoint_async(EndpointName=endpoint_name, InputLocation=InputLocation, ContentType="application/json", Accept="application/json")

output_location = response["OutputLocation"]Đầu ra cũng có thể được tìm thấy trong Amazon S3.

Suy luận thời gian thực đa mô hình của SageMaker

SageMaker suy luận thời gian thực điểm cuối đáp ứng yêu cầu tương tác, độ trễ thấp. Tùy chọn này có thể lưu trữ nhiều mô hình trong một vùng chứa phía sau một điểm cuối, đây là giải pháp có thể mở rộng và tiết kiệm chi phí để triển khai một số mô hình ML. MỘT Điểm cuối đa mô hình SageMaker sử dụng Máy chủ suy luận NVIDIA Triton với GPU để chạy nhiều suy luận mô hình học sâu.

Trong phần này, chúng tôi hướng dẫn cách tạo và gọi điểm cuối đa mô hình điều chỉnh vùng chứa suy luận của riêng bạn trong những điều sau đây mẫu máy tính xách tay. Các mô hình khác nhau có thể được phân phát trong một vùng chứa chung trên cùng một nhóm tài nguyên. Điểm cuối nhiều mô hình giúp giảm chi phí triển khai và suy luận mô hình tỷ lệ dựa trên mô hình lưu lượng truy cập đến điểm cuối. Chúng tôi đã sử dụng Công cụ dành cho nhà phát triển AWS kể cả Amazon CodeCommit, Xây dựng mã Amazonvà Đường ống mã Amazon xây dựng thùng chứa tùy chỉnh cho suy luận mô hình SageMaker. Chúng tôi đã chuẩn bị một model_handler.py để mang vùng chứa của riêng bạn thay vì tệp inference.py trong ví dụ trước và triển khai các hàm khởi tạo(), preprocess() và inference():

from app import AISpleenSegApp

from AHItoDICOMInterface.AHItoDICOM import AHItoDICOM

class ModelHandler(object): def __init__(self): self.initialized = False self.shapes = None def initialize(self, context): self.initialized = True properties = context.system_properties model_dir = properties.get("model_dir") gpu_id = properties.get("gpu_id") helper = AHItoDICOM() self.monai_app_instance = AISpleenSegApp(helper, do_run=False, path="/home/model-server/") def preprocess(self, request): inputStr = request[0].get("body").decode('UTF8') datastoreId = json.loads(inputStr)['inputs'][0]['datastoreId'] imageSetId = json.loads(inputStr)['inputs'][0]['imageSetId'] with open('/tmp/inputImageSets.json', 'w') as f: f.write(json.dumps({"datastoreId": datastoreId, "imageSetId": imageSetId})) return '/tmp/inputImageSets.json' def inference(self, model_input): self.monai_app_instance.run(input=model_input, output="/home/model-server/output/", workdir="/home/model-server/", model=os.environ["model_dir"]+"/model.ts")Sau khi container được xây dựng và đẩy lên Đăng ký container đàn hồi Amazon (Amazon ECR), bạn có thể tạo mô hình SageMaker bằng nó, cùng với các gói mô hình khác nhau (tệp tar.gz) trong đường dẫn Amazon S3 nhất định:

model_name = "DEMO-MONAIDeployModel" + strftime("%Y-%m-%d-%H-%M-%S", gmtime())

model_url = "s3://{}/{}/".format(bucket, prefix)

container = "{}.dkr.ecr.{}.amazonaws.com/{}:dev".format( account_id, region, prefix )

container = {"Image": container, "ModelDataUrl": model_url, "Mode": "MultiModel"}

create_model_response = sm_client.create_model(ModelName=model_name, ExecutionRoleArn=role, PrimaryContainer=container)Điều đáng chú ý là model_url ở đây chỉ chỉ định đường dẫn đến thư mục chứa các tệp tar.gz và bạn chỉ định gói mô hình nào sẽ sử dụng để suy luận khi bạn gọi điểm cuối, như minh họa trong đoạn mã sau:

Payload = {"inputs": [ {"datastoreId": datastoreId, "imageSetId": next(iter(imageSetIds))} ]}

response = runtime_sm_client.invoke_endpoint(EndpointName=endpoint_name, ContentType="application/json", Accept="application/json", TargetModel="model.tar.gz", Body=json.dumps(Payload))Chúng ta có thể thêm nhiều mô hình hơn vào điểm cuối suy luận đa mô hình hiện có mà không cần phải cập nhật điểm cuối hoặc tạo điểm cuối mới.

Làm sạch

Đừng quên hoàn thành Xóa tài nguyên lưu trữ bước vào phòng thí nghiệm-3 và phòng thí nghiệm-4 sổ ghi chép để xóa điểm cuối suy luận SageMaker. Bạn cũng nên từ chối phiên bản sổ ghi chép SageMaker để tiết kiệm chi phí. Cuối cùng, bạn có thể gọi hàm API AWS HealthImaging hoặc sử dụng bảng điều khiển AWS HealthImaging để xóa bộ hình ảnh và kho dữ liệu đã tạo trước đó:

for s in imageSetIds.keys(): medicalimaging.deleteImageSet(datastoreId, s)

medicalimaging.deleteDatastore(datastoreId)Kết luận

Trong bài đăng này, chúng tôi đã hướng dẫn bạn cách tạo trình kết nối MAP với AWS HealthImaging, có thể tái sử dụng trong các ứng dụng được xây dựng bằng SDK ứng dụng triển khai MONAI, để tích hợp và tăng tốc truy xuất dữ liệu hình ảnh từ cửa hàng DICOM gốc trên nền tảng đám mây cho khối lượng công việc AI hình ảnh y tế . SDK triển khai MONAI có thể được sử dụng để hỗ trợ hoạt động của bệnh viện. Chúng tôi cũng đã trình diễn hai tùy chọn lưu trữ để triển khai các ứng dụng MAP AI trên SageMaker trên quy mô lớn.

Xem qua các sổ ghi chép ví dụ trong Kho GitHub để tìm hiểu thêm về cách triển khai ứng dụng MONAI trên SageMaker với hình ảnh y tế được lưu trữ trong AWS HealthImaging. Để biết AWS có thể làm gì cho bạn, hãy liên hệ với đại diện AWS.

Để biết thêm tài nguyên, hãy tham khảo các tài liệu sau:

Về các tác giả

Ming (Melvin) Tần là người đóng góp độc lập cho nhóm Chăm sóc sức khỏe tại NVIDIA, tập trung vào phát triển nền tảng và khung ứng dụng suy luận AI để đưa AI vào quy trình xử lý hình ảnh y tế. Trước khi gia nhập NVIDIA vào năm 2018 với tư cách là thành viên sáng lập của Clara, Ming đã dành 15 năm phát triển Radiology PACS và Workflow SaaS với tư cách là kỹ sư/kiến trúc sư chính tại Stentor Inc., sau đó được Philips Healthcare mua lại để hình thành Enterprise Imaging.

Ming (Melvin) Tần là người đóng góp độc lập cho nhóm Chăm sóc sức khỏe tại NVIDIA, tập trung vào phát triển nền tảng và khung ứng dụng suy luận AI để đưa AI vào quy trình xử lý hình ảnh y tế. Trước khi gia nhập NVIDIA vào năm 2018 với tư cách là thành viên sáng lập của Clara, Ming đã dành 15 năm phát triển Radiology PACS và Workflow SaaS với tư cách là kỹ sư/kiến trúc sư chính tại Stentor Inc., sau đó được Philips Healthcare mua lại để hình thành Enterprise Imaging.

David Bericat là giám đốc sản phẩm Chăm sóc sức khỏe tại NVIDIA, nơi ông lãnh đạo nhóm làm việc Triển khai Dự án MONAI để đưa AI từ nghiên cứu sang triển khai lâm sàng. Niềm đam mê của ông là thúc đẩy đổi mới y tế trên toàn cầu, biến nó thành tác động lâm sàng thực sự. Trước đây, David làm việc tại Red Hat, triển khai các nguyên tắc nguồn mở ở điểm giao thoa giữa AI, đám mây, điện toán biên và IoT. Những khoảnh khắc đáng tự hào nhất của anh bao gồm việc đi bộ đến trại căn cứ Everest và chơi bóng đá trong hơn 20 năm.

David Bericat là giám đốc sản phẩm Chăm sóc sức khỏe tại NVIDIA, nơi ông lãnh đạo nhóm làm việc Triển khai Dự án MONAI để đưa AI từ nghiên cứu sang triển khai lâm sàng. Niềm đam mê của ông là thúc đẩy đổi mới y tế trên toàn cầu, biến nó thành tác động lâm sàng thực sự. Trước đây, David làm việc tại Red Hat, triển khai các nguyên tắc nguồn mở ở điểm giao thoa giữa AI, đám mây, điện toán biên và IoT. Những khoảnh khắc đáng tự hào nhất của anh bao gồm việc đi bộ đến trại căn cứ Everest và chơi bóng đá trong hơn 20 năm.

Brad Genereaux là Trưởng nhóm toàn cầu, Liên minh chăm sóc sức khỏe tại NVIDIA, nơi ông chịu trách nhiệm về quan hệ với nhà phát triển với trọng tâm là hình ảnh y tế để tăng tốc trí tuệ nhân tạo và các giải pháp học sâu, trực quan hóa, ảo hóa và phân tích. Brad truyền bá việc áp dụng rộng rãi và tích hợp quy trình chăm sóc sức khỏe và hình ảnh y tế liền mạch vào thực hành lâm sàng hàng ngày, với hơn 20 năm kinh nghiệm trong lĩnh vực CNTT chăm sóc sức khỏe.

Brad Genereaux là Trưởng nhóm toàn cầu, Liên minh chăm sóc sức khỏe tại NVIDIA, nơi ông chịu trách nhiệm về quan hệ với nhà phát triển với trọng tâm là hình ảnh y tế để tăng tốc trí tuệ nhân tạo và các giải pháp học sâu, trực quan hóa, ảo hóa và phân tích. Brad truyền bá việc áp dụng rộng rãi và tích hợp quy trình chăm sóc sức khỏe và hình ảnh y tế liền mạch vào thực hành lâm sàng hàng ngày, với hơn 20 năm kinh nghiệm trong lĩnh vực CNTT chăm sóc sức khỏe.

Gang Fu là Kiến trúc sư giải pháp chăm sóc sức khỏe tại AWS. Ông có bằng Tiến sĩ Khoa học Dược phẩm của Đại học Mississippi và có hơn 10 năm kinh nghiệm nghiên cứu công nghệ và y sinh. Anh ấy đam mê công nghệ và tác động của nó đối với việc chăm sóc sức khỏe.

Gang Fu là Kiến trúc sư giải pháp chăm sóc sức khỏe tại AWS. Ông có bằng Tiến sĩ Khoa học Dược phẩm của Đại học Mississippi và có hơn 10 năm kinh nghiệm nghiên cứu công nghệ và y sinh. Anh ấy đam mê công nghệ và tác động của nó đối với việc chăm sóc sức khỏe.

JP Leger là Kiến trúc sư giải pháp cấp cao hỗ trợ các trung tâm y tế học thuật và quy trình xử lý hình ảnh y tế tại AWS. Ông có hơn 20 năm chuyên môn về kỹ thuật phần mềm, CNTT chăm sóc sức khỏe và hình ảnh y tế, với kinh nghiệm sâu rộng về kiến trúc hệ thống về hiệu suất, khả năng mở rộng và bảo mật trong việc triển khai phân tán khối lượng dữ liệu lớn tại cơ sở, trên đám mây và kết hợp với phân tích và AI .

JP Leger là Kiến trúc sư giải pháp cấp cao hỗ trợ các trung tâm y tế học thuật và quy trình xử lý hình ảnh y tế tại AWS. Ông có hơn 20 năm chuyên môn về kỹ thuật phần mềm, CNTT chăm sóc sức khỏe và hình ảnh y tế, với kinh nghiệm sâu rộng về kiến trúc hệ thống về hiệu suất, khả năng mở rộng và bảo mật trong việc triển khai phân tán khối lượng dữ liệu lớn tại cơ sở, trên đám mây và kết hợp với phân tích và AI .

Chris Hafey là Kiến trúc sư giải pháp chính tại Amazon Web Services. Ông có hơn 25 năm kinh nghiệm trong ngành hình ảnh y tế và chuyên xây dựng các hệ thống hiệu suất cao có thể mở rộng. Anh ấy là người tạo ra dự án nguồn mở CornerstoneJS nổi tiếng, hỗ trợ trình xem dấu chân không mã nguồn mở phổ biến OHIF. Ông đã đóng góp vào đặc tả DICOMweb và tiếp tục nỗ lực cải thiện hiệu suất của nó để xem trên web.

Chris Hafey là Kiến trúc sư giải pháp chính tại Amazon Web Services. Ông có hơn 25 năm kinh nghiệm trong ngành hình ảnh y tế và chuyên xây dựng các hệ thống hiệu suất cao có thể mở rộng. Anh ấy là người tạo ra dự án nguồn mở CornerstoneJS nổi tiếng, hỗ trợ trình xem dấu chân không mã nguồn mở phổ biến OHIF. Ông đã đóng góp vào đặc tả DICOMweb và tiếp tục nỗ lực cải thiện hiệu suất của nó để xem trên web.

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- PlatoData.Network Vertical Generative Ai. Trao quyền cho chính mình. Truy cập Tại đây.

- PlatoAiStream. Thông minh Web3. Kiến thức khuếch đại. Truy cập Tại đây.

- Trung tâmESG. Than đá, công nghệ sạch, Năng lượng, Môi trường Hệ mặt trời, Quản lý chất thải. Truy cập Tại đây.

- PlatoSức khỏe. Tình báo thử nghiệm lâm sàng và công nghệ sinh học. Truy cập Tại đây.

- nguồn: https://aws.amazon.com/blogs/machine-learning/build-a-medical-imaging-ai-inference-pipeline-with-monai-deploy-on-aws/

- : có

- :là

- :không phải

- :Ở đâu

- $ LÊN

- 1

- 10

- 100

- 12

- 15 năm

- 15%

- 20

- 20 năm

- 200

- 2018

- 25

- 3d

- 7

- 8

- a

- Giới thiệu

- học tập

- đẩy nhanh tiến độ

- tăng tốc

- truy cập

- có thể truy cập

- Tài khoản

- mua lại

- ngang qua

- thêm vào

- thêm vào

- Nhận con nuôi

- Lợi thế

- giá cả phải chăng

- AI

- Mô hình AI

- Cảnh báo

- thuật toán

- Tất cả

- Liên minh

- cho phép

- Ngoài ra

- đàn bà gan dạ

- Amazon Web Services

- an

- phân tích

- và

- api

- Truy cập API

- API

- ứng dụng

- Các Ứng Dụng

- các ứng dụng

- kiến trúc

- LÀ

- nhân tạo

- trí tuệ nhân tạo

- AS

- At

- thuộc tính

- Tự động

- có sẵn

- AWS

- cơ sở

- dựa

- BE

- trước

- sau

- y sinh

- thân hình

- cả hai

- cây đinh mất đầu

- đột phá

- mang lại

- xây dựng

- Xây dựng

- xây dựng

- được xây dựng trong

- by

- cuộc gọi

- Trại

- CAN

- mà

- trường hợp

- Trung tâm

- Trung tâm

- Clara

- tốt nghiệp lớp XNUMX

- Lâm sàng

- đám mây

- mã

- Đến

- hoàn thành

- bao gồm

- máy tính

- Cấu hình

- Kết nối

- An ủi

- tập đoàn

- liên lạc

- Container

- chứa

- nội dung

- bối cảnh

- liên tiếp

- đóng góp

- người đóng góp

- Phí Tổn

- tiết kiệm chi phí

- chi phí-hiệu quả

- Chi phí

- che

- đồng viết

- tạo

- tạo ra

- yaratıcı

- tùy chỉnh

- dữ liệu

- Trung tâm dữ liệu

- David

- sâu

- học kĩ càng

- chứng minh

- chứng minh

- triển khai

- triển khai

- triển khai

- triển khai

- Dev

- phát triển

- Nhà phát triển

- phát triển

- phát triển

- khác nhau

- phân phối

- do

- phu bến tàu

- tài liệu

- xuống

- Sớm hơn

- Cạnh

- tính toán cạnh

- hiệu quả

- hay

- khác

- cho phép

- Cuối cùng đến cuối

- Điểm cuối

- Kỹ Sư

- Doanh nghiệp

- môi trường

- Tương đương

- everest

- Mỗi

- hàng ngày

- ví dụ

- Trừ

- hiện tại

- kinh nghiệm

- chuyên môn

- khám phá

- mở rộng

- Trải nghiệm sâu sắc

- cực kỳ

- sai

- NHANH

- Tập tin

- Các tập tin

- Cuối cùng

- Tên

- VÒI

- Tập trung

- tập trung

- theo

- tiếp theo

- sau

- Dấu chân

- Trong

- hình thức

- định dạng

- tìm thấy

- thành lập

- Khung

- từ

- fu

- đầy đủ

- chức năng

- chức năng

- chức năng

- GitHub

- được

- Toàn cầu

- Toàn cầu

- GPU

- Nhóm

- mũ

- Có

- có

- he

- tiêu đề

- cho sức khoẻ

- chăm sóc sức khỏe

- tại đây

- hiệu suất cao

- cao

- của mình

- giữ

- bệnh viện

- chủ nhà

- tổ chức

- lưu trữ

- Độ đáng tin của

- Hướng dẫn

- HTML

- http

- HTTPS

- Hỗn hợp

- ID

- lý tưởng

- Bản sắc

- if

- minh họa

- hình ảnh

- hình ảnh

- Hình ảnh

- Va chạm

- thực hiện

- thực hiện

- nhập khẩu

- nhập khẩu

- cải thiện

- in

- Inc.

- bao gồm

- bao gồm

- bao gồm

- Bao gồm

- độc lập

- ngành công nghiệp

- sự đổi mới

- đầu vào

- đầu vào

- cài đặt, dựng lên

- ví dụ

- thay vì

- tích hợp

- hội nhập

- Sự thông minh

- tương tác

- ngã tư

- trong

- iốt

- ireland

- IT

- ITS

- Việc làm

- tham gia

- jpg

- json

- Key

- Biết

- lớn

- Độ trễ

- một lát sau

- dẫn

- các nhà lãnh đạo

- Dẫn

- LEARN

- học tập

- Dòng

- tải

- loader

- tải

- địa phương

- dài

- máy

- học máy

- Đa số

- làm cho

- quản lý

- giám đốc

- quản lý

- bản đồ

- Maps

- y khoa

- Gặp gỡ

- hội viên

- Siêu dữ liệu

- Metrics

- Phút

- ML

- Chế độ

- kiểu mẫu

- mô hình

- Modules

- Khoảnh khắc

- Màn Hình

- chi tiết

- Điểm cuối đa mô hình

- nhiều

- tự nhiên

- Cần

- mạng

- mạng

- Mới

- Không

- Không áp dụng

- Bắc

- máy tính xách tay

- đáng chú ý

- Nvidia

- vật

- of

- Cung cấp

- on

- ONE

- có thể

- mở

- mở mạng

- mã nguồn mở

- Hoạt động

- nhà điều hành

- khai thác

- tối ưu hóa

- Tùy chọn

- Các lựa chọn

- or

- Oregon

- OS

- Nền tảng khác

- đầu ra

- kết thúc

- riêng

- gói

- gói

- bao bì

- đôi

- Song song

- niềm đam mê

- đam mê

- con đường

- mô hình

- hiệu suất

- cho phép

- Dược phẩm

- Bằng tiến sĩ

- đường ống dẫn

- điểm ảnh

- nền tảng

- plato

- Thông tin dữ liệu Plato

- PlatoDữ liệu

- chơi

- thêm

- Phổ biến

- Bài đăng

- -

- quyền hạn

- thực hành

- Dự đoán

- chuẩn bị

- trước

- trước đây

- Hiệu trưởng

- nguyên tắc

- quá trình

- Xử lý

- Quy trình

- xử lý

- Sản phẩm

- giám đốc sản xuất

- Sản lượng

- dự án

- tài sản

- cung cấp

- đẩy

- Python

- ngọn đuốc

- thời gian thực

- Thực tế

- nhận

- đỏ

- Red Hat

- giảm

- xem

- khu

- vùng

- quan hệ

- đại diện

- yêu cầu

- yêu cầu

- Yêu cầu

- đòi hỏi

- nghiên cứu

- nhà nghiên cứu

- Thông tin

- phản ứng

- chịu trách nhiệm

- trở lại

- có thể tái sử dụng

- chạy

- chạy

- s

- SaaS

- nhà làm hiền triết

- Suy luận của SageMaker

- tương tự

- Lưu

- Tiết kiệm

- khả năng mở rộng

- khả năng mở rộng

- Quy mô

- mở rộng quy mô

- Khoa học

- sdk

- liền mạch

- Phần

- an ninh

- phân khúc

- lựa chọn

- TỰ

- cao cấp

- Loạt Sách

- phục vụ

- dịch vụ

- DỊCH VỤ

- bộ

- thiết lập

- một số

- hình dạng

- chia sẻ

- nên

- cho thấy

- thể hiện

- Đơn giản

- kích thước

- thông suốt

- Bóng đá

- Phần mềm

- kỹ thuật phần mềm

- giải pháp

- Giải pháp

- nguồn

- chuyên

- đặc điểm kỹ thuật

- tiêu

- tiêu chuẩn

- Bước

- Các bước

- là gắn

- hàng

- lưu trữ

- Chuỗi

- như vậy

- hỗ trợ

- Hỗ trợ

- sydney

- hệ thống

- mất

- nhóm

- Công nghệ

- Kiểm tra

- hơn

- việc này

- Sản phẩm

- cung cấp their dịch

- Them

- sau đó

- Đó

- Kia là

- điều này

- Thông qua

- thời gian

- đến

- bên nhau

- công cụ

- đối với

- giao thông

- Triton

- đúng

- thử

- XOAY

- hai

- phổ cập

- trường đại học

- Cập nhật

- sử dụng

- đã sử dụng

- người sử dang

- sử dụng

- sử dụng

- tiện ích

- nhiều

- phiên bản

- xem

- virginia

- tầm nhìn

- hình dung

- hình dung

- khối lượng

- W

- đi bộ

- muốn

- we

- web

- các dịch vụ web

- Dựa trên web

- TỐT

- Điều gì

- khi nào

- cái nào

- sẽ

- với

- ở trong

- không có

- Công việc

- làm việc

- quy trình làm việc

- Luồng công việc

- đang làm việc

- Tổ công tác

- năm

- Bạn

- trên màn hình

- zephyrnet

- không