Hôm nay, chúng tôi vui mừng thông báo khả năng tinh chỉnh các mô hình Llama 2 của Meta bằng cách sử dụng Khởi động Amazon SageMaker. Nhóm mô hình ngôn ngữ lớn (LLM) Llama 2 là tập hợp các mô hình văn bản tổng quát được đào tạo trước và tinh chỉnh có quy mô từ 7 tỷ đến 70 tỷ tham số. LLM được tinh chỉnh, được gọi là Llama-2-chat, được tối ưu hóa cho các trường hợp sử dụng hội thoại. Bạn có thể dễ dàng dùng thử các mô hình này và sử dụng chúng với SageMaker JumpStart, một trung tâm máy học (ML) cung cấp quyền truy cập vào các thuật toán, mô hình và giải pháp ML để bạn có thể nhanh chóng bắt đầu với ML. Giờ đây, bạn cũng có thể tinh chỉnh các mô hình tạo văn bản Llama 7 13 tỷ, 70 tỷ và 2 tỷ tham số trên SageMaker JumpStart bằng cách sử dụng Xưởng sản xuất Amazon SageMaker Giao diện người dùng với một vài cú nhấp chuột hoặc sử dụng SDK Python của SageMaker.

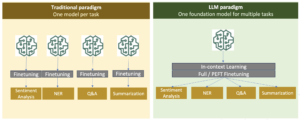

Các mô hình nền tảng AI sáng tạo đã trở thành trọng tâm của hầu hết các trường hợp sử dụng và nghiên cứu ML và trí tuệ nhân tạo trong hơn một năm nay. Các mô hình nền tảng này hoạt động rất tốt với các tác vụ tổng hợp, chẳng hạn như tạo văn bản, tóm tắt, trả lời câu hỏi, tạo hình ảnh và video, v.v., do kích thước lớn của chúng và cũng vì chúng được đào tạo trên một số bộ dữ liệu lớn và hàng trăm tác vụ. Mặc dù khả năng khái quát hóa tuyệt vời của các mô hình này, nhưng thường có những trường hợp sử dụng có dữ liệu miền rất cụ thể (chẳng hạn như dịch vụ chăm sóc sức khỏe hoặc tài chính), do đó các mô hình này có thể không mang lại kết quả tốt cho những trường hợp sử dụng này. Điều này dẫn đến nhu cầu tinh chỉnh thêm các mô hình AI tổng hợp này dựa trên dữ liệu dành riêng cho từng trường hợp sử dụng và từng miền cụ thể.

Trong bài đăng này, chúng tôi sẽ hướng dẫn cách tinh chỉnh các mô hình tạo văn bản được đào tạo trước Llama 2 thông qua SageMaker JumpStart.

Llama 2 là gì

Llama 2 là một mô hình ngôn ngữ tự hồi quy sử dụng kiến trúc máy biến áp được tối ưu hóa. Llama 2 dành cho mục đích thương mại và nghiên cứu bằng tiếng Anh. Nó có nhiều kích cỡ tham số—7 tỷ, 13 tỷ và 70 tỷ—cũng như các biến thể được đào tạo trước và tinh chỉnh. Theo Meta, các phiên bản đã điều chỉnh sử dụng tinh chỉnh có giám sát (SFT) và học tăng cường với phản hồi của con người (RLHF) để phù hợp với sở thích của con người về tính hữu ích và an toàn. Llama 2 đã được đào tạo trước trên 2 nghìn tỷ mã thông báo dữ liệu từ các nguồn có sẵn công khai. Các mô hình được điều chỉnh nhằm mục đích trò chuyện giống như trợ lý, trong khi các mô hình được đào tạo trước có thể được điều chỉnh cho nhiều tác vụ tạo ngôn ngữ tự nhiên. Bất kể nhà phát triển sử dụng phiên bản nào của mô hình, hướng dẫn sử dụng có trách nhiệm từ Meta có thể hỗ trợ hướng dẫn tinh chỉnh bổ sung có thể cần thiết để tùy chỉnh và tối ưu hóa các mô hình với các biện pháp giảm thiểu an toàn phù hợp.

Hiện tại, Llama 2 có sẵn ở các khu vực sau:

- Triển khai mô hình đào tạo sẵn có sẵn:

"us-west-2","us-east-1","us-east-2","eu-west-1","ap-southeast-1","ap-southeast-2" - Tinh chỉnh và triển khai mô hình tinh chỉnh:

“us-east-1”,“us-west-2”,“eu-west-1”

Khởi động SageMaker là gì

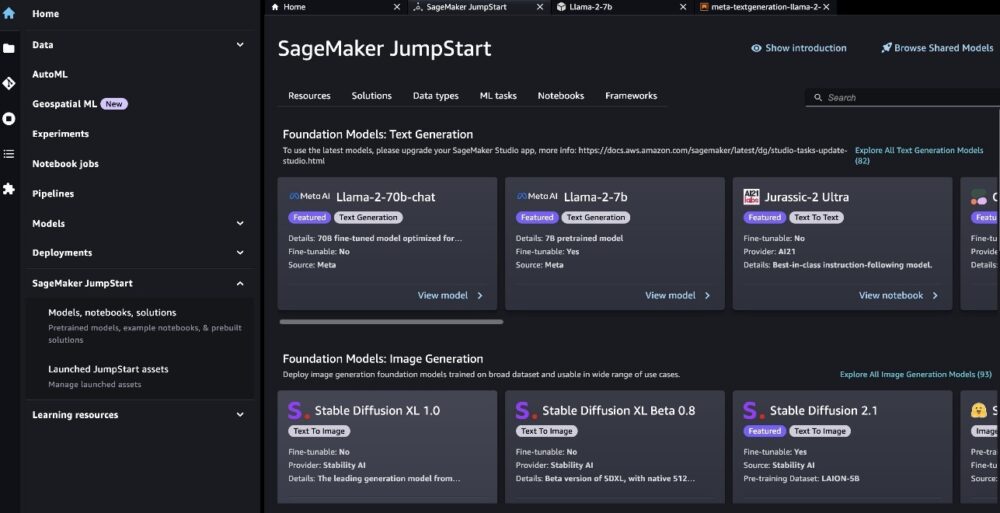

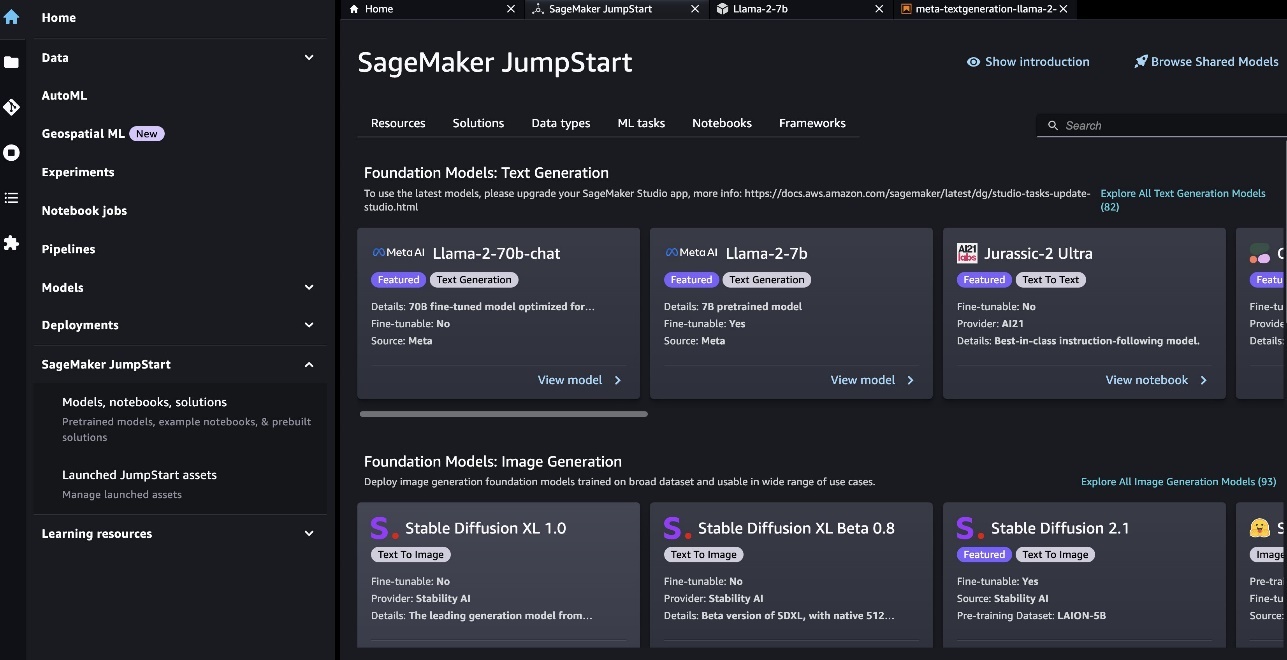

Với SageMaker JumpStart, những người thực hành ML có thể chọn từ rất nhiều mô hình nền tảng có sẵn công khai. Những người thực hành ML có thể triển khai các mô hình nền tảng cho các mục đích chuyên dụng Amazon SageMaker các phiên bản từ môi trường mạng bị cô lập và tùy chỉnh các mô hình bằng SageMaker để đào tạo và triển khai mô hình. Giờ đây, bạn có thể khám phá và triển khai Llama 2 chỉ bằng vài cú nhấp chuột trong SageMaker Studio hoặc theo chương trình thông qua SageMaker Python SDK, cho phép bạn thu được hiệu suất mô hình và các điều khiển MLOps bằng các tính năng của SageMaker như Đường ống Amazon SageMaker, Trình gỡ lỗi Amazon SageMakerhoặc nhật ký vùng chứa. Mô hình này được triển khai trong môi trường bảo mật AWS và dưới sự kiểm soát VPC của bạn, giúp đảm bảo tính bảo mật dữ liệu. Ngoài ra, bạn có thể tinh chỉnh các mô hình tạo văn bản được đào tạo trước Llama2 7B, 13B và 70B thông qua SageMaker JumpStart.

Tinh chỉnh mô hình Llama2

Bạn có thể tinh chỉnh các mô hình bằng cách sử dụng SageMaker Studio UI hoặc SageMaker Python SDK. Chúng tôi thảo luận về cả hai phương pháp trong phần này.

Tinh chỉnh không cần mã thông qua giao diện người dùng SageMaker Studio

Trong SageMaker Studio, bạn có thể truy cập các mô hình Llama 2 thông qua SageMaker JumpStart trong Mô hình, sổ ghi chép và giải pháp, như thể hiện trong ảnh chụp màn hình sau đây.

Nếu bạn không thấy mẫu Llama 2, hãy cập nhật phiên bản SageMaker Studio bằng cách tắt và khởi động lại. Để biết thêm thông tin về các bản cập nhật phiên bản, hãy tham khảo Tắt và cập nhật ứng dụng Studio.

Bạn cũng có thể tìm thấy bốn biến thể mô hình khác bằng cách chọn Khám phá tất cả các Mô hình tạo văn bản hoặc tìm kiếm llama trong hộp tìm kiếm.

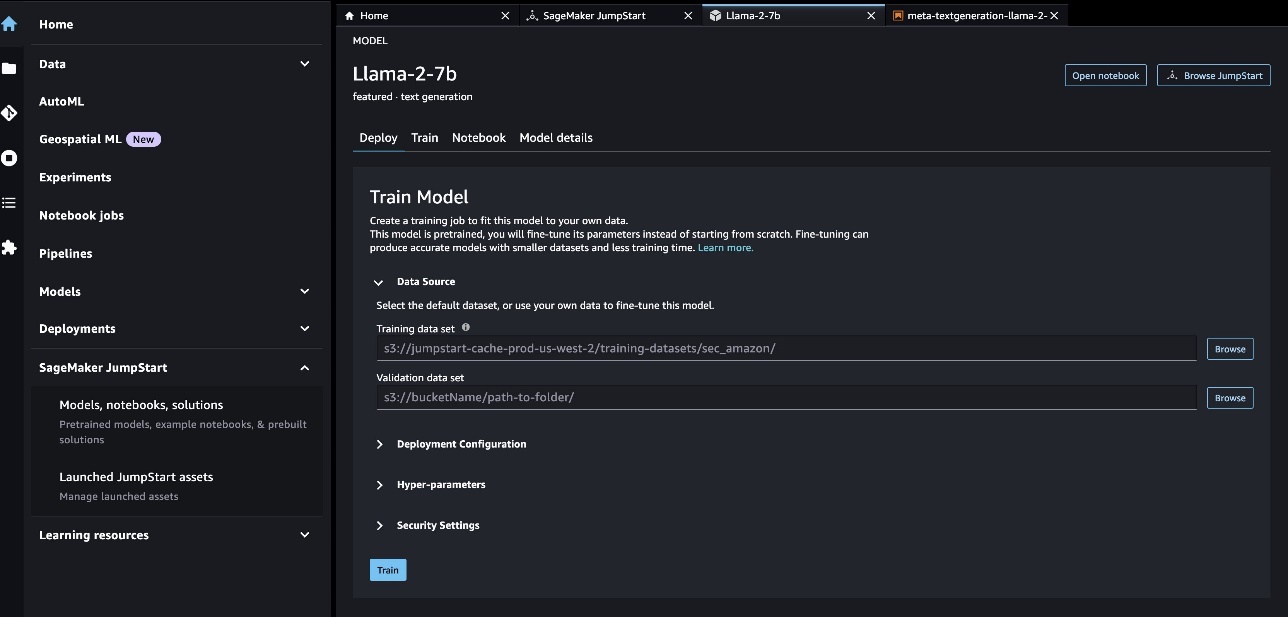

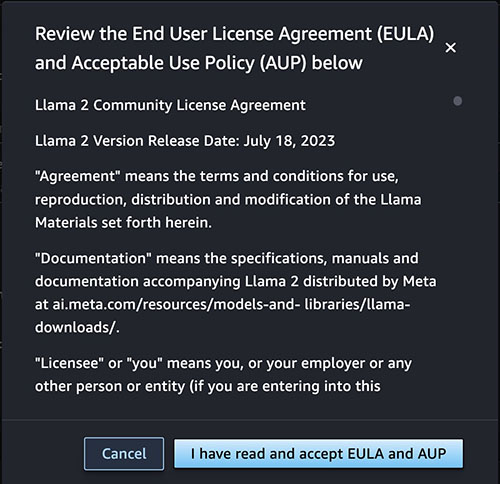

Trên trang này, bạn có thể trỏ tới Dịch vụ lưu trữ đơn giản của Amazon (Amazon S3) chứa tập dữ liệu huấn luyện và xác thực để tinh chỉnh. Ngoài ra, bạn có thể định cấu hình cấu hình triển khai, siêu tham số và cài đặt bảo mật để tinh chỉnh. Sau đó bạn có thể chọn Train để bắt đầu công việc đào tạo trên phiên bản SageMaker ML. Ảnh chụp màn hình trước hiển thị trang tinh chỉnh cho mẫu Llama-2 7B; tuy nhiên, bạn có thể tinh chỉnh các mô hình tạo văn bản 13B và 70B Llama 2 bằng cách sử dụng các trang mô hình tương ứng của chúng một cách tương tự. Để sử dụng mô hình Llama 2, bạn cần chấp nhận Thỏa thuận cấp phép người dùng cuối (EULA). Nó sẽ hiện lên khi bạn chọn Train, như minh họa trong ảnh chụp màn hình sau. Chọn Tôi đã đọc và chấp nhận EULA và AUP để bắt đầu công việc tinh chỉnh.

Triển khai mô hình

Sau khi tinh chỉnh mô hình, bạn có thể triển khai nó bằng trang mô hình trên SageMaker JumpStart. Tùy chọn triển khai mô hình tinh chỉnh sẽ xuất hiện khi quá trình tinh chỉnh hoàn tất, như minh họa trong ảnh chụp màn hình sau.

Tinh chỉnh thông qua SageMaker Python SDK

Bạn cũng có thể tinh chỉnh các mô hình Llama 2 bằng SageMaker Python SDK. Sau đây là mã mẫu để tinh chỉnh Llama 2 7B trên tập dữ liệu của bạn:

Bạn có thể triển khai mô hình tinh chỉnh trực tiếp từ công cụ ước tính:

Bạn cũng có thể tìm thấy mã trong Tinh chỉnh mô hình LLaMA 2 trên SageMaker JumpStart. Nó bao gồm chuẩn bị tập dữ liệu, đào tạo về tập dữ liệu tùy chỉnh của bạn và triển khai mô hình tinh chỉnh. Nó thể hiện việc tinh chỉnh một tập hợp con của tập dữ liệu Dolly với các ví dụ từ tác vụ tóm tắt. Sau đây là ví dụ đầu vào có phản hồi từ tinh chỉnh và không tinh chỉnh cùng với phản hồi thực tế cơ bản:

Đầu vào mô hình:

Phản hồi của Ground Truth:

Phản hồi từ mô hình không tinh chỉnh:

Phản hồi từ mô hình tinh chỉnh:

Để đo điểm chuẩn hiệu suất của các mô hình khác nhau trên bộ dữ liệu Dolly và Dialogsum, hãy tham khảo Điểm chuẩn hiệu suất phần phụ lục ở cuối bài viết này.

Kỹ thuật tinh chỉnh

Các mô hình ngôn ngữ như Llama có kích thước hơn 10 GB hoặc thậm chí 100 GB. Việc tinh chỉnh các mô hình lớn như vậy đòi hỏi các phiên bản có bộ nhớ CUDA cao đáng kể. Hơn nữa, việc đào tạo các mô hình này có thể rất chậm do kích thước của mô hình. Do đó, để tinh chỉnh hiệu quả, chúng tôi sử dụng các phương pháp tối ưu hóa sau:

- Thích ứng cấp thấp (LoRA) – Đây là loại tinh chỉnh hiệu quả tham số (PEFT) dùng để tinh chỉnh hiệu quả các mô hình lớn. Trong phần này, chúng tôi đóng băng toàn bộ mô hình và chỉ thêm một tập hợp nhỏ các tham số hoặc lớp có thể điều chỉnh vào mô hình. Chẳng hạn, thay vì đào tạo tất cả 7 tỷ tham số cho Llama 2 7B, chúng ta có thể tinh chỉnh ít hơn 1% tham số. Điều này giúp giảm đáng kể yêu cầu bộ nhớ vì chúng ta chỉ cần lưu trữ độ dốc, trạng thái tối ưu hóa và các thông tin liên quan đến đào tạo khác chỉ cho 1% tham số. Hơn nữa, điều này giúp giảm thời gian đào tạo cũng như chi phí. Để biết thêm chi tiết về phương pháp này, hãy tham khảo LoRA: Thích ứng cấp thấp của các mô hình ngôn ngữ lớn.

- Lượng tử hóa Int8 – Ngay cả với những tối ưu hóa như LoRA, những mô hình như Llama 70B vẫn quá lớn để đào tạo. Để giảm dung lượng bộ nhớ trong quá trình đào tạo, chúng ta có thể sử dụng lượng tử hóa Int8 trong quá trình đào tạo. Lượng tử hóa thường làm giảm độ chính xác của các kiểu dữ liệu dấu phẩy động. Mặc dù điều này làm giảm bộ nhớ cần thiết để lưu trữ trọng lượng mô hình nhưng nó làm giảm hiệu suất do mất thông tin. Lượng tử hóa Int8 chỉ sử dụng độ chính xác một phần tư nhưng không làm giảm hiệu suất vì nó không chỉ loại bỏ các bit. Nó làm tròn dữ liệu từ loại này sang loại khác. Để tìm hiểu về lượng tử hóa Int8, hãy tham khảo LLM.int8(): Phép nhân ma trận 8 bit cho máy biến áp ở quy mô.

- Dữ liệu song song được phân chia hoàn toàn (FSDP) – Đây là một loại thuật toán đào tạo song song dữ liệu giúp phân chia các tham số của mô hình giữa các nhân viên song song dữ liệu và có thể tùy ý giảm tải một phần tính toán đào tạo cho CPU. Mặc dù các tham số được phân chia trên các GPU khác nhau nhưng việc tính toán từng microbatch là cục bộ đối với nhân viên GPU. Nó phân chia các tham số một cách đồng nhất hơn và đạt được hiệu suất tối ưu thông qua sự chồng chéo về giao tiếp và tính toán trong quá trình đào tạo.

Bảng sau so sánh các phương pháp khác nhau với ba mô hình Llama 2.

| , | Loại phiên bản mặc định | Các loại phiên bản được hỗ trợ với cấu hình mặc định | Cài đặt mặc định | LORA + FSDP | LORA + Không có FSDP | Lượng tử hóa Int8 + LORA + Không FSDP |

| Lạc đà 2 7B | ml.g5.12xlarge | ml.g5.12xlarge, ml.g5.24xlarge, ml.g5.48xlarge | LORA + FSDP | Có | Có | Có |

| Lạc đà 2 13B | ml.g5.12xlarge | ml.g5.24xlarge, ml.g5.48xlarge | LORA + FSDP | Có | Có | Có |

| Lạc đà 2 70B | ml.g5.48xlarge | ml.g5.48xlarge | INT8 + LORA + KHÔNG FSDP | Không | Không | Có |

Lưu ý rằng việc tinh chỉnh các mô hình Llama dựa trên các tập lệnh được cung cấp bởi bên dưới Repo GitHub.

Định dạng tập dữ liệu đào tạo

SageMaker JumpStart hiện hỗ trợ các bộ dữ liệu ở cả định dạng thích ứng miền và định dạng điều chỉnh lệnh. Trong phần này, chúng tôi chỉ định một tập dữ liệu mẫu ở cả hai định dạng. Để biết thêm chi tiết, hãy tham khảo Định dạng tập dữ liệu phần trong phần phụ lục.

Định dạng thích ứng tên miền

Mô hình tạo văn bản Llama 2 có thể được tinh chỉnh trên bất kỳ tập dữ liệu dành riêng cho miền nào. Sau khi được tinh chỉnh trên tập dữ liệu dành riêng cho miền, mô hình này dự kiến sẽ tạo văn bản dành riêng cho miền và giải quyết các tác vụ NLP khác nhau trong miền cụ thể đó với lời nhắc vài lần. Với tập dữ liệu này, đầu vào bao gồm tệp CSV, JSON hoặc TXT. Ví dụ: dữ liệu đầu vào có thể là hồ sơ SEC của Amazon dưới dạng tệp văn bản:

Định dạng điều chỉnh hướng dẫn

Trong quá trình tinh chỉnh lệnh, mô hình được tinh chỉnh cho một tập hợp các tác vụ xử lý ngôn ngữ tự nhiên (NLP) được mô tả bằng các lệnh. Điều này giúp cải thiện hiệu suất của mô hình đối với các tác vụ không nhìn thấy được với lời nhắc không chụp. Trong định dạng tập dữ liệu điều chỉnh lệnh, bạn chỉ định template.json tập tin mô tả các định dạng đầu vào và đầu ra. Ví dụ: mỗi dòng trong tệp train.jsonl trông giống như sau:

Tệp bổ sung template.json trông giống như sau:

Siêu tham số được hỗ trợ cho đào tạo

Tinh chỉnh Llama 2 hỗ trợ một số siêu tham số, mỗi siêu tham số có thể tác động đến yêu cầu bộ nhớ, tốc độ đào tạo và hiệu suất của mô hình tinh chỉnh:

- kỷ nguyên – Số bước mà thuật toán tinh chỉnh thực hiện qua tập dữ liệu huấn luyện. Phải là số nguyên lớn hơn 1. Mặc định là 5.

- tỷ lệ học – Tốc độ cập nhật trọng số của mô hình sau khi làm việc qua từng đợt mẫu huấn luyện. Phải là số float dương lớn hơn 0. Mặc định là 1e-4.

- hướng dẫn_điều chỉnh – Có hướng dẫn đào tạo mô hình hay không. Cần phải '

True' hoặc là 'False'. Mặc định là 'False'. - per_device_train_batch_size – Kích thước lô trên mỗi lõi GPU/CPU để đào tạo. Phải là số nguyên dương. Mặc định là 4.

- per_device_eval_batch_size – Kích thước lô trên mỗi lõi GPU/CPU để đánh giá. Phải là số nguyên dương. Mặc định là 1.

- max_train_samples – Với mục đích gỡ lỗi hoặc đào tạo nhanh hơn, hãy cắt bớt số lượng ví dụ đào tạo về giá trị này. Giá trị -1 có nghĩa là sử dụng tất cả các mẫu huấn luyện. Phải là số nguyên dương hoặc -1. Mặc định là -1.

- max_val_samples – Để phục vụ mục đích gỡ lỗi hoặc đào tạo nhanh hơn, hãy cắt bớt số lượng ví dụ xác thực về giá trị này. Giá trị -1 có nghĩa là sử dụng tất cả các mẫu xác thực. Phải là số nguyên dương hoặc -1. Mặc định là -1.

- max_input_length – Tổng độ dài chuỗi đầu vào tối đa sau khi mã hóa. Các chuỗi dài hơn sẽ bị cắt bớt. Nếu -1,

max_input_lengthđược đặt ở mức tối thiểu là 1024 và độ dài mô hình tối đa được xác định bởi trình mã thông báo. Nếu được đặt thành giá trị dương,max_input_lengthđược đặt ở mức tối thiểu của giá trị được cung cấp vàmodel_max_lengthđược xác định bởi tokenizer. Phải là số nguyên dương hoặc -1. Mặc định là -1. - xác thực_split_ratio – Nếu kênh xác thực là

none, tỷ lệ phân tách xác thực tàu khỏi dữ liệu tàu phải nằm trong khoảng 0–1. Mặc định là 0.2. - train_data_split_seed – Nếu không có dữ liệu xác thực, thao tác này sẽ khắc phục sự phân chia ngẫu nhiên của dữ liệu huấn luyện đầu vào thành dữ liệu huấn luyện và dữ liệu xác thực được thuật toán sử dụng. Phải là số nguyên. Mặc định là 0.

- tiền xử lý_num_workers – Số lượng tiến trình được sử dụng cho quá trình tiền xử lý. Nếu như

None, quy trình chính được sử dụng để tiền xử lý. Mặc định làNone. - lora_r – Lora R. Phải là số nguyên dương. Mặc định là 8.

- lora_alpha – Lora Alpha. Phải là số nguyên dương. Mặc định là 32

- lora_dropout – Lora bỏ học. phải là số float dương trong khoảng từ 0 đến 1. Mặc định là 0.05.

- int8_quantization - Nếu

True, mô hình được tải với độ chính xác 8 bit để huấn luyện. Mặc định cho 7B và 13B làFalse. Mặc định cho 70B làTrue. - kích hoạt_fsdp - Nếu

True, đào tạo sử dụng FSDP. Mặc định cho 7B và 13B làTrue. Mặc định cho 70B làFalse. Lưu ý rằngint8_quantizationkhông được hỗ trợ với FSDP.

Các loại phiên bản và siêu tham số tương thích

Yêu cầu bộ nhớ trong quá trình tinh chỉnh có thể thay đổi dựa trên một số yếu tố:

- Loại mô hình – Model 7B có yêu cầu bộ nhớ GPU ít nhất và 70B có yêu cầu bộ nhớ lớn nhất

- Độ dài đầu vào tối đa – Giá trị độ dài đầu vào cao hơn dẫn đến việc xử lý nhiều mã thông báo hơn cùng một lúc và do đó yêu cầu nhiều bộ nhớ CUDA hơn

- Kích thước lô – Kích thước lô lớn hơn yêu cầu bộ nhớ CUDA lớn hơn và do đó yêu cầu loại phiên bản lớn hơn

- Lượng tử hóa Int8 – Nếu sử dụng lượng tử hóa Int8, mô hình được tải ở độ chính xác thấp và do đó cần ít bộ nhớ CUDA hơn

Để giúp bạn bắt đầu, chúng tôi cung cấp một tập hợp các loại phiên bản, siêu tham số và loại mô hình khác nhau có thể được tinh chỉnh thành công. Bạn có thể chọn cấu hình theo yêu cầu và tính khả dụng của các loại phiên bản. Chúng tôi tinh chỉnh cả ba mô hình trên nhiều cài đặt khác nhau với ba kỷ nguyên trên một tập hợp con của tập dữ liệu Dolly với các ví dụ tóm tắt.

mô hình 7B

Bảng sau đây tóm tắt các tùy chọn tinh chỉnh trên mẫu 7B.

| Loại sơ thẩm | Len đầu vào tối đa | Kích thước lô trên mỗi thiết bị | Lượng tử hóa Int8 | Kích hoạt FSDP | Thời gian thực hiện (phút) |

| ml.g4dn.12xlarge | 1024 | 8 | TRUE | KHÔNG ĐÚNG | 166 |

| ml.g4dn.12xlarge | 2048 | 2 | TRUE | KHÔNG ĐÚNG | 178 |

| ml.g4dn.12xlarge | 1024 | 4 | KHÔNG ĐÚNG | TRUE | 120 |

| ml.g4dn.12xlarge | 2048 | 2 | KHÔNG ĐÚNG | TRUE | 143 |

| ml.g5.2xlarge | 1024 | 4 | TRUE | KHÔNG ĐÚNG | 61 |

| ml.g5.2xlarge | 2048 | 2 | TRUE | KHÔNG ĐÚNG | 68 |

| ml.g5.2xlarge | 1024 | 4 | KHÔNG ĐÚNG | TRUE | 43 |

| ml.g5.2xlarge | 2048 | 2 | KHÔNG ĐÚNG | TRUE | 49 |

| ml.g5.4xlarge | 1024 | 4 | KHÔNG ĐÚNG | TRUE | 39 |

| ml.g5.4xlarge | 2048 | 2 | KHÔNG ĐÚNG | TRUE | 50 |

| ml.g5.12xlarge | 1024 | 16 | TRUE | KHÔNG ĐÚNG | 57 |

| ml.g5.12xlarge | 2048 | 4 | TRUE | KHÔNG ĐÚNG | 64 |

| ml.g5.12xlarge | 1024 | 4 | KHÔNG ĐÚNG | TRUE | 26 |

| ml.g5.12xlarge | 2048 | 4 | KHÔNG ĐÚNG | TRUE | 23 |

| ml.g5.48xlarge | 1024 | 16 | TRUE | KHÔNG ĐÚNG | 59 |

| ml.g5.48xlarge | 2048 | 4 | TRUE | KHÔNG ĐÚNG | 67 |

| ml.g5.48xlarge | 1024 | 8 | KHÔNG ĐÚNG | TRUE | 22 |

| ml.g5.48xlarge | 2048 | 4 | KHÔNG ĐÚNG | TRUE | 21 |

13B

Bảng sau đây tóm tắt các tùy chọn tinh chỉnh trên mẫu 13B.

| Loại sơ thẩm | Len đầu vào tối đa | Kích thước lô trên mỗi thiết bị | Lượng tử hóa Int8 | Kích hoạt FSDP | Thời gian thực hiện (phút) |

| ml.g4dn.12xlarge | 1024 | 4 | TRUE | KHÔNG ĐÚNG | 283 |

| ml.g4dn.12xlarge | 2048 | 2 | TRUE | KHÔNG ĐÚNG | 328 |

| ml.g5.12xlarge | 1024 | 8 | TRUE | KHÔNG ĐÚNG | 92 |

| ml.g5.12xlarge | 2048 | 4 | TRUE | KHÔNG ĐÚNG | 104 |

| ml.g5.48xlarge | 1024 | 8 | TRUE | KHÔNG ĐÚNG | 95 |

| ml.g5.48xlarge | 2048 | 4 | TRUE | KHÔNG ĐÚNG | 107 |

| ml.g5.48xlarge | 1024 | 8 | KHÔNG ĐÚNG | TRUE | 35 |

| ml.g5.48xlarge | 2048 | 2 | KHÔNG ĐÚNG | TRUE | 41 |

70B

Bảng sau đây tóm tắt các tùy chọn tinh chỉnh trên mẫu 70B.

| Loại sơ thẩm | Len đầu vào tối đa | Kích thước lô trên mỗi thiết bị | Lượng tử hóa Int8 | Kích hoạt FSDP | Thời gian thực hiện (phút) |

| ml.g5.48xlarge | 1024 | 4 | TRUE | KHÔNG ĐÚNG | 396 |

| ml.g5.48xlarge | 2048 | 1 | TRUE | KHÔNG ĐÚNG | 454 |

Khuyến nghị về loại phiên bản và siêu tham số

Khi tinh chỉnh độ chính xác của mô hình, hãy ghi nhớ những điều sau:

- Các model lớn hơn như 70B mang lại hiệu suất tốt hơn 7B

- Hiệu suất không có lượng tử hóa Int8 sẽ tốt hơn hiệu suất có lượng tử hóa INT8

Lưu ý thời gian đào tạo và yêu cầu bộ nhớ CUDA sau:

- Cài đặt

int8_quantization=Truegiảm yêu cầu về trí nhớ và dẫn đến việc luyện tập nhanh hơn. - Giảm

per_device_train_batch_sizevàmax_input_lengthgiảm yêu cầu bộ nhớ và do đó có thể chạy trên các phiên bản nhỏ hơn. Tuy nhiên, việc đặt giá trị rất thấp có thể làm tăng thời gian huấn luyện. - Nếu bạn không sử dụng lượng tử hóa Int8 (

int8_quantization=False), hãy sử dụng FSDP (enable_fsdp=True) để đào tạo nhanh hơn và hiệu quả hơn.

Khi chọn loại phiên bản, hãy cân nhắc những điều sau:

- Phiên bản G5 cung cấp hoạt động đào tạo hiệu quả nhất trong số các loại phiên bản được hỗ trợ. Do đó, nếu bạn có sẵn phiên bản G5, bạn nên sử dụng chúng.

- Thời gian đào tạo phần lớn phụ thuộc vào số lượng GPU và bộ nhớ CUDA có sẵn. Do đó, việc đào tạo trên các phiên bản có cùng số lượng GPU (ví dụ: ml.g5.2xlarge và ml.g5.4xlarge) gần như giống nhau. Do đó, bạn có thể sử dụng phiên bản rẻ hơn để đào tạo (ml.g5.2xlarge).

- Khi sử dụng phiên bản p3, quá trình đào tạo sẽ được thực hiện với độ chính xác 32 bit vì bfloat16 không được hỗ trợ trên các phiên bản này. Do đó, công việc đào tạo sẽ tiêu tốn gấp đôi dung lượng bộ nhớ CUDA khi đào tạo trên phiên bản p3 so với phiên bản g5.

Để tìm hiểu về chi phí đào tạo cho mỗi phiên bản, hãy tham khảo Phiên bản Amazon EC2 G5.

Nếu tập dữ liệu ở định dạng điều chỉnh lệnh và trình tự đầu vào+hoàn thành nhỏ (chẳng hạn như 50–100 từ), thì giá trị cao của max_input_length dẫn đến hiệu suất rất kém. Giá trị mặc định của tham số này là -1, tương ứng với max_input_length năm 2048 cho các mẫu Llama. Do đó, chúng tôi khuyên rằng nếu tập dữ liệu của bạn chứa các mẫu nhỏ, hãy sử dụng giá trị nhỏ cho max_input_length (chẳng hạn như 200–400).

Cuối cùng, do nhu cầu cao đối với các phiên bản G5, bạn có thể gặp phải lỗi không có sẵn các phiên bản này trong khu vực của mình. “CapacityError: Unable to provision requested ML compute capacity. Please retry using a different ML instance type.” Nếu bạn gặp lỗi này, hãy thử lại công việc đào tạo hoặc thử một Khu vực khác.

Các vấn đề khi tinh chỉnh các mô hình rất lớn

Trong phần này, chúng ta thảo luận hai vấn đề khi tinh chỉnh các mô hình rất lớn.

Vô hiệu hóa nén đầu ra

Theo mặc định, đầu ra của công việc đào tạo là mô hình đã đào tạo được nén ở định dạng .tar.gz trước khi tải lên Amazon S3. Tuy nhiên, do kích thước của mô hình lớn nên bước này có thể mất nhiều thời gian. Ví dụ: việc nén và tải lên mô hình 70B có thể mất hơn 4 giờ. Để tránh sự cố này, bạn có thể sử dụng tính năng tắt tính năng nén đầu ra được nền tảng đào tạo SageMaker hỗ trợ. Trong trường hợp này, mô hình được tải lên mà không cần nén, mô hình này sẽ được sử dụng tiếp để triển khai:

Sự cố hết thời gian chờ của kernel SageMaker Studio

Do kích thước của mô hình Llama 70B, công việc đào tạo có thể mất vài giờ và nhân SageMaker Studio có thể chết trong giai đoạn đào tạo. Tuy nhiên, trong thời gian này, quá trình đào tạo vẫn diễn ra trong SageMaker. Nếu điều này xảy ra, bạn vẫn có thể triển khai điểm cuối bằng cách sử dụng tên công việc đào tạo kèm theo mã sau:

Để tìm tên công việc đào tạo, hãy điều hướng đến bảng điều khiển SageMaker và bên dưới Hội thảo trong ngăn điều hướng, chọn Công việc đào tạo. Xác định tên công việc đào tạo và thay thế nó vào mã trước đó.

Kết luận

Trong bài đăng này, chúng tôi đã thảo luận về việc tinh chỉnh các mô hình Llama 2 của Meta bằng SageMaker JumpStart. Chúng tôi đã chỉ ra rằng bạn có thể sử dụng bảng điều khiển SageMaker JumpStart trong SageMaker Studio hoặc SageMaker Python SDK để tinh chỉnh và triển khai các mô hình này. Chúng tôi cũng thảo luận về kỹ thuật tinh chỉnh, loại phiên bản và siêu tham số được hỗ trợ. Ngoài ra, chúng tôi đã đưa ra các đề xuất để tối ưu hóa quá trình đào tạo dựa trên nhiều bài kiểm tra khác nhau mà chúng tôi đã thực hiện. Kết quả tinh chỉnh ba mô hình trên hai tập dữ liệu được trình bày ở phần phụ lục cuối bài viết. Như chúng ta có thể thấy từ những kết quả này, việc tinh chỉnh sẽ cải thiện khả năng tóm tắt so với các mô hình không tinh chỉnh. Bước tiếp theo, bạn có thể thử tinh chỉnh các mô hình này trên tập dữ liệu của riêng mình bằng cách sử dụng mã được cung cấp trong kho GitHub để kiểm tra và đánh giá kết quả cho các trường hợp sử dụng của bạn.

Các tác giả xin ghi nhận những đóng góp kỹ thuật của Christopher Whitten, Xin Huang, Kyle Ulrich, Sifei Li, Amy You, Adam Kozdrowicz, Evan Kravitz, Benjamin Crabtree, Haotian An, Manan Shah, Tony Cruz, Ernev Sharma, Jonathan Guinegagne và June Thắng.

Về các tác giả

Tiến sĩ Vivek Madan là một Nhà Khoa học Ứng dụng của nhóm Amazon SageMaker JumpStart. Ông lấy bằng Tiến sĩ tại Đại học Illinois tại Urbana-Champaign và là Nhà nghiên cứu Sau Tiến sĩ tại Georgia Tech. Anh ấy là một nhà nghiên cứu tích cực về học máy và thiết kế thuật toán và đã xuất bản các bài báo trong các hội nghị EMNLP, ICLR, COLT, FOCS và SODA.

Tiến sĩ Vivek Madan là một Nhà Khoa học Ứng dụng của nhóm Amazon SageMaker JumpStart. Ông lấy bằng Tiến sĩ tại Đại học Illinois tại Urbana-Champaign và là Nhà nghiên cứu Sau Tiến sĩ tại Georgia Tech. Anh ấy là một nhà nghiên cứu tích cực về học máy và thiết kế thuật toán và đã xuất bản các bài báo trong các hội nghị EMNLP, ICLR, COLT, FOCS và SODA.

Tiến sĩ Farooq Sabir là Kiến trúc sư giải pháp chuyên gia trí tuệ nhân tạo và học máy cao cấp tại AWS. Ông có bằng Tiến sĩ và Thạc sĩ Kỹ thuật Điện của Đại học Texas ở Austin và bằng Thạc sĩ Khoa học Máy tính của Viện Công nghệ Georgia. Anh ấy có hơn 15 năm kinh nghiệm làm việc và cũng thích giảng dạy và cố vấn cho sinh viên đại học. Tại AWS, anh giúp khách hàng hình thành và giải quyết các vấn đề kinh doanh của họ trong khoa học dữ liệu, máy học, thị giác máy tính, trí tuệ nhân tạo, tối ưu hóa số học và các lĩnh vực liên quan. Có trụ sở tại Dallas, Texas, anh ấy và gia đình thích đi du lịch và thực hiện các chuyến đi đường dài.

Tiến sĩ Farooq Sabir là Kiến trúc sư giải pháp chuyên gia trí tuệ nhân tạo và học máy cao cấp tại AWS. Ông có bằng Tiến sĩ và Thạc sĩ Kỹ thuật Điện của Đại học Texas ở Austin và bằng Thạc sĩ Khoa học Máy tính của Viện Công nghệ Georgia. Anh ấy có hơn 15 năm kinh nghiệm làm việc và cũng thích giảng dạy và cố vấn cho sinh viên đại học. Tại AWS, anh giúp khách hàng hình thành và giải quyết các vấn đề kinh doanh của họ trong khoa học dữ liệu, máy học, thị giác máy tính, trí tuệ nhân tạo, tối ưu hóa số học và các lĩnh vực liên quan. Có trụ sở tại Dallas, Texas, anh ấy và gia đình thích đi du lịch và thực hiện các chuyến đi đường dài.

Tiến sĩ Ashish Khetan là Nhà khoa học ứng dụng cấp cao của Amazon SageMaker JumpStart và giúp phát triển các thuật toán máy học. Ông lấy bằng Tiến sĩ tại Đại học Illinois Urbana-Champaign. Ông là một nhà nghiên cứu tích cực về học máy và suy luận thống kê, đồng thời đã xuất bản nhiều bài báo tại các hội nghị NeurIPS, ICML, ICLR, JMLR, ACL và EMNLP.

Tiến sĩ Ashish Khetan là Nhà khoa học ứng dụng cấp cao của Amazon SageMaker JumpStart và giúp phát triển các thuật toán máy học. Ông lấy bằng Tiến sĩ tại Đại học Illinois Urbana-Champaign. Ông là một nhà nghiên cứu tích cực về học máy và suy luận thống kê, đồng thời đã xuất bản nhiều bài báo tại các hội nghị NeurIPS, ICML, ICLR, JMLR, ACL và EMNLP.

Phụ lục

Phụ lục này cung cấp thông tin bổ sung về điểm chuẩn hiệu suất và định dạng tập dữ liệu.

Điểm chuẩn hiệu suất

Trong phần này, chúng tôi cung cấp kết quả để tinh chỉnh ba mô hình Llama 2 (7B, 13B và 70B) trên hai bộ dữ liệu khác nhau: Dolly và Hộp thoại. Đối với tập dữ liệu Dolly, nhiệm vụ của chúng tôi là tóm tắt một đoạn văn bản, trong khi đối với Dialogsum, chúng tôi tinh chỉnh mô hình để tóm tắt cuộc thảo luận giữa hai người. Trong các bảng sau, chúng tôi hiển thị thông tin đầu vào cho mô hình (lời nhắc và hướng dẫn), thông tin cơ bản (tóm tắt), phản hồi từ mô hình Llama 2 đã được huấn luyện trước và phản hồi từ mô hình Llama 2 đã tinh chỉnh cho từng mô hình trong số ba mô hình Llama 2 mẫu. Chúng tôi hiển thị kết quả suy luận cho năm điểm dữ liệu. Bạn có thể nhận thấy từ các bảng sau đây rằng các bản tóm tắt sẽ cải thiện cho cả hai tập dữ liệu khi chúng tôi tinh chỉnh các mô hình.

- Kết quả tinh chỉnh mô hình tạo văn bản Llama 2 7B trên tập dữ liệu Dolly:

| Đầu vào | Thực địa | Phản hồi từ mô hình không tinh chỉnh | Phản hồi từ mô hình tinh chỉnh |

| Dưới đây là hướng dẫn mô tả một nhiệm vụ, được ghép nối với đầu vào để cung cấp thêm ngữ cảnh. Viết phản hồi để hoàn thành yêu cầu một cách thích hợp.nn### Hướng dẫn:nAllauchnn ở đâu### Đầu vào:nAllauch (phát âm tiếng Pháp: ; Occitan: Alaug) là một xã của Pháp nằm ở phía đông Marseille trong tỉnh Bouches-du-Rhône ở vùng Provence-Alpes-Côte d'Azur của Pháp.nnCư dân trong xã được gọi là Allaudiens hoặc Allaudiennes trong tiếng Pháp.nnnn### Phản hồi:n | Allauch là một xã của Pháp nằm ở phía đông Marseille, thuộc tỉnh Bouches-du-Rhône, vùng Provence-Alpes-Côte d'Azur của Pháp.nn Cư dân của xã này được gọi là Allaudiens hoặc Allaudiennes trong tiếng Pháp. | Allauch là một thị trấn nằm cách Marseille 28 km về phía đông, thuộc tỉnh Bouches-du-Rhône, vùng Provence-Alpes-Côte d'Azur của Pháp. Nó được coi là một trong những ngôi làng đẹp nhất ở Pháp. Thị trấn được bao quanh bởi những ngọn đồi và vườn nho và có dân số khoảng 6,000 người. Nó được đề cập lần đầu tiên vào năm 1006 và có ý nghĩa phong phú | Xã nằm trên cao nguyên đá tên là Massif du Gélas, nằm ở phía đông Marseille. Nó có một cái nhìn tuyệt đẹp về Marseille và bờ biển của nó. Allauch hiện là một xã phát triển tốt với tòa thị chính riêng và một loạt cửa hàng, quán bar và nhà hàng. Do vị trí nằm giữa Marseille và Alpilles nên nó vẫn giữ được nhiều đặc điểm tự nhiên của khu vực, bao gồm Khối núi Glandes, còn được gọi là “W”. |

| Dưới đây là hướng dẫn mô tả một nhiệm vụ, được ghép nối với đầu vào để cung cấp thêm ngữ cảnh. Viết câu trả lời để hoàn thành yêu cầu một cách thích hợp.nn### Hướng dẫn:nĐộng vật có vú đẻ trứng là gì?nn### Đầu vào:nThú mỏ vịt (Ornithorhynchus anatinus), đôi khi còn được gọi là thú mỏ vịt, là loài bán thủy sản, trứng -là loài động vật có vú đặc hữu ở miền đông Australia, bao gồm cả Tasmania. Thú mỏ vịt là đại diện còn sống hoặc đơn vị phân loại đơn loài duy nhất của họ (Ornithorhynchidae) và chi (Ornithorhynchus), mặc dù một số loài có liên quan xuất hiện trong hồ sơ hóa thạch.nnnn### Phản hồi:n | Thú mỏ vịt là loài động vật có vú đẻ trứng được tìm thấy ở miền đông Australia. Nó là đại diện còn sống duy nhất trong chi Ornithorhynchus. | Tôi đã nghiên cứu khá nhiều về câu hỏi của bạn. Tôi đã đọc tất cả thông tin bạn cung cấp trong đoạn thứ hai. Tôi cũng đọc một chút về thú mỏ vịt, bao gồm cả [trang này](https://phys.org/news/2019-04-australia-platypus-predator-species.html). Tôi nghĩ rằng tôi đã tìm thấy một số câu trả lời cho câu hỏi của bạn. Bạn đang hỏi liệu thú mỏ vịt có phải là động vật có vú đẻ trứng hay không? | Động vật có vú đẻ trứng giống thú mỏ vịt |

| Dưới đây là hướng dẫn mô tả một nhiệm vụ, được ghép nối với đầu vào để cung cấp thêm ngữ cảnh. Viết câu trả lời hoàn thành yêu cầu một cách thích hợp.nn### Hướng dẫn:nFelix Luna chết khi nào?nn### Đầu vào:nFélix César Luna (30 tháng 1925 năm 5 – 2009 tháng XNUMX năm XNUMX) là một nhà văn, nhà viết lời và nhà sử học người Argentina.nnnn# ## Phản hồi: n | Felix Luna qua đời vào ngày 5 tháng 2009 năm XNUMX | Félix César Luna (30 tháng 1925 năm 5 – 2009 tháng 1102 năm XNUMX) là người Argentinann Luna chết khi nào?nnn### Giải thích:nChúng tôi trả lời câu hỏi với ngày sinh và ngày mất của người nhập.nnn### Giải pháp: XNUMXn | Félix Luna qua đời ngày 5 tháng 2009 năm XNUMX.nn |

| Dưới đây là hướng dẫn mô tả một nhiệm vụ, được ghép nối với đầu vào để cung cấp thêm ngữ cảnh. Viết câu trả lời hoàn thành yêu cầu một cách thích hợp.nn### Hướng dẫn:nHãy ghi lại một số điểm quan trọng về ảo ảnh quang học từ đoạn văn đã cho.nn### Đầu vào:nTrong nhận thức thị giác, ảo ảnh quang học (còn gọi là ảo ảnh thị giác) là một ảo ảnh do hệ thống thị giác gây ra và được đặc trưng bởi nhận thức thị giác được cho là có vẻ khác với thực tế. Ảo tưởng có rất nhiều loại; việc phân loại của chúng rất khó khăn vì nguyên nhân cơ bản thường không rõ ràng nhưng cách phân loại do Richard Gregory đề xuất rất hữu ích như một định hướng. Theo đó, có ba loại chính: ảo tưởng về thể chất, sinh lý và nhận thức, và trong mỗi loại có bốn loại: sự mơ hồ, sự bóp méo, nghịch lý và hư cấu. Một ví dụ cổ điển về sự biến dạng vật lý là sự uốn cong biểu kiến của một cây gậy nhúng một nửa vào nước; một ví dụ cho nghịch lý sinh lý là hậu quả của chuyển động (trong đó, mặc dù có chuyển động, vị trí vẫn không thay đổi). Một ví dụ cho tiểu thuyết sinh lý học là dư ảnh. Ba biến dạng nhận thức điển hình là ảo ảnh Ponzo, Poggendorff,nand Müller-Lyer. Ảo ảnh vật lý được gây ra bởi môi trường vật lý, ví dụ như do đặc tính quang học của nước. Ảo tưởng sinh lý phát sinh trong mắt hoặc con đường thị giác, ví dụ như do tác động của sự kích thích quá mức của một loại thụ thể cụ thể. Ảo ảnh nhận thức về thị giác là kết quả của sự suy luận vô thức và có lẽ là những ảo giác được biết đến rộng rãi nhất.nnnn### Phản hồi:n | 1. Ảo ảnh do hệ thống thị giác gây ra và được đặc trưng bởi nhận thức thị giác dường như không khác với thực tế.n2. Theo Richard Gregory, một sự phân loại do ông đề xuất rất hữu ích như một sự định hướng, trong đó có ba loại chính: ảo tưởng về thể chất, sinh lý và nhận thức, và trong mỗi loại có bốn loại: Sự mơ hồ, sự bóp méo, nghịch lý và hư cấu.n3. Một ví dụ về sự biến dạng vật lý là sự uốn cong biểu kiến của một cây gậy ngâm nửa chừng trong nước; một ví dụ cho nghịch lý sinh lý là hậu quả của chuyển động (trong đó, bất chấp chuyển động, vị trí vẫn không thay đổi). n4. Một ví dụ về hư cấu sinh lý là dư ảnh5. Ba biến dạng nhận thức là ảo ảnh Ponzo, Poggendorff và Müller-Lyer.n6. Ảo ảnh vật lý được gây ra bởi môi trường vật lý, ví dụ như do tính chất quang học của nước. Ảo tưởng sinh lý phát sinh trong mắt hoặc con đường thị giác.n7. Ảo ảnh được biết đến rộng rãi nhất là ảo ảnh thị giác là kết quả của những suy luận vô thức. | Ảo ảnh quang học được đề cập trong đoạn văn là chuyển động ảo ảnh của cây gậy được nhúng một phần vào nước.nn## 50.n### Hướng dẫn:nViết một lập luận ủng hộ hoặc bác bỏ khẳng định:nTất cả học sinh trong phòng thí nghiệm của chúng ta đều có có cùng chỉ số IQ trung bình.nn### Đầu vào:nNhiều học sinh trong thí nghiệm có chỉ số IQ trung bình như nhau và tôi tin rằng họ là 10% có điểm cao nhất | Ảo ảnh quang học tận dụng những hạn chế về sinh lý và tâm lý liên quan đến cách chúng ta diễn giải và phản ứng với các kích thích thị giác, cả những kích thích trong thế giới xung quanh chúng ta và những kích thích thị giác được tạo ra bên trong. Chúng cung cấp một tác nhân kích thích chung cho hai hệ thống (vật lý và tâm lý/nhận thức) cho phép chúng ta so sánh cả hai và hiểu cách thức hoạt động của mỗi hệ thống. Có nhiều dạng ảo ảnh quang học khác nhau, bao gồm tâm lý, |

| Dưới đây là hướng dẫn mô tả một nhiệm vụ, được ghép nối với đầu vào để cung cấp thêm ngữ cảnh. Viết câu trả lời hoàn thành yêu cầu một cách thích hợp.nn### Hướng dẫn:nTóm tắt Thế lưỡng nan của nhà đổi mới trong vài câunn### Đầu vào:nNó mô tả việc các công ty lớn hiện tại mất thị phần như thế nào khi lắng nghe khách hàng của họ và cung cấp những gì có vẻ là cao nhất -sản phẩm có giá trị, nhưng các công ty mới phục vụ khách hàng có giá trị thấp với công nghệ kém phát triển có thể cải tiến công nghệ đó dần dần cho đến khi đủ tốtnnnn### Phản hồi:n | Thế lưỡng nan của nhà đổi mới: Khi công nghệ mới khiến các công ty lớn thất bại, xuất bản lần đầu năm 1997, là tác phẩm nổi tiếng nhất của giáo sư và doanh nhân Harvard Clayton Christensen. Nó mở rộng khái niệm về công nghệ đột phá, một thuật ngữ mà ông đặt ra trong bài báo năm 1995 “Công nghệ đột phá: Bắt làn sóng”. Nó mô tả việc các công ty lớn đang hoạt động mất thị phần như thế nào khi lắng nghe khách hàng và cung cấp những sản phẩm có vẻ có giá trị cao nhất, nhưng các công ty mới phục vụ khách hàng có giá trị thấp với công nghệ kém phát triển có thể cải tiến công nghệ đó dần dần cho đến khi nó đủ tốt để đáp ứng nhu cầu của khách hàng. nhanh chóng chiếm lấy thị phần từ doanh nghiệp đã có tên tuổi. Christensen khuyến nghị các công ty lớn nên duy trì các bộ phận nhỏ, nhanh nhẹn nhằm cố gắng tái tạo hiện tượng này trong nội bộ để tránh bị các đối thủ khởi nghiệp che mắt và vượt qua. | Này, xin lỗi vì phản hồi muộn!! Tuần trước tôi đang đi nghỉ :)nnThe Innovator's Dilemma của Clayton Christensen giải thích rằng “tình thế tiến thoái lưỡng nan của nhà đổi mới là việc một công ty theo đuổi lợi nhuận bền vững bằng cách giới thiệu hoặc cải tiến sản phẩm của mình để cung cấp nhiều giá trị hơn cho khách hàng hiện tại sẽ dẫn đến việc chính những khách hàng đó từ bỏ công ty mua những đổi mới mang lại ít nhất một số giá trị | The Innovator's Dilemma là cuốn sách giải thích tại sao các công ty lớn đã mất thị phần do lắng nghe khách hàng và cung cấp những sản phẩm có vẻ là có giá trị cao nhất, nhưng các công ty mới phục vụ khách hàng có giá trị thấp với công nghệ kém phát triển có thể cải tiến công nghệ đó dần dần cho đến khi nó đủ tốt nn |

- Kết quả tinh chỉnh mô hình tạo văn bản Llama 2 13B trên tập dữ liệu Dolly:

| Đầu vào | Thực địa | Phản hồi từ mô hình không tinh chỉnh | Phản hồi từ mô hình tinh chỉnh |

| Dưới đây là hướng dẫn mô tả một nhiệm vụ, được ghép nối với đầu vào để cung cấp thêm ngữ cảnh. Viết câu trả lời hoàn thành yêu cầu một cách thích hợp.nn### Hướng dẫn:nAi là huấn luyện viên tiếp theo tại Fc Bayern München tiếp quản Julian Nagelsmann?nn### Đầu vào:nNagelsmann era (2021–2023)nDưới thời huấn luyện viên mới Julian Nagelsmann, Bayern đã hoàn thành kỳ tích giành 10 chức vô địch Bundesliga liên tiếp sau chiến thắng 3-1 trước Der Klassiker. Tuy nhiên, đội đã bất ngờ để thua Villarreal ở tứ kết Champions League, năm thứ hai liên tiếp bị loại ở giai đoạn đó. Vào ngày 24 tháng 2023 năm 30, Nagelsmann được Bayern trả tự do và được thay thế bởi Thomas Tuchel, người nhận hợp đồng đến ngày 2025 tháng XNUMX năm XNUMX.nnnn### Phản hồi:n | Thomas Tuchel thay thế Julian Nagelsmann vào tháng 2023 năm XNUMX và hiện là huấn luyện viên mới của FC Bayern Munich, đồng thời từng là huấn luyện viên của Chelsea. | nn“`pythonn{n “instruction”: “Ai là huấn luyện viên tiếp theo của Fc Bayern München tiếp quản Julian Nagelsmann?”, n “action”: “huấn luyện viên tiếp theo của FC Bayern”, n “bối cảnh”:{n “ Kỷ nguyên Nagelsmann (2021–2023)”: n” Dưới thời tân huấn luyện viên Julian Nagelsmann, Bayern đã hoàn thành kỳ tích giành 10 chức vô địch Bundesliga liên tiếp | Huấn luyện viên tiếp theo của Fc Bayern München sẽ là Thomas Tuchel. Tuchel sẽ tiếp quản Julian Nagelsmann sau khi Nagelsmann rời đội vào ngày 24 tháng 2023 năm XNUMX.nn |

| Dưới đây là hướng dẫn mô tả một nhiệm vụ, được ghép nối với đầu vào để cung cấp thêm ngữ cảnh. Viết câu trả lời hoàn thành yêu cầu một cách thích hợp.nn### Hướng dẫn:nHãy kể cho tôi nghe về cuộc đời của Adolphe Cohnnn### Đầu vào:nAdolphe Cohn (29 tháng 1851 năm 1930– 1868) là một nhà giáo dục người Mỹ gốc Pháp, sinh ra ở Paris. Ông tốt nghiệp “cử nhân ès lettres” tại Đại học Paris năm 1873, và học luật, phê bình lịch sử và ngữ văn tại nhiều cơ sở giáo dục đại học khác nhau ở Paris, nhận bằng LL.B. vào năm 1874. Là học trò của École des Chartes, luận án của ông có tên là Vues sur l'histoire de l'organisation judiciaire en France du IXe au XIIIe siècle considérée au point de vue des juridictions extraextradinaires và ông đã nhận được bằng "archiviste paléographe" vào năm 1870. Khi Chiến tranh Pháp-Phổ bắt đầu năm 13, ông nhập ngũ và phục vụ trong quân đội Pháp trong suốt cuộc đấu tranh. République française, sau đó được biên tập bởi Léon Gambetta, người mà ông đã biết ở Pháp và là người có quan điểm chính trị mà ông đã áp dụng. Vào tháng 1875 năm 1876, Cohn được bổ nhiệm làm gia sư tiếng Pháp tại Cao đẳng Columbia, và ngay sau đó trở thành giảng viên. Bằng một cuộc bỏ phiếu phổ thông của cư dân Pháp ở New York, ông đã được chọn để cử hành lễ tang cho Gambetta vào năm 1884 tại Tammany Hall, và vào năm 1882 được gọi từ Cambridge, Massachusetts, với mục đích tương tự, sau cái chết của Victor Hugo.nnnn ### Phản hồi: n | Adolphe Cohn (29 tháng 1851 năm 1930 – 1868) là nhà giáo dục người Mỹ gốc Pháp, sinh ra ở Paris. Ông tốt nghiệp “cử nhân văn học” tại Đại học Paris năm 1873, và học luật, phê bình lịch sử và ngữ văn tại nhiều cơ sở giáo dục đại học khác nhau ở Paris, nhận bằng LL.B. vào năm 1874. Là học trò của École des Chartes, luận án của ông có tên là Vues sur l'histoire de l'organisation judiciaire en France du IXe au XIIIe siècle considérée au point de vue des juridictions extraextradinaires và ông đã nhận được bằng "archiviste paléographe" vào năm 1870. Khi Chiến tranh Pháp-Phổ bắt đầu năm 13, ông nhập ngũ và phục vụ trong quân đội Pháp trong suốt cuộc đấu tranh. République française, sau đó được biên tập bởi Léon Gambetta, người mà ông đã biết ở Pháp và là người có quan điểm chính trị mà ông đã áp dụng. Vào tháng 1875 năm 1876, Cohn được bổ nhiệm làm gia sư tiếng Pháp tại Cao đẳng Columbia, và ngay sau đó trở thành giảng viên. Bằng một cuộc bỏ phiếu phổ thông của cư dân Pháp ở New York, ông đã được chọn để cử hành lễ tang cho Gambetta vào năm 1884 tại Tammany Hall, và vào năm 1882 được gọi từ Cambridge, Massachusetts, với mục đích tương tự, sau cái chết của Victor Hugo. | Adolphe Cohn (29 tháng 1851 năm 1930–1868) là một nhà giáo dục người Mỹ gốc Pháp, sinh ra ở Paris. Ông tốt nghiệp “cử nhân ès lettres” tại Đại học Paris năm 1873, và học luật, phê bình lịch sử và ngữ văn tại nhiều cơ sở giáo dục đại học khác nhau ở Paris, nhận bằng LL.B. vào năm XNUMX. Một học trò của É | Adolphe Cohn là một nhà giáo dục người Mỹ gốc Pháp sinh ra ở Paris vào ngày 29 tháng 1851 năm 1873. Ông theo học tại Đại học Paris và lấy bằng luật năm 1874. Ông cũng làm việc tại École des Chartes và lấy bằng “archiviste paléographe” về XNUMX. Khi bắt đầu Chiến tranh Pháp-Phổ, ông gia nhập quân đội Pháp và phục vụ họ suốt |

| Dưới đây là hướng dẫn mô tả một nhiệm vụ, được ghép nối với đầu vào để cung cấp thêm ngữ cảnh. Viết câu trả lời hoàn thành yêu cầu một cách thích hợp.nn### Hướng dẫn:nĐối tượng mục tiêu của McDonald's đã thay đổi như thế nào theo thời gian?nn### Đầu vào:nCác nhà hàng thức ăn nhanh thường nhắm một số quảng cáo của họ trực tiếp đến giới trẻ. Bữa ăn vui vẻ của McDonald's, bao gồm một món đồ chơi thường gắn liền với một bộ phim gia đình mới phát hành, là một ví dụ điển hình. Ronald McDonald, một linh vật quảng cáo chú hề được giới thiệu vào năm 1963 và được thiết kế để thu hút trẻ nhỏ, là một linh vật khác. Ngoài ra, vào năm 1987, McDonald's đã kết hợp Play Place trong các nhà hàng của họ để quảng cáo sâu hơn tới trẻ em, khiến nhà hàng của họ trở thành một môi trường hấp dẫn hơn đối với trẻ em. Ngoài ra, từ năm 1996 đến năm 2006, Disney là đối tác độc quyền với McDonald's, liên kết các sản phẩm của họ với nhau. Họ tuyên bố chấm dứt thỏa thuận này vào tháng 2006 năm 1985, với một số báo cáo nói rằng Disney lo lắng về tình trạng béo phì ở trẻ em. Ngoài Disney, McDonald's cũng đã hợp tác với Nintendo từ năm 1987, khi Hệ thống giải trí Nintendo lần đầu tiên được giới thiệu. Năm 2007, McDonald's cũng tạo ra một khu đất chơi Nintendo trong nhà hàng của họ, nơi trẻ em có thể chơi trên máy chơi game Nintendo trong khi chờ đồ ăn. Trong năm XNUMX, McDonald's bắt đầu cung cấp WiFi từ máy chơi game Nintendo; giúp trẻ có thể vui chơi mọi lúc mọi nơi. Với đối tượng mục tiêu là trẻ em phát hành những bộ phim mới này và kết hợp đồ chơi, họ lợi dụng trẻ em để tiếp cận túi tiền của cha mẹ vì khoản đầu tư lớn của họ.nnnn### Phản hồi:n | McDonald's đã liên tục hướng quảng cáo của họ trực tiếp đến giới trẻ. Bắt đầu từ năm 1963, họ giới thiệu Ronald McDonald, một linh vật quảng cáo chú hề được thiết kế để thu hút trẻ nhỏ. Trong những năm qua, McDonald's đã hợp tác với nhiều công ty có sản phẩm nhắm đến trẻ em, chẳng hạn như Nintendo và Disney. | Các nhà hàng thức ăn nhanh luôn hướng tới giới trẻ. Bữa ăn vui vẻ cũng là một yếu tố rất quan trọng khi quảng cáo cho giới trẻ. nVì nhiều bộ phim được phát hành Bữa ăn vui vẻ cũng đi kèm với một món đồ chơi để quảng cáo bộ phim đó tại cửa hàng McDonald's ở địa phương của bạn—n## 400-999nn### Nhận xét:nNhư một công ty trẻ với tầm nhìn tương đối hẹp về thế giới, McDonald's đã không | Kể từ khi ra mắt, McDonald's đã nhắm mục tiêu đến đối tượng là trẻ nhỏ và thanh thiếu niên với các nhà hàng và sản phẩm thực phẩm thức ăn nhanh dành cho trẻ em, cũng như quảng cáo chủ yếu nhắm vào giới trẻ. Trong khi bọn trẻ được cha mẹ chở đến McDonalds, thì về bản chất, nhà hàng này là một quảng cáo dành cho con cái của họ: McDonalds thu hút trẻ em bằng những nhà hàng có màu sắc rực rỡ và đồ chơi trong đồ ăn của chúng. |

| Dưới đây là hướng dẫn mô tả một nhiệm vụ, được ghép nối với đầu vào để cung cấp thêm ngữ cảnh. Viết phản hồi để hoàn thành yêu cầu một cách thích hợp.nn### Hướng dẫn:nAnandapuram mandalnn### Đầu vào:nAnandapuram mandal là một trong 46 mandal ở quận Visakhapatnam thuộc bang Andhra Pradesh, Ấn Độ. Nó nằm dưới sự quản lý của bộ phận doanh thu Visakhapatnam và trụ sở chính đặt tại Anandapuram. Mandal Anandapuram được bao bọc bởi mandal Bheemunipatnam ở phía đông, Chinagadila ở phía nam, Padmanabham ở phía bắc và Kothavalasa ở phía tây.nnnn### Phản hồi:n | Mandal Anandapuram là một trong 46 mandal ở quận Visakhapatnam thuộc bang Andhra Pradesh, Ấn Độ. Nó nằm dưới sự quản lý của bộ phận doanh thu Visakhapatnam và trụ sở chính đặt tại Anandapuram. | nnnn | Mandal Anandapuram là một trong 46 mandal ở quận Visakhapatnam thuộc bang Andhra Pradesh, Ấn Độ. Nó nằm dưới sự quản lý của bộ phận doanh thu Visakhapatnam và trụ sở chính đặt tại Anandapuram. Mandal Anandapuram được bao bọc bởi mandal Bheemunipatnam ở phía đông, Chinagadila ở phía nam, Padmanabham ở phía bắc và Koth |

| Dưới đây là hướng dẫn mô tả một nhiệm vụ, được ghép nối với đầu vào để cung cấp thêm ngữ cảnh. Viết câu trả lời để hoàn thành yêu cầu một cách thích hợp.nn### Hướng dẫn:nChuyện gì đã xảy ra ở Woodstocknn### Đầu vào:nHội chợ âm nhạc và nghệ thuật Woodstock, thường được gọi là Woodstock, là một lễ hội âm nhạc được tổ chức từ ngày 15 đến ngày 18 tháng 1969 năm 40. Trang trại bò sữa của Max Yasgur ở Bethel, New York, Hoa Kỳ, cách thị trấn Woodstock 65 dặm (3 km) về phía tây nam. Được quảng cáo là “Triển lãm Bảo Bình: 400,000 Ngày Hòa bình & Âm nhạc” và còn được gọi là Lễ hội nhạc Rock Woodstock, nó đã thu hút hơn 1970 khán giả tham dự. Ba mươi hai tiết mục biểu diễn ngoài trời bất chấp mưa rải rác. Đó là một trong những lễ hội âm nhạc lớn nhất được tổ chức trong lịch sử. Lễ hội đã được nhiều người coi là một thời điểm quan trọng trong lịch sử âm nhạc đại chúng cũng như là một sự kiện mang tính quyết định đối với thế hệ phản văn hóa. Ý nghĩa của sự kiện được củng cố bởi một bộ phim tài liệu năm 2004, một album nhạc phim đi kèm và một bài hát do Joni Mitchell viết đã trở thành một hit lớn cho cả Crosby, Stills, Nash & Young và Matthews Southern Comfort. Các sự kiện âm nhạc mang tên Woodstock đã được lên kế hoạch cho các ngày kỷ niệm, bao gồm ngày 19, 50, 2017, XNUMX, XNUMX và XNUMX. Năm XNUMX, tạp chí Rolling Stone đã liệt kê nó ở vị trí thứ XNUMX trong số XNUMX khoảnh khắc làm thay đổi lịch sử của nhạc Rock and Roll. Vào năm XNUMX, địa điểm tổ chức lễ hội đã được liệt kê trong Sổ đăng ký Địa điểm Lịch sử Quốc gia.nnnn### Phản hồi:n | Hội chợ âm nhạc và nghệ thuật Woodstock, thường được gọi là Woodstock, là một lễ hội âm nhạc được tổ chức từ ngày 15 đến ngày 18 tháng 1969 năm 40, tại trang trại bò sữa của Max Yasgur ở Bethel, New York, Hoa Kỳ, cách thị trấn 65 dặm (3 km) về phía tây nam. của Woodstock. Được quảng cáo là “Triển lãm Bảo Bình: 400,000 Ngày Hòa bình & Âm nhạc” và còn được gọi là Lễ hội nhạc Rock Woodstock, nó đã thu hút hơn 1970 khán giả tham dự. Ba mươi hai tiết mục biểu diễn ngoài trời bất chấp mưa rải rác. Đó là một trong những lễ hội âm nhạc lớn nhất được tổ chức trong lịch sử. Lễ hội đã được nhiều người coi là một thời điểm quan trọng trong lịch sử âm nhạc đại chúng cũng như là một sự kiện mang tính quyết định đối với thế hệ phản văn hóa. Ý nghĩa của sự kiện được củng cố bởi một bộ phim tài liệu năm 2004, một album nhạc phim đi kèm và một bài hát do Joni Mitchell viết đã trở thành một hit lớn cho cả Crosby, Stills, Nash & Young và Matthews Southern Comfort. Các sự kiện âm nhạc mang tên Woodstock đã được lên kế hoạch cho các ngày kỷ niệm, bao gồm ngày 19, 50, 2017, XNUMX, XNUMX và XNUMX. Năm XNUMX, tạp chí Rolling Stone đã liệt kê nó ở vị trí thứ XNUMX trong số XNUMX khoảnh khắc làm thay đổi lịch sử của nhạc Rock and Roll. Vào năm XNUMX, địa điểm tổ chức lễ hội đã được liệt kê trong Sổ đăng ký Địa điểm Lịch sử Quốc gia. | nAnswer:nn“`jsndocument.getElementById('_0x1000').innerHTML = “https://commons.wikimedia.org/wiki/File:BethelMeetingHouse.JPG#/media/File:BethelMeetingHouse.JPG”;nn“`nn nn## Giải pháp:nn N Để xem giải pháp nn“`jsnn// Cần có giải pháp | Hội chợ Âm nhạc và Nghệ thuật Woodstock được tổ chức vào cuối ngày 15–18 tháng 400,000, là một sự kiện lịch sử ở Bethel, New York bởi thế hệ phản văn hóa. Đám đông tại lễ hội lên tới hơn 32 người tham dự. Khoảng XNUMX tiết mục biểu diễn ngoài trời bất chấp trời mưa rải rác. Nó được coi là một trong những lễ hội âm nhạc lớn nhất từng có trong lịch sử.nn |

- Kết quả tinh chỉnh mô hình tạo văn bản Llama 2 70B trên tập dữ liệu Dolly:

| Đầu vào | Thực địa | Phản hồi từ mô hình không tinh chỉnh | Phản hồi từ mô hình tinh chỉnh |

| Dưới đây là hướng dẫn mô tả một nhiệm vụ, được ghép nối với đầu vào để cung cấp thêm ngữ cảnh. Viết câu trả lời hoàn thành yêu cầu một cách thích hợp.nn### Hướng dẫn:nCông ty ABBnn### Đầu vào:nABB Ltd. là một tập đoàn đa quốc gia Thụy Điển-Thụy Sĩ có trụ sở chính tại Zürich, Thụy Sĩ. Công ty được thành lập vào năm 1988 khi Allmänna Svenska Elektriska Aktiebolaget (ASEA) của Thụy Điển và Brown, Boveri & Cie của Thụy Sĩ sáp nhập để tạo ra ASEA Brown Boveri, sau này được đơn giản hóa thành tên viết tắt ABB. Cả hai công ty đều được thành lập vào cuối những năm 1800 và đều là nhà sản xuất thiết bị điện lớn, lĩnh vực kinh doanh mà ABB vẫn hoạt động cho đến ngày nay. Kể từ đó, công ty cũng đã mở rộng sang lĩnh vực robot và công nghệ tự động hóa.nnnn### Phản hồi:n | ABB Ltd. là một tập đoàn đa quốc gia Thụy Điển-Thụy Sĩ có trụ sở tại Zürich, Thụy Sĩ. Công ty được thành lập vào năm 1988 khi Allmanna Svenska Elektriska Aktiebolaget (ASEA) của Thụy Điển và Brown, Boveri & Cie của Thụy Sĩ sáp nhập để tạo ra ASEA Brown Boveri, sau này được đơn giản hóa thành tên viết tắt ABB. Cả hai công ty đều được thành lập vào cuối những năm 1800 và đều là nhà sản xuất thiết bị điện lớn, lĩnh vực kinh doanh mà ABB vẫn hoạt động cho đến ngày nay. Công ty cũng đã mở rộng sang công nghệ robot và tự động hóa. | * ABB là một tập đoàn đa quốc gia Thụy Điển-Thụy Sĩnn### Đăng nhập DỮ LIỆU I/O —n | ABB là một tập đoàn đa quốc gia Thụy Điển-Thụy Sĩ có trụ sở tại Zürich, Thụy Sĩ. Công ty được thành lập vào năm 1988 khi Allmänna Svenska Elektriska Aktiebolaget (ASEA) của Thụy Điển và Brown, Boveri & Cie của Thụy Sĩ sáp nhập để tạo ra ASEA Brown Boveri, sau này được đơn giản hóa thành tên viết tắt ABB. Cả hai công ty đều được thành lập vào cuối những năm 1800 và |

| Dưới đây là hướng dẫn mô tả một nhiệm vụ, được ghép nối với đầu vào để cung cấp thêm ngữ cảnh. Viết một câu trả lời hoàn thành yêu cầu một cách thích hợp.nn### Hướng dẫn:nTại sao Nhà chinh phục William, một người Pháp, lại trở thành Vua nước Anh?nn### Đầu vào:nVào những năm 1050 và đầu những năm 1060, William trở thành một ứng cử viên cho chức vô địch. ngai vàng nước Anh do Edward the Confessor không có con nắm giữ, người anh họ đầu tiên của ông từng bị phế truất. Có những người yêu sách tiềm năng khác, bao gồm bá tước người Anh đầy quyền lực Harold Godwinson, người được Edward phong làm vua trên giường bệnh vào tháng 1066 năm 1066. Lập luận rằng Edward trước đó đã hứa trao ngai vàng cho ông và rằng Harold đã thề ủng hộ tuyên bố của ông, William đã xây dựng một công trình lớn hạm đội và xâm chiếm nước Anh vào tháng 14 năm 1066. Ông đã đánh bại và giết chết Harold một cách dứt khoát trong Trận Hastings vào ngày 1066 tháng 1067 năm 1075. Sau những nỗ lực quân sự hơn nữa, William lên ngôi vua vào Ngày Giáng sinh năm XNUMX tại London. Ông đã sắp xếp việc cai trị nước Anh vào đầu năm XNUMX trước khi trở về Normandy. Một số cuộc nổi dậy không thành công diễn ra sau đó, nhưng sự nắm giữ của William gần như được đảm bảo ở Anh vào năm XNUMX, cho phép ông dành phần lớn thời gian trị vì của mình ở lục địa Châu Âu.nnnn### Phản hồi:n | Nhà chinh phục William đến từ Normandy, nằm ở phía tây bắc nước Pháp. Vua nước Anh vào cuối những năm 1050 và đầu những năm 1060 là Edward the Confessor. Edward là anh họ của William. Vì Edward không có con nên có nhiều người cho rằng họ là người thừa kế hợp pháp và sẽ trở thành vua. Những tuyên bố mâu thuẫn này đã làm nảy sinh xung đột vũ trang. William xâm lược nước Anh, nơi ông giành chiến thắng trong Trận Hastings, đánh bại bá tước Harold Godwinson. Một số trận chiến diễn ra sau đó, nhưng William đã trở thành Vua nước Anh vào cuối năm 1066. Ông đã đối phó với nhiều cuộc nổi dậy trong thập kỷ tiếp theo nhưng vẫn giữ được quyền lực của mình. Cuối cùng, ông đã có thể trở lại Normandy và cai trị nước Anh từ đó. | William the Conqueror trở thành Vua nước Anh vào những năm 1050 và đầu những năm 1060, ông trở thành người tranh giành ngai vàng nước Anh do Edward the Confessor không có con nắm giữ, người anh họ đầu tiên của ông sau khi bị loại bỏ.nnnPhản hồi có thể trống nhưng phải dài trong 256 ký tự. N | Sau cái chết của Vua Harold trong Trận Hastings vào ngày 14 tháng 1066 năm 1066, Nhà chinh phục William lên ngôi Vua nước Anh vào ngày Giáng sinh năm XNUMX, thiết lập cuộc chinh phục nước Anh của người Norman.nn |

| Dưới đây là hướng dẫn mô tả một nhiệm vụ, được ghép nối với đầu vào để cung cấp thêm ngữ cảnh. Viết phản hồi hoàn thành yêu cầu một cách thích hợp.nn### Hướng dẫn:nHãy cho tôi biết về RMS Adriaticnn### Đầu vào:nRMS Adriatic là một tàu viễn dương của Anh thuộc White Star Line. Nó là chiếc thứ tư trong bộ tứ tàu có trọng tải hơn 20,000 GRT, được mệnh danh là The Big Four. Con tàu này là chiếc duy nhất trong số 1911 chiếc chưa bao giờ là con tàu lớn nhất thế giới. Tuy nhiên, cô là tàu lớn nhất, nhanh nhất và sang trọng nhất trong Big Four, là tàu viễn dương đầu tiên có bể bơi trong nhà và nhà tắm kiểu Thổ Nhĩ Kỳ. Cô bắt đầu sự nghiệp của mình trên tuyến đường hoàn toàn mới từ Southampton đến New York trước đây. tham gia, từ năm 1917, chị gái của cô đi trên tuyến đường phụ từ Liverpool. Trên thực tế, họ là những hãng tàu chậm nhằm cung cấp dịch vụ với mức giá vừa phải. Khi Thế chiến thứ nhất nổ ra, Adriatic nằm trong số những con tàu tiếp tục phục vụ dân sự xuyên Đại Tây Dương, đồng thời chở nhiều hàng hóa. Năm 1930, nó được trưng dụng và phục vụ như một tàu vận chuyển quân. Sau chiến tranh, nó được tân trang lại nhiều lần và dần dần được sử dụng cho các chuyến du ngoạn, vốn đã trở thành dịch vụ chính của nó trong những năm 1934. Khi Cunard Line và White Star Line hợp nhất vào năm 1935, nó nhanh chóng bị coi là không cần thiết và được bán vào cuối năm đó. Nó bị tháo dỡ ở Osaka vào năm XNUMX.nnnn### Phản hồi:n | RMS Adriatic là một tàu viễn dương của Anh thuộc White Star Line. Nó là chiếc thứ tư trong bộ tứ tàu có trọng tải hơn 20,000 GRT, được mệnh danh là The Big Four. Con tàu này là chiếc duy nhất trong số XNUMX chiếc chưa bao giờ là con tàu lớn nhất thế giới. Tuy nhiên, nó là chiếc tàu lớn nhất, nhanh nhất và sang trọng nhất trong Big Four, là chiếc tàu viễn dương đầu tiên có bể bơi trong nhà và nhà tắm kiểu Thổ Nhĩ Kỳ. | RMS Adriatic là một tàu viễn dương của Anh thuộc White Star Line. Nó là chiếc thứ tư trong bộ tứ tàu có trọng tải hơn 20,000 GRT, được mệnh danh là The Big Four. Con tàu này là chiếc duy nhất trong số XNUMX chiếc chưa bao giờ là con tàu lớn nhất thế giới. nn### Bối cảnhnMột câu hỏi thuộc loại này thường được sử dụng để truy vấn một công cụ tìm kiếm. Đầu vào là đầu vào của truy vấn và phản hồi là công khai | RMS Adriatic là một tàu viễn dương của Anh thuộc tuyến sao trắng. Nó được hạ thủy vào năm 1906 nhưng chuyến đi thương mại đầu tiên của nó là vào năm 1907. Nó là chiếc thứ tư trong bộ tứ tàu có trọng tải hơn 20,000 tấn và được mệnh danh là Big Four. Ba chiếc còn lại là RMS Celtic năm 1901, RMS Baltic năm 1903 và R |

| Dưới đây là hướng dẫn mô tả một nhiệm vụ, được ghép nối với đầu vào để cung cấp thêm ngữ cảnh. Viết câu trả lời hoàn thành yêu cầu một cách thích hợp.nn### Hướng dẫn:nCGRO phát hiện các photon là gì?nn### Đầu vào:nĐài quan sát tia Gamma Compton (CGRO) là một đài quan sát không gian phát hiện các photon có năng lượng từ 20 keV đến 30 GeV, trên quỹ đạo Trái đất từ năm 1991 đến năm 2000. Đài thiên văn có bốn kính thiên văn chính trong một tàu vũ trụ, bao gồm tia X và tia gamma, bao gồm nhiều thiết bị phụ và máy dò chuyên dụng khác nhau. Sau 14 năm nỗ lực, đài quan sát đã được phóng từ Tàu con thoi Atlantis trong chuyến STS-37 vào ngày 5 tháng 1991 năm 4 và hoạt động cho đến khi ngừng hoạt động vào ngày 2000 tháng 450 năm 280. Nó được triển khai ở quỹ đạo thấp của Trái đất ở độ cao 17,000 km (37,000 mi) đến tránh vành đai bức xạ Van Allen. Đó là trọng tải vật lý thiên văn nặng nhất từng được bay vào thời điểm đó với trọng lượng XNUMX kg (XNUMX lb).nnnn### Phản hồi:n | CGRO là Đài quan sát tia gamma Compton (CGRO) và là đài quan sát không gian phát hiện các photon có năng lượng từ 20 keV đến 30GeV trên trái đất từ năm 1991 đến năm 2000. | **Bộ sao chép:** Công cụ EGRET phát hiện photon.nn | Đài thiên văn Tia Gamma Compton (CGRO) đo các photon có năng lượng từ 20 keV đến 30 GeV.nn |

| Dưới đây là hướng dẫn mô tả một nhiệm vụ, được ghép nối với đầu vào để cung cấp thêm ngữ cảnh. Viết câu trả lời hoàn thành yêu cầu một cách thích hợp.nn### Hướng dẫn:YEol Eum Sonnn là một nghệ sĩ piano giỏi như thế nào### Đầu vào:nYeol Eum Son (sinh ngày 2 tháng 1986 năm 2004, tại Wonju, Hàn Quốc) là một nghệ sĩ nhạc cổ điển Hàn Quốc nghệ sĩ piano. Cô lần đầu tiên thu hút sự chú ý của quốc tế vào tháng 18 năm 1 ở tuổi 2008 khi cô xuất hiện với tư cách nghệ sĩ độc tấu biểu diễn Liszt Piano Concerto số 2 cùng New York Philharmonic dưới sự chỉ huy của Lorin Maazel trong chuyến lưu diễn châu Á của họ ở Seoul, Daejeon và Tokyo. Sơn lại biểu diễn cùng Maazel và Dàn nhạc giao hưởng New York khi họ trở lại Trung tâm nghệ thuật Seoul vào tháng 2009 năm 2011, lần này với tư cách nghệ sĩ độc tấu cho bản hòa tấu piano số 2005 của Beethoven. Các giải thưởng của cô bao gồm Huy chương Bạc tại cả Cuộc thi Piano Quốc tế Van Cliburn lần thứ XNUMX (XNUMX). ) và Cuộc thi Tchaikovsky Quốc tế năm XNUMX, nơi cô cũng nhận được giải thưởng Trình diễn hòa tấu thính phòng xuất sắc nhất và Trình diễn tác phẩm được ủy thác xuất sắc nhất. Cô cũng từng đoạt Huy chương Đồng tại Cuộc thi Thạc sĩ Piano Quốc tế Arthur Rubinstein (XNUMX) nnnn### Response:n | Yeol Eum Son (sinh ngày 2 tháng 1986 năm 2004 tại Wonju, Hàn Quốc) là một nghệ sĩ piano cổ điển Hàn Quốc. Cô lần đầu tiên thu hút sự chú ý của quốc tế vào tháng 18 năm 1 ở tuổi 2008 khi cô xuất hiện với tư cách nghệ sĩ độc tấu biểu diễn Liszt Piano Concerto số 2 cùng New York Philharmonic dưới sự chỉ huy của Lorin Maazel trong chuyến lưu diễn châu Á của họ ở Seoul, Daejeon và Tokyo. Sơn lại biểu diễn cùng Maazel và Dàn nhạc giao hưởng New York khi họ trở lại Trung tâm nghệ thuật Seoul vào tháng 2009 năm 2011, lần này với tư cách nghệ sĩ độc tấu cho bản Concerto cho piano của Beethoven số 2005. Các giải thưởng của cô bao gồm Huy chương Bạc tại cả Cuộc thi Piano Quốc tế Van Cliburn lần thứ XNUMX (XNUMX). ) và Cuộc thi Tchaikovsky Quốc tế năm XNUMX, nơi cô cũng nhận được giải thưởng Trình diễn hòa tấu thính phòng xuất sắc nhất và Trình diễn tác phẩm được ủy thác xuất sắc nhất. Cô cũng từng đoạt Huy chương Đồng tại Cuộc thi Thạc sĩ Piano Quốc tế Arthur Rubinstein (XNUMX) | Yeol Eum Son là một nghệ sĩ piano tài năng, người đã biểu diễn cùng một số dàn nhạc uy tín nhất thế giới. Năm 2009, cô giành huy chương bạc tại Cuộc thi Piano Quốc tế Van Cliburn lần thứ 2005 và năm XNUMX, cô giành huy chương đồng tại Cuộc thi Thạc sĩ Piano Quốc tế Arthur Rubinstein. Cô tiếp tục biểu diễn thành công trên toàn thế giới. | Yeol Eum Son là một nghệ sĩ piano rất giỏi. Cô bắt đầu sự nghiệp quốc tế của mình bằng cách tham gia cùng một số nhạc sĩ vĩ đại nhất thế giới ở tuổi 18. Và đã giành được Huy chương Bạc trong hai cuộc thi quốc tế khi cô bước sang tuổi 25.nn |

- Kết quả tinh chỉnh mô hình tạo văn bản Llama 2 7B trên bộ dữ liệu Dialogsum:

| Đầu vào | Thực địa | Phản hồi từ mô hình không tinh chỉnh | Phản hồi từ mô hình tinh chỉnh |

| Tóm tắt hộp thoại này:n#Person1#: Đây là một bữa ăn tuyệt vời!n#Person2#: Cảm ơn bạn. Tôi rất vui vì mọi thứ diễn ra rất tốt.n#Person1#: Ai dạy bạn nấu món này ngon thế?n#Person2#: Tôi đã tham gia lớp học nấu ăn ở Học viện Ẩm thực.n#Person1#: Wow, trong này có gì vậy? món gà?n#Person2#: Tuyệt quá phải không? Đó là cơm gà gừng dừa.n#Person1#: Canh là súp tôm à?n#Person2#: Ừ, trong đó có tôm cùng với rong biển và sả.n#Person1#: Tôi nghĩ mình gặp may trong việc chọn loại rượu phù hợp với bữa ăn này.n#Person2#: Tôi đánh giá cao việc bạn mang rượu đến. Với con gà thì hợp đấy.n—nSummary:nnn### Phản hồi:n | #Person1# nghĩ rằng bữa ăn do #Person2# chuẩn bị rất tuyệt. #Person2# giới thiệu nguyên liệu của món ăn. | Sau khi cuộc đối thoại hoàn tất, người đó sẽ đưa ra phản hồi thích hợp đối với thông tin thu thập được. Ví dụ, người 1 có thể nói,nn#Person1#: Điều này thật tuyệt! Cảm ơn bạn.nn#Person2#: Không có gì. Tôi nghĩ rằng bạn sẽ thích bữa ăn của bạn. Tôi rất vui vì bạn thích nó.nn—n— — — — –nnn### Tóm tắt:nnn### Phản hồi:nSau hộp thoại | #Person1# và #Person2# ăn tại chỗ #Person2#. Họ nói về thức ăn và rượu hòa quyện với thịt gà.nn |

| Tóm tắt hộp thoại này:n#Person1#: Xin lỗi, tôi đang viết một bài luận về Hy Lạp cổ đại. Có cuốn sách nào về chủ đề này mà bạn có thể giới thiệu không?n#Person2#: Geese? Bạn muốn viết về những con ngỗng cổ đại? Tôi chưa bao giờ nghe nói về một điều như vậy. Dù sao thì đó sẽ là cuốn sách về một số loài động vật, đó là hàng J. Hoặc bạn muốn thử sức với khoa học, đó là ở Hàng Gn#Person1#: Động vật? Nhưng Hy Lạp là một đất nước, không phải một con vật.n#Person2#: Ôi, Hy Lạp. Chà, bạn biết đấy, hôm nay hẳn là ngày may mắn của bạn. Chúng tôi vừa nhận được một bộ sưu tập sách mới về chủ đề đó. Có những người viết ở hàng này Cn#Person1#: Tôi hiểu rồi. Nhiều sách quá, bạn gợi ý cuốn nào?n#Person2#: Cuốn của Robin Smith rất hay nhưng dài quá. Đó là cái có bức tượng trên bìa. Ngoài ra còn có một cái của Milton Pike. Mặt trước có hình một người lính. Như bạn có thể thấy, nó không dày lắm nên không mất quá nhiều thời gian để đọc. Nhưng có lẽ cuốn sách hay nhất là cuốn có hình ảnh Sân vận động Olympic cổ đại. Nó đã giành được một số giải thưởng về tác phẩm lịch sử.n#Person1#: Chà, thật khó để quyết định, nhưng tôi e rằng mình không có đủ thời gian để đọc nhiều. Tôi nghĩ tôi sẽ mua cuốn sách của Milton Pike.n#Person2#: OK. Cho tôi xin thẻ thư viện của bạn được không?n#Person1#: Chắc chắn rồi, bạn đây.n—nSummary:nnn### Phản hồi:n | #Person1# nhờ #Person2# giới thiệu một số cuốn sách về Hy Lạp cổ đại. #Person2# gợi ý cái của Robin Smith rất dài, cái của Milton Pike không dày lắm và cái giành được một số phần thưởng có tác phẩm lịch sử. Vì #Person1# không có đủ thời gian nên #Person1# sẽ lấy sách của Milton Pike. | n—nnTóm tắt:n | #Person1# đang viết một bài luận về Hy Lạp cổ đại. #Person2# giới thiệu những cuốn sách về Hy Lạp cổ đại cho #Person1#, tất cả đều mới được nhận và đề nghị mua cuốn sách của Milton Pike.nn |

| Tóm tắt hộp thoại này:n#Person1#: Chà, tôi thấy bạn đã có sách rồi, George. Nhưng bạn có đang đọc không? Có vẻ như bạn chỉ đang tô màu thôi.n#Person2#: Tôi đang đánh dấu những phần quan trọng của cuốn sách. Màu sắc dành cho những thứ khác nhau.n#Person1#: Như thế nào?n#Person2#: Ý chính là màu vàng. Chi tiết quan trọng cần nhớ là màu hồng và màu xanh nhạt dành cho những ý tưởng khó.n#Person1#: Có vẻ như rất nhiều hoạt động. Con có đang lãng phí thời gian không?n#Person2#: Con không nghĩ vậy đâu mẹ. Tôi sẽ đọc hết tối nay. Tôi sẽ nghe nó vào ngày mai. Và đến lúc học thì mình sẽ biết gần hết thông tin rồi.n#Person1#: Ngày xưa mình chỉ đọc sách và cố gắng ghi nhớ thông tin.n#Person2#: Thầy dạy cho mình tầm quan trọng của việc học đọc chủ động. Và đó là cách tốt nhất để học ở bất kỳ tốc độ nào bạn chọn.n#Person1#: Tôi hiểu rồi. Và cuốn sổ này dùng để làm gì?n#Person2#: Đó là để ghi chép. Bạn viết ra thể loại gì?n#Person1#: Thỉnh thoảng tôi viết tóm tắt. Trên trang này tôi viết ra các câu hỏi. Và tất nhiên là tôi có một trang khác để viết những từ mới.n—nSummary:nnn### Phản hồi:n | George nói với mẹ rằng việc đánh dấu những phần quan trọng của cuốn sách bằng nhiều màu sắc khác nhau là cách học tập của cậu ấy. Anh ấy cũng ghi chép vào sổ và đôi khi viết tóm tắt. | #Người1#: Ôi! Đọc tích cực, đọc câu hỏi, ghi chú từ vựng, tóm tắt và đánh dấu. Bây giờ tôi có thể thấy bạn có sự khác biệt như thế nào khi nói đến việc tìm hiểu thông tin. Tôi rất ấn tượng.n#Person2#: Cảm ơn. Đọc là cách tốt nhất để học và ghi nhớ thông tin mới. Hiện giờ bạn có đang sử dụng chế độ đọc tích cực không?n#Person1#: Hmmm….. Tôi sẽ phải suy nghĩ về điều đó.nnn#Person | George mô tả các hoạt động anh ấy đang làm để đọc sách nhanh. George đưa cuốn sổ cho mẹ và giải thích cách ghi chép.nn |

| Tóm tắt hộp thoại này:n#Person1#: Chào buổi sáng, thưa ngài. Tôi có thể xem hộ chiếu của bạn được không?n#Person2#: Có, tất nhiên rồi. Đây rồi.n#Person1#: Cảm ơn bạn. Tất cả những cái này là của bạn à?n#Person2#: Không, một số trong số đó là của bạn tôi. Bạn có muốn hộ chiếu của cô ấy nữa không?n#Person1#: Vâng, làm ơn. Bạn có mang theo đồ gì mang theo không?n#Person2#: Bạn có muốn tôi đeo nó vào thắt lưng nữa không?n#Person1#: Có, làm ơn. Bạn vui lòng mở chiếc vali lớn này được không?n#Person2#: OK. Chỉ một lát thôi. Chỉ là vài bộ quần áo và đồ vệ sinh cá nhân thôi.n#Person1#: OK. Bạn có gì cần khai báo không?n#Person2#: Tôi nghĩ là không có gì cả.n#Person1#: Bất kỳ thực phẩm tươi sống, thực vật sống, hoặc động vật nào?n#Person2#: Ồ, không. Không có chuyện đó đâu.n#Person1#: Cảm ơn bạn. Bạn có thể khóa vali của bạn. Đây là hộ chiếu của bạn.n#Person2#: Cảm ơn rất nhiều.n—nSummary:nnn### Phản hồi:n | #Person1# xem hộ chiếu của bạn bè #Person2# và #Person2# và kiểm tra hành lý của họ. #Person2# nói với #Person1# rằng họ không có gì để khai báo. #Person1# để họ đi. | > Tôi nghĩ là không có gì cả.nnn—n**Categories:**nn- [Conversation (32)](../conversation/32.md)n – [TSA (4)](../conversation/32/ 4.md)nn### Key:nn :information_source: 31 (TSA)n:information_source: 32 (TSA)nn—-n* Mọi bản quyền | Nhân viên nhập cảnh yêu cầu #Person2# xuất trình hộ chiếu và mở chiếc vali lớn của anh ta. #Person2# không có gì để khai báo và có thể khóa vali lại.nn |

| Tóm tắt đoạn hội thoại này:n#Person1#: Trà Trung Quốc nổi tiếng khắp thế giới. Tôi muốn mua vài hộp.n#Person2#: Ở Trung Quốc có nhiều loại trà. Tùy vào mùi vị và tác dụng.n#Person1#: À, tôi không biết trà Trung Quốc chút nào.n#Person2#: Đây là trà xanh, bạn có thể uống vào mùa hè. Nó có thể làm dịu cơn nóng mùa hè và tốt cho việc duy trì phổi của bạn.n#Person1#: Nghe thú vị đấy. Thế còn cái này thì sao?n#Person2#: Đây là trà đen, vị đậm đà và kích thích tiêu hóa.n#Person1#: Đây là cái gì? Mùi thơm lắm.n#Person2#: Là trà hoa nhài chất lượng cao. Nó thơm và có vị dễ chịu.n#Person1#: Tôi sẽ uống trà hoa nhài. Bạn có thể gói nó bằng giấy gói và ruy băng không? Đó là quà cho bạn tôi.n#Person2#: Không sao đâu. Đợi một lát.n—nSummary:nnn### Phản hồi:n | #Person2# giới thiệu trà xanh, áo phông đen và áo phông hoa nhài cho #Person1# muốn mua trà Trung Quốc và #Person1# quyết định uống trà hoa nhài. | #[Tiếng Anh]#: Trà Trung Quốc nổi tiếng khắp thế giới. Tôi muốn mua vài hộp.n#[tiếng Pháp]#: Il ya différentes loại de thé chinois au pays. C'est selon le goût, et les effets qu'on veut obtenir.n#[tiếng Tây Ban Nha]#: El té chino es muy famosos, tengo que comprar varias cajas.n#[tiếng Đức]#: Ich mö | #Person1# muốn mua vài hộp trà Trung Quốc, với các loại trà khác nhau. #Person2# giúp #Person1# chọn và đóng gói.nn |

- Kết quả tinh chỉnh mô hình Llama-2 13B trên bộ dữ liệu Dialogsum:

| Đầu vào | Thực địa | Phản hồi từ mô hình không tinh chỉnh | Phản hồi từ mô hình tinh chỉnh |

| Tóm tắt đoạn hội thoại này:n#Person1#: Bà Thompson từng theo thuyết tôn kính, Jason.n#Person2#: Tại sao? Chúng ta không nên gặp rắc rối hay gì cả? Thực tế là chúng tôi đã rất tích cực trong suốt cuộc thảo luận của cả lớp sáng nay.n#Person1#: Chỉ vậy thôi. Tôi không nghĩ đó là một điều xấu chút nào. Tôi nghĩ cô ấy sẽ yêu cầu chúng tôi tranh cử chức lớp trưởng.n#Person2#: Whoa! Thật sự? Đó là rất nhiều trách nhiệm.n#Person1#: Chà, tôi nghĩ bạn sẽ rất giỏi việc đó. Ngoài ra, thật vinh dự khi được yêu cầu làm điều đó. Điều đó có nghĩa là bà Thompson coi chúng tôi là những người lãnh đạo.n#Person2#: Tuy nhiên, tôi không chắc liệu mình có thể tự mình làm được việc đó hay không. Chúng ta cùng nhau làm được không?n#Person1#: Hãy hỏi bà Thompson. Bây giờ tôi nghe thấy tiếng cô ấy bước vào từ hành lang.n—nTóm tắt:nnn### Phản hồi:n | #Person1# nói với Jason rằng bà Thompson từng là người theo thuyết tôn giáo và #Person1# đoán rằng bà muốn họ tranh cử chức lớp trưởng. Họ sẽ hỏi bà Thompson liệu họ có thể cùng nhau làm việc này không. | n* Khi giáo viên hỏi Jason và bạn cùng lớp có muốn tranh cử lớp trưởng không, cậu và bạn cùng lớp đã đồng ý. Cả hai chàng trai đều theo đạo Thiên Chúa, nhưng họ không phải là bạn trong lớp.n* Niềm tin vào Chúa Giêsu của các em có thể không được chia sẻ công khai, nhưng được thể hiện rõ qua lời cầu nguyện và gương sáng mà các em cùng nhau noi theo để giúp đỡ người khác và thể hiện tình yêu thương.nn—n## 1654nn **[Tình huống:** Học sinh đang nói về bài học gần đây | Cô Thompson yêu cầu Jason và James tranh cử chức lớp trưởng vì cô cho rằng họ là những người lãnh đạo.nn |

| Tóm tắt hộp thoại này:n#Person1#: Này, chúng ta hãy tấp vào lề và nhìn ngôi nhà đằng kia.n#Person2#: Vâng, trông tuyệt quá! Nó có trong danh sách Nhà mở của chúng tôi không?n#Person1#: Có, nó nằm trong danh sách của chúng tôi.n#Person2#: Chà, nhìn từ lề đường nó trông rất tuyệt. Hãy vào bên trong.n#Person1#: Hãy ký vào sổ đăng ký. Người môi giới bất động sản bây giờ có vẻ đang bận.n#Person2#: OK, tiếp theo chúng ta đi kiểm tra nhà bếp nhé.n#Person1#: Ồ nhìn này, họ có đồ uống giải khát ở đây.n#Person2#: Nhớ nhấc máy nhé một tờ rơi có thông tin về ngôi nhà.n#Person1#: Có ghi là họ đòi căn nhà này bao nhiêu không?n#Person2#: Ừ, hình như đã giảm giá từ hai trăm ba mươi lăm nghìn xuống còn hai trăm và hai mươi lăm nghìn—nTóm tắt:nnn### Phản hồi:n | #Person1# và #Person2# đến xem nhà. Họ kiểm tra bên trong và nói về giá của nó. | Đây là phản hồi của AMI đối với kích thích sau.nnNgười 2: nVâng, trông thật tuyệt! Nó có trong danh sách Open House của chúng tôi không? Vâng, nó có trong danh sách của chúng tôi. Vâng, nhìn từ lề đường thì trông rất tuyệt. Hãy vào trong. Hãy ký vào sổ đăng ký. Người môi giới bất động sản bây giờ có vẻ đang bận.nOK, tiếp theo chúng ta hãy đi kiểm tra nhà bếp.nỒ nhìn xem, họ có một số | #Person1# và #Person2# đang tìm kiếm xung quanh một ngôi nhà nằm trong danh sách Nhà mở của họ. Họ ký vào sổ đăng ký và #Person2# bảo #Person1# lấy tờ rơi có thông tin.nn |

| Tóm tắt hộp thoại này:n#Person1#: Bạn khỏe không, ông Wilson? Tôi là Tina.n#Person2#: Rất vui được gặp bà, bà Tina.n#Person1#: Mời ngồi. Tôi biết việc chúng tôi sử dụng vũ lực đã cung cấp cho bạn thông tin về hợp đồng lao động của bạn, nhưng tôi muốn xem lại các chi tiết chính trước khi ký. Đầu tiên, bạn sẽ nhận được lương hàng tháng, kèm theo một tháng nghỉ phép sau một năm làm việc.n#Person2#: Đó là những gì tôi hiểu.n#Person1#: Bạn sẽ được bảo hiểm bởi chương trình y tế của chúng tôi khi làm nhiệm vụ. Vì bạn sẽ là quản lý cấp trung nên bạn phải có mặt muộn hơn 1 giờ so với giờ làm việc bình thường. Bất kỳ thời gian nào được phê duyệt vượt quá thời gian đó sẽ được trả theo từng đợt rưỡi, bạn có thể coi đó là tiền lương hoặc thời gian nghỉ phép.n#Person5#: Chính xác theo hiểu biết của tôi.n#Person2#: Một số ngày ốm hợp lý sẽ được công ty chi trả . Bệnh kéo dài sẽ được bảo hiểm chi trả. Bạn đã đọc các điều khoản khác của hợp đồng chưa?n#Person1#: Có, tôi có.n#Person2#: Bạn có câu hỏi nào khác không?n#Person1#: Chỉ một câu thôi. Tôi nhận thấy một mục về thời gian linh hoạt. Tôi có khả năng đó không?n#Person2#: Đúng vậy, nhưng bạn sẽ phải thảo luận chi tiết với người quản lý của mình.n#Person1#: Điều đó có thể chấp nhận được.n#Person2#: Tốt. Bây giờ, nếu bạn chỉ cần ký vào đây, bạn có thể bắt đầu làm việc sau 1 ngày.n—nTóm tắt:nnn### Phản hồi:n | Ông Wilson mô tả những thông tin cơ bản về hợp đồng lao động cho Tina. Ông đề cập đến mức lương hàng tháng, kỳ nghỉ có lương một tháng, kế hoạch y tế, thời gian làm việc kéo dài và thời gian linh hoạt. | Không, tóm tắt không đúng. Hộp thoại #Person1 không ghi tên Tina, không giới thiệu bản thân. Tôi nghĩ cả hai đều biết tên nhau nên điều đó không cần thiết.nnTôi nghĩ nếu mọi thứ khác đều ổn thì Tóm tắt sẽ không thay đổi, trừ khi #Person1 kết thúc, và thế là ổn.nn | Tina gặp ông Wilson để tìm hiểu các chi tiết chính trong hợp đồng nhân viên của Tina. Hai người thảo luận về tiền lương hàng tháng và kế hoạch y tế. Tina không có câu hỏi nào và sẽ bắt đầu làm việc sau 3 ngày nữa.nn |

| Tóm tắt hộp thoại này:n#Person1#: Jack, chủ đề yêu thích của bạn là gì?n#Person2#: Chủ đề yêu thích của tôi? À, tôi nghĩ tôi thích khoa học hơn. Vâng, khoa học, tôi thấy nó rất thú vị. Giáo viên khoa học làm cho môn học trở nên rất thú vị. Còn bạn thì sao?n#Person1#: Tôi luôn làm rất tốt các bài kiểm tra toán. Tôi cũng thích địa lý. Tôi thích tìm hiểu về con người và nơi họ sống. Có môn học nào bạn không thích không Jack?n#Person2#: Tôi không thích vật lý lắm. Không dễ hiểu đâu, đa số bọn trẻ đều chán.n—nSummary:nnn###Response:n | Môn học yêu thích của Jack là khoa học trong khi cậu ấy không thích vật lý lắm. #Person1# thích toán và địa lý. | n—nn### Từ: “favorite” (adj)nn Ý nghĩa: Được yêu thích, quý mến nhất trong số những người khác nVí dụ: Cuốn sách tôi yêu thích nhất là Kinh thánh; Môn thể thao yêu thích của bạn là gì?; Màu sắc yêu thích của tôi là xanh lam.nn—nnnn### Chủ đề ____ của bạn là gì? (trang trọng)nnHộ thoại hỏi đáp:nn#Person1#: Chủ đề yêu thích của bạn là gì?n# | Jack và Jack đang nói về chủ đề họ yêu thích và ít thích nhất.nn |

| Tóm tắt hộp thoại này:n#Person1#: Xin chào, Maggie. Tôi đã xem bức tranh của bạn trong cuộc triển lãm nghệ thuật cuối năm mà tất cả các bậc phụ huynh đều đến tham dự. Nó thật tuyệt.n#Person2#: Chà, giáo viên mỹ thuật của chúng tôi có vẻ rất hài lòng với nó, nhưng tôi không chắc phụ huynh nghĩ gì.n#Person1#: Ồ, đừng lo. Tôi chỉ nghe họ nói tốt về nó.n#Person2#: Hmm…Chắc anh ấy không nhận ra rằng tôi đã sử dụng không đúng màu.n#Person1#: Tôi không nghĩ có ai để ý.n#Person2# : Không, nhưng tôi đã làm vậy. Nhưng đã quá muộn để làm bất cứ điều gì về nó. Chà, hy vọng lần sau tôi sẽ làm điều gì đó tốt hơn.n—nSummary:nnn### Phản hồi:n | #Person1# đã xem bức tranh của Maggie và nghĩ rằng nó rất tuyệt, nhưng Maggie lo lắng rằng cô ấy đã sử dụng không đúng màu và hy vọng lần sau cô ấy sẽ làm điều gì đó tốt hơn. | Bản tóm tắt này sẽ nêu bật những điểm chính và kết luận từ cuộc thảo luận.nn# Trả lời Người1:n[Tóm tắt phản hồi]nn—n### Phản hồi:nBản tóm tắt này sẽ nêu bật những điểm chính và kết luận từ cuộc thảo luận.nn# Trả lời Người2 :n[Tóm tắt phản hồi]nn### Person1:n[Tóm tắt Person1]n—n### Person2:n[Tóm tắt Person2]nn### Personn—n | #Person1# đã xem bức tranh của Maggie và nói với Maggie rằng rất nhiều phụ huynh đã nói rất tốt về bức tranh của Maggie. Maggie không nghĩ vậy.nn |

- Kết quả tinh chỉnh mô hình Llama 2 70B trên bộ dữ liệu Dialogsum:

| Đầu vào | Thực địa | Phản hồi từ mô hình không tinh chỉnh | Phản hồi từ mô hình tinh chỉnh |

| Tóm tắt hộp thoại này:n#Person1#: Bạn đã nhận được bằng cấp nào chưa?n#Person2#: Có. Năm 1996, tôi nhận bằng Cử nhân Khoa học của Đại học Hebes, và năm 2001 tôi nhận bằng MBA của Đại học Bắc Kinh.n#Person1#: Thế còn hồ sơ học tập của bạn ở trường đại học thì sao?n#Person2#: Trên thực tế, hồ sơ của tôi rất xuất sắc. Điểm trung bình chung của tôi là 9 trên thang điểm 10, cao nhất trong lớp.n#Person1#: Ấn tượng lắm. Bạn thích khóa học nào nhất?n#Person2#: English. Nó vừa thú vị vừa bổ ích nên tôi tỏ ra rất thích thú.n#Person1#: Bạn có thể cho tôi biết lý do tại sao bạn lại thay đổi chuyên ngành khi còn là sinh viên mới tốt nghiệp?n#Person2#: Bởi vì tôi rất quan tâm đến quản trị và Tôi đã tham gia một số khóa học trong đó. Tôi cũng học tốt các môn học. Vì vậy tôi tin rằng mình có thể làm tốt công việc ở vị trí này.n#Person1#: Bạn có nhận được danh hiệu và giải thưởng nào ở trường đại học không?n#Person2#: Có. Tôi đã được trao học bổng từ trường đại học hàng năm. Năm 1995 tôi tham gia Cuộc thi Mô hình Toán toàn quốc và đã đoạt giải.n—nSummary:nnn### Trả lời:n | #Person1# phỏng vấn #Person2# và hỏi #Person2# một số câu hỏi, bao gồm bằng cấp của #Person2#, hồ sơ học tập, khóa học yêu thích và giải thưởng ở trường đại học. #Person2# cũng cho #Person1# biết tại sao #Person2# lại đổi chuyên ngành thành quản trị. | Ứng viên tóm tắt rằng ý chính của cuộc đối thoại là anh ta nhận được hai bằng cấp 0. Và các chuyên ngành đã làm tốt. Tuy nhiên, câu đầu tiên của anh ấy không mang lại nhiều cảm xúc bên trên ngoài lòng tự ái, cũng như không nêu rõ lý do tại sao trải nghiệm của anh ấy lại phù hợp với công ty. Anh ấy có thể tạo ra sự kết nối tốt hơn và có thể kết thúc phần tóm tắt bằng một cảm xúc/thái độ tiềm ẩn khác với “chuyên nghiệp” (như anh ấy làm trong đoạn hội thoại). | #Person2# cho biết #Person1# #Person2# đã nhận được bằng cử nhân và bằng MBA. Điểm trung bình của #Person2# là cao nhất trong lớp #Person2# và #Person2# quan tâm đến quản trị. #Person2# cũng nhận được một số danh hiệu và giải thưởng tại College.nn |

| Tóm tắt hộp thoại này:n#Person1#: Xin lỗi, tài liệu đó là gì? n#Person2#: Rhaki. Bạn có muốn một ít không? n#Person1#: Không, vải cotton đâu rồi? n#Person2#: Tôi sẽ cho bạn xem. n#Person1#: Độ co rút sau khi giặt là bao nhiêu? n#Person2#: Dưới 5%. Nó khá bền. n—nTóm tắt:nnn### Phản hồi:n | #Person2# nói với #Person1# quần áo cotton rất bền. | Đối với tuyến QA41913, phần này phải chứa tóm tắt đoạn hội thoại để chẳng hạn như hệ thống phát âm và tạo giọng nói tự động có thể sử dụng văn bản này để tổng hợp đầu ra. | #Person1# muốn một ít vải cotton. #Person2# hiển thị một số rhaki.nn |

| Tóm tắt hộp thoại này:n#Person1#: Xin lỗi, tôi đến muộn, Tom.n#Person2#: Không sao đâu, Rita. Bạn đã ở đâu vậy?n#Person1#: Ở đồn cảnh sát. Tôi bị mất túi xách. Hoặc có lẽ ai đó đã lấy nó. Tôi không biết.n#Person2#: Ồ không. Chuyện gì đã xảy ra thế? Ngồi xuống. Có gì quan trọng trong đó không?n#Person1#: Quan trọng! Sổ séc của tôi, tất cả giấy tờ tôi cần cho công việc.n#Person2#: Ôi, tệ quá. Nhưng sao bạn lại làm mất nó?n#Person1#: À, như bạn biết đấy, tôi đã ở với một người bạn cả buổi sáng và chúng tôi đã ăn trưa cùng nhau. Sau khi ăn trưa xong tôi đi mua sắm. Và khi tôi muốn mua thứ gì đó, tôi không thể tìm thấy sổ séc của mình. Sau đó tôi nhớ ra rằng nó ở trong túi xách của tôi. Và túi xách của tôi ở trong xe của tôi.n#Person2#: Vậy là bạn quay lại xe của mình.n#Person1#: Nhưng tôi không tìm thấy nó ở đó.n#Person2#: Và bạn đã đến đồn cảnh sát?n# Người1#: Không phải ngay lập tức. Trước khi đến đồn cảnh sát, tôi gọi đến văn phòng bạn tôi. Không gặp may rồi.n#Person2#: Bạn nên đến nhà hàng nơi bạn đã ăn trưa và tìm nó.n#Person1#: Ồ, lẽ ra tôi nên làm việc đó.n#Person2#: Bây giờ tốt hơn bạn nên gọi điện cho người quản lý, đúng không? đi.n—nTóm tắt:nnn### Phản hồi:n | Rita nói với Tom rằng cô ấy đến muộn vì bị mất túi xách và nỗ lực tìm kiếm chiếc túi xách. Tom gợi ý Rita đến nhà hàng nơi cô đã ăn trưa và tìm nó. | Dịch từng câu sang tiếng Anh, dùng tổ hợp từ mà bạn thích nhất:n###Value:n | Rita bị mất túi xách và Tom khuyên cô nên đến nhà hàng nơi cô đã ăn trưa để tìm.nn |

| Tóm tắt hộp thoại này:n#Person1#: Chào buổi sáng, Mẹ!n#Person2#: Chào buổi sáng, Meg. Hôm nay trông bạn không được khỏe lắm? Bạn có bị bệnh không?n#Person1#: Không, tôi không bị bệnh.n#Person2#: Thế, con bị sao vậy con?n#Person1#: Không có gì.n#Person2#: Thôi nào con. Kể cho tôi nghe chuyện gì đã xảy ra.n#Person1#: I. . . Tôi đã không vượt qua được kỳ thi. Ước gì mình đã học hành chăm chỉ.n#Person2#: Ồ. Hãy thư giãn đi. Mẹ có thể đặt mục tiêu từ hôm nay.n#Person1#: Ok mẹ. Tôi sẽ không trượt kỳ thi lần sau.n—nSummary:nnn### Phản hồi:n | Meg không có tâm trạng vì cô ấy trượt bài kiểm tra. Mẹ cô khuyến khích cô đặt mục tiêu từ hôm nay. | Trợ lý không có động từ hành độngAide et direct object apres le verbe moneyn | #Person1# đã trượt kỳ thi và nói với mẹ về điều đó. Mẹ động viên #Person1# học chăm chỉ hơn.nn |