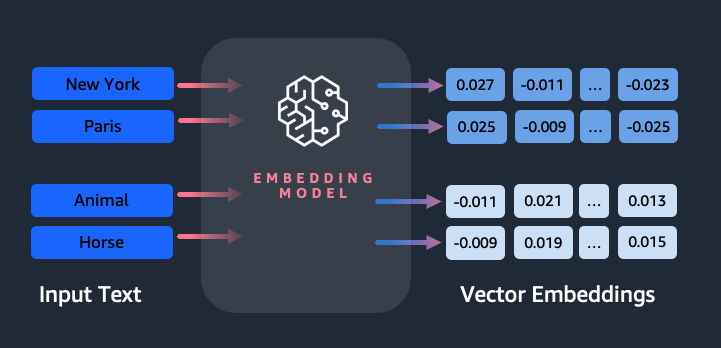

Nhúng đóng một vai trò quan trọng trong xử lý ngôn ngữ tự nhiên (NLP) và học máy (ML). Nhúng văn bản đề cập đến quá trình chuyển đổi văn bản thành các biểu diễn số nằm trong không gian vectơ nhiều chiều. Kỹ thuật này đạt được thông qua việc sử dụng thuật toán ML cho phép hiểu ý nghĩa và bối cảnh của dữ liệu (mối quan hệ ngữ nghĩa) cũng như tìm hiểu các mối quan hệ và mẫu phức tạp trong dữ liệu (mối quan hệ cú pháp). Bạn có thể sử dụng các biểu diễn vectơ thu được cho nhiều ứng dụng, chẳng hạn như truy xuất thông tin, phân loại văn bản, xử lý ngôn ngữ tự nhiên và nhiều ứng dụng khác.

Nhúng văn bản Amazon Titan là mô hình nhúng văn bản giúp chuyển đổi văn bản ngôn ngữ tự nhiên—bao gồm các từ, cụm từ hoặc thậm chí các tài liệu lớn—thành các biểu diễn số có thể được sử dụng để hỗ trợ các trường hợp sử dụng như tìm kiếm, cá nhân hóa và phân cụm dựa trên sự tương đồng về ngữ nghĩa.

Trong bài đăng này, chúng tôi thảo luận về mô hình Nhúng văn bản Amazon Titan, các tính năng của nó và các trường hợp sử dụng ví dụ.

Một số khái niệm chính bao gồm:

- Biểu diễn số của văn bản (vectơ) nắm bắt ngữ nghĩa và mối quan hệ giữa các từ

- Các phần nhúng phong phú có thể được sử dụng để so sánh độ giống nhau của văn bản

- Việc nhúng văn bản đa ngôn ngữ có thể xác định ý nghĩa trong các ngôn ngữ khác nhau

Làm thế nào một đoạn văn bản được chuyển đổi thành một vector?

Có nhiều kỹ thuật để chuyển đổi một câu thành một vector. Một phương pháp phổ biến là sử dụng các thuật toán nhúng từ, chẳng hạn như Word2Vec, GloVe hoặc FastText, sau đó tổng hợp các từ nhúng để tạo thành biểu diễn vectơ cấp độ câu.

Một cách tiếp cận phổ biến khác là sử dụng các mô hình ngôn ngữ lớn (LLM), như BERT hoặc GPT, có thể cung cấp các phần nhúng theo ngữ cảnh cho toàn bộ câu. Những mô hình này dựa trên các kiến trúc học sâu như Transformers, có thể nắm bắt thông tin theo ngữ cảnh và mối quan hệ giữa các từ trong câu một cách hiệu quả hơn.

Tại sao chúng ta cần một mô hình nhúng?

Việc nhúng vectơ là nền tảng để LLM hiểu mức độ ngữ nghĩa của ngôn ngữ và cũng cho phép LLM thực hiện tốt các nhiệm vụ NLP xuôi dòng như phân tích tình cảm, nhận dạng thực thể được đặt tên và phân loại văn bản.

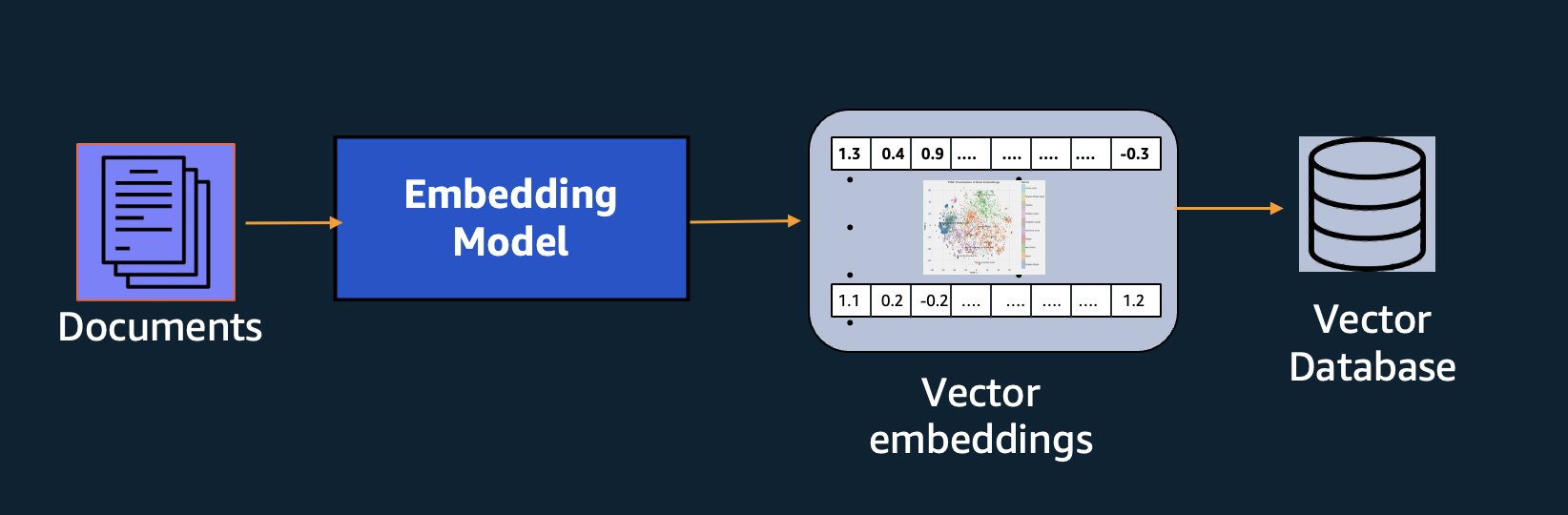

Ngoài tìm kiếm ngữ nghĩa, bạn có thể sử dụng các phần nhúng để tăng cường lời nhắc để có kết quả chính xác hơn thông qua Thế hệ tăng cường truy xuất (RAG)—nhưng để sử dụng chúng, bạn sẽ cần lưu trữ chúng trong cơ sở dữ liệu có khả năng vectơ.

Mô hình Nhúng văn bản Amazon Titan được tối ưu hóa cho việc truy xuất văn bản nhằm hỗ trợ các trường hợp sử dụng RAG. Trước tiên, nó cho phép bạn chuyển đổi dữ liệu văn bản của mình thành biểu diễn số hoặc vectơ, sau đó sử dụng các vectơ đó để tìm kiếm chính xác các đoạn có liên quan từ cơ sở dữ liệu vectơ, cho phép bạn tận dụng tối đa dữ liệu độc quyền của mình kết hợp với các mô hình nền tảng khác.

Bởi vì Nhúng văn bản Amazon Titan là một mô hình được quản lý trên nền tảng Amazon, nó được cung cấp dưới dạng trải nghiệm hoàn toàn không có máy chủ. Bạn có thể sử dụng nó thông qua Amazon Bedrock REST API hoặc SDK AWS. Các tham số bắt buộc là văn bản mà bạn muốn tạo phần nhúng và modelID tham số, đại diện cho tên của mô hình Amazon Titan Text Embeddings. Mã sau đây là ví dụ sử dụng AWS SDK cho Python (Boto3):

Đầu ra sẽ trông giống như sau:

Tham khảo Thiết lập boto3 của Amazon Bedrock để biết thêm chi tiết về cách cài đặt các gói cần thiết, hãy kết nối với Amazon Bedrock và gọi mô hình.

Các tính năng của tính năng nhúng văn bản Amazon Titan

Với tính năng nhúng văn bản Amazon Titan, bạn có thể nhập tới 8,000 mã thông báo, rất phù hợp để làm việc với các từ, cụm từ hoặc toàn bộ tài liệu tùy theo trường hợp sử dụng của bạn. người khổng lồ Amazon trả về vectơ đầu ra có kích thước 1536, mang lại độ chính xác cao, đồng thời tối ưu hóa để có kết quả có độ trễ thấp, tiết kiệm chi phí.

Tính năng nhúng văn bản của Amazon Titan hỗ trợ tạo và truy vấn các phần nhúng cho văn bản bằng hơn 25 ngôn ngữ khác nhau. Điều này có nghĩa là bạn có thể áp dụng mô hình cho các trường hợp sử dụng của mình mà không cần tạo và duy trì các mô hình riêng biệt cho từng ngôn ngữ bạn muốn hỗ trợ.

Việc đào tạo một mô hình nhúng duy nhất trên nhiều ngôn ngữ sẽ mang lại những lợi ích chính sau:

- Phạm vi tiếp cận rộng hơn – Bằng cách hỗ trợ sẵn hơn 25 ngôn ngữ, bạn có thể mở rộng phạm vi tiếp cận của ứng dụng của mình tới người dùng và nội dung ở nhiều thị trường quốc tế.

- Hiệu suất phù hợp – Với mô hình thống nhất bao gồm nhiều ngôn ngữ, bạn sẽ nhận được kết quả nhất quán trên các ngôn ngữ thay vì tối ưu hóa riêng lẻ cho từng ngôn ngữ. Mô hình này được đào tạo một cách toàn diện để bạn có được lợi thế trên nhiều ngôn ngữ.

- Hỗ trợ truy vấn đa ngôn ngữ – Tính năng nhúng văn bản của Amazon Titan cho phép truy vấn nội dung nhúng văn bản bằng bất kỳ ngôn ngữ nào được hỗ trợ. Điều này mang lại sự linh hoạt để truy xuất nội dung tương tự về mặt ngữ nghĩa giữa các ngôn ngữ mà không bị giới hạn ở một ngôn ngữ duy nhất. Bạn có thể xây dựng các ứng dụng truy vấn và phân tích dữ liệu đa ngôn ngữ bằng cách sử dụng cùng một không gian nhúng thống nhất.

Theo văn bản này, các ngôn ngữ sau được hỗ trợ:

- Tiếng Ả Rập

- Tiếng Trung (giản thể)

- Tiếng Trung (Phồn Thể)

- tiếng séc

- Tiếng Hà Lan

- Tiếng Anh

- Tiếng Pháp

- Tiếng Đức

- Hebrew

- Tiếng Hin-ddi

- Tiếng Ý

- Tiếng Nhật

- kannada

- Tiếng Hàn

- Malayalam

- Marathi

- Tiếng Ba Lan

- Bồ Đào Nha

- Tiếng Nga

- Tiếng Tây Ban Nha

- Tiếng Thụy Điển

- Tiếng Tagalog của Philippines

- tamil

- telugu

- Tiếng Thổ Nhĩ Kỳ

Sử dụng nhúng văn bản Amazon Titan với LangChain

LangChain là một framework mã nguồn mở phổ biến để làm việc với trí tuệ nhân tạo mô hình và công nghệ hỗ trợ. Nó bao gồm một Ứng dụng khách BedrockEmbeddings bao bọc Boto3 SDK một cách thuận tiện bằng một lớp trừu tượng. Các BedrockEmbeddings client cho phép bạn làm việc trực tiếp với văn bản và nội dung nhúng mà không cần biết chi tiết về cấu trúc yêu cầu hoặc phản hồi JSON. Sau đây là một ví dụ đơn giản:

Bạn cũng có thể sử dụng LangChain BedrockEmbeddings khách hàng cùng với khách hàng Amazon Bedrock LLM để đơn giản hóa việc triển khai RAG, tìm kiếm ngữ nghĩa và các mẫu liên quan đến nội dung nhúng khác.

Các trường hợp sử dụng cho phần nhúng

Mặc dù RAG hiện là trường hợp sử dụng phổ biến nhất để làm việc với các phần nhúng, nhưng có nhiều trường hợp sử dụng khác có thể áp dụng các phần nhúng. Sau đây là một số tình huống bổ sung mà bạn có thể sử dụng phần nhúng để giải quyết các vấn đề cụ thể, một mình hoặc hợp tác với LLM:

- Câu hỏi và trả lời – Phần nhúng có thể giúp hỗ trợ giao diện hỏi đáp thông qua mẫu RAG. Việc tạo các phần nhúng được ghép nối với cơ sở dữ liệu vectơ cho phép bạn tìm thấy sự trùng khớp chặt chẽ giữa các câu hỏi và nội dung trong kho kiến thức.

- Đề xuất được cá nhân hóa – Tương tự như câu hỏi và câu trả lời, bạn có thể sử dụng tính năng nhúng để tìm điểm đến cho kỳ nghỉ, trường đại học, phương tiện đi lại hoặc các sản phẩm khác dựa trên tiêu chí do người dùng cung cấp. Điều này có thể ở dạng một danh sách phù hợp đơn giản hoặc sau đó bạn có thể sử dụng LLM để xử lý từng đề xuất và giải thích cách đề xuất đó đáp ứng các tiêu chí của người dùng. Bạn cũng có thể sử dụng phương pháp này để tạo “10 bài viết hay nhất” tùy chỉnh cho người dùng dựa trên nhu cầu cụ thể của họ.

- Quản lý dữ liệu – Khi bạn có các nguồn dữ liệu không ánh xạ rõ ràng với nhau nhưng lại có nội dung văn bản mô tả bản ghi dữ liệu, bạn có thể sử dụng phần nhúng để xác định các bản ghi có thể trùng lặp. Ví dụ: bạn có thể sử dụng phần nhúng để xác định các ứng cử viên trùng lặp có thể sử dụng định dạng, chữ viết tắt khác hoặc thậm chí có tên được dịch.

- Hợp lý hóa danh mục đầu tư ứng dụng – Khi tìm cách sắp xếp các danh mục ứng dụng giữa công ty mẹ và mua lại, không phải lúc nào cũng rõ ràng nên bắt đầu tìm kiếm sự chồng chéo tiềm năng ở đâu. Chất lượng của dữ liệu quản lý cấu hình có thể là một yếu tố hạn chế và có thể khó phối hợp giữa các nhóm để hiểu được bối cảnh ứng dụng. Bằng cách sử dụng kết hợp ngữ nghĩa với các phần nhúng, chúng tôi có thể phân tích nhanh trên các danh mục ứng dụng để xác định các ứng dụng có tiềm năng cao để hợp lý hóa.

- Nhóm nội dung – Bạn có thể sử dụng phần nhúng để giúp tạo điều kiện thuận lợi cho việc nhóm nội dung tương tự thành các danh mục mà bạn có thể không biết trước. Ví dụ: giả sử bạn có một bộ sưu tập email của khách hàng hoặc các bài đánh giá sản phẩm trực tuyến. Bạn có thể tạo các phần nhúng cho từng mục, sau đó chạy các phần nhúng đó thông qua k-có nghĩa là phân cụm để xác định các nhóm hợp lý về mối quan tâm của khách hàng, khen ngợi hoặc phàn nàn về sản phẩm hoặc các chủ đề khác. Sau đó, bạn có thể tạo các bản tóm tắt tập trung từ nội dung của các nhóm đó bằng LLM.

Ví dụ về tìm kiếm ngữ nghĩa

Trong của chúng tôi ví dụ trên GitHub, chúng tôi trình diễn một ứng dụng tìm kiếm nội dung nhúng đơn giản với Amazon Titan Text Embeddings, LangChain và Streamlit.

Ví dụ này khớp truy vấn của người dùng với các mục nhập gần nhất trong cơ sở dữ liệu vectơ trong bộ nhớ. Sau đó chúng tôi hiển thị những kết quả phù hợp đó trực tiếp trong giao diện người dùng. Điều này có thể hữu ích nếu bạn muốn khắc phục sự cố ứng dụng RAG hoặc đánh giá trực tiếp mô hình nhúng.

Để đơn giản, chúng tôi sử dụng trong bộ nhớ THẤT BẠI cơ sở dữ liệu để lưu trữ và tìm kiếm các vectơ nhúng. Trong kịch bản thế giới thực ở quy mô lớn, bạn có thể sẽ muốn sử dụng kho lưu trữ dữ liệu liên tục như công cụ vector cho Amazon OpenSearch Serverless hoặc là pgvector phần mở rộng cho PostgreSQL.

Hãy thử một vài lời nhắc từ ứng dụng web bằng các ngôn ngữ khác nhau, chẳng hạn như sau:

- Làm cách nào tôi có thể theo dõi việc sử dụng của mình?

- Làm cách nào tôi có thể tùy chỉnh các mô hình?

- Tôi có thể sử dụng ngôn ngữ lập trình nào?

- Bình luận mes données sont-elles sécurisées ?

- 私のデータはどのように保護されていますか?

- Những điều cần thiết của mô hình được cung cấp cho Bedrock?

- Tại khu vực Welchen này có phải là phiên bản Amazon Bedrock không?

- 有哪些级别的支持?

Lưu ý rằng mặc dù tài liệu nguồn bằng tiếng Anh nhưng các truy vấn bằng các ngôn ngữ khác vẫn khớp với các mục nhập có liên quan.

Kết luận

Khả năng tạo văn bản của các mô hình nền tảng rất thú vị, nhưng điều quan trọng cần nhớ là hiểu văn bản, tìm nội dung có liên quan từ khối kiến thức và tạo kết nối giữa các đoạn văn là rất quan trọng để đạt được toàn bộ giá trị của AI tạo ra. Chúng ta sẽ tiếp tục thấy các trường hợp sử dụng mới và thú vị cho tính năng nhúng xuất hiện trong những năm tới khi các mô hình này tiếp tục được cải thiện.

Các bước tiếp theo

Bạn có thể tìm thấy các ví dụ bổ sung về phần nhúng dưới dạng sổ ghi chép hoặc ứng dụng demo trong các hội thảo sau:

Về các tác giả

Jason Stehle là Kiến trúc sư giải pháp cấp cao tại AWS, có trụ sở tại khu vực New England. Anh làm việc với khách hàng để điều chỉnh khả năng của AWS phù hợp với những thách thức kinh doanh lớn nhất của họ. Ngoài giờ làm việc, anh dành thời gian xây dựng mọi thứ và xem phim truyện tranh cùng gia đình.

Jason Stehle là Kiến trúc sư giải pháp cấp cao tại AWS, có trụ sở tại khu vực New England. Anh làm việc với khách hàng để điều chỉnh khả năng của AWS phù hợp với những thách thức kinh doanh lớn nhất của họ. Ngoài giờ làm việc, anh dành thời gian xây dựng mọi thứ và xem phim truyện tranh cùng gia đình.

Nitin Eusebius là Kiến trúc sư giải pháp doanh nghiệp cấp cao tại AWS, có kinh nghiệm về Kỹ thuật phần mềm, Kiến trúc doanh nghiệp và AI/ML. Anh ấy rất đam mê khám phá các khả năng của AI có thể tạo ra. Anh cộng tác với khách hàng để giúp họ xây dựng các ứng dụng có kiến trúc tốt trên nền tảng AWS và tận tâm giải quyết các thách thức công nghệ cũng như hỗ trợ hành trình đám mây của họ.

Nitin Eusebius là Kiến trúc sư giải pháp doanh nghiệp cấp cao tại AWS, có kinh nghiệm về Kỹ thuật phần mềm, Kiến trúc doanh nghiệp và AI/ML. Anh ấy rất đam mê khám phá các khả năng của AI có thể tạo ra. Anh cộng tác với khách hàng để giúp họ xây dựng các ứng dụng có kiến trúc tốt trên nền tảng AWS và tận tâm giải quyết các thách thức công nghệ cũng như hỗ trợ hành trình đám mây của họ.

Raj Pathak là Kiến trúc sư Giải pháp Chính và Cố vấn Kỹ thuật cho các công ty lớn trong Fortune 50 và các tổ chức dịch vụ tài chính cỡ vừa (FSI) trên khắp Canada và Hoa Kỳ. Anh ấy chuyên về các ứng dụng học máy như AI tổng quát, xử lý ngôn ngữ tự nhiên, xử lý tài liệu thông minh và MLOps.

Raj Pathak là Kiến trúc sư Giải pháp Chính và Cố vấn Kỹ thuật cho các công ty lớn trong Fortune 50 và các tổ chức dịch vụ tài chính cỡ vừa (FSI) trên khắp Canada và Hoa Kỳ. Anh ấy chuyên về các ứng dụng học máy như AI tổng quát, xử lý ngôn ngữ tự nhiên, xử lý tài liệu thông minh và MLOps.

Mani Khanuja là Trưởng nhóm công nghệ – Chuyên gia AI sáng tạo, tác giả cuốn sách – Học máy ứng dụng và tính toán hiệu năng cao trên AWS, đồng thời là thành viên Ban Giám đốc dành cho Phụ nữ trong Ban Tổ chức Giáo dục Sản xuất. Cô lãnh đạo các dự án học máy (ML) trong nhiều lĩnh vực khác nhau như thị giác máy tính, xử lý ngôn ngữ tự nhiên và AI tổng quát. Cô giúp khách hàng xây dựng, đào tạo và triển khai các mô hình máy học lớn trên quy mô lớn. Cô phát biểu trong các hội nghị nội bộ và bên ngoài như re:Invent, Women in Manufacturing West, hội thảo trực tuyến trên YouTube và GHC 23. Khi rảnh rỗi, cô thích chạy bộ dài dọc bãi biển.

Mani Khanuja là Trưởng nhóm công nghệ – Chuyên gia AI sáng tạo, tác giả cuốn sách – Học máy ứng dụng và tính toán hiệu năng cao trên AWS, đồng thời là thành viên Ban Giám đốc dành cho Phụ nữ trong Ban Tổ chức Giáo dục Sản xuất. Cô lãnh đạo các dự án học máy (ML) trong nhiều lĩnh vực khác nhau như thị giác máy tính, xử lý ngôn ngữ tự nhiên và AI tổng quát. Cô giúp khách hàng xây dựng, đào tạo và triển khai các mô hình máy học lớn trên quy mô lớn. Cô phát biểu trong các hội nghị nội bộ và bên ngoài như re:Invent, Women in Manufacturing West, hội thảo trực tuyến trên YouTube và GHC 23. Khi rảnh rỗi, cô thích chạy bộ dài dọc bãi biển.

Đánh dấu Roy là Kiến trúc sư máy học chính của AWS, giúp khách hàng thiết kế và xây dựng các giải pháp AI/ML. Công việc của Mark bao gồm nhiều trường hợp sử dụng ML, với mối quan tâm chính là thị giác máy tính, học sâu và mở rộng quy mô ML trên toàn doanh nghiệp. Ông đã giúp các công ty trong nhiều ngành công nghiệp, bao gồm bảo hiểm, dịch vụ tài chính, truyền thông và giải trí, chăm sóc sức khỏe, tiện ích và sản xuất. Mark có sáu Chứng nhận AWS, bao gồm cả Chứng nhận Chuyên môn ML. Trước khi gia nhập AWS, Mark là kiến trúc sư, nhà phát triển và lãnh đạo công nghệ trong hơn 25 năm, trong đó có 19 năm làm việc trong lĩnh vực dịch vụ tài chính.

Đánh dấu Roy là Kiến trúc sư máy học chính của AWS, giúp khách hàng thiết kế và xây dựng các giải pháp AI/ML. Công việc của Mark bao gồm nhiều trường hợp sử dụng ML, với mối quan tâm chính là thị giác máy tính, học sâu và mở rộng quy mô ML trên toàn doanh nghiệp. Ông đã giúp các công ty trong nhiều ngành công nghiệp, bao gồm bảo hiểm, dịch vụ tài chính, truyền thông và giải trí, chăm sóc sức khỏe, tiện ích và sản xuất. Mark có sáu Chứng nhận AWS, bao gồm cả Chứng nhận Chuyên môn ML. Trước khi gia nhập AWS, Mark là kiến trúc sư, nhà phát triển và lãnh đạo công nghệ trong hơn 25 năm, trong đó có 19 năm làm việc trong lĩnh vực dịch vụ tài chính.

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- PlatoData.Network Vertical Generative Ai. Trao quyền cho chính mình. Truy cập Tại đây.

- PlatoAiStream. Thông minh Web3. Kiến thức khuếch đại. Truy cập Tại đây.

- Trung tâmESG. Than đá, công nghệ sạch, Năng lượng, Môi trường Hệ mặt trời, Quản lý chất thải. Truy cập Tại đây.

- PlatoSức khỏe. Tình báo thử nghiệm lâm sàng và công nghệ sinh học. Truy cập Tại đây.

- nguồn: https://aws.amazon.com/blogs/machine-learning/getting-started-with-amazon-titan-text-embeddings/

- : có

- :là

- :không phải

- :Ở đâu

- $ LÊN

- 000

- 10

- 100

- 12

- 121

- 125

- 19

- 23

- 25

- 50

- 7

- 8

- a

- Giới thiệu

- sự trừu tượng

- Chấp nhận

- chính xác

- chính xác

- chính xác

- đạt được

- đạt được

- mua lại

- ngang qua

- Ngoài ra

- thêm vào

- Lợi thế

- cố vấn

- tổng hợp

- trước

- AI

- AI / ML

- thuật toán

- sắp xếp

- Tất cả

- cho phép

- Cho phép

- cho phép

- dọc theo

- bên cạnh

- Ngoài ra

- luôn luôn

- đàn bà gan dạ

- Amazon Web Services

- an

- phân tích

- phân tích

- và

- trả lời

- bất kì

- Các Ứng Dụng

- các ứng dụng

- áp dụng

- Đăng Nhập

- phương pháp tiếp cận

- kiến trúc

- kiến trúc

- LÀ

- KHU VỰC

- bài viết

- AS

- trợ giúp

- At

- tăng

- tăng cường

- tác giả

- có sẵn

- AWS

- dựa

- BE

- bờ biển

- được

- Lợi ích

- giữa

- bảng

- ban giám đốc

- thân hình

- cuốn sách

- Hộp

- xây dựng

- Xây dựng

- kinh doanh

- nhưng

- by

- CAN

- Canada

- ứng cử viên

- ứng cử viên

- khả năng

- nắm bắt

- chụp

- trường hợp

- trường hợp

- đố

- Chứng nhận

- chứng chỉ

- thách thức

- phân loại

- khách hàng

- Đóng

- đám mây

- tập hợp

- mã

- hợp tác

- bộ sưu tập

- Trường Cao đẳng

- kết hợp

- Chung

- Các công ty

- công ty

- so sánh

- khiếu nại

- phức tạp

- máy tính

- Tầm nhìn máy tính

- máy tính

- khái niệm

- Mối quan tâm

- hội nghị

- Cấu hình

- Kết nối

- liên quan

- Kết nối

- thích hợp

- nội dung

- bối cảnh

- theo ngữ cảnh

- tiếp tục

- thuận tiện

- chuyển đổi

- chuyển đổi

- hợp tác

- điều phối

- chi phí-hiệu quả

- có thể

- bao gồm

- Covers

- tạo

- Tạo

- tiêu chuẩn

- quan trọng

- Hiện nay

- khách hàng

- khách hàng

- khách hàng

- tùy chỉnh

- dữ liệu

- Cơ sở dữ liệu

- de

- dành riêng

- sâu

- học kĩ càng

- sâu

- định nghĩa

- Bằng cấp

- bản demo

- chứng minh

- triển khai

- mô tả

- Thiết kế

- khu

- chi tiết

- Nhà phát triển

- khác nhau

- khó khăn

- kích thước

- trực tiếp

- Giám đốc

- thảo luận

- Giao diện

- do

- tài liệu

- tài liệu

- lĩnh vực

- dont

- mỗi

- Đào tạo

- hiệu quả

- hay

- nhúng

- xuất hiện

- cho phép

- cho phép

- Động cơ

- Kỹ Sư

- Nước Anh

- Tiếng Anh

- Doanh nghiệp

- Giải trí

- Toàn bộ

- hoàn toàn

- thực thể

- đánh giá

- Ngay cả

- ví dụ

- ví dụ

- thú vị

- Mở rộng

- kinh nghiệm

- kinh nghiệm

- Giải thích

- Khám phá

- mở rộng

- ngoài

- tạo điều kiện

- yếu tố

- gia đình

- Tính năng

- vài

- tài chính

- dịch vụ tài chính

- Tìm kiếm

- tìm kiếm

- Tên

- Linh hoạt

- tập trung

- tiếp theo

- Trong

- hình thức

- Vận may

- Nền tảng

- Khung

- Miễn phí

- từ

- Full

- cơ bản

- tạo ra

- thế hệ

- thế hệ

- Trí tuệ nhân tạo

- được

- nhận được

- Cho

- găng tay

- Go

- lớn nhất

- có

- Có

- he

- chăm sóc sức khỏe

- giúp đỡ

- đã giúp

- giúp đỡ

- giúp

- cô

- Cao

- của mình

- giữ

- Độ đáng tin của

- Hướng dẫn

- HTML

- HTTPS

- i

- xác định

- if

- thực hiện

- nhập khẩu

- quan trọng

- nâng cao

- in

- Mặt khác

- bao gồm

- bao gồm

- Bao gồm

- các ngành công nghiệp

- thông tin

- đầu vào

- cài đặt, dựng lên

- thay vì

- tổ chức

- bảo hiểm

- Thông minh

- Xử lý tài liệu thông minh

- quan tâm

- thú vị

- Giao thức

- giao diện

- nội bộ

- Quốc Tế

- trong

- IT

- ITS

- tham gia

- cuộc hành trình

- jpg

- json

- Key

- Biết

- Biết

- kiến thức

- cảnh quan

- Ngôn ngữ

- Ngôn ngữ

- lớn

- lớp

- dẫn

- lãnh đạo

- Dẫn

- học tập

- cho phép

- Lượt thích

- Có khả năng

- Lượt thích

- hạn chế

- Danh sách

- LLM

- hợp lý

- dài

- Xem

- tìm kiếm

- máy

- học máy

- duy trì

- làm cho

- Làm

- quản lý

- quản lý

- sản xuất

- nhiều

- bản đồ

- dấu

- Điểm

- thị trường

- phù hợp

- diêm

- phù hợp

- vật liệu

- me

- có nghĩa là

- có nghĩa

- Phương tiện truyền thông

- hội viên

- phương pháp

- Might

- ML

- MLOps

- kiểu mẫu

- mô hình

- Màn Hình

- chi tiết

- hầu hết

- Phổ biến nhất

- Phim Điện Ảnh

- nhiều

- my

- tên

- Được đặt theo tên

- tên

- Tự nhiên

- Xử lý ngôn ngữ tự nhiên

- Cần

- cần

- nhu cầu

- Mới

- tiếp theo

- nlp

- Rõ ràng

- of

- cung cấp

- on

- ONE

- Trực tuyến

- mở

- mã nguồn mở

- tối ưu hóa

- tối ưu hóa

- or

- gọi món

- Nền tảng khác

- Khác

- vfoXNUMXfipXNUMXhfpiXNUMXufhpiXNUMXuf

- ra

- đầu ra

- bên ngoài

- kết thúc

- trùng lặp

- riêng

- gói

- ghép đôi

- tham số

- thông số

- công ty mẹ

- đoạn

- đam mê

- Họa tiết

- mô hình

- mỗi

- Thực hiện

- hiệu suất

- cá nhân

- cụm từ

- mảnh

- nền tảng

- plato

- Thông tin dữ liệu Plato

- PlatoDữ liệu

- Play

- xin vui lòng

- Phổ biến

- BY

- danh mục đầu tư

- danh mục đầu tư

- khả năng

- Bài đăng

- postgresql

- tiềm năng

- quyền lực

- chính

- Hiệu trưởng

- In

- Trước khi

- vấn đề

- quá trình

- xử lý

- Sản phẩm

- Nhận xét sản phẩm

- Sản phẩm

- Lập trình

- ngôn ngữ lập trình

- dự án

- nhắc nhở

- độc quyền

- cho

- cung cấp

- cung cấp

- Python

- chất lượng

- truy vấn

- truy vấn

- câu hỏi

- Câu hỏi

- Nhanh chóng

- giẻ lau

- phạm vi

- RE

- đạt

- thế giới thực

- công nhận

- Khuyến nghị

- khuyến nghị

- ghi

- hồ sơ

- đề cập

- Mối quan hệ

- có liên quan

- nhớ

- kho

- đại diện

- đại diện cho

- yêu cầu

- cần phải

- phản ứng

- REST của

- hạn chế

- kết quả

- Kết quả

- thu hồi

- Trả về

- Đánh giá

- Vai trò

- chạy

- chạy

- s

- tương tự

- nói

- Quy mô

- mở rộng quy mô

- kịch bản

- kịch bản

- sdk

- Tìm kiếm

- xem

- ngữ nghĩa

- ngữ nghĩa

- cao cấp

- kết án

- tình cảm

- riêng biệt

- Không có máy chủ

- DỊCH VỤ

- chị ấy

- tương tự

- Đơn giản

- đơn giản

- đơn giản hóa

- đơn giản hóa

- duy nhất

- Six

- So

- Phần mềm

- kỹ thuật phần mềm

- Giải pháp

- động SOLVE

- Giải quyết

- một số

- một cái gì đó

- nguồn

- nguồn

- Không gian

- Nói

- chuyên gia

- chuyên

- Đặc biệt

- riêng

- Bắt đầu

- bắt đầu

- Bang

- hàng

- cấu trúc

- như vậy

- hỗ trợ

- Hỗ trợ

- Hỗ trợ

- Hỗ trợ

- Hãy

- nhiệm vụ

- đội

- công nghệ cao

- Kỹ thuật

- kỹ thuật

- kỹ thuật

- Công nghệ

- Công nghệ

- nói

- văn bản

- Phân loại văn bản

- việc này

- Sản phẩm

- Nguồn

- cung cấp their dịch

- Them

- chủ đề

- sau đó

- Đó

- Kia là

- điều

- điều này

- những

- Tuy nhiên?

- Thông qua

- thời gian

- titan

- đến

- Tokens

- truyền thống

- Train

- đào tạo

- máy biến áp

- biến đổi

- hiểu

- sự hiểu biết

- thống nhât

- Kỳ

- Hoa Kỳ

- Sử dụng

- sử dụng

- ca sử dụng

- đã sử dụng

- hữu ích

- người sử dang

- Giao diện người dùng

- Người sử dụng

- sử dụng

- tiện ích

- kỳ nghỉ

- giá trị

- khác nhau

- Xe cộ

- rất

- thông qua

- tầm nhìn

- muốn

- là

- xem

- we

- web

- Ứng dụng web

- các dịch vụ web

- Hội thảo

- TỐT

- là

- hướng Tây

- khi nào

- cái nào

- trong khi

- rộng

- Phạm vi rộng

- sẽ

- với

- ở trong

- không có

- Dành cho Nữ

- Từ

- từ

- Công việc

- đang làm việc

- công trinh

- Hội thảo

- sẽ

- viết

- viết

- năm

- Bạn

- trên màn hình

- youtube

- zephyrnet