Video Mô hình ngôn ngữ AI lớn nhất của Google đang giúp robot linh hoạt hơn trong việc hiểu và diễn giải các lệnh của con người, theo nghiên cứu mới nhất của gã khổng lồ web.

Máy móc thường đáp ứng tốt nhất các yêu cầu rất cụ thể - các yêu cầu mở đôi khi có thể khiến chúng bị loại bỏ và dẫn đến kết quả mà người dùng không nghĩ đến. Mọi người học cách tương tác với robot một cách cứng nhắc, như đặt câu hỏi theo một cách cụ thể để nhận được phản hồi mong muốn.

Tuy nhiên, hệ thống mới nhất của Google, được gọi là PaLM-SayCan, hứa hẹn sẽ thông minh hơn. Thiết bị vật lý của Everyday Robots - một công ty khởi nghiệp được tách ra từ Google X - có camera cho đôi mắt trong đầu và một cánh tay có gọng kìm giấu sau thân dài thẳng của nó, nằm trên đầu một bộ bánh xe.

Bạn có thể xem robot hoạt động trong video dưới đây:

Hỏi robot, đại loại như "Tôi vừa mới tập thể dục, bạn có thể lấy cho tôi một món ăn nhẹ lành mạnh không?" sẽ thúc đẩy nó vào việc tìm nạp một quả táo. “PaLM-SayCan [là] một cách tiếp cận tổng quát và có thể diễn giải để tận dụng kiến thức từ các mô hình ngôn ngữ cho phép rô bốt làm theo các hướng dẫn văn bản cấp cao để thực hiện các nhiệm vụ cơ bản”, các nhà khoa học nghiên cứu từ nhóm Brain của Google Giải thích.

Google giới thiệu mô hình ngôn ngữ lớn nhất của mình Lòng bàn tay vào tháng XNUMX năm nay. PaLM đã được đào tạo về dữ liệu cóp nhặt từ internet, nhưng thay vì đưa ra các phản hồi văn bản mở, hệ thống đã được điều chỉnh để tạo ra một danh sách các hướng dẫn cho rô bốt làm theo.

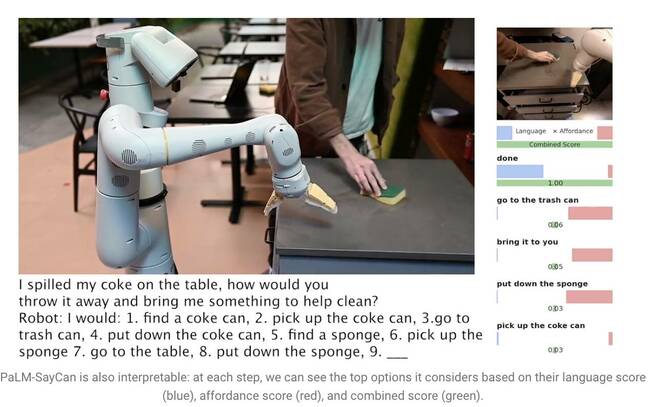

Nói “Tôi đã làm đổ Coca của mình trên bàn, bạn sẽ vứt nó đi và mang cho tôi thứ gì đó để dọn dẹp? nhặt lon, ném vào thùng và lấy một miếng bọt biển.

Tuy nhiên, các mô hình ngôn ngữ lớn (LLM) như PaLM không hiểu ý nghĩa của bất kỳ điều gì họ nói. Vì lý do này, các nhà nghiên cứu đã đào tạo một mô hình riêng biệt bằng cách sử dụng phương pháp học tăng cường để đưa ngôn ngữ trừu tượng thành các hành động và biểu diễn trực quan. Bằng cách đó, robot học cách liên kết từ “Coke” với hình ảnh của một lon đồ uống có ga.

PaLM-SayCan cũng học cái gọi là “chức năng chi trả” - một phương pháp xếp hạng khả năng hoàn thành một hành động cụ thể đối với các đối tượng trong môi trường của nó. Ví dụ, robot có nhiều khả năng nhặt miếng bọt biển hơn máy hút bụi, nếu nó phát hiện miếng bọt biển nhưng không có máy hút bụi ở gần nó.

“Phương pháp của chúng tôi, SayCan, trích xuất và tận dụng kiến thức trong LLMs trong các nhiệm vụ cơ sở vật chất,” nhóm giải thích trong một bài nghiên cứu. “LLM (Say) cung cấp cơ sở nhiệm vụ để xác định các hành động hữu ích cho mục tiêu cấp cao và các chức năng chi trả đã học được (Có thể) cung cấp cơ sở thế giới để xác định những gì có thể thực hiện theo kế hoạch. Chúng tôi sử dụng phương pháp học tăng cường (RL) như một cách để học các hàm giá trị có điều kiện của ngôn ngữ nhằm cung cấp khả năng chi trả của những gì có thể xảy ra trên thế giới ”.

Để ngăn robot không thực hiện nhiệm vụ, nó được huấn luyện để chỉ chọn các hành động từ 101 hướng dẫn khác nhau. Google đã huấn luyện nó để thích nghi với nhà bếp - PaLM-SayCan có thể lấy đồ ăn nhẹ, đồ uống và thực hiện các công việc dọn dẹp đơn giản. Các nhà nghiên cứu tin rằng LLM là bước đầu tiên giúp robot thực hiện các nhiệm vụ phức tạp hơn một cách an toàn với các hướng dẫn trừu tượng.

“Các thí nghiệm của chúng tôi trên một số nhiệm vụ robot trong thế giới thực chứng tỏ khả năng lập kế hoạch và hoàn thành các hướng dẫn dài hạn, trừu tượng, bằng ngôn ngữ tự nhiên với tỷ lệ thành công cao. Chúng tôi tin rằng khả năng diễn giải của PaLM-SayCan cho phép người dùng tương tác trong thế giới thực an toàn với robot, ”họ kết luận. ®

- AI

- nghệ thuật ai

- máy phát điện nghệ thuật ai

- ai rô bốt

- trí tuệ nhân tạo

- chứng nhận trí tuệ nhân tạo

- trí tuệ nhân tạo trong ngân hàng

- robot trí tuệ nhân tạo

- robot trí tuệ nhân tạo

- phần mềm trí tuệ nhân tạo

- blockchain

- hội nghị blockchain ai

- thiên tài

- trí tuệ nhân tạo đàm thoại

- hội nghị tiền điện tử ai

- dall's

- học kĩ càng

- google ai

- học máy

- plato

- Plato ai

- Thông tin dữ liệu Plato

- Trò chơi Plato

- PlatoDữ liệu

- Platogaming

- quy mô ai

- cú pháp

- Đăng ký

- zephyrnet