Trong thế giới năng động của phát trực tuyến Amazon Âm nhạc, mỗi lượt tìm kiếm một bài hát, podcast hoặc danh sách phát đều ẩn chứa một câu chuyện, một tâm trạng hoặc vô vàn cảm xúc đang chờ được bộc lộ. Những tìm kiếm này đóng vai trò là cửa ngõ dẫn đến những khám phá mới, những trải nghiệm đáng trân trọng và những kỷ niệm lâu dài. Thanh tìm kiếm không chỉ để tìm một bài hát; đó là về hàng triệu người dùng tích cực bắt đầu hành trình cá nhân của họ vào thế giới phong phú và đa dạng mà Amazon Music mang lại.

Mang lại trải nghiệm vượt trội cho khách hàng để tìm thấy ngay âm nhạc mà người dùng tìm kiếm đòi hỏi một nền tảng vừa thông minh vừa đáp ứng. Amazon Music sử dụng sức mạnh của AI để thực hiện điều này. Tuy nhiên, việc tối ưu hóa trải nghiệm của khách hàng trong khi quản lý chi phí đào tạo và suy luận của các mô hình AI hỗ trợ khả năng của thanh tìm kiếm, như kiểm tra chính tả theo thời gian thực và tìm kiếm vectơ, là điều khó khăn trong thời gian lưu lượng truy cập cao điểm.

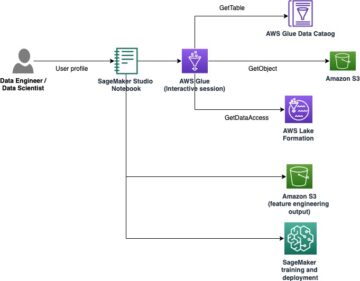

Amazon SageMaker cung cấp một bộ dịch vụ toàn diện cho phép Amazon Music xây dựng, đào tạo và triển khai trên Đám mây AWS với nỗ lực tối thiểu. Bằng cách xử lý những công việc nặng nhọc không phân biệt, SageMaker cho phép bạn tập trung vào làm việc trên các mô hình học máy (ML) của mình và không phải lo lắng về những thứ như cơ sở hạ tầng. Là một phần của mô hình trách nhiệm chung, SageMaker đảm bảo rằng các dịch vụ họ cung cấp là đáng tin cậy, có hiệu suất và có thể mở rộng, đồng thời bạn đảm bảo ứng dụng của mô hình ML tận dụng tối đa các khả năng mà SageMaker cung cấp.

Trong bài đăng này, chúng ta sẽ tìm hiểu hành trình mà Amazon Music đã thực hiện để tối ưu hóa hiệu suất và chi phí bằng cách sử dụng SageMaker và NVIDIA Triton Inference Server cũng như TensorRT. Chúng tôi đi sâu vào việc chỉ ra cách hoạt động của thanh tìm kiếm có vẻ đơn giản nhưng phức tạp, đảm bảo một hành trình không gián đoạn vào vũ trụ của Amazon Music với độ trễ lỗi đánh máy khó chịu từ ít đến XNUMX và các kết quả tìm kiếm theo thời gian thực có liên quan.

Amazon SageMaker và NVIDIA: Cung cấp khả năng tìm kiếm và kiểm tra chính tả vectơ nhanh chóng và chính xác

Amazon Music cung cấp một thư viện khổng lồ gồm hơn 100 triệu bài hát và hàng triệu tập podcast. Tuy nhiên, việc tìm đúng bài hát hoặc podcast có thể khó khăn, đặc biệt nếu bạn không biết chính xác tiêu đề, nghệ sĩ hoặc tên album hoặc truy vấn tìm kiếm rất rộng, chẳng hạn như “podcast tin tức”.

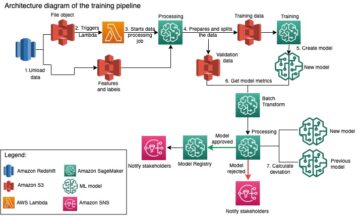

Amazon Music đã thực hiện cách tiếp cận theo hai hướng để cải thiện quá trình tìm kiếm và truy xuất. Bước đầu tiên là giới thiệu tìm kiếm vectơ (còn được gọi là truy xuất dựa trên nhúng), một kỹ thuật ML có thể giúp người dùng tìm thấy nội dung phù hợp nhất mà họ đang tìm kiếm bằng cách sử dụng ngữ nghĩa của nội dung. Bước thứ hai liên quan đến việc giới thiệu mô hình Sửa lỗi chính tả dựa trên Transformer trong ngăn xếp tìm kiếm. Điều này có thể đặc biệt hữu ích khi tìm kiếm nhạc vì không phải lúc nào người dùng cũng có thể biết chính xác cách viết tên bài hát hoặc tên nghệ sĩ. Sửa lỗi chính tả có thể giúp người dùng tìm thấy bản nhạc họ đang tìm kiếm ngay cả khi họ mắc lỗi chính tả trong truy vấn tìm kiếm của mình.

Việc giới thiệu các mô hình Biến áp trong quy trình tìm kiếm và truy xuất (trong quá trình tạo nhúng truy vấn cần thiết cho tìm kiếm vectơ và mô hình Biến áp Seq2Seq tổng hợp trong Sửa chính tả) có thể dẫn đến tăng đáng kể độ trễ tổng thể, ảnh hưởng tiêu cực đến trải nghiệm của khách hàng. Do đó, ưu tiên hàng đầu của chúng tôi là tối ưu hóa độ trễ suy luận thời gian thực cho các mô hình tìm kiếm vectơ và sửa lỗi chính tả.

Amazon Music và NVIDIA đã cùng nhau mang lại trải nghiệm tốt nhất có thể cho khách hàng trên thanh tìm kiếm, sử dụng SageMaker để triển khai cả khả năng kiểm tra chính tả nhanh chóng và chính xác cũng như đề xuất tìm kiếm ngữ nghĩa theo thời gian thực bằng cách sử dụng các kỹ thuật dựa trên tìm kiếm vectơ. Giải pháp này bao gồm việc sử dụng dịch vụ lưu trữ SageMaker được hỗ trợ bởi các phiên bản G5 sử dụng GPU NVIDIA A10G Tensor Core, Bộ chứa máy chủ suy luận NVIDIA Triton được SageMaker hỗ trợ và NVIDIA TenorRT định dạng mô hình. Bằng cách giảm độ trễ suy luận của mô hình kiểm tra chính tả xuống 25 mili giây ở lưu lượng truy cập cao nhất và giảm độ trễ tạo truy vấn tìm kiếm trung bình 63% và chi phí giảm 73% so với suy luận dựa trên CPU, Amazon Music đã nâng cao hiệu suất của thanh tìm kiếm.

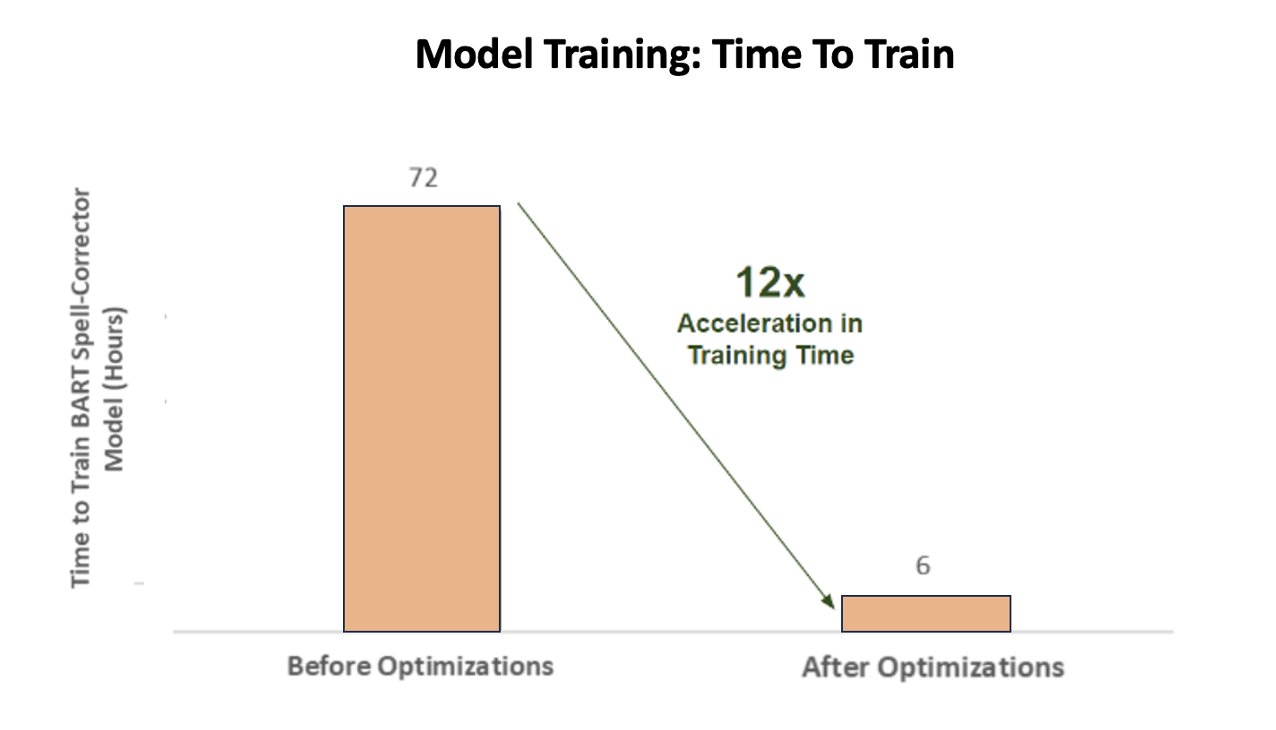

Ngoài ra, khi đào tạo mô hình AI để mang lại kết quả chính xác, Amazon Music đã đạt được mức tăng tốc gấp 12 lần về thời gian đào tạo cho mô hình biến áp sửa lỗi chính tả theo trình tự BART của họ, giúp họ tiết kiệm cả thời gian và tiền bạc bằng cách tối ưu hóa việc sử dụng GPU.

Amazon Music hợp tác với NVIDIA để ưu tiên trải nghiệm tìm kiếm của khách hàng và tạo ra thanh tìm kiếm với các chức năng tìm kiếm vectơ và kiểm tra chính tả được tối ưu hóa tốt. Trong các phần sau, chúng tôi chia sẻ thêm về cách sắp xếp các hoạt động tối ưu hóa này.

Tối ưu hóa hoạt động đào tạo với GPU NVIDIA Tensor Core

Có được quyền truy cập vào GPU NVIDIA Tensor Core để đào tạo mô hình ngôn ngữ lớn là không đủ để nắm bắt được tiềm năng thực sự của nó. Có các bước tối ưu hóa quan trọng phải diễn ra trong quá trình đào tạo để tối đa hóa tối đa việc sử dụng GPU. Tuy nhiên, GPU không được sử dụng đúng mức chắc chắn sẽ dẫn đến việc sử dụng tài nguyên không hiệu quả, thời gian đào tạo kéo dài và tăng chi phí vận hành.

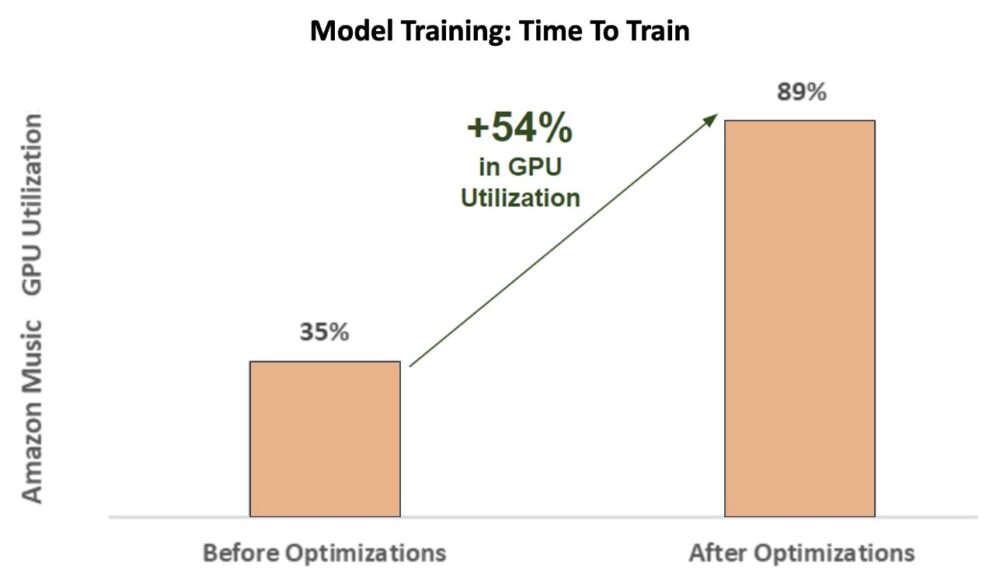

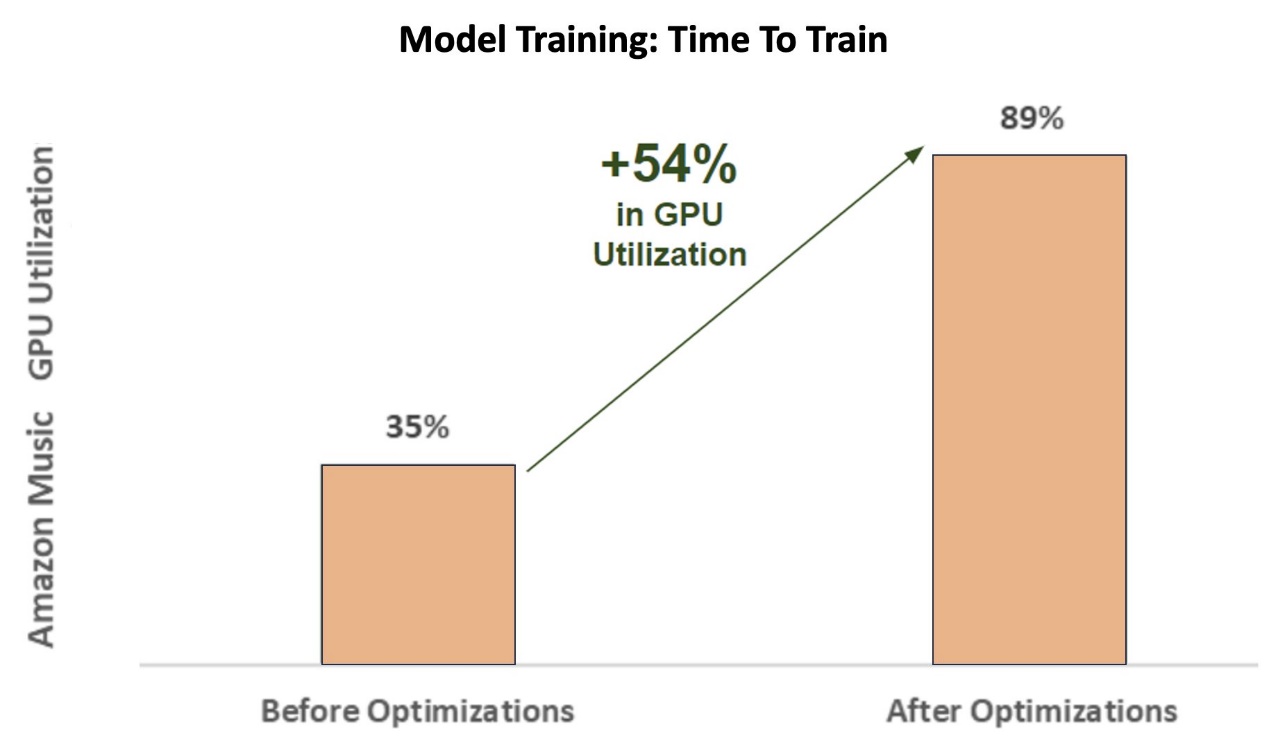

Trong giai đoạn đầu đào tạo người sửa lỗi chính tả BART (cơ sở bart) trên phiên bản SageMaker ml.p3.24xlarge (8 GPU NVIDIA V100 Tensor Core), mức sử dụng GPU của Amazon Music là khoảng 35%. Để tối đa hóa lợi ích của việc đào tạo tăng tốc GPU NVIDIA, các kiến trúc sư giải pháp của AWS và NVIDIA đã hỗ trợ Amazon Music trong việc xác định các lĩnh vực cần tối ưu hóa, đặc biệt là về kích thước lô và thông số độ chính xác. Hai thông số quan trọng này ảnh hưởng đến hiệu quả, tốc độ và độ chính xác của việc đào tạo các mô hình deep learning.

Kết quả tối ưu hóa mang lại mức sử dụng GPU V100 mới và cải tiến, ổn định ở mức khoảng 89%, giảm đáng kể thời gian đào tạo của Amazon Music từ 3 ngày xuống còn 5–6 giờ. Bằng cách chuyển kích thước lô từ 32 sang 256 và sử dụng các kỹ thuật tối ưu hóa như chạy đào tạo chính xác hỗn hợp tự động thay vì chỉ sử dụng độ chính xác FP32, Amazon Music đã có thể tiết kiệm cả thời gian và tiền bạc.

Biểu đồ sau đây minh họa mức tăng 54% điểm phần trăm trong việc sử dụng GPU sau khi tối ưu hóa.

Hình dưới đây minh họa sự tăng tốc trong thời gian đào tạo.

Việc tăng kích thước lô này cho phép GPU NVIDIA xử lý đồng thời nhiều dữ liệu hơn đáng kể trên nhiều lõi Tensor, giúp tăng tốc thời gian đào tạo. Tuy nhiên, điều quan trọng là phải duy trì sự cân bằng tinh tế với bộ nhớ vì kích thước lô lớn hơn đòi hỏi nhiều bộ nhớ hơn. Cả việc tăng kích thước lô và sử dụng độ chính xác hỗn hợp đều có thể rất quan trọng trong việc khai thác sức mạnh của GPU NVIDIA Tensor Core.

Sau khi mô hình được huấn luyện để hội tụ, đã đến lúc tối ưu hóa việc triển khai suy luận trên thanh tìm kiếm của Amazon Music.

Sửa lỗi chính tả: Suy luận mô hình BART

Với sự trợ giúp của các phiên bản SageMaker G5 và NVIDIA Triton Inference Server (một phần mềm phục vụ suy luận nguồn mở), cũng như NVIDIA TensorRT, một SDK dành cho suy luận deep learning hiệu suất cao bao gồm trình tối ưu hóa suy luận và thời gian chạy, Amazon Music giới hạn BART kiểm tra chính tả của họ (cơ sở bart) độ trễ suy luận của máy chủ mô hình chỉ còn 25 mili giây khi lưu lượng truy cập cao nhất. Điều này bao gồm các chi phí chung như cân bằng tải, tiền xử lý, suy luận mô hình và thời gian xử lý hậu kỳ.

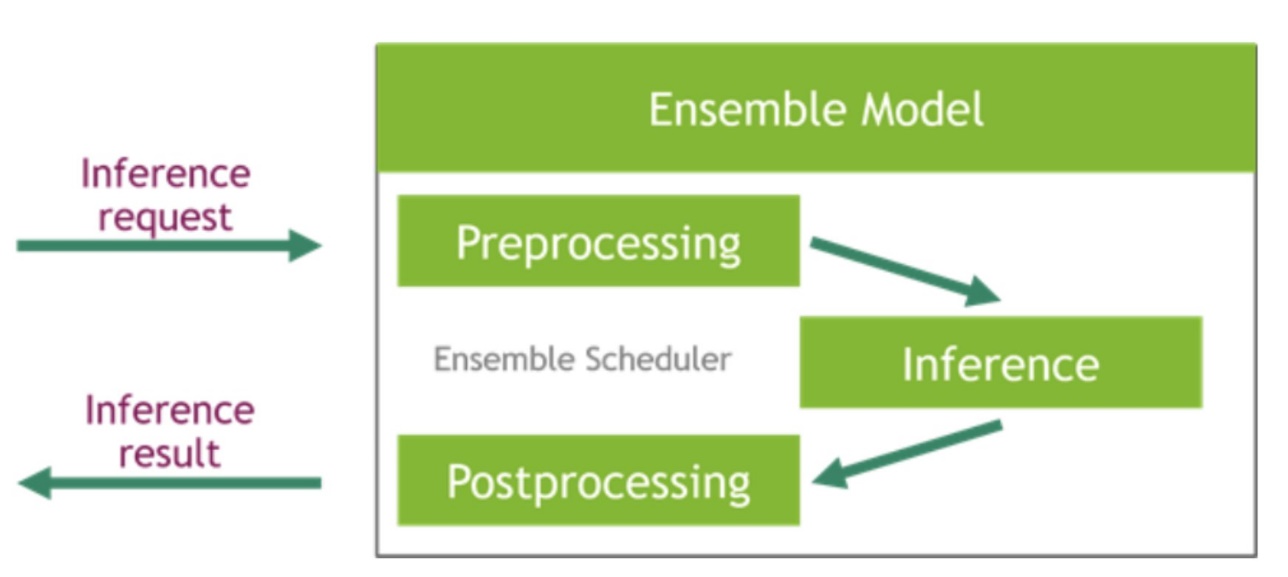

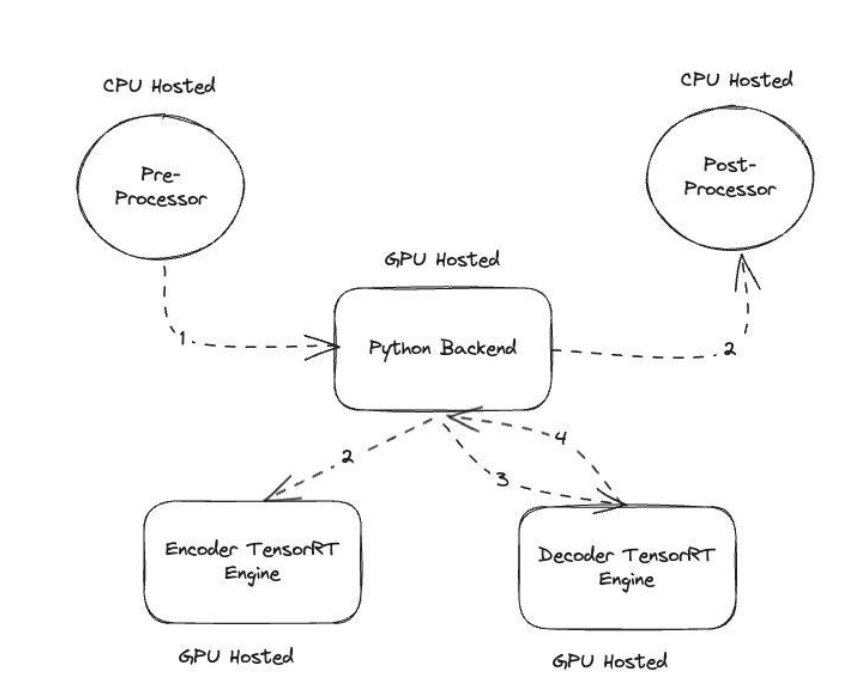

Máy chủ suy luận NVIDIA Triton cung cấp hai loại phụ trợ khác nhau: một để lưu trữ các mô hình trên GPU và một phụ trợ Python nơi bạn có thể mang mã tùy chỉnh của riêng mình để sử dụng trong các bước tiền xử lý và hậu xử lý. Hình dưới đây minh họa sơ đồ tổ hợp mô hình.

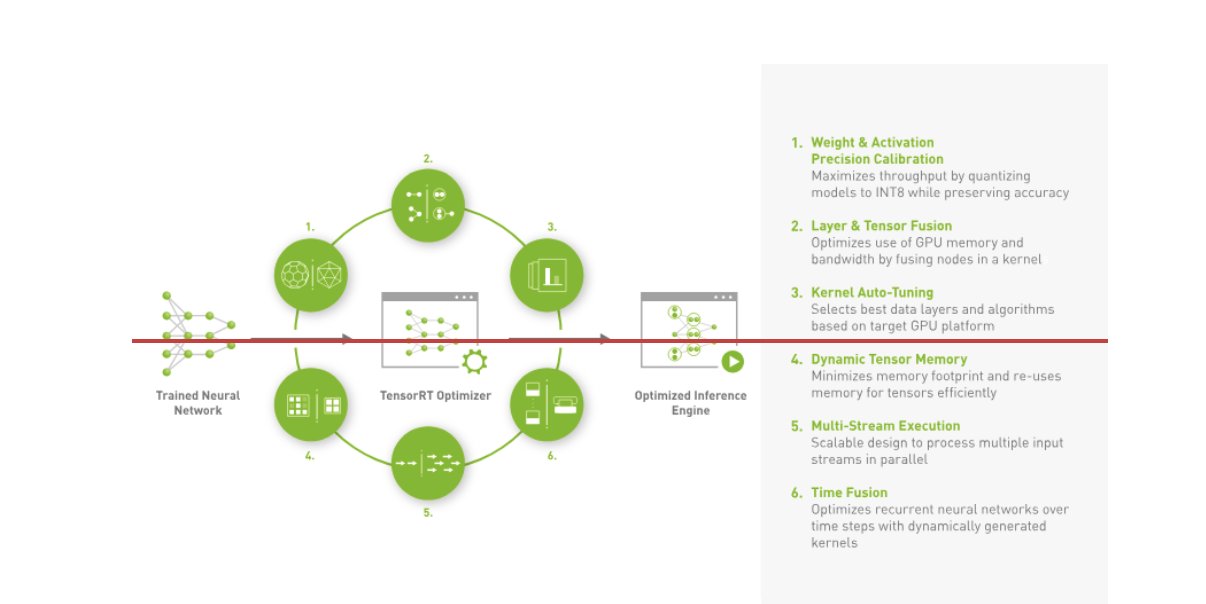

Amazon Music đã xây dựng BART của mình đường ống suy luận bằng cách chạy cả hai bước tiền xử lý (mã thông báo văn bản) và xử lý hậu kỳ (mã thông báo thành văn bản) trên CPU, trong khi bước thực thi mô hình chạy trên GPU lõi Tensor NVIDIA A10G. Phần phụ trợ Python nằm ở giữa các bước tiền xử lý và hậu xử lý, đồng thời chịu trách nhiệm liên lạc với các mô hình BART được chuyển đổi TensorRT cũng như các mạng bộ mã hóa/giải mã. TenorRT tăng hiệu suất suy luận với hiệu chuẩn chính xác, hợp nhất lớp và tensor, tự động điều chỉnh kernel, bộ nhớ tensor động, thực thi đa luồng và hợp nhất thời gian.

Hình dưới đây minh họa thiết kế cấp cao của các mô-đun chính tạo nên đường dẫn suy luận mô hình BART sửa lỗi chính tả.

Tìm kiếm vectơ: Truy vấn nhúng tạo câu suy luận mô hình BERT

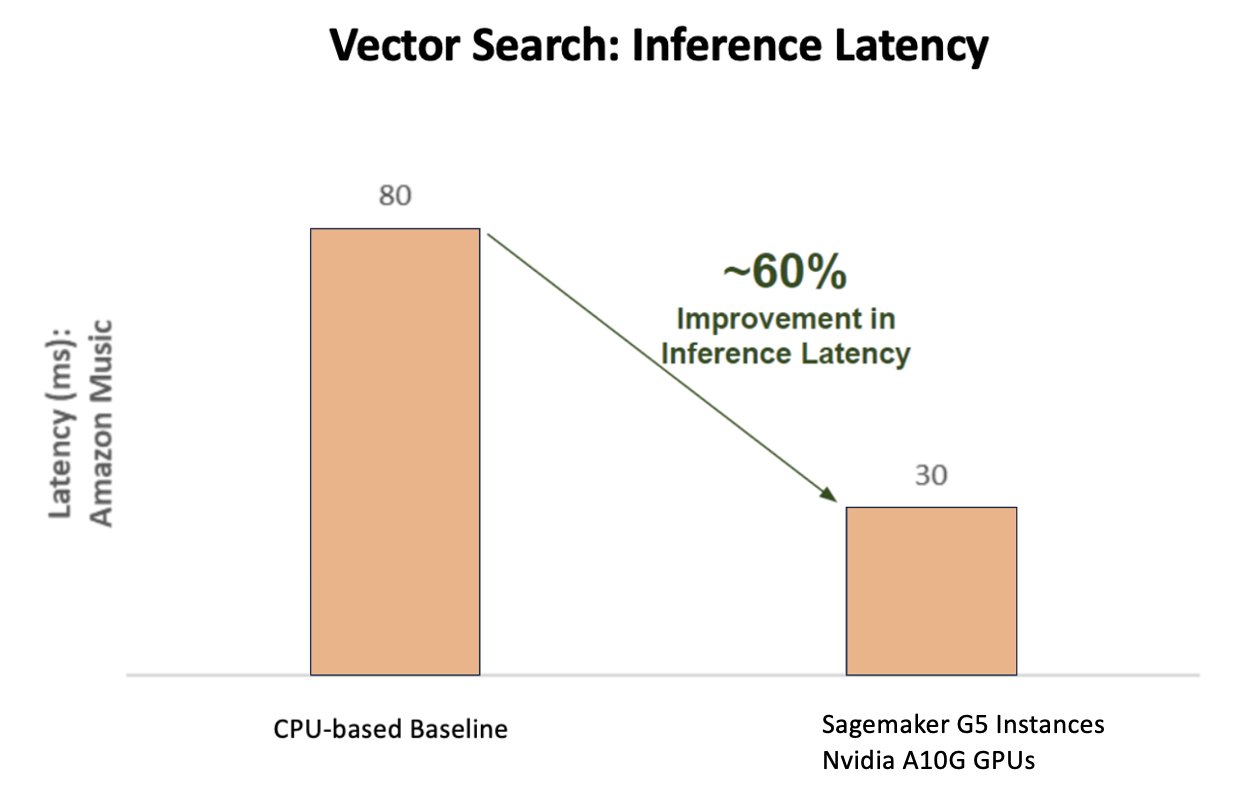

Biểu đồ sau đây minh họa độ trễ được cải thiện 60% (cung cấp p90 800–900 TPS) khi sử dụng Nền tảng suy luận AI của NVIDIA so với đường cơ sở dựa trên CPU.

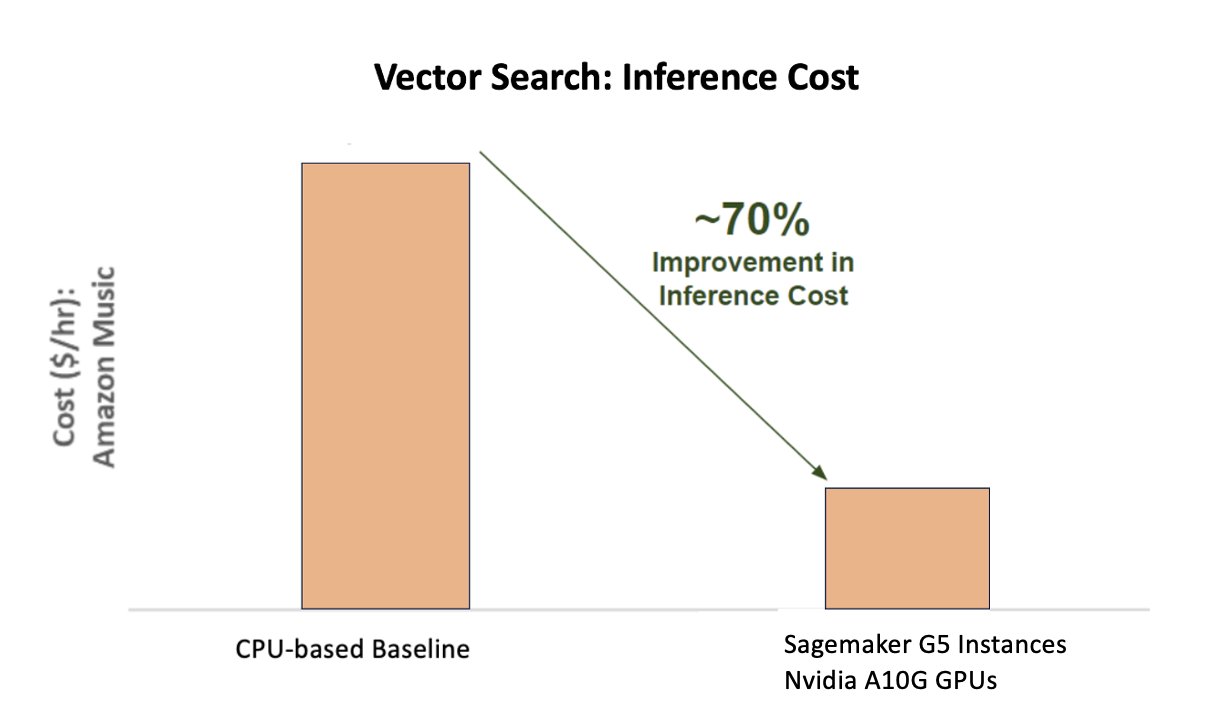

Biểu đồ sau đây cho thấy chi phí được cải thiện 70% khi sử dụng Nền tảng suy luận AI của NVIDIA so với đường cơ sở dựa trên CPU.

Hình dưới đây minh họa SDK cho suy luận deep learning hiệu suất cao. Nó bao gồm một trình tối ưu hóa suy luận deep learning và thời gian chạy mang lại độ trễ thấp và thông lượng cao cho các ứng dụng suy luận.

Để đạt được những kết quả này, Amazon Music đã thử nghiệm một số thông số triển khai Triton khác nhau bằng cách sử dụng Máy phân tích mô hình Triton, công cụ giúp tìm ra cấu hình model NVIDIA Triton tốt nhất để triển khai suy luận hiệu quả. Để tối ưu hóa suy luận mô hình, Triton cung cấp các tính năng như phân khối động và thực thi mô hình đồng thời, đồng thời hỗ trợ khung cho các khả năng linh hoạt khác. Tính năng phân nhóm động tập hợp các yêu cầu suy luận, nhóm chúng lại với nhau một cách liền mạch thành các nhóm nhằm tối đa hóa thông lượng, đồng thời đảm bảo phản hồi theo thời gian thực cho người dùng Amazon Music. Khả năng thực thi mô hình đồng thời nâng cao hơn nữa hiệu suất suy luận bằng cách lưu trữ nhiều bản sao của mô hình trên cùng một GPU. Cuối cùng, bằng cách sử dụng Máy phân tích mô hình Triton, Amazon Music đã có thể tinh chỉnh cẩn thận các tham số lưu trữ suy luận đồng thời theo mô hình và phân khối động để tìm ra cài đặt tối ưu nhằm tối đa hóa hiệu suất suy luận bằng lưu lượng mô phỏng.

Kết luận

Việc tối ưu hóa cấu hình với Triton Inference Server và TensorRT trên SageMaker đã cho phép Amazon Music đạt được kết quả vượt trội cho cả quy trình đào tạo và quy trình suy luận. Nền tảng SageMaker là nền tảng mở toàn diện dành cho AI sản xuất, mang lại thời gian định giá nhanh chóng và tính linh hoạt để hỗ trợ tất cả các trường hợp sử dụng AI chính trên cả phần cứng và phần mềm. Bằng cách tối ưu hóa việc sử dụng GPU V100 để đào tạo và chuyển đổi từ CPU sang phiên bản G5 bằng GPU NVIDIA A10G Tensor Core, cũng như bằng cách sử dụng phần mềm NVIDIA được tối ưu hóa như Triton Inference Server và TensorRT, các công ty như Amazon Music có thể tiết kiệm thời gian và tiền bạc đồng thời tăng hiệu suất ở cả hai đào tạo và suy luận, trực tiếp mang lại trải nghiệm tốt hơn cho khách hàng và giảm chi phí vận hành.

SageMaker xử lý khối lượng công việc nặng nhọc không phân biệt đối với việc đào tạo và lưu trữ ML, cho phép Amazon Music cung cấp các hoạt động ML đáng tin cậy, có thể mở rộng trên cả phần cứng và phần mềm.

Chúng tôi khuyến khích bạn kiểm tra xem khối lượng công việc của mình có được tối ưu hóa bằng SageMaker hay không bằng cách luôn đánh giá các lựa chọn phần cứng và phần mềm để xem liệu có cách nào giúp bạn đạt được hiệu suất tốt hơn với chi phí giảm hay không.

Để tìm hiểu thêm về NVIDIA AI trong AWS, hãy tham khảo phần sau:

Giới thiệu về tác giả

Siddharth Sharma là Trưởng nhóm công nghệ học máy tại nhóm Khoa học & Mô hình hóa tại Amazon Music. Anh ấy chuyên về các vấn đề về mô hình hóa liên quan đến Tìm kiếm, Truy xuất, Xếp hạng và NLP. Siddharth có nền tảng kiến thức phong phú về các vấn đề máy học quy mô lớn nhạy cảm với độ trễ, ví dụ: Nhắm mục tiêu quảng cáo, Truy xuất đa phương thức, Hiểu truy vấn tìm kiếm, v.v. Trước khi làm việc tại Amazon Music, Siddharth đã làm việc tại các công ty như Meta, Walmart Labs, Rakuten về các vấn đề ML tập trung vào thương mại điện tử. Siddharth đã dành phần đầu sự nghiệp của mình để làm việc với các công ty khởi nghiệp công nghệ quảng cáo ở vùng vịnh.

Siddharth Sharma là Trưởng nhóm công nghệ học máy tại nhóm Khoa học & Mô hình hóa tại Amazon Music. Anh ấy chuyên về các vấn đề về mô hình hóa liên quan đến Tìm kiếm, Truy xuất, Xếp hạng và NLP. Siddharth có nền tảng kiến thức phong phú về các vấn đề máy học quy mô lớn nhạy cảm với độ trễ, ví dụ: Nhắm mục tiêu quảng cáo, Truy xuất đa phương thức, Hiểu truy vấn tìm kiếm, v.v. Trước khi làm việc tại Amazon Music, Siddharth đã làm việc tại các công ty như Meta, Walmart Labs, Rakuten về các vấn đề ML tập trung vào thương mại điện tử. Siddharth đã dành phần đầu sự nghiệp của mình để làm việc với các công ty khởi nghiệp công nghệ quảng cáo ở vùng vịnh.

Tarun Sharma là Giám đốc phát triển phần mềm phụ trách lĩnh vực Liên quan tìm kiếm âm nhạc trên Amazon. Nhóm các nhà khoa học và kỹ sư ML của ông chịu trách nhiệm cung cấp các kết quả tìm kiếm được cá nhân hóa và phù hợp theo ngữ cảnh cho khách hàng của Amazon Music.

Tarun Sharma là Giám đốc phát triển phần mềm phụ trách lĩnh vực Liên quan tìm kiếm âm nhạc trên Amazon. Nhóm các nhà khoa học và kỹ sư ML của ông chịu trách nhiệm cung cấp các kết quả tìm kiếm được cá nhân hóa và phù hợp theo ngữ cảnh cho khách hàng của Amazon Music.

Công viên James là Kiến trúc sư giải pháp tại Amazon Web Services. Anh làm việc với Amazon.com để thiết kế, xây dựng và triển khai các giải pháp công nghệ trên AWS, đồng thời có mối quan tâm đặc biệt đến trí tuệ nhân tạo và máy học. Trong thời gian rảnh rỗi, anh ấy thích tìm kiếm những nền văn hóa mới, trải nghiệm mới và cập nhật những xu hướng công nghệ mới nhất. Bạn có thể tìm thấy anh ấy trên LinkedIn.

Công viên James là Kiến trúc sư giải pháp tại Amazon Web Services. Anh làm việc với Amazon.com để thiết kế, xây dựng và triển khai các giải pháp công nghệ trên AWS, đồng thời có mối quan tâm đặc biệt đến trí tuệ nhân tạo và máy học. Trong thời gian rảnh rỗi, anh ấy thích tìm kiếm những nền văn hóa mới, trải nghiệm mới và cập nhật những xu hướng công nghệ mới nhất. Bạn có thể tìm thấy anh ấy trên LinkedIn.

Kshitiz Gupta là Kiến trúc sư Giải pháp tại NVIDIA. Anh ấy thích giáo dục khách hàng đám mây về các công nghệ GPU AI mà NVIDIA cung cấp và hỗ trợ họ tăng tốc các ứng dụng học máy và học sâu. Ngoài công việc, anh ấy thích chạy, đi bộ đường dài và ngắm động vật hoang dã.

Kshitiz Gupta là Kiến trúc sư Giải pháp tại NVIDIA. Anh ấy thích giáo dục khách hàng đám mây về các công nghệ GPU AI mà NVIDIA cung cấp và hỗ trợ họ tăng tốc các ứng dụng học máy và học sâu. Ngoài công việc, anh ấy thích chạy, đi bộ đường dài và ngắm động vật hoang dã.

Gia Hồng Lưu là Kiến trúc sư Giải pháp trong nhóm Nhà cung cấp Dịch vụ Đám mây tại NVIDIA. Anh ấy hỗ trợ khách hàng trong việc áp dụng học máy và các giải pháp AI tận dụng tính toán tăng tốc của NVIDIA để giải quyết các thách thức về đào tạo và suy luận của họ. Trong thời gian rảnh rỗi, anh ấy thích xếp giấy origami, các dự án tự làm và chơi bóng rổ.

Gia Hồng Lưu là Kiến trúc sư Giải pháp trong nhóm Nhà cung cấp Dịch vụ Đám mây tại NVIDIA. Anh ấy hỗ trợ khách hàng trong việc áp dụng học máy và các giải pháp AI tận dụng tính toán tăng tốc của NVIDIA để giải quyết các thách thức về đào tạo và suy luận của họ. Trong thời gian rảnh rỗi, anh ấy thích xếp giấy origami, các dự án tự làm và chơi bóng rổ.

Tugrul Konuk là Kiến trúc sư giải pháp cấp cao tại NVIDIA, chuyên đào tạo quy mô lớn, học sâu đa phương thức và điện toán khoa học hiệu năng cao. Trước NVIDIA, ông làm việc trong ngành năng lượng, tập trung phát triển các thuật toán cho hình ảnh tính toán. Là một phần của chương trình Tiến sĩ, anh ấy đã nghiên cứu về học sâu dựa trên vật lý để mô phỏng số trên quy mô lớn. Trong thời gian rảnh rỗi, anh thích đọc sách, chơi guitar và piano.

Tugrul Konuk là Kiến trúc sư giải pháp cấp cao tại NVIDIA, chuyên đào tạo quy mô lớn, học sâu đa phương thức và điện toán khoa học hiệu năng cao. Trước NVIDIA, ông làm việc trong ngành năng lượng, tập trung phát triển các thuật toán cho hình ảnh tính toán. Là một phần của chương trình Tiến sĩ, anh ấy đã nghiên cứu về học sâu dựa trên vật lý để mô phỏng số trên quy mô lớn. Trong thời gian rảnh rỗi, anh thích đọc sách, chơi guitar và piano.

Rohil Bhargava là Giám đốc tiếp thị sản phẩm tại NVIDIA, tập trung vào việc triển khai các khung ứng dụng và SDK của NVIDIA trên các nền tảng CSP cụ thể.

Rohil Bhargava là Giám đốc tiếp thị sản phẩm tại NVIDIA, tập trung vào việc triển khai các khung ứng dụng và SDK của NVIDIA trên các nền tảng CSP cụ thể.

Eliuth Triana Isaza là Giám đốc quan hệ nhà phát triển tại NVIDIA, trao quyền cho các chuyên gia kỹ thuật AWS, DevOps, Nhà khoa học và AI MLOps của Amazon để làm chủ hệ thống điện toán NVIDIA nhằm tăng tốc và tối ưu hóa các mô hình Generative AI Foundation trải dài từ quản lý dữ liệu, đào tạo GPU, suy luận mô hình và triển khai sản xuất trên các phiên bản GPU AWS . Ngoài ra, Eliuth còn là một vận động viên đua xe đạp leo núi, vận động viên trượt tuyết, quần vợt và chơi bài poker đầy đam mê.

Eliuth Triana Isaza là Giám đốc quan hệ nhà phát triển tại NVIDIA, trao quyền cho các chuyên gia kỹ thuật AWS, DevOps, Nhà khoa học và AI MLOps của Amazon để làm chủ hệ thống điện toán NVIDIA nhằm tăng tốc và tối ưu hóa các mô hình Generative AI Foundation trải dài từ quản lý dữ liệu, đào tạo GPU, suy luận mô hình và triển khai sản xuất trên các phiên bản GPU AWS . Ngoài ra, Eliuth còn là một vận động viên đua xe đạp leo núi, vận động viên trượt tuyết, quần vợt và chơi bài poker đầy đam mê.

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- PlatoData.Network Vertical Generative Ai. Trao quyền cho chính mình. Truy cập Tại đây.

- PlatoAiStream. Thông minh Web3. Kiến thức khuếch đại. Truy cập Tại đây.

- Trung tâmESG. Than đá, công nghệ sạch, Năng lượng, Môi trường Hệ mặt trời, Quản lý chất thải. Truy cập Tại đây.

- PlatoSức khỏe. Tình báo thử nghiệm lâm sàng và công nghệ sinh học. Truy cập Tại đây.

- nguồn: https://aws.amazon.com/blogs/machine-learning/how-amazon-music-uses-sagemaker-with-nvidia-to-optimize-ml-training-and-inference-performance-and-cost/

- : có

- :là

- :không phải

- :Ở đâu

- $ LÊN

- 100

- 12

- 25

- 32

- 35%

- 7

- 8

- a

- Có khả năng

- Giới thiệu

- tăng tốc

- tăng tốc

- tăng tốc

- truy cập

- hoàn thành

- chính xác

- chính xác

- Đạt được

- đạt được

- ngang qua

- hoạt động

- Ngoài ra

- địa chỉ

- Nhận nuôi

- quảng cáo

- ảnh hưởng đến

- Sau

- AI

- Mô hình AI

- trường hợp sử dụng ai

- Album

- thuật toán

- Tất cả

- cho phép

- cho phép

- Cho phép

- cho phép

- Ngoài ra

- luôn luôn

- đàn bà gan dạ

- Amazon Web Services

- Amazon.com

- an

- và

- Các Ứng Dụng

- các ứng dụng

- phương pháp tiếp cận

- kiến trúc sư

- LÀ

- KHU VỰC

- khu vực

- xung quanh

- nghệ sĩ

- AS

- trợ giúp

- hỗ trợ

- At

- Trung bình cộng

- AWS

- Backend

- Cân đối

- cân bằng

- thanh

- dựa

- Baseline

- Bóng rổ

- vịnh

- BE

- đã trở thành

- bởi vì

- Lợi ích

- BEST

- Hơn

- thúc đẩy

- tăng

- cả hai

- mang lại

- rộng

- xây dựng

- xây dựng

- by

- CAN

- khả năng

- khả năng

- nắm bắt

- mà

- Tuyển Dụng

- cẩn thận

- trường hợp

- thách thức

- thách thức

- Biểu đồ

- kiểm tra

- ấp ủ

- lựa chọn

- khách hàng

- đám mây

- mã

- COM

- Đến

- giao tiếp

- Các công ty

- so

- tính toán

- máy tính

- đồng thời

- Cấu hình

- Container

- nội dung

- Hội tụ

- Trung tâm

- Phí Tổn

- Chi phí

- nghề

- quan trọng

- quan trọng

- CSP

- sự giám tuyển

- khách hàng

- khách hàng

- kinh nghiệm khach hang

- khách hàng

- dữ liệu

- Ngày

- Ngày

- giảm

- sâu

- học kĩ càng

- sự chậm trễ

- cung cấp

- phân phối

- cung cấp

- Nhu cầu

- triển khai

- triển khai

- triển khai

- Thiết kế

- Nhà phát triển

- phát triển

- Phát triển

- khác nhau

- khó khăn

- trực tiếp

- bổ nhào

- khác nhau

- Tự làm

- dont

- quyết liệt

- suốt trong

- năng động

- e

- thương mại điện tử

- Đầu

- giáo dục

- hiệu quả

- hiệu quả

- nỗ lực

- cao

- nhúng

- cảm xúc

- thuê mướn

- nâng cao vị thế

- kích hoạt

- khuyến khích

- Cuối cùng đến cuối

- năng lượng

- Kỹ sư

- Nâng cao

- đủ

- đảm bảo

- đặc biệt

- vv

- đánh giá

- Ngay cả

- Mỗi

- thực hiện

- kinh nghiệm

- Kinh nghiệm

- các chuyên gia

- NHANH

- Tính năng

- Hình

- Cuối cùng

- Tìm kiếm

- tìm kiếm

- Tên

- Linh hoạt

- lũ lụt

- Tập trung

- tập trung

- tập trung

- tiếp theo

- Trong

- định dạng

- Nền tảng

- Khung

- khung

- từ

- bực bội

- đầy đủ

- chức năng

- xa hơn

- nhiệt hạch

- cửa ngõ

- thế hệ

- thế hệ

- Trí tuệ nhân tạo

- GPU

- GPU

- Xử lý

- xảy ra

- phần cứng

- Có

- he

- nặng

- nâng nặng

- giúp đỡ

- hữu ích

- giúp

- Cao

- cấp độ cao

- hiệu suất cao

- anh ta

- của mình

- giữ

- lưu trữ

- GIỜ LÀM VIỆC

- Độ đáng tin của

- Tuy nhiên

- HTML

- HTTPS

- xác định

- if

- minh họa

- Hình ảnh

- thực hiện

- quan trọng

- nâng cao

- cải thiện

- cải thiện

- in

- bao gồm

- Tăng lên

- tăng

- tăng

- ngành công nghiệp

- không hiệu quả

- ảnh hưởng

- Cơ sở hạ tầng

- ban đầu

- ví dụ

- ngay lập tức

- thay vì

- quan tâm

- trong

- giới thiệu

- giới thiệu

- IT

- ITS

- cuộc hành trình

- jpg

- chỉ

- Key

- Loại

- Biết

- nổi tiếng

- Phòng thí nghiệm

- Ngôn ngữ

- lớn

- quy mô lớn

- lớn hơn

- lâu dài

- Độ trễ

- mới nhất

- lớp

- dẫn

- hàng đầu

- LEARN

- học tập

- Tỉ lệ đòn bẩy

- Thư viện

- nâng

- Lượt thích

- giới hạn

- tải

- tìm kiếm

- Thấp

- thấp hơn

- máy

- học máy

- duy trì

- chính

- làm cho

- LÀM CHO

- giám đốc

- quản lý

- Marketing

- chủ

- Tối đa hóa

- Có thể..

- Memories

- Bộ nhớ

- Siêu dữ liệu

- Tên đệm

- triệu

- hàng triệu

- mili giây

- tối thiểu

- sai lầm

- hỗn hợp

- ML

- MLOps

- kiểu mẫu

- người mẫu

- mô hình

- Modules

- tiền

- chi tiết

- hầu hết

- núi

- đa

- nhiều

- Âm nhạc

- phải

- tên

- cần thiết

- tiêu cực

- mạng

- Mới

- nlp

- Nvidia

- of

- cung cấp

- Cung cấp

- on

- ONE

- có thể

- mở

- mã nguồn mở

- hoạt động

- hoạt động

- Hoạt động

- tối ưu

- tối ưu hóa

- Tối ưu hóa

- tối ưu hóa

- tối ưu hóa

- or

- dàn xếp

- gọi món

- Nền tảng khác

- ra

- bên ngoài

- nổi bật

- kết thúc

- tổng thể

- riêng

- thông số

- một phần

- riêng

- đặc biệt

- hợp tác

- đam mê

- Đỉnh

- tỷ lệ phần trăm

- hiệu suất

- riêng

- Cá nhân

- Bằng tiến sĩ

- đường ống dẫn

- nền tảng

- Nền tảng

- plato

- Thông tin dữ liệu Plato

- PlatoDữ liệu

- máy nghe nhạc

- chơi

- Podcast

- Podcasts

- Điểm

- poker.

- có thể

- Bài đăng

- tiềm năng

- quyền lực

- -

- Độ chính xác

- Trước khi

- Ưu tiên

- ưu tiên

- vấn đề

- quá trình

- Sản phẩm

- Sản lượng

- dự án

- cho

- nhà cung cấp dịch vụ

- cung cấp

- cung cấp

- Python

- Nhanh chóng

- Xếp hạng

- Reading

- thời gian thực

- giảm

- xem

- liên quan

- quan hệ

- sự liên quan

- có liên quan

- đáng tin cậy

- yêu cầu

- đòi hỏi

- Thông tin

- phản ứng

- trách nhiệm

- chịu trách nhiệm

- đáp ứng

- kết quả

- Kết quả

- Giàu

- ngay

- chạy

- chạy

- thời gian chạy

- nhà làm hiền triết

- tương tự

- Lưu

- tiết kiệm

- khả năng mở rộng

- Quy mô

- Khoa học

- khoa học

- các nhà khoa học

- sdk

- sdk

- liền mạch

- Tìm kiếm

- tìm kiếm

- tìm kiếm

- Thứ hai

- phần

- xem

- tìm kiếm

- có vẻ

- ngữ nghĩa

- cao cấp

- nhạy cảm

- kết án

- phục vụ

- máy chủ

- dịch vụ

- Nhà cung cấp dịch vụ

- DỊCH VỤ

- phục vụ

- định

- thiết lập

- một số

- Chia sẻ

- chia sẻ

- Chương trình

- có ý nghĩa

- đáng kể

- Đơn giản

- ngồi

- Kích thước máy

- kích thước

- thông minh

- Phần mềm

- phát triển phần mềm

- giải pháp

- Giải pháp

- bài hát

- nguồn

- Vôn

- chuyên

- chuyên

- riêng

- tốc độ

- ĐÁNH VẦN

- chính tả

- tiêu

- ngăn xếp

- Bắt đầu

- Startups

- ở lại

- vững chắc

- Bước

- Các bước

- Câu chuyện

- trực tuyến

- như vậy

- cao

- hỗ trợ

- Hỗ trợ

- chắc chắn

- Lấy

- dùng

- nhắm mục tiêu

- nhóm

- công nghệ cao

- Kỹ thuật

- kỹ thuật

- kỹ thuật

- Công nghệ

- Công nghệ

- văn bản

- việc này

- Sản phẩm

- cung cấp their dịch

- Them

- Đó

- vì thế

- Kia là

- họ

- điều

- điều này

- Thông qua

- thông lượng

- thời gian

- thời gian

- Yêu sách

- đến

- bên nhau

- Mã thông báo

- Tokens

- mất

- công cụ

- hàng đầu

- Tps

- giao thông

- Train

- đào tạo

- Hội thảo

- biến áp

- Xu hướng

- Triton

- đúng

- hai

- sự hiểu biết

- Chắc chắn

- Vũ trụ

- mở khóa

- Tiết lộ

- us

- sử dụng

- đã sử dụng

- Người sử dụng

- sử dụng

- sử dụng

- Bằng cách sử dụng

- giá trị

- Lớn

- tính linh hoạt

- rất

- Đợi

- đi bộ

- Walmart

- là

- xem

- cách

- we

- web

- các dịch vụ web

- TỐT

- là

- khi nào

- trong khi

- trong khi

- sẽ

- với

- Công việc

- làm việc

- đang làm việc

- công trinh

- thế giới

- lo

- nhưng

- mang lại

- Bạn

- trên màn hình

- zephyrnet