Hiểu cách bộ não tổ chức và truy cập thông tin không gian - chúng ta đang ở đâu, xung quanh góc nào, làm thế nào để đạt được điều đó - vẫn là một thách thức tinh tế. Quá trình này liên quan đến việc nhớ lại toàn bộ mạng lưới ký ức và dữ liệu không gian được lưu trữ từ hàng chục tỷ tế bào thần kinh, mỗi tế bào thần kinh được kết nối với hàng nghìn tế bào khác. Các nhà khoa học thần kinh đã xác định các yếu tố chính như ô lưới, các tế bào thần kinh lập bản đồ vị trí. Nhưng đi sâu hơn sẽ chứng minh sự khó khăn: Các nhà nghiên cứu không thể loại bỏ và nghiên cứu các lát chất xám của con người để xem các ký ức dựa trên vị trí về hình ảnh, âm thanh và mùi truyền qua và kết nối với nhau.

Trí tuệ nhân tạo cung cấp một cách khác. Trong nhiều năm, các nhà khoa học thần kinh đã khai thác nhiều loại mạng lưới thần kinh - động cơ cung cấp năng lượng cho hầu hết các ứng dụng học sâu - để lập mô hình hoạt động của các tế bào thần kinh trong não. Trong nghiên cứu gần đây, các nhà nghiên cứu đã chỉ ra rằng hồi hải mã, một cấu trúc của não quan trọng đối với trí nhớ, về cơ bản là một loại mạng lưới thần kinh đặc biệt, được gọi là biến áp, trong ngụy trang. Mô hình mới của họ theo dõi thông tin không gian theo cách song song với hoạt động bên trong của não. Họ đã thành công đáng kể.

“Thực tế là chúng tôi biết các mô hình não này tương đương với máy biến áp có nghĩa là các mô hình của chúng tôi hoạt động tốt hơn nhiều và dễ huấn luyện hơn,” nói James Whittington, một nhà khoa học thần kinh nhận thức, người đã phân chia thời gian của mình giữa Đại học Stanford và phòng thí nghiệm của Tim Behrens tại Đại học Oxford.

Các nghiên cứu của Whittington và những người khác gợi ý rằng máy biến áp có thể cải thiện đáng kể khả năng của các mô hình mạng thần kinh để bắt chước các loại tính toán được thực hiện bởi các tế bào lưới và các bộ phận khác của não. Những mô hình như vậy có thể thúc đẩy sự hiểu biết của chúng ta về cách thức hoạt động của mạng nơ-ron nhân tạo và thậm chí có nhiều khả năng hơn, cách tính toán được thực hiện trong não, Whittington nói.

“Chúng tôi không cố gắng tạo lại bộ não,” nói David Hà, một nhà khoa học máy tính tại Google Brain, người cũng làm việc trên các mô hình máy biến áp. "Nhưng liệu chúng ta có thể tạo ra một cơ chế có thể làm những gì bộ não làm không?"

Transformers lần đầu tiên xuất hiện cách đây XNUMX năm như một cách mới để AI xử lý ngôn ngữ. Chúng là nước sốt bí mật trong các chương trình hoàn thành câu tiêu đề như Chứng nhận và GPT-3, có thể tạo ra lời bài hát thuyết phục, sáng tác sonnet của Shakespearean và mạo danh đại diện dịch vụ khách hàng.

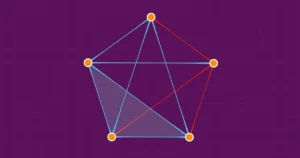

Máy biến áp hoạt động bằng cơ chế gọi là tự chú ý, trong đó mọi đầu vào - một từ, một pixel, một số trong một chuỗi - luôn được kết nối với mọi đầu vào khác. (Các mạng nơ-ron khác chỉ kết nối đầu vào với một số đầu vào khác.) Nhưng trong khi máy biến áp được thiết kế cho các nhiệm vụ ngôn ngữ, chúng đã xuất sắc trong các nhiệm vụ khác như phân loại hình ảnh - và giờ là mô hình hóa bộ não.

Vào năm 2020, một nhóm do Sepp Hochreiter, một nhà khoa học máy tính tại Đại học Johannes Kepler Linz ở Áo, đã sử dụng một máy biến áp để trang bị lại một mô hình truy xuất bộ nhớ mạnh mẽ, lâu đời được gọi là mạng Hopfield. Được giới thiệu lần đầu tiên cách đây 40 năm bởi nhà vật lý Princeton John Hopfield, những mạng lưới này tuân theo một quy tắc chung: Các tế bào thần kinh hoạt động cùng lúc sẽ xây dựng các kết nối mạnh mẽ với nhau.

Hochreiter và các cộng sự của ông, lưu ý rằng các nhà nghiên cứu đang tìm kiếm các mô hình truy xuất bộ nhớ tốt hơn, đã thấy mối liên hệ giữa cách mạng Hopfield lấy lại ký ức và cách máy biến áp thực hiện sự chú ý. Họ đã nâng cấp mạng Hopfield, về cơ bản là biến nó thành một máy biến áp. Sự thay đổi đó cho phép mô hình lưu trữ và truy xuất nhiều ký ức hơn vì các kết nối hiệu quả hơn, Whittington nói. Bản thân Hopfield cùng với Dmitry Krotov tại Phòng thí nghiệm Watson AI của MIT-IBM đã chứng minh rằng mạng Hopfield dựa trên máy biến áp là hợp lý về mặt sinh học.

Sau đó, đầu năm nay, Whittington và Behrens đã giúp điều chỉnh thêm cách tiếp cận của Hochreiter, sửa đổi máy biến áp để thay vì coi ký ức là một chuỗi tuyến tính - giống như một chuỗi từ trong một câu - nó mã hóa chúng dưới dạng tọa độ trong không gian có chiều cao hơn. Các nhà nghiên cứu gọi nó là “vòng xoắn”, cải thiện hơn nữa hiệu suất của mô hình trong các nhiệm vụ khoa học thần kinh. Họ cũng chỉ ra rằng mô hình tương đương về mặt toán học với các mô hình kích hoạt tế bào lưới mà các nhà khoa học thần kinh nhìn thấy trong các lần quét fMRI.

Caswell Barry, nhà khoa học thần kinh tại Đại học College London, cho biết: “Các tế bào lưới có kiểu cấu trúc thú vị, đẹp đẽ, đều đặn và với các mô hình nổi bật khó có thể xuất hiện ngẫu nhiên”. Công trình mới đã chỉ ra cách các máy biến áp tái tạo chính xác những mô hình quan sát được ở vùng hải mã. “Họ nhận ra rằng một máy biến áp có thể tìm ra vị trí của nó dựa trên các trạng thái trước đó và cách nó di chuyển, và theo cách được đưa vào các mô hình ô lưới truyền thống.”

Một nghiên cứu khác gần đây cho thấy rằng máy biến áp cũng có thể nâng cao hiểu biết của chúng ta về các chức năng khác của não. Năm ngoái, Martin Schrimpf, một nhà thần kinh học tính toán tại Viện Công nghệ Massachusetts, đã phân tích 43 mô hình mạng nơ ron khác nhau để xem họ đã dự đoán tốt như thế nào về các phép đo hoạt động thần kinh của con người theo báo cáo của fMRI và điện vỏ. Ông phát hiện ra rằng Transformers là mạng nơ-ron tiên tiến hàng đầu hiện nay, dự đoán gần như tất cả các biến thể được tìm thấy trong hình ảnh.

Và Hà, cùng với một nhà khoa học máy tính đồng nghiệp Đường Yujin, gần đây đã thiết kế một mô hình có thể cố ý gửi một lượng lớn dữ liệu qua một máy biến áp một cách ngẫu nhiên, không theo thứ tự, bắt chước cách cơ thể con người truyền các quan sát giác quan đến não. Máy biến áp của họ, giống như bộ não của chúng ta, có thể xử lý thành công luồng thông tin bị rối loạn.

Tang cho biết: “Các mạng lưới thần kinh rất khó chấp nhận một đầu vào cụ thể. Nhưng trong cuộc sống thực, các tập dữ liệu thường thay đổi nhanh chóng và hầu hết AI không có bất kỳ cách nào để điều chỉnh. “Chúng tôi muốn thử nghiệm với một kiến trúc có thể thích ứng rất nhanh.”

Bất chấp những dấu hiệu tiến bộ này, Behrens coi máy biến áp chỉ là một bước tiến tới một mô hình chính xác của bộ não - không phải là phần cuối của nhiệm vụ. “Tôi phải trở thành một nhà khoa học thần kinh hoài nghi ở đây,” anh nói. “Tôi không nghĩ rằng máy biến áp sẽ trở thành cách chúng ta nghĩ về ngôn ngữ trong não, chẳng hạn, mặc dù chúng có mẫu câu tốt nhất hiện nay.”

“Đây có phải là cơ sở hiệu quả nhất để đưa ra dự đoán về vị trí của tôi và những gì tôi sẽ thấy tiếp theo không? Nếu tôi trung thực, thì còn quá sớm để nói, ”Barry nói.

Schrimpf cũng lưu ý rằng ngay cả những máy biến áp hoạt động tốt nhất cũng bị hạn chế, chẳng hạn như hoạt động tốt đối với các từ và cụm từ ngắn, nhưng không hoạt động tốt đối với các nhiệm vụ ngôn ngữ quy mô lớn hơn như kể chuyện.

Schrimpf cho biết: “Cảm nhận của tôi là kiến trúc này, máy biến áp này, đưa bạn vào không gian thích hợp để hiểu cấu trúc của bộ não, và có thể được cải thiện khi được đào tạo. "Đây là một hướng đi tốt, nhưng lĩnh vực này siêu phức tạp."