Trong vài năm qua, các nền tảng giáo dục trực tuyến đã chứng kiến sự gia tăng trong việc áp dụng và nhu cầu học tập dựa trên video tăng lên vì nó cung cấp một phương tiện hiệu quả để thu hút người học. Để mở rộng ra thị trường quốc tế và giải quyết một nhóm dân cư đa dạng về văn hóa và ngôn ngữ, các doanh nghiệp cũng đang tìm cách đa dạng hóa các dịch vụ học tập của họ bằng cách bản địa hóa nội dung sang nhiều ngôn ngữ. Các doanh nghiệp này đang tìm kiếm những cách đáng tin cậy và hiệu quả về chi phí để giải quyết các trường hợp sử dụng bản địa hóa của họ.

Bản địa hóa nội dung chủ yếu bao gồm dịch giọng nói gốc sang ngôn ngữ mới và thêm các công cụ hỗ trợ trực quan như phụ đề. Theo truyền thống, quá trình này tốn kém nhiều chi phí, thủ công và mất rất nhiều thời gian, kể cả làm việc với các chuyên gia bản địa hóa. Với sức mạnh của các dịch vụ máy học AWS (ML) như Phiên âm Amazon, Amazon Dịchvà Amazon Polly, bạn có thể tạo ra một giải pháp bản địa hóa khả thi và hiệu quả về chi phí. Bạn có thể sử dụng Amazon Transcribe để tạo bản ghi các luồng âm thanh và video hiện có của mình, sau đó dịch bản ghi này sang nhiều ngôn ngữ bằng Amazon Dịch. Sau đó, bạn có thể sử dụng Amazon Polly, một dịch vụ chuyển văn bản thành giọng nói, để chuyển văn bản đã dịch thành giọng nói của con người có âm thanh tự nhiên.

Bước tiếp theo của quá trình bản địa hóa là thêm phụ đề vào nội dung, điều này có thể cải thiện khả năng tiếp cận và khả năng hiểu cũng như giúp người xem hiểu video tốt hơn. Việc tạo phụ đề trên nội dung video có thể gặp nhiều khó khăn vì bài phát biểu đã dịch không khớp với thời gian của bài phát biểu gốc. Việc đồng bộ hóa giữa âm thanh và phụ đề này là một nhiệm vụ quan trọng cần xem xét vì nó có thể ngắt kết nối khán giả khỏi nội dung của bạn nếu chúng không đồng bộ. Amazon Polly đưa ra giải pháp cho thách thức này thông qua việc bật dấu giọng nói, mà bạn có thể sử dụng để tạo tệp phụ đề có thể được đồng bộ hóa với đầu ra giọng nói đã tạo.

Trong bài đăng này, chúng tôi xem xét giải pháp bản địa hóa bằng cách sử dụng các dịch vụ AWS ML, nơi chúng tôi sử dụng video gốc tiếng Anh và chuyển đổi video đó sang tiếng Tây Ban Nha. Chúng tôi cũng tập trung vào việc sử dụng dấu giọng nói để tạo tệp phụ đề được đồng bộ hóa bằng tiếng Tây Ban Nha.

Tổng quan về giải pháp

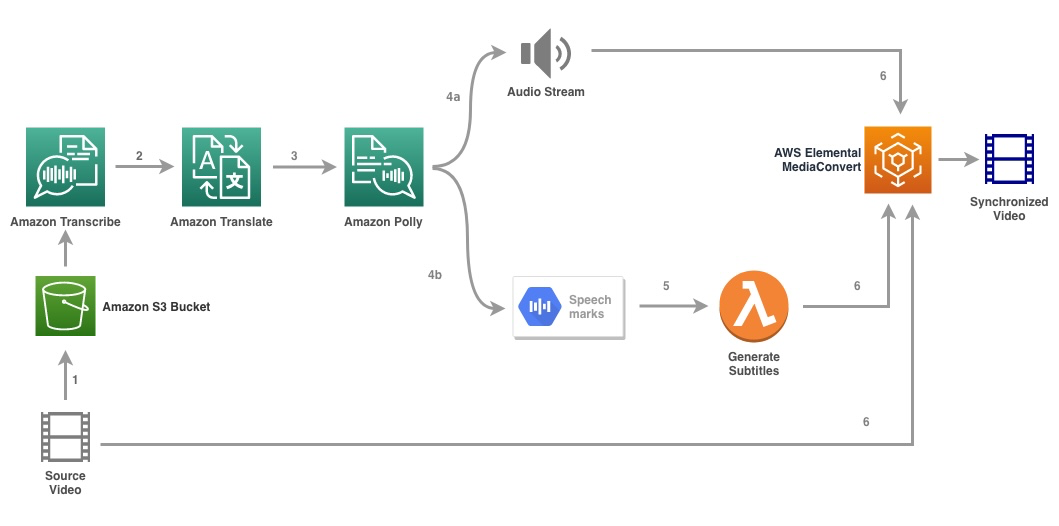

Sơ đồ sau minh họa kiến trúc giải pháp.

Giải pháp lấy một tệp video và cài đặt ngôn ngữ đích làm đầu vào và sử dụng Amazon Transcribe để tạo bản sao của video. Sau đó, chúng tôi sử dụng Amazon Dịch để dịch bản ghi sang ngôn ngữ đích. Văn bản đã dịch được cung cấp làm đầu vào cho Amazon Polly để tạo luồng âm thanh và dấu giọng nói bằng ngôn ngữ đích. Amazon Polly trở lại đầu ra dấu giọng nói trong luồng JSON được phân tách bằng dòng, chứa các trường như thời gian, loại, bắt đầu, kết thúc và giá trị. Giá trị có thể thay đổi tùy thuộc vào loại dấu giọng nói được yêu cầu trong đầu vào, chẳng hạn như SSML, thị giác, từ hoặc câu. Đối với mục đích của ví dụ của chúng tôi, chúng tôi đã yêu cầu loại dấu giọng nói as word. Với tùy chọn này, Amazon Polly chia một câu thành các từ riêng lẻ trong câu và thời gian bắt đầu và kết thúc của chúng trong luồng âm thanh. Với siêu dữ liệu này, các dấu giọng nói sau đó được xử lý để tạo phụ đề cho luồng âm thanh tương ứng do Amazon Polly tạo ra.

Cuối cùng, chúng tôi sử dụng AWS Elemental MediaChuyển đổi để hiển thị video cuối cùng với âm thanh đã dịch và phụ đề tương ứng.

Video sau đây minh họa kết quả cuối cùng của giải pháp:

Quy trình làm việc của Chức năng từng bước AWS

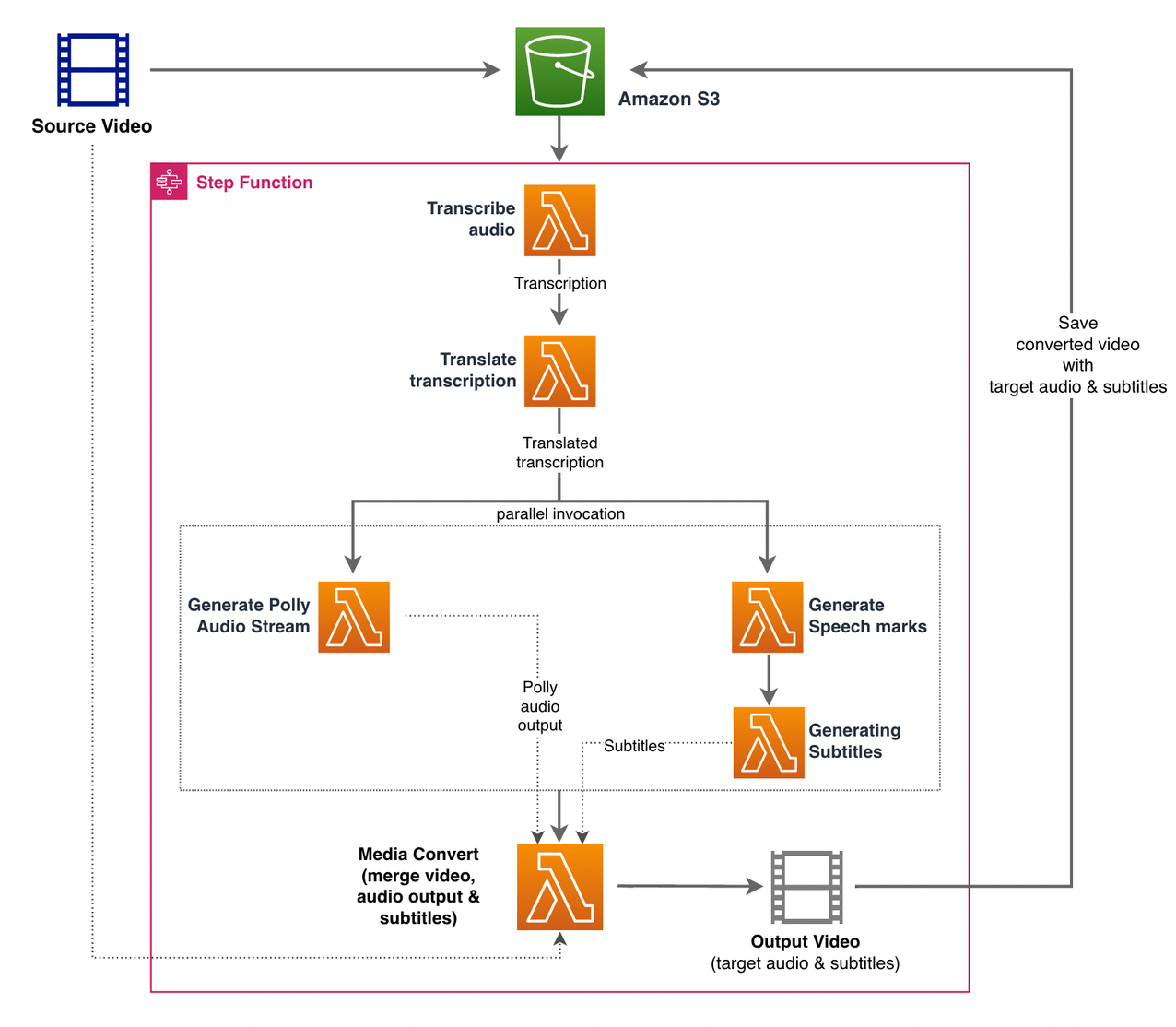

Chúng tôi sử dụng Chức năng bước AWS để sắp xếp quá trình này. Hình sau đây cho thấy dạng xem cấp cao của dòng công việc Chức năng Bước (một số bước được bỏ qua khỏi sơ đồ để rõ ràng hơn).

Các bước quy trình làm việc như sau:

- Người dùng tải tệp video nguồn lên một Dịch vụ lưu trữ đơn giản của Amazon (Amazon S3) xô.

- Sản phẩm Thông báo sự kiện S3 kích hoạt AWS Lambda chức năng bang_machine.py (không được hiển thị trong sơ đồ), gọi máy trạng thái Chức năng Bước.

- Bước đầu tiên, Phiên âm âm thanh, gọi hàm Lambda phiên âm.py, sử dụng Amazon Transcribe để tạo bản ghi âm thanh từ video nguồn.

Mã mẫu sau đây trình bày cách tạo công việc phiên âm bằng Amazon Transcribe boto3 SDK Python:

Sau khi công việc hoàn tất, các tệp đầu ra được lưu vào thùng S3 và quá trình tiếp tục sang bước dịch nội dung tiếp theo.

- Sản phẩm Dịch phiên âm bước gọi hàm Lambda dịch.py sử dụng Amazon Dịch để dịch bản ghi sang ngôn ngữ đích. Ở đây, chúng tôi sử dụng bản dịch đồng bộ / thời gian thực bằng cách sử dụng dịch_text chức năng:

Bản dịch đồng bộ có giới hạn về kích thước tài liệu mà nó có thể dịch; kể từ khi viết bài này, nó được đặt thành 5,000 byte. Đối với các kích thước tài liệu lớn hơn, hãy xem xét sử dụng một lộ trình không đồng bộ để tạo công việc bằng cách sử dụng bắt đầu_text_translation_job và kiểm tra trạng thái thông qua description_text_translation_job.

- Bước tiếp theo là một chức năng bước Song song trạng thái, nơi chúng ta tạo các nhánh song song trong máy trạng thái của chúng ta.

- Trong nhánh đầu tiên, chúng ta gọi hàm Lambda là hàm Lambda create_polly_audio.py để tạo luồng âm thanh Amazon Polly của chúng tôi:

Ở đây chúng tôi sử dụng start_speech_synthesis_task phương pháp của Amazon Polly Python SDK để kích hoạt tác vụ tổng hợp giọng nói tạo ra âm thanh Amazon Polly. Chúng tôi đặt

OutputFormatđếnmp3, yêu cầu Amazon Polly tạo luồng âm thanh cho lệnh gọi API này. - Trong nhánh thứ hai, chúng ta gọi hàm Lambda create_speech_marks.py để tạo đầu ra dấu giọng nói:

- Trong nhánh đầu tiên, chúng ta gọi hàm Lambda là hàm Lambda create_polly_audio.py để tạo luồng âm thanh Amazon Polly của chúng tôi:

- Chúng tôi lại sử dụng start_speech_synthesis_task phương pháp nhưng chỉ định

OutputFormatđếnjson, yêu cầu Amazon Polly tạo dấu giọng nói cho lệnh gọi API này.

Trong bước tiếp theo của nhánh thứ hai, chúng ta gọi hàm Lambda create_subtitles.py, thực hiện logic để tạo tệp phụ đề từ đầu ra dấu giọng nói.

Nó sử dụng mô-đun Python trong tệp webvtt_utils.py. Mô-đun này có nhiều chức năng tiện ích để tạo tệp phụ đề; một trong những phương pháp như vậy get_phrases_from_speechmarks chịu trách nhiệm phân tích cú pháp tệp dấu giọng nói. Cấu trúc JSON đánh dấu lời nói chỉ cung cấp thời gian bắt đầu cho từng từ riêng lẻ. Để tạo thời gian phụ đề cần thiết cho tệp SRT, trước tiên chúng ta tạo các cụm từ gồm khoảng n (trong đó n = 10) từ từ danh sách các từ trong tệp dấu giọng nói. Sau đó, chúng tôi viết chúng vào định dạng tệp SRT, lấy thời gian bắt đầu từ từ đầu tiên trong cụm từ và đối với thời gian kết thúc, chúng tôi sử dụng thời gian bắt đầu của (n + 1) từ và trừ nó đi 1 để tạo mục nhập theo trình tự . Hàm sau tạo các cụm từ để chuẩn bị ghi chúng vào tệp SRT:

- Bước cuối cùng, Chuyển đổi phương tiện truyền thông, gọi hàm Lambda create_mediaconvert_job.py để kết hợp luồng âm thanh từ Amazon Polly và tệp phụ đề với tệp video nguồn để tạo tệp đầu ra cuối cùng, sau đó được lưu trữ trong bộ chứa S3. Bước này sử dụng

MediaConvert, một dịch vụ chuyển mã video dựa trên tệp với các tính năng cấp độ phát sóng. Nó cho phép bạn dễ dàng tạo nội dung video theo yêu cầu và kết hợp khả năng video và âm thanh nâng cao với giao diện web đơn giản. Ở đây một lần nữa chúng tôi sử dụng Python boto3 SDK để tạoMediaConvertCông việc:

Điều kiện tiên quyết

Trước khi bắt đầu, bạn phải có các điều kiện tiên quyết sau:

Triển khai giải pháp

Để triển khai giải pháp bằng AWS CDK, hãy hoàn thành các bước sau:

- Sao chép kho:

- Để đảm bảo AWS CDK là khởi động, chạy lệnh

cdk bootstraptừ gốc của kho lưu trữ: - Thay đổi thư mục làm việc thành thư mục gốc của kho lưu trữ và chạy lệnh sau:

Theo mặc định, cài đặt âm thanh mục tiêu được đặt thành tiếng Tây Ban Nha Hoa Kỳ (es-US). Nếu bạn định kiểm tra nó bằng một ngôn ngữ đích khác, hãy sử dụng lệnh sau:

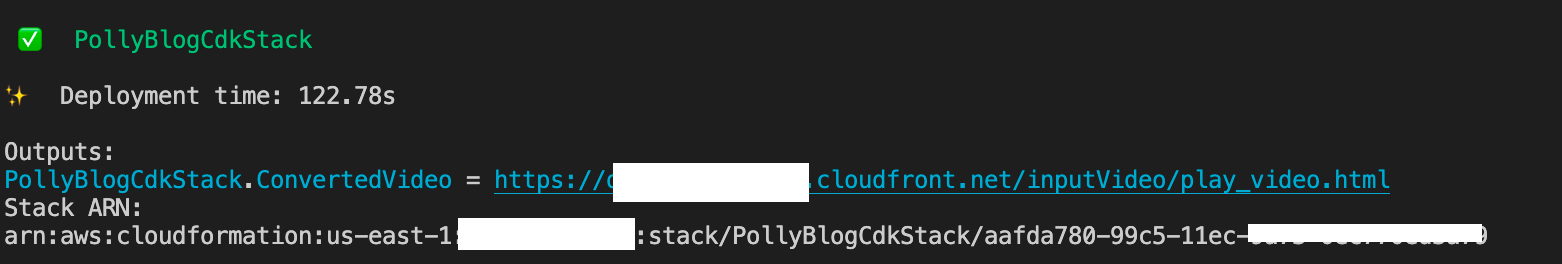

Quá trình này mất vài phút để hoàn tất, sau đó, nó sẽ hiển thị một liên kết mà bạn có thể sử dụng để xem tệp video đích với âm thanh đã dịch và phụ đề đã dịch.

Kiểm tra giải pháp

Để kiểm tra giải pháp này, chúng tôi đã sử dụng một phần nhỏ sau Video AWS re: Invent 2017 từ YouTube, nơi Amazon Transcribe lần đầu tiên được giới thiệu. Bạn cũng có thể kiểm tra giải pháp bằng video của riêng bạn. Ngôn ngữ gốc của video thử nghiệm của chúng tôi là tiếng Anh. Khi bạn triển khai giải pháp này, bạn có thể chỉ định cài đặt âm thanh mục tiêu hoặc bạn có thể sử dụng cài đặt âm thanh mục tiêu mặc định, sử dụng tiếng Tây Ban Nha để tạo âm thanh và phụ đề. Giải pháp tạo một thùng S3 có thể được sử dụng để tải tệp video lên.

- Trên bảng điều khiển Amazon S3, điều hướng đến nhóm

PollyBlogBucket.

- Chọn nhóm, điều hướng đến

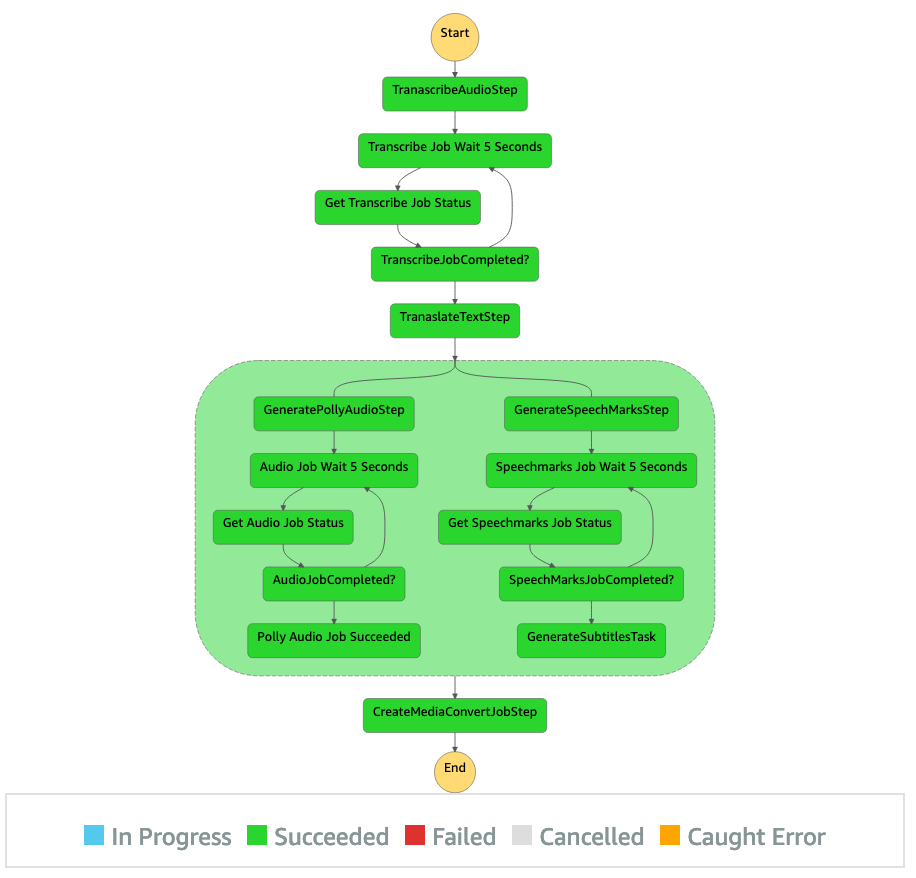

/inputVideovà tải lên tệp video (giải pháp được thử nghiệm với các video loại mp4). Tại thời điểm này, một thông báo sự kiện S3 sẽ kích hoạt chức năng Lambda, chức năng này khởi động máy trạng thái. - Trên bảng điều khiển Chức năng Bước, duyệt đến máy trạng thái (

ProcessAudioWithSubtitles). - Chọn một trong các lần chạy của máy trạng thái để xác định vị trí Trình kiểm tra đồ thị.

Điều này hiển thị kết quả chạy cho mỗi trạng thái. Quy trình Chức năng Bước mất vài phút để hoàn thành, sau đó bạn có thể xác minh xem tất cả các bước đã hoàn thành thành công hay chưa.

Xem lại kết quả đầu ra

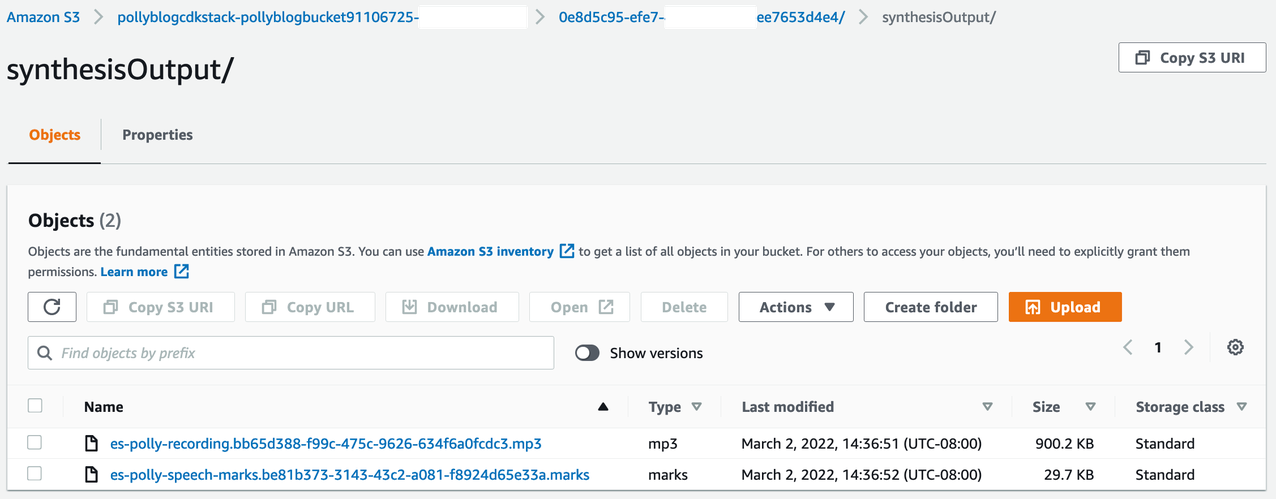

Để xem lại kết quả đầu ra, hãy mở bảng điều khiển Amazon S3 và kiểm tra xem tệp âm thanh (.mp3) và tệp dấu giọng nói (.marks) có được lưu trữ trong bộ chứa S3 dưới <ROOT_S3_BUCKET>/<UID>/synthesisOutput/.

Sau đây là một mẫu tệp dấu giọng nói được tạo từ văn bản đã dịch:

Trong đầu ra này, mỗi phần của văn bản được chia nhỏ theo dấu giọng nói:

- thời gian - Dấu thời gian tính bằng mili giây kể từ đầu luồng âm thanh tương ứng

- kiểu - Loại dấu giọng nói (câu, từ, viseme hoặc SSML)

- Bắt đầu - Độ lệch tính bằng byte (không phải ký tự) của phần bắt đầu đối tượng trong văn bản đầu vào (không bao gồm dấu viseme)

- cuối - Phần bù theo byte (không phải ký tự) của phần cuối đối tượng trong văn bản đầu vào (không bao gồm dấu viseme)

- giá trị - Các từ riêng lẻ trong câu

Tệp phụ đề đã tạo được ghi trở lại nhóm S3. Bạn có thể tìm thấy tệp dưới <ROOT_S3_BUCKET>/<UID>/subtitlesOutput/. Kiểm tra tệp phụ đề; nội dung phải tương tự như văn bản sau:

Sau khi tệp phụ đề và tệp âm thanh được tạo, tệp video nguồn cuối cùng sẽ được tạo bằng MediaConvert. Kiểm tra bảng điều khiển MediaConvert để xác minh xem trạng thái công việc có COMPLETE.

Khi công việc MediaConvert hoàn tất, tệp video cuối cùng sẽ được tạo và lưu trở lại nhóm S3, bạn có thể tìm thấy tệp này trong <ROOT_S3_BUCKET>/<UID>/convertedAV/.

Là một phần của quá trình triển khai này, video cuối cùng được phân phối thông qua Amazon CloudFront (CDN) và hiển thị trong thiết bị đầu cuối hoặc trong Hình thành đám mây AWS giao diện điều khiển.

Mở URL trong trình duyệt để xem video gốc với các tùy chọn bổ sung cho âm thanh và phụ đề. Bạn có thể xác minh rằng âm thanh đã dịch và phụ đề được đồng bộ hóa.

Kết luận

Trong bài đăng này, chúng tôi đã thảo luận về cách tạo phiên bản ngôn ngữ mới của tệp video mà không cần can thiệp thủ công. Người sáng tạo nội dung có thể sử dụng quy trình này để đồng bộ hóa âm thanh và phụ đề của video của họ và tiếp cận khán giả toàn cầu.

Bạn có thể dễ dàng tích hợp phương pháp này vào đường ống sản xuất của riêng mình để xử lý khối lượng và quy mô lớn theo nhu cầu của bạn. Amazon Polly sử dụng TTS thần kinh (NTTS) để tạo ra giọng nói chuyển văn bản thành giọng nói tự nhiên và giống con người. Nó cũng hỗ trợ tạo giọng nói từ SSML, giúp bạn kiểm soát thêm cách Amazon Polly tạo giọng nói từ văn bản được cung cấp. Amazon Polly cũng cung cấp một nhiều giọng nói khác nhau bằng nhiều ngôn ngữ để hỗ trợ nhu cầu của bạn.

Bắt đầu với các dịch vụ máy học AWS bằng cách truy cập vào trang sản phẩm, hoặc tham khảo Phòng thí nghiệm Giải pháp Máy học của Amazon trang nơi bạn có thể cộng tác với các chuyên gia để mang lại các giải pháp máy học cho tổ chức của mình.

Tài nguyên bổ sung

Để biết thêm thông tin về các dịch vụ được sử dụng trong giải pháp này, hãy tham khảo phần sau:

Giới thiệu về tác giả

Reagan Rosario làm việc với tư cách là kiến trúc sư giải pháp tại AWS, tập trung vào các công ty công nghệ giáo dục. Anh ấy thích giúp khách hàng xây dựng các giải pháp có thể mở rộng, khả dụng cao và an toàn trong Đám mây AWS. Ông có hơn một thập kỷ kinh nghiệm làm việc trong nhiều vai trò công nghệ, tập trung vào kỹ thuật phần mềm và kiến trúc.

Reagan Rosario làm việc với tư cách là kiến trúc sư giải pháp tại AWS, tập trung vào các công ty công nghệ giáo dục. Anh ấy thích giúp khách hàng xây dựng các giải pháp có thể mở rộng, khả dụng cao và an toàn trong Đám mây AWS. Ông có hơn một thập kỷ kinh nghiệm làm việc trong nhiều vai trò công nghệ, tập trung vào kỹ thuật phần mềm và kiến trúc.

Anil Kodali là một Kiến trúc sư Giải pháp với Dịch vụ Web của Amazon. Anh ấy làm việc với các khách hàng của AWS EdTech, hướng dẫn họ các phương pháp hay nhất về kiến trúc để di chuyển khối lượng công việc hiện có lên đám mây và thiết kế khối lượng công việc mới với cách tiếp cận dựa trên đám mây. Trước khi gia nhập AWS, anh ấy đã làm việc với các nhà bán lẻ lớn để giúp họ di chuyển qua đám mây.

Anil Kodali là một Kiến trúc sư Giải pháp với Dịch vụ Web của Amazon. Anh ấy làm việc với các khách hàng của AWS EdTech, hướng dẫn họ các phương pháp hay nhất về kiến trúc để di chuyển khối lượng công việc hiện có lên đám mây và thiết kế khối lượng công việc mới với cách tiếp cận dựa trên đám mây. Trước khi gia nhập AWS, anh ấy đã làm việc với các nhà bán lẻ lớn để giúp họ di chuyển qua đám mây.

Prasanna Saraswathi Krishnan là một Kiến trúc sư giải pháp của Amazon Web Services làm việc với các khách hàng của EdTech. Anh ấy giúp họ định hướng kiến trúc đám mây và chiến lược dữ liệu bằng các phương pháp hay nhất. Nền tảng của anh ấy là về máy tính phân tán, phân tích dữ liệu lớn và kỹ thuật dữ liệu. Anh ấy đam mê học máy và xử lý ngôn ngữ tự nhiên.

Prasanna Saraswathi Krishnan là một Kiến trúc sư giải pháp của Amazon Web Services làm việc với các khách hàng của EdTech. Anh ấy giúp họ định hướng kiến trúc đám mây và chiến lược dữ liệu bằng các phương pháp hay nhất. Nền tảng của anh ấy là về máy tính phân tán, phân tích dữ liệu lớn và kỹ thuật dữ liệu. Anh ấy đam mê học máy và xử lý ngôn ngữ tự nhiên.

- AI

- nghệ thuật ai

- máy phát điện nghệ thuật ai

- ai rô bốt

- Phòng thí nghiệm giải pháp Amazon ML

- Amazon Polly

- Phiên âm Amazon

- Amazon Dịch

- trí tuệ nhân tạo

- chứng nhận trí tuệ nhân tạo

- trí tuệ nhân tạo trong ngân hàng

- robot trí tuệ nhân tạo

- robot trí tuệ nhân tạo

- phần mềm trí tuệ nhân tạo

- Học máy AWS

- blockchain

- hội nghị blockchain ai

- thiên tài

- trí tuệ nhân tạo đàm thoại

- hội nghị tiền điện tử ai

- dall's

- học kĩ càng

- google ai

- học máy

- plato

- Plato ai

- Thông tin dữ liệu Plato

- Trò chơi Plato

- PlatoDữ liệu

- Platogaming

- quy mô ai

- cú pháp

- zephyrnet