Chúng tôi tin rằng AI có tiềm năng theo thời gian để biến đổi hầu như mọi trải nghiệm của khách hàng mà chúng tôi biết. Số lượng công ty tung ra các ứng dụng AI tổng quát trên AWS là rất lớn và đang tăng trưởng nhanh chóng, bao gồm adidas, Booking.com, Bridgewater Associates, Clariant, Cox Automotive, GoDaddy và LexisNexis Legal & Professional, chỉ kể tên một số công ty. Các công ty khởi nghiệp đổi mới như Perplexity AI đang dồn hết sức vào AWS để phát triển AI sáng tạo. Các công ty AI hàng đầu như Anthropic đã chọn AWS làm nhà cung cấp đám mây chính cho khối lượng công việc quan trọng và là nơi đào tạo các mô hình tương lai của họ. Và các nhà cung cấp giải pháp và dịch vụ toàn cầu như Accenture đang thu được lợi ích từ các ứng dụng AI có khả năng tạo ra tùy chỉnh khi họ trao quyền cho các nhà phát triển nội bộ của mình bằng Mã Amazon.

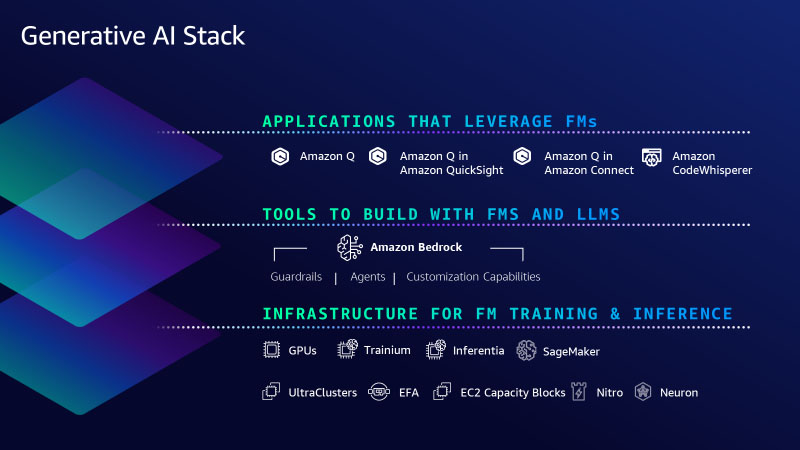

Những khách hàng này chọn AWS vì chúng tôi tập trung thực hiện những gì chúng tôi luôn làm—sử dụng công nghệ phức tạp và đắt tiền có thể thay đổi trải nghiệm của khách hàng và doanh nghiệp, đồng thời dân chủ hóa nó cho khách hàng thuộc mọi quy mô và khả năng kỹ thuật. Để làm được điều này, chúng tôi đang đầu tư và nhanh chóng đổi mới để cung cấp bộ khả năng toàn diện nhất trên ba lớp của hệ thống AI tổng hợp. Lớp dưới cùng là cơ sở hạ tầng để đào tạo Mô hình ngôn ngữ lớn (LLM) và các Mô hình nền tảng (FM) khác và đưa ra các suy luận hoặc dự đoán. Lớp giữa có thể dễ dàng truy cập vào tất cả các mô hình và công cụ mà khách hàng cần để xây dựng và mở rộng quy mô các ứng dụng AI tổng quát với cùng mức độ bảo mật, kiểm soát quyền truy cập và các tính năng khác mà khách hàng mong đợi từ dịch vụ AWS. Và ở cấp cao nhất, chúng tôi đã và đang đầu tư vào các ứng dụng có thể thay đổi trò chơi trong các lĩnh vực chính như mã hóa dựa trên AI tổng quát. Ngoài việc cung cấp cho họ sự lựa chọn và—như họ mong đợi từ chúng tôi—khả năng rộng và sâu trên tất cả các lớp, khách hàng còn cho chúng tôi biết rằng họ đánh giá cao cách tiếp cận ưu tiên dữ liệu của chúng tôi và tin tưởng rằng chúng tôi đã xây dựng mọi thứ ngay từ đầu với doanh nghiệp- cấp độ bảo mật và quyền riêng tư.

Tuần này, chúng tôi đã tiến một bước lớn, công bố nhiều chức năng mới quan trọng trên cả ba lớp nhằm giúp khách hàng của chúng tôi sử dụng rộng rãi AI tổng hợp trong doanh nghiệp của họ một cách dễ dàng và thiết thực.

Lớp dưới cùng của hệ thống: AWS Trainium2 là phần bổ sung mới nhất nhằm cung cấp cơ sở hạ tầng đám mây tiên tiến nhất cho AI tổng hợp

Lớp dưới cùng của ngăn xếp là cơ sở hạ tầng—điện toán, kết nối mạng, khung, dịch vụ—cần thiết để đào tạo và chạy LLM và các FM khác. AWS đổi mới để cung cấp cơ sở hạ tầng tiên tiến nhất cho ML. Thông qua sự hợp tác lâu dài của chúng tôi với NVIDIA, AWS là công ty đầu tiên đưa GPU lên đám mây hơn 12 năm trước và gần đây nhất, chúng tôi là nhà cung cấp đám mây lớn đầu tiên cung cấp GPU NVIDIA H100 với các phiên bản P5 của chúng tôi. Chúng tôi tiếp tục đầu tư vào những cải tiến độc đáo giúp AWS trở thành đám mây tốt nhất để chạy GPU, bao gồm các lợi ích về hiệu suất và giá của hệ thống ảo hóa tiên tiến nhất (AWS Nitro), mạng quy mô petabit mạnh mẽ với Bộ điều hợp vải đàn hồi (EFA) và siêu dữ liệu phân cụm quy mô với Amazon EC2 UltraClusters (hàng nghìn phiên bản tăng tốc được đặt cùng vị trí trong Vùng sẵn sàng và được kết nối với nhau trong mạng không chặn có thể cung cấp tốc độ lên tới 3,200 Gbps cho đào tạo ML quy mô lớn). Chúng tôi cũng đang giúp mọi khách hàng dễ dàng tiếp cận công suất tính toán GPU được săn đón nhiều hơn cho AI tổng hợp với Khối công suất Amazon EC2 cho ML—mô hình tiêu thụ đầu tiên và duy nhất trong ngành cho phép khách hàng dự trữ GPU để sử dụng trong tương lai (lên tới 500 được triển khai trong EC2 UltraClusters) cho khối lượng công việc ML trong thời gian ngắn.

Vài năm trước, chúng tôi nhận ra rằng để tiếp tục đẩy mạnh hiệu suất về giá, chúng tôi cần phải đổi mới hoàn toàn về silicon và chúng tôi bắt đầu đầu tư vào chip của riêng mình. Cụ thể đối với ML, chúng tôi đã bắt đầu với AWS Inferentia, chip suy luận được xây dựng theo mục đích riêng của chúng tôi. Hôm nay, chúng tôi đang sử dụng AWS Inferentia thế hệ thứ hai với các phiên bản Amazon EC2 Inf2 được tối ưu hóa đặc biệt cho các ứng dụng AI tổng hợp quy mô lớn với các mô hình chứa hàng trăm tỷ tham số. Phiên bản Inf2 mang lại chi phí suy luận trên đám mây thấp nhất, đồng thời mang lại thông lượng cao hơn tới bốn lần và độ trễ thấp hơn tới mười lần so với phiên bản Inf1. Được hỗ trợ bởi tối đa 12 chip Inferentia2, Inf2 là phiên bản EC2 được tối ưu hóa suy luận duy nhất có kết nối tốc độ cao giữa các bộ tăng tốc để khách hàng có thể chạy suy luận nhanh hơn và hiệu quả hơn (với chi phí thấp hơn) mà không làm giảm hiệu suất hoặc độ trễ bằng cách phân phối các mô hình cực lớn trên nhiều máy gia tốc. Những khách hàng như Adobe, Deutsche Telekom và Leonardo.ai đã nhận thấy những kết quả ban đầu tuyệt vời và rất hào hứng triển khai mô hình của họ trên quy mô lớn trên Inf2.

Về mặt đào tạo, các phiên bản Trn1—được hỗ trợ bởi chip đào tạo ML chuyên dụng của AWS, AWS Trainium—được tối ưu hóa để phân phối hoạt động đào tạo trên nhiều máy chủ được kết nối với mạng EFA. Những khách hàng như Ricoh đã đào tạo một LLM Nhật Bản với hàng tỷ thông số chỉ trong vài ngày. Databricks đang có hiệu suất về giá tốt hơn tới 40% với các phiên bản dựa trên Trainium để đào tạo các mô hình học sâu quy mô lớn. Nhưng với các mẫu mới, có nhiều tính năng hơn sắp ra mắt thực tế hàng tuần, chúng tôi đang tiếp tục vượt qua các ranh giới về hiệu suất và quy mô, đồng thời chúng tôi rất vui mừng được thông báo Đào tạo AWS2, được thiết kế để mang lại hiệu quả về giá thậm chí còn tốt hơn cho các mô hình đào tạo có hàng trăm tỷ đến hàng nghìn tỷ tham số. Trainium2 sẽ mang lại hiệu suất đào tạo nhanh hơn tới bốn lần so với Trainium thế hệ đầu tiên và khi được sử dụng trong EC2 UltraClusters sẽ cung cấp tới 65 exaflop điện toán tổng hợp. Điều này có nghĩa là khách hàng sẽ có thể đào tạo LLM tham số 300 tỷ trong vài tuần so với vài tháng. Hiệu suất, quy mô và hiệu quả sử dụng năng lượng của Trainium2 là một số lý do khiến Anthropic chọn đào tạo các mô hình của mình trên AWS và sẽ sử dụng Trainium2 cho các mô hình trong tương lai của mình. Và chúng tôi đang cộng tác với Anthropic để tiếp tục đổi mới với cả Trainium và Inferentia. Chúng tôi hy vọng các phiên bản Trainium2 đầu tiên sẽ được cung cấp cho khách hàng vào năm 2024.

Chúng tôi cũng đã tăng gấp đôi chuỗi công cụ phần mềm cho silicon ML của mình, đặc biệt là cải tiến AWS Neuron, bộ công cụ phát triển phần mềm (SDK) giúp khách hàng có được hiệu suất tối đa từ Trainium và Inferentia. Kể từ khi giới thiệu Neuron vào năm 2019, chúng tôi đã đầu tư đáng kể vào công nghệ trình biên dịch và khung và ngày nay Neuron hỗ trợ nhiều mô hình công khai phổ biến nhất, bao gồm Llama 2 từ Meta, MPT từ Databricks và Stable Diffusion từ Stability AI, cũng như 93 trong số 100 người mẫu hàng đầu trên kho người mẫu nổi tiếng Ôm Mặt. Neuron kết nối với các khung ML phổ biến như PyTorch và TensorFlow, đồng thời sẽ hỗ trợ JAX vào đầu năm tới. Khách hàng cho chúng tôi biết rằng Neuron đã giúp họ dễ dàng chuyển đổi quy trình suy luận và đào tạo mô hình hiện có sang Trainium và Inferentia chỉ bằng một vài dòng mã.

Không ai khác cung cấp sự kết hợp tương tự giữa các chip ML tốt nhất, mạng siêu nhanh, ảo hóa và cụm siêu quy mô. Vì vậy, không có gì đáng ngạc nhiên khi một số công ty khởi nghiệp AI có tính sáng tạo nổi tiếng nhất như AI21 Labs, Anthropic, Hugging Face, Perplexity AI, Runway và Stability AI chạy trên AWS. Tuy nhiên, bạn vẫn cần các công cụ phù hợp để tận dụng hiệu quả tính toán này nhằm xây dựng, đào tạo và chạy LLM cũng như các FM khác một cách hiệu quả và tiết kiệm chi phí. Và đối với nhiều công ty khởi nghiệp trong số này, Amazon SageMaker là câu trả lời. Cho dù xây dựng và đào tạo một mô hình mới, độc quyền từ đầu hay bắt đầu với một trong nhiều mô hình phổ biến đã được công bố rộng rãi, đào tạo là một công việc phức tạp và tốn kém. Việc vận hành những mô hình này một cách tiết kiệm chi phí cũng không phải là điều dễ dàng. Khách hàng phải thu thập lượng lớn dữ liệu và chuẩn bị nó. Điều này thường liên quan đến rất nhiều công việc thủ công để làm sạch dữ liệu, loại bỏ các bản sao, làm phong phú và chuyển đổi nó. Sau đó, họ phải tạo và duy trì các cụm GPU/bộ tăng tốc lớn, viết mã để phân phối hiệu quả quá trình đào tạo mô hình giữa các cụm, thường xuyên kiểm tra, tạm dừng, kiểm tra và tối ưu hóa mô hình, đồng thời can thiệp và khắc phục các sự cố phần cứng trong cụm theo cách thủ công. Nhiều thách thức trong số này không có gì mới, nhưng đó là một số lý do khiến chúng tôi ra mắt SageMaker sáu năm trước—nhằm phá bỏ nhiều rào cản liên quan đến việc đào tạo và triển khai mô hình cũng như cung cấp cho các nhà phát triển một cách dễ dàng hơn nhiều. Hàng chục nghìn khách hàng sử dụng Amazon SageMaker và ngày càng có nhiều khách hàng như LG AI Research, Perplexity AI, AI21, Hugging Face và Stability AI đang đào tạo LLM và các FM khác trên SageMaker. Mới gần đây, Viện Đổi mới Công nghệ (người tạo ra Falcon LLM nổi tiếng) đã đào tạo mô hình công khai lớn nhất—Falcon 180B—trên SageMaker. Khi kích thước và độ phức tạp của mô hình tăng lên, phạm vi của SageMaker cũng tăng theo.

Trong những năm qua, chúng tôi đã bổ sung hơn 380 tính năng và khả năng thay đổi cuộc chơi cho Amazon SageMaker như điều chỉnh mô hình tự động, đào tạo phân tán, tùy chọn triển khai mô hình linh hoạt, công cụ cho OP ML, công cụ chuẩn bị dữ liệu, kho tính năng, sổ ghi chép, tích hợp liền mạch với các đánh giá do con người thực hiện trong vòng đời ML và các tính năng tích hợp sẵn dành cho AI có trách nhiệm. Chúng tôi không ngừng đổi mới nhanh chóng để đảm bảo khách hàng của SageMaker có thể tiếp tục xây dựng, đào tạo và chạy suy luận cho tất cả các mô hình—bao gồm LLM và các FM khác. Và chúng tôi đang làm cho việc đào tạo và triển khai các mô hình lớn với hai khả năng mới trở nên dễ dàng và tiết kiệm chi phí hơn nữa. Đầu tiên, để đơn giản hóa việc đào tạo, chúng ta giới thiệu Amazon SageMaker HyperPod tự động hóa nhiều quy trình cần thiết hơn cho hoạt động đào tạo phân tán có khả năng chịu lỗi ở quy mô cao (ví dụ: định cấu hình thư viện đào tạo phân tán, mở rộng khối lượng công việc đào tạo trên hàng nghìn máy gia tốc, phát hiện và sửa chữa các trường hợp bị lỗi), tăng tốc độ đào tạo lên tới 40%. Do đó, những khách hàng như Perplexity AI, Hugging Face, Stability, Hippocrates, Alkaid và những khách hàng khác đang sử dụng SageMaker HyperPod để xây dựng, đào tạo hoặc phát triển các mô hình. Thứ hai, chúng tôi đang giới thiệu các khả năng mới giúp suy luận tiết kiệm chi phí hơn đồng thời giảm độ trễ. SageMaker hiện giúp khách hàng triển khai nhiều mô hình trong cùng một phiên bản để họ có thể chia sẻ tài nguyên điện toán—giảm chi phí suy luận xuống 50% (trung bình). SageMaker cũng chủ động giám sát các phiên bản đang xử lý yêu cầu suy luận và định tuyến các yêu cầu một cách thông minh dựa trên phiên bản nào có sẵn—đạt được độ trễ suy luận thấp hơn 20% (trung bình). Phỏng đoán, Salesforce và Slack đã sử dụng SageMaker để lưu trữ các mô hình nhờ những tối ưu hóa suy luận này.

Lớp giữa của ngăn xếp: Amazon Bedrock bổ sung các mô hình mới và làn sóng khả năng mới giúp khách hàng dễ dàng xây dựng và mở rộng quy mô các ứng dụng AI tổng hợp một cách an toàn

Trong khi một số khách hàng sẽ xây dựng LLM của riêng họ và các FM khác hoặc phát triển bất kỳ tùy chọn nào có sẵn công khai, nhiều khách hàng sẽ không muốn dành nguồn lực và thời gian để thực hiện việc này. Đối với họ, lớp giữa của ngăn xếp cung cấp các mô hình này như một dịch vụ. Giải pháp của chúng tôi ở đây, nền tảng Amazon, cho phép khách hàng lựa chọn trong số các mô hình hàng đầu trong ngành từ Anthropic, Stability AI, Meta, Cohere, AI21 và Amazon, tùy chỉnh chúng bằng dữ liệu của riêng họ và tận dụng tất cả các tính năng, kiểm soát truy cập và bảo mật hàng đầu mà họ quen dùng trong AWS—tất cả đều thông qua dịch vụ được quản lý. Chúng tôi đã cung cấp rộng rãi Amazon Bedrock vào cuối tháng XNUMX và phản hồi của khách hàng cực kỳ tích cực. Khách hàng từ khắp nơi trên thế giới và ở hầu hết mọi ngành đều hào hứng sử dụng Amazon Bedrock. adidas đang cho phép các nhà phát triển nhận được câu trả lời nhanh chóng về mọi thứ, từ thông tin “bắt đầu” đến các câu hỏi kỹ thuật sâu hơn. Booking.com dự định sử dụng AI tổng hợp để viết ra các đề xuất chuyến đi phù hợp cho từng khách hàng. Bridgewater Associates đang phát triển Trợ lý phân tích đầu tư được hỗ trợ bởi LLM để giúp tạo biểu đồ, tính toán các chỉ số tài chính và tóm tắt kết quả. Carrier đang thực hiện các phân tích năng lượng chính xác hơn và thông tin chi tiết hơn để khách hàng có thể tiếp cận để họ giảm mức tiêu thụ năng lượng và cắt giảm lượng khí thải carbon. Clariant đang trao quyền cho các thành viên trong nhóm của mình bằng một chatbot AI tổng hợp nội bộ để tăng tốc các quy trình R&D, hỗ trợ nhóm bán hàng chuẩn bị cuộc họp và tự động hóa email của khách hàng. GoDaddy đang giúp khách hàng dễ dàng thiết lập hoạt động kinh doanh trực tuyến bằng cách sử dụng AI tổng hợp để xây dựng trang web, tìm nhà cung cấp, kết nối với khách hàng, v.v. Lexis Nexis Legal & Professional đang chuyển đổi công việc pháp lý cho luật sư và tăng năng suất của họ với khả năng tìm kiếm, tóm tắt, soạn thảo và phân tích tài liệu bằng đàm thoại của Lexis+ AI. Nasdaq đang giúp tự động hóa quy trình điều tra các giao dịch đáng ngờ và tăng cường khả năng giám sát và chống tội phạm tài chính của họ. Tất cả những ứng dụng này—và nhiều ứng dụng AI tổng hợp đa dạng khác—đang chạy trên AWS.

Chúng tôi rất vui mừng về động lực của Amazon Bedrock nhưng vẫn còn sớm. Điều chúng tôi nhận thấy khi làm việc với khách hàng là mọi người đều chuyển động rất nhanh, nhưng sự phát triển của AI tổng hợp vẫn tiếp tục với tốc độ nhanh chóng với các lựa chọn và cải tiến mới diễn ra thực tế hàng ngày. Khách hàng nhận thấy có nhiều mô hình khác nhau hoạt động tốt hơn cho các trường hợp sử dụng khác nhau hoặc trên các tập dữ liệu khác nhau. Một số mô hình rất tốt cho việc tóm tắt, một số khác thì tuyệt vời cho lý luận và tích hợp, và những mô hình khác vẫn có sự hỗ trợ ngôn ngữ thực sự tuyệt vời. Và sau đó là việc tạo hình ảnh, trường hợp sử dụng tìm kiếm, v.v.—tất cả đều đến từ cả các mô hình độc quyền và từ các mô hình được cung cấp công khai cho bất kỳ ai. Và trong thời điểm có quá nhiều điều không thể biết được, khả năng thích ứng được cho là công cụ quý giá nhất. Sẽ không có một mô hình nào có thể thống trị tất cả. Và chắc chắn không chỉ có một công ty công nghệ cung cấp những mẫu máy mà mọi người đều sử dụng. Khách hàng cần phải thử các mẫu khác nhau. Họ cần có khả năng chuyển đổi giữa chúng hoặc kết hợp chúng trong cùng một trường hợp sử dụng. Điều này có nghĩa là họ cần một sự lựa chọn thực sự về các nhà cung cấp mô hình (điều mà các sự kiện trong 10 ngày qua càng cho thấy rõ hơn). Đây là lý do tại sao chúng tôi phát minh ra Amazon Bedrock, tại sao nó gây được tiếng vang sâu sắc với khách hàng và tại sao chúng tôi đang tiếp tục đổi mới và lặp lại nhanh chóng để giúp việc xây dựng với (và di chuyển giữa) nhiều mô hình trở nên dễ dàng như lệnh gọi API, áp dụng các kỹ thuật mới nhất để tất cả các nhà phát triển có thể tùy chỉnh mô hình và đảm bảo an toàn cho khách hàng cũng như bảo mật dữ liệu của họ. Chúng tôi rất vui mừng được giới thiệu một số khả năng mới sẽ giúp khách hàng xây dựng và mở rộng quy mô các ứng dụng AI tổng quát dễ dàng hơn nữa:

- Mở rộng lựa chọn mô hình với Anthropic Claude 2.1, Meta Llama 2 70B và các phần bổ sung cho dòng Amazon Titan. Trong những ngày đầu này, khách hàng vẫn đang tìm hiểu và thử nghiệm các mô hình khác nhau để xác định xem họ muốn sử dụng mô hình nào cho các mục đích khác nhau. Họ muốn có thể dễ dàng dùng thử các mẫu mới nhất, đồng thời kiểm tra xem khả năng và tính năng nào sẽ mang lại cho họ kết quả tốt nhất và đặc điểm chi phí cho trường hợp sử dụng của họ. Với Amazon Bedrock, khách hàng chỉ cần một lệnh gọi API là có thể sử dụng mô hình mới. Một số kết quả ấn tượng nhất mà khách hàng đã trải nghiệm trong vài tháng qua là từ các LLM như Mô hình Claude của Anthropic, vượt trội trong nhiều nhiệm vụ từ hộp thoại và tạo nội dung phức tạp đến lý luận phức tạp trong khi vẫn duy trì độ tin cậy và khả năng dự đoán cao. Khách hàng báo cáo rằng Claude ít có khả năng tạo ra đầu ra có hại hơn, dễ trò chuyện hơn và dễ điều khiển hơn so với các FM khác, vì vậy các nhà phát triển có thể đạt được đầu ra mong muốn mà không tốn nhiều công sức hơn. Mô hình tiên tiến nhất của Anthropic, Claude 2, đạt điểm trên 90 phần trăm trong bài thi đọc và viết GRE, cũng như tương tự trong bài thi lý luận định lượng. Và hiện tại, mẫu Claude 2.1 mới phát hành đã có sẵn trên Amazon Bedrock. Claude 2.1 cung cấp các khả năng chính cho doanh nghiệp như cửa sổ ngữ cảnh mã thông báo 200K dẫn đầu ngành (gấp đôi bối cảnh của Claude 2), giảm tỷ lệ ảo giác và cải thiện đáng kể về độ chính xác, ngay cả ở độ dài ngữ cảnh rất dài. Claude 2.0 cũng bao gồm các lời nhắc hệ thống được cải tiến – là các hướng dẫn mô hình mang lại trải nghiệm tốt hơn cho người dùng cuối – đồng thời giảm 2.1% chi phí cho lời nhắc và hoàn thành.

Đối với ngày càng nhiều khách hàng muốn sử dụng phiên bản được quản lý của mô hình Llama 2 có sẵn công khai của Meta, Amazon Bedrock cung cấp Llama 2 13B và chúng tôi đang thêm Llama 2 70B. Llama 2 70B phù hợp cho các nhiệm vụ quy mô lớn như mô hình hóa ngôn ngữ, tạo văn bản và hệ thống đối thoại. Các mô hình Llama có sẵn công khai đã được tải xuống hơn 30 triệu lần và khách hàng yêu thích việc Amazon Bedrock cung cấp chúng như một phần của dịch vụ được quản lý mà họ không cần phải lo lắng về cơ sở hạ tầng hoặc có kiến thức chuyên môn sâu về ML trong nhóm của mình. Ngoài ra, để tạo hình ảnh, AI ổn định còn cung cấp một bộ mô hình chuyển văn bản thành hình ảnh phổ biến. Stable Diffusion XL 1.0 (SDXL 1.0) là phiên bản cao cấp nhất trong số này và hiện đã có sẵn rộng rãi trên Amazon Bedrock. Phiên bản mới nhất của mẫu hình ảnh phổ biến này đã tăng độ chính xác, độ chân thực tốt hơn và độ phân giải cao hơn.

Khách hàng cũng đang sử dụng người khổng lồ Amazon các mô hình được AWS tạo và đào tạo trước để cung cấp các khả năng mạnh mẽ với tính kinh tế cao cho nhiều trường hợp sử dụng khác nhau. Amazon có thành tích 25 năm về ML và AI—công nghệ mà chúng tôi sử dụng trong các hoạt động kinh doanh của mình—và chúng tôi đã học được rất nhiều điều về việc xây dựng và triển khai các mô hình. Chúng tôi đã lựa chọn cẩn thận cách chúng tôi đào tạo các mô hình của mình và dữ liệu chúng tôi sử dụng để làm như vậy. Chúng tôi bồi thường cho khách hàng trước những khiếu nại rằng mô hình của chúng tôi hoặc kết quả đầu ra của họ vi phạm bản quyền của bất kỳ ai. Chúng tôi đã giới thiệu các mẫu Titan đầu tiên của mình vào tháng XNUMX năm nay. Titan Text Lite—bây giờ đã có sẵn—là một mô hình ngắn gọn, tiết kiệm chi phí cho các trường hợp sử dụng như chatbot, tóm tắt văn bản hoặc viết quảng cáo và nó cũng hấp dẫn để tinh chỉnh. Titan Text Express—hiện cũng đã có sẵn rộng rãi—có tính mở rộng hơn và có thể được sử dụng cho nhiều tác vụ dựa trên văn bản hơn, chẳng hạn như tạo văn bản mở và trò chuyện đàm thoại. Chúng tôi cung cấp các tùy chọn mô hình văn bản này để cung cấp cho khách hàng khả năng tối ưu hóa về độ chính xác, hiệu suất và chi phí tùy thuộc vào trường hợp sử dụng và yêu cầu kinh doanh của họ. Những khách hàng như Nexxiot, PGA Tour và Ryanair đang sử dụng hai mẫu Titan Text của chúng tôi. Chúng tôi cũng có một mô hình nhúng, Titan Text Embeddings, dành cho các trường hợp sử dụng tìm kiếm và cá nhân hóa. Những khách hàng như Nasdaq đang nhận được kết quả tuyệt vời khi sử dụng Titan Text Embeddings để nâng cao khả năng cho Nasdaq IR Insight nhằm tạo ra thông tin chuyên sâu từ hơn 9,000 tài liệu của các công ty toàn cầu dành cho nhóm phát triển bền vững, pháp lý và kế toán. Và chúng tôi sẽ tiếp tục bổ sung thêm nhiều mẫu khác cho dòng Titan theo thời gian. Chúng tôi đang giới thiệu một mô hình nhúng mới, Titan Multimodal Embeddings, để hỗ trợ trải nghiệm tìm kiếm và đề xuất đa phương thức cho người dùng sử dụng hình ảnh và văn bản (hoặc kết hợp cả hai) làm đầu vào. Và chúng ta giới thiệu mô hình chuyển văn bản thành hình ảnh mới, Amazon Titan Image Generator. Với Titan Image Generator, khách hàng trong các ngành như quảng cáo, thương mại điện tử, truyền thông và giải trí có thể sử dụng kiểu nhập văn bản để tạo ra hình ảnh chân thực, chất lượng studio với số lượng lớn và chi phí thấp. Chúng tôi rất vui mừng về cách khách hàng phản hồi với Titan Models và bạn có thể mong đợi rằng chúng tôi sẽ tiếp tục đổi mới ở đây.

- Các khả năng mới để tùy chỉnh ứng dụng AI tổng quát của bạn một cách an toàn với dữ liệu độc quyền của bạn: Một trong những khả năng quan trọng nhất của Amazon Bedrock là việc tùy chỉnh mô hình thật dễ dàng. Điều này trở nên thực sự thú vị đối với khách hàng vì đó là nơi AI tổng hợp gặp được yếu tố khác biệt cốt lõi—dữ liệu của họ. Tuy nhiên, điều thực sự quan trọng là dữ liệu của họ vẫn được bảo mật, họ có quyền kiểm soát dữ liệu trong quá trình thực hiện và việc cải tiến mô hình là quyền riêng tư của họ. Bạn có thể thực hiện việc này theo một số cách và Amazon Bedrock cung cấp nhiều lựa chọn tùy chỉnh nhất trên nhiều mô hình). Đầu tiên là tinh chỉnh. Tinh chỉnh mô hình trong Amazon Bedrock thật dễ dàng. Bạn chỉ cần chọn mô hình và Amazon Bedrock tạo một bản sao của mô hình đó. Sau đó, bạn chỉ ra một số ví dụ được gắn nhãn (ví dụ: một loạt các cặp câu hỏi-câu trả lời hay) mà bạn lưu trữ trong Amazon Simple Storage Service (Amazon S3) và Amazon Bedrock “đào tạo tăng dần” (tăng cường mô hình được sao chép bằng thông tin mới) dựa trên những ví dụ này và kết quả là một mô hình được tinh chỉnh riêng tư, chính xác hơn mang lại phản hồi tùy chỉnh, phù hợp hơn. Chúng tôi vui mừng thông báo rằng tính năng tinh chỉnh thường có sẵn cho Cohere Command, Meta Llama 2, Amazon Titan Text (Lite và Express), Amazon Titan Multimodal Embeddings và ở bản xem trước cho Amazon Titan Image Generator. Và thông qua sự hợp tác với Anthropic, chúng tôi sẽ sớm cung cấp cho khách hàng AWS quyền truy cập sớm vào các tính năng độc đáo để tùy chỉnh mô hình và tinh chỉnh mô hình Claude tiên tiến nhất của mình.

Kỹ thuật thứ hai để tùy chỉnh LLM và các FM khác cho doanh nghiệp của bạn là tạo tăng cường truy xuất (RAG), cho phép bạn tùy chỉnh phản hồi của mô hình bằng cách tăng cường lời nhắc của bạn bằng dữ liệu từ nhiều nguồn, bao gồm kho tài liệu, cơ sở dữ liệu và API. Vào tháng XNUMX, chúng tôi đã giới thiệu chức năng RAG, Cơ sở kiến thức cho Amazon Bedrock, kết nối an toàn các mô hình với nguồn dữ liệu độc quyền của bạn để bổ sung thêm thông tin cho lời nhắc của bạn để ứng dụng của bạn cung cấp phản hồi phù hợp, theo ngữ cảnh và chính xác hơn. Cơ sở kiến thức hiện đã có sẵn với API thực hiện toàn bộ quy trình làm việc RAG từ việc tìm nạp văn bản cần thiết để bổ sung lời nhắc, gửi lời nhắc đến mô hình và trả về phản hồi. Cơ sở Kiến thức hỗ trợ các cơ sở dữ liệu có khả năng vectơ lưu trữ các biểu diễn số cho dữ liệu của bạn (các phần nhúng) mà các mô hình sử dụng để truy cập dữ liệu này cho RAG, bao gồm Amazon OpenSearch Service và các cơ sở dữ liệu phổ biến khác như Pinecone và Redis Enterprise Cloud (sắp có hỗ trợ vectơ Amazon Aurora và MongoDB sớm).

Cách thứ ba để bạn có thể tùy chỉnh các mô hình trong Amazon Bedrock là tiếp tục đào tạo trước. Với phương pháp này, mô hình được xây dựng dựa trên quá trình đào tạo trước ban đầu để hiểu ngôn ngữ chung để học ngôn ngữ và thuật ngữ theo miền cụ thể. Cách tiếp cận này dành cho những khách hàng có lượng lớn thông tin không được gắn nhãn, theo miền cụ thể và muốn cho phép LLM của họ hiểu ngôn ngữ, cụm từ, chữ viết tắt, khái niệm, định nghĩa và biệt ngữ duy nhất trong thế giới (và hoạt động kinh doanh) của họ. Không giống như quá trình tinh chỉnh cần một lượng dữ liệu khá nhỏ, quá trình huấn luyện trước liên tục được thực hiện trên các tập dữ liệu lớn (ví dụ: hàng nghìn tài liệu văn bản). Giờ đây, khả năng đào tạo trước đã có sẵn trên Amazon Bedrock dành cho Titan Text Lite và Titan Text Express.

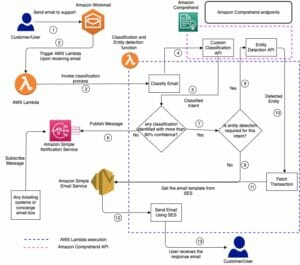

- Sự sẵn có chung của Đại lý cho Amazon Bedrock để giúp thực hiện các nhiệm vụ nhiều bước bằng cách sử dụng hệ thống, nguồn dữ liệu và kiến thức của công ty. LLM rất giỏi trong việc trò chuyện và tạo nội dung, nhưng khách hàng muốn ứng dụng của họ có thể do thậm chí còn hơn thế nữa—chẳng hạn như thực hiện hành động, giải quyết vấn đề và tương tác với nhiều hệ thống để hoàn thành các nhiệm vụ gồm nhiều bước như đặt chỗ chuyến đi, nộp đơn yêu cầu bảo hiểm hoặc đặt mua phụ tùng thay thế. Và Amazon Bedrock có thể giúp giải quyết thách thức này. Với các đại lý, các nhà phát triển chọn một mô hình, viết một số hướng dẫn cơ bản như “bạn là một đại lý dịch vụ khách hàng vui vẻ” và “kiểm tra tính sẵn có của sản phẩm trong hệ thống kiểm kê”, hướng mô hình đã chọn đến đúng nguồn dữ liệu và hệ thống doanh nghiệp (ví dụ: CRM hoặc ứng dụng ERP) và viết một số hàm AWS Lambda để thực thi các API (ví dụ: kiểm tra tính sẵn có của một mục trong kho ERP). Amazon Bedrock tự động phân tích yêu cầu và chia nhỏ yêu cầu đó thành một trình tự logic bằng cách sử dụng khả năng suy luận của mô hình đã chọn để xác định thông tin nào là cần thiết, API nào cần gọi và thời điểm gọi chúng để hoàn thành một bước hoặc giải quyết một nhiệm vụ. Hiện đã có sẵn rộng rãi, các đại lý có thể lập kế hoạch và thực hiện hầu hết các nhiệm vụ kinh doanh—từ trả lời các câu hỏi của khách hàng về tính sẵn có của sản phẩm cho đến nhận đơn đặt hàng của họ—và các nhà phát triển không cần phải làm quen với học máy, lời nhắc của kỹ sư, mô hình đào tạo hoặc kết nối hệ thống theo cách thủ công. Và Bedrock thực hiện tất cả những điều này một cách an toàn và riêng tư, đồng thời những khách hàng như Druva và Athene đã sử dụng chúng để cải thiện độ chính xác và tốc độ phát triển các ứng dụng AI tổng hợp của họ.

- Giới thiệu Lan can cho Amazon Bedrock để bạn có thể áp dụng các biện pháp bảo vệ dựa trên yêu cầu trường hợp sử dụng của mình và các chính sách AI có trách nhiệm. Khách hàng muốn đảm bảo rằng các hoạt động tương tác với ứng dụng AI của họ được an toàn, tránh ngôn ngữ độc hại hoặc gây khó chịu, phù hợp với hoạt động kinh doanh của họ và tuân thủ các chính sách AI có trách nhiệm của họ. Với lan can, khách hàng có thể chỉ định các chủ đề cần tránh và Amazon Bedrock sẽ chỉ cung cấp cho người dùng câu trả lời đã được phê duyệt cho các câu hỏi thuộc các danh mục bị hạn chế đó. Ví dụ: một ứng dụng ngân hàng trực tuyến có thể được thiết lập để tránh cung cấp lời khuyên đầu tư và xóa nội dung không phù hợp (chẳng hạn như lời nói căm thù và bạo lực). Vào đầu năm 2024, khách hàng cũng sẽ có thể loại bỏ thông tin nhận dạng cá nhân (PII) trong các câu trả lời mẫu. Ví dụ: sau khi khách hàng tương tác với nhân viên trung tâm cuộc gọi, cuộc trò chuyện của bộ phận dịch vụ khách hàng thường được tóm tắt để lưu giữ hồ sơ và các biện pháp bảo vệ có thể xóa PII khỏi những bản tóm tắt đó. Có thể sử dụng lan can trên nhiều mô hình trong Amazon Bedrock (bao gồm cả các mô hình đã tinh chỉnh) và với Đại lý dành cho Amazon Bedrock để khách hàng có thể mang lại mức độ bảo vệ nhất quán cho tất cả các ứng dụng AI tổng hợp của họ.

Lớp trên cùng của ngăn xếp: Sự đổi mới liên tục giúp AI tổng quát có thể tiếp cận được với nhiều người dùng hơn

Ở lớp trên cùng của ngăn xếp là các ứng dụng tận dụng LLM và các FM khác để bạn có thể tận dụng AI tổng hợp trong công việc. Một lĩnh vực mà AI tổng quát đang thay đổi cuộc chơi là viết mã. Năm ngoái, chúng tôi đã giới thiệu Amazon CodeWhisperer, giúp bạn xây dựng ứng dụng nhanh hơn và an toàn hơn bằng cách tạo đề xuất và đề xuất mã gần như theo thời gian thực. Các khách hàng như Accenture, Boeing, Bundesliga, The Cigna Group, Kone và Warner Music Group đang sử dụng CodeWhisperer để tăng năng suất của nhà phát triển—và Accenture đang hỗ trợ tới 50,000 nhà phát triển phần mềm và chuyên gia CNTT của họ sử dụng Amazon CodeWhisperer. Chúng tôi muốn càng nhiều nhà phát triển càng tốt có thể nhận được những lợi ích về năng suất của AI tổng quát, đó là lý do tại sao CodeWhisperer đưa ra các đề xuất miễn phí cho tất cả các cá nhân.

Tuy nhiên, trong khi các công cụ mã hóa AI giúp ích rất nhiều cho cuộc sống của các nhà phát triển, lợi ích về năng suất của chúng bị hạn chế do thiếu kiến thức về cơ sở mã nội bộ, API nội bộ, thư viện, gói và lớp. Một cách để nghĩ về điều này là nếu bạn thuê một nhà phát triển mới, ngay cả khi họ đẳng cấp thế giới, họ sẽ không làm việc hiệu quả ở công ty của bạn cho đến khi họ hiểu được các phương pháp và mã tốt nhất của bạn. Các công cụ mã hóa được hỗ trợ bởi AI ngày nay cũng giống như nhà phát triển mới được tuyển dụng. Để trợ giúp việc này, gần đây chúng tôi đã xem trước một khả năng tùy biến trong Amazon CodeWhisperer tận dụng cơ sở mã nội bộ của khách hàng một cách an toàn để cung cấp các đề xuất mã hữu ích và phù hợp hơn. Với khả năng này, CodeWhisperer là chuyên gia về qua một vài thao tác đơn giản về mã và cung cấp các đề xuất phù hợp hơn để tiết kiệm nhiều thời gian hơn. Trong một nghiên cứu chúng tôi thực hiện với Persistent, một công ty hiện đại hóa doanh nghiệp và kỹ thuật số toàn cầu, chúng tôi nhận thấy rằng các tùy chỉnh giúp nhà phát triển hoàn thành nhiệm vụ nhanh hơn tới 28% so với khả năng chung của CodeWhisperer. Giờ đây, nhà phát triển tại một công ty công nghệ chăm sóc sức khỏe có thể yêu cầu CodeWhisperer “nhập hình ảnh MRI được liên kết với ID khách hàng và chạy chúng thông qua bộ phân loại hình ảnh” để phát hiện các điểm bất thường. Vì CodeWhisperer có quyền truy cập vào cơ sở mã nên nó có thể cung cấp nhiều đề xuất phù hợp hơn bao gồm vị trí nhập của hình ảnh MRI và ID khách hàng. CodeWhisperer giữ các tùy chỉnh hoàn toàn riêng tư và FM cơ bản không sử dụng chúng để đào tạo, bảo vệ tài sản trí tuệ có giá trị của khách hàng. AWS là nhà cung cấp đám mây lớn duy nhất cung cấp khả năng như thế này cho mọi người.

Giới thiệu Amazon Q, trợ lý sáng tạo được hỗ trợ bởi AI được thiết kế riêng cho công việc

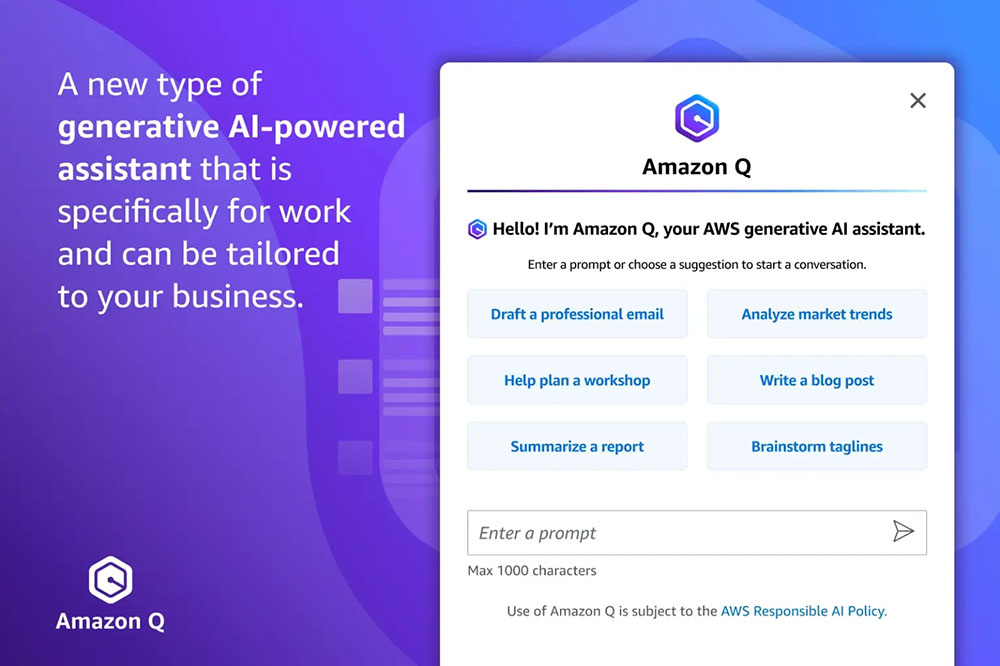

Các nhà phát triển chắc chắn không phải là những người duy nhất bắt tay vào tạo ra AI—hàng triệu người đang sử dụng các ứng dụng trò chuyện AI tạo ra. Những gì các nhà cung cấp ban đầu đã làm trong lĩnh vực này rất thú vị và siêu hữu ích cho người tiêu dùng, nhưng theo nhiều cách, họ không thực sự “làm việc” tại nơi làm việc. Kiến thức và khả năng chung của họ rất tuyệt vời, nhưng họ không biết về công ty, dữ liệu, khách hàng, hoạt động hoặc doanh nghiệp của bạn. Điều đó giới hạn mức độ họ có thể giúp bạn. Họ cũng không biết nhiều về vai trò của bạn—bạn làm công việc gì, bạn làm việc cùng ai, bạn sử dụng thông tin gì và bạn có quyền truy cập vào những gì. Những hạn chế này có thể hiểu được vì những trợ lý này không có quyền truy cập vào thông tin cá nhân của công ty bạn và chúng không được thiết kế để đáp ứng các yêu cầu về quyền riêng tư và bảo mật dữ liệu mà các công ty cần cấp cho họ quyền truy cập này. Thật khó để tăng cường bảo mật sau sự việc và mong đợi nó hoạt động tốt. Chúng tôi nghĩ rằng chúng tôi có một cách tốt hơn, cho phép mọi người trong mọi tổ chức sử dụng AI tổng hợp một cách an toàn trong công việc hàng ngày của họ.

We rất vui được giới thiệu Amazon Q, một loại trợ lý toàn diện mới được hỗ trợ bởi AI dành riêng cho công việc và có thể được điều chỉnh cho phù hợp với doanh nghiệp của bạn. Q có thể giúp bạn nhận được câu trả lời nhanh chóng, phù hợp cho các câu hỏi cấp bách, giải quyết vấn đề, tạo nội dung và thực hiện hành động bằng cách sử dụng dữ liệu và chuyên môn có trong kho thông tin, mã và hệ thống doanh nghiệp của công ty bạn. Khi bạn trò chuyện với Amazon Q, nó sẽ cung cấp thông tin và lời khuyên ngay lập tức, phù hợp để giúp hợp lý hóa các nhiệm vụ, đẩy nhanh quá trình ra quyết định, đồng thời giúp khơi dậy sự sáng tạo và đổi mới trong công việc. Chúng tôi đã xây dựng Amazon Q để đảm bảo an toàn và riêng tư, đồng thời nó có thể hiểu và tôn trọng danh tính, vai trò và quyền hiện có của bạn, đồng thời sử dụng thông tin này để cá nhân hóa các hoạt động tương tác của mình. Nếu người dùng không có quyền truy cập một số dữ liệu nhất định mà không có Q thì họ cũng không thể truy cập dữ liệu đó bằng Q. Chúng tôi đã thiết kế Amazon Q để đáp ứng các yêu cầu nghiêm ngặt của khách hàng doanh nghiệp ngay từ ngày đầu—không có nội dung nào của họ được sử dụng để cải thiện các mô hình cơ bản.

Amazon Q là trợ lý chuyên môn của bạn để xây dựng trên AWS: Chúng tôi đã đào tạo Amazon Q với kiến thức và kinh nghiệm 17 năm về AWS để nó có thể thay đổi cách bạn xây dựng, triển khai và vận hành các ứng dụng cũng như khối lượng công việc trên AWS. Amazon Q có giao diện trò chuyện trong Bảng điều khiển quản lý AWS và tài liệu, IDE của bạn (thông qua CodeWhisperer) và phòng trò chuyện nhóm của bạn trên Slack hoặc các ứng dụng trò chuyện khác. Amazon Q có thể giúp bạn khám phá các khả năng mới của AWS, bắt đầu nhanh hơn, tìm hiểu các công nghệ mới, giải pháp kiến trúc, khắc phục sự cố, nâng cấp, v.v. —đó là chuyên gia về các mẫu kiến trúc tốt, biện pháp thực hành tốt nhất, tài liệu và triển khai giải pháp của AWS. Dưới đây là một số ví dụ về những gì bạn có thể làm với trợ lý chuyên gia AWS mới của mình:

- Nhận câu trả lời và hướng dẫn rõ ràng về khả năng, dịch vụ và giải pháp của AWS: Yêu cầu Amazon Q “Hãy cho tôi biết về Đại lý của Amazon Bedrock” và Q sẽ cung cấp cho bạn mô tả về tính năng cùng với các liên kết đến các tài liệu có liên quan. Bạn cũng có thể hỏi Amazon Q hầu như bất kỳ câu hỏi nào về cách thức hoạt động của dịch vụ AWS (ví dụ: “Giới hạn mở rộng trên bảng DynamoDB là gì?” “Bộ lưu trữ được quản lý Redshift là gì?”) hoặc cách xây dựng kiến trúc tốt nhất cho bất kỳ giải pháp nào ( “Các phương pháp thực hành tốt nhất để xây dựng kiến trúc hướng sự kiện là gì?”). Và Amazon Q sẽ tập hợp các câu trả lời ngắn gọn và luôn trích dẫn (và liên kết tới) các nguồn của nó.

- Chọn dịch vụ AWS tốt nhất cho trường hợp sử dụng của bạn và bắt đầu nhanh chóng: Hỏi Amazon Q “Có những cách nào để xây dựng ứng dụng Web trên AWS? ” và nó sẽ cung cấp danh sách các dịch vụ tiềm năng như Amplify AWS, AWS Lambdavà Amazon EC2 với ưu điểm của từng loại. Từ đó, bạn có thể thu hẹp các tùy chọn bằng cách giúp Q hiểu các yêu cầu, sở thích và ràng buộc của bạn (ví dụ: “Cái nào trong số này sẽ tốt nhất nếu tôi muốn sử dụng vùng chứa?” hoặc “Tôi nên sử dụng cơ sở dữ liệu quan hệ hay phi quan hệ? ”). Kết thúc bằng “Làm cách nào để bắt đầu?” và Amazon Q sẽ phác thảo một số bước cơ bản và hướng dẫn bạn các tài nguyên bổ sung.

- Tối ưu hóa tài nguyên máy tính của bạn: Amazon Q có thể giúp bạn chọn phiên bản Amazon EC2. Nếu bạn yêu cầu “Giúp tôi tìm phiên bản EC2 phù hợp để triển khai khối lượng công việc mã hóa video cho ứng dụng trò chơi của tôi với hiệu suất cao nhất”, Q sẽ cung cấp cho bạn danh sách các dòng phiên bản kèm theo lý do cho mỗi đề xuất. Ngoài ra, bạn có thể hỏi bất kỳ số lượng câu hỏi tiếp theo nào để giúp tìm ra lựa chọn tốt nhất cho khối lượng công việc của mình.

- Nhận hỗ trợ gỡ lỗi, kiểm tra và tối ưu hóa mã của bạn: Nếu gặp lỗi khi mã hóa trong IDE, bạn có thể yêu cầu Amazon Q trợ giúp bằng cách nói: “Mã của tôi có lỗi IO, bạn có thể đưa ra cách khắc phục không?” và Q sẽ tạo mã cho bạn. Nếu thích đề xuất này, bạn có thể yêu cầu Amazon Q thêm bản sửa lỗi vào ứng dụng của mình. Vì Amazon Q nằm trong IDE của bạn nên nó hiểu mã bạn đang làm việc và biết nơi cần chèn bản sửa lỗi. Amazon Q cũng có thể tạo các bài kiểm thử đơn vị (“Viết bài kiểm thử đơn vị cho hàm đã chọn”) mà nó có thể chèn vào mã của bạn và bạn có thể chạy. Cuối cùng, Amazon Q có thể cho bạn biết cách tối ưu hóa mã để có hiệu suất cao hơn. Yêu cầu Q “Tối ưu hóa truy vấn DynamoDB đã chọn của tôi” và Q sẽ sử dụng sự hiểu biết về mã của bạn để đưa ra đề xuất ngôn ngữ tự nhiên về những gì cần khắc phục cùng với mã đi kèm mà bạn có thể triển khai chỉ bằng một cú nhấp chuột.

- Chẩn đoán và khắc phục sự cố: Nếu bạn gặp sự cố trong Bảng điều khiển quản lý AWS, chẳng hạn như lỗi quyền EC2 hoặc lỗi cấu hình Amazon S3, bạn chỉ cần nhấn nút “Khắc phục sự cố với Amazon Q” và nó sẽ sử dụng hiểu biết của mình về loại lỗi và dịch vụ nơi xảy ra lỗi để cho bạn gợi ý cách khắc phục. Bạn thậm chí có thể yêu cầu Amazon Q khắc phục sự cố mạng của mình (ví dụ: “Tại sao tôi không thể kết nối với phiên bản EC2 của mình bằng SSH?”) và Q sẽ phân tích cấu hình hai đầu của bạn và đưa ra chẩn đoán (ví dụ: “Phiên bản này dường như nằm trong một mạng con riêng tư, do đó khả năng truy cập công cộng có thể cần phải được thiết lập”).

- Tăng cường cơ sở mã mới ngay lập tức: Khi bạn trò chuyện với Amazon Q trong IDE, nó sẽ kết hợp chuyên môn của mình trong việc xây dựng phần mềm với hiểu biết về mã của bạn—một sự kết hợp mạnh mẽ! Trước đây, nếu bạn tiếp quản một dự án từ người khác hoặc bạn là người mới gia nhập nhóm, bạn có thể phải dành hàng giờ để xem lại mã và tài liệu theo cách thủ công để hiểu cách thức hoạt động và chức năng của nó. Bây giờ, vì Amazon Q hiểu mã trong IDE của bạn nên bạn chỉ cần yêu cầu Amazon Q giải thích mã (“Cung cấp cho tôi mô tả về chức năng và cách thức hoạt động của ứng dụng này”) và Q sẽ cung cấp cho bạn thông tin chi tiết như những dịch vụ nào bạn đang sử dụng. cách sử dụng mã và chức năng của các chức năng khác nhau (ví dụ: Q có thể trả lời bằng những câu như "Ứng dụng này đang xây dựng một hệ thống phiếu hỗ trợ cơ bản bằng cách sử dụng Python Flask và AWS Lambda" và tiếp tục mô tả từng khả năng cốt lõi của nó, cách chúng được triển khai, và nhiều hơn nữa).

- Xóa tồn đọng tính năng của bạn nhanh hơn: Bạn thậm chí có thể yêu cầu Amazon Q hướng dẫn bạn và tự động hóa phần lớn quy trình từ đầu đến cuối để thêm tính năng vào ứng dụng của bạn trong Amazon CodeCatalyst, dịch vụ phát triển phần mềm hợp nhất của chúng tôi dành cho các nhóm. Để thực hiện việc này, bạn chỉ cần giao cho Q một nhiệm vụ tồn đọng từ danh sách vấn đề của mình – giống như bạn làm với đồng đội – và Q tạo kế hoạch từng bước về cách xây dựng và triển khai tính năng này. Sau khi bạn phê duyệt kế hoạch, Q sẽ viết mã và trình bày các thay đổi được đề xuất cho bạn dưới dạng đánh giá mã. Bạn có thể yêu cầu làm lại (nếu cần), phê duyệt và/hoặc triển khai!

- Nâng cấp mã của bạn trong một khoảng thời gian ngắn: Hầu hết các nhà phát triển thực sự chỉ dành một phần thời gian để viết mã mới và xây dựng các ứng dụng mới. Họ dành nhiều thời gian hơn trong chu kỳ của mình cho những lĩnh vực khó khăn, khó khăn như bảo trì và nâng cấp. Hãy nâng cấp phiên bản ngôn ngữ. Một số lượng lớn khách hàng tiếp tục sử dụng các phiên bản Java cũ hơn vì sẽ mất nhiều tháng—thậm chí nhiều năm—và hàng nghìn giờ dành cho nhà phát triển để nâng cấp. Việc trì hoãn việc này sẽ gây ra chi phí và rủi ro thực sự—bạn bỏ lỡ cơ hội cải thiện hiệu suất và dễ gặp phải các vấn đề bảo mật. Chúng tôi cho rằng Amazon Q có thể là nhân tố thay đổi cuộc chơi ở đây và rất vui mừng về Chuyển đổi mã Q của Amazon, một tính năng có thể loại bỏ rất nhiều công việc nặng nhọc này và giảm thời gian nâng cấp ứng dụng từ vài ngày xuống còn vài phút. Bạn chỉ cần mở mã bạn muốn cập nhật trong IDE và yêu cầu Amazon Q “/transform” mã của bạn. Amazon Q sẽ phân tích toàn bộ mã nguồn của ứng dụng, tạo mã bằng ngôn ngữ và phiên bản đích, đồng thời thực hiện kiểm tra, giúp bạn nhận ra các cải tiến về bảo mật và hiệu suất của các phiên bản ngôn ngữ mới nhất. Gần đây, một nhóm rất nhỏ các nhà phát triển Amazon đã sử dụng Amazon Q Code Transformation để nâng cấp 1,000 ứng dụng sản xuất từ Java 8 lên Java 17 chỉ trong hai ngày. Thời gian trung bình cho mỗi ứng dụng là dưới 10 phút. Hôm nay, Amazon Q Code Transformation thực hiện nâng cấp ngôn ngữ Java từ Java 8 hoặc Java 11 lên Java 17. Tiếp theo (và sẽ sớm) là khả năng chuyển đổi .NET Framework sang .NET đa nền tảng (thậm chí còn có nhiều chuyển đổi hơn nữa trong tương lai) .

Amazon Q là chuyên gia kinh doanh của bạn: Bạn có thể kết nối Amazon Q với dữ liệu, thông tin và hệ thống kinh doanh của mình để nó có thể tổng hợp mọi thứ và cung cấp hỗ trợ phù hợp nhằm giúp mọi người giải quyết vấn đề, tạo nội dung và thực hiện các hành động liên quan đến doanh nghiệp của bạn. Đưa Amazon Q vào doanh nghiệp của bạn thật dễ dàng. Nó có hơn 40 trình kết nối tích hợp với các hệ thống doanh nghiệp phổ biến như Amazon S3, Microsoft 365, Salesforce, ServiceNow, Slack, Atlassian, Gmail, Google Drive và Zendesk. Nó cũng có thể kết nối với mạng nội bộ nội bộ, wiki và chạy sách của bạn và với Amazon Q SDK, bạn có thể tạo kết nối với bất kỳ ứng dụng nội bộ nào bạn muốn. Hướng Amazon Q vào các kho lưu trữ này và nó sẽ “tăng cường” hoạt động kinh doanh của bạn, nắm bắt và hiểu thông tin ngữ nghĩa khiến công ty của bạn trở nên độc đáo. Sau đó, bạn sẽ có được ứng dụng web Amazon Q đơn giản và thân thiện của riêng mình để nhân viên trong công ty của bạn có thể tương tác với giao diện đàm thoại. Amazon Q cũng kết nối với nhà cung cấp danh tính của bạn để hiểu người dùng, vai trò của họ và những hệ thống họ được phép truy cập để người dùng có thể đặt câu hỏi chi tiết, đa sắc thái và nhận được kết quả phù hợp chỉ bao gồm thông tin mà họ được phép xem. Amazon Q tạo ra các câu trả lời và thông tin chuyên sâu chính xác và trung thực với tài liệu cũng như kiến thức mà bạn cung cấp, đồng thời bạn có thể hạn chế các chủ đề nhạy cảm, chặn từ khóa hoặc lọc ra các câu hỏi và câu trả lời không phù hợp. Dưới đây là một số ví dụ về những gì bạn có thể làm với trợ lý chuyên gia mới của doanh nghiệp mình:

- Nhận câu trả lời rõ ràng, siêu phù hợp dựa trên dữ liệu và thông tin doanh nghiệp của bạn: Nhân viên có thể hỏi Amazon Q về bất cứ điều gì trước đây họ có thể phải tìm kiếm trên tất cả các loại nguồn. Hỏi “Các nguyên tắc mới nhất về sử dụng logo là gì?” hoặc “Làm cách nào để đăng ký thẻ tín dụng công ty?” và Amazon Q sẽ tổng hợp tất cả nội dung có liên quan mà nó tìm thấy và quay lại với các câu trả lời nhanh cùng với các liên kết đến các liên kết có liên quan. nguồn (ví dụ: cổng thương hiệu và kho lưu trữ logo, chính sách T&E của công ty và ứng dụng thẻ).

- Hợp lý hóa thông tin liên lạc hàng ngày: Chỉ cần yêu cầu và Amazon Q có thể tạo nội dung (“Tạo một bài đăng blog và ba tiêu đề trên mạng xã hội công bố sản phẩm được mô tả trong tài liệu này”), tạo bản tóm tắt điều hành (“Viết bản tóm tắt bản ghi cuộc họp của chúng tôi với danh sách các mục hành động có dấu đầu dòng” ), cung cấp thông tin cập nhật qua email (“Dự thảo email nêu bật các chương trình đào tạo quý 3 của chúng tôi dành cho khách hàng ở Ấn Độ”) và giúp tổ chức các cuộc họp (“Tạo chương trình cuộc họp để nói về báo cáo mới nhất về mức độ hài lòng của khách hàng”).

- Hoàn thành nhiệm vụ: Amazon Q có thể giúp hoàn thành một số nhiệm vụ nhất định, giảm lượng thời gian nhân viên dành cho những công việc lặp đi lặp lại như nộp phiếu yêu cầu. Yêu cầu Amazon Q “Tóm tắt phản hồi của khách hàng về ưu đãi giá mới trong Slack”, sau đó yêu cầu Q lấy thông tin đó và mở một yêu cầu trong Jira để cập nhật cho nhóm tiếp thị. Bạn có thể yêu cầu Q “Tóm tắt bản ghi cuộc gọi này” rồi “Mở một trường hợp mới cho Khách hàng A trong Salesforce”. Amazon Q hỗ trợ các công cụ tự động hóa công việc phổ biến khác như Zendesk và Service Now.

Amazon Q có trong Amazon QuickSight: Với Amazon Q trong QuickSight, dịch vụ thông tin kinh doanh của AWS, người dùng có thể đặt câu hỏi trên bảng thông tin của mình như “Tại sao số lượng đơn đặt hàng lại tăng vào tháng trước?” và nhận được hình ảnh trực quan cũng như giải thích về các yếu tố ảnh hưởng đến sự gia tăng. Và, các nhà phân tích có thể sử dụng Amazon Q để giảm thời gian xây dựng bảng thông tin từ vài ngày xuống còn vài phút với lời nhắc đơn giản như “Hiển thị cho tôi doanh số bán hàng theo khu vực theo tháng dưới dạng biểu đồ thanh xếp chồng”. Q quay lại ngay với sơ đồ đó và bạn có thể dễ dàng thêm nó vào trang tổng quan hoặc trò chuyện thêm với Q để tinh chỉnh trực quan hóa (ví dụ: “Thay đổi biểu đồ thanh thành sơ đồ Sankey” hoặc “Hiển thị các quốc gia thay vì khu vực”). Amazon Q trong QuickSight cũng giúp việc sử dụng bảng thông tin hiện có dễ dàng hơn để thông báo cho các bên liên quan trong kinh doanh, chắt lọc những hiểu biết quan trọng và đơn giản hóa việc ra quyết định bằng câu chuyện dữ liệu. Ví dụ: người dùng có thể nhắc Amazon Q “Xây dựng một câu chuyện về cách doanh nghiệp đã thay đổi trong tháng qua để đánh giá doanh nghiệp với lãnh đạo cấp cao” và trong vài giây, Amazon Q sẽ truyền tải một câu chuyện dựa trên dữ liệu hấp dẫn về mặt hình ảnh và hoàn toàn có thể tùy chỉnh. Những câu chuyện này có thể được chia sẻ một cách an toàn trong toàn tổ chức để giúp gắn kết các bên liên quan và đưa ra các quyết định tốt hơn.

Amazon Q có trong Amazon Connect: Trong Amazon Connect, dịch vụ trung tâm liên hệ của chúng tôi, Amazon Q giúp các đại lý dịch vụ khách hàng của bạn cung cấp dịch vụ khách hàng tốt hơn. Amazon Q tận dụng kho kiến thức mà các đại lý của bạn thường sử dụng để lấy thông tin cho khách hàng, sau đó các tổng đài viên có thể trò chuyện trực tiếp với Amazon Q trong Connect để nhận được câu trả lời giúp họ phản hồi nhanh hơn các yêu cầu của khách hàng mà không cần phải tự tìm kiếm trong tài liệu. Và mặc dù trò chuyện với Amazon Q để có câu trả lời siêu nhanh là điều tuyệt vời nhưng trong dịch vụ khách hàng không có gì gọi là quá nhanh. Đó là lý do tại sao Amazon Q Trong Kết nối biến cuộc trò chuyện trực tiếp của khách hàng với nhân viên hỗ trợ thành lời nhắc và tự động cung cấp cho nhân viên các câu trả lời có thể có, hành động được đề xuất và liên kết đến tài nguyên. Ví dụ: Amazon Q có thể phát hiện khách hàng đang liên hệ với công ty cho thuê ô tô để thay đổi đặt chỗ của họ, tạo phản hồi cho đại lý để nhanh chóng thông báo cách áp dụng chính sách phí thay đổi của công ty và hướng dẫn đại lý các bước họ cần cập nhật sự đặt chỗ.

Amazon Q nằm trong Chuỗi cung ứng AWS (Sắp ra mắt): Trong Chuỗi cung ứng AWS, dịch vụ hiểu biết sâu sắc về chuỗi cung ứng của chúng tôi, Amazon Q giúp các nhà lập kế hoạch cung và cầu, người quản lý hàng tồn kho và đối tác thương mại tối ưu hóa chuỗi cung ứng của họ bằng cách tóm tắt và nêu bật các rủi ro tiềm ẩn về tồn kho hoặc tồn kho quá mức cũng như trực quan hóa các kịch bản để giải quyết vấn đề. Người dùng có thể hỏi Amazon Q các câu hỏi “cái gì”, “tại sao” và “điều gì xảy ra nếu” về dữ liệu chuỗi cung ứng của họ và trò chuyện thông qua các tình huống phức tạp cũng như sự cân bằng giữa các quyết định khác nhau trong chuỗi cung ứng. Ví dụ: một khách hàng có thể hỏi: “Điều gì gây ra sự chậm trễ trong lô hàng của tôi và làm cách nào để tôi có thể đẩy nhanh tiến độ?” mà Amazon Q có thể trả lời, “90% đơn đặt hàng của bạn là ở bờ biển phía đông và một cơn bão lớn ở Đông Nam Bộ đang gây ra sự chậm trễ 24 giờ. Nếu bạn gửi hàng đến cảng New York thay vì Miami, bạn sẽ đẩy nhanh việc giao hàng và giảm 50% chi phí.”

Khách hàng của chúng tôi đang nhanh chóng áp dụng AI tạo mới—họ đang đào tạo các mô hình đột phá trên AWS, họ đang phát triển các ứng dụng AI tạo tạo với tốc độ kỷ lục bằng cách sử dụng Amazon Bedrock và họ đang triển khai các ứng dụng thay đổi cuộc chơi trong các tổ chức của mình như Amazon Q. Với những thông báo mới nhất của chúng tôi, AWS đang mang đến cho khách hàng nhiều hiệu suất, sự lựa chọn và sự đổi mới hơn nữa cho mọi lớp của hệ thống. Tác động tổng hợp của tất cả các khả năng mà chúng tôi đang cung cấp tại re:Invent đánh dấu một cột mốc quan trọng hướng tới việc đạt được mục tiêu thú vị và có ý nghĩa: Chúng tôi đang làm cho AI có thể tạo ra có thể tiếp cận được với khách hàng ở mọi quy mô và khả năng kỹ thuật để họ có thể phát minh lại và biến đổi những gì có khả năng.

Thông tin

Lưu ý

Swami Sivasubramanian là Phó chủ tịch về Dữ liệu và Máy học tại AWS. Với vai trò này, Swami giám sát tất cả các dịch vụ Cơ sở dữ liệu AWS, Phân tích và AI & Học máy. Nhiệm vụ của nhóm của anh ấy là giúp các tổ chức đưa dữ liệu của họ hoạt động với một giải pháp dữ liệu đầu cuối, hoàn chỉnh để lưu trữ, truy cập, phân tích và trực quan hóa cũng như dự đoán.

Swami Sivasubramanian là Phó chủ tịch về Dữ liệu và Máy học tại AWS. Với vai trò này, Swami giám sát tất cả các dịch vụ Cơ sở dữ liệu AWS, Phân tích và AI & Học máy. Nhiệm vụ của nhóm của anh ấy là giúp các tổ chức đưa dữ liệu của họ hoạt động với một giải pháp dữ liệu đầu cuối, hoàn chỉnh để lưu trữ, truy cập, phân tích và trực quan hóa cũng như dự đoán.

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- PlatoData.Network Vertical Generative Ai. Trao quyền cho chính mình. Truy cập Tại đây.

- PlatoAiStream. Thông minh Web3. Kiến thức khuếch đại. Truy cập Tại đây.

- Trung tâmESG. Than đá, công nghệ sạch, Năng lượng, Môi trường Hệ mặt trời, Quản lý chất thải. Truy cập Tại đây.

- PlatoSức khỏe. Tình báo thử nghiệm lâm sàng và công nghệ sinh học. Truy cập Tại đây.

- nguồn: https://aws.amazon.com/blogs/machine-learning/welcome-to-a-new-era-of-building-in-the-cloud-with-generative-ai-on-aws/

- : có

- :là

- :không phải

- :Ở đâu

- $ LÊN

- 000

- 1

- 10

- 100

- 11

- 12

- 17

- 200

- 2019

- 2024

- 25

- 30

- 35%

- 40

- 50

- 500

- 7

- 8

- 9

- a

- khả năng

- có khả năng

- Có khả năng

- Giới thiệu

- ở trên

- đẩy nhanh tiến độ

- tăng tốc

- máy gia tốc

- Accenture

- truy cập

- khả năng tiếp cận

- có thể truy cập

- Kế toán

- chính xác

- chính xác

- có được

- ngang qua

- Hoạt động

- hành động

- tích cực

- thực sự

- thích ứng

- thêm vào

- thêm

- thêm

- Ngoài ra

- thêm vào

- Ngoài ra

- bổ sung

- Thêm

- Adidas

- Adobe

- Nhận nuôi

- tiên tiến

- thăng tiến

- Lợi thế

- lợi thế

- Quảng cáo

- tư vấn

- Sau

- chống lại

- chương trình nghị sự

- Đại lý

- đại lý

- tổng hợp

- cách đây

- AI

- AI & Máy học

- Chatbot AI

- ai nghiên cứu

- Hỗ trợ AI

- sắp xếp

- Tất cả

- cho phép

- cho phép

- dọc theo

- Đã

- Ngoài ra

- luôn luôn

- đàn bà gan dạ

- Mã Amazon

- Amazon EC2

- Dịch vụ Tìm kiếm Mở của Amazon

- Amazon QuickSight

- Amazon SageMaker

- Amazon Web Services

- số lượng

- số lượng

- an

- phân tích

- phân tích

- Các nhà phân tích

- phân tích

- phân tích

- phân tích

- và

- Thông báo

- Thông báo

- Thông báo

- bất thường

- trả lời

- câu trả lời

- nhân loại

- bất kì

- bất kỳ ai

- bất cứ điều gì

- api

- API

- ứng dụng

- xuất hiện

- Các Ứng Dụng

- các ứng dụng

- Đăng Nhập

- đánh giá cao

- phương pháp tiếp cận

- phê duyệt

- phê duyệt

- ứng dụng

- Tháng Tư

- LÀ

- KHU VỰC

- khu vực

- được cho là

- xung quanh

- AS

- xin

- Hỗ trợ

- Trợ lý

- trợ lý

- liên kết

- liên kết

- At

- tăng

- tăng cường

- gia tăng

- Rạng đông

- ủy quyền

- tự động hóa

- tự động hóa

- Tự động

- tự động

- Tự động hóa

- ô tô

- sẵn có

- có sẵn

- Trung bình cộng

- tránh

- xa

- AWS

- Suy luận AWS

- AWS Lambda

- Bảng điều khiển quản lý AWS

- trở lại

- Ngân hàng

- thanh

- rào cản

- cơ sở

- dựa

- cơ bản

- BE

- bởi vì

- trở thành

- được

- bắt đầu

- Tin

- Lợi ích

- BEST

- thực hành tốt nhất

- Hơn

- giữa

- lớn

- Tỷ

- tỷ

- Chặn

- Khối

- Blog

- Boeing

- Bolt

- đặt phòng

- Booking.com

- Sách

- cả hai

- đáy

- ranh giới

- thương hiệu

- Nghỉ giải lao

- nghỉ giải lao

- mang lại

- Đưa

- xây dựng

- Xây dựng

- xây dựng

- xây dựng

- được xây dựng trong

- kinh doanh

- kinh doanh thông minh

- các doanh nghiệp

- nhưng

- nút

- by

- cuộc gọi

- Trung tâm cuộc gọi

- CAN

- Có thể có được

- khả năng

- khả năng

- có khả năng

- Sức chứa

- Chụp

- xe hơi

- carbon

- lượng khí thải carbon

- thẻ

- cẩn thận

- trường hợp

- trường hợp

- đố

- gây ra

- Trung tâm

- nhất định

- chắc chắn

- chuỗi

- thách thức

- thách thức

- thay đổi

- thay đổi

- Changer

- Những thay đổi

- thay đổi

- đặc điểm

- Biểu đồ

- Bảng xếp hạng

- các phòng chat

- chatbot

- chatbot

- tán gẫu

- kiểm tra

- Chip

- Snacks

- sự lựa chọn

- Chọn

- lựa chọn

- lựa chọn

- tuyên bố

- các lớp học

- Làm sạch

- trong sáng

- Nhấp chuột

- đám mây

- cơ sở hạ tầng đám mây

- cụm

- tập hợp

- Coast

- mã

- cơ sở mã

- Đánh giá mã

- Lập trình

- hợp tác

- hợp tác

- COM

- kết hợp

- kết hợp

- kết hợp

- kết hợp

- Đến

- đến

- đến

- Sắp Ra Mắt

- giao tiếp

- Truyền thông

- Các công ty

- công ty

- Của công ty

- so

- thuyết phục

- hoàn thành

- hoàn toàn

- phức tạp

- phức tạp

- toàn diện

- Tính

- khái niệm

- Cấu hình

- cấu hình

- phỏng đoán

- Kết nối

- kết nối

- liên quan

- Kết nối

- connect

- thích hợp

- An ủi

- khó khăn

- Người tiêu dùng

- tiêu thụ

- liên lạc

- trung tâm liên lạc

- Container

- nội dung

- Tạo nội dung

- bối cảnh

- theo ngữ cảnh

- tiếp tục

- tiếp tục

- liên tiếp

- tiếp tục

- điều khiển

- điều khiển

- Conversation

- đàm thoại

- cuộc hội thoại

- quyền tác giả

- copywriting

- Trung tâm

- Phí Tổn

- chi phí-hiệu quả

- Chi phí

- nước

- Thuyền trưởng

- tạo

- tạo ra

- sáng tạo

- người sáng tạo

- tín dụng

- thẻ tín dụng

- Tội phạm

- CRM

- khách hàng

- kinh nghiệm khach hang

- Sự hài lòng của khách hàng

- Dịch Vụ CSKH

- khách hàng

- tùy biến

- tùy biến

- tùy chỉnh

- tùy chỉnh

- Cắt

- chu kỳ

- tiền thưởng

- bảng điều khiển

- trang tổng quan

- dữ liệu

- Chuẩn bị dữ liệu

- dữ liệu riêng tư

- Bảo mật và bảo mật dữ liệu

- bộ dữ liệu

- hướng dữ liệu

- Cơ sở dữ liệu

- cơ sở dữ liệu

- ngày

- ngày qua ngày

- Ngày

- Ra quyết định

- quyết định

- sâu

- học kĩ càng

- sâu sắc hơn

- các định nghĩa

- Bằng cấp

- chậm trễ

- cung cấp

- Giao hàng

- phân phối

- cung cấp

- Nhu cầu

- Dân chủ hóa

- Tùy

- triển khai

- triển khai

- triển khai

- triển khai

- chiều sâu

- mô tả

- mô tả

- Mô tả

- thiết kế

- mong muốn

- chi tiết

- chi tiết

- phát hiện

- Xác định

- THIẾT BỊ VIỄN THÔNG

- Nhà phát triển

- phát triển

- phát triển

- Phát triển

- chẩn đoán

- Đối thoại

- Đối thoại

- ĐÃ LÀM

- khác nhau

- Lôi thôi

- kỹ thuật số

- trực tiếp

- phân phát

- phân phối

- đào tạo phân tán

- phân phối

- do

- tài liệu

- tài liệu hướng dẫn

- tài liệu

- làm

- Không

- làm

- thực hiện

- dont

- tăng gấp đôi

- xuống

- lái xe

- hai

- bản sao

- thời gian

- e

- thương mại điện tử

- mỗi

- Đầu

- dễ dàng hơn

- dễ dàng

- Đông

- dễ dàng

- Kinh tế

- phiên bản

- hiệu quả

- hiệu quả

- hiệu quả

- nỗ lực

- hay

- khác

- Phát thải

- nhân viên

- trao quyền

- nâng cao vị thế

- cho phép

- cho phép

- mã hóa

- cuối

- Cuối cùng đến cuối

- năng lượng

- Tiêu thụ năng lượng

- ky sư

- Kỹ Sư

- nâng cao

- cải tiến

- làm giàu

- Doanh nghiệp

- cấp doanh nghiệp

- doanh nghiệp

- Giải trí

- Toàn bộ

- phong bì

- Kỷ nguyên

- ERP

- lôi

- lỗi

- đánh giá

- Ngay cả

- sự kiện

- BAO GIỜ

- Mỗi

- mọi người

- tất cả mọi thứ

- sự tiến hóa

- phát triển

- ví dụ

- ví dụ

- kích thích

- thú vị

- thi hành

- điều hành

- hiện tại

- mở rộng

- mong đợi

- giục

- đắt tiền

- kinh nghiệm

- kinh nghiệm

- Kinh nghiệm

- chuyên gia

- chuyên môn

- Giải thích

- khám phá

- thể hiện

- vải

- Đối mặt

- thực tế

- các yếu tố

- khá

- trung thành

- Rơi

- quen

- gia đình

- gia đình

- NHANH

- nhanh hơn

- bị lỗi

- Đặc tính

- Tính năng

- chi phí

- thông tin phản hồi

- vài

- Nộp hồ sơ

- lọc

- Cuối cùng

- tài chính

- Tìm kiếm

- tìm kiếm

- tìm thấy

- cuối

- hoàn thành

- Tên

- Sửa chữa

- linh hoạt

- tập trung

- theo

- Trong

- Dành cho người tiêu dùng

- Forward

- tìm thấy

- Nền tảng

- 4

- phân số

- Khung

- khung

- Miễn phí

- thường xuyên

- thân thiện

- từ

- chức năng

- xa hơn

- tương lai

- trò chơi

- thay đổi cuộc chơi

- chơi game

- Tổng Quát

- nói chung

- tạo ra

- tạo

- tạo ra

- thế hệ

- thế hệ

- Trí tuệ nhân tạo

- máy phát điện

- được

- nhận được

- Cho

- Toàn cầu

- kỹ thuật số toàn cầu

- Go

- mục tiêu

- đi

- tốt

- GPU

- GPU

- tuyệt vời

- Mặt đất

- đột phá

- Nhóm

- Phát triển

- mới lớn

- hướng dẫn

- hướng dẫn

- hướng dẫn

- có

- Tay bài

- Xảy ra

- Cứng

- phần cứng

- có hại

- ghét

- Có

- có

- Tiêu đề

- chăm sóc sức khỏe

- nặng

- nâng nặng

- giúp đỡ

- giúp đỡ

- giúp

- tại đây

- Cao

- cao hơn

- cao nhất

- làm nổi bật

- cao

- Thuê

- của mình

- lưu trữ

- GIỜ LÀM VIỆC

- Độ đáng tin của

- Hướng dẫn

- Tuy nhiên

- HTTPS

- Hàng trăm

- i

- ID

- danh tính

- Bản sắc

- id

- if

- hình ảnh

- hình ảnh

- lập tức

- Va chạm

- thực hiện

- triển khai

- thực hiện

- nhập khẩu

- quan trọng

- ấn tượng

- nâng cao

- cải thiện

- cải tiến

- in

- bao gồm

- bao gồm

- Bao gồm

- Tăng lên

- tăng

- tăng

- Các chỉ số

- các cá nhân

- các ngành công nghiệp

- ngành công nghiệp

- đầu ngành

- bị ảnh hưởng

- Thông tin

- báo

- thông tin

- Cơ sở hạ tầng

- đổi mới

- đổi mới

- sự đổi mới

- đổi mới

- sáng tạo

- đầu vào

- đầu vào

- cái nhìn sâu sắc

- những hiểu biết

- ví dụ

- thay vì

- Viện

- hướng dẫn

- bảo hiểm

- hội nhập

- trí tuệ

- sở hữu trí tuệ

- Sự thông minh

- dự định

- tương tác

- tương tác

- tương tác

- kết nối với nhau

- Giao thức

- nội bộ

- can thiệp

- trong

- giới thiệu

- giới thiệu

- giới thiệu

- Phát minh

- hàng tồn kho

- Đầu tư

- điều tra

- đầu tư

- đầu tư

- Đầu Tư

- tham gia

- các vấn đề

- IT

- ITS

- Tiếng Nhật

- biệt ngữ

- Java

- jpg

- chỉ

- chỉ một

- Giữ

- giữ

- giữ

- Key

- Những vùng trọng điểm

- từ khóa

- Bộ công cụ (SDK)

- Biết

- kiến thức

- biết

- Phòng thí nghiệm

- Thiếu sót

- Ngôn ngữ

- lớn

- quy mô lớn

- lớn nhất

- Họ

- Năm ngoái

- Trễ, muộn

- Độ trễ

- mới nhất

- phát động

- ra mắt

- luật sư

- lớp

- lớp

- Lãnh đạo

- hàng đầu

- LEARN

- học

- học tập

- Hợp pháp

- ít

- cho phép

- Cấp

- Tỉ lệ đòn bẩy

- đòn bẩy

- Lexis Nexis

- LG

- thư viện

- vòng đời

- nâng

- Lượt thích

- Có khả năng

- hạn chế

- Hạn chế

- giới hạn

- dòng

- LINK

- liên kết

- Danh sách

- sống

- cuộc sống

- Loài đà mã ở nam mỹ

- LLM

- nằm

- . Các địa điểm

- hợp lý

- Logo

- dài

- lâu đời

- Rất nhiều

- yêu

- Thấp

- thấp hơn

- thấp nhất

- máy

- học máy

- thực hiện

- duy trì

- Duy trì

- bảo trì

- chính

- làm cho

- LÀM CHO

- Làm

- quản lý

- quản lý

- Quản lý

- nhãn hiệu

- công việc thủ công

- thủ công

- nhiều

- Marketing

- vật liệu

- nguyên vật liệu

- tối đa

- Có thể..

- me

- có ý nghĩa

- có nghĩa

- Phương tiện truyền thông

- Gặp gỡ

- cuộc họp

- các cuộc họp

- Đạt

- Các thành viên

- bộ ba

- Siêu dữ liệu

- phương pháp

- Miami

- microsoft

- Tên đệm

- Might

- sự kiện quan trọng

- Phút

- bỏ lỡ

- Sứ mệnh

- ML

- kiểu mẫu

- người mẫu

- mô hình

- Momentum

- MongoDB

- màn hình

- tháng

- tháng

- chi tiết

- hầu hết

- Phổ biến nhất

- di chuyển

- MRI

- nhiều

- nhiều

- Âm nhạc

- phải

- my

- tên

- hẹp

- Nasdaq

- Tự nhiên

- Gần

- cần thiết

- Cần

- cần thiết

- cần

- net

- mạng

- mạng lưới

- Mới

- Newyork

- mới

- tiếp theo

- Nitro

- Không

- tại

- con số

- Nvidia

- of

- off

- phản cảm

- cung cấp

- cung cấp

- Cung cấp

- thường

- cũ

- on

- hàng loạt

- ONE

- những

- Trực tuyến

- ngân hàng trực tuyến

- có thể

- mở

- hoạt động

- Hoạt động

- Tối ưu hóa

- tối ưu hóa

- tối ưu hóa

- Các lựa chọn

- or

- đơn đặt hàng

- cơ quan

- tổ chức

- nguyên

- Nền tảng khác

- Khác

- vfoXNUMXfipXNUMXhfpiXNUMXufhpiXNUMXuf

- ra

- đề cương

- đầu ra

- kết quả đầu ra

- kết thúc

- Overstock

- áp đảo

- riêng

- Hòa bình

- gói

- đau đớn

- cặp

- tham số

- thông số

- một phần

- Đối tác

- các bộ phận

- qua

- mô hình

- tạm dừng

- người

- mỗi

- Thực hiện

- hiệu suất

- thực hiện

- thực hiện

- cho phép

- quyền

- người

- cá nhân

- cá nhân

- Cá nhân

- Tham quan PGA

- cụm từ

- Nơi

- kế hoạch

- plato

- Thông tin dữ liệu Plato

- PlatoDữ liệu

- thêm

- Điểm

- Chính sách

- Phổ biến

- tích cực

- có thể

- Bài đăng

- tiềm năng

- quyền lực

- -

- mạnh mẽ

- Thực tế

- thực tế

- thực hành

- cần

- dự đoán

- Dự đoán

- ưu đãi

- chuẩn bị

- Chuẩn bị

- trình bày

- Chủ tịch

- nhấn

- nhấn

- Xem trước

- trước đây

- giá

- giá

- chính

- riêng tư

- Bảo mật và An ninh

- riêng

- thông tin cá nhân

- Vấn đề

- vấn đề

- quá trình

- Quy trình

- xử lý

- sản xuất

- Sản phẩm

- Sản lượng

- sản xuất

- năng suất

- chuyên nghiệp

- chuyên gia

- Khóa Học

- dự án

- nhắc nhở

- tài sản

- độc quyền

- bảo vệ

- bảo vệ

- cho

- nhà cung cấp dịch vụ

- nhà cung cấp

- cung cấp

- cung cấp

- công khai

- công khai

- mục đích

- Đẩy

- Đẩy

- đặt

- Đặt

- Python

- ngọn đuốc

- Q3

- định lượng

- câu hỏi

- Câu hỏi

- Nhanh chóng

- Mau

- khá

- R & D

- phạm vi

- nhanh

- nhanh chóng

- Giá

- RE

- Reading

- thực

- thời gian thực

- thực tế

- nhận ra

- nhận ra

- có thật không

- Chiêu quân

- lý do

- gần đây

- Khuyến nghị

- khuyến nghị

- ghi

- giảm

- Giảm

- giảm

- lọc

- khu

- phát hành

- có liên quan

- độ tin cậy

- vẫn còn

- tẩy

- loại bỏ

- sửa chữa

- lặp đi lặp lại

- thay thế

- trả lời

- báo cáo

- kho

- yêu cầu

- yêu cầu

- cần phải

- Yêu cầu

- nghiên cứu

- đặt phòng

- Dự trữ

- Độ phân giải

- cộng hưởng

- Thông tin

- tôn trọng

- Trả lời

- đáp ứng

- phản ứng

- phản ứng

- chịu trách nhiệm

- hạn chế

- hạn chế

- kết quả

- Kết quả

- trở về

- xem xét

- xem xét

- ngay

- rủi ro

- Vai trò

- vai trò

- phòng

- tuyến đường

- Quy tắc

- chạy

- chạy

- đường băng

- hy sinh

- an toàn

- biện pháp bảo vệ

- một cách an toàn

- nhà làm hiền triết

- bán hàng

- lực lượng bán hàng

- tương tự

- sự hài lòng

- Lưu

- nói

- Quy mô

- mở rộng quy mô

- kịch bản

- phạm vi

- xước

- sdk

- liền mạch

- Tìm kiếm

- Thứ hai

- Thế hệ thứ hai

- giây

- an toàn

- an toàn

- an ninh

- xem

- nhìn thấy

- đã xem

- chọn

- chọn

- lựa chọn

- gửi

- cao cấp

- Nhà lãnh đạo cấp cao

- nhạy cảm

- Tháng Chín

- Trình tự

- Loạt Sách

- Các máy chủ

- dịch vụ

- DỊCH VỤ

- định

- bộ

- một số

- Chia sẻ

- chia sẻ

- TÀU

- ngắn

- nên

- bên

- có ý nghĩa

- Silicon

- Tương tự

- Đơn giản

- đơn giản hóa

- đơn giản

- kể từ khi

- Six

- kích thước

- lún xuống

- nhỏ

- So

- Mạng xã hội

- truyền thông xã hội

- Phần mềm

- Nhà phát triển phần mềm

- phát triển phần mềm

- bộ phát triển phần mềm

- giải pháp

- Giải pháp

- động SOLVE

- một số

- Một người nào đó

- một cái gì đó

- sớm

- tinh vi

- nguồn

- mã nguồn

- nguồn

- Đông Nam

- Không gian

- Spark

- đặc biệt

- phát biểu

- tốc độ

- tiêu

- Tính ổn định

- ổn định

- ngăn xếp

- xếp chồng lên nhau

- các bên liên quan

- bắt đầu

- Bắt đầu

- Startups

- nhà nước-of-the-art

- ở lại

- Bước

- Các bước

- Vẫn còn

- là gắn

- hàng

- cửa hàng

- Những câu chuyện

- bão

- Câu chuyện

- hợp lý hóa

- Tăng cường

- nghiêm khắc

- cấu trúc

- Học tập

- subnet

- đáng kể

- như vậy

- phù hợp

- bộ

- tóm tắt

- TÓM TẮT

- lớn

- bổ sung

- nhà cung cấp

- cung cấp

- Cung và cầu

- chuỗi cung ứng

- hỗ trợ

- Hỗ trợ

- chắc chắn

- thật ngạc nhiên

- giám sát

- đáng ngờ

- Tính bền vững

- Công tắc điện

- tổng hợp

- hệ thống

- hệ thống

- bàn

- phù hợp

- Hãy

- mất

- dùng

- Thảo luận

- Mục tiêu

- Nhiệm vụ

- nhiệm vụ

- nhóm

- Thành viên của nhóm

- đội

- Kỹ thuật

- kỹ thuật

- kỹ thuật

- Công nghệ

- Công nghệ

- Đổi mới Công nghệ

- nói

- nói

- 10

- hàng chục

- tensorflow

- thuật ngữ

- thử nghiệm

- Kiểm tra

- kiểm tra

- văn bản

- hơn

- việc này

- Sản phẩm

- Tương lai

- thế giới

- cung cấp their dịch

- Them

- tự

- sau đó

- Đó

- Kia là

- họ

- điều

- điều

- nghĩ

- Thứ ba

- điều này

- năm nay

- những

- hàng ngàn

- số ba

- Thông qua

- khắp

- thông lượng

- vé

- vé

- thời gian

- thời gian

- titan

- đến

- bây giờ

- hôm nay

- bên nhau

- mã thông báo

- quá

- mất

- công cụ

- công cụ

- hàng đầu

- Chủ đề

- Chuyến du lịch

- đối với

- đối với

- theo dõi

- Hồ sơ theo dõi

- Giao dịch

- Train

- đào tạo

- Hội thảo

- Giao dịch

- Bảng điểm

- Chuyển đổi

- Chuyển đổi

- biến đổi

- biến đổi

- đi du lịch

- trillions

- chuyến đi

- thực sự

- NIỀM TIN

- thử

- cố gắng

- điều chỉnh

- biến

- hai

- kiểu

- thường

- cơ bản

- hiểu

- dễ hiểu

- sự hiểu biết

- hiểu

- không quen

- thống nhât

- độc đáo

- đơn vị

- không giống

- cho đến khi

- Cập nhật

- Cập nhật

- nâng cấp

- nâng cấp

- us

- Sử dụng

- sử dụng

- ca sử dụng

- đã sử dụng

- người sử dang

- Người sử dụng

- sử dụng

- sử dụng

- Quý báu

- nhiều

- khác nhau

- phiên bản

- phiên bản

- Versus

- rất

- thông qua

- phó

- Phó Chủ Tịch

- Video

- Bạo lực

- hầu như

- hình dung

- hình dung

- trực quan

- khối lượng

- Dễ bị tổn thương

- muốn

- Warner

- nhóm nhạc warner

- là

- Sóng

- Đường..

- cách

- we

- web

- Ứng dụng web

- các dịch vụ web

- trang web

- tuần

- tuần

- chào mừng

- TỐT

- nổi tiếng

- là

- Điều gì

- Là gì

- khi nào

- liệu

- cái nào

- trong khi

- CHÚNG TÔI LÀ

- tại sao

- rộng

- Phạm vi rộng

- rộng hơn

- sẽ

- cửa sổ

- với

- ở trong

- không có

- Công việc

- làm việc

- Luồng công việc

- đang làm việc

- công trinh

- thế giới

- đẳng cấp thế giới

- lo

- giá trị

- sẽ

- viết

- viết mã

- viết

- năm

- năm

- york

- Bạn

- trên màn hình

- Zendesk

- zephyrnet