欺诈检测是一个重要问题,在金融服务、社交媒体、电子商务、游戏和其他行业都有应用。 这篇文章介绍了一种欺诈检测解决方案的实现,该解决方案使用关系图卷积网络 (RGCN) 模型通过转导和归纳推理模式预测交易欺诈的概率。 您可以将我们的实施部署到 亚马逊SageMaker 端点作为实时欺诈检测解决方案,无需外部图形存储或编排,从而显着降低模型的部署成本。

寻找用于欺诈检测的完全托管 AWS AI 服务的企业也可以使用 亚马逊欺诈检测器,您可以使用它来识别可疑的在线支付、检测新帐户欺诈、防止滥用试用和忠诚度计划,或改进帐户接管检测。

解决方案概述

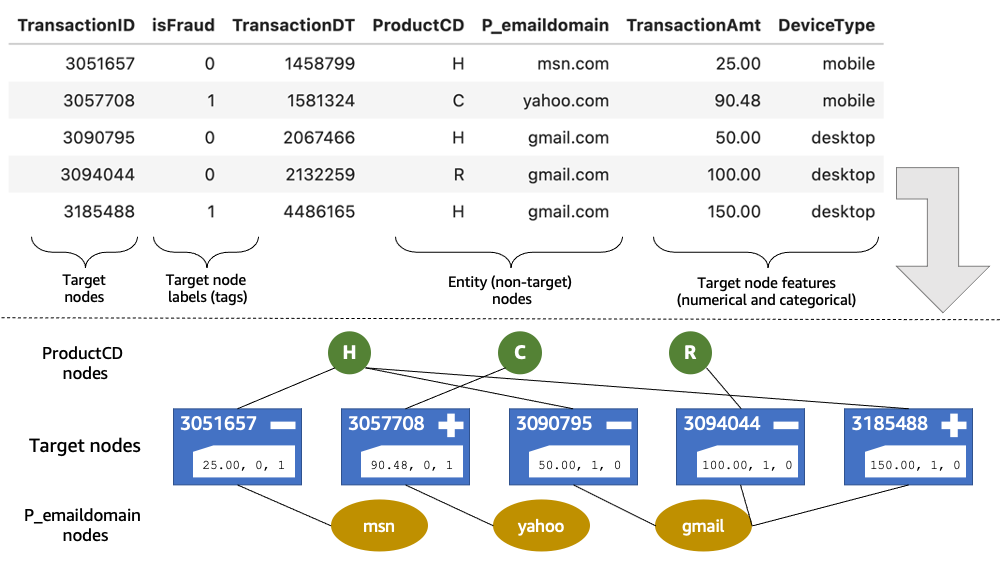

下图描述了一个包含不同类型信息的示例金融交易网络。 每笔交易都包含设备标识符、Wi-Fi ID、IP 地址、物理位置、电话号码等信息。 我们通过包含不同类型节点和边的异构图来表示交易数据集。 然后,将欺诈检测问题作为该异构图上的节点分类任务进行处理。

图神经网络 (GNN) 在解决欺诈检测问题方面显示出巨大潜力,在基准数据集上优于流行的监督学习方法,如梯度提升决策树或完全连接的前馈网络。 在典型的欺诈检测设置中,在训练阶段,GNN 模型在一组标记的交易上进行训练。 每个训练交易都带有一个二进制标签,表明它是否是欺诈性的。 然后,该经过训练的模型可用于在推理阶段检测一组未标记交易中的欺诈交易。 存在两种不同的推理模式:转导推理与归纳推理(我们将在本文后面详细讨论)。

基于 GNN 的模型,如 RGCN,可以利用拓扑信息,结合图形结构以及节点和边缘的特征来学习区分恶意交易和合法交易的有意义的表示。 RGCN 可以通过异构图嵌入有效地学习表示不同类型的节点和边(关系)。 在上图中,每个事务都被建模为目标节点,与每个事务关联的多个实体被建模为非目标节点类型,例如 ProductCD 和 P_emaildomain. 目标节点分配有数值和分类特征,而其他节点类型没有特征。 RGCN 模型学习每个非目标节点类型的嵌入。 对于目标节点的嵌入,使用卷积运算使用其特征和邻域嵌入来计算其嵌入。 在本文的其余部分,我们交替使用术语 GNN 和 RGCN。

值得注意的是,由于这些实体的基数很大,替代策略(例如将非目标实体视为特征并对它们进行单热编码)通常是不可行的。 相反,将它们编码为图形实体使 GNN 模型能够利用实体关系中的隐式拓扑。 例如,与已知欺诈交易共享电话号码的交易也更有可能是欺诈性的。

GNN 使用的图形表示在其实现中产生了一些复杂性。 对于欺诈检测等应用程序尤其如此,在这些应用程序中,图形表示可能会在推理过程中得到增强,新添加的节点对应于模型训练期间未知的实体。 这种推理场景通常被称为 感应模式。 相反, 传导模式 是一种假设在模型训练期间构建的图形表示在推理期间不会改变的场景。 GNN 模型通常以转导模式进行评估,方法是从一组训练和测试示例的组合中构建图形表示,同时在反向传播期间屏蔽测试标签。 这确保了图形表示是静态的,并且 GNN 模型在推理期间不需要执行操作来使用新节点扩展图形。 不幸的是,在检测真实世界环境中的欺诈交易时,无法假定静态图形表示。 因此,在将用于欺诈检测的 GNN 模型部署到生产环境时,需要支持归纳推理。

此外,实时检测欺诈交易至关重要,尤其是在只有一次机会阻止非法活动的商业案例中。 例如,欺诈用户可以仅使用一个帐户进行一次恶意行为,并且再也不会使用同一个帐户。 GNN 模型的实时推理给实现带来了额外的复杂性。 通常需要实现子图提取操作以支持实时推理。 当图表示很大并且对整个图执行推理变得非常昂贵时,需要子图提取操作来减少推理延迟。 使用 RGCN 模型进行实时归纳推理的算法运行如下:

- 给定一批交易和经过训练的 RGCN 模型,使用批次中的实体扩展图形表示。

- 将新的非目标节点的嵌入向量分配给它们各自节点类型的平均嵌入向量。

- 提取由 k-从批次中跳出目标节点的邻域。

- 对子图执行推理并返回批次目标节点的预测分数。

- 通过删除新添加的节点来清理图形表示(此步骤确保模型推理的内存需求保持不变)。

这篇文章的主要贡献是提出了一个实现实时归纳推理算法的 RGCN 模型。 您可以将我们的 RGCN 实施部署到 SageMaker 端点,作为实时欺诈检测解决方案。 我们的解决方案不需要外部图形存储或编排,并且显着降低了用于欺诈检测任务的 RGCN 模型的部署成本。 该模型还实现了转导推理模式,使我们能够进行实验以比较归纳和转导模式下的模型性能。 模型代码和带有实验的笔记本可以从 AWS 示例 GitHub 存储库.

这篇文章建立在帖子的基础上 使用 Amazon SageMaker、Amazon Neptune 和 Deep Graph Library 构建基于 GNN 的实时欺诈检测解决方案. 上一篇文章使用SageMaker构建了基于RGCN的实时欺诈检测方案, 亚马逊海王星,并 深度图库 (DGL)。 之前的解决方案使用 Neptune 数据库作为外部图形存储,需要 AWS Lambda 用于实时推理的编排,并且仅包括转换模式下的实验。

本文介绍的RGCN模型仅以DGL为依赖实现了实时归纳推理算法的所有操作,不需要外部图存储或编排部署。

我们首先在基准数据集上评估 RGCN 模型在转导和归纳模式下的性能。 正如预期的那样,归纳模式下的模型性能略低于转导模式。 我们还研究了超参数的影响 k 关于模型性能。 超参数 k 控制在实时推理算法的第 3 步中提取子图所执行的跳数。 更高的值 k 将产生更大的子图,并且可以以更高的延迟为代价带来更好的推理性能。 因此,我们还进行了时序实验,以评估 RGCN 模型在实时应用中的可行性。

数据集

我们使用 IEEE-CIS欺诈数据集,与之前使用的相同数据集 发表. 该数据集包含超过 590,000 条带有二进制欺诈标签的交易记录( isFraud 柱子)。 数据分为两个表:交易和身份。 但是,并不是所有的交易记录都有对应的身份信息。 我们加入了两个表 TransactionID 列,这给我们留下了总共 144,233 条交易记录。 我们按事务时间戳( TransactionDT 列)并按时间创建 80/20 百分比分割,分别产生 115,386 和 28,847 笔交易用于训练和测试。

有关数据集的更多详细信息以及如何对其进行格式化以满足 DGL 的输入要求,请参阅 使用Amazon SageMaker和Deep Graph Library检测异构网络中的欺诈行为.

图构建

我们使用 TransactionID 列生成目标节点。 我们使用以下列生成 11 类非目标节点:

card1通过card6ProductCDaddr1和addr2P_emaildomain和R_emaildomain

我们使用 38 列作为目标节点的分类特征:

M1通过M9DeviceType和DeviceInfoid_12通过id_38

我们使用 382 列作为目标节点的数值特征:

TransactionAmtdist1和dist2id_01通过id_11C1通过C14D1通过D15V1通过V339

我们从训练交易构建的图表包含 217,935 个节点和 2,653,878 条边。

超参数

其他参数设置为与之前报告的参数相匹配 发表. 以下片段说明了在转导和归纳模式下训练 RGCN 模型:

感应模式与感应模式

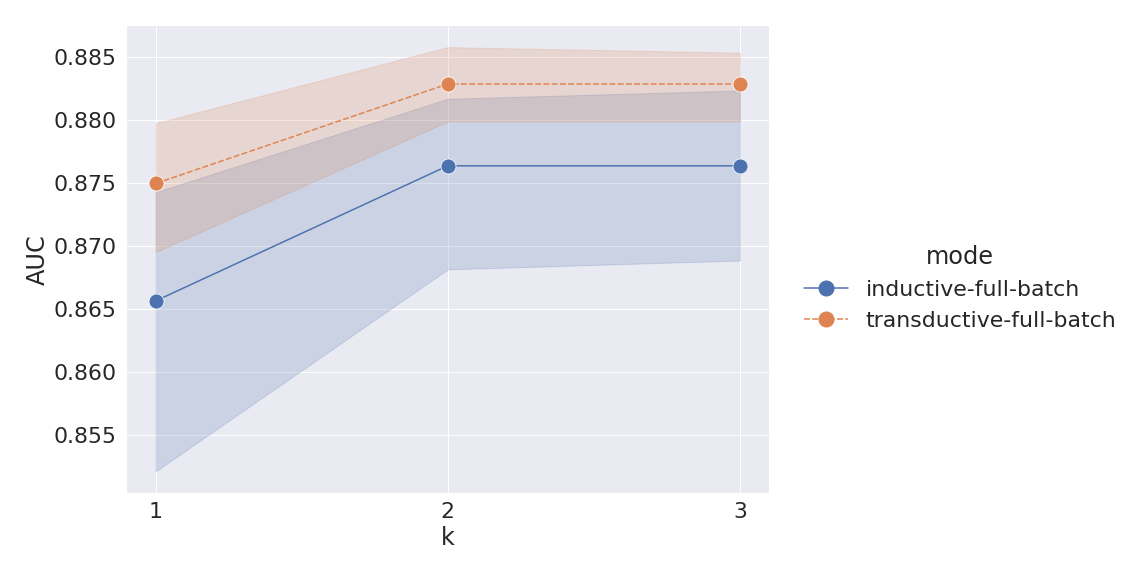

我们对感应模式进行了五次试验,对传导模式进行了五次试验。 对于每次试验,我们训练一个 RGCN 模型并将其保存到磁盘,获得 10 个模型。 我们在测试示例上评估每个模型,同时增加跳数(参数 k) 用于提取子图进行推理,设置 k 到 1、2 和 3。我们一次预测所有测试示例,并计算每个试验的 ROC AUC 分数。 下图显示了 AUC 分数的平均值和 95% 置信区间。

我们可以看到,转换模式下的性能略高于电感模式。 为了 k=2,感应和转换模式的平均 AUC 分数分别为 0.876 和 0.883。 这是意料之中的,因为 RGCN 模型能够以转换模式学习所有实体节点的嵌入,包括测试集中的实体节点。 相反,归纳模式只允许模型学习训练示例中存在的实体节点的嵌入,因此在推理过程中必须对某些节点进行均值填充。 同时,transductive 和 inductive 模式之间的性能下降并不显着,即使在 inductive 模式下,RGCN 模型也取得了良好的性能,AUC 为 0.876。 我们还观察到模型性能不会随着值的提高而提高 k>2。 这意味着设置 k=2 会在推理过程中提取足够大的子图,从而获得最佳性能。 我们的下一个实验也证实了这一观察结果。

同样值得注意的是,对于转换模式,我们模型的 AUC 0.883 高于之前报告的相应 AUC 0.870 发表. 我们使用更多的列作为目标节点的数值和分类特征,这可以解释更高的 AUC 分数。 我们还注意到,上一篇文章中的实验只进行了一次试验。

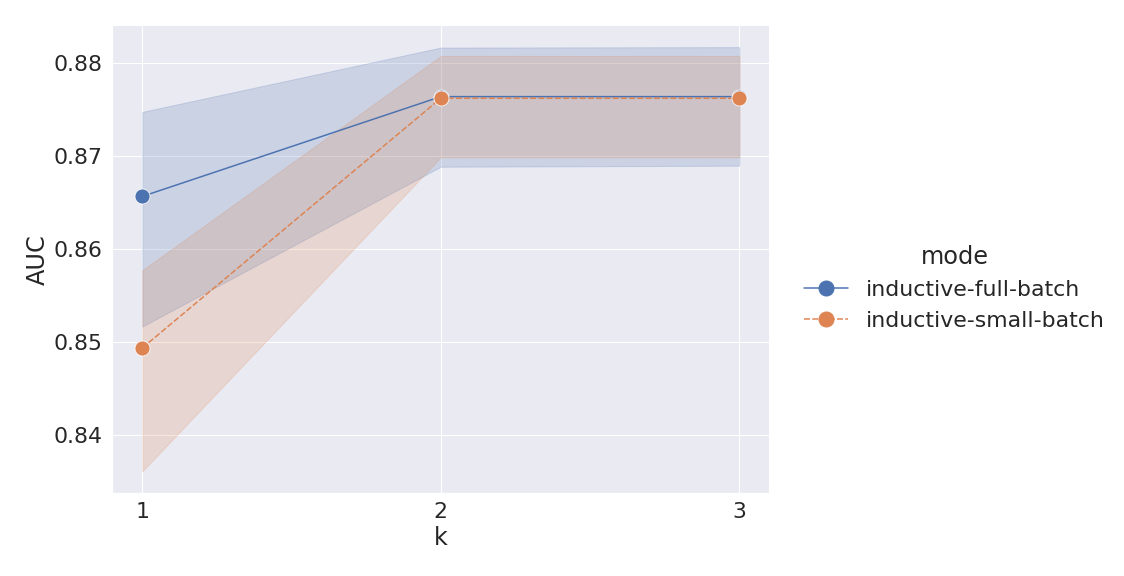

小批量推理

对于这个实验,我们在小批量推理设置中评估 RGCN 模型。 我们使用在之前的实验中以归纳模式训练的五个模型。 我们在两种设置下进行预测时比较了这些模型的性能:完整和小批量推理。 对于全批推理,我们在整个测试集上进行预测,就像在之前的实验中所做的那样。 对于小批量推理,我们通过将测试集分成 28 个大小相等的批次,每批次大约有 1,000 个事务来进行小批量预测。 我们使用不同的值计算两种设置的 AUC 分数 k. 下图显示了完整和小批量推理设置的平均和 95% 置信区间。

我们观察到小批量推理的性能 k=1 低于整批。 然而,小批量推理性能与全批量匹配时 k>1。 这可以归因于为小批量提取的子图要小得多。 我们通过将子图大小与从训练事务构建的整个图的大小进行比较来确认这一点。 我们根据节点数比较图的大小。 为了 k=1,小批量推理的平均子图大小小于训练图的 2%。 而对于全批推理时 k=1,子图大小为22%。 什么时候 k=2,小批量和全批量推理的子图大小分别为 54% 和 64%。 最后,两种推理设置的子图大小都达到 100% k=3。 换句话说,当 k>1,小批量的子图变得足够大,使小批量推理能够达到与全批量推理相同的性能。

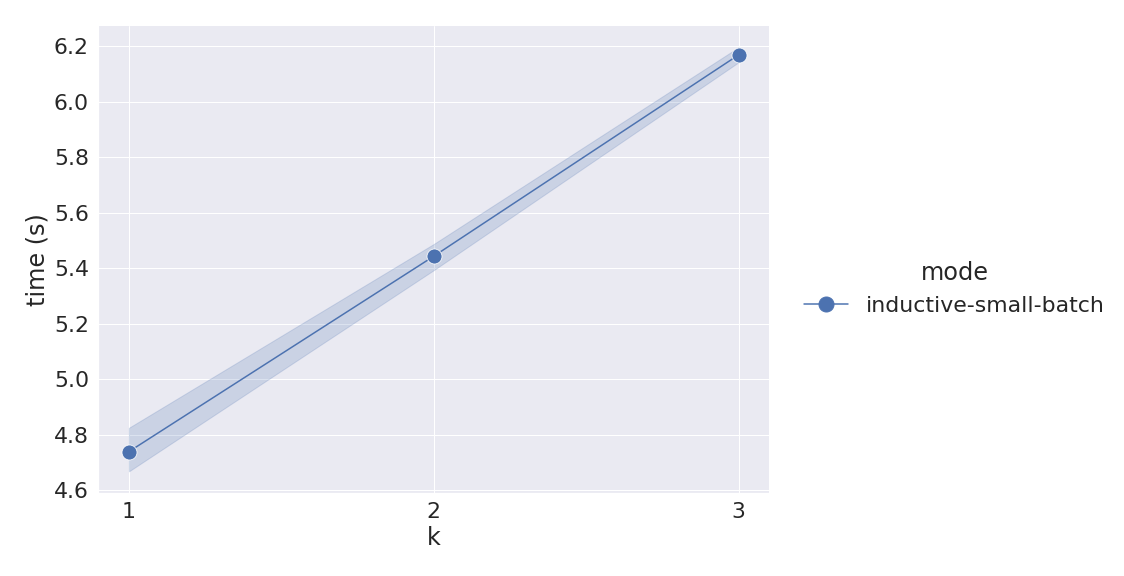

我们还记录了每批次的预测延迟。 我们在 ml.r5.12xlarge 实例上执行我们的实验,但您可以使用具有 64 G 内存的较小实例来运行相同的实验。 下图显示了不同值的小批量预测延迟的均值和 95% 置信区间 k.

延迟包括实时归纳推理算法的所有五个步骤。 我们看到当 k=2,预测 1,030 笔交易平均需要 5.4 秒,导致每秒 190 笔交易的吞吐量。 这证实了 RGCN 模型实现适用于实时欺诈检测。 我们还注意到,之前 发表 没有为其实施提供硬延迟值。

结论

随本文发布的 RGCN 模型实现了实时归纳推理的算法,不需要外部图形存储或编排。 参数 k 在算法的第 3 步中,指定为提取推理子图而执行的跳数,并导致模型准确性和预测延迟之间的权衡。 我们使用了 IEEE-CIS欺诈数据集 在我们的实验中,并根据经验验证了参数的最优值 k 此数据集的预测值为 2,AUC 得分为 0.876,每 6 笔交易的预测延迟小于 1,000 秒。

这篇文章提供了训练和评估用于实时欺诈检测的 RGCN 模型的分步过程。 包含的模型类实现整个模型生命周期的方法,包括序列化和反序列化方法。 这使得该模型能够用于实时欺诈检测。 您可以将模型训练为 PyTorch SageMaker 估算器,然后使用以下命令将其部署到 SageMaker 端点 笔记本 作为模板。 该端点能够实时预测小批量原始交易的欺诈行为。 您也可以使用 Amazon SageMaker 推理推荐器 根据您的工作负载为推理端点选择最佳实例类型和配置。

有关此主题和实施的更多信息,我们鼓励您自行探索和测试我们的脚本。 您可以从访问笔记本和相关模型类代码 AWS 示例 GitHub 存储库.

作者简介

德米特里·贝斯帕洛夫 是亚马逊机器学习解决方案实验室的高级应用科学家,他帮助不同行业的 AWS 客户加速人工智能和云的采用。

德米特里·贝斯帕洛夫 是亚马逊机器学习解决方案实验室的高级应用科学家,他帮助不同行业的 AWS 客户加速人工智能和云的采用。

瑞安·布兰德(Ryan Brand) 是亚马逊机器学习解决方案实验室的应用科学家。 他在将机器学习应用于医疗保健和生命科学问题方面拥有丰富的经验。 在空闲时间,他喜欢阅读历史和科幻小说。

瑞安·布兰德(Ryan Brand) 是亚马逊机器学习解决方案实验室的应用科学家。 他在将机器学习应用于医疗保健和生命科学问题方面拥有丰富的经验。 在空闲时间,他喜欢阅读历史和科幻小说。

严俊奇 是亚马逊机器学习解决方案实验室的高级应用科学经理。 她创新并应用机器学习来帮助 AWS 客户加快 AI 和云的采用。

严俊奇 是亚马逊机器学习解决方案实验室的高级应用科学经理。 她创新并应用机器学习来帮助 AWS 客户加快 AI 和云的采用。

- SEO 支持的内容和 PR 分发。 今天得到放大。

- 柏拉图区块链。 Web3 元宇宙智能。 知识放大。 访问这里。

- Sumber: https://aws.amazon.com/blogs/machine-learning/build-a-gnn-based-real-time-fraud-detection-solution-using-the-deep-graph-library-without-using-external-graph-storage/

- 000

- 1

- 10

- 100

- 11

- 2%

- 28

- 7

- 95%

- a

- Able

- 关于

- 滥用

- 加快

- ACCESS

- 访问

- 账号管理

- 实现

- 实现

- 横过

- 活动

- 添加

- 增加

- 额外

- 地址

- 采用

- 优点

- AI

- 算法

- 所有类型

- 允许

- 替代

- Amazon

- 亚马逊机器学习

- 亚马逊海王星

- 亚马逊SageMaker

- 其中

- 和

- 应用领域

- 应用领域

- 应用的

- 应用

- 约

- 排列

- 分配

- 相关

- 假定

- 增强

- AWS

- 基于

- 因为

- 成为

- 作为

- 基准

- 标杆

- 最佳

- 更好

- 之间

- 品牌

- 建立

- 建立

- 建

- 商业

- 携带

- 例

- 机会

- 更改

- 程

- 分类

- 云端技术

- 云采用

- 码

- 柱

- 列

- 结合

- 结合

- 比较

- 比较

- 复杂

- 计算

- 进行

- 信心

- 配置

- 确认

- CONFIRMED

- 已联繫

- 常数

- 构建

- 施工

- 包含

- 对比

- 贡献

- 控制

- 相应

- 价格

- 创建信息图

- 创建

- 关键

- 合作伙伴

- data

- 数据库

- 数据集

- 决定

- 深

- 默认

- 定义

- 依赖

- 部署

- 部署

- 部署

- 详情

- 检测

- 设备

- DGL

- DID

- 不同

- 讨论

- 不会

- 下降

- ,我们将参加

- 每

- 电子商务

- 效果

- 只

- 使

- 使

- 鼓励

- 端点

- 确保

- 整个

- 实体

- 实体

- 环境中

- 特别

- 评估

- 评估

- 评估

- 甚至

- 所有的

- 例子

- 例子

- 预期

- 昂贵

- 体验

- 实验

- 说明

- 探索

- 延长

- 外部

- 提取

- 特征

- 小说

- 终于

- 金融

- 金融服务

- (名字)

- 以下

- 如下

- 格式

- 骗局

- 欺诈检测

- 欺诈

- 自由的

- 止

- ,

- 充分

- 赌博

- 生成

- 得到

- GitHub上

- 非常好

- 图形

- 大

- 硬

- 医疗保健

- 帮助

- 帮助

- 更高

- 历史

- 创新中心

- How To

- 但是

- HTML

- HTTPS

- 鉴定

- 身分

- 不法

- 实施

- 履行

- 实施

- 器物

- 进口

- 重要

- 改善

- in

- 其他

- 包括

- 包括

- 包含

- 增加

- 行业

- 信息

- 输入

- 例

- 介绍

- 推出

- IP

- IP地址

- IT

- 加入

- 键

- 已知

- 实验室

- 标签

- 标签

- 大

- 大

- 潜伏

- 铅

- 学习用品

- 学习

- 自学资料库

- 生活

- 生命科学

- 生命周期

- 容易

- 加载

- 地点

- 寻找

- 忠诚

- 忠诚计划

- 机

- 机器学习

- 经理

- 匹配

- 有意义的

- 媒体

- 内存

- 方法

- ML

- 时尚

- 模型

- 模型

- 模式

- 更多

- 必要

- 海王星

- 网络

- 网络

- 神经网络

- 全新

- 下页

- 节点

- 节点

- 数

- 数字

- 观察

- 获得

- 一

- 在线

- 在线支付

- 操作

- 运营

- 最佳

- 管弦乐编曲

- 其他名称

- 成效超越

- 己

- 大熊猫

- 参数

- 参数

- 通过

- 支付

- 百分比

- 演出

- 性能

- 执行

- 相

- 电话

- 的

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 热门

- 帖子

- 预测

- 预测

- 预测

- 当下

- 礼物

- 防止

- 以前

- 先

- 市场问题

- 问题

- 过程

- 生产

- 生产

- 曲目

- 承诺

- 提供

- 提供

- pytorch

- Qi

- 原

- 达到

- 阅读

- 真实

- 真实的世界

- 实时的

- 记录

- 记录

- 减少

- 减少

- 减少

- 简称

- 有关

- 关系

- 关系

- 发布

- 删除

- 报道

- 代表

- 表示

- 要求

- 必须

- 需求

- 那些

- REST的

- 导致

- 成果

- 回报

- 运行

- 瑞安

- sagemaker

- SageMaker 推理

- 同

- 保存

- 脚本

- 科学

- 科幻小说

- 科学

- 科学家

- 脚本

- 其次

- 秒

- 前辈

- 服务

- 特色服务

- 集

- 设置

- 设置

- 格局

- 几个

- Share

- 如图

- 作品

- 显著

- 显著

- 单

- 尺寸

- 尺寸

- 小

- 小

- So

- 社会

- 社会化媒体

- 方案,

- 解决方案

- 一些

- 具体的

- 速度

- 分裂

- 拆分

- 步

- 步骤

- 停车

- 存储

- 策略

- 结构体

- 学习

- 子图

- 子图

- 这样

- 如下

- 合适的

- SUPPORT

- 可疑

- 表

- 采取

- 收购

- 需要

- 目标

- 任务

- 任务

- 模板

- 条款

- test

- 测试

- 图

- 其

- 从而

- 因此

- 通过

- 吞吐量

- 次

- 时间戳

- 定时

- 至

- 也有

- 主题

- 合计

- 培训

- 熟练

- 产品培训

- 交易

- 交易

- 治疗

- 树

- 试用

- 试验

- true

- 类型

- 普遍

- us

- 使用

- 用户

- 平时

- 验证

- 折扣值

- 价值观

- 通过

- 这

- 而

- 无线网络连接

- 将

- 也完全不需要

- 话

- 价值

- 将

- 完全

- 您一站式解决方案

- 和风网