计算机视觉(CV)是机器学习(ML)和深度学习最常见的应用之一。 使用案例包括自动驾驶汽车、社交媒体平台上的内容审核、癌症检测和自动缺陷检测。 亚马逊重新认识 是一项完全托管的服务,可以执行对象检测、视频片段检测、内容审核等 CV 任务,以便从数据中提取见解,而无需任何先前的 ML 经验。 在某些情况下,可能需要更定制的解决方案以及服务来解决非常具体的问题。

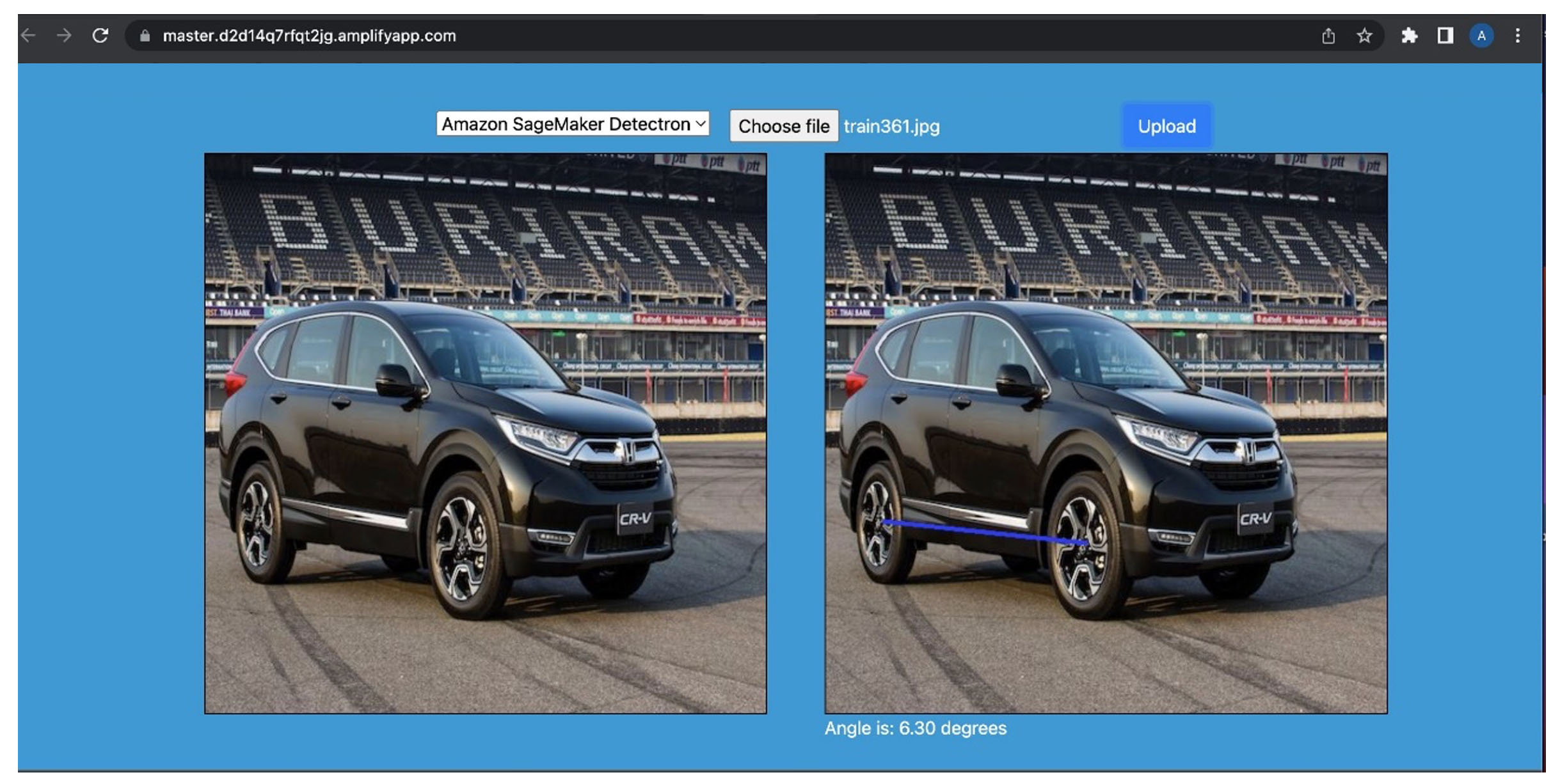

在这篇文章中,我们将讨论 CV 可以应用于对象姿势、位置和方向很重要的用例的领域。 其中一种用例是需要上传图像的面向客户的移动应用程序。 这可能是出于合规性原因,也可能是为了提供一致的用户体验并提高参与度。 例如,在网络购物平台上,产品在图像中展示的角度会影响该产品的购买率。 其中一个例子是检测汽车的位置。 我们演示了如何将众所周知的 ML 解决方案与后处理相结合,以在 AWS 云上解决此问题。

我们使用深度学习模型来解决这个问题。 训练用于姿态估计的 ML 算法需要大量专业知识和自定义训练数据。 满足这两个要求都很困难且成本高昂。 因此,我们提供两种选择:一种不需要任何 ML 专业知识并使用 Amazon Rekognition,另一种则使用 亚马逊SageMaker 训练和部署自定义 ML 模型。 在第一个选项中,我们使用 Amazon Rekognition 来检测汽车的车轮。 然后,我们使用基于规则的系统从车轮位置推断汽车方向。 在第二个选项中,我们使用以下方法检测车轮和其他汽车部件 侦探 模型。 这些再次用于通过基于规则的代码推断汽车位置。 第二种选择需要机器学习经验,但也更具可定制性。 它可用于对图像进行进一步的后处理,例如裁剪整个汽车。 这两个选项都可以在公开可用的数据集上进行训练。 最后,我们向您展示如何使用以下服务将此汽车姿态检测解决方案集成到您现有的 Web 应用程序中: Amazon API网关 和 AWS放大.

解决方案概述

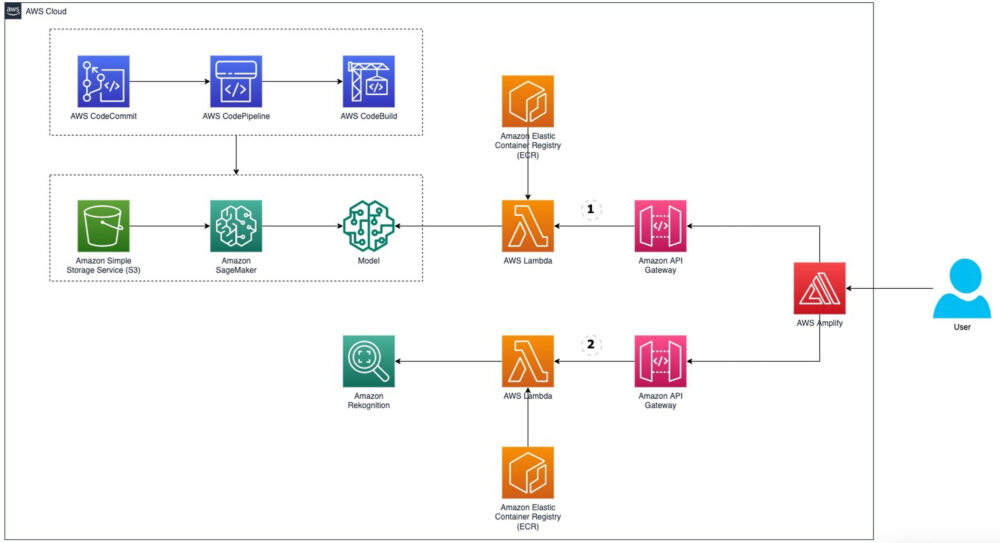

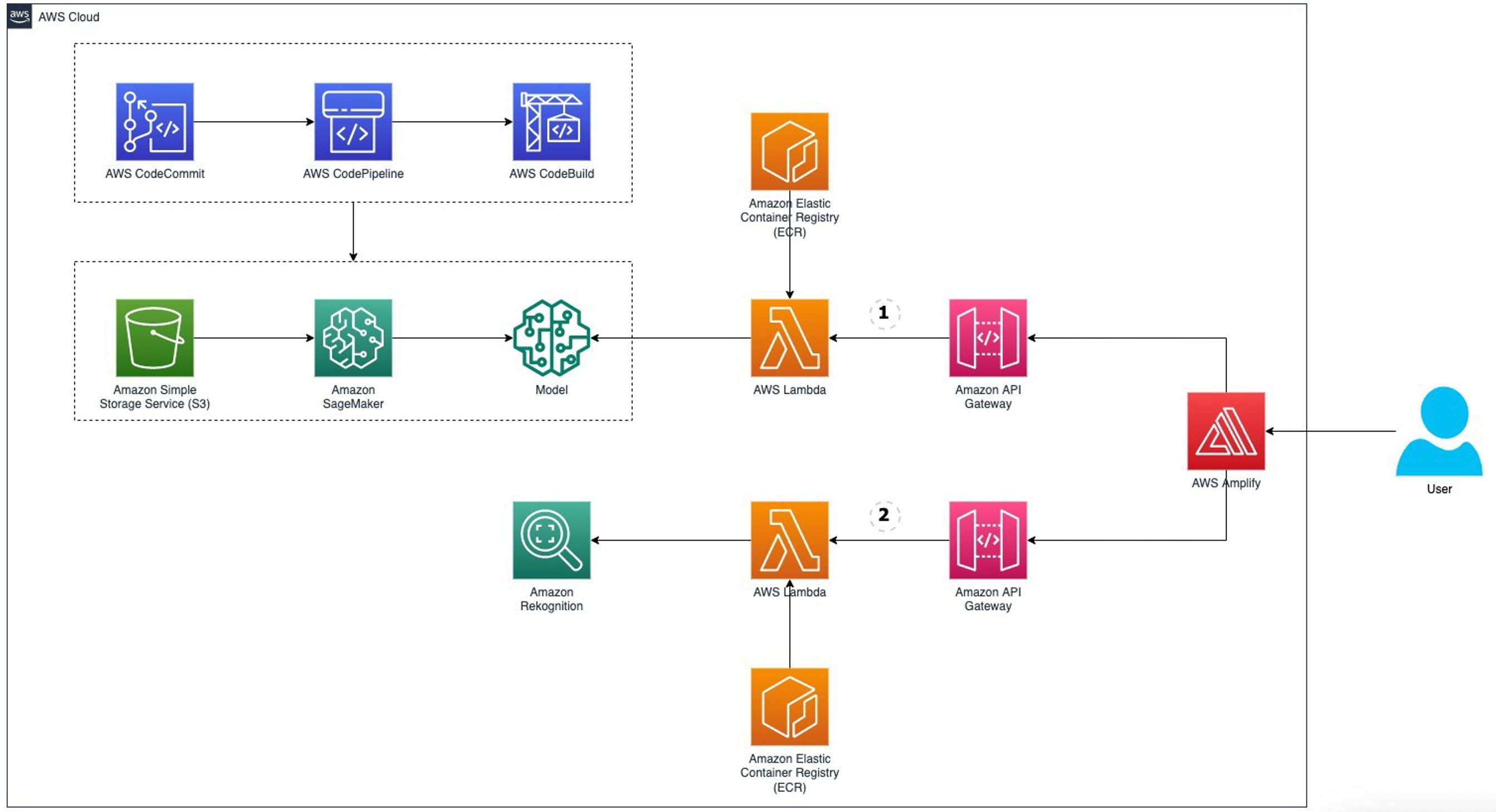

下图说明了解决方案体系结构。

该解决方案由 Amplify 中的模拟 Web 应用程序组成,用户可以在其中上传图像并调用 Amazon Rekognition 模型或自定义 Detectron 模型来检测汽车的位置。 对于每个选项,我们都会举办 AWS Lambda 暴露给我们的模拟应用程序的 API 网关后面的函数。 我们将 Lambda 函数配置为与在 SageMaker 或 Amazon Rekognition 中训练的 Detectron 模型一起运行。

先决条件

对于本演练,您应该具有以下先决条件:

使用 Amazon Rekognition 创建无服务器应用程序

我们的第一个选项演示了如何使用 Amazon Rekognition 检测图像中的汽车方向。 这个想法是使用 Amazon Rekognition 检测汽车及其车轮的位置,然后进行后处理以根据此信息得出汽车的方向。 整个解决方案使用 Lambda 进行部署,如下所示 Github存储库。 该文件夹包含两个主要文件:一个 Dockerfile,它定义将在我们的 Lambda 函数中运行的 Docker 映像,以及 app.py 文件,这将是 Lambda 函数的主要入口点:

Lambda 函数需要一个包含标头和正文的事件,其中正文应该是需要标记为 Base64 解码对象的图像。 给定图像,Amazon Rekognition detect_labels 函数是从 Lambda 函数调用的 博托3。 该函数返回图像中每个对象的一个或多个标签,以及所有检测到的对象标签的边界框详细信息作为响应的一部分,以及其他信息,例如指定标签的置信度、检测到的标签的祖先标签等标签的别名以及检测到的标签所属的类别。 根据 Amazon Rekognition 返回的标签,我们运行该函数 label_image,它根据检测到的车轮计算汽车角度,如下所示:

请注意,该应用程序要求图像中仅存在一辆车,如果不是这种情况,则返回错误。 然而,后处理可以适应提供更细粒度的方向描述、覆盖多辆汽车或计算更复杂对象的方向。

改进车轮检测

为了进一步提高车轮检测的准确性,可以使用 Amazon Rekognition自定义标签。 与使用 SageMaker 进行微调来训练和部署自定义 ML 模型类似,您可以自带标记数据,以便 Amazon Rekognition 可以在短短几个小时内为您生成自定义图像分析模型。 借助 Rekognition 自定义标签,您只需要一小组特定于您的使用案例的训练图像(在本例中为具有特定角度的汽车图像),因为它使用 Amazon Rekognition 中的现有功能,可以对跨区域的数千万张图像进行训练。许多类别。 只需点击几下鼠标,并对我们用于标准 Amazon Rekognition 解决方案的 Lambda 函数进行一些小调整,即可集成 Rekognition 自定义标签。

使用 SageMaker 训练作业训练模型

在第二个选项中,我们在 SageMaker 上训练自定义深度学习模型。 我们使用 Detectron2框架 用于汽车零部件的细分。 然后使用这些片段来推断汽车的位置。

Detectron2 框架是一个提供最先进的检测和分割算法的库。 Detectron 提供了多种 Mask R-CNN 模型,这些模型是在著名的 COCO(上下文中的常见对象)数据集上进行训练的。 为了构建我们的汽车物体检测模型,我们使用迁移学习来微调预训练的 Mask R-CNN 模型 汽车零部件细分 数据集。 该数据集使我们能够训练一个可以检测车轮以及其他汽车零件的模型。 该附加信息可以进一步用于相对于图像的汽车角度计算。

该数据集包含用于对象检测和语义分割任务的汽车零件的注释数据:大约 500 张轿车、皮卡和运动型多功能车 (SUV) 的图像,以多个视图(前视图、后视图和侧视图)拍摄。 每个图像都由 18 个实例蒙版和边界框进行注释,代表汽车的不同部分,如车轮、后视镜、灯光以及前后玻璃。 我们修改了车轮的基本注释,使每个车轮被视为一个单独的对象,而不是将图像中所有可用的车轮视为一个对象。

我们使用 亚马逊简单存储服务 (Amazon S3) 用于存储用于训练 Detectron 模型的数据集以及经过训练的模型工件。 而且,Lambda函数中运行的Docker容器存储在 Amazon Elastic Container注册 (亚马逊 ECR)。 Lambda 函数中的 Docker 容器需要包含运行代码所需的库和依赖项。 我们也可以使用 Lambda 层,但解压后的部署打包大小配额限制为 250 MB,并且 Lambda 函数最多可以添加 XNUMX 层。

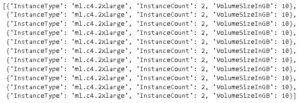

我们的解决方案基于 SageMaker:我们扩展了预构建 SageMaker Docker 容器 让 PyTorch 运行我们的自定义 PyTorch 训练代码。 接下来,我们使用 SageMaker Python SDK 将训练图像包装到 SageMaker PyTorch 估计器中,如以下代码片段所示:

最后,我们通过调用 fit() 在创建的 PyTorch 估计器上运行函数。 训练完成后,训练后的模型工件将存储在 Amazon S3 中的会话存储桶中,以用于推理管道。

使用 SageMaker 和推理管道部署模型

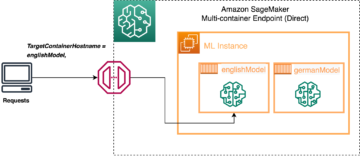

我们还使用 SageMaker 托管运行自定义 Detectron 模型的推理端点。 用于部署我们的解决方案的完整基础设施是使用 AWS CDK 进行配置的。 我们可以通过托管我们的自定义模型 SageMaker 实时端点 通过打电话 deploy 在 PyTorch 估计器上。 这是我们第二次扩展预构建的 SageMaker PyTorch 容器以包含 PyTorch Detectron。 我们使用它来运行推理脚本并托管经过训练的 PyTorch 模型,如下所示:

请注意,我们使用 ml.g4dn.xlarge GPU 进行部署,因为它是可用的最小 GPU,足以满足此演示。 我们需要配置两个组件 推理脚本:模型加载和模型服务。 功能 model_fn() 用于加载经过训练的模型,该模型是托管 Docker 容器的一部分,也可以在 Amazon S3 中找到,并返回可用于模型服务的模型对象,如下所示:

该功能 predict_fn() 执行预测并返回结果。 除了使用我们训练的模型之外,我们还使用在 COCO 数据集上训练的 Mask R-CNN 模型的预训练版本来提取图像中的主要汽车。 这是一个额外的后处理步骤,用于处理存在不止一辆汽车的图像。 请看下面的代码:

与 Amazon Rekognition 解决方案类似,预测的边界框 wheel 类从检测输出中过滤出来并提供给后处理模块以评估汽车相对于输出的位置。

最后,我们还改进了 Detectron 解决方案的后处理。 它还使用不同汽车零件的片段来推断解决方案。 例如,每当检测到前保险杠但没有检测到后保险杠时,就假设我们有汽车的前视图并计算相应的角度。

将您的解决方案连接到 Web 应用程序

将模型端点连接到 Amplify 的步骤如下:

- 克隆 AWS CDK 堆栈创建的应用程序存储库,名为

car-angle-detection-website-repo。 确保您在用于部署的区域中查找它。 - 将每个已部署的 Lambda 函数的 API Gateway 端点复制到

index.html前面的存储库中的文件(有需要放置端点的占位符)。 以下代码是 .html 文件的此部分的示例:

- 保存 HTML 文件并将代码更改推送到远程主分支。

这将更新部署中的 HTML 文件。 该应用程序现在可以使用了。

- 导航到 Amplify 控制台并找到您创建的项目。

部署完成后,应用程序 URL 将可见。

- 导航到 URL 并享受 UI 带来的乐趣。

结论

恭喜! 我们部署了一个完整的无服务器架构,其中使用了 Amazon Rekognition,但也为您自己的自定义模型提供了一个选项,此示例可在 GitHub上。 如果您的团队没有 ML 专业知识,也没有足够的自定义数据来训练模型,您可以选择使用 Amazon Rekognition 的选项。 如果您希望更好地控制模型、进一步自定义模型并拥有足够的数据,则可以选择 SageMaker 解决方案。 如果您有一个数据科学家团队,他们可能还想进一步增强模型并选择更加定制和灵活的选项。 您可以使用这两个选项之一将 Lambda 函数和 API 网关置于 Web 应用程序后面。 您还可以将此方法用于您可能想要调整代码的不同用例。

这种无服务器架构的优点是构建块是完全可互换的。 机会几乎是无限的。 那么,今天就开始吧!

与往常一样,AWS欢迎反馈。 请提交任何意见或问题。

作者简介

迈克尔·沃尔纳 是 AWS 专业服务的数据和人工智能高级顾问,热衷于帮助客户在 AWS 云中实现数据驱动和 AWSome。 最重要的是,他喜欢与客户一起思考,为他们创新和发明新想法。

迈克尔·沃尔纳 是 AWS 专业服务的数据和人工智能高级顾问,热衷于帮助客户在 AWS 云中实现数据驱动和 AWSome。 最重要的是,他喜欢与客户一起思考,为他们创新和发明新想法。

阿姆纳·纳吉米 是 AWS 专业服务的数据科学家。 她热衷于帮助客户利用大数据和人工智能技术进行创新,从数据中挖掘商业价值和见解。 她在医疗保健和生命科学垂直领域的数据平台和 AI/ML 项目方面拥有丰富的工作经验。 业余时间,她喜欢园艺和去新地方旅行。

阿姆纳·纳吉米 是 AWS 专业服务的数据科学家。 她热衷于帮助客户利用大数据和人工智能技术进行创新,从数据中挖掘商业价值和见解。 她在医疗保健和生命科学垂直领域的数据平台和 AI/ML 项目方面拥有丰富的工作经验。 业余时间,她喜欢园艺和去新地方旅行。

大卫·索尔温 是 AWS Professional Services 的高级数据科学家,他帮助客户在 AWS 云上进行 AI/ML 之旅。 David 专注于数字孪生、预测和量子计算。 他拥有奥地利因斯布鲁克大学理论物理学博士学位。 他还是德国马克斯普朗克量子光学研究所的博士和博士后研究员。 在空闲时间,他喜欢阅读、滑雪以及与家人共度时光。

大卫·索尔温 是 AWS Professional Services 的高级数据科学家,他帮助客户在 AWS 云上进行 AI/ML 之旅。 David 专注于数字孪生、预测和量子计算。 他拥有奥地利因斯布鲁克大学理论物理学博士学位。 他还是德国马克斯普朗克量子光学研究所的博士和博士后研究员。 在空闲时间,他喜欢阅读、滑雪以及与家人共度时光。

斯里克里希纳·柴坦尼亚·孔杜鲁 是一位拥有 AWS 专业服务的高级数据科学家。 他支持客户在 AWS 上对其 ML 应用程序进行原型设计和操作。 Srikrishna 专注于计算机视觉和 NLP。 他还为不同垂直行业的客户领导机器学习平台设计和用例识别计划。 Srikrishna 拥有德国亚琛工业大学生物医学工程硕士学位,主攻医学成像。

斯里克里希纳·柴坦尼亚·孔杜鲁 是一位拥有 AWS 专业服务的高级数据科学家。 他支持客户在 AWS 上对其 ML 应用程序进行原型设计和操作。 Srikrishna 专注于计算机视觉和 NLP。 他还为不同垂直行业的客户领导机器学习平台设计和用例识别计划。 Srikrishna 拥有德国亚琛工业大学生物医学工程硕士学位,主攻医学成像。

艾哈迈德·曼苏尔 是 AWS 专业服务的数据科学家。 他通过 AWS 云上的 AI/ML 之旅为客户提供技术支持。 Ahmed 专注于 NLP 和 RL 在蛋白质领域的应用。 他拥有德国慕尼黑工业大学工程博士学位。 在空闲时间,他喜欢去健身房和孩子们一起玩耍。

艾哈迈德·曼苏尔 是 AWS 专业服务的数据科学家。 他通过 AWS 云上的 AI/ML 之旅为客户提供技术支持。 Ahmed 专注于 NLP 和 RL 在蛋白质领域的应用。 他拥有德国慕尼黑工业大学工程博士学位。 在空闲时间,他喜欢去健身房和孩子们一起玩耍。

- SEO 支持的内容和 PR 分发。 今天得到放大。

- PlatoData.Network 垂直生成人工智能。 赋予自己力量。 访问这里。

- 柏拉图爱流。 Web3 智能。 知识放大。 访问这里。

- 柏拉图ESG。 汽车/电动汽车, 碳, 清洁科技, 能源, 环境, 太阳能, 废物管理。 访问这里。

- 块偏移量。 现代化环境抵消所有权。 访问这里。

- Sumber: https://aws.amazon.com/blogs/machine-learning/build-and-train-computer-vision-models-to-detect-car-positions-in-images-using-amazon-sagemaker-and-amazon-rekognition/

- :具有

- :是

- :不是

- :在哪里

- 1

- 10

- 100

- 11

- 12

- 13

- 15%

- 17

- 19

- 22

- 250

- 500

- 7

- 9

- a

- 关于

- 横过

- 适应

- 改编

- 添加

- 额外

- 附加信息

- 地址

- 优点

- 后

- 再次

- AI

- AI / ML

- 算法

- 所有类型

- 允许

- 沿

- 还

- 时刻

- Amazon

- 亚马逊重新认识

- 亚马逊SageMaker

- 亚马逊网络服务

- an

- 分析

- 和

- 另一个

- 任何

- API

- 应用

- 应用领域

- 应用领域

- NLP 的应用

- 应用的

- 的途径

- 约

- 架构

- 保健

- 地区

- 人造的

- 人工智能

- AS

- 评估

- 分配

- 假定

- At

- 奥地利

- 自动化

- 可使用

- AWS

- AWS专业服务

- 背部

- 基地

- 基于

- BE

- 因为

- 成为

- 背后

- 作为

- 属于

- 除了

- 大

- 大数据运用

- 生物医学

- 吹氣梢

- 身体

- 都

- 盒子

- 箱

- 分支机构

- 带来

- 建立

- 建筑物

- 建

- 商业

- 但是

- 买房

- by

- 计算

- 计算

- 计算

- 调用

- CAN

- 癌症预防

- 能力

- 汽车

- 汽车

- 案件

- 例

- 类别

- Center

- 更改

- 程

- 云端技术

- COCO

- 码

- 结合

- 注释

- 相当常见

- 完成

- 完全

- 复杂

- 符合

- 组件

- 计算

- 计算

- 一台

- 计算机视觉

- 信心

- 配置

- 分享链接

- 考虑

- 考虑

- 一贯

- 由

- 安慰

- 顾问

- 容器

- 包含

- 内容

- 上下文

- 控制

- 相应

- 昂贵

- 可以

- 外壳

- 创建

- 作物

- 习俗

- 合作伙伴

- 定制

- 定制

- data

- 数据平台

- 数据科学家

- 数据驱动

- 数据集

- David

- 处理

- 深

- 深入学习

- 定义

- 演示

- 演示

- 演示

- 依赖

- 部署

- 部署

- 部署

- 设计

- 详情

- 检测

- 检测

- 检测

- 不同

- 数字

- 数字双胞胎

- 不同

- do

- 码头工人

- 不会

- 域

- 别

- 每

- 效果

- 或

- 其他

- 使

- 使

- 端点

- 订婚

- 工程师

- 提高

- 更多

- 条目

- 错误

- 活动

- 例子

- 现有

- 存在

- 预计

- 体验

- 专门知识

- 裸露

- 延长

- 额外

- 提取

- 家庭

- 著名

- 反馈

- 少数

- 文件

- 档

- 终于

- 姓氏:

- 柔软

- 专注焦点

- 重点

- 以下

- 如下

- 针对

- 发现

- 骨架

- Free

- 止

- 前

- ,

- 充分

- 开玩笑

- 功能

- 功能

- 进一步

- 网关

- 德国

- 得到

- 特定

- 玻璃

- Go

- GPU

- 健身房

- 硬

- 有

- he

- 医疗保健

- 帮助

- 这里

- 他的

- 主持人

- 托管

- HOURS

- 创新中心

- 但是

- HTML

- HTTPS

- 主意

- 思路

- 鉴定

- if

- 说明

- 图片

- 图片

- 同步成像

- 重要

- 改善

- 改善

- in

- 包括

- 个人

- 行业中的应用:

- 信息

- 基础设施

- 项目

- 创新

- 输入

- 可行的洞见

- 例

- 代替

- 整合

- 集成

- 房源搜索

- 成

- 调用

- IT

- 它的

- 工作

- 旅程

- JPG

- JSON

- 只是

- 键

- 孩子们

- 标签

- 标签

- 层

- 信息

- 学习

- 库

- 自学资料库

- 生活

- 生命科学

- 喜欢

- 喜欢

- 有限

- 无限

- 加载

- 装载

- 圖書分館的位置

- 寻找

- LOOKS

- 占地

- 爱

- 机

- 机器学习

- 主要

- 使

- 管理

- 许多

- 制图

- 面膜

- 面膜

- 数学

- 最多

- 媒体

- 医生

- 可能

- 百万

- ML

- 联络号码

- 移动应用程序

- 模型

- 模型

- 适度

- 改性

- 模块

- 更多

- 此外

- 最先进的

- 多

- 命名

- 需求

- 打印车票

- 需要

- 全新

- 下页

- NLP

- 没有

- 现在

- 对象

- 物体检测

- 对象

- 获得

- of

- on

- 一

- 在线

- 网上购物

- 仅由

- 机会

- 光学

- 附加选项

- 附加选项

- or

- 其他名称

- 我们的

- 输出

- 产量

- 超过

- 己

- συσκευάζονται

- 对

- 部分

- 部分

- 多情

- 演出

- 施行

- 物理

- 挑

- 管道

- 地方

- 平台

- 平台

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 播放

- 请

- 点

- 提出

- 姿势估计

- 位置

- 职位

- 可能

- 帖子

- 预测

- 都曾预测

- 预测

- 预报器

- 先决条件

- 当下

- 先

- 市场问题

- 生产

- 产品

- 热销产品

- 所以专业

- 项目

- 项目

- 蛋白质

- 原型

- 提供

- 提供

- 公然

- 推

- 放

- 蟒蛇

- pytorch

- 量子

- 量子光学

- 有疑问吗?

- 范围

- 率

- 阅读

- 准备

- 实时的

- 原因

- 地区

- 相对的

- 远程

- 知识库

- 代表

- 要求

- 必须

- 岗位要求

- 需要

- 研究员

- 响应

- 导致

- 回报

- 回报

- 运行

- 运行

- 运行

- sagemaker

- SC

- 科学

- 科学家

- 科学家

- SDK

- 其次

- 部分

- 看到

- 段

- 分割

- 中模板

- 自驾车

- 前辈

- 无服务器

- 服务

- 特色服务

- 服务

- 会议

- 集

- 几个

- 她

- 购物

- 应该

- 显示

- 如图

- 侧

- 类似

- 简易

- 尺寸

- 小

- So

- 社会

- 社会化媒体

- 社会化媒体平台

- 方案,

- 解决方案

- 解决

- 一些

- 具体的

- 花

- 运动

- 堆

- 标准

- 开始

- 开始

- 国家的最先进的

- 步

- 步骤

- 存储

- 商店

- 存储

- 提交

- 这样

- 足够

- 提供

- SUPPORT

- 支持

- 肯定

- 系统

- 拍摄

- 敲打

- 任务

- TD

- 团队

- 文案

- 技术

- HAST

- 比

- 这

- 其

- 他们

- 然后

- 理论

- 那里。

- 因此

- 博曼

- 他们

- 思维

- Free Introduction

- 通过

- 次

- 至

- 最佳

- 培训

- 熟练

- 产品培训

- 转让

- 旅游

- 双胞胎

- 二

- ui

- 大学

- 更新

- 网址

- us

- 使用

- 用例

- 用过的

- 用户

- 用户体验

- 使用

- 运用

- 效用

- 验证

- 折扣值

- 各种

- 车辆

- 版本

- 垂直

- 垂直

- 非常

- 视频

- 查看

- 意见

- 可见

- 愿景

- 演练

- 想

- 是

- we

- 卷筒纸

- Web应用程序

- Web服务

- 欢迎光临

- 知名

- 为

- 什么是

- 轮

- ,尤其是

- 每当

- 这

- 全

- 将

- 也完全不需要

- 加工

- 将

- 包装

- 完全

- 您一站式解决方案

- 和风网