这篇文章是与 Booking.com 的 Kostia Kofman 和 Jenny Tokar 共同撰写的。

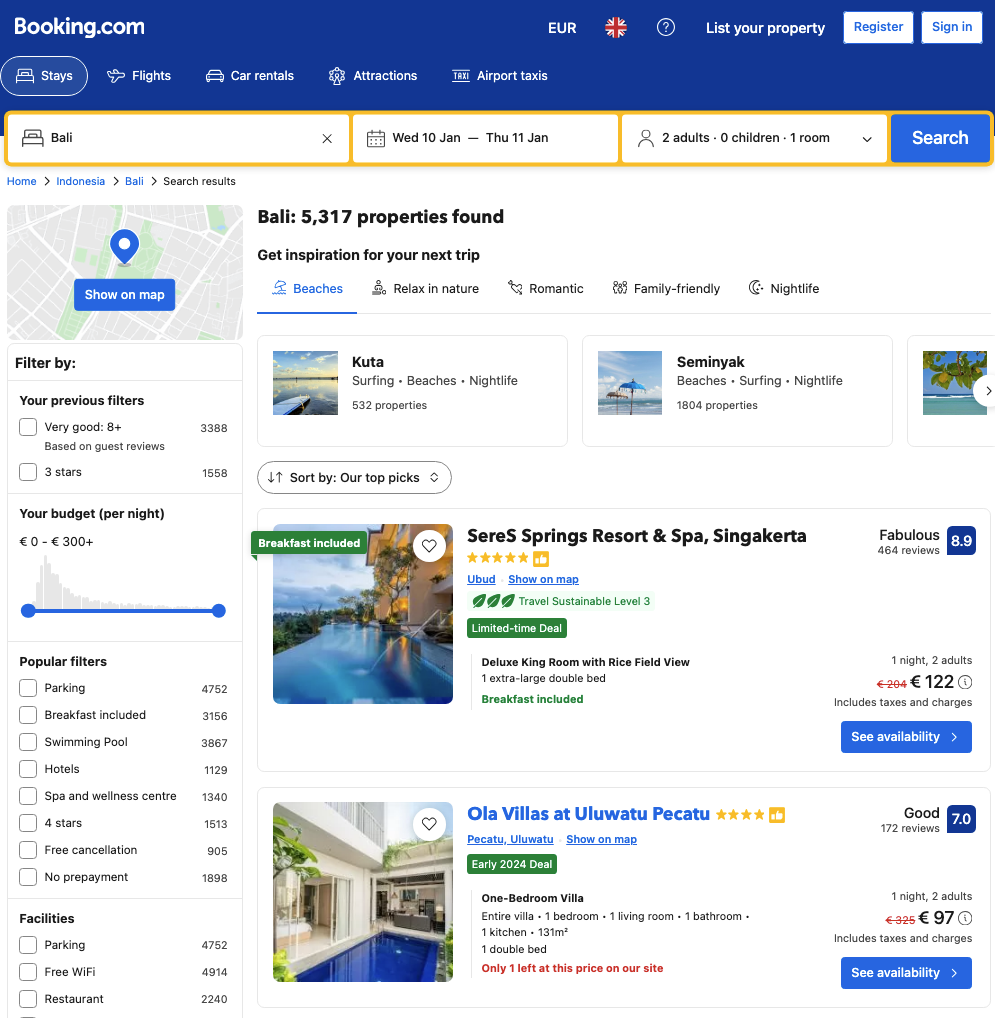

作为全球在线旅游行业的领导者, Booking.com 始终寻求创新方法来增强服务并为客户提供量身定制的无缝体验。 Booking.com 的排名团队在确保优化搜索和推荐算法以为用户提供最佳结果方面发挥着关键作用。

Ranking 团队的机器学习 (ML) 科学家与其他内部团队共享内部资源,经常需要等待很长的时间才能获取模型训练和实验的资源,这对他们快速实验和创新的能力提出了挑战。认识到对现代化 ML 基础设施的需求,Ranking 团队开始了利用 亚马逊SageMaker 大规模构建、训练和部署 ML 模型。

Booking.com 合作伙伴 AWS专业服务 通过以下改进构建解决方案,以加快改进的 ML 模型的上市时间:

- 减少培训和实验资源的等待时间

- 集成基本的 ML 功能,例如超参数调整

- 缩短机器学习模型的开发周期

减少等待时间意味着团队可以快速迭代和试验模型,以更快的速度获得见解。使用 SageMaker 按需可用实例可以将等待时间减少十倍。本地缺乏超参数调整和模型可解释性等基本的机器学习功能。该团队的现代化之旅通过以下方式引入了这些功能 Amazon SageMaker 自动模型调整 和 亚马逊SageMaker澄清。最后,团队的愿望是立即收到代码中所做的每个更改的反馈,将反馈循环从几分钟缩短到瞬间,从而缩短机器学习模型的开发周期。

在这篇文章中,我们深入探讨了 Booking.com 的 Ranking 团队利用 SageMaker 的功能实现 ML 实验框架现代化的历程。通过这样做,他们不仅克服了现有的挑战,还改善了搜索体验,最终使全球数百万旅行者受益。

现代化之路

Ranking 团队由几位 ML 科学家组成,他们每个人都需要离线开发和测试自己的模型。当离线评估认为模型成功时,可以将其转移到生产 A/B 测试。如果它显示出在线改进,则可以将其部署到所有用户。

该项目的目标是为 ML 科学家创建一个用户友好的环境,以便轻松运行可定制的 Amazon SageMaker 模型构建管道 测试他们的假设,而无需编写又长又复杂的模块。

面临的几个挑战之一是调整现有的本地管道解决方案以在 AWS 上使用。该解决方案涉及两个关键组件:

- 修改和扩展现有代码 – 我们解决方案的第一部分涉及修改和扩展现有代码,使其与 AWS 基础设施兼容。这对于确保从本地处理顺利过渡到基于云的处理至关重要。

- 客户端包开发 – 开发了一个客户端包,充当 SageMaker API 和先前存在的代码的包装器。该软件包将两者结合起来,使机器学习科学家能够轻松配置和部署机器学习管道,而无需编码。

SageMaker 管道配置

可定制性是模型构建流程的关键,它是通过以下方式实现的 config.ini,一个广泛的配置文件。该文件充当管道所有输入和行为的控制中心。

内部可用配置 config.ini 包括:

- 管道详情 – 从业者可以定义管道的名称,指定应运行哪些步骤,确定输出应存储在何处 亚马逊简单存储服务 (Amazon S3),然后选择要使用的数据集

- AWS 账户详细信息 – 您可以决定管道应在哪个区域运行以及应使用哪个角色

- 特定于步骤的配置 – 对于管道中的每个步骤,您可以指定详细信息,例如要使用的实例的数量和类型以及相关参数

以下代码显示了示例配置文件:

config.ini 是由 Git 管理的版本控制文件,代表成功运行训练管道所需的最低配置。在开发过程中,可以使用不受版本控制的本地配置文件。这些本地配置文件只需要包含与特定运行相关的设置,从而引入灵活性而不复杂。管道创建客户端旨在处理多个配置文件,最新的配置文件优先于之前的设置。

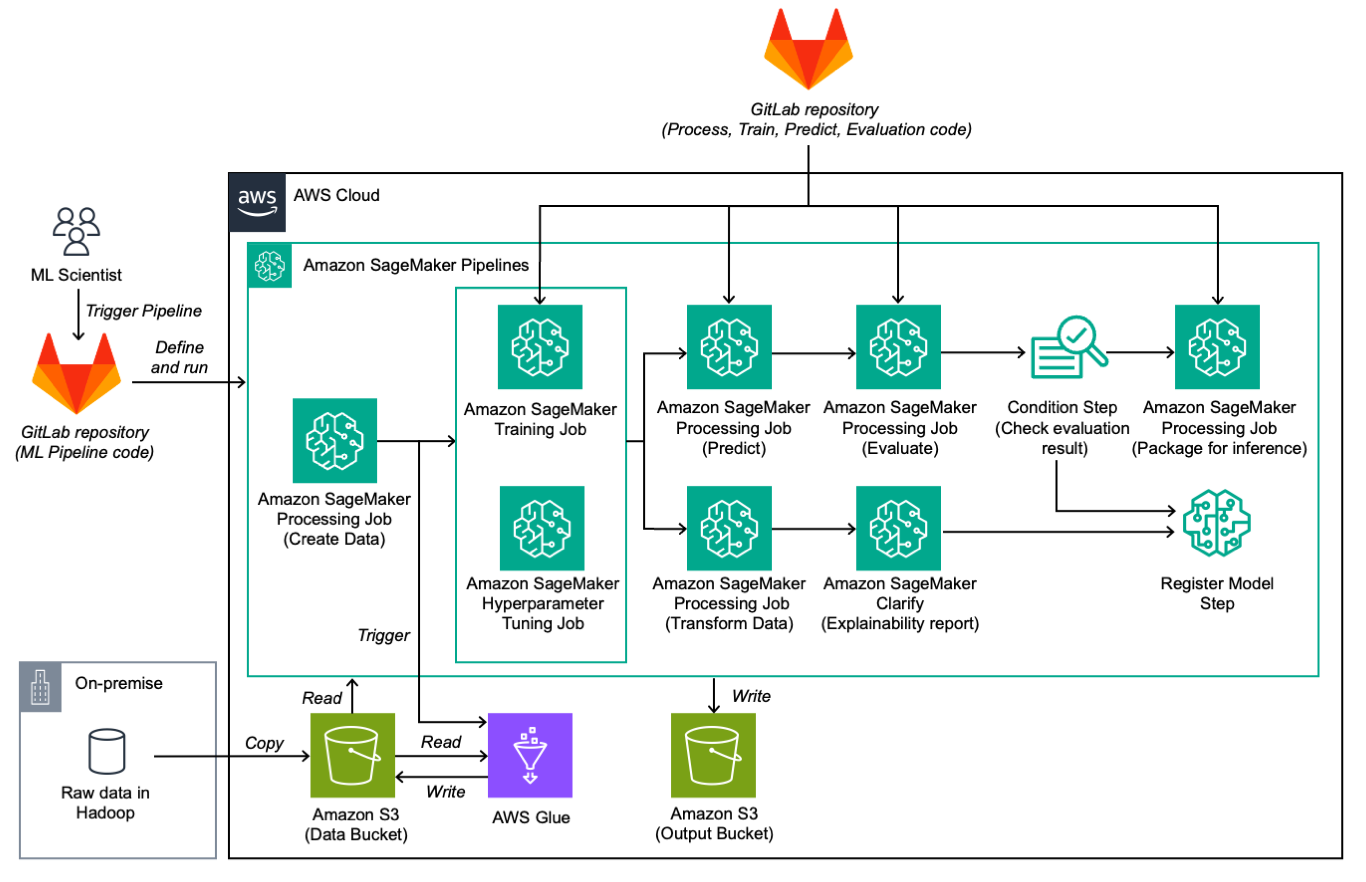

SageMaker 管道步骤

管道分为以下步骤:

- 训练和测试数据准备 – TB 级的原始数据被复制到 S3 存储桶,并使用 AWS胶水 用于 Spark 处理的作业,从而对数据进行结构化和格式化以实现兼容性。

- 培训 – 训练步骤使用 TensorFlow 估算器进行 SageMaker 训练作业。使用 Horovod 以分布式方式进行训练,生成的模型工件存储在 Amazon S3 中。对于超参数调整,可以启动超参数优化 (HPO) 作业,根据目标指标选择最佳模型。

- 预测 – 在此步骤中,SageMaker 处理作业使用存储的模型工件进行预测。此过程在可用计算机上并行运行,预测结果存储在 Amazon S3 中。

- 评估 – PySpark 处理作业使用自定义 Spark 脚本评估模型。然后评估报告存储在 Amazon S3 中。

- Condition – 评估后,就模型的质量做出决定。该决定基于配置文件中定义的条件度量。如果评价是肯定的,则该模型被注册为已批准;否则,将被登记为拒绝。在这两种情况下,评估和可解释性报告(如果生成)都会记录在模型注册表中。

- 用于推理的封装模型 – 使用处理作业,如果评估结果是肯定的,则将模型打包并存储在 Amazon S3 中,并准备好上传到内部 ML 门户。

- 说明 – SageMaker Clarify 生成可解释性报告。

使用两个不同的存储库。第一个存储库包含 ML 管道的定义和构建代码,第二个存储库包含每个步骤中运行的代码,例如处理、训练、预测和评估。这种双存储库方法可实现更大的模块化,并使科学和工程团队能够独立迭代 ML 代码和 ML 管道组件。

下图说明了解决方案的工作流程。

自动模型调整

训练 ML 模型需要采用多次训练实验的迭代方法来构建健壮且高性能的最终模型以供业务使用。机器学习科学家必须选择适当的模型类型,构建正确的输入数据集,并在训练期间调整控制模型学习过程的超参数集。

为模型训练过程选择合适的超参数值可以显着影响模型的最终性能。但是,没有唯一或定义的方法来确定哪些值适合特定用例。大多数时候,机器学习科学家需要使用稍微不同的超参数集运行多个训练作业,观察模型训练指标,然后尝试为下一次迭代选择更有希望的值。这种调整模型性能的过程也称为超参数优化 (HPO),有时可能需要数百次实验。

Ranking 团队过去常常在本地环境中手动执行 HPO,因为他们只能并行启动数量非常有限的训练作业。因此,他们必须顺序运行 HPO,手动测试和选择超参数值的不同组合,并定期监控进度。这延长了模型开发和调整过程,并限制了在可行时间内运行的 HPO 实验的总数。

迁移到 AWS 后,Ranking 团队能够使用 SageMaker 的自动模型调整 (AMT) 功能。 AMT 使 Ranking ML 科学家能够在感兴趣的超参数范围内自动启动数百个训练作业,以根据所选指标找到最终模型的最佳性能版本。 Ranking 团队现在可以在四种不同的自动调整策略中选择超参数:

- 网格搜索 – AMT 将期望所有超参数都是分类值,并且它将针对每个不同的分类组合启动训练作业,探索整个超参数空间。

- 随机搜索 – AMT 将在提供的范围内随机选择超参数值组合。由于不同训练作业和参数值选择之间不存在依赖性,因此可以使用该方法启动多个并行训练作业,从而加快最佳参数选择过程。

- 贝叶斯优化 – AMT 使用贝叶斯优化实现来猜测最佳的超参数值集,将其视为回归问题。它将考虑之前测试的超参数组合及其对新参数选择的模型训练作业的影响,通过更少的实验优化更智能的参数选择,但它也将仅按顺序启动训练作业,以便始终能够从之前的训练中学习。

- 超频带 – AMT 将使用其正在运行的训练作业的中间和最终结果,通过超参数配置动态地将资源重新分配给训练作业,这些配置显示出更有希望的结果,同时自动停止那些表现不佳的结果。

SageMaker 上的 AMT 使 Ranking 团队能够首次运行多个并行实验、使用自动调优策略并在几天内执行两位数的训练作业运行,从而减少模型开发的超参数调优过程所花费的时间,这在现场是不可行的。

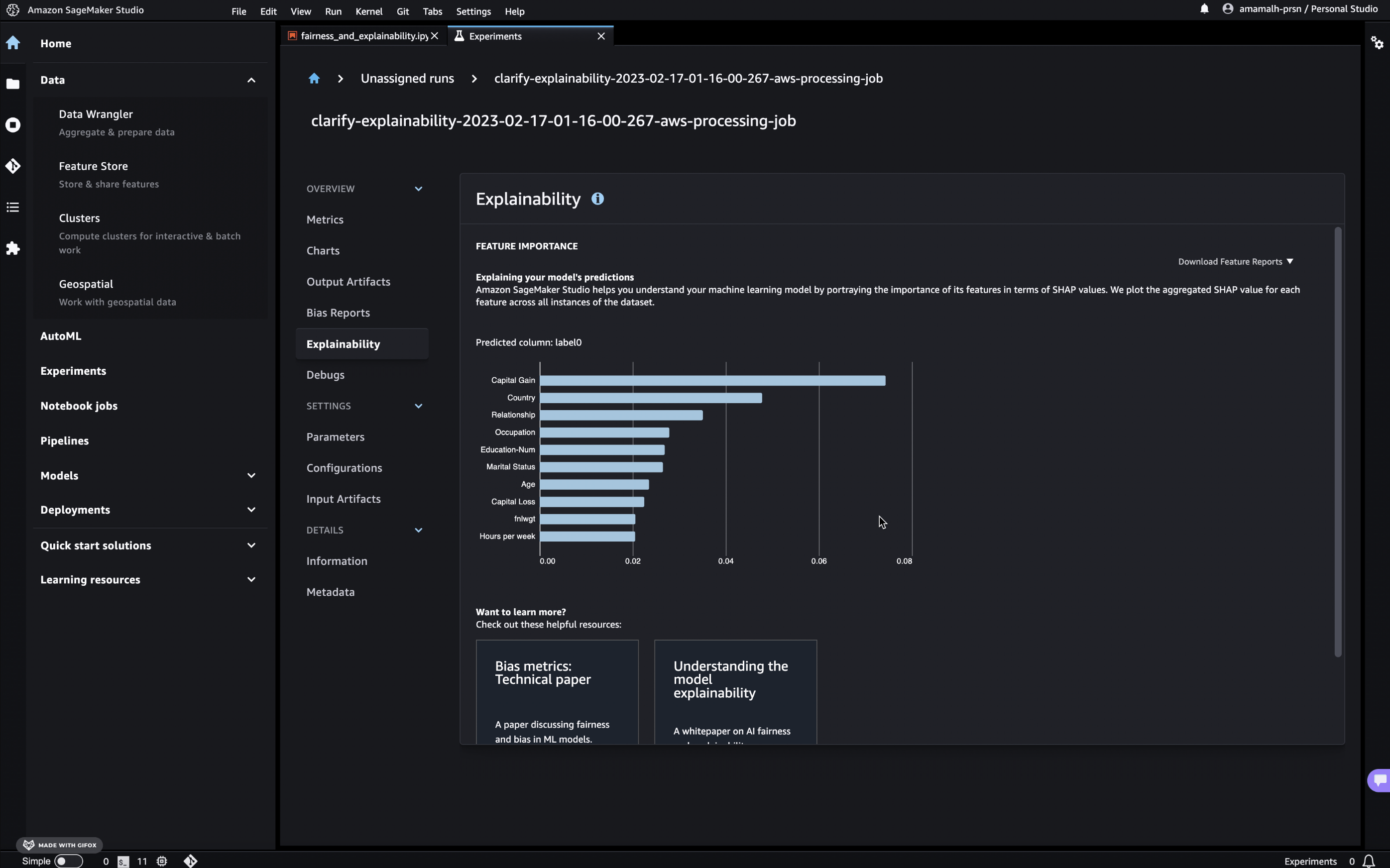

使用 SageMaker Clarify 进行模型可解释性

模型可解释性使 ML 从业者能够为特征工程和选择决策提供有价值的见解,从而了解其 ML 模型的性质和行为,从而提高模型预测的质量。排名团队希望通过两种方式评估他们的可解释性见解:了解特征输入如何影响整个数据集的模型输出(全局可解释性),并且还能够发现输入特征对感兴趣的数据点的特定模型预测的影响(本地可解释性)。借助这些数据,Ranking ML 科学家可以就如何进一步提高模型性能做出明智的决策,并解释模型偶尔会提供的具有挑战性的预测结果。

SageMaker Clarify 使您能够使用以下方式生成模型可解释性报告 Shapley 加法解释 (SHAP) 在 SageMaker 上训练模型时,支持全局和本地模型的可解释性。除了模型可解释性报告之外,SageMaker Clarify 还支持对训练前偏差指标、训练后偏差指标和部分依赖图运行分析。该作业将作为 AWS 账户中的 SageMaker 处理作业运行,并直接与 SageMaker 管道集成。

全局可解释性报告将在作业输出中自动生成并显示在 亚马逊SageMaker Studio 环境作为训练实验运行的一部分。如果此模型随后在 SageMaker 模型注册表中注册,则该报告将另外链接到模型工件。使用这两个选项,排名团队能够轻松追踪不同的模型版本及其行为变化。

为了探索输入特征对单个预测(局部可解释性值)的影响,排名团队启用了参数 save_local_shap_values 在 SageMaker Clarify 作业中,并能够从 S3 存储桶加载它们,以便在 SageMaker Studio 的 Jupyter 笔记本中进行进一步分析。

前面的图像显示了任意 ML 模型的模型可解释性的示例。

培训优化

深度学习 (DL) 的兴起导致机器学习越来越依赖计算能力和大量数据。机器学习从业者在训练这些复杂模型时通常面临有效利用资源的障碍。当您在大型计算集群上运行训练时,优化资源利用率会出现各种挑战,包括 I/O 瓶颈、内核启动延迟、内存限制和未充分利用的资源等问题。如果训练作业的配置没有针对效率进行微调,这些障碍可能会导致硬件使用不理想、训练持续时间延长,甚至训练运行不完整。这些因素增加了项目成本并延迟了工期。

对 CPU 和 GPU 使用情况进行分析有助于了解这些低效率问题,确定模型中各种 TensorFlow 操作的硬件资源消耗(时间和内存),解决性能瓶颈,并最终使模型运行得更快。

排名团队使用了框架分析功能 Amazon SageMaker调试器 (现已弃用,取而代之的是 Amazon SageMaker 分析器)来优化这些培训工作。这使您可以跟踪 CPU 和 GPU 上的所有活动,例如 CPU 和 GPU 利用率、GPU 上的内核运行、CPU 上的内核启动、同步操作、跨 GPU 的内存操作、内核启动和相应运行之间的延迟以及 CPU 之间的数据传输和 GPU。

排名团队还使用了 TensorFlow 分析器 的特点 张量板,这进一步帮助分析了 TensorFlow 模型训练。 SageMaker 现在是 与 TensorBoard 进一步集成 并将 TensorBoard 的可视化工具引入 SageMaker,并与 SageMaker 训练和领域集成。 TensorBoard 允许您使用 TensorBoard 可视化插件执行模型调试任务。

借助这两个工具,Ranking 团队优化了 TensorFlow 模型,能够识别瓶颈,并将 CPU 上的平均训练步骤时间从 350 毫秒减少到 140 毫秒,GPU 上从 170 毫秒减少到 70 毫秒,加速了 60%和 59%。

业务成果

迁移工作的重点是增强可用性、可扩展性和弹性,这共同将 ML 环境提升到了卓越运营的新水平,具体表现为模型训练频率的增加、故障的减少、训练时间的优化以及先进的 ML 功能。

模型训练频率和失败

每月模型训练作业的数量增加了五倍,导致模型优化的频率显着提高。此外,新的机器学习环境还降低了管道运行的故障率,从大约 50% 下降到 20%。失败作业的处理时间大幅减少,从平均一个多小时减少到可以忽略不计的 5 秒。这极大地提高了运营效率并减少了资源浪费。

优化训练时间

通过基于 SageMaker 的 GPU 训练,迁移带来了效率提高。这一转变将模型训练时间减少到之前的五分之一。此前,深度学习模型的训练过程在CPU上消耗了大约60个小时;在 GPU 上,该时间被简化为大约 12 小时。这一改进不仅节省了时间,还加快了开发周期,从而实现更快的迭代和模型改进。

高级机器学习功能

迁移成功的关键是使用 SageMaker 功能集,包括超参数调整和模型可解释性。此外,迁移允许使用无缝实验跟踪 Amazon SageMaker实验,实现更有洞察力和富有成效的实验。

最重要的是,新的机器学习实验环境支持了现已投入生产的新模型的成功开发。该模型是深度学习而不是基于树,并且在在线模型性能方面引入了显着的改进。

结论

这篇文章概述了 AWS Professional Services 和 Booking.com 的合作,该合作实现了可扩展的 ML 框架,并成功缩短了排名团队的 ML 模型的上市时间。

Booking.com 的 Ranking 团队了解到,迁移到云和 SageMaker 已被证明是有益的,并且采用机器学习操作 (MLOps) 实践可以让他们的 ML 工程师和科学家专注于他们的技术并提高开发速度。该团队正在通过与 ML 从业者的会谈和专门会议来分享代码和功能,从而与 Booking.com 的整个 ML 社区分享所学到的知识和完成的工作。我们希望这篇文章可以作为分享知识的另一种方式。

AWS 专业服务已准备好帮助您的团队在 AWS 中开发可扩展且可用于生产的 ML。有关更多信息,请参阅 AWS专业服务 或通过您的客户经理取得联系。

作者简介

劳伦斯范德马斯 是 AWS Professional Services 的机器学习工程师。他与客户密切合作,在 AWS 上构建机器学习解决方案,专门从事分布式培训、实验和负责任的 AI,并且热衷于机器学习如何改变我们所知道的世界。

劳伦斯范德马斯 是 AWS Professional Services 的机器学习工程师。他与客户密切合作,在 AWS 上构建机器学习解决方案,专门从事分布式培训、实验和负责任的 AI,并且热衷于机器学习如何改变我们所知道的世界。

丹尼尔·扎吉瓦 是 AWS 专业服务的数据科学家。他专门为 AWS 客户开发可扩展的生产级机器学习解决方案。他的经验涵盖不同领域,包括自然语言处理、生成式人工智能和机器学习操作。

丹尼尔·扎吉瓦 是 AWS 专业服务的数据科学家。他专门为 AWS 客户开发可扩展的生产级机器学习解决方案。他的经验涵盖不同领域,包括自然语言处理、生成式人工智能和机器学习操作。

科斯蒂亚·科夫曼 是 Booking.com 的高级机器学习经理,领导搜索排名机器学习团队,监督 Booking.com 最广泛的机器学习系统。凭借个性化和排名方面的专业知识,他擅长利用尖端技术来增强客户体验。

科斯蒂亚·科夫曼 是 Booking.com 的高级机器学习经理,领导搜索排名机器学习团队,监督 Booking.com 最广泛的机器学习系统。凭借个性化和排名方面的专业知识,他擅长利用尖端技术来增强客户体验。

珍妮·托卡 是 Booking.com 搜索排名团队的高级机器学习工程师。她专门开发端到端的机器学习管道,其特点是效率、可靠性、可扩展性和创新。 Jenny 的专业知识使她的团队能够创建尖端的排名模型,每天为数百万用户提供服务。

珍妮·托卡 是 Booking.com 搜索排名团队的高级机器学习工程师。她专门开发端到端的机器学习管道,其特点是效率、可靠性、可扩展性和创新。 Jenny 的专业知识使她的团队能够创建尖端的排名模型,每天为数百万用户提供服务。

亚历山大·多克奇 是 AWS 专业服务的高级数据科学家。她喜欢支持客户在 AWS 上构建创新的 AI/ML 解决方案,并且对通过数据的力量实现业务转型感到兴奋。

亚历山大·多克奇 是 AWS 专业服务的高级数据科学家。她喜欢支持客户在 AWS 上构建创新的 AI/ML 解决方案,并且对通过数据的力量实现业务转型感到兴奋。

卢巴·普罗西瓦 是 AWS Professional Services 的项目经理。她专注于提供数据和 GenAI/ML 解决方案,使 AWS 客户能够最大化其业务价值并加快创新速度。

卢巴·普罗西瓦 是 AWS Professional Services 的项目经理。她专注于提供数据和 GenAI/ML 解决方案,使 AWS 客户能够最大化其业务价值并加快创新速度。

- SEO 支持的内容和 PR 分发。 今天得到放大。

- PlatoData.Network 垂直生成人工智能。 赋予自己力量。 访问这里。

- 柏拉图爱流。 Web3 智能。 知识放大。 访问这里。

- 柏拉图ESG。 碳, 清洁科技, 能源, 环境, 太阳能, 废物管理。 访问这里。

- 柏拉图健康。 生物技术和临床试验情报。 访问这里。

- Sumber: https://aws.amazon.com/blogs/machine-learning/how-booking-com-modernized-its-ml-experimentation-framework-with-amazon-sagemaker/

- :具有

- :是

- :不是

- :在哪里

- $UP

- 1

- 100

- 12

- 130

- 140

- 16

- 350

- 60

- 7

- 70

- a

- 对,能力--

- Able

- 关于

- 加快

- ACCESS

- 根据

- 账号管理

- 实现

- 横过

- 活动

- 行为

- 调整

- 增加

- 另外

- 高级

- 影响

- 后

- AI

- AI / ML

- 算法

- 所有类型

- 允许

- 允许

- 沿

- 还

- 时刻

- Amazon

- 亚马逊SageMaker

- 亚马逊网络服务

- 量

- 量

- an

- 检测值

- 和

- 另一个

- APIs

- 的途径

- 适当

- 批准

- 约

- 随意

- 保健

- 地区

- 出现

- 围绕

- AS

- 心愿

- At

- 自动表

- 自动

- 可用性

- 可使用

- AWS

- AWS专业服务

- 背部

- 基于

- 贝叶斯

- BE

- 因为

- 成为

- 行为

- 行为

- 行为

- 有利

- 受益

- 最佳

- 之间

- 偏见

- 预订

- Booking.com

- 都

- 瓶颈

- 带来

- 带

- 建立

- 建筑物

- 商业

- 但是

- by

- CAN

- 能力

- 案件

- 例

- Center

- 中心

- 挑战

- 挑战

- 更改

- 更改

- 改变

- 特征

- 选择

- 客户

- 密切

- 云端技术

- 码

- 编码

- 合作

- 合作

- 统

- COM的

- 组合

- 组合

- 结合

- 常用

- 社体的一部分

- 兼容性

- 兼容

- 复杂

- 复杂

- 复杂

- 组件

- 计算

- 计算能力

- 计算

- 流程条件

- 配置

- 考虑

- 由

- 约束

- 消费

- 消费

- 包含

- 包含

- 控制

- 正确

- 相应

- 成本

- 可以

- 手艺

- 创建信息图

- 创建

- 关键

- 习俗

- 顾客

- 合作伙伴

- 定制

- 前沿

- 尖端技术

- 周期

- data

- 资料准备

- 数据科学家

- 数据集

- 天

- 一年中的

- 决定

- 决定

- 决定

- 下降

- 专用

- 认为

- 深

- 深入学习

- 定义

- 定义

- 定义

- 延迟

- 延误

- 交付

- 交付

- 钻研

- 依赖

- 依赖

- 部署

- 部署

- 弃用

- 设计

- 详情

- 确定

- 开发

- 发达

- 发展

- 研发支持

- 图表

- 不同

- 直接

- 通过各种方式找到

- 显示

- 不同

- 分布

- 分布式培训

- 分

- 做

- 域名

- 完成

- 大幅

- 删除

- 为期

- ,我们将参加

- 动态

- 每

- 容易

- 效率

- 有效

- 工作的影响。

- 开始

- 如虎添翼

- enable

- 启用

- 使

- 使

- 包含

- 端至端

- 订婚

- 工程师

- 工程师

- 工程师

- 提高

- 加强

- 保证

- 整个

- 环境

- 时代

- 必要

- 评估

- 评估

- 甚至

- 所有的

- 每天

- 例子

- 追求卓越

- 兴奋

- 举例说明

- 现有

- 期望

- 加快

- 体验

- 体验

- 实验

- 实验

- 专门知识

- 说明

- 探索

- 探索

- 延长

- 扩展

- 延期

- 广泛

- 面部彩妆

- 面临

- 因素

- 失败

- 失败

- 失败

- false

- 快

- 赞成

- 可行

- 专栏

- 特征

- 反馈

- 少

- 文件

- 档

- 最后

- 终于

- 找到最适合您的地方

- (名字)

- 第一次

- 高度灵活

- 专注焦点

- 以下

- 针对

- 四

- 骨架

- 频率

- 频繁

- 止

- 进一步

- 此外

- 获得

- 生成

- 产生

- 产生

- 生成的

- 生成式人工智能

- 得到

- 混帐

- 全球

- 目标

- GPU

- 图形处理器

- 更大的

- 猜

- 民政事务总署

- 处理

- 硬件

- 驾驭

- 有

- he

- 帮助

- 帮助

- 帮助

- 这里

- 他的

- 抱有希望

- 小时

- HOURS

- 创新中心

- How To

- 但是

- HTML

- HTTP

- HTTPS

- 数百

- 栏

- 超参数优化

- 超参数调整

- 鉴定

- if

- 说明

- 图片

- 即时

- 影响力故事

- 履行

- 重要的

- 改善

- 改善

- 改进

- 改善

- 提高

- in

- 包括

- 包含

- 增加

- 增加

- 增加

- 日益

- 独立地

- 行业中的应用:

- 效率低下

- 影响

- 信息

- 通知

- 基础设施

- 启动

- 创新

- 創新

- 创新

- 输入

- 输入

- 内

- 有见地

- 可行的洞见

- 即食类

- 集成

- 集成

- 兴趣

- 内部

- 成

- 介绍

- 介绍

- 参与

- 问题

- IT

- 迭代

- 迭代

- 它的

- 工作

- 工作机会

- 旅程

- JPG

- 键

- 知道

- 知识

- 已知

- 不足

- 语言

- 大

- 最新

- 发射

- 推出

- 启动

- 领导者

- 领导

- 学习用品

- 知道

- 学习

- 导致

- Level

- 借力

- 喜欢

- 有限

- 链接

- 加载

- 本地

- 长

- 看

- 看起来像

- 机

- 机器学习

- 机

- 制成

- 使

- 管理

- 经理

- 方式

- 手动

- 生产力

- 意味着

- 内存

- 方法

- 公

- 指标

- 迁移

- 移民

- 百万

- 毫秒

- 最小

- 分钟

- ML

- 多播

- 模型

- 模型

- 现代化

- 模块

- 显示器

- 每月一次

- 更多

- 最先进的

- 移动

- 移动

- 许多

- 多

- 姓名

- 自然

- 自然语言处理

- 自然

- 需求

- 全新

- 下页

- 没有

- 现在

- 数

- 目标

- 观察

- 障碍

- of

- 这一点在线下监测数字化产品的影响方面尤为明显。

- 经常

- on

- 点播

- 一

- 在线

- 仅由

- 操作

- 运营

- 最佳

- 优化

- 优化

- 优化

- 优化

- 追求项目的积极优化

- 附加选项

- or

- 其他名称

- 除此以外

- 我们的

- 输出

- 产量

- 输出

- 超过

- 最划算

- 监督

- 简介

- 己

- 步伐

- 包

- συσκευάζονται

- 并行

- 参数

- 部分

- 多情

- 演出

- 性能

- 执行

- 个性化

- 管道

- 关键的

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 扮演

- 插件

- 点

- 门户网站

- 积极

- 帖子

- 功率

- 做法

- 前

- 预测

- 预测

- 预测

- 准备

- 以前

- 先前

- 市场问题

- 过程

- 处理

- 过程

- 处理

- 生产

- 生产力

- 所以专业

- 本人简介

- 剖析

- 进展

- 项目

- 有希望

- 证明

- 提供

- 提供

- 优

- 质量

- 很快

- 范围

- 排行

- 急速

- 率

- 宁

- 原

- 达到

- 准备

- 接收

- 认识

- 推荐

- 记录

- 减少

- 减少

- 减少

- 减少

- 关于

- 地区

- 寄存器

- 在相关机构注册的

- 注册处

- 经常

- 被拒绝..

- 相应

- 可靠性

- 报告

- 业务报告

- 知识库

- 代表

- 要求

- 必须

- 需要

- 解决

- 资源

- 资源

- 分别

- 提供品牌战略规划

- 导致

- 导致

- 成果

- 上升

- 健壮

- 角色

- 运行

- 运行

- 运行

- sagemaker

- SageMaker管道

- 可扩展性

- 可扩展性

- 鳞片

- 科学

- 科学家

- 科学家

- 脚本

- 无缝的

- 搜索

- 其次

- 秒

- 看到

- 寻求

- 选择

- 选择

- 选择

- 前辈

- 服务

- 服务

- 特色服务

- 招生面试

- 集

- 套数

- 设置

- 几个

- Share

- 共享

- 她

- 转移

- 应该

- 显示

- 作品

- 显著

- 简易

- 单

- 略有不同

- 聪明

- 光滑

- So

- 方案,

- 解决方案

- 东西

- 太空

- 火花

- 专业

- 具体的

- 速度

- 花费

- 步

- 步骤

- 停车

- 存储

- 存储

- 策略

- 精简

- 非常

- 结构化

- 工作室

- 次优

- 成功

- 成功

- 顺利

- 这样

- 支持

- 支持

- 支持

- 同步。

- 系统

- 量身定制

- 服用

- 会谈

- 任务

- 团队

- 队

- 专业技术

- tensorflow

- test

- 测试

- 测试

- 比

- 这

- 世界

- 其

- 他们

- 然后

- 那里。

- 从而

- 因此

- 博曼

- 他们

- Free Introduction

- 那些

- 蓬勃发展

- 通过

- 次

- 时间表

- 时

- 至

- 工具

- 触摸

- 向

- 跟踪时

- 跟踪

- 培训

- 产品培训

- 培训

- 转让

- 转换

- 过渡

- 旅行

- 旅游业

- 旅客

- 治疗

- true

- 尝试

- 调音

- 转

- 二

- 类型

- 最终

- 理解

- 独特

- 用法

- 使用

- 用例

- 用过的

- 用户友好

- 用户

- 使用

- 运用

- 利用

- 有价值

- 折扣值

- 价值观

- 各个

- 广阔

- 速度

- 版本

- 版本

- 非常

- 可视化

- 等待

- 通缉

- 是

- 方法..

- 方法

- we

- 卷筒纸

- Web服务

- 为

- ,尤其是

- 这

- 而

- WHO

- 将

- 中

- 也完全不需要

- 工作

- 工作流程

- 合作

- 世界

- 全世界

- 将

- 完全

- 您一站式解决方案

- 和风网