介绍

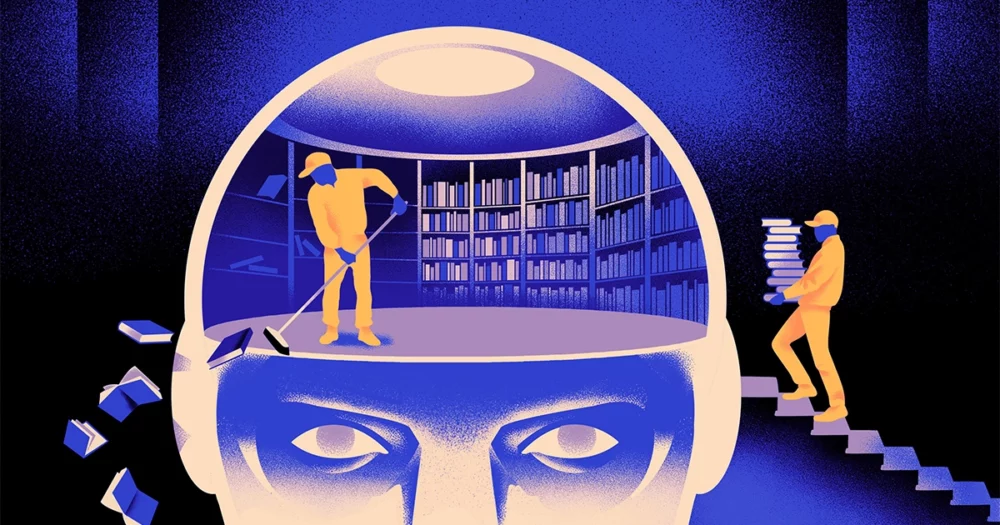

一组计算机科学家创建了一个 更灵活、更灵活的类型 的机器学习模型。诀窍是:它必须定期忘记它所知道的事情。虽然这种新方法不会取代支撑最大应用程序的庞大模型,但它可以更多地揭示这些程序如何理解语言。

这项新研究标志着“该领域的重大进步”, 权济权,韩国基础科学研究所的人工智能工程师。

当今使用的人工智能语言引擎主要由 人工神经网络。网络中的每个“神经元”都是一个数学函数,它接收来自其他此类神经元的信号,运行一些计算并通过多层神经元发送信号。最初,信息流或多或少是随机的,但通过训练,神经元之间的信息流随着网络适应训练数据而改善。例如,如果人工智能研究人员想要创建一个双语模型,她会用大量两种语言的文本来训练该模型,这将调整神经元之间的连接,从而将一种语言的文本与等效的文本相关联。对方的话。

但这个训练过程需要大量的计算能力。如果模型不能很好地工作,或者用户的需求后来发生变化,就很难适应它。 “假设你有一个包含 100 种语言的模型,但想象一下你想要的一种语言没有被覆盖,”说 米克尔·阿泰克斯是这项新研究的合著者,也是人工智能初创公司 Reka 的创始人。 “你可以从头开始,但这并不理想。”

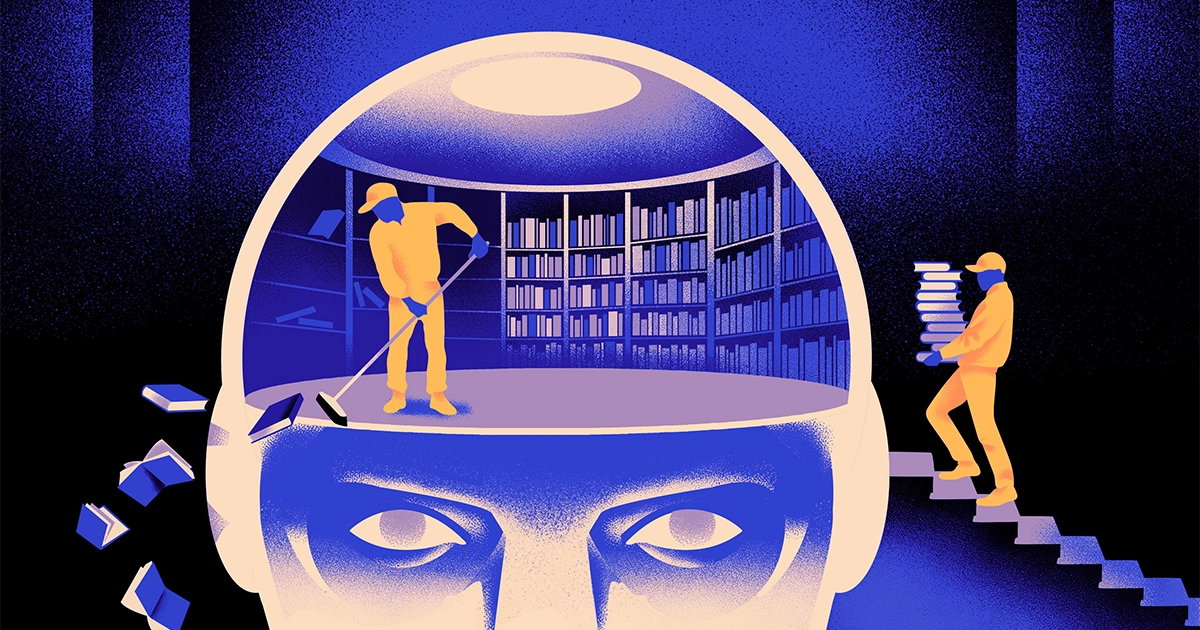

Artetxe 和他的同事试图规避这些限制。 几年前、Artetxe 和其他人用一种语言训练了一个神经网络,然后删除了它对单词构建块(称为标记)的了解。这些存储在神经网络的第一层,称为嵌入层。他们保留了模型的所有其他层。擦除第一种语言的标记后,他们在第二种语言上重新训练模型,用该语言的新标记填充嵌入层。

尽管模型包含不匹配的信息,但重新训练仍然有效:模型可以学习和处理新语言。研究人员推测,虽然嵌入层存储了该语言中使用的单词的特定信息,但网络的更深层次存储了有关人类语言背后的概念的更多抽象信息,从而帮助模型学习第二语言。

“我们生活在同一个世界。我们用不同的语言用不同的词来概念化相同的事物,” 陈一红,最近论文的主要作者。 “这就是为什么模型中有同样的高级推理。苹果是一种甜甜多汁的东西,而不仅仅是一个词。”

介绍

虽然这种遗忘方法是将新语言添加到已经训练的模型中的有效方法,但重新训练仍然要求很高——它需要大量的语言数据和处理能力。 Chen 建议进行调整:他们应该在第一轮训练期间定期重置嵌入层,而不是训练、擦除嵌入层,然后重新训练。 “通过这样做,整个模型就会习惯于重置,”Artetxe 说。 “这意味着当你想将模型扩展到另一种语言时,会更容易,因为这就是你一直在做的事情。”

研究人员采用了一种常用的语言模型,称为 罗伯塔,使用周期性遗忘技术对其进行训练,并将其与使用标准非遗忘方法训练的同一模型的性能进行比较。遗忘模型的表现比传统模型稍差,在一项常见的语言准确性衡量标准中,其得分为 85.1,而传统模型的得分为 86.1。然后,他们在其他语言上重新训练模型,使用的数据集小得多,只有 5 万个标记,而不是第一次训练时使用的 70 亿个标记。标准模型的准确率平均下降至 53.3,但遗忘模型仅下降至 62.7。

如果团队在再训练期间施加计算限制,遗忘模型也会表现得更好。当研究人员将训练长度从 125,000 步减少到 5,000 步时,遗忘模型的平均准确度下降到 57.8,而标准模型则骤降到 37.2,这并不比随机猜测更好。

介绍

研究小组得出的结论是,周期性遗忘似乎可以使模型总体上更好地学习语言。 “因为[他们]在训练过程中不断忘记和重新学习,所以以后向网络教授新东西变得更容易,”说 叶夫根尼·尼基申,魁北克深度学习研究中心 Mila 的研究员。它表明,当语言模型理解一种语言时,它们会在更深层次上进行理解,而不仅仅是单个单词的含义。

这种方法类似于我们大脑的工作方式。 “一般来说,人类记忆不太擅长准确存储大量详细信息。相反,人类倾向于记住我们经历的要点,进行抽象和推断。” 本杰明·利维(Benjamin Levy),旧金山大学的神经科学家。 “让人工智能具有更人性化的过程,比如适应性遗忘,是让人工智能获得更灵活表现的一种方法。”

除了解释理解的工作原理之外,Artetxe 希望更灵活的遗忘语言模型也能帮助将最新的人工智能突破带入更多语言。尽管人工智能模型擅长处理西班牙语和英语这两种具有充足训练材料的语言,但这些模型对于他的母语巴斯克语(西班牙东北部特有的当地语言)却不太擅长。 “大型科技公司的大多数模型都做得不好,”他说。 “使现有模型适应巴斯克语是正确的出路。”

陈也期待世界有更多AI之花绽放。 “我正在考虑一种情况,世界不需要一种大的语言模型。我们有很多,”她说。 “如果有一家制造语言模型的工厂,就需要这种技术。它有一个可以快速适应新领域的基本模型。”

- :具有

- :是

- :不是

- :在哪里

- ][p

- 000

- 1

- 100

- 125

- 7

- 70

- 8

- a

- 关于

- 摘要

- 准确

- 适应

- 自适应

- 适应

- 加

- 增加

- 推进

- 后

- AI

- AI模型

- 所有类型

- 单

- 已经

- 还

- 量

- an

- 和

- 另一个

- Apple

- 的途径

- 应用

- 保健

- AS

- At

- 作者

- 基地

- 基本包

- 因为

- 成为

- 很

- 背后

- 更好

- 之间

- 大

- 大科技

- 最大

- 亿

- 吹氣梢

- Bloom

- 都

- 突破

- 带来

- 建筑物

- 但是

- by

- 计算

- 被称为

- CAN

- Center

- 更改

- 陈

- 规避

- 合著者

- 同事

- 相当常见

- 常用

- 公司

- 相比

- 计算

- 一台

- 计算

- 计算能力

- 概念

- 总结

- 连接

- 包含

- 常规

- 可以

- 覆盖

- 创建信息图

- 创建

- 切

- data

- 数据集

- 下降

- 深

- 深入学习

- 更深

- 严格

- 详细

- DID

- 不同

- do

- 不会

- 做

- 域名

- 别

- 下降

- ,我们将参加

- 每

- 更容易

- 有效

- 嵌入

- 工程师

- 引擎

- 英语

- 整个

- 例子

- 现有

- 体验

- 延长

- 工厂

- 少数

- 部分

- 满

- (名字)

- 柔软

- 流

- 针对

- 向前

- 创办人

- 旧金山

- 止

- 功能

- 其他咨询

- 通常

- 得到

- GitHub上

- Go

- 非常好

- 处理

- 硬

- 有

- he

- 帮助

- 帮助

- 高水平

- 他的

- 希望

- 创新中心

- HTTPS

- 巨大

- 人

- 人性化

- 人类

- 理想

- if

- 想像

- 征收

- 提高

- in

- 个人

- 信息

- 初始

- 原来

- 代替

- 研究所

- IT

- 只是

- 保持

- 类

- 知道

- 韩国

- 语言

- 语言

- 大

- 后来

- 最新

- 层

- 层

- 铅

- 学习用品

- 学习

- 左

- 长度

- 减

- Level

- 各级

- 喜欢

- 限制

- 范围

- 生活

- 本地

- LOOKS

- 占地

- 机

- 机器学习

- 杂志

- 使

- 制作

- 许多

- 物料

- 数学的

- 含义

- 手段

- 衡量

- 内存

- 可能

- 百万

- 模型

- 模型

- 更多

- 大多

- 许多

- 多

- 必须

- 本地人

- 需求

- 需要

- 网络

- 神经

- 神经网络

- 神经元

- 全新

- 没有

- of

- on

- 一

- 仅由

- or

- 其他名称

- 其它

- 我们的

- 超过

- 己

- 纸类

- 性能

- 定期

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 暴跌

- 功率

- 供电

- 过程

- 过程

- 处理

- 处理能力

- 训练课程

- 量子杂志

- 魁北克

- 很快

- 随机

- 宁

- 接收

- 接收

- 最近

- 纪念

- 必须

- 研究

- 研究员

- 研究人员

- 揭示

- 圆

- 运行

- 说

- 同

- 圣

- 旧金山

- 对工资盗窃

- 科学

- 科学家

- 得分了

- 划伤

- 其次

- 似乎

- 可选择的

- 发送

- 套数

- 她

- 应该

- 信号

- 显著

- 类似

- 情况

- 小

- So

- 一些

- 东西

- 南部

- South Korea

- 西班牙

- 西班牙语

- 具体的

- 标准

- 开始

- 启动

- 步骤

- 仍

- 存储

- 存储

- 这样

- 提示

- 甜

- 需要

- 教诲

- 团队

- 科技

- 高科技公司

- 技术

- 专业技术

- 易于

- 文本

- 比

- 这

- 信息

- 世界

- 其

- 他们

- 然后

- 博曼

- 他们

- 事

- 思维

- Free Introduction

- 虽然?

- 通过

- 至

- 今晚

- 令牌

- 了

- 培训

- 熟练

- 产品培训

- 招

- 尝试

- 拧

- 二

- 理解

- 理解

- 大学

- 使用

- 用过的

- 运用

- 非常

- 想

- 希望

- 是

- 方法..

- we

- 网页

- 井

- 什么是

- ,尤其是

- 这

- 而

- 为什么

- Word

- 话

- 工作

- 工作

- 合作

- 世界

- 更坏

- 将

- 年

- 完全

- 和风网