随着客户数字化足迹的扩大以及这些数字资产的业务影响力的增加,客户在基础设施和应用程序资源中面临着越来越多的安全威胁和漏洞。常见的网络安全挑战有两个:

- 使用来自不同格式和模式的数字资源的日志,并根据这些日志自动分析威胁结果。

- 无论日志来自 Amazon Web Services (AWS)、其他云提供商、本地还是边缘设备,客户都需要集中和标准化安全数据。

此外,用于识别安全威胁的分析必须能够扩展和发展,以满足威胁参与者、安全向量和数字资产不断变化的形势。

解决这种复杂安全分析场景的一种新颖方法是将安全数据的摄取和存储结合起来,使用 亚马逊安全湖 并使用机器学习 (ML) 分析安全数据 亚马逊SageMaker。 Amazon Security Lake 是一项专门构建的服务,可自动将组织的安全数据从云和本地源集中到存储在您的 AWS 账户中的专门构建的数据湖中。 Amazon Security Lake 可自动执行安全数据的集中管理,规范来自集成 AWS 服务和第三方服务的日志,并通过可自定义的保留来管理数据的生命周期,并自动执行存储分层。 Amazon Security Lake 摄取日志文件 开放网络安全模式框架 (OCSF) 格式,支持 Cisco Security、CrowdStrike、Palo Alto Networks 等合作伙伴以及来自 AWS 环境外部资源的 OCSF 日志。这种统一的模式简化了下游的消费和分析,因为数据遵循标准化的模式,并且可以通过最少的数据管道更改来添加新的源。将安全日志数据存储到 Amazon Security Lake 后,问题就变成了如何分析它。分析安全日志数据的有效方法是使用机器学习;具体来说,异常检测,检查活动和流量数据并将其与基线进行比较。基线定义了该环境中哪些活动在统计上是正常的。异常检测的范围超出了单个事件特征,并且可以通过定期重新训练来发展;然后可以根据优先重点和紧急程度对分类为异常或异常的流量采取行动。 Amazon SageMaker 是一项完全托管的服务,使客户能够利用完全托管的基础设施、工具和工作流程(包括为业务分析师提供的无代码产品)准备数据并为任何用例构建、训练和部署 ML 模型。 SageMaker 支持两种内置异常检测算法: 知识产权洞察 和 随机砍伐森林。您还可以使用 SageMaker 创建自己的自定义异常值检测模型 算法 源自多个机器学习框架。

在本文中,您将了解如何准备来自 Amazon Security Lake 的数据,然后使用 SageMaker 中的 IP Insights 算法训练和部署 ML 模型。该模型可识别异常网络流量或行为,然后将其组成更大的端到端安全解决方案的一部分。如果用户从异常服务器或在异常时间登录,此类解决方案可以调用多重身份验证 (MFA) 检查;如果有来自新 IP 地址的可疑网络扫描,则通知工作人员;如果网络异常,则向管理员发出警报使用协议或端口,或使用其他数据源(例如 亚马逊GuardDuty 和 IP 声誉评分来对威胁发现进行排名。

解决方案概述

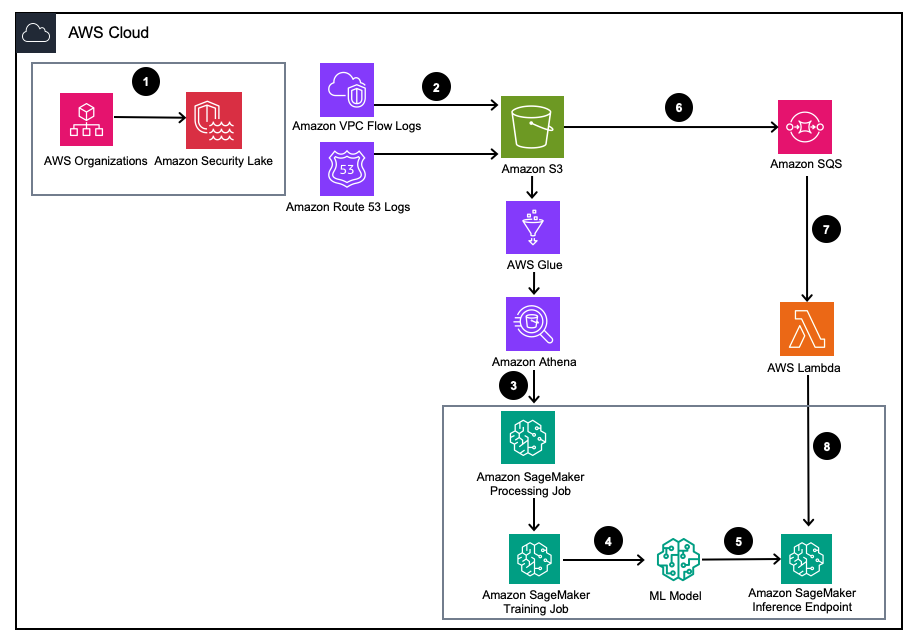

图 1 – 解决方案架构

- 启用 Amazon Security Lake: AWS组织 适用于 AWS 账户、AWS 区域和外部 IT 环境。

- 设置 Security Lake 源 亚马逊虚拟私有云(Amazon VPC) 流日志和 亚马逊 Route53 DNS 日志记录到 Amazon Security Lake S3 存储桶。

- 使用 SageMaker 处理作业处理 Amazon Security Lake 日志数据以设计功能。使用 亚马逊雅典娜 从中查询结构化 OCSF 日志数据 亚马逊简单存储服务(Amazon S3) 通过 AWS胶水 由 AWS LakeFormation 管理的表。

- 使用使用已处理的 Amazon Security Lake 日志的 SageMaker 训练作业来训练 SageMaker ML 模型。

- 将经过训练的 ML 模型部署到 SageMaker 推理端点。

- 将新的安全日志存储在 S3 存储桶中,并将事件排队 Amazon Simple Queue Service(Amazon SQS).

- 订阅一个 AWS Lambda 功能到 SQS 队列。

- 使用 Lambda 函数调用 SageMaker 推理端点,将安全日志实时分类为异常。

先决条件

要部署该解决方案,您必须首先满足以下先决条件:

- 启用 Amazon Security Lake 在您的组织内或启用了 VPC 流日志和 Route 53 解析程序日志的单个账户中。

- 确保 AWS身份和访问管理(IAM) SageMaker 处理作业和笔记本使用的角色已被授予 IAM 策略,包括 Amazon Security Lake 订阅者查询访问权限 用于由 AWS Lake Formation 管理的托管 Amazon Security Lake 数据库和表。此处理作业应从分析或安全工具帐户内运行,以保持符合 AWS 安全参考架构 (AWS SRA).

- 确保 Lambda 函数使用的 IAM 角色已被授予 IAM 策略,包括 Amazon Security Lake 订阅者数据访问权限.

部署解决方案

要设置环境,请完成以下步骤:

- 启动一个 SageMaker 工作室 或 SageMaker Jupyter 笔记本

ml.m5.large实例。 请注意: 实例大小取决于您使用的数据集。 - 克隆 GitHub 知识库.

- 打开笔记本

01_ipinsights/01-01.amazon-securitylake-sagemaker-ipinsights.ipy. - 实施 提供 IAM 政策 和 对应的IAM信任策略 使您的 SageMaker Studio Notebook 实例能够访问 S3、Lake Formation 和 Athena 中的所有必要数据。

本博客将逐步介绍笔记本中部署到您的环境中后的相关代码部分。

安装依赖项并导入所需的库

使用以下代码安装依赖项,导入所需的库,并创建数据处理和模型训练所需的 SageMaker S3 存储桶。所需的库之一, awswrangler, 是一个 适用于 pandas 数据框的 AWS 开发工具包 用于查询 AWS Glue 数据目录中的相关表并将结果本地存储在数据帧中。

查询 Amazon Security Lake VPC 流日志表

这部分代码使用适用于 pandas 的 AWS 开发工具包来查询与 VPC 流日志相关的 AWS Glue 表。如先决条件中所述,Amazon Security Lake 表由以下人员管理 AWS湖形成,因此必须向 SageMaker 笔记本使用的角色授予所有适当的权限。此查询将拉取多天的 VPC 流日志流量。该博客开发过程中使用的数据集很小。根据您的使用案例的规模,您应该了解适用于 pandas 的 AWS 开发工具包的限制。在考虑 TB 规模时,您应该考虑 AWS SDK for pandas 支持 莫丁.

当您查看数据框时,您将看到单个列的输出,其中包含可以在以下位置找到的公共字段: 网络活动 (4001) OCSF 的类别。

将 Amazon Security Lake VPC 流日志数据标准化为 IP Insights 所需的训练格式。

IP Insights 算法要求训练数据为 CSV 格式并包含两列。第一列必须是与实体的唯一标识符相对应的不透明字符串。第二列必须是实体访问事件的 IPv4 地址(采用小数点表示法)。在本博客的示例数据集中,唯一标识符是与该博客关联的 EC2 实例的实例 ID。 instance_id 值范围内 dataframe。 IPv4 地址将从 src_endpoint。根据 Amazon Athena 查询的创建方式,导入的数据已经采用正确的格式来训练 IP Insights 模型,因此不需要额外的功能工程。如果您以其他方式修改查询,则可能需要合并其他特征工程。

查询并规范化 Amazon Security Lake Route 53 解析器日志表

正如您在上面所做的那样,笔记本的下一步将对 Amazon Security Lake Route 53 解析器表运行类似的查询。由于您将在此笔记本中使用所有符合 OCSF 的数据,因此 Route 53 解析器日志的任何功能工程任务与 VPC 流日志的功能工程任务保持相同。然后,您可以将两个数据帧组合成一个用于训练的数据帧。由于 Amazon Athena 查询以正确的格式在本地加载数据,因此不需要进一步的特征工程。

获取 IP Insights 训练图像并使用 OCSF 数据训练模型

在本笔记本的下一部分中,您将基于 IP Insights 算法训练 ML 模型并使用整合的 dataframe 来自不同类型日志的 OCSF。可以找到 IP Insights 超参数列表 此处。在下面的示例中,我们选择了输出性能最佳模型的超参数,例如 epoch 为 5,vector_dim 为 128。由于我们样本的训练数据集相对较小,因此我们使用了 ml.m5.large 实例。应根据您的目标指标和训练数据大小来选择超参数和训练配置(例如实例计数和实例类型)。您可以在 Amazon SageMaker 中利用一项功能来找到模型的最佳版本:Amazon SageMaker 自动模型调整 在一系列超参数值中搜索最佳模型。

部署经过训练的模型并使用有效和异常流量进行测试

训练模型后,您可以将模型部署到 SageMaker 终端节点,并发送一系列唯一标识符和 IPv4 地址组合来测试您的模型。这部分代码假设您已将测试数据保存在 S3 存储桶中。测试数据是一个 .csv 文件,其中第一列是实例 ID,第二列是 IP。建议测试有效和无效数据以查看模型的结果。以下代码部署您的端点。

现在您的端点已部署,您现在可以提交推理请求来确定流量是否可能存在异常。下面是格式化数据的示例。在这种情况下,第一列标识符是实例 ID,第二列是关联的 IP 地址,如下所示:

获得 CSV 格式的数据后,您可以通过从 S3 存储桶读取 .csv 文件来使用代码提交数据进行推理:

IP Insights 模型的输出提供了对 IP 地址和在线资源的统计预期程度的衡量。然而,此地址和资源的范围是无限的,因此需要考虑如何确定实例 ID 和 IP 地址组合是否应被视为异常。

在前面的示例中,向模型提交了四种不同的标识符和 IP 组合。前两个组合是根据训练集预期的有效实例 ID 和 IP 地址组合。第三种组合具有正确的唯一标识符,但在同一子网内具有不同的 IP 地址。由于嵌入与训练数据略有不同,模型应确定存在适度的异常。第四个组合具有有效的唯一标识符,但具有环境中任何 VPC 内不存在的子网的 IP 地址。

请注意: 正常和异常流量数据将根据您的具体用例而变化,例如:如果您想监控外部和内部流量,您将需要一个与每个 IP 地址对齐的唯一标识符以及一个生成外部标识符的方案。

要确定确定流量是否异常的阈值,可以使用已知的正常和异常流量来完成。中概述的步骤 这个样本笔记本 如下面所述:

- 构建一个测试集来代表正常流量。

- 将异常流量添加到数据集中。

- 绘制分布图

dot_product模型在正常流量和异常流量上的得分。 - 选择区分正常子集和异常子集的阈值。该值基于您的误报容忍度

设置对新 VPC 流日志流量的持续监控。

为了演示如何以主动的方式将这个新的 ML 模型与 Amazon Security Lake 结合使用,我们将配置一个 Lambda 函数以在每个 PutObject Amazon Security Lake 托管存储桶内的事件,特别是 VPC 流日志数据。 Amazon Security Lake 中有一个订阅者的概念,它使用来自 Amazon Security Lake 的日志和事件。响应新事件的 Lambda 函数必须被授予数据访问订阅。当对象写入 Security Lake 存储桶时,数据访问订阅者会收到源的新 Amazon S3 对象通知。订阅者可以直接访问 S3 对象,并通过订阅终端节点或通过轮询 Amazon SQS 队列接收新对象的通知。

- 打开 安全湖控制台.

- 在导航窗格中,选择 认购.

- 在订阅者页面上,选择 创建订阅者.

- 对于订阅者详细信息,请输入

inferencelambda订户姓名 和一个可选的 课程描述. - 区域 会自动设置为您当前选择的 AWS 区域并且无法修改。

- 针对 日志和事件源,选择 特定日志和事件源 并选择 VPC 流日志和 Route 53 日志

- 针对 数据存取方式,选择 S3.

- 针对 订户凭证,提供 Lambda 函数将驻留的账户的 AWS 账户 ID 以及用户指定的 外部ID.

请注意: 如果在帐户内本地执行此操作,则无需拥有外部 ID。 - 创建.

创建 Lambda 函数

要创建和部署 Lambda 函数,您可以完成以下步骤或部署预构建的 SAM 模板 01_ipinsights/01.02-ipcheck.yaml 在 GitHub 存储库中。 SAM 模板要求您提供 SQS ARN 和 SageMaker 终端节点名称。

- 在Lambda控制台上,选择 创建功能.

- 从头开始.

- 针对 功能名称,输入

ipcheck. - 针对 运行时,选择 Python的3.10.

- 针对 建筑, 选择 x86_64.

- 针对 执行角色, 选择 创建具有 Lambda 权限的新角色.

- 创建函数后,输入内容 ipcheck.py 来自 GitHub 存储库的文件。

- 在导航窗格中,选择 环境变量.

- 编辑.

- 添加环境变量.

- 对于新的环境变量,输入

ENDPOINT_NAME对于值,输入在 SageMaker 端点部署期间输出的端点 ARN。 - 选择 保存.

- 部署.

- 在导航窗格中,选择 配置.

- 选择 触发器.

- 选择 添加触发器.

- 下 选择来源,选择 SQS.

- 下 SQS队列,输入 Security Lake 创建的主 SQS 队列的 ARN。

- 选中复选框 激活触发器.

- 选择 地址.

验证 Lambda 发现

- 打开 亚马逊 CloudWatch 控制台.

- 在左侧窗格中,选择 日志组.

- 在搜索栏中输入 ipcheck,然后选择名称为 ipcheck 的日志组

/aws/lambda/ipcheck. - 选择下面的最新日志流 日志流.

- 在日志中,您应该会看到每个新 Amazon Security Lake 日志的结果如下所示:

{'predictions': [{'dot_product': 0.018832731992006302}, {'dot_product': 0.018832731992006302}]}

此 Lambda 函数持续分析 Amazon Security Lake 摄取的网络流量。这允许您构建机制,以便在违反指定阈值时通知您的安全团队,这将表明您的环境中存在异常流量。

净化

当您完成此解决方案的试验并避免向您的账户收取费用时,请通过删除 S3 存储桶、SageMaker 终端节点、关闭附加到 SageMaker Jupyter 笔记本的计算、删除 Lambda 函数以及禁用 Amazon Security 来清理您的资源您帐户中的湖。

结论

在本文中,您了解了如何准备来自 Amazon Security Lake 的网络流量数据以进行机器学习,然后使用 Amazon SageMaker 中的 IP Insights 算法训练和部署 ML 模型。 Jupyter Notebook 中概述的所有步骤都可以在端到端 ML 管道中复制。您还实现了一个 AWS Lambda 函数,该函数使用新的 Amazon Security Lake 日志并根据经过训练的异常检测模型提交推论。当满足特定阈值时,AWS Lambda 收到的 ML 模型响应可以主动向安全团队通知异常流量。通过让您的安全团队参与循环审查来标记被识别为异常的流量是否是误报,可以实现模型的持续改进。然后可以将其添加到您的训练集中,也可以添加到您的 正常 确定经验阈值时的流量数据集。该模型可以识别潜在的异常网络流量或行为,从而可以将其作为更大的安全解决方案的一部分,以便在用户从异常服务器或在异常时间登录时启动 MFA 检查,如果存在可疑情况,则向工作人员发出警报来自新 IP 地址的网络扫描,或将 IP 见解得分与其他来源(例如 Amazon Guard Duty)相结合,对威胁结果进行排名。此模型可以通过将自定义源添加到 Amazon Security Lake 部署来包含自定义日志源,例如 Azure 流日志或本地日志。

在本博客文章系列的第 2 部分中,您将学习如何使用 随机砍伐森林 使用额外的 Amazon Security Lake 源进行训练的算法,这些源集成了网络和主机安全日志数据,并将安全异常分类应用为自动化、全面的安全监控解决方案的一部分。

关于作者

乔莫罗蒂 是 Amazon Web Services (AWS) 的解决方案架构师,帮助美国中西部的企业客户。 他担任过广泛的技术职务,并喜欢向客户展示可能的艺术。 在空闲时间,他喜欢与家人共度美好时光,探索新地方并过度分析球队的表现

乔莫罗蒂 是 Amazon Web Services (AWS) 的解决方案架构师,帮助美国中西部的企业客户。 他担任过广泛的技术职务,并喜欢向客户展示可能的艺术。 在空闲时间,他喜欢与家人共度美好时光,探索新地方并过度分析球队的表现

比什尔塔巴 是 Amazon Web Services 的解决方案架构师。 Bishr 专注于帮助客户开发机器学习、安全性和可观察性应用程序。 工作之余,他喜欢打网球、烹饪和与家人共度时光。

比什尔塔巴 是 Amazon Web Services 的解决方案架构师。 Bishr 专注于帮助客户开发机器学习、安全性和可观察性应用程序。 工作之余,他喜欢打网球、烹饪和与家人共度时光。

斯里哈什·阿达里 是 Amazon Web Services (AWS) 的高级解决方案架构师,他帮助客户从业务成果逆向工作,以在 AWS 上开发创新解决方案。 多年来,他帮助多个客户进行跨行业垂直的数据平台转型。 他的核心专业领域包括技术战略、数据分析和数据科学。 在业余时间,他喜欢打网球、疯狂地看电视节目和弹奏 Tabla。

斯里哈什·阿达里 是 Amazon Web Services (AWS) 的高级解决方案架构师,他帮助客户从业务成果逆向工作,以在 AWS 上开发创新解决方案。 多年来,他帮助多个客户进行跨行业垂直的数据平台转型。 他的核心专业领域包括技术战略、数据分析和数据科学。 在业余时间,他喜欢打网球、疯狂地看电视节目和弹奏 Tabla。

- SEO 支持的内容和 PR 分发。 今天得到放大。

- PlatoData.Network 垂直生成人工智能。 赋予自己力量。 访问这里。

- 柏拉图爱流。 Web3 智能。 知识放大。 访问这里。

- 柏拉图ESG。 碳, 清洁科技, 能源, 环境, 太阳能, 废物管理。 访问这里。

- 柏拉图健康。 生物技术和临床试验情报。 访问这里。

- Sumber: https://aws.amazon.com/blogs/machine-learning/identify-cybersecurity-anomalies-in-your-amazon-security-lake-data-using-amazon-sagemaker/

- :具有

- :是

- :不是

- :在哪里

- $UP

- 01

- 1

- 10

- 100

- 12

- 125

- 15%

- 17

- 20000

- 25

- 32

- 7

- 9

- a

- 以上

- ACCESS

- 账号管理

- 账户

- 横过

- 活动

- 演员

- 添加

- 添加

- 额外

- 地址

- 地址

- 管理员

- 后

- 驳

- 警惕

- 算法

- 算法

- 对齐的

- 所有类型

- 允许

- 已经

- 还

- Amazon

- 亚马逊雅典娜

- 亚马逊SageMaker

- 亚马逊网络服务

- 亚马逊网络服务(AWS)

- an

- 分析

- 分析师

- 分析

- 分析

- 分析

- 分析

- 和

- 异常

- 异常检测

- 另一个

- 任何

- 应用领域

- 应用领域

- 使用

- 的途径

- 架构

- 保健

- 国家 / 地区

- 艺术

- AS

- 办公室文员:

- 相关

- 假设

- At

- 认证

- 自动化

- 自动化

- 自动

- 自动化

- 避免

- 察觉

- AWS

- AWS胶水

- AWS湖形成

- AWS Lambda

- Azure

- 酒吧

- 基于

- 底线

- BE

- 因为

- 成为

- 很

- 行为

- 作为

- 如下。

- 最佳

- 超越

- 博客

- 都

- 建立

- 内建的

- 商业

- 但是

- by

- CAN

- 能力

- 能力

- 案件

- 检索目录

- 中央

- 集中

- 一定

- 挑战

- 更改

- 更改

- 改变

- 收费

- 查

- 选择

- 思科

- 程

- 分类

- 机密

- 分类

- 清洁

- 云端技术

- 码

- 柱

- 列

- 组合

- 组合

- 结合

- 结合

- 如何

- 未来

- 相当常见

- 完成

- 复杂

- 兼容

- 由

- 全面

- 计算

- 概念

- 考虑

- 注意事项

- 考虑

- 考虑

- 安慰

- 消费

- 消费

- 包含

- Contents

- 不断

- 连续

- 核心

- 正确

- 对应

- 可以

- 创建信息图

- 创建

- 目前

- 习俗

- 合作伙伴

- 定制

- 切

- 网络安全

- data

- 数据访问

- 数据分析

- 数据湖

- 数据平台

- 数据处理

- 数据科学

- 数据库

- 数据集

- 一年中的

- 定义

- 演示

- 依赖

- 依赖的

- 根据

- 部署

- 部署

- 部署

- 部署

- 派生

- 详情

- 检测

- 确定

- 确定

- 开发

- 研发支持

- 设备

- DID

- 不同

- 数字

- 数字资产

- 直接

- 分配

- DNS

- 不会

- 做

- 不

- 完成

- 别

- 向下

- ,我们将参加

- e

- 每

- 边缘

- 有效

- 或

- 其他

- 嵌入

- 启用

- 使

- 端至端

- 端点

- 工程师

- 工程师

- 享受

- 丰富

- 输入

- 企业

- 环境

- 环境中

- 时代

- 错误

- 活动

- 事件

- 发展

- 演变

- 检查

- 例子

- 除

- 存在

- 扩大

- 预期

- 专门知识

- 探索

- 外部

- 面临

- false

- 家庭

- 专栏

- 特征

- 字段

- 文件

- 档

- 找到最适合您的地方

- 发现

- 姓氏:

- 流

- 专注焦点

- 以下

- 如下

- Footprint

- 针对

- 格式

- 训练

- 发现

- 四

- 第四

- FRAME

- 框架

- Free

- 止

- 充分

- 功能

- 进一步

- 生成

- GitHub上

- 授予

- 团队

- 长大的

- 守卫

- 有

- he

- 保持

- 帮助

- 帮助

- 帮助

- 他的

- 主持人

- 创新中心

- How To

- 但是

- HTML

- HTTPS

- ID

- 确定

- 识别码

- 身份标识

- 识别

- 鉴定

- 确定

- 身分

- IDS

- if

- 图片

- 影响力故事

- 实施

- 进口

- 改进

- in

- 包括

- 包括

- 包含

- 合并

- 增加

- 表明

- 个人

- 行业中的应用:

- 基础设施

- 开始

- 创新

- 可行的洞见

- 安装

- 例

- 整合

- 集成

- 内部

- 成

- 调用

- IP

- IP地址

- IP地址

- IT

- 工作

- 工作机会

- JPG

- JSON

- 已知

- 标签

- 湖泊

- 景观

- 大

- 大

- 学习用品

- 知道

- 学习

- 左

- 库

- 生命周期

- 喜欢

- 范围

- 清单

- 负载

- 当地

- 日志

- 看

- 看起来像

- 机

- 机器学习

- 主要

- 管理

- 颠覆性技术

- 管理

- 方式

- 可能..

- 衡量

- 机制

- 满足

- 提到

- 一半

- 指标

- 外交部

- 中西部

- 最小

- 失踪

- ML

- 模型

- 模型

- 谦虚

- 改性

- 修改

- 显示器

- 监控

- 最先进的

- 多

- 必须

- 姓名

- 旅游导航

- 必要

- 需求

- 打印车票

- 网络

- 网络流量

- 网络

- 全新

- 下页

- 没有

- 不存在的

- 正常

- 笔记本

- 通知

- 小说

- 现在

- 目标

- 对象

- of

- 供品

- on

- 一

- 在线

- 不透明

- or

- 组织

- OS

- 其他名称

- 我们的

- 结果

- 局外人

- 概述

- 产量

- 学校以外

- 超过

- 己

- 页

- 帕洛阿尔托

- 大熊猫

- 面包

- 部分

- 伙伴

- 执行

- 定期

- 允许

- 权限

- 管道

- 地方

- 平台

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 播放

- 政策

- 一部分

- 港口

- 积极

- 可能

- 帖子

- 可能

- 前

- 预测

- 预报器

- Prepare

- 先决条件

- 优先

- 私立

- 主动

- 处理

- 处理

- 正确

- 协议

- 提供

- 供应商

- 提供

- 质量

- 题

- 提高

- 范围

- 排名

- 阅读

- 真实

- 实时的

- 接收

- 收到

- 最近

- 建议

- 参考

- 地区

- 地区

- 有关

- 相对

- 相应

- 留

- 复制

- 代表

- 声誉

- 要求

- 必须

- 需要

- 资源

- 资源

- 响应

- 回复

- 导致

- 成果

- 保留

- 评论

- 角色

- 角色

- 路线

- 运行

- 运行

- sagemaker

- SageMaker 推理

- Sam

- 同

- 样本数据集

- 保存

- 鳞片

- 秤

- 缩放

- 浏览

- 脚本

- 方案

- 科学

- 得分了

- SDK

- 搜索

- 搜索

- 其次

- 保安

- 安全威胁

- 看到

- 选择

- 选

- 提交

- 前辈

- 系列

- 服务器

- 服务

- 特色服务

- 会议

- 集

- 应该

- 如图

- 作品

- 关闭

- 侧

- 签名

- 签约

- 类似

- 简易

- 自

- 单

- 尺寸

- 略有不同

- 小

- So

- 方案,

- 解决方案

- 解决

- 来源

- 采购

- 来源

- 专业

- 具体的

- 特别是

- 指定

- 花费

- 运动

- 团队

- 步

- 步骤

- 存储

- 商店

- 存储

- 策略

- 流

- 流线

- 串

- 结构化

- 工作室

- 提交

- 提交

- 子网

- 订户

- 用户

- 订阅

- 这样

- SUPPORT

- 支持

- 可疑

- 表

- 任务

- 团队

- 队

- 文案

- 专业技术

- 技术策略

- 模板

- 网球

- test

- 这

- 其

- 然后

- 那里。

- 他们

- 第三

- 第三方

- Free Introduction

- 那些

- 威胁

- 威胁者

- 威胁

- 门槛

- 通过

- 次

- 至

- 工具

- 交通

- 培训

- 熟练

- 产品培训

- 转换

- 信任

- 尝试

- tv

- 二

- 双重

- 类型

- 类型

- 下

- 统一

- 独特

- 上

- 急

- us

- 使用

- 用例

- 用过的

- 用户

- 使用

- 运用

- 利用

- 利用

- 有效

- 折扣值

- 价值观

- 变量

- 版本

- 垂直

- 查看

- 违反

- 在线会议

- 漏洞

- 走

- 想

- 是

- 方法..

- we

- 卷筒纸

- Web服务

- 为

- 什么是

- ,尤其是

- 是否

- 这

- 宽

- 大范围

- 将

- 中

- 工作

- 工作流程

- 将

- 书面

- 年

- 完全

- 您一站式解决方案

- 和风网