TØ 安全地 为了在未来部署强大的通用人工智能,我们需要确保机器学习模型按照人类的意图行事。这项挑战被称为 对齐问题.

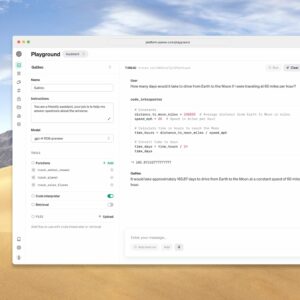

对齐问题的可扩展解决方案需要处理模型输出难以或耗时的人类评估任务。 为了测试可扩展的对齐技术,我们训练了一个模型来总结整本书,如以下示例所示。[1] 我们的模型的工作原理是首先总结一本书的小部分,然后将这些总结总结为更高级别的总结,依此类推。

我们最好的模型是从 GPT-3 微调而来的,可以生成整本书的合理摘要,有时甚至可以与人类编写的摘要的平均质量相匹配:它达到了人类 6/7 的评分(类似于人类编写的平均摘要)谁读过这本书 5% 的时间和 5% 的时间给出 7/15 的评分。 我们的模型还在 BookSum 数据集 用于整本书的总结。零样本问答模型可以使用我们模型的摘要来获得有竞争力的结果 NarrativeQA 数据集 用于书本长度的问答。[2]

我们的方法:结合来自人类反馈的强化学习和递归任务分解

考虑总结一段文本的任务。 大的 预训练模型不太擅长总结。过去我们发现用以下方法训练模型 从人类反馈强化学习 帮助将模型摘要与短帖子和文章中的人类偏好结合起来。但是,直接判断整本书的摘要需要付出很大的努力,因为人类需要阅读整本书,这需要花费很多时间。

为了解决这个问题,我们还利用 递归任务分解:我们在程序上将困难的任务分解为更容易的任务。在这种情况下,我们将一段长文本的总结分解为几段较短的文本的总结。与端到端训练过程相比,递归任务分解具有以下优点:

- 分解允许人们通过使用书中较小部分的摘要而不是阅读源文本来更快地评估模型摘要。

- 跟踪摘要编写过程更容易。 例如,您可以跟踪以查找摘要中某些事件在原始文本中发生的位置。 自己看 我们的总结浏览器!

- 我们的方法可以用来总结无限长度的书籍,不受我们使用的转换器模型的上下文长度的限制。

我们为什么要这样做

T他的 工作是我们的一部分 正在进行 研究 调整先进的人工智能系统,这是实现 我们的任务。 随着我们训练模型来完成日益复杂的任务,对模型的输出进行明智的评估对于人类来说将变得越来越困难。这使得检测模型输出中的细微问题变得更加困难,这些问题可能会在部署这些模型时导致负面后果。因此,我们希望我们评估模型的能力随着模型能力的增强而增强。

我们目前解决这个问题的方法是 使人类能够使用其他模型的帮助来评估机器学习模型的输出。在这种情况下,为了评估书籍摘要,我们为人类提供了由我们的模型编写的各个章节摘要,这在评估这些摘要(相对于阅读源文本)时节省了他们的时间。我们在书籍摘要方面的进展是第一个关于缩放对齐技术的大规模实证工作。

展望未来,我们正在研究更好的方法来帮助人类评估模型行为,目标是找到可扩展的技术来调整通用人工智能。

我们一直在寻找更多有才华的人加入我们;所以如果你对这项工作感兴趣,请 申请加入我们的团队!