تمت كتابة منشور المدونة هذا بالاشتراك مع Tuana Çelik من Deepset.

البحث المؤسسي هو عنصر حاسم في الكفاءة التنظيمية من خلال رقمنة الوثائق وإدارة المعرفة. يغطي بحث المؤسسة تخزين المستندات مثل الملفات الرقمية ، وفهرسة المستندات للبحث ، وتقديم النتائج ذات الصلة بناءً على استفسارات المستخدم. مع ظهور نماذج اللغات الكبيرة (LLMs) ، يمكننا تنفيذ تجارب المحادثة في توفير النتائج للمستخدمين. ومع ذلك ، نحتاج إلى التأكد من أن LLM تحد من الاستجابات لبيانات الشركة ، وبالتالي التخفيف من الهلوسة النموذجية.

في هذا المنشور ، نعرض كيفية إنشاء تطبيق AI تولد من طرف إلى طرف للبحث في المؤسسات باستخدام Retrieval Augmented Generation (RAG) باستخدام خطوط أنابيب Haystack ونموذج Falcon-40b-Instruct من أمازون سيج ميكر جومب ستارت و خدمة Amazon OpenSearch. يتوفر رمز المصدر للعينة المعروضة في هذا المنشور في ملف مستودع جيثب

حل نظرة عامة

لتقييد استجابات تطبيق الذكاء الاصطناعي التوليدية لبيانات الشركة فقط ، نحتاج إلى استخدام تقنية تسمى Retrieval Augmented Generation (RAG). يسترد التطبيق الذي يستخدم نهج RAG المعلومات الأكثر صلة بطلب المستخدم من قاعدة المعرفة أو المحتوى الخاص بالمؤسسة ، ويجمعها كسياق جنبًا إلى جنب مع طلب المستخدم كموجه ، ثم يرسلها إلى LLM للحصول على رد. تحتوي LLM على قيود حول الحد الأقصى لعدد الكلمات لمطالبات الإدخال ، لذا فإن اختيار المقاطع الصحيحة بين آلاف أو ملايين المستندات في المؤسسة له تأثير مباشر على دقة LLM.

أصبحت تقنية RAG ذات أهمية متزايدة في البحث عن المؤسسات. في هذا المنشور ، نعرض سير عمل يستفيد من SageMaker JumpStart لنشر نموذج Falcon-40b-Instruct ويستخدم Haystack لتصميم وتشغيل خط أنابيب للإجابة على سؤال معزز للاسترجاع. يغطي سير عمل زيادة الاسترجاع النهائي الخطوات عالية المستوى التالية:

- يتم استخدام استعلام المستخدم لمكون المسترد ، الذي يقوم بالبحث المتجه ، لاسترداد السياق الأكثر صلة من قاعدة البيانات الخاصة بنا.

- تم تضمين هذا السياق في موجه مصمم لإرشاد LLM لإنشاء إجابة من السياق المقدم فقط.

- ينشئ LLM استجابة للاستعلام الأصلي من خلال النظر فقط في السياق المضمن في المطالبة التي تلقاها.

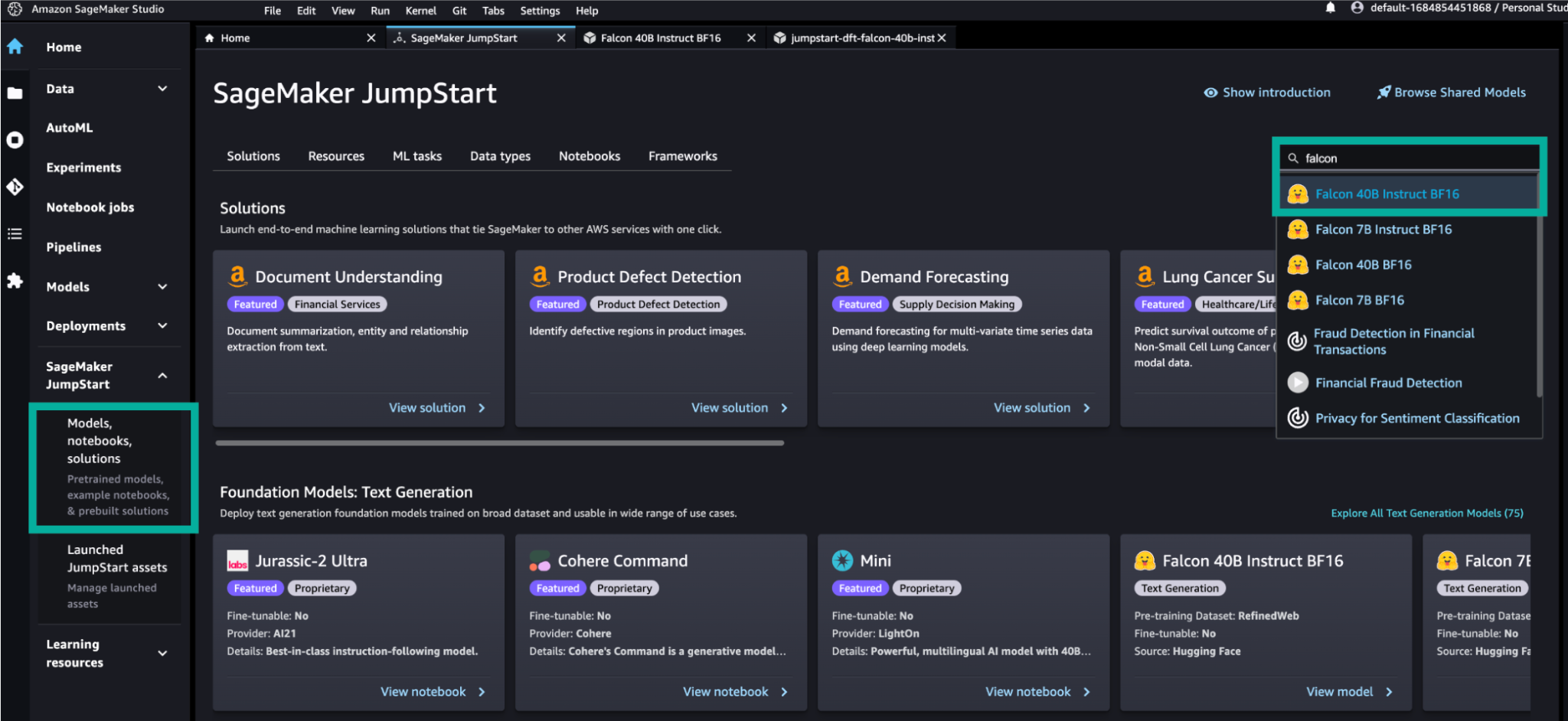

سيج ميكر جومب ستارت

يعمل SageMaker JumpStart كمحور نموذجي يضم مجموعة واسعة من نماذج التعلم العميق للنص ، والرؤية ، والصوت ، وحالات استخدام التضمين. مع أكثر من 500 نموذج ، يتألف مركز النموذج الخاص بها من نماذج عامة ومملوكة من شركاء AWS مثل AI21 و Stability AI و Cohere و LightOn. كما أنها تستضيف نماذج الأساس التي طورتها أمازون فقط ، مثل AlexaTM. توفر لك بعض النماذج إمكانات لضبطها باستخدام بياناتك الخاصة. يوفر SageMaker JumpStart أيضًا قوالب الحلول التي تقوم بإعداد البنية التحتية لحالات الاستخدام الشائعة ، وأمثلة من دفاتر الملاحظات القابلة للتنفيذ للتعلم الآلي (ML) باستخدام SageMaker.

كومة قش

كومة قش هو إطار عمل مفتوح المصدر من خلال Deepset يسمح للمطورين بتنسيق تطبيقات LLM المكونة من مكونات مختلفة مثل النماذج وقاعدة البيانات المتجهة ومحولات الملفات وعدد لا يحصى من الوحدات النمطية الأخرى. يوفر Haystack خطوط الأنابيب و وسيط عقاري، هيكلان قويتان لتصميم تطبيقات LLM لحالات الاستخدام المختلفة بما في ذلك البحث والإجابة على الأسئلة والذكاء الاصطناعي للمحادثة. مع التركيز الكبير على طرق الاسترجاع الحديثة ومقاييس التقييم القوية ، فإنه يوفر لك كل ما تحتاجه لشحن تطبيق موثوق وجدير بالثقة. يمكنك إجراء تسلسل لخطوط الأنابيب إلى ملفات YAML، فضحهم عبر أ REST API، وقم بتوسيعها بمرونة مع أعباء عملك ، مما يسهل عليك نقل تطبيقك من مرحلة النموذج الأولي إلى مرحلة الإنتاج.

أمازون أوبن سيرش

OpenSearch Service هي خدمة مُدارة بالكامل تجعل من السهل نشر OpenSearch وتوسيع نطاقها وتشغيلها في سحابة AWS. OpenSearch عبارة عن مجموعة برامج مفتوحة المصدر قابلة للتطوير ومرنة وقابلة للتوسيع لتطبيقات البحث والتحليلات والمراقبة الأمنية والمراقبة ، ومرخصة بموجب ترخيص Apache 2.0.

في السنوات الأخيرة ، أصبحت تقنيات تعلم الآلة شائعة بشكل متزايد لتحسين البحث. من بينها استخدام نماذج التضمين، وهو نوع من النماذج يمكنه ترميز مجموعة كبيرة من البيانات في فضاء ذي أبعاد n حيث يتم ترميز كل كيان في ناقلات، وهي نقطة بيانات في تلك المساحة ، ومنظمة بحيث تكون الكيانات المتشابهة أقرب معًا. توفر قاعدة بيانات المتجهات بحثًا فعالاً عن تشابه المتجهات من خلال توفير فهارس متخصصة مثل فهارس k-NN.

من خلال إمكانات قاعدة بيانات المتجه في OpenSearch Service ، يمكنك تنفيذ البحث الدلالي ، و RAG مع LLMs ، ومحركات التوصية ، والبحث في الوسائط الغنية. في هذا المنشور ، نستخدم RAG لتمكيننا من استكمال LLMs التوليدية بقاعدة معرفة خارجية يتم بناؤها عادةً باستخدام قاعدة بيانات متجهية مرطبة بمقالات معرفية مشفرة بالناقل.

نظرة عامة على التطبيق

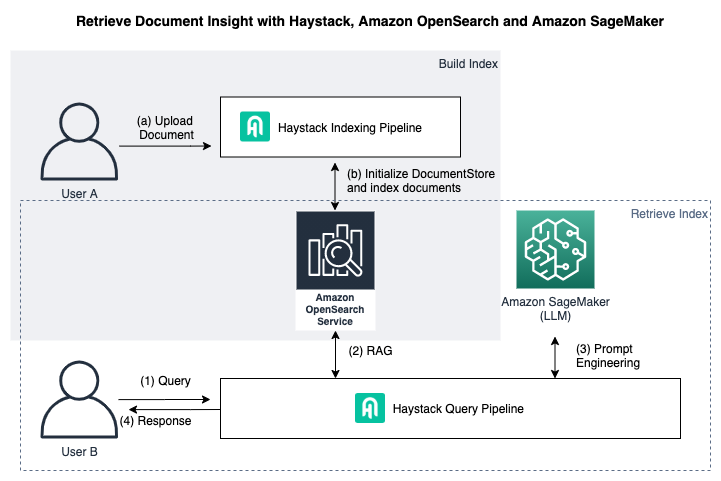

يوضح الرسم البياني التالي هيكل التطبيق النهائي.

في هذا التطبيق ، نستخدم خط أنابيب فهرسة Haystack لإدارة المستندات التي تم تحميلها وفهرسة المستندات و Haystack Query Pipeline لإجراء استرجاع المعرفة من المستندات المفهرسة.

يتضمن خط أنابيب فهرسة كومة القش الخطوات عالية المستوى التالية:

- تحميل مستند.

- تهيئة

DocumentStoreوفهرسة المستندات.

نحن نستخدم OpenSearch كملف DocumentStore وكومة قش خط أنابيب الفهرسة للمعالجة المسبقة لملفاتنا وفهرستها إلى OpenSearch. كومة قش محولات الملفات و المعالج تسمح لك بتنظيف وإعداد ملفاتك الأولية لتكون في شكل وصيغة يمكن أن يتعامل معها خط أنابيب معالجة اللغة الطبيعية (NLP) ونموذج اللغة الذي تختاره. يستخدم خط أنابيب الفهرسة الذي استخدمناه هنا أيضًا sentence-transformers/all-MiniLM-L12-v2 لإنشاء حفلات زفاف لكل وثيقة ، والتي نستخدمها للاسترجاع الفعال.

يتضمن خط أنابيب استعلام كومة القش الخطوات عالية المستوى التالية:

- نرسل استعلامًا إلى خط أنابيب RAG.

- An التضمين المكون يعمل كعامل تصفية يسترد الأكثر صلة

top_kالمستندات من مستنداتنا المفهرسة في OpenSearch. نستخدم اختيارنا لنموذج التضمين لتضمين كل من الاستعلام والمستندات (عند الفهرسة) لتحقيق ذلك. - يتم تضمين المستندات المسترجعة في موجهنا إلى نموذج Falcon-40b-Instruct.

- ترجع LLM باستجابة تستند إلى المستندات المستردة.

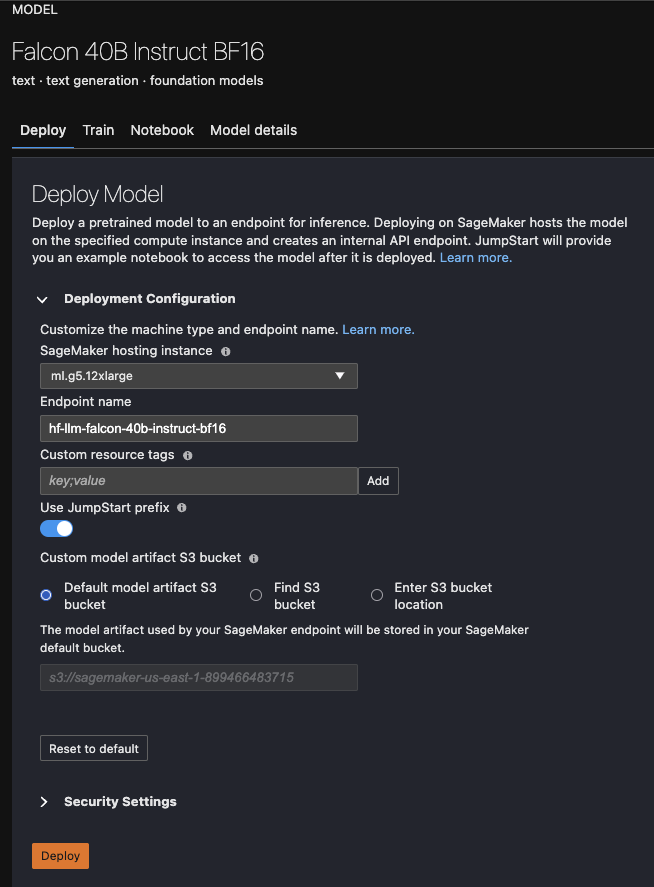

لنشر النموذج ، نستخدم SageMaker JumpStart ، الذي يبسط نشر النماذج بضغطة زر بسيطة. على الرغم من أننا استخدمنا واختبرنا تعليمات Falcon-40b في هذا المثال ، يمكنك استخدام أي طراز Hugging Face متاح على SageMaker.

الحل النهائي متاح على صانع قش كومة قش المستودع ويستخدم موقع OpenSearch على الويب والوثائق (لـ OpenSearch 2.7) كمثال لبياناتنا لإجراء الاسترجاع والإجابة على الأسئلة المعززة.

المتطلبات الأساسية المسبقة

أول شيء يجب فعله قبل أن نتمكن من استخدام أي من خدمات AWS هو التأكد من أننا اشتركنا في حساب AWS وأنشأناه. ثم يجب عليك إنشاء مستخدم إداري ومجموعة. للحصول على إرشادات حول كلتا الخطوتين ، ارجع إلى إعداد المتطلبات الأساسية لـ Amazon SageMaker.

لتتمكن من استخدام Haystack ، يجب عليك تثبيت ملف farm-haystack الحزمة مع التبعيات المطلوبة. لتحقيق ذلك ، استخدم requirements.txt ملف في مستودع جيثب عن طريق الركض pip install requirements.txt.

فهرس المستندات إلى OpenSearch

يقدم Haystack عددًا من الموصلات لقواعد البيانات ، والتي تسمى DocumentStores. لسير عمل RAG هذا ، نستخدم ملف OpenSearchDocumentStore. المثال مستودع يتضمن خط أنابيب فهرسة و تكوين سحابة AWS قالب لاقامة OpenSearchDocumentStore مع المستندات التي تم الزحف إليها من موقع OpenSearch على الويب وصفحات التوثيق.

في كثير من الأحيان ، للحصول على تطبيق NLP يعمل لحالات استخدام الإنتاج ، ينتهي بنا الأمر إلى التفكير في إعداد البيانات وتنظيفها. هذا مغطى بـ خطوط أنابيب فهرسة كومة القش، والذي يسمح لك بتصميم خطوات إعداد البيانات الخاصة بك ، والتي في النهاية تكتب مستنداتك إلى قاعدة البيانات التي تختارها.

قد يتضمن خط أنابيب الفهرسة أيضًا خطوة لإنشاء حفلات الزفاف لمستنداتك. هذا مهم للغاية لخطوة الاسترجاع. في مثالنا ، نستخدم محولات الجملة / all-MiniLM-L12-v2-mod.apk كنموذج التضمين لدينا. يُستخدم هذا النموذج لإنشاء حفلات الزفاف لجميع مستنداتنا المفهرسة ، وأيضًا استعلام المستخدم في وقت الاستعلام.

لفهرسة المستندات في ملف OpenSearchDocumentStore، نحن نقدم خيارين مع تعليمات مفصلة في README من مستودع المثال. هنا ، ننتقل عبر خطوات الفهرسة إلى خدمة OpenSearch المنشورة على AWS.

ابدأ خدمة OpenSearch

استخدم ملف قالب CloudFormation لإعداد خدمة OpenSearch على AWS. من خلال تشغيل الأمر التالي ، سيكون لديك خدمة OpenSearch فارغة. يمكنك بعد ذلك إما اختيار فهرسة البيانات النموذجية التي قدمناها أو استخدام بياناتك الخاصة ، والتي يمكنك تنظيفها ومعالجتها مسبقًا باستخدام خط أنابيب فهرسة كومة القش. لاحظ أن هذا يؤدي إلى إنشاء مثيل مفتوح على الإنترنت ، وهو غير موصى به للاستخدام الإنتاجي.

اسمح بحوالي 30 دقيقة حتى يكتمل إطلاق المكدس. يمكنك التحقق من تقدمه على وحدة تحكم AWS CloudFormation بالانتقال إلى ملف كومات الصفحة والبحث عن المكدس المسمى HaystackOpensearch.

فهرس المستندات في OpenSearch

الآن بعد أن أصبح لدينا خدمة OpenSearch قيد التشغيل ، يمكننا استخدام فئة OpenSearchDocumentStore للاتصال بها وكتابة مستنداتنا إليها.

للحصول على اسم المضيف لـ OpenSearch ، قم بتشغيل الأمر التالي:

أولاً ، قم بتصدير ما يلي:

بعد ذلك ، يمكنك استخدام ملف opensearch_indexing_pipeline.py البرنامج النصي لمعالجة البيانات التجريبية المقدمة وفهرستها.

إذا كنت ترغب في استخدام بياناتك الخاصة ، فقم بتعديل خط أنابيب الفهرسة في opensearch_indexing_pipeline.py لتشمل تحويل الملف و المعالج خطوات الإعداد التي تحتاجها.

تنفيذ خط أنابيب الاسترجاع المعزز الذي يجيب على السؤال

الآن بعد أن قمنا بفهرسة البيانات في OpenSearch ، يمكننا إجراء الإجابة على الأسئلة على هذه المستندات. بالنسبة لخط أنابيب RAG هذا ، نستخدم نموذج Falcon-40b-التعليمي الذي نشرناه على SageMaker JumpStart.

لديك أيضًا خيار نشر النموذج برمجيًا من دفتر Jupyter. للحصول على تعليمات ، راجع جيثب ريبو.

- ابحث عن طراز Falcon-40b-instruct على SageMaker JumpStart.

- انشر النموذج الخاص بك على SageMaker JumpStart ، ولاحظ اسم نقطة النهاية.

- قم بتصدير القيم التالية:

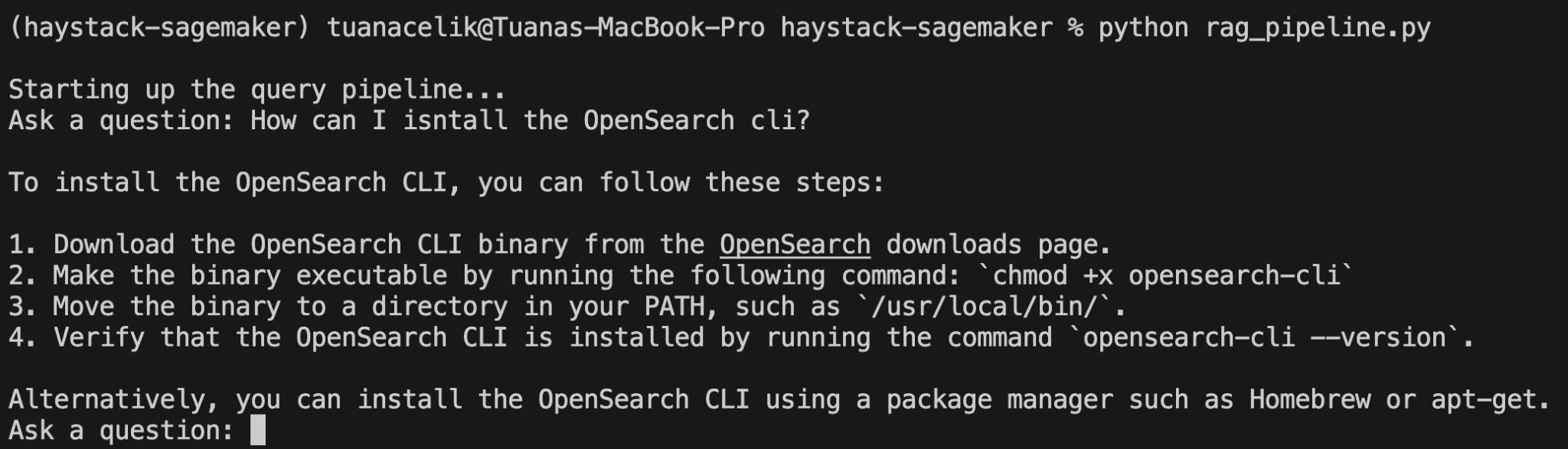

- يجري

python rag_pipeline.py.

سيبدأ هذا أداة سطر أوامر تنتظر سؤال المستخدم. على سبيل المثال ، دعنا نسأل "كيف يمكنني تثبيت OpenSearch cli؟"

يتم تحقيق هذه النتيجة لأننا حددنا موجهنا في موجه كومة القش ليكون على النحو التالي:

مزيد من التخصيصات

يمكنك إجراء تخصيصات إضافية لعناصر مختلفة في الحل ، مثل ما يلي:

- البيانات - لقد قدمنا البحث المفتوح توثيق و موقع الكتروني البيانات كمثال للبيانات. تذكر تعديل ملف

opensearch_indexing_pipeline.pyالبرنامج النصي ليناسب احتياجاتك إذا اخترت استخدام البيانات الخاصة بك. - نموذج - في هذا المثال ، استخدمنا نموذج Falcon-40b-instruct. أنت حر في نشر واستخدام أي نموذج Hugging Face آخر على SageMaker. لاحظ أن تغيير النموذج يعني على الأرجح أنه يجب عليك تكييف موجهك مع شيء تم تصميمه للتعامل معه.

- موجه - لهذا المنشور ، أنشأنا منطقتنا

PromptTemplateيوجه النموذج للإجابة على الأسئلة بناءً على السياق المقدم والإجابة "لا أعرف" إذا كان السياق لا يتضمن معلومات ذات صلة. يمكنك تغيير هذه المطالبة لتجربة مطالبات مختلفة باستخدام Falcon-40b-Instruct. يمكنك أيضًا سحب بعض مطالباتنا من ملف PromptHub. - نموذج التضمين - لخطوة الاسترجاع ، نستخدم نموذج تضمين خفيف الوزن: محولات الجملة / all-MiniLM-L12-v2-mod.apk. ومع ذلك ، يمكنك أيضًا تغيير هذا وفقًا لاحتياجاتك. تذكر تعديل أبعاد التضمين المتوقعة في ملف

DocumentStoreوفقا لذلك. - عدد المستندات المسترجعة - يمكنك أيضًا اختيار التلاعب بعدد المستندات التي تطلبها

EmbeddingRetrieverلاسترداد كل استعلام. في الإعداد لدينا ، تم تعيين هذا على top_k = 5. يمكنك تجربة تغيير هذا الرقم لمعرفة ما إذا كان توفير المزيد من السياق يحسن دقة نتائجك.

جاهزية الإنتاج

يمكن للحل المقترح في هذه الوظيفة تسريع الوقت المستغرق في قيمة عملية تطوير المشروع. يمكنك إنشاء مشروع يسهل توسيع نطاقه مع بيئة الأمان والخصوصية على سحابة AWS.

للأمان والخصوصية ، توفر خدمة البحث المفتوح حماية البيانات مع إدارة الهوية والوصول و منع الوكيل الخلط عبر الخدمات. يمكنك استخدام التحكم الدقيق في وصول المستخدم بحيث لا يتمكن المستخدم إلا من الوصول إلى البيانات المصرح له بالوصول إليها فقط. بالإضافة إلى ذلك ، يوفر SageMaker إعدادات أمان قابلة للتكوين لـ وصول السيطرة, حماية البياناتو تسجيل الدخول والرقابة. يمكنك حماية بياناتك في حالة السكون والتي تنتقل من خلال خدمة إدارة مفتاح AWS (AWS KMS). يمكنك أيضًا تتبع سجل نشر نموذج SageMaker أو الوصول إلى نقطة النهاية باستخدام الأمازون CloudWatch. لمزيد من المعلومات ، يرجى الرجوع إلى راقب Amazon SageMaker باستخدام Amazon CloudWatch.

لقابلية التوسع العالية في خدمة البحث المفتوح ، يمكنك تعديلها من خلال تحديد حجم نطاقات خدمة OpenSearch Service الخاصة بك وتوظيف أفضل الممارسات التشغيلية. يمكنك أيضًا الاستفادة من القياس التلقائي لنقطة نهاية SageMaker - يمكنك ذلك مقياس نماذج SageMaker تلقائيًا لضبط نقطة النهاية عند زيادة حركة المرور أو عدم استخدام الموارد.

تنظيف

لتوفير التكاليف ، احذف جميع الموارد التي قمت بنشرها كجزء من هذا المنشور. إذا قمت بتشغيل مكدس CloudFormation ، فيمكنك حذفه عبر وحدة تحكم AWS CloudFormation. وبالمثل ، يمكنك حذف أي نقاط نهاية لـ SageMaker قد تكون أنشأتها عبر وحدة تحكم SageMaker.

وفي الختام

في هذا المنشور ، عرضنا كيفية إنشاء تطبيق AI تولد من طرف إلى طرف للبحث في المؤسسات باستخدام RAG باستخدام خطوط أنابيب Haystack ونموذج Falcon-40b-instruct من SageMaker JumpStart و OpenSearch Service. يعتبر نهج RAG أمرًا بالغ الأهمية في البحث في المؤسسة لأنه يضمن أن تكون الاستجابات المتولدة داخل المجال وبالتالي تخفف من الهلوسة. باستخدام خطوط أنابيب Haystack ، يمكننا تنظيم تطبيقات LLM المكونة من مكونات مختلفة مثل النماذج وقواعد بيانات المتجهات. يوفر لنا SageMaker JumpStart حلاً بنقرة واحدة لنشر LLM ، واستخدمنا OpenSearch Service كقاعدة بيانات متجه لبياناتنا المفهرسة. يمكنك البدء في تجربة وبناء براهين RAG للمفهوم لتطبيقات الذكاء الاصطناعي الخاصة بمؤسستك ، باستخدام الخطوات الموضحة في هذا المنشور ورمز المصدر المتاح في مستودع جيثب.

حول المؤلف

توانا سيليك هي المحامية الرئيسية للمطورين في Deepset ، حيث تركز على مجتمع المصدر المفتوح لـ Haystack. تقود وظيفة علاقات المطورين وتتحدث بانتظام في الأحداث حول البرمجة اللغوية العصبية وتخلق مواد تعليمية للمجتمع.

توانا سيليك هي المحامية الرئيسية للمطورين في Deepset ، حيث تركز على مجتمع المصدر المفتوح لـ Haystack. تقود وظيفة علاقات المطورين وتتحدث بانتظام في الأحداث حول البرمجة اللغوية العصبية وتخلق مواد تعليمية للمجتمع.

روي أليلا هو مهندس حلول متخصص في الذكاء الاصطناعي / التعلم الآلي في AWS ومقره في ميونيخ ، ألمانيا. يساعد Roy عملاء AWS - من الشركات الناشئة الصغيرة إلى المؤسسات الكبيرة - في تدريب نماذج اللغة الكبيرة ونشرها بكفاءة على AWS. روي متحمس لمشاكل التحسين الحسابي وتحسين أداء أعباء عمل الذكاء الاصطناعي.

روي أليلا هو مهندس حلول متخصص في الذكاء الاصطناعي / التعلم الآلي في AWS ومقره في ميونيخ ، ألمانيا. يساعد Roy عملاء AWS - من الشركات الناشئة الصغيرة إلى المؤسسات الكبيرة - في تدريب نماذج اللغة الكبيرة ونشرها بكفاءة على AWS. روي متحمس لمشاكل التحسين الحسابي وتحسين أداء أعباء عمل الذكاء الاصطناعي.

ميا تشانغ هو مهندس حلول متخصص في ML لخدمات الويب من أمازون. تعمل مع العملاء في أوروبا والشرق الأوسط وإفريقيا وتشارك أفضل الممارسات لتشغيل أحمال عمل الذكاء الاصطناعي / التعلم الآلي على السحابة بخلفيتها في الرياضيات التطبيقية وعلوم الكمبيوتر والذكاء الاصطناعي / تعلم الآلة. تركز على أعباء العمل الخاصة بمعالجة اللغات الطبيعية ، وتشارك تجربتها كمتحدث في المؤتمر ومؤلف كتاب. في أوقات فراغها ، تستمتع برياضة المشي لمسافات طويلة وألعاب الطاولة وتخمير القهوة.

ميا تشانغ هو مهندس حلول متخصص في ML لخدمات الويب من أمازون. تعمل مع العملاء في أوروبا والشرق الأوسط وإفريقيا وتشارك أفضل الممارسات لتشغيل أحمال عمل الذكاء الاصطناعي / التعلم الآلي على السحابة بخلفيتها في الرياضيات التطبيقية وعلوم الكمبيوتر والذكاء الاصطناعي / تعلم الآلة. تركز على أعباء العمل الخاصة بمعالجة اللغات الطبيعية ، وتشارك تجربتها كمتحدث في المؤتمر ومؤلف كتاب. في أوقات فراغها ، تستمتع برياضة المشي لمسافات طويلة وألعاب الطاولة وتخمير القهوة.

إنعام سيد هو مهندس حلول بدء التشغيل في AWS ، مع تركيز قوي على مساعدة الشركات الناشئة B2B و SaaS في التوسع وتحقيق النمو. إنه يمتلك شغفًا عميقًا للهياكل التي لا تحتاج إلى خادم و AI / ML. في أوقات فراغه ، يستمتع إنعام بلحظات رائعة مع عائلته وينغمس في حبه لركوب الدراجات وكرة الريشة.

إنعام سيد هو مهندس حلول بدء التشغيل في AWS ، مع تركيز قوي على مساعدة الشركات الناشئة B2B و SaaS في التوسع وتحقيق النمو. إنه يمتلك شغفًا عميقًا للهياكل التي لا تحتاج إلى خادم و AI / ML. في أوقات فراغه ، يستمتع إنعام بلحظات رائعة مع عائلته وينغمس في حبه لركوب الدراجات وكرة الريشة.

ديفيد تيبت هو كبير محامي المطورين الذي يعمل على OpenSearch مفتوح المصدر في AWS. يشمل عمله جميع مجالات البحث المفتوح من البحث والأهمية إلى تحليلات المراقبة والأمن.

ديفيد تيبت هو كبير محامي المطورين الذي يعمل على OpenSearch مفتوح المصدر في AWS. يشمل عمله جميع مجالات البحث المفتوح من البحث والأهمية إلى تحليلات المراقبة والأمن.

- محتوى مدعوم من تحسين محركات البحث وتوزيع العلاقات العامة. تضخيم اليوم.

- PlatoData.Network Vertical Generative Ai. تمكين نفسك. الوصول هنا.

- أفلاطونايستريم. ذكاء Web3. تضخيم المعرفة. الوصول هنا.

- أفلاطون السيارات / المركبات الكهربائية ، كربون، كلينتك ، الطاقة، بيئة، شمسي، إدارة المخلفات. الوصول هنا.

- أفلاطون هيلث. التكنولوجيا الحيوية وذكاء التجارب السريرية. الوصول هنا.

- تشارت بريم. ارفع مستوى لعبة التداول الخاصة بك مع ChartPrime. الوصول هنا.

- BlockOffsets. تحديث ملكية الأوفست البيئية. الوصول هنا.

- المصدر https://aws.amazon.com/blogs/machine-learning/build-production-ready-generative-ai-applications-for-enterprise-search-using-haystack-pipelines-and-amazon-sagemaker-jumpstart-with-llms/

- :لديها

- :يكون

- :ليس

- :أين

- $ UP

- 100

- 12

- 13

- 30

- 500

- 7

- 8

- a

- ماهرون

- حول المستشفى

- تسريع

- الوصول

- إنجاز

- وفقا لذلك

- حسابي

- دقة

- التأهيل

- تحقق

- تحقيق

- الأفعال

- تكيف

- إضافي

- وبالإضافة إلى ذلك

- إداري

- مميزات

- مجيء

- محام

- AI

- AI / ML

- الكل

- السماح

- يسمح

- على طول

- أيضا

- بالرغم ان

- أمازون

- الأمازون SageMaker

- أمازون سيج ميكر جومب ستارت

- أمازون ويب سيرفيسز

- من بين

- an

- تحليلات

- و

- إجابة

- أي وقت

- أباتشي

- تطبيق

- التطبيقات

- تطبيقي

- نهج

- ما يقرب من

- هي

- المناطق

- حول

- مجموعة

- فنـون

- مقالات

- AS

- مساعدة

- At

- سمعي

- المعزز

- المؤلفة

- مخول

- السيارات

- متاح

- AWS

- تكوين سحابة AWS

- دليل الشركات

- خلفية

- قاعدة

- على أساس

- BE

- لان

- أصبح

- قبل

- يجري

- أقل من

- أفضل

- أفضل الممارسات

- كبير

- المدونة

- مجلس

- العاب طاولة

- الجسدي

- كتاب

- على حد سواء

- واسع

- نساعدك في بناء

- ابني

- بنيت

- بال

- لكن

- زر

- by

- تسمى

- CAN

- قدرات

- الحالات

- تغيير

- متغير

- التحقق

- خيار

- اختار

- اختيار

- اختار

- فئة

- سوائل التنظيف

- أقرب

- سحابة

- الكود

- قهوة

- مشترك

- مجتمع

- حول الشركة

- تكملة

- إكمال

- عنصر

- مكونات

- يتألف

- الكمبيوتر

- علوم الكمبيوتر

- مفهوم

- مؤتمر

- الخلط

- التواصل

- النظر

- كنسولات

- الواردة

- محتوى

- سياق الكلام

- مراقبة

- تحادثي

- محادثة منظمة العفو الدولية

- التكاليف

- مغطى

- يغطي

- خلق

- خلق

- يخلق

- حرج

- العملاء

- البيانات

- تحضير البيانات

- حماية البيانات

- قاعدة البيانات

- قواعد البيانات

- DBS

- صفقة

- عميق

- التعلم العميق

- تعريف

- عرض

- التبعيات

- نشر

- نشر

- نشر

- نشر

- تصميم

- تصميم

- تصميم

- مفصلة

- المتقدمة

- المطور

- المطورين

- التطوير التجاري

- مختلف

- رقمي

- رقمنة

- الأبعاد

- مباشرة

- do

- وثيقة

- توثيق

- وثائق

- هل

- لا

- دون

- لا

- كل

- سهل

- كفاءة

- فعال

- بكفاءة

- إما

- عناصر

- تضمين

- جزءا لا يتجزأ من

- تضمين

- EMEA

- تمكين

- النهاية

- النهائي إلى نهاية

- نقطة النهاية

- محركات

- تعزيز

- ضمان

- يضمن

- مشروع

- الكيانات

- كيان

- البيئة

- تقييم

- أحداث

- كل شىء

- مثال

- متوقع

- الخبره في مجال الغطس

- خبرة

- تجربة

- تصدير

- خارجي

- الوجه

- للعائلات

- الشكل

- قم بتقديم

- ملفات

- تصفية

- نهائي

- الاسم الأول

- تناسب

- مرن

- بمرونة

- تركز

- ويركز

- متابعيك

- في حالة

- شكل

- دورة تأسيسية

- الإطار

- مجانًا

- تبدأ من

- تماما

- وظيفة

- ألعاب

- توليد

- ولدت

- يولد

- جيل

- توليدي

- الذكاء الاصطناعي التوليدي

- ألمانيا

- دولار فقط واحصل على خصم XNUMX% على جميع

- معطى

- تجمع

- التسويق

- مقبض

- يملك

- وجود

- he

- يساعد

- لها

- هنا

- مرتفع

- رفيع المستوى

- جدا

- له

- المضيفين

- كيفية

- كيفية

- لكن

- HTML

- HTTP

- HTTPS

- محور

- i

- هوية

- if

- التأثير

- تنفيذ

- أهمية

- تحسين

- in

- تتضمن

- يشمل

- بما فيه

- زيادة

- على نحو متزايد

- مؤشر

- مفهرس

- الفهارس

- معلومات

- البنية التحتية

- إدخال

- تثبيت

- مثل

- تعليمات

- Internet

- إلى

- IT

- انها

- JPG

- القفل

- مفاتيح

- علم

- المعرفة

- إدارة المعرفة

- لغة

- كبير

- إطلاق

- أطلقت

- قيادة

- يؤدي

- تعلم

- حقوق الملكية الفكرية

- مرخص

- خفيفة الوزن

- مثل

- على الأرجح

- مما سيحدث

- القيود

- خط

- LLM

- سجل

- تسجيل

- أبحث

- حب

- آلة

- آلة التعلم

- صنع

- جعل

- يصنع

- القيام ب

- إدارة

- تمكن

- إدارة

- المواد

- الرياضيات

- أقصى

- مايو..

- تعني

- الوسائط

- طرق

- المقاييس

- ملايين

- دقيقة

- مخففا

- ML

- نموذج

- عارضات ازياء

- تعديل

- الوحدات

- لحظات

- مراقبة

- الأكثر من ذلك

- أكثر

- خطوة

- الاسم

- عين

- طبيعي

- معالجة اللغات الطبيعية

- التنقل

- حاجة

- إحتياجات

- البرمجة اللغوية العصبية

- مفكرة

- عدد

- of

- عرض

- عروض

- on

- فقط

- جاكيت

- المصدر المفتوح

- برمجيات مفتوحة المصدر

- طريقة التوسع

- التحسين

- خيار

- مزيد من الخيارات

- or

- التنظيمية

- منظم

- أصلي

- أخرى

- لنا

- أوجز

- على مدى

- الخاصة

- صفقة

- صفحة

- صفحات

- جزء

- شركاء

- شغف

- عاطفي

- نفذ

- أداء

- خط أنابيب

- أفلاطون

- الذكاء افلاطون البيانات

- أفلاطون داتا

- بلايستشن

- من فضلك

- البوينت

- الرائج

- منشور

- قوي

- الممارسات

- إعداد

- خصوصية

- مشاكل

- عملية المعالجة

- معالجة

- الإنتــاج

- التقدّم

- تنفيذ المشاريع

- البراهين

- المقترح

- الملكية

- حماية

- الحماية

- النموذج

- تزود

- المقدمة

- ويوفر

- توفير

- الوكيل

- جمهور

- دفع

- جودة

- الاستفسارات

- سؤال

- الأسئلة المتكررة

- الخام

- تلقى

- الأخيرة

- توصية مجاناً

- موصى به

- بانتظام

- العلاقات

- مدى صلة

- ذات الصلة

- الخدمة الموثوقة

- تذكر

- مستودع

- طلب

- تطلب

- مطلوب

- المتطلبات الأساسية

- الموارد

- استجابة

- ردود

- REST

- بتقييد

- نتيجة

- النتائج

- عائدات

- النوادي الثرية

- حق

- روي

- يجري

- تشغيل

- ادارة العلاقات مع

- sagemaker

- حفظ

- قول

- التدرجية

- تحجيم

- حجم

- التحجيم

- علوم

- بحث

- أمن

- انظر تعريف

- إرسال

- يرسل

- كبير

- Serverless

- يخدم

- الخدمة

- خدماتنا

- طقم

- إعدادات

- الإعداد

- الشكل

- مشاركة

- هي

- سفينة

- ينبغي

- إظهار

- عرض

- عرضت

- وقعت

- مماثل

- وبالمثل

- الاشارات

- ببساطة

- صغير

- So

- تطبيقات الكمبيوتر

- فقط

- الصلبة

- حل

- الحلول

- بعض

- شيء

- مصدر

- شفرة المصدر

- الفضاء

- مكبرات الصوت

- يتحدث

- متخصص

- متخصص

- استقرار

- كومة

- المسرح

- بداية

- بدء التشغيل

- البدء

- خطوة

- خطوات

- تخزين

- قوي

- بناء

- هذه

- جناح

- بالتأكيد

- أخذ

- يأخذ

- تقنيات

- النماذج

- اختبار

- أن

- •

- المصدر

- منهم

- then

- وبالتالي

- وبالتالي

- تشبه

- هم

- شيء

- اعتقد

- الآلاف

- عبر

- الوقت

- إلى

- سويا

- مسار

- حركة المرور

- عبور

- جدير بالثقة

- اثنان

- نوع

- عادة

- في النهاية

- مع

- تم التحميل

- us

- تستخدم

- مستعمل

- مستخدم

- المستخدمين

- يستخدم

- استخدام

- سهل حياتك

- قيمنا

- القيم

- مختلف

- بواسطة

- رؤيتنا

- ينتظر

- we

- الويب

- خدمات ويب

- الموقع الإلكتروني

- متى

- التي

- سوف

- مع

- في غضون

- كلمة

- للعمل

- سير العمل

- عامل

- أعمال

- سوف

- اكتب

- يامل

- سنوات

- أنت

- حل متجر العقارات الشامل الخاص بك في جورجيا

- زفيرنت