نحن عند نقطة انعطاف مثيرة في الاعتماد الواسع النطاق للتعلم الآلي (ML)، ونعتقد أنه سيتم إعادة اختراع معظم تجارب العملاء والتطبيقات باستخدام الذكاء الاصطناعي التوليدي. يمكن للذكاء الاصطناعي التوليدي إنشاء محتوى وأفكار جديدة، بما في ذلك المحادثات والقصص والصور ومقاطع الفيديو والموسيقى. مثل معظم الذكاء الاصطناعي، يتم تشغيل الذكاء الاصطناعي التوليدي بواسطة نماذج التعلم الآلي، وهي نماذج كبيرة جدًا يتم تدريبها على كميات هائلة من البيانات ويشار إليها عادةً باسم النماذج الأساسية (FMs). تعتمد FMs على المحولات. المحولات بطيئة ومتعطشة للذاكرة عند إنشاء تسلسلات نصية طويلة نظرًا للحجم الهائل للنماذج. تحتاج نماذج اللغات الكبيرة (LLMs) المستخدمة لإنشاء تسلسلات نصية إلى كميات هائلة من قوة الحوسبة وتواجه صعوبة في الوصول إلى ذاكرة النطاق الترددي العالي (HBM) المتوفرة والقدرة الحاسوبية. وذلك لأن جزءًا كبيرًا من النطاق الترددي للذاكرة المتوفرة يتم استهلاكه عن طريق تحميل معلمات النموذج وعن طريق عملية فك التشفير الانحداري التلقائيونتيجة لذلك، حتى مع الكميات الهائلة من قوة الحوسبة، فإن حاملي شهادات LLM مقيدون بحدود الإدخال/الإخراج للذاكرة وحدود الحوسبة، مما يمنعهم من الاستفادة الكاملة من موارد الأجهزة المتاحة.

وبشكل عام، فإن الاستدلال التوليدي للماجستير في القانون يواجه ثلاثة تحديات رئيسية (وفقًا لـ البابا وآخرون. 2022):

- مساحة كبيرة للذاكرة بسبب معلمات النموذج الضخمة والحالة العابرة أثناء فك التشفير. غالبًا ما تتجاوز المعلمات ذاكرة شريحة تسريع واحدة. تتطلب ذاكرة التخزين المؤقت لقيمة مفتاح الانتباه أيضًا ذاكرة كبيرة.

- تؤدي قابلية التوازي المنخفضة إلى زيادة زمن الوصول، خاصة مع مساحة الذاكرة الكبيرة، مما يتطلب عمليات نقل كبيرة للبيانات لتحميل المعلمات وذاكرة التخزين المؤقت في مراكز الحساب في كل خطوة. يؤدي هذا إلى ارتفاع إجمالي عرض النطاق الترددي للذاكرة لتلبية أهداف زمن الوصول.

- يؤدي القياس التربيعي لحساب آلية الانتباه بالنسبة إلى طول التسلسل إلى تفاقم التحديات المتعلقة بزمن الوصول والحسابات.

يعد التجميع أحد الأساليب لمعالجة هذه التحديات. يشير التجميع إلى عملية إرسال تسلسلات إدخال متعددة معًا إلى LLM وبالتالي تحسين أداء استدلال LLM. يساعد هذا الأسلوب على تحسين الإنتاجية لأن معلمات النموذج لا تحتاج إلى التحميل لكل تسلسل إدخال. يمكن تحميل المعلمات مرة واحدة واستخدامها لمعالجة تسلسلات إدخال متعددة. يستخدم التجميع بكفاءة عرض النطاق الترددي HBM الخاص بالمسرع، مما يؤدي إلى زيادة استخدام الحوسبة، وتحسين الإنتاجية، والاستدلال الفعال من حيث التكلفة.

يتناول هذا المنشور تقنيات زيادة الإنتاجية إلى أقصى حد باستخدام تقنيات التجميع للاستدلال التوليدي المتوازي في LLMs. نناقش طرق التجميع المختلفة لتقليل أثر الذاكرة، وزيادة إمكانية التوازي، وتخفيف المقياس التربيعي للانتباه لتعزيز الإنتاجية. الهدف هو الاستخدام الكامل للأجهزة مثل HBM والمسرعات للتغلب على الاختناقات في الذاكرة والإدخال/الإخراج والحساب. ثم نسلط الضوء على كيفية ذلك الأمازون SageMaker يمكن أن تساعد حاويات التعلم العميق (DLCs) لاستدلال النماذج الكبيرة (LMI) في هذه التقنيات. أخيرًا، نقدم تحليلًا مقارنًا لتحسينات الإنتاجية مع كل إستراتيجية تجميعية تستخدمها SageMaker DLCs LMI لتحسين الإنتاجية لنماذج مثل اللاما v2. يمكنك العثور على نموذج دفتر الملاحظات المصاحب في أمثلة SageMaker على مستودع GitHub.

الاستدلال لنماذج اللغات الكبيرة (LLMs)

فك التشفير التلقائي هو العملية التي من خلالها تقوم نماذج اللغة مثل GPT بإنشاء مخرجات نصية رمزًا مميزًا واحدًا في كل مرة. يتضمن ذلك تغذية الرموز المميزة التي تم إنشاؤها بشكل متكرر مرة أخرى إلى النموذج كجزء من تسلسل الإدخال من أجل التنبؤ بالرموز المميزة اللاحقة. والخطوات هي كما يلي:

- يتلقى النموذج الرموز المميزة السابقة في التسلسل كمدخل. بالنسبة للخطوة الأولى، هذه هي مطالبة البداية التي يقدمها المستخدم.

- يتنبأ النموذج بتوزيع المفردات للرمز التالي.

- يتم تحديد الرمز المميز ذو أعلى احتمالية متوقعة وإلحاقه بتسلسل الإخراج. الخطوتان 2 و 3 جزء من فك حتى كتابة هذه السطور، فإن أبرز طرق فك التشفير هي البحث الجشع، والبحث الشعاعي، والبحث التقابلي، وأخذ العينات.

- تتم إضافة هذا الرمز المميز الجديد إلى تسلسل الإدخال لخطوة فك التشفير التالية.

- يتكرر النموذج من خلال هذه الخطوات، مما يؤدي إلى إنشاء رمز مميز واحد جديد في كل خطوة، حتى يتم إنتاج علامة نهاية التسلسل أو الوصول إلى طول الإخراج المطلوب.

خدمة نموذجية لـ LLMs

يشير نموذج التقديم لـ LLMs إلى عملية تلقي طلبات الإدخال لإنشاء النص وإجراء الاستدلالات وإعادة النتائج إلى التطبيقات الطالبة. فيما يلي المفاهيم الأساسية المتعلقة بخدمة النماذج:

- يقوم العملاء بإنشاء طلبات استدلال متعددة، حيث يتكون كل طلب من تسلسل من الرموز المميزة أو مطالبات الإدخال

- يتم تلقي الطلبات بواسطة خادم الاستدلال (على سبيل المثال، DJLServing, تورش سيرف, تريتون نصف إله عند الإغريقالطرق أو معانقة الوجه TGI)

- يقوم خادم الاستدلال بتجميع طلبات الاستدلال على دفعات ويقوم بجدولة الدفعة إلى محرك التنفيذ الذي يتضمن مكتبات تقسيم النماذج (مثل المحولات- NeuronX, السرعة العميقة, تسريعالطرق أو أسرع محول) لتشغيل التمرير الأمامي (التنبؤ بتسلسل الرمز المميز للإخراج) على نموذج اللغة التوليدية

- يقوم محرك التنفيذ بإنشاء رموز الاستجابة ويرسل الاستجابة مرة أخرى إلى خادم الاستدلال

- يرد خادم الاستدلال على العملاء بالنتائج التي تم إنشاؤها

توجد تحديات في الجدولة على مستوى الطلب عندما يتفاعل خادم الاستدلال مع محرك التنفيذ على مستوى الطلب، مثل كل طلب يستخدم عملية بايثون، الأمر الذي يتطلب نسخة منفصلة من النموذج، وهو أمر مقيد للذاكرة. على سبيل المثال، كما هو موضح في الشكل التالي، يمكنك فقط استيعاب تحميل نسخة واحدة من نموذج بحجم 80 جيجابايت على مثيل التعلم الآلي (ML) مع 96 جيجابايت من إجمالي ذاكرة جهاز التسريع. ستحتاج إلى تحميل نسخة إضافية من النموذج بأكمله إذا كنت تريد تقديم طلبات إضافية بشكل متزامن. هذه ليست الذاكرة وفعالة من حيث التكلفة.

الآن بعد أن فهمنا التحديات التي تطرحها الجدولة على مستوى الطلب، فلنلقِ نظرة على تقنيات التجميع المختلفة التي يمكن أن تساعد في تحسين الإنتاجية.

تقنيات الخلط

في هذا القسم، نشرح تقنيات التجميع المختلفة ونوضح كيفية تنفيذها باستخدام SageMaker حاوية LMI.

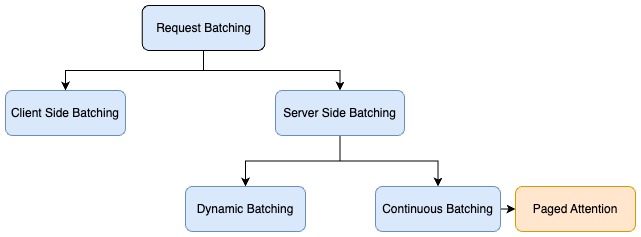

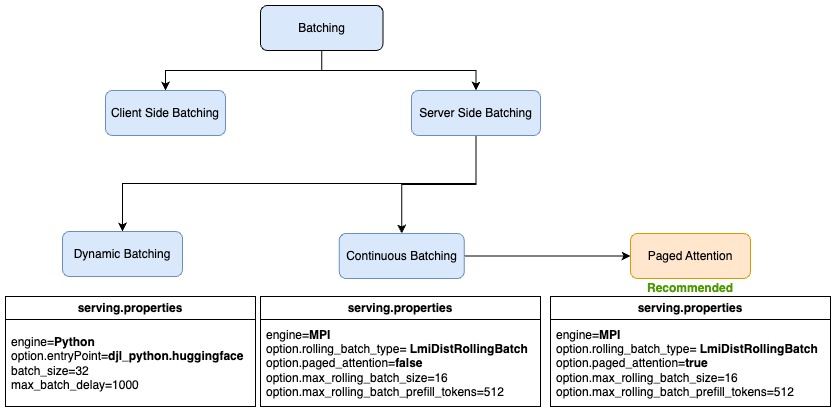

هناك نوعان رئيسيان من تجميع طلبات الاستدلال:

- جانب العميل (ثابت) - عادةً، عندما يرسل العميل طلبًا إلى الخادم، سيقوم الخادم بمعالجة كل طلب بالتسلسل افتراضيًا، وهو ليس الأمثل للإنتاجية. لتحسين الإنتاجية، يقوم العميل بتجميع طلبات الاستدلال في الحمولة الفردية ويقوم الخادم بتنفيذ منطق المعالجة المسبقة لتقسيم الدفعة إلى طلبات متعددة وتشغيل الاستدلال لكل طلب على حدة. في هذا الخيار، يحتاج العميل إلى تغيير رمز الدفعة ويكون الحل مقترنًا بإحكام بحجم الدفعة.

- جانب الخادم (ديناميكي) - أسلوب آخر للتجميع هو استخدام الاستدلال للمساعدة في تحقيق التجميع على جانب الخادم. عند وصول طلبات الاستدلال المستقلة إلى الخادم، يمكن لخادم الاستدلال تجميعها ديناميكيًا في دفعات أكبر على جانب الخادم. يمكن لخادم الاستدلال إدارة الدُفعات لتلبية هدف زمن الوصول المحدد، مما يؤدي إلى زيادة الإنتاجية مع البقاء ضمن نطاق زمن الوصول المطلوب. يتعامل خادم الاستدلال مع هذا تلقائيًا، لذلك لا يلزم إجراء تغييرات على التعليمات البرمجية من جانب العميل. يتضمن التجميع من جانب الخادم تقنيات مختلفة لتحسين الإنتاجية بشكل أكبر لنماذج اللغة التوليدية استنادًا إلى فك التشفير الانحداري التلقائي. تتضمن تقنيات التجميع هذه الدُفعات الديناميكية، والدُفعات المستمرة، وتجميع PagedAttention (vLLM).

الخلط الديناميكي

يشير التجميع الديناميكي إلى دمج طلبات الإدخال وإرسالها معًا كدفعة للاستدلال. التجميع الديناميكي هو أسلوب تجميع عام من جانب الخادم يعمل لجميع المهام، بما في ذلك رؤية الكمبيوتر (CV)، ومعالجة اللغة الطبيعية (NLP)، والمزيد.

في حاوية LMI، يمكنك تكوين تجميع الطلبات بناءً على الإعدادات التالية في خدمة:

- حجم الدفعة - يشير إلى حجم الدفعة

- max_batch_delay - يشير إلى الحد الأقصى للتأخير لتجميع الدفعة

إذا تم استيفاء أي من هذه الحدود (استيفاء الحد الأقصى لحجم الدفعة أو إكمال فترة الانتظار)، فسيتم إعداد دفعة جديدة ودفعها إلى النموذج للاستدلال عليها. يوضح الرسم البياني التالي التجميع الديناميكي للطلبات ذات أطوال تسلسل الإدخال المختلفة التي تتم معالجتها معًا بواسطة النموذج.

يمكنك تنفيذ التجميع الديناميكي على SageMaker عن طريق تكوين حاوية LMI خدمة كما يلي:

على الرغم من أن التجميع الديناميكي يمكن أن يوفر زيادة تصل إلى أربعة أضعاف في الإنتاجية مقارنة بعدم وجود تجميع، إلا أننا نلاحظ أن استخدام وحدة معالجة الرسومات ليس الأمثل في هذه الحالة لأن النظام لا يمكنه قبول دفعة أخرى حتى تكتمل معالجة جميع الطلبات.

الخلط المستمر

يعد التجميع المستمر بمثابة تحسين خاص بإنشاء النص. فهو يعمل على تحسين الإنتاجية ولا يضحي بالوقت من أجل زمن وصول البايت الأول. الخلط المستمر (المعروف أيضًا باسم ترابطي or الخلط المتداول) يعالج التحدي المتمثل في وقت وحدة معالجة الرسومات الخامل ويبني على نهج التجميع الديناميكي بشكل أكبر من خلال الدفع المستمر للطلبات الأحدث في الدفعة. يوضح الرسم البياني التالي الدفع المستمر للطلبات. عند انتهاء معالجة الطلبين 2 و3، تتم جدولة مجموعة أخرى من الطلبات.

يتعمق الرسم التخطيطي التفاعلي التالي في كيفية عمل الخلط المستمر.

(كياسة: https://github.com/InternLM/lmdeploy)

يمكنك استخدام تقنية قوية لجعل دورات LLM وإنشاء النصوص فعالة: التخزين المؤقت لبعض مصفوفات الاهتمام. وهذا يعني أن التمريرة الأولى للموجه تختلف عن التمريرات الأمامية اللاحقة. بالنسبة للمرور الأول، يجب عليك حساب مصفوفة الاهتمام بأكملها، في حين أن المتابعات تتطلب منك فقط حساب الاهتمام المميز الجديد. يتم استدعاء التمريرة الأولى التعبئة قبل في جميع أنحاء قاعدة التعليمات البرمجية هذه، في حين يتم استدعاء المتابعات فك شفرة. نظرًا لأن التعبئة المسبقة أكثر تكلفة بكثير من فك التشفير، فإننا لا نريد القيام بذلك طوال الوقت، ولكن من المحتمل أن يقوم الاستعلام الجاري حاليًا بفك التشفير. إذا أردنا استخدام الدُفعات المستمرة كما هو موضح سابقًا، فنحن بحاجة إلى تشغيل التعبئة المسبقة في مرحلة ما لإنشاء مصفوفة الاهتمام المطلوبة حتى نتمكن من الانضمام إلى مجموعة فك التشفير.

قد تسمح هذه التقنية بزيادة تصل إلى 20 مرة في الإنتاجية مقارنة بعدم التجميع من خلال الاستخدام الفعال لوحدات معالجة الرسومات الخاملة.

يمكنك ضبط المعلمات التالية في serving.properties لحاوية LMI لاستخدام الخلط المستمر:

- محرك - محرك وقت التشغيل للكود. تشمل القيم

Python,DeepSpeed,FasterTransformerوMPI. استعمالMPIلتمكين الخلط المستمر. - roll_batch – تمكين التجميع على مستوى التكرار باستخدام إحدى الاستراتيجيات المدعومة. تشمل القيم

auto,schedulerوlmi-dist. نحن نستخدمlmi-distلتشغيل الدفع المستمر لـ Llama 2. - max_rolling_batch_size – يحد من عدد الطلبات المتزامنة في الدفعة المستمرة. الافتراضي إلى 32.

- max_rolling_batch_prefill_tokens - يحد من عدد الرموز للتخزين المؤقت. يجب ضبط ذلك بناءً على حجم الدفعة وطول تسلسل الإدخال لتجنب نفاد ذاكرة وحدة معالجة الرسومات. إنه مدعوم فقط عندما

rolling_batch=lmi-dist. توصيتنا هي تعيين القيمة بناءً على عدد الطلبات المتزامنة × الذاكرة المطلوبة لتخزين رموز الإدخال ورموز الإخراج لكل طلب.

ما يلي هو نموذج التعليمات البرمجية ل serving.properties لتكوين الدفع المستمر:

تجميع PagedAttention

في عملية فك التشفير الانحداري التلقائي، تنتج جميع الرموز المميزة المدخلة إلى LLM مفتاح الانتباه وموترات القيمة الخاصة بها، ويتم الاحتفاظ بهذه الموترات في ذاكرة وحدة معالجة الرسومات لإنشاء الرموز المميزة التالية. غالبًا ما يشار إلى موترات القيمة والمفتاح المخزنة مؤقتًا باسم مخبأ كيلو فولت or مخبأ الاهتمام. حسب الورقة vLLM: عرض LLM سهل وسريع ورخيص مع PagedAttention، تستهلك ذاكرة التخزين المؤقت KV ما يصل إلى 1.7 جيجابايت لتسلسل واحد في Llama 13B. كما أنها ديناميكية. ويعتمد حجمها على طول التسلسل، وهو متغير بدرجة كبيرة ولا يمكن التنبؤ به. ونتيجة لذلك، تمثل إدارة ذاكرة التخزين المؤقت KV بكفاءة تحديًا كبيرًا. وجدت الورقة أن الأنظمة الحالية تهدر ما بين 60 إلى 80% من الذاكرة بسبب التجزئة والحجز الزائد.

PagedAttention عبارة عن خوارزمية تحسين جديدة تم تطويرها بواسطة جامعة كاليفورنيا في بيركلي تعمل على تحسين عملية التجميع المستمرة من خلال السماح لذاكرة التخزين المؤقت للانتباه (ذاكرة التخزين المؤقت KV) بأن تكون غير متجاورة من خلال تخصيص الذاكرة في صفحات أو كتل ذات حجم ثابت. وهذا مستوحى من الذاكرة الافتراضية ومفاهيم الترحيل التي تستخدمها أنظمة التشغيل.

وفقًا لورقة vLLM، يتم تقسيم ذاكرة التخزين المؤقت للانتباه لكل تسلسل من الرموز المميزة إلى كتل وتعيينها إلى كتل فعلية من خلال جدول الكتل. أثناء حساب الاهتمام، يمكن لنواة PagedAttention استخدام جدول الكتل لجلب الكتل بكفاءة من الذاكرة الفعلية. يؤدي هذا إلى تقليل كبير في هدر الذاكرة ويسمح بحجم أكبر للدفعة، وزيادة استخدام وحدة معالجة الرسومات، وإنتاجية أعلى. يوضح الشكل التالي تقسيم ذاكرة التخزين المؤقت للانتباه إلى صفحات غير متجاورة.

يعرض الرسم التخطيطي التالي مثالًا للاستدلال باستخدام PagedAttention. الخطوات الرئيسية هي:

- يتم تلقي طلب الاستدلال مع موجه الإدخال.

- في مرحلة التعبئة المسبقة، يتم حساب الاهتمام ويتم تخزين قيم المفاتيح في الذاكرة الفعلية غير المتجاورة وتعيينها إلى كتل قيمة المفتاح المنطقية. يتم تخزين هذا التعيين في جدول كتلة.

- يتم تشغيل موجه الإدخال من خلال النموذج (تمرير للأمام) لإنشاء رمز الاستجابة الأول. أثناء إنشاء رمز الاستجابة، يتم استخدام ذاكرة التخزين المؤقت للانتباه من مرحلة التعبئة المسبقة.

- أثناء إنشاء الرمز المميز اللاحق، إذا كانت الكتلة الفعلية الحالية ممتلئة، يتم تخصيص ذاكرة إضافية بطريقة غير متجاورة، مما يسمح بالتخصيص في الوقت المناسب.

يساعد PagedAttention في استخدام الذاكرة بشكل شبه مثالي وتقليل هدر الذاكرة. وهذا يسمح بتجميع المزيد من الطلبات معًا، مما يؤدي إلى زيادة كبيرة في إنتاجية الاستدلال.

التعليمات البرمجية التالية هي عينة serving.properties لتكوين مجموعة PagedAttention في حاوية LMI على SageMaker:

متى يتم استخدام تقنية الخلط

يلخص الشكل التالي تقنيات التجميع من جانب الخادم مع العينة serving.properties في LMI على SageMaker.

يلخص الجدول التالي تقنيات التجميع المختلفة وحالات استخدامها.

| تجميع الاهتمام بصفحة | الخلط المستمر | الخلط الديناميكي | التجميع من جانب العميل | لا دفعة | |

| كيف يعمل | قم دائمًا بدمج الطلبات الجديدة على مستوى الرمز المميز مع الكتل المقسمة إلى صفحات وإجراء الاستدلال الدفعي. | قم دائمًا بدمج الطلب الجديد على مستوى الرمز المميز وإجراء الاستدلال الدفعي. | دمج الطلب الجديد على مستوى الطلب؛ يمكن أن يتأخر لبضعة أجزاء من الثانية لتكوين دفعة. | يكون العميل مسؤولاً عن تجميع طلبات الاستدلال المتعددة في نفس الحمولة قبل إرسالها إلى خادم الاستدلال. | عند وصول الطلب، قم بتشغيل الاستدلال على الفور. |

| عندما يعمل بشكل أفضل | هذا هو النهج الموصى به ل أيد نماذج فك التشفير فقط إنها مناسبة لأحمال العمل المحسنة للإنتاجية. إنه قابل للتطبيق على نماذج إنشاء النص فقط. | الطلبات المتزامنة تأتي في أوقات مختلفة بنفس استراتيجية فك التشفير. إنها مناسبة لأحمال العمل المحسنة للإنتاجية. إنه قابل للتطبيق على نماذج إنشاء النص فقط. | الطلبات المتزامنة تأتي في أوقات مختلفة بنفس استراتيجية فك التشفير. إنها مناسبة لأحمال العمل الحساسة لوقت الاستجابة والتي تحتاج إلى إنتاجية أعلى. إنه ينطبق على السيرة الذاتية، البرمجة اللغوية العصبية، وأنواع أخرى من النماذج. | إنها مناسبة لحالات استخدام الاستدلال في وضع عدم الاتصال والتي لا تحتوي على قيود زمن الوصول لزيادة الإنتاجية إلى الحد الأقصى. | طلبات الاستدلال النادرة أو طلبات الاستدلال ذات استراتيجيات فك التشفير المختلفة. إنها مناسبة لأحمال العمل ذات الاحتياجات الصارمة لزمن الاستجابة. |

مقارنة الإنتاجية بين تقنيات التجميع المختلفة لنموذج توليدي كبير على SageMaker

لقد أجرينا قياس الأداء على اللاما v2 7B نموذج على SageMaker باستخدام حاوية LMI وتقنيات التجميع المختلفة التي تمت مناقشتها في هذا المنشور مع الطلبات الواردة المتزامنة التي تبلغ 50 وإجمالي عدد الطلبات 5,000.

استخدمنا ثلاث مطالبات إدخال مختلفة بأطوال متغيرة لاختبار الأداء. في الدفعة المستمرة وPagedAttention، تم تعيين أطوال الرموز المميزة للإخراج على 64 و128 و256 لمطالبات الإدخال الثلاثة، على التوالي. بالنسبة للتجميع الديناميكي، استخدمنا طول رمز إخراج ثابت يبلغ 128 رمزًا. قمنا بنشر نقاط نهاية SageMaker للاختبار باستخدام نوع المثيل ml.g5.24xlarge. يحتوي الجدول التالي على نتائج اختبارات قياس الأداء.

| الموديل | استراتيجية الضرب | الطلبات في الثانية على ml.g5.24xlarge |

| LLaMA2-7b | الخلط الديناميكي | 3.24 |

| LLaMA2-7b | الخلط المستمر | 6.92 |

| LLaMA2-7b | تجميع الاهتمام بصفحة | 7.41 |

نشهد زيادة قدرها 2.3 مرة تقريبًا في الإنتاجية باستخدام تجميع PagedAttention مقارنةً بالتجميع الديناميكي لنموذج Llama2-7B على SageMaker باستخدام حاوية LMI.

وفي الختام

في هذا المنشور، شرحنا تقنيات التجميع المختلفة لاستدلال LLM وكيف يساعد في زيادة الإنتاجية. لقد أظهرنا كيف يمكن لتقنيات تحسين الذاكرة أن تزيد من كفاءة الأجهزة عن طريق استخدام الدُفعات المستمرة وPagedAttention وتوفير قيم إنتاجية أعلى من الدُفعات الديناميكية. لقد شهدنا زيادة بمقدار 2.3 مرة تقريبًا في الإنتاجية باستخدام تجميع PagedAttention مقارنةً بالتجميع الديناميكي لنموذج Llama2-7B على SageMaker باستخدام حاوية LMI. يمكنك العثور على دفتر الملاحظات المستخدم لاختبار تقنيات التجميع المختلفة GitHub جيثب:.

عن المؤلفين

جاجان سينغ هو مدير حسابات فني أول في AWS، حيث يتعاون مع الشركات الناشئة الرقمية الأصلية لتمهيد طريقهم لتحقيق نجاح تجاري متزايد. ومن خلال تخصصه في دفع مبادرات التعلم الآلي، فإنه يستفيد من Amazon SageMaker، مع التركيز بشكل خاص على حلول التعلم العميق والذكاء الاصطناعي التوليدي. في أوقات فراغه، يجد غاغان عزاءه في الرحلات على مسارات جبال الهيمالايا والانغماس في أنواع موسيقية متنوعة.

جاجان سينغ هو مدير حسابات فني أول في AWS، حيث يتعاون مع الشركات الناشئة الرقمية الأصلية لتمهيد طريقهم لتحقيق نجاح تجاري متزايد. ومن خلال تخصصه في دفع مبادرات التعلم الآلي، فإنه يستفيد من Amazon SageMaker، مع التركيز بشكل خاص على حلول التعلم العميق والذكاء الاصطناعي التوليدي. في أوقات فراغه، يجد غاغان عزاءه في الرحلات على مسارات جبال الهيمالايا والانغماس في أنواع موسيقية متنوعة.

ضوال باتل هو مهندس رئيسي لتعلم الآلة في AWS. لقد عمل مع مؤسسات تتراوح من المؤسسات الكبيرة إلى الشركات الناشئة متوسطة الحجم في المشكلات المتعلقة بالحوسبة الموزعة والذكاء الاصطناعي. يركز على التعلم العميق بما في ذلك مجالات البرمجة اللغوية العصبية ورؤية الكمبيوتر. إنه يساعد العملاء على تحقيق استدلال نموذج عالي الأداء على SageMaker.

ضوال باتل هو مهندس رئيسي لتعلم الآلة في AWS. لقد عمل مع مؤسسات تتراوح من المؤسسات الكبيرة إلى الشركات الناشئة متوسطة الحجم في المشكلات المتعلقة بالحوسبة الموزعة والذكاء الاصطناعي. يركز على التعلم العميق بما في ذلك مجالات البرمجة اللغوية العصبية ورؤية الكمبيوتر. إنه يساعد العملاء على تحقيق استدلال نموذج عالي الأداء على SageMaker.

فينوجوبال باي هو مهندس الحلول في AWS. وهو يعيش في بنغالورو بالهند، ويساعد العملاء الرقميين الأصليين على توسيع نطاق تطبيقاتهم وتحسينها على AWS.

فينوجوبال باي هو مهندس الحلول في AWS. وهو يعيش في بنغالورو بالهند، ويساعد العملاء الرقميين الأصليين على توسيع نطاق تطبيقاتهم وتحسينها على AWS.

- محتوى مدعوم من تحسين محركات البحث وتوزيع العلاقات العامة. تضخيم اليوم.

- PlatoData.Network Vertical Generative Ai. تمكين نفسك. الوصول هنا.

- أفلاطونايستريم. ذكاء Web3. تضخيم المعرفة. الوصول هنا.

- أفلاطون كربون، كلينتك ، الطاقة، بيئة، شمسي، إدارة المخلفات. الوصول هنا.

- أفلاطون هيلث. التكنولوجيا الحيوية وذكاء التجارب السريرية. الوصول هنا.

- المصدر https://aws.amazon.com/blogs/machine-learning/improve-throughput-performance-of-llama-2-models-using-amazon-sagemaker/

- :لديها

- :يكون

- :ليس

- :أين

- $ UP

- 000

- 1

- 100

- 116

- 118

- 12

- 14

- 150

- 17

- 237

- 32

- 50

- 67

- 7

- 8

- 80

- 9

- 97

- a

- ماهرون

- مسرع

- المعجلات

- استمر

- الوصول

- استيعاب

- وفقا

- حسابي

- التأهيل

- وأضاف

- إضافي

- العنوان

- عناوين

- تبني

- مميزات

- AI

- AL

- خوارزمية

- الكل

- تخصيص

- توزيع

- السماح

- السماح

- يسمح

- على طول

- أيضا

- أمازون

- الأمازون SageMaker

- أمازون ويب سيرفيسز

- المبالغ

- an

- تحليل

- و

- آخر

- ذو صلة

- التطبيقات

- نهج

- ما يقرب من

- هي

- وصول

- مصطنع

- الذكاء الاصطناعي

- AS

- At

- اهتمام

- تلقائيا

- متاح

- تجنب

- AWS

- الى الخلف

- عرض النطاق الترددي

- قاعدة

- على أساس

- BE

- شعاع

- لان

- قبل

- يجري

- اعتقد

- المقارنة

- بيركلي

- حظر

- Blocks

- زيادة

- استراحة

- يبني

- الأعمال

- لكن

- by

- مخبأ

- تسمى

- CAN

- الطاقة الإنتاجية

- حقيبة

- الحالات

- تحدى

- التحديات

- تغيير

- التغييرات

- رخيص

- رقاقة

- زبون

- عميل

- الكود

- قاعدة التعليمات البرمجية

- الجمع بين

- آت

- عادة

- مقارنة

- مقارنة

- الطلب مكتمل

- إكمال

- حساب

- إحصاء

- الكمبيوتر

- رؤية الكمبيوتر

- الحوسبة

- القدرة الحاسوبية

- المفاهيم

- منافس

- ثابتة

- تتكون

- القيود

- مستهلك

- وعاء

- حاويات

- يحتوي

- محتوى

- متواصل

- بشكل متواصل

- المحادثات

- التكلفة

- فعاله من حيث التكلفه

- إلى جانب

- خلق

- حالياًّ

- حاليا

- زبون

- العملاء

- البيانات

- فك

- عميق

- التعلم العميق

- أعمق

- الترتيب

- الافتراضات

- تأخير

- يعتمد

- نشر

- مطلوب

- المتقدمة

- جهاز

- مختلف

- صعوبة

- رقمي

- بحث

- ناقش

- وزعت

- الحوسبة الموزعة

- توزيع

- عدة

- do

- لا

- فعل

- المجالات

- لا

- إلى أسفل

- اثنان

- أثناء

- ديناميكي

- حيوي

- E & T

- كل

- سهل

- على نحو فعال

- كفاءة

- فعال

- بكفاءة

- إما

- مؤكدا

- تمكين

- تمكن

- محرك

- الشركات

- كامل

- خاصة

- حتى

- كل

- ويبحث

- مثال

- أمثلة

- تجاوز

- المثيره

- القائمة

- ذو تكلفة باهظة

- خبرة

- شرح

- شرح

- الوجه

- الأزياء

- FAST

- تغذية

- قليل

- الشكل

- أخيرا

- ويرى

- نهاية

- الاسم الأول

- ويركز

- متابعيك

- متابعات

- البصمة

- في حالة

- النموذج المرفق

- إلى الأمام

- وجدت

- دورة تأسيسية

- تجزئة

- مجانًا

- تبدأ من

- بالإضافة إلى

- تماما

- إضافي

- توليد

- ولدت

- يولد

- توليد

- جيل

- توليدي

- الذكاء الاصطناعي التوليدي

- GIF

- GitHub جيثب:

- هدف

- وحدة معالجة الرسوميات:

- وحدات معالجة الرسومات

- طامع

- تجمع

- مقابض

- أجهزة التبخير

- يملك

- he

- تزايد

- مساعدة

- يساعد

- مرتفع

- أعلى

- أعلى

- تسليط الضوء

- جدا

- له

- كيفية

- كيفية

- HTML

- HTTPS

- تعانق الوجه

- الأفكار

- الخمول

- if

- يوضح

- صور

- فورا

- هائلة

- تنفيذ

- الأدوات

- تحسن

- تحسن

- تحسينات

- يحسن

- in

- تتضمن

- يشمل

- بما فيه

- الوارد

- القيمة الاسمية

- زيادة

- الزيادات

- مستقل

- الهند

- لديها

- نقطة الأنحراف

- المبادرات

- إدخال

- موحى

- مثل

- رؤيتنا

- التفاعلية

- يتفاعل

- إلى

- المشاركة

- IT

- انها

- الانضمام

- JPG

- أبقى

- القفل

- معروف

- لغة

- كبير

- الشركات الكبيرة

- أكبر

- كمون

- تعلم

- الطول

- مستوى

- روافع

- المكتبات

- مثل

- محدود

- حدود

- حياة

- اللاما نوع من الجمال

- LLM

- تحميل

- جار التحميل

- منطق

- منطقي

- طويل

- بحث

- آلة

- آلة التعلم

- الرئيسية

- جعل

- القيام ب

- إدارة

- مدير

- إدارة

- رسم الخرائط

- علامة

- هائل

- مصفوفة

- تعظيم

- تعظيم

- أقصى

- مايو..

- يعني

- آلية

- تعرف علي

- الاجتماع

- مكبر الصوت : يدعم، مع دعم ميكروفون مدمج لمنع الضوضاء

- دمج

- قابل

- مييتااا

- طرق

- ميلي ثانية

- تخفيف

- ML

- نموذج

- عارضات ازياء

- الأكثر من ذلك

- أكثر

- كثيرا

- متعدد

- موسيقى

- محلي

- طبيعي

- معالجة اللغات الطبيعية

- حاجة

- بحاجة

- الحاجة

- إحتياجات

- جديد

- التالي

- محراب

- البرمجة اللغوية العصبية

- لا

- مفكرة

- عدد

- NVIDIA

- رصد

- of

- حاليا

- غالبا

- on

- ONE

- فقط

- تعمل

- أنظمة التشغيل

- الأمثل

- التحسين

- الأمثل

- تحسين

- خيار

- or

- طلب

- المنظمات

- أخرى

- لنا

- خارج

- الناتج

- على مدى

- تغلب

- صفحات

- ورق

- المعلمات

- جزء

- خاصة

- شركاء

- pass

- يمر

- مسار

- تدمير

- إلى

- أداء

- تنفيذ

- فترة

- مرحلة جديدة

- مادي

- أفلاطون

- الذكاء افلاطون البيانات

- أفلاطون داتا

- البوينت

- جزء

- طرح

- منشور

- قوة

- مدعوم

- قوي

- تنبأ

- وتوقع

- توقع

- تتوقع

- أعدت

- يقدم

- الهدايا

- منع

- سابق

- سابقا

- رئيسي

- المحتمل

- مشاكل

- عملية المعالجة

- معالجتها

- معالجة

- إنتاج

- أنتج

- بارز

- دافع

- تزود

- المقدمة

- دفع

- دفع

- بايثون

- الدرجة الثانية

- نطاق

- تتراوح

- التي تم الوصول إليها

- تلقى

- يتلقى

- يستلم

- توصية مجاناً

- موصى به

- تخفيض

- تخفيض

- يشار

- يشير

- ذات صلة

- نسبي

- طلب

- طلبات

- تطلب

- مطلوب

- يتطلب

- الموارد

- على التوالي

- استجابة

- مسؤول

- تقييدي

- نتيجة

- مما أدى

- النتائج

- عودة

- يجري

- تشغيل

- يدير

- تضحية

- sagemaker

- نفسه

- رأى

- حجم

- التحجيم

- المقرر

- جدولة

- بحث

- الثاني

- القسم

- انظر تعريف

- مختار

- إرسال

- يرسل

- كبير

- مستقل

- تسلسل

- خدمة

- الخادم

- خدماتنا

- خدمة

- طقم

- إعدادات

- إظهار

- أظهرت

- أظهرت

- يظهر

- جانب

- هام

- عزباء

- المقاس

- بطيء

- So

- حل

- الحلول

- بعض

- محدد

- محدد

- ابتداء

- البدء

- الولايه او المحافظه

- البقاء

- خطوة

- خطوات

- متجر

- تخزين

- قصص

- استراتيجيات

- الإستراتيجيات

- صارم

- لاحق

- جوهري

- تحقيق النجاح

- هذه

- مناسب

- مدعومة

- نظام

- أنظمة

- جدول

- يأخذ

- مع الأخذ

- الهدف

- الأهداف

- المهام

- تقني

- تقنيات

- تجربه بالعربي

- الاختبار

- اختبارات

- نص

- من

- أن

- •

- كتلة

- من مشاركة

- منهم

- then

- وبالتالي

- تشبه

- ثلاثة

- عبر

- طوال

- الإنتاجية

- بإحكام

- الوقت

- وقت حساس

- مرات

- إلى

- سويا

- رمز

- الرموز

- تيشرت

- الإجمالي

- متدرب

- التحويلات

- محولات

- تحول

- اثنان

- نوع

- أنواع

- عادة

- فهم

- لا يمكن التنبؤ به

- حتى

- الأستعمال

- تستخدم

- مستعمل

- مستخدم

- استخدام

- يستخدم

- استخدام

- قيمنا

- القيم

- متغير

- كبير

- مقاطع فيديو

- افتراضي

- رؤيتنا

- انتظار

- تريد

- نفاية

- we

- الويب

- خدمات ويب

- كان

- متى

- في حين

- التي

- في حين

- واسع الانتشار

- سوف

- مع

- في غضون

- عمل

- أعمال

- جاري الكتابة

- X

- أنت

- زفيرنت