شهد عالم الذكاء الاصطناعي (AI) والتعلم الآلي (ML) نقلة نوعية مع ظهور نماذج الذكاء الاصطناعي التوليدية التي يمكنها إنشاء نصوص وصور ورموز وصوت شبيهة بالبشر. بالمقارنة مع نماذج ML الكلاسيكية ، فإن نماذج الذكاء الاصطناعي التوليدية أكبر بكثير وأكثر تعقيدًا. ومع ذلك ، فإن تعقيدها المتزايد يأتي أيضًا مع ارتفاع تكاليف الاستدلال والحاجة المتزايدة لموارد حسابية قوية. يمكن أن تكون التكلفة العالية للاستدلال لنماذج الذكاء الاصطناعي التوليدية عائقًا أمام دخول الشركات والباحثين ذوي الموارد المحدودة ، مما يستلزم الحاجة إلى حلول أكثر كفاءة وفعالية من حيث التكلفة. علاوة على ذلك ، تتضمن غالبية حالات استخدام الذكاء الاصطناعي التوليدية تفاعلًا بشريًا أو سيناريوهات في العالم الحقيقي ، مما يستلزم وجود أجهزة يمكنها تقديم أداء بزمن انتقال منخفض. تعمل AWS على ابتكار شرائح مصممة خصيصًا لتلبية الحاجة المتزايدة إلى أجهزة حوسبة قوية وفعالة وفعالة من حيث التكلفة.

اليوم ، نحن متحمسون للإعلان عن ذلك الأمازون SageMaker وتدعم AWS الاستدلال 2 (ml.inf2) و تدريب AWS (ml.trn1) استنادًا إلى مثيلات SageMaker لاستضافة نماذج AI التوليدية للاستدلال في الوقت الفعلي وغير المتزامن. تتوفر مثيلات ml.inf2 لنشر النموذج على مثيلات SageMaker في شرق الولايات المتحدة (أوهايو) ومثيلات ml.trn1 في شرق الولايات المتحدة (شمال فيرجينيا).

يمكنك استخدام هذه المثيلات على SageMaker لتحقيق أداء عالٍ بتكلفة منخفضة لنماذج الذكاء الاصطناعي التوليدية ، بما في ذلك نماذج اللغات الكبيرة (LLMs) والانتشار المستقر ومحولات الرؤية. بالإضافة إلى ذلك ، يمكنك استخدام ملفات التوصية بالاستدلال من Amazon SageMaker لمساعدتك في إجراء اختبارات الحمل وتقييم مزايا أداء السعر لنشر النموذج الخاص بك على هذه الحالات.

يمكنك استخدام مثيلات ml.inf2 و ml.trn1 لتشغيل تطبيقات ML الخاصة بك على SageMaker لتلخيص النص وإنشاء التعليمات البرمجية وإنشاء مقاطع الفيديو والصور والتعرف على الكلام والتخصيص واكتشاف الاحتيال والمزيد. يمكنك البدء بسهولة عن طريق تحديد حالات ml.trn1 أو ml.inf2 عند تكوين نقطة نهاية SageMaker. يمكنك استخدام حاويات AWS Deep Learning (DLC) المتوافقة مع ml.trn1 و ml.inf2 لـ PyTorch و TensorFlow و Hugging Face واستدلال النماذج الكبيرة (LMI) للبدء بسهولة. للحصول على القائمة الكاملة مع الإصدارات ، انظر صور حاويات التعلم العميق المتاحة.

في هذا المنشور ، نعرض عملية نشر نموذج لغة كبير على AWS Inferentia2 باستخدام SageMaker ، دون الحاجة إلى أي تشفير إضافي ، من خلال الاستفادة من حاوية LMI. نحن نستخدم ال GPT4ALL-J، نموذج GPT-J 7B مضبوط بدقة يوفر تفاعل أسلوب روبوت المحادثة.

نظرة عامة على مثيلات ml.trn1 و ml.inf2

يتم تشغيل مثيلات ml.trn1 بواسطة مسرع Trainium ، والذي تم تصميمه بشكل أساسي للتدريب على التعلم العميق عالي الأداء لنماذج الذكاء الاصطناعي التوليدية ، بما في ذلك LLMs. ومع ذلك ، تدعم هذه الحالات أيضًا استنتاج أحمال العمل للنماذج التي تكون أكبر حتى مما يناسب Inf2. أكبر حجم للمثيل ، مثيلات trn1.32xlarge ، يضم 16 مسرعات Trainium مع 512 جيجا بايت من ذاكرة التسريع في مثيل واحد توفر ما يصل إلى 3.4 بيتافلوب من قوة حوسبة FP16 / BF16. 16 مسرعات Trainium متصلة بـ NeuronLinkv2 فائقة السرعة من أجل اتصالات جماعية مبسطة.

يتم تشغيل مثيلات ml.Inf2 بواسطة ملف مُسرع AWS Inferentia2، مسرع مصمم لغرض الاستدلال. إنها توفر أداء حوسبة أعلى بثلاث مرات ، وإنتاجية أعلى بأربع مرات ، وزمن انتقال أقل بما يصل إلى 10 مرات مقارنة بالجيل الأول من AWS Inferentia. أكبر حجم للمثيل ، Inf2.48xlarge ، يتميز بـ 12 مسرّع AWS Inferentia2 مع 384 غيغابايت من ذاكرة التسريع في مثيل واحد للحصول على قوة حوسبة مجمعة تبلغ 2.3 بيتافلوب لـ BF16 / FP16. يمكّنك من نشر ما يصل إلى 175 مليار نموذج في مثيل واحد. Inf2 هو المثيل الوحيد المُحسَّن للاستدلال لتقديم هذا الترابط ، وهي ميزة لا تتوفر إلا في حالات التدريب الأكثر تكلفة. بالنسبة للطرز الكبيرة جدًا التي لا تتناسب مع مسرع واحد ، تتدفق البيانات مباشرة بين المسرعات باستخدام NeuronLink ، متجاوزًا وحدة المعالجة المركزية تمامًا. باستخدام NeuronLink ، يدعم Inf2 الاستدلال الموزع بشكل أسرع ويحسن الإنتاجية وزمن الانتقال.

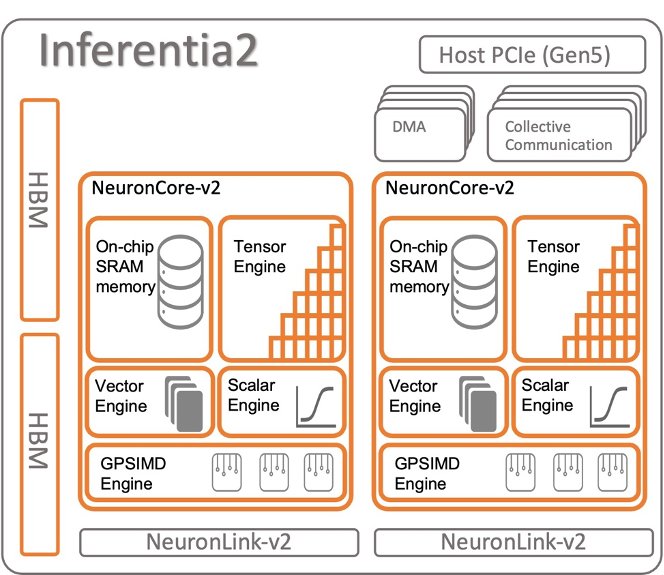

يحتوي كل من مسرعي AWS Inferentia2 و Trainium على اثنين NeuronCores- v2 تحديث، مكدسات ذاكرة HBM بسعة 32 جيجا بايت ، ومحركات مخصصة للحوسبة الجماعية ، والتي تعمل تلقائيًا على تحسين وقت التشغيل من خلال تداخل الحساب والاتصال عند إجراء استدلال متعدد المسرع. لمزيد من التفاصيل حول الهندسة المعمارية ، يرجى الرجوع إلى أجهزة Trainium و Inferentia.

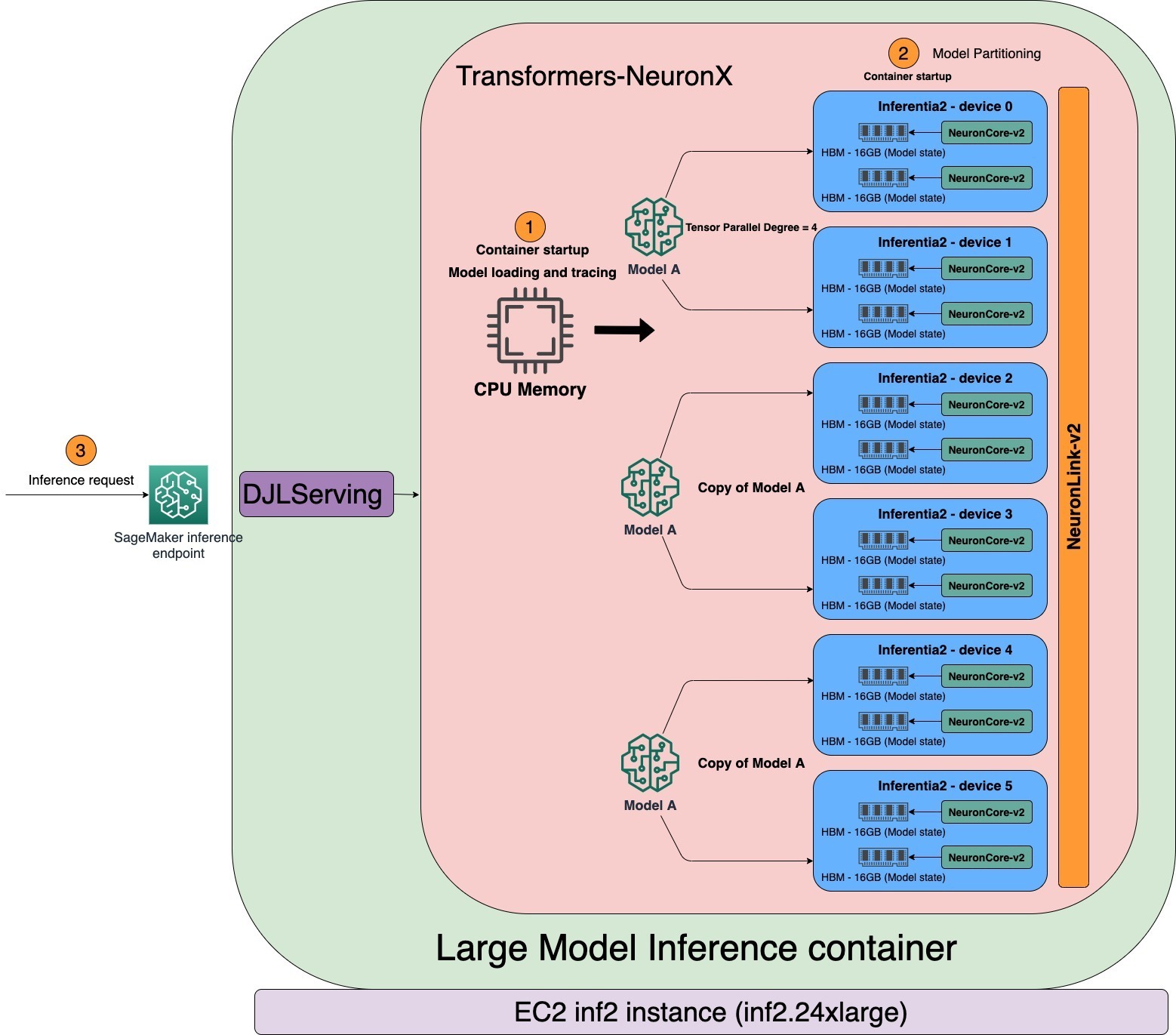

يُظهر الرسم البياني التالي نموذجًا معماريًا باستخدام AWS Inferentia2.

AWS العصبية SDK

AWS نيورون هي SDK المستخدمة لتشغيل أعباء عمل التعلم العميق على المثيلات القائمة على AWS Inferentia و Trainium. يتضمن AWS Neuron مترجمًا للتعلم العميق ووقت تشغيل وأدوات مدمجة أصلاً في TensorFlow و PyTorch. باستخدام Neuron ، يمكنك تطوير وتخصيص ونشر أحمال عمل ML عالية الأداء على ml.trn1 و ml.inf2.

• مترجم الخلايا العصبية يقبل نماذج ML بتنسيقات مختلفة (TensorFlow و PyTorch و XLA HLO) ويحسنها للتشغيل على أجهزة Neuron. يتم استدعاء مترجم Neuron داخل إطار عمل ML ، حيث يتم إرسال نماذج ML إلى المترجم بواسطة المكون الإضافي لـ Neuron framework. يُطلق على أداة المترجم الناتجة اسم ملف NEFF (تنسيق ملف Neuron القابل للتنفيذ) والذي يتم تحميله بدوره بواسطة وقت تشغيل Neuron إلى جهاز Neuron.

• وقت تشغيل الخلايا العصبية يتكون من برنامج تشغيل kernel ومكتبات C / C ++ ، والتي توفر واجهات برمجة تطبيقات للوصول إلى أجهزة AWS Inferentia و Trainium Neuron. تستخدم المكونات الإضافية لإطارات عمل Neuron ML لـ TensorFlow و PyTorch وقت تشغيل Neuron لتحميل النماذج وتشغيلها على NeuronCores. يقوم وقت تشغيل Neuron بتحميل نماذج التعلم العميق المجمعة (NEFF) لأجهزة Neuron وتم تحسينها للإنتاجية العالية وزمن الانتقال المنخفض.

استضف نماذج البرمجة اللغوية العصبية باستخدام مثيلات SageMaker ml.inf2

قبل أن نغوص بعمق في خدمة ماجستير في القانون مع محولات الخلايا العصبية، وهي مكتبة مفتوحة المصدر لتقسيم مصفوفات الوزن الكبيرة للنموذج إلى عدة NeuronCores ، دعنا ننتقل بإيجاز إلى تدفق النشر النموذجي لنموذج يمكن أن يتناسب مع NeuronCore الفردي.

افحص ال قائمة الموديلات المدعومة لضمان دعم النموذج على AWS Inferentia2. بعد ذلك ، يجب أن يتم تجميع النموذج مسبقًا بواسطة Neuron Compiler. يمكنك استخدام دفتر SageMaker أو ملف الأمازون الحوسبة المرنة السحابية (Amazon EC2) لتجميع النموذج. يمكنك استخدام SageMaker Python SDK لنشر النماذج باستخدام أطر عمل التعلم العميق الشائعة مثل PyTorch ، كما هو موضح في الكود التالي. يمكنك نشر النموذج الخاص بك في خدمات استضافة SageMaker والحصول على نقطة نهاية يمكن استخدامها للاستدلال. تتم إدارة نقاط النهاية هذه بشكل كامل وتدعم القياس التلقائي.

الرجوع إلى تدفقات المطور لمزيد من التفاصيل حول تدفقات التطوير النموذجية لـ Inf2 على SageMaker مع نماذج البرامج النصية.

استضافة LLM باستخدام مثيلات SageMaker ml.inf2

غالبًا ما تكون النماذج اللغوية الكبيرة ذات المليارات من المعلمات أكبر من أن تتناسب مع مسرّع واحد. هذا يستلزم استخدام التقنيات المتوازية النموذجية لاستضافة LLM عبر عدة مسرعات. هناك مطلب أساسي آخر لاستضافة LLM وهو تنفيذ حل خدمة نموذج عالي الأداء. يجب أن يقوم هذا الحل بتحميل النموذج بكفاءة وإدارة التقسيم وخدمة الطلبات بسلاسة عبر نقاط نهاية HTTP.

يتضمن SageMaker حاويات التعلم العميق المتخصصة (DLC) والمكتبات والأدوات لتوازي النموذج واستدلال النموذج الكبير. للحصول على الموارد لبدء استخدام LMI على SageMaker ، ارجع إلى التوازي النموذجي واستدلال النموذج الكبير. تحافظ SageMaker على DLCs مع مكتبات مفتوحة المصدر شهيرة لاستضافة نماذج كبيرة مثل GPT و T5 و OPT و BLOOM و Stable Diffusion على بنية AWS الأساسية. يشار إلى هذه DLCs المتخصصة باسم حاويات SageMaker LMI.

حاويات SageMaker LMI استخدم DJLServing ، وهو خادم نموذجي متكامل مع مكتبة المحولات العصبية لدعم توازي الموتر عبر NeuronCores. لمعرفة المزيد حول كيفية عمل DJLServing ، ارجع إلى انشر نماذج كبيرة على Amazon SageMaker باستخدام الاستدلال المتوازي لنموذج DJLServing و DeepSpeed. يعمل خادم نموذج DJL ومكتبة المحولات العصبية كمكونات أساسية للحاوية ، والتي تتضمن أيضًا Neuron SDK. يسهل هذا الإعداد تحميل النماذج على مسرعات AWS Inferentia2 ، ويوازي النموذج عبر العديد من NeuronCores ، ويتيح الخدمة عبر نقاط نهاية HTTP.

تدعم حاوية LMI تحميل النماذج من ملف خدمة تخزين أمازون البسيطة (Amazon S3) دلو أو Hugging Face Hub. يقوم البرنامج النصي للمعالج الافتراضي بتحميل النموذج وتجميعه وتحويله إلى تنسيق محسن لـ Neuron وتحميله. لاستخدام حاوية LMI لاستضافة LLM ، لدينا خياران:

- لا كود (مفضل) - هذه هي أسهل طريقة لنشر LLM باستخدام حاوية LMI. في هذه الطريقة ، يمكنك استخدام المعالج الافتراضي وقم فقط بتمرير اسم النموذج والمعلمات المطلوبة في

serving.propertiesملف لتحميل واستضافة النموذج. لاستخدام المعالج الافتراضي ، نقدم ملفentryPointالمعلمة مثلdjl_python.transformers-neuronx. - أحضر البرنامج النصي الخاص بك - في هذا الأسلوب ، لديك خيار إنشاء ملف model.py الخاص بك ، والذي يحتوي على الكود اللازم لتحميل النموذج وتقديمه. يعمل هذا الملف كوسيط بين ملفات

DJLServingواجهات برمجة التطبيقات وtransformers-neuronxواجهات برمجة التطبيقات. لتخصيص عملية تحميل النموذج ، يمكنك توفيرserving.propertiesمع معلمات شكلي. للحصول على قائمة شاملة للمعلمات القابلة للتكوين المتاحة ، يرجى الرجوع إلى جميع خيارات تكوين DJL. هنا مثال على ملف model.py ملف.

هندسة وقت التشغيل

• tensor_parallel_degree تحدد قيمة الخاصية توزيع الوحدات النمطية المتوازية للموتر عبر العديد من الخلايا العصبية. على سبيل المثال ، يحتوي inf2.24xlarge على ستة مسرعات AWS Inferentia2. يحتوي كل مسرّع AWS Inferentia2 على اثنين من NeuronCores. يحتوي كل NeuronCore على ذاكرة مخصصة عالية النطاق الترددي (HBM) تبلغ 16 جيجا بايت لتخزين الوحدات المتوازية المتوازية. مع درجة موتر متوازية تبلغ 4 ، سيخصص LMI ثلاث نسخ نموذجية من نفس النموذج ، كل منها يستخدم أربعة NeuronCores. كما هو موضح في الرسم البياني التالي ، عند بدء تشغيل حاوية LMI ، سيتم تحميل النموذج وتتبعه أولاً في ذاكرة وحدة المعالجة المركزية القابلة للتوجيه. عند اكتمال التتبع ، يتم تقسيم النموذج عبر NeuronCores بناءً على درجة الموتر المتوازية.

يستخدم LMI نظام DJLServing كمكدس تقديم نموذجي. بعد اجتياز فحص صحة الحاوية في SageMaker ، تكون الحاوية جاهزة لخدمة طلب الاستدلال. تطلق DJLServing العديد من عمليات Python المكافئة لملف TOTAL NUMBER OF NEURON CORES/TENSOR_PARALLEL_DEGREE. تحتوي كل عملية Python على مؤشرات ترابط في C ++ مكافئة لـ TENSOR_PARALLEL_DEGREE. كل خيط C ++ يحمل جزءًا واحدًا من النموذج على NeuronCore واحد.

يميل العديد من الممارسين (عملية Python) إلى تشغيل الاستدلال بالتسلسل عندما يتم استدعاء الخادم بطلبات مستقلة متعددة. على الرغم من أنه من الأسهل إعداده ، إلا أنه ليس من أفضل الممارسات عادةً الاستفادة من القدرة الحسابية للمسرع. لمعالجة هذا الأمر ، تقدم DJLServing التحسينات المضمنة للتجميع الديناميكي لدمج طلبات الاستدلال المستقلة هذه على جانب الخادم لتكوين دفعة أكبر ديناميكيًا لزيادة الإنتاجية. تصل جميع الطلبات إلى جهاز التجميع الديناميكي أولاً قبل الدخول إلى قوائم انتظار الوظائف الفعلية لانتظار الاستدلال. يمكنك تعيين أحجام الدُفعات المفضلة لديك للجمع الديناميكي باستخدام ملف batch_size الإعدادات في serving.properties. يمكنك أيضًا تكوين ملفات max_batch_delay لتحديد الحد الأقصى لوقت التأخير في المُجمع لانتظار الطلبات الأخرى للانضمام إلى الدُفعة بناءً على متطلبات زمن الانتقال. تعتمد الإنتاجية أيضًا على عدد نسخ النموذج ومجموعات معالجة Python التي تم إطلاقها في الحاوية. كما هو موضح في الرسم البياني التالي ، مع ضبط درجة التنسور المتوازية على 4 ، تطلق حاوية LMI ثلاث مجموعات عمليات Python ، كل منها يحمل النسخة الكاملة من النموذج. يتيح لك ذلك زيادة حجم الدُفعة والحصول على إنتاجية أعلى.

دفتر SageMaker لنشر LLM

في هذا القسم ، نقدم عرضًا تفصيليًا خطوة بخطوة لنشر GPT4All-J ، وهو نموذج مكون من 6 مليارات معلمة تبلغ 24 جيجابايت في FP32. GPT4All-J هو روبوت محادثة شائع تم تدريبه على مجموعة متنوعة من محتوى التفاعل مثل مشاكل الكلمات والحوارات والرموز والقصائد والأغاني والقصص. GPT4all-J هو نموذج GPT-J مضبوط بدقة يولد استجابات مشابهة للتفاعلات البشرية.

يتم توفير دفتر الملاحظات الكامل لهذا المثال في GitHub جيثب:. يمكننا استخدام SageMaker Python SDK لنشر النموذج على مثيل Inf2. نحن نستخدم المعالج الافتراضي لتحميل النموذج. مع هذا ، نحتاج فقط إلى توفير ملف الحصص ملف. يحتوي هذا الملف على التكوينات المطلوبة لخادم طراز DJL لتنزيل النموذج واستضافته. يمكننا تحديد اسم نموذج Hugging Face باستخدام ملف model_id المعلمة لتنزيل النموذج مباشرة من Hugging Face repo. بدلاً من ذلك ، يمكنك تنزيل النموذج من Amazon S3 من خلال توفير ملف s3url معامل. ال entryPoint تم تكوين المعلمة للإشارة إلى المكتبة لتحميل النموذج. لمزيد من التفاصيل حول djl_python.fastertransformer، الرجوع إلى كود جيثب.

• tensor_parallel_degree تحدد قيمة الخاصية توزيع وحدات موتر متوازية عبر أجهزة متعددة. على سبيل المثال ، مع 12 NeuronCores ودرجة موتر متوازية تبلغ 4 ، سيخصص LMI ثلاث نسخ من النماذج ، كل منها يستخدم أربعة NeuronCores. يمكنك أيضًا تحديد نوع الدقة باستخدام الخاصية dtype. n_position تحدد المعلمة مجموع الحد الأقصى لطول تسلسل الإدخال والإخراج للنموذج. انظر الكود التالي:

بناء tarball تحتوي serving.properties وتحميله إلى حاوية S3. على الرغم من استخدام المعالج الافتراضي في هذا المثال ، يمكنك تطوير ملف model.py ملف لتخصيص عملية التحميل والخدمة. إذا كانت هناك أي حزم تحتاج إلى التثبيت ، فقم بتضمينها في ملف requirements.txt ملف. انظر الكود التالي:

استرجع صورة حاوية DJL وأنشئ نموذج SageMaker:

بعد ذلك ، نقوم بإنشاء نقطة نهاية SageMaker مع تكوين النموذج المحدد مسبقًا. تقوم الحاوية بتنزيل النموذج في ملف /tmp space لأن SageMaker يقوم بتعيين ملف /tmp إلى متجر أمازون مطاط بلوك (Amazon EBS). نحن بحاجة إلى إضافة volume_size المعلمة لضمان /tmp الدليل به مساحة كافية لتنزيل النموذج وتجميعه. وضعنا container_startup_health_check_timeout إلى 3,600 ثانية لضمان بدء الفحص الصحي بعد أن يصبح النموذج جاهزًا. نحن نستخدم المثيل ml.inf2.8xlarge. انظر الكود التالي:

بعد إنشاء نقطة نهاية SageMaker ، يمكننا عمل تنبؤات في الوقت الفعلي مقابل نقاط نهاية SageMaker باستخدام Predictor موضوع:

تنظيف

احذف نقاط النهاية لتوفير التكاليف بعد الانتهاء من اختباراتك:

وفي الختام

في هذا المنشور ، عرضنا القدرة التي تم إطلاقها حديثًا لـ SageMaker ، والتي تدعم الآن مثيلات ml.inf2 و ml.trn1 لاستضافة نماذج الذكاء الاصطناعي التوليدية. لقد أوضحنا كيفية نشر GPT4ALL-J ، نموذج الذكاء الاصطناعي التوليفي ، على AWS Inferentia2 باستخدام SageMaker وحاوية LMI ، دون كتابة أي رمز. عرضنا أيضًا كيف يمكنك استخدام DJLServing و transformers-neuronx لتحميل نموذج وتقسيمه وتقديمه.

توفر مثيلات Inf2 الطريقة الأكثر فعالية من حيث التكلفة لتشغيل نماذج الذكاء الاصطناعي التوليدية على AWS. للحصول على تفاصيل الأداء ، يرجى الرجوع إلى أداء Inf2.

افحص GitHub جيثب: الريبو لمثال على دفتر الملاحظات. جربه وأخبرنا إذا كان لديك أي أسئلة!

حول المؤلف

فيفيك جانجاساني هو كبير مهندسي حلول التعلم الآلي في Amazon Web Services. يعمل مع Machine Learning Startups لبناء ونشر تطبيقات AI / ML على AWS. يركز حاليًا على تقديم حلول لـ MLOps و ML Inference و ML منخفض الكود. لقد عمل في مشاريع في مجالات مختلفة ، بما في ذلك معالجة اللغة الطبيعية والرؤية الحاسوبية.

فيفيك جانجاساني هو كبير مهندسي حلول التعلم الآلي في Amazon Web Services. يعمل مع Machine Learning Startups لبناء ونشر تطبيقات AI / ML على AWS. يركز حاليًا على تقديم حلول لـ MLOps و ML Inference و ML منخفض الكود. لقد عمل في مشاريع في مجالات مختلفة ، بما في ذلك معالجة اللغة الطبيعية والرؤية الحاسوبية.

هيروشي توكويو مهندس حلول في مختبرات AWS Annapurna. يوجد مقره في اليابان ، وانضم إلى معامل أنابورنا حتى قبل الاستحواذ عليها من قبل AWS وساعد العملاء باستمرار باستخدام تقنية مختبرات أنابورنا. ينصب تركيزه مؤخرًا على حلول التعلم الآلي القائمة على السيليكون المصمم لغرض معين و AWS Inferentia و Trainium.

هيروشي توكويو مهندس حلول في مختبرات AWS Annapurna. يوجد مقره في اليابان ، وانضم إلى معامل أنابورنا حتى قبل الاستحواذ عليها من قبل AWS وساعد العملاء باستمرار باستخدام تقنية مختبرات أنابورنا. ينصب تركيزه مؤخرًا على حلول التعلم الآلي القائمة على السيليكون المصمم لغرض معين و AWS Inferentia و Trainium.

ضوال باتل هو مهندس رئيسي لتعلم الآلة في AWS. لقد عمل مع مؤسسات تتراوح من المؤسسات الكبيرة إلى الشركات الناشئة متوسطة الحجم في المشكلات المتعلقة بالحوسبة الموزعة والذكاء الاصطناعي. يركز على التعلم العميق بما في ذلك مجالات البرمجة اللغوية العصبية ورؤية الكمبيوتر. إنه يساعد العملاء على تحقيق استدلال نموذج عالي الأداء على SageMaker.

ضوال باتل هو مهندس رئيسي لتعلم الآلة في AWS. لقد عمل مع مؤسسات تتراوح من المؤسسات الكبيرة إلى الشركات الناشئة متوسطة الحجم في المشكلات المتعلقة بالحوسبة الموزعة والذكاء الاصطناعي. يركز على التعلم العميق بما في ذلك مجالات البرمجة اللغوية العصبية ورؤية الكمبيوتر. إنه يساعد العملاء على تحقيق استدلال نموذج عالي الأداء على SageMaker.

تشينغ لان هو مهندس تطوير برمجيات في AWS. لقد كان يعمل على العديد من المنتجات الصعبة في Amazon ، بما في ذلك حلول استدلال ML عالية الأداء ونظام تسجيل عالي الأداء. أطلق فريق Qing بنجاح أول نموذج مليار معلمة في إعلانات أمازون بزمن انتقال منخفض للغاية مطلوب. تتمتع Qing بمعرفة متعمقة حول تحسين البنية التحتية وتسريع التعلم العميق.

تشينغ لان هو مهندس تطوير برمجيات في AWS. لقد كان يعمل على العديد من المنتجات الصعبة في Amazon ، بما في ذلك حلول استدلال ML عالية الأداء ونظام تسجيل عالي الأداء. أطلق فريق Qing بنجاح أول نموذج مليار معلمة في إعلانات أمازون بزمن انتقال منخفض للغاية مطلوب. تتمتع Qing بمعرفة متعمقة حول تحسين البنية التحتية وتسريع التعلم العميق.

تشينغوي لي هو متخصص في التعلم الآلي في Amazon Web Services. حصل على الدكتوراه. في بحوث العمليات بعد أن كسر حساب منحة مستشاره البحثي وفشل في تسليم جائزة نوبل التي وعد بها. يقوم حاليًا بمساعدة العملاء في مجال الخدمات المالية وصناعة التأمين في بناء حلول التعلم الآلي على AWS. في أوقات فراغه يحب القراءة والتعليم.

تشينغوي لي هو متخصص في التعلم الآلي في Amazon Web Services. حصل على الدكتوراه. في بحوث العمليات بعد أن كسر حساب منحة مستشاره البحثي وفشل في تسليم جائزة نوبل التي وعد بها. يقوم حاليًا بمساعدة العملاء في مجال الخدمات المالية وصناعة التأمين في بناء حلول التعلم الآلي على AWS. في أوقات فراغه يحب القراءة والتعليم.

آلان تان هو مدير أول للمنتجات مع جهود SageMaker الرائدة في الاستدلال على النماذج الكبيرة. إنه متحمس لتطبيق التعلم الآلي في مجال التحليلات. خارج العمل ، يستمتع بالخارج.

آلان تان هو مدير أول للمنتجات مع جهود SageMaker الرائدة في الاستدلال على النماذج الكبيرة. إنه متحمس لتطبيق التعلم الآلي في مجال التحليلات. خارج العمل ، يستمتع بالخارج.

فارون سيال هو مهندس تطوير برمجيات مع AWS Sagemaker يعمل على ميزات مواجهة العملاء المهمة لمنصة ML Inference. إنه متحمس للعمل في مجال الأنظمة الموزعة والذكاء الاصطناعي. في أوقات فراغه ، يحب القراءة والبستنة.

فارون سيال هو مهندس تطوير برمجيات مع AWS Sagemaker يعمل على ميزات مواجهة العملاء المهمة لمنصة ML Inference. إنه متحمس للعمل في مجال الأنظمة الموزعة والذكاء الاصطناعي. في أوقات فراغه ، يحب القراءة والبستنة.

- محتوى مدعوم من تحسين محركات البحث وتوزيع العلاقات العامة. تضخيم اليوم.

- أفلاطونايستريم. ذكاء بيانات Web3. تضخيم المعرفة. الوصول هنا.

- سك المستقبل مع أدرين أشلي. الوصول هنا.

- شراء وبيع الأسهم في شركات ما قبل الاكتتاب مع PREIPO®. الوصول هنا.

- المصدر https://aws.amazon.com/blogs/machine-learning/achieve-high-performance-with-lowest-cost-for-generative-ai-inference-using-aws-inferentia2-and-aws-trainium-on-amazon-sagemaker/

- :لديها

- :يكون

- :ليس

- :أين

- $ UP

- 10

- 100

- 12

- 13

- 14

- 15%

- 22

- 24

- 7

- 8

- 9

- a

- من نحن

- مسرع

- المعجلات

- يقبل

- الوصول

- حسابي

- التأهيل

- استحواذ

- في

- الأفعال

- تضيف

- إضافة

- العنوان

- عنونة

- مميزات

- دعاية

- بعد

- ضد

- AI

- حالات استخدام ai

- AI / ML

- الكل

- يسمح

- أيضا

- بالرغم ان

- أمازون

- Amazon EC2

- الأمازون SageMaker

- أمازون ويب سيرفيسز

- an

- تحليلات

- و

- أعلن

- آخر

- أي وقت

- واجهات برمجة التطبيقات

- التطبيقات

- تطبيق

- نهج

- هندسة معمارية

- هي

- المنطقة

- مصطنع

- الذكاء الاصطناعي

- الذكاء الاصطناعي (منظمة العفو الدولية)

- AS

- At

- سمعي

- السيارات

- تلقائيا

- متاح

- AWS

- استدلال AWS

- كرة

- عرض النطاق الترددي

- حاجز

- على أساس

- BE

- لان

- كان

- قبل

- الفوائد

- أفضل

- ما بين

- كبير

- أكبر

- المليارات

- حظر

- المدونة

- إزهار

- موجز

- حطم

- نساعدك في بناء

- بنيت

- مدمج

- الأعمال

- by

- C + +

- تسمى

- CAN

- الحالات

- تحدي

- chatbot

- التحقق

- شيبس

- الكود

- البرمجة

- جماعي

- دمج

- الجمع بين

- يأتي

- Communication

- مجال الاتصالات

- مقارنة

- متوافق

- إكمال

- تماما

- مجمع

- تعقيد

- مكونات

- شامل

- حساب

- إحصاء

- الكمبيوتر

- رؤية الكمبيوتر

- الحوسبة

- الاعداد

- متصل

- وعاء

- حاويات

- يحتوي

- محتوى

- جوهر

- التكلفة

- فعاله من حيث التكلفه

- التكاليف

- خلق

- خلق

- حرج

- حاسم

- حاليا

- زبون

- العملاء

- تصميم

- البيانات

- مخصصة

- عميق

- التعلم العميق

- الترتيب

- تعريف

- يعرف

- الدرجة العلمية

- تأخير

- نقل

- تقديم

- يسلم

- تظاهر

- يعتمد

- نشر

- نشر

- نشر

- تفاصيل

- كشف

- يحدد

- تطوير

- التطوير التجاري

- جهاز

- الأجهزة

- مختلف

- التوزيع

- مباشرة

- وزعت

- الحوسبة الموزعة

- الانظمة الموزعة

- توزيع

- فعل

- المجالات

- لا

- بإمكانك تحميله

- التنزيلات

- سائق

- ديناميكي

- حيوي

- كل

- في وقت سابق

- أسهل

- أسهل

- بسهولة

- الشرق

- فعال

- بكفاءة

- جهود

- تمكن

- النهاية

- نقطة النهاية

- مهندس

- محركات

- كاف

- ضمان

- الدخول

- الشركات

- دخول

- معادل

- تقييم

- حتى

- مثال

- متحمس

- ذو تكلفة باهظة

- احتفل على

- الوجه

- يسهل

- مواجهة

- فشل

- أسرع

- الميزات

- المميزات

- قم بتقديم

- مالي

- الخدمات المالية

- نهاية

- الاسم الأول

- تناسب

- تدفق

- يطفو

- تركز

- ركز

- ويركز

- متابعيك

- في حالة

- النموذج المرفق

- شكل

- أربعة

- الإطار

- الأطر

- احتيال

- الكشف عن الغش

- تبدأ من

- بالإضافة إلى

- تماما

- علاوة على ذلك

- يولد

- جيل

- توليدي

- الذكاء الاصطناعي التوليدي

- دولار فقط واحصل على خصم XNUMX% على جميع

- Go

- منح

- مجموعات

- متزايد

- أجهزة التبخير

- يملك

- he

- صحة الإنسان

- مساعدة

- ساعد

- يساعد

- هنا

- مرتفع

- أداء عالي

- أعلى

- له

- عقد

- يحمل

- مضيف

- استضافة

- خدمات الاستضافة

- منـزل

- كيفية

- كيفية

- لكن

- HTML

- HTTP

- HTTPS

- محور

- الانسان

- if

- صورة

- صور

- التنفيذ

- استيراد

- in

- في العمق

- تتضمن

- يشمل

- بما فيه

- القيمة الاسمية

- في ازدياد

- مستقل

- العالمية

- البنية التحتية

- ابتكار

- إدخال

- المدخلات

- التركيب

- مثل

- التأمين

- المتكاملة

- رؤيتنا

- تفاعل

- التفاعلات

- وسيط

- إلى

- التذرع

- تنطوي

- IT

- انها

- اليابان

- وظيفة

- الانضمام

- انضم

- JPG

- جسون

- م

- علم

- المعرفة

- مختبرات

- لغة

- كبير

- الشركات الكبيرة

- أكبر

- أكبر

- كمون

- أطلقت

- تطلق

- قيادة

- تعلم

- تعلم

- الطول

- اسمحوا

- المكتبات

- المكتبة

- مثل

- الإعجابات

- محدود

- قائمة

- LLM

- تحميل

- جار التحميل

- الأحمال

- تسجيل

- منخفض

- خفض

- أدنى

- آلة

- آلة التعلم

- في الأساس

- تحتفظ

- أغلبية

- جعل

- إدارة

- تمكن

- مدير

- برنامج Maps

- ماكس

- أقصى

- مكبر الصوت : يدعم، مع دعم ميكروفون مدمج لمنع الضوضاء

- طريقة

- ML

- MLOps

- نموذج

- عارضات ازياء

- الوحدات

- الأكثر من ذلك

- أكثر فعالية

- أكثر

- متعدد

- الاسم

- طبيعي

- معالجة اللغات الطبيعية

- ضروري

- حاجة

- إحتياجات

- جديد

- نيويورك

- التالي

- البرمجة اللغوية العصبية

- جائزة نوبل

- مفكرة

- الآن

- عدد

- موضوع

- of

- عرض

- عروض

- غالبا

- أوهايو

- on

- ONE

- فقط

- المصدر المفتوح

- عمليات

- التحسين

- الأمثل

- الأمثل

- المثلى

- خيار

- مزيد من الخيارات

- or

- المنظمات

- أخرى

- لنا

- خارج

- في الهواء الطلق

- الناتج

- في الخارج

- الخاصة

- حزم

- نموذج

- موازية

- المعلمة

- المعلمات

- pass

- يمر

- عاطفي

- أداء

- التخصيص

- المنصة

- أفلاطون

- الذكاء افلاطون البيانات

- أفلاطون داتا

- المساعد

- الإضافات

- البوينت

- الرائج

- منشور

- قوة

- مدعوم

- قوي

- ممارسة

- دقة

- تنبؤات

- متنبئ

- المفضل

- رئيسي

- جائزة

- مشاكل

- عملية المعالجة

- العمليات

- معالجة

- المنتج

- مدير المنتج

- المنتجات

- ملفي الشخصي

- مشروع ناجح

- وعد

- HAS

- الملكية

- تزود

- المقدمة

- ويوفر

- توفير

- غرض

- بايثون

- pytorch

- تتراوح

- الوصول

- نادي القراءة

- استعداد

- العالم الحقيقي

- في الوقت الحقيقي

- تلقى

- الأخيرة

- اعتراف

- يشار

- ذات صلة

- طلب

- طلبات

- مطلوب

- المتطلبات

- المتطلبات الأساسية

- بحث

- الباحثين

- الموارد

- ردود

- مما أدى

- ارتفاع

- يجري

- sagemaker

- الاستدلال SageMaker

- نفسه

- حفظ

- التحجيم

- سيناريوهات

- مخطوطات

- الإستراحة

- بسلاسة

- ثواني

- القسم

- انظر تعريف

- كبير

- تسلسل

- خدمة

- الخدمة

- خدماتنا

- خدمة

- طقم

- إعدادات

- الإعداد

- عدة

- نقل

- ينبغي

- إظهار

- عرضت

- أظهرت

- يظهر

- جانب

- بشكل ملحوظ

- السيليكون

- مماثل

- الاشارات

- عزباء

- SIX

- المقاس

- الأحجام

- So

- تطبيقات الكمبيوتر

- تطوير البرمجيات

- حل

- الحلول

- الفضاء

- متخصص

- متخصص

- خطاب

- التعرف على الكلام

- مستقر

- كومة

- كومات

- بداية

- بدأت

- يبدأ

- البدء

- تخزين

- قصص

- تخزين

- تبسيط

- نمط

- بنجاح

- هذه

- الدعم

- مدعومة

- الدعم

- نظام

- أنظمة

- مع الأخذ

- التدريس

- فريق

- تقنيات

- تكنولوجيا

- tensorflow

- اختبارات

- من

- أن

- •

- المنطقة

- من مشاركة

- منهم

- هناك.

- تشبه

- ثلاثة

- عبر

- الإنتاجية

- الوقت

- مرات

- إلى

- جدا

- أدوات

- البحث عن المفقودين

- متدرب

- قادة الإيمان

- محولات

- منعطف أو دور

- اثنان

- نوع

- نموذجي

- تم التحميل

- us

- تستخدم

- مستعمل

- استخدام

- عادة

- الاستفادة من

- استخدام

- قيمنا

- تشكيلة

- مختلف

- كبير

- جدا

- بواسطة

- فيديو

- فرجينيا

- رؤيتنا

- انتظر

- تجول

- طريق..

- we

- الويب

- خدمات ويب

- وزن

- ابحث عن

- متى

- التي

- سوف

- مع

- في غضون

- بدون

- تشهد

- كلمة

- للعمل

- عمل

- عامل

- أعمال

- العالم

- اكتب

- جاري الكتابة

- نيويورك

- أنت

- حل متجر العقارات الشامل الخاص بك في جورجيا

- زفيرنت