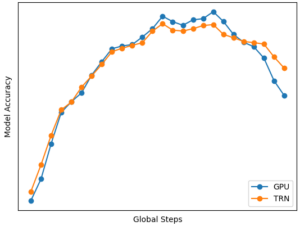

بينما تقوم المؤسسات بنشر النماذج في الإنتاج، فإنها تبحث باستمرار عن طرق لتحسين أداء نماذجها الأساسية (FMs) التي تعمل على أحدث المسرعات، مثل استدلال AWS ووحدات معالجة الرسومات، حتى تتمكن من تقليل تكاليفها وتقليل زمن الاستجابة لتوفير أفضل تجربة للمستخدمين النهائيين. ومع ذلك، فإن بعض FMs لا تستخدم بشكل كامل المسرعات المتوفرة مع المثيلات التي يتم نشرها عليها، مما يؤدي إلى استخدام غير فعال لموارد الأجهزة. تقوم بعض المؤسسات بنشر عدة FMs في نفس المثيل للاستفادة بشكل أفضل من جميع المسرعات المتاحة، ولكن هذا يتطلب تنسيقًا معقدًا للبنية التحتية يستغرق وقتًا طويلاً ويصعب إدارته. عندما تتشارك عدة FMs نفس المثيل، يكون لكل FM احتياجات التوسع وأنماط الاستخدام الخاصة بها، مما يجعل من الصعب التنبؤ عندما تحتاج إلى إضافة مثيلات أو إزالتها. على سبيل المثال، يمكن استخدام أحد النماذج لتشغيل تطبيق مستخدم حيث يمكن أن يرتفع الاستخدام خلال ساعات معينة، في حين قد يكون لنموذج آخر نمط استخدام أكثر اتساقًا. بالإضافة إلى تحسين التكاليف، يرغب العملاء في تقديم أفضل تجربة للمستخدم النهائي من خلال تقليل زمن الوصول. وللقيام بذلك، غالبًا ما يقومون بنشر نسخ متعددة من FM لتلقي الطلبات المقدمة من المستخدمين بشكل متوازٍ. نظرًا لأن مخرجات FM يمكن أن تتراوح من جملة واحدة إلى فقرات متعددة، فإن الوقت المستغرق لإكمال طلب الاستدلال يختلف بشكل كبير، مما يؤدي إلى ارتفاعات غير متوقعة في زمن الاستجابة إذا تم توجيه الطلبات بشكل عشوائي بين المثيلات. الأمازون SageMaker يدعم الآن إمكانات الاستدلال الجديدة التي تساعدك على تقليل تكاليف النشر وزمن الوصول.

يمكنك الآن إنشاء نقاط نهاية قائمة على مكونات الاستدلال ونشر نماذج التعلم الآلي (ML) إلى نقطة نهاية SageMaker. يلخص مكون الاستدلال (IC) نموذج ML الخاص بك ويمكّنك من تعيين وحدات المعالجة المركزية (CPU) أو وحدة معالجة الرسومات (GPU) أو AWS نيورون المسرعات وسياسات التوسع لكل نموذج. تقدم مكونات الاستدلال الفوائد التالية:

- سيقوم SageMaker بوضع النماذج وتعبئتها على النحو الأمثل في مثيلات تعلم الآلة لتحقيق أقصى قدر من الاستخدام، مما يؤدي إلى توفير التكاليف.

- سيقوم SageMaker بتوسيع كل نموذج لأعلى ولأسفل بناءً على التكوين الخاص بك لتلبية متطلبات تطبيق ML الخاص بك.

- سيقوم SageMaker بالتوسع لإضافة المثيلات وإزالتها ديناميكيًا لضمان توفر السعة مع الحفاظ على الحوسبة الخاملة عند الحد الأدنى.

- يمكنك تقليص حجم النسخ إلى الصفر من النموذج لتحرير الموارد لنماذج أخرى. يمكنك أيضًا تحديد إبقاء النماذج المهمة محملة دائمًا وجاهزة لخدمة حركة المرور.

باستخدام هذه الإمكانات، يمكنك تقليل تكاليف نشر النموذج بنسبة 50% في المتوسط. ستختلف وفورات التكلفة وفقًا لحجم العمل وأنماط حركة المرور لديك. لنأخذ مثالاً بسيطًا لتوضيح كيف أن تعبئة نماذج متعددة على نقطة نهاية واحدة يمكن أن يؤدي إلى زيادة الاستخدام وتوفير التكاليف. لنفترض أن لديك تطبيق دردشة يساعد السائحين على فهم العادات المحلية وأفضل الممارسات التي تم إنشاؤها باستخدام نوعين مختلفين من Llama 2: أحدهما تم ضبطه بدقة للزوار الأوروبيين والآخر تم ضبطه بدقة للزوار الأمريكيين. نتوقع حركة المرور للنموذج الأوروبي بين الساعة 00:01 - 11:59 بالتوقيت العالمي والنموذج الأمريكي بين الساعة 12:00 - 23:59 بالتوقيت العالمي. بدلاً من نشر هذه النماذج على مثيلاتها المخصصة حيث تظل خاملة نصف الوقت، يمكنك الآن نشرها على نقطة نهاية واحدة لتوفير التكاليف. يمكنك تقليص النموذج الأمريكي إلى الصفر عندما لا تكون هناك حاجة إليه لتحرير القدرة للنموذج الأوروبي، والعكس صحيح. يتيح لك ذلك استخدام أجهزتك بكفاءة وتجنب الهدر. هذا مثال بسيط باستخدام نموذجين، ولكن يمكنك بسهولة توسيع هذه الفكرة لتجميع مئات النماذج في نقطة نهاية واحدة تتوسع تلقائيًا لأعلى ولأسفل مع عبء العمل الخاص بك.

في هذا المنشور، نعرض لك الإمكانيات الجديدة لنقاط نهاية SageMaker المستندة إلى IC. نوجهك أيضًا خلال نشر نماذج متعددة باستخدام مكونات الاستدلال وواجهات برمجة التطبيقات. وأخيرًا، نعرض بالتفصيل بعض إمكانات المراقبة الجديدة وكيفية إعداد سياسات القياس التلقائي لنماذجك وإدارة قياس المثيل لنقاط النهاية الخاصة بك. يمكنك أيضًا نشر النماذج من خلال تجربة المستخدم التفاعلية والمبسطة الجديدة. نحن ندعم أيضًا إمكانات التوجيه المتقدمة لتحسين زمن الاستجابة وأداء أعباء عمل الاستدلال لديك.

اللبنات

دعونا نلقي نظرة أعمق ونفهم كيفية عمل هذه الإمكانات الجديدة. فيما يلي بعض المصطلحات الجديدة لاستضافة SageMaker:

- مكون الاستدلال - كائن استضافة SageMaker يمكنك استخدامه لنشر نموذج إلى نقطة النهاية. يمكنك إنشاء مكون الاستدلال عن طريق توفير ما يلي:

- نموذج SageMaker أو مواصفات الصورة المتوافقة مع SageMaker وعناصر النموذج.

- حساب متطلبات الموارد، التي تحدد احتياجات كل نسخة من النموذج الخاص بك، بما في ذلك مراكز وحدة المعالجة المركزية والذاكرة المضيفة وعدد المسرعات.

- نسخة النموذج – نسخة وقت التشغيل من مكون الاستدلال القادر على خدمة الطلبات.

- القياس التلقائي للمثيل المُدار – قدرة استضافة SageMaker على زيادة أو تقليل عدد مثيلات الحوسبة المستخدمة لنقطة النهاية. يتفاعل تحجيم المثيل مع تحجيم مكونات الاستدلال.

لإنشاء مكون استدلال جديد، يمكنك تحديد صورة حاوية ومنتج نموذجي، أو يمكنك استخدام نماذج SageMaker التي ربما تكون قد قمت بإنشائها بالفعل. تحتاج أيضًا إلى تحديد متطلبات موارد الحساب مثل عدد مراكز وحدة المعالجة المركزية المضيفة، أو ذاكرة المضيف، أو عدد المسرعات التي يحتاج النموذج الخاص بك إلى تشغيلها.

عند نشر مكون الاستدلال، يمكنك تحديد MinCopies للتأكد من أن النموذج محمل بالفعل بالكمية التي تحتاجها، وجاهز لخدمة الطلبات.

لديك أيضًا خيار تعيين سياساتك بحيث يتم ضبط نسخ مكونات الاستدلال على الصفر. على سبيل المثال، إذا لم يكن لديك أي تحميل يعمل على IC، فسيتم إلغاء تحميل نسخة النموذج. يمكن أن يؤدي ذلك إلى تحرير الموارد التي يمكن استبدالها بأعباء العمل النشطة لتحسين استخدام نقطة النهاية لديك وكفاءتها.

مع زيادة أو نقصان طلبات الاستدلال، يمكن أيضًا زيادة عدد نسخ الشهادات المرحلية الخاصة بك أو تقليلها بناءً على سياسات القياس التلقائي الخاصة بك. سيتولى SageMaker التعامل مع الموضع لتحسين تعبئة نماذجك من حيث التوفر والتكلفة.

بالإضافة إلى ذلك، إذا قمت بتمكين القياس التلقائي للمثيل المُدار، فسيقوم SageMaker بقياس مثيلات الحوسبة وفقًا لعدد مكونات الاستدلال التي يجب تحميلها في وقت معين لخدمة حركة المرور. سيقوم SageMaker بتوسيع نطاق المثيلات وحزم المثيلات ومكونات الاستدلال لتحسين التكلفة مع الحفاظ على أداء النموذج. على الرغم من أننا نوصي باستخدام مقياس المثيل المُدار، إلا أنه لديك أيضًا خيار إدارة القياس بنفسك، إذا اخترت ذلك، من خلال القياس التلقائي للتطبيق.

سيعمل SageMaker على إعادة موازنة مكونات الاستدلال وتقليص المثيلات إذا لم تعد هناك حاجة إليها بواسطة مكونات الاستدلال وتوفير التكاليف.

تجول في واجهات برمجة التطبيقات (APIs).

قدم SageMaker كيانًا جديدًا يسمى InferenceComponent. يؤدي هذا إلى فصل تفاصيل استضافة نموذج تعلم الآلة عن نقطة النهاية نفسها. ال InferenceComponent يسمح لك بتحديد الخصائص الرئيسية لاستضافة النموذج مثل نموذج SageMaker الذي تريد استخدامه أو تفاصيل الحاوية وعناصر النموذج. يمكنك أيضًا تحديد عدد نسخ المكونات نفسها المراد نشرها، وعدد المسرعات (وحدات معالجة الرسومات، أو Inf، أو مسرعات Trn) أو وحدة المعالجة المركزية (vCPUs) المطلوبة. وهذا يوفر لك المزيد من المرونة لاستخدام نقطة نهاية واحدة لأي عدد من النماذج التي تخطط لنشرها عليها في المستقبل.

دعونا نلقي نظرة على استدعاءات Boto3 API لإنشاء نقطة نهاية بمكون الاستدلال. لاحظ أن هناك بعض المعلمات التي سنتناولها لاحقًا في هذا المنشور.

ما يلي هو رمز المثال ل CreateEndpointConfig:

ما يلي هو رمز المثال ل CreateEndpoint:

ما يلي هو رمز المثال ل CreateInferenceComponent:

هذا الانفصال InferenceComponent إلى نقطة النهاية يوفر المرونة. يمكنك استضافة نماذج متعددة على نفس البنية الأساسية، وإضافتها أو إزالتها مع تغير متطلباتك. يمكن تحديث كل نموذج بشكل مستقل حسب الحاجة. بالإضافة إلى ذلك، يمكنك توسيع نطاق النماذج وفقًا لاحتياجات عملك. InferenceComponent كما يسمح لك بالتحكم في السعة لكل نموذج. بمعنى آخر، يمكنك تحديد عدد النسخ التي تريد استضافتها من كل نموذج. يساعدك هذا القياس المتوقع على تلبية متطلبات زمن الوصول المحددة لكل نموذج. إجمالي، InferenceComponent يمنحك المزيد من التحكم في النماذج المستضافة.

في الجدول التالي، نعرض مقارنة جنبًا إلى جنب للنهج عالي المستوى لإنشاء واستدعاء نقطة النهاية بدون InferenceComponent ومع InferenceComponent. لاحظ أن CreateModel() أصبح الآن اختياريًا لنقاط النهاية المستندة إلى IC.

| خطوة | نقاط النهاية المستندة إلى النموذج | استنتاج نقاط النهاية القائمة على المكونات |

| 1 | إنشاء نموذج (...) | إنشاء EndpointConfig (...) |

| 2 | إنشاء EndpointConfig (...) | إنشاء نقطة النهاية (...) |

| 3 | إنشاء نقطة النهاية (...) | إنشاء مكون الاستدلال (...) |

| 4 | استدعاء نقطة النهاية (...) | InvocEndpoint(InferneceComponentName='القيمة'...) |

إدخال InferenceComponent يسمح لك بالتوسع على مستوى النموذج. يرى التعمق في المثيل والقياس التلقائي لـ IC لمزيد من التفاصيل حول كيفية InferenceComponent يعمل مع التحجيم التلقائي.

عند استدعاء نقطة نهاية SageMaker، يمكنك الآن تحديد المعلمة الجديدة InferenceComponentName ليصيب المطلوب InferenceComponentName. سيتعامل SageMaker مع توجيه الطلب إلى المثيل الذي يستضيف الطلب InferenceComponentName. انظر الكود التالي:

افتراضيًا، يستخدم SageMaker التوجيه العشوائي للطلبات إلى المثيلات التي تدعم نقطة النهاية الخاصة بك. إذا كنت تريد تمكين توجيه الطلبات الأقل معلقة، فيمكنك تعيين استراتيجية التوجيه في تكوين نقطة النهاية RoutingConfig:

تقوم الطلبات الأقل المعلقة بتوجيه المسارات إلى المثيلات المحددة التي لديها قدرة أكبر على معالجة الطلبات. سيوفر هذا المزيد من موازنة التحميل واستخدام الموارد بشكل موحد.

بالإضافة إلى CreateInferenceComponent، واجهات برمجة التطبيقات التالية متاحة الآن:

DescribeInferenceComponentDeleteInferenceComponentUpdateInferenceComponentListInferenceComponents

سجلات ومقاييس InferenceComponent

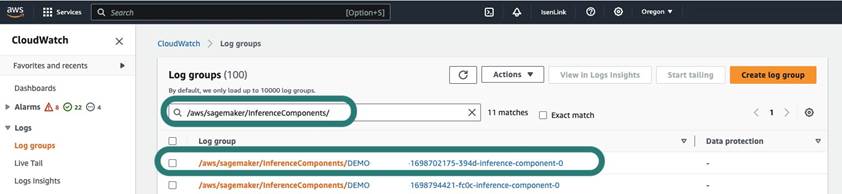

InferenceComponent السجلات موجودة في /aws/sagemaker/InferenceComponents/<InferenceComponentName>. يتم إرسال كافة السجلات المرسلة إلى stderr وstdout في الحاوية إلى سجلات الدخول هذه الأمازون CloudWatch.

مع تقديم نقاط النهاية المستندة إلى IC، لديك الآن القدرة على عرض مقاييس المثيلات الإضافية، ومقاييس مكونات الاستدلال، ومقاييس الاستدعاء.

بالنسبة لمثيلات SageMaker، يمكنك الآن تتبع ملف GPUReservation و CPUReservation مقاييس لرؤية الموارد المحجوزة لنقطة النهاية بناءً على مكونات الاستدلال التي قمت بنشرها. يمكن أن تساعدك هذه المقاييس في تحديد حجم سياسات نقطة النهاية والقياس التلقائي. يمكنك أيضًا عرض المقاييس المجمعة المرتبطة بجميع النماذج المنشورة على نقطة النهاية.

يعرض SageMaker أيضًا المقاييس على مستوى مكون الاستدلال، والتي يمكن أن تعرض عرضًا أكثر تفصيلاً لاستخدام الموارد لمكونات الاستدلال التي قمت بنشرها. يتيح لك هذا الحصول على عرض لمقدار الاستخدام الإجمالي للموارد مثل GPUUtilizationNormalized و GPUMemoryUtilizationNormalized لكل مكون استدلالي قمت بنشره والذي قد يحتوي على صفر نسخ أو عدة نسخ.

وأخيرًا، يوفر SageMaker مقاييس الاستدعاء، والتي تتتبع الآن الاستدعاءات لمكونات الاستدلال بشكل إجمالي (Invocations) أو لكل نسخة تم إنشاء مثيل لها (InvocationsPerCopy)

للحصول على قائمة شاملة بالمقاييس، راجع مقاييس استدعاء نقطة نهاية SageMaker.

القياس التلقائي على مستوى النموذج

لتنفيذ سلوك القياس التلقائي الذي وصفناه، عند إنشاء مكون الاستدلال وتكوين نقطة نهاية SageMaker، يمكنك تحديد عدد المثيلات الأولي وعدد نسخ النموذج الأولي، على التوالي. بعد إنشاء نقطة النهاية والدوائر المتكاملة المقابلة، لتطبيق القياس التلقائي على مستوى IC، تحتاج أولاً إلى تسجيل هدف القياس ثم ربط سياسة القياس بـ IC.

عند تنفيذ سياسة القياس، نستخدم SageMakerInferenceComponentInvocationsPerCopyوهو مقياس جديد قدمته SageMaker. فهو يلتقط متوسط عدد الاستدعاءات لكل نسخة نموذجية في الدقيقة.

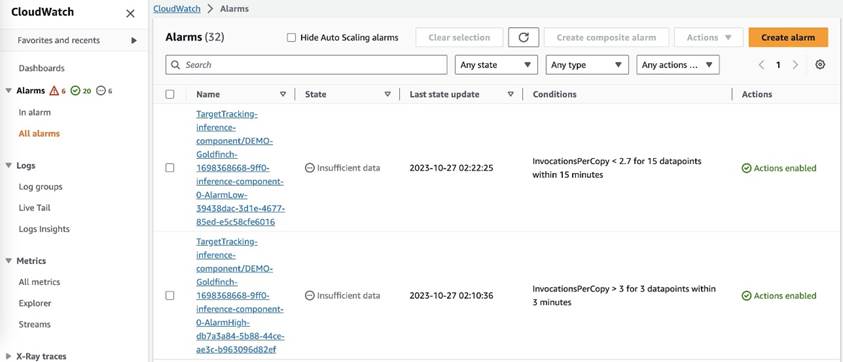

بعد تعيين سياسة القياس، يقوم SageMaker بإنشاء منبهين CloudWatch لكل هدف من أهداف القياس التلقائي: أحدهما لتشغيل القياس الخارجي إذا كان في التنبيه لمدة 3 دقائق (ثلاث نقاط بيانات لمدة دقيقة واحدة) والآخر لتشغيل القياس الداخلي إذا كان التنبيه لمدة 1 دقيقة (15 نقطة بيانات مدتها دقيقة واحدة)، كما هو موضح في لقطة الشاشة التالية. عادةً ما يكون وقت تشغيل إجراء القياس أطول من تلك الدقائق بدقيقة أو دقيقتين لأن نقطة النهاية تستغرق وقتًا لنشر المقاييس على CloudWatch، وتستغرق أيضًا وقتًا لـ AutoScaling للرد. فترة التهدئة هي مقدار الوقت، بالثواني، بعد اكتمال نشاط التوسع أو التوسع قبل أن يبدأ نشاط توسيع آخر. إذا كانت فترة تهدئة التوسيع أقصر من وقت تحديث نقطة النهاية، فلن يكون لها أي تأثير، لأنه لا يمكن تحديث نقطة نهاية SageMaker عندما تكون في وضع التشغيل تحديث الحالة.

لاحظ أنه عند إعداد القياس التلقائي على مستوى IC، فإنك تحتاج إلى التأكد من MaxInstanceCount المعلمة تساوي أو أصغر من الحد الأقصى لعدد المرحلية التي يمكن لنقطة النهاية هذه التعامل معها. على سبيل المثال، إذا تم تكوين نقطة النهاية الخاصة بك بحيث تحتوي على مثيل واحد فقط في تكوين نقطة النهاية ويمكن لهذا المثيل أن يستضيف أربع نسخ كحد أقصى من النموذج، فإن MaxInstanceCount يجب أن يكون مساويًا لـ 4 أو أصغر منه. ومع ذلك، يمكنك أيضًا استخدام إمكانية القياس التلقائي المُدار التي توفرها SageMaker لقياس عدد المثيلات تلقائيًا بناءً على رقم نسخة النموذج المطلوب لتلبية الحاجة إلى المزيد من موارد الحوسبة. يوضح مقتطف التعليمات البرمجية التالي كيفية إعداد مقياس المثيل المُدار أثناء إنشاء تكوين نقطة النهاية. بهذه الطريقة، عندما يتطلب القياس التلقائي على مستوى IC عددًا أكبر من المثيلات لاستضافة نسخ النموذج، سيقوم SageMaker تلقائيًا بقياس رقم المثيل للسماح بنجاح القياس على مستوى IC.

يمكنك تطبيق سياسات تغيير الحجم التلقائي المتعددة على نفس نقطة النهاية، مما يعني أنك ستتمكن من تطبيق سياسة القياس التلقائي التقليدية على نقاط النهاية التي تم إنشاؤها باستخدام الدوائر المتكاملة وتوسيع نطاقها لأعلى ولأسفل بناءً على مقاييس نقطة النهاية الأخرى. لمزيد من المعلومات، راجع قم بتحسين عمليات نشر التعلم الآلي الخاصة بك باستخدام التوسيع التلقائي على Amazon SageMaker. ومع ذلك، على الرغم من أن هذا ممكن، إلا أننا لا نزال نوصي باستخدام قياس المثيل المُدار بدلاً من إدارة القياس بنفسك.

وفي الختام

في هذا المنشور، قدمنا ميزة جديدة في استدلال SageMaker والتي ستساعدك على تحقيق أقصى قدر من الاستفادة من مثيلات الحوسبة، وتوسيع النطاق ليشمل مئات النماذج، وتحسين التكاليف، مع توفير أداء يمكن التنبؤ به. علاوة على ذلك، قدمنا شرحًا تفصيليًا لواجهات برمجة التطبيقات وأظهرنا لك كيفية تكوين مكونات الاستدلال ونشرها لأعباء العمل لديك.

نحن ندعم أيضا قدرات التوجيه المتقدمة لتحسين زمن الاستجابة وأداء أعباء عمل الاستدلال لديك. يمكن أن يساعدك SageMaker في تحسين أعباء عمل الاستدلال الخاصة بك من حيث التكلفة والأداء ويمنحك دقة على مستوى النموذج للإدارة. لقد أنشأنا أ مجموعة من الدفاتر سيوضح لك ذلك كيفية نشر ثلاثة نماذج مختلفة، باستخدام حاويات مختلفة وتطبيق سياسات القياس التلقائي في GitHub. نحن نشجعك على البدء باستخدام الكمبيوتر الدفتري 1 والتدرب على إمكانات استضافة SageMaker الجديدة اليوم!

عن المؤلفين

جيمس بارك هو مهندس الحلول في Amazon Web Services. وهو يعمل مع Amazon.com لتصميم الحلول التقنية وإنشائها ونشرها على AWS، ولديه اهتمام خاص بالذكاء الاصطناعي والتعلم الآلي. في وقت فراغه، يستمتع بالبحث عن ثقافات جديدة وتجارب جديدة ومواكبة أحدث اتجاهات التكنولوجيا. يمكنك العثور عليه على لينكدين:.

جيمس بارك هو مهندس الحلول في Amazon Web Services. وهو يعمل مع Amazon.com لتصميم الحلول التقنية وإنشائها ونشرها على AWS، ولديه اهتمام خاص بالذكاء الاصطناعي والتعلم الآلي. في وقت فراغه، يستمتع بالبحث عن ثقافات جديدة وتجارب جديدة ومواكبة أحدث اتجاهات التكنولوجيا. يمكنك العثور عليه على لينكدين:.

ميلاني ليحاصل على درجة الدكتوراه ، وهو متخصص أول في الذكاء الاصطناعي / التعلم الآلي TAM في AWS ومقرها في سيدني ، أستراليا. تساعد عملاء المؤسسات على بناء الحلول باستخدام أحدث أدوات الذكاء الاصطناعي / التعلم الآلي على AWS وتقدم إرشادات حول تصميم وتنفيذ حلول التعلم الآلي باستخدام أفضل الممارسات. في أوقات فراغها ، تحب استكشاف الطبيعة وقضاء الوقت مع العائلة والأصدقاء.

ميلاني ليحاصل على درجة الدكتوراه ، وهو متخصص أول في الذكاء الاصطناعي / التعلم الآلي TAM في AWS ومقرها في سيدني ، أستراليا. تساعد عملاء المؤسسات على بناء الحلول باستخدام أحدث أدوات الذكاء الاصطناعي / التعلم الآلي على AWS وتقدم إرشادات حول تصميم وتنفيذ حلول التعلم الآلي باستخدام أفضل الممارسات. في أوقات فراغها ، تحب استكشاف الطبيعة وقضاء الوقت مع العائلة والأصدقاء.

مارك كارب هو مهندس ML مع فريق Amazon SageMaker Service. يركز على مساعدة العملاء في تصميم ونشر وإدارة أعباء عمل ML على نطاق واسع. في أوقات فراغه ، يستمتع بالسفر واستكشاف أماكن جديدة.

مارك كارب هو مهندس ML مع فريق Amazon SageMaker Service. يركز على مساعدة العملاء في تصميم ونشر وإدارة أعباء عمل ML على نطاق واسع. في أوقات فراغه ، يستمتع بالسفر واستكشاف أماكن جديدة.

آلان تان هو مدير أول للمنتجات في SageMaker ، ويقود الجهود في الاستدلال على النماذج الكبيرة. إنه متحمس لتطبيق التعلم الآلي في مجال التحليلات. خارج العمل ، يستمتع بالخارج.

آلان تان هو مدير أول للمنتجات في SageMaker ، ويقود الجهود في الاستدلال على النماذج الكبيرة. إنه متحمس لتطبيق التعلم الآلي في مجال التحليلات. خارج العمل ، يستمتع بالخارج.

راغو راميشا هو أحد كبار مهندسي حلول ML مع فريق خدمة Amazon SageMaker. وهو يركز على مساعدة العملاء في إنشاء أعباء عمل إنتاج تعلم الآلة ونشرها وترحيلها إلى SageMaker على نطاق واسع. وهو متخصص في مجالات التعلم الآلي والذكاء الاصطناعي ورؤية الكمبيوتر، ويحمل درجة الماجستير في علوم الكمبيوتر من جامعة تكساس في دالاس. وفي أوقات فراغه، يستمتع بالسفر والتصوير الفوتوغرافي.

راغو راميشا هو أحد كبار مهندسي حلول ML مع فريق خدمة Amazon SageMaker. وهو يركز على مساعدة العملاء في إنشاء أعباء عمل إنتاج تعلم الآلة ونشرها وترحيلها إلى SageMaker على نطاق واسع. وهو متخصص في مجالات التعلم الآلي والذكاء الاصطناعي ورؤية الكمبيوتر، ويحمل درجة الماجستير في علوم الكمبيوتر من جامعة تكساس في دالاس. وفي أوقات فراغه، يستمتع بالسفر والتصوير الفوتوغرافي.

روبيندر جريوال هو مهندس حلول متخصص في الذكاء الإصطناعي / ML مع AWS. يركز حاليًا على خدمة النماذج و MLOps على SageMaker. قبل توليه هذا المنصب ، عمل كمهندس لتعلم الآلة ونماذج البناء والاستضافة. خارج العمل يستمتع بلعب التنس وركوب الدراجات على المسارات الجبلية.

روبيندر جريوال هو مهندس حلول متخصص في الذكاء الإصطناعي / ML مع AWS. يركز حاليًا على خدمة النماذج و MLOps على SageMaker. قبل توليه هذا المنصب ، عمل كمهندس لتعلم الآلة ونماذج البناء والاستضافة. خارج العمل يستمتع بلعب التنس وركوب الدراجات على المسارات الجبلية.

ضوال باتل هو مهندس رئيسي لتعلم الآلة في AWS. لقد عمل مع مؤسسات تتراوح من المؤسسات الكبيرة إلى الشركات الناشئة متوسطة الحجم في المشكلات المتعلقة بالحوسبة الموزعة والذكاء الاصطناعي. يركز على التعلم العميق بما في ذلك مجالات البرمجة اللغوية العصبية ورؤية الكمبيوتر. إنه يساعد العملاء على تحقيق استدلال نموذج عالي الأداء على SageMaker.

ضوال باتل هو مهندس رئيسي لتعلم الآلة في AWS. لقد عمل مع مؤسسات تتراوح من المؤسسات الكبيرة إلى الشركات الناشئة متوسطة الحجم في المشكلات المتعلقة بالحوسبة الموزعة والذكاء الاصطناعي. يركز على التعلم العميق بما في ذلك مجالات البرمجة اللغوية العصبية ورؤية الكمبيوتر. إنه يساعد العملاء على تحقيق استدلال نموذج عالي الأداء على SageMaker.

سوراب تريكاندي هو مدير أول للمنتجات في Amazon SageMaker Inference. إنه متحمس للعمل مع العملاء وتحفزه هدف إضفاء الطابع الديمقراطي على التعلم الآلي. يركز على التحديات الأساسية المتعلقة بنشر تطبيقات ML المعقدة ، ونماذج ML متعددة المستأجرين ، وتحسين التكلفة ، وجعل نشر نماذج التعلم العميق أكثر سهولة. في أوقات فراغه ، يستمتع سوراب بالمشي لمسافات طويلة والتعرف على التقنيات المبتكرة واتباع TechCrunch وقضاء الوقت مع عائلته.

سوراب تريكاندي هو مدير أول للمنتجات في Amazon SageMaker Inference. إنه متحمس للعمل مع العملاء وتحفزه هدف إضفاء الطابع الديمقراطي على التعلم الآلي. يركز على التحديات الأساسية المتعلقة بنشر تطبيقات ML المعقدة ، ونماذج ML متعددة المستأجرين ، وتحسين التكلفة ، وجعل نشر نماذج التعلم العميق أكثر سهولة. في أوقات فراغه ، يستمتع سوراب بالمشي لمسافات طويلة والتعرف على التقنيات المبتكرة واتباع TechCrunch وقضاء الوقت مع عائلته.

لاكشمي راماكريشنان هو مهندس رئيسي في فريق النظام الأساسي Amazon SageMaker Machine Learning (ML) في AWS ، حيث يوفر القيادة التقنية للمنتج. عمل في العديد من المناصب الهندسية في أمازون لأكثر من 9 سنوات. وهو حاصل على درجة البكالوريوس في الهندسة في تكنولوجيا المعلومات من المعهد الوطني للتكنولوجيا ، كارناتاكا ، الهند ، ودرجة الماجستير في علوم الكمبيوتر من جامعة مينيسوتا توين سيتيز.

لاكشمي راماكريشنان هو مهندس رئيسي في فريق النظام الأساسي Amazon SageMaker Machine Learning (ML) في AWS ، حيث يوفر القيادة التقنية للمنتج. عمل في العديد من المناصب الهندسية في أمازون لأكثر من 9 سنوات. وهو حاصل على درجة البكالوريوس في الهندسة في تكنولوجيا المعلومات من المعهد الوطني للتكنولوجيا ، كارناتاكا ، الهند ، ودرجة الماجستير في علوم الكمبيوتر من جامعة مينيسوتا توين سيتيز.

ديفيد نيجيندا هو كبير مهندسي تطوير البرمجيات في فريق Amazon SageMaker ، ويعمل حاليًا على تحسين سير عمل التعلم الآلي للإنتاج ، بالإضافة إلى إطلاق ميزات استدلال جديدة. في أوقات فراغه ، يحاول مواكبة أطفاله.

ديفيد نيجيندا هو كبير مهندسي تطوير البرمجيات في فريق Amazon SageMaker ، ويعمل حاليًا على تحسين سير عمل التعلم الآلي للإنتاج ، بالإضافة إلى إطلاق ميزات استدلال جديدة. في أوقات فراغه ، يحاول مواكبة أطفاله.

- محتوى مدعوم من تحسين محركات البحث وتوزيع العلاقات العامة. تضخيم اليوم.

- PlatoData.Network Vertical Generative Ai. تمكين نفسك. الوصول هنا.

- أفلاطونايستريم. ذكاء Web3. تضخيم المعرفة. الوصول هنا.

- أفلاطون كربون، كلينتك ، الطاقة، بيئة، شمسي، إدارة المخلفات. الوصول هنا.

- أفلاطون هيلث. التكنولوجيا الحيوية وذكاء التجارب السريرية. الوصول هنا.

- المصدر https://aws.amazon.com/blogs/machine-learning/reduce-model-deployment-costs-by-50-on-average-using-sagemakers-latest-features/

- :لديها

- :يكون

- :ليس

- :أين

- $ UP

- 1

- 10

- 100

- 114

- 12

- 13

- 15%

- 150

- 16

- 22

- 360

- 362

- 500

- 7

- 9

- a

- القدرة

- ماهرون

- من نحن

- الملخصات

- المعجلات

- يمكن الوصول

- وفقا

- التأهيل

- اكشن

- نشط

- نشاط

- تضيف

- مضيفا

- إضافة

- إضافي

- وبالإضافة إلى ذلك

- العنوان

- متقدم

- بعد

- ضد

- مجموع

- AI

- AI / ML

- آلان

- إنذار

- الكل

- السماح

- يسمح

- سابقا

- أيضا

- بالرغم ان

- دائما

- أمازون

- الأمازون SageMaker

- أمازون ويب سيرفيسز

- Amazon.com

- أمريكي

- كمية

- an

- تحليلات

- و

- آخر

- أي وقت

- API

- واجهات برمجة التطبيقات

- تطبيق

- التطبيقات

- التقديم

- تطبيق

- نهج

- هي

- المنطقة

- مصطنع

- الذكاء الاصطناعي

- AS

- محام

- أسوشيتد

- At

- أستراليا

- السيارات

- تلقائيا

- توفر

- متاح

- المتوسط

- تجنب

- AWS

- دعم

- على أساس

- BE

- لان

- قبل

- سلوك

- الفوائد

- أفضل

- أفضل الممارسات

- أفضل

- ما بين

- نساعدك في بناء

- ابني

- بنيت

- الأعمال

- لكن

- by

- تسمى

- دعوات

- CAN

- قدرات

- قدرة

- قادر على

- الطاقة الإنتاجية

- يلتقط

- معين

- التحديات

- تحدي

- تغيير

- اختار

- مدن

- الكود

- COM

- مقارنة

- إكمال

- يكمل

- مجمع

- عنصر

- مكونات

- شامل

- إحصاء

- الكمبيوتر

- علوم الكمبيوتر

- رؤية الكمبيوتر

- الحوسبة

- الاعداد

- تكوين

- ثابتة

- باستمرار

- استهلاك

- وعاء

- حاويات

- مراقبة

- جوهر

- المقابلة

- التكلفة

- وفورات في التكاليف

- التكاليف

- استطاع

- خلق

- خلق

- يخلق

- خلق

- خلق

- حاليا

- العملاء

- الجمارك

- دالاس

- البيانات

- نقاط البيانات

- التاريخ

- تخفيض

- مخصصة

- عميق

- التعلم العميق

- أعمق

- الترتيب

- حدد

- الدرجة العلمية

- الخوض

- الديمقراطية

- يوضح

- اعتمادا

- نشر

- نشر

- نشر

- نشر

- نشر

- وصف

- تصميم

- مطلوب

- التفاصيل

- تفاصيل

- حدد

- التطوير التجاري

- مختلف

- صعبة

- وزعت

- الحوسبة الموزعة

- do

- المجالات

- لا

- إلى أسفل

- أثناء

- حيوي

- كل

- بسهولة

- تأثير

- كفاءة

- بكفاءة

- جهود

- تمكين

- تمكين

- تمكن

- شجع

- نقطة النهاية

- مهندس

- الهندسة

- ضمان

- مشروع

- الشركات

- كيان

- متساو

- المجلة الأوروبية

- مثال

- توقع

- الخبره في مجال الغطس

- خبرة

- اكتشف

- استكشاف

- مد

- للعائلات

- الميزات

- المميزات

- حقل

- الاسم الأول

- مرونة

- ويركز

- متابعيك

- في حالة

- دورة تأسيسية

- أربعة

- مجانا

- الاصدقاء

- تبدأ من

- تماما

- علاوة على ذلك

- مستقبل

- دولار فقط واحصل على خصم XNUMX% على جميع

- GIF

- GitHub جيثب:

- منح

- معطى

- يعطي

- هدف

- وحدة معالجة الرسوميات:

- وحدات معالجة الرسومات

- حبيبي

- توجيه

- نصفي

- مقبض

- العناية باليد

- أجهزة التبخير

- يملك

- he

- مساعدة

- مساعدة

- يساعد

- لها

- مرتفع

- رفيع المستوى

- وسلم

- له

- ضرب

- يحمل

- مضيف

- استضافت

- استضافة

- ساعات العمل

- كيفية

- كيفية

- لكن

- HTTP

- HTTPS

- مئات

- فكرة

- الخمول

- if

- توضيح

- صورة

- تنفيذ

- تحقيق

- أهمية

- تحسين

- in

- في أخرى

- بما فيه

- القيمة الاسمية

- بشكل مستقل

- الهند

- غير فعال

- معلومات

- تكنولوجيا المعلومات

- البنية التحتية

- في البداية

- مبتكرة

- تقنيات مبتكرة

- مثل

- بدلًا من ذلك

- معهد

- رؤيتنا

- التفاعلية

- مصلحة

- إلى

- أدخلت

- المُقدّمة

- IT

- انها

- نفسها

- JPG

- احتفظ

- حفظ

- القفل

- اطفال

- كبير

- الشركات الكبيرة

- أخيرا

- كمون

- الى وقت لاحق

- آخر

- إطلاق

- القيادة

- قيادة

- تعلم

- الأقل

- مستوى

- مثل

- لينكدين:

- قائمة

- اللاما نوع من الجمال

- تحميل

- محلي

- تقع

- يعد

- بحث

- أبحث

- يحب

- آلة

- آلة التعلم

- جعل

- القيام ب

- إدارة

- تمكن

- إدارة

- مدير

- إدارة

- كثير

- رئيسي

- سادة

- تعظيم

- أقصى

- مايو..

- يعني

- تعرف علي

- مكبر الصوت : يدعم، مع دعم ميكروفون مدمج لمنع الضوضاء

- متري

- المقاييس

- الهجرة

- الحد الأدنى

- دقيقة

- دقيقة

- ML

- MLOps

- نموذج

- عارضات ازياء

- الأكثر من ذلك

- الدافع

- جبل

- كثيرا

- متعدد

- محليات

- الطبيعة

- حاجة

- بحاجة

- إحتياجات

- جديد

- البرمجة اللغوية العصبية

- لا

- لاحظ

- مفكرة

- الآن

- عدد

- موضوع

- of

- عرض

- غالبا

- on

- ONE

- فقط

- على

- الأمثل

- تحسين

- خيار

- or

- تزامن

- المنظمات

- أخرى

- لنا

- خارج

- في الهواء الطلق

- النتائج

- في الخارج

- معلقة

- على مدى

- الكلي

- الخاصة

- حزمة

- موازية

- المعلمة

- المعلمات

- خاص

- عاطفي

- نمط

- أنماط

- إلى

- أداء

- فترة

- رسالة دكتوراه

- تصوير

- المكان

- وضع

- وجهات

- خطة

- المنصة

- أفلاطون

- الذكاء افلاطون البيانات

- أفلاطون داتا

- لعب

- نقاط

- سياسات الخصوصية والبيع

- سياسة

- ممكن

- منشور

- قوة

- الممارسات

- تنبأ

- قابل للتنبؤ

- الحفاظ على

- رئيسي

- قبل

- مشاكل

- عملية المعالجة

- المنتج

- مدير المنتج

- الإنتــاج

- HAS

- تزود

- المقدمة

- ويوفر

- توفير

- نشر

- كمية

- عشوائية

- نطاق

- تتراوح

- رد فعل

- يتفاعل

- استعداد

- إعادة التوازن

- نوصي

- تخفيض

- تقليص

- الرجوع

- تسجيل جديد

- ذات صلة

- إزالة

- إزالة

- استبدال

- طلب

- طلبات

- تطلب

- مطلوب

- المتطلبات الأساسية

- يتطلب

- محفوظة

- مورد

- الموارد

- على التوالي

- استجابة

- النوع

- الأدوار

- طرق

- التوجيه

- يجري

- تشغيل

- وقت التشغيل

- sagemaker

- الاستدلال SageMaker

- نفسه

- حفظ

- مدخرات

- قول

- حجم

- النطاقات

- التحجيم

- علوم

- ثواني

- انظر تعريف

- تسعى

- كبير

- أرسلت

- عقوبة

- خدمة

- الخدمة

- خدماتنا

- خدمة

- طقم

- ضبط

- عدة

- مشاركة

- هي

- ينبغي

- إظهار

- أظهرت

- أظهرت

- بشكل ملحوظ

- الاشارات

- مبسط

- عزباء

- الجلوس

- المقاس

- الأصغر

- قصاصة

- So

- تطبيقات الكمبيوتر

- تطوير البرمجيات

- الحلول

- بعض

- متخصص

- تتخصص

- محدد

- مواصفة

- أنفق

- الإنفاق

- مسمار

- التموج

- بداية

- البدء

- دولة من بين الفن

- الحالة

- البقاء

- لا يزال

- الإستراتيجيات

- ناجح

- هذه

- تموين

- الدعم

- الدعم

- بالتأكيد

- سيدني

- جدول

- أخذ

- يأخذ

- الهدف

- فريق

- تشكرونش

- تقني

- التكنولوجيا

- تكنولوجيا

- كرة المضرب

- المصطلح

- من

- أن

- •

- المنطقة

- المستقبل

- من مشاركة

- منهم

- then

- هناك.

- تشبه

- هم

- هؤلاء

- ثلاثة

- عبر

- الوقت

- إلى

- أدوات

- مسار

- تقليدي

- حركة المرور

- السفر

- جديد الموضة

- يثير

- التوأم

- اثنان

- فهم

- جامعة

- لا يمكن التنبؤ به

- تحديث

- تحديث

- الأستعمال

- تستخدم

- مستعمل

- مستخدم

- تجربة المستخدم

- المستخدمين

- يستخدم

- استخدام

- عادة

- بالتوقيت العالمي

- الاستفادة من

- رذيلة

- المزيد

- رؤيتنا

- الزوار

- سير

- تجول

- تريد

- نفاية

- طريق..

- طرق

- we

- الويب

- خدمات ويب

- حسن

- متى

- في حين

- التي

- في حين

- سوف

- مع

- بدون

- كلمات

- للعمل

- عمل

- سير العمل

- عامل

- أعمال

- سنوات

- أنت

- حل متجر العقارات الشامل الخاص بك في جورجيا

- نفسك

- زفيرنت

- صفر