هذه هي المقالة الثانية في سلسلة من جزأين أقترح فيها دليلًا عمليًا للمؤسسات حتى تتمكن من تقييم جودة نماذج تلخيص النص في مجالك.

للحصول على مقدمة لتلخيص النص ، ولمحة عامة عن هذا البرنامج التعليمي ، وخطوات إنشاء خط أساس لمشروعنا (يشار إليه أيضًا بالقسم 1) ، ارجع إلى أول مشاركة.

هذا المنشور مقسم إلى ثلاثة أقسام:

- القسم 2: إنشاء الملخصات باستخدام نموذج اللقطة الصفرية

- القسم 3: تدريب نموذج التلخيص

- القسم 4: تقييم النموذج المدرب

القسم 2: إنشاء الملخصات باستخدام نموذج اللقطة الصفرية

في هذا المنشور ، نستخدم مفهوم التعلم من الصفر (ZSL) ، مما يعني أننا نستخدم نموذجًا تم تدريبه على تلخيص النص ولكن لم نر أي أمثلة على مجموعة بيانات arXiv. إنها تشبه إلى حد ما محاولة رسم صورة عندما يكون كل ما كنت تفعله في حياتك هو رسم المناظر الطبيعية. أنت تعرف كيف ترسم ، لكن قد لا تكون على دراية كبيرة بتعقيدات الرسم البورتريه.

في هذا القسم ، نستخدم ما يلي مفكرة.

لماذا التعلم بدون طلقة؟

أصبح ZSL شائعًا على مدار السنوات الماضية لأنه يسمح لك باستخدام أحدث نماذج البرمجة اللغوية العصبية بدون تدريب. وأحيانًا يكون أداؤهم مذهلًا للغاية: مجموعة عمل أبحاث العلوم الكبيرة أطلق مؤخرًا نموذج T0pp (يُطلق عليه "T Zero Plus Plus") ، والذي تم تدريبه خصيصًا للبحث في التعلم متعدد المهام. يمكن أن يتفوق في كثير من الأحيان على النماذج الأكبر بست مرات على مقعد كبير القياسي ، ويمكن أن يتفوق على GPT-3 (أكبر بـ 16 مرة) في العديد من معايير البرمجة اللغوية العصبية الأخرى.

فائدة أخرى لـ ZSL هي أنه لا يتطلب سوى سطرين من الكود لاستخدامه. من خلال تجربتها ، نقوم بإنشاء خط أساس ثانٍ ، نستخدمه لتحديد الزيادة في أداء النموذج بعد أن نقوم بضبط النموذج في مجموعة البيانات الخاصة بنا.

قم بإعداد خط أنابيب التعلم بدون طلقة

لاستخدام نماذج ZSL ، يمكننا استخدام Hugging Face's API خط الأنابيب. تمكننا واجهة برمجة التطبيقات هذه من استخدام نموذج تلخيص نصي يتكون من سطرين فقط من التعليمات البرمجية. يعتني بخطوات المعالجة الرئيسية في نموذج البرمجة اللغوية العصبية:

- معالجة النص مسبقًا بتنسيق يمكن للنموذج فهمه.

- قم بتمرير المدخلات المجهزة مسبقًا إلى النموذج.

- المعالجة اللاحقة لتنبؤات النموذج ، حتى تتمكن من فهمها.

يستخدم نماذج التلخيص المتوفرة بالفعل على تعانق الوجه نموذج المحور.

لاستخدامه ، قم بتشغيل الكود التالي:

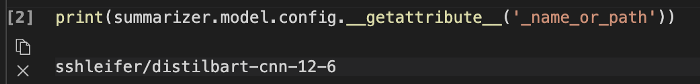

هذا هو! تقوم الكود بتنزيل نموذج تلخيص وإنشاء ملخصات محليًا على جهازك. إذا كنت تتساءل عن النموذج الذي تستخدمه ، فيمكنك إما البحث عنه في ملف شفرة المصدر أو استخدم الأمر التالي:

عندما نقوم بتشغيل هذا الأمر ، نرى أن النموذج الافتراضي لتلخيص النص يسمى sshleifer/distilbart-cnn-12-6:

يمكننا العثور على بطاقة نموذجية لهذا النموذج على موقع Hugging Face ، حيث يمكننا أيضًا أن نرى أن النموذج قد تم تدريبه على مجموعتي بيانات: مجموعة بيانات CNN Dailymail و مجموعة بيانات التلخيص الشديد (XSum). تجدر الإشارة إلى أن هذا النموذج ليس مألوفًا لمجموعة بيانات arXiv ويستخدم فقط لتلخيص النصوص المشابهة لتلك التي تم التدريب عليها (معظمها مقالات إخبارية). يشير الرقمان 12 و 6 في اسم النموذج إلى عدد طبقات المشفر وطبقات مفكك التشفير ، على التوالي. إن شرح ما هو خارج نطاق هذا البرنامج التعليمي ، ولكن يمكنك قراءة المزيد عنها في المنشور تقديم بارت بواسطة Sam Shleifer ، الذي ابتكر النموذج.

نحن نستخدم النموذج الافتراضي من الآن فصاعدًا ، لكنني أشجعك على تجربة نماذج مختلفة مدربة مسبقًا. يمكن العثور على جميع النماذج المناسبة للتلخيص على موقع ويب Hugging Face. لاستخدام نموذج مختلف ، يمكنك تحديد اسم النموذج عند استدعاء Pipeline API:

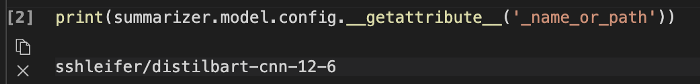

التلخيص الاستخراجي مقابل التلخيص التجريدي

لم نتحدث بعد عن طريقتين محتملتين ولكن مختلفتين لتلخيص النص: الاستخراجية مقابل تجريدي. التلخيص الاستخراجي هو استراتيجية لدمج المقتطفات المأخوذة من نص إلى ملخص ، بينما يتضمن التلخيص التجريدي إعادة صياغة النص باستخدام جمل جديدة. تعتمد معظم نماذج التلخيص على النماذج التي تولد نصًا جديدًا (وهي نماذج لتوليد اللغة الطبيعية ، مثل ، على سبيل المثال ، GPT-3). هذا يعني أن نماذج التلخيص تولد أيضًا نصًا جديدًا ، مما يجعلها نماذج تلخيص تجريدية.

إنشاء ملخصات بدون طلقة

الآن بعد أن عرفنا كيفية استخدامه ، نريد استخدامه في مجموعة بيانات الاختبار الخاصة بنا - وهي نفس مجموعة البيانات التي استخدمناها في قسم شنومكس لإنشاء خط الأساس. يمكننا فعل ذلك من خلال الحلقة التالية:

نستخدم min_length و max_length معلمات للتحكم في الملخص الذي يولده النموذج. في هذا المثال ، قمنا بتعيين min_length إلى 5 لأننا نريد أن يتكون العنوان من خمس كلمات على الأقل. وبتقدير الملخصات المرجعية (العناوين الفعلية لأوراق البحث) ، نحدد أن 20 يمكن أن تكون قيمة معقولة لـ max_length. لكن مرة أخرى ، هذه مجرد محاولة أولى. عندما يكون المشروع في مرحلة التجريب ، يمكن ويجب تغيير هاتين المعلمتين لمعرفة ما إذا كان أداء النموذج يتغير.

معلمات إضافية

إذا كنت معتادًا بالفعل على إنشاء النص ، فقد تعلم أن هناك العديد من المعلمات للتأثير على النص الذي يولده النموذج ، مثل البحث بالحزمة وأخذ العينات ودرجة الحرارة. تمنحك هذه المعلمات مزيدًا من التحكم في النص الذي يتم إنشاؤه ، على سبيل المثال ، جعل النص أكثر سلاسة وأقل تكرارًا. لا تتوفر هذه الأساليب في Pipeline API — يمكنك أن ترى في ملف شفرة المصدر أن min_length و max_length هي المعلمات الوحيدة التي يتم أخذها في الاعتبار. بعد أن نقوم بتدريب ونشر نموذجنا الخاص ، يمكننا الوصول إلى هذه المعايير. المزيد عن ذلك في القسم 4 من هذا المنشور.

تقييم النموذج

بعد الانتهاء من إنشاء الملخصات الصفرية ، يمكننا استخدام دالة ROUGE مرة أخرى لمقارنة ملخصات المرشح مع الملخصات المرجعية:

تشغيل هذا الحساب على الملخصات التي تم إنشاؤها باستخدام نموذج ZSL يعطينا النتائج التالية:

عندما نقارن تلك مع خط الأساس لدينا ، نرى أن نموذج ZSL هذا يؤدي في الواقع أداء أسوأ من استدلالنا البسيط لأخذ الجملة الأولى. مرة أخرى ، هذا ليس غير متوقع: على الرغم من أن هذا النموذج يعرف كيفية تلخيص المقالات الإخبارية ، إلا أنه لم ير أبدًا مثالًا لتلخيص ملخص ورقة بحث أكاديمية.

مقارنة خط الأساس

لقد أنشأنا الآن خطين أساسيين: أحدهما يستخدم إرشاديًا بسيطًا والآخر بنموذج ZSL. من خلال مقارنة درجات ROUGE ، نرى أن الاستدلال البسيط يتفوق حاليًا على نموذج التعلم العميق.

في القسم التالي ، نأخذ نفس نموذج التعلم العميق ونحاول تحسين أدائه. نقوم بذلك عن طريق تدريبه على مجموعة بيانات arXiv (تسمى هذه الخطوة أيضًا الكون المثالى). نحن نستفيد من حقيقة أنه يعرف بالفعل كيفية تلخيص النص بشكل عام. نعرض بعد ذلك الكثير من الأمثلة على مجموعة بيانات arXiv الخاصة بنا. تعد نماذج التعلم العميق جيدة بشكل استثنائي في تحديد الأنماط في مجموعات البيانات بعد أن يتم تدريبهم عليها ، لذلك نتوقع أن يتحسن النموذج في هذه المهمة بالذات.

القسم 3: تدريب نموذج التلخيص

في هذا القسم ، نقوم بتدريب النموذج الذي استخدمناه للملخصات الصفرية في القسم 2 (sshleifer/distilbart-cnn-12-6) في مجموعة البيانات الخاصة بنا. الفكرة هي تعليم النموذج كيف تبدو ملخصات ملخصات الأوراق البحثية من خلال عرض العديد من الأمثلة عليه. بمرور الوقت ، يجب أن يتعرف النموذج على الأنماط الموجودة في مجموعة البيانات هذه ، مما سيسمح له بإنشاء ملخصات أفضل.

تجدر الإشارة مرة أخرى إلى أنه إذا قمت بتسمية البيانات ، أي النصوص والملخصات المقابلة ، فيجب عليك استخدامها لتدريب نموذج. من خلال القيام بذلك فقط ، يمكن للنموذج التعرف على أنماط مجموعة البيانات المحددة الخاصة بك.

الكود الكامل لتدريب النموذج هو كما يلي مفكرة.

قم بإعداد وظيفة تدريبية

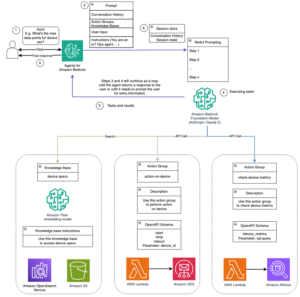

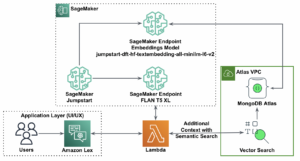

لأن تدريب نموذج التعلم العميق قد يستغرق بضعة أسابيع على جهاز كمبيوتر محمول ، فإننا نستخدم الأمازون SageMaker وظائف التدريب بدلا من ذلك. لمزيد من التفاصيل ، يرجى الرجوع إلى تدريب نموذج مع Amazon SageMaker. في هذا المنشور ، أسلط الضوء لفترة وجيزة على ميزة استخدام وظائف التدريب هذه ، إلى جانب حقيقة أنها تسمح لنا باستخدام مثيلات حساب GPU.

لنفترض أن لدينا مجموعة من مثيلات GPU يمكننا استخدامها. في هذه الحالة ، من المحتمل أن نرغب في إنشاء صورة Docker لتشغيل التدريب حتى نتمكن من تكرار بيئة التدريب بسهولة على الأجهزة الأخرى. نقوم بعد ذلك بتثبيت الحزم المطلوبة ولأننا نريد استخدام عدة حالات ، نحتاج إلى إعداد تدريب موزع أيضًا. عندما يكتمل التدريب ، نريد إيقاف تشغيل أجهزة الكمبيوتر هذه بسرعة لأنها مكلفة.

يتم استخلاص كل هذه الخطوات بعيدًا عنا عند استخدام وظائف التدريب. في الواقع ، يمكننا تدريب نموذج بنفس الطريقة الموضحة من خلال تحديد معلمات التدريب ثم استدعاء طريقة واحدة فقط. يعتني SageMaker بالباقي ، بما في ذلك إيقاف مثيلات GPU عند اكتمال التدريب حتى لا تتحمل أي تكاليف إضافية.

بالإضافة إلى ذلك ، أعلنت Hugging Face و AWS عن شراكة في وقت سابق في عام 2022 تجعل من الأسهل تدريب نماذج Hugging Face على SageMaker. هذه الوظيفة متاحة من خلال تطوير Hugging Face حاويات AWS Deep Learning (DLCs). تتضمن هذه الحاويات Hugging Face Transformers و Tokenizers ومكتبة Datasets ، والتي تتيح لنا استخدام هذه الموارد في وظائف التدريب والاستدلال. للحصول على قائمة بصور DLC المتاحة ، انظر المتاح تعانق الوجه صور حاويات التعلم العميق. يتم صيانتها وتحديثها بانتظام مع تصحيحات الأمان. يمكننا العثور على العديد من الأمثلة حول كيفية تدريب نماذج Hugging Face باستخدام DLCs و تعانق الوجه Python SDK في التالي جيثب ريبو.

نستخدم أحد هذه الأمثلة كقالب لأنه يفعل كل ما نحتاجه تقريبًا لغرضنا: تدريب نموذج التلخيص على مجموعة بيانات محددة بطريقة موزعة (باستخدام أكثر من مثيل GPU).

ومع ذلك ، هناك شيء واحد علينا مراعاته وهو أن هذا المثال يستخدم مجموعة بيانات مباشرة من مركز مجموعة بيانات Hugging Face. لأننا نريد تقديم بياناتنا المخصصة ، نحتاج إلى تعديل دفتر الملاحظات قليلاً.

تمرير البيانات إلى وظيفة التدريب

لحساب حقيقة أننا نأتي بمجموعة البيانات الخاصة بنا ، نحتاج إلى استخدام قنوات. لمزيد من المعلومات ، يرجى الرجوع إلى كيف توفر Amazon SageMaker معلومات التدريب.

أنا شخصياً أجد هذا المصطلح مربكًا بعض الشيء ، لذلك أعتقد دائمًا في ذهني رسم الخرائط عندما اسمع قنوات، لأنها تساعدني على تصور ما يحدث بشكل أفضل. اسمحوا لي أن أشرح: كما تعلمنا بالفعل ، فإن وظيفة التدريب تدور حول مجموعة من الأمازون الحوسبة المرنة السحابية (Amazon EC2) ونسخ صورة Docker عليها. ومع ذلك ، يتم تخزين مجموعات البيانات الخاصة بنا في ملفات خدمة تخزين أمازون البسيطة (Amazon S3) ولا يمكن الوصول إليه بواسطة صورة Docker هذه. بدلاً من ذلك ، تحتاج مهمة التدريب إلى نسخ البيانات من Amazon S3 إلى مسار محدد مسبقًا محليًا في صورة Docker هذه. الطريقة التي يتم بها ذلك هي من خلال إخبارنا بوظيفة التدريب حيث توجد البيانات في Amazon S3 وأين يجب نسخ البيانات على صورة Docker بحيث يمكن لوظيفة التدريب الوصول إليها. نحن رسم خريطة موقع Amazon S3 بالمسار المحلي.

حددنا المسار المحلي في قسم المعلمات الفائقة لوظيفة التدريب:

ثم نخبر وظيفة التدريب حيث توجد البيانات في Amazon S3 عند استدعاء طريقة fit () ، والتي تبدأ التدريب:

![]()

لاحظ أن اسم المجلد بعد /opt/ml/input/data يطابق اسم القناة (datasets). يتيح ذلك لمهمة التدريب نسخ البيانات من Amazon S3 إلى المسار المحلي.

ابدأ التدريب

نحن الآن جاهزون لبدء وظيفة التدريب. كما ذكرنا من قبل ، نقوم بذلك عن طريق استدعاء fit() طريقة. يستمر التدريب لمدة 40 دقيقة. يمكنك متابعة التقدم والاطلاع على معلومات إضافية على وحدة تحكم SageMaker.

عند اكتمال مهمة التدريب ، حان الوقت لتقييم نموذجنا الذي تم تدريبه حديثًا.

القسم 4: تقييم النموذج المدرب

إن تقييم نموذجنا المُدرب مشابه جدًا لما فعلناه في القسم 2 ، حيث قمنا بتقييم نموذج ZSL. ندعو النموذج وننشئ ملخصات المرشحين ونقارنها بالملخصات المرجعية من خلال حساب درجات ROUGE. ولكن الآن ، يوجد النموذج في Amazon S3 في ملف يسمى model.tar.gz (للعثور على الموقع الدقيق ، يمكنك التحقق من مهمة التدريب على وحدة التحكم). إذن كيف يمكننا الوصول إلى النموذج لتوليد الملخصات؟

لدينا خياران: نشر النموذج على نقطة نهاية SageMaker أو تنزيله محليًا ، على غرار ما فعلناه في القسم 2 مع نموذج ZSL. في هذا البرنامج التعليمي ، أنا نشر النموذج إلى نقطة نهاية SageMaker لأنه أكثر ملاءمة وباختيار مثيل أكثر قوة لنقطة النهاية ، يمكننا تقصير وقت الاستنتاج بشكل كبير. يحتوي GitHub repo على ملف مفكرة يوضح كيفية تقييم النموذج محليًا.

نشر نموذج

عادة ما يكون من السهل جدًا نشر نموذج مدرب على SageMaker (انظر مرة أخرى المثال التالي على GitHub جيثب: من تعانق الوجه). بعد تدريب النموذج ، يمكننا الاتصال estimator.deploy() و SageMaker يقوم بالباقي لنا في الخلفية. لأنه في برنامجنا التعليمي ننتقل من دفتر ملاحظات إلى آخر ، يتعين علينا تحديد وظيفة التدريب والنموذج المرتبط أولاً ، قبل أن نتمكن من نشره:

بعد استرجاع موقع النموذج ، يمكننا نشره في نقطة نهاية SageMaker:

يعد النشر على SageMaker أمرًا سهلاً لأنه يستخدم امتداد مجموعة أدوات استدلال الوجه المعانقة من SageMaker، مكتبة مفتوحة المصدر لخدمة نماذج Transformers على SageMaker. في العادة لا نضطر حتى إلى تقديم نص استدلال ؛ مجموعة الأدوات تعتني بذلك. ومع ذلك ، في هذه الحالة ، تستخدم مجموعة الأدوات Pipeline API مرة أخرى ، وكما ناقشنا في القسم 2 ، لا تسمح لنا Pipeline API باستخدام تقنيات إنشاء نص متقدمة مثل البحث في الحزمة وأخذ العينات. لتجنب هذا القيد ، نقدم نص برمجي مخصص للاستدلال.

التقييم الأول

بالنسبة للتقييم الأول لنموذجنا الذي تم تدريبه حديثًا ، نستخدم نفس المعلمات كما في القسم 2 مع نموذج اللقطة الصفرية لإنشاء ملخصات المرشحين. يسمح هذا بإجراء مقارنة بين التفاح والتفاح:

نقارن الملخصات التي تم إنشاؤها بواسطة النموذج مع الملخصات المرجعية:

هذا مشجع! أدت محاولتنا الأولى لتدريب النموذج ، دون أي ضبط للمعامل الفائق ، إلى تحسين درجات ROUGE بشكل ملحوظ.

التقييم الثاني

حان الوقت الآن لاستخدام بعض التقنيات الأكثر تقدمًا مثل البحث بالحزمة وأخذ العينات للتلاعب بالنموذج. للحصول على شرح مفصل لما تفعله كل من هذه المعلمات ، يرجى الرجوع إلى كيفية إنشاء نص: استخدام طرق فك تشفير مختلفة لتوليد اللغة باستخدام المحولات. لنجربها باستخدام مجموعة شبه عشوائية من القيم لبعض هذه المعلمات:

عند تشغيل نموذجنا بهذه المعلمات ، نحصل على الدرجات التالية:

لم ينجح ذلك تمامًا كما كنا نأمل - فقد انخفضت نتائج ROUGE بشكل طفيف في الواقع. ومع ذلك ، لا تدع هذا يثنيك عن تجربة قيم مختلفة لهذه المعلمات. في الواقع ، هذه هي النقطة التي ننتهي فيها من مرحلة الإعداد والانتقال إلى مرحلة الاختبار الخاصة بالمشروع.

الخلاصة والخطوات التالية

لقد انتهينا من الإعداد لمرحلة التجريب. في هذه السلسلة المكونة من جزأين ، نزّلنا بياناتنا وأعدناها ، وأنشأنا خطًا أساسيًا باستخدام إرشادي بسيط ، وأنشأنا خطًا أساسيًا آخر باستخدام التعلم بدون طلقة ، ثم قمنا بتدريب نموذجنا وشهدنا زيادة ملحوظة في الأداء. حان الوقت الآن للتلاعب بكل جزء أنشأناه من أجل إنشاء ملخصات أفضل. ضع في اعتبارك ما يلي:

- معالجة البيانات بشكل صحيح - على سبيل المثال ، قم بإزالة كلمات التوقف وعلامات الترقيم. لا تقلل من شأن هذا الجزء - في العديد من مشاريع علوم البيانات ، تعد المعالجة المسبقة للبيانات أحد أهم الجوانب (إن لم تكن أهمها) ، وعادةً ما يقضي علماء البيانات معظم وقتهم في هذه المهمة.

- جرب نماذج مختلفة - في برنامجنا التعليمي ، استخدمنا النموذج القياسي للتلخيص (

sshleifer/distilbart-cnn-12-6)، ولكن العديد من النماذج متوفرة يمكنك استخدامها لهذه المهمة. قد يكون أحد هؤلاء أكثر ملاءمة لحالة الاستخدام الخاصة بك. - قم بإجراء ضبط للمعلمة الفائقة - عند تدريب النموذج ، استخدمنا مجموعة معينة من المعلمات الفائقة (معدل التعلم ، وعدد الحقب ، وما إلى ذلك). لم يتم وضع هذه المعلمات في حجر - بل على العكس تمامًا. يجب عليك تغيير هذه المعلمات لفهم كيفية تأثيرها على أداء النموذج الخاص بك.

- استخدم معلمات مختلفة لتوليد النص - لقد قمنا بالفعل بجولة واحدة لإنشاء الملخصات بمعايير مختلفة للاستفادة من بحث الحزمة وأخذ العينات. جرب قيم ومعايير مختلفة. لمزيد من المعلومات ، يرجى الرجوع إلى كيفية إنشاء نص: استخدام طرق فك تشفير مختلفة لتوليد اللغة باستخدام المحولات.

أتمنى أن تكون قد وصلت إلى النهاية ووجدت هذا البرنامج التعليمي مفيدًا.

عن المؤلف

هيكو هوتز هو مهندس حلول أول للذكاء الاصطناعي والتعلم الآلي ويقود مجتمع معالجة اللغات الطبيعية (NLP) داخل AWS. قبل هذا المنصب ، كان رئيسًا لعلوم البيانات لخدمة عملاء أمازون في الاتحاد الأوروبي. تساعد Heiko عملاءنا على تحقيق النجاح في رحلة الذكاء الاصطناعي / التعلم الآلي الخاصة بهم على AWS وعملت مع مؤسسات في العديد من الصناعات ، بما في ذلك التأمين والخدمات المالية والإعلام والترفيه والرعاية الصحية والمرافق والتصنيع. يسافر هيكو قدر الإمكان في أوقات فراغه.

هيكو هوتز هو مهندس حلول أول للذكاء الاصطناعي والتعلم الآلي ويقود مجتمع معالجة اللغات الطبيعية (NLP) داخل AWS. قبل هذا المنصب ، كان رئيسًا لعلوم البيانات لخدمة عملاء أمازون في الاتحاد الأوروبي. تساعد Heiko عملاءنا على تحقيق النجاح في رحلة الذكاء الاصطناعي / التعلم الآلي الخاصة بهم على AWS وعملت مع مؤسسات في العديد من الصناعات ، بما في ذلك التأمين والخدمات المالية والإعلام والترفيه والرعاية الصحية والمرافق والتصنيع. يسافر هيكو قدر الإمكان في أوقات فراغه.

- "

- &

- 100

- 2022

- 7

- 84

- 9

- حول المستشفى

- الملخص

- الوصول

- حسابي

- إضافة

- إضافي

- متقدم

- مميزات

- AI

- الكل

- سابقا

- بالرغم ان

- أمازون

- أعلن

- آخر

- API

- حول

- مقالات

- متاح

- AWS

- خلفية

- خط الأساس

- شعاع

- أصبح

- يجري

- مؤشر

- تستفيد

- قطعة

- دعوة

- يهمني

- تغيير

- الكود

- مجتمع

- إحصاء

- أجهزة الكمبيوتر

- مفهوم

- كنسولات

- حاويات

- يحتوي

- مراقبة

- مناسب

- التكاليف

- استطاع

- يخلق

- خلق

- على

- خدمة العملاء

- العملاء

- البيانات

- علم البيانات

- نشر

- التطوير التجاري

- فعل

- مختلف

- وزعت

- عامل في حوض السفن

- لا

- نطاق

- إلى أسفل

- التنزيلات

- بسهولة

- شجع

- نقطة النهاية

- ترفيه

- البيئة

- EU

- كل شىء

- مثال

- توقع

- مقتطفات

- الوجه

- مالي

- الخدمات المالية

- الاسم الأول

- تناسب

- اتباع

- متابعيك

- شكل

- إلى الأمام

- وجدت

- وظيفة

- وظيفة

- إضافي

- العلاجات العامة

- توليد

- جيل

- GitHub جيثب:

- الذهاب

- خير

- وحدة معالجة الرسوميات:

- توجيه

- رئيس

- الرعاية الصحية

- يساعد

- تسليط الضوء

- كيفية

- كيفية

- HTTPS

- فكرة

- تحديد

- صورة

- أهمية

- تحسن

- تتضمن

- بما فيه

- القيمة الاسمية

- الصناعات

- تأثير

- معلومات

- تثبيت

- التأمين

- تعقيدات

- IT

- وظيفة

- المشــاريــع

- القفل

- المشهد

- لغة

- كمبيوتر محمول

- أكبر

- يؤدي

- تعلم

- تعلم

- تعلم

- المكتبة

- قائمة

- محلي

- محليا

- موقع

- طويل

- آلة

- آلة التعلم

- الآلات

- يصنع

- تصنيع

- الوسائط

- مانع

- ML

- نموذج

- عارضات ازياء

- الأكثر من ذلك

- أكثر

- أي

- طبيعي

- أخبار

- مفكرة

- عدد

- أرقام

- مزيد من الخيارات

- طلب

- المنظمات

- أخرى

- ورق

- الشراكة

- بقع

- أداء

- مرحلة جديدة

- بلايستشن

- البوينت

- الرائج

- ممكن

- قوي

- تنبؤات

- تنفيذ المشاريع

- مشروع ناجح

- اقترح

- تزود

- ويوفر

- غرض

- جودة

- بسرعة

- معقول

- الاعتراف

- مطلوب

- بحث

- الموارد

- REST

- النتائج

- دائري

- يجري

- تشغيل

- علوم

- العلماء

- بحث

- أمن

- إحساس

- مسلسلات

- الخدمة

- خدماتنا

- خدمة

- طقم

- هام

- مماثل

- الاشارات

- SIX

- So

- الحلول

- على وجه التحديد

- أنفق

- بداية

- يبدأ

- دولة من بين الفن

- تخزين

- الإستراتيجيات

- ناجح

- مفاتيح

- تقنيات

- تجربه بالعربي

- عبر

- الوقت

- عنوان

- قادة الإيمان

- عادة

- فهم

- us

- تستخدم

- عادة

- الاستفادة من

- قيمنا

- الموقع الإلكتروني

- ابحث عن

- من الذى

- ويكيبيديا

- في غضون

- بدون

- كلمات

- للعمل

- اكتشف - حل

- عمل

- قيمة

- سنوات

- صفر