حدد الباحثون ما يقرب من اثنتي عشرة نقطة ضعف حرجة في البنية التحتية التي تستخدمها نماذج الذكاء الاصطناعي (بالإضافة إلى ثلاثة أخطاء عالية واثنين من الأخطاء متوسطة الخطورة)، والتي يمكن أن تترك الشركات في خطر أثناء تسابقها للاستفادة من الذكاء الاصطناعي. البعض منهم لا يزال دون إصلاح.

تُستخدم الأنظمة الأساسية المتأثرة لاستضافة ونشر ومشاركة نماذج اللغات الكبيرة (LLM) ومنصات ML وأنظمة الذكاء الاصطناعي الأخرى. وهي تشمل راي، المستخدم في التدريب الموزع لنماذج التعلم الآلي؛ وMLflow، منصة دورة حياة التعلم الآلي؛ ModelDBومنصة لإدارة التعلم الآلي؛ و H20 الإصدار 3، منصة مفتوحة المصدر للتعلم الآلي تعتمد على جافا.

Mكشفت شركة أمن التعلم الآلي Protect AI عن النتائج في 16 نوفمبر كجزء من برنامج مكافآت الأخطاء الخاص بالذكاء الاصطناعي، Huntr. لاأطلعت مشرفي البرامج والبائعين على الثغرات الأمنية، مما أتاح لهم 45 يومًا لإصلاح المشكلات.

تم تعيين معرف CVE لكل مشكلة، وعلى الرغم من إصلاح العديد من المشكلات، تظل المشكلات الأخرى دون تصحيح، وفي هذه الحالة أوصت شركة Protect AI بحل بديل في استشاري لها.

تشكل أخطاء الذكاء الاصطناعي خطرًا كبيرًا على المؤسسات

وفقًا لـ Protect AI، يمكن لنقاط الضعف في أنظمة الذكاء الاصطناعي أن تمنح المهاجمين وصولاً غير مصرح به إلى نماذج الذكاء الاصطناعي، مما يسمح لهم باختيار النماذج لتحقيق أهدافهم الخاصة.

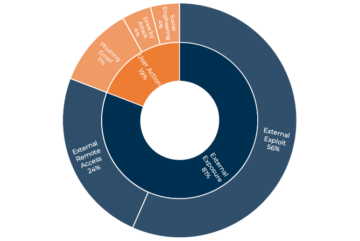

لكن يمكنهم أيضًا منحهم مدخلاً إلى بقية الشبكة، كما يقول شون مورغان، كبير المهندسين في شركة Protect AI. يعد اختراق الخادم وسرقة بيانات الاعتماد من خدمات الذكاء الاصطناعي ذات التعليمات البرمجية المنخفضة احتمالين للوصول الأولي، على سبيل المثال.

ويقول: "يمكن أن تحتوي خوادم الاستدلال على نقاط نهاية يمكن الوصول إليها ليتمكن المستخدمون من استخدام نماذج التعلم الآلي [عن بعد]، ولكن هناك طرقًا كثيرة للوصول إلى شبكة شخص ما". "غالبًا ما تتمتع أنظمة تعلم الآلة التي نستهدفها [باستخدام برنامج مكافآت الأخطاء] بامتيازات مرتفعة، ولذا فمن المهم جدًا أنه إذا تمكن شخص ما من الدخول إلى شبكتك، فلن يتمكن من تصعيد الامتيازات بسرعة إلى نظام حساس للغاية ".

على سبيل المثال، هناك مشكلة خطيرة تتعلق بتضمين ملف محلي (تم تصحيحها الآن) في واجهة برمجة التطبيقات (API) الخاصة بمنصة التعلم الموزعة Ray والتي تسمح للمهاجم بقراءة أي ملف على النظام. هناك مشكلة أخرى في منصة H20 (تم إصلاحها أيضًا) تسمح بتنفيذ التعليمات البرمجية عبر استيراد نموذج الذكاء الاصطناعي.

والخطر ليس نظريا: فقد شرعت الشركات الكبرى بالفعل في حملات مكثفة للعثور على نماذج مفيدة للذكاء الاصطناعي وتطبيقها في أسواقها وعملياتها. وتستخدم البنوك بالفعل التعلم الآلي والذكاء الاصطناعي لمعالجة الرهن العقاري ومكافحة غسيل الأموال، على سبيل المثال.

أثناء العثور نقاط الضعف في أنظمة الذكاء الاصطناعي هذه يقول داريان دهغانبيشه، الرئيس والمؤسس المشارك لشركة Protect AI، إن سرقة الملكية الفكرية يمكن أن تؤدي إلى تعريض البنية التحتية للخطر، كما أن سرقة الملكية الفكرية تعد هدفًا كبيرًا أيضًا.

ويقول: "يعد التجسس الصناعي عنصرًا كبيرًا، وفي المعركة من أجل الذكاء الاصطناعي والتعلم الآلي، تعد النماذج أحد أصول الملكية الفكرية القيمة للغاية". "فكر في مقدار الأموال التي يتم إنفاقها على تدريب النموذج على أساس يومي، وعندما تتحدث عن مليار معلمة وأكثر من ذلك، فهذا يعني الكثير من الاستثمار، مجرد رأس مال خالص يمكن اختراقه أو سرقته بسهولة."

يقول داين شيريتس، كبير مهندسي الحلول في HackerOne، إن مكافحة الاستغلالات الجديدة للبنية التحتية التي تقوم عليها تفاعلات اللغة الطبيعية التي يمتلكها الأشخاص مع أنظمة الذكاء الاصطناعي مثل ChatGPT ستكون أكثر تأثيرًا. وذلك لأنه عندما يتمكن مجرمو الإنترنت من إثارة هذه الأنواع من نقاط الضعف، فإن كفاءة أنظمة الذكاء الاصطناعي ستجعل التأثير أكبر بكثير.

ويقول إن هذه الهجمات "يمكن أن تجعل النظام ينشر بيانات حساسة أو سرية، أو تساعد الجهة الخبيثة على الوصول إلى الواجهة الخلفية للنظام". "يمكن أن يكون لنقاط الضعف في الذكاء الاصطناعي، مثل تسميم بيانات التدريب، تأثير مضاعف كبير، مما يؤدي إلى نشر مخرجات خاطئة أو ضارة على نطاق واسع."

أمن البنية التحتية للذكاء الاصطناعي: غالبًا ما يتم التغاضي عنه

بعد تقديم ChatGPT قبل عام، انطلقت التقنيات والخدمات القائمة على الذكاء الاصطناعي - وخاصة الذكاء الاصطناعي التوليدي (GenAI). في أعقابها، أ مجموعة متنوعة من الهجمات العدائية تم تطويرها بحيث يمكنها استهداف أنظمة الذكاء الاصطناعي والتعلم الآلي وعملياتها. في 15 نوفمبر، على سبيل المثال، قامت شركة أمن الذكاء الاصطناعي Adversa AI

كشفت عن عدد من الهجمات على الأنظمة القائمة على GPT بما في ذلك التسريب الفوري وتعداد واجهات برمجة التطبيقات التي يمكن للنظام الوصول إليها.

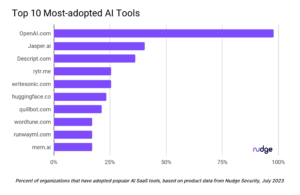

ومع ذلك، فإن الكشف عن أخطاء شركة ProtectAI يؤكد حقيقة أن الأدوات والبنية التحتية التي تدعم عمليات التعلم الآلي وعمليات الذكاء الاصطناعي يمكن أن تصبح أهدافًا أيضًا. وفي كثير من الأحيان، اعتمدت الشركات الأدوات وسير العمل المستندة إلى الذكاء الاصطناعي دون استشارة مجموعات أمن المعلومات في كثير من الأحيان.

"كما هو الحال مع أي دورة ضجيج عالية التقنية، سينشر الأشخاص الأنظمة، وسيطرحون التطبيقات، وسيخلقون تجارب جديدة لتلبية احتياجات الأعمال والسوق، وفي كثير من الأحيان إما يهملون الأمن ويقومون بإنشاء هذه يقول دهغانبيشه: "إنهم سيستخدمون أنواعًا مختلفة من "أكوام الظل"، أو سيفترضون أن القدرات الأمنية الحالية التي لديهم يمكن أن تحافظ على سلامتهم". "لكن الأشياء التي نقوم بها نحن [المحترفون في مجال الأمن السيبراني] لمراكز البيانات التقليدية، لا تحافظ بالضرورة على سلامتك في السحابة، والعكس صحيح."

استخدمت شركة Protect AI منصة مكافآت الأخطاء الخاصة بها، والتي يطلق عليها اسم Huntr، للحصول على بيانات حول الثغرات الأمنية من آلاف الباحثين لمنصات مختلفة للتعلم الآلي، ولكن حتى الآن، لا يزال صيد الأخطاء في هذا القطاع في بداياته. وهذا يمكن أن يكون على وشك التغيير، على الرغم من.

على سبيل المثال، لم تشهد مبادرة Zero Day الخاصة بشركة Trend Micro طلبًا كبيرًا حتى الآن على اكتشاف الأخطاء في أدوات الذكاء الاصطناعي/التعلم الآلي، لكن المجموعة شهدت تحولات منتظمة في أنواع نقاط الضعف التي تريد الصناعة من الباحثين العثور عليها، ومن المرجح أن يكون التركيز على الذكاء الاصطناعي قادمًا قريبًا، كما يقول داستن تشايلدز، رئيس قسم التوعية بالتهديدات في مبادرة Zero Day من Trend Micro.

ويقول: "إننا نرى الشيء نفسه في الذكاء الاصطناعي الذي رأيناه في الصناعات الأخرى أثناء تطورها". "في البداية، تم إلغاء أولوية الأمن لصالح إضافة وظائف. والآن بعد أن وصل الأمر إلى مستوى معين من القبول، بدأ الناس يتساءلون عن التداعيات الأمنية.

- محتوى مدعوم من تحسين محركات البحث وتوزيع العلاقات العامة. تضخيم اليوم.

- PlatoData.Network Vertical Generative Ai. تمكين نفسك. الوصول هنا.

- أفلاطونايستريم. ذكاء Web3. تضخيم المعرفة. الوصول هنا.

- أفلاطون كربون، كلينتك ، الطاقة، بيئة، شمسي، إدارة المخلفات. الوصول هنا.

- أفلاطون هيلث. التكنولوجيا الحيوية وذكاء التجارب السريرية. الوصول هنا.

- المصدر https://www.darkreading.com/vulnerabilities-threats/unpatched-critical-vulnerabilities-ai-models-takeover

- :لديها

- :يكون

- :ليس

- 15%

- 16

- 7

- a

- ماهرون

- من نحن

- قبول

- الوصول

- يمكن الوصول

- مضيفا

- اعتمد

- مميزات

- الخصومة

- تتأثر

- ضد

- العدواني

- منذ

- AI

- نماذج الذكاء الاصطناعى

- خدمات الذكاء الاصطناعي

- أنظمة الذكاء الاصطناعي

- AI / ML

- السماح

- يسمح

- سابقا

- أيضا

- an

- و

- والبنية التحتية

- آخر

- مكافحة غسل الاموال

- أي وقت

- API

- واجهات برمجة التطبيقات

- التطبيقات

- التقديم

- هي

- AS

- تطلب

- الأصول

- تعيين

- افترض

- At

- الهجمات

- وعي

- الخلفية

- البنوك

- على أساس

- أساس

- معركة

- BE

- لان

- أصبح

- كان

- كبير

- مليار

- هبة

- علة

- علة فضله

- البق

- الأعمال

- الأعمال

- لكن

- by

- الحملات

- CAN

- قدرات

- الموارد

- حقيبة

- سبب

- مراكز

- معين

- تغيير

- شات جي بي تي

- رئيس

- سحابة

- المؤسس المشارك

- الكود

- آت

- يصل قريباً

- الشركات

- عنصر

- حل وسط

- تسوية

- الاستشارات

- استطاع

- خلق

- أوراق اعتماد

- حرج

- CVE

- مجرمو الإنترنت

- الأمن السيبراني

- دورة

- يوميا

- البيانات

- مراكز البيانات

- يوم

- أيام

- الطلب

- نشر

- نشر

- المتقدمة

- مختلف

- وزعت

- التدريب الموزع

- فعل

- دون

- دزينة

- يطلق عليها اسم

- بسهولة

- تأثير

- الكفاءات

- إما

- مرتفع

- شرعت

- يتصعد

- خاصة

- تجسس

- حتى

- مثال

- أعدم

- القائمة

- خبرة

- مآثر

- حقيقة

- بعيدا

- صالح

- قم بتقديم

- العثور على

- شركة

- الاسم الأول

- ثابت

- تركز

- في حالة

- تبدأ من

- وظيفة

- ربح

- توليدي

- الذكاء الاصطناعي التوليدي

- دولار فقط واحصل على خصم XNUMX% على جميع

- منح

- هدف

- الأهداف

- أكبر

- تجمع

- يملك

- he

- رئيس

- مساعدة

- مرتفع

- ضرب

- استضافة

- كيفية

- HTML

- HTTPS

- صيد

- الضجيج

- محدد

- معرف

- if

- التأثير

- تؤثر

- آثار

- استيراد

- أهمية

- in

- في أخرى

- تتضمن

- بما فيه

- صناعي

- الصناعات

- العالمية

- معلومات

- امن المعلومات

- البنية التحتية

- في البداية

- مبادرة

- مثل

- فكري

- الملكية الفكرية

- التفاعلات

- إلى

- المُقدّمة

- استثمار

- قضية

- مسائل

- IT

- انها

- جافا

- JPG

- م

- احتفظ

- لغة

- كبير

- غسيل

- قيادة

- قيادة

- تعلم

- يترك

- مستوى

- دورة حياة

- مثل

- على الأرجح

- ll

- LLM

- محلي

- الكثير

- آلة

- آلة التعلم

- جعل

- إدارة

- كثير

- تجارة

- الأسواق

- تعرف علي

- الصغير

- ML

- نموذج

- عارضات ازياء

- مال

- الأكثر من ذلك

- مورغان

- رهن

- كثيرا

- تقريبا

- بالضرورة

- إحتياجات

- شبكة

- جديد

- نوفمبر

- رواية

- الآن

- عدد

- of

- خصم

- غالبا

- on

- جاكيت

- المصدر المفتوح

- عمليات

- or

- أخرى

- أخرى

- خارج

- النتائج

- الخاصة

- المعلمات

- جزء

- بقعة

- مجتمع

- المنصة

- منصات التداول

- أفلاطون

- الذكاء افلاطون البيانات

- أفلاطون داتا

- المزيد

- إمكانيات

- يقدم

- رئيس

- امتياز

- الامتيازات

- العمليات

- معالجة

- المهنيين

- البرنامج

- الملكية

- حماية

- وضع

- بسرعة

- سباق

- RAY

- RE

- عرض

- موصى به

- منتظم

- لا تزال

- بقايا

- بعد

- الباحثين

- REST

- النتائج

- تموج

- المخاطرة

- s

- خزنة

- نفسه

- رأى

- يقول

- شون

- القطاع

- أمن

- رؤية

- رأيت

- كبير

- حساس

- الخادم

- خوادم

- خدماتنا

- شادو

- مشاركة

- التحولات

- هام

- So

- حتى الآن

- تطبيقات الكمبيوتر

- الحلول

- بعض

- شخص ما

- قريبا

- مصدر

- قضى

- كومات

- ابتداء

- مسروق

- التقديمات

- الدعم

- نظام

- أنظمة

- أخذ

- اتخذت

- استيلاء

- الحديث

- الهدف

- استهداف

- الأهداف

- التكنولوجيا

- أن

- •

- سرقة

- من مشاركة

- منهم

- نظري

- هناك.

- تشبه

- هم

- شيء

- الأشياء

- اعتقد

- على الرغم من؟

- الآلاف

- التهديد

- ثلاثة

- إلى

- أدوات

- تقليدي

- قادة الإيمان

- اكثر شيوعا

- يثير

- اثنان

- أنواع

- غير مصرح

- دعم

- تستخدم

- مستعمل

- المستخدمين

- القيمة

- الباعة

- الإصدار

- جدا

- بواسطة

- رذيلة

- نقاط الضعف

- الضعف

- استيقظ

- يريد

- وكان

- طرق

- we

- حسن

- ابحث عن

- متى

- التي

- في حين

- واسع الانتشار

- سوف

- مع

- سير العمل

- عام

- حتى الآن

- أنت

- حل متجر العقارات الشامل الخاص بك في جورجيا

- زفيرنت

- صفر

- يوم الصفر