الأمازون الحوسبة المرنة السحابية (أمازون EC2) مثيلات G5 هي المثيلات الأولى والوحيدة في السحابة التي تتميز بوحدات معالجة الرسومات NVIDIA A10G Tensor Core ، والتي يمكنك استخدامها لمجموعة كبيرة من حالات استخدام التعلم المكثف والرسومات (ML). مع مثيلات G5 ، يحصل عملاء ML على أداء عالٍ وبنية تحتية فعالة من حيث التكلفة لتدريب ونشر نماذج أكبر وأكثر تعقيدًا لمعالجة اللغة الطبيعية (NLP) ورؤية الكمبيوتر (CV) وحالات استخدام محرك التوصية.

الغرض من هذا المنشور هو عرض مزايا أداء مثيلات G5 لأعباء عمل استدلال ML على نطاق واسع. نقوم بذلك من خلال مقارنة أداء السعر (الذي تم قياسه على أساس $ لكل مليون استدلال) لنماذج NLP و CV مع مثيلات G4dn. نبدأ بوصف نهجنا المعياري ثم نقدم منحنيات الإنتاجية مقابل زمن الانتقال عبر أحجام الدُفعات ودقة نوع البيانات. بالمقارنة مع مثيلات G4dn ، نجد أن مثيلات G5 تقدم تكلفة أقل باستمرار لكل مليون استدلال لكل من الدقة الكاملة وأوضاع الدقة المختلطة لنماذج NLP و CV مع تحقيق إنتاجية أعلى وزمن انتقال أقل.

نهج المقارنة المعيارية

لتطوير دراسة أداء السعر بين G5 و G4dn ، نحتاج إلى قياس الإنتاجية ووقت الاستجابة والتكلفة لكل مليون استدلال كدالة لحجم الدُفعة. ندرس أيضًا تأثير الدقة الكاملة مقابل الدقة المختلطة. يتم تحميل كل من الرسم البياني للنموذج والمدخلات في CUDA قبل الاستنتاج.

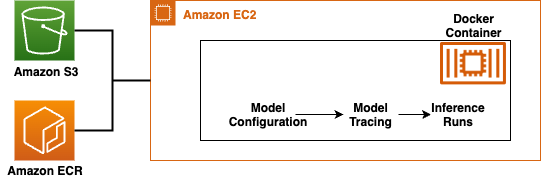

كما هو موضح في الرسم التخطيطي للهندسة المعمارية التالي ، نقوم أولاً بإنشاء صور حاوية أساسية خاصة باستخدام CUDA لمثيل EC2 الأساسي (G4dn ، G5). لبناء صور الحاوية الأساسية ، نبدأ بـ حاويات AWS Deep Learning، والتي تستخدم صور Docker المعبأة مسبقًا لنشر بيئات التعلم العميق في دقائق. تحتوي الصور على مكتبات وأدوات PyTorch للتعلم العميق المطلوبة. يمكنك إضافة المكتبات والأدوات الخاصة بك فوق هذه الصور للحصول على درجة أعلى من التحكم في المراقبة والامتثال ومعالجة البيانات.

ثم نقوم ببناء صورة حاوية خاصة بالنموذج تضم تكوين النموذج وتتبع النموذج والشفرة ذات الصلة لتشغيل التمريرات إلى الأمام. يتم تحميل جميع صور الحاوية في أمازون ECR للسماح بالقياس الأفقي لهذه النماذج لتكوينات النماذج المختلفة. نحن نستخدم خدمة تخزين أمازون البسيطة (Amazon S3) كمخزن بيانات شائع لتنزيل التكوين وتحميل نتائج القياس للتلخيص. يمكنك استخدام هذه البنية لإعادة إنشاء نتائج القياس وإعادة إنتاجها وإعادة الغرض منها لقياس أنواع النماذج المختلفة (مثل نماذج Hugging Face ، ونماذج PyTorch ، والنماذج المخصصة الأخرى) عبر أنواع مثيلات EC2 (وحدة المعالجة المركزية ، وحدة معالجة الرسومات ، Inf1).

مع إعداد هذه التجربة ، يتمثل هدفنا في دراسة زمن الانتقال كدالة للإنتاجية. يعتبر هذا المنحنى مهمًا لتصميم التطبيق للوصول إلى بنية تحتية مُثلى من حيث التكلفة للتطبيق المستهدف. لتحقيق ذلك ، نقوم بمحاكاة الأحمال المختلفة عن طريق ترتيب الاستعلامات في قائمة انتظار من سلاسل رسائل متعددة ثم قياس وقت الذهاب والإياب لكل طلب مكتمل. يتم قياس الإنتاجية بناءً على عدد الطلبات المكتملة لكل وحدة وقت ساعة. علاوة على ذلك ، يمكنك تغيير أحجام الدُفعات والمتغيرات الأخرى مثل طول التسلسل والدقة الكاملة مقابل نصف الدقة لاكتساح مساحة التصميم بشكل شامل للوصول إلى مقاييس الأداء الإرشادية. في دراستنا ، من خلال المسح المعياري لحجم الدُفعة والاستفسارات من العملاء متعددي الخيوط ، يتم تحديد منحنى الإنتاجية مقابل زمن الانتقال. يمكن تجميع كل طلب لضمان الاستخدام الكامل للمسرع ، خاصة للطلبات الصغيرة التي قد لا تستخدم عقدة الحساب بشكل كامل. يمكنك أيضًا اعتماد هذا الإعداد لتحديد حجم الدُفعة من جانب العميل للحصول على الأداء الأمثل.

باختصار ، يمكننا تمثيل هذه المشكلة رياضيًا على النحو التالي: (الإنتاجية ، الكمون) = وظيفة (حجم الدُفعة ، عدد الخيوط ، الدقة).

وهذا يعني أنه بالنظر إلى المساحة الهائلة ، يمكن أن يكون عدد التجارب كبيرًا. لحسن الحظ ، يمكن تشغيل كل تجربة بشكل مستقل. نوصي باستخدام دفعة AWS لإجراء هذا القياس المعياري الأفقي في وقت مضغوط دون زيادة في تكلفة قياس الأداء مقارنة بالنهج الخطي للاختبار. رمز تكرار النتائج موجود في ملف مستودع جيثب أعدت لـ AWS Re: Invent 2021. المستودع شامل لأداء قياس الأداء على مسرعات مختلفة. يمكنك الرجوع إلى جانب GPU من التعليمات البرمجية لإنشاء الحاوية (Dockerfile-gpu) ثم الرجوع إلى الكود الموجود بالداخل Container-Root للحصول على أمثلة محددة لـ BERT و ResNet50.

استخدمنا النهج السابق لتطوير دراسات الأداء عبر نوعين من النماذج: Bert-base-uncased (110 مليون معلمة ، NLP) و ResNet50 (25.6 مليون معلمة ، السيرة الذاتية). يلخص الجدول التالي تفاصيل النموذج.

| نوع النموذج | الموديل | التفاصيل |

| NLP | twmkn9 / bert-base-uncased-squad2 | 110 مليون معلمة طول التسلسل = 128 |

| CV | ريسنت 50 | 25.6 مليون معلمة |

بالإضافة إلى ذلك ، للقياس عبر أنواع البيانات (كاملة ، نصف الدقة) ، نستخدمها torch.cuda.amp، والذي يوفر طرقًا ملائمة للتعامل مع الدقة المختلطة حيث تستخدم بعض العمليات torch.float32 (عائم) نوع البيانات واستخدام العمليات الأخرى torch.float16 (نصف). على سبيل المثال ، تكون عوامل التشغيل مثل الطبقات الخطية والتلافيف أسرع بكثير مع float16 ، بينما تتطلب عوامل أخرى مثل التخفيضات غالبًا النطاق الديناميكي لـ float. تحاول الدقة المختلطة التلقائية مطابقة كل مشغل بنوع بياناته المناسب لتحسين وقت تشغيل الشبكة وبصمة الذاكرة.

نتائج قياس الأداء

لمقارنة عادلة ، اخترنا G4dn.4xlarge و G5.4xكبيرة مثيلات ذات سمات متشابهة ، كما هو موضح في الجدول التالي.

| حتة | وحدات معالجة الرسومات | ذاكرة وحدة معالجة الرسومات (جيجابايت) | وحدات المعالجة المركزية الافتراضية | الذاكرة (جيجابايت) | تخزين المثيل (جيجابايت) | أداء الشبكة (جيجابت في الثانية) | عرض النطاق الترددي لـ EBS (جيجابت في الثانية) | تسعير Linux عند الطلب (الولايات المتحدة-الشرق -1) |

| G5.4xكبيرة | 1 | 24 | 16 | 64 | 1 × 600 NVMe SSD | حتى 25 | 8 | ٤٠ دولار/ساعة |

| G4dn.4xlarge | 1 | 16 | 16 | 64 | 1 × 225 NVMe SSD | حتى 25 | 4.75 | ٤٠ دولار/ساعة |

في الأقسام التالية ، نقارن أداء استدلال ML لنماذج BERT و RESNET50 بنهج مسح الشبكة لأحجام دُفعات معينة (32 ، 16 ، 8 ، 4 ، 1) ودقة نوع البيانات (دقة كاملة ونصف) للوصول إلى الإنتاجية مقابل منحنى الكمون. بالإضافة إلى ذلك ، نحن نتحرى تأثير الإنتاجية مقابل حجم الدُفعة لكل من الدقة الكاملة ونصف. أخيرًا ، نقيس التكلفة لكل مليون استدلال كدالة لحجم الدفعة. يتم تلخيص النتائج المجمعة عبر هذه التجارب لاحقًا في هذا المنشور.

الإنتاجية مقابل زمن الوصول

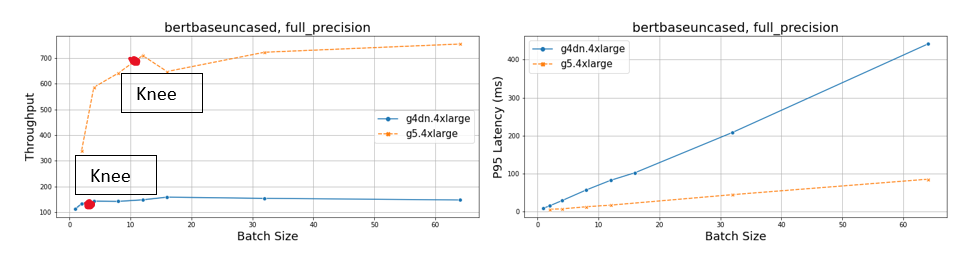

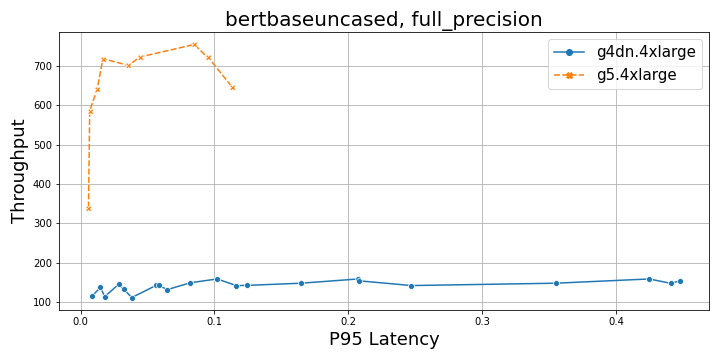

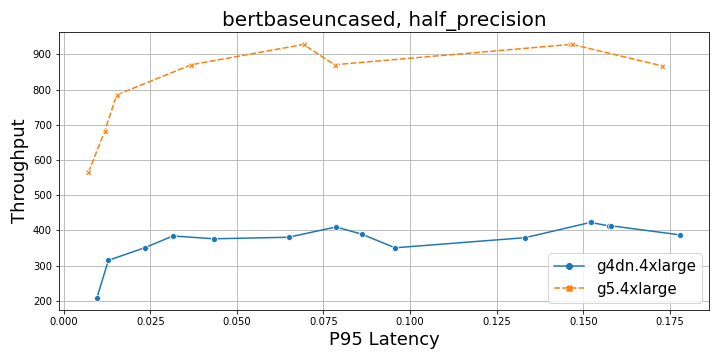

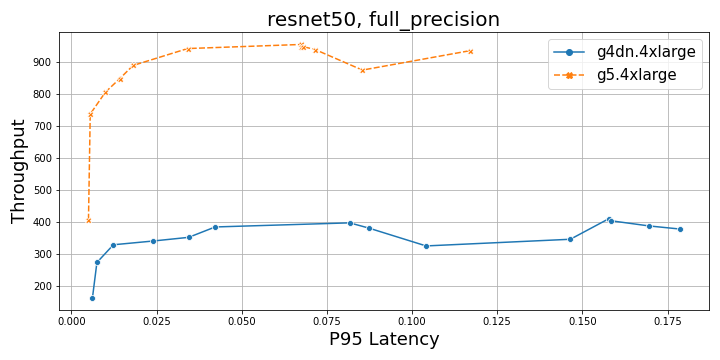

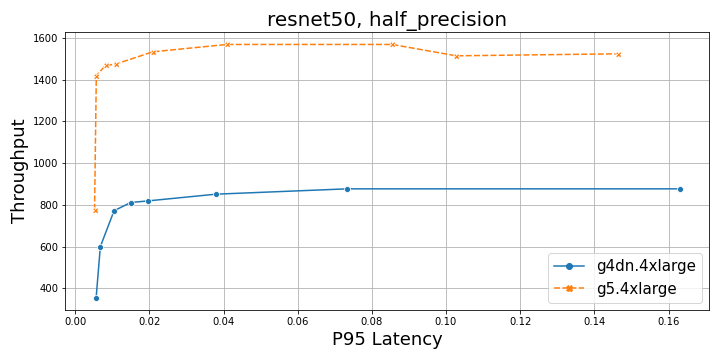

تقارن الأرقام التالية مثيلات G4dn و G5 لأحمال عمل NLP والسيرة الذاتية بدقة كاملة ونصف. بالمقارنة مع مثيلات G4dn ، يوفر مثيل G5 إنتاجية أعلى بحوالي خمس مرات (دقة كاملة) وحوالي 2.5 مرة أعلى (نصف دقة) لنموذج BERT الأساسي ، وحوالي 2 - 2.5 مرة أعلى لنموذج ResNet50. بشكل عام ، يعد G5 هو الخيار المفضل ، مع زيادة أحجام الدُفعات لكلا الطرازين من أجل الدقة الكاملة والمختلطة من منظور الأداء.

تقارن الرسوم البيانية التالية معدل النقل ووقت الاستجابة P95 بدقة كاملة ونصف الدقة لـ BERT.

|

|

تقارن الرسوم البيانية التالية الإنتاجية ووقت الاستجابة P95 بدقة كاملة ونصف الدقة لـ ResNet50.

|

|

الإنتاجية والكمون مقابل حجم الدُفعة

توضح الرسوم البيانية التالية معدل النقل كدالة لحجم الدُفعة. في أحجام الدُفعات المنخفضة ، لا يعمل المسرع بكامل طاقته ومع زيادة حجم الدُفعات ، تزداد الإنتاجية على حساب زمن الانتقال. يقارب منحنى معدل النقل الحد الأقصى لقيمة التي هي دالة لأداء المسرع. للمنحنى سمتان مميزتان: قسم مرتفع وقسم مقارب مسطح. بالنسبة لنموذج معين ، يمكن للمسرع عالي الأداء (G5) تمديد القسم الصاعد إلى أحجام دفعات أعلى من G4dn والخط المقارب بمعدل إنتاجية أعلى. أيضًا ، هناك مقايضة خطية بين زمن الوصول وحجم الدُفعة. لذلك ، إذا كان التطبيق مرتبطًا بوقت الاستجابة ، فيمكننا استخدام زمن انتقال P95 مقابل حجم الدُفعة لتحديد الحجم الأمثل للدُفعة. ومع ذلك ، إذا كان الهدف هو زيادة الإنتاجية إلى أقصى حد عند أدنى زمن انتقال ، فمن الأفضل تحديد حجم الدُفعة المقابل "للركبة" بين القسمين الصاعد والمقارب ، لأن أي زيادة أخرى في حجم الدُفعة ستؤدي إلى نفس الإنتاجية عند أسوأ كمون. لتحقيق أفضل نسبة أداء للسعر ، واستهداف إنتاجية أعلى بأقل زمن انتقال ، فمن الأفضل لك التوسع الأفقي لهذا النطاق الأمثل من خلال خوادم الاستدلال المتعددة بدلاً من مجرد زيادة حجم الدُفعة.

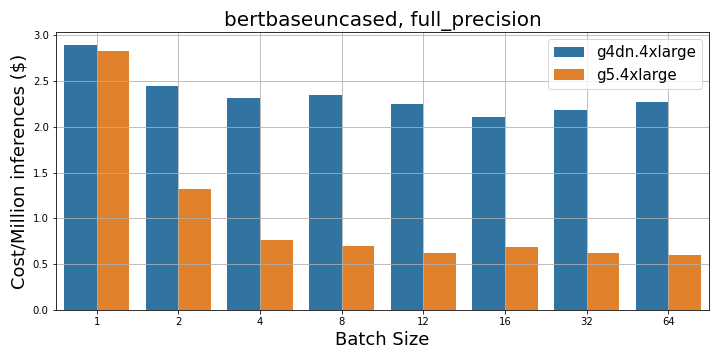

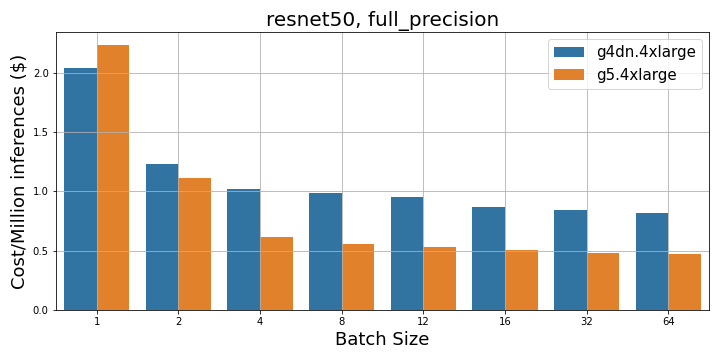

التكلفة مقابل حجم الدفعة

في هذا القسم ، نقدم النتائج المقارنة لتكاليف الاستدلال (دولار لكل مليون استدلالات) مقابل حجم الدُفعة. من الشكل التالي ، يمكننا أن نلاحظ بوضوح أن التكلفة (تقاس بالدولار لكل مليون استدلال) تكون أقل باستمرار مع G5 مقابل G4dn على حد سواء (الدقة الكاملة ونصف الدقة).

|

|

يلخص الجدول التالي مقارنات الإنتاجية ووقت الاستجابة والتكلفة (بالدولار لكل مليون استدلال) لنماذج BERT و RESNET50 عبر كلا وضعي الدقة لأحجام الدُفعات المحددة. على الرغم من التكلفة المرتفعة لكل مثيل ، فإن G5 يتفوق باستمرار على G4dn في جميع جوانب زمن انتقال الاستدلال والإنتاجية والتكلفة (بالدولار لكل مليون استدلال) ، لجميع أحجام الدُفعات. الجمع بين المقاييس المختلفة في تكلفة (دولار لكل مليون استدلالات) ، نموذج BERT (حجم 32 دفعة ، دقة كاملة) مع G5 هو 3.7 مرة أكثر ملاءمة من G4dn ، ومع نموذج ResNet50 (حجم دفعة 32 ، دقة كاملة) ، فهو 1.6 مرات أكثر ملاءمة من G4dn.

| الموديل | حجم الدفعة | دقة |

الإنتاجية (حجم الدفعة X الطلبات / ثانية) |

زمن الانتقال (بالميلي ثانية) |

مليون دولار الاستدلالات (عند الطلب) |

التكاليف والفوائد (G5 عبر G4dn) |

|||

| . | . | . | G5 | G4dn | G5 | G4dn | G5 | G4dn | |

| قاعدة بيرت غير مسجلة | 32 | طويل | 723 | 154 | 44 | 208 | $0.6 | $2.2 | 3.7X |

| خليط | 870 | 410 | 37 | 79 | $0.5 | $0.8 | 1.6X | ||

| 16 | طويل | 651 | 158 | 25 | 102 | $0.7 | $2.1 | 3.0X | |

| خليط | 762 | 376 | 21 | 43 | $0.6 | $0.9 | 1.5X | ||

| 8 | طويل | 642 | 142 | 13 | 57 | $0.7 | $2.3 | 3.3X | |

| خليط | 681 | 350 | 12 | 23 | $0.7 | $1.0 | 1.4X | ||

| . | 1 | طويل | 160 | 116 | 6 | 9 | $2.8 | $2.9 | 1.0X |

| خليط | 137 | 102 | 7 | 10 | $3.3 | $3.3 | 1.0X | ||

| ريسنت 50 | 32 | طويل | 941 | 397 | 34 | 82 | $0.5 | $0.8 | 1.6X |

| خليط | 1533 | 851 | 21 | 38 | $0.3 | $0.4 | 1.3X | ||

| 16 | طويل | 888 | 384 | 18 | 42 | $0.5 | $0.9 | 1.8X | |

| خليط | 1474 | 819 | 11 | 20 | $0.3 | $0.4 | 1.3X | ||

| 8 | طويل | 805 | 340 | 10 | 24 | $0.6 | $1.0 | 1.7X | |

| خليط | 1419 | 772 | 6 | 10 | $0.3 | $0.4 | 1.3X | ||

| . | 1 | طويل | 202 | 164 | 5 | 6 | $2.2 | $2 | 0.9X |

| خليط | 196 | 180 | 5 | 6 | $2.3 | $1.9 | 0.8X | ||

معايير الاستدلال الإضافية

بالإضافة إلى قاعدة BERT ونتائج ResNet50 في الأقسام السابقة ، نقدم نتائج قياس أداء إضافية لنماذج NLP و CV كبيرة أخرى شائعة الاستخدام في PyTorch. تم تقديم ميزة أداء G5 عبر G4dn لطرازات BERT الكبيرة بدقة مختلفة ، ونماذج Yolo-v5 بأحجام مختلفة. للحصول على رمز لتكرار المعيار ، ارجع إلى أمثلة على التعلم العميق من NVIDIA لـ Tensor Cores. تُظهر هذه النتائج فائدة استخدام G5 عبر G4dn لمجموعة واسعة من مهام الاستدلال التي تشمل أنواعًا مختلفة من النماذج.

| الموديل | دقة | حجم الدفعة | طول التسلسل | صبيب (إرسال / ثانية) | الصبيب: G4dn | تسريع أكثر من G4dn |

| بيرت كبير | FP16 | 1 | 128 | 93.5 | 40.31 | 2.3 |

| بيرت كبير | FP16 | 4 | 128 | 264.2 | 87.4 | 3.0 |

| بيرت كبير | FP16 | 8 | 128 | 392.1 | 107.5 | 3.6 |

| بيرت كبير | FP32 | 1 | 128 | 68.4 | 22.67 | 3.0 |

| بيرت كبير | 4 | 128 | 118.5 | 32.21 | 3.7 | |

| بيرت كبير | 8 | 128 | 132.4 | 34.67 | 3.8 |

| الموديل | GFLOPS | عدد المعلمات | المعالجة المسبقة (مللي ثانية) | الاستدلال (مللي ثانية) | الاستدلال (عدم الحد الأقصى للقمع) (NMS / الصورة) |

| YOLOv5s | 16.5 | 7.2M | 0.2 | 3.6 | 4.5 |

| YOLov5m | 49.1 | 21M | 0.2 | 6.5 | 4.5 |

| يولوف 5 لتر | 109.3 | 46M | 0.2 | 9.1 | 3.5 |

| YOLov5x | 205.9 | 86M | 0.2 | 14.4 | 1.3 |

وفي الختام

في هذا المنشور ، أظهرنا أنه بالنسبة للاستدلال باستخدام نماذج PyTorch و CV كبيرة ، تعد مثيلات EC2 G5 خيارًا أفضل مقارنة بمثيلات G4dn. على الرغم من أن التكلفة بالساعة عند الطلب لمثيلات G5 أعلى من مثيلات G4dn ، إلا أن أدائها الأعلى يمكن أن يحقق 2-5 أضعاف الإنتاجية بأي دقة لنماذج NLP و CV ، مما يجعل التكلفة لكل مليون استدلال 1.5-3.5 مرة أكثر ملاءمة من مثيلات G4dn. حتى بالنسبة للتطبيقات المرتبطة بزمن الانتقال ، فإن G5 أفضل 2.5 إلى 5 مرات من G4dn لنماذج البرمجة اللغوية العصبية والسيرة الذاتية.

باختصار ، تعد مثيلات AWS G5 اختيارًا ممتازًا لاحتياجاتك الاستدلالية من منظور الأداء والتكلفة لكل استنتاج. توفر لك عالمية إطار عمل CUDA وحجم وعمق مجموعة مثيلات G5 على AWS قدرة فريدة على أداء الاستدلال على نطاق واسع.

عن المؤلفين

أنكور سريفاستافا مهندس حلول في فريق ML Frameworks. يركز على مساعدة العملاء من خلال التدريب والاستدلال الموزع المُدار ذاتيًا على نطاق واسع على AWS. تشمل خبرته الصيانة التنبؤية الصناعية والتوائم الرقمية وتحسين التصميم الاحتمالي وأكمل دراسات الدكتوراه من الهندسة الميكانيكية في جامعة رايس وأبحاث ما بعد الدكتوراه من معهد ماساتشوستس للتكنولوجيا.

أنكور سريفاستافا مهندس حلول في فريق ML Frameworks. يركز على مساعدة العملاء من خلال التدريب والاستدلال الموزع المُدار ذاتيًا على نطاق واسع على AWS. تشمل خبرته الصيانة التنبؤية الصناعية والتوائم الرقمية وتحسين التصميم الاحتمالي وأكمل دراسات الدكتوراه من الهندسة الميكانيكية في جامعة رايس وأبحاث ما بعد الدكتوراه من معهد ماساتشوستس للتكنولوجيا.

سوندار رانجاناثان هو رئيس تطوير الأعمال ، ML Frameworks في فريق Amazon EC2. يركز على أعباء عمل ML على نطاق واسع عبر خدمات AWS مثل Amazon EKS و Amazon ECS و Elastic Fabric Adapter و AWS Batch و Amazon SageMaker. تشمل خبرته الأدوار القيادية في إدارة المنتجات وتطوير المنتجات في NetApp و Micron Technology و Qualcomm و Mentor Graphics.

سوندار رانجاناثان هو رئيس تطوير الأعمال ، ML Frameworks في فريق Amazon EC2. يركز على أعباء عمل ML على نطاق واسع عبر خدمات AWS مثل Amazon EKS و Amazon ECS و Elastic Fabric Adapter و AWS Batch و Amazon SageMaker. تشمل خبرته الأدوار القيادية في إدارة المنتجات وتطوير المنتجات في NetApp و Micron Technology و Qualcomm و Mentor Graphics.

ماهاديفان بالاسوبرامانيام هو مهندس حلول رئيسي للحوسبة الذاتية مع ما يقرب من 20 عامًا من الخبرة في مجال التعلم العميق المليء بالفيزياء ، وبناء ونشر التوائم الرقمية للأنظمة الصناعية على نطاق واسع. حصل مهاديفان على درجة الدكتوراه في الهندسة الميكانيكية من معهد ماساتشوستس للتكنولوجيا ولديه أكثر من 25 براءة اختراع ومنشورًا لحسابه.

ماهاديفان بالاسوبرامانيام هو مهندس حلول رئيسي للحوسبة الذاتية مع ما يقرب من 20 عامًا من الخبرة في مجال التعلم العميق المليء بالفيزياء ، وبناء ونشر التوائم الرقمية للأنظمة الصناعية على نطاق واسع. حصل مهاديفان على درجة الدكتوراه في الهندسة الميكانيكية من معهد ماساتشوستس للتكنولوجيا ولديه أكثر من 25 براءة اختراع ومنشورًا لحسابه.

عمرو رجب هو مهندس حلول رئيسي لمنصات EC2 Accelerated for AWS ، وهو مكرس لمساعدة العملاء على تشغيل أعباء العمل الحسابية على نطاق واسع. في أوقات فراغه ، يحب السفر وإيجاد طرق جديدة لدمج التكنولوجيا في الحياة اليومية.

عمرو رجب هو مهندس حلول رئيسي لمنصات EC2 Accelerated for AWS ، وهو مكرس لمساعدة العملاء على تشغيل أعباء العمل الحسابية على نطاق واسع. في أوقات فراغه ، يحب السفر وإيجاد طرق جديدة لدمج التكنولوجيا في الحياة اليومية.

- متقدم (300،XNUMX)

- AI

- ai الفن

- مولد الفن ai

- الروبوت ai

- Amazon EC2

- الذكاء الاصطناعي

- شهادة الذكاء الاصطناعي

- الذكاء الاصطناعي في البنوك

- روبوت ذكاء اصطناعي

- روبوتات الذكاء الاصطناعي

- برنامج ذكاء اصطناعي

- التعلم الآلي من AWS

- سلسلة كتلة

- مؤتمر blockchain ai

- عملة عبقرية

- الذكاء الاصطناعي للمحادثة

- مؤتمر التشفير ai

- دال

- التعلم العميق

- google ai

- آلة التعلم

- أفلاطون

- أفلاطون ع

- الذكاء افلاطون البيانات

- لعبة أفلاطون

- أفلاطون داتا

- بلاتوغمينغ

- مقياس ai

- بناء الجملة

- زفيرنت