غالبًا ما يتعين على المؤسسات عبر الصناعات مثل التجزئة والبنوك والتمويل والرعاية الصحية والتصنيع والإقراض التعامل مع كميات هائلة من المستندات النصية غير المهيكلة القادمة من مصادر مختلفة ، مثل الأخبار والمدونات ومراجعات المنتجات وقنوات دعم العملاء ووسائل التواصل الاجتماعي. تحتوي هذه المستندات على معلومات مهمة تعتبر أساسية لاتخاذ قرارات العمل المهمة. مع نمو المنظمة ، يصبح من الصعب استخراج المعلومات الهامة من هذه الوثائق. مع تقدم تقنيات معالجة اللغة الطبيعية (NLP) والتعلم الآلي (ML) ، يمكننا الكشف عن رؤى واتصالات قيمة من هذه المستندات النصية بسرعة وبدقة عالية ، وبالتالي مساعدة الشركات على اتخاذ قرارات أعمال عالية الجودة في الوقت المحدد. كما أدت خدمات البرمجة اللغوية العصبية المدارة بالكامل إلى تسريع اعتماد البرمجة اللغوية العصبية. فهم الأمازون هي خدمة مُدارة بالكامل تمكنك من إنشاء نماذج NLP مخصصة خاصة بمتطلباتك ، دون الحاجة إلى أي خبرة في تعلم الآلة.

في هذا المنشور ، نوضح كيفية استخدام أحدث تقنيات تعلم الآلة لحل خمس مهام مختلفة في البرمجة اللغوية العصبية: تلخيص المستندات ، وتصنيف النص ، والإجابة على الأسئلة ، والتعرف على الكيانات المسماة ، واستخراج العلاقة. لكل مهمة من مهام البرمجة اللغوية العصبية هذه ، نوضح كيفية استخدامها الأمازون SageMaker للقيام بالإجراءات التالية:

- نشر وتشغيل الاستدلال على نموذج مدرب مسبقًا

- اضبط النموذج المدرَّب مسبقًا على مجموعة بيانات مخصصة جديدة

- زيادة تحسين أداء الضبط الدقيق باستخدام SageMaker ضبط النموذج التلقائي

- قم بتقييم أداء النموذج على بيانات اختبار الانتظار بمقاييس تقييم مختلفة

على الرغم من أننا نغطي خمس مهام محددة في البرمجة اللغوية العصبية في هذا المنشور ، يمكنك استخدام هذا الحل كقالب لتعميم الضبط الدقيق للنماذج المدربة مسبقًا باستخدام مجموعة البيانات الخاصة بك ، ثم تشغيل تحسين المعلمة الفائقة لاحقًا لتحسين الدقة.

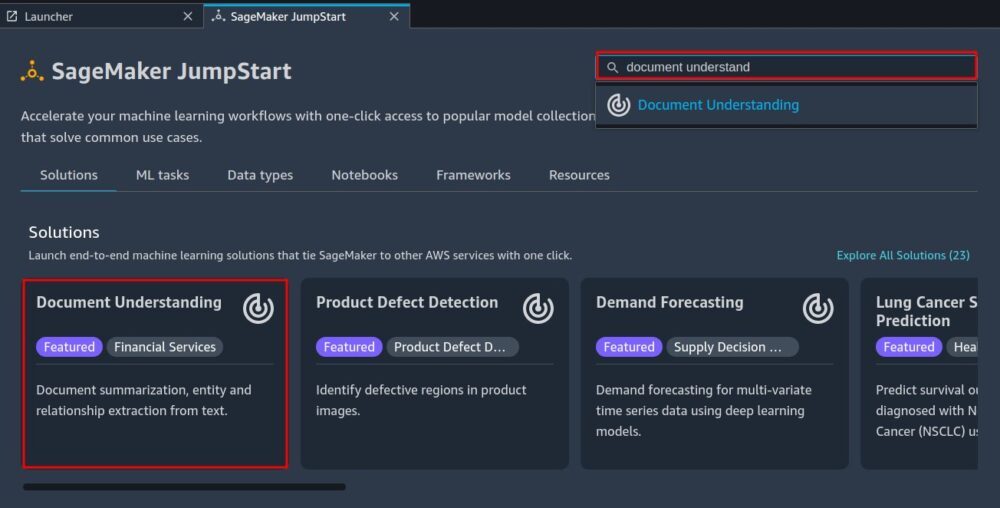

قوالب حل JumpStart

أمازون سيج ميكر جومب ستارت يوفر حلولاً شاملة بنقرة واحدة للعديد من حالات استخدام ML الشائعة. استكشف حالات الاستخدام التالية لمزيد من المعلومات حول قوالب الحلول المتوفرة:

تغطي قوالب حل JumpStart مجموعة متنوعة من حالات الاستخدام ، حيث يتم تقديم العديد من قوالب الحلول المختلفة في ظل كل منها (يوجد حل فهم المستند هذا ضمن حالة استخدام "استخراج البيانات من المستندات وتحليلها").

اختر قالب الحل الأنسب لحالة الاستخدام من صفحة JumpStart المقصودة. لمزيد من المعلومات حول حلول محددة لكل حالة استخدام وكيفية تشغيل حل JumpStart ، راجع قوالب الحل.

حل نظرة عامة

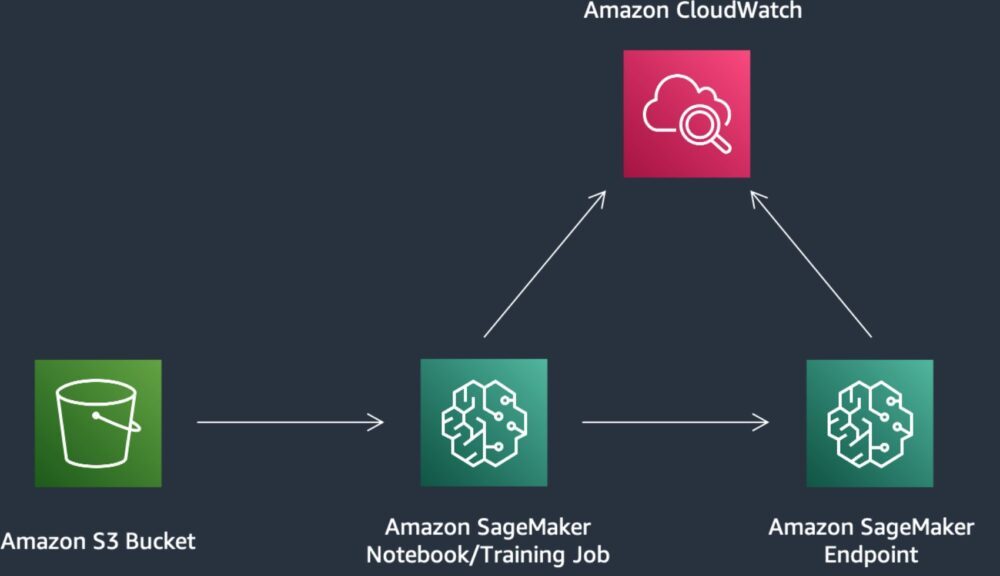

توضح الصورة التالية كيف يمكنك استخدام هذا الحل مع مكونات SageMaker. تُستخدم وظائف تدريب SageMaker لتدريب نماذج البرمجة اللغوية العصبية المختلفة ، ويتم استخدام نقاط نهاية SageMaker لنشر النماذج في كل مرحلة. نحن نستخدم خدمة تخزين أمازون البسيطة (Amazon S3) جنبًا إلى جنب مع SageMaker لتخزين بيانات التدريب ومصنوعات النماذج ، و الأمازون CloudWatch لتسجيل مخرجات التدريب ونقطة النهاية.

افتح حل "فهم المستند"

انتقل إلى حل "فهم المستند" في JumpStart.

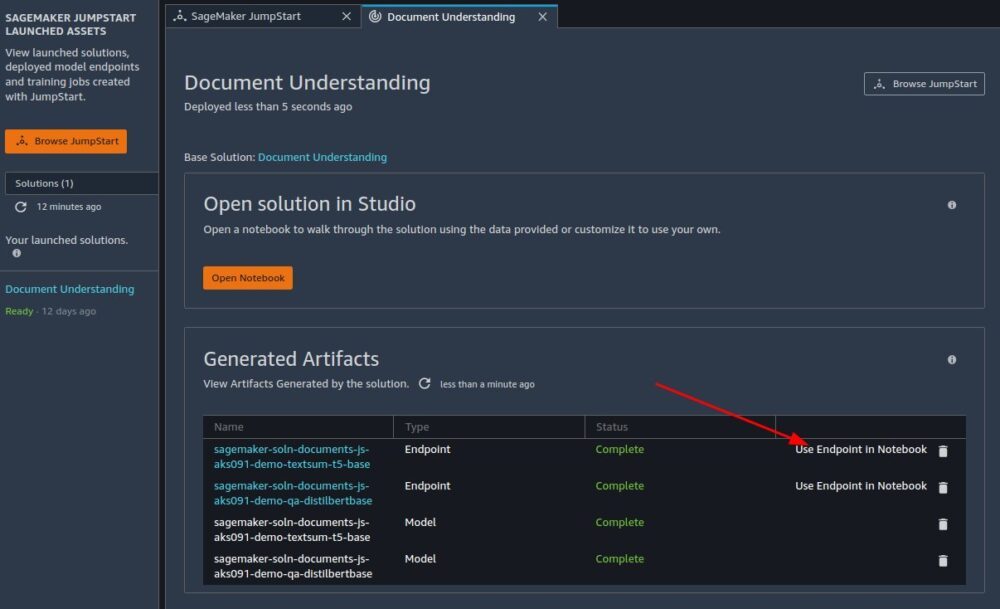

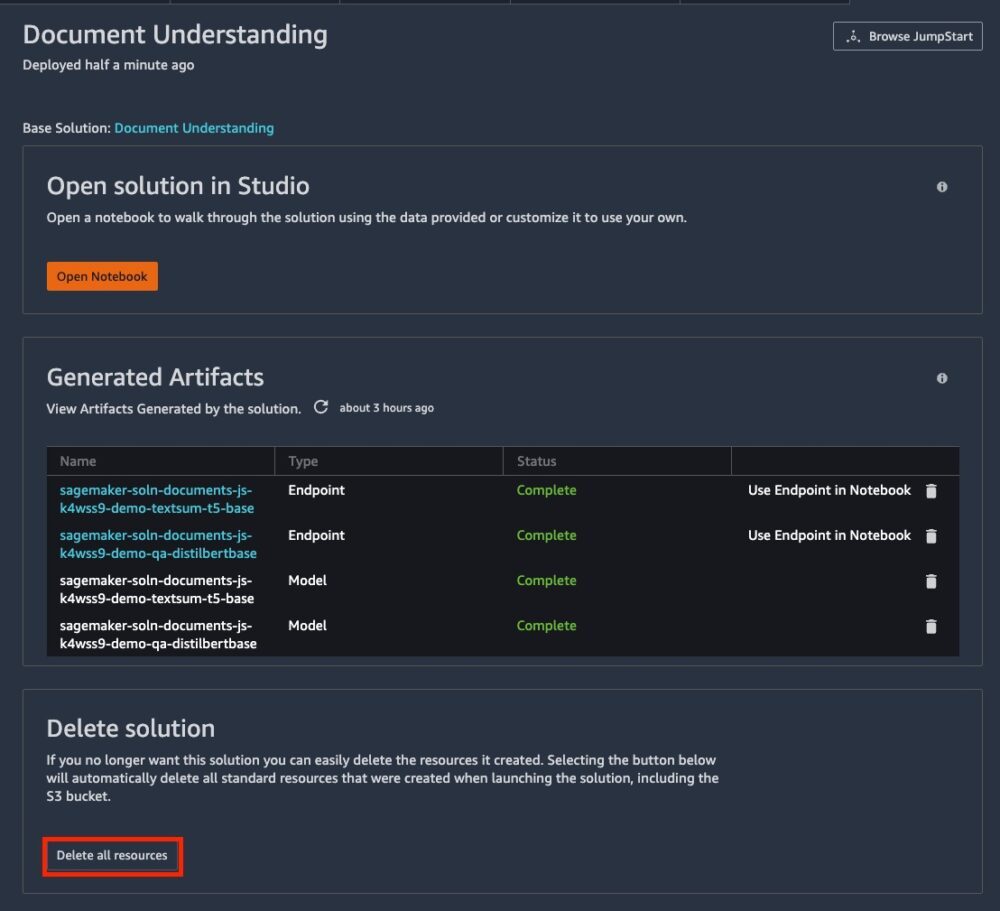

يمكننا الآن إلقاء نظرة فاحصة على بعض الأصول المضمنة في هذا الحل ، بدءًا من الكمبيوتر الدفتري التجريبي.

دفتر تجريبي

يمكنك استخدام دفتر الملاحظات التجريبي لإرسال بيانات نموذجية إلى نقاط نهاية النماذج التي تم نشرها بالفعل لتلخيص المستند ومهام الإجابة على الأسئلة. يسمح لك الكمبيوتر الدفتري التجريبي بسرعة بالحصول على خبرة عملية من خلال الاستعلام عن بيانات المثال.

بعد تشغيل حل "فهم المستند" ، افتح دفتر الملاحظات التجريبي بالاختيار استخدم نقطة النهاية في دفتر الملاحظات.

دعنا نتعمق أكثر في كل من أجهزة الكمبيوتر المحمولة الخمسة الرئيسية لهذا الحل.

المتطلبات الأساسية المسبقة

In أمازون ساجميكر ستوديو، تأكد من أنك تستخدم ملف PyTorch 1.10 Python 3.8 CPU Optimized image / kernel لفتح دفاتر الملاحظات. يستخدم التدريب خمس مثيلات ml.g4dn.2xlarge ، لذلك يجب رفع ملف طلب زيادة حد الخدمة إذا كان حسابك يتطلب حدودًا متزايدة لهذا النوع.

تصنيف النص

يشير تصنيف النص إلى تصنيف جملة إدخال إلى إحدى تسميات الفصل لمجموعة بيانات التدريب. يوضح هذا الكمبيوتر الدفتري كيفية استخدام واجهة برمجة تطبيقات JumpStart لتصنيف النص.

نشر وتشغيل الاستدلال على النموذج المدرب مسبقًا

نموذج تصنيف النص الذي اخترناه لاستخدامه مبني على تضمين النص (tensorflow-tc-bert-en-uncased-L-12-H-768-A-12-2) نموذج من محور TensorFlow، والتي تم تدريبها مسبقًا على مجموعات بيانات Wikipedia و BookCorpus.

يتم إنشاء النموذج المتاح للنشر عن طريق إرفاق طبقة تصنيف ثنائية بإخراج نموذج تضمين النص ، ثم ضبط النموذج بالكامل على SST-2 مجموعة البيانات ، والتي تتكون من مراجعات الأفلام الإيجابية والسلبية.

لتشغيل الاستدلال على هذا النموذج ، نحتاج أولاً إلى تنزيل حاوية الاستدلال (deploy_image_uri) ، نص الاستدلال (deploy_source_uri) ، ونموذج مدرب مسبقًا (base_model_uri). ثم نقوم بتمريرها كمعلمات لإنشاء مثيل لكائن نموذج SageMaker ، والذي يمكننا بعد ذلك نشره:

يوضح الكود التالي ردودنا:

اضبط النموذج المدرَّب مسبقًا على مجموعة بيانات مخصصة

لقد مررنا للتو من خلال تشغيل الاستدلال على نموذج BERT مدرب مسبقًا ، والذي تم ضبطه بدقة على SST-2 مجموعة البيانات.

بعد ذلك ، نناقش كيفية ضبط نموذج على مجموعة بيانات مخصصة بأي عدد من الفئات. لا تزال مجموعة البيانات التي نستخدمها للضبط الدقيق هي SST-2 مجموعة البيانات. يمكنك استبدال مجموعة البيانات هذه بأي مجموعة بيانات تهتم بها.

نسترجع حاوية Docker التدريبية ومصدر خوارزمية التدريب ونموذج مدرب مسبقًا:

بالنسبة للمعلمات التشعبية الخاصة بالخوارزمية ، نبدأ بجلب قاموس Python لمعلمات التدريب التشعبية التي تقبلها الخوارزمية بقيمها الافتراضية. يمكنك تجاوزها بقيم مخصصة ، كما هو موضح في الكود التالي:

مجموعة البيانات (SST-2) إلى مجموعات التدريب والتحقق والاختبار ، حيث يتم استخدام مجموعة التدريب لتناسب النموذج ، ويتم استخدام مجموعة التحقق من الصحة لحساب مقاييس التقييم التي يمكن استخدامها لـ HPO ، ويتم استخدام مجموعة الاختبار كبيانات الانتظار لتقييم أداء النموذج. بعد ذلك ، يتم تحميل مجموعة بيانات القطار والتحقق من الصحة إلى Amazon S3 واستخدامها لبدء مهمة التدريب على الضبط الدقيق:

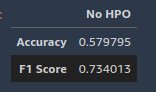

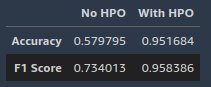

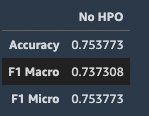

بعد اكتمال مهمة الضبط الدقيق ، ننشر النموذج ، ونجري الاستدلال على مجموعة بيانات اختبار الانتظار ، ونحسب مقاييس التقييم. نظرًا لأنها مهمة تصنيف ثنائي ، فإننا نستخدم الامتداد درجة الدقة و نتيجة F1 كمقاييس التقييم. تشير القيمة الأكبر إلى الأداء الأفضل. تظهر لقطة الشاشة التالية نتائجنا.

يمكنك زيادة تحسين أداء الضبط الدقيق باستخدام الضبط التلقائي للنموذج SageMaker

في هذه الخطوة ، نوضح كيف يمكنك تحسين أداء النموذج بشكل أكبر من خلال ضبط النموذج باستخدام الضبط التلقائي للنموذج SageMaker. يعثر ضبط النموذج التلقائي ، المعروف أيضًا باسم تحسين المعلمات الفائقة (HPO) ، على أفضل إصدار من النموذج عن طريق تشغيل مهام تدريب متعددة على مجموعة البيانات الخاصة بك مع مجموعة من المعلمات الفائقة التي تحددها. ثم يختار قيم المعلمة التشعبية التي ينتج عنها نموذج يحقق أفضل أداء ، كما تم قياسه بواسطة مقياس تختاره ، في مجموعة بيانات التحقق من الصحة.

أولاً ، حددنا الهدف على أنه درجة الدقة في بيانات التحقق من الصحة (val_accuracy) والمقاييس المحددة لوظيفة الضبط من خلال تحديد اسم المقياس الموضوعي والتعبير العادي (regex). يتم استخدام التعبير العادي لمطابقة مخرجات سجل الخوارزمية والتقاط القيم الرقمية للمقاييس. بعد ذلك ، نحدد نطاقات المعلمات التشعبية لتحديد أفضل قيم المعلمات التشعبية منها. حددنا العدد الإجمالي لوظائف الضبط بستة وظائف ووزعناها على ثلاث وظائف مختلفة الأمازون الحوسبة المرنة السحابية مثيلات (Amazon EC2) لتشغيل وظائف الضبط المتوازي. انظر الكود التالي:

نقوم بتمرير هذه القيم لإنشاء مثيل لكائن SageMaker Estimator ، على غرار ما فعلناه في خطوة الضبط السابقة. بدلاً من استدعاء fit وظيفة من Estimator كائن ، نمرر Estimator الكائن في كمعامل لـ HyperparameterTuner منشئ واستدعاء fit وظيفة منه لإطلاق وظائف التوليف:

بعد اكتمال وظائف الضبط ، ننشر النموذج الذي يعطي أفضل نتيجة قياس تقييم على مجموعة بيانات التحقق من الصحة ، ونقوم بالاستدلال على نفس مجموعة بيانات الاختبار التي أجريناها في القسم السابق ، ونحسب مقاييس التقييم.

تظهر النتائج أن النموذج المحدد عن طريق الضبط التلقائي للنموذج يتفوق بشكل كبير على النموذج الذي تم ضبطه في القسم السابق في مجموعة بيانات اختبار الانتظار.

التعرف على الكيان المسمى

التعرف على الكيان المسمى (NER) هو عملية الكشف عن الكيانات المسماة وتصنيفها إلى فئات محددة مسبقًا ، مثل أسماء الأشخاص والمؤسسات والمواقع والكميات. هناك العديد من حالات الاستخدام الواقعية لـ NER ، مثل محركات التوصية ، وتصنيف وتعيين تذاكر دعم العملاء إلى القسم الصحيح ، واستخراج المعلومات الأساسية من تقارير المرضى في الرعاية الصحية ، وتصنيف المحتوى من الأخبار والمدونات.

نشر وتشغيل الاستدلال على النموذج المدرب مسبقًا

ننشر En_core_web_md نموذج من سبا مكتبة. spaCy هي مكتبة البرمجة اللغوية العصبية مفتوحة المصدر التي يمكن استخدامها في مهام مختلفة ، ولديها طرق مضمنة لـ NER. نستخدم حاوية AWS PyTorch Deep Learning Container (DLC) مع وضع البرنامج النصي ونقوم بتثبيت مكتبة spaCy كاعتماد أعلى الحاوية.

بعد ذلك ، توجد نقطة دخول للبرنامج النصي (وسيطة entry_point.py) ، الذي يحتوي على جميع الكود المطلوب تنزيله وتحميله En_core_web_md نموذج وتنفيذ الاستدلال على البيانات التي يتم إرسالها إلى نقطة النهاية. أخيرًا ، ما زلنا بحاجة إلى تقديم model_data كنموذج تم تدريبه مسبقًا للاستدلال. لأن المدربين مسبقا En_core_web_md يتم تنزيل النموذج سريعًا ، والذي تم تحديده في البرنامج النصي للإدخال ، نقدم ملف أرشيف فارغًا. بعد نشر نقطة النهاية ، يمكنك استدعاء نقطة النهاية مباشرة من دفتر الملاحظات باستخدام SageMaker Python SDK Predictor. انظر الكود التالي:

بيانات الإدخال للنموذج هي مستند نصي. يستخرج نموذج الكيان المسمى أجزاء الأسماء والكيانات المسماة في المستند النصي ويصنفها في عدد من الأنواع المختلفة (مثل الأشخاص والأماكن والمؤسسات). يظهر المثال المدخلات والمخرجات في الكود التالي. ال start_char تشير المعلمة إلى إزاحة الحرف لبداية الامتداد ، و end_char يشير إلى نهاية الفترة.

اضبط النموذج المدرَّب مسبقًا على مجموعة بيانات مخصصة

في هذه الخطوة ، نوضح كيفية ضبط نماذج اللغة المدربة مسبقًا لـ NER على مجموعة البيانات الخاصة بك. تعمل خطوة الضبط الدقيق على تحديث معلمات النموذج لالتقاط خصائص بياناتك وتحسين الدقة. نحن نستخدم ال ويكي (PAN-X) لضبط ملف DistilBERT-قاعدة غير مغطاة نموذج محول من Hugging Face.

يتم تقسيم مجموعة البيانات إلى مجموعات التدريب والتحقق والاختبار.

بعد ذلك ، نحدد المعلمات الفائقة للنموذج ، ونستخدم AWS Hugging Face DLC مع وضع البرنامج النصي (وسيطة entry_point) لتشغيل وظيفة الضبط:

بعد اكتمال مهمة الضبط الدقيق ، نقوم بنشر نقطة نهاية والاستعلام عن هذه النقطة النهائية باستخدام بيانات اختبار الانتظار. للاستعلام عن نقطة النهاية ، يجب ترميز كل سلسلة نصية في رمز واحد أو عدة رموز وإرسالها إلى نموذج المحول. يحصل كل رمز مميز على علامة كيان مسماة متوقعة. نظرًا لأنه يمكن تحويل كل سلسلة نصية إلى رمز مميز واحد أو عدة رموز ، فنحن بحاجة إلى تكرار علامة الكيان المسماة بالحقيقة الأساسية للسلسلة إلى جميع الرموز المميزة المرتبطة بها. يرشدك دفتر الملاحظات المقدم عبر الخطوات لتحقيق ذلك.

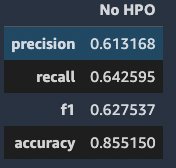

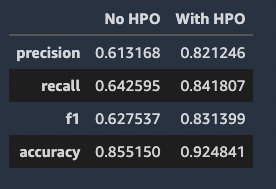

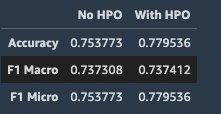

أخيرًا ، نستخدم مقاييس التقييم المضمنة في Hugging Face تسلسل لحساب درجات التقييم على بيانات اختبار الانتظار. مقاييس التقييم المستخدمة هي الدقة الشاملة ، والتذكر العام ، وإجمالي F1 ، والدقة. تظهر لقطة الشاشة التالية نتائجنا.

يمكنك زيادة تحسين أداء الضبط الدقيق باستخدام الضبط التلقائي للنموذج SageMaker

على غرار تصنيف النص ، نوضح كيف يمكنك زيادة تحسين أداء النموذج من خلال ضبط النموذج باستخدام الضبط التلقائي للنموذج SageMaker. لتشغيل وظيفة الضبط ، نحتاج إلى تحديد مقياس موضوعي نريد استخدامه لتقييم أداء النموذج في مجموعة بيانات التحقق (درجة F1 في هذه الحالة) ، ونطاقات المعلمات الفائقة لتحديد أفضل قيم المعلمات الفائقة من ، بالإضافة إلى ضبط تكوينات الوظيفة مثل الحد الأقصى لعدد وظائف التوليف وعدد الوظائف المتوازية التي سيتم إطلاقها في كل مرة:

بعد اكتمال وظائف الضبط ، ننشر النموذج الذي يعطي أفضل نتيجة قياس تقييم على مجموعة بيانات التحقق من الصحة ، ونقوم بالاستدلال على نفس مجموعة بيانات الاختبار التي أجريناها في القسم السابق ، ونحسب مقاييس التقييم.

يمكننا أن نرى أن النموذج مع HPO يحقق أداءً أفضل بشكل ملحوظ عبر جميع المقاييس.

الإجابة على السؤال

تعد الإجابة عن الأسئلة مفيدة عندما تريد الاستعلام عن قدر كبير من النص للحصول على معلومات محددة. يسمح للمستخدم بالتعبير عن سؤال بلغة طبيعية والحصول على إجابة فورية ومختصرة. يمكن استخدام أنظمة الإجابة على الأسئلة التي يتم تشغيلها بواسطة البرمجة اللغوية العصبية في محركات البحث وواجهات المحادثات الهاتفية.

نشر وتشغيل الاستدلال على النموذج المدرب مسبقًا

نموذجنا المدرَّب مسبقًا هو نموذج الإجابة على الأسئلة الاستخراجية (EQA) فريق بيرت كبير غير محدد كلمة كاملة مبني على نموذج محول من Hugging Face. نستخدم AWS PyTorch DLC مع وضع البرنامج النصي ونقوم بتثبيت ملف محولات مكتبة كاعتماد على الجزء العلوي من الحاوية. على غرار مهمة NER ، نقدم ملف أرشيف فارغًا في الوسيطة model_data لأنه يتم تنزيل النموذج الذي تم تدريبه مسبقًا بشكل سريع. بعد نشر نقطة النهاية ، يمكنك استدعاء نقطة النهاية مباشرة من دفتر الملاحظات باستخدام SageMaker Python SDK Predictor. انظر الكود التالي:

كل ما نحتاجه هو إنشاء كائن قاموس بمفتاحين. context هو النص الذي نرغب في استرجاع المعلومات منه. question هو استعلام اللغة الطبيعية الذي يحدد المعلومات التي نهتم باستخراجها. نحن نتصل predict على متنبئنا ، ويجب أن نحصل على استجابة من نقطة النهاية تحتوي على الإجابات الأكثر احتمالاً:

لدينا الرد ، ويمكننا طباعة الإجابات الأكثر احتمالاً التي تم استخلاصها من النص السابق. كل إجابة لها درجة ثقة تستخدم للترتيب (ولكن لا ينبغي تفسير هذه النتيجة على أنها احتمال حقيقي). بالإضافة إلى الإجابة الحرفية ، يمكنك أيضًا الحصول على فهارس أحرف البداية والنهاية للإجابة من السياق الأصلي:

نقوم الآن بضبط هذا النموذج باستخدام مجموعة البيانات المخصصة الخاصة بنا للحصول على نتائج أفضل.

اضبط النموذج المدرَّب مسبقًا على مجموعة بيانات مخصصة

في هذه الخطوة ، نوضح كيفية ضبط نماذج اللغة المدربة مسبقًا لـ EQA على مجموعة البيانات الخاصة بك. تعمل خطوة الضبط الدقيق على تحديث معلمات النموذج لالتقاط خصائص بياناتك وتحسين الدقة. نحن نستخدم ال SQuAD2.0 مجموعة بيانات لضبط نموذج تضمين النص بيرت قاعدة غير مسجلة من تعانق الوجه. يُلحق النموذج المتاح للضبط الدقيق طبقة استخراج إجابات بنموذج دمج النص ويهيئ معلمات الطبقة إلى قيم عشوائية. تعمل خطوة الضبط الدقيق على ضبط جميع معلمات النموذج لتقليل خطأ التنبؤ في بيانات الإدخال وإرجاع النموذج الدقيق.

على غرار مهمة تصنيف النص ، يتم تقسيم مجموعة البيانات (SQuAD2.0) إلى مجموعة تدريب وتحقق واختبار.

بعد ذلك ، نحدد المعلمات الفائقة للنموذج ، ونستخدم واجهة برمجة تطبيقات JumpStart لبدء مهمة الضبط:

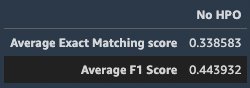

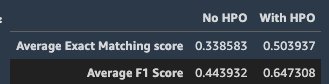

بعد اكتمال مهمة الضبط الدقيق ، ننشر النموذج ، ونجري الاستدلال على مجموعة بيانات اختبار الانتظار ، ونحسب مقاييس التقييم. مقاييس التقييم المستخدمة هي متوسط درجة المطابقة الدقيقة ومتوسط درجة F1. تظهر لقطة الشاشة التالية النتائج.

يمكنك زيادة تحسين أداء الضبط الدقيق باستخدام الضبط التلقائي للنموذج SageMaker

على غرار الأقسام السابقة ، نستخدم ملف HyperparameterTuner كائن لإطلاق وظائف الضبط:

بعد اكتمال وظائف الضبط ، ننشر النموذج الذي يعطي أفضل نتيجة قياس تقييم على مجموعة بيانات التحقق من الصحة ، ونقوم بالاستدلال على نفس مجموعة بيانات الاختبار التي أجريناها في القسم السابق ، ونحسب مقاييس التقييم.

يمكننا أن نرى أن النموذج المزود بـ HPO يُظهر أداءً أفضل بشكل ملحوظ في بيانات اختبار الانتظار.

استخراج العلاقة

استخراج العلاقات هو مهمة استخراج العلاقات الدلالية من النص ، والتي تحدث عادة بين كيانين أو أكثر. يلعب استخراج العلاقات دورًا مهمًا في استخراج المعلومات المنظمة من مصادر غير منظمة مثل النص الخام. في هذا دفتر الملاحظات ، نعرض حالتين من حالات الاستخدام لاستخراج العلاقة.

اضبط النموذج المدرَّب مسبقًا على مجموعة بيانات مخصصة

نستخدم نموذج استخراج علاقة مبني على أ BERT- قاعدة- غير محددة نموذج باستخدام محولات من تعانق محولات الوجه مكتبة. يُلحق نموذج الضبط الدقيق طبقة تصنيف خطية تأخذ زوجًا من التضمينات الرمزية التي يتم إخراجها بواسطة نموذج دمج النص وتهيئة معلمات الطبقة إلى قيم عشوائية. تعمل خطوة الضبط الدقيق على ضبط جميع معلمات النموذج لتقليل خطأ التنبؤ في بيانات الإدخال وإرجاع النموذج الدقيق.

مجموعة البيانات التي قمنا بضبط النموذج هي مهمة SemEval-2010 8. يمكن نشر النموذج الذي تم إرجاعه عن طريق الضبط الدقيق للاستدلال.

تحتوي مجموعة البيانات على مجموعات التدريب والتحقق والاختبار.

نستخدم AWS PyTorch DLC مع وضع البرنامج النصي من SageMaker Python SDK ، حيث transformers تم تثبيت مكتبة على أنها تبعية أعلى الحاوية. نحدد SageMaker PyTorch مقدر ومجموعة من المعلمات الفائقة مثل النموذج المدرب مسبقًا ومعدل التعلم وأرقام الحقبة لإجراء الضبط الدقيق. يتم تعريف رمز الضبط الدقيق لنموذج استخراج العلاقة في ملف entry_point.py. انظر الكود التالي:

يمكنك زيادة تحسين أداء الضبط الدقيق باستخدام الضبط التلقائي للنموذج SageMaker

على غرار الأقسام السابقة ، نستخدم ملف HyperparameterTuner كائن للتفاعل مع واجهات برمجة تطبيقات ضبط المعلمات الفائقة من SageMaker. يمكننا بدء وظيفة ضبط المعامل التشعبي عن طريق استدعاء fit الأسلوب:

عند اكتمال وظيفة ضبط المعلمة الفائقة ، نقوم بالاستدلال ونتحقق من درجة التقييم.

يمكننا أن نرى أن النموذج مع HPO يُظهر أداءً أفضل في بيانات اختبار الانتظار.

تلخيص الوثيقة

تلخيص المستند أو النص هو مهمة تكثيف كميات كبيرة من البيانات النصية في مجموعة فرعية أصغر من الجمل ذات المعنى التي تمثل المعلومات الأكثر أهمية أو ذات الصلة داخل المحتوى الأصلي. يعد تلخيص المستند أسلوبًا مفيدًا لاستخلاص المعلومات المهمة من كميات كبيرة من البيانات النصية إلى بضع جمل. يتم استخدام تلخيص النص في العديد من حالات الاستخدام ، مثل معالجة المستندات واستخراج المعلومات من المدونات والمقالات والأخبار.

يوضح هذا الكمبيوتر الدفتري نشر نموذج تلخيص المستند T5- قاعدة من تعانق محولات الوجه مكتبة. نقوم أيضًا باختبار نقاط النهاية المنشورة باستخدام مقالة نصية وتقييم النتائج باستخدام مقياس التقييم المدمج في Hugging Face ROUGE.

على غرار الإجابة على الأسئلة ودفاتر NER ، نستخدم PyTorchModel من SageMaker Python SDK جنبًا إلى جنب مع ملف entry_point.py البرنامج النصي لتحميل النموذج الأساسي T5 إلى نقطة نهاية HTTPS. بعد نشر نقطة النهاية بنجاح ، يمكننا إرسال مقالة نصية إلى نقطة النهاية للحصول على استجابة تنبؤ:

بعد ذلك ، نقوم بتقييم ومقارنة المقالة النصية ونتائج التلخيص باستخدام مقياس ROUGE. يتم حساب ثلاثة مقاييس للتقييم: rougeN, rougeLو rougeLsum. rougeN يقيس عدد المطابقة n-grams بين النص الناتج عن النموذج (نتيجة التلخيص) و a reference (أدخل نصآ). المقاييس rougeL و rougeLsum قم بقياس أطول سلاسل الكلمات المطابقة من خلال البحث عن السلاسل الفرعية الأكثر شيوعًا في الملخصات المُنشأة والمرجعية. لكل مقياس ، يتم حساب فترات الثقة للدقة ، والاستدعاء ، ودرجة F1. انظر الكود التالي:

تنظيف

يمكن حذف الموارد التي تم إنشاؤها لهذا الحل باستخدام حذف كافة الموارد زر من SageMaker Studio IDE. يوفر كل دفتر ملاحظات أيضًا قسم تنظيف يحتوي على رمز لحذف نقاط النهاية.

وفي الختام

في هذا المنشور ، أوضحنا كيفية الاستفادة من أحدث تقنيات تعلم الآلة لحل خمس مهام مختلفة في البرمجة اللغوية العصبية: تلخيص المستندات ، وتصنيف النص ، والسؤال والإجابة ، والتعرف على الكيانات المسماة ، واستخراج العلاقة باستخدام Jumpstart. ابدأ مع Jumpstart الآن!

حول المؤلف

الدكتور شين هوانغ هو عالم تطبيقي في Amazon SageMaker JumpStart وخوارزميات Amazon SageMaker المدمجة. يركز على تطوير خوارزميات التعلم الآلي القابلة للتطوير. تتركز اهتماماته البحثية في مجال معالجة اللغة الطبيعية ، والتعلم العميق القابل للتفسير على البيانات المجدولة ، والتحليل القوي لتجميع الزمكان غير المعياري. وقد نشر العديد من الأوراق البحثية في ACL و ICDM ومؤتمرات KDD والجمعية الملكية للإحصاء: مجلة Series A.

الدكتور شين هوانغ هو عالم تطبيقي في Amazon SageMaker JumpStart وخوارزميات Amazon SageMaker المدمجة. يركز على تطوير خوارزميات التعلم الآلي القابلة للتطوير. تتركز اهتماماته البحثية في مجال معالجة اللغة الطبيعية ، والتعلم العميق القابل للتفسير على البيانات المجدولة ، والتحليل القوي لتجميع الزمكان غير المعياري. وقد نشر العديد من الأوراق البحثية في ACL و ICDM ومؤتمرات KDD والجمعية الملكية للإحصاء: مجلة Series A.

فيفيك جانجاساني هو كبير مهندسي حلول التعلم الآلي في Amazon Web Services. يساعد الشركات الناشئة في بناء تطبيقات AI / ML وتشغيلها. يركز حاليًا على الجمع بين خلفيته في الحاويات والتعلم الآلي لتقديم حلول بشأن MLOps و ML Inference و ML منخفض الكود. في أوقات فراغه ، يستمتع بتجربة مطاعم جديدة واستكشاف الاتجاهات الناشئة في مجال الذكاء الاصطناعي والتعلم العميق.

فيفيك جانجاساني هو كبير مهندسي حلول التعلم الآلي في Amazon Web Services. يساعد الشركات الناشئة في بناء تطبيقات AI / ML وتشغيلها. يركز حاليًا على الجمع بين خلفيته في الحاويات والتعلم الآلي لتقديم حلول بشأن MLOps و ML Inference و ML منخفض الكود. في أوقات فراغه ، يستمتع بتجربة مطاعم جديدة واستكشاف الاتجاهات الناشئة في مجال الذكاء الاصطناعي والتعلم العميق.

جيريمي كوهين هو مهندس حلول مع AWS حيث يساعد العملاء على بناء حلول متطورة قائمة على السحابة. في أوقات فراغه ، يستمتع بالمشي لمسافات قصيرة على الشاطئ ، واستكشاف منطقة الخليج مع عائلته ، وإصلاح الأشياء حول المنزل ، وكسر الأشياء حول المنزل ، والشواء.

جيريمي كوهين هو مهندس حلول مع AWS حيث يساعد العملاء على بناء حلول متطورة قائمة على السحابة. في أوقات فراغه ، يستمتع بالمشي لمسافات قصيرة على الشاطئ ، واستكشاف منطقة الخليج مع عائلته ، وإصلاح الأشياء حول المنزل ، وكسر الأشياء حول المنزل ، والشواء.

نيلام كوشيا هو مهندس حلول المشاريع في AWS. ينصب تركيزها الحالي على مساعدة عملاء المؤسسة في رحلة تبني السحابة لتحقيق نتائج أعمال استراتيجية في أوقات فراغها ، تستمتع بالقراءة والتواجد في الهواء الطلق.

نيلام كوشيا هو مهندس حلول المشاريع في AWS. ينصب تركيزها الحالي على مساعدة عملاء المؤسسة في رحلة تبني السحابة لتحقيق نتائج أعمال استراتيجية في أوقات فراغها ، تستمتع بالقراءة والتواجد في الهواء الطلق.

- متقدم (300،XNUMX)

- AI

- ai الفن

- مولد الفن ai

- الروبوت ai

- الأمازون SageMaker

- أمازون سيج ميكر جومب ستارت

- الذكاء الاصطناعي

- شهادة الذكاء الاصطناعي

- الذكاء الاصطناعي في البنوك

- روبوت ذكاء اصطناعي

- روبوتات الذكاء الاصطناعي

- برنامج ذكاء اصطناعي

- التعلم الآلي من AWS

- سلسلة كتلة

- مؤتمر blockchain ai

- عملة عبقرية

- الذكاء الاصطناعي للمحادثة

- مؤتمر التشفير ai

- دال

- التعلم العميق

- خبير (400)

- google ai

- آلة التعلم

- أفلاطون

- أفلاطون ع

- الذكاء افلاطون البيانات

- لعبة أفلاطون

- أفلاطون داتا

- بلاتوغمينغ

- مقياس ai

- بناء الجملة

- زفيرنت