مختبر QuOne ، مركز البحوث والابتكار Phanous ، طهران ، إيران

تجد هذه الورقة مثيرة للاهتمام أو ترغب في مناقشة؟ Scite أو ترك تعليق على SciRate.

ملخص

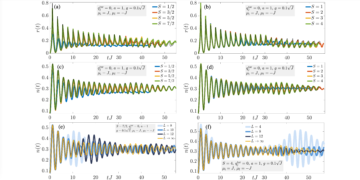

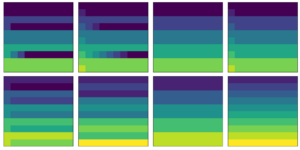

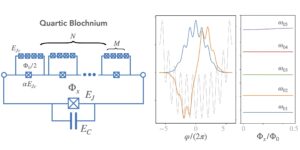

في التدريب على وظائف النموذج ذات المعلمات الزائدة عن طريق النسب المتدرج ، في بعض الأحيان لا تتغير المعلمات بشكل كبير وتظل قريبة من قيمها الأولية. تسمى هذه الظاهرة $ textit {lazy training} $ وهي تحفز النظر في التقريب الخطي لوظيفة النموذج حول المعلمات الأولية. في النظام الكسول ، يحاكي هذا التقريب الخطي سلوك الوظيفة ذات المعلمات التي تحدد النواة المرتبطة بها ، والتي تسمى $ textit {tangent kernel} $ ، أداء التدريب للنموذج. من المعروف أن التدريب الكسول يحدث في حالة الشبكات العصبية (الكلاسيكية) ذات العروض الكبيرة. في هذا البحث ، نوضح أن تدريب الدوائر الكمية ذات المعلمات $ textit {geometrically local} $ يدخل في النظام الكسول لعدد كبير من الكيوبتات. بتعبير أدق ، نثبت حدودًا لمعدل تغيرات المعلمات لدائرة كمومية ذات معلمات محلية هندسية في عملية التدريب ، وعلى دقة التقريب الخطي لوظيفة النموذج الكمومي المصاحب ؛ تميل كلتا الحدين إلى الصفر مع زيادة عدد البتات الكمومية. نحن ندعم نتائجنا التحليلية بمحاكاة عددية.

► بيانات BibTeX

ferences المراجع

[1] جون بريسكيل. الحوسبة الكمية في عصر NISQ وما بعده. الكم ، 2:79 ، 2018. دوى: 10.22331 / q-2018-08-06-79.

https://doi.org/10.22331/q-2018-08-06-79

[2] ماركو سيريزو ، أندرو أراسميث ، رايان بابوش ، سيمون سي بنيامين ، سوجورو إندو ، كيسوكي فوجي ، جارود آر ماكلين ، كوسوكي ميتاراي ، شياو يوان ، لوكاس سينسيو ، وآخرون. خوارزميات الكم المتغيرة. Nature Reviews Physics، 3 (9): 625–644، 2021. doi: 10.1038 / s42254-021-00348-9.

https://doi.org/10.1038/s42254-021-00348-9

[3] جارود آر ماكلين وسيرجيو بويكسو وفاديم ن سميليانسكي وريان بابوش وهارتموت نيفين. الهضاب القاحلة في المناظر الطبيعية للتدريب على الشبكة العصبية الكمومية. اتصالات الطبيعة ، 9 (1): 1–6 ، 2018. doi: 10.1038 / s41467-018-07090-4.

https://doi.org/10.1038/s41467-018-07090-4

[4] سامسون وانج وإنريكو فونتانا وماركو سيريزو وكونال شارما وأكيرا سون ولوكاس سينسيو وباتريك جيه كولز. الهضاب القاحلة الناتجة عن الضوضاء في خوارزميات الكم المتغيرة. اتصالات الطبيعة ، 12 (1): 1-11 ، 2021. دوى: 10.1038 / s41467-021-27045-6.

https://doi.org/10.1038/s41467-021-27045-6

[5] فرانسيس باخ. تحسين بدون مجهود من خلال التدفقات المتدرجة. https: / / francisbach.com/ التدفقات المتدرجة.

https: / / francisbach.com/ التدفقات المتدرجة

[6] آرثر جاكوت وفرانك غابرييل وكليمان هونجلر. نواة الظل العصبية: التقارب والتعميم في الشبكات العصبية. التطورات في أنظمة معالجة المعلومات العصبية (NeurIPS 2018) ، 31: 8571-8580 ، 2018. doi: 10.1145 / 3406325.3465355.

الشبكي: / / doi.org/ 10.1145 / 3406325.3465355

[7] لينيك شيزات وإدوار أويالون وفرانسيس باخ. على التدريب الكسول في البرمجة التفاضلية. التطورات في أنظمة معالجة المعلومات العصبية ، 32 ، 2019.

[8] كوهي ناكاجي وهيرويوكي تيزوكا وناوكي ياماموتو. الشبكات العصبية المحسنة الكم في إطار نواة الظل العصبية. 2021. arXiv: 2109.03786.

أرخايف: 2109.03786

[9] نوريهيتو شيراي وكينجي كوبو وكوسوكي ميتاراي وكيسوكي فوجي. نواة الظل الكم. 2021. arXiv: 2111.02951.

أرخايف: 2111.02951

[10] ماريا شولد وناثان كيلوران. التعلم الآلي الكمي في مساحات هيلبرت المميزة. فيز. القس Lett.، 122: 040504، فبراير 2019. doi: 10.1103 / PhysRevLett.122.040504.

الشبكي: / / doi.org/ 10.1103 / PhysRevLett.122.040504

[11] فويتش هافليسيك ، أنطونيو د. التعلم الخاضع للإشراف مع مساحات الميزات المحسنة الكم. Nature، 567 (7747): 209–212، Mar 2019. doi: 10.1038 / s41586-019-0980-2.

https://doi.org/10.1038/s41586-019-0980-2

[12] جونيو ليو ، وفرانشيسكو تاكينو ، وجنيفر آر جليك ، وليانغ جيانغ ، وأنطونيو ميزاكابو. تعلم التمثيل من خلال حبات الظل العصبية الكمومية. PRX Quantum، 3: 030323، 2022. doi: 10.1103 / PRXQuantum.3.030323.

https: / / doi.org/ 10.1103 / PRXQuantum.3.030323

[13] دي لو وجيمس هالفرسون. الدول الكمومية للشبكة العصبية اللانهائية. 2021. arXiv: 2112.00723.

أرخايف: 2112.00723

[14] جونيو ليو ، وخديجة نجفي ، وكونال شارما ، وفرانشيسكو تاشينو ، وليانغ جيانغ ، وأنطونيو ميزاكابو. نظرية تحليلية لديناميات الشبكات العصبية الكمية الواسعة. فيز. القس Lett.، 130 (15): 150601، 2023. doi: 10.1103 / PhysRevLett.130.150601.

الشبكي: / / doi.org/ 10.1103 / PhysRevLett.130.150601

[15] Junyu Liu و Zexi Lin و Liang Jiang. الكسل والهضبة القاحلة والضوضاء في التعلم الآلي ، 2022. doi: 10.48550 / arXiv.2206.09313.

https: / / doi.org/10.48550 / arXiv.2206.09313

[16] إدوارد فارحي وهارتموت نيفين. التصنيف باستخدام الشبكات العصبية الكمومية على معالجات المدى القريب. 2018. arXiv: 1802.06002.

أرخايف: 1802.06002

[17] سيريزو ، أكيرا سون ، تايلر فولكوف ، لوكاس سينسيو ، وباتريك جيه كولز. تعتمد وظيفة التكلفة على الهضاب القاحلة في الدوائر الكمومية الضحلة ذات البارامترات. اتصالات الطبيعة ، 12 (1): 1791 ، 2021. دوى: 10.1038 / s41467-021-21728-w.

https: / / doi.org/ 10.1038 / s41467-021-21728-ث

[18] Adrián Pérez-Salinas، Alba Cervera-Lierta، Elies Gil-Fuster، and José I. Latorre. إعادة تحميل البيانات لمصنف كمي عالمي. الكم ، 4: 226 ، 2020. doi: 10.22331 / q-2020-02-06-226.

https://doi.org/10.22331/q-2020-02-06-226

[19] ماريا شولد وريان سويكي ويوهانس جاكوب ماير. تأثير ترميز البيانات على القوة التعبيرية لنماذج التعلم الآلي الكمومية. فيز. القس أ ، 103: 032430 ، مارس 2021. دوى: 10.1103 / PhysRevA.103.032430.

الشبكي: / / doi.org/ 10.1103 / PhysRevA.103.032430

[20] كولين مكديرميد. على طريقة الخلافات يحدها. في استطلاعات في التوافقية ، 1989 (نورويتش ، 1989) ، المجلد 141 من لندن ماث. شركة مذكرة محاضرة ، الصفحات 148-188. جامعة كامبريدج. الصحافة ، كامبريدج ، 1989. دوى: 10.1017 / cbo9781107359949.008.

الشبكي: / / doi.org/ 10.1017 / cbo9781107359949.008

[21] فيل بيرغولم ، جوش إيزاك ، ماريا شولد ، كريستيان غوغولين ، إم صهيب علم ، شاهناواز أحمد ، خوان ميغيل أرازولا ، كارستن بلانك ، آلان ديلجادو ، سوران جاهانجيري ، وآخرون. Pennylane: التمايز التلقائي للحسابات الكمومية الهجينة. 2018. arXiv: 1811.04968.

أرخايف: 1811.04968

[22] كيرستين بير ودميترو بوندارينكو وتيري فارلي وتوبياس جيه أوزبورن وروبرت سالزمان ودانييل شيرمان ورامونا وولف. تدريب الشبكات العصبية الكمومية العميقة. اتصالات الطبيعة ، 11 (1): 1–6 ، 2020. doi: 10.1038 / s41467-020-14454-2.

https://doi.org/10.1038/s41467-020-14454-2

دليلنا يستخدم من قبل

[1] Junyu Liu و Zexi Lin و Liang Jiang ، "الكسل وهضبة القاحلة والضوضاء في التعلم الآلي" ، أرخايف: 2206.09313, (2022).

[2] Yuxuan Du و Min-Hsiu Hsieh و Tongliang Liu و Shan You و Dacheng Tao ، "Erratum: Learnability of Quantum Neural Networks [PRX QUANTUM 2، 040337 (2021)]" ، PRX كوانتوم 3 3 ، 030901 (2022).

الاستشهادات المذكورة أعلاه من إعلانات ساو / ناسا (تم آخر تحديث بنجاح 2023-04-27 12:25:17). قد تكون القائمة غير كاملة نظرًا لأن جميع الناشرين لا يقدمون بيانات اقتباس مناسبة وكاملة.

لا يمكن أن تجلب استشهد تبادل البيانات أثناء آخر محاولة 2023-04-27 12:25:15: لا يمكن جلب البيانات المستشهد بها من 10.22331 / q-2023-04-27-989 من Crossref. هذا أمر طبيعي إذا تم تسجيل DOI مؤخرًا.

نشرت هذه الورقة في الكم تحت نسبة المشاع الإبداعي 4.0 الدولية (CC BY 4.0) رخصة. يظل حقوق الطبع والنشر مع مالكي حقوق الطبع والنشر الأصليين مثل المؤلفين أو مؤسساتهم.

- محتوى مدعوم من تحسين محركات البحث وتوزيع العلاقات العامة. تضخيم اليوم.

- أفلاطونايستريم. ذكاء بيانات Web3. تضخيم المعرفة. الوصول هنا.

- سك المستقبل مع أدرين أشلي. الوصول هنا.

- المصدر https://quantum-journal.org/papers/q-2023-04-27-989/

- :يكون

- :ليس

- 1

- 10

- 11

- 12

- 13

- 14

- 20

- 2018

- 2019

- 2020

- 2021

- 2022

- 2023

- 22

- 7

- 8

- 9

- a

- فوق

- الملخص

- الوصول

- السلف

- الانتماءات

- AL

- خوارزميات

- الكل

- an

- تحليلي

- و

- أندرو

- أبريل

- هي

- حول

- أرثر

- AS

- أسوشيتد

- المؤلفة

- الكتاب

- أوتوماتيك

- BE

- بيرة

- البلسمينة

- Beyond

- على حد سواء

- استراحة

- by

- تسمى

- كامبردج

- حقيبة

- مركز

- تغيير

- التغييرات

- تصنيف

- اغلاق

- التعليق

- جميل

- مجال الاتصالات

- إكمال

- الحسابات

- الحوسبة

- نظر

- التقاء

- حقوق الطبع والنشر

- التكلفة

- استطاع

- دانيال

- البيانات

- عميق

- تابع

- الخلافات

- التفاضل

- بحث

- do

- أثناء

- دينامية

- E & T

- إدوارد

- تأثير

- يدخل

- عصر

- معبر

- الميزات

- فبراير

- يطفو

- في حالة

- الإطار

- فرانسيس

- تبدأ من

- وظيفة

- وظائف

- ينمو

- هارفارد

- أصحاب

- HTTPS

- مهجنة

- هجين الكم الكلاسيكي

- i

- if

- in

- لا نهاية

- معلومات

- في البداية

- الابتكار

- المؤسسات

- وكتابة مواضيع مثيرة للاهتمام

- عالميا

- جافا سكريبت

- جينيفر

- جون

- مجلة

- معروف

- مختبر

- كبير

- والأخير

- تعلم

- يترك

- قراءة

- حقوق الملكية الفكرية

- قائمة

- محلي

- لندن

- آلة

- آلة التعلم

- ماركو

- الرياضيات

- مايو..

- طريقة

- ماير

- نموذج

- عارضات ازياء

- شهر

- الأكثر من ذلك

- الطبيعة

- قرب

- شبكة

- الشبكات

- الشبكة العصبية

- الشبكات العصبية

- ضجيج

- عادي

- عدد

- أرقام

- of

- on

- جاكيت

- التحسين

- or

- أصلي

- لنا

- ورق

- المعلمات

- أداء

- ظاهرة

- فيزياء

- أفلاطون

- الذكاء افلاطون البيانات

- أفلاطون داتا

- قوة

- على وجه التحديد

- دقة

- صحافة

- عملية المعالجة

- معالجة

- المعالجات

- برمجة وتطوير

- إثبات

- تزود

- نشرت

- الناشر

- الناشرين

- كمية

- خوارزميات الكم

- الاحصاء الكمية

- تعلم الآلة الكمومية

- المكدسة

- معدل

- مؤخرا

- المراجع

- النظام الحاكم

- مسجل

- لا تزال

- بقايا

- التمثيل

- بحث

- النتائج

- التعليقات

- ROBERT

- ريان

- ضحل

- شارما

- إظهار

- بشكل ملحوظ

- سيمون

- المساحات

- المحافظة

- بنجاح

- هذه

- مناسب

- الدعم

- أنظمة

- طهران

- تيزوكا

- أن

- •

- من مشاركة

- تشبه

- عبر

- عنوان

- إلى

- قادة الإيمان

- مع

- عالمي

- تحديث

- URL

- القيم

- بواسطة

- حجم

- W

- تريد

- وكان

- we

- واسع

- مع

- الذئب

- عام

- أنت

- يوان

- زفيرنت

- صفر