أدت التطورات الأخيرة في التعلم العميق إلى نماذج كبيرة بشكل متزايد مثل GPT-3 و BLOOM و OPT ، والتي يتجاوز بعضها بالفعل 100 مليار معلمة. على الرغم من أن النماذج الأكبر تميل إلى أن تكون أكثر قوة ، فإن تدريب مثل هذه النماذج يتطلب موارد حسابية كبيرة. حتى مع استخدام مكتبات التدريب الموزعة المتقدمة مثل FSDP و DeepSpeed ، فمن الشائع أن تتطلب وظائف التدريب مئات من أجهزة التسريع لعدة أسابيع أو أشهر في كل مرة.

في أواخر عام 2022 ، أعلنت AWS عن التوفر العام لـ مثيلات Amazon EC2 Trn1 مدعوم من تدريب AWS—مُسرِّع التعلم الآلي (ML) المصمم لهذا الغرض والذي تم تحسينه لتوفير نظام أساسي عالي الأداء وفعال من حيث التكلفة وقابل للتطوير على نطاق واسع لتدريب نماذج التعلم العميق في السحابة. تتوفر مثيلات Trn1 بعدد من الأحجام (انظر الجدول التالي) ، مع ما يصل إلى 16 مسرّعًا من Trainium لكل مثيل.

| حجم المثيل | مسرعات Trainium | ذاكرة التسريع (جيجابايت) | وحدات المعالجة المركزية الافتراضية | ذاكرة المثيل (جيجابايت) | عرض النطاق الترددي للشبكة (جيجابت في الثانية) |

| trn1.2xlarge | 1 | 32 | 8 | 32 | حتى 12.5 |

| trn1.32xlarge | 16 | 512 | 128 | 512 | 800 |

| trn1n.32xlarge (قريبًا) | 16 | 512 | 128 | 512 | 1600 |

يمكن نشر مثيلات Trn1 كمثيلات مستقلة لوظائف التدريب الأصغر ، أو في مجموعات فائقة الدقة قابلة للتطوير بدرجة كبيرة تدعم التدريب الموزع عبر عشرات الآلاف من مسرعات Trainium. تدعم جميع مثيلات Trn1 التكوين المستقل ، بينما تتطلب Trn1 ultraclusters مثيلات trn1.32xlarge أو trn1n.32xlarge. في مجموعة فائقة الدقة ، توجد مثيلات Trn1 المتعددة في مكان واحد في منطقة توافر AWS معينة ومتصلة بشبكات مهايئ نسيج مرن (EFA) عالي السرعة وزمن انتقال منخفض يوفر 800 جيجابت في الثانية من النطاق الترددي للشبكة غير المحظورة لكل مثيل لعمليات الحوسبة الجماعية . سيؤدي نوع المثيل trn1n.32xlarge ، الذي تم إطلاقه في أوائل عام 2023 ، إلى زيادة عرض النطاق الترددي هذا إلى 1600 جيجابت في الثانية لكل مثيل.

يختار العديد من عملاء المؤسسة نشر أحمال عمل التعلم العميق الخاصة بهم باستخدام Kubernetes - المعيار الفعلي لتنظيم الحاويات في السحابة. غالبًا ما ينشر عملاء AWS أحمال العمل هذه باستخدام ملفات خدمة أمازون مطاطا Kubernetes (أمازون EKS). Amazon EKS هي خدمة Kubernetes مُدارة تعمل على تبسيط إنشاء مجموعات Kubernetes وتكوينها ودورة حياتها ومراقبتها مع الاستمرار في تقديم المرونة الكاملة لـ Kubernetes المنبع.

اليوم ، يسعدنا الإعلان عن الدعم الرسمي لوظائف التدريب الموزعة باستخدام مثيلات Amazon EKS و EC2 Trn1. مع هذا الإعلان ، يمكنك الآن بسهولة تشغيل وظائف التدريب على حاويات واسعة النطاق داخل Amazon EKS مع الاستفادة الكاملة من أداء السعر وقابلية التوسع وسهولة الاستخدام التي توفرها مثيلات Trn1.

إلى جانب هذا الإعلان ، ننشر أيضًا برنامجًا تعليميًا مفصلاً يرشدك خلال الخطوات المطلوبة لتشغيل وظيفة تدريب موزعة متعددة المثيلات (BERT مرحلة 1 تدريب مسبق) باستخدام مثيلات Amazon EKS و Trn1. في هذا المنشور ، ستتعرف على بنية الحلول وتراجع عدة خطوات أساسية من البرنامج التعليمي. الرجوع إلى المستودع التعليمي الرسمي لسير العمل الكامل من طرف إلى طرف.

للمتابعة ، معرفة واسعة بخدمات AWS الأساسية مثل الأمازون الحوسبة المرنة السحابية (Amazon EC2) و Amazon EKS ضمنيان ، والإلمام الأساسي بالتعلم العميق و PyTorch سيكون مفيدًا.

هندسة الحل

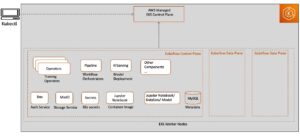

يوضح الرسم البياني التالي بنية الحل.

يتكون الحل من المكونات الرئيسية التالية:

- مجموعة EKS

- مجموعة عقدة EKS تتكون من مثيلات trn1.32xlarge

- • AWS نيورون SDK

- المكونات الإضافية EKS لـ Neuron و EFA

- An سجل الأمازون المرنة للحاويات (Amazon ECR) إعادة تكوين

- صورة حاوية تدريب

- An أمازون FSx لستر نظام الملفات

- جدولة الدُفعات البركان وخادم الخ

- قاذفة الوظائف العالمية TorchX

- وحدة TorchX DDP لـ Trainium

يوجد في قلب الحل مجموعة EKS التي توفر لك وظائف إدارة Kubernetes الأساسية عبر نقطة نهاية خدمة EKS. تتمثل إحدى مزايا Amazon EKS في أن الخدمة تراقب بنشاط وتوسع مستوى التحكم بناءً على الحمل ، مما يضمن أداءً عاليًا لأحمال العمل الكبيرة مثل التدريب الموزع. يوجد داخل مجموعة EKS مجموعة عقدة تتكون من مثلين أو أكثر من المثيلات المستندة إلى trn1.32xlarge من Trainium الموجودة في نفس منطقة توافر الخدمات.

Neuron SDK هي مجموعة البرامج التي توفر السائق والمترجم ووقت التشغيل وتكامل الإطار (على سبيل المثال ، PyTorch Neuron) وأدوات المستخدم التي تتيح لك الوصول إلى مزايا مسرعات Trainium. يعمل برنامج تشغيل جهاز Neuron مباشرة على عقد EKS (مثيلات Trn1) ويوفر الوصول إلى رقائق Trainium من داخل حاويات التدريب التي يتم إطلاقها على العقد. يتم تثبيت المكونات الإضافية لـ Neuron و EFA داخل مجموعة EKS لتوفير الوصول إلى رقائق Trainium وأجهزة شبكات EFA المطلوبة للتدريب الموزع.

يتم استخدام مستودع ECR لتخزين صور حاوية التدريب. تحتوي هذه الصور على Neuron SDK (باستثناء برنامج تشغيل Neuron ، الذي يعمل مباشرة على مثيلات Trn1) ، ونص تدريب PyTorch ، والاعتماديات المطلوبة. عند بدء مهمة تدريبية على مجموعة EKS ، يتم سحب صور الحاوية أولاً من Amazon ECR إلى عقد EKS ، ثم يتم إنشاء مثيل حاويات عمال PyTorch من الصور.

يتم توفير التخزين المشترك باستخدام FSx عالي الأداء لنظام الملفات Luster الموجود في نفس منطقة توافر الخدمات مثل مثيلات trn1.32xlarge. يتم التوسط في إنشاء FSx لنظام الملفات Luster وإرفاقه بمجموعة EKS بواسطة ملف Amazon FSx لبرنامج تشغيل Luster CSI. في هذا الحل ، يتم استخدام التخزين المشترك لتخزين مجموعة بيانات التدريب وأي سجلات أو عناصر أثرية تم إنشاؤها أثناء عملية التدريب.

الحل يستخدم TorchX قاذفة عمل عالمية لإطلاق وظائف تدريبية موزعة داخل Amazon EKS. يحتوي TorchX على تبعيتين مهمتين: جدولة الدُفعات Volcano والخادم إلخ. يتعامل Volcano مع جدولة وظائف التدريب وانتظارها ، بينما يعد الخادم etcd مخزنًا ذا قيمة رئيسية يستخدمه TorchElastic للمزامنة واكتشاف الأقران أثناء بدء العمل.

عندما يتم تشغيل مهمة تدريبية باستخدام TorchX ، يستخدم أمر التشغيل وحدة TorchX الموزعة DDP المقدمة لـ Trainium لتكوين مهمة التدريب الشاملة ثم تشغيل أوامر torchrun المناسبة على كل من كبسولات PyTorch للعمال. عند تشغيل مهمة ما ، يمكن مراقبتها باستخدام أدوات Kubernetes القياسية (مثل kubectl) أو عبر مجموعات أدوات ML القياسية مثل TensorBoard.

حل نظرة عامة

لنلقِ نظرة على الخطوات المهمة لهذا الحل. خلال هذه النظرة العامة ، نشير إلى قم بتشغيل وظيفة تدريب الخلايا العصبية PyTorch متعددة العقد على Trainium باستخدام TorchX و EKS تعليمي على جيثب.

قم بإنشاء مجموعة EKS

لبدء مهام التدريب الموزعة في Amazon EKS مع مثيلات Trn1 ، عليك أولاً إنشاء مجموعة EKS كما هو موضح في تعليمي على جيثب. يمكن تحقيق إنشاء الكتلة باستخدام أدوات قياسية مثل eksctl و تكوين سحابة AWS.

قم بإنشاء مجموعة عقدة EKS

بعد ذلك ، نحتاج إلى إنشاء مجموعة عقدة EKS تحتوي على مثلين أو أكثر من مثيلات trn1.32xlarge في منطقة مدعومة. في البرنامج التعليمي ، يُستخدم AWS CloudFormation لإنشاء قالب إطلاق EC2 خاص بـ Trainium، مما يضمن تشغيل مثيلات Trn1 باستخدام صورة آلة Amazon (AMI) المناسبة وتهيئة شبكة EFA الصحيحة اللازمة لدعم التدريب الموزع. يتضمن AMI أيضًا برنامج تشغيل جهاز Neuron الذي يوفر الدعم لرقائق تسريع Trainium. مع ال eksctl أداة إدارة Amazon EKS ، يمكنك بسهولة إنشاء مجموعة عقدة Trainium باستخدام بيان YAML الأساسي الذي يشير إلى نموذج الإطلاق الذي تم إنشاؤه حديثًا. على سبيل المثال:

في البيان السابق ، تم تكوين العديد من السمات للسماح باستخدام مثيلات Trn1 في مجموعة EKS. أولاً، metadata.region تم تعيينه على إحدى المناطق التي تدعم مثيلات Trn1 (حاليًا us-east-1 و us-west-2). بعد ذلك ، بالنسبة إلى مناطق التوفر ، تتطلب Amazon EKS تحديد منطقتي توافر. يجب أن تدعم إحدى مناطق توافر الخدمات استخدام مثيلات Trn1 ، بينما يمكن اختيار الأخرى عشوائيًا. يوضح البرنامج التعليمي كيفية تحديد مناطق توافر الخدمات التي ستسمح بمثيلات Trn1 داخل حساب AWS الخاص بك. يجب أيضًا تحديد منطقة توافر الخدمة نفسها التي تدعم Trn1 باستخدام ملف availabiltyZones السمة المرتبطة بمجموعة عقدة EKS. efaEnabled ومن المقرر أن true لتكوين العقد مع تكوين شبكة EFA المناسب المطلوب للتدريب الموزع. أخيرًا ، launchTemplate.id تشير السمة المرتبطة بمجموعة العقد إلى نموذج تشغيل EC2 الذي تم إنشاؤه عبر AWS CloudFormation في خطوة سابقة.

بافتراض أنك قمت بالفعل بتطبيق نموذج CloudFormation وقمت بتثبيت ملف eksctl أداة الإدارة ، يمكنك إنشاء مجموعة عقدة EKS قادرة على Trainium عن طريق تشغيل الكود التالي:

قم بتثبيت ملحقات Kubernetes لأجهزة Trainium و EFA

مع وجود مجموعة العقدة في مكانها الصحيح ، فإن الخطوة التالية هي تثبيت ملحقات Kubernetes التي توفر الدعم لمسرعات Trainium (عبر المكون الإضافي Neuron) وأجهزة EFA (عبر المكون الإضافي EFA). يمكن تثبيت هذه المكونات الإضافية بسهولة على الكتلة باستخدام المعيار kubectl أداة الإدارة كما هو موضح في البرنامج التعليمي.

لاستخدام مشغل TorchX العالمي PyTorch لإطلاق وظائف التدريب الموزعة ، يلزم وجود متطلبين أساسيين: جدولة دفعة Volcano ، وخادم إلخ. مثل الكثير من المكونات الإضافية Neuron و EFA ، يمكننا استخدام ملحق kubectl أداة لتثبيت Volcano وخادم إلخ على مجموعة EKS.

قم بإرفاق التخزين المشترك بمجموعة EKS

في البرنامج التعليمي ، يتم استخدام FSx for Luster لتوفير نظام ملفات مشترك عالي الأداء يمكن الوصول إليه بواسطة مجموعات عمال EKS المختلفة. يتم استخدام هذا التخزين المشترك لاستضافة مجموعة بيانات التدريب ، بالإضافة إلى أي عناصر وسجلات يتم إنشاؤها أثناء عملية التدريب. يصف البرنامج التعليمي كيفية إنشاء وإرفاق التخزين المشترك بالكتلة باستخدام ملف Amazon FSx لبرنامج تشغيل Luster CSI.

قم بإنشاء صورة حاوية تدريب

بعد ذلك ، نحتاج إلى إنشاء صورة حاوية تدريب تتضمن البرنامج النصي للتدريب PyTorch مع أي تبعيات. تم تضمين مثال Dockerfile في البرنامج التعليمي ، والذي يتضمن البرنامج النصي BERT قبل التدريب جنبًا إلى جنب مع تبعيات البرامج الخاصة به. يتم استخدام Dockerfile لبناء صورة حاوية التدريب ، ثم يتم دفع الصورة إلى مستودع ECR حيث يمكن لعمال PyTorch سحب الصورة عند بدء عمل تدريب على الكتلة.

قم بإعداد بيانات التدريب

قبل بدء وظيفة تدريبية ، يتم أولاً نسخ بيانات التدريب إلى وحدة التخزين المشتركة على FSx for Luster. يوضح البرنامج التعليمي كيفية إنشاء Kubernetes pod مؤقت له حق الوصول إلى وحدة التخزين المشتركة ، ويوضح كيفية تسجيل الدخول إلى pod لتنزيل واستخراج مجموعة بيانات التدريب باستخدام أوامر Linux shell القياسية.

مع وجود المتطلبات الأساسية المختلفة للبنية التحتية والبرامج ، يمكننا الآن التركيز على جوانب Trainium في الحل.

تجميع نموذجك مسبقًا

تدعم حزمة Neuron SDK PyTorch من خلال طبقة تكامل تسمى بايتورتش الخلايا العصبية. بشكل افتراضي ، تعمل PyTorch Neuron مع التجميع في الوقت المناسب ، حيث يتم تجميع الرسوم البيانية المختلفة للشبكة العصبية ضمن مهمة تدريبية عند مواجهتها أثناء عملية التدريب. بالنسبة للطرز الأكبر ، يمكن أن يكون أكثر ملاءمة لاستخدام المقدمة neuron_parallel_compile أداة للترجمة والتخزين المؤقت للرسوم البيانية المختلفة للحساب مسبقًا لتجنب تجميع الرسوم البيانية في وقت التدريب. قبل بدء مهمة التدريب على مجموعة EKS ، يوضح البرنامج التعليمي كيفية بدء تشغيل وظيفة ما قبل الترجمة أولاً عبر TorchX باستخدام neuron_parallel_compile أداة. عند الانتهاء من مهمة التجميع المسبق ، سيكون مترجم Neuron قد حدد وجمع جميع الرسوم البيانية لحساب الشبكة العصبية ، وتخزينها مؤقتًا في حجم التخزين المشترك لاستخدامها لاحقًا خلال مهمة BERT الفعلية قبل التدريب.

إطلاق الوظيفة التدريبية الموزعة

مع اكتمال التجميع المسبق ، يتم استخدام TorchX بعد ذلك لإطلاق مهمة تدريب موزعة لـ 64 عاملاً عبر مثلين trn 1.32xlarge ، مع 32 عاملًا لكل حالة. نستخدم 32 عاملاً في كل حالة لأن كل مثيل trn1.32xlarge يحتوي على 16 مسرّعًا من Trainium ، حيث يوفر كل مسرع 2 نيورونكورس. يمكن الوصول إلى كل NeuronCore باعتباره ملفًا فريدًا جهاز PyTorch XLA في نص التدريب. مثال على أمر تشغيل TorchX من البرنامج التعليمي يبدو مثل الكود التالي:

يتم وصف وسيطات سطر الأوامر المختلفة في أمر TorchX السابق بالتفصيل في البرنامج التعليمي. ومع ذلك ، فإن الحجج التالية هي الأكثر أهمية في تكوين وظيفة التدريب:

- -cfg queue = اختبار - يحدد قائمة انتظار Volcano لاستخدامها في مهمة التدريب

- -cfg image_repo - يحدد مستودع ECR الذي سيتم استخدامه لصور حاوية TorchX

- –script_args - يحدد أي وسيطات يجب تمريرها إلى البرنامج النصي للتدريب PyTorch

- - العقد و - nproc_per_node - عدد المثيلات والعاملين في كل حالة لاستخدامها في وظيفة التدريب

- -النصي - اسم البرنامج النصي للتدريب PyTorch للإطلاق داخل حاوية التدريب

- -صورة - المسار إلى صورة حاوية التدريب في Amazon ECR

- –bf16 - ما إذا كان سيتم تمكين نوع بيانات BF16 أم لا

مراقبة وظيفة التدريب

بعد بدء وظيفة التدريب ، هناك طرق مختلفة يمكن من خلالها مراقبة الوظيفة. يوضح البرنامج التعليمي كيفية مراقبة مقاييس البرنامج النصي للتدريب الأساسي على سطر الأوامر باستخدام kubectl، وكيفية مراقبة تقدم البرنامج النصي للتدريب بشكل مرئي في TensorBoard (انظر لقطة الشاشة التالية) ، وكيفية مراقبة استخدام مسرع Trainium باستخدام neuron-top أداة من Neuron SDK.

نظف البيئة أو أعد استخدامها

عند اكتمال مهمة التدريب ، يمكن إعادة استخدام المجموعة أو إعادة تكوينها لوظائف تدريبية إضافية. على سبيل المثال ، يمكن زيادة مجموعة عقدة EKS بسرعة باستخدام امتداد eksctl الأمر من أجل دعم وظائف التدريب التي تتطلب مثيلات Trn1 إضافية. وبالمثل ، يمكن بسهولة تعديل أوامر إطلاق Dockerfile و TorchX لدعم نماذج التعلم العميق الإضافية وتوزيع طبولوجيا التدريب.

إذا لم تعد المجموعة مطلوبة ، فإن البرنامج التعليمي يتضمن أيضًا جميع الخطوات المطلوبة لإزالة البنية التحتية EKS والموارد ذات الصلة.

وفي الختام

في هذا المنشور ، اكتشفنا كيف توفر مثيلات Trn1 و Amazon EKS نظامًا أساسيًا مُدارًا للتدريب الموزع عالي الأداء والفعال من حيث التكلفة والقابل للتطوير على نطاق واسع لنماذج التعلم العميق. شاركنا أيضًا برنامجًا تعليميًا شاملاً يوضح كيفية تشغيل وظيفة تدريب موزعة في العالم الحقيقي متعددة المثيلات في Amazon EKS باستخدام مثيلات Trn1 ، وأبرزنا العديد من الخطوات والمكونات الرئيسية في الحل. يمكن تكييف محتوى البرنامج التعليمي هذا بسهولة مع النماذج وأعباء العمل الأخرى ، ويوفر لك حلاً أساسيًا للتدريب الموزع على نماذج التعلم العميق في AWS.

لمعرفة المزيد حول كيفية بدء استخدام مثيلات Trn1 التي تعمل بنظام Trainium ، راجع ملف توثيق الخلايا العصبية.

حول المؤلف

سكوت بيري هو مهندس حلول في فريق مسرعات Annapurna ML في AWS. مقره في كندا ، يساعد العملاء على نشر وتحسين التدريب على التعلم العميق وأعباء العمل الخاصة بالاستدلال باستخدام AWS Inferentia و AWS Trainium. تشمل اهتماماته نماذج اللغة الكبيرة ، والتعلم المعزز العميق ، وإنترنت الأشياء ، وعلم الجينوم.

سكوت بيري هو مهندس حلول في فريق مسرعات Annapurna ML في AWS. مقره في كندا ، يساعد العملاء على نشر وتحسين التدريب على التعلم العميق وأعباء العمل الخاصة بالاستدلال باستخدام AWS Inferentia و AWS Trainium. تشمل اهتماماته نماذج اللغة الكبيرة ، والتعلم المعزز العميق ، وإنترنت الأشياء ، وعلم الجينوم.

لوريا أريزابالاجا هي مهندسة حلول متوافقة مع القطاع العام في المملكة المتحدة ، حيث تساعد العملاء على تصميم حلول ML باستخدام Amazon SageMaker. وهي أيضًا جزء من مجتمع المجال التقني المخصص لتسريع الأجهزة وتساعد في اختبار وقياس أحمال عمل AWS Inferentia و AWS Trainium.

لوريا أريزابالاجا هي مهندسة حلول متوافقة مع القطاع العام في المملكة المتحدة ، حيث تساعد العملاء على تصميم حلول ML باستخدام Amazon SageMaker. وهي أيضًا جزء من مجتمع المجال التقني المخصص لتسريع الأجهزة وتساعد في اختبار وقياس أحمال عمل AWS Inferentia و AWS Trainium.

- محتوى مدعوم من تحسين محركات البحث وتوزيع العلاقات العامة. تضخيم اليوم.

- بلاتوبلوكشين. Web3 Metaverse Intelligence. تضخيم المعرفة. الوصول هنا.

- المصدر https://aws.amazon.com/blogs/machine-learning/scaling-distributed-training-with-aws-trainium-and-amazon-eks/

- 1

- 100

- 11

- 2022

- 2023

- 7

- a

- ماهرون

- من نحن

- مسرع

- المعجلات

- الوصول

- الوصول

- تحقق

- في

- بنشاط

- إضافي

- تقدم

- متقدم

- مميزات

- الانحياز

- الكل

- سابقا

- بالرغم ان

- أمازون

- Amazon EC2

- الأمازون SageMaker

- و

- أعلن

- أعلن

- اشعارات

- تطبيقي

- مناسب

- هندسة معمارية

- الحجج

- الجوانب

- أسوشيتد

- يرفق

- سمات

- توفر

- متاح

- AWS

- تكوين سحابة AWS

- استدلال AWS

- عرض النطاق الترددي

- على أساس

- الأساسية

- لان

- قبل

- المقارنة

- الفوائد

- مليار

- إزهار

- واسع

- نساعدك في بناء

- مخبأ

- تسمى

- كندا

- شيبس

- اختار

- اختيار

- سحابة

- كتلة

- الكود

- جماعي

- آت

- يصل قريباً

- مشترك

- مجتمع

- إكمال

- إكمال

- مكونات

- شامل

- إحصاء

- الاعداد

- متصل

- تتكون

- وعاء

- حاويات

- يحتوي

- محتوى

- مراقبة

- مناسب

- جوهر

- فعاله من حيث التكلفه

- خلق

- خلق

- خلق

- خلق

- سي أيس آئي

- حاليا

- العملاء

- البيانات

- DDP

- مخصصة

- عميق

- التعلم العميق

- الترتيب

- نشر

- نشر

- وصف

- تصميم

- التفاصيل

- مفصلة

- التطورات

- جهاز

- الأجهزة

- مباشرة

- اكتشاف

- وزعت

- التدريب الموزع

- توزيع

- بإمكانك تحميله

- سائق

- أثناء

- كل

- في وقت سابق

- في وقت مبكر

- سهولة الاستخدام

- بسهولة

- إما

- تمكين

- النهائي إلى نهاية

- نقطة النهاية

- يضمن

- مشروع

- حتى

- مثال

- متحمس

- ازالة

- موجود

- استكشاف

- استخراج

- قماش

- معرفة

- حقل

- قم بتقديم

- الاسم الأول

- مرونة

- تركز

- اتباع

- متابعيك

- الإطار

- تبدأ من

- بالإضافة إلى

- وظيفة

- العلاجات العامة

- علم الجينوم

- دولار فقط واحصل على خصم XNUMX% على جميع

- GitHub جيثب:

- معطى

- رسم بياني

- الرسوم البيانية

- تجمع

- دليل

- مقابض

- أجهزة التبخير

- قلب

- مفيد

- يساعد

- مرتفع

- أداء عالي

- سلط الضوء

- جدا

- مضيف

- كيفية

- كيفية

- لكن

- HTML

- HTTPS

- مئات

- ID

- محدد

- صورة

- صور

- ضمني

- أهمية

- in

- تتضمن

- شامل

- يشمل

- القيمة الاسمية

- على نحو متزايد

- البنية التحتية

- تثبيت

- تثبيت

- مثل

- التكامل

- السريرية

- قام المحفل

- IT

- وظيفة

- المشــاريــع

- القفل

- نوع

- لغة

- كبير

- على نطاق واسع

- أكبر

- متأخر

- إطلاق

- أطلقت

- إطلاق

- طبقة

- تعلم

- تعلم

- ليد

- المكتبات

- خط

- لينكس

- تحميل

- يعد

- بحث

- تبدو

- آلة

- آلة التعلم

- الرئيسية

- تمكن

- إدارة

- نطاق واسع

- مكبر الصوت : يدعم، مع دعم ميكروفون مدمج لمنع الضوضاء

- البيانات الوصفية

- المقاييس

- ML

- عارضات ازياء

- تم التعديل

- وحدة

- مراقبة

- مراقبة

- مراقبة

- شاشات

- المقبلة.

- الأكثر من ذلك

- أكثر

- متعدد

- الاسم

- حاجة

- شبكة

- الشبكات

- الشبكة العصبية

- التالي

- العقدة

- العقد

- عدد

- عرضت

- الوهب

- رسمي

- ONE

- تعمل

- عمليات

- الأمثل

- الأمثل

- تزامن

- طلب

- أخرى

- أوجز

- حدود

- الكلي

- نظرة عامة

- المعلمات

- جزء

- مرت

- مسار

- الند

- أداء

- مرحلة جديدة

- المكان

- المنصة

- أفلاطون

- الذكاء افلاطون البيانات

- أفلاطون داتا

- المساعد

- الإضافات

- نقاط

- منشور

- مدعوم

- قوي

- الشروط

- عملية المعالجة

- التقدّم

- تزود

- المقدمة

- ويوفر

- توفير

- جمهور

- نشر

- دفع

- pytorch

- بسرعة

- عشوائية

- العالم الحقيقي

- المراجع

- منطقة

- المناطق

- ذات صلة

- إزالة

- مستودع

- تطلب

- مطلوب

- يتطلب

- الموارد

- مراجعة

- يجري

- تشغيل

- sagemaker

- نفسه

- التدرجية

- تحجيم

- النطاقات

- التحجيم

- الإستراحة

- القطاع

- الخدمة

- خدماتنا

- طقم

- عدة

- شاركت

- قذيفة

- ينبغي

- أظهرت

- يظهر

- هام

- وبالمثل

- الأحجام

- الأصغر

- So

- تطبيقات الكمبيوتر

- حل

- الحلول

- بعض

- محدد

- كومة

- مستقل

- معيار

- بدأت

- بدء التشغيل

- خطوة

- خطوات

- لا يزال

- تخزين

- متجر

- هذه

- الدعم

- مدعومة

- الدعم

- تزامن

- نظام

- جدول

- مع الأخذ

- فريق

- تقني

- قالب

- مؤقت

- الاختبار

- •

- المملكة المتحدة

- من مشاركة

- الآلاف

- عبر

- طوال

- الوقت

- إلى

- أداة

- أدوات

- قادة الإيمان

- صحيح

- البرنامج التعليمي

- Uk

- فريد من نوعه

- عالمي

- تستخدم

- مستخدم

- مختلف

- الإصدار

- بواسطة

- حجم

- طرق

- أسابيع

- سواء

- التي

- في حين

- سوف

- في غضون

- عامل

- العمال

- سوف

- يامل

- أنت

- حل متجر العقارات الشامل الخاص بك في جورجيا

- زفيرنت

- المناطق