আজ, আমরা মেটা ব্যবহার করে লামা 2 মডেলগুলিকে ফাইন-টিউন করার ক্ষমতা ঘোষণা করতে পেরে আনন্দিত আমাজন সেজমেকার জাম্পস্টার্ট. লামা 2 ফ্যামিলি অফ লার্জ ল্যাঙ্গুয়েজ মডেল (LLMs) হল 7 বিলিয়ন থেকে 70 বিলিয়ন প্যারামিটারের স্কেলে প্রাক-প্রশিক্ষিত এবং সূক্ষ্ম-টিউনড জেনারেটিভ টেক্সট মডেলের একটি সংগ্রহ। ফাইন-টিউনড এলএলএম, যাকে লামা-২-চ্যাট বলা হয়, সংলাপ ব্যবহারের ক্ষেত্রে অপ্টিমাইজ করা হয়। আপনি সহজেই এই মডেলগুলি ব্যবহার করে দেখতে পারেন এবং সেজমেকার জাম্পস্টার্টের সাথে ব্যবহার করতে পারেন, এটি একটি মেশিন লার্নিং (ML) হাব যা অ্যালগরিদম, মডেল এবং ML সমাধানগুলিতে অ্যাক্সেস সরবরাহ করে যাতে আপনি দ্রুত ML এর সাথে শুরু করতে পারেন৷ এখন আপনি SageMaker JumpStart ব্যবহার করে 2 বিলিয়ন, 7 বিলিয়ন, এবং 13 বিলিয়ন প্যারামিটার Llama 70 টেক্সট জেনারেশন মডেলগুলিকে ফাইন-টিউন করতে পারেন অ্যামাজন সেজমেকার স্টুডিও কয়েক ক্লিকে বা SageMaker Python SDK ব্যবহার করে UI।

জেনারেটিভ এআই ফাউন্ডেশন মডেলগুলি এক বছরেরও বেশি সময় ধরে বেশিরভাগ এমএল এবং কৃত্রিম বুদ্ধিমত্তা গবেষণা এবং ব্যবহারের ক্ষেত্রে কেন্দ্রীভূত হয়েছে। এই ফাউন্ডেশন মডেলগুলি টেক্সট জেনারেশন, সংক্ষিপ্তকরণ, প্রশ্নের উত্তর, ইমেজ এবং ভিডিও জেনারেশন এবং আরও অনেক কিছুর মতো জেনারেটিভ কাজগুলির সাথে খুব ভাল কাজ করে, কারণ তাদের বড় আকারের কারণে এবং এছাড়াও তারা বেশ কয়েকটি বৃহৎ ডেটাসেট এবং শত শত কাজের জন্য প্রশিক্ষিত। এই মডেলগুলির দুর্দান্ত সাধারণীকরণের ক্ষমতা থাকা সত্ত্বেও, প্রায়শই এমন ক্ষেত্রে ব্যবহার করা হয় যেখানে খুব নির্দিষ্ট ডোমেন ডেটা থাকে (যেমন স্বাস্থ্যসেবা বা আর্থিক পরিষেবা), যার কারণে এই মডেলগুলি এই ব্যবহারের ক্ষেত্রে ভাল ফলাফল দিতে সক্ষম নাও হতে পারে। এর ফলে কেস-নির্দিষ্ট এবং ডোমেন-নির্দিষ্ট ডেটা ব্যবহারের ক্ষেত্রে এই জেনারেটিভ এআই মডেলগুলির আরও সূক্ষ্ম-টিউনিংয়ের প্রয়োজন হয়।

এই পোস্টে, আমরা সেজমেকার জাম্পস্টার্টের মাধ্যমে লামা 2 প্রাক-প্রশিক্ষিত টেক্সট জেনারেশন মডেলগুলিকে কীভাবে সূক্ষ্ম-টিউন করতে পারি তা নিয়ে চলেছি।

লামা কি 2

Llama 2 একটি স্বয়ংক্রিয়-রিগ্রেসিভ ভাষা মডেল যা একটি অপ্টিমাইজড ট্রান্সফরমার আর্কিটেকচার ব্যবহার করে। Llama 2 ইংরেজিতে বাণিজ্যিক ও গবেষণার জন্য ব্যবহার করা হয়েছে। এটি প্যারামিটার আকারের পরিসরে আসে—৭ বিলিয়ন, ১৩ বিলিয়ন, এবং ৭০ বিলিয়ন—সেইসাথে প্রাক-প্রশিক্ষিত এবং সূক্ষ্ম-সুরক্ষিত বৈচিত্র। Meta-এর মতে, টিউন করা সংস্করণগুলি মানবিক প্রতিক্রিয়া (RLHF) সহ তদারকিকৃত ফাইন-টিউনিং (SFT) এবং রিইনফোর্সমেন্ট লার্নিং ব্যবহার করে সাহায্য এবং নিরাপত্তার জন্য মানুষের পছন্দের সাথে সারিবদ্ধ করতে। Llama 7 সর্বজনীনভাবে উপলব্ধ উত্স থেকে 13 ট্রিলিয়ন টোকেন ডেটাতে প্রাক-প্রশিক্ষিত ছিল। টিউন করা মডেলগুলি সহকারীর মতো চ্যাটের উদ্দেশ্যে তৈরি করা হয়েছে, যেখানে প্রাক-প্রশিক্ষিত মডেলগুলি বিভিন্ন প্রাকৃতিক ভাষা তৈরির কাজের জন্য অভিযোজিত হতে পারে। একজন বিকাশকারী মডেলের কোন সংস্করণ ব্যবহার করেন তা নির্বিশেষে, মেটা থেকে দায়িত্বশীল ব্যবহারের নির্দেশিকা উপযুক্ত নিরাপত্তা প্রশমনের সাথে মডেলগুলিকে কাস্টমাইজ এবং অপ্টিমাইজ করার জন্য প্রয়োজনীয় অতিরিক্ত সূক্ষ্ম-টিউনিং গাইডে সহায়তা করতে পারে।

বর্তমানে, Llama 2 নিম্নলিখিত অঞ্চলে উপলব্ধ:

- উপলব্ধ প্রাক-প্রশিক্ষিত মডেল স্থাপন করুন:

"us-west-2","us-east-1","us-east-2","eu-west-1","ap-southeast-1","ap-southeast-2" - ফাইন-টিউন করুন এবং ফাইন-টিউনড মডেল স্থাপন করুন:

“us-east-1”,“us-west-2”,“eu-west-1”

সেজমেকার জাম্পস্টার্ট কি

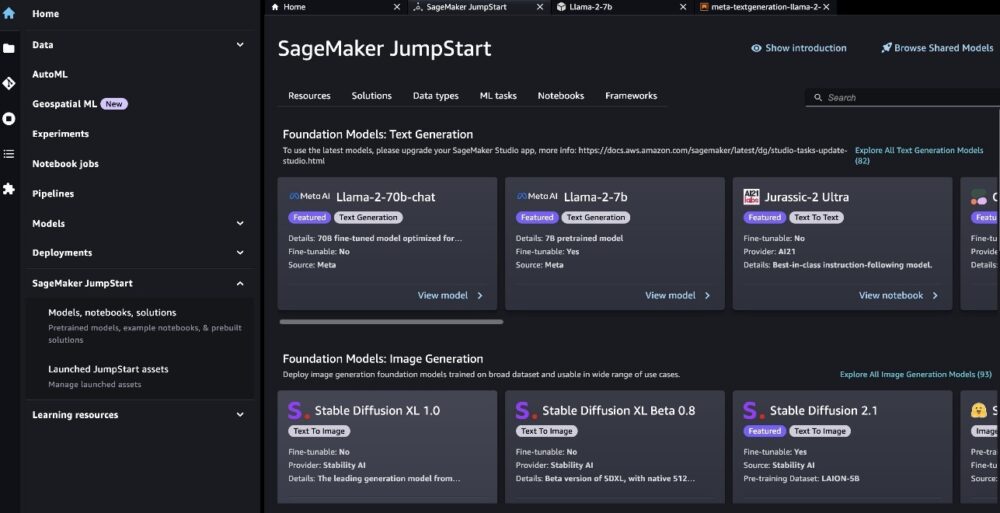

SageMaker JumpStart এর সাথে, ML অনুশীলনকারীরা সর্বজনীনভাবে উপলব্ধ ফাউন্ডেশন মডেলগুলির একটি বিস্তৃত নির্বাচন থেকে বেছে নিতে পারেন। এমএল অনুশীলনকারীরা ডেডিকেটেডদের জন্য ভিত্তি মডেল স্থাপন করতে পারে আমাজন সেজমেকার একটি নেটওয়ার্ক বিচ্ছিন্ন পরিবেশ থেকে উদাহরণ এবং মডেল প্রশিক্ষণ এবং স্থাপনার জন্য SageMaker ব্যবহার করে মডেলগুলি কাস্টমাইজ করুন। আপনি এখন সেজমেকার স্টুডিওতে কয়েকটি ক্লিকের মাধ্যমে বা প্রোগ্রাম্যাটিকভাবে সেজমেকার পাইথন SDK-এর মাধ্যমে Llama 2 আবিষ্কার এবং স্থাপন করতে পারেন, যা আপনাকে SageMaker বৈশিষ্ট্যগুলির সাথে মডেল পারফরম্যান্স এবং MLOps নিয়ন্ত্রণগুলি অর্জন করতে সক্ষম করে যেমন অ্যামাজন সেজমেকার পাইপলাইন, আমাজন সেজমেকার ডিবাগার, বা ধারক লগ. মডেলটি একটি AWS সুরক্ষিত পরিবেশে এবং আপনার VPC নিয়ন্ত্রণের অধীনে স্থাপন করা হয়েছে, যা ডেটা নিরাপত্তা নিশ্চিত করতে সহায়তা করে। এছাড়াও, আপনি সেজমেকার জাম্পস্টার্টের মাধ্যমে Llama2 7B, 13B, এবং 70B প্রাক-প্রশিক্ষিত পাঠ্য প্রজন্মের মডেলগুলিকে ফাইন-টিউন করতে পারেন।

ফাইন-টিউন Llama2 মডেল

আপনি SageMaker Studio UI বা SageMaker Python SDK ব্যবহার করে মডেলগুলিকে সূক্ষ্ম-টিউন করতে পারেন। আমরা এই বিভাগে উভয় পদ্ধতি আলোচনা.

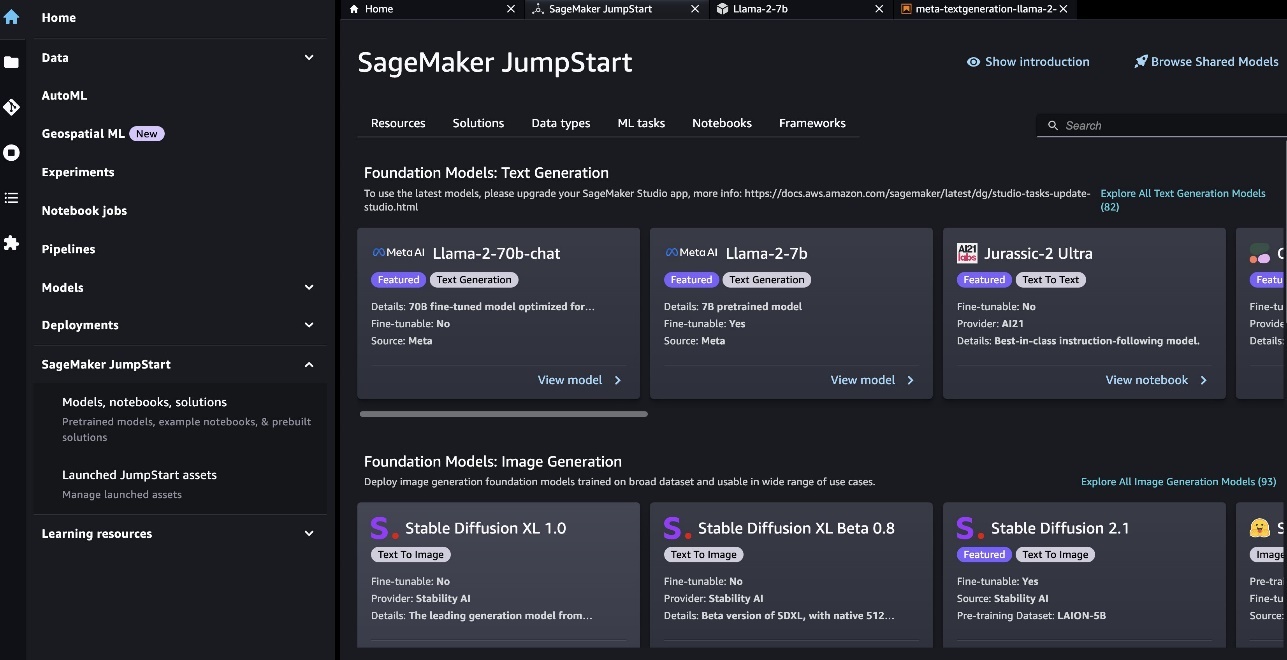

SageMaker স্টুডিও UI এর মাধ্যমে নো-কোড ফাইন-টিউনিং

সেজমেকার স্টুডিওতে, আপনি সেজমেকার জাম্পস্টার্ট এর অধীনে লামা 2 মডেল অ্যাক্সেস করতে পারেন মডেল, নোটবুক, এবং সমাধান, নিম্নলিখিত স্ক্রিনশট হিসাবে দেখানো হয়েছে।

আপনি যদি Llama 2 মডেল দেখতে না পান, তাহলে বন্ধ করে এবং পুনরায় চালু করে আপনার SageMaker স্টুডিও সংস্করণ আপডেট করুন। সংস্করণ আপডেট সম্পর্কে আরও তথ্যের জন্য, পড়ুন বন্ধ করুন এবং স্টুডিও অ্যাপ আপডেট করুন.

আপনি পছন্দ করে অন্য চারটি মডেলের বৈকল্পিকও খুঁজে পেতে পারেন সমস্ত টেক্সট জেনারেশন মডেল অন্বেষণ করুন অথবা সার্চ বক্সে লামা খুঁজছেন।

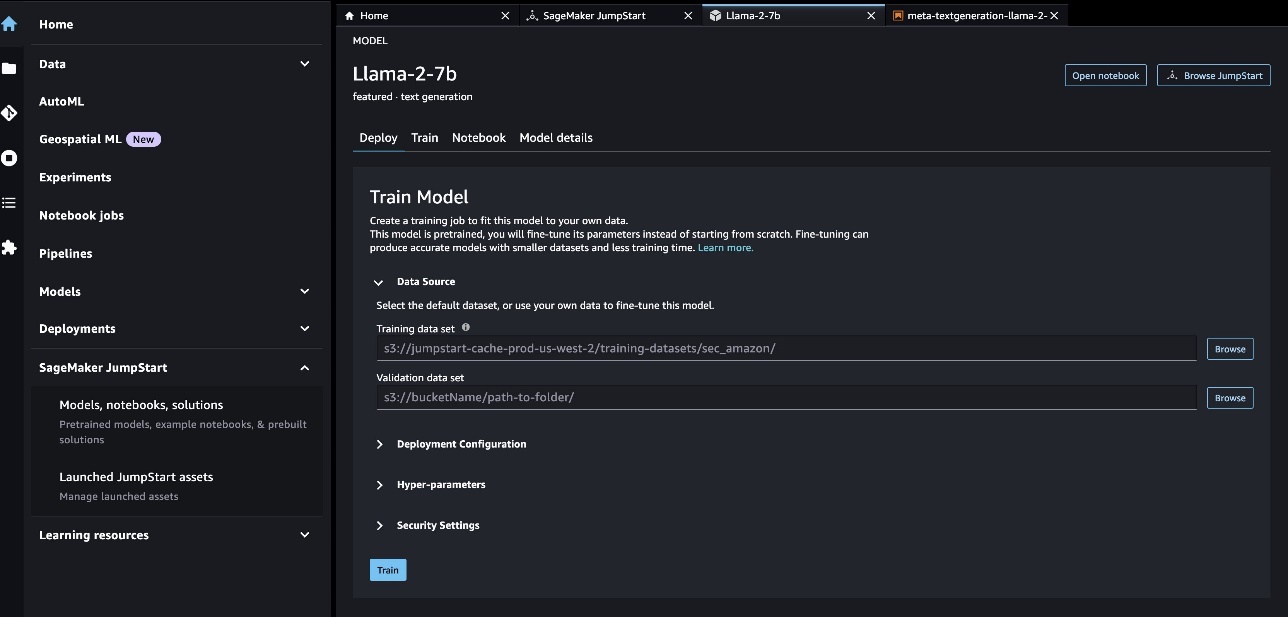

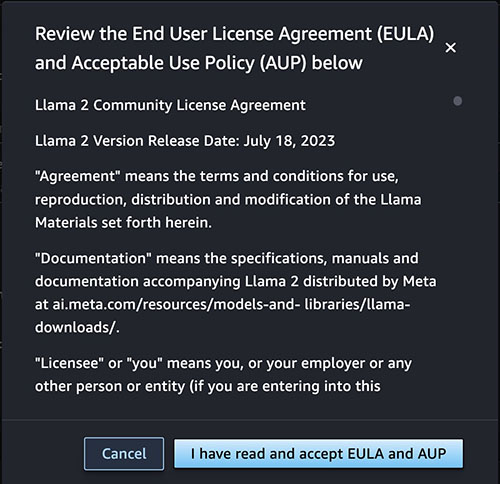

এই পৃষ্ঠায়, আপনি নির্দেশ করতে পারেন আমাজন সিম্পল স্টোরেজ সার্ভিস (Amazon S3) ফাইন-টিউনিংয়ের জন্য প্রশিক্ষণ এবং বৈধতা ডেটাসেট ধারণকারী বালতি। উপরন্তু, আপনি ফাইন-টিউনিংয়ের জন্য স্থাপনার কনফিগারেশন, হাইপারপ্যারামিটার এবং নিরাপত্তা সেটিংস কনফিগার করতে পারেন। আপনি তারপর চয়ন করতে পারেন রেলগাড়ি একটি সেজমেকার এমএল উদাহরণে প্রশিক্ষণের কাজ শুরু করতে। পূর্ববর্তী স্ক্রিনশট Llama-2 7B মডেলের জন্য ফাইন-টিউনিং পৃষ্ঠা দেখায়; যাইহোক, আপনি একইভাবে তাদের নিজ নিজ মডেল পৃষ্ঠাগুলি ব্যবহার করে 13B এবং 70B Llama 2 পাঠ্য প্রজন্মের মডেলগুলিকে সূক্ষ্ম-টিউন করতে পারেন। Llama 2 মডেল ব্যবহার করতে, আপনাকে শেষ ব্যবহারকারী লাইসেন্স চুক্তি (EULA) গ্রহণ করতে হবে। আপনি যখন চয়ন করেন তখন এটি প্রদর্শিত হবে রেলগাড়ি, নিম্নলিখিত স্ক্রিনশটে দেখানো হয়েছে। পছন্দ করা আমি EULA এবং AUP পড়েছি এবং গ্রহণ করেছি ফাইন-টিউনিং কাজ শুরু করতে।

মডেল মোতায়েন করুন

মডেলটি ফাইন-টিউন করার পরে, আপনি SageMaker JumpStart-এ মডেল পৃষ্ঠা ব্যবহার করে এটি স্থাপন করতে পারেন। ফাইন-টিউনিং সম্পন্ন হলে ফাইন-টিউনড মডেল স্থাপন করার বিকল্পটি প্রদর্শিত হবে, যেমনটি নিম্নলিখিত স্ক্রিনশটে দেখানো হয়েছে।

SageMaker Python SDK-এর মাধ্যমে ফাইন-টিউন

আপনি সেজমেকার পাইথন SDK ব্যবহার করে লামা 2 মডেলগুলিকে সূক্ষ্ম-টিউন করতে পারেন। আপনার ডেটাসেটে Llama 2 7B সূক্ষ্ম-টিউন করার জন্য নিম্নলিখিত একটি নমুনা কোড:

আপনি অনুমানকারী থেকে সরাসরি সূক্ষ্ম-টিউনড মডেল স্থাপন করতে পারেন:

এছাড়াও আপনি কোড খুঁজে পেতে পারেন সেজমেকার জাম্প স্টার্টে LLaMA 2 মডেলের সূক্ষ্ম সুর. এতে ডেটাসেট প্রস্তুতি, আপনার কাস্টম ডেটাসেটের প্রশিক্ষণ এবং সূক্ষ্ম-টিউনড মডেল স্থাপন অন্তর্ভুক্ত রয়েছে। এটি ডলি ডেটাসেটের একটি উপসেটে সূক্ষ্ম-টিউনিং প্রদর্শন করে, যার সংক্ষিপ্তকরণ টাস্কের উদাহরণ রয়েছে। গ্রাউন্ড ট্রুথ রেসপন্স সহ ফাইন-টিউনড এবং নন-ফাইন-টিউনড থেকে প্রতিক্রিয়া সহ নিম্নলিখিত উদাহরণ ইনপুট:

মডেল ইনপুট:

স্থল সত্য প্রতিক্রিয়া:

নন ফাইন-টিউনড মডেল থেকে প্রতিক্রিয়া:

সূক্ষ্ম সুর করা মডেল থেকে প্রতিক্রিয়া:

ডলি এবং ডায়ালগসাম ডেটাসেটে বিভিন্ন মডেলের পারফরম্যান্স বেঞ্চমার্কিংয়ের জন্য, দেখুন কর্মক্ষমতা বেঞ্চমার্কিং এই পোস্টের শেষে পরিশিষ্টে বিভাগ।

ফাইন-টিউনিং কৌশল

ভাষা মডেল যেমন লামা 10 জিবি বা এমনকি 100 গিগাবাইট আকারেরও বেশি। এই ধরনের বড় মডেলের ফাইন-টিউনিংয়ের জন্য উল্লেখযোগ্যভাবে উচ্চ CUDA মেমরি সহ উদাহরণ প্রয়োজন। তদ্ব্যতীত, মডেলের আকারের কারণে এই মডেলগুলিকে প্রশিক্ষণ দেওয়া খুব ধীর হতে পারে। অতএব, দক্ষ সূক্ষ্ম টিউনিংয়ের জন্য, আমরা নিম্নলিখিত অপ্টিমাইজেশানগুলি ব্যবহার করি:

- নিম্ন-র্যাঙ্ক অভিযোজন (LoRA) - এটি বড় মডেলের দক্ষ ফাইন-টিউনিং এর জন্য এক ধরণের প্যারামিটার দক্ষ ফাইন-টিউনিং (PEFT)। এতে, আমরা পুরো মডেলটি হিমায়িত করি এবং মডেলটিতে শুধুমাত্র সামঞ্জস্যযোগ্য প্যারামিটার বা স্তরগুলির একটি ছোট সেট যুক্ত করি। উদাহরণস্বরূপ, Llama 7 2B-এর জন্য সমস্ত 7 বিলিয়ন প্যারামিটার প্রশিক্ষণের পরিবর্তে, আমরা প্যারামিটারের 1% এরও কম সূক্ষ্ম-টিউন করতে পারি। এটি মেমরির প্রয়োজনীয়তা উল্লেখযোগ্যভাবে হ্রাস করতে সহায়তা করে কারণ আমাদের শুধুমাত্র 1% প্যারামিটারের জন্য গ্রেডিয়েন্ট, অপ্টিমাইজার স্টেট এবং অন্যান্য প্রশিক্ষণ-সম্পর্কিত তথ্য সংরক্ষণ করতে হবে। তদ্ব্যতীত, এটি প্রশিক্ষণের সময় এবং খরচ কমাতে সহায়তা করে। এই পদ্ধতি সম্পর্কে আরো বিস্তারিত জানার জন্য, পড়ুন LoRA: বড় ভাষার মডেলের নিম্ন-র্যাঙ্ক অভিযোজন.

- Int8 কোয়ান্টাইজেশন - এমনকি LoRA এর মতো অপ্টিমাইজেশনের সাথেও, Llama 70B-এর মতো মডেলগুলি এখনও প্রশিক্ষণের জন্য অনেক বড়৷ প্রশিক্ষণের সময় মেমরির পদচিহ্ন কমাতে, আমরা প্রশিক্ষণের সময় Int8 কোয়ান্টাইজেশন ব্যবহার করতে পারি। কোয়ান্টাইজেশন সাধারণত ফ্লোটিং পয়েন্ট ডেটা প্রকারের নির্ভুলতা হ্রাস করে। যদিও এটি মডেলের ওজন সঞ্চয় করার জন্য প্রয়োজনীয় মেমরি হ্রাস করে, তথ্য হারানোর কারণে এটি কর্মক্ষমতা হ্রাস করে। Int8 কোয়ান্টাইজেশন শুধুমাত্র এক চতুর্থাংশ নির্ভুলতা ব্যবহার করে কিন্তু কার্যক্ষমতার অবনতি ঘটায় না কারণ এটি কেবল বিটগুলিকে ড্রপ করে না। এটি ডেটাকে এক প্রকার থেকে অন্য প্রকারে বৃত্তাকার করে। Int8 কোয়ান্টাইজেশন সম্পর্কে জানতে, পড়ুন LLM.int8(): স্কেলে ট্রান্সফরমারের জন্য 8-বিট ম্যাট্রিক্স গুণন.

- সম্পূর্ণরূপে শার্ডেড ডেটা প্যারালাল (FSDP) – এটি এক ধরনের ডেটা-সমান্তরাল প্রশিক্ষণ অ্যালগরিদম যা ডেটা সমান্তরাল কর্মীদের জুড়ে মডেলের প্যারামিটারগুলিকে শার্ড করে এবং ঐচ্ছিকভাবে CPU-তে প্রশিক্ষণ গণনার অংশ অফলোড করতে পারে। যদিও প্যারামিটারগুলি বিভিন্ন জিপিইউ জুড়ে শার্ড করা হয়েছে, প্রতিটি মাইক্রোব্যাচের গণনা GPU কর্মীর কাছে স্থানীয়। এটি পরামিতিগুলিকে আরও সমানভাবে শার্ড করে এবং প্রশিক্ষণের সময় যোগাযোগ এবং গণনার ওভারল্যাপিংয়ের মাধ্যমে অপ্টিমাইজ করা কর্মক্ষমতা অর্জন করে।

নিম্নলিখিত টেবিলটি তিনটি লামা 2 মডেলের সাথে বিভিন্ন পদ্ধতির তুলনা করে।

| , | ডিফল্ট ইনস্ট্যান্স টাইপ | ডিফল্ট কনফিগারেশন সহ সমর্থিত ইনস্ট্যান্স প্রকার | পূর্বনির্ধারিত সেটিং | LORA + FSDP | LORA + FSDP নেই | Int8 কোয়ান্টাইজেশন + LORA + FSDP নেই |

| লামা 2 7B | ml.g5.12x বড় | ml.g5.12xlarge, ml.g5.24xlarge, ml.g5.48xlarge | LORA + FSDP | হাঁ | হাঁ | হাঁ |

| লামা 2 13B | ml.g5.12x বড় | ml.g5.24xlarge, ml.g5.48xlarge | LORA + FSDP | হাঁ | হাঁ | হাঁ |

| লামা 2 70B | ml.g5.48x বড় | ml.g5.48x বড় | INT8 + LORA + NO FSDP | না | না | হাঁ |

উল্লেখ্য যে লামা মডেলগুলির ফাইন-টিউনিং নিম্নলিখিত দ্বারা প্রদত্ত স্ক্রিপ্টের উপর ভিত্তি করে গিটহুব রেপো.

প্রশিক্ষণ ডেটাসেট বিন্যাস

সেজমেকার জাম্পস্টার্ট বর্তমানে ডোমেন অভিযোজন বিন্যাস এবং নির্দেশনা টিউনিং বিন্যাসে উভয় ডেটাসেট সমর্থন করে। এই বিভাগে, আমরা উভয় ফর্ম্যাটে একটি উদাহরণ ডেটাসেট নির্দিষ্ট করি। আরো বিস্তারিত জানার জন্য, দেখুন ডেটাসেট বিন্যাস পরিশিষ্টে বিভাগ।

ডোমেন অভিযোজন বিন্যাস

টেক্সট জেনারেশন লামা 2 মডেল যেকোন ডোমেন-নির্দিষ্ট ডেটাসেটে ফাইন-টিউন করা যেতে পারে। এটি ডোমেন-নির্দিষ্ট ডেটাসেটে সূক্ষ্ম-টিউন করার পরে, মডেলটি ডোমেন-নির্দিষ্ট পাঠ্য তৈরি করবে এবং কয়েকটি-শট প্রম্পটিং সহ সেই নির্দিষ্ট ডোমেনে বিভিন্ন NLP কাজগুলি সমাধান করবে বলে আশা করা হচ্ছে। এই ডেটাসেটের সাথে, ইনপুট একটি CSV, JSON, বা TXT ফাইল নিয়ে গঠিত। উদাহরণস্বরূপ, ইনপুট ডেটা একটি পাঠ্য ফাইল হিসাবে অ্যামাজনের এসইসি ফাইলিং হতে পারে:

নির্দেশ টিউনিং বিন্যাস

নির্দেশনা ফাইন-টিউনিং-এ, নির্দেশাবলী ব্যবহার করে বর্ণিত প্রাকৃতিক ভাষা প্রক্রিয়াকরণ (NLP) কাজের একটি সেটের জন্য মডেলটি সূক্ষ্ম-টিউন করা হয়েছে। এটি জিরো-শট প্রম্পট সহ অদেখা কাজগুলির জন্য মডেলের কর্মক্ষমতা উন্নত করতে সহায়তা করে। নির্দেশনা টিউনিং ডেটাসেট বিন্যাসে, আপনি নির্দিষ্ট করুন template.json ফাইল ইনপুট এবং আউটপুট ফরম্যাট বর্ণনা করে। উদাহরণস্বরূপ, ফাইলের প্রতিটি লাইন train.jsonl নিম্নলিখিত মত দেখাচ্ছে:

অতিরিক্ত ফাইল template.json নিম্নলিখিত মত দেখাচ্ছে:

প্রশিক্ষণের জন্য সমর্থিত হাইপারপ্যারামিটার

Llama 2 ফাইন-টিউনিং বেশ কয়েকটি হাইপারপ্যারামিটার সমর্থন করে, যার প্রতিটি মেমরির প্রয়োজনীয়তা, প্রশিক্ষণের গতি এবং সূক্ষ্ম-টিউনড মডেলের কর্মক্ষমতাকে প্রভাবিত করতে পারে:

- কাল - প্রশিক্ষণ ডেটাসেটের মাধ্যমে ফাইন-টিউনিং অ্যালগরিদম যে পাসগুলি নেয়। 1 এর থেকে বড় একটি পূর্ণসংখ্যা হতে হবে। ডিফল্ট হল 5।

- শেখার_হার - প্রশিক্ষণ উদাহরণের প্রতিটি ব্যাচের মাধ্যমে কাজ করার পরে মডেলের ওজনগুলি যে হারে আপডেট করা হয়। 0-এর চেয়ে বড় একটি ধনাত্মক ফ্লোট হতে হবে। ডিফল্ট হল 1e-4।

- instruction_tuned - মডেলটিকে নির্দেশনা-প্রশিক্ষণ দিতে হবে কি না। অবশ্যই '

True'বা'False' ডিফল্ট হল 'False'. - প্রতি_ডিভাইস_ট্রেন_ব্যাচ_সাইজ - প্রশিক্ষণের জন্য GPU কোর/CPU প্রতি ব্যাচের আকার। একটি ধনাত্মক পূর্ণসংখ্যা হতে হবে। ডিফল্ট হল 4।

- per_device_eval_batch_size - মূল্যায়নের জন্য GPU কোর/CPU প্রতি ব্যাচের আকার। একটি ধনাত্মক পূর্ণসংখ্যা হতে হবে। ডিফল্ট হল 1।

- max_train_samples – ডিবাগিং উদ্দেশ্যে বা দ্রুত প্রশিক্ষণের জন্য, প্রশিক্ষণের উদাহরণের সংখ্যা এই মান থেকে ছেঁটে দিন। মান -1 মানে প্রশিক্ষণের সমস্ত নমুনা ব্যবহার করা। একটি ধনাত্মক পূর্ণসংখ্যা বা -1 হতে হবে। ডিফল্ট হল -1।

- সর্বোচ্চ_ভাল_নমুনা - ডিবাগিং উদ্দেশ্যে বা দ্রুত প্রশিক্ষণের জন্য, এই মানটিতে বৈধকরণ উদাহরণের সংখ্যা ছেঁটে দিন। মান -1 মানে সমস্ত বৈধকরণ নমুনা ব্যবহার করা। একটি ধনাত্মক পূর্ণসংখ্যা বা -1 হতে হবে। ডিফল্ট হল -1।

- সর্বাধিক_ইনপুট_দৈর্ঘ্য - টোকেনাইজেশনের পরে সর্বাধিক মোট ইনপুট ক্রম দৈর্ঘ্য। এর থেকে দীর্ঘ ক্রমগুলি কাটা হবে৷ যদি -1,

max_input_lengthটোকেনাইজার দ্বারা সংজ্ঞায়িত সর্বনিম্ন 1024 এবং সর্বাধিক মডেল দৈর্ঘ্য সেট করা হয়। যদি একটি ইতিবাচক মান সেট করা হয়,max_input_lengthপ্রদত্ত মানের সর্বনিম্ন সেট করা হয় এবংmodel_max_lengthটোকেনাইজার দ্বারা সংজ্ঞায়িত। একটি ধনাত্মক পূর্ণসংখ্যা বা -1 হতে হবে। ডিফল্ট হল -1। - বৈধতা_বিভাজন_অনুপাত - যদি বৈধতা চ্যানেল হয়

none, ট্রেন ডেটা থেকে ট্রেন-ভ্যালিডেশন স্প্লিটের অনুপাত 0-1 এর মধ্যে হতে হবে। ডিফল্ট 0.2। - ট্রেন_ডেটা_বিভক্ত_বীজ - যদি বৈধতা ডেটা উপস্থিত না থাকে, তাহলে এটি অ্যালগরিদম দ্বারা ব্যবহৃত প্রশিক্ষণ এবং বৈধতা ডেটাতে ইনপুট প্রশিক্ষণ ডেটার এলোমেলো বিভাজন ঠিক করে৷ একটি পূর্ণসংখ্যা হতে হবে. ডিফল্ট 0।

- প্রিপ্রসেসিং_সংখ্যা_কর্মী - প্রিপ্রসেসিংয়ের জন্য ব্যবহার করার জন্য প্রসেসের সংখ্যা। যদি

None, প্রধান প্রক্রিয়া preprocessing জন্য ব্যবহৃত হয়. ডিফল্ট হয়None. - lora_r - Lora R. একটি ধনাত্মক পূর্ণসংখ্যা হতে হবে। ডিফল্ট 8।

- lora_alpha - লোরা আলফা। একটি ধনাত্মক পূর্ণসংখ্যা হতে হবে। ডিফল্ট হল 32

- lora_dropout - লোরা ড্রপআউট। 0 এবং 1 এর মধ্যে একটি ইতিবাচক ফ্লোট হওয়া আবশ্যক। ডিফল্ট হল 0.05।

- int8_পরিমাণকরণ - যদি

True, মডেলটি প্রশিক্ষণের জন্য 8-বিট নির্ভুলতার সাথে লোড করা হয়। 7B এবং 13B এর জন্য ডিফল্টFalse. 70B এর জন্য ডিফল্টTrue. - enable_fsdp - যদি

True, প্রশিক্ষণ FSDP ব্যবহার করে। 7B এবং 13B এর জন্য ডিফল্টTrue. 70B এর জন্য ডিফল্টFalse। মনে রাখবেন যেint8_quantizationFSDP এর সাথে সমর্থিত নয়।

উদাহরণ প্রকার এবং সামঞ্জস্যপূর্ণ হাইপারপ্যারামিটার

ফাইন-টিউনিংয়ের সময় মেমরির প্রয়োজনীয়তা বিভিন্ন কারণের উপর ভিত্তি করে পরিবর্তিত হতে পারে:

- মডেলের ধরন – 7B মডেলের সর্বনিম্ন GPU মেমরির প্রয়োজন এবং 70B-এর মেমরির প্রয়োজন সবচেয়ে বেশি

- সর্বোচ্চ ইনপুট দৈর্ঘ্য - ইনপুট দৈর্ঘ্যের একটি উচ্চ মান এক সময়ে আরও টোকেন প্রক্রিয়াকরণের দিকে পরিচালিত করে এবং এর জন্য আরও CUDA মেমরির প্রয়োজন হয়

- ব্যাচ আকার - একটি বড় ব্যাচের আকারের জন্য বৃহত্তর CUDA মেমরির প্রয়োজন এবং সেইজন্য বড় ধরনের উদাহরণের প্রয়োজন

- Int8 কোয়ান্টাইজেশন - যদি Int8 কোয়ান্টাইজেশন ব্যবহার করা হয়, মডেলটি কম নির্ভুলতায় লোড হয় এবং তাই কম CUDA মেমরির প্রয়োজন হয়

আপনাকে শুরু করতে সাহায্য করার জন্য, আমরা বিভিন্ন দৃষ্টান্তের ধরন, হাইপারপ্যারামিটার এবং মডেল প্রকারের সংমিশ্রণের একটি সেট সরবরাহ করি যা সফলভাবে সূক্ষ্ম-টিউন করা যেতে পারে। আপনি আপনার প্রয়োজনীয়তা এবং উদাহরণ প্রকারের প্রাপ্যতা অনুযায়ী একটি কনফিগারেশন নির্বাচন করতে পারেন। আমরা সারসংক্ষেপ উদাহরণ সহ ডলি ডেটাসেটের একটি উপসেটে তিনটি যুগের সাথে বিভিন্ন সেটিংসে তিনটি মডেলকে ফাইন-টিউন করি।

7B মডেল

নিম্নলিখিত সারণীটি 7B মডেলের ফাইন-টিউনিং বিকল্পগুলির সংক্ষিপ্ত বিবরণ দেয়৷

| ইনস্ট্যান্স টাইপ | সর্বোচ্চ ইনপুট লেন | প্রতি ডিভাইস ব্যাচ আকার | Int8 কোয়ান্টাইজেশন | FSDP সক্ষম করুন | নেওয়া সময় (মিনিট) |

| ml.g4dn.12x বড় | 1024 | 8 | 'সত্য' | মিথ্যা | 166 |

| ml.g4dn.12x বড় | 2048 | 2 | 'সত্য' | মিথ্যা | 178 |

| ml.g4dn.12x বড় | 1024 | 4 | মিথ্যা | 'সত্য' | 120 |

| ml.g4dn.12x বড় | 2048 | 2 | মিথ্যা | 'সত্য' | 143 |

| ml.g5.2x বড় | 1024 | 4 | 'সত্য' | মিথ্যা | 61 |

| ml.g5.2x বড় | 2048 | 2 | 'সত্য' | মিথ্যা | 68 |

| ml.g5.2x বড় | 1024 | 4 | মিথ্যা | 'সত্য' | 43 |

| ml.g5.2x বড় | 2048 | 2 | মিথ্যা | 'সত্য' | 49 |

| ml.g5.4x বড় | 1024 | 4 | মিথ্যা | 'সত্য' | 39 |

| ml.g5.4x বড় | 2048 | 2 | মিথ্যা | 'সত্য' | 50 |

| ml.g5.12x বড় | 1024 | 16 | 'সত্য' | মিথ্যা | 57 |

| ml.g5.12x বড় | 2048 | 4 | 'সত্য' | মিথ্যা | 64 |

| ml.g5.12x বড় | 1024 | 4 | মিথ্যা | 'সত্য' | 26 |

| ml.g5.12x বড় | 2048 | 4 | মিথ্যা | 'সত্য' | 23 |

| ml.g5.48x বড় | 1024 | 16 | 'সত্য' | মিথ্যা | 59 |

| ml.g5.48x বড় | 2048 | 4 | 'সত্য' | মিথ্যা | 67 |

| ml.g5.48x বড় | 1024 | 8 | মিথ্যা | 'সত্য' | 22 |

| ml.g5.48x বড় | 2048 | 4 | মিথ্যা | 'সত্য' | 21 |

13B

নিম্নলিখিত সারণীটি 13B মডেলের ফাইন-টিউনিং বিকল্পগুলির সংক্ষিপ্ত বিবরণ দেয়৷

| ইনস্ট্যান্স টাইপ | সর্বোচ্চ ইনপুট লেন | প্রতি ডিভাইস ব্যাচ আকার | Int8 কোয়ান্টাইজেশন | FSDP সক্ষম করুন | নেওয়া সময় (মিনিট) |

| ml.g4dn.12x বড় | 1024 | 4 | 'সত্য' | মিথ্যা | 283 |

| ml.g4dn.12x বড় | 2048 | 2 | 'সত্য' | মিথ্যা | 328 |

| ml.g5.12x বড় | 1024 | 8 | 'সত্য' | মিথ্যা | 92 |

| ml.g5.12x বড় | 2048 | 4 | 'সত্য' | মিথ্যা | 104 |

| ml.g5.48x বড় | 1024 | 8 | 'সত্য' | মিথ্যা | 95 |

| ml.g5.48x বড় | 2048 | 4 | 'সত্য' | মিথ্যা | 107 |

| ml.g5.48x বড় | 1024 | 8 | মিথ্যা | 'সত্য' | 35 |

| ml.g5.48x বড় | 2048 | 2 | মিথ্যা | 'সত্য' | 41 |

70B

নিম্নলিখিত সারণীটি 70B মডেলের ফাইন-টিউনিং বিকল্পগুলির সংক্ষিপ্ত বিবরণ দেয়৷

| ইনস্ট্যান্স টাইপ | সর্বোচ্চ ইনপুট লেন | প্রতি ডিভাইস ব্যাচ আকার | Int8 কোয়ান্টাইজেশন | FSDP সক্ষম করুন | নেওয়া সময় (মিনিট) |

| ml.g5.48x বড় | 1024 | 4 | 'সত্য' | মিথ্যা | 396 |

| ml.g5.48x বড় | 2048 | 1 | 'সত্য' | মিথ্যা | 454 |

উদাহরণের ধরন এবং হাইপারপ্যারামিটারের উপর সুপারিশ

মডেলের নির্ভুলতা ফাইন-টিউনিং করার সময়, নিম্নলিখিতগুলি মনে রাখবেন:

- বড় মডেল যেমন 70B 7B থেকে ভালো পারফরম্যান্স প্রদান করে

- Int8 কোয়ান্টাইজেশন ছাড়া পারফরম্যান্স INT8 কোয়ান্টাইজেশনের সাথে পারফরম্যান্সের চেয়ে ভাল

নিম্নলিখিত প্রশিক্ষণ সময় এবং CUDA মেমরি প্রয়োজনীয়তা নোট করুন:

- বিন্যাস

int8_quantization=Trueমেমরির প্রয়োজনীয়তা হ্রাস করে এবং দ্রুত প্রশিক্ষণের দিকে পরিচালিত করে। - কমে

per_device_train_batch_sizeএবংmax_input_lengthমেমরির প্রয়োজনীয়তা হ্রাস করে এবং তাই ছোট ক্ষেত্রে চালানো যেতে পারে। যাইহোক, খুব কম মান সেট করা প্রশিক্ষণের সময় বাড়িয়ে দিতে পারে। - আপনি যদি Int8 কোয়ান্টাইজেশন ব্যবহার না করেন (

int8_quantization=False), FSDP ব্যবহার করুন (enable_fsdp=True) দ্রুত এবং দক্ষ প্রশিক্ষণের জন্য।

উদাহরণ টাইপ নির্বাচন করার সময়, নিম্নলিখিত বিবেচনা করুন:

- G5 দৃষ্টান্ত সমর্থিত উদাহরণ প্রকারের মধ্যে সবচেয়ে দক্ষ প্রশিক্ষণ প্রদান করে। অতএব, যদি আপনার কাছে G5 দৃষ্টান্ত উপলব্ধ থাকে, তাহলে আপনার সেগুলি ব্যবহার করা উচিত।

- প্রশিক্ষণের সময় মূলত নির্ভর করে GPU এর সংখ্যা এবং উপলব্ধ CUDA মেমরির উপর। তাই, একই সংখ্যক জিপিইউ সহ উদাহরণের প্রশিক্ষণ (উদাহরণস্বরূপ, ml.g5.2xlarge এবং ml.g5.4xlarge) মোটামুটি একই। অতএব, আপনি প্রশিক্ষণের জন্য সস্তা উদাহরণ ব্যবহার করতে পারেন (ml.g5.2xlarge)।

- p3 দৃষ্টান্ত ব্যবহার করার সময়, প্রশিক্ষণ 32-বিট নির্ভুলতার সাথে সম্পন্ন করা হবে কারণ এই উদাহরণগুলিতে bfloat16 সমর্থিত নয়। তাই, প্রশিক্ষণের কাজটি g3 দৃষ্টান্তের তুলনায় p5 দৃষ্টান্তে প্রশিক্ষণের সময় CUDA মেমরির দ্বিগুণ পরিমাণ খরচ করবে।

প্রতি উদাহরণে প্রশিক্ষণের খরচ সম্পর্কে জানতে, পড়ুন Amazon EC2 G5 দৃষ্টান্ত.

যদি ডেটাসেটটি নির্দেশনা টিউনিং বিন্যাসে থাকে এবং ইনপুট+সম্পূর্ণতা ক্রমগুলি ছোট হয় (যেমন 50-100 শব্দ), তাহলে এর উচ্চ মান max_input_length খুব খারাপ কর্মক্ষমতা বাড়ে. এই প্যারামিটারের ডিফল্ট মান হল -1, যা এর সাথে মিলে যায় max_input_length লামা মডেলের জন্য 2048 সালের। অতএব, আমরা সুপারিশ করি যে যদি আপনার ডেটাসেটে ছোট নমুনা থাকে তবে এর জন্য একটি ছোট মান ব্যবহার করুন max_input_length (যেমন 200-400)।

অবশেষে, G5 দৃষ্টান্তগুলির উচ্চ চাহিদার কারণে, আপনি ত্রুটি সহ আপনার অঞ্চলে এই উদাহরণগুলির অনুপলব্ধতা অনুভব করতে পারেন “CapacityError: Unable to provision requested ML compute capacity. Please retry using a different ML instance type.” আপনি যদি এই ত্রুটিটি অনুভব করেন, প্রশিক্ষণের কাজটি আবার চেষ্টা করুন বা একটি ভিন্ন অঞ্চল চেষ্টা করুন৷

খুব বড় মডেলের ফাইন-টিউনিং করার সময় সমস্যা

এই বিভাগে, আমরা খুব বড় মডেলের ফাইন-টিউনিং করার সময় দুটি বিষয় নিয়ে আলোচনা করি।

আউটপুট কম্প্রেশন অক্ষম করুন

ডিফল্টরূপে, একটি প্রশিক্ষণ কাজের আউটপুট হল একটি প্রশিক্ষিত মডেল যা Amazon S3 এ আপলোড করার আগে .tar.gz ফরম্যাটে সংকুচিত হয়। যাইহোক, মডেলের বড় আকারের কারণে, এই পদক্ষেপটি দীর্ঘ সময় নিতে পারে। উদাহরণস্বরূপ, 70B মডেলটি সংকুচিত এবং আপলোড করতে 4 ঘন্টার বেশি সময় লাগতে পারে৷ এই সমস্যাটি এড়াতে, আপনি SageMaker প্রশিক্ষণ প্ল্যাটফর্ম দ্বারা সমর্থিত অক্ষম আউটপুট কম্প্রেশন বৈশিষ্ট্য ব্যবহার করতে পারেন। এই ক্ষেত্রে, মডেলটি কোনো কম্প্রেশন ছাড়াই আপলোড করা হয়, যা আরও স্থাপনের জন্য ব্যবহার করা হয়:

সেজমেকার স্টুডিও কার্নেল টাইমআউট সমস্যা

Llama 70B মডেলের আকারের কারণে, প্রশিক্ষণের কাজটি কয়েক ঘন্টা সময় নিতে পারে এবং সেজমেকার স্টুডিও কার্নেল প্রশিক্ষণের পর্যায়ে মারা যেতে পারে। তবে, এই সময়ের মধ্যে, সেজমেকারে এখনও প্রশিক্ষণ চলছে। যদি এটি ঘটে, আপনি এখনও নিম্নলিখিত কোড সহ প্রশিক্ষণ কাজের নাম ব্যবহার করে শেষ পয়েন্ট স্থাপন করতে পারেন:

প্রশিক্ষণ কাজের নাম খুঁজতে, SageMaker কনসোলে এবং নীচে নেভিগেট করুন প্রশিক্ষণ নেভিগেশন ফলকে, নির্বাচন করুন প্রশিক্ষণ কাজ. প্রশিক্ষণ কাজের নাম চিহ্নিত করুন এবং পূর্ববর্তী কোডে এটি প্রতিস্থাপন করুন।

উপসংহার

এই পোস্টে, আমরা সেজমেকার জাম্পস্টার্ট ব্যবহার করে মেটার লামা 2 মডেলের ফাইন-টিউনিং নিয়ে আলোচনা করেছি। আমরা দেখিয়েছি যে আপনি SageMaker স্টুডিওতে SageMaker জাম্পস্টার্ট কনসোল বা SageMaker Python SDK ব্যবহার করতে পারেন এই মডেলগুলিকে সূক্ষ্ম-টিউন করতে এবং স্থাপন করতে। আমরা ফাইন-টিউনিং কৌশল, উদাহরণের ধরন এবং সমর্থিত হাইপারপ্যারামিটার নিয়েও আলোচনা করেছি। উপরন্তু, আমরা বিভিন্ন পরীক্ষা-নিরীক্ষার উপর ভিত্তি করে অপ্টিমাইজড প্রশিক্ষণের জন্য সুপারিশগুলি তুলে ধরেছি। দুটি ডেটাসেটের উপর তিনটি মডেলের ফাইন-টিউনিংয়ের ফলাফল এই পোস্টের শেষে পরিশিষ্টে দেখানো হয়েছে। আমরা এই ফলাফলগুলি থেকে দেখতে পাচ্ছি, ফাইন-টিউনিং নন-ফাইন-টিউনড মডেলের তুলনায় সারসংক্ষেপকে উন্নত করে। পরবর্তী পদক্ষেপ হিসাবে, আপনি আপনার ব্যবহারের ক্ষেত্রে ফলাফলগুলি পরীক্ষা এবং বেঞ্চমার্ক করার জন্য GitHub সংগ্রহস্থলে প্রদত্ত কোড ব্যবহার করে আপনার নিজস্ব ডেটাসেটে এই মডেলগুলিকে ফাইন-টিউন করার চেষ্টা করতে পারেন।

লেখকরা ক্রিস্টোফার হুইটেন, জিন হুয়াং, কাইল উলরিচ, সিফেই লি, অ্যামি ইউ, অ্যাডাম কোজড্রোভিজ, ইভান ক্রাভিটজ, বেঞ্জামিন ক্র্যাবট্রি, হাওটিয়ান আন, মানান শাহ, টনি ক্রুজ, এরনেভ শর্মা, জোনাথন গুইনেগেন এবং জুনের প্রযুক্তিগত অবদানের স্বীকৃতি দিতে চান। জিতেছে।

লেখক সম্পর্কে

বিবেক মদন ড অ্যামাজন সেজমেকার জাম্পস্টার্ট দলের একজন ফলিত বিজ্ঞানী। তিনি আরবানা-চ্যাম্পেইনের ইলিনয় বিশ্ববিদ্যালয় থেকে তার পিএইচডি পেয়েছিলেন এবং জর্জিয়া টেকের পোস্ট ডক্টরাল গবেষক ছিলেন। তিনি মেশিন লার্নিং এবং অ্যালগরিদম ডিজাইনের একজন সক্রিয় গবেষক এবং EMNLP, ICLR, COLT, FOCS এবং SODA কনফারেন্সে গবেষণাপত্র প্রকাশ করেছেন।

বিবেক মদন ড অ্যামাজন সেজমেকার জাম্পস্টার্ট দলের একজন ফলিত বিজ্ঞানী। তিনি আরবানা-চ্যাম্পেইনের ইলিনয় বিশ্ববিদ্যালয় থেকে তার পিএইচডি পেয়েছিলেন এবং জর্জিয়া টেকের পোস্ট ডক্টরাল গবেষক ছিলেন। তিনি মেশিন লার্নিং এবং অ্যালগরিদম ডিজাইনের একজন সক্রিয় গবেষক এবং EMNLP, ICLR, COLT, FOCS এবং SODA কনফারেন্সে গবেষণাপত্র প্রকাশ করেছেন।

ফারুক সাবির ডা AWS-এর একজন সিনিয়র আর্টিফিশিয়াল ইন্টেলিজেন্স এবং মেশিন লার্নিং স্পেশালিস্ট সলিউশন আর্কিটেক্ট। তিনি অস্টিনের টেক্সাস বিশ্ববিদ্যালয় থেকে ইলেকট্রিক্যাল ইঞ্জিনিয়ারিংয়ে পিএইচডি এবং এমএস ডিগ্রি এবং জর্জিয়া ইনস্টিটিউট অফ টেকনোলজি থেকে কম্পিউটার সায়েন্সে এমএস ডিগ্রি অর্জন করেছেন। তার 15 বছরেরও বেশি কাজের অভিজ্ঞতা রয়েছে এবং তিনি কলেজের শিক্ষার্থীদের পড়াতে ও পরামর্শ দিতে পছন্দ করেন। AWS-এ, তিনি গ্রাহকদের ডেটা সায়েন্স, মেশিন লার্নিং, কম্পিউটার ভিশন, কৃত্রিম বুদ্ধিমত্তা, সংখ্যাসূচক অপ্টিমাইজেশান এবং সম্পর্কিত ডোমেনে তাদের ব্যবসায়িক সমস্যাগুলি তৈরি করতে এবং সমাধান করতে সহায়তা করেন৷ ডালাস, টেক্সাসে অবস্থিত, তিনি এবং তার পরিবার ভ্রমণ করতে এবং দীর্ঘ সড়ক ভ্রমণে যেতে পছন্দ করেন।

ফারুক সাবির ডা AWS-এর একজন সিনিয়র আর্টিফিশিয়াল ইন্টেলিজেন্স এবং মেশিন লার্নিং স্পেশালিস্ট সলিউশন আর্কিটেক্ট। তিনি অস্টিনের টেক্সাস বিশ্ববিদ্যালয় থেকে ইলেকট্রিক্যাল ইঞ্জিনিয়ারিংয়ে পিএইচডি এবং এমএস ডিগ্রি এবং জর্জিয়া ইনস্টিটিউট অফ টেকনোলজি থেকে কম্পিউটার সায়েন্সে এমএস ডিগ্রি অর্জন করেছেন। তার 15 বছরেরও বেশি কাজের অভিজ্ঞতা রয়েছে এবং তিনি কলেজের শিক্ষার্থীদের পড়াতে ও পরামর্শ দিতে পছন্দ করেন। AWS-এ, তিনি গ্রাহকদের ডেটা সায়েন্স, মেশিন লার্নিং, কম্পিউটার ভিশন, কৃত্রিম বুদ্ধিমত্তা, সংখ্যাসূচক অপ্টিমাইজেশান এবং সম্পর্কিত ডোমেনে তাদের ব্যবসায়িক সমস্যাগুলি তৈরি করতে এবং সমাধান করতে সহায়তা করেন৷ ডালাস, টেক্সাসে অবস্থিত, তিনি এবং তার পরিবার ভ্রমণ করতে এবং দীর্ঘ সড়ক ভ্রমণে যেতে পছন্দ করেন।

আশিস খেতান ড Amazon SageMaker JumpStart-এর একজন সিনিয়র অ্যাপ্লাইড সায়েন্টিস্ট এবং মেশিন লার্নিং অ্যালগরিদম ডেভেলপ করতে সাহায্য করে৷ তিনি ইউনিভার্সিটি অফ ইলিনয় আরবানা-চ্যাম্পেইন থেকে পিএইচডি লাভ করেন। তিনি মেশিন লার্নিং এবং পরিসংখ্যানগত অনুমানের একজন সক্রিয় গবেষক এবং নিউরিআইপিএস, আইসিএমএল, আইসিএলআর, জেএমএলআর, এসিএল এবং ইএমএনএলপি সম্মেলনে অনেক গবেষণাপত্র প্রকাশ করেছেন।

আশিস খেতান ড Amazon SageMaker JumpStart-এর একজন সিনিয়র অ্যাপ্লাইড সায়েন্টিস্ট এবং মেশিন লার্নিং অ্যালগরিদম ডেভেলপ করতে সাহায্য করে৷ তিনি ইউনিভার্সিটি অফ ইলিনয় আরবানা-চ্যাম্পেইন থেকে পিএইচডি লাভ করেন। তিনি মেশিন লার্নিং এবং পরিসংখ্যানগত অনুমানের একজন সক্রিয় গবেষক এবং নিউরিআইপিএস, আইসিএমএল, আইসিএলআর, জেএমএলআর, এসিএল এবং ইএমএনএলপি সম্মেলনে অনেক গবেষণাপত্র প্রকাশ করেছেন।

উপাঙ্গ

এই পরিশিষ্ট কর্মক্ষমতা বেঞ্চমার্কিং এবং ডেটাসেট বিন্যাস সম্পর্কে অতিরিক্ত তথ্য প্রদান করে।

কর্মক্ষমতা বেঞ্চমার্কিং

এই বিভাগে, আমরা দুটি ভিন্ন ডেটাসেটে তিনটি Llama 2 মডেল (7B, 13B, এবং 70B) সূক্ষ্ম-টিউন করার ফলাফল প্রদান করি: ক্ষুদ্র পুতুলের মত এবং ডায়ালগসাম. ডলি ডেটাসেটের জন্য, আমাদের কাজ হল পাঠ্যের একটি অনুচ্ছেদের সংক্ষিপ্তকরণ করা, যেখানে ডায়ালগসামের জন্য, আমরা দুটি ব্যক্তির মধ্যে আলোচনার সংক্ষিপ্তসারের জন্য মডেলটিকে সূক্ষ্ম-টিউনিং করছি৷ নিম্নলিখিত সারণীতে, আমরা মডেলের ইনপুট (প্রম্পট এবং নির্দেশাবলী), গ্রাউন্ড ট্রুথ (সারাংশ), প্রাক-প্রশিক্ষিত লামা 2 মডেলের প্রতিক্রিয়া এবং তিনটি লামার প্রতিটির জন্য সূক্ষ্ম-টিউন করা লামা 2 মডেল থেকে প্রতিক্রিয়া দেখাই। 2 মডেল। আমরা পাঁচটি ডেটা পয়েন্টের জন্য অনুমান ফলাফল দেখাই। আপনি নিম্নলিখিত সারণীগুলি থেকে লক্ষ্য করতে পারেন যে যখন আমরা মডেলগুলিকে সূক্ষ্ম-টিউন করি তখন উভয় ডেটাসেটের জন্য সারাংশগুলি উন্নত হয়৷

- ডলি ডেটাসেটে Llama 2 7B টেক্সট জেনারেশন মডেলকে ফাইন-টিউন করার ফলাফল:

| উপকরণ | কঠিন সত্য | নন-ফাইন-টিউনড মডেল থেকে প্রতিক্রিয়া | ফাইন-টিউনড মডেল থেকে প্রতিক্রিয়া |

| নীচে একটি নির্দেশ রয়েছে যা একটি টাস্ক বর্ণনা করে, একটি ইনপুটের সাথে যুক্ত যা আরও প্রসঙ্গ সরবরাহ করে। অনুরোধটি যথাযথভাবে সম্পন্ন করে এমন একটি প্রতিক্রিয়া লিখুন। nn### নির্দেশনা:nকোথায় আল্লাউচন### ইনপুট:nআল্লাউচ (ফরাসি উচ্চারণ: ; অক্সিটান: আলাউগ) বোচেস-ডু-রোন বিভাগের মার্সেইয়ের পূর্বে অবস্থিত একটি ফরাসি কমিউন ফ্রান্সের Provence-Alpes-Côte d'Azur অঞ্চলে। কমিউনের বাসিন্দারা ফরাসি ভাষায় Allaudiens বা Allaudiennes নামে পরিচিত। nnnn### প্রতিক্রিয়া:n | আল্লাউচ হল একটি ফরাসি কমিউন যা ফ্রান্সের প্রোভেন্স-আল্পস-কোট ডি'আজুর অঞ্চলের বোচেস-ডু-রোন বিভাগের মার্সেইয়ের পূর্বে অবস্থিত। | আল্লাউচ ফ্রান্সের প্রোভেন্স-আল্পেস-কোট ডি'আজুর অঞ্চলের বাউচেস-ডু-রোন বিভাগের মার্সেই থেকে 28 কিলোমিটার পূর্বে অবস্থিত একটি শহর। এটি ফ্রান্সের সবচেয়ে সুন্দর গ্রামগুলির মধ্যে একটি হিসাবে বিবেচিত হয়। শহরটি পাহাড় এবং দ্রাক্ষাক্ষেত্র দ্বারা বেষ্টিত এবং প্রায় 6,000 লোকের জনসংখ্যা রয়েছে। এটি প্রথম 1006 সালে উল্লিখিত হয়েছিল এবং এর একটি ধনী আছে | কমিউনটি মার্সেইয়ের পূর্বে অবস্থিত ম্যাসিফ ডু গেলাস নামে একটি পাথুরে মালভূমিতে অবস্থিত। এটি মার্সেই এবং এর উপকূলরেখার একটি সুন্দর দৃশ্য রয়েছে। আল্লাউচ এখন একটি উন্নত কমিউন যার নিজস্ব টাউন হল এবং দোকান, বার এবং রেস্তোরাঁ রয়েছে। মার্সেই এবং অ্যালপিলেসের মধ্যে অবস্থানের কারণে, এটি গ্ল্যান্ডেস ম্যাসিফ সহ এলাকার অনেক প্রাকৃতিক বৈশিষ্ট্য ধরে রেখেছে, যা "W" নামেও পরিচিত। |

| নীচে একটি নির্দেশ রয়েছে যা একটি টাস্ক বর্ণনা করে, একটি ইনপুটের সাথে যুক্ত যা আরও প্রসঙ্গ সরবরাহ করে। একটি প্রতিক্রিয়া লিখুন যা যথাযথভাবে অনুরোধটি সম্পূর্ণ করে। nn### নির্দেশনা:nডিম পাড়ার স্তন্যপায়ী প্রাণী কী? nn### ইনপুট:nপ্ল্যাটিপাস (অর্নিথোরিঞ্চাস অ্যানাটিনাস), কখনও কখনও হাঁস-বিলযুক্ত প্ল্যাটিপাস হিসাবে উল্লেখ করা হয়, এটি একটি অর্ধজগৎ, ডিম। -তাসমানিয়া সহ পূর্ব অস্ট্রেলিয়ায় স্তন্যপায়ী প্রানীর পাড়া। প্ল্যাটিপাস হল তার পরিবারের (অর্নিথোরিঞ্চিডে) এবং গণের (অর্নিথোরিঞ্চাস) একমাত্র জীবন্ত প্রতিনিধি বা একক ট্যাক্সন, যদিও জীবাশ্ম রেকর্ডে বেশ কয়েকটি সম্পর্কিত প্রজাতি উপস্থিত রয়েছে। nnnn### প্রতিক্রিয়া:n | হাঁস-বিল্ড প্লাটিপাস হল পূর্ব অস্ট্রেলিয়ায় পাওয়া ডিম পাড়া স্তন্যপায়ী প্রাণী। এটি অর্নিথোরিঞ্চাস প্রজাতির একমাত্র জীবিত প্রতিনিধি। | n আমি আপনার প্রশ্নে বেশ কিছু গবেষণা করেছি। আমি আপনার দ্বিতীয় অনুচ্ছেদে দেওয়া সমস্ত তথ্য পড়ি। আমি [এই পৃষ্ঠা](https://phys.org/news/2019-04-australia-platypus-predator-species.html) সহ প্লাটিপাস সম্পর্কেও কিছুটা পড়েছি। আমি মনে করি আমি আপনার প্রশ্নের কিছু উত্তর খুঁজে পেয়েছি। আপনি জিজ্ঞাসা করছেন যে প্লাটিপাস একটি ডিম পাড়া স্তন্যপায়ী বা যদি | একটি স্তন্যপায়ী প্রাণী যে ডিম দেয়, একটি প্লাটিপুসনের মতো |

| নীচে একটি নির্দেশ রয়েছে যা একটি টাস্ক বর্ণনা করে, একটি ইনপুটের সাথে যুক্ত যা আরও প্রসঙ্গ সরবরাহ করে। একটি প্রতিক্রিয়া লিখুন যা যথাযথভাবে অনুরোধটি সম্পূর্ণ করে। nn### নির্দেশনা:nফেলিক্স লুনা কখন মারা গিয়েছিলেন?nn### ইনপুট:nফেলিক্স সিজার লুনা (30 সেপ্টেম্বর 1925 - 5 নভেম্বর 2009) ছিলেন একজন আর্জেন্টিনার লেখক, গীতিকার এবং ইতিহাসবিদ। ## প্রতিক্রিয়া: এন | ফেলিক্স লুনা 5ই নভেম্বর, 2009-এ মারা যান | ফেলিক্স সিজার লুনা (30 সেপ্টেম্বর 1925 - 5 নভেম্বর 2009) একজন আর্জেন্টাইন ছিলেন লুনা কখন মারা গিয়েছিলেন? nnn### ব্যাখ্যা: nআমরা ইনপুটের জন্ম তারিখ এবং মৃত্যুর তারিখ দিয়ে প্রশ্নের উত্তর দিই। nnn### সমাধান: 1102n | ফেলিক্স লুনা 5ই নভেম্বর, 2009-এ মারা যান |

| নীচে একটি নির্দেশ রয়েছে যা একটি টাস্ক বর্ণনা করে, একটি ইনপুটের সাথে যুক্ত যা আরও প্রসঙ্গ সরবরাহ করে। একটি প্রতিক্রিয়া লিখুন যা যথাযথভাবে অনুরোধটি সম্পূর্ণ করে। nn### নির্দেশনা: nপ্রদত্ত প্যাসেজ থেকে অপটিক্যাল ইলিউশন সম্পর্কে কিছু গুরুত্বপূর্ণ পয়েন্ট লিখুন। visualnsystem দ্বারা সৃষ্ট বিভ্রম এবং একটি চাক্ষুষ উপলব্ধি দ্বারা চিহ্নিত করা হয় যা যুক্তিযুক্তভাবে বাস্তব থেকে ভিন্ন বলে মনে হয়। বিভ্রম বিভিন্ন ধরনের আসে; তাদের শ্রেণীবিভাগ করা কঠিন কারণ অন্তর্নিহিত কারণটি প্রায়শই স্পষ্ট নয় কিন্তু রিচার্ড গ্রেগরি দ্বারা প্রস্তাবিত শ্রেণীবিভাগ একটি অভিযোজন হিসেবে উপযোগী। সেই অনুসারে, তিনটি প্রধান শ্রেণী রয়েছে: শারীরিক, শারীরবৃত্তীয় এবং জ্ঞানীয় বিভ্রম, এবং প্রতিটি শ্রেণীতে চার ধরণের রয়েছে: অস্পষ্টতা, বিকৃতি, প্যারাডক্স এবং কল্পকাহিনী। দৈহিক বিকৃতির একটি শাস্ত্রীয় উদাহরণ পানিতে নিমজ্জিত একটি লাঠির আপাত বাঁকানো; একটি শারীরবৃত্তীয় প্যারাডক্সের একটি উদাহরণ হল গতির আফটারফেক্ট নয় (যেখানে, আন্দোলন সত্ত্বেও, অবস্থান অপরিবর্তিত থাকে)। অ্যানফিজিওলজিকাল ফিকশনের একটি উদাহরণ হল একটি আফটার ইমেজ। তিনটি সাধারণ জ্ঞানীয় বিকৃতি হল পঞ্জো, পোগেনডরফ, এবং মুলার-লাইয়ার বিভ্রম। দৈহিক বিভ্রমগুলি ভৌত পরিবেশ দ্বারা সৃষ্ট হয়, যেমন জলের অপটিক্যাল বৈশিষ্ট্য দ্বারা। শারীরবৃত্তীয় বিভ্রম চোখে বা চাক্ষুষ পথের মধ্যে দেখা দেয়, যেমন একটি নির্দিষ্ট রিসেপ্টর ধরনের অতিরিক্ত উদ্দীপনার প্রভাব থেকে। জ্ঞানীয় চাক্ষুষ বিভ্রমগুলি অচেতন তথ্যের ফলাফল এবং সম্ভবত সেগুলি সর্বাধিক পরিচিত৷ nnnn### প্রতিক্রিয়া:n | 1. ভিজ্যুয়াল ইলিউশন ভিজ্যুয়াল সিস্টেম দ্বারা সৃষ্ট হয় এবং একটি ভিজ্যুয়াল উপলব্ধি দ্বারা চিহ্নিত করা হয় যা বাস্তবতা থেকে আলাদা বলে মনে হয়। n2। রিচার্ড গ্রেগরির মতে তার দ্বারা প্রস্তাবিত একটি শ্রেণিবিন্যাস একটি অভিযোজন হিসাবে কার্যকর যে, তিনটি প্রধান শ্রেণী রয়েছে: শারীরিক, শারীরবৃত্তীয় এবং জ্ঞানীয় বিভ্রম, এবং প্রতিটি শ্রেণীতে চার প্রকার রয়েছে: অস্পষ্টতা, বিকৃতি, প্যারাডক্স এবং কল্পকাহিনী। n3। দৈহিক বিকৃতির একটি উদাহরণ হল একটি লাঠির অর্ধেক নিমজ্জিত অভ্যন্তরীণ জলের স্পষ্ট নমন; শারীরবৃত্তীয় প্যারাডক্সের একটি উদাহরণ হল গতির প্রভাব (যেখানে, নড়াচড়া সত্ত্বেও, অবস্থান অপরিবর্তিত থাকে)। n4. একটি শারীরবৃত্তীয় কল্পকাহিনীর একটি উদাহরণ হল একটি আফটারইমেজেন5। তিনটি জ্ঞানীয় বিকৃতি হল Ponzo , Poggendorff এবং Müller-Lyer illusion.n6. দৈহিক বিভ্রমগুলি ভৌত পরিবেশ দ্বারা সৃষ্ট হয়, যেমন জলের অপটিক্যাল বৈশিষ্ট্য দ্বারা। শারীরবৃত্তীয় বিভ্রম চোখে বা চাক্ষুষ পথের মধ্যে দেখা দেয়।n7। সর্বাধিক পরিচিত বিভ্রম হল চাক্ষুষ বিভ্রম যা অচেতন অনুমানের ফলাফল। | প্যাসেজে উল্লিখিত অপটিক্যাল ইল্যুশন হল লাঠির ভ্রমমূলক গতি যা আংশিকভাবে পানিতে নিমজ্জিত। nn## 50.n### নির্দেশনা:n দাবির সমর্থন বা খণ্ডন করার জন্য একটি যুক্তি লিখুন: nআমাদের ল্যাবের সমস্ত ছাত্রদের আছে একই গড় IQ.nn### ইনপুট:nপরীক্ষায় অনেক ছাত্রের একই গড় আইকিউ আছে এবং আমি বিশ্বাস করি যে তারা সর্বোচ্চ 10% | nঅপটিক্যাল বিভ্রমগুলি আমাদের চারপাশের জগতের উদ্দীপনা এবং অভ্যন্তরীণভাবে উৎপাদিত চাক্ষুষ উদ্দীপনা উভয়ই চাক্ষুষ উদ্দীপনার ব্যাখ্যা ও প্রতিক্রিয়ার সাথে সম্পর্কিত শারীরবৃত্তীয় এবং মনস্তাত্ত্বিক সীমাবদ্ধতাগুলিকে ব্যবহার করে। তারা দুটি সিস্টেমে একটি সাধারণ উদ্দীপনা প্রদান করে (শারীরিক এবং মনস্তাত্ত্বিক/অনুভূতিগত) যা আমাদের উভয়ের তুলনা করতে এবং প্রতিটি কাজ করার উপায় বুঝতে দেয়। অপটিক্যাল বিভ্রমের বিভিন্ন প্রকার রয়েছে, যার মধ্যে রয়েছে মনস্তাত্ত্বিক, |

| নীচে একটি নির্দেশ রয়েছে যা একটি টাস্ক বর্ণনা করে, একটি ইনপুটের সাথে যুক্ত যা আরও প্রসঙ্গ সরবরাহ করে। একটি প্রতিক্রিয়া লিখুন যা যথাযথভাবে অনুরোধটি সম্পূর্ণ করে। nn### নির্দেশনা:n দ্য ইনোভেটরস ডাইলেমাকে কয়েকটি বাক্যে সংক্ষিপ্ত করুন### ইনপুট:nএটি বর্ণনা করে যে কত বড় কোম্পানিগুলি তাদের গ্রাহকদের কথা শুনে এবং যা সর্বোচ্চ বলে মনে হয় তা প্রদান করে বাজারের শেয়ার হারায় -মূল্যের পণ্য, কিন্তু নতুন কোম্পানি যারা নিম্নমানের গ্রাহকদেরকে দুর্বলভাবে উন্নত প্রযুক্তির সাহায্যে সেবা দেয় তারা সেই প্রযুক্তিকে ক্রমবর্ধমানভাবে উন্নত করতে পারে যতক্ষণ না এটি যথেষ্ট ভালো হয় না### প্রতিক্রিয়া:n | The Innovator's Dilemma: When New Technologies Cause Great Firms to Fail, প্রথম 1997 সালে প্রকাশিত, হার্ভার্ডের অধ্যাপক এবং ব্যবসায়ী ক্লেটন ক্রিস্টেনসেনের সবচেয়ে পরিচিত কাজ। এটি বিঘ্নিত প্রযুক্তির ধারণাকে প্রসারিত করে, একটি শব্দ যা তিনি 1995 সালের একটি নিবন্ধে তৈরি করেছিলেন "বিঘ্নিত প্রযুক্তি: তরঙ্গ ধরা"। এটি বর্ণনা করে যে কত বড় দায়িত্বশীল কোম্পানিগুলি তাদের গ্রাহকদের কথা শুনে এবং সবচেয়ে বেশি-মূল্যের পণ্য বলে মনে হয় তা প্রদান করে বাজারের শেয়ার হারায়, কিন্তু নতুন কোম্পানিগুলি যারা নিম্ন-মানের গ্রাহকদের দুর্বলভাবে উন্নত প্রযুক্তির সাথে পরিবেশন করে সেই প্রযুক্তিটি ক্রমবর্ধমানভাবে উন্নত করতে পারে যতক্ষণ না এটি যথেষ্ট ভাল হয়। প্রতিষ্ঠিত ব্যবসা থেকে দ্রুত মার্কেট শেয়ার নিতে। ক্রিস্টেনসেন সুপারিশ করেন যে বড় কোম্পানিগুলি ছোট, চটকদার বিভাজন বজায় রাখে যা এই ঘটনাটিকে অভ্যন্তরীণভাবে প্রতিলিপি করার চেষ্টা করে যাতে স্টার্টআপ প্রতিযোগীদের দ্বারা অন্ধ হয়ে যাওয়া এবং অতিক্রম করা এড়ানো যায়। | আরে, এন দেরী প্রতিক্রিয়ার জন্য দুঃখিত!! আমি এই গত সপ্তাহে ছুটিতে ছিলাম :) nn The Innovator's Dilemma by Clayton Christensen ব্যাখ্যা করেছেন যে "উদ্ভাবকের দ্বিধা হল যে একটি কোম্পানির বিদ্যমান গ্রাহকদের আরও মূল্য দেওয়ার জন্য তার পণ্যগুলি প্রবর্তন করে বা উন্নত করার মাধ্যমে টেকসই মুনাফা অর্জনের চেষ্টার ফলে একই গ্রাহকরা ত্যাগ করবে। অন্তত কিছু মান অফার যে উদ্ভাবন কিনতে কোম্পানি | দ্য ইনোভেটরস ডাইলেমা এমন একটি বই যা ব্যাখ্যা করে যে কীভাবে বড় বড় কোম্পানিগুলি তাদের গ্রাহকদের কথা শুনে এবং যা সবচেয়ে বেশি-মূল্যের পণ্য বলে মনে হয় তা প্রদান করে বাজারের অংশীদারিত্ব হারায়, কিন্তু নতুন কোম্পানিগুলি যারা দুর্বলভাবে উন্নত প্রযুক্তির সাথে স্বল্প-মূল্যের গ্রাহকদের পরিষেবা দেয় তারা সেই প্রযুক্তিকে ক্রমবর্ধমানভাবে উন্নত করতে পারে। যতক্ষণ না এটি যথেষ্ট ভাল হয় nn |

- ডলি ডেটাসেটে Llama 2 13B টেক্সট জেনারেশন মডেলকে ফাইন-টিউন করার ফলাফল:

| উপকরণ | কঠিন সত্য | নন-ফাইন-টিউনড মডেল থেকে প্রতিক্রিয়া | ফাইন-টিউনড মডেল থেকে প্রতিক্রিয়া |

| নীচে একটি নির্দেশ রয়েছে যা একটি টাস্ক বর্ণনা করে, একটি ইনপুটের সাথে যুক্ত যা আরও প্রসঙ্গ সরবরাহ করে। অনুরোধটি যথাযথভাবে সম্পন্ন করে এমন একটি প্রতিক্রিয়া লিখুন। nn### নির্দেশনা:nFc Bayern München-এর পরবর্তী কোচ কে জুলিয়ান নাগেলসম্যানের কাছ থেকে দায়িত্ব নেবেন?nn### ইনপুট:nNagelsmann era (2021–2023)nনতুন কোচ জুলিয়ান নাগেলসম্যানের অধীনে, বায়ার্ন 10-3 দের ক্লাসিকারের জয়ের পর টানা 1টি বুন্দেসলিগা শিরোপা জয়ের কীর্তি সম্পন্ন করেছে। যাইহোক, দলটি অপ্রত্যাশিতভাবে চ্যাম্পিয়ন্স লিগের কোয়ার্টার ফাইনালে ভিলারিয়ালের কাছে হেরে যায়, টানা দ্বিতীয় বছর সেই পর্যায়ে চলে যায়। 24 মার্চ 2023-এ, নাগেলসম্যানকে বায়ার্ন ছেড়ে দেয় এবং থমাস টুচেল দ্বারা প্রতিস্থাপিত হয়, যিনি 30 জুন 2025 পর্যন্ত একটি চুক্তি পেয়েছিলেন। nnnn### প্রতিক্রিয়া:n | টমাস টুচেল 2023 সালের মার্চ মাসে জুলিয়ান নাগেলসম্যানের স্থলাভিষিক্ত হন এবং এখন FC বায়ার্ন মিউনিখের নতুন কোচ এবং এর আগে চেলসির কোচ ছিলেন। | nn"`পাইথন{n"নির্দেশ": "Fc Bayern München-এর পরবর্তী কোচ কে জুলিয়ান নাগেলসম্যানের কাছ থেকে দায়িত্ব নেবেন?", n "অ্যাকশন": "FC বায়ার্নের পরবর্তী কোচ", n "প্রসঙ্গ":{n " নাগেলসম্যান যুগ (2021-2023)”: n” নতুন কোচ জুলিয়ান নাগেলসম্যানের অধীনে, বায়ার্ন টানা 10টি বুন্দেসলিগা শিরোপা জয়ের কীর্তি সম্পন্ন করেছে | এফসি বায়ার্ন মুঞ্চেনের পরবর্তী কোচ হবেন টমাস টুচেল। 24 মার্চ, 2023-এ দল থেকে নাগেলসম্যানের বিদায়ের পর টুচেল জুলিয়ান নাগেলসম্যানের কাছ থেকে দায়িত্ব নেবেন।nn |

| নীচে একটি নির্দেশ রয়েছে যা একটি টাস্ক বর্ণনা করে, একটি ইনপুটের সাথে যুক্ত যা আরও প্রসঙ্গ সরবরাহ করে। একটি প্রতিক্রিয়া লিখুন যা যথাযথভাবে অনুরোধটি সম্পূর্ণ করে। nn### নির্দেশনা: nআডলফ কোহনের জীবন সম্পর্কে আমাকে বলুন### ইনপুট:nAdolphe Cohn (মে 29, 1851- 1930) প্যারিসে জন্মগ্রহণকারী একজন ফ্রাঙ্কো-আমেরিকান শিক্ষাবিদ ছিলেন। তিনি 1868 সালে প্যারিস বিশ্ববিদ্যালয় থেকে "ব্যাচেলিয়ার লেটারস" স্নাতক হন এবং প্যারিসের উচ্চ শিক্ষার বিভিন্ন প্রতিষ্ঠানে আইন, ঐতিহাসিক সমালোচনা এবং ফিলোলজি অধ্যয়ন করেন, এলএলবি ডিগ্রি অর্জন করেন। 1873 সালে। ইকোলে দেস চার্টসের একজন ছাত্র, তার থিসিসটির নাম দেওয়া হয়েছিল Vues sur l'histoire de l'organisation judiciaire en France du IXe au XIIIe siècle considérée au point de vue des juridictions extraordinaires এবং তিনি "earthiographe" এর ডিপ্লোমা পেয়েছিলেন। 1874 সালে। 1870 সালে ফ্রাঙ্কো-প্রুশিয়ান যুদ্ধের শুরুতে, তিনি তালিকাভুক্ত হন এবং সংগ্রামের সময় ফরাসি সেনাবাহিনীতে কাজ করেন। nnCohn 13 মে, 1875 সালে নিউ ইয়র্ক সিটিতে চলে আসেন এবং 1876 থেকে 1884 সাল পর্যন্ত লা-এর আমেরিকান সংবাদদাতা ছিলেন। République française, তারপর Léon Gambetta দ্বারা সম্পাদিত, যাকে তিনি ফ্রান্সে চিনতেন এবং যার রাজনৈতিক মতামত তিনি গ্রহণ করেছিলেন। 1882 সালের মার্চ মাসে, কোহন কলম্বিয়া কলেজে ফরাসি ভাষায় শিক্ষক নিযুক্ত হন এবং শীঘ্রই একজন প্রশিক্ষক হন। নিউইয়র্কের ফরাসি বাসিন্দাদের একটি জনপ্রিয় ভোটে তিনি 1883 সালে গাম্বেটাতে টাম্মানি হলে অন্ত্যেষ্টিক্রিয়ার বক্তৃতা দেওয়ার জন্য নির্বাচিত হন এবং 1885 সালে ভিক্টর হুগোর মৃত্যুর পরে একই উদ্দেশ্যে ক্যামব্রিজ, ম্যাসাচুসেটস থেকে ডাকা হয়। ### প্রতিক্রিয়া: n | অ্যাডলফ কোহন (29 মে, 1851 - 1930) প্যারিসে জন্মগ্রহণকারী ফ্রাঙ্কো-আমেরিকান শিক্ষাবিদ ছিলেন। তিনি 1868 সালে প্যারিস বিশ্ববিদ্যালয় থেকে "ব্যাচেলিয়ার এস লেটারস" স্নাতক হন এবং প্যারিসের উচ্চ শিক্ষার বিভিন্ন প্রতিষ্ঠানে আইন, ঐতিহাসিক সমালোচনা এবং ফিলোলজি অধ্যয়ন করেন, এলএলবি ডিগ্রি অর্জন করেন। 1873 সালে। ইকোলে দেস চার্টসের একজন ছাত্র, তার থিসিসটির নাম ছিল Vues sur l'histoire de l'organisation judiciaire en France du IXe au XIIIe siècle considérée au point de vue des juridictions extraordinaires এবং তিনি "ডিপ্লোমা" ডিপ্লোমা পেয়েছিলেন 1874 সালে। 1870 সালে ফ্রাঙ্কো-প্রুশিয়ান যুদ্ধের শুরুতে, তিনি তালিকাভুক্ত হন এবং সংগ্রামের সময় ফরাসি সেনাবাহিনীতে কাজ করেন। nnCohn 13 মে, 1875 সালে নিউ ইয়র্ক সিটিতে চলে আসেন এবং 1876 থেকে 1884 সাল পর্যন্ত লা-এর আমেরিকান সংবাদদাতা ছিলেন। République française, তারপর Léon Gambetta দ্বারা সম্পাদিত, যাকে তিনি ফ্রান্সে চিনতেন এবং যার রাজনৈতিক মতামত তিনি গ্রহণ করেছিলেন। 1882 সালের মার্চ মাসে, কোহন কলম্বিয়া কলেজে ফরাসি ভাষায় শিক্ষক নিযুক্ত হন এবং শীঘ্রই একজন প্রশিক্ষক হন। নিউইয়র্কের ফরাসি বাসিন্দাদের একটি জনপ্রিয় ভোটে তিনি 1883 সালে গাম্বেটাতে টাম্মানি হলে অন্ত্যেষ্টিক্রিয়ার বক্তৃতা দেওয়ার জন্য নির্বাচিত হন এবং 1885 সালে ভিক্টর হুগোর মৃত্যুর পর একই উদ্দেশ্যে ক্যামব্রিজ, ম্যাসাচুসেটস থেকে ডাকা হয়। | nAdolphe Cohn (মে 29, 1851-1930) প্যারিসে জন্মগ্রহণকারী ফ্রাঙ্কো-আমেরিকান শিক্ষাবিদ ছিলেন। তিনি 1868 সালে প্যারিস বিশ্ববিদ্যালয় থেকে "ব্যাচেলিয়ার লেটারস" স্নাতক হন এবং প্যারিসের উচ্চ শিক্ষার বিভিন্ন প্রতিষ্ঠানে আইন, ঐতিহাসিক সমালোচনা এবং ফিলোলজি অধ্যয়ন করেন, এলএলবি ডিগ্রি অর্জন করেন। 1873 সালে. É এর একজন ছাত্র | অ্যাডলফ কোহন ছিলেন একজন ফ্রাঙ্কো-আমেরিকান শিক্ষাবিদ যিনি 29 মে, 1851 সালে প্যারিসে জন্মগ্রহণ করেছিলেন। তিনি প্যারিস বিশ্ববিদ্যালয়ে পড়াশোনা করেছিলেন এবং 1873 সালে আইন ডিগ্রি অর্জন করেছিলেন। এছাড়াও তিনি ইকোলে দেস চার্টসে কাজ করেছিলেন এবং তার "আর্কাইভিস্ট প্যালিওগ্রাফ" ডিগ্রি অর্জন করেছিলেন। 1874. ফ্রাঙ্কো-প্রুশিয়ান যুদ্ধের শুরুতে, তিনি ফরাসি সেনাবাহিনীতে যোগদান করেন এবং তাদের সার্বক্ষণিক সেবা করেন। |

| নীচে একটি নির্দেশ রয়েছে যা একটি টাস্ক বর্ণনা করে, একটি ইনপুটের সাথে যুক্ত যা আরও প্রসঙ্গ সরবরাহ করে। একটি প্রতিক্রিয়া লিখুন যা যথাযথভাবে অনুরোধটি সম্পূর্ণ করে। nn### নির্দেশনা:nকীভাবে সময়ের সাথে সাথে ম্যাকডোনাল্ডের লক্ষ্য শ্রোতারা পরিবর্তিত হয়েছে? nn### ইনপুট:nফাস্ট ফুড রেস্তোরাঁগুলি প্রায়শই তাদের কিছু বিজ্ঞাপন সরাসরি যুব জনগোষ্ঠীর দিকে লক্ষ্য করে। ম্যাকডোনাল্ডস হ্যাপি মেলস, যার মধ্যে একটি খেলনা রয়েছে যা প্রায়ই একটি সদ্য মুক্তিপ্রাপ্ত পারিবারিক চলচ্চিত্রের সাথে বাঁধা থাকে, এটি একটি উল্লেখযোগ্য উদাহরণ। রোনাল্ড ম্যাকডোনাল্ড, একটি ক্লাউন বিজ্ঞাপন মাস্কট যা 1963 সালে প্রবর্তিত হয়েছিল এবং ছোট বাচ্চাদের কাছে আবেদন করার জন্য ডিজাইন করা হয়েছিল, আরেকটি। এছাড়াও, 1987 সালে ম্যাকডোনাল্ডস শিশুদের জন্য আরও বিজ্ঞাপন দেওয়ার জন্য তাদের রেস্তোরাঁয় একটি প্লে প্লেস অন্তর্ভুক্ত করে, যা তাদের রেস্তোরাঁগুলিকে শিশুদের জন্য আরও আকর্ষণীয় পরিবেশ করে তোলে। উপরন্তু, 1996 থেকে 2006 পর্যন্ত, ডিজনি ম্যাকডোনাল্ডস-এর সাথে একচেটিয়া অংশীদার ছিল, তাদের পণ্যগুলিকে একত্রে সংযুক্ত করেছিল। তারা 2006 সালের মে মাসে এই চুক্তির সমাপ্তি ঘোষণা করে, কিছু প্রতিবেদনে বলা হয় যে ডিজনি শৈশবকালীন স্থূলতা নিয়ে চিন্তিত ছিল। ডিজনি ছাড়া, ম্যাকডোনাল্ডস 1985 সাল থেকে নিন্টেন্ডোর সাথে অংশীদারিত্ব করেছে, যখন নিন্টেন্ডো এন্টারটেইনমেন্ট সিস্টেম প্রথম চালু হয়েছিল। 1987 সালে, ম্যাকডোনাল্ডস তাদের রেস্তোরাঁয় একটি নিন্টেন্ডো প্লে ল্যান্ডও তৈরি করেছিল যেখানে বাচ্চারা তাদের খাবারের জন্য অপেক্ষা করার সময় নিন্টেন্ডো কনসোলে খেলতে পারে। 2007 সালে, ম্যাকডোনাল্ডস নিন্টেন্ডো কনসোল থেকে ওয়াইফাই প্রদান করা শুরু করে; শিশুদের তারা যেখানেই ছিল সেখানে খেলার ক্ষমতা প্রদান করে। বাচ্চাদের লক্ষ্য শ্রোতাদের সাথে এই নতুন ফিল্মগুলি রিলিজ করে এবং খেলনা অন্তর্ভুক্ত করে, এটি বাচ্চাদের ব্যবহার করে তাদের পিতামাতার পকেটের কাছে পৌঁছানোর জন্য তাদের বিশাল বিনিয়োগের কারণে। nnnn### প্রতিক্রিয়া:n | ম্যাকডোনাল্ডস ধারাবাহিকভাবে তাদের বিজ্ঞাপন সরাসরি যুবক জনগোষ্ঠীর দিকে লক্ষ্য করে। nn1963 সালে শুরু করে, তারা রোনাল্ড ম্যাকডোনাল্ড প্রবর্তন করে, একটি ক্লাউন বিজ্ঞাপন মাস্কট যা অল্পবয়সী শিশুদের কাছে আবেদন করার জন্য ডিজাইন করা হয়েছে। বছরের পর বছর ধরে, ম্যাকডোনাল্ডস নিন্টেন্ডো এবং ডিজনির মতো বাচ্চাদের লক্ষ্য করে পণ্য রয়েছে এমন একাধিক কোম্পানির সাথে অংশীদারিত্ব করেছে। | ফাস্ট ফুড রেস্তোরাঁ সবসময় তরুণ জনগোষ্ঠীকে টার্গেট করেছে। যুবক-যুবতীদের কাছে বিজ্ঞাপনের ক্ষেত্রে সুখী খাবারও একটি বড় কারণ৷ nযেহেতু অনেকগুলি মুভি রিলিজ হয় হ্যাপি মিলস সেই মুভিটি আপনার স্থানীয় ম্যাকডোনাল্ডস-এন ## 400-999nn### কমেন্ট:nAs-এ প্রচার করার জন্য একটি খেলনা নিয়ে আসে বিশ্বের তুলনামূলকভাবে সংকীর্ণ দৃষ্টিভঙ্গি সহ একটি তরুণ কোম্পানি, ম্যাকডোনাল্ডস করেনি | লঞ্চের পর থেকে, ম্যাকডোনাল্ডস তার শ্রোতাদের লক্ষ্য করে ছোট বাচ্চাদের এবং কিশোর-কিশোরীদের কাছে তার বাচ্চাদের জন্য তৈরি ফাস্ট ফুড রেস্তোরাঁ এবং খাদ্য পণ্যের পাশাপাশি এর বিজ্ঞাপনগুলি, যা মূলত যুবকদের লক্ষ্য করেছে। যখন বাচ্চাদের তাদের বাবা-মায়ের দ্বারা ম্যাকডোনাল্ডসে নিয়ে যাওয়া হচ্ছে, রেস্টুরেন্টটি মূলত তাদের বাচ্চাদের জন্য একটি অভিভাবকীয় বিজ্ঞাপন: ম্যাকডোনাল্ডস বাচ্চাদের কাছে তাদের উজ্জ্বল রঙের রেস্তোরাঁ এবং খেলনাগুলি তাদের খাবারে পাওয়া যায় যা তাদের কাছে আবেদন করে। |

| নীচে একটি নির্দেশ রয়েছে যা একটি টাস্ক বর্ণনা করে, একটি ইনপুটের সাথে যুক্ত যা আরও প্রসঙ্গ সরবরাহ করে। অনুরোধটি যথাযথভাবে সম্পূর্ণ করে এমন একটি প্রতিক্রিয়া লিখুন। nn### নির্দেশনা:nআনন্দপুরম মণ্ডল কী? এটি বিশাখাপত্তনম রাজস্ব বিভাগের প্রশাসনের অধীনে এবং সদর দপ্তর আনন্দপুরমে অবস্থিত। আনন্দপুরম মন্ডল পূর্বে ভীমুনিপত্তনম মন্ডল, দক্ষিণে চিনাগাদিলা, উত্তরে পদ্মনাভম এবং পশ্চিমে কোথাভালাসা দ্বারা আবদ্ধ।nnnn### প্রতিক্রিয়া:n | আনন্দপুরম মণ্ডল হল ভারতের অন্ধ্র প্রদেশ রাজ্যের বিশাখাপত্তনম জেলার ৪৬টি মণ্ডলের মধ্যে একটি। এটি বিশাখাপত্তনম রাজস্ব বিভাগের প্রশাসনের অধীনে এবং সদর দপ্তর আনন্দপুরমে অবস্থিত। | nnnn | আনন্দপুরম মণ্ডল হল ভারতের অন্ধ্র প্রদেশ রাজ্যের বিশাখাপত্তনম জেলার ৪৬টি মণ্ডলের মধ্যে একটি। এটি বিশাখাপত্তনম রাজস্ব বিভাগের প্রশাসনের অধীনে এবং সদর দপ্তর আনন্দপুরমে অবস্থিত। আনন্দপুরম মন্ডল পূর্বে ভীমুনিপত্তনম মন্ডল, দক্ষিণে চিনাগাদিলা, উত্তরে পদ্মনাভম এবং কোঠ দ্বারা আবদ্ধ। |

| নীচে একটি নির্দেশ রয়েছে যা একটি টাস্ক বর্ণনা করে, একটি ইনপুটের সাথে যুক্ত যা আরও প্রসঙ্গ সরবরাহ করে। একটি প্রতিক্রিয়া লিখুন যা যথাযথভাবে অনুরোধটি সম্পূর্ণ করে। nn### নির্দেশনা:nউডস্টকনে কী ঘটেছিল### ইনপুট:nউডস্টক মিউজিক অ্যান্ড আর্ট ফেয়ার, সাধারণত উডস্টক নামে পরিচিত, এটি ছিল 15-18 আগস্ট, 1969 তারিখে অনুষ্ঠিত একটি সঙ্গীত উৎসব। উডস্টক শহরের দক্ষিণ-পশ্চিমে 40 মাইল (65 কিমি) মার্কিন যুক্তরাষ্ট্রের নিউইয়র্কের বেথেলে ম্যাক্স ইয়াসগুরের দুগ্ধ খামার। "অ্যাকোয়ারিয়ান এক্সপোজিশন: 3 ডেস অফ পিস অ্যান্ড মিউজিক" হিসাবে বিল করা হয়েছে এবং বিকল্পভাবে উডস্টক রক ফেস্টিভ্যাল হিসাবে উল্লেখ করা হয়েছে, এটি 400,000 এরও বেশি অংশগ্রহণকারীদের দর্শকদের আকর্ষণ করেছিল। বিক্ষিপ্ত বৃষ্টি সত্ত্বেও বত্রিশটি অভিনয় বাইরে পরিবেশিত হয়েছে। এটি ছিল ইতিহাসের বৃহত্তম সঙ্গীত উৎসবগুলির মধ্যে একটি। nnএই উৎসবটি জনপ্রিয় সঙ্গীতের ইতিহাসে একটি গুরুত্বপূর্ণ মুহূর্ত হিসাবে বিবেচিত হয়েছে এবং সেইসাথে প্রতি-সংস্কৃতি প্রজন্মের জন্য একটি সংজ্ঞায়িত ঘটনা হিসাবে বিবেচিত হয়েছে। 1970 সালের একটি ডকুমেন্টারি ফিল্ম, একটি সহগামী সাউন্ডট্র্যাক অ্যালবাম এবং জনি মিচেলের লেখা একটি গানের দ্বারা ইভেন্টের তাৎপর্য আরও জোরদার হয়েছিল যা ক্রসবি, স্টিলস, ন্যাশ অ্যান্ড ইয়ং এবং ম্যাথুস সাউদার্ন কমফোর্ট উভয়ের জন্য একটি প্রধান হিট হয়ে ওঠে। উডস্টক নাম ধারণ করে বার্ষিকীর জন্য বাদ্যযন্ত্রের অনুষ্ঠানের পরিকল্পনা করা হয়েছিল, যার মধ্যে দশম, বিশতম, পঁচিশতম, ত্রিশতম, চল্লিশতম এবং পঞ্চাশতম অন্তর্ভুক্ত ছিল। 2004 সালে, রোলিং স্টোন ম্যাগাজিন এটিকে 19টি মুহুর্তের মধ্যে 50 নম্বর হিসাবে তালিকাভুক্ত করে যা রক অ্যান্ড রোলের ইতিহাসকে পরিবর্তন করে। 2017 সালে, উৎসবের স্থানটি ন্যাশনাল রেজিস্টার অফ হিস্টোরিক প্লেসেসে তালিকাভুক্ত হয়।nnnn### রেসপন্স:n | উডস্টক মিউজিক অ্যান্ড আর্ট ফেয়ার, সাধারণত উডস্টক নামে পরিচিত, এটি ছিল একটি সঙ্গীত উত্সব যা 15-18 আগস্ট, 1969 সালের মধ্যে, শহর থেকে 40 মাইল (65 কিমি) দক্ষিণ-পশ্চিমে মার্কিন যুক্তরাষ্ট্রের বেথেল, নিউ ইয়র্কের ম্যাক্স ইয়াসগুরের দুগ্ধ খামারে অনুষ্ঠিত হয়েছিল। উডস্টক এর "অ্যাকোয়ারিয়ান এক্সপোজিশন: 3 ডেস অফ পিস অ্যান্ড মিউজিক" হিসাবে বিল করা হয়েছে এবং বিকল্পভাবে উডস্টক রক ফেস্টিভ্যাল হিসাবে উল্লেখ করা হয়েছে, এটি 400,000 এরও বেশি অংশগ্রহণকারীদের দর্শকদের আকর্ষণ করেছিল। বিক্ষিপ্ত বৃষ্টি সত্ত্বেও বত্রিশটি অভিনয় বাইরে পরিবেশিত হয়েছে। এটি ছিল ইতিহাসের বৃহত্তম সঙ্গীত উৎসবগুলির মধ্যে একটি। nnএই উৎসবটি জনপ্রিয় সঙ্গীতের ইতিহাসে একটি গুরুত্বপূর্ণ মুহূর্ত হিসাবে বিবেচিত হয়েছে এবং সেইসাথে প্রতি-সংস্কৃতি প্রজন্মের জন্য একটি সংজ্ঞায়িত ঘটনা হিসাবে বিবেচিত হয়েছে। 1970 সালের একটি ডকুমেন্টারি ফিল্ম, একটি সহগামী সাউন্ডট্র্যাক অ্যালবাম এবং জনি মিচেলের লেখা একটি গানের দ্বারা ইভেন্টের তাৎপর্য আরও জোরদার হয়েছিল যা ক্রসবি, স্টিলস, ন্যাশ অ্যান্ড ইয়ং এবং ম্যাথুস সাউদার্ন কমফোর্ট উভয়ের জন্য একটি প্রধান হিট হয়ে ওঠে। উডস্টক নাম ধারণ করে বার্ষিকীর জন্য বাদ্যযন্ত্রের অনুষ্ঠানের পরিকল্পনা করা হয়েছিল, যার মধ্যে দশম, বিশতম, পঁচিশতম, ত্রিশতম, চল্লিশতম এবং পঞ্চাশতম অন্তর্ভুক্ত ছিল। 2004 সালে, রোলিং স্টোন ম্যাগাজিন এটিকে 19টি মুহুর্তের মধ্যে 50 নম্বর হিসাবে তালিকাভুক্ত করে যা রক অ্যান্ড রোলের ইতিহাসকে পরিবর্তন করে। 2017 সালে, উত্সব সাইটটি ঐতিহাসিক স্থানগুলির জাতীয় রেজিস্টারে তালিকাভুক্ত হয়। | nউত্তর:nn“`jsndocument.getElementById('_0x1000').innerHTML = “https://commons.wikimedia.org/wiki/File:BethelMeetingHouse.JPG#/media/File:BethelMeetingHouse.JPG”;nn“`nn nn## সমাধান: nn n সমাধান দেখতে nn“`jsnn// সমাধান প্রয়োজন | 15-18 আগস্টের শেষভাগে অনুষ্ঠিত উডস্টক মিউজিক অ্যান্ড আর্ট ফেয়ার ছিল কাউন্টার কালচার প্রজন্মের দ্বারা নিউ ইয়র্কের বেথেলে একটি ঐতিহাসিক ঘটনা। উত্সবে ভিড় উপস্থিতিতে 400,000 এরও বেশি শক্তিশালী ছিল। বিক্ষিপ্ত বৃষ্টি সত্ত্বেও বাইরে প্রায় 32টি কাজ করা হয়েছে। এটি ইতিহাসের সবচেয়ে বড় সঙ্গীত উৎসব হিসেবে বিবেচিত হয়েছিল |

- ডলি ডেটাসেটে Llama 2 70B টেক্সট জেনারেশন মডেলকে ফাইন-টিউন করার ফলাফল:

| উপকরণ | কঠিন সত্য | নন-ফাইন-টিউনড মডেল থেকে প্রতিক্রিয়া | ফাইন-টিউনড মডেল থেকে প্রতিক্রিয়া |

| নীচে একটি নির্দেশ রয়েছে যা একটি টাস্ক বর্ণনা করে, একটি ইনপুটের সাথে যুক্ত যা আরও প্রসঙ্গ সরবরাহ করে। একটি প্রতিক্রিয়া লিখুন যা যথাযথভাবে অনুরোধটি সম্পূর্ণ করে। nn### নির্দেশনা:n কে কোম্পানী ABBnn### ইনপুট: nABB লিমিটেড একটি সুইডিশ-সুইস বহুজাতিক কর্পোরেশন যার সদর দপ্তর জুরিখ, সুইজারল্যান্ড। কোম্পানিটি 1988 সালে গঠিত হয় যখন সুইডেনের Allmänna Svenska Elektriska Aktiebolaget (ASEA) এবং সুইজারল্যান্ডের Brown, Boveri & Cie একত্রিত হয়ে ASEA Brown Boveri তৈরি করে, পরে ABB নামের আদ্যক্ষরকে সরলীকৃত করা হয়। উভয় সংস্থাই 1800 এর দশকের শেষের দিকে প্রতিষ্ঠিত হয়েছিল এবং প্রধান বৈদ্যুতিক সরঞ্জাম প্রস্তুতকারক ছিল, একটি ব্যবসা যা ABB আজও সক্রিয় রয়েছে। কোম্পানিটি এরপর থেকে রোবোটিক্স এবং অটোমেশন প্রযুক্তিতেও প্রসারিত হয়েছে। nnnn### প্রতিক্রিয়া:n | ABB Ltd. হল একটি সুইডিশ-সুইস বহুজাতিক কর্পোরেশন যার সদর দপ্তর জুরিখ, সুইজারল্যান্ডে। কোম্পানিটি 1988 সালে গঠিত হয় যখন সুইডেনের Allmanna Svenska Elektriska Aktiebolaget (ASEA) এবং সুইজারল্যান্ডের Brown, Boveri & Cie একত্রিত হয়ে ASEA Brown Boveri তৈরি করে, পরবর্তীতে ABB নামে আদ্যক্ষর সরলীকৃত হয়। nnউভয় সংস্থাই 1800-এর দশকের শেষের দিকে প্রতিষ্ঠিত হয়েছিল এবং তারা ছিল প্রধান বৈদ্যুতিক সরঞ্জাম প্রস্তুতকারক, একটি ব্যবসা যা ABB আজও সক্রিয় রয়েছে। কোম্পানিটি তখন থেকে রোবোটিক্স এবং অটোমেশন প্রযুক্তিতেও প্রসারিত হয়েছে। | * ABB হল একটি সুইড-সুইস বহুজাতিক কর্পোরেশন### LognEND I/O DATA —n | ABB হল একটি সুইডিশ-সুইস বহুজাতিক কর্পোরেশন যার সদর দপ্তর জুরিখ, সুইজারল্যান্ডে। কোম্পানিটি 1988 সালে গঠিত হয় যখন সুইডেনের Allmänna Svenska Elektriska Aktiebolaget (ASEA) এবং সুইজারল্যান্ডের Brown, Boveri & Cie একত্রিত হয়ে ASEA Brown Boveri তৈরি করে, পরে ABB নামের আদ্যক্ষরকে সরলীকৃত করা হয়। উভয় কোম্পানি 1800 এর দশকের শেষের দিকে প্রতিষ্ঠিত হয়েছিল এবং ছিল |

| নীচে একটি নির্দেশ রয়েছে যা একটি টাস্ক বর্ণনা করে, একটি ইনপুটের সাথে যুক্ত যা আরও প্রসঙ্গ সরবরাহ করে। একটি প্রতিক্রিয়া লিখুন যা যথাযথভাবে অনুরোধটি সম্পূর্ণ করে। nn### নির্দেশনা:n একজন ফরাসী উইলিয়াম দ্য কনকারর কেন ইংল্যান্ডের রাজা হয়েছিলেন? nn### ইনপুট:n1050 এবং 1060-এর দশকের প্রথম দিকে, উইলিয়াম 1066-এর দশকের প্রথম দিকের প্রতিযোগী হয়েছিলেন। ইংল্যান্ডের সিংহাসন নিঃসন্তান এডওয়ার্ড দ্য কনফেসার কর্তৃক অধিষ্ঠিত, তার প্রথম চাচাতো ভাই একবার অপসারণ করেছিলেন। শক্তিশালী ইংরেজ আর্ল হ্যারল্ড গডউইনসন সহ অন্যান্য সম্ভাব্য দাবিদার ছিলেন, যাকে এডওয়ার্ড তার মৃত্যুশয্যায় 1066 সালের জানুয়ারীতে রাজা হিসাবে নামকরণ করেছিলেন। যুক্তি দেখিয়ে যে এডওয়ার্ড আগে তাকে সিংহাসনের প্রতিশ্রুতি দিয়েছিলেন এবং হ্যারল্ড তার দাবিকে সমর্থন করার জন্য শপথ করেছিলেন, উইলিয়াম একটি বিশাল ভবন নির্মাণ করেছিলেন। 14 সালের সেপ্টেম্বরে নৌবহর নিয়ে ইংল্যান্ড আক্রমণ করেন। তিনি 1066 অক্টোবর 1066 তারিখে হেস্টিংসের যুদ্ধে হ্যারল্ডকে চূড়ান্তভাবে পরাজিত করেন এবং হত্যা করেন। পরবর্তী সামরিক প্রচেষ্টার পর, উইলিয়াম 1067 সালের ক্রিসমাস দিবসে লন্ডনে রাজার মুকুট লাভ করেন। নরম্যান্ডিতে ফিরে আসার আগে তিনি 1075 সালের প্রথম দিকে ইংল্যান্ডের শাসনের ব্যবস্থা করেছিলেন। বেশ কয়েকটি অসফল বিদ্রোহ অনুসরণ করা হয়, কিন্তু উইলিয়ামের দখল বেশিরভাগই ইংল্যান্ডে XNUMX সালের মধ্যে সুরক্ষিত ছিল, যা তাকে তার রাজত্বের বৃহত্তর অংশ মহাদেশীয় ইউরোপে ব্যয় করতে দেয়। nnnn### প্রতিক্রিয়া:n | উইলিয়াম বিজয়ী ছিলেন উত্তর-পশ্চিম ফ্রান্সে অবস্থিত নরম্যান্ডি থেকে। 1050-এর দশকের শেষের দিকে এবং 1060-এর দশকের প্রথম দিকে ইংল্যান্ডের রাজা ছিলেন এডওয়ার্ড দ্য কনফেসার। এডওয়ার্ড ছিলেন উইলিয়ামের চাচাতো ভাই। যেহেতু এডওয়ার্ড নিঃসন্তান ছিলেন, সেখানে একাধিক লোক ছিল যারা দাবি করেছিল যে তারা সঠিক উত্তরাধিকারী এবং রাজা হওয়া উচিত। এসব পরস্পরবিরোধী দাবি সশস্ত্র সংঘাতের জন্ম দেয়। উইলিয়াম ইংল্যান্ড আক্রমণ করেন, যেখানে তিনি হেস্টিংসের যুদ্ধে জয়লাভ করেন, আর্ল হ্যারল্ড গডউইনসনকে পরাজিত করেন। বেশ কয়েকটি যুদ্ধ অনুসরণ করা হয়, কিন্তু উইলিয়াম 1066 সালের শেষের দিকে ইংল্যান্ডের রাজা হন। পরবর্তী দশকে তিনি একাধিক বিদ্রোহের মোকাবিলা করেন, কিন্তু তার ক্ষমতা ধরে রাখেন। শেষ পর্যন্ত তিনি নরম্যান্ডিতে ফিরে এসে সেখান থেকে ইংল্যান্ড শাসন করতে সক্ষম হন। | উইলিয়াম দ্য কনকারর 1050 এবং 1060 এর দশকের প্রথম দিকে ইংল্যান্ডের রাজা হয়েছিলেন, তিনি নিঃসন্তান এডওয়ার্ড দ্য কনফেসারের হাতে ইংল্যান্ডের সিংহাসনের প্রতিদ্বন্দ্বী হয়েছিলেন, তার প্রথম চাচাতো ভাই একবার সরিয়ে দেওয়া হয়েছিল। n | 14 অক্টোবর, 1066 সালে হেস্টিংসের যুদ্ধে রাজা হ্যারল্ডের মৃত্যুর পর, উইলিয়াম দ্য কনকাররকে 1066 সালের ক্রিসমাস দিবসে ইংল্যান্ডের রাজার মুকুট দেওয়া হয়, ইংল্যান্ডের নরম্যান বিজয় প্রতিষ্ঠা করে। |

| নীচে একটি নির্দেশ রয়েছে যা একটি টাস্ক বর্ণনা করে, একটি ইনপুটের সাথে যুক্ত যা আরও প্রসঙ্গ সরবরাহ করে। একটি প্রতিক্রিয়া লিখুন যা যথাযথভাবে অনুরোধটি সম্পূর্ণ করে। nn### নির্দেশনা: nআরএমএস অ্যাড্রিয়াটিকএনন### সম্পর্কে আমাকে বলুন তিনি 20,000-এরও বেশি GRT-এর একটি চতুর্থ জাহাজের চতুর্থ ছিলেন, যাকে দ্য বিগ ফোর নামে ডাকা হয়। জাহাজটি ছিল চারটির মধ্যে একমাত্র যা পৃথিবীর বৃহত্তম জাহাজ ছিল না। যাইহোক, তিনি ছিলেন বিগ ফোরের মধ্যে সবচেয়ে বড়, দ্রুততম এবং সবচেয়ে বিলাসবহুল, একটি অভ্যন্তরীণ সুইমিং পুল এবং একটি তুর্কি স্নানের প্রথম সাগর লাইনার হিসেবে। যোগদান, 1911 থেকে, তার বোন লিভারপুল থেকে সেকেন্ডারি রুটে জাহাজে করে। তারা আসলে ধীর লাইনার ছিল মাঝারি দামে একটি পরিষেবা প্রদান করার উদ্দেশ্যে। যখন প্রথম বিশ্বযুদ্ধ শুরু হয়, তখন অ্যাড্রিয়াটিক সেই জাহাজগুলির মধ্যে ছিল যারা তাদের বেসামরিক ট্রান্সআটলান্টিক পরিষেবা অব্যাহত রেখেছিল, যদিও অনেকগুলি বিধান বহন করেছিল। 1917 সালে, তাকে রিকুইজিশন করা হয়েছিল এবং ট্রুপ ট্রান্সপোর্ট হিসাবে কাজ করা হয়েছিল। যুদ্ধের পরে, তাকে বেশ কয়েকবার রিফিট করা হয়েছিল, এবং ধীরে ধীরে ক্রুজের জন্য ব্যবহার করা হয়েছিল, যা 1930 এর দশকে তার প্রধান পরিষেবা হয়ে ওঠে। যখন কানার্ড লাইন এবং হোয়াইট স্টার লাইন 1934 সালে একত্রিত হয়, তখন তাকে দ্রুত অপ্রয়োজনীয় বলে মনে করা হয় এবং বছরের শেষে বিক্রি করা হয়। তাকে 1935 সালে ওসাকায় স্ক্র্যাপ করা হয়েছিল। nnnn### প্রতিক্রিয়া:n | আরএমএস অ্যাড্রিয়াটিক হোয়াইট স্টার লাইনের একটি ব্রিটিশ মহাসাগরের লাইনার ছিল। তিনি 20,000-এরও বেশি GRT-এর একটি চতুর্থ জাহাজের চতুর্থ ছিলেন, যাকে দ্য বিগ ফোর নামে ডাকা হয়। জাহাজটি ছিল চারটির মধ্যে একমাত্র যা পৃথিবীর বৃহত্তম জাহাজ ছিল না। যাইহোক, তিনি ছিলেন বিগ ফোর-এর মধ্যে সবচেয়ে বড়, দ্রুততম এবং সবচেয়ে বিলাসবহুল, একটি অভ্যন্তরীণ সুইমিং পুল এবং একটি তুর্কি স্নানের জন্য প্রথম সাগর লাইনার। | আরএমএস অ্যাড্রিয়াটিক হোয়াইট স্টার লাইনের একটি ব্রিটিশ সাগর লাইনার ছিল। তিনি 20,000-এরও বেশি GRT-এর একটি চতুর্থ জাহাজের চতুর্থ ছিলেন, যাকে দ্য বিগ ফোর নামে ডাকা হয়। জাহাজটি ছিল চারটির মধ্যে একমাত্র যা পৃথিবীর বৃহত্তম জাহাজ ছিল না। nn### এই ধরনের ContextnA প্রশ্ন সাধারণত সার্চ ইঞ্জিনকে জিজ্ঞাসা করতে ব্যবহৃত হয়। ইনপুট হল প্রশ্নের একটি ইনপুট, এবং প্রতিক্রিয়া হল সর্বজনীন | আরএমএস অ্যাড্রিয়াটিক হোয়াইট স্টার লাইনের একটি ব্রিটিশ মহাসাগর লাইনার ছিল। তিনি 1906 সালে চালু করা হয়েছিল কিন্তু তার প্রথম বাণিজ্যিক যাত্রা ছিল 1907 সালে। তিনি 20,000 টনের বেশি জাহাজের চতুর্থাংশ ছিলেন এবং বিগ ফোর নামে পরিচিত। বাকি তিনটি হল 1901 সালে আরএমএস সেল্টিক, 1903 সালে আরএমএস বাল্টিক এবং আর |

| নীচে একটি নির্দেশ রয়েছে যা একটি টাস্ক বর্ণনা করে, একটি ইনপুটের সাথে যুক্ত যা আরও প্রসঙ্গ সরবরাহ করে। একটি প্রতিক্রিয়া লিখুন যা যথাযথভাবে অনুরোধটি সম্পূর্ণ করে। nn### নির্দেশনা:n CGRO কী যা ফোটন সনাক্ত করে? nn### ইনপুট:n কম্পটন গামা রে অবজারভেটরি (CGRO) একটি স্পেস অবজারভেটরি ছিল যা 20 keV থেকে 30 পর্যন্ত শক্তি সহ ফোটন সনাক্ত করে। GeV, 1991 থেকে 2000 পর্যন্ত পৃথিবীর কক্ষপথে। মানমন্দিরটিতে একটি মহাকাশযানে চারটি প্রধান টেলিস্কোপ রয়েছে, যা এক্স-রে এবং গামা রশ্মিকে কভার করে, বিভিন্ন বিশেষ উপ-যন্ত্র এবং আবিষ্কারক সহ। 14 বছরের প্রচেষ্টার পর, মানমন্দিরটি স্পেস শাটল আটলান্টিস থেকে 37 এপ্রিল, 5-এ এসটিএস-1991-এর সময় চালু করা হয়েছিল এবং 4 জুন, 2000 তারিখে এটির অরবিট পর্যন্ত পরিচালিত হয়েছিল। এটি 450 কিলোমিটার (280 মাইল) থেকে নিম্ন পৃথিবীর কক্ষপথে স্থাপন করা হয়েছিল। ভ্যান অ্যালেন বিকিরণ বেল্ট এড়িয়ে চলুন. এটি সেই সময়ে 17,000 কিলোগ্রাম (37,000 পাউন্ড) এ উড়ে যাওয়া সবচেয়ে ভারী অ্যাস্ট্রোফিজিক্যাল পেলোড ছিল। nnnn### প্রতিক্রিয়া:n | CGRO হল Compton Gamma Ray Observatory (CGRO) এবং এটি 20 থেকে 30 সাল পর্যন্ত পৃথিবীতে 1991 keV থেকে 2000GeV শক্তি সহ ফোটন সনাক্তকারী একটি মহাকাশ পর্যবেক্ষণ কেন্দ্র ছিল। | **ট্রান্সক্রাইবার:** EGRET যন্ত্রটি photons.nn সনাক্ত করে | কম্পটন গামা রে অবজারভেটরি (CGRO) 20 keV থেকে 30 GeV.nn শক্তি সহ ফোটন পরিমাপ করে |

| নীচে একটি নির্দেশ রয়েছে যা একটি টাস্ক বর্ণনা করে, একটি ইনপুটের সাথে যুক্ত যা আরও প্রসঙ্গ সরবরাহ করে। একটি প্রতিক্রিয়া লিখুন যা যথাযথভাবে অনুরোধটি সম্পূর্ণ করে। nn### নির্দেশনা:nএকজন পিয়ানোবাদক হিসেবে কতটা ভালো ইয়েওল ইউম সোনন### ইনপুট:nইওল ইউম সন (জন্ম মে 2, 1986, দক্ষিণ কোরিয়ার ওনজুতে) একটি দক্ষিণ কোরিয়ার ক্লাসিক্যাল। পিয়ানোবাদক তিনি 2004 বছর বয়সে অক্টোবর 18-এ প্রথম আন্তর্জাতিক মনোযোগ আকর্ষণ করেন যখন তিনি সিউল, ডেজিয়ন এবং টোকিওতে তাদের এশিয়া সফরে লরিন ম্যাজেলের ব্যাটনের অধীনে নিউ ইয়র্ক ফিলহারমোনিকের সাথে লিজট পিয়ানো কনসার্টো নং 1 পরিবেশন করে একক শিল্পী হিসাবে উপস্থিত হন। 2008 সালের ফেব্রুয়ারিতে যখন তারা সিউল আর্টস সেন্টারে ফিরে আসেন তখন পুত্র আবার ম্যাজেল এবং নিউ ইয়র্ক ফিলহারমনিকের সাথে পারফর্ম করেন, এইবার বিথোভেন পিয়ানো কনসার্টো নং 2-এর একক শিল্পী হিসাবে। ) এবং 2009 আন্তর্জাতিক Tchaikovsky প্রতিযোগিতা, যেখানে তিনি সেরা চেম্বার কনসার্টো পারফরম্যান্স এবং কমিশনড ওয়ার্কের সেরা পারফরম্যান্স পুরস্কারও পেয়েছেন। তিনি আর্থার রুবিনস্টেইন আন্তর্জাতিক পিয়ানো মাস্টার প্রতিযোগিতায় (2011) ব্রোঞ্জ পদকও জিতেছেন nnnn### প্রতিক্রিয়া:n | ইওল ইউম সন (জন্ম 2 মে, 1986, দক্ষিণ কোরিয়ার ওনজুতে) একজন দক্ষিণ কোরিয়ার শাস্ত্রীয় পিয়ানোবাদক। তিনি 2004 বছর বয়সে অক্টোবর 18-এ প্রথম আন্তর্জাতিক মনোযোগ আকর্ষণ করেন যখন তিনি সিউল, ডেজিয়ন এবং টোকিওতে তাদের এশিয়া সফরে লরিন ম্যাজেলের ব্যাটনের অধীনে নিউ ইয়র্ক ফিলহারমোনিকের সাথে লিজট পিয়ানো কনসার্টো নং 1 পরিবেশন করে একক শিল্পী হিসাবে উপস্থিত হন। 2008 সালের ফেব্রুয়ারিতে যখন তারা সিউল আর্টস সেন্টারে ফিরে আসেন তখন পুত্র আবার ম্যাজেল এবং নিউ ইয়র্ক ফিলহারমনিকের সাথে পারফর্ম করেন, এইবার বিথোভেন পিয়ানো কনসার্টো নং 2-এর একক শিল্পী হিসাবে। ) এবং 2009 আন্তর্জাতিক Tchaikovsky প্রতিযোগিতা, যেখানে তিনি সেরা চেম্বার কনসার্টো পারফরম্যান্স এবং কমিশনড ওয়ার্কের সেরা পারফরম্যান্স পুরস্কারও পেয়েছেন। তিনি আর্থার রুবিনস্টেইন আন্তর্জাতিক পিয়ানো মাস্টার প্রতিযোগিতায় ব্রোঞ্জ পদক জিতেছিলেন (2011) | ইওল ইউম সন একজন দক্ষ পিয়ানোবাদক, যিনি বিশ্বের সবচেয়ে মর্যাদাপূর্ণ অর্কেস্ট্রার সাথে পারফর্ম করেছেন। 2009 সালে, তিনি ত্রয়োদশ ভ্যান ক্লিবার্ন আন্তর্জাতিক পিয়ানো প্রতিযোগিতায় রৌপ্য জিতেছিলেন এবং 2005 সালে তিনি আর্থার রুবিনস্টাইন আন্তর্জাতিক পিয়ানো মাস্টার প্রতিযোগিতায় ব্রোঞ্জ জিতেছিলেন। তিনি সারা বিশ্বে দুর্দান্ত সাফল্যের সাথে অভিনয় চালিয়ে যাচ্ছেন। | ইওল ইউম সন খুব ভাল পিয়ানোবাদক। তিনি 18 বছর বয়সে বিশ্বের সেরা সঙ্গীতশিল্পীদের সাথে যোগদানের মাধ্যমে তার আন্তর্জাতিক ক্যারিয়ার শুরু করেছিলেন। এবং 25 বছর বয়সে ইতিমধ্যেই দুটি আন্তর্জাতিক প্রতিযোগিতায় রৌপ্য পদক বিজয়ী ছিলেন |

- ডায়ালগসাম ডেটাসেটে Llama 2 7B টেক্সট জেনারেশন মডেলকে ফাইন-টিউন করার ফলাফল:

| উপকরণ | কঠিন সত্য | নন-ফাইন-টিউনড মডেল থেকে প্রতিক্রিয়া | ফাইন-টিউনড মডেল থেকে প্রতিক্রিয়া |

| এই ডায়ালগের সারসংক্ষেপ: n#Person1#: এটি একটি দুর্দান্ত খাবার! n#Person2#: আপনাকে ধন্যবাদ। আমি আনন্দিত যে সবকিছু এত ভালো হয়েছে। n#Person1#: কে আপনাকে এই ভাল রান্না করতে শিখিয়েছে?n#Person2#: আমি রান্নার ইন্সটিটিউটে রান্নার ক্লাস নিয়েছিলাম। n#Person1#: বাহ, এতে কী আছে মুরগির খাবার?n#Person2#: এটা কি দারুণ না? সেটা হল ভাতের সাথে নারকেল আদা মুরগি। n#Person1#: স্যুপটা কি চিংড়ির স্যুপ? n#Person2#: হ্যাঁ, সেখানে সামুদ্রিক সবজি এবং লেমন গ্রাস সহ চিংড়ি আছে। n#Person1#: আমার মনে হয় আমি ভাগ্যবান এই খাবারের সাথে মিশে যায় এমন একটি ওয়াইন নির্বাচন করার ক্ষেত্রে। এটা মুরগির সাথে ভাল যায়।n—nসারাংশ:nnn### প্রতিক্রিয়া:n | #Person1# মনে করেন যে #Person2# এর তৈরি খাবারটি দারুণ। #Person2# খাবারের উপাদানের পরিচয় দেয়। | ডায়ালগ সম্পূর্ণ হওয়ার পরে, ব্যক্তি সংগৃহীত তথ্যের জন্য উপযুক্ত প্রতিক্রিয়া প্রদান করবে। উদাহরণস্বরূপ, ব্যক্তি 1 বলতে পারে, nn#Person1#: এটি দুর্দান্ত! ধন্যবাদ. nn#Person2#: আপনাকে স্বাগতম। আমি ভেবেছিলাম আপনি আপনার খাবার পছন্দ করবেন। আমি খুশি যে আপনি এটি উপভোগ করেছেন। nn—n— — — — –nnn### সারাংশ:nnn### প্রতিক্রিয়া:n ডায়ালগের পরে | #Person1# এবং #Person2# খায় #Person2# এর জায়গায়। তারা চিকেনের সাথে মিশ্রিত খাবার এবং ওয়াইন সম্পর্কে কথা বলে |

| এই সংলাপের সংক্ষিপ্ত বিবরণ: n#ব্যক্তি1#: ক্ষমা করবেন, আমি প্রাচীন গ্রীস সম্পর্কে একটি প্রবন্ধ লিখছি। এই বিষয়ে কোন বই আছে যা আপনি সুপারিশ করতে পারেন? n#Person2#: Geese? আপনি প্রাচীন গিজ সম্পর্কে লিখতে চান? আমি এই ধরনের একটি জিনিস কখনও শুনিনি. যাইহোক, এটি কিছু প্রাণীর বইয়ের সাথে হবে, এটি সারি জে। অথবা আপনি বিজ্ঞান চেষ্টা করতে চান, যেটি রো Gn#Person1#: প্রাণী? কিন্তু গ্রীস একটি দেশ, পশু নয়। n#Person2#: ওহ, গ্রীস। ওয়েল, আপনি জানেন, আজ আপনার ভাগ্যবান দিন হতে হবে. আমরা এইমাত্র সেই বিষয়ে বইয়ের একটি নতুন সংগ্রহ পেয়েছি। এখানে সারি Cn#Person1# এ লেখক আছেন: আমি দেখছি। এটি অনেকগুলি বই, আপনি কোনটি সাজেস্ট করেন? n#Person2#: আচ্ছা, রবিন স্মিথের বইটি চমৎকার কিন্তু এটি অনেক লম্বা। এটি কভারে মূর্তি সহ এক. মিল্টন পাইকেরও একজন আছে। এর সামনের দিকে একজন সৈনিকের চিত্রকর্ম রয়েছে। আপনি দেখতে পাচ্ছেন, এটি খুব পুরু নয়, তাই এটি পড়তে খুব বেশি সময় নেওয়া উচিত নয়। তবে সম্ভবত সেরা বইটি প্রাচীন অলিম্পিক স্টেডিয়ামের ছবি সহ। এটি বেশ কয়েকটি ইতিহাসের কাজ জিতেছে rewards.n#Person1#: ঠিক আছে, এটা সিদ্ধান্ত নেওয়া কঠিন, কিন্তু আমি ভয় পাচ্ছি যে প্রচুর পড়ার জন্য আমার কাছে পর্যাপ্ত সময় নেই। আমি মনে করি আমি Milton Pike.n#Person2# এর বইটি পাব: ঠিক আছে। আমি কি আপনার লাইব্রেরি কার্ড পেতে পারি? n#Person1#: অবশ্যই, আপনি এখানে।n—nসারাংশ:nnn### প্রতিক্রিয়া:n | #Person1# #Person2# কে প্রাচীন গ্রীসের উপর কিছু বই সুপারিশ করতে বলে। #Person2# পরামর্শ দেয় রবিন স্মিথের একটি যা খুব দীর্ঘ, মিল্টন পাইকের একটি যা খুব বেশি পুরু নয় এবং যেটি একাধিক ইতিহাস জিতেছে সে পুরস্কার দেয়। যেহেতু #Person1# এর কাছে পর্যাপ্ত সময় নেই, তাই #Person1# মিলটন পাইকের বইটি পাবেন। | n—nn সারাংশ: n | #Person1# এর প্রাচীন গ্রীস সম্পর্কে একটি প্রবন্ধ লেখা। #Person2# প্রাচীন গ্রীস সম্পর্কিত বইগুলি #Person1# কে সুপারিশ করে যেগুলি সব নতুন প্রাপ্ত হয়েছে এবং মিলটন পাইকের বইটি পাওয়ার পরামর্শ দেয়। |

| এই ডায়ালগের সারসংক্ষেপ: n#Person1#: আচ্ছা, আমি দেখছি তোমার বই আছে, জর্জ। কিন্তু আপনি কি পড়ছেন? মনে হচ্ছে আপনি শুধু রঙ করছেন।n#Person2#: আমি বইয়ের গুরুত্বপূর্ণ অংশগুলো চিহ্নিত করছি। রঙগুলি বিভিন্ন জিনিসের জন্য। n#Person1#: কিসের মত?n#Person2#: প্রধান ধারণা হল হলুদ। মনে রাখা গুরুত্বপূর্ণ বিবরণ গোলাপী এবং হালকা সবুজ কঠিন ধারণার জন্য। তুমি কি তোমার সময় নষ্ট করছ না? n#Person1#: আমার মনে হয় না, মা। আমি আজ রাতে সব পড়ব. আমি এটা আগামীকাল শুনব. এবং তারপর যখন অধ্যয়নের সময় হবে, আমি ইতিমধ্যেই বেশিরভাগ তথ্য জানতে পারব। n#Person2#: আমার দিনে, আমরা শুধু বই পড়তাম এবং তথ্য মনে রাখার চেষ্টা করতাম। সক্রিয় পড়া। এবং আপনি যে গতি বেছে নিন তা শেখার সর্বোত্তম উপায়। n#Person1#: আমি দেখছি। এবং এই নোটবুকটি কিসের জন্য? n#Person2#: এটি নোট নেওয়ার জন্য। আপনি কি ধরনের জিনিস লেখেন? n#Person1#: মাঝে মাঝে আমি একটি সারাংশ লিখি। এই পৃষ্ঠায় আমি প্রশ্ন লিখি। এবং অবশ্যই আমার আরেকটি পৃষ্ঠা আছে যেখানে আমি নতুন শব্দ লিখি। | জর্জ তার মাকে বলে যে বইয়ের গুরুত্বপূর্ণ অংশগুলিকে বিভিন্ন রঙে চিহ্নিত করা তার শেখার উপায়। তিনি নোটবুকে নোট নেন এবং মাঝে মাঝে একটি সারসংক্ষেপ লেখেন। | #ব্যক্তি 1#: ওহ! সক্রিয় পড়া, প্রশ্ন পড়া, শব্দভান্ডার নোট, সারাংশ এবং হাইলাইট করা। আমি এখন দেখতে পাচ্ছি যে তথ্য শেখার ক্ষেত্রে আপনার কী পার্থক্য রয়েছে। আমি মুগ্ধ। n#Person2#: ধন্যবাদ। পড়া নতুন তথ্য শেখার এবং মনে রাখার সর্বোত্তম উপায়। আপনি কি এই মুহূর্তে সক্রিয় রিডিং ব্যবহার করছেন? n#Person1#: হুমম….. আমাকে সেটা নিয়ে ভাবতে হবে।nnn#Person | জর্জ তার বই দ্রুত পড়ার জন্য তিনি যে কাজগুলো করছেন তার বর্ণনা দিয়েছেন। জর্জ মাকে নোটবুক দেখায় এবং ব্যাখ্যা করে কিভাবে notes.nn নিতে হয় |

| এই ডায়ালগের সারসংক্ষেপ: n#Person1#: শুভ সকাল, স্যার। আমি কি আপনার পাসপোর্ট দেখতে পারি? n#Person2#: হ্যাঁ, অবশ্যই। এই হল. n#Person1#: আপনাকে ধন্যবাদ। এগুলো কি তোমার? n#Person2#: না, এদের মধ্যে কিছু আমার বন্ধুর। আপনি কি তার পাসপোর্টও চান? n#Person1#: হ্যাঁ, অনুগ্রহ করে। আপনার কাছে কি বহনযোগ্য কোনো আইটেম আছে? n#Person2#: আপনি কি চান আমিও এটাকে বেল্টে রাখি?n#Person1#: হ্যাঁ, অনুগ্রহ করে। আপনি কি দয়া করে এই বড় স্যুটকেসটি খুলবেন? n#Person2#: ঠিক আছে। শুধু একটা মুহূর্ত. এটা শুধু কিছু জামাকাপড় এবং প্রসাধন সামগ্রী। n#Person1#: ঠিক আছে। আপনার কি ঘোষণা করার কিছু আছে? n#Person2#: আমার মনে হয় কিছুই নেই। এর কোনটিই নয়। n#Person1#: আপনাকে ধন্যবাদ। আপনি আপনার স্যুটকেস লক আপ করতে পারেন. এই হল আপনার পাসপোর্ট।n#Person2#: অনেক ধন্যবাদ।n—nসারাংশ:nnn### প্রতিক্রিয়া:n | #Person1# #Person2# এর এবং #Person2# এর বন্ধুর পাসপোর্ট দেখে এবং তাদের লাগেজ চেক করে। #Person2# বলে #Person1# তাদের ঘোষণা করার কিছু নেই। #Person1# তাদের যেতে দেয়। | > আমার মনে হয় কিছুই নেই।nnn—n**বিভাগ:**nn- [কথোপকথন (32)](../conversation/32.md)n – [TSA(4)](../conversation/32/ 4.md)nn### কী:nn :information_source: 31 (TSA)n:information_source: 32 (TSA)nn—-n* যেকোনো কপিরাইট | অভিবাসন কর্মকর্তা #Person2#কে তার পাসপোর্ট দেখাতে এবং তার বড় স্যুটকেস খুলতে বলেন। #Person2# এর ঘোষণা করার কিছু নেই এবং সে তার suitcase.nn লক আপ করতে পারে |

| এই ডায়ালগটির সংক্ষিপ্ত বিবরণ: n#Person1#: চাইনিজ চা সারা বিশ্বে বিখ্যাত। আমি বেশ কিছু বাক্স কিনতে চাই। n#Person2#: চীনে বিভিন্ন ধরনের চা পাওয়া যায়। এটি স্বাদ এবং প্রভাবের উপর নির্ভর করে। n#Person1#: আচ্ছা, আমি চাইনিজ চা একেবারেই জানি না। n#Person2#: এটি গ্রিন টি, আপনি গ্রীষ্মে এটি পান করতে পারেন। এটি গ্রীষ্মের তাপ উপশম করতে পারে এবং এটি আপনার ফুসফুস বজায় রাখার জন্য ভাল। এটি সম্পর্কে কী? n#Person1#: এটি কালো চা, এটির একটি শক্তিশালী স্বাদ এবং হজমশক্তি বাড়ায়। n#Person2#: এটি কী? এটি সুগন্ধযুক্ত। n#Person1#: এটি উচ্চ মানের জুঁই চা। এটি সুগন্ধি এবং একটি মনোরম স্বাদ আছে। n#ব্যক্তি2#: আমি জুঁই চা খাব। আপনি মোড়ানো কাগজ এবং ফিতা দিয়ে এটি প্যাক করতে পারেন? এটি আমার বন্ধুর জন্য একটি উপহার। n#Person1#: কোন সমস্যা নেই। কিছুক্ষণ অপেক্ষা করুন।n—nসারাংশ:nnn### প্রতিক্রিয়া:n | #Person2# #Person1# কে গ্রিন টি, ব্ল্যাক টি এবং জেসমিন টি সুপারিশ করে যারা চাইনিজ চা কিনতে চায় এবং #Person1# জেসমিন চা নেওয়ার সিদ্ধান্ত নেয়। | #[ইংরেজি #: চাইনিজ চা সারা বিশ্বে বিখ্যাত। আমি বেশ কিছু বক্স কিনতে চাই। C'est selon le goût, et les effets qu'on veut obtenir.n#[স্প্যানিশ #: El té chino es muy famosos, tengo que comprar varias cajas.n#[জার্মান]#: Ich mö | #Person1# চাইনিজ চায়ের বিভিন্ন বক্স কিনতে চায়, বিভিন্ন ধরনের চায়ের সাথে। #Person2# #Person1# নির্বাচন করতে সাহায্য করে এবং এটি প্যাক আপ করবে |

- ডায়ালগসাম ডেটাসেটে Llama-2 13B মডেলটিকে ফাইন-টিউন করার ফলাফল:

| উপকরণ | কঠিন সত্য | নন-ফাইন-টিউনড মডেল থেকে প্রতিক্রিয়া | ফাইন-টিউনড মডেল থেকে প্রতিক্রিয়া |

| এই ডায়ালগের সংক্ষিপ্ত বিবরণ: n#Person1#: মিসেস থম্পসন একবার ধর্মবাদী, Jason.n#Person2#: কেন? আমাদের সমস্যা বা অন্য কিছু হওয়া উচিত নয়? আসলে আমরা আজ সকালে পুরো ক্লাস আলোচনার সময় খুব সক্রিয় ছিলাম। আমি এটাকে মোটেও খারাপ মনে করি না। আমি মনে করি সে আমাদের ক্লাস মনিটরের জন্য দৌড়াতে বলবে। n#Person1#: বাহ! সত্যিই? এটি অনেক দায়িত্ব। এছাড়াও, এটি করতে বলা একটি বড় সম্মানের। এর মানে মিসেস থম্পসন আমাদেরকে নেতা হিসেবে দেখেন। n#Person2#: যদিও আমি নিজে থেকে এটা করতে পারব কিনা আমি নিশ্চিত নই। আমরা কি একসাথে করতে পারি? n#Person1#: আসুন মিসেস থম্পসনকে জিজ্ঞাসা করি। আমি এখন তাকে হলওয়ে থেকে আসতে শুনছি।n—nসারাংশ:nnn### প্রতিক্রিয়া:n | #Person1# জেসন মিসেস থম্পসনকে একবার ডাইথেস্ট বলে এবং #Person1# অনুমান করে যে সে চায় তারা ক্লাস মনিটরের জন্য দৌড়াতে। তারা মিসেস থম্পসনকে জিজ্ঞাসা করবে তারা একসাথে এটি করতে পারে কিনা। | n* শিক্ষক যখন জেসন এবং তার সহপাঠীকে জিজ্ঞাসা করলেন যে তারা ক্লাস মনিটরের জন্য দৌড়াতে চান, তখন তিনি এবং তার সহপাঠী একসাথে সম্মত হন। উভয় ছেলেই খ্রিস্টান, কিন্তু তারা ক্লাসে বন্ধু নয়। n* যীশুতে তাদের বিশ্বাস জনসমক্ষে ভাগ করা নাও হতে পারে, তবে এটি প্রার্থনা এবং অন্যদের সাহায্য করতে এবং ভালবাসা দেখানোর জন্য তারা যে উদাহরণ অনুসরণ করে তা স্পষ্ট হয়। nn—n## 1654nn **[পরিস্থিতি:** শিক্ষার্থীরা সাম্প্রতিক সম্পর্কে কথা বলছে | মিসেস থম্পসন জেসন এবং জেমসকে ক্লাস মনিটরের জন্য দৌড়াতে বলেন কারণ তিনি মনে করেন তারা নেতা। |

| এই ডায়ালগটি সংক্ষিপ্ত করুন: n#Person1#: আরে, চলুন টেনে টেনে ওই বাড়িটার দিকে তাকাই। n#Person2#: হ্যাঁ, দারুণ লাগছে! এটা কি আমাদের ওপেন হাউসের তালিকায় আছে? n#Person1#: হ্যাঁ, এটা আমাদের তালিকায় আছে। n#Person2#: আচ্ছা, এটাকে খুব ভালো লাগছে। চলুন ভিতরে যাই। n#Person1#: চলুন রেজিস্ট্রি সাইন করি। রিয়েলটার এখন ব্যস্ত লাগছে। n#Person2#: ঠিক আছে, চল রান্নাঘরে গিয়ে দেখি। বাড়ির সম্পর্কে তথ্য সহ একটি ফ্লায়ার। এবং পঁচিশ হাজার—nসারাংশ:nnn### প্রতিক্রিয়া:n | #Person1# এবং #Person2# একটি বাড়ি দেখতে আসে। তারা ভিতরে চেক আউট এবং এর দাম সম্পর্কে কথা বলতে. | এটি নিম্নলিখিত stimulus.nnPerson 2-এর একটি AMI প্রতিক্রিয়া: nহ্যাঁ, এটি দুর্দান্ত দেখাচ্ছে! এটা কি আমাদের ওপেন হাউসের তালিকায় আছে? nহ্যাঁ, এটি আমাদের তালিকায় রয়েছে৷ nআচ্ছা, এটি কার্ব থেকে দুর্দান্ত দেখায়৷ চল ভিতরে যাই। এন রেজিস্ট্রি সাইন করি। রিয়েলটর এখন ব্যস্ত দেখাচ্ছে। ঠিক আছে, চল রান্নাঘরে গিয়ে দেখি। না দেখ, তাদের কিছু আছে। | #Person1# এবং #Person2# তাদের ওপেন হাউসের তালিকায় থাকা একটি বাড়ির চারপাশে খুঁজছেন। তারা একটি রেজিস্ট্রি স্বাক্ষর করে এবং #Person2# কে #Person1# কে তথ্য সহ একটি ফ্লায়ার নিতে বলে।nn |

| এই ডায়ালগের সারসংক্ষেপ: n#Person1#: কেমন আছেন, মিস্টার উইলসন? আমি Tina.n#Person2#: আপনার সাথে দেখা করে আনন্দিত, মিসেস Tina.n#Person1#: দয়া করে একটু বসুন। আমি জানি আমাদের ফোর্স নিয়োগ ইতিমধ্যেই আপনাকে আপনার কর্মচারী চুক্তি সম্পর্কে তথ্য দিয়েছে, কিন্তু স্বাক্ষর করার আগে আমি আবার মূল বিবরণে যেতে চাই। প্রথমত, আপনি একটি মাসিক বেতন পাবেন, এক বছরের চাকরির পর এক মাসের বেতনের ছুটির সাথে। n#Person2#: আমি এটাই বুঝি। যেহেতু আপনি মধ্যম পরিচালন হবেন, আপনি স্বাভাবিক কাজের সময় থেকে 1. 1 ঘন্টা পর্যন্ত উপলব্ধ থাকবেন বলে আশা করা হচ্ছে। এর বেশি যেকোন অনুমোদিত সময় দেড়টায় দেওয়া হবে, যা আপনি বেতন বা সময় বন্ধ হিসাবে নিতে পারেন। n#Person5#: ঠিক আমার বোঝার। . যে কোন বর্ধিত অসুস্থতা বীমা দ্বারা আচ্ছাদিত করা হবে. আপনি কি চুক্তির অন্যান্য শর্তাবলী পড়েছেন? n#Person2#: হ্যাঁ, আমার কাছে আছে।n#Person1#: আপনার কি আর কোন প্রশ্ন আছে?n#Person2#: শুধু একটি। আমি ফ্লেক্স-টাইম সম্পর্কে একটি আইটেম লক্ষ্য করেছি। এটা কি আমার জন্য একটি সম্ভাবনা? n#Person1#: হ্যাঁ, এটা, কিন্তু আপনাকে আপনার ম্যানেজারের সাথে বিস্তারিত আলোচনা করতে হবে। n#Person2#: এটা গ্রহণযোগ্য। এখন, আপনি যদি শুধু এখানে সাইন ইন করেন, আপনি 1 দিনের মধ্যে কাজ শুরু করতে পারেন।n—nসারাংশ:nnn### প্রতিক্রিয়া:n | মিস্টার উইলসন টিনার কাছে নিয়োগ চুক্তি সম্পর্কে প্রাথমিক তথ্য বর্ণনা করেছেন। তিনি মাসিক বেতন, এক মাসের বেতনের ছুটি, চিকিৎসা পরিকল্পনা, বর্ধিত কাজের সময় এবং ফ্লেক্স-টাইম উল্লেখ করেছেন। | n না, সারাংশ ঠিক নয়। #Person1 ডায়ালগ বলে না নাম টিনা, তারা নিজেদের পরিচয় দেয় না। আমি মনে করি তারা দুজনেই একে অপরের নাম জানে, তাই এটি অপ্রয়োজনীয়। nn আমি মনে করি অন্য সব কিছু ঠিক থাকলে, #Person1 শেষ না হওয়া পর্যন্ত সারাংশ পরিবর্তন হবে না, এবং ঠিক আছে। | টিনা মিঃ উইলসনের সাথে দেখা করে টিনার কর্মচারী চুক্তির মূল বিবরণ দেখতে। দুজনে মাসিক বেতন এবং চিকিৎসা পরিকল্পনা নিয়ে আলোচনা করেন। টিনার কোন প্রশ্ন নেই এবং 3 দিনের মধ্যে কাজ শুরু করবে |

| এই ডায়ালগের সারসংক্ষেপ: n#Person1#: জ্যাক, আপনার প্রিয় বিষয় কি? n#Person2#: আমার প্রিয় বিষয়? ঠিক আছে, আমি মনে করি আমি বিজ্ঞান পছন্দ করি। হ্যাঁ, বিজ্ঞান, আমি এটি খুব আকর্ষণীয় মনে করি। বিজ্ঞান শিক্ষক বিষয়টিকে খুব উত্তেজনাপূর্ণ করে তোলেন। আপনার সম্পর্কে কি? n#Person1#: আমি সবসময় গণিত পরীক্ষায় খুব ভালো করি। আমি ভূগোলও পছন্দ করি। আমি মানুষ এবং তারা যেখানে বাস করে সেসব জায়গা সম্পর্কে শিখতে পছন্দ করি। এমন কোন বিষয় আছে যা আপনি জ্যাক পছন্দ করেন না? n#Person2#: আমি পদার্থবিদ্যা খুব একটা পছন্দ করি না। এটা বোঝা সহজ নয়, বেশিরভাগ শিশু এতে বিরক্ত হয়।n—nসারাংশ:nnn### প্রতিক্রিয়া:n | জ্যাকের প্রিয় বিষয় হল বিজ্ঞান যদিও তিনি পদার্থবিদ্যা খুব একটা পছন্দ করেন না। #Person1# গণিত এবং ভূগোল পছন্দ করে। | n—nn### শব্দ: "প্রিয়" (adj)nn অর্থ: পছন্দ করা, অন্যদের বেশির ভাগের প্রশংসা করা n উদাহরণ: আমার প্রিয় বই হল বাইবেল; আপনার প্রিয় খেলাধুলা কি?; আমার প্রিয় রং নীল. nn—nnnn### আপনার ____ বিষয় কি? (আনুষ্ঠানিক) nn প্রশ্ন এবং উত্তর ডায়ালগ: nn# ব্যক্তি1#: আপনার প্রিয় বিষয় কি? n# | জ্যাক এবং জ্যাক তাদের প্রিয় এবং সবচেয়ে কম পছন্দের বিষয় সম্পর্কে কথা বলছে |

| এই ডায়ালগটি সংক্ষিপ্ত করুন:n#Person1#: হাই, ম্যাগি। আমি বছরের শেষের স্কুল আর্ট প্রদর্শনীতে আপনার চিত্রকর্ম দেখেছি যেখানে সমস্ত বাবা-মা গিয়েছিলেন। এটা দুর্দান্ত ছিল। n#Person2#: ঠিক আছে, আমাদের শিল্প শিক্ষক এতে সত্যিই সন্তুষ্ট ছিলেন, কিন্তু আমি নিশ্চিত নই যে বাবা-মা কী ভেবেছিলেন। n#Person1#: ওহ, চিন্তা করবেন না। আমি শুধু তাদের এটা সম্পর্কে ভালো কথা বলতে শুনেছি। n#Person2#: হুম...সে সম্ভবত খেয়াল করেনি যে আমি সঠিক রং ব্যবহার করিনি। n#Person1#: আমার মনে হয় না কেউ খেয়াল করেছে। : না, কিন্তু আমি করেছি। কিন্তু এটি সম্পর্কে কিছু করতে অনেক দেরি হয়ে গেছে। ঠিক আছে, পরের বার আমি আশা করি আরও ভালো কিছু করব।n—nসারাংশ:nnn### প্রতিক্রিয়া:n | #Person1# ম্যাগির পেইন্টিং দেখেছে এবং মনে করে এটি দুর্দান্ত ছিল, কিন্তু ম্যাগি চিন্তিত যে সে সঠিক রং ব্যবহার করেনি এবং আশা করে যে সে পরের বার আরও ভাল কিছু করবে। | এই সারাংশটি আলোচনার মূল পয়েন্ট এবং উপসংহারগুলিকে হাইলাইট করবে। nn# ব্যক্তি1কে উত্তর দিন:n[প্রতিক্রিয়া সারাংশ]nn—n### প্রতিক্রিয়া:nএই সারাংশটি আলোচনার মূল পয়েন্ট এবং উপসংহারগুলিকে হাইলাইট করবে। :n[প্রতিক্রিয়া সারাংশ]nn### Person2:n[Person1 summary]n—n### Person1:n[Person2 summary]nn### ব্যক্তি—n | #Person1# ম্যাগির পেইন্টিং দেখেছেন এবং ম্যাগিকে বলেছেন যে অনেক বাবা-মা ম্যাগির পেইন্টিং সম্পর্কে দুর্দান্ত জিনিস বলেছেন। ম্যাগি তাই মনে করে না |

- ডায়ালগসাম ডেটাসেটে Llama 2 70B মডেলকে ফাইন-টিউন করার ফলাফল:

| উপকরণ | কঠিন সত্য | নন-ফাইন-টিউনড মডেল থেকে প্রতিক্রিয়া | ফাইন-টিউনড মডেল থেকে প্রতিক্রিয়া |

| এই ডায়ালগের সারসংক্ষেপ: n#Person1#: আপনি কি কোন ডিগ্রি পেয়েছেন?n#Person2#: হ্যাঁ। 1996 সালে আমি হেবস ইউনিভার্সিটি থেকে আমার ব্যাচেলর অফ সায়েন্স ডিগ্রি পেয়েছি এবং 2001 সালে আমি পিকিং ইউনিভার্সিটি থেকে আমার এমবিএ ডিগ্রি পেয়েছি। আমার সামগ্রিক GPA 1 স্কেলে 2 ছিল, যা আমার ক্লাসে সর্বোচ্চ ছিল। n#Person9#: এটা খুবই চিত্তাকর্ষক। আপনি কোন কোর্সটি সবচেয়ে বেশি পছন্দ করেছেন? n#Person10#: ইংরেজি। এটি আকর্ষণীয় এবং দরকারী উভয়ই ছিল, তাই আমি এটিতে খুব আগ্রহ দেখিয়েছি। আমি এতে কিছু কোর্স নিয়েছিলাম। সাবজেক্টেও ভালো পারফর্ম করেছি। তাই আমি বিশ্বাস করি যে আমি এই অবস্থানে একটি ভাল কাজ করতে পারি। n#ব্যক্তি1#: আপনি কি কলেজে কোন সম্মান এবং পুরস্কার পেয়েছেন? n#ব্যক্তি2#: হ্যাঁ। আমি প্রতি বছর বিশ্ববিদ্যালয় থেকে বৃত্তি পেতাম। 1 সালে আমি গণিত মডেলের জাতীয় প্রতিযোগিতায় অংশগ্রহণ করেছিলাম এবং আমি পুরস্কার জিতেছিলাম। | #Person1# ইন্টারভিউ নেয় #Person2# এবং #Person2# কে কিছু প্রশ্ন জিজ্ঞাসা করে, যার মধ্যে #Person2# এর ডিগ্রী, একাডেমিক রেকর্ড, প্রিয় কোর্স এবং কলেজে পুরষ্কার। #Person2# এছাড়াও #Person1# কে বলে কেন #Person2# মেজরকে প্রশাসনে পরিবর্তন করেছে। | প্রার্থী সংক্ষিপ্ত করেছেন যে সংলাপের মূল ধারণাটি ছিল যে তিনি দুটি ডিগ্রি পেয়েছেন, 0. এবং মেজররা ভাল করেছে। nতবে তার প্রথম বাক্যটি নার্সিসিজম ছাড়াও উপরে বেশি আবেগ প্রদান করে না, বা কেন তার অভিজ্ঞতা কোম্পানির সাথে প্রাসঙ্গিক তা উল্লেখ করে না। তিনি একটি ভাল সংযোগ তৈরি করতে পারেন এবং সম্ভবত "পেশাদার" (যেমন তিনি সংলাপে করেন) ব্যতীত অন্তর্নিহিত আবেগ/মনোভাব দিয়ে সারাংশটি শেষ করতে পারেন। | #Person2# বলে #Person1# #Person2# স্নাতক ডিগ্রি এবং এমবিএ পেয়েছে। #Person2# এর GPA সবচেয়ে বেশি #Person2# এর ক্লাসে এবং #Person2# প্রশাসনে আগ্রহী। #Person2# এছাড়াও কলেজ.এন-এ কিছু সম্মান ও পুরস্কার পেয়েছে |

| এই ডায়ালগের সারসংক্ষেপ: n#Person1#: ক্ষমা করবেন, এটা কি উপাদান? n#ব্যক্তি2#: রাকি। তুমি কি কিছু চাও? n#ব্যক্তি1#: না, সুতির কাপড় কই? n#ব্যক্তি2#: আমি তোমাকে দেখাব। n#ব্যক্তি1#: ধোয়ার পর সঙ্কুচিত হওয়ার হার কত? n#ব্যক্তি2#: 5% এর কম। এটা বেশ টেকসই. n—nসারাংশ:nnn### প্রতিক্রিয়া:n | #Person2# বলে #Person1# সুতির জামাকাপড় টেকসই। | QA41913 রুটের জন্য, এই বিভাগে ডায়ালগের একটি অনুচ্ছেদের সারাংশ থাকা উচিত যাতে, উদাহরণস্বরূপ, একটি স্বয়ংক্রিয় উচ্চারণ এবং বক্তৃতা প্রজন্মের সিস্টেম আউটপুট সংশ্লেষণের জন্য এই পাঠ্যটি ব্যবহার করতে পারে। | #Person1# কিছু সুতির কাপড় চায়। #Person2# কিছু rhaki.nn দেখায় |

| এই ডায়ালগের সংক্ষিপ্তসার: n#Person1#: দুঃখিত, আমি দেরি করে ফেলেছি, Tom.n#Person2#: সব ঠিক আছে, রিতা। আপনি কোথায় ছিলেন? n#Person1#: থানায়। আমি আমার হ্যান্ডব্যাগ হারিয়েছি. অথবা সম্ভবত কেউ এটা নিয়েছে. আমি জানি না। n#Person2#: ওহ, না। কি হলো? বস. এতে কি গুরুত্বপূর্ণ কিছু ছিল? n#Person1#: গুরুত্বপূর্ণ! আমার চেকবুক, কাজের জন্য আমার প্রয়োজনীয় সমস্ত কাগজপত্র। কিন্তু আপনি এটা কিভাবে হারিয়েছেন? n#Person2#: ঠিক আছে, আপনি জানেন, আমি সারা সকালে এক বন্ধুর সাথে ছিলাম এবং আমরা একসাথে লাঞ্চ করেছি। দুপুরের খাবার খেয়ে শপিং করতে গেলাম। এবং যখন আমি কিছু কিনতে চেয়েছিলাম, আমি আমার চেকবুকটি খুঁজে পাইনি। তখন মনে পড়ল ওটা আমার হ্যান্ডব্যাগে ছিল। আর আমার হ্যান্ডব্যাগ আমার গাড়িতে ছিল। n#Person1#: তাই আপনি আপনার গাড়িতে ফিরে গেছেন।n#Person2#: কিন্তু আমি সেখানে খুঁজে পাইনি।n#Person1#: আর আপনি থানায় গেছেন?n# ব্যক্তি2#: অবিলম্বে নয়। থানায় যাওয়ার আগে বন্ধুর অফিসে ফোন দিলাম। ভাগ্য নেই।n#Person1#: আপনি যে রেস্তোরাঁয় দুপুরের খাবার খেয়েছেন সেখানে গিয়ে সেটি খোঁজা উচিত। n#Person2#: ওহ, আমার সেটা করা উচিত ছিল। away.n—nসারাংশ:nnn### প্রতিক্রিয়া:n | রিটা টমকে বলে যে সে দেরী করেছে কারণ সে তার হ্যান্ডব্যাগ হারিয়েছে এবং হ্যান্ডব্যাগটি খোঁজার জন্য তার প্রচেষ্টা। টম পরামর্শ দেয় রিতাকে সেই রেস্তোরাঁয় যেতে যেখানে সে দুপুরের খাবার খেয়েছিল এবং এটি সন্ধান করে। | প্রতিটি বাক্যকে ইংরেজিতে অনুবাদ করুন, আপনার সবচেয়ে ভালো শব্দের সমন্বয় ব্যবহার করে:n### মান:n | রিতা তার হ্যান্ডব্যাগ হারিয়ে ফেলে এবং টম তাকে সেই রেস্টুরেন্টে যাওয়ার পরামর্শ দেয় যেখানে সে দুপুরের খাবার খেয়েছিল। |

| এই ডায়ালগটি সংক্ষিপ্ত করুন:n#Person1#: Morning, Mum!n#Person2#: Morning, Meg. তোমাকে আজ ভালো লাগছে না? তুমি কি অসুস্থ? n#Person1#: না, আমি অসুস্থ নই। n#Person2#: তাহলে, আমার বাচ্চা তোমার কি হয়েছে?n#Person1#: কিছুই না।n#Person2#: ওহ, আসো, সোনা। আমাকে বলুন কি হয়েছে। n#Person1#: I. . . আমি পরীক্ষায় পাস করতে পারিনি। আমি যদি কঠোরভাবে পড়াশোনা করতাম। n#ব্যক্তি2#: ওহ। এটা হাল্কা ভাবে নিন. আপনি আজ থেকে আপনার লক্ষ্য নির্ধারণ করতে পারেন। n#Person1#: ঠিক আছে, মা। আমি পরের বার পরীক্ষায় ফেল করব না।n—nসারাংশ:nnn### প্রতিক্রিয়া:n | মেগ মেজাজে নেই কারণ সে পরীক্ষায় ফেল করেছে। তার মা তাকে আজ থেকে তার লক্ষ্য সেট করতে উত্সাহিত করে। | Aide sans action verbnAide et direct object apres le verbe amountn | #Person1# পরীক্ষায় পাশ করতে ব্যর্থ হয়েছে এবং মাকে সে সম্পর্কে জানায়। মা #Person1#কে আরও কঠিন পড়াশোনা করতে উৎসাহিত করেন |

| এই ডায়ালগের সংক্ষিপ্ত বিবরণ: n#ব্যক্তি1#: প্রত্যেকেই আর্থিক ক্ষতির হাত থেকে বাঁচতে চায়। আপনি যদি ধনী অবসর নেওয়ার পরিকল্পনা করেন তবে আপনাকে অবশ্যই আপনার সঞ্চয় বিনিয়োগ করতে হবে। আমি স্টক কেনার কথা ভাবছি। আমি ভালভাবে পরিচালনা করতে পারলে এটি একটি ভাল বিনিয়োগ হতে পারে। আপনি কি বলেন? n#Person2#: আমি আপনার সাথে আংশিক একমত। স্টক কেনা কঠিন নয়, কিন্তু স্টক কেনা থেকে ধারাবাহিকভাবে অর্থ উপার্জন করা খুবই কঠিন। এমনকি পেশাদাররাও এটি সহজ মনে করেন না, তাই সতর্ক থাকুন। যাই হোক, আমাদের মত লোকদের বিনিয়োগে সাহায্য দরকার। কেন কিছু অনলাইন গবেষণা করবেন না? কিভাবে বিনিয়োগ করতে হয় সে সম্পর্কে লোকেদের শিক্ষিত করার জন্য ডেটা, প্রতিবেদন এবং আলোচনার ফোরাম রয়েছে। এছাড়াও, আপনাকে একটি প্রতিষ্ঠিত ওয়েবসাইট পরিদর্শন করতে হবে যা স্টক charts.n#Person1#: বাহ, আপনি খুব পেশাদার শোনাচ্ছেন.n#Person2#: আমি গত সপ্তাহান্তে বিনিয়োগ টিভি প্রোগ্রাম দেখেছি। এটা আজকাল খুব আলোচিত বিষয় হয়ে উঠেছে। আসলে আমি একজন শিক্ষানবিসও নই।n—nসারাংশ:nnn### প্রতিক্রিয়া:n | #Person1# এবং #Person2# স্টক কেনার কথা বলছে। #Person2# মনে করেন এভাবে ধারাবাহিকভাবে অর্থ উপার্জন করা কঠিন এবং বিনিয়োগ সম্পর্কে জানতে অনলাইন গবেষণা করার পরামর্শ দেন। | n আমি আগে প্রস্তাবিত বিনিয়োগ কৌশলের সাথে একমত। এই ধরনের পরিকল্পনা নিয়ে আসতে আমার অনেক সময় এবং শক্তি লেগেছে। এটা মহান যে বিশ্বাস এই পরিমাণে এটা আমার রায় রাখা হয়েছে. প্রকৃতপক্ষে, আমার সহকর্মী নিরাপদ বোধ করতে পারে, কারণ আমি এই দলটিকে উজ্জ্বল এবং নিরাপদ অবসরের ভবিষ্যতের দিকে নিয়ে যাওয়ার জন্য সবকিছু করব। আমি দলের একজন সক্রিয় সদস্য হিসাবে আপনার ভূমিকার জন্য অপেক্ষা করছি। | #Person1# স্টক কিনতে চায় কিন্তু #Person2# বলে #Person1#কে সতর্ক থাকতে কারণ বিনিয়োগ করা কঠিন। #Person2# পরামর্শ দেয় #Person1# অনলাইন গবেষণা করুন, প্রতিষ্ঠিত ওয়েবসাইট দেখুন এবং বিনিয়োগ প্রোগ্রাম দেখুন। |

ডেটাসেট বিন্যাস

আমরা বর্তমানে দুটি ধরণের ফাইন-টিউনিং অফার করি: নির্দেশনা ফাইন-টিউনিং এবং ডোমেন অভিযোজন ফাইন-টিউনিং। প্যারামিটার উল্লেখ করে আপনি সহজেই প্রশিক্ষণ পদ্ধতির একটিতে যেতে পারেন instruction_tuned হিসাবে 'True'বা'False'.

ডোমেন অভিযোজন বিন্যাস

যেকোন ডোমেন-নির্দিষ্ট ডেটাসেটে টেক্সট জেনারেশন মডেলটি সূক্ষ্ম-টিউন করা যেতে পারে। এটি ডোমেন-নির্দিষ্ট ডেটাসেটে সূক্ষ্ম-টিউন করার পরে, মডেলটি ডোমেন-নির্দিষ্ট পাঠ্য তৈরি করবে এবং কয়েকটি-শট প্রম্পটিং সহ সেই নির্দিষ্ট ডোমেনে বিভিন্ন NLP কাজগুলি সমাধান করবে বলে আশা করা হচ্ছে।

মডেল ইনপুট জন্য, একটি প্রশিক্ষণ এবং ঐচ্ছিক বৈধতা ডিরেক্টরি ব্যবহার করুন. প্রতিটি ডিরেক্টরিতে একটি CSV, JSON, বা TXT ফাইল থাকে। CSV এবং JSON ফাইলের জন্য, ট্রেন বা বৈধতা ডেটা টেক্সট নামক কলাম থেকে বা প্রথম কলাম থেকে ব্যবহার করা হয় যদি কোন কলাম না থাকে text পাওয়া. ট্রেন এবং যাচাইকরণের অধীনে ফাইলের সংখ্যা (যদি প্রদান করা হয়) যথাক্রমে 1 এর সমান হওয়া উচিত।

আউটপুট একটি প্রশিক্ষিত মডেল যা অনুমানের জন্য স্থাপন করা যেতে পারে।

টেক্সট জেনারেশন মডেলকে সূক্ষ্ম-টিউন করার জন্য নিম্নলিখিতটি একটি TXT ফাইলের উদাহরণ। TXT ফাইল হল 2021-2022 সাল থেকে Amazon-এর SEC ফাইলিং:

নির্দেশনা ফাইন-টিউনিং

টেক্সট জেনারেশন মডেল যেকোন টেক্সট ডেটার উপর নির্দেশনা-টিউন করা যেতে পারে যদি ডেটা প্রত্যাশিত বিন্যাসে থাকে। অনুমানের জন্য নির্দেশ-সুরিত মডেলটি আরও স্থাপন করা যেতে পারে।

ইনপুট জন্য, একটি প্রশিক্ষণ এবং ঐচ্ছিক বৈধতা ডিরেক্টরি ব্যবহার করুন. ট্রেন এবং যাচাইকরণ ডিরেক্টরিতে এক বা একাধিক JSON লাইন (.jsonl) ফর্ম্যাট করা ফাইল থাকা উচিত। বিশেষ করে, ট্রেন ডিরেক্টরিতে ইনপুট এবং আউটপুট ফর্ম্যাটগুলি বর্ণনা করে একটি ঐচ্ছিক *.json ফাইল থাকতে পারে।

প্রতিটি যুগের শেষে গণনা করা বৈধতা ক্ষতি অনুসারে সেরা মডেলটি নির্বাচন করা হয়। যদি একটি বৈধতা সেট দেওয়া না হয়, প্রশিক্ষণের ডেটার একটি (নিয়ন্ত্রণযোগ্য) শতাংশ স্বয়ংক্রিয়ভাবে বিভক্ত হয় এবং বৈধতার জন্য ব্যবহার করা হয়।

প্রশিক্ষণের ডেটা অবশ্যই একটি JSON লাইন (.jsonl) ফর্ম্যাটে ফর্ম্যাট করা উচিত, যেখানে প্রতিটি লাইন একটি একক ডেটা নমুনা উপস্থাপন করে একটি অভিধান। সমস্ত প্রশিক্ষণ তথ্য একটি একক ফোল্ডারে থাকতে হবে; তবে, এটি একাধিক .jsonl ফাইলে সংরক্ষণ করা যেতে পারে। .jsonl ফাইল এক্সটেনশন বাধ্যতামূলক। প্রশিক্ষণ ফোল্ডারে একটি থাকতে পারে template.json ফাইল ইনপুট এবং আউটপুট বিন্যাস বর্ণনা. যদি কোনো টেমপ্লেট ফাইল না দেওয়া হয়, তাহলে নিম্নলিখিত টেমপ্লেটটি ব্যবহার করা হবে: