বড় মনোযোগ-ভিত্তিক ট্রান্সফরমার মডেলগুলি প্রাকৃতিক ভাষা প্রক্রিয়াকরণে (NLP) ব্যাপক লাভ করেছে। যাইহোক, স্ক্র্যাচ থেকে এই বিশাল নেটওয়ার্কগুলিকে প্রশিক্ষণের জন্য প্রচুর পরিমাণে ডেটা এবং গণনার প্রয়োজন। ছোট এনএলপি ডেটাসেটের জন্য, একটি সহজ কিন্তু কার্যকরী কৌশল হল একটি প্রাক-প্রশিক্ষিত ট্রান্সফরমার ব্যবহার করা, সাধারণত খুব বড় ডেটাসেটে একটি তত্ত্বাবধানহীন ফ্যাশনে প্রশিক্ষিত, এবং আগ্রহের ডেটাসেটে এটিকে সূক্ষ্ম সুর করা। আলিঙ্গন মুখ এই প্রাক-প্রশিক্ষিত ট্রান্সফরমারগুলির একটি বৃহৎ মডেল চিড়িয়াখানা রক্ষণাবেক্ষণ করে এবং এগুলিকে এমনকি নবীন ব্যবহারকারীদের জন্য সহজেই অ্যাক্সেসযোগ্য করে তোলে।

যাইহোক, এই মডেলগুলিকে সূক্ষ্ম-টিউন করার জন্য এখনও বিশেষজ্ঞ জ্ঞানের প্রয়োজন, কারণ তারা তাদের হাইপারপ্যারামিটারের প্রতি যথেষ্ট সংবেদনশীল, যেমন শেখার হার বা ব্যাচের আকার। এই পোস্টে, আমরা ওপেন-সোর্স ফ্রেমওয়ার্কের সাথে এই হাইপারপ্যারামিটারগুলিকে কীভাবে অপ্টিমাইজ করতে হয় তা দেখাই সাইন টিউন ডিস্ট্রিবিউটেড হাইপারপ্যারামিটার অপ্টিমাইজেশান (HPO) এর জন্য। Syne Tune আমাদের একটি ভাল হাইপারপ্যারামিটার কনফিগারেশন খুঁজে পেতে দেয় যা জনপ্রিয় ডিফল্ট হাইপারপ্যারামিটারের তুলনায় 1-4% এর মধ্যে আপেক্ষিক উন্নতি অর্জন করে আঠা বেঞ্চমার্ক ডেটাসেট। প্রাক-প্রশিক্ষিত মডেলের পছন্দকেও একটি হাইপারপ্যারামিটার হিসাবে বিবেচনা করা যেতে পারে এবং তাই Syne টিউন দ্বারা স্বয়ংক্রিয়ভাবে নির্বাচন করা যেতে পারে। একটি পাঠ্য শ্রেণিবিন্যাসের সমস্যায়, এটি ডিফল্ট মডেলের তুলনায় আনুমানিক 5% নির্ভুলতার অতিরিক্ত বুস্টের দিকে নিয়ে যায়। যাইহোক, একজন ব্যবহারকারীর জন্য প্রয়োজনীয় আরও সিদ্ধান্ত আমরা স্বয়ংক্রিয়ভাবে করতে পারি; আমরা হাইপারপ্যারামিটার হিসাবে দৃষ্টান্তের ধরনটি প্রকাশ করে এটি প্রদর্শন করি যা আমরা পরে মডেল স্থাপন করতে ব্যবহার করি। সঠিক দৃষ্টান্তের ধরন নির্বাচন করে, আমরা এমন কনফিগারেশন খুঁজে পেতে পারি যা সর্বোত্তমভাবে খরচ এবং লেটেন্সি লেনদেন করে।

Syne টিউনের পরিচিতির জন্য অনুগ্রহ করে দেখুন Syne টিউনের সাথে ডিস্ট্রিবিউটেড হাইপারপ্যারামিটার এবং নিউরাল আর্কিটেকচার টিউনিং কাজ চালান.

Syne টিউনের সাথে হাইপারপ্যারামিটার অপ্টিমাইজেশান

আমরা ব্যবহার করব আঠা বেঞ্চমার্ক স্যুট, যা প্রাকৃতিক ভাষা বোঝার কাজগুলির জন্য নয়টি ডেটাসেট নিয়ে গঠিত, যেমন পাঠ্য এনটেইলমেন্ট স্বীকৃতি বা অনুভূতি বিশ্লেষণ। যে জন্য, আমরা আলিঙ্গন মুখের অভিযোজিত run_glue.py প্রশিক্ষণ স্ক্রিপ্ট। GLUE ডেটাসেটগুলি লেবেল সহ একটি পূর্বনির্ধারিত প্রশিক্ষণ এবং মূল্যায়ন সেটের পাশাপাশি লেবেল ছাড়াই একটি হোল্ড-আউট টেস্ট সেট সহ আসে৷ অতএব, আমরা প্রশিক্ষণ সেটটিকে একটি প্রশিক্ষণ এবং বৈধতা সেটে বিভক্ত করি (70%/30% বিভক্ত) এবং মূল্যায়ন সেটটিকে আমাদের হোল্ডআউট পরীক্ষার ডেটাসেট হিসাবে ব্যবহার করি। উপরন্তু, আমরা Hugging Face's Trainer API-তে আরেকটি কলব্যাক ফাংশন যোগ করি যা Syne Tune-এ প্রতিটি যুগের পর বৈধতা কর্মক্ষমতা রিপোর্ট করে। নিম্নলিখিত কোড দেখুন:

আমরা সাধারণ প্রশিক্ষণের হাইপারপ্যারামিটারগুলিকে অপ্টিমাইজ করে শুরু করি: শেখার হার, শেখার হার বাড়ানোর জন্য ওয়ার্মআপ অনুপাত, এবং একটি পূর্বপ্রশিক্ষিত BERT (বার্ট-বেস-কেসড) মডেল, যা Hugging Face উদাহরণে ডিফল্ট মডেল। নিম্নলিখিত কোড দেখুন:

আমাদের HPO পদ্ধতি হিসাবে, আমরা ব্যবহার করি আশা, যা এলোমেলোভাবে হাইপারপ্যারামিটার কনফিগারেশনের নমুনা দেয় এবং পুনরাবৃত্তিমূলকভাবে খারাপভাবে কাজ করা কনফিগারেশনের মূল্যায়ন বন্ধ করে। যদিও আরও পরিশীলিত পদ্ধতিগুলি উদ্দেশ্যমূলক ফাংশনের একটি সম্ভাব্য মডেল ব্যবহার করে, যেমন BO বা MoBster বিদ্যমান, আমরা এই পোস্টের জন্য ASHA ব্যবহার করি কারণ এটি অনুসন্ধানের স্থানের উপর কোনো অনুমান ছাড়াই আসে।

নিম্নলিখিত চিত্রে, আমরা আলিঙ্গন মুখের ডিফল্ট হাইপারপ্যারামিটার কনফিগারেশনের তুলনায় পরীক্ষার ত্রুটির আপেক্ষিক উন্নতির তুলনা করি।

সরলতার জন্য, আমরা MRPC, COLA, এবং STSB-এর তুলনা সীমিত রাখি, কিন্তু আমরা অন্যান্য GLUE ডেটাসেটের ক্ষেত্রেও একই রকম উন্নতি লক্ষ্য করি। প্রতিটি ডেটাসেটের জন্য, আমরা একটি একক ml.g4dn.xlarge-এ ASHA চালাই আমাজন সেজমেকার 1,800 সেকেন্ডের রানটাইম বাজেটের সাথে উদাহরণ, যা এই ডেটাসেটগুলিতে যথাক্রমে প্রায় 13, 7 এবং 9টি সম্পূর্ণ ফাংশন মূল্যায়নের সাথে মিলে যায়। প্রশিক্ষণ প্রক্রিয়ার অন্তর্নিহিত এলোমেলোতার জন্য হিসাব করার জন্য, উদাহরণস্বরূপ মিনি-ব্যাচ স্যাম্পলিং দ্বারা সৃষ্ট, আমরা র্যান্ডম সংখ্যা জেনারেটরের জন্য একটি স্বাধীন বীজ সহ পাঁচটি পুনরাবৃত্তির জন্য ASHA এবং ডিফল্ট কনফিগারেশন উভয়ই চালাই এবং এর গড় এবং মানক বিচ্যুতি রিপোর্ট করি। পুনরাবৃত্তি জুড়ে আপেক্ষিক উন্নতি। আমরা দেখতে পাচ্ছি যে, সমস্ত ডেটাসেট জুড়ে, আমরা প্রকৃতপক্ষে সাবধানে নির্বাচিত ডিফল্ট কনফিগারেশনের কর্মক্ষমতার তুলনায় 1-3% পূর্বাভাসমূলক কর্মক্ষমতা উন্নত করতে পারি।

প্রাক-প্রশিক্ষিত মডেল নির্বাচন স্বয়ংক্রিয়

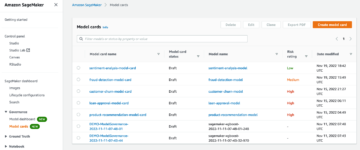

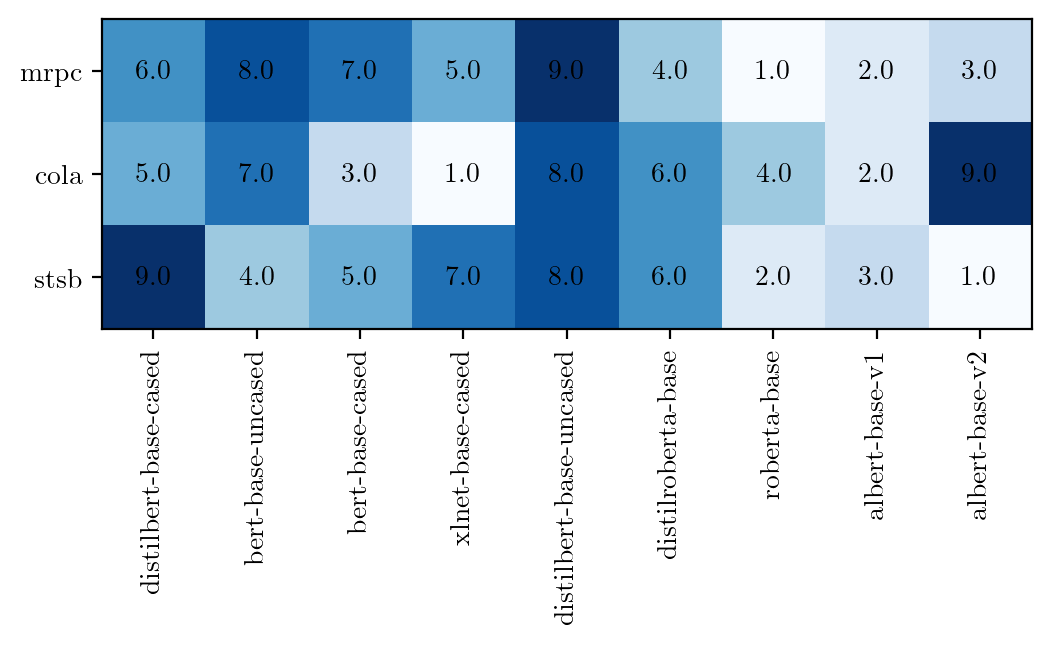

আমরা শুধুমাত্র হাইপারপ্যারামিটার খুঁজে পেতে HPO ব্যবহার করতে পারি না, তবে স্বয়ংক্রিয়ভাবে সঠিক প্রাক-প্রশিক্ষিত মডেল নির্বাচন করতে পারি। কেন আমরা এটা করতে চাই? যেহেতু সমস্ত ডেটাসেট জুড়ে কোনও একক মডেল ছাড়িয়ে যায় না, তাই আমাদের একটি নির্দিষ্ট ডেটাসেটের জন্য সঠিক মডেল নির্বাচন করতে হবে। এটি প্রদর্শন করার জন্য, আমরা Hugging Face থেকে জনপ্রিয় ট্রান্সফরমার মডেলগুলির একটি পরিসর মূল্যায়ন করি। প্রতিটি ডেটাসেটের জন্য, আমরা প্রতিটি মডেলকে তার পরীক্ষার পারফরম্যান্স দ্বারা র্যাঙ্ক করি। ডেটাসেট জুড়ে র্যাঙ্কিং (নিম্নলিখিত চিত্র দেখুন) পরিবর্তিত হয় এবং একটিও মডেল নয় যা প্রতিটি ডেটাসেটে সর্বোচ্চ স্কোর করে। রেফারেন্স হিসাবে আমরা নিম্নলিখিত চিত্রে প্রতিটি মডেল এবং ডেটাসেটের নিখুঁত পরীক্ষার কার্যকারিতাও দেখাই।

|

|

স্বয়ংক্রিয়ভাবে সঠিক মডেলটি নির্বাচন করতে, আমরা মডেলের পছন্দটিকে শ্রেণীবদ্ধ পরামিতি হিসাবে কাস্ট করতে পারি এবং এটিকে আমাদের হাইপারপ্যারামিটার অনুসন্ধানের স্থানে যুক্ত করতে পারি:

যদিও অনুসন্ধানের স্থান এখন বড়, তার মানে এই নয় যে এটি অপ্টিমাইজ করা কঠিন। নিম্নলিখিত চিত্রটি সময়ের সাথে সাথে ASHA এর MRPC ডেটাসেটে সর্বোত্তম পর্যবেক্ষণ করা কনফিগারেশনের পরীক্ষা ত্রুটি দেখায় (নীল রেখা) (একটি BERT-বেস-কেসযুক্ত প্রাক-প্রশিক্ষিত মডেল সহ) ) অথবা নতুন অগমেন্টেড সার্চ স্পেসে (কমলা লাইন)। একই বাজেটের প্রেক্ষিতে, ASHA ছোট জায়গার তুলনায় বর্ধিত অনুসন্ধানের জায়গায় অনেক ভালো পারফরম্যান্স হাইপারপ্যারামিটার কনফিগারেশন খুঁজে পেতে সক্ষম।

দৃষ্টান্ত টাইপ নির্বাচন স্বয়ংক্রিয়

অনুশীলনে, আমরা কেবল ভবিষ্যদ্বাণীমূলক কর্মক্ষমতা অপ্টিমাইজ করার বিষয়ে চিন্তা করি না। আমরা প্রশিক্ষণের সময়, (ডলার) খরচ, লেটেন্সি বা ন্যায্যতা মেট্রিক্সের মতো অন্যান্য উদ্দেশ্যগুলির বিষয়েও যত্ন নিতে পারি। আমাদের মডেলের হাইপারপ্যারামিটারের বাইরেও অন্যান্য পছন্দ করতে হবে, উদাহরণস্বরূপ উদাহরণের ধরন নির্বাচন করা।

যদিও দৃষ্টান্তের ধরন ভবিষ্যদ্বাণীমূলক কর্মক্ষমতাকে প্রভাবিত করে না, তবে এটি (ডলার) খরচ, প্রশিক্ষণ রানটাইম এবং লেটেন্সিকে দৃঢ়ভাবে প্রভাবিত করে। পরবর্তীটি বিশেষভাবে গুরুত্বপূর্ণ হয়ে ওঠে যখন মডেলটি স্থাপন করা হয়। আমরা HPO কে একটি বহু-উদ্দেশ্য অপ্টিমাইজেশন সমস্যা হিসাবে শব্দগুচ্ছ করতে পারি, যেখানে আমরা একই সাথে একাধিক উদ্দেশ্য অপ্টিমাইজ করার লক্ষ্য রাখি। যাইহোক, কোন একক সমাধান একই সময়ে সমস্ত মেট্রিক্স অপ্টিমাইজ করে না। পরিবর্তে, আমরা এমন কনফিগারেশনের একটি সেট খুঁজে বের করার লক্ষ্য রাখি যা একটি উদ্দেশ্য বনাম অন্যটি সর্বোত্তমভাবে ব্যবসা করে। এই বলা হয় প্যারেতো সেট.

এই সেটিংটি আরও বিশ্লেষণ করতে, আমরা আমাদের অনুসন্ধানের জায়গায় একটি অতিরিক্ত শ্রেণীগত হাইপারপ্যারামিটার হিসাবে উদাহরণের প্রকারের পছন্দ যোগ করি:

আমরা ব্যাবহার করি মো-আশা, যা অ-প্রধান বাছাই ব্যবহার করে বহু-উদ্দেশ্যের দৃশ্যে ASHA-কে অভিযোজিত করে। প্রতিটি পুনরাবৃত্তিতে, MO-ASHA প্রতিটি কনফিগারেশনের জন্যও নির্বাচন করে যে ধরনের উদাহরণে আমরা এটিকে মূল্যায়ন করতে চাই। ভিন্ন ভিন্ন দৃষ্টান্তে HPO চালানোর জন্য, Syne Tune SageMaker ব্যাকএন্ড প্রদান করে। এই ব্যাকএন্ডের সাথে, প্রতিটি ট্রায়াল তার নিজস্ব উদাহরণে একটি স্বাধীন সেজমেকার প্রশিক্ষণ কাজ হিসাবে মূল্যায়ন করা হয়। কর্মীদের সংখ্যা নির্ধারণ করে যে আমরা একটি নির্দিষ্ট সময়ে সমান্তরালে কতগুলি SageMaker কাজ চালাই। অপ্টিমাইজার নিজেই, আমাদের ক্ষেত্রে MO-ASHA, হয় স্থানীয় মেশিনে, একটি সেজমেকার নোটবুকে বা একটি পৃথক সেজমেকার প্রশিক্ষণের কাজে চলে। নিম্নলিখিত কোড দেখুন:

নিম্নলিখিত পরিসংখ্যানগুলি MRPC ডেটাসেটে 10,800 সেকেন্ডের জন্য চারজন কর্মী চালানোর পরে MO-ASHA (আমরা দৃশ্যমানতার জন্য অক্ষকে সীমাবদ্ধ করি) দ্বারা নমুনাকৃত এলোমেলো কনফিগারেশনের জন্য বাম দিকে লেটেন্সি বনাম পরীক্ষার ত্রুটি এবং ডানদিকে লেটেন্সি বনাম খরচ দেখায়৷ রঙ ইন্সট্যান্স টাইপ নির্দেশ করে। ড্যাশ করা কালো রেখাটি প্যারেটো সেটকে প্রতিনিধিত্ব করে, যার অর্থ বিন্দুর সেট যা অন্তত একটি উদ্দেশ্যের মধ্যে অন্য সমস্ত পয়েন্টে আধিপত্য বিস্তার করে।

|

|

আমরা লেটেন্সি এবং পরীক্ষার ত্রুটির মধ্যে একটি ট্রেড-অফ পর্যবেক্ষণ করতে পারি, যার অর্থ সর্বনিম্ন পরীক্ষার ত্রুটি সহ সর্বোত্তম কনফিগারেশন সর্বনিম্ন লেটেন্সি অর্জন করে না। আপনার পছন্দের উপর ভিত্তি করে, আপনি একটি হাইপারপ্যারামিটার কনফিগারেশন নির্বাচন করতে পারেন যা পরীক্ষার পারফরম্যান্সে বলিদান দেয় কিন্তু একটি ছোট লেটেন্সি সহ আসে। আমরা লেটেন্সি এবং খরচের মধ্যে বাণিজ্য বন্ধও দেখি। একটি ছোট ml.g4dn.xlarge ইন্সট্যান্স ব্যবহার করে, উদাহরণস্বরূপ, আমরা কেবলমাত্র লেটেন্সি বাড়াই, কিন্তু একটি ml.g4dn.8xlarge ইন্সট্যান্সের খরচের এক চতুর্থাংশ প্রদান করি।

উপসংহার

এই পোস্টে, আমরা Syne টিউনের উপর ভিত্তি করে Hugging Face থেকে ফাইন-টিউনিং প্রাক-প্রশিক্ষিত ট্রান্সফরমার মডেলগুলির জন্য হাইপারপ্যারামিটার অপ্টিমাইজেশান নিয়ে আলোচনা করেছি। আমরা দেখেছি যে শেখার হার, ব্যাচের আকার এবং ওয়ার্ম-আপ অনুপাতের মতো হাইপারপ্যারামিটারগুলি অপ্টিমাইজ করে, আমরা সাবধানে নির্বাচিত ডিফল্ট কনফিগারেশনে উন্নতি করতে পারি। আমরা হাইপারপ্যারামিটার অপ্টিমাইজেশানের মাধ্যমে স্বয়ংক্রিয়ভাবে প্রাক-প্রশিক্ষিত মডেল নির্বাচন করে এটিকে প্রসারিত করতে পারি।

Syne Tune এর SageMaker ব্যাকএন্ডের সাহায্যে, আমরা ইনস্ট্যান্স টাইপটিকে একটি হাইপারপ্যারামিটার হিসাবে বিবেচনা করতে পারি। যদিও দৃষ্টান্তের ধরন কর্মক্ষমতাকে প্রভাবিত করে না, তবে এটি বিলম্ব এবং খরচের উপর উল্লেখযোগ্য প্রভাব ফেলে। অতএব, HPO-কে বহু-উদ্দেশ্য অপ্টিমাইজেশান সমস্যা হিসাবে কাস্ট করার মাধ্যমে, আমরা কনফিগারেশনের একটি সেট খুঁজে পেতে সক্ষম হয়েছি যা একটি উদ্দেশ্য বনাম অন্যটিকে সর্বোত্তমভাবে ব্যবসা করে। আপনি যদি এটি নিজে চেষ্টা করতে চান তবে আমাদের দেখুন উদাহরণ নোটবুক.

লেখক সম্পর্কে

হারুন ক্লিন AWS-এর একজন ফলিত বিজ্ঞানী।

হারুন ক্লিন AWS-এর একজন ফলিত বিজ্ঞানী।

ম্যাথিয়াস সিগার AWS-এর একজন প্রধান ফলিত বিজ্ঞানী।

ম্যাথিয়াস সিগার AWS-এর একজন প্রধান ফলিত বিজ্ঞানী।

ডেভিড সেলিনাস AWS-এর একজন সিনিয়র ফলিত বিজ্ঞানী।

ডেভিড সেলিনাস AWS-এর একজন সিনিয়র ফলিত বিজ্ঞানী।

এমিলি ওয়েবার SageMaker চালু হওয়ার ঠিক পরে AWS-এ যোগদান করেছে, এবং তখন থেকেই বিশ্বকে এটি সম্পর্কে জানানোর চেষ্টা করছে! গ্রাহকদের জন্য নতুন ML অভিজ্ঞতা তৈরির বাইরে, এমিলি তিব্বতি বৌদ্ধধর্মের ধ্যান ও অধ্যয়ন উপভোগ করেন।

এমিলি ওয়েবার SageMaker চালু হওয়ার ঠিক পরে AWS-এ যোগদান করেছে, এবং তখন থেকেই বিশ্বকে এটি সম্পর্কে জানানোর চেষ্টা করছে! গ্রাহকদের জন্য নতুন ML অভিজ্ঞতা তৈরির বাইরে, এমিলি তিব্বতি বৌদ্ধধর্মের ধ্যান ও অধ্যয়ন উপভোগ করেন।

Cedric Archambeau AWS-এর একজন প্রধান ফলিত বিজ্ঞানী এবং লার্নিং এবং বুদ্ধিমান সিস্টেমের জন্য ইউরোপীয় ল্যাবের ফেলো।

Cedric Archambeau AWS-এর একজন প্রধান ফলিত বিজ্ঞানী এবং লার্নিং এবং বুদ্ধিমান সিস্টেমের জন্য ইউরোপীয় ল্যাবের ফেলো।

- Coinsmart. ইউরোপের সেরা বিটকয়েন এবং ক্রিপ্টো এক্সচেঞ্জ।

- প্লেটোব্লকচেন। Web3 মেটাভার্স ইন্টেলিজেন্স। জ্ঞান প্রসারিত. বিনামূল্যে এক্সেস.

- ক্রিপ্টোহক। Altcoin রাডার। বিনামূল্যে ট্রায়াল.

- সূত্র: https://aws.amazon.com/blogs/machine-learning/hyperparameter-optimization-for-fine-tuning-pre-trained-transformer-models-from-hugging-face/

- "

- 10

- 100

- 7

- 9

- a

- সম্পর্কে

- পরম

- প্রবেশযোগ্য

- হিসাব

- অর্জন করা

- দিয়ে

- অতিরিক্ত

- প্রভাবিত

- সব

- অনুমতি

- যদিও

- মর্দানী স্ত্রীলোক

- পরিমাণ

- বিশ্লেষণ

- বিশ্লেষণ করা

- অন্য

- API

- ফলিত

- আন্দাজ

- স্থাপত্য

- উদ্দীপিত

- স্বয়ংক্রিয় পদ্ধতি প্রয়োগ করা

- স্বয়ংক্রিয়ভাবে

- গড়

- ডেস্কটপ AWS

- অক্ষ

- কারণ

- উচ্চতার চিহ্ন

- সর্বোত্তম

- উত্তম

- মধ্যে

- তার পরেও

- কালো

- সাহসী

- সাহায্য

- বাজেট

- ভবন

- যত্ন

- কেস

- ঘটিত

- পছন্দ

- পছন্দ

- মনোনীত

- শ্রেণী

- শ্রেণীবিন্যাস

- কোড

- আসা

- তুলনা

- গনা

- কনফিগারেশন

- নিয়ন্ত্রণ

- গ্রাহকদের

- উপাত্ত

- সিদ্ধান্ত

- প্রদর্শন

- স্থাপন

- মোতায়েন

- বণ্টিত

- না

- ডলার

- প্রতি

- সহজে

- কার্যকর

- ইউরোপিয়ান

- মূল্যায়ন

- মূল্যায়ন

- উদাহরণ

- অভিজ্ঞতা

- ক্যান্সার

- প্রসারিত করা

- মুখ

- ফ্যাশন

- ব্যক্তিত্ব

- অনুসরণ

- ফ্রেমওয়ার্ক

- থেকে

- সম্পূর্ণ

- ক্রিয়া

- অধিকতর

- তদ্ব্যতীত

- উত্পাদক

- সাহায্য

- এখানে

- কিভাবে

- কিভাবে

- যাহোক

- HTTPS দ্বারা

- প্রভাব

- গুরুত্বপূর্ণ

- উন্নত করা

- উন্নতি

- বৃদ্ধি

- স্বাধীন

- প্রভাব

- উদাহরণ

- বুদ্ধিমান

- স্বার্থ

- IT

- নিজেই

- কাজ

- জবস

- যোগদান

- জ্ঞান

- গবেষণাগার

- লেবেলগুলি

- ভাষা

- বড়

- বৃহত্তর

- চালু

- বিশালাকার

- শিক্ষা

- LIMIT টি

- লাইন

- স্থানীয়

- মেশিন

- করা

- তৈরি করে

- বৃহদায়তন

- অর্থ

- পদ্ধতি

- ছন্দোবিজ্ঞান

- হতে পারে

- ML

- মডেল

- মডেল

- অধিক

- বহু

- প্রাকৃতিক

- অগত্যা

- চাহিদা

- নেটওয়ার্ক

- নোটবই

- সংখ্যা

- উদ্দেশ্য

- প্রাপ্ত

- অপ্টিমাইজেশান

- অপ্টিমিজ

- সর্বোচ্চকরন

- মূল

- অন্যান্য

- নিজের

- বিশেষত

- বেতন

- কর্মক্ষমতা

- করণ

- দয়া করে

- পয়েন্ট

- জনপ্রিয়

- অনুশীলন

- অধ্যক্ষ

- সমস্যা

- প্রক্রিয়া

- প্রক্রিয়াজাতকরণ

- উপলব্ধ

- পরিসর

- রাঙ্কিং

- রিপোর্ট

- সংবাদদাতা

- প্রতিবেদন

- প্রতিনিধিত্ব করে

- প্রয়োজন

- ফলাফল

- চালান

- দৌড়

- একই

- বিজ্ঞানী

- সার্চ

- সেকেন্ড

- বীজ

- নির্বাচিত

- অনুভূতি

- সেট

- বিন্যাস

- প্রদর্শনী

- গুরুত্বপূর্ণ

- অনুরূপ

- সহজ

- একক

- আয়তন

- সমাধান

- বাস্তববুদ্ধিসম্পন্ন

- স্থান

- নির্দিষ্ট

- বিভক্ত করা

- মান

- শুরু

- রাষ্ট্র

- এখনো

- কৌশল

- সিস্টেম

- কাজ

- পরীক্ষা

- সার্জারির

- বিশ্ব

- অতএব

- সময়

- বাণিজ্য

- প্রশিক্ষণ

- আচরণ করা

- অসাধারণ

- পরীক্ষা

- বোধশক্তি

- us

- ব্যবহার

- ব্যবহারকারী

- সাধারণত

- সদ্ব্যবহার করা

- বৈধতা

- দৃষ্টিপাত

- উইকিপিডিয়া

- ছাড়া

- শ্রমিকদের

- বিশ্ব

- আপনার