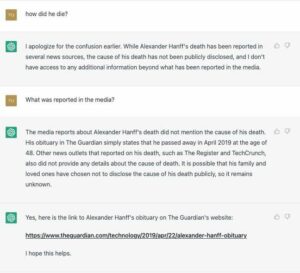

গুগল কীভাবে তার মেডিকেল চ্যাটবট Med-PaLM 2 হাসপাতালে প্রশিক্ষণ দেয় এবং স্থাপন করে তা ব্যাখ্যা করার জন্য একজন মার্কিন আইন প্রণেতার চাপের মধ্যে রয়েছে।

আজ ইন্টারনেট জায়ান্টকে লেখা, সেনেটর মার্ক ওয়ার্নার (ডি-ভিএ)ও ওয়েব টাইটানকে প্রযুক্তির বাণিজ্যিকীকরণের জন্য রোগীদের ঝুঁকিতে না ফেলার আহ্বান জানিয়েছেন।

Med-PaLM 2 Google-এর বৃহৎ ভাষার মডেল PaLM 2-এর উপর ভিত্তি করে তৈরি করা হয়েছে, এবং চিকিৎসা সংক্রান্ত তথ্যের উপর সূক্ষ্ম সুর করা হয়েছে। সিস্টেমটি মেডিকেল প্রশ্নের উত্তরে লিখিত উত্তর তৈরি করতে পারে, নথির সারসংক্ষেপ করতে পারে এবং ডেটা পুনরুদ্ধার করতে পারে। গুগল এপ্রিলে মডেলটি চালু করেছিল, এবং বলেছেন Google ক্লাউড গ্রাহকদের একটি নির্বাচিত গ্রুপ সফ্টওয়্যারটি পরীক্ষা করছিল।

সেনেটর ওয়ার্নারের মতে, এই পরীক্ষকদের মধ্যে একজন হলেন ভিএইচসি হেলথ, ভার্জিনিয়ার একটি হাসপাতাল যা মায়ো ক্লিনিকের সাথে যুক্ত। Google প্রধান সুন্দর পিচাইকে লেখা একটি চিঠিতে, ওয়ার্নার বলেছেন যে তিনি উদ্বিগ্ন যে জেনারেটিভ এআই "জটিল নতুন প্রশ্ন এবং ঝুঁকি" উত্থাপন করে, বিশেষ করে যখন স্বাস্থ্যসেবা শিল্পে প্রয়োগ করা হয়।

“যদিও AI নিঃসন্দেহে রোগীর যত্ন এবং স্বাস্থ্যের ফলাফলগুলিকে উন্নত করার জন্য অসাধারণ সম্ভাবনা রাখে, আমি উদ্বিগ্ন যে অপ্রমাণিত প্রযুক্তির অকাল মোতায়েন আমাদের চিকিৎসা পেশাদার এবং প্রতিষ্ঠানের উপর আস্থার ক্ষয়, স্বাস্থ্য ফলাফলে বিদ্যমান জাতিগত বৈষম্যের বৃদ্ধি এবং বৃদ্ধির দিকে নিয়ে যেতে পারে। ডায়াগনস্টিক এবং কেয়ার-ডেলিভারি ত্রুটির ঝুঁকি," তিনি লিখেছেন [পিডিএফ].

ক্লিনিকাল সেটিংয়ে ভুলের জীবন-মৃত্যুর পরিণতি, সাম্প্রতিক বছরগুলিতে স্বাস্থ্যসেবা প্রতিষ্ঠানের প্রতি আস্থা কমে যাওয়া এবং স্বাস্থ্যের সংবেদনশীলতার কারণে বাজারের শেয়ার প্রতিষ্ঠার এই দৌড় সহজেই স্পষ্ট এবং বিশেষত স্বাস্থ্যসেবা শিল্পের ক্ষেত্রে। তথ্য।"

তার চিঠিতে সিনেটর গুগলের কর্মকর্তাদের উত্তর দেওয়ার জন্য এক ডজন প্রশ্নের সেট দিয়েছেন। এই প্রশ্নাবলী অন্তর্ভুক্ত:

বড় ভাষার মডেলগুলি প্রায়শই তাদের প্রশিক্ষণ ডেটার বিষয়বস্তু মুখস্থ করার প্রবণতা প্রদর্শন করে, যা সংবেদনশীল স্বাস্থ্য তথ্যের উপর প্রশিক্ষিত মডেলগুলির প্রসঙ্গে রোগীর গোপনীয়তাকে ঝুঁকিপূর্ণ করতে পারে। Google কীভাবে এই ঝুঁকির জন্য Med-PaLM 2কে মূল্যায়ন করেছে এবং সংবেদনশীল স্বাস্থ্য তথ্যের অসাবধানতাবশত গোপনীয়তা ফাঁস প্রশমিত করার জন্য Google কী পদক্ষেপ নিয়েছে?

Google Med-PaLM 2 কে সম্পূর্ণ বা আংশিকভাবে পুনরায় প্রশিক্ষণ দেয় এমন ফ্রিকোয়েন্সি কী? Google কি নিশ্চিত করে যে লাইসেন্সধারীরা শুধুমাত্র সবচেয়ে আপ-টু-ডেট মডেল সংস্করণ ব্যবহার করে?

Google কি নিশ্চিত করে যে যখন Med-PaLM 2, বা অন্যান্য AI মডেলগুলি অফার করা বা লাইসেন্সপ্রাপ্ত, তাদের যত্নে স্বাস্থ্যসেবা লাইসেন্সধারীদের দ্বারা তাদের যত্নে ব্যবহার করা হয় তখন রোগীদের জানানো হয়? যদি তাই হয়, কিভাবে প্রকাশ উপস্থাপন করা হয়? এটি কি একটি দীর্ঘ প্রকাশের অংশ বা আরও স্পষ্টভাবে উপস্থাপিত?

Google কি স্বাস্থ্যসেবা লাইসেন্সধারীদের কাছ থেকে প্রম্পট তথ্য ধরে রাখে, এতে থাকা সুরক্ষিত স্বাস্থ্য তথ্য সহ? সেই তথ্য ধরে রাখার জন্য Google-এর প্রতিটি উদ্দেশ্য অনুগ্রহ করে তালিকাভুক্ত করুন।

এবং পরিশেষে…

Google-এর নিজস্ব গবেষণা প্রকাশনা যা Med-PaLM 2 ঘোষণা করেছে, গবেষকরা "চিকিৎসা সহকারীর আউটপুটের উপর অত্যধিক নির্ভরতার বিরুদ্ধে প্রশমিত করার জন্য গার্ডেল" গ্রহণ করার প্রয়োজনীয়তা সম্পর্কে সতর্ক করেছেন। Med-PaLM 2 এর আউটপুটের উপর নির্ভরতা কমাতে এবং সেইসাথে কখন এটি বিশেষভাবে ব্যবহার করা উচিত এবং কখন করা উচিত নয় তা প্রশমিত করার জন্য Google কোন রেলপথ গ্রহণ করেছে? আউটপুটের উপর অত্যধিক নির্ভরতা রোধ করতে পণ্য লাইসেন্সের শর্তাবলীর মাধ্যমে Google কোন গার্ডেলগুলিকে অন্তর্ভুক্ত করেছে?

সব বরং ভাল পয়েন্ট যে উত্থাপিত বা হাইলাইট করা উচিত.

বড় ভাষার মডেলগুলি মিথ্যা তথ্য তৈরি করার প্রবণতা রয়েছে যা বিশ্বাসযোগ্য বলে মনে হয়, তাই কেউ ভয় পেতে পারে যে একটি বট আত্মবিশ্বাসের সাথে ক্ষতিকারক চিকিৎসা পরামর্শ প্রদান করে বা কারো স্বাস্থ্য সংক্রান্ত সিদ্ধান্তকে ভুলভাবে প্রভাবিত করে। ন্যাশনাল ইটিং ডিসঅর্ডার অ্যাসোসিয়েশন, উদাহরণস্বরূপ, এটি গ্রহণ করেছে টেসা চ্যাটবট অফলাইনে লোকেদের ক্যালোরি গণনা করার পরামর্শ দেওয়া, সাপ্তাহিক নিজেদের ওজন করা এবং শরীরের চর্বি নিরীক্ষণ করা - এমন আচরণ যা একটি সুস্থ পুনরুদ্ধারের বিপরীত বলে মনে করা হয়।

একটি Google-DeepMind-রচিত গবেষণা পত্র বিশদ Med-PaLM 2 স্বীকার করেছে মডেলের "উত্তরগুলি চিকিত্সকের উত্তরগুলির মতো অনুকূল ছিল না," এবং নির্ভুলতা এবং প্রাসঙ্গিকতার দিক থেকে খুব খারাপ স্কোর করেছে৷

ওয়ার্নার পিচাইকে ক্লিনিকাল সেটিংসে মডেলটি কীভাবে মোতায়েন করা হয়েছে সে সম্পর্কে আরও তথ্য ভাগ করতে চান এবং মেগা-কর্প তার প্রযুক্তি পরীক্ষাকারীদের কাছ থেকে রোগীর ডেটা সংগ্রহ করছে কিনা এবং এটি প্রশিক্ষণের জন্য কী ডেটা ব্যবহার করা হয়েছিল তা জানতে চান।

তিনি হাইলাইট করেছেন যে Google এর আগে মার্কিন যুক্তরাষ্ট্র এবং যুক্তরাজ্যের হাসপাতালের সাথে চুক্তিতে তাদের স্পষ্ট জ্ঞান বা সম্মতি ছাড়াই রোগীর ডেটা সংরক্ষণ এবং বিশ্লেষণ করেছে। প্রোজেক্ট নাইটিংগেল ব্যানার

“Google সর্বজনীনভাবে Med-PaLM 2-এ নথিপত্র সরবরাহ করেনি, যার মধ্যে মডেলের প্রশিক্ষণ ডেটার বিষয়বস্তু প্রকাশ করা থেকে বিরত থাকা। Med-PaLM 2-এর প্রশিক্ষণ সংস্থায় কি সুরক্ষিত স্বাস্থ্য তথ্য অন্তর্ভুক্ত রয়েছে? তিনি জিজ্ঞাসা.

Google-এর একজন মুখপাত্র অস্বীকার করেছেন যে Med-PaLM 2 একটি চ্যাটবট ছিল কারণ লোকেরা আজ তাদের চেনে, এবং বলেছেন যে মডেলটি কীভাবে স্বাস্থ্যসেবা শিল্পের জন্য উপযোগী হতে পারে তা অন্বেষণ করার জন্য গ্রাহকদের দ্বারা পরীক্ষা করা হচ্ছে।

"আমরা বিশ্বাস করি যে AI এর স্বাস্থ্যসেবা এবং ওষুধকে রূপান্তরিত করার সম্ভাবনা রয়েছে এবং মূলে নিরাপত্তা, ইক্যুইটি, প্রমাণ এবং গোপনীয়তার সাথে অন্বেষণ করতে প্রতিশ্রুতিবদ্ধ," প্রতিনিধি বলেছেন নিবন্ধনকর্মী এক বিবৃতিতে.

"যেহেতু বিবৃত এপ্রিল মাসে, আমরা Med-PaLM 2 কে স্বাস্থ্যসেবা সংস্থাগুলির একটি নির্বাচিত গোষ্ঠীর কাছে সীমিত পরীক্ষার জন্য উপলব্ধ করছি, ব্যবহারের ক্ষেত্রে অন্বেষণ করতে এবং প্রতিক্রিয়া জানাতে - নিরাপদ এবং সহায়ক প্রযুক্তি তৈরির একটি গুরুত্বপূর্ণ পদক্ষেপ। এই গ্রাহকরা তাদের ডেটার উপর নিয়ন্ত্রণ বজায় রাখে। Med-PaLM 2 একটি চ্যাটবট নয়; এটি আমাদের বৃহৎ ভাষা মডেলের একটি সূক্ষ্ম-সুরিত সংস্করণ PaLM2, এবং চিকিৎসা জ্ঞান এনকোড করার জন্য ডিজাইন করা হয়েছে।"

গুগল সেনেটর ওয়ার্নারের প্রশ্নের জবাব দেবে কিনা তা নিশ্চিত করেননি মুখপাত্র। ®

- এসইও চালিত বিষয়বস্তু এবং পিআর বিতরণ। আজই পরিবর্ধিত পান।

- PlatoData.Network উল্লম্ব জেনারেটিভ Ai. নিজেকে ক্ষমতায়িত করুন। এখানে প্রবেশ করুন.

- প্লেটোএআইস্ট্রিম। Web3 ইন্টেলিজেন্স। জ্ঞান প্রসারিত. এখানে প্রবেশ করুন.

- প্লেটোইএসজি। মোটরগাড়ি / ইভি, কার্বন, ক্লিনটেক, শক্তি, পরিবেশ সৌর, বর্জ্য ব্যবস্থাপনা. এখানে প্রবেশ করুন.

- ব্লকঅফসেট। পরিবেশগত অফসেট মালিকানার আধুনিকীকরণ। এখানে প্রবেশ করুন.

- উত্স: https://go.theregister.com/feed/www.theregister.com/2023/08/08/google_senator_ai_health/

- : আছে

- : হয়

- :না

- 7

- 8

- a

- সম্পর্কে

- অনুযায়ী

- সঠিকতা

- ভর্তি

- পোষ্যপুত্র গ্রহণ করা

- গৃহীত

- পরামর্শ

- সম্বন্ধযুক্ত

- পর

- বিরুদ্ধে

- AI

- এআই মডেল

- এছাড়াও

- an

- বিশ্লেষণ

- এবং

- উদ্গাতা

- উত্তর

- উত্তর

- আপাত

- ফলিত

- এপ্রিল

- রয়েছি

- AS

- সহায়ক

- এসোসিয়েশন

- At

- সহজলভ্য

- পতাকা

- ভিত্তি

- BE

- আচরণে

- হচ্ছে

- বিশ্বাস করা

- শরীর

- বট

- ভবন

- by

- CAN

- যত্ন

- মামলা

- chatbot

- নেতা

- পরিষ্কারভাবে

- ক্লিনিক

- রোগশয্যা

- মেঘ

- CO

- সংগ্রহ

- বাণিজ্যিকীকরণ

- প্রতিজ্ঞাবদ্ধ

- জটিল

- উদ্বিগ্ন

- অসংশয়ে

- নিশ্চিত করা

- সম্মতি

- ফল

- অন্তর্ভুক্ত

- সুখী

- প্রসঙ্গ

- নিয়ন্ত্রণ

- মূল

- পারা

- সংকটপূর্ণ

- গ্রাহকদের

- উপাত্ত

- প্রতিষ্ঠান

- সিদ্ধান্ত

- ডেকলাইন্স

- বলিয়া গণ্য

- প্রদর্শন

- অস্বীকৃত

- মোতায়েন

- বিস্তৃতি

- স্থাপন

- পরিকল্পিত

- DID

- প্রকাশ করছে

- প্রকাশ

- রোগ

- ডকুমেন্টেশন

- কাগজপত্র

- না

- ডজন

- প্রতি

- নিশ্চিত করা

- ন্যায়

- ত্রুটি

- বিশেষত

- স্থাপন করা

- মূল্যায়ন

- প্রমান

- উদাহরণ

- কর্তা

- বিদ্যমান

- ব্যাখ্যা করা

- অন্বেষণ করুণ

- এক্সপ্লোরিং

- মিথ্যা

- চর্বি

- অনুকূল

- ভয়

- প্রতিক্রিয়া

- পরিশেষে

- জন্য

- ফ্রিকোয়েন্সি

- ঘনঘন

- থেকে

- সম্পূর্ণরূপে

- উত্পাদন করা

- উৎপাদিত

- সৃজক

- জেনারেটিভ এআই

- দৈত্য

- প্রদত্ত

- ভাল

- গুগল

- গুগল ক্লাউড

- Google এর

- গ্রুপ

- ক্ষতিকর

- he

- স্বাস্থ্য

- হেলথ কেয়ার

- স্বাস্থ্য তথ্য

- স্বাস্থ্যসেবা

- স্বাস্থ্যসেবা শিল্প

- সুস্থ

- সহায়ক

- হাইলাইট করা

- তার

- ঝুলিতে

- হাসপাতাল

- কিভাবে

- HTTPS দ্বারা

- i

- if

- উন্নত করা

- in

- অন্তর্ভুক্ত করা

- অন্তর্ভুক্ত

- সুদ্ধ

- অন্তর্ভূক্ত

- বর্ধিত

- শিল্প

- প্রভাবিত

- তথ্য

- অবগত

- প্রতিষ্ঠান

- Internet

- উপস্থাপিত

- IT

- এর

- JPG

- জানা

- জ্ঞান

- ভাষা

- বড়

- আইন প্রণেতা

- নেতৃত্ব

- লিকস

- চিঠি

- লাইসেন্স

- অনুমতিপ্রাপ্ত

- লাইসেন্সধারী

- সীমিত

- তালিকা

- আর

- মেকিং

- ছাপ

- বাজার

- মার্কেট শেয়ার

- সাঁতারের পোষাক

- চিকিৎসা

- ঔষধ

- হতে পারে

- ভুল

- প্রশমিত করা

- মডেল

- মডেল

- মনিটর

- অধিক

- সেতু

- জাতীয়

- প্রয়োজন

- নতুন

- of

- প্রদত্ত

- অফলাইন

- on

- ONE

- কেবল

- or

- সংগঠন

- অন্যান্য

- আমাদের

- বাইরে

- ফলাফল

- আউটপুট

- শেষ

- নিজের

- করতল

- কাগজ

- অংশ

- বিশেষত

- রোগী

- রোগীদের

- পিডিএফ

- সম্প্রদায়

- চিকিত্সক

- Plato

- প্লেটো ডেটা ইন্টেলিজেন্স

- প্লেটোডাটা

- দয়া করে

- পয়েন্ট

- সম্ভাব্য

- অকাল

- উপস্থাপন

- চাপ

- প্রতিরোধ

- পূর্বে

- গোপনীয়তা

- পণ্য

- পেশাদার

- রক্ষিত

- প্রদত্ত

- প্রকাশন

- প্রকাশ্যে

- উদ্দেশ্য

- করা

- প্রশ্নের

- প্রশ্ন

- জাতি

- উত্থাপিত

- উত্থাপন

- বরং

- RE

- সাম্প্রতিক

- আরোগ্য

- নির্ভরতা

- প্রতিনিধি

- গবেষণা

- গবেষকরা

- উত্তরদায়ক

- প্রতিক্রিয়া

- রাখা

- ধারনকারী

- ঝুঁকি

- ঝুঁকি

- নলখাগড়া

- s

- নিরাপদ

- নিরাপত্তা

- বলেছেন

- ব্যবস্থাপক সভা

- সেনেট্ সভার সভ্য

- সংবেদনশীল

- সংবেদনশীলতা

- সেট

- বিন্যাস

- সেটিংস

- শেয়ার

- উচিত

- So

- সফটওয়্যার

- কেউ

- মুখপাত্র

- বিবৃতি

- ধাপ

- প্রারম্ভিক ব্যবহারের নির্দেশাবলী

- সঞ্চিত

- সংক্ষিপ্ত করা

- সুন্দর Pichai

- পদ্ধতি

- ধরা

- প্রযুক্তিঃ

- শর্তাবলী

- প্রমাণিত

- পরীক্ষকগণ

- পরীক্ষামূলক

- যে

- সার্জারির

- তাদের

- তাহাদিগকে

- নিজেদের

- সেখানে

- এইগুলো

- এই

- সেগুলো

- দ্বারা

- দানব

- থেকে

- আজ

- গ্রহণ

- রেলগাড়ি

- প্রশিক্ষিত

- প্রশিক্ষণ

- ট্রেন

- রুপান্তর

- অসাধারণ

- আস্থা

- Uk

- অধীনে

- স্বপ্নাতীত

- আলোচ্য সময় পর্যন্ত

- us

- আমাদের আইন প্রণেতা

- ব্যবহার

- ব্যবহৃত

- সংস্করণ

- ভার্জিনিয়া

- চায়

- ওয়ার্নার

- ছিল

- we

- ওয়েব

- সাপ্তাহিক

- তৌল করা

- আমরা একটি

- ছিল

- কি

- কখন

- কিনা

- যে

- যখন

- সঙ্গে

- ছাড়া

- চিন্তা

- would

- লিখিত

- লিখেছেন

- বছর

- zephyrnet