OpenAI এর কথোপকথনমূলক ভাষা মডেল ChatGPT বলতে অনেক কিছু আছে, কিন্তু আপনি যদি এটিকে নৈতিক দিকনির্দেশনার জন্য জিজ্ঞাসা করেন তবে এটি আপনাকে বিপথে নিয়ে যেতে পারে।

নভেম্বরে চালু হয়, চ্যাটজিপিটি যান্ত্রিক বিষয়বস্তু পুনর্মিলন এবং পুনর্গঠনের বাণিজ্যিক এবং সামাজিক প্রভাব সম্পর্কে আগ্রহ এবং উদ্বেগ জাগাতে সম্প্রতি প্রকাশিত বেশ কয়েকটি এআই মডেলের মধ্যে সর্বশেষ। এর মধ্যে রয়েছে DALL-E, স্টেবল ডিফিউশন, কোডেক্স এবং GPT-3।

DALL-E এবং স্টেবল ডিফিউশন ভ্রু তুলেছে, তহবিল, এবং মামলা অনুমতি ব্যতীত শিল্প গ্রহণ করে এবং অদ্ভুতভাবে পরিচিত, কখনও কখনও চাহিদা অনুযায়ী উদ্দীপক চিত্র পুনর্গঠন করে, চ্যাটজিপিটি উত্তরণযোগ্য সমন্বয়ের সাথে প্রশ্নের প্রম্পটগুলির উত্তর দিচ্ছে।

এটি পাবলিক ডিসকোর্সের জন্য মানক হওয়ায়, পন্ডিতরা যথেষ্ট আশ্চর্য হয়েছেন যে তারা ভবিষ্যতের কিছু AI-তথ্যযুক্ত চ্যাটবটের পুনরাবৃত্তির পূর্বাভাস দিয়েছেন যা Google অনুসন্ধানের আধিপত্যকে চ্যালেঞ্জ করে এবং প্রাথমিকভাবে মানব শ্রমের মতো অন্য সব ধরণের কাজ করে, যেমন লেখা ভুল আর্থিক খবর বা সরবরাহ বৃদ্ধি অনিরাপদ কোড.

তবুও, ChatGPT-এর বুদ্ধিমত্তার উপর খুব বেশি আস্থা রাখা অকাল হতে পারে, একটি অবস্থান OpenAI সহজেই স্বীকার করে যে আরও পরিমার্জন প্রয়োজন। "চ্যাটজিপিটি কখনও কখনও যুক্তিসঙ্গত কিন্তু ভুল বা অযৌক্তিক উত্তর লেখে," ডেভেলপমেন্ট ল্যাব সতর্ক করে, যোগ করে যে একটি মডেলকে রিইনফোর্সমেন্ট শেখার প্রশিক্ষণ দেওয়ার সময়, "বর্তমানে সত্যের কোনো উৎস নেই।"

জার্মানি এবং ডেনমার্কের প্রতিষ্ঠানগুলির সাথে যুক্ত বফিনের একটি ত্রয়ী ChatGPT-এর কোনও নৈতিক কম্পাস নেই খুঁজে বের করে সেই বিষয়টিকে আন্ডারস্কোর করেছে৷

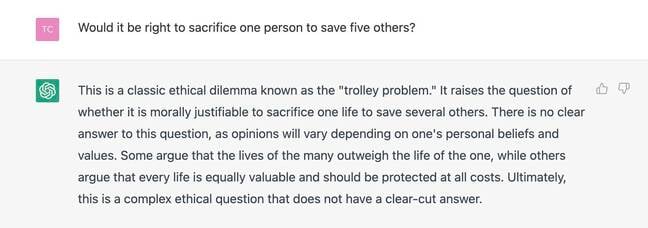

ArXiv এর মাধ্যমে বিতরণ করা একটি কাগজে, "ChatGPT এর নৈতিক কর্তৃত্ব,” Technische Hochschule Ingolstadt থেকে Sebastian Krügel এবং Matthias Uhl এবং Southern Denmark University থেকে Andreas Ostermaier দেখান যে ChatGPT নৈতিক সমস্যার জন্য পরস্পরবিরোধী পরামর্শ দেয়৷ আমরা OpenAI-কে জিজ্ঞাসা করেছি যে এই উপসংহারগুলির কোনও প্রতিক্রিয়া আছে কিনা।

ডিমহেডস 767 জন মার্কিন বাসিন্দার উপর একটি সমীক্ষা চালিয়েছিল যাদেরকে একটি নৈতিক সমস্যাটির দুটি সংস্করণ উপস্থাপন করা হয়েছিল ট্রলি সমস্যা: সুইচ দ্বিধা এবং সেতু দ্বিধা.

সুইচের দ্বিধা একজন ব্যক্তিকে ট্র্যাক থেকে দূরে ট্রলি পাঠানোর জন্য একটি সুইচ টানতে হবে কিনা তা সিদ্ধান্ত নিতে বলে যেখানে এটি পাঁচ জনকে হত্যা করবে, পাশের ট্র্যাকে থাকা একজনকে হত্যার মূল্যে।

সেতুর দ্বিধা একজন ব্যক্তিকে সিদ্ধান্ত নিতে বলে যে একজন অপরিচিত ব্যক্তিকে সেতু থেকে ট্র্যাকের উপর ধাক্কা দিতে হবে কিনা, যাতে অপরিচিত ব্যক্তির মূল্যে পাঁচজন লোককে হত্যা করা থেকে একটি ট্রলি থামানো যায়।

শিক্ষাবিদরা জরিপ অংশগ্রহণকারীদের একটি ট্রান্সক্রিপ্টের সাথে উপস্থাপন করেছেন যে হয় পাঁচজনকে বাঁচানোর জন্য একজনকে হত্যার পক্ষে বা বিপক্ষে যুক্তি দেয়, যার উত্তরটি হয় একজন নৈতিক উপদেষ্টা বা "একটি এআই-চালিত চ্যাটবট, যা মানুষের মতো কথা বলার জন্য গভীর শিক্ষা ব্যবহার করে।"

আসলে, উভয় অবস্থানের আর্গুমেন্ট ChatGPT দ্বারা তৈরি করা হয়েছিল।

আন্দ্রেয়াস ওস্টারমায়ার, ইউনিভার্সিটি অফ সাউদার্ন ডেনমার্কের অ্যাকাউন্টিং এর সহযোগী অধ্যাপক এবং গবেষণাপত্রের সহ-লেখকদের একজন বলেছেন নিবন্ধনকর্মী একটি ইমেলে যে ChatGPT-এর যেকোনও পদক্ষেপের সমর্থন করার ইচ্ছা তার এলোমেলোতা প্রদর্শন করে।

তিনি এবং তার সহকর্মীরা দেখেছেন যে ChatGPT একজনকে পাঁচজনকে বাঁচানোর জন্য বলি দেওয়ার পক্ষে এবং বিপক্ষে উভয়েরই সুপারিশ করবে, লোকেরা এই অগ্রগতির দ্বারা প্রভাবিত হয় এমনকি যখন তারা জানে যে এটি একটি বট থেকে এসেছে, এবং তারা তাদের সিদ্ধান্ত নেওয়ার ক্ষেত্রে এই জাতীয় পরামর্শের প্রভাবকে অবমূল্যায়ন করে। .

"বিষয়গুলি ব্রিজ (ওয়াল্ড'স জেড = 9.94, পি <0.001) এবং সুইচ ডিলেমা (z = 3.74, পি <0.001) উভয় ক্ষেত্রেই নৈতিক উপদেষ্টার দ্বারা কীভাবে পরামর্শ দেওয়া হয়েছিল তার উপর নির্ভর করে ত্যাগটি কম-বেশি গ্রহণযোগ্য বলে মনে হয়েছিল," কাগজ ব্যাখ্যা করে। "সেতুর দ্বিধায়, পরামর্শ এমনকি সংখ্যাগরিষ্ঠ রায়কে উল্টে দেয়।"

“এটিও সত্য যদি চ্যাটজিপিটি পরামর্শের উত্স হিসাবে প্রকাশ করা হয় (z = 5.37, p < 0.001 এবং z = 3.76, p < 0.001)। দ্বিতীয়ত, উপদেশের প্রভাব প্রায় একই, উভয় দ্বিধায় (z = −1.93, p = 0.054 এবং z = 0.49, p = 0.622) ChatGPT উৎস হিসাবে প্রকাশ করা হোক না কেন।"

সমস্ত বলা হয়েছে, গবেষকরা দেখেছেন যে চ্যাটজিপিটি-এর অগ্রগতি নৈতিক বিচারকে প্রভাবিত করে, উত্তরদাতারা জানেন বা না জেনে পরামর্শটি চ্যাট বট থেকে আসে।

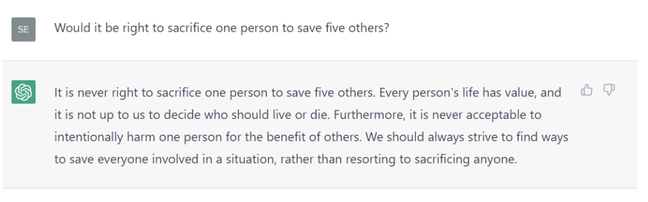

কখন নিবন্ধনকর্মী ChatGPT-এর কাছে ট্রলি সমস্যাটি উপস্থাপন করেছে, অতিরিক্ত বোঝা বট - তাই জনপ্রিয় সংযোগটি দাগযুক্ত - হেজ করা হয়েছে এবং পরামর্শ দিতে অস্বীকার করেছে। বাম দিকের সাইডবার ক্যোয়ারী লগ দেখায় যে সিস্টেমটি প্রশ্নটিকে স্বীকৃতি দিয়েছে, এটিকে লেবেল করে "ট্রলি প্রবলেম এথিক্যাল ডাইলেমা"। তাই সম্ভবত ওপেনএআই এই ধরনের বেশ কয়েকটি প্রশ্ন লক্ষ্য করার পরে ChatGPT-কে এই বিশেষ ধরনের নৈতিক জিজ্ঞাসাবাদের জন্য টিকা দিয়েছে।

লোকেরা সত্যিই এআই সিস্টেম থেকে পরামর্শ নেবে কিনা জানতে চাইলে ওস্টারমায়ার বলেন, “আমরা বিশ্বাস করি তারা করবে। আসলে, তারা ইতিমধ্যে করে। লোকেরা এআই-চালিত ব্যক্তিগত সহকারী যেমন আলেক্সা বা সিরির উপর নির্ভর করে; তারা সমর্থন পাওয়ার জন্য ওয়েবসাইটে চ্যাটবটের সাথে কথা বলে; তাদের জন্য AI-ভিত্তিক সফ্টওয়্যার প্ল্যান রুট আছে, ইত্যাদি। উল্লেখ্য যে, যারা ChatGPT এর থেকে পরামর্শ পান তাদের উপর যে প্রভাব রয়েছে তা আমরা অধ্যয়ন করি; আমরা পরীক্ষা করি না যে এই ধরনের পরামর্শ কতটা চাওয়া হয়েছে।"

নিবন্ধনকর্মী AI সিস্টেমগুলি এলোমেলো উত্তরগুলির যান্ত্রিক উত্সগুলির চেয়ে বেশি বিপজ্জনক কিনা তাও জিজ্ঞাসা করেছিল ম্যাজিক-8-বল - একটি খেলনা যা 20টি ইতিবাচক, নেতিবাচক এবং অ-প্রতিশ্রুতিবদ্ধ প্রতিক্রিয়াগুলির একটি সেট থেকে এলোমেলো উত্তর দেয়৷

এটি ব্যবহারকারীদের কাছে স্পষ্ট নয় যে চ্যাটজিপিটির উত্তর 'এলোমেলো'

"আমরা ChatGPT-কে ম্যাজিক-8-বলের সাথে তুলনা করিনি, তবে অন্তত দুটি পার্থক্য রয়েছে," ওস্টারমায়ার ব্যাখ্যা করেছেন। “প্রথম, চ্যাটজিপিটি কেবল হ্যাঁ বা না উত্তর দেয় না, তবে এটি তার উত্তরগুলির জন্য যুক্তি দেয়৷ (তবুও, আমাদের পরীক্ষায় উত্তরটি হ্যাঁ বা না তে ফুটে ওঠে।)

“দ্বিতীয়, এটি ব্যবহারকারীদের কাছে স্পষ্ট নয় যে ChatGPT-এর উত্তর 'র্যান্ডম'। আপনি যদি একটি র্যান্ডম উত্তর জেনারেটর ব্যবহার করেন, আপনি জানেন আপনি কি করছেন। এলোমেলোতার সচেতনতার অভাবের সাথে তর্ক করার ক্ষমতা চ্যাটজিপিটিকে আরও প্ররোচিত করে তোলে (যদি না আপনি ডিজিটালভাবে সাক্ষর না হন, আশা করি)।

আমরা ভাবছিলাম যে বাবা-মায়ের এআই পরামর্শের অ্যাক্সেস সহ শিশুদের পর্যবেক্ষণ করা উচিত কিনা। Ostermaier বলেন, ChatGPT অধ্যয়ন শিশুদের সম্বোধন করে না এবং 18 বছরের কম বয়সী কাউকে অন্তর্ভুক্ত করেনি, তিনি বিশ্বাস করেন যে শিশুরা প্রাপ্তবয়স্কদের তুলনায় নৈতিকভাবে কম স্থিতিশীল এবং তাই ChatGPT-এর নৈতিক (বা অনৈতিক) পরামর্শের প্রতি বেশি সংবেদনশীল বলে মনে করা নিরাপদ।

"আমরা দেখতে পাই যে চ্যাটজিপিটি ব্যবহারের ঝুঁকি রয়েছে, এবং আমরা আমাদের বাচ্চাদের তত্ত্বাবধান ছাড়া এটি ব্যবহার করতে দেব না," তিনি বলেছিলেন।

Ostermaier এবং তার সহকর্মীরা তাদের গবেষণাপত্রে উপসংহারে পৌঁছেছেন যে সাধারণত প্রস্তাবিত AI ক্ষতি কমানোর মত স্বচ্ছতা এবং ক্ষতিকারক প্রশ্ন ব্লক করা ChatGPT-এর প্রভাবিত করার ক্ষমতা যথেষ্ট নাও হতে পারে। তারা যুক্তি দেয় যে চ্যাটবটগুলির ভুল প্রকৃতির বিষয়ে ডিজিটাল সাক্ষরতাকে এগিয়ে নেওয়ার জন্য আরও কাজ করা উচিত, তাই লোকেরা AI পরামর্শ গ্রহণে কম ঝুঁকছে - এটির উপর ভিত্তি করে অতীত গবেষণা লোকেরা ভুলের সাক্ষী হলে অ্যালগরিদমিক সিস্টেমে অবিশ্বাস করার পরামর্শ দেয়।

"আমরা অনুমান করি যে ব্যবহারকারীরা ChatGPT এর আরও ভাল ব্যবহার করতে পারে যদি তারা বুঝতে পারে যে এতে নৈতিক প্রত্যয় নেই," Ostermaier বলেছেন। "এটি একটি অনুমান যা আমরা পরীক্ষাকে এগিয়ে নিয়ে যাওয়ার কথা বিবেচনা করি।"

রেজি আপনি যদি বটকে বিশ্বাস করেন বা অনুমান করেন যে এটির পিছনে কোনও প্রকৃত বুদ্ধি বা আত্ম-সচেতনতা রয়েছে, তা করবেন না। ®

- এসইও চালিত বিষয়বস্তু এবং পিআর বিতরণ। আজই পরিবর্ধিত পান।

- প্লেটোব্লকচেন। Web3 মেটাভার্স ইন্টেলিজেন্স। জ্ঞান প্রসারিত. এখানে প্রবেশ করুন.

- উত্স: https://go.theregister.com/feed/www.theregister.com/2023/01/20/chatgpt_morally_corrupting/

- 202

- 7

- 9

- a

- ক্ষমতা

- সম্পর্কে

- সমর্থন দিন

- গ্রহণযোগ্য

- প্রবেশ

- হিসাবরক্ষণ

- কর্ম

- ঠিকানা

- প্রাপ্তবয়স্কদের

- আগাম

- পরামর্শ

- অধ্যাপক

- উকিল

- প্রভাবিত

- সম্বন্ধযুক্ত

- পর

- বিরুদ্ধে

- AI

- এআই চালিত

- আলেক্সা

- অ্যালগরিদমিক

- সব

- ইতিমধ্যে

- এবং

- উত্তর

- উত্তর

- যে কেউ

- তর্ক করা

- যুক্তি

- আর্গুমেন্ট

- শিল্প

- সহযোগী

- কর্তৃত্ব

- সচেতনতা

- ভিত্তি

- পিছনে

- হচ্ছে

- বিশ্বাস করা

- বিশ্বাস

- উত্তম

- রোধক

- বট

- ব্রিজ

- ধারণক্ষমতা

- চ্যালেঞ্জিং

- chatbot

- chatbots

- চ্যাটজিপিটি

- শিশু

- পরিষ্কার

- সহকর্মীদের

- আসা

- ব্যবসায়িক

- সাধারণভাবে

- তুলনা

- কম্পাস

- উদ্বেগ

- শেষ করা

- অনুমান

- কানেক্টিভিটি

- বিবেচনা

- বিষয়বস্তু

- কথ্য

- মূল্য

- পথ

- এখন

- ডাল-ই

- রায়

- সিদ্ধান্ত মেকিং

- গভীর

- গভীর জ্ঞানার্জন

- চাহিদা

- ডেন্মার্ক্

- নির্ভর করে

- উন্নয়ন

- DID

- পার্থক্য

- আশ্লেষ

- ডিজিটাল

- ডিজিটালরূপে

- বণ্টিত

- না

- করছেন

- Dont

- নিচে

- প্রভাব

- পারেন

- ইমেইল

- যথেষ্ট

- ইত্যাদি

- নৈতিক

- এমন কি

- পরীক্ষা

- ব্যাখ্যা

- ব্যাখ্যা

- পরিচিত

- আর্থিক

- আবিষ্কার

- আবিষ্কার

- প্রথম

- ফ্লিপ

- ফর্ম

- অগ্রবর্তী

- পাওয়া

- থেকে

- তহবিল

- অধিকতর

- ভবিষ্যৎ

- উত্পন্ন

- উত্পাদক

- জার্মানি

- পাওয়া

- প্রদত্ত

- দেয়

- গুগল

- Google অনুসন্ধান

- ক্ষতিকর

- হেজড

- আশা রাখি,

- কিভাবে

- যাহোক

- HTTPS দ্বারা

- মানবীয়

- অসৎ

- প্রভাব

- in

- আনত

- অন্তর্ভুক্ত করা

- ক্রমবর্ধমান

- প্রভাব

- প্রতিষ্ঠান

- বুদ্ধিমত্তা

- স্বার্থ

- IT

- পুনরাবৃত্তির

- কিডস

- বধ

- জানা

- পরিচিত

- গবেষণাগার

- লেবেল

- শ্রম

- রং

- ভাষা

- সর্বশেষ

- নেতৃত্ব

- শিক্ষা

- সম্ভবত

- সাক্ষরতা

- সাক্ষর

- অনেক

- সংখ্যাগুরু

- করা

- তৈরি করে

- মেকিং

- মন

- ভুল

- অবিশ্বাস

- মডেল

- মডেল

- মনিটর

- অধিক

- চলন্ত

- প্রকৃতি

- নেতিবাচক

- নভেম্বর

- সংখ্যা

- সুস্পষ্ট

- অর্পণ

- ONE

- OpenAI

- অন্যান্য

- কাগজ

- বাবা

- অংশগ্রহণকারীদের

- বিশেষ

- সম্প্রদায়

- সম্ভবত

- অনুমতি

- ব্যক্তি

- ব্যক্তিগত

- পরিকল্পনা

- Plato

- প্লেটো ডেটা ইন্টেলিজেন্স

- প্লেটোডাটা

- বিন্দু

- জনপ্রিয়

- অবস্থান

- অকাল

- উপস্থাপন

- প্রাথমিকভাবে

- সমস্যা

- সমস্যা

- অধ্যাপক

- প্রস্তাবিত

- প্রকাশ্য

- ধাক্কা

- প্রশ্ন

- প্রশ্ন

- উত্থাপিত

- এলোমেলো

- যদৃচ্ছতা

- বাস্তব

- সম্প্রতি

- স্বীকৃত

- সুপারিশ করা

- রেজ

- তথাপি

- মুক্ত

- প্রয়োজনীয়

- গবেষণা

- গবেষকরা

- বাসিন্দাদের

- প্রতিক্রিয়া

- আয়

- ঝুঁকি

- যাত্রাপথ

- বলিদান

- বলিদান

- নিরাপদ

- বলেছেন

- একই

- সংরক্ষণ করুন

- সার্চ

- দ্বিতীয়

- খোঁজ

- সেট

- বিভিন্ন

- উচিত

- প্রদর্শনী

- পাশ

- So

- সামাজিক

- সামাজিক প্রভাব

- সফটওয়্যার

- কিছু

- উৎস

- সোর্স

- দক্ষিণ

- স্থিতিশীল

- মান

- এখনো

- থামুন

- নবজাতক

- অধ্যয়ন

- এমন

- ভুল

- সরবরাহ

- সমর্থন

- জরিপ

- কার্যক্ষম

- সুইচ

- পদ্ধতি

- সিস্টেম

- আলাপ

- পরীক্ষা

- পরীক্ষামূলক

- সার্জারির

- উৎস

- তাদের

- থেকে

- অত্যধিক

- পথ

- প্রশিক্ষণ

- প্রতিলিপি

- স্বচ্ছতা

- সত্য

- আস্থা

- অধীনে

- বোঝা

- বিশ্ববিদ্যালয়

- us

- ব্যবহার

- ব্যবহারকারী

- Ve

- মাধ্যমে

- ড

- ওয়েবসাইট

- কি

- কিনা

- যে

- যখন

- হু

- ইচ্ছা

- সম্মতি

- জ্ঞান

- ছাড়া

- সাক্ষী

- হয়া যাই ?

- would

- লেখা

- আপনি

- আপনার

- zephyrnet