ভাষা মডেলের ক্রমবর্ধমান আকার সাম্প্রতিক বছরগুলিতে প্রাকৃতিক ভাষা প্রক্রিয়াকরণের (NLP) সবচেয়ে বড় প্রবণতাগুলির মধ্যে একটি। 2018 সাল থেকে, আমরা BERT এবং এর ভেরিয়েন্ট, GPT-2, T-NLG, এবং GPT-3 (175 বিলিয়ন প্যারামিটার) সহ সর্বদা বৃহত্তর ভাষার মডেলগুলির অভূতপূর্ব বিকাশ এবং স্থাপনা দেখেছি।

এই মডেলগুলি সম্ভাব্য স্থাপত্য উদ্ভাবনের সীমানাকে ঠেলে দিয়েছে। বৃহৎ আকারের গভীর শিক্ষার মডেল, বিশেষ করে জেনারেটিভ প্রাক-প্রশিক্ষিত ট্রান্সফরমারের নতুন তরঙ্গ প্রশিক্ষণের সময় আমরা বিভিন্ন চ্যালেঞ্জের সম্মুখীন হই। এই চ্যালেঞ্জগুলির মধ্যে রয়েছে হার্ডওয়্যার সীমাবদ্ধতা এবং গণনা এবং দক্ষতার সাথে ট্রেড-অফ। মডেল এবং ডেটা সমান্তরালতার এই চ্যালেঞ্জগুলি কাটিয়ে উঠতে, AWS ক্ষমতার বিস্তৃত পরিসর সরবরাহ করে।

এই পোস্টে, আমরা দুটি প্রধান পন্থা প্রবর্তন করি: ডেটা সমান্তরালকরণ এবং মডেল সমান্তরাল ব্যবহার করে আমাজন সেজমেকার, এবং তাদের সুবিধা এবং অসুবিধা নিয়ে আলোচনা করুন।

মডেলটি

ভাষার মডেলের জন্য, আমরা কাগজে প্রবর্তিত ট্রান্সফরমার ব্যবহার করি মনোযোগ আপনার প্রয়োজন সব. ট্রান্সফরমারগুলি হল গভীর শিক্ষার মডেল যা ইচ্ছাকৃতভাবে ইনপুট এবং আউটপুটের মধ্যে বিশ্বব্যাপী নির্ভরতা আঁকতে একটি স্ব-মনোযোগ ব্যবস্থার উপর নির্ভর করে RNN-এর ত্রুটিগুলি এড়াতে ডিজাইন করা হয়েছে। ট্রান্সফরমার মডেল আর্কিটেকচার উল্লেখযোগ্যভাবে ভালো সমান্তরালকরণের অনুমতি দেয় এবং তুলনামূলকভাবে স্বল্প প্রশিক্ষণের সময়ে উচ্চ কর্মক্ষমতা অর্জন করতে পারে। ট্রান্সফরমারের সাফল্যের উপর নির্মিত, বিইআরটি, কাগজে প্রবর্তিত BERT: ভাষা বোঝার জন্য ডিপ বিডেরেশিয়াল ট্রান্সফর্মারগুলির প্রাক প্রশিক্ষণ, ভাষা উপস্থাপনার জন্য দ্বিমুখী প্রাক-প্রশিক্ষণ যোগ করা হয়েছে। ক্লোজ টাস্ক দ্বারা অনুপ্রাণিত হয়ে, BERT-কে মাস্কড ল্যাঙ্গুয়েজ মডেলিং (MLM) এর সাথে প্রাক-প্রশিক্ষিত করা হয়েছে, যেখানে মডেল এলোমেলোভাবে মুখোশযুক্ত টোকেনগুলির জন্য আসল শব্দগুলি পুনরুদ্ধার করতে শেখে। BERT মডেলটি পরবর্তী বাক্য ভবিষ্যদ্বাণী (NSP) টাস্কেও পূর্বপ্রশিক্ষিত হয় যাতে ভবিষ্যদ্বাণী করা যায় যে দুটি বাক্য সঠিক পাঠের ক্রমে রয়েছে কিনা। 2018 সালে এর আবির্ভাবের পর থেকে, BERT এবং এর বৈচিত্রগুলি ভাষার মডেলগুলিতে ব্যাপকভাবে ব্যবহৃত হয়েছে।

আমরা টোকেন এবং অবস্থানগত এম্বেডিংয়ের জন্য দুটি এমবেডিং স্তর তৈরি করে শুরু করি। ইনপুট এম্বেডিং হল টোকেন এম্বেডিং এবং অবস্থান এমবেডিংয়ের সমষ্টি।

তারপরে আমরা দুটি সাব-লেয়ার সহ একটি ট্রান্সফরমার ডিকোডার ব্লক সংজ্ঞায়িত করি: একটি মাল্টি-হেড সেলফ-অ্যাটেনশন লেয়ার, এবং একটি সাধারণ সম্পূর্ণভাবে সংযুক্ত ফিড-ফরোয়ার্ড নেটওয়ার্ক যার পরে স্তর স্বাভাবিককরণ এবং ড্রপআউট হয়:

অবশেষে, আমরা পূর্ববর্তী এম্বেডিং স্তর এবং ট্রান্সফরমার ব্লকগুলির সাথে আমাদের ভাষা মডেল তৈরি করি:

আপনার হাইপারপ্যারামিটারের উপর নির্ভর করে, আপনি এই মডেলটিকে হাজার হাজার প্যারামিটার থেকে বিলিয়ন প্যারামিটারে স্কেল করতে পারেন। বিলিয়ন-প্যারামিটার মডেলগুলির সাথে প্রাথমিক চ্যালেঞ্জ হল যে আপনি একটি উদাহরণে মডেলটিকে হোস্ট করতে পারবেন না এবং প্রশিক্ষণ এবং অনুমানের জন্য মডেলটিকে বিভিন্ন নোডে বিতরণ করতে হবে।

ডেটাসেট

আমাদের পরীক্ষায়, আমরা ব্যবহার করি পাইল ডেটাসেট. পাইল হল একটি 800 GiB ইংরেজি টেক্সট ডেটাসেট যা বড় মাপের ভাষা মডেল প্রশিক্ষণের জন্য ডিজাইন করা হয়েছে। এটি 22টি বৈচিত্র্যময় এবং উচ্চ-মানের ডেটাসেট থেকে তৈরি করা হয়েছে, যার মধ্যে প্রতিষ্ঠিত NLP ডেটাসেট এবং নতুন প্রবর্তিত উভয়ই রয়েছে৷

ডেটাসেটটি বই সহ বিভিন্ন ডেটা উত্স থেকে তৈরি করা হয়েছে; GitHub সংগ্রহস্থল; ওয়েব পেজ; চ্যাট লগ; এবং চিকিৎসা, পদার্থবিদ্যা, গণিত, কম্পিউটার বিজ্ঞান, এবং দর্শনের কাগজপত্র। বিশেষত, এটি নিম্নলিখিত উত্সগুলি ব্যবহার করে: Pile-CC, PubMed Central, ArXiv, GitHub, FreeLaw Project, Stack Exchange, US Patent and Trademark Office, PubMed, Ubuntu, IRC, HackerNews, YouTube, PhilPapers, Books3, Project Gutenberg ( PG-19), OpenSubtitles, English Wikipedia, DM Mathematics, EuroParl, এনরন ইমেল কর্পাস, এবং NIH এক্সপোর্টার। এটিতে OpenWebText2 এবং BookCorpus2ও রয়েছে, যা যথাক্রমে মূল OpenWebText এবং BookCorpus ডেটাসেটের এক্সটেনশন। ডেটা উত্সের বৈচিত্র্য সাধারণ ক্রস-ডোমেন জ্ঞানকে উন্নত করতে পারে এবং ফলস্বরূপ ডাউনস্ট্রিম সাধারণীকরণ ক্ষমতা উন্নত করতে পারে।

এই ডেটাসেটের প্রাথমিক চ্যালেঞ্জ হল নিছক আকার; ডেটাসেটে 825 GiB পাঠ্য রয়েছে, যা 4.2 টিআইবি প্রিপ্রসেসড এবং সংকুচিত ডেটাপয়েন্টে অনুবাদ করে। মডেলগুলিকে প্রশিক্ষণ এবং হোস্ট করার ক্ষেত্রে আমরা যে চ্যালেঞ্জগুলির মুখোমুখি হই, একইভাবে এই ডেটাসেটের সাথে একটি মডেলকে একটি একক উদাহরণে প্রশিক্ষণ দিতে অনেক সময় লাগবে এবং এটি ব্যবহারিক নয়৷

আমাদের সমাধান হল ডেটাসেটকে আনুমানিক 1 GiB খণ্ডে বিভক্ত করা, বৈশিষ্ট্যগুলি লোড করা এবং প্রিপ্রসেস করা টেনসরফ্লো ডেটাসেট বস্তু, এবং তাদের মধ্যে সংরক্ষণ করুন আমাজন ইলাস্টিক ফাইল সার্ভিস (আমাজন ইএফএস)। টেনসরফ্লো ডেটাসেটগুলি একটি সহজে ব্যবহারযোগ্য এবং উচ্চ-পারফরম্যান্স ডেটা পাইপলাইন সরবরাহ করে যা আমাদের মডেলগুলির সাথে ভালভাবে সংহত করে। Amazon EFS হল একটি সহজ-ব্যবহারযোগ্য পরিষেবা যা আমাদেরকে একটি শেয়ার্ড ফাইল সিস্টেম তৈরি করতে সক্ষম করে যা ফাইলগুলি যুক্ত এবং মুছে ফেলার সাথে সাথে স্বয়ংক্রিয়ভাবে স্কেল করে। উপরন্তু, Amazon EFS প্রয়োজনের সময় উচ্চতর থ্রুপুট স্তরে বিস্ফোরিত হতে সক্ষম, যা আমাদের ডেটা এবং মডেল প্রশিক্ষণ পাইপলাইনে গুরুত্বপূর্ণ।

এর পরে, আমরা এই চ্যালেঞ্জগুলি মোকাবেলা করার জন্য বিতরণকৃত প্রশিক্ষণ কৌশলগুলির দিকে নজর দিই।

বিতরণ প্রশিক্ষণ

এই প্রকল্পে, আমরা দুটি চ্যালেঞ্জের মুখোমুখি হয়েছিলাম: মডেলের আকার এবং ডেটা ভলিউম স্কেলিং। মডেলের আকার এবং প্রশিক্ষণযোগ্য প্যারামিটারের সংখ্যা বাড়ানোর ফলে আরও ভাল নির্ভুলতা হতে পারে, তবে মডেলের একটি সীমা আছে যে আপনি একটি একক GPU মেমরিতে বা এমনকি একাধিক GPU তে একক উদাহরণে ফিট করতে পারেন। উপরন্তু, বড় মডেল মাপ প্রশিক্ষণ আরো সময় নেয়.

আপনি এই চ্যালেঞ্জ দুটি ভিন্ন উপায়ে মোকাবেলা করতে পারেন: ডেটা সমান্তরালতা এবং মডেল সমান্তরালতা। ডেটা সমান্তরালতার সাথে, আমরা প্রশিক্ষণের গতি বাড়ানোর জন্য বিভিন্ন ডিভাইসে একটি মিনি-ব্যাচের রেকর্ড বিতরণ করে স্টোকাস্টিক গ্রেডিয়েন্ট ডিসেন্ট (SGD) সম্পাদন করি। যাইহোক, সমান্তরাল ডেটা প্রশিক্ষণ সমস্ত ডিভাইসের গ্রেডিয়েন্ট সহ মিনি-ব্যাচ গ্রেডিয়েন্ট গড় কম্পিউট করার অতিরিক্ত জটিলতার সাথে আসে, একটি ধাপ বলা হয় AllReduce, যা প্রশিক্ষণ ক্লাস্টার বড় হওয়ার সাথে সাথে কঠিন হয়ে যায়। ডেটা সমান্তরালতা ব্যবহার করার সময়, আমাদের অবশ্যই একটি ডিভাইসে মডেল এবং একটি একক ডেটাপয়েন্ট (সিপিইউ বা জিপিইউ) ফিট করতে সক্ষম হতে হবে, যা আমাদের পরীক্ষায় একটি সীমিত কারণ কারণ এত বড় মডেলের আকার একক GPU-এর মেমরির চেয়ে অনেক বড়। আকার

আরেকটি সমাধান হল মডেল সমান্তরালতা ব্যবহার করা, যা মডেলটিকে একাধিক ডিভাইসে বিভক্ত করে। মডেল সমান্তরালতা হল একটি মডেলকে একাধিক ডিভাইস বা নোডের মধ্যে বিভক্ত করার প্রক্রিয়া (যেমন GPU-সজ্জিত উদাহরণ) এবং GPU ব্যবহার সর্বাধিক করার জন্য এই ডিভাইসগুলি জুড়ে মডেলটিকে প্রশিক্ষণ দেওয়ার জন্য একটি দক্ষ পাইপলাইন তৈরি করা।

ডেটা সমান্তরালকরণ

একাধিক জিপিইউ বা বিতরণ করা প্রশিক্ষণের জন্য ডেটা সমান্তরাল করা সবচেয়ে সাধারণ পদ্ধতি। আপনি আপনার ডেটা ব্যাচ করতে পারেন, এটি একাধিক ডিভাইসে পাঠাতে পারেন (প্রতিটি একটি প্রতিলিপি করা মডেল হোস্ট করে), তারপর ফলাফলগুলি একত্রিত করুন৷ আমরা ডেটা সমান্তরালকরণের জন্য দুটি প্যাকেজ নিয়ে পরীক্ষা করেছি: Horovod এবং the সেজমেকার ডেটা সমান্তরাল লাইব্রেরি বিতরণ করেছে.

Horovod হল TensorFlow, Keras, PyTorch, এবং Apache MXNet-এর জন্য একটি বিতরণ করা গভীর শিক্ষার প্রশিক্ষণ কাঠামো। Horovod ব্যবহার করতে, আমরা নিম্নলিখিত প্রক্রিয়ার মধ্য দিয়ে গিয়েছিলাম:

- রান করে শুরু করুন

hvd.init(). - প্রতিটি ডিভাইসকে একটি একক প্রক্রিয়ার সাথে সংযুক্ত করুন। প্রথম প্রক্রিয়া বা কর্মী প্রথম ডিভাইসের সাথে যুক্ত, দ্বিতীয় প্রক্রিয়াটি দ্বিতীয় ডিভাইসের সাথে যুক্ত, ইত্যাদি।

- ডিভাইসের সংখ্যার উপর ভিত্তি করে শেখার হার সামঞ্জস্য করুন।

- মধ্যে অপ্টিমাইজার মোড়ানো

hvd.DistributedOptimizer. - র্যাঙ্ক 0 সহ প্রথম কর্মী থেকে অন্যান্য সমস্ত প্রক্রিয়াতে প্রাথমিক পরিবর্তনশীল অবস্থা সম্প্রচার করুন। এলোমেলো ওজনের সাথে প্রশিক্ষণ শুরু হলে বা চেকপয়েন্ট থেকে পুনরুদ্ধার করার সময় সমস্ত কর্মীদের ধারাবাহিক সূচনা নিশ্চিত করার জন্য এটি প্রয়োজনীয়।

- নিশ্চিত করুন যে শুধুমাত্র ডিভাইস 0 চেকপয়েন্ট সংরক্ষণ করতে পারে যাতে অন্য কর্মীদের দূষিত হতে বাধা দেয়।

নিম্নলিখিত প্রশিক্ষণ স্ক্রিপ্ট:

SageMaker ডেটা সমান্তরাল লাইব্রেরি আমাদের প্রশিক্ষণকে কাছাকাছি-রৈখিক দক্ষতার সাথে স্কেল করতে সক্ষম করে, ন্যূনতম কোড পরিবর্তনের সাথে আমাদের প্রশিক্ষণকে দ্রুততর করে। লাইব্রেরি একটি কাস্টম সঞ্চালন AllReduce AWS-এর নেটওয়ার্ক অবকাঠামো সম্পূর্ণরূপে ব্যবহার করে ডিভাইস থেকে ডিভাইস যোগাযোগকে অপ্টিমাইজ করে এবং অ্যামাজন ইলাস্টিক কম্পিউট ক্লাউড (Amazon EC2) উদাহরণ টপোলজি। SageMaker ডেটা সমান্তরাল লাইব্রেরি ব্যবহার করতে, আমরা নিম্নলিখিত প্রক্রিয়ার মধ্য দিয়ে গিয়েছিলাম:

- আমদানি করুন এবং শুরু করুন

sdp.init(). - প্রতিটি ডিভাইস একটি একক সঙ্গে সংযুক্ত করুন

smdistributed.dataparallelসঙ্গে প্রক্রিয়াlocal_rank.sdp.tensorflow.local_rank()আমাদের ডিভাইসের স্থানীয় র্যাঙ্ক দেয়। নেতা হল র্যাঙ্ক 0, এবং কর্মীদের র্যাঙ্ক 1, 2, 3, ইত্যাদি। - ডিভাইসের সংখ্যার উপর ভিত্তি করে শেখার হার সামঞ্জস্য করুন।

- মোড়ানো

tf.GradientTapeসঙ্গেDistributedGradientTapeকরতেAllReduce. - লিডার নোড থেকে সমস্ত কর্মী নোডে প্রাথমিক মডেল ভেরিয়েবল সম্প্রচার করুন।

- নিশ্চিত করুন যে শুধুমাত্র ডিভাইস 0 চেকপয়েন্ট সংরক্ষণ করতে পারে।

মডেল সমান্তরালকরণ

আমরা একটি একক GPU ব্যবহার করে প্রশিক্ষিত করার জন্য মডেলটিকে যথেষ্ট ছোট রাখতে হাইপারপ্যারামিটারগুলি সামঞ্জস্য করতে পারি, অথবা আমরা একাধিক দৃষ্টান্ত জুড়ে একাধিক GPU-এর মধ্যে মডেলটিকে বিভক্ত করতে মডেল সমান্তরালতা ব্যবহার করতে পারি। একটি মডেলের প্রশিক্ষণযোগ্য প্যারামিটারের সংখ্যা বাড়ানোর ফলে আরও ভাল নির্ভুলতা হতে পারে, তবে আপনি একটি একক GPU মেমরিতে ফিট করতে পারেন এমন সর্বাধিক মডেলের আকারের একটি সীমা রয়েছে। আমরা আমাদের বৃহত্তর মডেলগুলিকে প্রশিক্ষণের জন্য SageMaker বিতরণকৃত মডেল সমান্তরাল লাইব্রেরি ব্যবহার করেছি। নিম্নরূপ পদক্ষেপ:

- এর সাথে লাইব্রেরি আমদানি করুন এবং শুরু করুন

smp.init(). - Keras মডেলটি কেরাস মডেল ক্লাসের পরিবর্তে smp.DistributedModel থেকে উত্তরাধিকার সূত্রে প্রাপ্ত হওয়া দরকার।

- সেট

drop_remainder=Trueমধ্যেtf.Dataset.batch()ব্যাচের আকার সর্বদা মাইক্রোব্যাচের সংখ্যা দ্বারা বিভাজ্য হয় তা নিশ্চিত করার পদ্ধতি। - ডাটা পাইপলাইনে র্যান্ডম অপারেশনের জন্য একই বীজ ব্যবহার করতে হবে:

smp.dp_rank(), উদাহরণ স্বরূপ,shuffle(ds, seed=smp.dp_rank()). এটি বিভিন্ন মডেল পার্টিশন ধারণ করে এমন ডিভাইস জুড়ে ডেটা নমুনার ধারাবাহিকতা নিশ্চিত করে। - ফরওয়ার্ড এবং পশ্চাদমুখী যুক্তি একটি ধাপ ফাংশন সঙ্গে থাকা প্রয়োজন

smp.stepপ্রসাধন। - স্টেপআউটপুট পদ্ধতি যেমন ব্যবহার করে মাইক্রোব্যাচ জুড়ে আউটপুটগুলিতে পোস্টপ্রসেসিং সম্পাদন করুন

reduce_mean. দ্যsmp.stepফাংশনের একটি রিটার্ন মান থাকতে হবে যা এর আউটপুটের উপর নির্ভর করেsmp.DistributedModel.

প্রশিক্ষণ স্ক্রিপ্ট নিম্নরূপ:

SageMaker বিতরণকৃত মডেল সমান্তরাল লাইব্রেরির জন্য TensorFlow প্রশিক্ষণ স্ক্রিপ্ট সক্ষম করার জন্য একটি বিস্তারিত গাইডের জন্য, দেখুন একটি টেনসরফ্লো প্রশিক্ষণ স্ক্রিপ্ট পরিবর্তন করুন. PyTorch এর জন্য, পড়ুন একটি PyTorch প্রশিক্ষণ স্ক্রিপ্ট পরিবর্তন করুন.

সেজমেকার ডিবাগার

পূর্ববর্তী বিভাগে, আমরা আলোচনা করেছি কিভাবে মডেল এবং ডেটা সমান্তরালকরণ কৌশল ব্যবহার করে প্রশিক্ষণকে অপ্টিমাইজ করা যায়। সঙ্গে আমাজন সেজমেকার ডিবাগার, আমরা এখন প্রশিক্ষণের কতটা উন্নতি করেছে তা নির্ধারণ করতে আমাদের প্রশিক্ষণ থেকে কর্মক্ষমতা প্রোফাইলিং তথ্য ক্যাপচার করতে পারি। ডিফল্টরূপে, ডিবাগার 500 মিলিসেকেন্ডের স্যাম্পলিং ব্যবধানে GPU, CPU ব্যবহার, মেমরি, নেটওয়ার্ক এবং I/O এর মতো প্রতিটি সেজমেকার প্রশিক্ষণ কাজের জন্য সিস্টেম মেট্রিক্স ক্যাপচার করে। আমরা নিম্নলিখিত হিসাবে ডেটা অ্যাক্সেস করতে পারি:

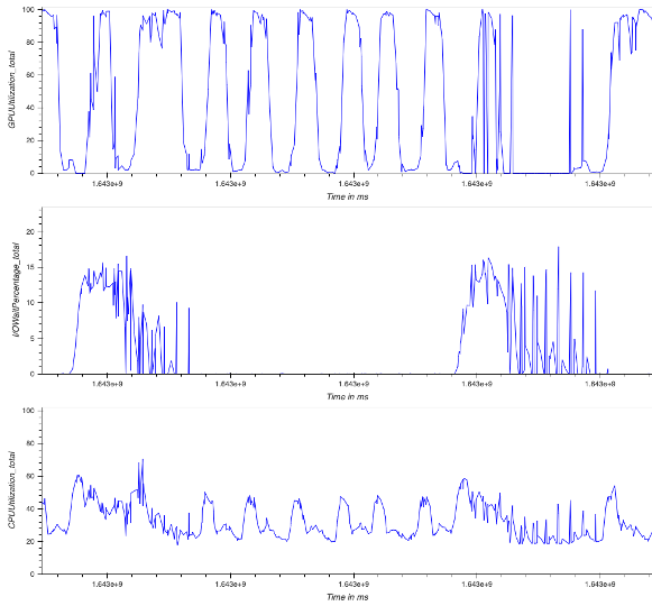

ডিবাগার ইউটিলিটি প্রদান করে ঠাহর করা বিভিন্ন উপায়ে প্রোফাইলিং ডেটা। নিম্নলিখিত উদাহরণে, আমরা Horovod ব্যবহার করে মাল্টি-জিপিইউ প্রশিক্ষণ কাজের জন্য মোট GPU এবং CPU ব্যবহারের পাশাপাশি I/O অপেক্ষার সময় দেখতে পাচ্ছি। এই গ্রাফগুলি তৈরি করতে, আমরা নিম্নলিখিত কোডটি চালাই:

GPU ব্যবহার প্রায়শই 0-100% এর মধ্যে ওঠানামা করে এবং কম GPU ব্যবহার সহ উচ্চ I/O অপেক্ষার সময় I/O বাধার একটি সূচক। অধিকন্তু, মোট CPU ব্যবহার কখনই 70% এর বেশি হয় না, যার মানে আমরা কর্মী প্রক্রিয়ার সংখ্যা বাড়িয়ে ডেটা প্রিপ্রসেসিং উন্নত করতে পারি।

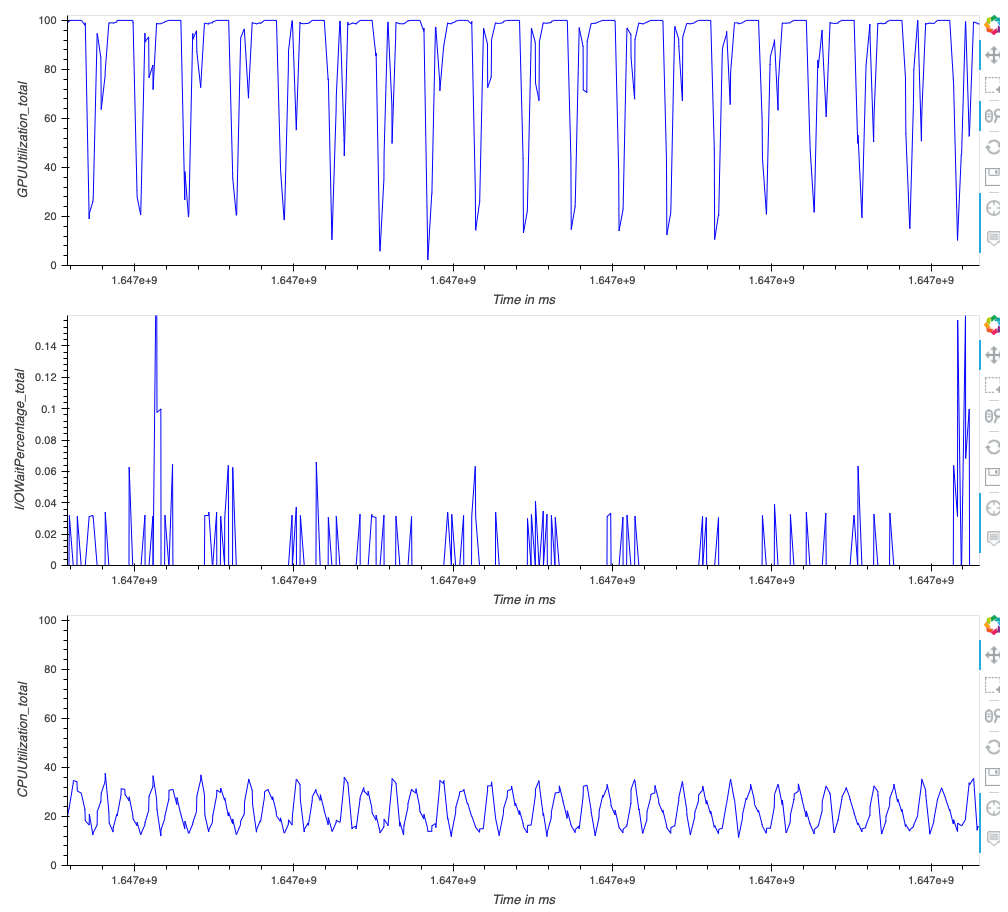

আমরা Horovod থেকে SageMaker বিতরণ করা ডেটা সমান্তরাল লাইব্রেরিতে স্যুইচ করে কর্মক্ষমতা উন্নত করতে পারি। নিম্নলিখিত গ্রাফগুলিতে, আমরা দেখতে পাচ্ছি যে GPU গুলি আরও দক্ষতার সাথে ব্যবহার করা হয়েছে এবং শুধুমাত্র অল্প সময়ের জন্য কম ব্যবহারে নেমে যাচ্ছে।

প্রশিক্ষণের অবকাঠামো

মডেলদের প্রশিক্ষণের জন্য, আমরা SageMaker প্রশিক্ষণের কাজ ব্যবহার করে 10 ml.p3.16x বড় উদাহরণ ব্যবহার করেছি। সেজমেকার অবকাঠামো পরিচালনার প্রয়োজন ছাড়াই মেশিন লার্নিং (এমএল) মডেলগুলিকে প্রশিক্ষণ এবং টিউন করার সময় এবং খরচ কমিয়ে দেয়। SageMaker-এর সাহায্যে, আপনি প্রশিক্ষণ পরীক্ষাগুলি পরিচালনা এবং ট্র্যাক করতে অন্তর্নির্মিত সরঞ্জামগুলি ব্যবহার করে ML মডেলগুলিকে সহজেই প্রশিক্ষিত এবং টিউন করতে পারেন, স্বয়ংক্রিয়ভাবে সর্বোত্তম হাইপারপ্যারামিটার নির্বাচন করতে পারেন, প্রশিক্ষণের কাজগুলি ডিবাগ করতে পারেন এবং সিস্টেম সংস্থান যেমন GPUs, CPUs এবং নেটওয়ার্ক ব্যান্ডউইথের ব্যবহার নিরীক্ষণ করতে পারেন৷ ডেটা আমাজন ইএফএস-এ হোস্ট করা হয়েছিল, যা পরিচালনা বা বিধানের প্রয়োজন ছাড়াই ফাইলগুলি যুক্ত এবং সরানোর সাথে সাথে আমাদের বৃদ্ধি এবং সঙ্কুচিত হতে সক্ষম করে। আমাদের প্রাথমিক উদ্দেশ্য ছিল প্রশিক্ষণের গতি উন্নত করা এবং খরচ কমানো।

মডেল মাপযোগ্যতা

যদিও এই অবকাঠামোটি প্রাথমিকভাবে ভাষা তৈরির জন্য ব্যবহার করা হয়, GPT আর্কিটেকচার এবং পাইল ডেটাসেটের সাথে, আপনি এই কৌশলগুলিকে বড় আকারের ট্রান্সফরমার মডেলগুলিকে প্রশিক্ষণ দিতে ব্যবহার করতে পারেন, যা NLP এর বাইরেও অনেক ডোমেনে কার্যকর। মেশিন লার্নিংয়েই, অনেক কম্পিউটার ভিশন টাস্ক এখন বড়-প্যারামিটার (ট্রান্সফরমার) আর্কিটেকচারের মাধ্যমে সমাধান করা হয় যেখানে তারা উপস্থাপনা শেখার মতো কাজগুলিতে ঐতিহ্যবাহী সিএনএন (কনভোলিউশনাল নিউরাল নেটওয়ার্ক) কে ছাড়িয়ে যেতে দেখা গেছে (দেখুন স্ব-তত্ত্বাবধানে ট্রান্সফরমার এবং 10 গুণ বেশি দক্ষ প্রশিক্ষণের মাধ্যমে কম্পিউটার দৃষ্টিতে শিল্পের অবস্থার উন্নতি করা) এবং টেক্সটে চিত্রের বড় আকারের ম্যাপিং (যেমন ক্লিপ) বড়-প্যারামিটার মডেলগুলিও ক্ষেত্রগুলিতে জীবন বিজ্ঞানে নতুন ভিত্তি তৈরি করছে প্রোটিন গঠন বিশ্লেষণ এবং মেডিকেল ইমেজ ডেটা বিশ্লেষণ.

বিতরণ করা প্রশিক্ষণ এবং বড় মডেল পরিচালনার জন্য আমরা এই পোস্টে যে সমাধানগুলি বিস্তারিত করেছি তা এই ডোমেনের যে কোনও মডেলের ক্ষেত্রেও প্রযোজ্য হওয়া উচিত।

বাণিজ্য বন্ধ

বৃহৎ মাপের ভাষা মডেল প্রশিক্ষণের ঝুঁকি সম্পর্কে গবেষণা সম্প্রদায়ের মধ্যে একটি চলমান আলোচনা হয়েছে, এবং তাদের বিকাশের সাথে যুক্ত সম্ভাব্য ঝুঁকি এবং এই ঝুঁকিগুলি হ্রাস করার কৌশলগুলির বিষয়ে যথেষ্ট চিন্তাভাবনা করা হয়েছে কিনা, যার মধ্যে কিছু আর্থিক এবং পরিবেশগত খরচ। অনুযায়ী ক কাগজ ACM-এ প্রকাশিত, GPU-তে একটি একক BERT বেস মডেল (হাইপারপ্যারামিটার টিউনিং ছাড়া) প্রশিক্ষণের জন্য ট্রান্স-আমেরিকান ফ্লাইটের মতো শক্তির প্রয়োজন হয় বলে অনুমান করা হয়েছিল। পরিবেশগত প্রভাবগুলি মডেলের আকারের সাথে স্কেল করে, এবং এই ধরনের মডেলগুলিকে দক্ষতার সাথে সূক্ষ্ম-টিউন করতে সক্ষম হওয়া সম্ভাব্যভাবে উল্লেখযোগ্যভাবে নির্গমন হ্রাস করতে পারে। AWS সম্প্রতি একটি নতুন চালু করেছে গ্রাহক কার্বন ফুটপ্রিন্ট টুল, স্থায়িত্ব বৃদ্ধি এবং কার্বন নিঃসরণ কমানোর জন্য Amazon-এর প্রচেষ্টার অংশ হিসাবে বিনা খরচে সমস্ত AWS গ্রাহকদের জন্য উপলব্ধ৷ AWS ক্লাউডে অ্যাপ্লিকেশন চালানোর ফলে কার্বন ফুটপ্রিন্ট সম্ভাব্যভাবে হ্রাস পেতে পারে (যখন এন্টারপ্রাইজ ডেটা সেন্টারের সাথে তুলনা করা হয়েছিল যা জরিপ করা হয়েছিল একটি 2019 রিপোর্ট).

উপসংহার

এই পোস্টটি একটি সমাধান প্রদর্শন করেছে যা SageMaker ব্যবহার করে AWS ক্লাউডে এক বিলিয়ন প্যারামিটার সহ ভাষার মডেলগুলির সূক্ষ্ম-টিউনিংকে সহজতর করে।

SageMaker-এর সাথে মডেল সমান্তরাল সম্পর্কে আরও তথ্যের জন্য, পড়ুন Amazon SageMaker-এ মডেলের সমান্তরাল সংযোজন এবং Hugging Face সহ 175+ বিলিয়ন প্যারামিটার NLP মডেলকে প্রশিক্ষণ দিন এবং কিভাবে সুপ্ত স্পেস অ্যামাজন সেজমেকার মডেলের সমান্তরাল লাইব্রেরি ব্যবহার করে বৃহৎ আকারের ট্রান্সফরমারগুলির সীমানাকে ঠেলে দেয়.

আপনি যদি আপনার পণ্য এবং প্রক্রিয়াগুলিতে আপনার ML-এর ব্যবহারকে ত্বরান্বিত করতে সহায়তা করতে চান তবে অনুগ্রহ করে যোগাযোগ করুন অ্যামাজন এমএল সলিউশন ল্যাব.

লেখক সম্পর্কে

সিয়া গোলামী তিনি আমাজন এমএল সলিউশন ল্যাবের একজন সিনিয়র ডেটা সায়েন্টিস্ট, যেখানে তিনি বিভিন্ন শিল্পে গ্রাহকদের জন্য এআই/এমএল সমাধান তৈরি করেন। তিনি প্রাকৃতিক ভাষা প্রক্রিয়াকরণ (NLP) এবং গভীর শিক্ষার বিষয়ে উত্সাহী। কাজের বাইরে, সিয়া প্রকৃতিতে সময় কাটানো এবং টেনিস খেলা উপভোগ করে।

সিয়া গোলামী তিনি আমাজন এমএল সলিউশন ল্যাবের একজন সিনিয়র ডেটা সায়েন্টিস্ট, যেখানে তিনি বিভিন্ন শিল্পে গ্রাহকদের জন্য এআই/এমএল সমাধান তৈরি করেন। তিনি প্রাকৃতিক ভাষা প্রক্রিয়াকরণ (NLP) এবং গভীর শিক্ষার বিষয়ে উত্সাহী। কাজের বাইরে, সিয়া প্রকৃতিতে সময় কাটানো এবং টেনিস খেলা উপভোগ করে।

মেহেদী নূরীতিনি আমাজন এমএল সলিউশন ল্যাবের একজন ম্যানেজার এবং একজন সিনিয়র অ্যাপ্লাইড সায়েন্টিস্ট, যেখানে তিনি বিভিন্ন শিল্পের গ্রাহকদের সাথে কাজ করেন এবং তাদের ক্লাউড মাইগ্রেশন যাত্রাকে ত্বরান্বিত করতে এবং অত্যাধুনিক সমাধান ব্যবহার করে তাদের এমএল সমস্যা সমাধান করতে সাহায্য করেন। প্রযুক্তি

মেহেদী নূরীতিনি আমাজন এমএল সলিউশন ল্যাবের একজন ম্যানেজার এবং একজন সিনিয়র অ্যাপ্লাইড সায়েন্টিস্ট, যেখানে তিনি বিভিন্ন শিল্পের গ্রাহকদের সাথে কাজ করেন এবং তাদের ক্লাউড মাইগ্রেশন যাত্রাকে ত্বরান্বিত করতে এবং অত্যাধুনিক সমাধান ব্যবহার করে তাদের এমএল সমস্যা সমাধান করতে সাহায্য করেন। প্রযুক্তি

মুহিউন কিম অ্যামাজন মেশিন লার্নিং সলিউশন ল্যাবের একজন ডেটা সায়েন্টিস্ট। তিনি মেশিন লার্নিং এবং ডিপ লার্নিং প্রয়োগ করে গ্রাহকের বিভিন্ন ব্যবসায়িক সমস্যা সমাধান করেন এবং তাদের দক্ষ হতেও সাহায্য করেন।

মুহিউন কিম অ্যামাজন মেশিন লার্নিং সলিউশন ল্যাবের একজন ডেটা সায়েন্টিস্ট। তিনি মেশিন লার্নিং এবং ডিপ লার্নিং প্রয়োগ করে গ্রাহকের বিভিন্ন ব্যবসায়িক সমস্যা সমাধান করেন এবং তাদের দক্ষ হতেও সাহায্য করেন।

ড্যানি বার্ড অ্যামাজন এমএল সলিউশন ল্যাবের একজন ফলিত বিজ্ঞানী। ল্যাবে তিনি গ্রাহকদের কম্পিউটার ভিশন থেকে রিইনফোর্সমেন্ট লার্নিং পর্যন্ত এমএল বিশেষত্বে উন্নত ML সমাধান তৈরি করতে সাহায্য করেছেন। তিনি প্রযুক্তিকে এগিয়ে নিয়ে যাওয়ার এবং পথ ধরে AWS পণ্যগুলি থেকে নতুন সম্ভাবনা আনলক করার বিষয়ে উত্সাহী।

ড্যানি বার্ড অ্যামাজন এমএল সলিউশন ল্যাবের একজন ফলিত বিজ্ঞানী। ল্যাবে তিনি গ্রাহকদের কম্পিউটার ভিশন থেকে রিইনফোর্সমেন্ট লার্নিং পর্যন্ত এমএল বিশেষত্বে উন্নত ML সমাধান তৈরি করতে সাহায্য করেছেন। তিনি প্রযুক্তিকে এগিয়ে নিয়ে যাওয়ার এবং পথ ধরে AWS পণ্যগুলি থেকে নতুন সম্ভাবনা আনলক করার বিষয়ে উত্সাহী।

ফ্রান্সিসকো ক্যালডেরন রদ্রিগেজ অ্যামাজন এমএল সলিউশন ল্যাবে একজন ডেটা সায়েন্টিস্ট। এমএল সলিউশন ল্যাবের একজন সদস্য হিসেবে, তিনি গভীর শিক্ষা ব্যবহার করে AWS গ্রাহকদের জন্য গুরুত্বপূর্ণ ব্যবসায়িক সমস্যা সমাধানে সাহায্য করেন। তার অবসর সময়ে, ফ্রান্সিসকো সঙ্গীত এবং গিটার বাজাতে, তার মেয়েদের সাথে ফুটবল খেলতে এবং তার পরিবারের সাথে সময় উপভোগ করতে পছন্দ করে।

ফ্রান্সিসকো ক্যালডেরন রদ্রিগেজ অ্যামাজন এমএল সলিউশন ল্যাবে একজন ডেটা সায়েন্টিস্ট। এমএল সলিউশন ল্যাবের একজন সদস্য হিসেবে, তিনি গভীর শিক্ষা ব্যবহার করে AWS গ্রাহকদের জন্য গুরুত্বপূর্ণ ব্যবসায়িক সমস্যা সমাধানে সাহায্য করেন। তার অবসর সময়ে, ফ্রান্সিসকো সঙ্গীত এবং গিটার বাজাতে, তার মেয়েদের সাথে ফুটবল খেলতে এবং তার পরিবারের সাথে সময় উপভোগ করতে পছন্দ করে।

ইয়োহেই নাকায়ামা অ্যামাজন এমএল সলিউশন ল্যাবের একজন ডিপ লার্নিং আর্কিটেক্ট। কৃত্রিম বুদ্ধিমত্তা এবং AWS ক্লাউড পরিষেবাগুলির ব্যবহারকে ত্বরান্বিত করতে তিনি বিভিন্ন উল্লম্ব জুড়ে গ্রাহকদের সাথে কাজ করেন তাদের ব্যবসায়িক চ্যালেঞ্জগুলি সমাধান করতে। তিনি মহাকাশ শিল্পে এমএল/এআই প্রযুক্তি প্রয়োগ করতে আগ্রহী।

ইয়োহেই নাকায়ামা অ্যামাজন এমএল সলিউশন ল্যাবের একজন ডিপ লার্নিং আর্কিটেক্ট। কৃত্রিম বুদ্ধিমত্তা এবং AWS ক্লাউড পরিষেবাগুলির ব্যবহারকে ত্বরান্বিত করতে তিনি বিভিন্ন উল্লম্ব জুড়ে গ্রাহকদের সাথে কাজ করেন তাদের ব্যবসায়িক চ্যালেঞ্জগুলি সমাধান করতে। তিনি মহাকাশ শিল্পে এমএল/এআই প্রযুক্তি প্রয়োগ করতে আগ্রহী।

নাথালি রাউশমায়ার AWS-এর একজন সিনিয়র ফলিত বিজ্ঞানী, যেখানে তিনি গ্রাহকদের গভীর শিক্ষার অ্যাপ্লিকেশন বিকাশে সহায়তা করেন।

নাথালি রাউশমায়ার AWS-এর একজন সিনিয়র ফলিত বিজ্ঞানী, যেখানে তিনি গ্রাহকদের গভীর শিক্ষার অ্যাপ্লিকেশন বিকাশে সহায়তা করেন।

- Coinsmart. ইউরোপের সেরা বিটকয়েন এবং ক্রিপ্টো এক্সচেঞ্জ।

- প্লেটোব্লকচেন। Web3 মেটাভার্স ইন্টেলিজেন্স। জ্ঞান প্রসারিত. বিনামূল্যে এক্সেস.

- ক্রিপ্টোহক। Altcoin রাডার। বিনামূল্যে ট্রায়াল.

- সূত্র: https://aws.amazon.com/blogs/machine-learning/create-train-and-deploy-a-billion-parameter-language-model-on-terabytes-of-data-with-tensorflow-and- amazon-sagemaker/

- "

- 10

- 100

- 2019

- a

- সম্পর্কে

- দ্রুততর করা

- ত্বরক

- প্রবেশ

- অনুযায়ী

- অর্জন করা

- দিয়ে

- যোগ

- যোগ

- অগ্রসর

- সব

- অনুমতি

- সর্বদা

- মর্দানী স্ত্রীলোক

- বিশ্লেষণ

- API

- অ্যাপ্লিকেশন

- ফলিত

- প্রয়োগ করা

- প্রয়োগ করা হচ্ছে

- অভিগমন

- পন্থা

- আন্দাজ

- স্থাপত্য

- স্থাপত্য

- শিল্প

- কৃত্রিম

- কৃত্রিম বুদ্ধিমত্তা

- যুক্ত

- মনোযোগ

- স্বয়ংক্রিয়ভাবে

- সহজলভ্য

- গড়

- ডেস্কটপ AWS

- কারণ

- হচ্ছে

- মধ্যে

- তার পরেও

- বড়

- বৃহত্তম

- বিলিয়ন

- কোটি কোটি

- বাধা

- বই

- নির্মাণ করা

- তৈরী করে

- বিল্ট-ইন

- ব্যবসায়

- ক্ষমতা

- সক্ষম

- গ্রেপ্তার

- ক্যাচ

- কারবন

- কার্বন নিঃসরণ

- মধ্য

- চ্যালেঞ্জ

- চ্যালেঞ্জ

- বেছে নিন

- শ্রেণী

- মেঘ

- মেঘ পরিষেবা

- কোড

- সাধারণ

- যোগাযোগ

- সম্প্রদায়

- তুলনা

- গণনা

- গনা

- কম্পিউটার

- কম্পিউটার বিজ্ঞান

- কম্পিউটিং

- সংযুক্ত

- মন্দ দিক

- সঙ্গত

- যোগাযোগ

- খরচ

- সৃষ্টি

- নির্মিত

- সৃষ্টি

- তৈরি করা হচ্ছে

- সংকটপূর্ণ

- প্রথা

- গ্রাহকদের

- উপাত্ত

- তথ্য কেন্দ্র

- তথ্য বিজ্ঞানী

- গভীর

- প্রদর্শিত

- নির্ভর করে

- স্থাপন

- বিস্তৃতি

- পরিকল্পিত

- বিস্তারিত

- বিশদ

- নির্ধারণ

- বিকাশ

- উন্নয়নশীল

- উন্নয়ন

- যন্ত্র

- ডিভাইস

- বিভিন্ন

- আলোচনা করা

- বণ্টিত

- বিভাজক

- বৈচিত্র্য

- DM

- ডোমেইনের

- নিচে

- সহজে

- ব্যবহার করা সহজ

- দক্ষতা

- দক্ষ

- দক্ষতার

- প্রচেষ্টা

- নির্গমন

- সক্ষম করা

- সম্ভব

- শক্তি

- ইংরেজি

- উদ্যোগ

- পরিবেশ

- বিশেষত

- প্রতিষ্ঠিত

- আনুমানিক

- উদাহরণ

- অতিক্রম করে

- বিনিময়

- এক্সটেনশন

- মুখ

- ফেসবুক

- মুখোমুখি

- পরিবার

- বৈশিষ্ট্য

- ক্ষেত্রসমূহ

- আর্থিক

- প্রথম

- ফিট

- ফ্লাইট

- অনুসরণ

- অনুসরণ

- পদাঙ্ক

- অগ্রবর্তী

- ফ্রেমওয়ার্ক

- ফ্রান্সিসকো

- থেকে

- ক্রিয়া

- তদ্ব্যতীত

- সাধারণ

- উত্পাদন করা

- প্রজন্ম

- সৃজক

- পেয়ে

- GitHub

- বিশ্বব্যাপী

- জিপিইউ

- জিপিইউ

- হত্তয়া

- কৌশল

- হার্ডওয়্যারের

- সাহায্য

- সাহায্য

- উচ্চ

- উচ্চ গুনসম্পন্ন

- ঊর্ধ্বতন

- রাখা

- হোস্ট

- হোস্টিং

- কিভাবে

- কিভাবে

- যাহোক

- HTTPS দ্বারা

- ভাবমূর্তি

- চিত্র

- উন্নত করা

- উন্নত

- অন্তর্ভুক্ত করা

- অন্তর্ভুক্ত

- সুদ্ধ

- বৃদ্ধি

- ক্রমবর্ধমান

- সূচক

- শিল্প

- শিল্প

- তথ্য

- পরিকাঠামো

- প্রবর্তিত

- ইনপুট

- অনুপ্রাণিত

- উদাহরণ

- বুদ্ধিমত্তা

- আগ্রহী

- IT

- নিজেই

- কাজ

- জবস

- যাত্রা

- রাখা

- জ্ঞান

- গবেষণাগার

- লেবেল

- লেবেলগুলি

- ভাষা

- বড়

- বৃহত্তর

- চালু

- স্তর

- নেতা

- শিক্ষা

- মাত্রা

- লাইব্রেরি

- জীবন বিজ্ঞান

- বোঝা

- স্থানীয়

- দেখুন

- মেশিন

- মেশিন লার্নিং

- পরিচালনা করা

- ব্যবস্থাপনা

- পরিচালক

- পরিচালক

- ম্যাপিং

- মাস্ক

- গণিত

- অংক

- মানে

- চিকিৎসা

- সদস্য

- স্মৃতি

- পদ্ধতি

- ছন্দোবিজ্ঞান

- ML

- মডেল

- মডেল

- মনিটর

- অধিক

- সেতু

- বহু

- সঙ্গীত

- প্রাকৃতিক

- প্রকৃতি

- প্রয়োজনীয়

- চাহিদা

- নেটওয়ার্ক

- NIH এ

- নোড

- সংখ্যা

- উদ্দেশ্য

- অফার

- দপ্তর

- নিরন্তর

- অপারেশন

- অপারেশনস

- অপ্টিমিজ

- ক্রম

- অন্যান্য

- কাগজ

- অংশ

- কামুক

- পেটেণ্ট

- পিডিএফ

- কর্মক্ষমতা

- মাসিক

- দর্শন

- পদার্থবিদ্যা

- খেলা

- কেলি

- অবস্থান

- সম্ভব

- সম্ভাব্য

- ভবিষ্যদ্বাণী করা

- ভবিষ্যদ্বাণী

- ভবিষ্যতবাণী

- আগে

- প্রাথমিক

- সমস্যা

- প্রক্রিয়া

- প্রসেস

- প্রক্রিয়াজাতকরণ

- পণ্য

- প্রোফাইলিং

- প্রকল্প

- অনুকূল

- প্রদান

- উপলব্ধ

- ধাক্কা

- পরিসর

- পড়া

- সাম্প্রতিক

- সম্প্রতি

- রেকর্ড

- উদ্ধার করুন

- হ্রাস করা

- সংক্রান্ত

- প্রতিনিধিত্ব

- প্রতিনিধিত্ব

- প্রয়োজন

- গবেষণা

- Resources

- ফলাফল

- প্রত্যাবর্তন

- ঝুঁকি

- চালান

- দৌড়

- একই

- স্কেল

- আরোহী

- বিজ্ঞান

- বিজ্ঞান

- বিজ্ঞানী

- বীজ

- সেবা

- সেবা

- বিভিন্ন

- SGD

- আকৃতি

- ভাগ

- সংক্ষিপ্ত

- প্রদর্শিত

- অনুরূপ

- সহজ

- থেকে

- একক

- আয়তন

- ছোট

- So

- সকার

- সমাধান

- সলিউশন

- সমাধান

- solves

- কিছু

- স্থান

- বিশেষভাবে

- স্পীড

- খরচ

- বিভক্ত করা

- টুকরা

- গাদা

- শুরু

- রাষ্ট্র

- রাষ্ট্র-এর-শিল্প

- যুক্তরাষ্ট্র

- দোকান

- কৌশল

- সাফল্য

- সাস্টেনিবিলিটি

- পদ্ধতি

- কাজ

- প্রযুক্তি

- প্রযুক্তি

- প্রযুক্তিঃ

- সার্জারির

- হাজার হাজার

- দ্বারা

- থ্রুপুট

- সময়

- বার

- টোকেন

- টোকেন

- সরঞ্জাম

- পথ

- ট্রেডমার্ক

- ঐতিহ্যগত

- প্রশিক্ষণ

- প্রবণতা

- উবুন্টু

- অভূতপূর্ব

- us

- ব্যবহার

- ইউটিলিটি

- ব্যবহার

- মূল্য

- বৈচিত্র্য

- বিভিন্ন

- উল্লম্ব

- দৃষ্টি

- আয়তন

- অপেক্ষা করুন

- তরঙ্গ

- উপায়

- কিনা

- যখন

- উইকিপিডিয়া

- ছাড়া

- শব্দ

- হয়া যাই ?

- কর্মী

- শ্রমিকদের

- কাজ

- X

- বছর

- আপনার

- ইউটিউব