ভূমিকা

আপনার গ্রেড স্কুল শিক্ষক সম্ভবত আপনাকে দেখাননি কিভাবে 20-সংখ্যার সংখ্যা যোগ করতে হয়। কিন্তু আপনি যদি জানেন কিভাবে ছোট সংখ্যা যোগ করতে হয়, আপনার যা দরকার তা হল কাগজ এবং পেন্সিল এবং একটু ধৈর্য। একটি জায়গা দিয়ে শুরু করুন এবং ধাপে ধাপে বাম দিকে কাজ করুন, এবং শীঘ্রই আপনি সহজে কুইন্টিলিয়ন স্তুপীকৃত হবেন।

এই ধরনের সমস্যা মানুষের জন্য সহজ, কিন্তু শুধুমাত্র যদি আমরা সঠিক উপায়ে তাদের কাছে যাই। "আমরা মানুষ কীভাবে এই সমস্যাগুলি সমাধান করি তা নয় 'এটির দিকে তাকান এবং তারপরে উত্তর লিখুন'," বলেছেন৷ এরান মালাচ, হার্ভার্ড বিশ্ববিদ্যালয়ের একজন মেশিন লার্নিং গবেষক। "আমরা আসলে ধাপগুলি দিয়ে হাঁটছি।"

এই অন্তর্দৃষ্টি ChatGPT-এর মতো চ্যাটবটগুলিকে শক্তিশালী করে এমন বড় ভাষার মডেলগুলি অধ্যয়নরত গবেষকদের অনুপ্রাণিত করেছে৷ যদিও এই সিস্টেমগুলি পাটিগণিতের কয়েকটি ধাপ জড়িত প্রশ্নগুলিকে উসকে দিতে পারে, তারা প্রায়শই দুটি বড় সংখ্যার যোগফল গণনা করার মতো অনেকগুলি ধাপ জড়িত সমস্যাগুলিকে ফ্লব করবে। কিন্তু 2022 সালে, গুগল গবেষকদের একটি দল দেখিয়েছেন যে ভাষা মডেলগুলিকে ধাপে ধাপে সমাধানগুলি তৈরি করতে বলা মডেলগুলিকে এমন সমস্যাগুলি সমাধান করতে সক্ষম করেছে যা আগে তাদের নাগালের বাইরে বলে মনে হয়েছিল৷ তাদের কৌশল, যাকে চেইন-অফ-থট প্রম্পটিং বলা হয়, শীঘ্রই ব্যাপক হয়ে ওঠে, এমনকি গবেষকরা এটি কী কাজ করে তা বোঝার জন্য সংগ্রাম করে।

এখন, বেশ কয়েকটি দল কম্পিউটেশনাল জটিলতা তত্ত্ব নামক তাত্ত্বিক কম্পিউটার বিজ্ঞানের একটি অত্যাশ্চর্য শাখা থেকে কৌশল ব্যবহার করে চেইন-অফ-থট যুক্তির শক্তি অন্বেষণ করেছে। এটি গবেষণার একটি লাইনের সর্বশেষ অধ্যায় যা ভাষা মডেলের অন্তর্নিহিত ক্ষমতা এবং সীমাবদ্ধতাগুলি অধ্যয়ন করতে জটিলতা তত্ত্ব ব্যবহার করে। এই প্রচেষ্টাগুলি স্পষ্ট করে যে আমাদের কোথায় মডেলগুলি ব্যর্থ হওয়ার আশা করা উচিত এবং তারা সেগুলি তৈরির জন্য নতুন পদ্ধতির দিকে নির্দেশ করতে পারে।

"তারা কিছু জাদু সরিয়ে দেয়," বলেন দিমিত্রিস পাপাইলিওপোলোস, উইসকনসিন, ম্যাডিসন বিশ্ববিদ্যালয়ের একজন মেশিন লার্নিং গবেষক। "সেটা একটা ভাল জিনিস."

ট্রান্সফরমার প্রশিক্ষণ

কৃত্রিম নিউরাল নেটওয়ার্ক নামে গাণিতিক কাঠামোর চারপাশে বড় ভাষার মডেল তৈরি করা হয়। এই নেটওয়ার্কগুলির মধ্যে থাকা অনেকগুলি "নিউরন" পৃথক শব্দের প্রতিনিধিত্বকারী সংখ্যার দীর্ঘ স্ট্রিংগুলিতে সহজ গাণিতিক ক্রিয়াকলাপ সম্পাদন করে, নেটওয়ার্কের মধ্য দিয়ে যাওয়া প্রতিটি শব্দকে অন্যটিতে স্থানান্তরিত করে। এই গাণিতিক আলকেমির বিশদ বিবরণ নেটওয়ার্কের প্যারামিটার নামক সংখ্যার আরেকটি সেটের উপর নির্ভর করে, যা নিউরনের মধ্যে সংযোগের শক্তি পরিমাপ করে।

সুসংগত আউটপুট তৈরি করার জন্য একটি ভাষা মডেলকে প্রশিক্ষণ দেওয়ার জন্য, গবেষকরা সাধারণত একটি নিউরাল নেটওয়ার্ক দিয়ে শুরু করেন যার সমস্ত প্যারামিটারের এলোমেলো মান থাকে এবং তারপরে এটি ইন্টারনেটের চারপাশ থেকে ডেটা রিম করে। প্রতিবার মডেলটি পাঠ্যের একটি নতুন ব্লক দেখে, এটি পালাক্রমে প্রতিটি শব্দের ভবিষ্যদ্বাণী করার চেষ্টা করে: এটি প্রথমটির উপর ভিত্তি করে দ্বিতীয়টি অনুমান করে, তৃতীয়টি প্রথম দুটির উপর ভিত্তি করে এবং আরও অনেক কিছু। এটি প্রতিটি ভবিষ্যদ্বাণীকে প্রকৃত পাঠ্যের সাথে তুলনা করে, তারপর পার্থক্য কমাতে এর পরামিতিগুলিকে টুইক করে। প্রতিটি টুইক শুধুমাত্র মডেলের ভবিষ্যদ্বাণীগুলিকে সামান্য পরিবর্তন করে, কিন্তু কোন না কোনভাবে তাদের সম্মিলিত প্রভাব একটি মডেলকে এমন ইনপুটগুলিতে সুসঙ্গতভাবে প্রতিক্রিয়া জানাতে সক্ষম করে যা এটি কখনও দেখেনি।

গবেষকরা 20 বছর ধরে ভাষা প্রক্রিয়া করার জন্য নিউরাল নেটওয়ার্ককে প্রশিক্ষণ দিচ্ছেন। কিন্তু কাজটি সত্যিই 2017 সালে শুরু হয়েছিল, যখন গুগলের গবেষকরা একটি প্রবর্তন করেছিলেন নতুন ধরনের নেটওয়ার্ক ট্রান্সফরমার বলা হয়।

"এটি সাত বছর আগে প্রস্তাব করা হয়েছিল, যা প্রাগৈতিহাসিক বলে মনে হয়," বলেন পাবলো বার্সেলো, চিলির পন্টিফিকাল ক্যাথলিক বিশ্ববিদ্যালয়ের একজন মেশিন লার্নিং গবেষক।

যা ট্রান্সফরমারগুলিকে এতটাই রূপান্তরকারী করে তুলেছে যে প্রশিক্ষণকে নিষেধমূলকভাবে ব্যয়বহুল না করেই — প্যারামিটারের সংখ্যা এবং প্রশিক্ষণের ডেটার পরিমাণ বাড়ানো — এগুলিকে বড় করা সহজ। ট্রান্সফরমারের আগে, নিউরাল নেটওয়ার্কে সর্বাধিক কয়েকশ মিলিয়ন প্যারামিটার ছিল; আজ, বৃহত্তম ট্রান্সফরমার-ভিত্তিক মডেলগুলি ট্রিলিয়নেরও বেশি। গত পাঁচ বছরে ভাষা-মডেলের পারফরম্যান্সের বেশিরভাগ উন্নতি কেবলমাত্র স্কেল আপ করার মাধ্যমে আসে।

ট্রান্সফরমাররা অ্যাটেনশন হেড নামক বিশেষ গাণিতিক কাঠামো ব্যবহার করে এটি সম্ভব করেছে, যা তাদের পাঠ্য পাঠের এক ধরণের পাখির দৃষ্টি দেয়। যখন একটি ট্রান্সফরমার পাঠ্যের একটি নতুন ব্লক পড়ে, তখন তার মনোযোগের প্রধানগুলি দ্রুত পুরো জিনিসটি স্ক্যান করে এবং শব্দগুলির মধ্যে প্রাসঙ্গিক সংযোগগুলি সনাক্ত করে - সম্ভবত লক্ষ্য করে যে চতুর্থ এবং অষ্টম শব্দগুলি 10 তম ভবিষ্যদ্বাণী করার জন্য সবচেয়ে কার্যকর হতে পারে৷ তারপর মনোযোগের মাথাগুলি ফিডফরওয়ার্ড নেটওয়ার্ক নামে পরিচিত নিউরনের একটি বিশাল ওয়েবের সাথে শব্দগুলি পাস করে, যা এটিকে শিখতে সাহায্য করে এমন ভবিষ্যদ্বাণী তৈরি করতে প্রয়োজনীয় ভারী সংখ্যা ক্রঞ্চিং করে।

বাস্তব ট্রান্সফরমারগুলিতে ফিডফরোয়ার্ড নেটওয়ার্কগুলির দ্বারা আলাদা করা মনোযোগের মাথার একাধিক স্তর থাকে এবং শুধুমাত্র শেষ স্তরের পরে পূর্বাভাস দেয়। কিন্তু প্রতিটি স্তরে, মনোযোগ প্রধানগুলি ইতিমধ্যে প্রতিটি শব্দের জন্য সবচেয়ে প্রাসঙ্গিক প্রসঙ্গ চিহ্নিত করেছে, তাই টেক্সটের প্রতিটি শব্দের জন্য গণনামূলকভাবে নিবিড় ফিডফরওয়ার্ড পদক্ষেপ একই সাথে ঘটতে পারে। এটি প্রশিক্ষণ প্রক্রিয়াকে গতিশীল করে, ক্রমবর্ধমান বড় ডেটার সেটগুলিতে ট্রান্সফরমারকে প্রশিক্ষণ দেওয়া সম্ভব করে তোলে। আরও গুরুত্বপূর্ণ, এটি গবেষকদের টেন্ডেমে কাজ করা অনেক প্রসেসর জুড়ে একটি বিশাল নিউরাল নেটওয়ার্ক প্রশিক্ষণের বিশাল গণনামূলক লোড ছড়িয়ে দেওয়ার অনুমতি দেয়।

বৃহৎ ডেটা সেট থেকে সর্বাধিক সুবিধা পেতে, "আপনাকে মডেলগুলিকে সত্যিই বড় করতে হবে," বলেছেন৷ ডেভিড চিয়াং, নটরডেম বিশ্ববিদ্যালয়ের একজন মেশিন লার্নিং গবেষক। "এটি সমান্তরাল না হলে তাদের প্রশিক্ষণ দেওয়া বাস্তবিক হবে না।"

যাইহোক, সমান্তরাল কাঠামো যা ট্রান্সফরমারগুলিকে প্রশিক্ষণ দেওয়া এত সহজ করে তোলে প্রশিক্ষণের পরে সাহায্য করে না — সেই সময়ে, ইতিমধ্যে বিদ্যমান শব্দগুলির ভবিষ্যদ্বাণী করার দরকার নেই। সাধারণ ক্রিয়াকলাপের সময়, ট্রান্সফরমারগুলি একবারে একটি শব্দ আউটপুট করে, পরবর্তী শব্দ তৈরি করার আগে প্রতিটি আউটপুটকে ইনপুটে ফিরে ট্যাক করে, কিন্তু তারা এখনও সমান্তরাল প্রক্রিয়াকরণের জন্য অপ্টিমাইজ করা একটি আর্কিটেকচারের সাথে আটকে থাকে।

যেহেতু ট্রান্সফরমার-ভিত্তিক মডেলগুলি বেড়েছে এবং নির্দিষ্ট কিছু কাজ তাদের সমস্যা দিতে থাকে, কিছু গবেষকরা ভাবতে শুরু করেন যে আরও সমান্তরাল মডেলগুলির দিকে ধাক্কা খরচে এসেছে কিনা। তাত্ত্বিকভাবে ট্রান্সফরমারের আচরণ বোঝার একটি উপায় ছিল?

ট্রান্সফরমারের জটিলতা

নিউরাল নেটওয়ার্কের তাত্ত্বিক অধ্যয়নগুলি অনেক সমস্যার সম্মুখীন হয়, বিশেষ করে যখন তারা প্রশিক্ষণের জন্য অ্যাকাউন্ট করার চেষ্টা করে। নিউরাল নেটওয়ার্কগুলি প্রশিক্ষণ প্রক্রিয়ার প্রতিটি ধাপে তাদের পরামিতিগুলিকে পরিবর্তন করার জন্য একটি সুপরিচিত পদ্ধতি ব্যবহার করে। কিন্তু কেন এই সহজ পদ্ধতিটি পরামিতিগুলির একটি ভাল সেটে একত্রিত হয় তা বোঝা কঠিন হতে পারে।

প্রশিক্ষণের সময় কী ঘটে তা বিবেচনা করার পরিবর্তে, কিছু গবেষক ট্রান্সফরমারগুলির অন্তর্নিহিত ক্ষমতাগুলি অধ্যয়ন করে কল্পনা করে যে তাদের পরামিতিগুলিকে যে কোনও নির্বিচারে মানগুলির সাথে সামঞ্জস্য করা সম্ভব। এটি একটি ট্রান্সফরমারকে একটি বিশেষ ধরনের প্রোগ্রামেবল কম্পিউটার হিসাবে বিবেচনা করার পরিমাণ।

"আপনার কাছে কিছু কম্পিউটিং ডিভাইস আছে, এবং আপনি জানতে চান, 'আচ্ছা, এটি কী করতে পারে? এটা কি ধরনের ফাংশন গণনা করতে পারে?'” চিয়াং বলল।

এগুলি গণনার আনুষ্ঠানিক অধ্যয়নের কেন্দ্রীয় প্রশ্ন। ক্ষেত্রটি 1936 সালের, যখন অ্যালান টুরিং প্রথম একটি কল্পনা করেছিলেন কল্পনাপ্রসূত ডিভাইস, যাকে এখন একটি টুরিং মেশিন বলা হয়, যা একটি অসীম টেপে প্রতীকগুলি পড়া এবং লেখার মাধ্যমে যে কোনও গণনা সম্পাদন করতে পারে। কম্পিউটেশনাল জটিলতা তত্ত্ববিদরা পরবর্তীতে টুরিং এর কাজকে প্রমাণ করে যে কম্পিউটেশনাল সমস্যাগুলি স্বাভাবিকভাবেই বিভিন্ন ক্ষেত্রে পড়ে। জটিলতা ক্লাস তাদের সমাধান করার জন্য প্রয়োজনীয় সংস্থান দ্বারা সংজ্ঞায়িত।

2019 সালে, বার্সেলো এবং অন্য দুই গবেষক প্রতিপন্ন যে একটি নির্দিষ্ট সংখ্যক পরামিতি সহ একটি ট্রান্সফরমারের একটি আদর্শ সংস্করণ টিউরিং মেশিনের মতোই শক্তিশালী হতে পারে। আপনি যদি একটি ট্রান্সফরমার সেট আপ করেন যাতে বারবার তার আউটপুটকে ইনপুট হিসাবে ফিড করা যায় এবং আপনি যে নির্দিষ্ট সমস্যার সমাধান করতে চান তার জন্য উপযুক্ত মানগুলিতে প্যারামিটার সেট করেন, এটি শেষ পর্যন্ত সঠিক উত্তরটি বের করে দেবে।

এই ফলাফলটি একটি সূচনা বিন্দু ছিল, কিন্তু এটি কিছু অবাস্তব অনুমানের উপর নির্ভর করে যা সম্ভবত ট্রান্সফরমারের শক্তিকে অতিরিক্ত মূল্যায়ন করবে। পরবর্তী বছরগুলিতে, গবেষকরা আরও বাস্তবসম্মত তাত্ত্বিক কাঠামো বিকাশের জন্য কাজ করেছেন।

এমন একটি প্রচেষ্টা 2021 সালে শুরু হয়েছিল, যখন উইলিয়াম মেরিল, এখন নিউ ইয়র্ক বিশ্ববিদ্যালয়ের একজন স্নাতক ছাত্র, সিয়াটেলের অ্যালেন ইনস্টিটিউট ফর কৃত্রিম বুদ্ধিমত্তায় দুই বছরের ফেলোশিপ ছেড়ে যাচ্ছিলেন৷ সেখানে থাকাকালীন, তিনি ট্রান্সফরমারের সমান্তরাল আর্কিটেকচারের জন্য দুর্বল ফিট বলে মনে হয় এমন কৌশল ব্যবহার করে অন্যান্য ধরণের নিউরাল নেটওয়ার্কগুলি বিশ্লেষণ করতেন। যাওয়ার কিছুক্ষণ আগে, তিনি এআই গবেষক অ্যালেন ইনস্টিটিউটের সাথে একটি কথোপকথন শুরু করেছিলেন আশিস সবরওয়াল, যিনি AI গবেষণায় যাওয়ার আগে জটিলতা তত্ত্ব অধ্যয়ন করেছিলেন। তারা সন্দেহ করতে শুরু করে যে জটিলতা তত্ত্ব তাদের ট্রান্সফরমারের সীমা বুঝতে সাহায্য করতে পারে।

“এটা মনে হচ্ছিল এটা একটা সাধারণ মডেল; কিছু সীমাবদ্ধতা থাকতেই হবে যেগুলো একজনকে মেরে ফেলতে পারে,” সবরওয়াল বলেছেন।

এই জুটি গণনাগত জটিলতা তত্ত্বের একটি শাখা ব্যবহার করে ট্রান্সফরমার বিশ্লেষণ করেছে, যাকে বলা হয় সার্কিট জটিলতা, যা প্রায়শই সমান্তরাল গণনা অধ্যয়ন করতে ব্যবহৃত হয় এবং ছিল সম্প্রতি প্রয়োগ করা হয়েছে ট্রান্সফরমারের সরলীকৃত সংস্করণে। পরের বছর ধরে, তারা পূর্ববর্তী কাজের বেশ কয়েকটি অবাস্তব অনুমানকে পরিমার্জন করেছে। ট্রান্সফরমারগুলির সমান্তরাল কাঠামো কীভাবে তাদের ক্ষমতাকে সীমাবদ্ধ করতে পারে তা অধ্যয়ন করার জন্য, জোড়াটি সেই ক্ষেত্রে বিবেচনা করে যেখানে ট্রান্সফরমারগুলি তাদের আউটপুটকে তাদের ইনপুটে ফিরিয়ে দেয় না — পরিবর্তে, তাদের প্রথম আউটপুটটি চূড়ান্ত উত্তর হতে হবে। তারা প্রতিপন্ন যে এই তাত্ত্বিক কাঠামোর ট্রান্সফরমারগুলি একটি নির্দিষ্ট জটিলতার শ্রেণির বাইরে থাকা কোনও গণনীয় সমস্যা সমাধান করতে পারেনি। এবং অনেক গণিতের সমস্যা, যার মধ্যে তুলনামূলকভাবে সহজ সমস্যা যেমন রৈখিক সমীকরণ সমাধান করা, এই শ্রেণীর বাইরে থাকে বলে মনে করা হয়।

মূলত, তারা দেখিয়েছিল যে সমান্তরালতা একটি খরচে এসেছিল - অন্তত যখন ট্রান্সফরমারদের এখনই একটি উত্তর বের করতে হবে। মেরিল বলেন, "ট্রান্সফরমারগুলি বেশ দুর্বল হয় যদি আপনি তাদের ব্যবহার করার পদ্ধতিতে আপনি একটি ইনপুট দেন এবং আপনি শুধুমাত্র একটি তাত্ক্ষণিক উত্তর আশা করেন," মেরিল বলেন।

চিন্তা পরীক্ষা

মেরিল এবং সাভারওয়ালের ফলাফল একটি স্বাভাবিক প্রশ্ন উত্থাপন করেছে — ট্রান্সফরমারগুলিকে তাদের আউটপুট পুনর্ব্যবহার করার অনুমতি দেওয়া হলে তারা কতটা শক্তিশালী হয়ে ওঠে? বার্সেলো এবং তার সহ-লেখকরা তাদের 2019 সালের আদর্শিক ট্রান্সফরমারের বিশ্লেষণে এই কেসটি অধ্যয়ন করেছিলেন, কিন্তু আরও বাস্তবসম্মত অনুমানের সাথে প্রশ্নটি উন্মুক্ত ছিল। এবং মধ্যবর্তী বছরগুলিতে, গবেষকরা চেইন-অফ-থট প্রম্পটিং আবিষ্কার করেছিলেন, প্রশ্নটিকে একটি নতুন প্রাসঙ্গিকতা দিয়েছে।

মেরিল এবং সাভারওয়াল জানতেন যে তাদের সম্পূর্ণরূপে গাণিতিক পদ্ধতি বাস্তব ভাষার মডেলগুলিতে চেইন-অফ-থট যুক্তির সমস্ত দিক ধরতে পারে না, যেখানে প্রম্পটে শব্দগুলি খুব গুরুত্বপূর্ণ হতে পারে. কিন্তু প্রম্পট যেভাবে শব্দগুচ্ছ করা হোক না কেন, যতক্ষণ না এটি একটি ভাষা মডেলকে ধাপে ধাপে সমাধানের জন্য আউটপুট করে, মডেলটি নীতিগতভাবে ট্রান্সফরমারের মধ্য দিয়ে পরবর্তী পাসে মধ্যবর্তী ধাপের ফলাফল পুনঃব্যবহার করতে পারে। এটি সমান্তরাল গণনার সীমা এড়াতে একটি উপায় প্রদান করতে পারে।

ইতিমধ্যে, পিকিং ইউনিভার্সিটির একটি দল অনুরূপ লাইন ধরে চিন্তা করছিল এবং তাদের প্রাথমিক ফলাফল ইতিবাচক ছিল। মে 2023 সালের একটি গবেষণাপত্রে, তারা কিছু গণিত সমস্যা চিহ্নিত করেছে যা মেরিল এবং সাভারওয়ালের কাঠামোর সাধারণ ট্রান্সফরমারদের জন্য অসম্ভব হওয়া উচিত এবং দেখিয়েছেন যে মধ্যবর্তী পদক্ষেপগুলি ট্রান্সফরমারগুলিকে এই সমস্যাগুলি সমাধান করতে সক্ষম করে।

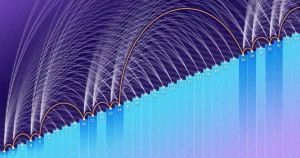

অক্টোবরে, মেরিল এবং সাভারওয়াল তাদের পূর্ববর্তী কাজ অনুসরণ করেন a বিস্তারিত তাত্ত্বিক অধ্যয়ন চিন্তার শৃঙ্খলের গণনা শক্তির। তারা পরিমাপ করেছে যে কীভাবে অতিরিক্ত গণনা শক্তি একটি ট্রান্সফরমারকে একটি চূড়ান্ত উত্তর বের করার আগে ব্যবহার করার অনুমতি দেওয়া মধ্যবর্তী পদক্ষেপের সংখ্যার উপর নির্ভর করে। সাধারণভাবে, গবেষকরা আশা করেন যে কোনও সমস্যা সমাধানের জন্য উপযুক্ত সংখ্যক মধ্যবর্তী পদক্ষেপগুলি সমস্যার ইনপুটের আকারের উপর নির্ভর করে। উদাহরণস্বরূপ, দুটি 20-সংখ্যার সংখ্যা যোগ করার জন্য সবচেয়ে সহজ কৌশলটির জন্য দুটি 10-সংখ্যার সংখ্যা যোগ করার জন্য একই পদ্ধতির চেয়ে দ্বিগুণ মধ্যবর্তী সংযোজন পদক্ষেপ প্রয়োজন।

এই ধরনের উদাহরণগুলি সুপারিশ করে যে ট্রান্সফরমারগুলি শুধুমাত্র কয়েকটি মধ্যবর্তী পদক্ষেপ ব্যবহার করে খুব বেশি লাভ করবে না। প্রকৃতপক্ষে, মেরিল এবং সাভারওয়াল প্রমাণ করেছেন যে চিন্তার চেইনটি তখনই সাহায্য করতে শুরু করে যখন ইনপুটের আকারের অনুপাতে মধ্যবর্তী ধাপের সংখ্যা বৃদ্ধি পায় এবং অনেক সমস্যার জন্য মধ্যবর্তী পদক্ষেপের সংখ্যা এখনও অনেক বড় হওয়ার প্রয়োজন হয়।

ফলাফলের পুঙ্খানুপুঙ্খতা গবেষকদের মুগ্ধ করেছে। "তারা সত্যিই এটি পিন করেছে," বলেছেন ড্যানিয়েল হু, কলম্বিয়া বিশ্ববিদ্যালয়ের একজন মেশিন লার্নিং গবেষক।

মেরিল এবং সাভারওয়ালের সাম্প্রতিক কাজ ইঙ্গিত দেয় যে চিন্তার চেইন একটি প্যানেসিয়া নয় — নীতিগতভাবে, এটি ট্রান্সফরমারগুলিকে কঠিন সমস্যা সমাধানে সাহায্য করতে পারে, তবে শুধুমাত্র প্রচুর গণনামূলক প্রচেষ্টার খরচে।

"আমরা এক ধাপে ট্রান্সফরমারের সীমাবদ্ধতাগুলির কাছাকাছি পাওয়ার বিভিন্ন উপায়ে আগ্রহী," মেরিল বলেছেন। "চিন্তা চেইন এক উপায়, কিন্তু এই কাগজ দেখায় যে এটি সবচেয়ে অর্থনৈতিক উপায় নাও হতে পারে।"

বাস্তবে প্রত্যাবর্তন

তবুও, গবেষকরা সতর্ক করেন যে এই ধরণের তাত্ত্বিক বিশ্লেষণ শুধুমাত্র বাস্তব ভাষার মডেল সম্পর্কে এত কিছু প্রকাশ করতে পারে। ইতিবাচক ফলাফল - প্রমাণ যে ট্রান্সফরমারগুলি নীতিগতভাবে কিছু সমস্যার সমাধান করতে পারে - এটি বোঝায় না যে একটি ভাষা মডেল আসলে প্রশিক্ষণের সময় সেই সমাধানগুলি শিখবে।

এবং এমনকি ট্রান্সফরমারের সীমাবদ্ধতাগুলিকে সম্বোধন করে এমন ফলাফলগুলি সতর্কতার সাথে আসে: তারা নির্দেশ করে যে কোনও ট্রান্সফরমার সমস্ত ক্ষেত্রে নিখুঁতভাবে নির্দিষ্ট সমস্যার সমাধান করতে পারে না। অবশ্যই, যে একটি চমত্কার উচ্চ বার. "সমস্যাটির বিশেষ ক্ষেত্রে হতে পারে যে এটি ঠিকভাবে পরিচালনা করতে পারে," হু বলেছেন।

এই সতর্কতা সত্ত্বেও, নতুন কাজটি বিভিন্ন ধরণের নিউরাল নেটওয়ার্ক আর্কিটেকচার বিশ্লেষণ করার জন্য একটি টেমপ্লেট অফার করে যা অবশেষে ট্রান্সফরমার প্রতিস্থাপন করতে পারে। যদি একটি জটিলতা তত্ত্ব বিশ্লেষণ প্রস্তাব করে যে নির্দিষ্ট ধরণের নেটওয়ার্কগুলি অন্যদের তুলনায় বেশি শক্তিশালী, তবে এটি প্রমাণ হবে যে সেই নেটওয়ার্কগুলি বাস্তব জগতেও ভাল হতে পারে।

চিয়াং আরও জোর দিয়েছিলেন যে ট্রান্সফরমারগুলির সীমাবদ্ধতাগুলির উপর গবেষণাটি আরও মূল্যবান কারণ ভাষা মডেলগুলি বাস্তব-বিশ্বের অ্যাপ্লিকেশনগুলির একটি বিস্তৃত পরিসরে ক্রমবর্ধমানভাবে ব্যবহৃত হচ্ছে, যার ফলে তাদের ক্ষমতাগুলিকে অতিমূল্যায়ন করা সহজ হয়ে উঠেছে।

চিয়াং বলেন, "আসলে অনেক কিছু আছে যা তারা ভালো করে না, এবং আমাদের সীমাবদ্ধতাগুলি সম্পর্কে খুব, খুব সচেতন হতে হবে," চিয়াং বলেছিলেন। "তাই এই ধরনের কাজ সত্যিই গুরুত্বপূর্ণ।"

- এসইও চালিত বিষয়বস্তু এবং পিআর বিতরণ। আজই পরিবর্ধিত পান।

- PlatoData.Network উল্লম্ব জেনারেটিভ Ai. নিজেকে ক্ষমতায়িত করুন। এখানে প্রবেশ করুন.

- প্লেটোএআইস্ট্রিম। Web3 ইন্টেলিজেন্স। জ্ঞান প্রসারিত. এখানে প্রবেশ করুন.

- প্লেটোইএসজি। কার্বন, ক্লিনটেক, শক্তি, পরিবেশ সৌর, বর্জ্য ব্যবস্থাপনা. এখানে প্রবেশ করুন.

- প্লেটো হেলথ। বায়োটেক এবং ক্লিনিক্যাল ট্রায়াল ইন্টেলিজেন্স। এখানে প্রবেশ করুন.

- উত্স: https://www.quantamagazine.org/how-chain-of-thought-reasoning-helps-neural-networks-compute-20240321/

- : আছে

- : হয়

- :না

- :কোথায়

- [পৃ

- $ ইউপি

- 10th

- 20

- 20 বছর

- 2017

- 2019

- 2021

- 2022

- 2023

- a

- ক্ষমতার

- সম্পর্কে

- হিসাব

- দিয়ে

- আসল

- প্রকৃতপক্ষে

- যোগ

- যোগ

- যোগ

- ঠিকানা

- সমন্বয় করা

- পর

- পূর্বে

- AI

- আইআই গবেষণা

- অ্যালান

- এলান টুরিং

- কিমিতি

- সব

- অ্যালেন

- অনুমতি

- অনুমতি

- বরাবর

- ইতিমধ্যে

- এছাড়াও

- পরিমাণ

- পরিমাণে

- an

- বিশ্লেষণ

- বিশ্লেষণ

- বিশ্লেষণ

- এবং

- অন্য

- উত্তর

- কোন

- অ্যাপ্লিকেশন

- অভিগমন

- পন্থা

- যথাযথ

- অবাধ

- রহস্যময়

- স্থাপত্য

- আর্কিটেকচারের

- রয়েছি

- কাছাকাছি

- কৃত্রিম

- কৃত্রিম বুদ্ধিমত্তা

- AS

- জিজ্ঞাসা

- আ

- অনুমানের

- At

- মনোযোগ

- দূরে

- পিছনে

- বার

- ভিত্তি

- BE

- হয়ে ওঠে

- পরিণত

- হয়েছে

- আগে

- শুরু হয়

- শুরু

- আচরণ

- উত্তম

- মধ্যে

- তার পরেও

- বিট

- বাধা

- শাখা

- নির্মাণ করা

- ভবন

- নির্মিত

- কিন্তু

- by

- গণক

- নামক

- CAN

- ক্ষমতা

- গ্রেপ্তার

- কেস

- মামলা

- কারণসমূহ

- সাবধানতা

- মধ্য

- কিছু

- চেন

- পরিবর্তন

- অধ্যায়

- chatbots

- চ্যাটজিপিটি

- চিলি

- শ্রেণী

- সমন্বিত

- সমষ্টিগত

- COLUMBIA

- আসা

- আসে

- জটিলতা

- গণনা

- গণনা

- গণনা ক্ষমতা

- গণনাগতভাবে

- গনা

- কম্পিউটার

- কম্পিউটার বিজ্ঞান

- কম্পিউটিং

- সংযোগ

- বিবেচনা

- বিবেচিত

- প্রসঙ্গ

- অব্যাহত

- কথোপকথন

- ঠিক

- মূল্য

- পারা

- পথ

- উপাত্ত

- ডেটা সেট

- তারিখগুলি

- সংজ্ঞায়িত

- নির্ভর

- নির্ভর করে

- বিস্তারিত

- বিকাশ

- যন্ত্র

- DID

- পার্থক্য

- বিভিন্ন

- কঠিন

- অসুবিধা

- আবিষ্কৃত

- do

- না

- না

- Dont

- নিচে

- সময়

- প্রতি

- পূর্বে

- আরাম

- সহজ

- প্রভাব

- প্রচেষ্টা

- প্রচেষ্টা

- অষ্টম

- সক্ষম করা

- সম্ভব

- প্রচুর

- সমীকরণ

- বিশেষত

- টালা

- এমন কি

- অবশেষে

- প্রতি

- প্রমান

- উদাহরণ

- থাকা

- আশা করা

- ব্যয়বহুল

- অন্বেষণ করা

- অতিরিক্ত

- মুখ

- ব্যর্থ

- পতন

- কয়েক

- ক্ষেত্র

- চূড়ান্ত

- জরিমানা

- প্রথম

- ফিট

- পাঁচ

- স্থায়ী

- অনুসৃত

- অনুসরণ

- জন্য

- আনুষ্ঠানিকভাবে

- চতুর্থ

- ফ্রেমওয়ার্ক

- অবকাঠামো

- থেকে

- ক্রিয়াকলাপ

- লাভ করা

- সাধারণ

- উত্পাদন করা

- উৎপাদিত

- পাওয়া

- পেয়ে

- দাও

- দান

- চালু

- ভাল

- গুগল

- পেয়েছিলাম

- শ্রেণী

- স্নাতক

- বড় হয়েছি

- হত্তয়া

- বৃদ্ধি

- ছিল

- হাতল

- ঘটা

- এরকম

- কঠিনতর

- হার্ভার্ড

- হার্ভার্ড বিশ্ববিদ্যালয়

- আছে

- he

- মাথা

- ভারী

- সাহায্য

- সাহায্য

- উচ্চ

- তার

- কিভাবে

- কিভাবে

- HTTP

- HTTPS দ্বারা

- মানুষেরা

- শত

- চিহ্নিত

- সনাক্ত করা

- if

- প্রকল্পিত

- আশু

- গুরুত্বপূর্ণ

- অসম্ভব

- অঙ্কিত

- উন্নতি

- in

- সুদ্ধ

- বৃদ্ধি

- ক্রমবর্ধমানভাবে

- প্রকৃতপক্ষে

- ইঙ্গিত

- ইঙ্গিত

- স্বতন্ত্র

- অসীম

- আইএনজি

- ইনপুট

- ইনপুট

- ভিতরে

- সূক্ষ্মদৃষ্টি

- অনুপ্রাণিত

- পরিবর্তে

- প্রতিষ্ঠান

- বুদ্ধিমত্তা

- আগ্রহী

- Internet

- হস্তক্ষেপ

- মধ্যে

- স্বকীয়

- উপস্থাপিত

- ঘটিত

- IT

- এর

- মাত্র

- রকম

- ধরণের

- জানা

- ভাষা

- বড়

- বৃহত্তর

- বৃহত্তম

- গত

- পরে

- সর্বশেষ

- স্তর

- স্তর

- শিখতে

- শিক্ষা

- অন্তত

- ছোড়

- মিথ্যা

- মত

- সম্ভবত

- LIMIT টি

- সীমাবদ্ধতা

- সীমা

- লাইন

- রৈখিক

- লাইন

- বোঝা

- দীর্ঘ

- অনেক

- মেশিন

- মেশিন লার্নিং

- প্রণীত

- পত্রিকা

- জাদু

- করা

- তৈরি করে

- মেকিং

- অনেক

- বৃহদায়তন

- গণিত

- গাণিতিক

- ব্যাপার

- মে..

- মেরিল

- হতে পারে

- মিলিয়ন

- মডেল

- মডেল

- অধিক

- সেতু

- চলন্ত

- অনেক

- বহু

- অবশ্যই

- প্রাকৃতিক

- প্রয়োজন

- প্রয়োজন

- নেটওয়ার্ক

- নেটওয়ার্ক

- নার্ভীয়

- স্নায়বিক নেটওয়ার্ক

- নিউরাল নেটওয়ার্ক

- নিউরোন

- না

- নতুন

- নিউ ইয়র্ক

- পরবর্তী

- না।

- লক্ষ

- এখন

- সংখ্যা

- সংখ্যার

- অক্টোবর

- of

- বন্ধ

- অফার

- প্রায়ই

- on

- ONE

- ওগুলো

- কেবল

- সম্মুখের দিকে

- খোলা

- অপারেশন

- অপারেশনস

- অপ্টিমাইজ

- সাধারণ

- অন্যান্য

- অন্যরা

- বাইরে

- আউটপুট

- আউটপুট

- বাহিরে

- শেষ

- যুগল

- সর্বব্যাধিহর ঔষধ

- কাগজ

- সমান্তরাল

- পরামিতি

- পাস

- পাস

- গত

- ধৈর্য

- পীকিং

- ঠিকভাবে

- সম্পাদন করা

- কর্মক্ষমতা

- সম্ভবত

- জায়গা

- Plato

- প্লেটো ডেটা ইন্টেলিজেন্স

- প্লেটোডাটা

- বিন্দু

- দরিদ্র

- ধনাত্মক

- সম্ভব

- ক্ষমতা

- ক্ষমতাশালী

- ব্যবহারিক

- ভবিষ্যদ্বাণী করা

- পূর্বাভাসের

- ভবিষ্যদ্বাণী

- ভবিষ্যতবাণী

- প্রারম্ভিক

- চমত্কার

- আগে

- পূর্বে

- নীতি

- সম্ভবত

- সমস্যা

- সমস্যা

- কার্যপ্রণালী

- প্রক্রিয়া

- প্রক্রিয়াজাতকরণ

- প্রসেসর

- উৎপাদন করা

- প্রোগ্রামযোগ্য

- প্রমাণাদি

- অনুপাত

- প্রস্তাবিত

- প্রতিপন্ন

- প্রদান

- প্রতিপাদন

- বিশুদ্ধরূপে

- ধাক্কা

- কোয়ান্টাম্যাগাজিন

- পরিমাপ করা

- প্রশ্ন

- প্রশ্ন

- দ্রুত

- পুরোপুরি

- উত্থাপিত

- এলোমেলো

- পরিসর

- নাগাল

- পড়া

- বাস্তব

- বাস্তব জগতে

- বাস্তবানুগ

- বাস্তবতা

- সত্যিই

- সাম্প্রতিক

- হ্রাস করা

- মিহি

- অপেক্ষাকৃতভাবে

- প্রাসঙ্গিকতা

- প্রাসঙ্গিক

- রয়ে

- অপসারণ

- পুনঃপুনঃ

- প্রতিস্থাপন করা

- প্রতিনিধিত্বমূলক

- প্রয়োজন

- প্রয়োজনীয়

- প্রয়োজন

- গবেষণা

- গবেষক

- গবেষকরা

- Resources

- প্রতিক্রিয়া

- ফল

- ফলাফল

- পুনঃব্যবহারের

- প্রকাশ করা

- অধিকার

- বলেছেন

- একই

- স্কেল

- আরোহী

- স্ক্যান

- স্কুল

- বিজ্ঞান

- সিয়াটেল

- দ্বিতীয়

- করলো

- মনে হয়

- দেখা

- দেখেন

- সেট

- সেট

- সাত

- বিভিন্ন

- শীঘ্র

- উচিত

- প্রদর্শনী

- দেখিয়েছেন

- শো

- অনুরূপ

- সহজ

- সরলীকৃত

- কেবল

- এককালে

- থেকে

- আয়তন

- ক্ষুদ্রতর

- So

- সলিউশন

- সমাধান

- সমাধানে

- কিছু

- একরকম

- শীঘ্রই

- প্রশিক্ষণ

- নির্দিষ্ট

- গতি

- বিস্তার

- স্ট্যাক

- শুরু

- শুরু হচ্ছে

- ধাপ

- প্রারম্ভিক ব্যবহারের নির্দেশাবলী

- এখনো

- কৌশল

- শক্তি

- গঠন

- কাঠামো

- ছাত্র

- চর্চিত

- গবেষণায়

- অধ্যয়ন

- অধ্যয়নরত

- পরবর্তী

- এমন

- সুপারিশ

- প্রস্তাব

- সিস্টেম

- টমটম

- কাজ

- টীম

- দল

- প্রযুক্তি

- প্রযুক্তি

- টেমপ্লেট

- পাঠ

- চেয়ে

- যে

- সার্জারির

- তাদের

- তাহাদিগকে

- তারপর

- তত্ত্বীয়

- তত্ত্ব

- সেখানে।

- এইগুলো

- তারা

- জিনিস

- কিছু

- চিন্তা

- তৃতীয়

- এই

- সেগুলো

- চিন্তা

- দ্বারা

- সময়

- থেকে

- আজ

- গ্রহণ

- দিকে

- রেলগাড়ি

- প্রশিক্ষণ

- রূপান্তরিত

- ট্রান্সফরমার

- ট্রান্সফরমার

- চিকিত্সা

- দশ সহস্রের ত্রিঘাত

- ব্যাধি

- চেষ্টা

- টুরিং

- চালু

- খামচি

- সমন্বয়

- দ্বিগুণ

- দুই

- আদর্শ

- ধরনের

- সাধারণত

- বোঝা

- বিশ্ববিদ্যালয়

- যদি না

- ব্যবহার

- ব্যবহৃত

- দরকারী

- ব্যবহারসমূহ

- ব্যবহার

- দামি

- মানগুলি

- সংস্করণ

- সংস্করণ

- খুব

- চেক

- পদব্রজে ভ্রমণ

- প্রয়োজন

- ছিল

- উপায়..

- উপায়

- we

- দুর্বল

- ওয়েব

- webp

- আমরা একটি

- সুপরিচিত

- ছিল

- কি

- কখন

- কিনা

- যে

- যখন

- সমগ্র

- যাহার

- কেন

- ব্যাপক

- প্রশস্ত পরিসর

- ব্যাপক

- ইচ্ছা

- সঙ্গে

- ছাড়া

- আশ্চর্য

- শব্দ

- বাক্যে কথন

- শব্দ

- হয়া যাই ?

- কাজ করছে

- কাজ

- বিশ্ব

- would

- লেখা

- লেখা

- বছর

- বছর

- ইয়র্ক

- আপনি

- zephyrnet