Dette er et gæsteblogindlæg af Danny Brock, Rajeev Govindan og Krishnaram Kenthapadi hos Fiddler AI.

Din Amazon SageMaker modeller er live. De håndterer millioner af slutninger hver dag og skaber bedre forretningsresultater for din virksomhed. De præsterer præcis lige så godt som den dag, de blev lanceret.

Øh, vent. Er de? Måske. Måske ikke.

Uden virksomhedsklasse modelovervågning, kan dine modeller forfalde i stilhed. Dine maskinlæringshold (ML) ved måske aldrig, at disse modeller rent faktisk har ændret sig fra mirakler af indtægtsgenerering til forpligtelser, der træffer forkerte beslutninger, der koster din virksomhed tid og penge.

Fortvivl ikke. Løsningen er tættere på, end du tror.

Fiddler, en virksomhedsklasse Model Performance Management-løsning tilgængelig på AWS Marketplace, tilbyder modelovervågning og forklarlig AI for at hjælpe ML-teams med at inspicere og løse en omfattende række af modelproblemer. Gennem modelovervågning, modelforklarlighed, analyse og bias-detektion giver Fiddler din virksomhed en letanvendelig enkelt rude for at sikre, at dine modeller opfører sig, som de skal. Og hvis de ikke er det, tilbyder Fiddler også funktioner, der giver dig mulighed for at inspicere dine modeller for at finde de underliggende årsager til ydelsesfald.

Dette indlæg viser, hvordan din MLOps team kan forbedre data scientists produktivitet og reducere tiden til at opdage problemer for dine modeller implementeret i SageMaker ved at integrere med Fiddler Model Performance Management Platform i nogle få enkle trin.

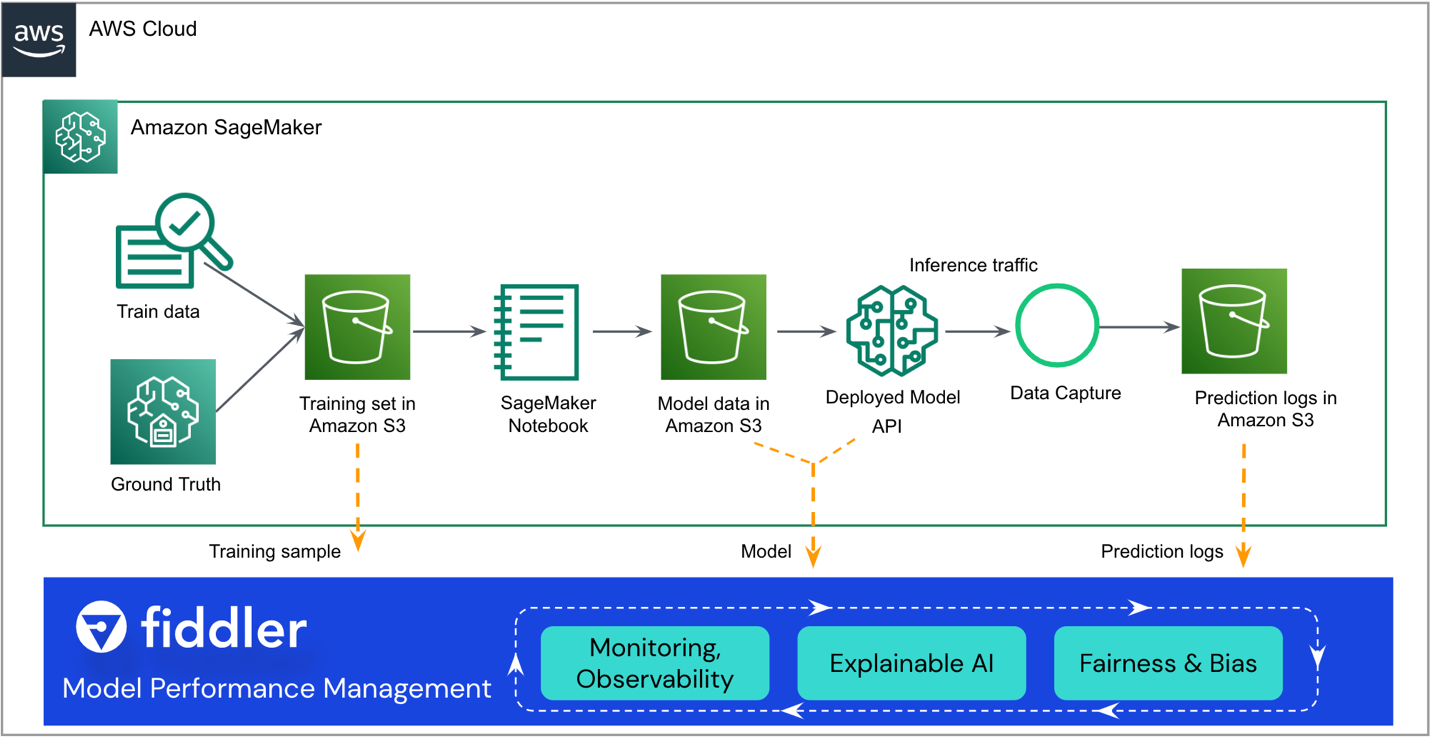

Løsningsoversigt

Den følgende referencearkitektur fremhæver de primære punkter ved integration. Fiddler eksisterer som en "sidevogn" til din eksisterende SageMaker ML-arbejdsgang.

Resten af dette indlæg leder dig gennem trinene til at integrere din SageMaker-model med Fiddler's Model Performance Management Platform:

- Sørg for, at din model har datafangst aktiveret.

- Opret et Fiddler-prøvemiljø.

- Registrer oplysninger om din model i dit Fiddler-miljø.

- Opret en AWS Lambda funktion til at offentliggøre SageMaker-slutninger til Fiddler.

- Udforsk Fiddlers overvågningsmuligheder i dit Fiddler-prøvemiljø.

Forudsætninger

Dette indlæg forudsætter, at du har konfigureret SageMaker og implementeret et modelslutpunkt. For at lære, hvordan du konfigurerer SageMaker til modelservering, se Implementer modeller til inferens. Nogle eksempler er også tilgængelige på GitHub repo.

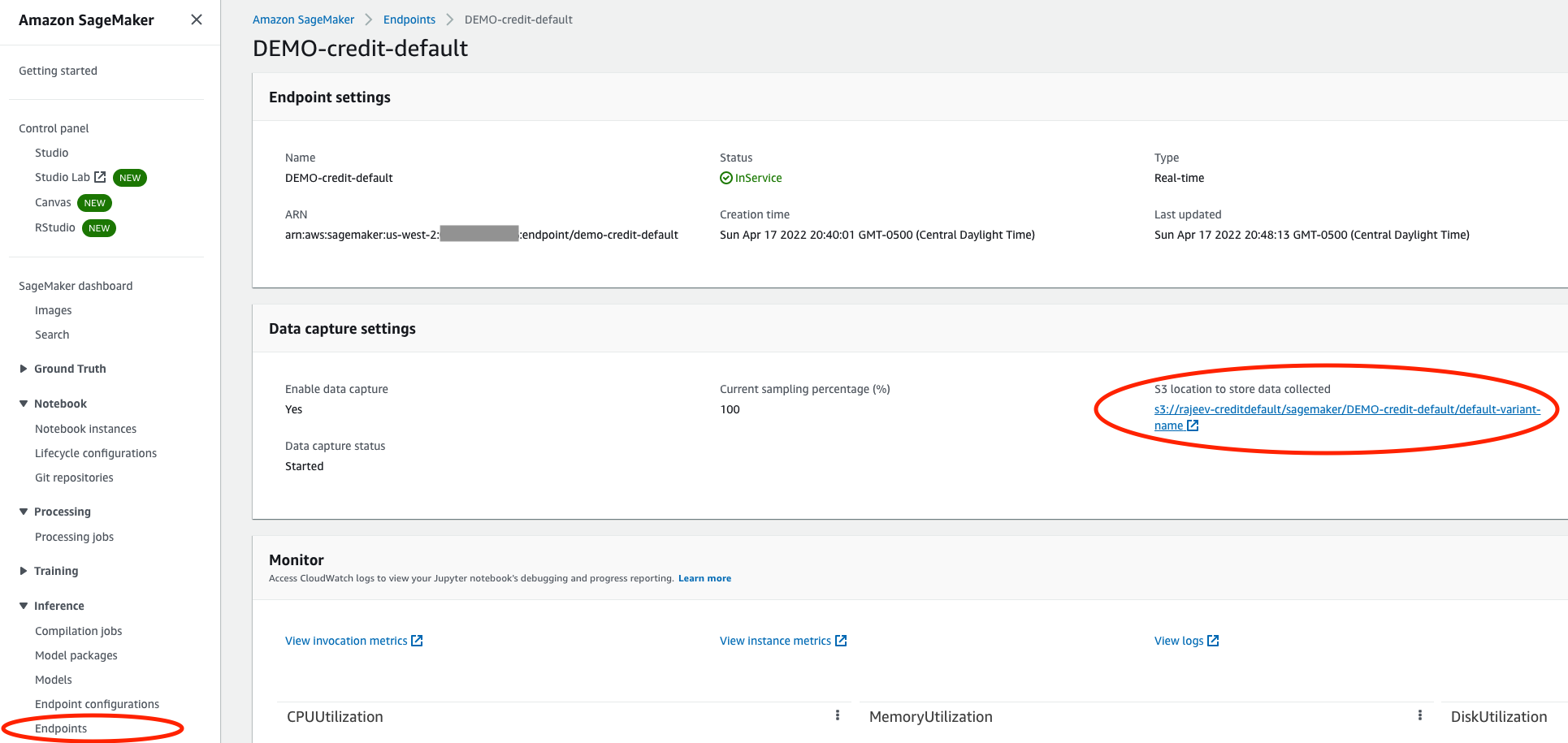

Sørg for, at din model har datafangst aktiveret

På SageMaker-konsollen skal du navigere til din models betjeningsslutpunkt og sikre, at du har aktiveret datafangst ind i en Amazon Simple Storage Service (Amazon S3) spand. Dette gemmer de slutninger (anmodninger og svar), din model gør hver dag som JSON linjer filer (.jsonl) i Amazon S3.

Opret et Fiddler-prøvemiljø

På hjemmesiden for oprettelse af en konto skal du indtaste postnummeret for dit service-eller faktureringsområde i feltet, der er markeret (A) på billedet ovenfor. spillemand.ai hjemmeside, kan du anmode om en gratis prøveperiode. Efter at have udfyldt en hurtig formular, vil Fiddler kontakte dig for at forstå de specifikke behov for din modelpræstationsstyring og vil have et prøvemiljø klar til dig om et par timer. Du kan forvente et dedikeret miljø som https://yourcompany.try.fiddler.ai.

Registrer oplysninger om din model i dit Fiddler-miljø

Før du kan begynde at udgive begivenheder fra din SageMaker-hostede model i Fiddler, skal du oprette et projekt i dit Fiddler-prøvemiljø og give Fiddler-oplysninger om din model gennem et trin kaldet modelregistrering. Hvis du vil bruge en forudkonfigureret notesbog indefra Amazon SageMaker Studio i stedet for at kopiere og indsætte følgende kodestykker, kan du referere til Fiddler quickstart notesbogen på GitHub. Studio tilbyder en enkelt webbaseret visuel grænseflade, hvor du kan udføre alle ML-udviklingstrin.

Først skal du installere Fiddler Python klient i din SageMaker-notesbog, og instantiér Fiddler-klienten. Du kan få AUTH_TOKEN fra Indstillinger side i dit Fiddler-prøvemiljø.

Opret derefter et projekt i dit Fiddler-prøvemiljø:

Upload nu dit træningsdatasæt. Notesbogen indeholder også et eksempeldatasæt til at køre Fiddler's forklarlighed algoritmer og som baseline for overvågning af metrikker. Datasættet bruges også til at generere skemaet for denne model i Fiddler.

Til sidst, før du kan begynde at udgive slutninger til Fiddler til overvågning, rodårsagsanalyse og forklaringer, skal du registrere din model. Lad os først oprette en model_info objekt, der indeholder metadata om din model:

Så kan du registrere modellen med din nye model_info objekt:

Store! Nu kan du udgive nogle begivenheder til Fiddler for at observere modellens ydeevne.

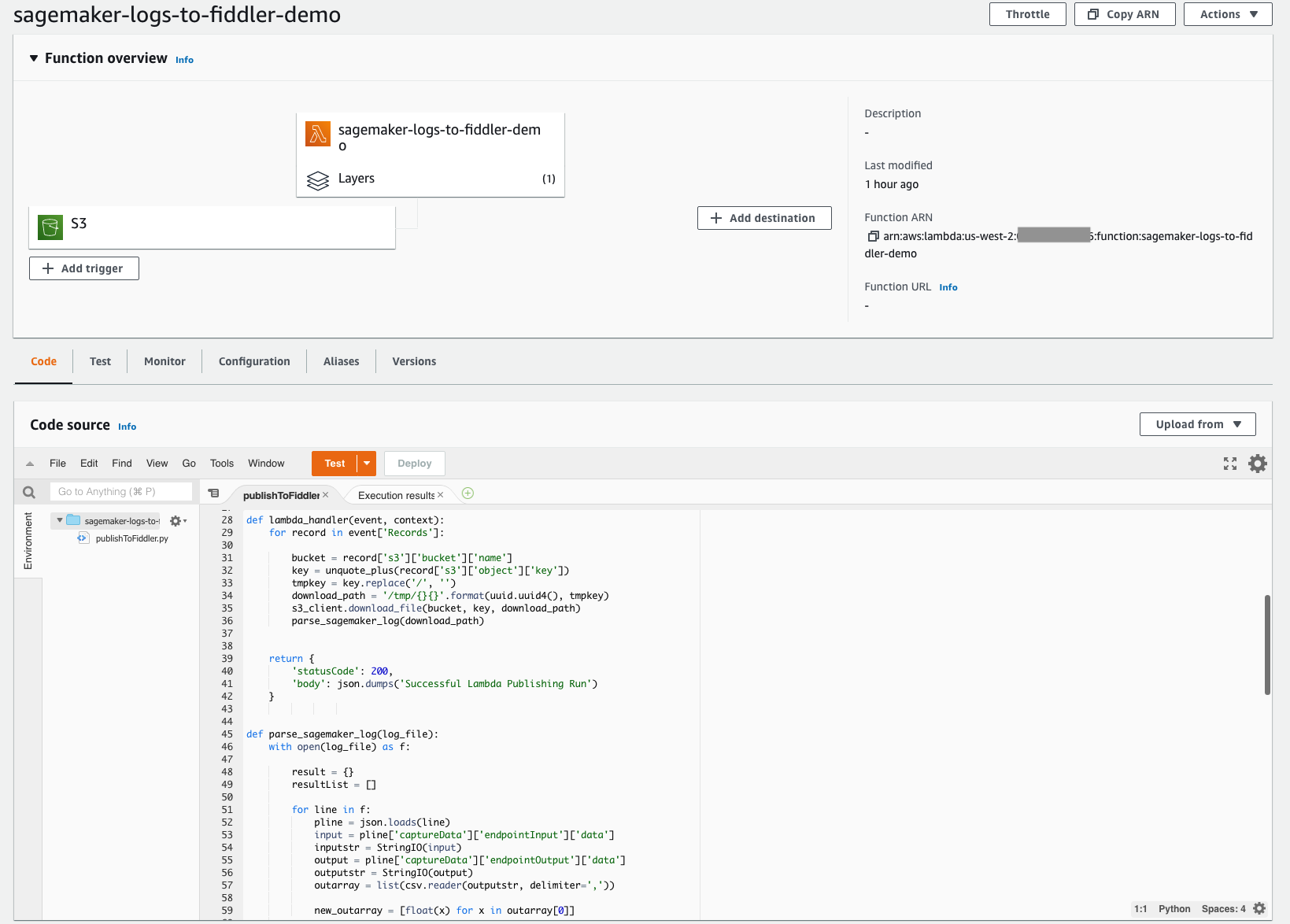

Opret en Lambda-funktion til at publicere SageMaker-slutninger til Fiddler

Med Lambdas serverløse arkitektur, der er nem at implementere, kan du hurtigt bygge den mekanisme, der kræves for at flytte dine konklusioner fra den S3-bøtte, du satte op tidligere, til dit nyligt klargjorte Fiddler-prøvemiljø. Denne Lambda-funktion er ansvarlig for at åbne eventuelle nye JSONL-hændelseslogfiler i din models S3-bøtte, parse og formatere JSONL-indholdet til en dataramme og derefter udgive denne dataramme med hændelser til dit Fiddler-prøvemiljø. Følgende skærmbillede viser kodedetaljerne for vores funktion.

Lambda-funktionen skal konfigureres til at udløse nyoprettede filer i din S3-bøtte. Det følgende tutorial guider dig gennem oprettelse af en Amazon Eventbridge trigger, der aktiverer Lambda-funktionen, når en fil uploades til Amazon S3. Følgende skærmbillede viser vores funktions trigger-konfiguration. Dette gør det nemt at sikre, at hver gang din model foretager nye slutninger, indlæses de hændelser, der er gemt i Amazon S3, i Fiddler for at skabe den modelobservabilitet, din virksomhed har brug for.

For at forenkle dette yderligere er koden til denne Lambda-funktion offentligt tilgængelig fra Spillemands dokumentationsside. Dette kodeeksempel fungerer i øjeblikket for binære klassifikationsmodeller med strukturerede input. Hvis du har modeltyper med forskellige funktioner eller opgaver, bedes du kontakte Fiddler for at få hjælp til mindre ændringer af koden.

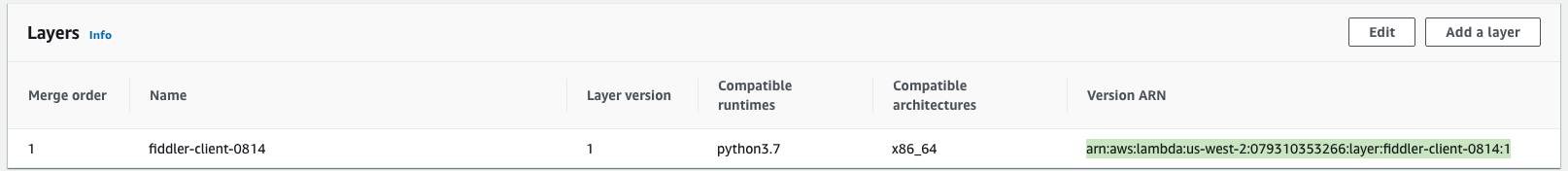

Lambda-funktionen skal henvise til Fiddler Python-klienten. Fiddler har lavet et offentligt tilgængeligt Lambda-lag, som du kan henvise til for at sikre, at import fiddler as fdl step fungerer problemfrit. Du kan referere til dette lag via et ARN i us-west-2-regionen: arn:aws:lambda:us-west-2:079310353266:layer:fiddler-client-0814:1, som vist i følgende skærmbillede.

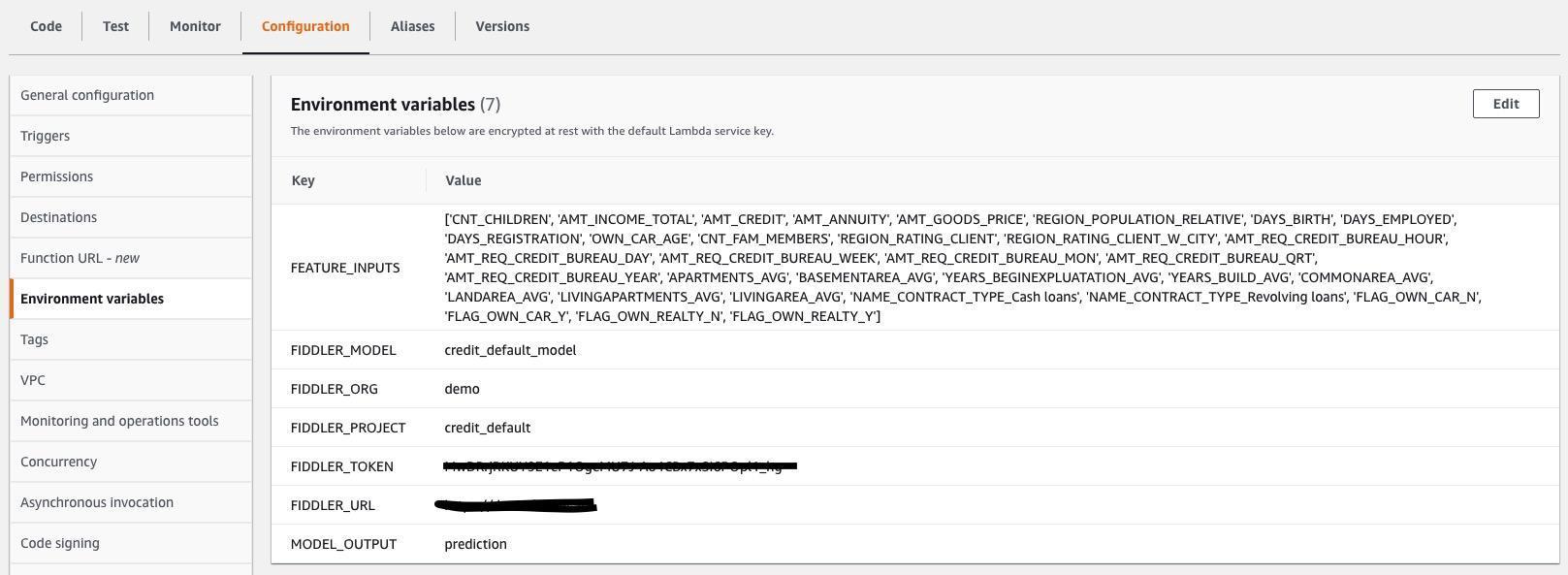

Du skal også angive Lambda-miljøvariabler, så Lambda-funktionen ved, hvordan man forbinder til dit Fiddler-prøvemiljø, og hvad input og output er inden for de .jsonl-filer, der fanges af din model. Følgende skærmbillede viser en liste over de nødvendige miljøvariabler, som også er aktiveret Spillemands dokumentationsside. Opdater værdierne for miljøvariablerne, så de matcher din model og dit datasæt.

Udforsk Fiddlers overvågningsmuligheder i dit Fiddler-prøvemiljø

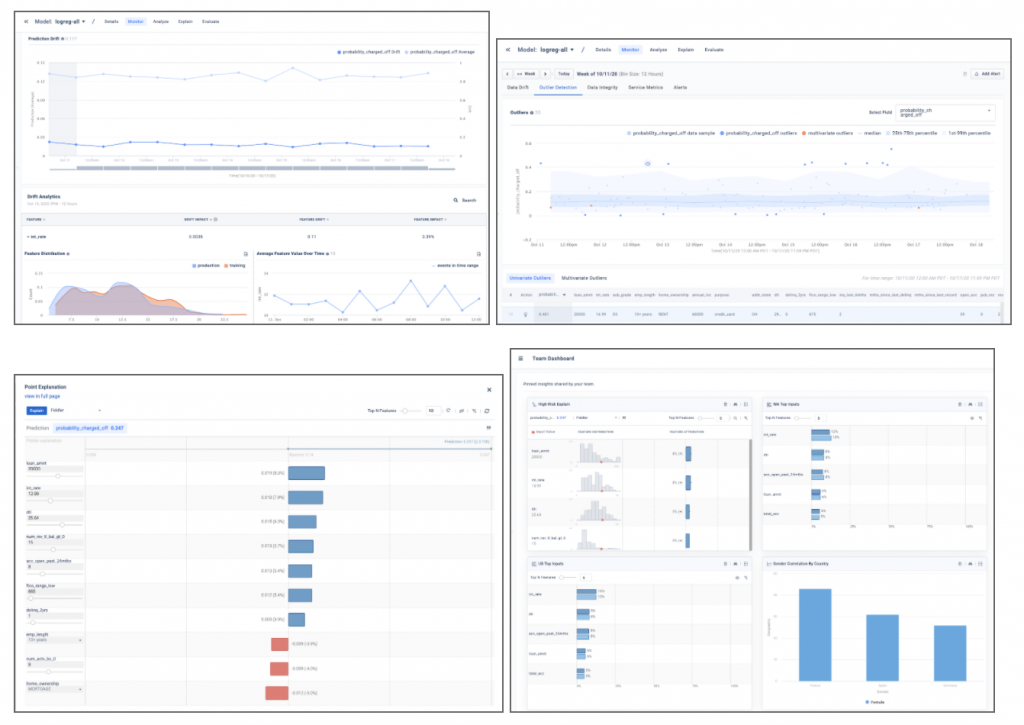

Du har gjort det! Med din baseline data, model og trafik forbundet, kan du nu forklare datadrift, afvigere, model bias, dataproblemer og ydeevneblips, og del dashboards med andre. Fuldfør din rejse ved ser en demo om de modelpræstationsstyringsevner, du har introduceret til din virksomhed.

Eksempelskærmbillederne nedenfor giver et glimt af modelindsigter som drift, afvigende detektering, lokale punktforklaringer og modelanalyse, der vil blive fundet i dit Fiddler-prøvemiljø.

Konklusion

Dette indlæg fremhævede behovet for virksomhedsklasse modelovervågning og viste, hvordan du kan integrere dine modeller implementeret i SageMaker med Fiddler Model Performance Management Platform på få trin. Fiddler tilbyder funktionalitet til modelovervågning, forklarlig AI, bias-detektion og rodårsagsanalyse og er tilgængelig på AWS Marketplace. Ved at give din MLOps team med en letanvendelig enkelt rude for at sikre, at dine modeller opfører sig som forventet og for at identificere de underliggende årsager til ydeevneforringelse, kan Fiddler hjælpe med at forbedre dataforskernes produktivitet og reducere tiden til at opdage og løse problemer.

Hvis du gerne vil vide mere om Fiddler, så besøg venligst spillemand.ai eller hvis du foretrækker at oprette en personlig demo og teknisk diskussions-e-mail sales@fiddler.ai.

Om forfatterne

Danny Brock er Sr Solutions Engineer hos Fiddler AI. Danny har længe været ansat i analyse- og ML-området og kører presales og post-sales teams for startups som Endeca og Incorta. Han grundlagde sit eget big data analytics konsulentfirma, Branchbird, i 2012.

Danny Brock er Sr Solutions Engineer hos Fiddler AI. Danny har længe været ansat i analyse- og ML-området og kører presales og post-sales teams for startups som Endeca og Incorta. Han grundlagde sit eget big data analytics konsulentfirma, Branchbird, i 2012.

Rajeev Govindan er Sr Solutions Engineer hos Fiddler AI. Rajeev har stor erfaring med salgsteknik og softwareudvikling hos flere virksomhedsvirksomheder, herunder AppDynamics.

Rajeev Govindan er Sr Solutions Engineer hos Fiddler AI. Rajeev har stor erfaring med salgsteknik og softwareudvikling hos flere virksomhedsvirksomheder, herunder AppDynamics.

Krishnaram Kenthapadi er chefforsker for Fiddler AI. Tidligere var han Principal Scientist hos Amazon AWS AI, hvor han ledede initiativerne for retfærdighed, forklaring, privatliv og modelforståelse i Amazon AI-platformen, og før det havde han roller hos LinkedIn AI og Microsoft Research. Krishnaram modtog sin ph.d. i datalogi fra Stanford University i 2006.

Krishnaram Kenthapadi er chefforsker for Fiddler AI. Tidligere var han Principal Scientist hos Amazon AWS AI, hvor han ledede initiativerne for retfærdighed, forklaring, privatliv og modelforståelse i Amazon AI-platformen, og før det havde han roller hos LinkedIn AI og Microsoft Research. Krishnaram modtog sin ph.d. i datalogi fra Stanford University i 2006.

- AI

- ai kunst

- ai kunst generator

- en robot

- Amazon SageMaker

- kunstig intelligens

- certificering af kunstig intelligens

- kunstig intelligens i banksektoren

- kunstig intelligens robot

- kunstig intelligens robotter

- software til kunstig intelligens

- AWS maskinindlæring

- AWS Marketplace

- blockchain

- blockchain konference ai

- coingenius

- samtale kunstig intelligens

- kryptokonference ai

- dalls

- dyb læring

- du har google

- machine learning

- plato

- platon ai

- Platon Data Intelligence

- Platon spil

- PlatoData

- platogaming

- skala ai

- syntaks

- zephyrnet