I 2021 lancerede vi AWS Support Proactive Services som en del af AWS Enterprise Support plan. Siden introduktionen har vi hjulpet hundredvis af kunder med at optimere deres arbejdsbelastninger, sætte autoværn og forbedre synligheden af deres maskinlærings (ML) arbejdsbelastningers omkostninger og brug.

I denne serie af indlæg deler vi erfaringer om optimering af omkostninger i Amazon SageMaker. I del 1, viste vi, hvordan du kommer i gang med at bruge AWS Cost Explorer at identificere omkostningsoptimeringsmuligheder i SageMaker. I dette indlæg fokuserer vi på SageMaker-inferensmiljøer: realtidsinferens, batchtransformation, asynkron inferens og serverløs inferens.

SageMaker tilbyder flere slutningsmuligheder for dig at vælge imellem baseret på dine krav til arbejdsbelastning:

- Realtidsslutning til online, lav latenstid eller høje gennemløbskrav

- Batch transformation til offline, planlagt behandling og når du ikke har brug for et vedvarende slutpunkt

- Asynkron inferens til når du har store nyttelaster med lange behandlingstider og ønsker at stille anmodninger i kø

- Serverløs slutning til når du har periodiske eller uforudsigelige trafikmønstre og kan tåle koldstart

I de følgende afsnit diskuterer vi hver slutningsmulighed mere detaljeret.

SageMaker inferens i realtid

Når du opretter et slutpunkt, vedhæfter SageMaker en Amazon Elastic Block Store (Amazon EBS) lagervolumen til Amazon Elastic Compute Cloud (Amazon EC2) forekomst, der er vært for slutpunktet. Dette gælder for alle instanstyper, der ikke kommer med et SSD-lager. Fordi d*-instanstyperne kommer med et NVMe SSD-lager, knytter SageMaker ikke en EBS-lagervolumen til disse ML-beregningsinstanser. Henvise til Værtsforekomstens lagervolumener for størrelsen af de lagervolumener, som SageMaker tilknytter for hver instanstype for et enkelt slutpunkt og for et multimodelslutpunkt.

Omkostningerne til SageMaker real-time endpoints er baseret på den forbrugte instanstime for hver instans, mens endepunktet kører, prisen på GB-måneds klargjort lagerplads (EBS-volumen) samt GB-data behandlet ind og ud af endepunktsforekomsten, som skitseret i Amazon SageMaker-priser. I Cost Explorer kan du se slutpunktomkostninger i realtid ved at anvende et filter på brugstypen. Navnene på disse brugstyper er struktureret som følger:

REGION-Host:instanceType(for eksempel,USE1-Host:ml.c5.9xlarge)REGION-Host:VolumeUsage.gp2(for eksempel,USE1-Host:VolumeUsage.gp2)REGION-Hst:Data-Bytes-Out(for eksempel,USE2-Hst:Data-Bytes-In)REGION-Hst:Data-Bytes-Out(for eksempel,USW2-Hst:Data-Bytes-Out)

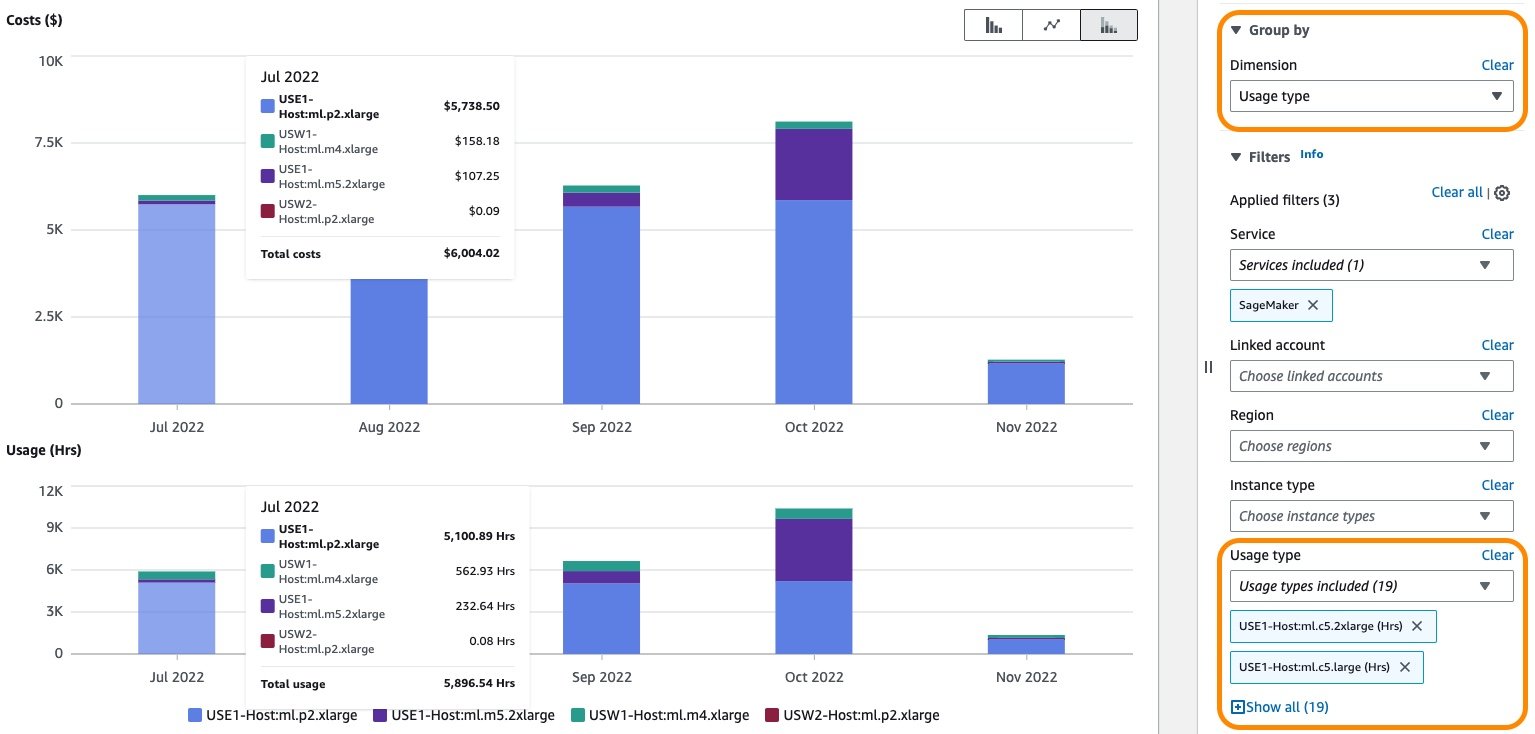

Som vist på det følgende skærmbillede, filtrering efter brugstype Host: vil vise en liste over hostingbrugstyper i realtid på en konto.

Du kan enten vælge specifikke brugstyper eller vælge Marker alt Og vælg Indløs for at vise omkostningsfordelingen af SageMaker real-time hostingbrug. For at se pris- og forbrugsopdelingen efter forekomsttimer skal du fravælge alle REGION-Host:VolumeUsage.gp2 brugstyper, før du anvender filteret for brugstype. Du kan også anvende yderligere filtre såsom kontonummer, EC2-instanstype, omkostningsfordelingstag, region og mere. Følgende skærmbillede viser pris- og brugsgrafer for de valgte hostingbrugstyper.

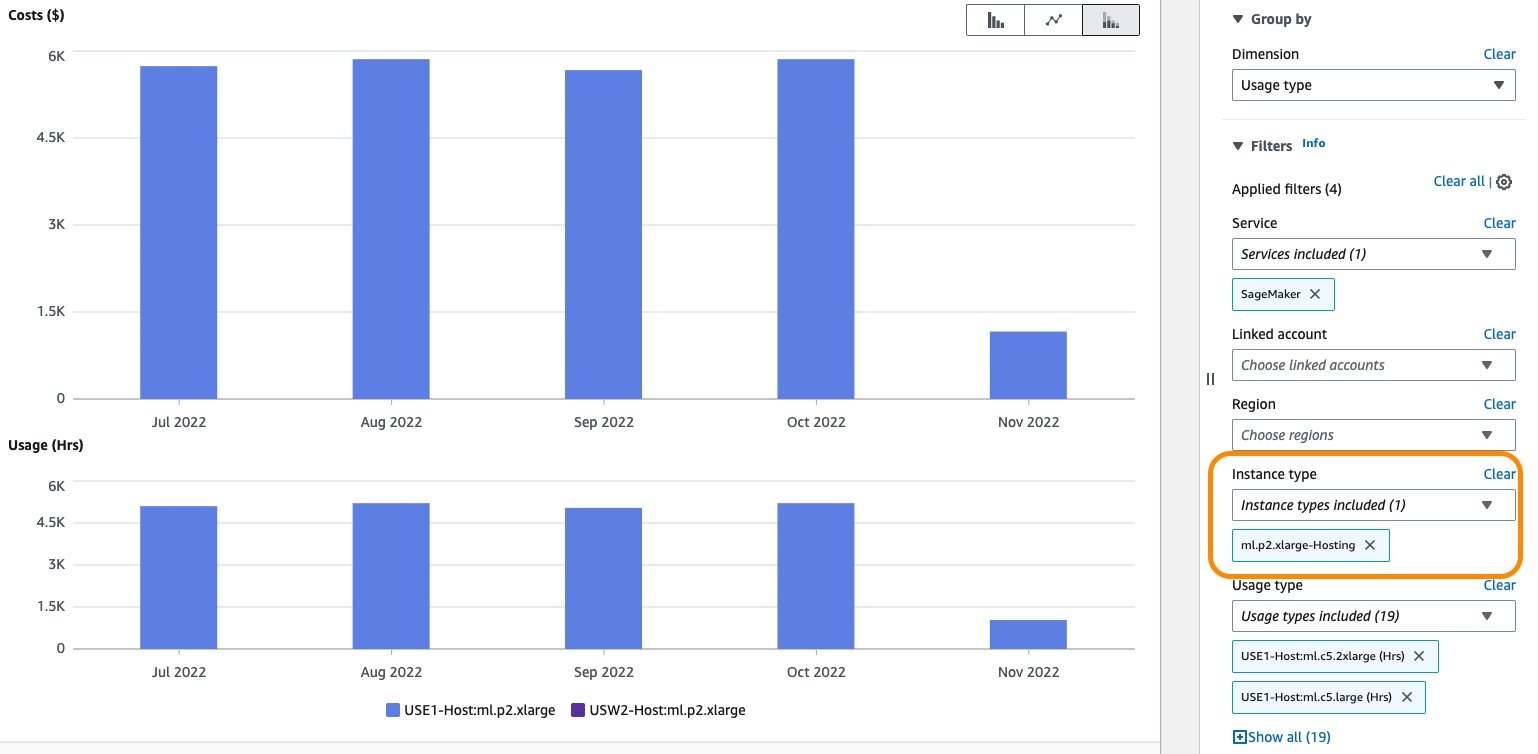

Derudover kan du undersøge omkostningerne forbundet med en eller flere hostingforekomster ved at bruge Forekomsttype filter. Følgende skærmbillede viser pris- og forbrugsopdeling for hostingforekomst ml.p2.xlarge.

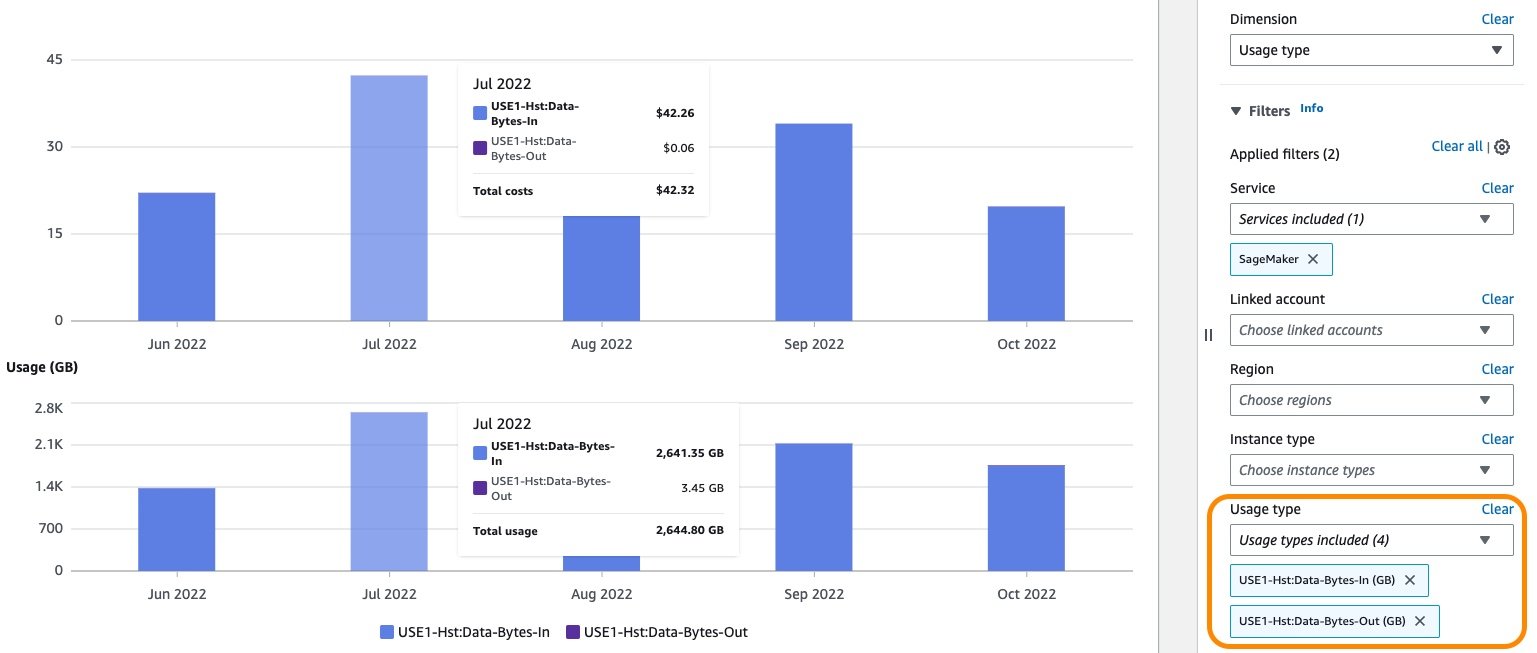

Tilsvarende kan omkostningerne for GB-data behandlet ind og udbearbejdes vises ved at vælge de tilknyttede brugstyper som et anvendt filter, som vist på det følgende skærmbillede.

Når du har opnået dine ønskede resultater med filtre og grupperinger, kan du enten downloade dine resultater ved at vælge Download som CSV eller gem rapporten ved at vælge Gem til rapportbibliotek. For generel vejledning om brug af Cost Explorer, se AWS Cost Explorers nye udseende og almindelige brugssager.

Du kan eventuelt aktivere AWS omkostnings- og brugsrapporter (AWS CUR) for at få indsigt i omkostninger og brugsdata for dine konti. AWS CUR indeholder oplysninger om AWS-forbrug pr. time. Det er gemt i Amazon Simple Storage Service (Amazon S3) på betalerkontoen, som konsoliderer data for alle de sammenkædede konti. Du kan køre forespørgsler for at analysere tendenser i dit forbrug og træffe passende foranstaltninger for at optimere omkostningerne. Amazonas Athena er en serverløs forespørgselstjeneste, som du kan bruge til at analysere dataene fra AWS CUR i Amazon S3 ved hjælp af standard SQL. Mere information og eksempler på forespørgsler kan findes i AWS CUR-forespørgselsbibliotek.

Du kan også indlæse AWS CUR-data Amazon QuickSight, hvor du kan skære og skære den, som du vil, til rapportering eller visualiseringsformål. For instruktioner, se Hvordan indtager og visualiserer jeg AWS Cost and Usage Report (CUR) i Amazon QuickSight.

Du kan få oplysninger på ressourceniveau, såsom slutpunkt ARN, slutpunktforekomsttyper, timepris for forekomster, daglige brugstimer og mere fra AWS CUR. Du kan også inkludere omkostningsfordelingstags i din forespørgsel for et ekstra granularitetsniveau. Følgende eksempelforespørgsel returnerer hostingressourceforbrug i realtid i de sidste 3 måneder for den givne betalerkonto:

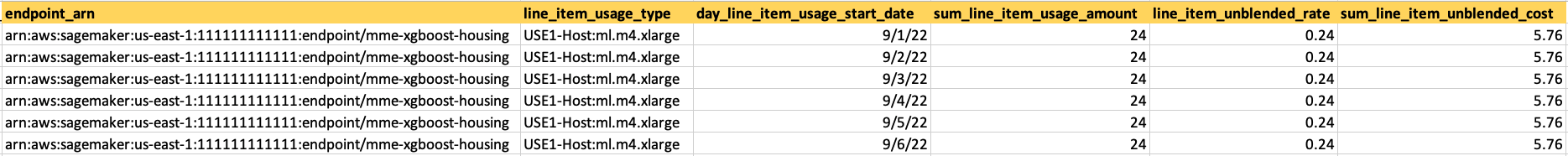

Følgende skærmbillede viser resultaterne opnået ved at køre forespørgslen ved hjælp af Athena. For mere information, se Forespørgsel på omkostnings- og brugsrapporter ved hjælp af Amazon Athena.

Resultatet af forespørgslen viser dette slutpunkt mme-xgboost-housing med ml.x4.xlarge-forekomsten rapporterer 24 timers runtime i flere på hinanden følgende dage. Forekomstprisen er $0.24/time, og den daglige pris for at køre i 24 timer er $5.76.

AWS CUR-resultater kan hjælpe dig med at identificere mønstre af endepunkter, der kører i på hinanden følgende dage i hver af de linkede konti, såvel som endepunkter med de højeste månedlige omkostninger. Dette kan også hjælpe dig med at beslutte, om endepunkterne i ikke-produktionskonti kan slettes for at spare omkostninger.

Optimer omkostningerne til slutpunkter i realtid

Fra et omkostningsstyringsperspektiv er det vigtigt at identificere underudnyttede (eller overdimensionerede) forekomster og bringe forekomststørrelsen og -antallet, hvis det er nødvendigt, i overensstemmelse med kravene til arbejdsbelastning. Almindelige systemmålinger som CPU/GPU-udnyttelse og hukommelsesudnyttelse skrives til amazoncloudwatch for alle hosting-instanser. For endepunkter i realtid gør SageMaker flere ekstra metrics tilgængelige i CloudWatch. Nogle af de almindeligt overvågede metrics inkluderer kaldtællinger og kald 4xx/5xx fejl. Se en komplet liste over målinger Overvåg Amazon SageMaker med Amazon CloudWatch.

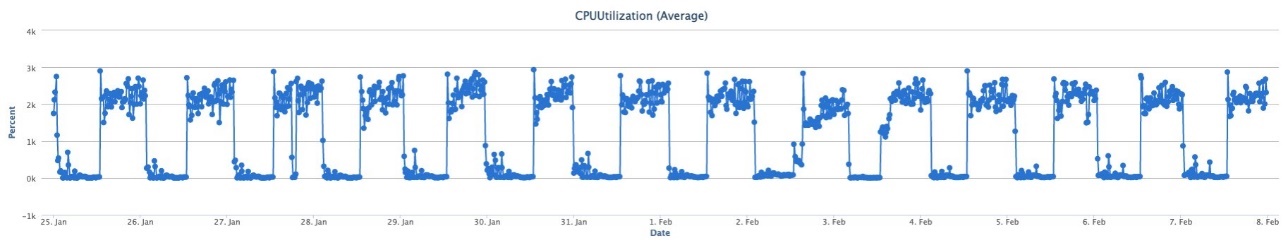

Metrikken CPUUtilization giver summen af hver enkelt CPU-kernes udnyttelse. CPU-udnyttelsen af hvert kerneområde er 0-100. For eksempel, hvis der er fire CPU'er, CPUUtilization interval er 0-400 %. Metrikken MemoryUtilization er den procentdel af hukommelse, der bruges af containerne på en instans. Dette værdiområde er 0–100 %. Følgende skærmbillede viser et eksempel på CloudWatch-målinger CPUUtilization , MemoryUtilization for en slutpunktsinstans ml.m4.10xlarge, der kommer med 40 vCPU'er og 160 GiB hukommelse.

Disse metriske grafer viser maksimal CPU-udnyttelse på cirka 3,000 %, hvilket svarer til 30 vCPU'er. Det betyder, at dette endepunkt ikke bruger mere end 30 vCPU'er ud af den samlede kapacitet på 40 vCPU'er. Tilsvarende er hukommelsesudnyttelsen under 6%. Ved at bruge disse oplysninger kan du eventuelt eksperimentere med en mindre instans, der kan matche dette ressourcebehov. Desuden CPUUtilization metric viser et klassisk mønster af periodisk høj og lav CPU-efterspørgsel, hvilket gør dette endepunkt til en god kandidat til automatisk skalering. Du kan starte med en mindre forekomst og skalere ud først, efterhånden som din computerefterspørgsel ændrer sig. For information, se Skaler automatisk Amazon SageMaker-modeller.

SageMaker er fantastisk til at teste nye modeller, fordi du nemt kan implementere dem i et A/B-testmiljø ved hjælp af produktionsvarianter, og du betaler kun for det, du bruger. Hver produktionsvariant kører på sin egen computerforekomst, og du debiteres pr. forekomst-time, der forbruges for hver forekomst, mens varianten kører.

SageMaker understøtter også skyggevarianter, som har de samme komponenter som en produktionsvariant og kører på deres egen computerforekomst. Med skyggevarianter implementerer SageMaker automatisk modellen i et testmiljø, dirigerer en kopi af de slutningsanmodninger, som produktionsmodellen har modtaget, til testmodellen i realtid og indsamler ydeevnemålinger såsom latens og gennemløb. Dette giver dig mulighed for at validere enhver ny kandidatkomponent i din modelserveringsstabel, før den promoveres til produktion.

Når du er færdig med dine tests og ikke bruger slutpunktet eller varianterne i vid udstrækning længere, bør du slette det for at spare omkostninger. Fordi modellen er gemt i Amazon S3, kan du genskabe den efter behov. Du kan automatisk registrere disse endepunkter og foretage korrigerende handlinger (såsom at slette dem) ved at bruge Amazon CloudWatch-begivenheder , AWS Lambda funktioner. Du kan f.eks. bruge Invocations metrisk for at få det samlede antal anmodninger sendt til et modelendepunkt og derefter registrere, om slutpunkterne har været inaktive i det seneste antal timer (uden påkald over en bestemt periode, f.eks. 24 timer).

Hvis du har flere underudnyttede slutpunktsinstanser, skal du overveje hostingmuligheder som f.eks multi-model slutpunkter (MME'er), multi-container endepunkter (MCE'er), og serielle inferensrørledninger for at konsolidere brugen til færre endpoint-forekomster.

Til realtids- og asynkron inferensmodelimplementering kan du optimere omkostninger og ydeevne ved at implementere modeller på SageMaker vha. AWS Graviton. AWS Graviton er en familie af processorer designet af AWS, der giver den bedste prisydelse og er mere energieffektive end deres x86-modstykker. For vejledning om implementering af en ML-model til AWS Graviton-baserede forekomster og detaljer om prisydelsesfordelen, se Kør maskinlæringsindledningsarbejdsbelastninger på AWS Graviton-baserede instanser med Amazon SageMaker. SageMaker understøtter også AWS-inferens acceleratorer gennem ml.inf2 familie af instanser til implementering af ML-modeller til realtid og asynkron inferens. Du kan bruge disse forekomster på SageMaker til at opnå høj ydeevne til en lav pris for generativ kunstig intelligens (AI) modeller, herunder store sprogmodeller (LLM'er) og vision transformere.

Derudover kan du bruge Amazon SageMaker Inference Recommender at køre belastningstests og evaluere fordelene ved at implementere din model i disse tilfælde. For yderligere vejledning om automatisk detektering af ledige SageMaker-endepunkter, samt instanshøjre størrelse og automatisk skalering for SageMaker-slutpunkter, henvises til Sørg for effektive computerressourcer på Amazon SageMaker.

SageMaker batch transformation

Batch-inferens, eller offline slutning, er processen med at generere forudsigelser på en batch af observationer. Offline forudsigelser er velegnede til større datasæt og i tilfælde, hvor du har råd til at vente flere minutter eller timer på et svar.

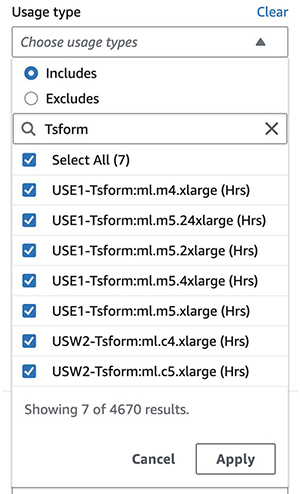

Prisen for SageMaker batchtransformation er baseret på den forbrugte instanstime for hver instans, mens batchtransformationsjobbet kører, som beskrevet i Amazon SageMaker-priser. I Cost Explorer kan du udforske batchtransformationsomkostninger ved at anvende et filter på brugstypen. Navnet på denne brugstype er struktureret som REGION-Tsform:instanceType (for eksempel, USE1-Tsform:ml.c5.9xlarge).

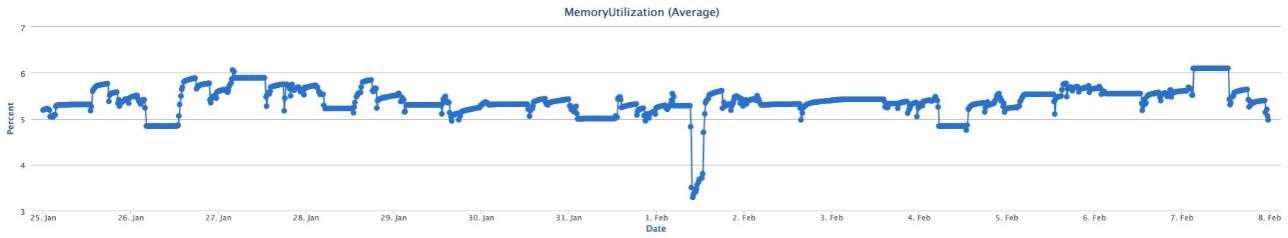

Som vist i det følgende skærmbillede, filtrering efter brugstype Tsform: vil vise en liste over SageMaker batch transform brugstyper på en konto.

Du kan enten vælge specifikke brugstyper eller vælge Marker alt Og vælg Indløs for at vise omkostningsopdelingen af brug af batchtransformationsinstanser for de valgte typer. Som tidligere nævnt kan du også anvende yderligere filtre. Følgende skærmbillede viser omkostnings- og brugsgrafer for de valgte batchtransformationsbrugstyper.

Optimer omkostningerne til batchtransformation

SageMaker batchtransformation opkræver dig kun for de forekomster, der bruges, mens dine job kører. Hvis dine data allerede er i Amazon S3, er der ingen omkostninger for at læse inputdata fra Amazon S3 og skrive outputdata til Amazon S3. Alle outputobjekter er forsøgt uploadet til Amazon S3. Hvis alt lykkes, markeres batchtransformationsjobbet som afsluttet. Hvis et eller flere objekter fejler, markeres batchtransformationsjobbet som mislykket.

Gebyrer for batchtransformationsjob gælder i følgende scenarier:

- Jobbet er vellykket

- Svigt pga

ClientErrorog modelbeholderen er SageMaker eller en SageMaker-styret ramme - Svigt pga

AlgorithmErrororClientErrorog modelbeholderen er din egen tilpassede beholder (BYOC)

Følgende er nogle af de bedste fremgangsmåder til at optimere et SageMaker batch-transformationsjob. Disse anbefalinger kan reducere den samlede køretid for dit batchtransformationsjob og derved sænke omkostningerne:

- sæt Batchstrategi til

MultiRecord,SplitTypetilLinehvis du har brug for batchtransformationsjobbet for at lave minibatches fra inputfilen. Hvis det ikke automatisk kan opdele datasættet i minibatches, kan du opdele det i minibatches ved at lægge hver batch i en separat inputfil, placeret i datakildens S3-bøtte. - Sørg for, at batchstørrelsen passer ind i hukommelsen. SageMaker håndterer normalt dette automatisk; Men når batches opdeles manuelt, skal dette justeres baseret på hukommelsen.

- Batchtransformation opdeler S3-objekterne i input med nøgle og kortlægger disse objekter til instanser. Når du har flere filer, kan én instans behandle

input1.csv, og en anden instans kan behandleinput2.csv. Hvis du har én inputfil, men initialiserer flere computerforekomster, behandler kun én forekomst inputfilen, og resten af forekomsterne er inaktive. Sørg for, at antallet af filer er lig med eller større end antallet af forekomster. - Hvis du har et stort antal små filer, kan det være en fordel at kombinere flere filer til et lille antal større filer for at reducere Amazon S3-interaktionstiden.

- Hvis du bruger Opret TransformJob API kan du reducere den tid, det tager at fuldføre batchtransformationsjob ved at bruge optimale værdier for parametre som f.eks MaxPayloadInMB, MaxConcurrentTransforms eller Batchstrategi:

MaxConcurrentTransformsangiver det maksimale antal parallelle anmodninger, der kan sendes til hver instans i et transformationsjob. Den ideelle værdi forMaxConcurrentTransformser lig med antallet af vCPU-kerner i en instans.MaxPayloadInMBer den maksimalt tilladte størrelse af nyttelasten i MB. Værdien iMaxPayloadInMBskal være større end eller lig med størrelsen af en enkelt post. For at estimere størrelsen af en post i MB skal du dividere størrelsen af dit datasæt med antallet af poster. For at sikre, at posterne passer inden for den maksimale nyttelaststørrelse, anbefaler vi at bruge en lidt større værdi. Standardværdien er 6 MB.MaxPayloadInMBmå ikke være større end 100 MB. Hvis du angiver den valgfrieMaxConcurrentTransformsparameter, derefter værdien af (MaxConcurrentTransforms*MaxPayloadInMB) må heller ikke overstige 100 MB.- I tilfælde, hvor nyttelasten kan være vilkårligt stor og transmitteres ved hjælp af HTTP-chunk-kodning, skal du indstille MaxPayloadInMB-værdien til 0. Denne funktion virker kun i understøttede algoritmer. I øjeblikket understøtter SageMaker indbyggede algoritmer ikke HTTP-chunked-kodning.

- Batch-inferensopgaver er normalt gode kandidater til horisontal skalering. Hver medarbejder i en klynge kan arbejde på en anden delmængde af data uden behov for at udveksle information med andre arbejdere. AWS tilbyder flere lagrings- og beregningsmuligheder, der muliggør horisontal skalering. Hvis en enkelt instans ikke er tilstrækkelig til at opfylde dine præstationskrav, kan du overveje at bruge flere instanser parallelt for at fordele arbejdsbyrden. For nøgleovervejelser ved arkitektur af batchtransformationsjob henvises til Batch-inferens i skala med Amazon SageMaker.

- Overvåg løbende præstationsmålingerne for dine SageMaker batch-transformationsjob ved hjælp af CloudWatch. Se efter flaskehalse, såsom høj CPU- eller GPU-udnyttelse, hukommelsesbrug eller netværksgennemstrømning, for at afgøre, om du skal justere instansstørrelser eller -konfigurationer.

- SageMaker bruger Amazon S3 multipart upload API at uploade resultater fra et batchtransformationsjob til Amazon S3. Hvis der opstår en fejl, fjernes de uploadede resultater fra Amazon S3. I nogle tilfælde, såsom når der opstår et netværksudfald, kan en ufuldstændig upload af flere dele forblive i Amazon S3. For at undgå at pådrage sig lageromkostninger, anbefaler vi, at du tilføjer S3 skovlpolitik til S3 skovlens livscyklusregler. Denne politik sletter ufuldstændige multipart-uploads, der muligvis er gemt i S3-bøtten. For mere information, se Håndtering af din lagerlivscyklus.

SageMaker asynkron inferens

Asynkron inferens er et godt valg til omkostningsfølsomme arbejdsbelastninger med store nyttelaster og burst-trafik. Forespørgsler kan tage op til 1 time at behandle og have nyttelaststørrelser på op til 1 GB, så det er mere velegnet til arbejdsbelastninger, der har lempede latenskrav.

Påkaldelse af asynkrone endepunkter adskiller sig fra endepunkter i realtid. I stedet for at sende en anmodningsnyttelast synkront med anmodningen, uploader du nyttelasten til Amazon S3 og sender en S3 URI som en del af anmodningen. Internt holder SageMaker en kø med disse anmodninger og behandler dem. Under oprettelse af slutpunkt kan du valgfrit angive en Amazon Simple Notification Service (Amazon SNS) emne for at modtage succes- eller fejlmeddelelser. Når du modtager meddelelsen om, at din slutningsanmodning er blevet behandlet, kan du få adgang til resultatet i output Amazon S3-placeringen.

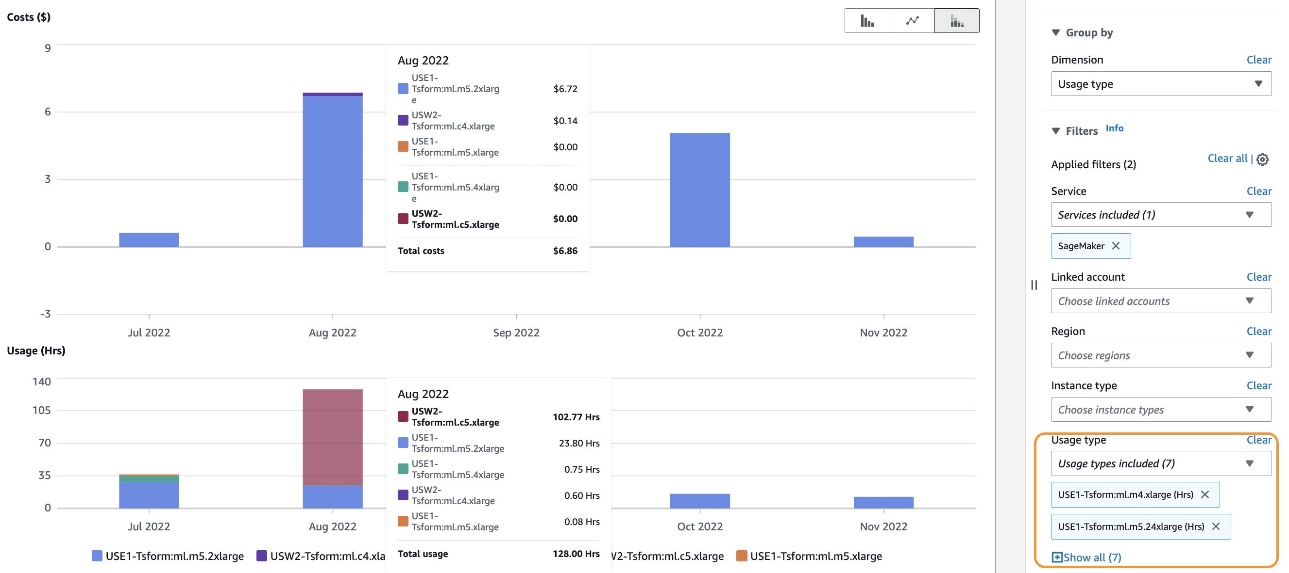

Omkostningerne for asynkron inferens er baseret på den forbrugte instanstime for hver instans, mens endepunktet kører, omkostningerne for GB-måned med klargjort lagerplads samt GB-data behandlet ind og ud af endepunktsforekomsten, som beskrevet i Amazon SageMaker-priser. I Cost Explorer kan du filtrere asynkrone slutningsomkostninger ved at anvende et filter på brugstypen. Navnet på denne brugstype er struktureret som REGION-AsyncInf:instanceType (for eksempel, USE1-AsyncInf:ml.c5.9xlarge). Bemærk, at GB-volumen og GB-databehandlede brugstyper er de samme som endepunkter i realtid, som nævnt tidligere i dette indlæg.

Som vist på det følgende skærmbillede, filtrering efter brugstype AsyncInf: i Cost Explorer viser en omkostningsopdeling efter asynkrone slutpunktbrugstyper.

For at se pris- og forbrugsopdelingen efter forekomsttimer skal du fravælge alle REGION-Host:VolumeUsage.gp2 brugstyper, før du anvender filteret for brugstype. Du kan også anvende yderligere filtre. Oplysninger på ressourceniveau såsom slutpunkt ARN, slutpunktinstanstyper, timeforekomsttakst og daglige brugstimer kan fås fra AWS CUR. Følgende er et eksempel på en AWS CUR-forespørgsel for at opnå asynkron hostingressourceforbrug i de sidste 3 måneder:

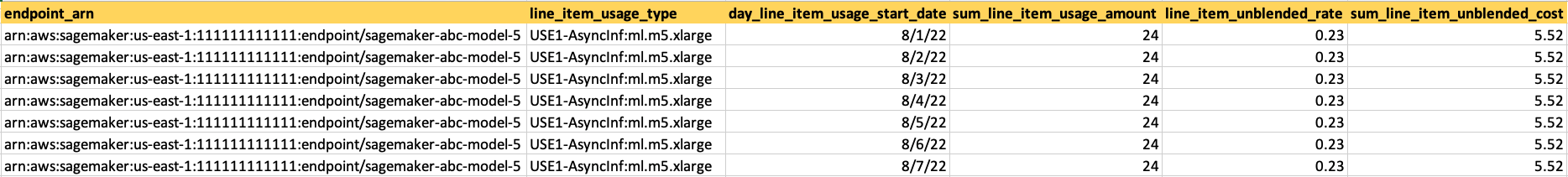

Følgende skærmbillede viser resultaterne opnået ved at køre AWS CUR-forespørgslen ved hjælp af Athena.

Resultatet af forespørgslen viser dette slutpunkt sagemaker-abc-model-5 med ml.m5.xlarge-forekomsten rapporterer 24 timers køretid i flere på hinanden følgende dage. Forekomstprisen er $0.23/time, og den daglige pris for at køre i 24 timer er $5.52.

Som nævnt tidligere kan AWS CUR-resultater hjælpe dig med at identificere mønstre af endepunkter, der kører i på hinanden følgende dage, såvel som endepunkter med de højeste månedlige omkostninger. Dette kan også hjælpe dig med at beslutte, om endepunkterne i ikke-produktionskonti kan slettes for at spare omkostninger.

Optimer omkostningerne til asynkron inferens

Ligesom endepunkterne i realtid er prisen for asynkrone endepunkter baseret på instanstypens brug. Derfor er det vigtigt at identificere underudnyttede forekomster og ændre størrelsen på dem baseret på arbejdsbelastningskravene. For at overvåge asynkrone endepunkter laver SageMaker flere målinger såsom ApproximateBacklogSize, HasBacklogWithoutCapacity, og mere tilgængeligt i CloudWatch. Disse metrics kan vise anmodninger i køen for en instans og kan bruges til automatisk skalering af et slutpunkt. SageMaker asynkron inferens inkluderer også metrics på værtsniveau. For oplysninger om metrics på værtsniveau, se SageMaker Jobs og Endpoint Metrics. Disse metrics kan vise ressourceudnyttelse, der kan hjælpe dig med at tilpasse forekomsten i den rigtige størrelse.

SageMaker understøtter automatisk skalering for asynkrone endepunkter. I modsætning til hostede endepunkter i realtid understøtter asynkrone inferensslutpunkter nedskalering af forekomster til nul ved at indstille minimumskapaciteten til nul. For asynkrone endepunkter anbefaler SageMaker kraftigt, at du opretter en politikkonfiguration til målsporingsskalering for en implementeret model (variant). Du skal definere den skaleringspolitik, der skaleres på ApproximateBacklogPerInstance brugerdefineret metrisk og indstil MinCapacity værdi til nul.

Asynkron inferens giver dig mulighed for at spare på omkostningerne ved automatisk at skalere instansantallet til nul, når der ikke er nogen anmodninger at behandle, så du betaler kun, når dit slutpunkt behandler anmodninger. Forespørgsler, der modtages, når der er nul forekomster, sættes i kø til behandling, efter endtpunktet skaleres op. Derfor, for brugssager, der kan tolerere en koldstartsstraf på et par minutter, kan du valgfrit nedskalere endepunktsforekomstoptællingen til nul, når der ikke er nogen udestående anmodninger, og skalere op igen, når der kommer nye anmodninger. Koldstartstid afhænger af den tid, der kræves for at starte et nyt slutpunkt fra bunden. Også, hvis selve modellen er stor, så kan tiden være længere. Hvis dit job forventes at tage længere tid end 1-times behandlingstid, kan du overveje SageMaker batch transformation.

Derudover kan du også overveje din anmodnings køtid kombineret med behandlingstiden for at vælge instanstypen. For eksempel, hvis din use case kan tolerere timers ventetid, kan du vælge en mindre instans for at spare omkostninger.

For yderligere vejledning om instansstørrelser og automatisk skalering for SageMaker-endepunkter, se Sørg for effektive computerressourcer på Amazon SageMaker.

Serverløs slutning

Serverløs inferens giver dig mulighed for at implementere ML-modeller til inferens uden at skulle konfigurere eller administrere den underliggende infrastruktur. Baseret på mængden af slutningsanmodninger, din model modtager, sørger SageMaker serverløs slutning automatisk for, skalerer og slukker for beregningskapacitet. Som følge heraf betaler du kun for beregningstiden for at køre din slutningskode og mængden af behandlede data, ikke for inaktiv tid. For serverløse endepunkter er instansklargøring ikke nødvendig. Du skal levere hukommelsesstørrelse og maksimal samtidighed. Fordi serverløse endepunkter leverer beregningsressourcer efter behov, kan dit endepunkt opleve et par ekstra sekunders latency (koldstart) for den første påkaldelse efter en inaktiv periode. Du betaler for den beregningskapacitet, der bruges til at behandle slutningsanmodninger, faktureret med millisekund, GB-måned af klargjort lagerplads og mængden af behandlede data. Beregningsafgiften afhænger af den hukommelseskonfiguration, du vælger.

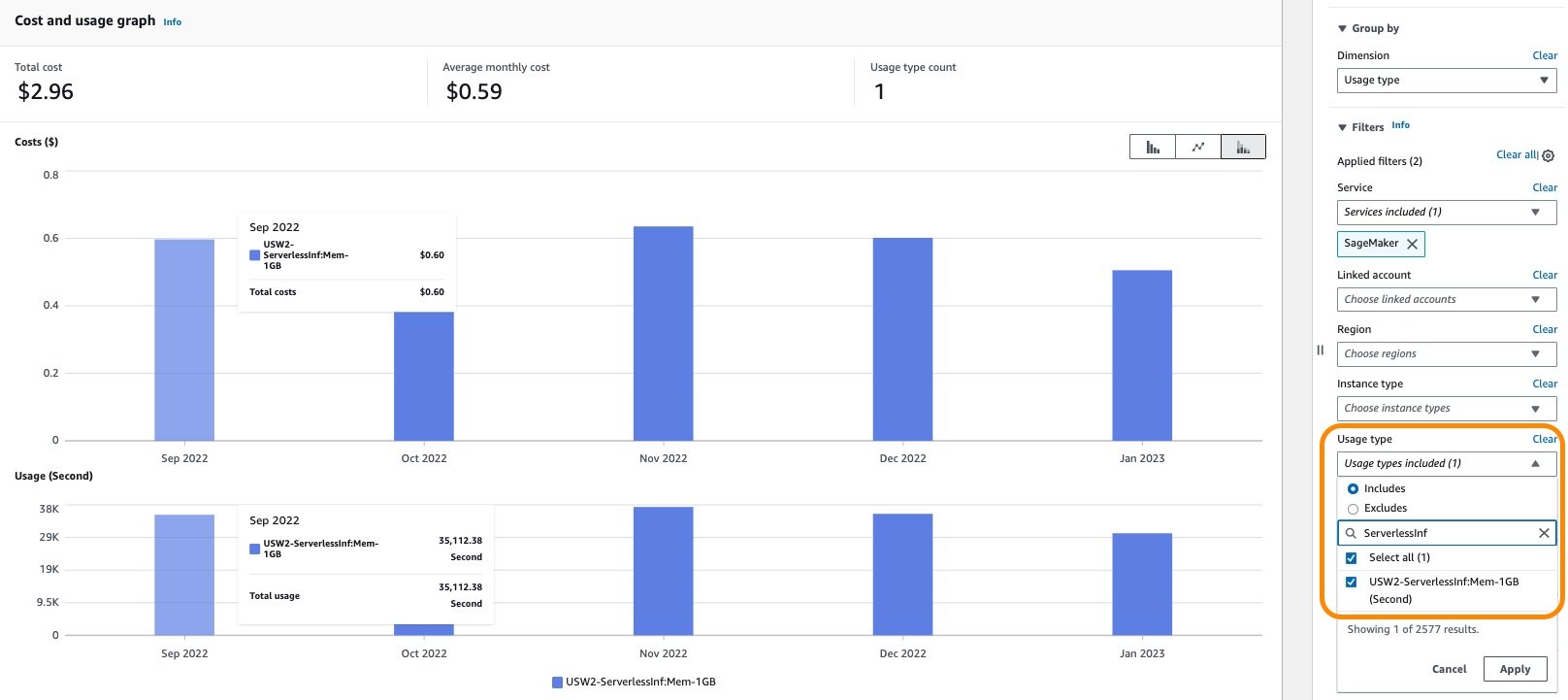

I Cost Explorer kan du filtrere omkostninger til serverløse slutpunkter ved at anvende et filter på brugstypen. Navnet på denne brugstype er struktureret som REGION-ServerlessInf:Mem-MemorySize (for eksempel, USE2-ServerlessInf:Mem-4GB). Bemærk, at GB-volumen og GB-databehandlede brugstyper er de samme som endepunkter i realtid.

Du kan se omkostningsopdelingen ved at anvende yderligere filtre såsom kontonummer, instanstype, region og mere. Følgende skærmbillede viser omkostningsopdelingen ved at anvende filtre for den serverløse inferensbrugstype.

Optimer omkostningerne til serverløs slutning

Når du konfigurerer dit serverløse slutpunkt, kan du angive hukommelsesstørrelsen og det maksimale antal samtidige opkald. SageMaker serverløs inferens tildeler automatisk computerressourcer proportionalt med den hukommelse, du vælger. Hvis du vælger en større hukommelsesstørrelse, har din container adgang til flere vCPU'er. Med serverløs slutning betaler du kun for den beregningskapacitet, der bruges til at behandle slutningsanmodninger, faktureret med millisekund, og mængden af behandlede data. Beregningsafgiften afhænger af den hukommelseskonfiguration, du vælger. De hukommelsesstørrelser, du kan vælge, er 1024 MB, 2048 MB, 3072 MB, 4096 MB, 5120 MB og 6144 MB. Prisen stiger med hukommelsesstørrelsen, som forklaret i Amazon SageMaker-priser, så det er vigtigt at vælge den korrekte hukommelsesstørrelse. Som en generel regel skal hukommelsesstørrelsen være mindst lige så stor som din modelstørrelse. Det er dog en god praksis at henvise til hukommelsesudnyttelse, når du beslutter endepunkthukommelsesstørrelsen, ud over selve modelstørrelsen.

Generel bedste praksis til optimering af SageMaker-udledningsomkostninger

Optimering af hostingomkostninger er ikke en engangsbegivenhed. Det er en kontinuerlig proces med at overvåge implementeret infrastruktur, brugsmønstre og ydeevne, og også holde et skarpt øje med nye innovative løsninger, som AWS udgiver, og som kan påvirke omkostningerne. Overvej følgende bedste praksis:

- Vælg en passende instanstype – SageMaker understøtter flere instanstyper, hver med forskellige kombinationer af CPU, GPU, hukommelse og lagerkapacitet. Baseret på din models ressourcekrav skal du vælge en instanstype, der giver de nødvendige ressourcer uden overprovisionering. For information om tilgængelige SageMaker-instanstyper, deres specifikationer og vejledning om valg af den rigtige instans, se Sørg for effektive computerressourcer på Amazon SageMaker.

- Test ved hjælp af lokal tilstand – For at opdage fejl og fejlfinde hurtigere, anbefales det at teste koden og beholderen (i tilfælde af BYOC) i Lokal tilstand før du kører inferensarbejdsbelastningen på den eksterne SageMaker-instans. Lokal tilstand er en fantastisk måde at teste dine scripts, før du kører dem i et SageMaker-administreret hostingmiljø.

- Optimer modeller for at være mere effektive – Uoptimerede modeller kan føre til længere køretider og bruge flere ressourcer. Du kan vælge at bruge flere eller større instanser til at forbedre ydeevnen; dette fører dog til højere omkostninger. Ved at optimere dine modeller, så de er mere effektive, kan du muligvis sænke omkostningerne ved at bruge færre eller mindre forekomster og samtidig bevare de samme eller bedre ydeevneegenskaber. Du kan bruge Amazon SageMaker Neo med SageMaker-inferens for automatisk at optimere modeller. For flere detaljer og prøver, se Optimer modellens ydeevne ved hjælp af Neo.

- Brug tags og omkostningsstyringsværktøjer – For at bevare overblik over dine inferensarbejdsbelastninger anbefales det at bruge tags samt AWS-omkostningsstyringsværktøjer som f.eks. AWS budgetter, AWS Billing-konsol, og prognosefunktionen i Cost Explorer. Du kan også udforske SageMaker Savings Plans som en fleksibel prismodel. For mere information om disse muligheder, se del 1 af denne serie.

Konklusion

I dette indlæg gav vi vejledning om omkostningsanalyse og bedste praksis ved brug af SageMaker-slutningsmuligheder. Da maskinlæring etablerer sig som et kraftfuldt værktøj på tværs af brancher, skal træning og drift af ML-modeller forblive omkostningseffektive. SageMaker tilbyder et bredt og dybt funktionssæt til at lette hvert trin i ML-pipelinen og giver muligheder for omkostningsoptimering uden at påvirke ydeevne eller smidighed. Kontakt dit AWS-team for at få vejledning om dine SageMaker-arbejdsbelastninger.

Om forfatterne

Deepali Rajale er Senior AI/ML Specialist hos AWS. Hun arbejder med virksomhedskunder, der giver teknisk vejledning med bedste praksis for implementering og vedligeholdelse af AI/ML-løsninger i AWS-økosystemet. Hun har arbejdet med en bred vifte af organisationer på forskellige deep learning use cases, der involverer NLP og computervision. Hun brænder for at give organisationer mulighed for at udnytte generativ AI til at forbedre deres brugsoplevelse. I sin fritid nyder hun film, musik og litteratur.

Deepali Rajale er Senior AI/ML Specialist hos AWS. Hun arbejder med virksomhedskunder, der giver teknisk vejledning med bedste praksis for implementering og vedligeholdelse af AI/ML-løsninger i AWS-økosystemet. Hun har arbejdet med en bred vifte af organisationer på forskellige deep learning use cases, der involverer NLP og computervision. Hun brænder for at give organisationer mulighed for at udnytte generativ AI til at forbedre deres brugsoplevelse. I sin fritid nyder hun film, musik og litteratur.

Uri Rosenberg er AI & ML Specialist Technical Manager for Europa, Mellemøsten og Afrika. Med base i Israel arbejder Uri på at give virksomhedskunder i stand til at designe, bygge og drive i stor skala, hvad angår ML. I sin fritid nyder han at cykle, vandre og klatring.

Uri Rosenberg er AI & ML Specialist Technical Manager for Europa, Mellemøsten og Afrika. Med base i Israel arbejder Uri på at give virksomhedskunder i stand til at designe, bygge og drive i stor skala, hvad angår ML. I sin fritid nyder han at cykle, vandre og klatring.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoAiStream. Web3 Data Intelligence. Viden forstærket. Adgang her.

- Udmøntning af fremtiden med Adryenn Ashley. Adgang her.

- Køb og sælg aktier i PRE-IPO-virksomheder med PREIPO®. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/part-5-analyze-amazon-sagemaker-spend-and-determine-cost-optimization-opportunities-based-on-usage-part-5-hosting/

- :har

- :er

- :ikke

- :hvor

- $OP

- 000

- 1

- 100

- 2021

- 24

- 30

- 40

- 500

- 7

- 8

- a

- I stand

- Om

- acceleratorer

- adgang

- Konto

- Konti

- opnå

- opnået

- tværs

- Handling

- aktioner

- tilføje

- Desuden

- Yderligere

- afrika

- Efter

- AI

- AI / ML

- algoritmer

- Alle

- allokering

- tillader

- allerede

- også

- Amazon

- Amazon EC2

- Amazon SageMaker

- Amazon Web Services

- beløb

- an

- analyse

- analysere

- ,

- En anden

- enhver

- længere

- api

- anvendt

- Indløs

- Anvendelse

- passende

- cirka

- ER

- kunstig

- kunstig intelligens

- Kunstig intelligens (AI)

- AS

- forbundet

- At

- vedhæfte

- forsøgt

- auto

- automatisk

- til rådighed

- undgå

- AWS

- tilbage

- baseret

- BE

- fordi

- været

- før

- jf. nedenstående

- gavnlig

- gavner det dig

- fordele

- BEDSTE

- bedste praksis

- Bedre

- Big

- større

- fakturerings- og

- Bloker

- Fordeling

- bringe

- bygge

- indbygget

- men

- by

- CAN

- kandidat

- kandidater

- kapaciteter

- Kapacitet

- tilfælde

- tilfælde

- vis

- Ændringer

- karakteristika

- afgift

- opladet

- afgifter

- valg

- Vælg

- vælge

- Classic

- Klatring

- Cluster

- kode

- forkølelse

- kombinationer

- kombinerer

- kombineret

- Kom

- kommer

- Fælles

- almindeligt

- fuldføre

- komponent

- komponenter

- Compute

- computer

- Computer Vision

- konkurrent

- Konfiguration

- træk

- Overvej

- overvejelser

- konsolidere

- konsoliderer

- forbruges

- forbrug

- Container

- Beholdere

- indeholder

- kontinuerlig

- Core

- korrigere

- Koste

- Omkostningsstyring

- omkostningseffektiv

- Omkostninger

- kunne

- skabe

- skabelse

- For øjeblikket

- skik

- Kunder

- dagligt

- data

- datasæt

- Dage

- beslutte

- Beslutter

- dyb

- dyb læring

- Standard

- Efterspørgsel

- afhænger

- indsætte

- indsat

- implementering

- implementering

- udruller

- Design

- konstrueret

- ønskes

- detail

- detaljer

- Bestem

- forskellige

- diskutere

- Skærm

- displays

- distribuere

- do

- Er ikke

- færdig

- Dont

- fordoble

- ned

- downloade

- grund

- i løbet af

- hver

- tidligere

- nemt

- Øst

- økosystem

- effektiv

- enten

- bemyndige

- bemyndigelse

- muliggøre

- muliggør

- Endpoint

- energi

- forbedre

- sikre

- Enterprise

- Miljø

- miljøer

- lige

- Ækvivalent

- fejl

- fejl

- indfører

- skøn

- Europa

- evaluere

- begivenhed

- eksempel

- overstige

- udveksling

- forventet

- erfaring

- eksperiment

- forklarede

- udforske

- opdagelsesrejsende

- ekstensivt

- ekstra

- øje

- faciliterende

- FAIL

- mislykkedes

- familie

- hurtigere

- Feature

- få

- færre

- File (Felt)

- Filer

- filtrere

- filtrering

- Filtre

- Fornavn

- passer

- fleksibel

- Fokus

- efter

- følger

- Til

- fundet

- fire

- fra

- fuld

- funktioner

- Endvidere

- Gevinst

- Generelt

- generere

- generative

- Generativ AI

- få

- given

- godt

- GPU

- grafer

- stor

- større

- gruppe

- vejledning

- Håndterer

- Have

- have

- he

- hjælpe

- hjulpet

- hende

- Høj

- højere

- højeste

- hans

- Vandret

- hostede

- Hosting

- hosting omkostninger

- værter

- time

- HOURS

- Hvordan

- How To

- Men

- HTML

- http

- HTTPS

- Hundreder

- i

- ideal

- identificere

- tomgang

- if

- KIMOs Succeshistorier

- påvirker

- vigtigt

- Forbedre

- in

- omfatter

- omfatter

- Herunder

- Stigninger

- angiver

- individuel

- industrier

- oplysninger

- Infrastruktur

- innovativ

- indgang

- indsigt

- instans

- anvisninger

- Intelligens

- interaktion

- internt

- ind

- Introduktion

- involverer

- israel

- IT

- ITS

- selv

- Job

- Karriere

- jpg

- Keen

- holde

- Nøgle

- Sprog

- stor

- større

- Efternavn

- Latency

- lancere

- lanceret

- føre

- Leads

- lærte

- læring

- mindst

- Lessons

- Erfaringer

- Niveau

- Leverage

- livscyklus

- ligesom

- Line (linje)

- forbundet

- Liste

- litteratur

- belastning

- lokale

- placering

- Lang

- længere

- Se

- Lav

- lavere

- Sænkning

- maskine

- machine learning

- vedligeholde

- Vedligeholdelse

- fastholder

- lave

- maerker

- administrere

- lykkedes

- ledelse

- styringsværktøjer

- leder

- manuelt

- Maps

- markeret

- Match

- maksimal

- Kan..

- midler

- Mød

- Hukommelse

- nævnte

- metrisk

- Metrics

- Mellemøsten

- Middle East

- måske

- minimum

- minutter

- ML

- tilstand

- model

- modeller

- Overvåg

- overvåges

- overvågning

- Måned

- månedligt

- måned

- mere

- Film

- Multi-model slutpunkt

- flere

- Musik

- skal

- navn

- navne

- nødvendig

- Behov

- behov

- behov

- netværk

- NETVÆRKSUDBRUD

- Ny

- NLP

- ingen

- underretning

- meddelelser

- nummer

- objekter

- opnå

- opnået

- of

- off

- Tilbud

- offline

- on

- ONE

- online

- kun

- betjene

- Muligheder

- optimal

- optimering

- Optimer

- optimering

- Option

- Indstillinger

- or

- ordrer

- organisationer

- Andet

- ud

- nedbrud

- skitseret

- output

- udestående

- i løbet af

- egen

- Parallel

- parameter

- parametre

- del

- passerer

- Passing

- lidenskabelige

- forbi

- Mønster

- mønstre

- Betal

- procentdel

- ydeevne

- periode

- periodisk

- perspektiv

- pick

- pipeline

- fly

- planer

- plato

- Platon Data Intelligence

- PlatoData

- politik

- eventuelt

- Indlæg

- Indlæg

- vigtigste

- praksis

- praksis

- Forudsigelser

- pris

- prissætning

- prisfastsættelsesmodel

- Proaktiv

- behandle

- Behandlet

- Processer

- forarbejdning

- processorer

- produktion

- Fremme

- give

- forudsat

- giver

- leverer

- bestemmelse

- formål

- Sætte

- forespørgsler

- rækkevidde

- Sats

- hellere

- nå

- Læsning

- ægte

- realtid

- modtage

- modtaget

- modtager

- anbefaler

- anbefalinger

- anbefales

- anbefaler

- optage

- optegnelser

- reducere

- region

- Udgivelser

- forblive

- fjern

- fjernet

- indberette

- Rapportering

- Rapporter

- anmode

- anmodninger

- påkrævet

- Krav

- ressource

- Ressourcer

- svar

- REST

- resultere

- Resultater

- afkast

- højre

- klippe

- Roll

- veje

- Herske

- regler

- Kør

- kører

- sagemaker

- SageMaker Inference

- samme

- Gem

- Besparelser

- Scale

- skalaer

- skalering

- scenarier

- planlagt

- ridse

- scripts

- sekunder

- sektioner

- se

- valgt

- udvælgelse

- senior

- sendt

- adskille

- Series

- Serverless

- tjeneste

- Tjenester

- servering

- sæt

- indstilling

- flere

- Shadow

- Del

- hun

- bør

- Vis

- viste

- vist

- Shows

- Tilsvarende

- Simpelt

- siden

- enkelt

- Størrelse

- størrelser

- Slice

- lille

- mindre

- So

- Løsninger

- nogle

- Kilde

- specialist

- specifikke

- specifikationer

- tilbringe

- delt

- stable

- standard

- starte

- påbegyndt

- Trin

- opbevaring

- opbevaret

- kraftigt

- struktureret

- succes

- vellykket

- Succesfuld

- sådan

- tilstrækkeligt

- egnede

- support

- støtte proaktivt

- Understøttet

- Understøtter

- systemet

- TAG

- Tag

- tager

- opgaver

- hold

- Teknisk

- prøve

- Test

- tests

- end

- at

- deres

- Them

- derefter

- Der.

- derved

- derfor

- Disse

- ting

- denne

- dem

- Gennem

- kapacitet

- tid

- gange

- til

- værktøj

- værktøjer

- emne

- I alt

- Trafik

- Kurser

- Transform

- transformers

- Tendenser

- sand

- vender

- typen

- typer

- underliggende

- I modsætning til

- uforudsigelige

- uploadet

- Brug

- brug

- brug tilfælde

- anvendte

- bruger

- ved brug af

- sædvanligvis

- Ved hjælp af

- VALIDATE

- værdi

- Værdier

- Variant

- forskellige

- Specifikation

- synlighed

- vision

- visualisering

- bind

- mængder

- vente

- ønsker

- Vej..

- we

- web

- webservices

- GODT

- Hvad

- hvornår

- hvorvidt

- som

- mens

- bred

- Bred rækkevidde

- vilje

- med

- inden for

- uden

- arbejdede

- arbejdstager

- arbejdere

- virker

- skrivning

- skriftlig

- Du

- Din

- zephyrnet

- nul